如何根据变量类型选择数据分析方法?

发表于 2014-09-02 22:48 来源:

面对大量数据,你将如何开展数据分析?您会选择什么样的数据分析方法呢?您是否看着数

据感到迷茫,无所适从。认真读完这篇文章,或许你将有所收获。

把握两个关键

1、抓住业务问题不放松。您费大力气收集数据的动机是什么?你想解决什么问题?这是核心,是方向,这是业务把握层面。

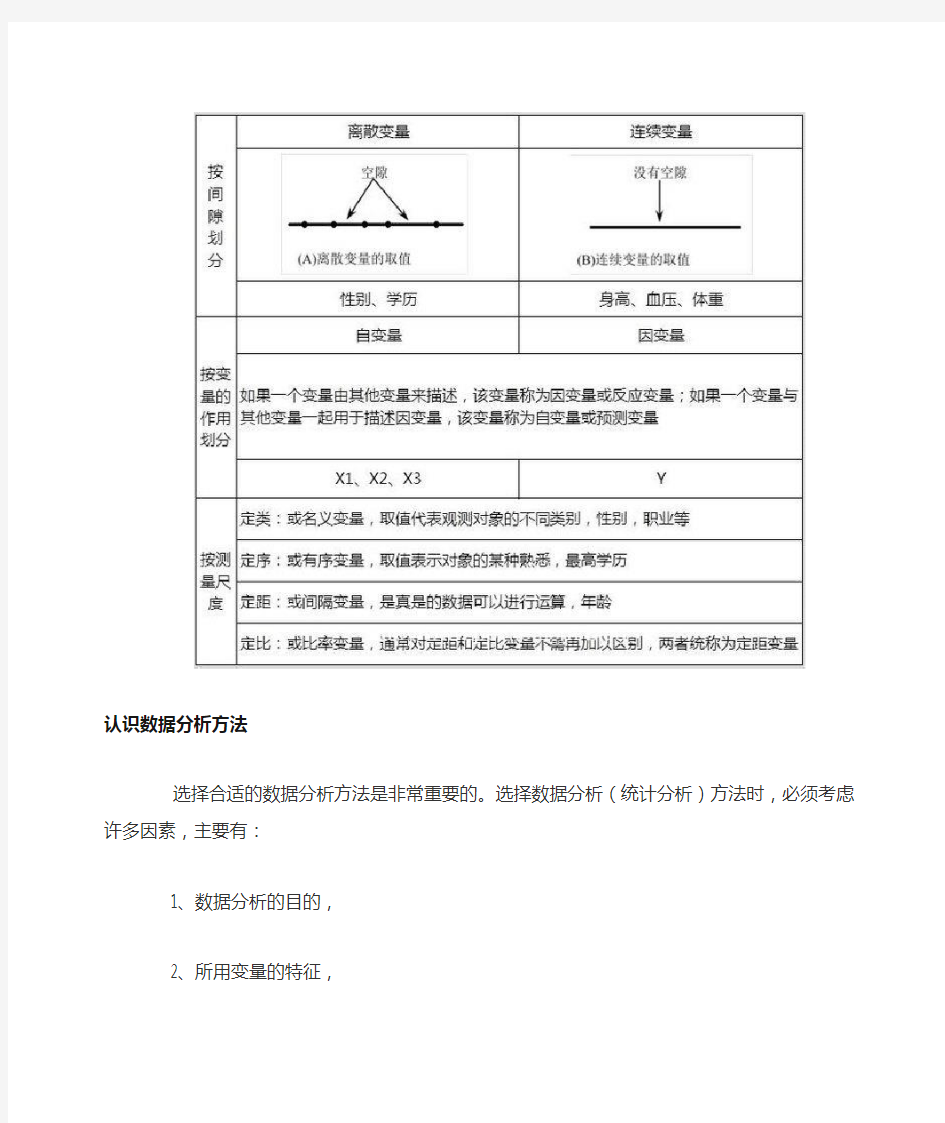

2、全面理解数据。哪些变量,什么类型?适合或者可以用什么统计方法,这是数据分析技术

层面。须把握三大关键:变量、数据分析方法、变量和方法的关联。

认识变量

认识数据分析方法

选择合适的数据分析方法是非常重要的。选择数据分析(统计分析)方法时,必须考虑许多因素,主要有:

1、数据分析的目的,

2、所用变量的特征,

3、对变量所作的假定,

4、数据的收集方法。选择统计分析方法时一般考虑前两个因素就足够了。

将变量与分析方法关联、对应起来

其一:

其二:

本篇资料主要参考自《实用现代统计分析方法及SPSS应用》

一、描述统计 描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率\回归法、决策树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数μ与已知的某一总体均数μ0 (常为理论值或标准值)有无差别; B 配对样本t检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似; C 两独立样本t检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。 适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。

A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析 检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、内在信度;每个量表是否测量到单一的概念,同时组成两表的内在体项一致性如何,常用方法分半信度。 四、列联表分析 用于分析离散变量或定型变量之间是否存在相关。 对于二维表,可进行卡方检验,对于三维表,可作Mentel-Hanszel分层分析。 列联表分析还包括配对计数资料的卡方检验、行列均为顺序变量的相关检验。 五、相关分析 研究现象之间是否存在某种依存关系,对具体有依存关系的现象探讨相关方向及相关程度。 1、单相关:两个因素之间的相关关系叫单相关,即研究时只涉及一个自变量和一个因变量; 2、复相关:三个或三个以上因素的相关关系叫复相关,即研究时涉及两个或两个以上的

毕业论文 题目多元回归分析中的变量选取 ——SPSS的应用 院(系)数学与统计学院 专业年级 2010级统计学 指导教师职称副教授

多元回归分析中的变量选取——SPSS的应用 殷婷 摘要 本文不仅对于复杂的统计计算通过常用的计算机应用软件SPSS来实现,同时通过对两组数据的实证分析,来研究统计学中多元回归分析中的变量选取,让大家对统计中的多元回归数据的选取和操作方法有更深层次的了解。一组数据是对于淘宝交易额的未来发展趋势的研究,一组数据时对于我国财政收入的研究。本文通过两个实证从不同程度上对数据选取的研究运用通俗的语言和浅显的描述将SPSS在多元回归分析中的统计分析方法呈现在大家面前,让大家对多元回归分析以及SPSS软件都可以有更深一步的了解。通过SPSS软件对数据进行分析,对数据进行处理的方法进行总结,找出SPSS对于数据处理和分析的优缺点,最后得在对变量的选取和软件的操作提出建议。 关键词:统计学 SPSS 变量的选取多元回归分析 Abstract

In this paper, not only for complex statistical calculations done by the commonly used computer application software of SPSS, through the empirical analysis of the two groups of data at the same time, to study the statistics of the variables in the multivariate regression analysis, let everybody to select multiple regression in statistical data and operation methods have a deeper understanding. Is a set of data for the future development trend of taobao transactions of research, a set of data for the research of our country's financial income. In this paper, through two empirical to select data from different extent research using a common language and plain the SPSS statistical analysis method in multiple regression analysis of present in front of everyone, let everyone to multiple regression analysis and SPSS software can have a deeper understanding. Through the SPSS software to analyze data, and summarizes method of data processing, find out the advantages and disadvantages of SPSS for data processing and analysis, finally had to put forward the proposal to the operation of the selection of variables and software. Keywords: Statistical SPSS The selection of variables multiple regression analysis 目录 摘要 (1) 英文摘要 (1) 引言 (3) 第一章回归分析 (3) 1.1自变量的选择 (4)

大数据分析的六大工具介绍 2016年12月 一、概述 来自传感器、购买交易记录、网络日志等的大量数据,通常是万亿或EB的大小,如此庞大的数据,寻找一个合适处理工具非常必要,今天我们为大家分学在大数据处理分析过程中六大最好用的工具。 我们的数据来自各个方面,在面对庞大而复杂的大数据,选择一个合适的处理工具显得很有必要,工欲善其事,必须利其器,一个好的工具不仅可以使我们的工作事半功倍,也可以让我们在竞争日益激烈的云计算时代,挖掘大数据价值,及时调整战略方向。 大数据是一个含义广泛的术语,是指数据集,如此庞大而复杂的,他们需要专门设il?的硬件和软件工具进行处理。该数据集通常是万亿或EB的大小。这些数据集收集自各种各样的来源:传感器、气候信息、公开的信息、如杂志、报纸、文章。大数据产生的其他例子包括购买交易记录、网络日志、病历、事监控、视频和图像档案、及大型电子商务。大数据分析是在研究大量的数据的过程中寻找模式, 相关性和其他有用的信息,可以帮助企业更好地适应变化,并做出更明智的决策。 二.第一种工具:Hadoop Hadoop是一个能够对大量数据进行分布式处理的软件框架。但是Hadoop是 以一种可黑、高效、可伸缩的方式进行处理的。Hadoop是可靠的,因为它假设计算元素和存储会失败,因此它维护多个工作数据副本,确保能够针对失败的节点重新分布处理。Hadoop 是高效的,因为它以并行的方式工作,通过并行处理加快处理速度。Hadoop还是可伸缩的,能够处理PB级数据。此外,Hadoop依赖于社区服务器,因此它的成本比较低,任何人都可以使用。

Hadoop是一个能够让用户轻松架构和使用的分布式计算平台。用户可以轻松地 在Hadoop上开发和运行处理海量数据的应用程序。它主要有以下儿个优点: ,高可黑性。Hadoop按位存储和处理数据的能力值得人们信赖。,高扩展性。Hadoop是 在可用的计?算机集簇间分配数据并完成讣算任务 的,这些集簇可以方便地扩展到数以千计的节点中。 ,高效性。Hadoop能够在节点之间动态地移动数据,并保证各个节点的动 态平衡,因此处理速度非常快。 ,高容错性。Hadoop能够自动保存数据的多个副本,并且能够自动将失败 的任务重新分配。 ,Hadoop带有用Java语言编写的框架,因此运行在Linux生产平台上是非 常理想的。Hadoop上的应用程序也可以使用其他语言编写,比如C++。 第二种工具:HPCC HPCC, High Performance Computing and Communications(高性能计?算与通信)的缩写° 1993年,山美国科学、工程、技术联邦协调理事会向国会提交了“重大挑战项 U:高性能计算与通信”的报告,也就是被称为HPCC计划的报告,即美国总统科学战略项U ,其U的是通过加强研究与开发解决一批重要的科学与技术挑战 问题。HPCC是美国实施信息高速公路而上实施的计?划,该计划的实施将耗资百亿 美元,其主要U标要达到:开发可扩展的计算系统及相关软件,以支持太位级网络 传输性能,开发千兆比特网络技术,扩展研究和教育机构及网络连接能力。

科研常用的实验数据分析与处理方法 对于每个科研工作者而言,对实验数据进行处理是在开始论文写作之前十分常见的工作之一。但是,常见的数据分析方法有哪些呢?常用的数据分析方法有:聚类分析、因子分析、相关分析、对应分析、回归分析、方差分析。 1、聚类分析(Cluster Analysis) 聚类分析指将物理或抽象对象的集合分组成为由类似的对象组成的多个类的分析过程。聚类是将数据分类到不同的类或者簇这样的一个过程,所以同一个簇中的对象有很大的相似性,而不同簇间的对象有很大的相异性。聚类分析是一种探索性的分析,在分类的过程中,人们不必事先给出一个分类的标准,聚类分析能够从样本数据出发,自动进行分类。聚类分析所使用方法的不同,常常会得到不同的结论。不同研究者对于同一组数据进行聚类分析,所得到的聚类数未必一致。 2、因子分析(Factor Analysis) 因子分析是指研究从变量群中提取共性因子的统计技术。因子分析就是从大量的数据中寻找内在的联系,减少决策的困难。因子分析的方法约有10多种,如重心法、影像分析法,最大似然解、最小平方法、阿尔发抽因法、拉奥典型抽因法等等。这些方法本质上大都属近似方法,是以相关系数矩阵为基础的,所不同的是相关系数矩阵对角线上的值,采用不同的共同性□2估值。在社会学研究中,因子分析常采用以主成分分析为基础的反覆法。

3、相关分析(Correlation Analysis) 相关分析(correlation analysis),相关分析是研究现象之间是否存在某种依存关系,并对具体有依存关系的现象探讨其相关方向以及相关程度。相关关系是一种非确定性的关系,例如,以X和Y 分别记一个人的身高和体重,或分别记每公顷施肥量与每公顷小麦产量,则X与Y显然有关系,而又没有确切到可由其中的一个去精确地决定另一个的程度,这就是相关关系。 4、对应分析(Correspondence Analysis) 对应分析(Correspondence analysis)也称关联分析、R-Q 型因子分析,通过分析由定性变量构成的交互汇总表来揭示变量间的联系。可以揭示同一变量的各个类别之间的差异,以及不同变量各个类别之间的对应关系。对应分析的基本思想是将一个联列表的行和列中各元素的比例结构以点的形式在较低维的空间中表示出来。 5、回归分析 研究一个随机变量Y对另一个(X)或一组(X1,X2,…,Xk)变量的相依关系的统计分析方法。回归分析(regression analysis)是确定两种或两种以上变数间相互依赖的定量关系的一种统计分析方法。运用十分广泛,回归分析按照涉及的自变量的多少,可分为一

数据存储 我们必须能够存储数据,对个人来讲至少应该掌握一种数据库技术,当然也不一定要熟练操作,但至少要能够理解数据的存储和数据的基本结构和数据类型,比如数据的安全性、唯一性、冗余性,表的关系,粒度,容量等,最好能够理解SQL查询语言的基本结构和读取等等! · Access2003、Access07等:这是最基本的个人数据库,经常用于个人或部分基本的数据存储; · MySQL数据库,这个对于部门级或者互联网的数据库应用是必要的,这个时候关键掌握数据库的库结构和SQL语言的数据查询能力; · SQL Server 2005或更高版本,对中小企业,一些大型企业也可以采用SQL Server数据库,其实这个时候本身除了数据存储,也包括了数据报表和数据分析了,甚至数据挖掘工具都在其中了; · DB2,Oracle数据库都是大型数据库了,主要是企业级,特别是大型企业或者对数据海量存储需求的就是必须的了,一般大型数据库公司都提供非常好的数据整合应用平台;· BI级,实际上这个不是数据库,而是建立在前面数据库基础上的,这个主要是数据库的企业应用级了,一般这个时候的数据库都叫数据仓库了,Data Warehouse,建立在DW级上的数据存储基本上都是商业智能平台,或许整合了各种数据分析,报表、分析和展现! 数据处理 数据挖掘与数据分析 这个层其实有很多分析工具,当然我们最常用的就是Excel,我经常用的就是统计分析和数据挖掘工具; · Excel软件,首先版本越高越好用这是肯定的;当然对Excel来讲很多人只是掌握了5%Excel功能,Excel功能非常强大,甚至可以完成所有的统计分析工作!但是我也常说,有能力把Excel玩成统计工具不如专门学会统计软件; · SPSS软件:当前版本是18,名字也改成了PASW Statistics;我从3.0开始Dos环境下编程分析,到现在版本的变迁也可以看出SPSS社会科学统计软件包的变化,从重视医学、化学等开始越来越重视商业分析,现在已经成为了预测分析软件。 · Clementine软件:当前版本13.0,数据挖掘工具,我从6.0开始用,到了13版,已经越来越多的提高了更多有好的建模工具,现在改名叫PASW Modeler 13建模器了。而且与SPSS统计功能有了更多的整合,数据处理也更加灵活和好用。 · SAS软件:SAS相对SPSS其实功能更强大,SAS是平台化的,EM挖掘模块平台整合,相对来讲,SAS比较难学些,但如果掌握了SAS会更有价值,比如离散选择模型,抽样问题,正交实验设计等还是SAS比较好用,另外,SAS的学习材料比较多,也公开,会有收获的!

各种分布 泊松分布 Poisson分布,是一种统计与概率学里常见到的离散概率分布。 泊松分布的概率函数为: 泊松分布的参数λ是单位时间(或单位面积、单位体积)内随机事件的平均发生率。泊松分布适合于描述单位时间内随机事件发生的次数。 泊松分布的期望和方差均为 特征函数为: 泊松分布与二项分布 当二项分布的n很大而p很小时,泊松分布可作为二项分布的近似,其中λ为np。通常当n≧10,p≦0.1时,就可以用泊松公式近似得计算。 事实上,泊松分布正是由二项分布推导而来的。 泊松分布可作为二项分布的极限而得到。一般的说,若 ,其中n很大, p很小,因而不太大时,X的分布接近于泊松分布。这个事实有时可将较难计算的二项分布转化为泊松分布去计算。 应用示例 泊松分布适合于描述单位时间(或空间)内随机事件发生的次数。如某一服务设施在一定时间内到达的人数,电话交换机接到呼叫的次数,汽车站台的候客人数,某放射性物质发射出的粒子,机器出现的故障数,自然灾害发生的次数,一块产品上的缺陷数,显微镜下单位分区内的细菌分布数等等。 卡方分布 卡方分布( 分布)是概率论与统计学中常用的一种概率分布。n 个独立的标准

正态分布变量的平方和服从自由度为n 的卡方分布。卡方分布常用于假设检验和置信区间的计算。 若n个相互独立的随机变量ξ?、ξ?、……、ξn ,均服从标准正态分布(也称独立同分布于标准正态分布),则这n个服从标准正态分布的随机变量的平方和构成 一新的随机变量,其分布规律称为卡方分布(chi-square distribution),即分布(chi-square distribution),其中参数n称为自由度。正如正态分布中均值或方差不同就是另一个正态分布一样,自由度不同就是另一个分布。记为或者。 卡方分布与正态分布 卡方分布是由正态分布构造而成的一个新的分布,当自由度n很大时,分布 近似为正态分布。对于任意正整数x,自由度为 k的卡方分布是一个随机变量X 的机率分布。 期望和方差 分布的均值为自由度n,记为E( ) = n。分布的方差为2倍的自由度(2n),记为D( ) = 2n。 均匀分布 均匀分布(Uniform Distribution)是概率统计中的重要分布之一。 顾名思义,均匀,表示可能性相等的含义。 (1) 如果,则称X服从离散的均匀分布。 (2) 设连续型随机变量X的概率密度函数为,则称随机变

数据分析必备|你不得不知道的11款数据分析工具 毋庸置疑,大数据市场是一座待挖掘的金矿。随着数据使用量的增长,将有更多的人通过数据来寻求专业问题的答案。可视化数据分析工具的出现让人们可以通过将数据可视化来探讨问题、揭示洞见,用数据分享故事。甚至于不懂挖掘算法的人员,也能够为用户进行画像。 BI(BusinessIntelligence)即商业智能,越来越多的智能软件供应商推出可视化数据分析工具,应对企业业务人员的大数据分析需求。然而如果你觉得不是数据分析专业、没有挖掘算法基础就无法使用BI工具?NO,自助式分析工具已经让数据产品链条变得大众化,。为了更好地帮助读者选择分析工具,本文将为介绍数说立方、数据观、魔镜等11款BI-商业智能产品,排名不分先后! 功能列表

详细介绍 数说立方 数说立方是数说故事新推出的一款面向数据分析师的在线商业智能产品。最重要的特点是配备百亿级社交数据库,同时支持全网公开数据实时抓取,从数据源端解决分析师难点;另外数说立方搭载了分布式搜索、语义分析、数据可视化三大引擎系统的海量计算平台,实现数据处理“探索式 分析”和“秒级响应”的两个核心功能。同时数说立方是数说故事三大主打产品之一,并与其他两大产品数说聚合和数说雷达实现从数据源、数据分析、到数据展示完整的数据解决方案。 优点: 即便是个人免费版,体验和功能仍然非常好; 与自家产品“数说聚合”的无缝接入,支持定向抓取微信、微博等数据; 功能完善,集数据处理、特征工程、建模、文本挖掘为一体的机器学习平台; 可视化视图展现、友好的客户感知页面; 支持SAAS,私有化部署,有权限管理; 缺点: 产品新上市,操作指导页不太完善; 体验过程中有一些小bug;

一、描述统计描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率回归法、决策 树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W 检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数卩与已知的某一总体均数卩0 (常为理论值或标准值)有无差别; B 配对样本t 检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似; C 两独立样本t 检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。 适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。 A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10 以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、内在信度;每个量表是否测量到单一的概念,同时组成两表的内在体项一致性如何,常用方法分半信度。 四、列联表分析用于分析离散变量或定型变量之间是否存在相关。对于二维表,可进行卡 方检验,对于三维表,可作Mentel-Hanszel 分层分析列联表分析还包括配对计数资料的卡方检验、行列均为顺序变量的相关检验。 五、相关分析 研究现象之间是否存在某种依存关系,对具体有依存关系的现象探讨相关方向及相关程度。 1、单相关:两个因素之间的相关关系叫单相关,即研究时只涉及一个自变量和一个因变量; 2、复相关:三个或三个以上因素的相关关系叫复相关,即研究时涉及两个或两个以

以下是我在近三年做各类计量和统计分析过程中感受最深的东西,或能对大家有所帮助。当然,它不是ABC的教程,也不是细致的数据分析方法介绍,它只是“总结”和“体会”。由于我所学所做均甚杂,我也不是学统计、数学出身的,故本文没有主线,只有碎片,且文中内容仅为个人观点,许多论断没有数学证明,望统计、计量大牛轻拍。 于我个人而言,所用的数据分析软件包括EXCEL、SPSS、STATA、EVIEWS。在分析前期可以使用EXCEL进行数据清洗、数据结构调整、复杂的新变量计算(包括逻辑计算);在后期呈现美观的图表时,它的制图制表功能更是无可取代的利器;但需要说明的是,EXCEL毕竟只是办公软件,它的作用大多局限在对数据本身进行的操作,而非复杂的统计和计量分析,而且,当样本量达到“万”以上级别时,EXCEL的运行速度有时会让人抓狂。 SPSS是擅长于处理截面数据的傻瓜统计软件。首先,它是专业的统计软件,对“万”甚至“十万”样本量级别的数据集都能应付自如;其次,它是统计软件而非专业的计量软件,因此它的强项在于数据清洗、描述统计、假设检验(T、F、卡方、方差齐性、正态性、信效度等检验)、多元统计分析(因子、聚类、判别、偏相关等)和一些常用的计量分析(初、中级计量教科书里提到的计量分析基本都能实现),对于复杂的、前沿的计量分析无能为力;第三,SPSS主要用于分析截面数据,在时序和面板数据处理方面功能了了;最后,SPSS兼容菜单化和编程化操作,是名副其实的傻瓜软件。 STATA与EVIEWS都是我偏好的计量软件。前者完全编程化操作,后者兼容菜单化和编程化操作;虽然两款软件都能做简单的描述统计,但是较之 SPSS差了许多;STATA与EVIEWS都是计量软件,高级的计量分析能够在这两个软件里得到实现;STATA的扩展性较好,我们可以上网找自己需要的命令文件(.ado文件),不断扩展其应用,但EVIEWS 就只能等着软件升级了;另外,对于时序数据的处理,EVIEWS较强。 综上,各款软件有自己的强项和弱项,用什么软件取决于数据本身的属性及分析方法。EXCEL适用于处理小样本数据,SPSS、 STATA、EVIEWS可以处理较大的样本;EXCEL、SPSS适合做数据清洗、新变量计算等分析前准备性工作,而STATA、EVIEWS在这方面较差;制图制表用EXCEL;对截面数据进行统计分析用SPSS,简单的计量分析SPSS、STATA、EVIEWS可以实现,高级的计量分析用 STATA、EVIEWS,时序分析用EVIEWS。 关于因果性 做统计或计量,我认为最难也最头疼的就是进行因果性判断。假如你有A、B两个变量的数据,你怎么知道哪个变量是因(自变量),哪个变量是果(因变量)? 早期,人们通过观察原因和结果之间的表面联系进行因果推论,比如恒常会合、时间顺序。但是,人们渐渐认识到多次的共同出现和共同缺失可能是因果关系,也可能是由共同的原因或其他因素造成的。从归纳法的角度来说,如果在有A的情形下出现B,没有A的情形下就没有B,那么A很可能是B的原因,但也可能是其他未能预料到的因素在起作用,所以,在进行因果判断时应对大量的事例进行比较,以便提高判断的可靠性。 有两种解决因果问题的方案:统计的解决方案和科学的解决方案。统计的解决方案主要指运用统计和计量回归的方法对微观数据进行分析,比较受干预样本与未接受干预样本在效果指标(因变量)上的差异。需要强调的是,利用截面数据进行统计分析,不论是进行均值比较、频数分析,还是方差分析、相关分析,其结果只是干预与影响效果之间因果关系成立的必要条件而非充分条件。类似的,利用截面数据进行计量回归,所能得到的最多也只是变量间的数量关系;计量模型中哪个变量为因变量哪个变量为自变量,完全出于分析者根据其他考虑进行的预设,与计量分析结果没有关系。总之,回归并不意味着因果关系的成立,因果关系的判定或推断必须依据经过实践检验的相关理论。虽然利用截面数据进行因果判断显得勉强,但如果研究者掌握了时间序列数据,因果判断仍有可为,其

常用的数理统计及数据处理方法 水泥厂生产中的质量控制和分析都是以数据为基础的技术活动。如果没有数据的定量分析,就无法形成明确的质量概念。因此,必须通过对大量数据的整理和分析,才能发现事物的规律性和生产中存在的问题,进而作出正确的判断并提出解决的方法。 第一节数理统计的有关概念 一、个体、母体与子样 在统计分析中,构成研究对象的每一个最基本的单位称为个体。 研究对象的所有个体的集合即全部个体称为母体或总体,它可以无限大,也可以是有限的,如一道工序或一批产品、半成品、成品,可根据需要加以选择。 进行统计分析,通常是从母体中随机地选择一部分样品,称为子样(又称样本)。用它来代表母体进行观察、研究、检验、分析,取得数据后加以整理,得出结论。取样只要是随机和足够的数量,则所得结论能近似地反映母体的客观实际。抽取样本的过程被称作抽样;依据对样本的检测或观察结果去推断总体状况,就是所谓的统计推断,也叫判断。 例如,我们可将一个编号水泥看成是母体,每一包水泥看成是个体,通过随机取样(连续取样或从20个以上不同部位取样),所取出的12kg检验样品可称为子样,通过检验分析,即可判断该编号水泥(母体)的质量状况。 二、数据、计量值与计数值 1,数据 通过测试或调查母体所得的数字或符号记录,称为数据。在水泥生产中,无任对原材料、半成品、成品的检验,还是水泥的出厂销售,都要遇到很多报表和数据,特别是评定水泥质量好坏时,更要拿出检验数据来说明,所以可用与质量有关的数据来反映产品质量的特征。 根据数据本身的特征、测试对象和数据来源的不同,质量检验数据可分为计量值和计算值两类。 2,计量值 凡具有连续性或可以利用各种计量分析一起、量具测出的数据。如长度、质量、温度、化学成分、强度等,多属于计量值数据。计量值也可以是整数,也可以是小数,具有连续性。

大数据处理分析的六大最好工具 来自传感器、购买交易记录、网络日志等的大量数据,通常是万亿或EB的大小,如此庞大的数据,寻找一个合适处理工具非常必要,今天我们为大家分享在大数据处理分析过程中六大最好用的工具。 【编者按】我们的数据来自各个方面,在面对庞大而复杂的大数据,选择一个合适的处理工具显得很有必要,工欲善其事,必须利其器,一个好的工具不仅可以使我们的工作事半功倍,也可以让我们在竞争日益激烈的云计算时代,挖掘大数据价值,及时调整战略方向。本文转载自中国大数据网。 CSDN推荐:欢迎免费订阅《Hadoop与大数据周刊》获取更多Hadoop技术文献、大数据技术分析、企业实战经验,生态圈发展趋势。 以下为原文: 大数据是一个含义广泛的术语,是指数据集,如此庞大而复杂的,他们需要专门设计的硬件和软件工具进行处理。该数据集通常是万亿或EB的大小。这些数据集收集自各种各样的来源:传感器、气候信息、公开的信息、如杂志、报纸、文章。大数据产生的其他例子包括购买交易记录、网络日志、病历、事监控、视频和图像档案、及大型电子商务。大数据分析是在研究大量的数据的过程中寻找模式,相关性和其他有用的信息,可以帮助企业更好地适应变化,并做出更明智的决策。 Hadoop Hadoop 是一个能够对大量数据进行分布式处理的软件框架。但是Hadoop 是以一种可靠、高效、可伸缩的方式进行处理的。Hadoop 是可靠的,因为它假设计算元素和存储会失败,因此它维护多个工作数据副本,确保能够针对失败的节点重新分布处理。Hadoop 是高效的,因为它以并行的方式工作,通过并行处理加快处理速度。Hadoop 还是可伸缩的,能够处理PB 级数据。此外,Hadoop 依赖于社区服务器,因此它的成本比较低,任何人都可以使用。

50个大数据可视化分析工具 在大数据时代,数据可视化工具必须具有以下特性: (1)实时性:数据可视化工具必须适应大数据时代数据量的爆炸式增长需求,必须快速的收集分析数据、并对数据信息进行实时更新; (2)简单操作:数据可视化工具满足快速开发、易于操作的特性,能满足互联网时代信息多变的特点; (3)更丰富的展现:数据可视化工具需具有更丰富的展现方式,能充分满足数据展现的多维度要求; (4)多种数据集成支持方式:数据的来源不仅仅局限于数据库,数据可视化工具将支持团队协作数据、数据仓库、文本等多种方式,并能够通过互联网进行展现。 Excel 是快速分析数据的理想工具,也能创建供内部使用的数据图,但在颜色、线条和样式上可选择的范围有限。 Google Charts 提供了大量现成的图表类型,从简单的线图表到复杂的分层树地图等,还内置了动画和用户交互控制。 D3 能够提供大量线性图和条形图之外的复杂图表样式,例如V oronoi图、树形图、圆形集群和单词云等。 R语言 是主要用于统计分析、绘图的语言和操作环境。 Visual.ly 如果你需要制作信息图而不仅仅是数据可视化,Visual.ly是最流行的一个选择。

Processing 是数据可视化的招牌工具,只需要编写一些简单的代码,然后编译成Java,可在几乎所有平台上运行。 Leaflet 用来开发移动友好地交互地图。 OpenLayers 对于一些特定的任务来说,能够提供一些其他地图库都没有的特殊工具。 Polymaps 是一个地图库,主要面向数据可视化用户。可以将符号字体与字体整合,创建出漂亮的矢量化图标。 Gephi 是一个可视化的网络探索平台,用于构建动态的、分层的数据图表。 可以用CartoDB很轻易就把表格数据和地图关联起来。 Weka是数据分析的强大工具,还能生成一些简单的图表。 NodeBox是OS X上创建二维图形和可视化的应用程序。 Kartograph不需要任何地图提供者像Google Maps,用来建立互动式地图。 Modest Maps在一些扩展库的配合下,例如Wax,Modest Maps立刻会变成一个强大的地图工具。 Tangle是个用来探索、Play和查看文档更新的交互式库。既是图表,又是互动图形用户界面的小程序。当你调整一个图表中的输入范围时,其他关联图表的数据也会随之改变。 Rapha憀与其他库最大的不同是输出格式仅限SVG和VML。 jsDraw2DX用来创建任意类型的SVG交互式图形,可生成包括线、举行、多边形、椭圆、弧线等等图形。 Pizza Pie Charts是个响应式饼图图表。 FusionCharts XT是一款跨平台、跨浏览器的JavaScript图表组件,可提供令人愉悦的JavaScript图表体验。 iCharts有交互元素,可以从Google Doc、Excel 表单和其他来源中获取数据。

常用数据分析方法详解 目录 1、历史分析法 2、全店框架分析法 3、价格带分析法 4、三维分析法 5、增长率分析法 6、销售预测方法 1、历史分析法的概念及分类 历史分析法指将与分析期间相对应的历史同期或上期数据进行收集并对比,目的是通过数据的共性查找目前问题并确定将来变化的趋势。 *同期比较法:月度比较、季度比较、年度比较 *上期比较法:时段比较、日别对比、周间比较、 月度比较、季度比较、年度比较 历史分析法的指标 *指标名称: 销售数量、销售额、销售毛利、毛利率、贡献度、交叉比率、销售占比、客单价、客流量、经营品数动销率、无销售单品数、库存数量、库存金额、人效、坪效 *指标分类: 时间分类 ——时段、单日、周间、月度、季度、年度、任意 多个时段期间 性质分类 ——大类、中类、小类、单品 图例 2框架分析法 又叫全店诊断分析法 销量排序后,如出现50/50、40/60等情况,就是什么都能卖一点但什么都不 好卖的状况,这个时候就要对品类设置进行增加或删减,因为你的门店缺少 重点,缺少吸引顾客的东西。 如果达到10/90,也是品类出了问题。 如果是20/80或30/70、30/80,则需要改变的是商品的单品。 *单品ABC分析(PSI值的概念) 销售额权重(0.4)×单品销售额占类别比+销售数量权重(0.3) × 单品销售数量占类别比+毛利额权重(0.3)单品毛利额占类别比 *类别占比分析(大类、中类、小类) 类别销售额占比、类别毛利额占比、 类别库存数量占比、类别库存金额占比、

类别来客数占比、类别货架列占比 表格例 3价格带及销售二维分析法 首先对分析的商品按价格由低到高进行排序,然后 *指标类型:单品价格、销售额、销售数量、毛利额 *价格带曲线分布图 *价格带与销售对数图 价格带及销售数据表格 价格带分析法 4商品结构三维分析法 *一种分析商品结构是否健康、平衡的方法叫做三维分析图。在三维空间坐标上以X、Y、Z 三个坐标轴分别表示品类销售占有率、销售成长率及利润率,每个坐标又分为高、低两段,这样就得到了8种可能的位置。 *如果卖场大多数商品处于1、2、3、4的位置上,就可以认为商品结构已经达到最佳状态。以为任何一个商品的品类销售占比率、销售成长率及利润率随着其商品生命周期的变化都会有一个由低到高又转低的过程,不可能要求所有的商品同时达到最好的状态,即使达到也不可能持久。因此卖场要求的商品结构必然包括:目前虽不能获利但具有发展潜力以后将成为销售主力的新商品、目前已经达到高占有率、高成长率及高利润率的商品、目前虽保持较高利润率但成长率、占有率趋于下降的维持性商品,以及已经决定淘汰、逐步收缩的衰退型商品。 *指标值高低的分界可以用平均值或者计划值。 图例 5商品周期增长率分析法 就是将一段时期的销售增长率与时间增长率的比值来判断商品所处生命周期阶段的方法。不同比值下商品所处的生命周期阶段(表示) 如何利用商品生命周期理论指导营运(图示) 6销售预测方法[/hide] 1.jpg (67.5 KB) 1、历史分析法

课程设计(论文) 课程名称:应用回归分析 设计题目:自变量的选择 院系:数学与统计学院 专业:概率论与数理统计 设计者:沈铁 学号: 12012000819

自变量选择 一.自变量选择概述 在应用回归分析去处理实际问题时,回归自变量选择是首先要解决的重要问题。通常,在做回归分析时,人们根据所研究问题的目的,结合经济理论罗列出对因变量可能有影响的的一些因素作为自变量引进回归模型,其结果是把一些对因变量影响很小的,有些甚至没有影响的自变量也选入了回归模型中,这样一来,不但计算量变大,而且估计和预测的精度也会下降。此外,如果遗漏了某些重要变量,回归方程的效果肯定不好。在一些情况下,某些自变量的观测数据的获得代价昂贵,如果这些自变量本身对因变量的影响很小或根本没有影响,我们不加选择的引进回归模型,势必造成观测数据收集和模型应用的费用不必要的加大。因此,在应用回归分析中,对进入模型的自变量作精心的选择是十分必要的。 在多元线性回归模型中,自变量的选择实质上就是模型的选择。现设一切可供选择的变量是t 个 ,它们组成的回归模型称为全模型(记:1+=t m ),在获得n 组观测数据后,我们有模型 ???+=),0(~2 n n I N X Y σεε β 其中:Y 是1?n 的观测值,β是1?m 未知参数向量,X 是m n ?结构矩阵,并假定X 的秩为m 。 现从 t x x x ,,,21 这t 个变量中选t '变量,不妨设 t x x x ' ,,,21 ,那么对全模型

中的参数β和结构矩阵X 可作如下的分块(记:1+'=t p ): ()' =q p βββ,, () q p X X X = 我们称下面的回归模型为选模型: ?? ?+=),0(~2n p p I N X Y σεε β 其中:Y 是1?n 的观测值,p β是1?p 未知参数向量, p X 是p n ?结构矩阵, 并假定 p X 的秩为p 。 自变量的选择可以看成是这样的两个问题,一是究竟是用全模型还是用选模型,二是若用选模型,则究竟应包含多少变量最适合。如果全模型为真,而我们用了选模型,这就表示在方程中丢掉了部分有用变量,相反,如果选模型为真,而我们选用了全模型,这就表示在方程中引入了一些无用变量,下面从参数估计和预测两个角度来看一看由于模型选择不当带来的后果。 为了讨论方便起见,先引入几个记号: 全模型中参数2 ,σβ的估计: 1?()'X X X Y β-'= 211 ?[()]()Y I X X X X Y n R X σ -'''=-- 其中:)(X R 为矩阵X 的秩。 在点 )(1' =t x x x 点上的预测值为??y x β'= 在选模型中参数2 ,σβ的估计: 121()1 [()]() p p p p p p p p p p X X X Y Y I X X X X Y n R X βσ--''=''= --

云计算大数据的55个最实用 可视化分析工具 近年来,随着云和大数据时代的来临,数据可视化产品已经不再满足于使用传统的数据可视化工具来对数据仓库中的数据抽取、归纳并简单的展现。传统的数据可视化工具仅仅将数据加以组合,通过不同的展现方式提供给用户,用于发现数据之间的关联信息。新型的数据可视化产品必须满足互联网爆发的大数据需求,必须快速的收集、筛选、分析、归纳、展现决策者所需要的信息,并根据新增的数据进行实时更新。因此,在大数据时代,数据可视化工具必须具有以下特性: (1)实时性:数据可视化工具必须适应大数据时代数据量的爆炸式增长需求,必须快速的收集分析数据、并对数据信息进行实时更新; (2)简单操作:数据可视化工具满足快速开发、易于操作的特性,能满足互联网时代信息多变的特点; (3)更丰富的展现:数据可视化工具需具有更丰富的展现方式,能充分满足数据展现的多维度要求; (4)多种数据集成支持方式:数据的来源不仅仅局限于数据库,数据可视化工具将支持团队协作数据、数据仓库、文本等多种方式,并能够通过互联网进行展现。

为了进一步让大家了解如何选择适合的数据可视化产品,本文将围绕这一话题展开,希望能对正在选型中的企业有所帮助。下面就来看看全球备受欢迎的的可视化工具都有哪些吧! 1.Excel Excel作为一个入门级工具,是快速分析数据的理想工具,也能创建供内部使用的数据图,但是Excel在颜色、线条和样式上课选择的范围有限,这也意味着用Excel很难制作出能符合专业出版物和网站需要的数据图。 2.Google Chart API Google Chart提供了一种非常完美的方式来可视化数据,提供了大量现成的图标类型,从简单的线图表到复杂的分层树地图等。它还内置了动画和用户交互控制。 3.D3 D3(Data Driven Documents)是支持SVG渲染的另一种JavaScript库。但是D3能够提供大量线性图和条形图之外的复杂图表样式,例如Voronoi图、树形图、圆形集群和单词云等。 4.R

常用数据分析方法论 ——摘自《谁说菜鸟不会数据分析》 数据分析方法论主要用来指导数据分析师进行一次完整的数据分析,它更多的是指数据分析思路,比如主要从哪几方面开展数据分析?各方面包含什么内容和指标? 数据分析方法论主要有以下几个作用: ●理顺分析思路,确保数据分析结构体系化 ●把问题分解成相关联的部分,并显示它们之间的关系 ●为后续数据分析的开展指引方向 ●确保分析结果的有效性及正确性 常用的数据分析理论模型 营销方面管理方面 4P 用户使用行为STP理论 SWOT …… PEST 5W2H 时间管理生命周期 逻辑树 金字塔SMART原则 …… PEST分析法 PEST分析理论主要用于行业分析 PEST分析法用于对宏观环境的分析。宏观环境又称一般环境,是指影响一切行业和企业的各种宏观力量。 对宏观环境因素作分析时,由于不同行业和企业有其自身特点和经营需要,分析的具体内容会有差异,但一般都应对政治、经济、技术、社会,这四大类影响企业的主要外部环境因素进行分析。

以下以中国互联网行业分析为例。此处仅为方法是用实力,并不代表互联网行业分析只需要作这几方面的分析,还可根据实际情况进一步调整和细化相关分析指标:

5W2H分析法 5W2H分析理论的用途广泛,可用于用户行为分析、业务问题专题分析等。 利用5W2H分析法列出对用户购买行为的分析:(这里的例子并不代表用户购买行为只有以下所示,要做到具体问题具体分析)

逻辑树分析法 逻辑树分析理论课用于业务问题专题分析 逻辑树又称问题树、演绎树或分解树等。逻辑树是分析问题最常使用的工具之一,它将问题的所有子问题分层罗列,从最高层开始,并逐步向下扩展。 把一个已知问题当成树干,然后开始考虑这个问题和哪些相关问题有关。 (缺点:逻辑树分析法涉及的相关问题可能有遗漏。)

大数据分析软件?安徽象形信息科技专注于大数据分析领域,依托革命性的技术创新,产品远超国内外先进水平,已发展成为国内大数据分析产品领域的领导企业。公司以技术创新为核心战略,与中国科学技术大学成立大数据联合实验室,有效的把创新机制融入到科研、开发、生产和经营的各个环节。目前,已经与中软国际、天源迪科、神州数码、浪潮集团等多家知名企业形成了深入合作。 合肥卷烟厂打造大数据精益管理智能平台 2014年,合肥卷烟厂利用大数据分析软件ETHINK大数据平台技术,打造了大数据精益管理智能平台,深度分析“口袋”里的信息。他们将设备信息、生产信息、质量信息、能源消耗、成本数据等进行融合整理,形成了大数据的高效集成。 以该平台健康诊断云图为例,合肥卷烟厂围绕生产、设备、质量三个维度,利用专家法、层次分析法,设置各项数据彼此间的函数关系,计算出生产、设备、质量每天的分数。将不达标的关键单项指标产生告警,追踪问题缘由,指导问题解决,及时对问

题进行动态优化,并进行自我组织调整。 卷烟厂的大数据智能平台还包含决策管控、智慧社区等几个模块。在车间级管理上,平台可以按照需求,形成智能报表。卷烟厂智能检索知识库包含了经验库、说明书、OPS改善等企业知识成果,员工在遇到难题时可查阅信息,做到了企业知识成果的共享与交流,实现了员工能力提升的目的。 大数据分析软件?ETHINK是业界唯一的端到端的hadoop、spark平台上的大数据分析基础平台。我们的目标是简化大数据分析的过程,让人人都能够快速从数据获得决策智慧。您不再需要采用很多的数据集成、数据清洗、数据预处理、数据分析、数据挖掘、数据可视化、数据报告等众多的工具。ETHINK是一个集成性的平台,能够将您所有的数据,加载到hadoop,spark平台,并能够可视化您的数据,挖掘您的数据的高效平台。