第9卷 第7期2004年7月

中国图象图形学报Journal of Image and G raphics

V ol.9,N o.7July 2004

基金项目:国家“863”计划资助项目(编号:2001AA422200)收稿日期:2004201213;改回日期:2004204206

基于路径识别的移动机器人视觉导航

张海波 原 魁 周庆瑞

(中国科学院自动化研究所高技术创新中心,北京 100080)

摘 要 跟随路径导引是自主式移动机器人广泛采用的一种导航方式,其中视觉导航具有其他传感器导航方式所无法比拟的优点,是移动机器人智能导航的主要发展方向。为了提高移动机器人视觉导航的实时性和准确性,提出了一个基于路径识别的视觉导航系统,其基本思想是首先用基于变分辨率的采样二值化和形态学去噪方法从原始场景图像中提取出目标支持点集,然后用一种改进的哈夫变化检测出场景中的路径,最后由路径跟踪模块分直行和转弯两种情况进行导航计算。实验结果表明,该视觉导航系统具有较好的实时性和准确性。关键词 自主式移动机器人 视觉导航 路径识别

中图法分类号:TP242.62 文献标识码:A 文章编号:100628961(2004)0720853205

Visual N avigation of a Mobile R obot B ased on P ath R ecognition

ZH ANG Hai 2bo ,Y UAN K ui ,ZH OU Qing 2rui

(Hi 2tech Innovation Centre ,Institute o f Automation ,Chinese Academy o f Sciences ,Beijing 100080)

Abctract G uidance using path following is widely applied in the field of autonom ous m obile robots.C om pared with the navigation system without vision ,visual navigation has obvious advantages as rich in formation ,low cost ,quietness ,innocuity ,etc.This pa 2per describes a navigation system which uses the visual in formation provided by guide lines and color signs.In our approach ,the visual navigation is com posed of three main m odules :image 2preprocessing ,path 2recognition and path 2tracking.First ,image 2pre 2processing m odule formulates color m odels of all kinds of objects ,and establishes each object ’s support through adaptive subsam 2pling 2based binarization and mathematical m orphology.Second ,path 2recognition m odule detects the guide lines through an im 2proved H ough trans form alg orithm ,and the detected results including guide lines and color signs integrate the path in formation.Fi 2nally ,calling different functions according to the m ovement of straight 2g oing or turning ,path 2tracking m odule provides required in 2put parameters to m otor controller and steering controller.The experimental results dem onstrate the effectiveness and the robustness of our approach.

K eyw ords com puter perception ,autonom ous m obile robot ,visual navigation ,path recognition

1 引 言

导航技术是移动机器人的一项核心技术,其难

度远远超出人们最初的设想,其主要原因有:一是环境的动态变化和不可预测;二是机器人感知手段的不完备,即很多情况下传感器给出的数据是不完全、不连续、不可靠的[1]。这些原因使得机器人系统在复杂度、成本和可靠性方面很难满足要求。

目前广泛应用的一种导航方式是“跟随路径导

引”,即机器人通过对能敏感到的某些外部的连续路

径参照线作出相应反应来进行导航[2]。这种方法和传统的“硬”自动化相比大大增加了系统的灵活性,其具有代表性的系统有:C ontrol Engineering 公司安装的导线引导系统,它是通过检测埋在地下的引导导线来控制行进方向,其线路分岔则通过在导线上加载不同频率的电流来实现[3];Egemin Automation 公司生产的Mailm obile 机器人则安装有主动式紫外光源,并通过3个光电探头来跟随由受激化学物质构成的发光引导路径[4];Macome 公司为自动驾驶车

辆则开发了一种磁引导单元,它是通过磁通门传感器检测磁带来进行车辆导航[5]。从导航的观点来讲,这些引导方法的优点在于不会迷路,但是最大的缺点是功能单一,无法在行进的同时完成目标识别、绕过障碍等其他行为,而且,在安装维护成本、灵活性、抗干扰能力等方面与用户的期望尚有距离,从而限制了机器人产品的推广使用。

视觉方法是近年发展起来的一种先进导航方法,其和非视觉类传感器相比,视觉传感器具无噪声、无有害影响、信息量大等特点。在实际应用中,只需在路面上画出路径引导线,机器人就可以通过视觉导航系统来控制自身行走。相对于埋设导线、磁条,安装发光带等方法而言,这种方法进一步增强了系统的灵活性,并且降低了成本。为识别引导路径,Ishikawa 采用了一种状态转移算法,并利用了系统中事先存储的110种不同的场景模式[6];Beccari 还采用了一组特定的模板来检测不同的转弯路口[7]。但是这些方法都有以下共同的缺陷:其一是为了提高视觉处理速度,检测方法不同程度依赖于确定的场景模式或模板,这样当机器人在运动过程中出现较大的偏差时,几乎不可能再回到正确路径上来;二是在检测目标时,仅考虑了当前帧场景图像,而没有充分利用以前目标识别的信息,从而在实时性和准确性两方面都会受到影响。

笔者研制开发了一个视觉导航系统,它是通过识别路径引导线和标志信息来为移动机器人提供视觉导航。由于只采用了单目视觉传感器,因此系统的成本和复杂度都得到了降低。为了使之真正做到稳健快速,在图像预处理、路径识别和路径跟踪等各个环节都充分考虑到算法的实时性与鲁棒性(见主要算法描述)。

2 软件流程

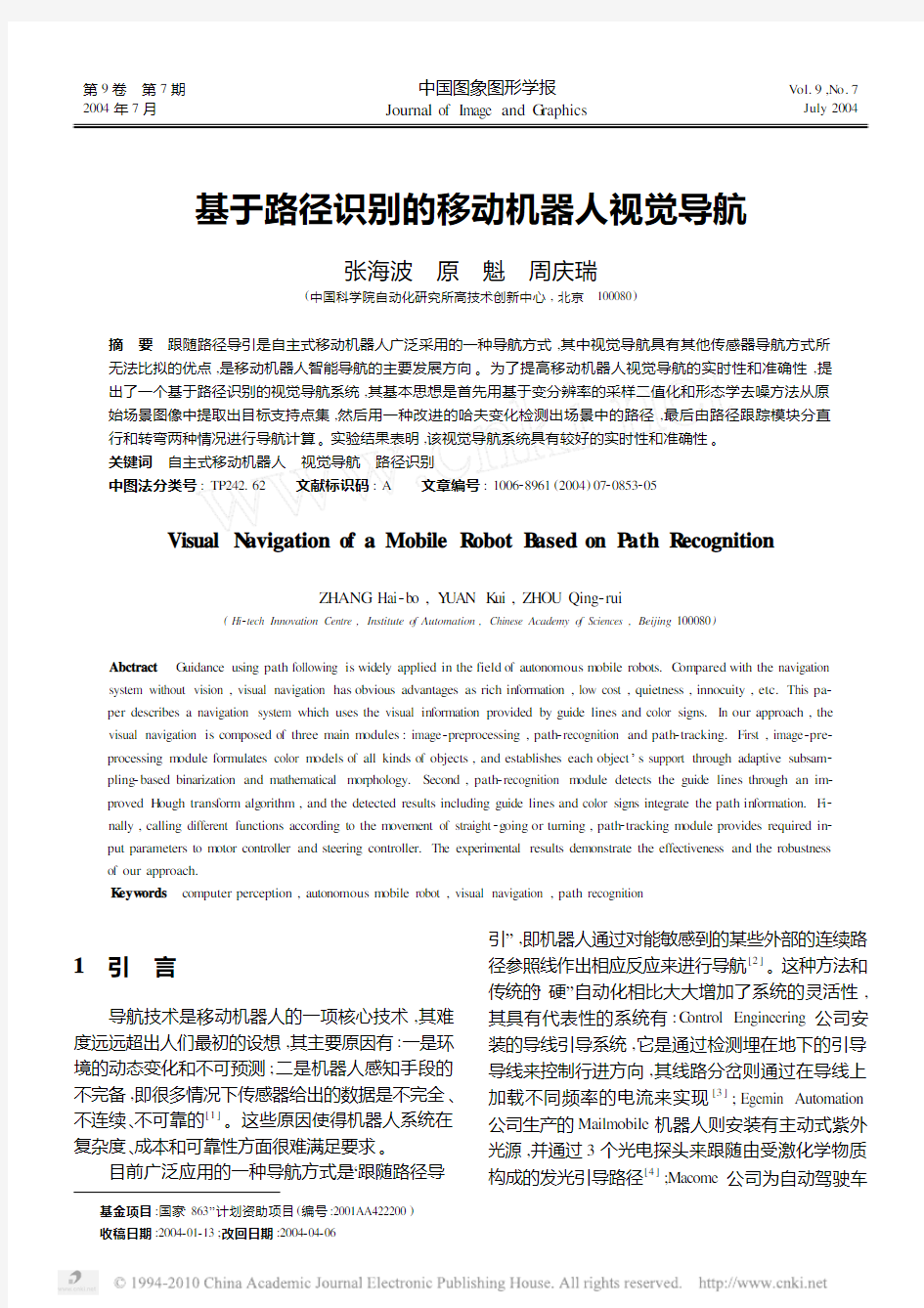

视觉导航系统软件由图像预处理、路径识别和路径跟踪3个主要模块组成,其工作流程如图1所示。

机器人视觉系统的原始输入图像是经图像采集卡A/D (模拟量/数字量)转换之后得到的连续数字图像。系统工作时,首先,图像预处理模块对原始输入图像以合适的分辨率和分割阈值挑选出对机器人有用的各类目标点(包括路径中的引导线、转弯标

图1 视觉导航工作流程图

志、目的地标志等),并剔除其中的噪声点,而这些点

的集合则构成目标的支持点集(support );然后,路径识别模块根据目标支持点集来检测场景中的引导线和各类标志,而引导线和标志综合起来就可以得到所需的路径信息;最后,路径跟踪模块根据路径识别模块所提供的路径信息,分直行和转弯两类情况调用不同的计算模块来为移动平台的运动控制系统提供输入参数。

3 主要算法描述

快速、稳定、准确是移动机器人视觉导航的目标,为实现该目标,本文充分利用了图像序列信息,并且摒弃了过于复杂的处理算法,提出了一种基于路径的改进算法。改进后的算法在准确理解道路图像的前提下,每帧图像的处理时间不超过40ms ,可以满足系统实时性的要求(25帧/s )。3.1 图像预处理3.1.1 彩色图像二值化

对彩色图像进行二值化处理,不仅可以减少目标识别的计算量,还可以降低识别复杂度。本系统中原始输入图像为(384×288)像素的Y UV 格式图像[8],显然,如果对所有110592个像素点都进行二值化处理,在运算时间上是一笔不小的开销。为此,笔者采用了如下一种基于变分辨率的智能采样方法:

(1)在初始化阶段,即不具备目标的先验知识时,以一种较低的分辨率对整幅图像中的像素点进行采样,并首先选出N ×M 个像素点作为目标候选采样点;

(2)进入目标稳定跟踪阶段后,再根据目标上一时刻在图像中的位置和大小设置搜索子窗口。由于窗口内采样的分辨率可以随窗口尺寸自动变化,因

4

58中国图象图形学报第9卷

此可以在不至于丢失目标的前提下选择足够低的分辨率,以减少处理时间;

(3)当目标或者机器人的运动发生突然变化时,则有可能在搜索窗口内丢失目标,这时可以返回步骤1重新进行全局搜索。

上述步骤3虽会降低图像处理的效率,但是由于这种情形出现的概率很小,因此这种采样方法仍然节约了大量的处理时间。

接下来再对采样点进行二值化处理。由于成像质量的原因,图像中存在很多孤立的噪声点,它们有可能正好被抽取作为目标候选采样点,因此如果直接对这些采样点进行阈值分割,则结果并不理想。为了减少这类噪声的干扰,对于每一个候选点(i, j),可选取一个2×2的邻域内的4个像素点(i,j)、(i,j+1)、(i+1,j)和(i+1,j+1)分别进行颜色阈值判定,如果在该候选点的邻域中被判定为目标点的像素总数超过某一设定值,则判定该候选点为目标点。

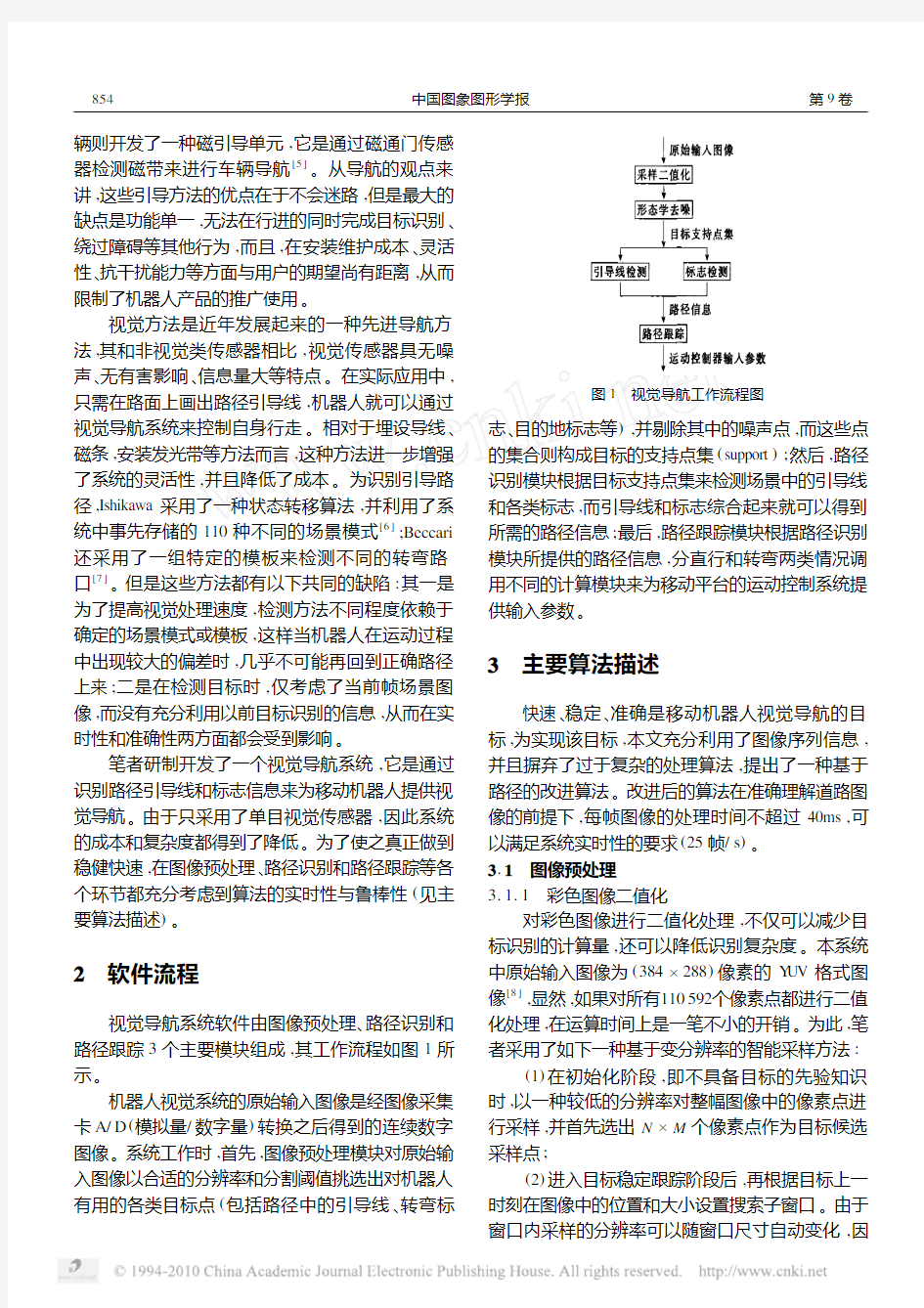

3.1.2 数学形态学去噪

多数情况下得到的二值化图像,往往在目标内部有一些噪声孔,并且在目标周围有一些噪声块,而将二值形态学中的开启和闭合算法结合起来则可以构成有效的噪声滤除器[9]。

开启和闭合是膨胀和腐蚀按不同次序的组合运算。膨胀可以定义为

A S={x|[(^S)x∩A]≠ }(1)其中,A为待膨胀的图像,S为用来膨胀A的结构元素。膨胀操作的基本作用是扩张原图像区域,这样如果图像中有空洞,则将被缩小。腐蚀可以定义为

A S={x|[(S)xΑA]}(2)腐蚀操作的基本作用是收缩原图像区域,并且扩大图像中的空洞。

闭合的定义为

A●S=(A S) S(3) 开启的定义为

B○S=(B S) S(4) 而整个去噪过程可由一次闭合和开启串行结合运算来完成。

图2(a)是一幅采样二值化后的图像,由于阴影和反光的影响,在目标区域的内外均存在噪声,从图2(b)可以看出,用闭合、开启相结合的形态学方法处理后,噪声已很好地被滤除掉了,可以满足下一步识别的要求

。

(a)

噪声滤除前图像

(b)噪声滤除后图像

图2 噪声滤除示例

3.2 引导线检测

众所周知,哈夫变换是常用的直线目标提取方法,其检测直线的基本原理是利用点2线的对偶性来对目标点进行共线统计[10]。设直线的极坐标方程为

λ=x cosθ+y sinθ(5)然后在参数空间中建立累加数组C(θ,λ),让θ取遍所有可能的值,并根据式(5)算出所对应的λ,再根据θ和λ的值(取整后)对累加数组C累加,最后C的数值即为共线点的个数。

为了正确快速地检测引导线,本系统在应用哈夫变换时,从以下两个方面进行了改进:

(1)细化预处理。由于机器人的视野中经常会出现不止一条引导线的情景,因此直接应用上述哈夫变换方法往往会出现错误的结果,如图3(a)所示。由于出现这种误检的原因在于引导线的宽度,所以在做哈夫变换之前应先对目标进行快速细化处理。结果表明,细化处理可以消除这种误检(如图3 (b)所示)

。

(a)

直接哈夫变换检测结果(b)细化预处理后检测结果

图3 引导线检测示例

(2)参数区间选择。在稳定跟踪阶段,还需根据目标直线在上一帧图像中的参数和容许偏差值来选择θ和λ的取值区间。这种做法一方面可以大大节省运算量,提高计算效率,另一方面只在目标可能出现的局部范围内进行检测,还可以完全不受场景中其他地方干扰的影响。

3.3 路径跟踪

路径跟踪分为直行和转弯两个模块,其算法的基本思想是:当机器人视野中只有一条主引导线时,

558

第7期张海波等:基于路径识别的移动机器人视觉导航

运行直行模块,以便使机器人沿该引导线前行。当视野中出现转弯路口时,则根据识别的路径信息启动转弯模块,直到视野中又出现新的主引导线时,才重新转入直行模块。

直行模块的功能是用于主引导线跟踪。在每一个步长的开始时刻,机器人的偏差包括侧向偏差ε0(mm )和方向偏差β0(°),这样可以采用以下一个三次曲线模型作为侧向偏差的变化模型:

ε(s )=2ε0+β0L L

3s 3-3ε0+2β0L L

2

s 2

+β0s +ε0 (6)其中,s 为机器人质心前行距离,L 为机器人质心到摄像头视野中心的水平距离,s ∈[0,L ]。

图4给出在4组不同的初始侧向偏差和方向偏差下,

期望的侧向偏差变化曲线。

图4 侧向偏差期望曲线

转弯模块采用场景模式监测的方法来避免复杂的计算[11]。当机器人转弯时,视野中的场景不仅可

发生连续的变化,而且,对于同一类型的转弯路口和转弯动作,场景的变化方式是固定不变的。由于转弯模块建立了对应各个场景变化序列的模型,因此可根据这些模型来控制机器人的转弯。

图5是机器人

图5 转弯时场景模式变化序列图像(从图5(a )到图5(f ))

在丁字路口右转弯时视野中的场景变化序列图像,

路径跟踪时,转弯模块能通过监测这些场景变化来修改控制参数,并能在转弯结束时,通过给出新的指令来转入直行模块。

4 实验结果及分析

视觉导航系统在移动机器人平台AI MR 上进行了实验,该平台最大运动速度为2m/s ,实验中,视觉云台应保持静止,摄像头视野中心到机器人质心的水平距离为713mm 。图像处理系统为667M 处理器,算法在Visual C ++6.0编译环境中实现。

机器人导航实验场地如图6所示。场地中铺设了宽1m 的绿色道路,道路中央有10cm 宽的白色引导线。为检验系统的路径识别能力,在场地中设置了直线、拐角、丁字路口和三岔路口。此外,在需要转弯的路口放置黄色三角柱作为转弯标志,在各个目标站点设置了蓝色标牌作为调头标志。实验过程中机器人上不装载环境地图,

完全根据引导线和各类标志来行走。

图6 视觉导航实验场地示意图

实验开始时,首先将机器人放置在出发点道路

中央处,并基本对准引导线,然后用本文算法进行机器人导航,算法在初始化阶段处理时间较长,需要大约不超过1s 的时间。初始化成功之后进入稳定跟踪阶段,识别一幅场景仅需时约20ms ,加上上层决策系统所耗时间仍不超过40ms ,因此可以达到25H z 的识别频率。场地上的反光和阴影是机器人行走过程中最主要的干扰,由于系统利用了路径的历史位置和颜色信息,因此不管是在白天自然光照条件,还是晚上灯光条件下,这些干扰都能很好地被滤除。笔者通过调整转弯标志的位置进行了多次实验,机器人均能以接近最大速度运行到正确的目的地,这

6

58中国图象图形学报第9卷

表明算法的实时性和精确度能满足导航要求。另外,当道路上出现了障碍或者非常严重的干扰时(如较大面积的强烈反光、极暗的阴影等),错误检测机制还可以使机器人重新进入初始化阶段,而不会出现失去控制的局面。

5 结 论

据统计,人类六成以上的信息都是由视觉获得的,从这一意义上来说,视觉导航最接近人的导航机理,也许最终其可以使得机器人能像人类那样不依赖任何外界帮助地自由行走。

本文介绍的视觉导航系统具有很大的推广意义,在工厂、医院、办公楼等环境中,只要设立路径引导线和转弯标志,机器人便可以自主地到达目的地,并且不受障碍的影响。事实上,在很多室内环境中,大量存在可用于视觉导航的陆标,如规则的地板瓷砖、天花板网格线、踢脚板、门牌标志等。由于所用算法并不失一般性,因此该视觉系统可以通过功能扩展之后,仅靠识别这些陆标来进行导航,而不再依赖专用的路径引导线。当然,由于环境的规整化程度降低和噪声的增多,视觉导航面临的困难也会更大,因此其在复杂的动态环境和高噪声条件下是否有效、可靠,这将是下一步工作的重点。

参考文献

1 陆新华,张桂林.室内服务机器人导航方法研究[J].机器人, 2003,25(1):80~87.

2 中国电子学会敏感技术分会.2001/2002传感器与执行器大全(年卷)[M].北京:电子工业出版社,2002.

3 C ontrol Engineering C om pany.Automated guided vechiles[E B/O L].

http://w w https://www.doczj.com/doc/2d9641989.html,,2003209227.

4 Egem in Automation Inc./Bell&H owell.R obotic transport systems that fit y our environment[E B/O L].http://w w w.mailm https://www.doczj.com/doc/2d9641989.html,,20032102

13.

5 M acome corporation.M agnetic tape guidance AG V sens or[E B/O L].

http://w w w.macome.co.jp,2003210213.

6 Ishikkawa Shigeki,K uwam oto Hideki,Ozawa Shinji.Visual navigation of an autonom ous vehicle using white line recognition[J].IEEE T ransac2 tions on PAMI,1988,10(5):743749.7 Beccari G,Caselli S,Z anichelli F,et al.Vision2based line tracking and navigation in structured environments[A].In:Proceedings of the1997 IEEE International Sym posium on C om putational Intelligence in R obotics and Automation[C],M onterey,California,US A,1997.

8 中国大恒(集团)有限公司.大恒图像系列板卡用户手册[E B/ O L].http://w w https://www.doczj.com/doc/2d9641989.html,,2002203227.

9 ZHANG Hai2bo,Y UAN K ui,LIU Jin2dong.A fast and robust vision sys2 tem forautonom ous m obile robots[A].In:IEEE International C on ference on R obotics,Intelligent Systems and S ignal Processing[C],Changsha, China,2003.

10章毓晋.图象处理和分析[M].北京:清华大学出版社,1999:187~190

11Vassallo Raquel Frizera,Schneebeli Hans Jorg,Victor Jose Santos.Visu2 al navigation:combining visual serv oing and appearance based methods

[A].In:6th International Sym posium on Intelligent R obotic Systems

[C],Edinburgh,Scotland,

1998.

张海波 1974年生,1997年获得国防

科学技术大学硕士学位,现为中国科学院

自动化研究所博士研究生。主要研究方向

为机器视觉、图像处理以及智能机器人。

E2mail:haibo.zhang@sina.

com

原 魁 1957年生,1982至1988年在

日本九州大学先后获工学硕士和工学博士

学位。现为中科院自动化所研究员,博士

生导师,国家“863”计划智能机器人主题专

家组成员,国家科技进步奖评审组成员,人

工智能学会智能机器人学会理事。主要研

究方向为智能机器人、智能传感与智能信

息处理技术、人机接口技术、虚拟现实技

术

。

周庆瑞 1971年生,现为中国科学院

自动化研究所博士研究生。主要研究方向

为嵌入式视觉系统、图像处理和机器视觉。

758

第7期张海波等:基于路径识别的移动机器人视觉导航

移动机器人的关键技术分为以下三种: (1)导航技术 导航技术是移动机器人的一项核心技术之一[3,4]"它是指移动机器人通过传感器感知环境信息和自身状态,实现在有障碍的环境中面向目标的自主运动"目前,移动机器人主要的导航方式包括:磁导航,惯性导航,视觉导航等"其中,视觉导航15一7]通过摄像头对障碍物和路标信息拍摄,获取图像信息,然后对图像信息进行探测和识别实现导航"它具有信号探测范围广,获取信息完整等优点,是移动机器人导航的一个主要发展方向,而基于非结构化环境视觉导航是移动机器人导航的研究重点。 (2)多传感器信息融合技术多传感器信息融合技术是移动机器人的关键技术之一,其研究始于20世纪80年代18,9]"信息融合是指将多个传感器所提供的环境信息进行集成处理,形成对外部环境的统一表示"它融合了信息的互补性,信息的冗余性,信息的实时性和信息的低成本性"因而能比较完整地,精确地反映环境特征,从而做出正确的判断和决策,保证了机器人系统快速性,准确性和稳定性"目前移动机器人的多传感器融合技术的研究方法主要有:加权平均法,卡尔曼滤波,贝叶斯估计,D-S证据理论推理,产生规则,模糊逻辑,人工神经网络等"例如文献[10]介绍了名为Xavier的机器人,在机器人上装有多种传感器,如激光探测器!声纳、车轮编码器和彩色摄像机等,该机器人具有很高的自主导航能力。 (3)机器人控制器作为机器人的核心部分,机器人控制器是影响机器人性能的关键部分之一"目前,国内外机器人小车的控制系统的核心处理器,己经由MCS-51、80C196等8位、16位微控制器为主,逐渐演变为DSP、高性能32位微控制器为核心构成"由于模块化系统具有良好的前景,开发具有开放式结构的模块化、标准化机器人控制器也成为当前机器人控制器的一个研究热点"近几年,日本!美国和欧洲一些国家都在开发具有开放式结构的机器人控制器,如日本安川公司基于PC开发的具有开放式结构!网络功能的机器人控制器"我国863计划智能机器人主题也已对这方面的研究立项 视觉导航技术分类 机器人视觉被认为是机器人重要的感觉能力,机器人视觉系统正如人的眼睛一样,是机器人感知局部环境的重要“器官”,同时依此感知的环境信息实现对机器人的导航。机器人视觉信息主要指二维彩色CCD摄像机信息,在有些系统中还包括三维激光雷达采集的信息。视觉信息能否正确、实时地处理直接关系到机器人行驶速度、路径跟踪以及对障碍物的避碰,对系统的实时性和鲁棒性具有决定性的作用。视觉信息处理技术是移动机器人研究中最为关键的技术之一。

移动机器人视觉导航。 0504311 19 刘天庆一、引言 智能自主移动机器人系统能够通过传感器感知外界环境和自身状态,实现在有障碍物环境中面向目标的自主运动,从而完成一定作业功能。其本身能够认识工作环境和工作对象,能够根据人给予的指令和“自身”认识外界来独立地工作,能够利用操作机构和移动机构完成复杂的操作任务。因此,要使智能移动机器人具有特定智能,其首先就须具有多种感知功能,进而进行复杂的逻辑推理、规划和决策,在作业环境中自主行动。机器人在行走过程中通常会碰到并且要解决如下三个问题:(1)我(机器人)现在何处?(2)我要往何处走?(3)我要如何到达该处?其中第一个问题是其导航系统中的定位及其跟踪问题,第二、三个是导航系统的路径规划问题。移动机器人导航与定位技术的任务就是解决上面的三个问题。移动机器人通过传感器感知环境和自身状态,进而实现在有障碍物的环境中面向目标自主运动,这就是通常所说的智能自主移动机器人的导航技术。而定位则是确定移动机器人在工作环境中相对于全局坐标的位置及其本身的姿态,是移动机器人导航的基本环节。 目前,应用于自主移动机器人的导航定位技术有很多,归纳起来主要有:安装CCD 摄像头的视觉导航定位、光反射导航定位、全球定位系统GPS(Global Positioning System)、声音导航定位以及电磁导航定位等。下面分别对这几种方法进行简单介绍和分析。 1、视觉导航定位 在视觉导航定位系统中,目前国内外应用较多的是基于局部视觉的在机器人中安装车载摄像机的导航方式。在这种导航方式中,控制设备和传感装置装载在机器人车体上,图像识别、路径规划等高层决策都由车载控制计算机完成。视觉导航定位系统主要包括:摄像机(或CCD 图像传感器)、视频信号数字化设备、基于DSP 的快速信号处理器、计算机及其外设等。现在有很多机器人系统采用CCD 图像传感器,其基本元件是一行硅成像元素,在一个衬底上配置光敏元件和电荷转移器件,通过电荷的依次转移,将多个象素的视频信号分时、顺序地取出来,如面阵CCD传感器采集的图像的分辨率可以从32×32 到1024×1024 像素等。视觉导航定位系统的工作原理简单说来就是对机器人周边的环境进行光学处理,先用摄像头进行图像信息采集,将采集的信息进行压缩,然后将它反馈到一个由神经网络和统计学方法构成的学习子系统,再由学习子系统将采集到的图像信息和机器人的实际位置联系起来,完成机器人的自主导航定位功能。 视觉导航定位中,图像处理计算量大,计算机实时处理的速度要达到576MOPS~5.76BOPS,这样的运算速度在一般计算机上难以实现,因此实时性差这一瓶颈问题有待解决; 另外,对于要求在黑暗环境中作业的机器人来说,这种导航定位方式因为受光线条件限制也不太适应。 当今国内外广泛研制的竞赛足球机器人通常都采用上面所说的视觉导航定位方式,在机器人小车子系统中安装摄像头,配置图像采集板等硬件设备和图像处理软件等组成机器人视觉系统。通过这个视觉系统,足球机器人就可以实现对球的监测,机器人自身的定位,作出相应动作和预测球的走向等功能

机器人视觉(Robot Vision)简介 机器视觉系统的组成 机器视觉系统是指用计算机来实现人的视觉功能,也就是用计算机来实现对客观的三维世界的识别。按现在的理解,人类视觉系统的感受部分是视网膜,它是一个三维采样系统。三维物体的可见部分投影到网膜上,人们按照投影到视网膜上的二维的像来对该物体进行三维理解。所谓三维理解是指对被观察对象的形状、尺寸、离开观察点的距离、质地和运动特征(方向和速度)等的理解。 机器视觉系统的输入装置可以是摄像机、转鼓等,它们都把三维的影像作为输入源,即输入计算机的就是三维管观世界的二维投影。如果把三维客观世界到二维投影像看作是一种正变换的话,则机器视觉系统所要做的是从这种二维投影图像到三维客观世界的逆变换,也就是根据这种二维投影图像去重建三维的客观世界。 机器视觉系统主要由三部分组成:图像的获取、图像的处理和分析、输出或显示。 将近80%的工业视觉系统主要用在检测方面,包括用于提高生产效率、控制生产过程中的产品质量、采集产品数据等。产品的分类和选择也集成于检测功能中。下面通过一个用于生产线上的单摄像机视觉系统,说明系统的组成及功能。 视觉系统检测生产线上的产品,决定产品是否符合质量要求,并根据结果,产生相应的信号输入上位机。图像获取设备包括光源、摄像机等;图像处理设备包括相应的软件和硬件系统;输出设备是与制造过程相连的有关系统,包括过程控制器和报警装置等。数据传输到计算机,进行分析和产品控制,若发现不合格品,则报警器告警,并将其排除出生产线。机器视觉的结果是CAQ系统的质量信息来源,也可以和CIMS其它系统集成。 图像的获取 图像的获取实际上是将被测物体的可视化图像和内在特征转换成能被计算机处理的一系列数据,它主要由三部分组成: *照明 *图像聚焦形成 *图像确定和形成摄像机输出信号

机器人与自动化技术 “机器人、无处不在的屏幕、语音交互,这些都将改变我们看待‘电脑’的方式。一旦看、听、阅读能力得到提升,你就可以以新的方式进行交互。”----比尔?盖茨在某电视节目中,预测未来科技领域的下一件大事时表示:机器人与自动化技术将成为未来发展的一大趋势,可以改变世界! 工业机器人的应用,正从汽车工业向一般工业延伸,除了金属加工、食品饮料、塑料橡胶、3C、医药等行业,机器人在风能、太阳能、交通运输、建筑材料、物流甚至废品处理等行业都可以大有作为。 当然,即将“改变世界”的机器人不仅仅具有代替人工的价值,在很多人类无法实现的领域也将出现机器人的身影。譬如,派送采矿机器人到月球和小行星上采挖稀土矿,将有望成为现实。 而更令比尔?盖茨寄予厚望的是机器人将像“电脑”一样改变人类的生活。 日本早稻田大学研究人员推出一种新型仿人型家务机器人。它集安全性、可靠性和灵巧性于一身,还具有仿人脸的外观。在工作时,它将一名男子抱下床,与他聊天并为他准备早餐。由于拥有和成年女性大小相当的灵巧双臂、双手,这种机器人能够用夹子将面包从面包机中取出,而丝毫不弄碎它。 英国阿伯丁大学启动了一项新的研究计划,在3年内研发出允许机器人与人类进行交谈,甚至讨论具体决定的系统……。 作为先进制造业中不可替代的重要装备,工业机器人已经成为衡量一个国家制造水平和科技水平的重要标志。 在机器人市场中,目前80%的市场份额仍由跨国公司占有,其中瑞典ABB、日本发那科FANUC、日本安川yaskawa和德国库卡KUKA四大企业则是市场第一梯队的“四大金刚”。其它有瑞士史陶比尔Staubli、德国克鲁斯CLOOS、德国百格拉、德国徕斯、德国斯图加特航空航天自动化集团(STUAA)、意太利瀚博士hanbs、意大利柯马COMAU、英国Auto Tech Robotics等。 目前国内生产机器人的企业主要有:中科院沈阳新松机器人自动化股份有限公司、芜湖埃夫特智能装备有限公司、上海新时达机器人有限公司、安川首钢机器人有限公司、哈工大海尔机器人有限公司、南京埃斯顿机器人工程有限公司、广州数控设备有限公司、上海沃迪自动化装备股份有限公司等。 2015年,中国机器人市场需求预计将达35000台,占全球比重16.9%,成为全球规模最大的市场。 一、机器人的系统构成 由3大部分6个子系统组成。 3大部分是:机械部分、传感部分、控制部分。 6个子系统是:驱动系统、机械结构系统、感受系统、机器人-环境交互系统、人-机交互系统、控制系统。

带有视觉识别模块的分拣机器人 传统的机器人分拣操作一般采用示教或离线编程方式,当机器人所处的工作环境发生改变时机器人很难即时作出相应的调整,为了使机器人具有更加智能化的功能,以阿童木并联机器人和工业智能相机为基础,组成一套带有视觉模块的机器人分拣系统。这样的分拣系统结合了并联型机器人和视觉模块两个方面的优势,通过视觉模块智能的识别不同的对象,系统可以完成高速的分拣工作,显著提升了机器人对工作环境的适应能力,提高了工作效率。同时,实验结果证明了该系统软硬件设计正确,分拣成功率高。 随着我们国家生产需求的不断增加,机器人越来越多的参与到各行各业的生产过程中来。其中,对工件的分拣作业是当前生产过程中的一个重要环节,传统的机器人分拣,其动作和目标的摆放位置都需要根据程序预先严格的设定。一旦机器人所处的环境有所改变,很容易导致抓取错误。本文模拟工业生产中的分拣作业环境,引入视觉模块,用摄像机来模拟人类的视觉功能来对待测的对象进行识别分类,可以使分拣作业拥有更高的可靠性和灵活性,作业对象以及分拣工序可以随时随地的变换,也提高了工作的效率和机器人的智能化程度。 1机器人系统组成介绍 我们设计的机器人分拣系统主要由并联机器人、视觉模块、传送带装置以及分拣对象组成,结构如图1所示: 1.1并联机器人 相比于其他工业机器人,并联机器人占用较小的空间,其更具有高速度、高精度、灵活性等特点,更能適合苛刻的工业生产需求。我们在实验中采用的是阿童木4轴并联型机器人,如图2所示,它能够完成空间中X、Y、Z方向的移动及角度的转动。除了并联型机器人本体之外,机器人配套设施还包括机器人控制柜、控制编程器和驱动机器人各关节运动的伺服交流电机。机器人末端执行机构为气动吸盘,用于吸附传送带上的分拣对象,完成抓取动作。 1.2 视觉模块 视觉模块我们采用康奈视公司的In-Sight7000型智能相机,如图3所示。该视觉模块能够智能的识别出实验中不同种类的实验对象,以及采集各个实验对象的位置信息。 1.3网络交换机 实验中,我们使用一般的家用路由器来替代网络交换机。视觉模块采集到的信息要通过局域网来络传递给机器人,因此我们要用到网络交换机来搭建局域网络,进而使各个模块间完成信息传输。

浅谈机器人视觉技术 摘要 机器人视觉是使机器人具有视觉感知功能的系统,是机器人系统组成的重要部分之一。机器人视觉可以通过视觉传感器获取环境的二维图像,并通过视觉处理器进行分析和解释,进而转换为符号,让机器人能够辨识物体,并确定其位置。机器人视觉广义上称为机器视觉,其基本原理与计算机视觉类似。计算机视觉研究视觉感知的通用理论,研究视觉过程的分层信息表示和视觉处理各功能模块的计算方法。而机器视觉侧重于研究以应用为背景的专用视觉系统,只提供对执行某一特定任务相关的景物描述。机器人视觉硬件主要包括图像获取和视觉处理两部分,而图像获取由照明系统、视觉传感器、模拟-数字转换器和帧存储器等组成。本文介绍了机器人的发展以及视觉计算理论和视觉的关键技术。 关键词:机器人、视觉、计算、关键技术 一、机器人发展概述 科学技术的发展,诞生了机器人。社会的进步也提出要求,希望创造出一种能够代替人进行各种工作的机器,甚至从事人类不能及的事情。自从1959年诞生第一台机器人以来,机器人技术取得了很大的进步和发展,至今已成为一门集机械、电子、计算机、控制、传感器、信号处理等多学科门类为一体的综合性尖端科学。当今机器人技术的发展趋势主要有两个突出的特点:一个是在横向上,机器人的应用领域在不断扩大,机器人的种类日趋增多;另一个是在纵向上,机器人的性能不 断提高,并逐步向智能化方向发展。前者是指应用领域的横向拓宽,后者是在性能及水平上的纵向提高。机器人应用领域的拓宽和性能水平的提高,二者相辅相成、相互促进。 智能机器人是具有感知、思维和行动功能的机器,是机构学、自动控制、计算机、人工智能、微电子学、光学、通讯技术、传感技术、仿生学等多种学科和技术的综合成果阎。智能机器人可获取、处理和识别多种信息,自主地完成较为复杂的操作任务,比一般的工业机器人具有更大的灵活性、机动性和更广泛的应用领域。要使机器人拥有智能,对环境变化做出反应,首先,必须使机器人具有感知

第32卷第4期2006年7月 光学技术 OPTICAL TECHN IQU E Vol.32No.4 J uly 2006 文章编号:1002-1582(2006)04-0591-03 一种基于单目视觉的移动机器人室内导航方法Ξ 付梦印,谭国悦,王美玲 (北京理工大学信息科学技术学院自动控制系,北京 100081) 摘 要:针对室内导航的环境特点,提出了一种简单快速的、以踢脚线为参考目标的移动机器人室内导航方法。该方法从图像中提取踢脚线作为参考直线,通过两条直线在图像中的成像特征,提取角度和横向偏离距离作为移动机器人的状态控制输入,从而实现移动机器人的横向运动控制。该方法无需进行摄像机的外部参数标定,大大简化了计算过程,提高了视觉导航的实时性。 关键词:视觉导航;直线提取;Hough变换;移动机器人;踢脚线 中图分类号:TP242.6+2;TP391 文献标识码:A An indoor navigation algorithm for mobile robot based on monocular vision FU Meng-yin,T AN G uo-yue,WANG Mei-ling (Department of Automatic Control,School of Information and Science Technolo gy, Beijing Institute of Technology,Beijing 100081,China) Abstract:Considered the features of indoor environment,a sim ple fast indoor navigation algorithm for vision-guide mobile robot was presented,which used skirting lines as the reference objects to locate the mobile robot.This algorithm detected skirt2 ing lines using monocular images and analyzed the lines’parameters to provide angle and distance of the robot as in puts of robot control.Without calibrating camera parameters,this algorithm greatly reduces computation time and improves the real-time a2 bility of vision navigation. K ey w ords:vision navigation;line detection;Hough transform;mobile robot;skirt line 1 引 言 近年来,机器视觉因其含有丰富的环境信息而受到普遍的关注。随着视觉传感器价格的不断下降,视觉导航已成为导航领域研究的热点。在室外进行视觉导航时,采用视觉传感器可获取车道信息,通过摄像机的标定来实现坐标转换,通过确定车辆当前的状态来实现导航。绝大部分智能车辆都是应用视觉来完成车道检测的[1,2],例如意大利的AR2 GO[3]项目就是通过使用逆投射投影的方法[4]来确定车辆状态的,并获得了良好的实验效果。在室内进行视觉导航时,利用视觉提取室内环境特征,例如一些预先设置的引导标志就是通过图像处理进行识别并理解这些标志来完成导航任务的[5,6]。这些都需要在图像中进行大量的搜索运算来提取标志,并通过一系列的图像理解算法来理解标志的信息,因而计算量很大。当然也可以通过视觉计算室内环境,例如通过走廊中的角点特征来获取状态信息[7],以此减少图像搜索时的计算量。但这些角点信息易受移动机器人运动的影响,会模糊角点信息,为了提高计算精度需要通过光流法对背景信息进行运动补偿,计算复杂,实时性不理想。 当移动机器人在实验室走廊环境下进行导航控制时,需要视觉传感器为其提供偏航角和横向偏离距离这两个参数。通过对单目视觉图像进行处理来获取这两个参数,完成移动机器人的横向运动控制。 2 摄像机成像模型与视觉系统 2.1 摄像机成像模型 使用视觉传感器首先要考虑的是其成像模型,它是指三维空间中场景到图像平面的投影关系,不同的视觉传感器有不同的成像模型。本文采用高分辨率CCD摄像机作为视觉传感器,其成像模型为针孔模型,空间中任意一点P在图像上的成像位置可以用针孔模型近似表示。如图1所示,P点投影位置为p,它是光心O同P点的连线O P与图像平面的交点,这种关系叫投射投影。图中标出的坐标系定义如下[8]: (1)图像坐标系I(u,v)是以图像平面的左上角为坐标原点所定义的直角坐标系,以像素为单位表示图像中点的位置。 (2)像平面坐标(x,y)指的是CCD成像靶面 195 Ξ收稿日期:2005-07-12 E-m ail:guoyuetan@https://www.doczj.com/doc/2d9641989.html, 基金项目:国家自然科学基金资助项目(60453001) 作者简介:付梦印(1964-),男,北京理工大学信息科学技术学院自动控制系教授,博士,主要从事导航制导、控制组合导航及智能导航技术的研究。

1.什么是机器视觉 【概述】 机器视觉就是用机器代替人眼来做测量和判断。机器视觉系统是指通过机器视觉产品(即图像摄取装置,分 CMOS 和 CCD 两种)将被摄取目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号;图像系统对这些信号进行各种运算来抽取目标的特征,进而根据判别的结果来控制现场的设备动作。 机器视觉系统的特点是提高生产的柔性和自动化程度。在一些不适合于人工作业的危险工作环境或人工视觉难以满足要求的场合,常用机器视觉来替代人工视觉;同时在大批量工业生产过程中,用人工视觉检查产品质量效率低且精度不高,用机器视觉检测方法可以大大提高生产效率和生产的自动化程度。而且机器视觉易于实现信息集成,是实现计算机集成制造的基础技术。 正是由于机器视觉系统可以快速获取大量信息,而且易于自动处理,也易于同设计信息以及加工控制信息集成,因此,在现代自动化生产过程中,人们将机器视觉系统广泛地用于工况监视、成品检验和质量控制等领域。【基本构造】 一个典型的工业机器视觉系统包括:光源、镜头、 CCD 照相机、图像处理单元(或图像捕获卡)、图像处理软件、监视器、通讯 / 输入输出单元等。 系统可再分为: 主端电脑(Host Computer) 影像撷取卡(Frame Grabber)与影像处理器影像摄影机 CCTV镜头显微镜头照明设备: Halogen光源 LED光源 高周波萤光灯源闪光灯源其他特殊光源影像显示器 LCD 机构及控制系统 PLC、PC-Base控制器 精密桌台伺服运动机台 【工作原理】 机器视觉检测系统采用CCD照相机将被检测的目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号,图像处理系统对这些信号进行各种运算来抽取目标的特征,如面积、数量、位置、长度,再根据预设的允许度和其他条件输出结果,包括尺寸、角度、个数、合格 / 不合格、有 / 无等,实现自动识别功能。 【机器视觉系统的典型结构】 一个典型的机器视觉系统包括以下五大块: 1.照明 照明是影响机器视觉系统输入的重要因素,它直接影响输入数据的质量和应用效果。由于没有通用的机器视觉照明设备,所以针对每个特定的应用实例,要选择相应的照明装置,以达到最佳效果。光源可分为可见光和不可见光。常用的几种可见光源是白帜灯、日光灯、水银灯和钠光灯。可见光的缺点是光能不能保持稳定。如何使光能在一定的程度上保持稳定,是实用化过程中急需要解决的问题。另一方面,环境光有可能影响图像的质量,所以可采用加防护屏的方法来减少环境光的影响。照明系统按其照射方法可分为:背向照明、前向照明、结构光和频闪光照明等。其中,背向照明是被测物放在光源和摄像机之间,它的优点是能获得高对比度的图像。前向照明是光源和摄像机位于被测物的同侧,这种方式便于安装。结构光照明是将光栅或线光源等投射到被测物上,根据它们产生的畸变,解调出被测物的三维信息。频闪光照明是将高频率的光脉冲照射到物体上,摄像机拍摄要求与光源同步。 2.镜头FOV(Field Of Vision)=所需分辨率*亚象素*相机尺寸/PRTM(零件测量公差比)镜头选择应注意: ①焦距②目标高度③影像高度④放大倍数⑤影像至目标的距离⑥中心点 / 节点⑦畸变 3.相机 按照不同标准可分为:标准分辨率数字相机和模拟相机等。要根据不同的实际应用场合选不同的相机和高分辨率相机:线扫描CCD和面阵CCD;单色相机和彩色相机。 4.图像采集卡 图像采集卡只是完整的机器视觉系统的一个部件,但是它扮演一个非常重要的角色。图像采集卡直接决定了摄像头的接口:黑白、彩色、模拟、数字等等。 比较典型的是PCI或AGP兼容的捕获卡,可以将图像迅速地传送到计算机存储器进行处理。有些采集卡有内置的多路开关。例如,可以连接8个不同的摄像机,然后告诉采集卡采用那一个相机抓拍到的信息。有些采集卡有内置的数字输入以触发采集卡进行捕捉,当采集卡抓拍图像时数字输出口就触发闸门。 5.视觉处理器 视觉处理器集采集卡与处理器于一体。以往计算机速度较慢时,采用视觉处理器加快视觉处理任务。现在由于采集

基于视觉导航的轮式移动机器人设计方案第一章移动机器人 §1.1移动机器人的研究历史 机器人是一种自动化的机器,所不同的是这种机器具备一些与人或生物相似的智能,如感知能力、规划能力、动作能力和协同能力,是一种具有高度灵活性的自动化机器)。1962年,美国Unimation公司的第一台机器人Unimate。在美国通用汽车公司(GM)投入使用,标志着第一代机器人的诞生。 智能移动机器人更加强调了机器人具有的移动能力,从而面临比固定式机器人更为复杂的不确定性环境,也增加了智能系统的设计复杂度。1968年到1972年间,美国斯坦福国际研究所(Stanford Research Institute, SRI)研制了移动式机器人Shaky,这是首台采用了人工智能学的移动机器人。Shaky具备一定人工智能,能够自主进行感知、环境建模、行为规划并执行任务(如寻找木箱并将其推到指定目的位置)。它装备了电视摄像机、三角法测距仪、碰撞传感器、驱动电机以及编码器,并通过无线通讯系统由二台计算机控制。当时计算机的体积庞大,但运算速度缓慢,导致Shaky往往需要数小时的时间来分析环境并规划行动路径。 1970年前联月球17号探测器把世界第一个无人驾驶的月球车送七月球,月球车行驶0.5公里,考察了8万平方米的月面。后来的月球车行驶37公里,向地球发回88幅月面全景图。在同一时代,美国喷气推进实验室也研制了月球车(Lunar rover),应用于行星探测的研究。采用了摄像机,激光测距仪以及触觉传感器。机器人能够把环境区分为可通行、不可通行以及未知等类型区域。 1973年到1979年,斯坦福大学人工智能实验室研制了CART移动机器人,CART可以自主地在办公室环境运行。CART每移动1米,就停下来通过摄像机的图片对环境进行分析,规划下一步的运行路径。由于当时计算机性能的限制,CART每一次规划都需要耗时约15分钟。CMU Rover由卡耐基梅隆大学机

工业机器人及机器人视觉系统 人类想要实现一系列的基本活动,如生活、工作、学习就必须依靠自身的器官,除脑以外,最重要的就是我们的眼睛了,(工业)机器人也不例外,要完成正常的生产任务,没有一套完善的,先进的视觉系统是很难想象的。 机器视觉系统就是利用机器代替人眼来作各种测量和判断。它是计算科的一个重要分支,它综合了光学、机械、电子、计算机软硬件等方面的技术,涉及到计算机、图像处理、模式识别、人工智能、信号处理、光机电一体化等多个领域。图像处理和模式识别等技术的快速发展,也大大地推动了机器视觉的发展。 机器视觉系统的应用 在生产线上,人来做此类测量和判断会因疲劳、个人之间的差异等产生误差和错误,但是机器却会不知疲倦地、稳定地进行下去。一般来说,机器视觉系统包括了照明系统、镜头、摄像系统和图像处理系统。对于每一个应用,我们都需要考虑系统的运行速度和图像的

处理速度、使用彩色还是黑白摄像机、检测目标的尺寸还是检测目标有无缺陷、视场需要多大、分辨率需要多高、对比度需要多大等。从功能上来看,典型的机器视觉系统可以分为:图像采集部分、图像处理部分和运动控制部分 工作过程 ?一个完整的机器视觉系统的主要工作过程如下: ?1、工件定位检测器探测到物体已经运动至接近摄像系统的视野中心,向图像采集部分发送触发脉冲。 ?2、图像采集部分按照事先设定的程序和延时,分别向摄像机和照明系统发出启动脉冲。 ?3、摄像机停止目前的扫描,重新开始新的一帧扫描,或者摄像机在启动脉冲来到之前处于等待状态,启动脉冲到来后启动一帧扫描。 ?4、摄像机开始新的一帧扫描之前打开曝光机构,曝光时间可以事先设定。

机器人视觉系统(Robot Vision)简介 【字体:大中小】时间:2014-08-28 11:00:06 点击次数:23次 机器视觉系统的组成 机器视觉系统是指用计算机来实现人的视觉功能,也就是用计算机来实现对客观的三维世界的识别。按现在的理解,人类视觉系统的感受部分是视网膜,它是一个三维采样系统。三维物体的可见部分投影到网膜上,人们按照投影到视网膜上的二维的像来对该物体进行三维理解。所谓三维理解是指对被观察对象的形状、尺寸、离开观察点的距离、质地和运动特征(方向和速度)等的理解。 机器视觉系统的输入装置可以是摄像机、转鼓等,它们都把三维的影像作为输入源,即输入计算机的就是三维管观世界的二维投影。如果把三维客观世界到二维投影像看作是一种正变换的话,则机器视觉系统所要做的是从这种二维投影图像到三维客观世界的逆变换,也就是根据这种二维投影图像去重建三维的客观世界。 机器视觉系统主要由三部分组成:图像的获取、图像的处理和分析、输出或显示。 将近80%的工业视觉系统主要用在检测方面,包括用于提高生产效率、控制生产过程中的产品质量、采集产品数据等。产品的分类和选择也集成于检测功能中。下面通过一个用于生产线上的单摄像机视觉系统,说明系统的组成及功能。 视觉系统检测生产线上的产品,决定产品是否符合质量要求,并根据结果,产生相应的信号输入上位机。图像获取设备包括光源、摄像机等;图像处理设备包括相应的软件和硬件系统;输出设备是与制造过程相连的有关系统,包括过程控制器和报警装置等。数据传输到计算机,进行分析和产品控制,若发现不合格品,则报警器告警,并将其排除出生产线。机器视觉的结果是CAQ系统的质量信息来源,也可以和CIMS其它系统集成。 图像的获取 图像的获取实际上是将被测物体的可视化图像和内在特征转换成能被计算机处理的一系列数据,它主要由三部分组成: *照明 *图像聚焦形成 *图像确定和形成摄像机输出信号

机器人视觉系统 ——人脸识别技术 优势 1 不被察觉,不会引起人的反感。 2 非接触性,不需要和设备接触即可识别 3 自然性 4 准确,可靠,灵活。 原理 在检测到人脸并定位面部关键特征点之后,主要的人脸区域就可以被裁剪出来,经过预处理之后,馈入后端的识别算法。识别算法要完成人脸特征的提取,并与库存的已知人脸进行比对,完成最终的分类。 主要过程 一般分三步: (1)首先建立人脸的面像档案。即用摄像机采集单位人员的人脸的面像文件或取他们的照片形成面像文件,并将这些面像文件生成面纹(Faceprint)编码贮存起来。 (2)获取当前的人体面像。即用摄像机捕捉的当前出入人员的面像,或取照片输入,并将当前的面像文件生成面纹编码。(智械科技) (3)用当前的面纹编码与档案库存的比对。即将当前的面像的面纹编码与档案库存中的面纹编码进行检索比对。上述的“面纹编码”方式是根据人脸脸部的本质特征和开头来工作的。这种面纹编码可以抵抗光线、皮肤色调、面部毛发、发型、眼镜、表情和姿态的变化,具有强大的可靠性,从而使它可以从百万人中精确地辩认出某个人。人脸的识别过程,利用普通的图像处理设备就能自动、连续、实时地完成。 实现方法 基于OpenCv人脸识别设计方案 1 系统组成 以OpenCV 图像处理库为基础,利用库中提供的相关功能函数进行各种处理:通过相机对图像数据进行采集,人脸检测主要是调用已训练好的Haar 分类器来对采集的图像进行模

式匹配,检测结果利用PCA 算法可进行人脸图像训练与身份识别,而人脸表情识别则利用了Camshift 跟踪算法和Lucas–Kanade 光流算法。

移动机器人的自主导航控制 一、研究的背景 移动机器人是一个集环境感知、动态决策与规划、行为控制与执行等多功能于一体的综合系统。它集中了传感器技术、计算机技术、机械工程、电子工程、自动化控制工程以及人工智能等多学科的研究成果,是目前科学技术发展最活跃的领域之一。随着机器人性能不断地完善,移动机器人的应用范围大为扩展,不仅在工业、农业、国防、医疗、服务等行业中得到广泛的应用,而且在排雷、搜捕、救援、辐射和空间领域等有害与危险场合都得到很好的应用。因此,移动机器人技术已经得到世界各国的普遍关注。 在自主式移动机器人相关技术的研究中,导航技术是其研究核心,同时也是移动机器人实现智能化及完全自主的关键技术。导航是指移动机器人通过传感器感知环境信息和自身状态,实现在有障碍的环境中面向目标的自主运动。导航主要解决以下三方面的问题:(l)通过移动机器人的传感器系统获取环境信息;(2)用一定的算法对所获信息进行处理并构建环境地图;(3)根据地图实现移动机器人的路径规划及运动控制。 二、相关技术 移动机器人定位是指确定机器人在工作环境中相对于全局坐标的位置,是移动机器人导航的基本环节。定位方法根据机器人工作环境的复杂性、配备传感器种类和数量等方面的不同而采用多种方法。主要方法有惯性定位、标记定位、GPS定位、基于地图的定位等,它们都不同程度地适用于各种不同的环境,括室内和室外环境,结构化环境与非结构化环境。 惯性定位是在移动机器人的车轮上装有光电编码器,通过对车轮转动的记录来粗略地确定移动机器人位置。该方法虽然简单,但是由于车轮与地面存在打滑现象,生的累积误差随路径的增加而增大,导致定位误差的逐渐累积,从而引起更大的差。 标记定位法是在移动机器人工作的环境里人为地设置一些坐标已知的标记,超声波发射器、激光反射板等,通过机器人的传感器系统对标记的探测来确定机器人在全局地图中的位置坐标。三角测量法是标记定位中常用的方法,机器人在同一点探测到三个陆标,并通过三角几何运算,由此可确定机器人在工作环境中的坐标。标记定位是移动机器人定位中普遍采用的方法,其可获得较高的定位精度且计量小,但是在实际应用中需要对环境作一些改造,添加相应的标记,不太符合真正意义的自主导航。 GPS定位是利用环绕地球的24颗卫星,准确计算使用者所在位置的庞大卫星网 定位系统。GPS定位技术应用已经非常广泛,除了最初的军事领域外,在民用方面也得到了广泛的应用,但是因为在移动导航中,移动GPS接收机定位精度受到卫 星信号状况和道路环境的影响,同时还受到时钟误差、传播误差、接收机噪声

第9卷 第7期2004年7月 中国图象图形学报Journal of Image and G raphics V ol.9,N o.7July 2004 基金项目:国家“863”计划资助项目(编号:2001AA422200)收稿日期:2004201213;改回日期:2004204206 基于路径识别的移动机器人视觉导航 张海波 原 魁 周庆瑞 (中国科学院自动化研究所高技术创新中心,北京 100080) 摘 要 跟随路径导引是自主式移动机器人广泛采用的一种导航方式,其中视觉导航具有其他传感器导航方式所无法比拟的优点,是移动机器人智能导航的主要发展方向。为了提高移动机器人视觉导航的实时性和准确性,提出了一个基于路径识别的视觉导航系统,其基本思想是首先用基于变分辨率的采样二值化和形态学去噪方法从原始场景图像中提取出目标支持点集,然后用一种改进的哈夫变化检测出场景中的路径,最后由路径跟踪模块分直行和转弯两种情况进行导航计算。实验结果表明,该视觉导航系统具有较好的实时性和准确性。关键词 自主式移动机器人 视觉导航 路径识别 中图法分类号:TP242.62 文献标识码:A 文章编号:100628961(2004)0720853205 Visual N avigation of a Mobile R obot B ased on P ath R ecognition ZH ANG Hai 2bo ,Y UAN K ui ,ZH OU Qing 2rui (Hi 2tech Innovation Centre ,Institute o f Automation ,Chinese Academy o f Sciences ,Beijing 100080) Abctract G uidance using path following is widely applied in the field of autonom ous m obile robots.C om pared with the navigation system without vision ,visual navigation has obvious advantages as rich in formation ,low cost ,quietness ,innocuity ,etc.This pa 2per describes a navigation system which uses the visual in formation provided by guide lines and color signs.In our approach ,the visual navigation is com posed of three main m odules :image 2preprocessing ,path 2recognition and path 2tracking.First ,image 2pre 2processing m odule formulates color m odels of all kinds of objects ,and establishes each object ’s support through adaptive subsam 2pling 2based binarization and mathematical m orphology.Second ,path 2recognition m odule detects the guide lines through an im 2proved H ough trans form alg orithm ,and the detected results including guide lines and color signs integrate the path in formation.Fi 2nally ,calling different functions according to the m ovement of straight 2g oing or turning ,path 2tracking m odule provides required in 2put parameters to m otor controller and steering controller.The experimental results dem onstrate the effectiveness and the robustness of our approach. K eyw ords com puter perception ,autonom ous m obile robot ,visual navigation ,path recognition 1 引 言 导航技术是移动机器人的一项核心技术,其难 度远远超出人们最初的设想,其主要原因有:一是环境的动态变化和不可预测;二是机器人感知手段的不完备,即很多情况下传感器给出的数据是不完全、不连续、不可靠的[1]。这些原因使得机器人系统在复杂度、成本和可靠性方面很难满足要求。 目前广泛应用的一种导航方式是“跟随路径导 引”,即机器人通过对能敏感到的某些外部的连续路 径参照线作出相应反应来进行导航[2]。这种方法和传统的“硬”自动化相比大大增加了系统的灵活性,其具有代表性的系统有:C ontrol Engineering 公司安装的导线引导系统,它是通过检测埋在地下的引导导线来控制行进方向,其线路分岔则通过在导线上加载不同频率的电流来实现[3];Egemin Automation 公司生产的Mailm obile 机器人则安装有主动式紫外光源,并通过3个光电探头来跟随由受激化学物质构成的发光引导路径[4];Macome 公司为自动驾驶车

机器人视觉系统系统基本组成:CCD、PCI、PC及其外设等 1.机器人视觉 机器人研究的核心就是:导航定位、路径规划、避障、多传感器融合。定位技术有几种,不关心,只关心视觉的。视觉技术用到“眼睛”可以分为:单目,双目,多目、RGB-D,后三种可以使图像有深度,这些眼睛亦可称为VO(视觉里程计:单目or立体),维基百科给出的介绍:在机器人和计算机视觉问题中,视觉里程计就是一个通过分析处理相关图像序列来确定机器人的位置和姿态。 当今,由于数字图像处理和计算机视觉技术的迅速发展,越来越多的研究者采用摄像机作为全自主用移动机器人的感知传感器。这主要是因为原来的超声或红外传感器感知信息量有限,鲁棒性差,而视觉系统则可以弥补这些缺点。而现实世界是三维的,而投射于摄像镜头(CCD/CMOS)上的图像则是二维的,视觉处理的最终目的就是要从感知到的二维图像中提取有关的三维世界信息。 2.系统基本组成:CCD、PCI、PC及其外设等。 2.1 CCD/CMOS一行硅成像元素,在一个衬底上配置光敏元件和电荷转移器件,通过电荷的依次转移,将多个象素的视频信号分时、顺序地取出来,如面阵CCD传感器采集的图像的分辨率可以从32×32到1024×1024像素等。 2.2视频数字信号处理器图像信号一般是二维信号,一幅图像通常由512×512个像素组成(当然有时也有256×256,或者1024×1024个像素),每个像素有256级灰度,或者是3×8bit,红黄兰16M种颜色,一幅图像就有256KB或者768KB(对于彩色)个数据。为了完成视觉处理的传感、预处理、分割、描述、识别和解释,上述前几项主要完成的数学运算可归纳为: (1)点处理常用于对比度增强、密度非线性较正、阈值处理、伪彩色处理等。每个像素的输入数据经过一定关系映射成像素的输出数据,例如对数变换可实现暗区对比度扩张。(2)二维卷积的运算常用于图像平滑、尖锐化、轮廓增强、空间滤波、标准模板匹配计算等。

自主移动机器人智能导航研究进展 冯建农 柳 明 吴 捷 (华南理工大学计算机系 广州 510641)摘 要 本文对当前在自主移动机器人智能导航研究中已被采用并取得成果的研究方法进行了 综述,并根据已取得的成果预测了移动机器人智能导航研究的发展趋势,指出视觉导航和传感器融合将是移动机器人智能导航的主要发展方向. 关键词 移动机器人,智能系统,导航 1 引言 国际机器人研究在经过了80年代的低潮之后,呈现出复苏和继续发展的形势;我国的机器人研究在国家“七五”、“八五”及“863”计划的推动下也取得了很大进展.与70年代的机器人浪潮相比,现在的机器人研究有两个特点:一是对机器人智能的定位有了更加符合实际的标准,也就是不要求机器人具有象人类一样的高智能,而只是要求机器人在某种程度上具有自主处理问题的能力;另一个特点是许多新技术及控制方法(神经网络、传感器融合、虚拟现实、高速度的并行处理机等)被引入到机器人研究中.研究重点的转变使机器人研究走向了健康而平稳的发展道路,并不断取得新的研究成果. 智能自主移动机器人能够按照存储在其内部的地图信息,或根据外部环境所提供的一些引导信号(即通过对环境的实时探测所获得的信息)规划出一条路径,并能够沿着该路径在没有人工干预的情况下,移动到预定目标点.智能自主移动机器人对它的研究正在成为一个重要的研究热点. 由于机器人应用从制造业向非制造业的扩展,以及自主移动智能机器人在诸如野外作业、深海探测、以及一些人类本身所不能进入的有毒或高温环境的作业中,有着极其广泛的应用前景,因此近年来机器人研究在多方面都已取得了很大的进展.研究的成果必将成为各行各业提高生产力的强有力工具. 2 移动机器人导航分类 移动机器人有多种导航方式,根据环境信息的完整程度、导航指示信号类型、导航地域等因素的不同,可以分为基于地图导航、基于陆标导航、基于视觉导航、基于感知器导航等. 基于地图的导航是在机器人内部存有关于环境的完整信息,并在预先规划出的一条全局路线的基础上,采用路径跟踪和避障技术,实现机器人导航;当机器人对周围环境并不完全了解时,则可采用基于陆标的导航策略,也就是将环境中具有明显特征的景物存储在机器人内部,机器人通过对陆标的探测来确定自己的位置,并将全局路线分解成陆标与陆标之间的片段,再通过一连串的陆标探测和陆标制导来完成导航任务;在环境信息完全未知的情况下,可1997年11月机器人 R OBOT N ov.,1997 1996-11-04收稿