0 前言

工作之余,时常会想能做点什么有意思的玩意。互联网时代,到处都是互联网思维,大数据、深度学习、人工智能,这些新词刮起一股旋风。所以笔者也赶赶潮流,买了本Python爬虫书籍研读起来。

网络爬虫,顾名思义就是将互联网上的内容按照自己编订的规则抓取保存下来。理论上来讲,浏览器上只要眼睛能看到的网页内容都可以抓起保存下来,当然很多网站都有自己的反爬虫技术,不过反爬虫技术的存在只是增加网络爬虫的成本而已,所以爬取些有更有价值的内容,也就对得起技术得投入。

1案例选取

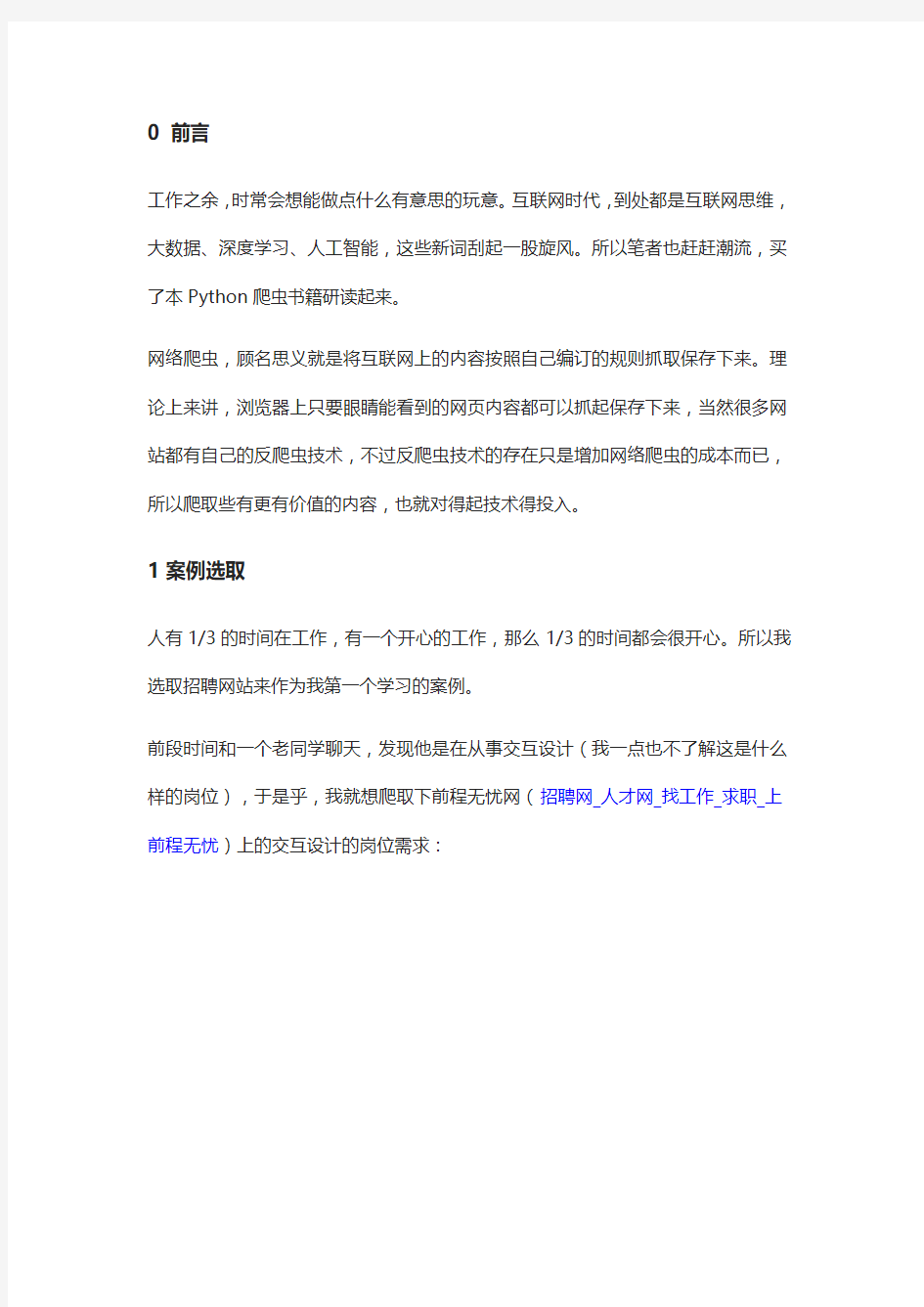

人有1/3的时间在工作,有一个开心的工作,那么1/3的时间都会很开心。所以我选取招聘网站来作为我第一个学习的案例。

前段时间和一个老同学聊天,发现他是在从事交互设计(我一点也不了解这是什么样的岗位),于是乎,我就想爬取下前程无忧网(招聘网_人才网_找工作_求职_上前程无忧)上的交互设计的岗位需求:

2实现过程

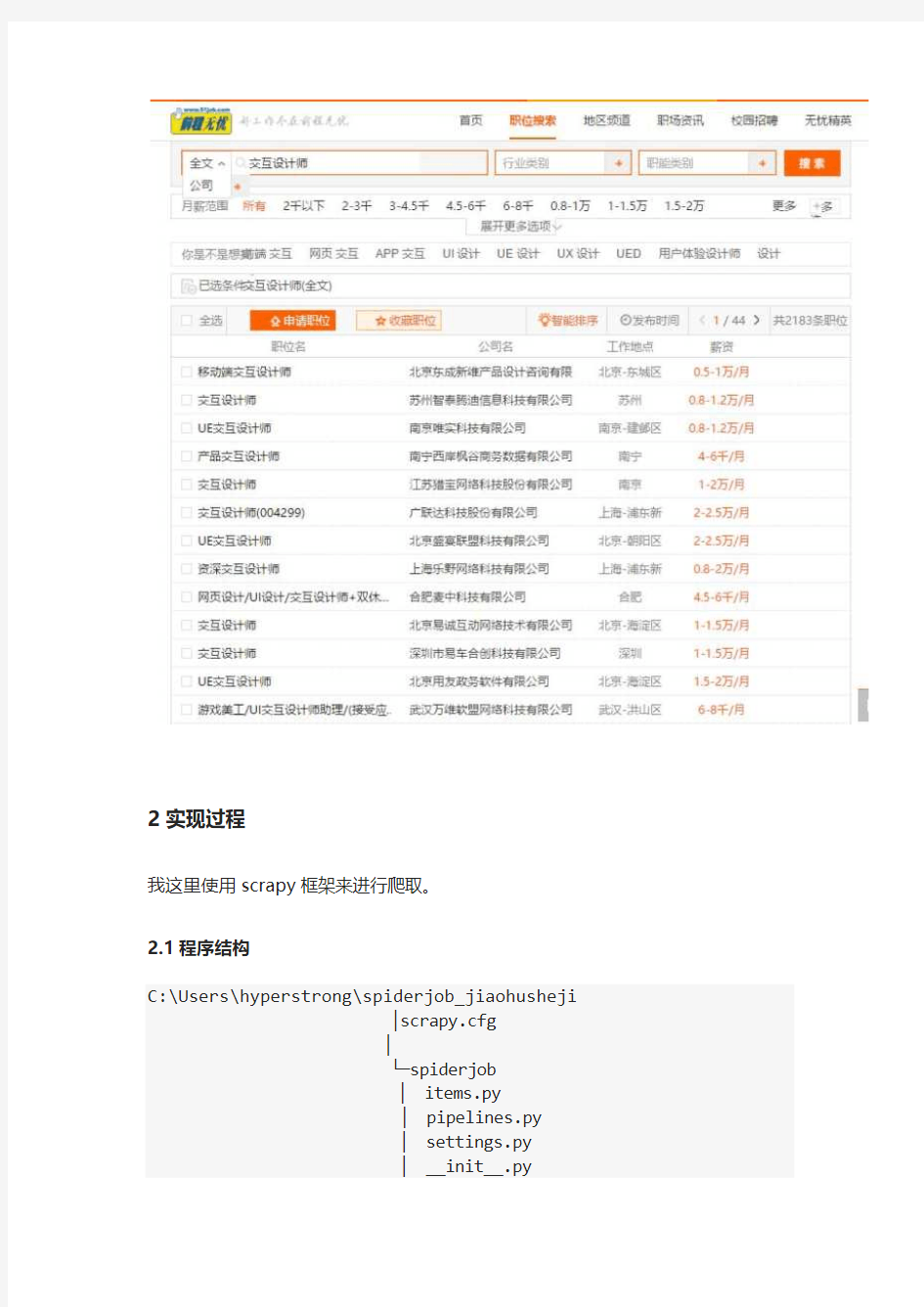

我这里使用scrapy框架来进行爬取。

2.1程序结构

C:\Users\hyperstrong\spiderjob_jiaohusheji │scrapy.cfg

│

└─spiderjob

│ items.py

│ pipelines.py │ settings.py │ __init__.py

│ middlewares.py

├─spiders

│ jobSpider.py

│ __init__.py

其中:

items.py是从网页抽取的项目

jobSpider.py是主程序

2.2链接的构造

用浏览器打开前程无忧网站 招聘网_人才网_找工作_求职_上前程无忧,在职务搜索里输入“交互设计师”,搜索出页面后,观察网址链接:

【交互设计师招聘】前程无忧手机网_触屏版

https://www.doczj.com/doc/0b14970514.html,/jobsearch/search_result.php?fromJs=1&k eyword=%E4%BA%A4%E4%BA%92%E8%AE%BE%E8%AE%A1%E5%B8%88&keywordty pe=2&lang=c&stype=2&postchannel=0000&fromType=1&confirmdate=9 网址链接中并没有页码,于是选择第二页,观察链接:

红色标记的为页码,于是可以通过更改此处数字来实现从“第1页”到第44页“的网页自动跳转。当然读者也可以通过网页内容抓取处下一页的链接进行自动翻页,有兴趣的网友可以试下:

2.3网页分析

我要抓取的几个数据分别是

职位名

公司名

工作地点

薪资

发布时间

截图如下,右侧是浏览器-开发者工具(F12)里查找的源代码,和网页对应查看:

2.4数据字段:items.py

# -*- coding: utf-8 -*-

# Define here the models for your scraped items

# See documentation in:

# https://www.doczj.com/doc/0b14970514.html,/en/latest/topics/items.html

import scrapy

class SpiderjobItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

jobname = scrapy.Field()

companyname= scrapy.Field()

workingplace= scrapy.Field()

salary= scrapy.Field()

posttime= scrapy.Field()

2.5主要运行程序

我是用的python2.7编写的,并且使用XPath表达式进行数据的筛选和提取。

# -*- coding: utf-8 -*-

from scrapy import Request

from scrapy.spiders import Spider

from spiderjob.items import SpiderjobItem

class jobSpider(Spider):

name ='jobSpider'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/49.0.2623.75 Safari/537.36 LBBROWSER',

'Accept':'text/css,*/*;q=0.1',

'Accept-Encoding':'gzip, deflate, sdch',

'Accept-Language':'zh-CN,zh;q=0.8',

'Referer':'close',

'Host':'https://www.doczj.com/doc/0b14970514.html,'};

def start_requests(self):

url1 =

'https://www.doczj.com/doc/0b14970514.html,/list/000000,000000,0000,00,9,99,%25E4 %25BA%25A4%25E4%25BA%2592%25E8%25AE%25BE%25E8%25AE%25A1%25E5%2 5B8%2588,2,'

url2 =

'.html?lang=c&stype=1&postchannel=0000&workyear=99&cotype=99&d egreefrom=99&jobterm=99&companysize=99&lonlat=0%2C0&radius=-1& ord_field=0&confirmdate=9&fromType=1&dibiaoid=0&address=&line= &specialarea=00&from=&welfare='

url = url1 +'1'+ url2

yield Request(url, headers=self.headers)

def parse(self, response):

item = SpiderjobItem()

jobs =

response.xpath('//div[@class="dw_table"]/div[@class="el"]') for job in jobs:

item['companyname'] = job.xpath(

'.//span[@class="t2"]/a[@target="_blank"]/text()').extract()[0 ]

item['workingplace'] = job.xpath(

'.//span[@class="t3"]/text()').extract()[0]

item['salary'] = job.xpath(

'.//span[@class="t4"]/text()').extract()

item['posttime'] =

job.xpath('.//span[@class="t5"]/text()').extract()[0]

item['jobname'] = job.xpath(

'.//p[@class="t1

"]/span/a[@target="_blank"]/text()').extract()[0]

yield item

for i in range(2,44):

url1 =

'https://www.doczj.com/doc/0b14970514.html,/list/000000,000000,0000,00,9,99,%25E4 %25BA%25A4%25E4%25BA%2592%25E8%25AE%25BE%25E8%25AE%25A1%25E5%2 5B8%2588,2,'

url2 =

'.html?lang=c&stype=1&postchannel=0000&workyear=99&cotype=99&d egreefrom=99&jobterm=99&companysize=99&lonlat=0%2C0&radius=-1& ord_field=0&confirmdate=9&fromType=1&dibiaoid=0&address=&line= &specialarea=00&from=&welfare='

next_url = url1 +str(i)+ url2

yield Request(next_url,

headers=self.headers,callback=self.parse)

2.6抓取效果:

在开始运行里输入里cmd,修改路径为

C:\Users\hyperstrong\spiderjob_jiaohusheji 。然后输入scrapy crawl jobSpder -o jiaohusheji.csv

3数据进行简单分析

从excel表格里抽取2个特征:薪资和城市

分析不同城市的交互设计岗位 平均薪资

分析不同城市对于交互设计岗位需求,即在该城市是否容易找到工作说干就干,代码奉上:

#!/usr/bin/python

# -*- coding: UTF-8 -*-

import pandas as pd

import numpy as np

from datetime import datetime

import matplotlib.pyplot as plt

import sys

import re

import csv

import string

def analyze_job_demand (filepath):

data = pd.read_csv(filepath)

wp=[]

num=len(data['workingplace'])

for i in range(0,num-1):

a=data['workingplace'].ix[i].decode('utf-8') b=a[0:2].encode('utf-8')

wp.append(b)

bj=wp.count('北京')

sh=wp.count('上海')

gz=wp.count('广州')

sz=wp.count('深圳')

wh=wp.count('武汉')

cd=wp.count('成都')

cq=wp.count('重庆')

zz=wp.count('郑州')

nj=wp.count('南京')

sz1=wp.count('苏州')

hz=wp.count('杭州')

xa=wp.count('西安')

dl=wp.count('大连')

qd=wp.count('青岛')

cs=wp.count('长沙')

nc=wp.count('南昌')

hf=wp.count('合肥')

nb=wp.count('宁波')

km=wp.count('昆明')

last=num-bj-sh-gz-sz-wh-cd-cq-nj-sz1-hz-xa-cs-hf print( u'武汉的交互设计相关岗位占全国的需求比例为:'+

str(float(wh)/num*100)+'%')

print( u'苏州的交互设计相关岗位占全国的需求比例为:'+

str(float(sz1)/num*100)+'%')

print( u'杭州的交互设计相关岗位占全国的需求比例为:'+

str(float(hz)/num*100)+'%')

print( u'合肥的交互设计相关岗位占全国的需求比例为:'+

str(float(hf)/num*100)+'%')

print( u'长沙的交互设计相关岗位占全国的需求比例为:'+

str(float(cs)/num*100)+'%')

print( u'北京的交互设计相关岗位占全国的需求比例为:'+

str(float(bj)/num*100)+'%')

print( u'上海的交互设计相关岗位占全国的需求比例为:'+

str(float(sh)/num*100)+'%')

print( u'广州的交互设计相关岗位占全国的需求比例为:'+

str(float(gz)/num*100)+'%')

print( u'深圳的交互设计相关岗位占全国的需求比例为:'+

str(float(sz)/num*100)+'%')

print( u'重庆的交互设计相关岗位占全国的需求比例为:'+

str(float(cq)/num*100)+'%')

print( u'成都的交互设计相关岗位占全国的需求比例为:'+

str(float(cd)/num*100)+'%')

print( u'南京的交互设计相关岗位占全国的需求比例为:'+

str(float(nj)/num*100)+'%')

print( u'西安的交互设计相关岗位占全国的需求比例为:'+

str(float(xa)/num*100)+'%')

#绘制饼图

#调节图形大小,宽,高

plt.figure(figsize=(6,9))

#定义饼状图的标签,标签是列表

labels =

['shanghai','shenzhen','beijing','guangzhou','hangzhou','wuhan

','chengdu','chongqing','nanjing','suzhou','xian','changsha',' hefei','else']

sizes = [sh,sz,bj,gz,hz,wh,cd,cq,nj,sz1,xa,cs,hf,last]

colors =

['red','yellowgreen','lightskyblue','blue','pink','coral','ora nge']

#将某部分爆炸出来,使用括号,将第一块分割出来,数值的大小是分割出来的与其他两块的间隙

explode = (0.05,0,0,0,0,0,0,0,0,0,0,0,0,0)

patches,l_text,p_text =

plt.pie(sizes,explode=explode,labels=labels,colors=colors,

labeldistance =1.1,autopct =

'%3.1f%%',shadow =False,

startangle =90,pctdistance =0.6) #labeldistance,文本的位置离远点有多远,1.1指1.1倍半径的位置#autopct,圆里面的文本格式,%3.1f%%表示小数有三位,整数有一位的浮点数

#shadow,饼是否有阴影

#startangle,起始角度,0,表示从0开始逆时针转,为第一块。一般选择从90度开始比较好看

#pctdistance,百分比的text离圆心的距离

#patches, l_texts, p_texts,为了得到饼图的返回值,p_texts饼图内部文本的,l_texts饼图外label的文本

#改变文本的大小

#方法是把每一个text遍历。调用set_size方法设置它的属性

for t in l_text:

t.set_size=(30)

for t in p_text:

t.set_size=(40)

# 设置x,y轴刻度一致,这样饼图才能是圆的

plt.axis('equal')

#图形中的文字无法通过rcParams设置

plt.legend()

plt.show()

def analyze_salary(filepath):

data = pd.read_csv(filepath)

chengshi=[u'北京',u'上海',u'广州',u'深圳',u'武汉',u'成都',u'

重庆',u'郑州',u'南京',u'苏州',u'杭州',u'西安',u'大连',u'青岛',u'长沙',u'南昌',u'合肥',u'宁波',u'昆明']

city_salary=[]

salary=[]

num=len(data['workingplace'])

for j in range(0,18):

city=chengshi[j]

for i in range(0,num-1):

a=data['workingplace'].ix[i].decode('utf-8')

if a.find(city)!=-1:

if data['salary'].ix[i] :

c=str(data['salary'].ix[i])

d=c.decode('utf-8')

if d.find(u'万/月')!=-1:

pattern=https://www.doczj.com/doc/0b14970514.html,pile('\d+\.?\d*',re.S)

items = re.findall(pattern,c)

ave=(float(items[0])+float(items[1]))/2 sal=float(ave)*10

elif d.find(u'千/月')!=-1:

pattern=https://www.doczj.com/doc/0b14970514.html,pile('\d+\.?\d*',re.S)

items = re.findall(pattern,c)

ave=(float(items[0])+float(items[1]))/2 sal=float(ave)*1

elif d.find(u'万/年')!=-1:

pattern=https://www.doczj.com/doc/0b14970514.html,pile('\d+\.?\d*',re.S)

items = re.findall(pattern,c)

ave=(float(items[0])+float(items[1]))/2 sal=float(ave)*0.8333

salary.append(sal)

ave=sum(salary)/len(salary)

print( chengshi[j] +u'的交互设计相关岗位的平均工资为:'+ str(ave) +u'千/月')

city_salary.append(ave)

salary=[]

with

open('C:\Users\hyperstrong\spiderjob_jiaohusheji\salary.csv', 'wb') as f:

writer = csv.writer(f)

chengshi_encode=[]

for k in range(0,18):

chengshi_encode.append(chengshi[k].encode('utf-8')) writer.writerow(chengshi_encode)

writer.writerow(city_salary)

f.close()

if __name__ =='__main__':

filepath =input('Please enter the filename:')

analyze_salary(filepath)

analyze_job_demand (filepath)

运行程序,输入excel的路径:

r'C:\Users\hyperstrong\spiderjob_jiaohusheji\jiaohusheji.csv'(注意路径前加 r,去掉转移字符)

效果如下:

不同城市的岗位需求量占全国总需求的比例,自动生产的饼图:

保存的excel绘制出不同城市的该岗位的平均薪资的柱状图,如下:

从以上几图可以看出:

1.北京的交互设计平均工资最高

2.杭州的交互设计需求和平均工资都已经是一线城市的水平,怪不得很多IT人才往杭

州跑

3.江浙沪的需求量占了半壁江山

结束语

弄了这么半天,从城市需求、平均工资方面我已经对这个岗位有了初步认识。如果我是一个即将毕业并想从事该工作的大学生,看到这些,应该会有些帮助。不过实际选择会更加困难,不同的城市竞争是不一样的,房贷压力、幸福指数、城市的行业分布、城市未来发展潜力都不不一样。于是我想到:如何从不同城市各个行业求职情况,来看出城市的幸福指数、发展潜力。找个时间研究下~~~///(^v^)\\\~~~

超全的python教程网盘分享 Python由于其简单,快速,库丰富的特点在国内使用的越来越广泛。最近几年它出现了爆发式的增长,而且与中国人密切相关。所以,人多真的力量大啊!好,小编重点该提重点了。python教程网盘在此,请点击以下链接: 千锋Python基础教程:https://www.doczj.com/doc/0b14970514.html,/s/1qYTZiNE Python课程教学高手晋级视频总目录: https://www.doczj.com/doc/0b14970514.html,/s/1hrXwY8k Python课程windows知识点:https://www.doczj.com/doc/0b14970514.html,/s/1kVcaH3x Python课程linux知识点:https://www.doczj.com/doc/0b14970514.html,/s/1i4VZh5b Python课程web知识点:https://www.doczj.com/doc/0b14970514.html,/s/1jIMdU2i Python课程机器学习:https://www.doczj.com/doc/0b14970514.html,/s/1o8qNB8Q Python 多用途是高级编程脚本语言Python的特点,可以写出一般的桌面程序、桌面界面程序(结合wx等扩展包)、web服务器、web客户端等等,并且某种程度上还允许跨平台。 另外,python在进行系统命令、网络传输协议、字符处理方面具有优

势,因此被很多大型项目作为粘合剂来使用。 可能因为云计算、大数据和机器学习,也可能因为学习编程的人多了,也可能......总之,Python 热度不减。而在众多语言中,大部分人选择了学习Python。 Python 有大量的自带以及第三方库,因此Python 比其他的很多语言更有效率。如果你不知道为何Python 是如此的小巧和高效,千锋小编建议你借此机会学习Python,同时自己多加实践。 想选机构培训却无从下手?来千锋吧。千锋教育通过前期企业调研,将潮流技术完美融入课程体系,实用性强,摒弃无用讲解,只为给你最极致的教学 体验。 千锋Python人工智能培训是真正的Python全栈开发,包含Python项目,爬虫、服务集群、网站后台、微信公众号开发,Python机器学习与数据挖掘,数据分析框架与实战,Python物联网树莓派的开发等。 千锋坚持100%全程面授,三师护航(讲师,项目老师,就业老师),23周让你历经行业小白到技术牛人的进阶!

基于p y t h o n的网络爬虫 设计 Last updated on the afternoon of January 3, 2021

基于python的网络爬虫设计 【摘要】近年来,随着网络应用的逐渐扩展和深入,如何高效的获取网上数据成为了无数公司和个人的追求,在大数据时代,谁掌握了更多的数据,谁就可以获得更高的利益,而网络爬虫是其中最为常用的一种从网上爬取数据的手段。网络爬虫,即WebSpider,是一个很形象的名字。如果把互联网比喻成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛。网络蜘蛛是通过网页的链接地址来寻找网页的。从网站某一个页面(通常是首页)开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一直循环下去,直到把这个网站所有的网页都抓取完为止。如果把整个互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。那么,既然网络爬虫有着如此先进快捷的特点,我们该如何实现它呢?在众多面向对象的语言中,首选python,因为python是一种“解释型的、面向对象的、带有动态语义的”高级程序,可以使人在编程时保持自己的风格,并且编写的程 序清晰易懂,有着很广阔的应用前景。 关键词python爬虫数据 1前言 本编程设计的目的和意义 随着网络的迅速发展,万维网成为大量信息的载体,如何有效地提取并利用这些信息成为一个巨大的挑战。搜索引擎(例如传统的通用搜索引擎AltaVista,Yahoo!和Google等)作为一个辅助人们检索信息的工具成为用户访问万维网的入口和指南。但是,这些通用性搜索引擎也存在着一定的局限性,如:(1)不同领域、不同背景的用户往往具有不同的检索目的和需求,通用搜索引擎所返回的结果包含大量用户不关心的网页。(2)通用搜索引擎的目标是尽可能大的网络覆盖率,有限的搜索引擎服务器资源与无限的网络数据资源之间的矛盾将进一步加深。(3)万维网数据形式的丰富和网络技术的不断发展,图片、数据库、音频/视频多媒体等不同数据大量出现,通用搜索引擎往往对这些信息含量密集且具有一定结构的数据无能为力,不能很好地发现和获取。(4)通用搜索引擎大多提供基于关键字的检索,难以支持根据语义信息提出的查询。为了解决上述问题,定向抓取相关网页资源的聚焦爬虫应运而生。聚焦爬虫是一个自动下载网页的程序,它根据既定的抓取目标,有选择的访问万维网上的网页与相关的链接,获取所需要的信息。与通用爬虫(generalpurposewebcrawler)不同,聚焦爬虫并不追求大的覆盖,而将目标定为抓取与某一特定主题内容相关的网页,为面向主题的用户查询准备数据资源。 编程设计目及思路 学习了解并熟练掌握python的语法规则和基本使用,对网络爬虫的基础知识进行了一定程度的理解,提高对网页源代码的认知水平,学习用正则表达式来完成匹配查找的工作,了解数据库的用途,学习mongodb数据库的安装和使用,及配合python的工作。 (1)以世纪佳缘网为例,思考自己所需要的数据资源,并以此为基础设计自己的爬虫程序。 (2)应用python伪装成浏览器自动登陆世纪佳缘网,加入变量打开多个网页。 (3)通过python的urllib2函数进行世纪佳缘网源代码的获取。 (4)用正则表达式分析源代码,找到所需信息导入excel。

第1章Python爬虫环境与爬虫简介 教案 课程名称:Python网络爬虫技术 课程类别:必修 适用专业:大数据技术类相关专业 总学时:32学时(其中理论14学时,实验18学时) 总学分:2.0学分 本章学时:2学时 一、材料清单 (1)《Python网络爬虫技术》教材。 (2)配套PPT。 (3)引导性提问。 (4)探究性问题。 (5)拓展性问题。 二、教学目标与基本要求 1.教学目标 先对爬虫的概念和原理,及反爬虫的概念进行基本的概述,列举针对反爬虫的常用手段制定对应爬取策略。而后简要介绍了Python常用爬虫库和爬虫环境,以及用于存储爬取的数据的MySQL、MongoDB数据库。 2.基本要求 (1)了解爬虫的原理。

(2)了解爬虫运作时应遵守的规则。 (3)了解反爬虫的目的和常用手段。 (4)了解Python常用爬虫库。 (5)掌握MySQL、MongoDB数据库的配置方法。 三、问题 1.引导性提问 引导性提问需要教师根据教材内容和学生实际水平,提出问题,启发引导学生去解决问题,提问,从而达到理解、掌握知识,发展各种能力和提高思想觉悟的目的。 (1)爬虫能够做什么? (2)爬虫能爬哪些数据? (3)Python语言在爬虫方面有哪些优势? 2.探究性问题 探究性问题需要教师深入钻研教材的基础上精心设计,提问的角度或者在引导性提问的基础上,从重点、难点问题切入,进行插入式提问。或者是对引导式提问中尚未涉及但在课文中又是重要的问题加以设问。 (1)爬虫能够应用在那些场景? (2)爬虫的原理是什么? 3.拓展性问题 拓展性问题需要教师深刻理解教材的意义,学生的学习动态后,根据学生学习层次,提出切实可行的关乎实际的可操作问题。亦可以提供拓展资料供学生研习探讨,完成拓展性问题。 (1)爬虫是不是万能的? (2)爬虫在数据分析有哪些作用?

0 前言 工作之余,时常会想能做点什么有意思的玩意。互联网时代,到处都是互联网思维,大数据、深度学习、人工智能,这些新词刮起一股旋风。所以笔者也赶赶潮流,买了本Python爬虫书籍研读起来。 网络爬虫,顾名思义就是将互联网上的内容按照自己编订的规则抓取保存下来。理论上来讲,浏览器上只要眼睛能看到的网页内容都可以抓起保存下来,当然很多网站都有自己的反爬虫技术,不过反爬虫技术的存在只是增加网络爬虫的成本而已,所以爬取些有更有价值的内容,也就对得起技术得投入。 1案例选取 人有1/3的时间在工作,有一个开心的工作,那么1/3的时间都会很开心。所以我选取招聘网站来作为我第一个学习的案例。 前段时间和一个老同学聊天,发现他是在从事交互设计(我一点也不了解这是什么样的岗位),于是乎,我就想爬取下前程无忧网(招聘网_人才网_找工作_求职_上前程无忧)上的交互设计的岗位需求:

2实现过程 我这里使用scrapy框架来进行爬取。 2.1程序结构 C:\Users\hyperstrong\spiderjob_jiaohusheji │scrapy.cfg │ └─spiderjob │ items.py │ pipelines.py │ settings.py │ __init__.py

│ middlewares.py ├─spiders │ jobSpider.py │ __init__.py 其中: items.py是从网页抽取的项目 jobSpider.py是主程序 2.2链接的构造 用浏览器打开前程无忧网站 招聘网_人才网_找工作_求职_上前程无忧,在职务搜索里输入“交互设计师”,搜索出页面后,观察网址链接: 【交互设计师招聘】前程无忧手机网_触屏版 https://www.doczj.com/doc/0b14970514.html,/jobsearch/search_result.php?fromJs=1&k eyword=%E4%BA%A4%E4%BA%92%E8%AE%BE%E8%AE%A1%E5%B8%88&keywordty pe=2&lang=c&stype=2&postchannel=0000&fromType=1&confirmdate=9 网址链接中并没有页码,于是选择第二页,观察链接:

千锋教育Python入门教程 有人说,看着Python简单易学,想尝试自学,打算找些入门教程自学Python,不知道哪的视频好。现在,你可来对地方了,接下来附上千锋教育Python入门教程的链接。 千锋Python基础教程:https://www.doczj.com/doc/0b14970514.html,/s/1qYTZiNE Python课程教学高手晋级视频总目录: https://www.doczj.com/doc/0b14970514.html,/s/1hrXwY8k Python课程windows知识点:https://www.doczj.com/doc/0b14970514.html,/s/1kVcaH3x Python课程linux知识点:https://www.doczj.com/doc/0b14970514.html,/s/1i4VZh5b Python课程web知识点:https://www.doczj.com/doc/0b14970514.html,/s/1jIMdU2i Python课程机器学习:https://www.doczj.com/doc/0b14970514.html,/s/1o8qNB8Q Python 看完视频,建议你了解一下Python可以做什么: 1.网站后端程序员:使用它单间网站,后台服务比较容易维护。如:Gmail 、Youtube、知乎、豆瓣;

2.自动化运维:自动化处理大量的运维任务; 3.数据分析师:快速开发快速验证,分析数据得到结果; 4.游戏开发者:一般是作为游戏脚本内嵌在游戏中; 5.自动化测试:编写为简单的实现脚本运用在Selenium/lr,可实现自动化; 6.网站开发:借助django,flask框架自己搭建网站; 7.爬虫获取或处理大量信息:批量下载美剧、运行投资策略、爬合适房源、系统管理员的脚本任务等。 千锋教育Python培训课程共23周10大阶段力造Python全栈工程师,直击月薪15000!内容包括3.Python语言基础2.7.3、Python 3.x 进阶与python第三方库、PyQt开发、Linux指令、Linux Shell、Linux python运维自动化、KaliLinux 安全课程、Linux 网站后台-python开发、Python 数据库MySQL Oracle开发、HTML5基础CSS基础。 当然,没说完,还有Java-Script JQuery基础、Python项目爬虫,服务集群,网站后台,微信公众号开发、Python机器学习与数据挖掘,数据分析

https://www.doczj.com/doc/0b14970514.html, python爬虫入门到精通必备的书籍 python是一种常见的网络爬虫语言,学习python爬虫,需要理论与实践相结合,Python生态中的爬虫库多如牛毛,urllib、urllib2、requests、beautifulsoup、scrapy、pyspider都是爬虫相关的库,但是如果没有理论知识,纯粹地学习如何使用这些API如何调用是不会有提升的。所以,在学习这些库的同时,需要去系统的学习爬虫的相关原理。你需要懂的技术包括Python编程语言、HTTP协议、数据库、Linux等知识。这样才能做到真正从入门python爬虫到精通,下面推荐几本经典的书籍。 1、Python语言入门的书籍: 适合没有编程基础的,入门Python的书籍 1、《简明Python教程》 本书采用知识共享协议免费分发,意味着任何人都可以免费获取,这

https://www.doczj.com/doc/0b14970514.html, 本书走过了11个年头,最新版以Python3为基础同时也会兼顾到Python2的一些东西,内容非常精简。 2、《父与子的编程之旅》 一本正儿八经Python编程入门书,以寓教于乐的形式阐述编程,显得更轻松愉快一些。 3、《笨办法学Python》 这并不是关于亲子关系的编程书,而是一本正儿八经Python编程入门书,只是以这种寓教于乐的形式阐述编程,显得更轻松愉快一些。 4、《深入浅出Python》 Head First 系列的书籍一直饱受赞誉,这本也不例外。Head First Python主要讲述了Python 3的基础语法知识以及如何使用Python

https://www.doczj.com/doc/0b14970514.html, 快速地进行Web、手机上的开发。 5、《像计算机科学家一样思考python》 内容讲解清楚明白,非常适合python入门用,但对于学习过其他编程语言的读者来说可能会觉得进度比较慢,但作者的思路和想法确实给人很多启发,对于菜鸟来说收益匪浅,书中很多例子还是有一定难度的,完全吃透也不容易。 6、《Python编程:入门到实践》 厚厚的一本书,本书的内容基础而且全面,适合纯小白看。Python学习进阶书籍 1、《Python学习手册》 本书解释详细,例子丰富;关于Python语言本身的讲解全面详尽而

Python网络爬虫实习报告

目录 一、选题背景.................................................................................... - 2 - 二、爬虫原理.................................................................................... - 2 - 三、爬虫历史和分类......................................................................... - 2 - 四、常用爬虫框架比较..................................................................... - 2 - 五、数据爬取实战(豆瓣网爬取电影数据)................................... - 3 -1分析网页 .. (3) 2爬取数据 (3) 3数据整理、转换 (4) 4数据保存、展示 (9) 5技术难点关键点 (10) 六、总结 ......................................................................................... - 13 -

一、选题背景 二、爬虫原理 三、爬虫历史和分类 四、常用爬虫框架比较 Scrapy框架:Scrapy框架是一套比较成熟的Python爬虫框架,是使用Python开发的快速、高层次的信息爬取框架,可以高效的爬取web页面并提取出结构化数据。Scrapy应用范围很广,爬虫开发、数据挖掘、数据监测、自动化测试等。 Crawley框架:Crawley也是Python开发出的爬虫框架,该框架致力于改变人们从互联网中提取数据的方式。 Portia框架:Portia框架是一款允许没有任何编程基础的用户可视化地爬取网页的爬虫框架。 newspaper框架:newspaper框架是一个用来提取新闻、文章以及内容分析的Python爬虫框架。 Python-goose框架:Python-goose框架可提取的信息包括:<1>文章主体内容;<2>文章主要图片;<3>文章中嵌入的任heYoutube/Vimeo视频;<4>元描述;<5>元标签

Python基础入门课程 --学习笔记 近期忽然有点迷上了爬虫Python,可能原因是最近人工智能,深度学习炒的比较热火有关。所以在网上搜了一大圈,想找点基础教程看看,发现还真不少,不过还真没有发现比较适合我这种菜鸟的教程,要么是英文的,要么一开始就讲的比较深,连测试环境都搭建不起了。让人一看就有点畏难放弃了。最后终于发现了唐老师的视频教程,好了,废话不多说,我就把我最近一段时间的学习笔记给大家分享一下。 要想学习Python,首先要搭建测试环境。本教程所用的环境如下: 一、测试环境: 系统:64位win7中文版 浏览器:Google Chrome,尽量不要用IE浏览器,测试中可能不能使用。 Python:Anaconda3-4.3.1-Windows-x86_64.exe Python可以自行通过Baidu自行搜索下载安装即可。 二、Python安装: 如果你能下载到上面的版本,直接双击运行安装即可,可以更改安装路径到D盘,因为占用空间比较大。我就是安装到D盘。安装完成后你就可以在开始菜单-所有程序-Anaconda3找到Jupyter Notebook。本次教程所有脚本全部在该notebook中运行和测试。

三、入门学习: 如果你顺利看到这里,并能在你的电脑上看到上面的截图,那么恭喜你,你已经成功的拥有了本次学习测试的环境。 1、打开Jupyter notebook。 路径:开始菜单-所有程序- Anaconda3找到Jupyter Notebook单击打开, 界面如下。如能打开Dos窗口,不能出现下面的截图,请尝试安装Google Chrome,并设置成默认浏览器即可解决。 单击上图中的New,从下来菜单中选择Python 3即可打开代码编辑窗口。 如下两图:

山东建筑大学 课程设计成果报告 题目:基于Python的网络爬虫设计课程:计算机网络A 院(部):管理工程学院 专业:信息管理与信息系统 班级: 学生姓名: 学号: 指导教师: 完成日期:

目录 1 设计目的 (1) 2 设计任务内容 (1) 3 网络爬虫程序总体设计 (1) 4 网络爬虫程序详细设计 (1) 4.1 设计环境和目标分析 (1) 4.1.1 设计环境 (1) 4.1.2 目标分析 (2) 4.2 爬虫运行流程分析 (2) 4.3 控制模块详细设计 (3) 4.3 爬虫模块详细设计 (3) 4.3.1 URL管理器设计 (3) 4.3.2 网页下载器设计 (3) 4.3.3 网页解析器设计 (3) 4.4数据输出器详细设计 (4) 5 调试与测试 (4) 5.1 调试过程中遇到的问题 (4) 5.2测试数据及结果显示 (5) 6 课程设计心得与体会 (5) 7 参考文献 (6) 8 附录1 网络爬虫程序设计代码 (6) 9 附录2 网络爬虫爬取的数据文档 (9)

1 设计目的 本课程设计是信息管理与信息系统专业重要的实践性环节之一,是在学生学习完《计算机网络》课程后进行的一次全面的综合练习。本课程设计的目的和任务: 1.巩固和加深学生对计算机网络基本知识的理解和掌握; 2.培养学生进行对网络规划、管理及配置的能力或加深对网络协议体系结构的理解或提高网络编程能力; 3.提高学生进行技术总结和撰写说明书的能力。 2 设计任务内容 网络爬虫是从web中发现,下载以及存储内容,是搜索引擎的核心部分。传统爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入队列,直到满足系统的一定停止条件。 参照开放源码分析网络爬虫实现方法,给出设计方案,画出设计流程图。 选择自己熟悉的开发环境,实现网络爬虫抓取页面、从而形成结构化数据的基本功能,界面适当美化。给出软件测试结果。 3 网络爬虫程序总体设计 在本爬虫程序中共有三个模块: 1、爬虫调度端:启动爬虫,停止爬虫,监视爬虫的运行情况 2、爬虫模块:包含三个小模块,URL管理器、网页下载器、网页解析器。 (1)URL管理器:对需要爬取的URL和已经爬取过的URL进行管理,可以从URL 管理器中取出一个待爬取的URL,传递给网页下载器。 (2)网页下载器:网页下载器将URL指定的网页下载下来,存储成一个字符串,传递给网页解析器。 (3)网页解析器:网页解析器解析传递的字符串,解析器不仅可以解析出需要爬取的数据,而且还可以解析出每一个网页指向其他网页的URL,这些URL被解析出来会补充进URL管理器 3、数据输出模块:存储爬取的数据 4 网络爬虫程序详细设计 4.1 设计环境和目标分析 4.1.1 设计环境

第7章Scrapy爬虫 教案 课程名称:Python网络爬虫技术 课程类别:必修 适用专业:大数据技术类相关专业 总学时:32学时(其中理论14学时,实验18学时) 总学分:2.0学分 本章学时:5学时 一、材料清单 (1)《Python网络爬虫技术》教材。 (2)配套PPT。 (3)引导性提问。 (4)探究性问题。 (5)拓展性问题。 二、教学目标与基本要求 1.教学目标 使用Scrapy框架爬取网站,学会Scrapy的数据流向、框架,以及框架各组成部分的作用。Scrapy的常用命令及其作用。创建Scrapy爬虫项目,创建爬虫模板的方法。根据项目最终目标修改items/piplines脚本。编写spider脚本,解析网页。修改settings脚本,实现下载延迟设置等。定制下载中间件,实现随机选择访问USER_AGENT与IP。 2.基本要求

(1)了解Scrapy爬虫框架。 (2)熟悉Scrapy常用命令。 (3)修改items/piplines脚本存储数据。 (4)编写spider脚本解析网页信息。 (5)修改settings脚本设置爬虫参数。 (6)定制Scrapy中间件。 三、问题 1.引导性提问 引导性提问需要教师根据教材内容和学生实际水平,提出问题,启发引导学生去解决问题,提问,从而达到理解、掌握知识,发展各种能力和提高思想觉悟的目的。 (1)如何实现对爬取过的内容不重新爬取? 2.探究性问题 探究性问题需要教师深入钻研教材的基础上精心设计,提问的角度或者在引导性提问的基础上,从重点、难点问题切入,进行插入式提问。或者是对引导式提问中尚未涉及但在课文中又是重要的问题加以设问。 (1)如何实现日志打印到文件中? (2)piplines脚本中item是什么数据类型? (3)如何实现保存数据到MongoDB数据库? 3.拓展性问题 拓展性问题需要教师深刻理解教材的意义,学生的学习动态后,根据学生学习层次,提出切实可行的关乎实际的可操作问题。亦可以提供拓展资料供学生研习探讨,完成拓展性问题。 (1)Requests库和Scarpy库对比各有什么优缺点? (2)Scarpy如何实现人工验证码验证?

【黑马程序员】Python入门教程、python基础教程 黑马程序员视频库网址:https://www.doczj.com/doc/0b14970514.html,(海量热门编程视频、资料免费学习)学习路线图、学习大纲、各阶段知识点、资料网盘免费领取+QQ 3285264708 / 3549664195 适合人群:零基础小白 学习周期:15天 课程章节:2章(每章包含1-100小节课程) 学习后目标:1.掌握基本的Linux系统操作。2.掌握Python基础编程语法。3.建立起编程思维和面向对象思想。 0基础小白也能学会的人工智能 完整视频:https://www.doczj.com/doc/0b14970514.html,/course/534.html?1911sxkqq 课程资料:https://https://www.doczj.com/doc/0b14970514.html,/s/1EDaAE9eG0fhW7V5haowbig 提取码:9kml 内容简介: 本套课程从零开始,讲解人工智能的全部核心基础,4天课让你掌握机器学习、线性代数、微积分和概率论,学完课程你可以自己推导损失函数,实现梯度下降,手写神经网络,把控无人驾驶,完成手写字识别... 2019年python入门到精通(19天全) 完整视频:https://www.doczj.com/doc/0b14970514.html,/course/542.html?1910sxkqq

课程资料:https://https://www.doczj.com/doc/0b14970514.html,/s/1UzxLIXhkRppccqf2vGyOhA 提取码:ueva 内容简介: python基础学习课程,从搭建环境到判断语句,再到基础的数据类型,之后对函数进行学习掌握,熟悉文件操作,初步构建面向对象的编程思想,最后以一个案例带领同学进入python的编程殿堂 Python入门教程完整版(懂中文就能学会) 完整视频:https://www.doczj.com/doc/0b14970514.html,/course/273.html?1910sxkqq 课程资料:https://https://www.doczj.com/doc/0b14970514.html,/s/12-dymJ8FjWzh6b5NKJuP3Q 提取码:gqly 内容简介: 1-3 天内容为Linux基础命令;4-13 天内容为Python基础教程;14-15 天内容为飞机大战项目演练。 python进阶深入浅出完整版 完整视频:https://www.doczj.com/doc/0b14970514.html,/course/541.html?1910sxkqq 课程资料:https://https://www.doczj.com/doc/0b14970514.html,/s/1Y83bFUKz1Z-gM5x_5b_r7g 提取码:ix8q 内容简介: python高级学习课程,从linux操作系统到网络编程,再到多任务编程以及http同学协议,熟练掌握mysql数据库的使用,构建完整python编程技能,进入python殿堂,一窥python 编程之美。 Python进阶之Django框架

Python爬虫实战(1):爬取糗事百科段子 大家好,前面入门已经说了那么多基础知识了,下面我们做几个实战项目来挑战一下吧。那么这次为大家带来,Python爬取糗事百科的小段子的例子。 首先,糗事百科大家都听说过吧糗友们发的搞笑的段子一抓一大把,这次我们尝试一下用爬虫把他们抓取下来。 本篇目标 1.抓取糗事百科热门段子 2.过滤带有图片的段子 3.实现每按一次回车显示一个段子的发布时间,发布人,段子内容,点赞数。 糗事百科是不需要登录的,所以也没必要用到Cookie,另外糗事百科有的段子是附图的,我们把图抓下来图片不便于显示,那么我们就尝试过滤掉有图的段子吧。 好,现在我们尝试抓取一下糗事百科的热门段子吧,每按下一次回车我们显示一个段子。

1.确定URL并抓取页面代码 首先我们确定好页面的URL是,其中最后一个数字1代表页数,我们可以传入不同的值来获得某一页的段子内容。 我们初步构建如下的代码来打印页面代码内容试试看,先构造最基本的页面抓取方式,看看会不会成功 1 2 3 4 5 6 7 8 9 10# -*- coding:utf-8 -*-import urllib import urllib2 page = 1 url = '' + str(page) try: request = (url) response = (request) print ()

11 12 13 14 15 16except , e: if hasattr(e,"code"): print if hasattr(e,"reason"): print 运行程序,哦不,它竟然报错了,真是时运不济,命途多舛啊 1 2 3line 373, in _read_status raise BadStatusLine(line) : '' 好吧,应该是headers验证的问题,我们加上一个headers验证试试看吧,将代码修改如下 1 2# -*- coding:utf-8 -*-import urllib

山东建筑大学计算机网络课程设计基于Python的网络爬 虫设计

山东建筑大学 课程设计成果报告 题目:基于Python的网络爬虫设计课程:计算机网络A 院(部):管理工程学院 专业:信息管理与信息系统 班级: 学生姓名: 学号: 指导教师: 完成日期:

目录 1 设计目的 0 2 设计任务内容 0 3 网络爬虫程序总体设计 0 4 网络爬虫程序详细设计 (1) 4.1 设计环境和目标分析 (1) 4.1.1 设计环境 (1) 4.1.2 目标分析 (1) 4.2 爬虫运行流程分析 (2) 4.3 控制模块详细设计 (3) 4.3 爬虫模块详细设计 (3) 4.3.1 URL管理器设计 (3) 4.3.2 网页下载器设计 (4) 4.3.3 网页解析器设计 (5) 4.4数据输出器详细设计 (6) 5 调试与测试 (6) 5.1 调试过程中遇到的问题 (6) 5.2测试数据及结果显示 (7) 6 课程设计心得与体会 (7) 7 参考文献 (8) 8 附录1 网络爬虫程序设计代码 (8)

9 附录2 网络爬虫爬取的数据文档 (15)

1 设计目的 本课程设计是信息管理与信息系统专业重要的实践性环节之一,是在学生学习完《计算机网络》课程后进行的一次全面的综合练习。本课程设计的目的和任务: 1.巩固和加深学生对计算机网络基本知识的理解和掌握; 2.培养学生进行对网络规划、管理及配置的能力或加深对网络协议体系结构的理解或提高网络编程能力; 3.提高学生进行技术总结和撰写说明书的能力。 2 设计任务内容 网络爬虫是从web中发现,下载以及存储内容,是搜索引擎的核心部分。传统爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入队列,直到满足系统的一定停止条件。 参照开放源码分析网络爬虫实现方法,给出设计方案,画出设计流程图。 选择自己熟悉的开发环境,实现网络爬虫抓取页面、从而形成结构化数据的基本功能,界面适当美化。给出软件测试结果。 3 网络爬虫程序总体设计

第4章常规动态网页爬取 教案 课程名称:Python网络爬虫技术 课程类别:必修 适用专业:大数据技术类相关专业 总学时:32学时(其中理论14学时,实验18学时) 总学分:2.0学分 本章学时:6学时 一、材料清单 (1)《Python网络爬虫技术》教材。 (2)配套PPT。 (3)引导性提问。 (4)探究性问题。 (5)拓展性问题。 二、教学目标与基本要求 1.教学目标 先通过源码对比区分动态网页和静态网页,然后使用逆向分析技术爬取网站“https://www.doczj.com/doc/0b14970514.html,”首页新书信息。还有使用Selenium爬取网站“https://www.doczj.com/doc/0b14970514.html,/search/books”中的以“Python编程”为关键词的信息。和将数据存入MongoDB数据库。 2.基本要求

(1)了解静态网页和动态网页的区别。 (2)逆向分析爬取动态网页。 (3)使用Selenium库爬取动态网页。 (4)使用MongoDB数据库储存数据。 三、问题 1.引导性提问 引导性提问需要教师根据教材内容和学生实际水平,提出问题,启发引导学生去解决问题,提问,从而达到理解、掌握知识,发展各种能力和提高思想觉悟的目的。 (1)什么是动态网站? (2)动态网站和静态网站有和区别? (3)和关系型数据库比较,非关系型数据库解决了什么问题? 2.探究性问题 探究性问题需要教师深入钻研教材的基础上精心设计,提问的角度或者在引导性提问的基础上,从重点、难点问题切入,进行插入式提问。或者是对引导式提问中尚未涉及但在课文中又是重要的问题加以设问。 (1)Selenium库爬取网站的优缺点是什么? (2)Selenium库如何快速得到想要数据? (3)MongoDB和MySQL对比有哪些优点? 3.拓展性问题 拓展性问题需要教师深刻理解教材的意义,学生的学习动态后,根据学生学习层次,提出切实可行的关乎实际的可操作问题。亦可以提供拓展资料供学生研习探讨,完成拓展性问题。 (1)Selenium库Requests库相比爬取网站和的优缺点是什么? (2)如何提高Selenium爬取网站速度?

基于python的网络爬虫设计【摘要】近年来,随着网络应用的逐渐扩展和深入,如何高效的获取网上数据成为了无数公司和个人的追求,在大数据时代,谁掌握了更多的数据,谁就可以获得更高的利益,而网络爬虫是其中最为常用的 一种从网上爬取数据的手段。 网络爬虫,即Web Spider,是一个很形象的名字。如果把互联网比喻成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛。网络蜘蛛是通过网页的链接地址来寻找网页的。从网站某一个页面(通常是首页) 开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一 直循环下去,直到把这个网站所有的网页都抓取完为止。如果把整个互联网当成一个网站,那么网络蜘蛛 就可以用这个原理把互联网上所有的网页都抓取下来。 那么,既然网络爬虫有着如此先进快捷的特点,我们该如何实现它呢?在众多面向对象的语言中,首选python,因为python是一种“解释型的、面向对象的、带有动态语义的”高级程序,可以使人在编程时保 持自己的风格,并且编写的程序清晰易懂,有着很广阔的应用前景。 关键词python 爬虫数据 1 前言 1.1本编程设计的目的和意义 随着网络的迅速发展,万维网成为大量信息的载体,如何有效地提取并利用这些信息成为一个巨大的挑战。搜索引擎(例如传统的通用搜索引擎AltaVista,Yahoo!和Google等)作为一个辅助人们检索信息的工具成为用户访问万维网的入口和指南。但是,这些通用性搜索引擎也存在着一定的局限性,如: (1) 不同领域、不同背景的用户往往具有不同的检索目的和需求,通用搜索引擎所返回的结果包含大量用户不关心的网页。 (2) 通用搜索引擎的目标是尽可能大的网络覆盖率,有限的搜索引擎服务器资源与无限的网络数据资源之间的矛盾将进一步加深。 (3) 万维网数据形式的丰富和网络技术的不断发展,图片、数据库、音频/视频多媒体等不同数据大量出现,通用搜索引擎往往对这些信息含量密集且具有一定结构的数据无能为力,不能很好地发现和获取。 (4) 通用搜索引擎大多提供基于关键字的检索,难以支持根据语义信息提出的查询。为了解决上述问题,定向抓取相关网页资源的聚焦爬虫应运而生。聚焦爬虫是一个自动下载网页的程序,它根据既定的抓取目标,有选择的访问万维网上的网页与相关的链接,获取所需要的信息。与通用爬虫(generalpurpose web crawler)不同,聚焦爬虫并不追求大的覆盖,而将目标定为抓取与某一特定主题内容相关的网页,为面向主题的用户查询准备数据资源。 1.2编程设计目及思路 1.2.1编程设计目的 学习了解并熟练掌握python的语法规则和基本使用,对网络爬虫的基础知识进行了一定程度的理解,提高对网页源代码的认知水平,学习用正则表达式来完成匹配查找的工作,了解数据库的用途,学习mongodb数据库的安装和使用,及配合python的工作。 1.2.2设计思路

小白必看的Python教程基础 Python的排名从去年开始就借助人工智能持续上升,现在它已经成为了第一名。Python的火热,也带动了工程师们的就业热。可能你也想通过学习加入这个炙手可热的行业,可以看看千锋的Python视频基础教程,小白必看哟! python基础教程:https://www.doczj.com/doc/0b14970514.html,/s/1qYTZiNE python课程教学高手晋级视频总目录: https://www.doczj.com/doc/0b14970514.html,/s/1hrXwY8k python课程windows知识点:https://www.doczj.com/doc/0b14970514.html,/s/1kVcaH3x python课程linux知识点:https://www.doczj.com/doc/0b14970514.html,/s/1i4VZh5b python课程web知识点:https://www.doczj.com/doc/0b14970514.html,/s/1jIMdU2i python课程机器学习:https://www.doczj.com/doc/0b14970514.html,/s/1o8qNB8Q python课程-树莓派设备:https://www.doczj.com/doc/0b14970514.html,/s/1slFee2T 如果在看这篇文章的你刚好就是小白,就该了解一下学完Python以后能做些什么事了。总结如下: 1.帮助公司开发各种自动化工具

每个公司业务不同,会导致有不同的定制开发需求。如果具备一定的开发能力,你就可以进行二次开发了。觉得开源软件不好用,你还可以自己做一个。 2.开发公司的内部办公系统、CRM、网站等 学会了自动化开发不代表你只能做IT自动化,你也可以尝试去做纯开发的工作,帮助公司开发相应的业务系统,这样更能提升自己的工作价值。 3.帮助评估和优化业务技术架构 在很多情况下普通的开发人员更多地关注于功能的实现,因此写出来的技术架构不一定是高效的。 如果你具备开发能力,你就可以帮助评估技术架构是否合理,哪里可以优秀,哪里可以做异步,哪里可以配置缓存,具备开发和架构设计及调优能力可是成为一个出色架构师的必备能力。 4.利用python做爬虫 利用python的爬虫我们可以采集网上的各种数据为自己所用。 5.做个全栈工程师

【黑马程序员】Python教程、Python下载、Python爬虫、Python学习路线图、Python就业方向 一、Python学习路线图

二、Python就业方向 三、Python各阶段技能 四、Python学习教程下载 免费领取网盘提取码+ Q 1679806262

适合人群:零基础小白 学习周期:15天 课程章节:2章(每章包含1-100小节课程) 学习后目标:1.掌握基本的Linux系统操作。2.掌握Python基础编程语法。3.建立起编程思维和面向对象思想。 0基础小白也能学会的人工智能 视频网盘:https://www.doczj.com/doc/0b14970514.html,/course/534.html?1912sxkqq 资料网盘:https://https://www.doczj.com/doc/0b14970514.html,/s/1EDaAE9eG0fhW7V5haowbig 内容简介: 本套课程从零开始,讲解人工智能的全部核心基础,4天课让你掌握机器学习、线性代数、微积分和概率论,学完课程你可以自己推导损失函数,实现梯度下降,手写神经网络,把控无人驾驶,完成手写字识别... 2019年python入门到精通(19天全) 视频网盘:https://www.doczj.com/doc/0b14970514.html,/course/542.html?1912sxkqq 资料网盘:https://https://www.doczj.com/doc/0b14970514.html,/s/1UzxLIXhkRppccqf2vGyOhA 内容简介: python基础学习课程,从搭建环境到判断语句,再到基础的数据类型,之后对函数进行学习掌握,熟悉文件操作,初步构建面向对象的编程思想,最后以一个案例带领同学进入python 的编程殿堂 免费领取网盘提取码+ Q 1679806262 Python入门教程完整版(懂中文就能学会) 视频网盘:https://www.doczj.com/doc/0b14970514.html,/course/273.html?1912sxkqq 资料网盘:https://https://www.doczj.com/doc/0b14970514.html,/s/12-dymJ8FjWzh6b5NKJuP3Q 内容简介: 1-3 天内容为Linux基础命令;4-13 天内容为Python基础教程;14-15 天内容为飞机大战项目演练。 python进阶深入浅出完整版 视频网盘:https://www.doczj.com/doc/0b14970514.html,/course/541.html?1912sxkqq 资料网盘:https://https://www.doczj.com/doc/0b14970514.html,/s/1Y83bFUKz1Z-gM5x_5b_r7g 内容简介: python高级学习课程,从linux操作系统到网络编程,再到多任务编程以及http同学协议,熟练掌握mysql数据库的使用,构建完整python编程技能,进入python殿堂,一窥python 编程之美。 Python进阶之Django框架 视频网盘:https://www.doczj.com/doc/0b14970514.html,/course/257.html?1912sxkqq 资料网盘:https://https://www.doczj.com/doc/0b14970514.html,/s/1OJ4SE8wClgV_53GclWPXDQ

龙源期刊网 https://www.doczj.com/doc/0b14970514.html, 基于Python专用型网络爬虫的设计及实现作者:贾棋然 来源:《电脑知识与技术》2017年第12期 摘要:网络爬虫一种网络机器人,也有人说是网页的蜘蛛。随着科技在生活和工作中的应用,计算机也成了人们最为依赖的工具,随着互联网的信息管理量的逐渐增加,搜索引擎也是这个时期被创造并投入使用。但是初被使用的搜索引擎是无法精确搜索到人们需要的信息,面对人们越来越多样的需求,这样的搜索引擎已经无法满足人们的需求了。所以就有人研究了一种专用性的网络爬虫,它能解决传统搜索引擎的出现的局限性,所以该文将会对Python专用型的网络爬虫进行分析和探讨。 关键词:网络爬虫;Python;数据的挖掘;搜索引擎 在很多用户进行搜索引擎的使用中,往往会出现很多不需要的信息,这就是传统搜索引擎的局限性。通过传统的搜索引擎进行信息的搜索中,还需要用户对搜索到的信息进行分析,最终寻找到自己需要的信息。就目前的网络发达现状,这样的搜索引擎是非常浪费时间的,而且准确性也不高,用户很容易丧失搜索的心情。所以,本文将会针对这一问题,对专用型的网络爬虫进行分析,提高信息检索的效率。 1分析Python和爬虫系统设计需求 1.1Python的网络爬虫 网络爬虫主要是通过每个网页的链接地址进行相关内容的查找,然后将结果直接传送给用户,不用通过人工进行浏览器的操作来获取信息了。而Python是一种广泛应用的脚本语言,它自身带有urllib2、urllib相关的爬虫基础库等,在Python语言的基础上开发出的一种开源软件则是Scrapy,它可以在Linux、Windows等多种操作系统中使用。如果被获取的网页经过大量的HTML源代码进行编写,这种情况下需要下载很多内容,但是用户可以在Scrapy爬虫系统上制定一部分模块,从而实现爬虫的功能。 1.2爬虫系统设计需求 在进行网络爬虫系统的开发时,对系统建设进行分析是基础性问题,同时也要将符合设计该系统的代码和功能规范提出来。这样能够促进网络爬虫系统顺利的开发,进而保证开发的结果能够符合系统功能的基本需求。网络爬虫系统的建设基本上同时通过模块化进行的设计,一般每个功能都要自己的模块。这样能够方便以后进行代码的维护,而且还能提高代码的重要性。将整个系统分成不同的模块,之后把每个模块的功能编制完成,这样整个网络爬虫体系的功能就是已经完成了。本系统主要是根据某些用户的上网习惯,进行网络专用型的爬虫系统设计,根据用户的不同需求,确定网络爬虫系统中的各个功能。而且在进行系统的设计时,还要