音频压缩编码原理及标准

- 格式:ppt

- 大小:3.39 MB

- 文档页数:67

深入解读:媒体编码技术的编码原理媒体编码技术在现代社会中扮演着重要的角色,它对于数字化媒体的存储、传输和展示起着关键的作用。

在本文中,我们将深入探讨媒体编码技术的编码原理,从理论层面揭示其工作原理。

一、数字媒体的编码数字媒体编码是将模拟信号转化为数字信号的过程,这种转化涉及到信号的采样、量化和编码。

首先是采样,也就是将连续的模拟信号在特定的时间节点上进行取样。

其次是量化,即将采样得到的连续信号转化为离散信号,通过将信号值映射为用固定位数表示的离散值。

最后是编码,将量化的离散信号用二进制代码表示。

二、音频编码原理音频编码的目标是实现对音频信号的高效压缩和无损还原。

著名的音频编码标准有MP3、AAC等。

这些编码标准基于声音的听觉特性,将人耳对声音的不敏感性利用起来。

例如,MP3采用了人耳对声音频率和强度的不同敏感度,通过减少对人耳较不敏感的声音部分的编码精度,实现了对音频信号的压缩。

另外,还有一些音频编码标准利用了时间和频域上的冗余性,通过有损压缩减少冗余信息,并且通过逆变换和滤波器补偿等技术在解码端进行还原。

三、视频编码原理视频编码是将连续的视频信号进行压缩和编码的过程。

是一种广泛使用的视频编码标准。

其原理包括空间域和时间域的压缩。

在空间域上,利用了人眼对高频细节的不敏感性,通过对图像进行空间上的预测和差分编码,减少了编码所需的位数。

在时间域上,通过帧间预测和运动补偿,利用了视频帧之间的冗余性,从而降低了码率。

此外,还有一些视频编码技术采用了变换编码、量化和熵编码等方法,进一步提高了压缩性能。

四、图像编码原理图像编码是将图像信号进行压缩和编码的过程。

JPEG是一种广泛应用的图像编码标准。

在JPEG编码中,首先将输入图像分为若干个8x8的图像块。

然后,对每个图像块进行离散余弦变换(DCT),并对变换系数进行量化。

量化是图像编码中一个重要的步骤,它通过降低变换系数的精度,减少图像的细节和冗余信息,从而实现对图像的高压缩。

Matlab中常用的音频压缩与编解码方法音频是我们日常生活中必不可少的一部分,无论是通过音乐欣赏、语音通信还是多媒体娱乐,音频都扮演着重要的角色。

然而,随着技术的迅速发展,音频文件的大小也越来越大,给存储和传输带来了挑战。

为了解决这个问题,人们开始研究音频压缩与编解码方法,Matlab作为一种常用的工具,为我们提供了丰富的音频压缩与编解码函数和算法。

在Matlab中,常见的音频压缩与编解码方法有基于人耳特性的压缩方法、无损压缩和有损压缩。

下面将分别介绍这三种方法的原理和在Matlab中的实现方式。

1. 基于人耳特性的压缩方法人类对音频信号的感知是有限的,我们对高频信号的敏感度相对较低。

因此,在对音频信号进行压缩时,可以根据人耳的特性,对高频信号进行适当的降采样和量化,以减小存储或传输所需的数据量。

在Matlab中,可以使用函数如"audioread"和"audiowrite"来读取和写入音频文件,使用函数如"spectrogram"和"resample"来进行音频信号的频谱分析和重采样。

通过对高频信号进行降采样和量化,可以减小音频文件的大小,同时保持人耳可以接受的音质。

2. 无损压缩方法无损压缩是指在压缩音频文件的同时,不丢失任何信息。

这种压缩方法通常使用的是无损编码技术,例如FLAC、ALAC等。

这些编码技术通过识别和利用音频信号中的冗余信息,以减小文件的大小,同时能够在解码时完全恢复原始音频信号。

在Matlab中,可以使用函数如"audioread"和"audiowrite"来读取和写入音频文件。

然后,可以使用无损编码技术库,如FLAC或ALAC库,对音频信号进行编码。

需要注意的是,无损压缩方法通常会导致压缩比较低,因为它要求尽量保存原始音频信号的所有信息。

3. 有损压缩方法有损压缩是指在压缩音频文件的同时,会有一定的信息损失。

AAC解码算法原理详解AAC(Advanced Audio Coding)是一种高级音频编码格式,它是MPEG-2和MPEG-4标准中定义的一种音频压缩算法。

AAC算法通过使用一系列的信号处理技术,能够在保持高音质的同时实现较高的压缩率。

本文将详细解释AAC解码算法的原理,包括主要的信号处理步骤和算法流程。

一、AAC解码算法的主要信号处理步骤1. 帧解析(Frame Parsing):AAC音频数据以一帧一帧的形式进行传输和存储。

解码器首先需要对输入的AAC数据进行帧解析,将音频数据按照帧的格式进行划分和组织。

2. 音频元数据提取(Audio Metadata Extraction):在AAC数据中,包含了一些音频元数据,如采样率、声道数、比特率等信息。

解码器需要从AAC数据中提取这些元数据,以便后续的解码处理。

3. 预处理(Preprocessing):预处理是为了减少音频数据中的冗余信息和噪声,提高解码的准确性和音质。

预处理步骤包括滤波、降噪、均衡化等。

4. 频谱分析(Spectrum Analysis):频谱分析是将音频数据从时域转换到频域的过程。

在AAC解码中,常用的频谱分析算法有快速傅里叶变换(FFT)和短时傅里叶变换(STFT)。

频谱分析可以提取音频数据的频谱特征,用于后续的声音重建。

5. 音频解码(Audio Decoding):音频解码是将压缩的AAC数据解码为原始的音频信号的过程。

在AAC解码中,主要使用了两种解码算法:MDCT(Modified Discrete Cosine Transform)和TNS(Temporal Noise Shaping)。

MDCT算法将频域的音频数据转换为时域的音频数据,而TNS算法则用于降低音频数据中的噪声。

6. 声音重建(Audio Reconstruction):声音重建是将解码后的音频信号进行还原和重建的过程。

在AAC解码中,声音重建主要采用了滤波、插值和重采样等技术,以提高音质和还原度。

音频基础知识及编码原理音频是我们日常生活中不可或缺的一部分,它通过我们的耳朵传达声音信息。

音频的基础知识和编码原理对于我们理解音频的特性和进行音频处理都是非常重要的。

一、音频基础知识1.音频信号:音频信号是一种连续时间变化的模拟信号,它可以通过声音的压力波来传递声音信息。

在计算机中,音频信号会被采样和量化为离散的数字信号。

2.音频频率:音频频率是指声音中的振荡周期数量。

它以赫兹(Hz)为单位表示,描述了声波的频率。

人类可以听到的频率范围约为20Hz到20kHz,不同的生物和设备有着不同的频率感知范围。

3.音频幅度:音频幅度是指声音的强度或振幅。

它可以通过声音的声压级来表示,单位为分贝(dB)。

声压级越高,声音就越大;声压级越低,声音就越小。

4. 音频声道:音频声道是指音频信号的通道数量。

单声道(mono)只有一个通道,立体声(stereo)有两个通道,多声道(multi-channel)有三个或更多个通道。

5.音频采样率:音频采样率是指音频信号在单位时间内进行采样的次数。

它以赫兹(Hz)为单位表示,描述了数字音频的采样精度。

常见的采样率有44.1kHz和48kHz,高采样率可以提高音频的质量。

二、音频编码原理音频编码是将模拟音频信号转换为数字音频信号的过程。

在音频编码中,采样和量化是两个主要步骤。

1.采样:采样是将连续时间的模拟音频信号转换为离散时间的数字音频信号的过程。

采样率决定了采样的频率,即每秒钟采样的次数。

采样过程会将每个采样点的幅度值记录下来,形成一个采样序列。

2.量化:量化是将连续的模拟音频信号转换为离散的数字音频信号的过程。

它将每个采样点的幅度值映射到一个有限的数值范围内,通常使用固定的比特数来表示每个采样点的幅度。

3.压缩编码:为了减小数字音频的文件大小,音频信号通常会经过压缩编码的处理。

压缩编码可以通过去除信号中的冗余信息或者使用有损压缩算法来实现。

常见的音频压缩编码格式有MP3、AAC和FLAC等。

声音压缩典型方法及原理1. 声音压缩是一种音频信号处理技术,用于减少音频信号的动态范围并增加整体响度。

2. 动态范围是指音频信号中最大和最小幅度之间的差异。

声音压缩通过减小这种差异来提高音频信号的可听性。

3. 声音压缩的主要原理是对音频信号进行自动增益控制(AGC),根据信号的幅度变化调整增益。

4. 自动增益控制通过设置阈值来确定何时启动增益调整。

当信号的幅度超过阈值时,增益被降低以减小动态范围。

5. 增益的调整是通过压缩比来实现的,压缩比是指输入信号的变化与输出信号变化之间的比例关系。

6. 压缩比越高,输出信号的动态范围就越小,音频信号的差异也就越小。

7. 压缩比通常以分贝(dB)为单位进行表达,比如 4:1 的压缩比表示输出信号每增加 4 分贝,输入信号只增加 1 分贝。

8. 压缩比大于 1:1 的情况下,被压缩的音频信号通常会失去部分动态范围,从而产生所谓的“压缩效果”。

9. 压缩效果可以使音频信号更具聚焦性,使细节更加清晰,但过度压缩可能导致音频信号变得平淡无力或产生副作用,如失真或噪音增加。

10. 声音压缩常用的算法之一是均衡压缩算法,它根据输入信号的频谱特征自适应地调整增益。

11. 均衡压缩算法将输入信号分成多个频带,并在每个频带上应用独立的压缩参数。

12. 这种算法可确保在音频信号的各个频段上获得更平衡的增益调整,从而提供更好的音频质量。

13. 另一种常见的压缩方法是峰值限制器,它主要用于防止音频信号过载。

14. 峰值限制器通过将超过某个设定阈值的信号限制在该阈值以内,从而防止信号超载,并保持输出信号处于可接受的范围内。

15. 除了阈值和压缩比,声音压缩中常用的参数还包括攻击时间、释放时间和输出增益等。

16. 攻击时间指的是从输入信号超过阈值到压缩开始生效的时间,攻击时间越短,压缩器的反应越快。

17. 释放时间指的是当输入信号低于阈值时,压缩器停止工作并返回到原始增益水平所需的时间。

FLAC编码原理解析1. 引言FLAC(Free Lossless Audio Codec)是一种无损音频编码格式,它可以将音频文件压缩到较小的尺寸,而不会损失音频质量。

本文将详细解释FLAC编码的基本原理,包括压缩算法、预测算法和编码过程。

2. 压缩算法FLAC使用了一种基于线性预测的压缩算法,该算法能够通过对音频信号进行预测来减少冗余信息。

具体而言,FLAC将音频信号分为多个小区块,对每个小区块进行独立的压缩。

2.1 线性预测在每个小区块中,FLAC使用线性预测来估计当前采样点的值。

线性预测通过对之前的采样点进行加权求和来预测当前采样点的值。

加权系数由FLAC编码器根据音频信号的特性进行选择。

2.2 残差编码线性预测只能对音频信号的低频成分进行较好的预测,对于高频成分则预测效果较差。

因此,FLAC使用残差编码来表示预测误差,即当前采样点的真实值与预测值之间的差异。

FLAC使用了一种叫做RICE编码的方法来对残差进行编码。

RICE编码将残差值分为两部分:符号部分和幅度部分。

符号部分表示残差值的正负,幅度部分表示残差值的大小。

在RICE编码中,幅度部分使用了变长编码,即较小的幅度值使用较短的编码表示,较大的幅度值使用较长的编码表示。

这样可以更好地压缩残差信息。

3. 预测算法FLAC使用了一种称为自适应混合预测(Adaptive Hybrid Prediction)的预测算法。

该算法根据音频信号的特性选择合适的预测器进行预测。

3.1 短期预测短期预测器使用之前的采样点来预测当前采样点的值。

FLAC使用了线性预测器和FIR(Finite Impulse Response)预测器来进行短期预测。

线性预测器通过对之前的采样点进行加权求和来预测当前采样点的值。

加权系数由FLAC编码器根据音频信号的特性进行选择。

FIR预测器使用了一个滤波器来对之前的采样点进行加权求和。

滤波器的系数由FLAC编码器根据音频信号的特性进行选择。

本文以MPEG-2的系统、MPEG-2的编码、及MPEG-2的应用为题,讨论MPEG-2压缩编码技术。

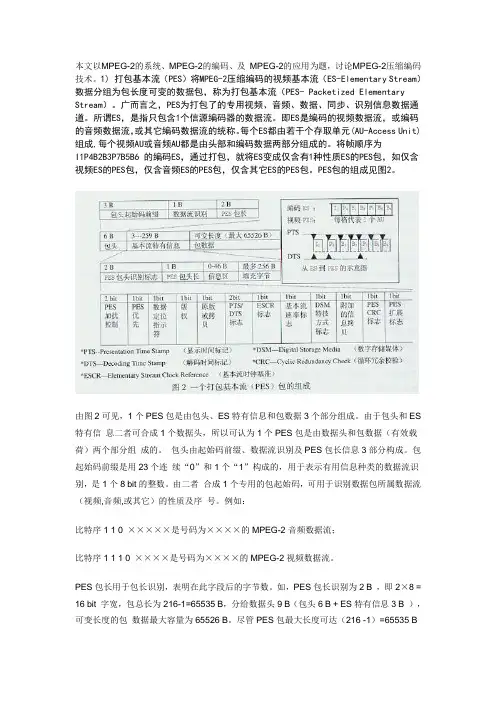

1) 打包基本流(PES)将MPEG-2压缩编码的视频基本流(ES-Elementary Stream)数据分组为包长度可变的数据包,称为打包基本流(PES- Packetized Elementary Stream)。

广而言之,PES为打包了的专用视频、音频、数据、同步、识别信息数据通道。

所谓ES,是指只包含1个信源编码器的数据流。

即ES是编码的视频数据流,或编码的音频数据流,或其它编码数据流的统称。

每个ES都由若干个存取单元(AU-Access Unit)组成,每个视频AU或音频AU都是由头部和编码数据两部分组成的。

将帧顺序为I1P4B2B3P7B5B6 的编码ES,通过打包,就将ES变成仅含有1种性质ES的PES包,如仅含视频ES的PES包,仅含音频ES的PES包,仅含其它ES的PES包。

PES包的组成见图2。

由图2可见,1个PES包是由包头、ES特有信息和包数据3个部分组成。

由于包头和ES特有信息二者可合成1个数据头,所以可认为1个PES包是由数据头和包数据(有效载荷)两个部分组成的。

包头由起始码前缀、数据流识别及PES包长信息3部分构成。

包起始码前缀是用23个连续“0”和1个“1”构成的,用于表示有用信息种类的数据流识别,是1个8 bit的整数。

由二者合成1个专用的包起始码,可用于识别数据包所属数据流(视频,音频,或其它)的性质及序号。

例如:比特序1 1 0 ×××××是号码为××××的MPEG-2音频数据流;比特序1 1 1 0 ××××是号码为××××的MPEG-2视频数据流。

PES包长用于包长识别,表明在此字段后的字节数。

视频会议的音视频编解码技术随着全球化的发展和工作场景的变迁,视频会议已经成为了我们日常工作和社交交流的必要方式。

而视频会议能够正常进行,离不开音视频编解码技术的支持。

本文将从编解码原理、编解码标准、编解码器选择、编解码效果等方面,探讨视频会议的音视频编解码技术。

一、编解码原理音视频编解码技术是通过压缩和解压缩实现的。

所谓压缩,是指通过算法等方式将音视频信号中的冗余内容去掉,从而降低信号的数据量,以达到传输、存储等目的;解压缩则是指将压缩后的音视频信号还原成原始信号。

在音视频编解码中,编码是通过将原始信号转换成数字信号,并将数字信号压缩来实现的。

解码则是对压缩后的信号进行还原,并将其转换为显示或播放所需的信号。

二、编解码标准编解码标准是指压缩和解压缩音视频信号所使用的数据格式、算法、参数等规范。

在视频会议中,常用的编解码标准包括H.264/AVC、H.265/HEVC、VP8、VP9等。

H.264/AVC是目前视频会议中最普及的编解码标准。

它采用了先进的压缩算法,可以在保证视频质量的前提下实现更小的数据传输量。

而H.265/HEVC则是H.264/AVC的升级版,它能够在不降低画质的情况下,实现更高的压缩比,进一步降低视频传输成本。

VP8和VP9则是由Google开发的开源编解码标准,在一些商业应用中得到一定应用。

它们的优势在于能够在低带宽情况下保证视频质量,同时在压缩比方面也有较高的表现。

三、编解码器的选择选择正确的编解码器对于视频会议的流畅程度和画质有着至关重要的影响。

目前,常见的编解码器包括x264、x265、ffmpeg 等。

x264是一款开源的H.264/AVC编码器,它的编码速度快,压缩比高,适合在较低带宽环境中进行视频会议。

x265则是x264的升级版,能够更高效地运用CPU的处理能力,同时在保证视频质量的前提下,实现更小的视频文件大小。

而ffmpeg则是一款集多种视频编解码器于一身的开源软件,能够对多种视频编码进行支持,能够应对各种视频会议场景。

音频压缩由编码和解码两个部分组成。

把波形文件里的数字音频数据转换为高度压缩的形式(称为比特流)即为编码;要解码则把比特流重建为波形文件。

音频压缩可以分为无损(lossless)压缩和有损压缩。

无损压缩就是尽量降低音频数据的冗余度,以减小其体积。

音频信号经过编码和解码之后,必须要和原来的信号一致。

无损压缩的压缩率是比较有限的,不过现在比较出色的APE能做到50%的压缩率(本人用Monkey's Audio 3.97,Extra High压缩模式下压缩WAV,压缩率最低能达到52%);有损压缩就是用尽一切手段,包括无损压缩用到的方法,丢掉一切能丢掉的数据,以减小体积。

而音频压缩后解码听起来起码是要跟原来差不多的,有损压缩的压缩比能大幅提高,MP3就是属于有损压缩,压缩比是12:1(128kbps)。

MP3文件是由帧(frame)构成的,帧是MP3文件最小的组成单位。

什么是帧?还记得最初的动画是怎么做的吗?不同的连续画面切换以达到动态效果,每幅画面就是一个“帧”,不同的是MP3里面的帧记录的是音频数据而不是图形数据。

MP3的帧速度大概是30帧/秒。

每个帧又由帧头和帧数据组成,帧头记录着该帧的基本信息,包括位率索引和采样率索引(这对理解ABR和VBR编码方式很重要)。

帧数据,顾名思义就是记录着主体音频数据。

上面说的都是MP3编码的基础,但事实上,早期的编码器都非常不完善,压缩算法近于粗暴,音质很不理想。

MP3的音质达到现在的水平有两次飞跃:人体听觉心理学模型(Perceptual Model)的导入和VBR技术的应用。

◆人体听觉心理学模型下面将简要介绍一下几个重要原理:1) 最小听觉门槛判定(The minimal audition threshold)人耳的听力范围是20Hz-20k Hz的频率范围,但是人耳对不同的频率声音的灵敏度是不同的,不同频率的声音要达到能被人耳听到的水平所需要的强度是不一样。

MPEG音频文件格式(包括MP3文件格式)详解MP3 文件是由帧(frame)构成的,帧是MP3 文件最小的组成单位。

MP3 的全称应为MPEG1 Layer-3 音频文件,MPEG(Moving Picture Experts Group)在汉语中译为活动图像专家组,特指活动影音压缩标准,MPEG 音频文件是MPEG1 标准中的声音部分,也叫MPEG 音频层,它根据压缩质量和编码复杂程度划分为三层,即 Layer-1、Layer2、Layer3,且分别对应MP1、MP2、MP3 这三种声音文件,并根据不同的用途,使用不同层次的编码。

MPEG 音频编码的层次越高,编码器越复杂,压缩率也越高,MP1 和MP2 的压缩率分别为4:1 和6:1-8:1,而MP3 的压缩率则高达10:1-12:1,也就是说,一分钟CD 音质的音乐,未经压缩需要10MB的存储空间,而经过MP3 压缩编码后只有1MB 左右。

不过MP3 对音频信号采用的是有损压缩方式,为了降低声音失真度,MP3 采取了“感官编码技术”,即编码时先对音频文件进行频谱分析,然后用过滤器滤掉噪音电平,接着通过量化的方式将剩下的每一位打散排列,最后形成具有较高压缩比的MP3 文件,并使压缩后的文件在回放时能够达到比较接近原音源的声音效果。

一、MPEG音频压缩基础在众多音频压缩方法中,这些方法在保持声音质量的同时尽量压缩数字音频使之占用更小的存储空间。

MPEG压缩是该领域中效果最好的一个。

这种压缩是有损压缩,这意味着,当运用这一方法压缩时肯定会丢失一部分音频信息。

但是,由于压缩方法的控制很难发现这种损失。

使用几个非常复杂和苛刻的数学算法,使得只有原始音频中几乎听不到的部分损失掉。

这就给重要的信息剩下了更多的空间。

通过这种方法可以将音频压缩12倍(可以选择压缩率),效果显著。

正是应为他的质量,MPEG音频变得流行起来。

MPEG-1,MPEG-2和MPEG-4都是人们熟悉的MPEG标准,MP3只涉及到前两中,另外还有一个非官方标准MPEG-2.5用于扩展MPEG-2/LSF到更低的采样率。

音频压缩算法压缩第7章凌阳音频压缩算法261第7章凌阳音频压缩算法7.1背景介绍7.1.1音频的概述(特点,分类)我们所说的音频是指频率在20Hz~20kHz的声音信号,分为:波形声音,语音和音乐三种,其中波形声音就是自然界中所有的声音,是声音数字化的基础.语音也可以表示为波形声音,但波形声音表示不出语言,语音学的内涵.语音是对讲话声音的一次抽象.是语言的载体,是人类社会特有的一种信息系统,是社会交际工具的符号.音乐与语音相比更规范一些,是符号化了的声音.但音乐不能对所有的声音进行符号化.乐谱是符号化声音的符号组,表示比单个符号更复杂的声音信息内容.7.1.2数字音频的采样和量化将模拟的(连续的)声音波形数字元化(离散化),以便利数字计算机进行处理的过程,主要包括采样和量化两个方面.数字音频的质量取决于:采样频率和量化位数这两个重要参数.此外,声道的数目,相应的音频设备也是影响音频质量的原因.7.1.3音频格式的介绍音频文件通常分为两类:声音文件和MIDI文件(1)声音文件:指的是通过声音录入设备录制的原始声音,直接记录了真实声音的二进制采样数据,通常文件较大;(2)MIDI文件:它是一种音乐演奏指令序列,相当于乐谱,可以利用声音输出设备或与计算机相连的电子乐器进行演奏,由于不包含声音数据,其文件尺寸较小.1)声音文件的格式WAVE文件――*.WAVWAVE文件使用三个参数来表示声音,它们是:采样位数,采样频率和声道数. 在计算机中采样位数一般有8位和16位两种,而采样频率一般有__Hz(11KHz),__Hz(22KHz),__Hz(44KHz)三种.我们以单声道为例,则一般WAVE文件的比特率可达到88K~704Kbps.具体介绍如下:(1)WAVE格式是Microsoft公司开发的一种声音文件格式,它符合RIFF(Resource InterchangeFileFormat)文件规范;第7章凌阳音频压缩算法262(2)用于保存Windows平台的音频信息资源,被Windows平台及其应用程序所广泛支持.(3)WAVE格式支持__,__aw,CCITTLaw和其它压缩算法,支持多种音频位数,采样频率和声道,是PC机上最为流行的声音文件格式.(4)但其文件尺寸较大,多用于存储简短的声音片段.AIFF文件――AIF/AIFF(1)AIFF是音频交换文件格式(AudioInterchangeFileFormat)的英文缩写,是苹果计算机公司开发的一种声音文件格式;压缩(2)被Macintosh平台及其应用程序所支持,NetscapeNavigator浏览器中的LiveAudio也支持AIFF格式,SGI及其它专业音频软件包同样支持这种格式.(3)AIFF支持ACE2,ACE8,MAC3和MAC6压缩,支持16位44.1Kz立体声. Audio文件――*.Audio(1)Audio文件是SunMicrosystems公司推出的一种经过压缩的数字声音格式,是Internet中常用的声音文件格式;(2)NetscapeNavigator浏览器中的LiveAudio也支持Audio格式的声音文件. MPEG文件――*.MP1/*.MP2/*.MP3(1)MPEG是运动图像专家组(MovingPictureExpertsGroup)的英文缩写,代表MPEG标准中的音频部分,即MPEG音频层(MPEGAudioLayer);(2)MPEG音频文件的压缩是一种有损压缩,根据压缩质量和编码复杂程度的不同可分为三层(MPEGAudioLayer1/2/3),分别对应MP1,MP2和MP3这三种声音文件;(3)MPEG音频编码具有很高的压缩率,MP1和MP2的压缩率分别为4:1和6: 1~8:1,而MP3的压缩率则高达10:1~12:1,也就是说一分钟CD音质的音乐,未经压缩需要10MB存储空间,而经过MP3压缩编码后只有1MB左右, 同时其音质基本保持不失真,因此,目前使用最多的是MP3文件格式.RealAudio文件――*.RA/*.RM/*.RAM(1)RealAudio文件是RealNerworks公司开发的一种新型流式音频(Streaming Audio)文件格式;(2)它包含在RealMedia中,主要用于在低速的广域网上实时传输音频信息;(3)网络连接速率不同,客户端所获得的声音质量也不尽相同:对于28.8Kbps的连接,可以达到广播级的声音质量;如果拥有ISDN或更快的线路连接,则可获得CD音质的声音.2)MIDI文件――*.MID/*.RMI(1)MIDI是乐器数字接口(MusicalInstrumentDigitalInterface)的英文缩写,是数字音乐/电子合成乐器的统一国际标准;(2)它定义了计算机音乐程序,合成器及其它电子设备交换音乐信号的方式,还规第7章凌阳音频压缩算法263定了不同厂家的电子乐器与计算机连接的电缆和硬件及设备间数据传输的协议,可用于为不同乐器创建数字声音,可以模拟大提琴,小提琴,钢琴等常见乐器;(3)在MIDI文件中,只包含产生某种声音的指令,这些指令包括使用什么MIDI 设备的音色,声音的强弱,声音持续多长时间等,计算机将这些指令发送给声卡,声卡按照指令将声音合成出来,MIDI在重放时可以有不同的效果,这取决于音乐合成器的质量;(4)相对于保存真实采样资料的声音文件,MIDI文件显得更加紧凑,其文件尺寸通常比声音文件小得多.7.1.4语音压缩编码基础语音压缩编码中的数据量是指:数据量=(采样频率×量化位数)/8(字节数)×声道数目.压缩压缩编码的目的:通过对资料的压缩,达到高效率存储和转换资料的结果,即在保证一定声音质量的条件下,以最小的资料率来表达和传送声音信息.压缩编码的必要性:实际应用中,未经压缩编码的音频资料量很大,进行传输或存储是不现实的.所以要通过对信号趋势的预测和冗余信息处理,进行资料的压缩,这样就可以使我们用较少的资源建立更多的信息.举个例子,没有压缩过的CD品质的资料,一分钟的内容需要11MB的内存容量来存储.如果将原始资料进行压缩处理,在确保声音品质不失真的前提下,将数据压缩一半,5.5MB就可以完全还原效果.而在实际操作中,可以依需要来选择合适的算法.常见的几种音频压缩编码:1)波形编码:将时间域信号直接变换为数字代码,力图使重建语音波形保持原语音信号的波形形状.波形编码的基本原理是在时间轴上对模拟语音按一定的速率抽样,然后将幅度样本分层量化,并用代码表示.译码是其反过程,将收到的数字序列经过译码和滤波恢复成模拟信号.如:脉冲编码调制(PulseCodeModulation,PCM),差分脉冲编码调制(DPCM), 增量调制(DM)以及它们的各种改进型,如自适应差分脉冲编码调制(ADPCM),自适应增量调制(ADM),自适应传输编码(AdaptiveTransferCoding,ATC)和子带编码(SBC)等都属于波形编码技术.波形编码特点:高话音质量,高码率,适于高保真音乐及语音.2)参数编码:参数编码又称为声源编码,是将信源信号在频率域或其它正交变换域提取特征参数,并将其变换成数字代码进行传输.译码为其反过程,将收到的数字序列经变换恢复特征参量,再根据特征参量重建语音信号.具体说,参数编码是通过对语音信号特征参数的提取和编码,力图使重建语音信号具有尽可能高的准确性,但重建信号的波形同原语音信号的波形可能会有相当大的差别.第7章凌阳音频压缩算法264如:线性预测编码(LPC)及其它各种改进型都属于参数编码.该编码比特率可压缩到2Kbit/s-4.8Kbit/s,甚至更低,但语音质量只能达到中等,特别是自然度较低.参数编码特点:压缩比大,计算量大,音质不高,廉价!3)混合编码:混合编码使用参数编码技术和波形编码技术,计算机的发展为语音编码技术的研究提供了强有力的工具,大规模,超大规模集成电路的出现,则为语音编码的实现提供了基础.80年代以来,语音编码技术有了实质性的进展,产生了新一代的编码算法,这就是混合编码.它将波形编码和参数编码组合起来,克服了原有波形编码和参数编码的弱点,结合各自的长处,力图保持波形编码的高质量和参数编码的低速率.如:多脉冲激励线性预测编码(MPLPC),规划脉冲激励线性预测编码(KPELPC), 码本激励线性预测编码(CELP)等都是属于混合编码技术.其数据率和音质介于参数和波形编码之间.总之,音频压缩技术之趋势有两个:压缩1)降低资料率,提高压缩比,用于廉价,低保真场合(如:电话).2)追求高保真度,复杂的压缩技术(如:CD).语音合成,辨识技术的介绍: 按照实现的功能来分,语音合成可分两个档次:(1)有限词汇的计算机语音输出(2)基于语音合成技术的文字语音转换(TTS:Text-to-Speech)按照人类语言功能的不同层次,语音合成可分为三个层次:(1)从文字到语音的合成(Text-to-Speech)(2)从概念到语音的合成(Concept-to-Speech)(3)从意向到语音的合成(Intention-to-Speech)图7.1是文本到语音的转换过程:文本处理语音合成韵律处理语音数据库词典及语言规范合成语音输出文本输入图7.1从文本到语音转换过程示意语音辨识:语音辨识技术有三大研究范围:口音独立,连续语音及可辨认字词数量. 口音独立:1)早期只能辨认特定的使用者即特定语者(SpeakerDependent,SD)模式,使用者可针对特定语者辨认词汇(可由使用者自行定义,如人名声控拨号),作简单快速的训第7章凌阳音频压缩算法265练纪录使用者的声音特性来加以辨认.随着技术的成熟,进入语音适应阶段SA(speakeradaptation),使用者只要对于语音辨识核心,经过一段时间的口音训练后,即可拥有不错的辨识率.2)非特定语者模式(SpeakerIndependent,SI),使用者无需训练即可使用,并进行辨认.任何人皆可随时使用此技术,不限定语者即男性,女性,小孩,老人皆可. 连续语音:1)单字音辨认:为了确保每个字音可以正确地切割出来,必须一个字一个字分开来念,非常不自然,与我们平常说话的连续方式,还是有点不同.2)整个句子辨识:只要按照你正常说话的速度,直接将要表达的说出来,中间并不需要停顿,这种方式是最直接最自然的,难度也最高,现阶段连续语音的辨识率及正确率,虽然效果还不错但仍需再提高.然而,中文字有太多的同音字,因此目前所有的中文语音辨识系统,几乎都是以词为依据,来判断正确的同音字.可辨认词汇数量:内建的词汇数据库的多寡,也直接影响其辨识能力.因此就语音辨识的词汇数量来说亦可分为三种:1)小词汇量(10-100)2)中词汇量(100-1000)3)无限词汇量(即听写机)图7.2是简化的语音识别原理图,其中实线部分成为训练模块,虚线部分为识别压缩模块.复杂声学,言语条件下的语音输入语音模型声学模式训练语音匹配语音模式训练语音处理识别结果,理解结果语言模型图7.2语音识别原理简图第7章凌阳音频压缩算法2667.2凌阳音频简介7.2.1凌阳音频压缩算法的编码标准表7.1是不同音频质量等级的编码技术标准(频响): 表7.1信号类型频率范围(Hz)采样率(kHz)量化精度(位) 电话话音200~__宽带音频(AM质量)50~__-__调频广播(FM质量)20~15k37.816高质量音频(CD质量)20~20k44.116凌阳音频压缩算法处理的语音信号的范围是200Hz-3.4KHz的电话话音.7.2.2压缩分类压缩分无损压缩和有损压缩.无损压缩一般指:磁盘文件,压缩比低:2:1~4:1. 而有损压缩则是指:音/视频文件,压缩比可高达100:1.凌阳音频压缩算法根据不同的压缩比分为以下几种(具体可参见语音压缩工具一节内容):SACM-A2022年:压缩比为8:1,8:1.25,8:1.5SACM-S480:压缩比为80:3,80:4.5SACM-S240:压缩比为80:1.5按音质排序:A2022年S480S2407.2.3凌阳常用的音频形式和压缩算法1)波形编码:sub-band即SACM-A2022年特点:高质量,高码率,适于高保真语音/音乐.压缩2)参数编码:声码器(vocoder)模型表达,抽取参数与激励信号进行编码.如: SACM-S240.特点:压缩比大,计算量大,音质不高,廉价!3)混合编码:CELP即SACM-S480特点:综合参数和波形编码之优点.除此之外,还具有FM音乐合成方式即SACM-MS01.第7章凌阳音频压缩算法2677.2.4分别介绍凌阳语音的播放,录制,合成和辨识凌阳的__A是16位单片机,具有DSP功能,有很强的信息处理能力,最高时钟频率可达到49MHz,具备运算速度高的优势等等,这些都无疑为语音的播放,录放,合成及辨识提供了条件.凌阳压缩算法中SACM_A2022年,SACM_S480,SACM_S240主要是用来放音,可用于语音提示,而DVR则用来录放音.对于音乐合成MS01,该算法较繁琐,而且需要具备音乐理论,配器法及和声学知识,所以对于特别爱好者可以到我们的网站去了。

H.264H.264是ITU-T以H.26x系列为名称命名的视频编解码技术标准之一。

国际上制定视频编解码技术的组织有两个,一个是“国际电联(ITU-T)”,它制定的标准有H.261、H.263、H.263+等,另一个是“国际标准化组织(ISO)”它制定的标准有MPEG-1、MPEG-2、MPEG-4等。

而H.264则是由两个组织联合组建的联合视频组(JVT)共同制定的新数字视频编码标准,所以它既是ITU-T的H.264,又是ISO/IEC的MPEG-4高级视频编码(AdvancedVideoCoding,AVC),而且它将成为MPEG-4标准的第10部分。

因此,不论是MPEG-4AVC、MPEG-4Part10,还是ISO/IEC14496-10,都是指H.264。

H.264是国际标准化组织(ISO)和国际电信联盟(ITU)共同提出的继MPEG4之后的新一代数字视频压缩格式,它既保留了以往压缩技术的优点和精华又具有其他压缩技术无法比拟的许多优点。

[4]1.低码率(LowBitRate):和MPEG2和MPEG4ASP等压缩技术相比,在同等图像质量下,采用H.264技术压缩后的数据量只有MPEG2的1/8,MPEG4的1/3。

[4]显然,H.264压缩技术的采用将大大节省用户的下载时间和数据流量收费。

[4]2.高质量的图象:H.264能提供连续、流畅的高质量图象(DVD质量)。

[4]3.容错能力强:H.264提供了解决在不稳定网络环境下容易发生的丢包等错误的必要工具。

[4]4.网络适应性强:H.264提供了网络抽象层(NetworkAbstractionLayer),使得H.264的文件能容易地在不同网络上传输(例如互联网,CDMA,GPRS,WCDMA,CDMA2000等)。

[4]H.264最大的优势是具有很高的数据压缩比率,在同等图像质量的条件下,H.264的压缩比是MPEG-2的2倍以上,是MPEG-4的1.5~2倍。

语⾳压缩编码语⾳编码第⼀章⾳频1.1 ⾳频和语⾳的定义声⾳是携带信息的重要媒体,是通过空⽓传播的⼀种连续的波,叫声波。

对声⾳信号的分析表明,声⾳信号有许多频率不同的信号组成,这类信号称为复合信号。

⽽单⼀频率的信号称为分量信号。

声⾳信号的两个基本参数频率和幅度。

1.1.1声⾳信号的数字化声⾳数字化包括采样和量化。

采样频率由采样定理给出。

1.1.2声⾳质量划分根据声⾳频带,声⾳质量分5个等级,依次为:电话、调幅⼴播、调频⼴播、光盘、数字录⾳带DAT(digital audio tape)的声⾳。

第⼆章语⾳编码技术的发展和分类现有的语⾳编码器⼤体可以分三种类型:波形编码器、⾳源编码器和混合编码器。

⼀般来说,波形编码器的话⾳质量⾼,但数据率也很⾼。

⾳源编码器的数据率很低,产⽣的合成话⾳⾳质有待提⾼。

混合编码器使⽤⾳源编码器和波形编码器技术,数据率和⾳质介于⼆者之间。

语⾳编码性能指标主要有⽐特速率、时延、复杂性和还原质量。

其中语⾳编码的三种最常⽤的技术是脉冲编码调制(PCM)、差分PCM(DPCM)和增量调制(DM)。

通常,公共交换电话⽹中的数字电话都采⽤这三种技术。

第⼆类语⾳数字化⽅法主要与⽤于窄带传输系统或有限容量的数字设备的语⾳编码器有关。

采⽤该数字化技术的设备⼀般被称为声码器,声码器技术现在开始展开应⽤,特别是⽤于帧中继和IP上的语⾳。

在具体的编码实现(如VoIP)中除压缩编码技术外,⼈们还应⽤许多其它节省带宽的技术来减少语⾳所占带宽,优化⽹络资源。

静⾳抑制技术可将连接中的静⾳数据消除。

语⾳活动检测(SAD)技术可以⽤来动态跟踪噪⾳电平,并将噪⾳可听度抑制到最⼩,并确保话路两端的语⾳质量和⾃然声⾳的连接。

回声消除技术监听回声信号,并将它从听话⼈的语⾳信号中清除。

处理话⾳抖动的技术则将能导致通话⾳质下降的信道延时与信道抖动平滑掉。

2.1波形编码波形编解码器的思想是,编码前根据采样定理对模拟语⾳信号进⾏采样,然后进⾏幅度量化与⼆进制编码。

霍夫曼编码原理及编码规则引言概述:霍夫曼编码是一种常用的数据压缩算法,通过将出现频率较高的字符用较短的编码表示,从而实现对数据的高效压缩。

本文将介绍霍夫曼编码的原理及编码规则,并分析其在数据压缩中的应用。

正文内容:1. 霍夫曼编码原理1.1 可变长度编码- 霍夫曼编码是一种可变长度编码,不同字符的编码长度不同。

- 出现频率较高的字符使用较短的编码,出现频率较低的字符使用较长的编码。

1.2 无前缀编码- 霍夫曼编码是一种无前缀编码,即任何一个字符的编码都不是其他字符编码的前缀。

- 这样可以避免解码时的歧义,保证解码的唯一性。

1.3 最优编码- 霍夫曼编码是一种最优编码,即平均编码长度最短。

- 通过构建霍夫曼树,将出现频率较高的字符放在树的顶部,出现频率较低的字符放在树的底部,从而实现最优编码。

2. 霍夫曼编码规则2.1 构建霍夫曼树- 统计字符出现的频率,根据频率构建霍夫曼树。

- 霍夫曼树的构建可以使用贪心算法,每次选择频率最低的两个节点合并,直到只剩下一个根节点。

2.2 分配编码- 从根节点开始,向左走为0,向右走为1,将每个字符的编码从根节点到叶子节点的路径记录下来。

- 通过遍历霍夫曼树,分配每个字符的编码。

2.3 压缩数据- 将原始数据中的每个字符替换为对应的编码。

- 将编码后的数据按照固定长度进行存储,从而实现数据的压缩。

3. 应用场景3.1 数据压缩- 霍夫曼编码可以对数据进行高效压缩,减小存储空间的占用。

- 在图像、音频、视频等大数据文件的传输和存储中,霍夫曼编码被广泛应用。

3.2 传输错误检测- 霍夫曼编码具有一定的纠错能力,可以检测传输中的错误。

- 通过校验编码的长度和校验和等方式,可以检测出传输中发生的错误。

3.3 数据加密- 霍夫曼编码可以用于数据加密,通过将原始数据转换为编码后的数据,增加数据的安全性。

- 在信息安全领域中,霍夫曼编码被用于数据加密和解密的过程。

总结:霍夫曼编码是一种可变长度、无前缀的最优编码算法,通过构建霍夫曼树和分配编码,实现对数据的高效压缩。