量子计算机基本原理是什么,又长什么样

- 格式:doc

- 大小:17.38 KB

- 文档页数:8

量子计算技术的原理解析1. 什么是量子计算技术量子计算技术是一种基于量子力学理论的计算思想和计算方法,它在基本概念、运算方式和应用场合等方面都有很大的不同于传统计算机的特点。

量子计算技术潜在的优势在于它可以处理传统计算机难以解决的问题,例如分子模拟、密码学和优化问题等。

2. 量子计算机的物理实现实现量子计算机,需要用到量子比特或qubit,可以是物理塞曼核自旋、电子自旋、量子点电荷等多种物理系统。

量子计算机和经典计算机不同,单个qubit可以同时处于多种状态,这种状态称为叠加态。

一个含有n个叠加态qubit的量子系统,它的状态可以被表示为一个包含2^n复数系数的量子状态向量,这个向量的每个系数是在某个状态里测量该量子系统时,所得到的概率幅。

3. 量子计算机的运算在量子计算机中,位运算和传统计算机一样,但是过程不一样。

传统计算机中的逻辑门经过特定的电信号作用转化为输出信号,而量子计算机的逻辑门则是用来干涉量子态的,使得量子态进行相互干涉和纠缠。

量子计算机的运算以幺正矩阵为基础,所有的逻辑门都是由单量子门和CPHASE门组合而成的。

其中单量子门可以简单的改变一个比特的叠加态,而CPHASE门则是用来干涉两个比特的叠加态。

4. 量子计算机的算法量子计算机的算法比传统的算法,要快得多,例如Shor's算法,Grover's搜索算法,这些算法的实现都是基于量子纠缠和量子干涉的。

Shor's算法可以在多项式时间内整数因数分解,这在传统计算机中是一个NP难问题;而Grover's搜索算法可以在O(2^(N/2))步骤内从无序数据库中搜索出指定的记录,传统计算机则需要O(2^N)步才能实现。

这些算法都是可以用量子计算机实现的,但是传统计算机却不能做到。

5. 量子计算技术的应用前景除了上述算法之外,量子计算技术在化学合成、材料科学、生物医药、金融等领域都有广泛的应用前景,例如在药物筛选中可以为药物设计师加速筛选过程;在量子化学计算中可以计算出大规模多原子分子的电子结构和反应性;在金融领域则可以用来编码和解码金融信息和信用卡信息等。

什么是量子计算它对信息技术的意义是什么量子计算,又称为量子计算机,是一种利用量子力学原理进行计算和存储信息的计算模型。

相比传统的二进制计算机,量子计算机利用了量子叠加和量子纠缠等特殊性质,具有更强大的计算能力和信息处理速度。

本文将介绍量子计算的概念、原理和应用,并探讨其对信息技术的意义。

一、什么是量子计算量子计算的概念可追溯到20世纪80年代,由美国物理学家理查德·费曼在科学论文中首次提出。

量子计算使用量子比特(qubit)作为信息的基本单位,与经典计算机的比特(bit)不同。

比特只能表示0或1两种状态,而量子比特可以同时处于0和1的叠加态,这种特性被称为量子叠加。

量子计算利用量子叠加和量子纠缠实现并行计算,可以在同一时间内处理多个计算任务,大大提高了计算效率。

此外,量子计算还具备量子随机性和量子相干性,可用于解决某些问题,如大整数分解和模拟量子系统等,对于经典计算机难以解决的问题,量子计算机更具优势。

二、量子计算的原理量子计算的基本原理涉及量子力学的相关概念,其中最重要的是量子叠加和量子纠缠。

1. 量子叠加量子叠加是指量子比特可以处于0和1两种状态的叠加态。

具体而言,一个量子比特可以被表示为α|0⟩+ β|1⟩的线性组合,其中α和β为复数,表示相应状态的概率振幅。

当进行测量时,量子比特会坍缩到具体状态0或1,根据几率规则确定测量结果。

2. 量子纠缠量子纠缠是指多个量子比特之间的非经典关联。

当多个量子比特处于纠缠态时,它们的状态无法独立描述,而是共同构成一个系统的整体状态。

改变系统中一个量子比特的状态,会立即影响到其他纠缠的比特,即实现了远程相互作用。

基于量子叠加和量子纠缠的原理,量子计算机可以同时处理多个计算任务,并在一定情况下实现指数级的计算速度提升。

三、量子计算对信息技术的意义量子计算作为下一代计算技术的前沿领域,具有重要的意义和广阔的应用前景。

1. 加速传统计算量子计算的并行计算能力使其在某些问题上远超过传统计算机。

量子计算机量子计算机处理器量子计算机(quantum computer)是一类遵循量子力学规律进行高速数学和逻辑运算、存储及处理量子信息的物理装置。

当某个装置处理和计算的是量子信息,运行的是量子算法时,它就是量子计算机。

量子计算机的概念源于对可逆计算机的研究。

研究可逆计算机的目的是为了解决计算机中的能耗问题。

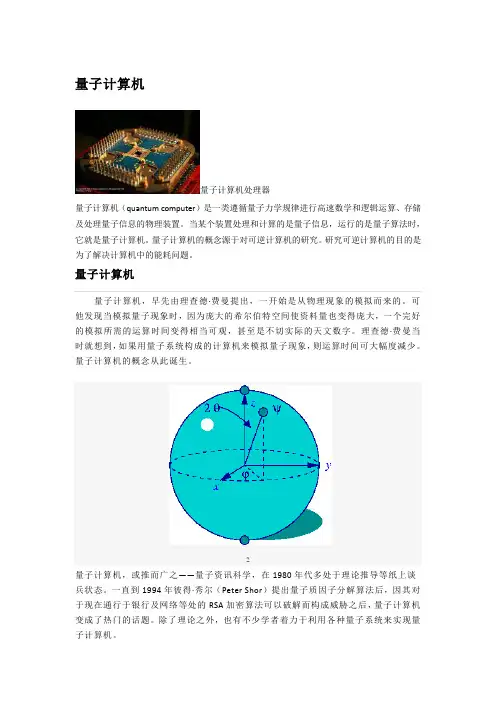

量子计算机量子计算机,早先由理查德·费曼提出,一开始是从物理现象的模拟而来的。

可他发现当模拟量子现象时,因为庞大的希尔伯特空间使资料量也变得庞大,一个完好的模拟所需的运算时间变得相当可观,甚至是不切实际的天文数字。

理查德·费曼当时就想到,如果用量子系统构成的计算机来模拟量子现象,则运算时间可大幅度减少。

量子计算机的概念从此诞生。

2量子计算机,或推而广之——量子资讯科学,在1980年代多处于理论推导等纸上谈兵状态。

一直到1994年彼得·秀尔(Peter Shor)提出量子质因子分解算法后,因其对于现在通行于银行及网络等处的RSA加密算法可以破解而构成威胁之后,量子计算机变成了热门的话题。

除了理论之外,也有不少学者着力于利用各种量子系统来实现量子计算机。

半导体靠控制集成电路来记录和运算信息,量子电脑则希望控制原子或小分子的状态,记录和运算信息。

图2:布洛赫球面乃一种对于二阶量子系统之纯态空间的几何表示法,是建立量子计算机的基础。

20世纪60年代至70年代,人们发现能耗会导致计算机中的芯片发热,极大地影响了芯片的集成度,从而限制了计算机的运行速度。

研究发现,能耗来源于计算过程中的不可逆操作。

那么,是否计算过程必须要用不可逆操作才能完成呢?问题的答案是:所有经典计算机都可以找到一种对应的可逆计算机,而且不影响运算能力。

既然计算机中的每一步操作都可以改造为可逆操作,那么在量子力学中,它就可以用一个幺正变换来表示。

早期量子计算机,实际上是用量子力学语言描述的经典计算机,并没有用到量子力学的本质特性,如量子态的叠加性和相干性。

量子计算机原理量子计算机是一种基于量子力学原理设计的计算模型,与经典计算机完全不同。

这种计算机利用量子叠加和量子纠缠等性质,可以在指数级别上加速某些特定的计算任务,例如质因数分解、化学反应模拟等。

经典计算机不适合处理这些问题,因为许多问题的复杂度都是指数级别的,需要大量的时间和资源才能完成。

量子计算机的核心是量子比特或qubit。

与经典比特有两个状态0或1不同,量子比特可以表示为任意的线性组合,即0和1的加权和。

此外,量子比特还具有量子叠加和量子纠缠等特性,使得其可以在一定条件下同时存在多个状态,实现某些计算任务的快速处理。

量子计算机的运行过程可以分为三个主要阶段:初始化、操作和读取。

在初始化阶段,量子比特被置于一定的状态,称为量子态。

在操作阶段,一系列量子门操作被施加到量子比特上,以实现特定的计算任务。

量子门操作是用于改变量子比特之间相互作用的操作,例如Hadamard门和CNOT门等。

在读取阶段,量子比特的状态被量化,并得到质量结果。

但是,量子计算机的设计和操作过程并不容易。

其中最大的困难之一是量子误差纠正问题。

由于任何操作都会引入一些型错误,导致计算结果不精确。

此外,量子比特之间的相互作用也会导致误差的增加,因此需要使用量子纠错代码来抵消这些误差。

另一个重要的问题是保持量子比特的相干性。

量子比特很容易受到外部噪声和干扰的影响,从而失去其相干性。

这些干扰源可以来自于环境、电磁波辐射和其他硬件问题,因此需要使用量子红外线冷却器和超导材料等技术来保持量子比特的相干性。

总的来说,量子计算机是未来计算领域的一种重要的发展趋势。

虽然这种计算机目前还处于研究阶段,但科学家们已经开始进行实验验证,并研究各种量子算法和量子协议。

相信在不久的将来,量子计算机将成为计算领域的一项重大突破,并广泛应用于各个领域,从而引发新的科技革命。

量子计算技术的发展和应用随着科学技术的不断发展,人们对于计算技术的需求也越来越高,传统的计算机已经难以满足人们的需要。

因此,量子计算技术应运而生。

量子计算技术是一种基于量子力学原理的计算方式,与传统计算机相比,它具有更强的计算能力和更高的效率。

本文将从量子计算技术的基本原理、技术发展历程、应用前景等方面进行探讨。

一、基本原理量子力学是一种描述自然界微观物理现象的理论,它描绘的是微观粒子的运动状态。

量子计算机的基本理论就是利用量子力学原理,通过量子比特和量子门,对量子态进行操作,实现计算。

量子比特是量子计算机的基本要素,它与传统计算机的比特不同。

传统计算机的比特只有两种状态,即0和1,而量子比特则呈现出量子叠加态,其状态可以同时表现出0和1,这意味着量子计算机具备在同一时间内处理多个计算任务的能力。

量子门是量子计算机的基本操作单元,相当于传统计算机的逻辑门,在量子力学的描述下,它可以对多个量子状体进行相互作用实现计算操作。

这种相互作用方式与传统计算机的逻辑运算方式不同,量子计算机在操作过程中会产生叠加态和纠缠态等非经典特性,这也是量子计算机能够实现高效计算的重要原因之一。

二、技术发展历程量子计算技术的研究始于上世纪80年代,自那时起,科学家们开始探索利用量子力学原理进行计算的可能性。

在接下来的20年里,科研人员逐渐发现了量子计算技术的局限性和技术难点。

其中最主要的就是量子比特的制备和保持时间短,以及量子门的实现难度大等问题。

随着科学技术的不断进步,量子计算技术愈加成熟。

2001年,IBM联合加州大学圣巴巴拉分校成功实现了13量子比特的量子计算机;2010年,加拿大D-Wave公司推出了世界上第一台商用量子计算机;2016年,中国科学家在实验中成功实现了10个量子比特的量子运算。

过去几年,世界各国纷纷加强对于量子计算技术的投入和研究,不断探索更多潜在的应用领域,这为量子计算技术的发展带来了巨大的机遇。

量子计算机的工作原理解析量子计算机是近年来备受关注的前沿技术,相比传统计算机,它拥有更快的计算速度和更强的处理能力,可以帮助我们解决各种复杂问题。

那么,量子计算机的工作原理是什么呢?本文将对此进行探讨。

一、量子计算的基本原理传统计算机使用的是二进制系统,即由0和1两种状态组成。

而量子计算机则是基于量子比特(qubit)这种特殊的量子态来完成计算。

量子态与经典态不同,它可以同时处于多个状态,这一现象被称为叠加态。

例如,一个量子比特可以同时处于0和1两种状态,表示为|0⟩和|1⟩,也可以处于两种状态的叠加态,如(√2/2|0⟩+ √2/2|1⟩)。

这种叠加态使得量子计算机可以在单次计算中同时处理多个问题,从而大大提高了计算效率。

另外,量子比特还有一个重要的性质:量子纠缠。

当两个或多个量子比特之间存在纠缠时,它们之间的状态将会发生共振,这种现象被称为量子纠缠。

当其中一个量子比特发生改变时,其他量子比特也会跟着发生改变,无论它们之间的距离有多远。

这种纠缠现象是量子计算中的重要资源,可以用来进行量子通信、量子加密等操作。

二、量子门的作用为了对量子比特进行操作,量子计算机使用的是一系列量子门。

量子门本质上是对量子比特的一种操作,它可以将一个量子比特从一个状态转换成另一个状态。

例如,最常用的量子门是Hadamard门,它可以将|0⟩态转变为(√2/2|0⟩+ √2/2|1⟩)态,将|1⟩态转变为(√2/2|0⟩- √2/2|1⟩)态。

通过使用多个量子门和纠缠技术,量子计算机可以完成各种计算任务。

三、量子计算机的工作流程量子计算机的工作流程主要包括以下几个步骤:1. 初始化。

将量子比特置于所需的初始状态,通常使用|0⟩态或|1⟩态。

2. 量子门操作。

通过使用各种量子门将量子比特转换成所需的状态,同时利用纠缠技术实现多个比特之间的操作。

3. 量子测量。

测量量子比特的状态,得到一个确定的值。

4. 根据测量结果做出判断。

量子计算机及其原理随着社会的进步和科技的发展,计算机科学也在不断地发展和进步。

近年来,量子计算机的出现引起了广泛的关注和讨论。

与传统计算机不同,量子计算机利用量子力学的原理进行计算,其计算速度可以达到远远超过传统计算机的水平。

本文将从量子计算机的原理、优势和应用等方面进行探究和分析。

一、量子计算机的原理量子计算机是利用量子力学的原理进行计算的一种新型计算机。

量子力学是研究微观粒子运动和相互作用规律的一门学科。

根据量子力学原理,微观粒子的行为具有不确定性和叠加性,即微观粒子是以概率形式存在的,同时,一个量子比特可以处于多种状态的叠加状态。

量子计算机利用量子比特代替传统计算机的二进制比特,采用量子叠加和纠缠等特殊的量子力学原理进行计算。

与传统计算机相比,量子计算机的运算速度可以达到远远超过传统计算机的水平。

这是因为传统计算机是利用二进制比特进行运算,每个二进制比特只能存在于0或1状态中的一个,而量子比特可以处于多种状态的叠加状态中,从而能够进行更加复杂的运算。

二、量子计算机的优势相比传统计算机,量子计算机具有以下优势:1.运算速度更快:由于量子计算机采用量子叠加和纠缠等特殊的量子力学原理进行计算,其运算速度可以达到远远超过传统计算机的水平。

2.数据处理能力更强:量子计算机可以处理更加复杂的数据结构和算法,可以解决传统计算机无法处理的问题。

3.信息传输更加安全:量子计算机采用量子纠缠原理,可以实现量子密钥分发,从而实现更加安全的信息传输。

4.节约成本:由于量子计算机可以进行更加高效的计算,从而可以节约成本,提高计算效率。

三、量子计算机的应用目前,量子计算机的研究和应用还处于起步阶段,但是其应用前景十分广阔,主要应用领域包括以下几个方面:1.密码学:利用量子计算机进行加密和解密,保护数据的安全性。

2.化学模拟:利用量子计算机模拟分子的结构和性质,加速药物研发。

3.机器学习:利用量子计算机进行数据挖掘和机器学习,提高大数据处理的效率。

量子计算机技术的原理及应用随着科技的不断进步,量子计算机已成为人们瞩目的焦点。

量子计算机,简称量子计算,是利用量子力学原理设计的一种新型计算机。

与传统计算机相比,量子计算机在计算速度和可执行的算法等方面有着巨大的潜力。

下面将从量子计算机技术的原理、应用等方面进行深入探讨。

量子计算机的原理量子计算机的主要运作原理是基于量子力学原理的。

量子力学中存在着“叠加态”和“纠缠态”,量子比特可以同时处于多个状态中,这是传统计算机做不到的。

量子计算通过精确控制量子比特的叠加态和纠缠态,来执行特定算法,以实现对复杂问题的高效求解。

量子计算机的核心部分是量子比特,量子比特包括两个量子态:叠加态和纠缠态。

其中,叠加态指的是两个或多个不同态的相加,这种状态下,量子比特具有多种状态的叠加;而纠缠态指的是两个或多个量子比特之间存在联系,一个量子比特的状态改变会影响其他量子比特,即“量子纠缠”。

量子计算机的应用随着量子计算机技术的日益成熟,其应用场景也越来越广泛。

以下是量子计算机常见的应用:1.密码学传统的密码学是基于某些数学问题的算法,但现代密码学却需要使用更高效的算法。

而量子计算机在解决这些问题上有着天然的优势,可以有效地破解传统密码学算法。

因此,量子计算机可以被用来打破传统密码,而后者则可以利用量子计算机的特性来提高安全性。

这种“打破密码学-创建密码学”之间的关系,被称为“量子密码学”。

2.化学计算在化学领域中,计算机的主要作用是预测分子的性质和反应,并设计更好的材料和药物。

传统计算机在这些问题上的处理速度十分缓慢,而又不够准确,因此限制着设计师的创新性。

量子计算机可以模拟分子的量子力学状态,在更短的时间内更准确地预测分子的性质和反应,为材料和药物的研发提供全新的方法。

3.优化问题许多有意义的问题,如运输和旅行路径、资源分配、排产和交通流等都伴随着优化问题的存在。

在这些问题上,传统计算机需要运行大量时间,而量子计算机的速度则可以充分发挥其算法的潜力快速求解。

解读:颠覆常识的量子计算到底是什么?

量子计算的潜力有多大?传统计算用尽洪荒之力几十年才能解决的数据问

题,量子计算可能只需要1秒就可以搞定。

中国科学技术大学潘建伟与陆朝阳课题组于2017年成功研制出世界首台超

越早期传统计算机的量子计算机。也正是看到了这样的“洪荒之力”,各大巨

头开始入局量子计算。2017年底,IBM称已成功研制出50个量子比特的量

子计算处理器样机。据报道,谷歌正在研究49个量子比特的芯片,英特尔、

微软也加大了对量子计算的投入。

量子计算的基本原理

量子计算是一种基于量子效应的新型计算方式。基本原理是以量子位作为

信息编码和存储的基本单元,通过大量量子位的受控演化来完成计算任务。

所谓量子位就是一个具有两个量子态的物理系统,如光子的两个偏振态、

电子的两个自旋态、离子(原子)的两个能级等都可构成量子位的两个状态

——晶体管只有开/关状态,也就是要幺是0状态,要幺是1状态;而基于量

子叠加性原理,一个量子位可以同时处于0状态和1状态,当量子系统的状

态变化时,叠加的各个状态都可以发生变化。

举例来说,因为1个量子位同时表示0和1两个状态,2个这样的量子态

就可以同时表示4个状态。N个量子位可同时存储2的二次方N个数据,数

据量随N呈指数增长。同时,量子计算机操作一次可同时对2的二次方N数

据实现变换,这种并行处理数据的能力等效于电子计算机要进行2的二次方

N次方操作的效果......等于是一次演化相当完成了2的N次方个数据的并行

量子计算机基本原理是什么,又长什么样(原标题:再谈量子计算机:中国队有何突破;基本原理是什么,又长什么样)唐旭安妮晓查发自凹非寺量子位报道| 公众号QbitAI 继续谈谈量子计算。

昨天,中科院召开发布会正式宣布:“世界首台超越早期经典计算机的光量子计算机在中国诞生”。

这件事当然要点赞,不过也要有正确的姿势。

几个要点有人在激动之余,把这件事理解为“世界第一台量子计算机诞生”,这显然就不对了。

也没有正确理解中科大潘建伟、陆朝阳、朱晓波和浙大王浩华等教授,经过长期攻关获得的这一成果。

中国这台量子计算机性能如何?通过公开信息可见:■ 目前只有一个单光子的量子模拟机,并且证明了通过量子计算的并行性加速求解线性方程组的可行性。

■ 这个科研用的模拟机,性能比人类第一台电子管计算机(1946年诞生)和第一台晶体管计算机(1954年诞生)快10-100倍。

实际上,这件事的突破之处体现在以下三个方面:1、高效率多光子玻色采样在玻色采样这个问题上,量子算法有着指数级的优势。

潘建伟团队制造出一台专门计算玻色采样的光量子计算机,在计算三光子、四光子、五光子玻色采样问题时,计算速度比国外同行和早期计算机要快。

相关论文:/nphoton/journal/vaop/ncurrent/full/n photon.2017.63.html2、超导电路中实现10比特纠缠和并行逻辑运算就目前已经公开的情况看,是超导量子系统中最多的比特纠缠数,这在全世界也是处于领先的水平。

相关论文:https:///pdf/1703.10302.pdf3、使用超导量子处理器求解线性方程组在四个超导量子比特上,证明了通过量子计算的并行性加速求解线性方程组的可行性。

相关论文:https:///pdf/1703.06613.pdf先说到这里,懂的自然懂,不懂的应该还是不懂……有专业人士给了量子位一个简单的总结:是个很棒的成果,但仍然需要冷静看待。

基本原理和现状概况昨天不少读者在后台留言,希望解释一下量子计算机。

那么,接下来量子位就强行讲讲量子计算机。

目前量子计算机有很多实现的方法,上面潘建伟团队使用的就是超导+多光子的方法。

除此以外,还有半导体量子芯片和离子阱等等路径。

为了制造量子计算机,谷歌、IBM想出的办法是用超导回路,深耕半导体行业几十年的英特尔希望用传统的硅晶体管,而一家名为ionQ的公司则是使用离子。

核心原理无非一个:进入量子力学奇怪和反直觉的世界(包括叠加态以及纠缠、隧穿),加快计算速度。

与传统计算机使用0或者1的比特来存储信息不同,量子计算机使用量子比特来存储信息。

量子比特存储的信息可能是0、可能是1,或者有可能既是0也是1。

量子力学认为,微观物体可以处于一种“似是而非”的状态,即一个原子可以同时处于两种状态。

1个量子比特可以存储2种状态的信息,也就是0和1;2个量子比特就可以存储4种状态的信息,3个8种,4个16种。

量子计算机的性能随着“量子比特”的增加呈指数增长,而传统计算机按“比特位”呈线性增长。

总有那么一个临界点,量子计算机的性能就会超过传统计算机。

虽然量子计算机看似美好,但目前还有许多挑战,最大的问题在于这些计算机的精度相比传统计算机实在是低太多了。

一些微小的扰动,都可能带来极大的破坏。

不久前,在IBM在和ionQ公司的一次量子计算机大比拼中,两家开发的计算机分别只有35%和77%的运算正确率。

这还只是5个量子比特的情况,如果是有成千上万个量子比特,那量子计算机恐怕根本不可能得到正确的结果。

而且5个量子比特的计算机现阶段远远落后于我们手中的笔记本电脑。

长什么样?举个栗子说一千道一万,量子计算机到底社么样?我们来举一个真实的“栗子”:D-Wave。

这家加拿大公司是量子计算机界一个充满争议的明星。

D-Wave开发出了世界上第一台商用量子计算机。

年初,他们推出可以处理2000量子比特的第四代产品:2000Q,售价超过1亿元人民币。

设备环境D-Wave 2000Q系统的外壳长宽高大约是3×2×3(米),其包含的硬件包括了复杂的低温制冷系统、防护罩、I/O系统,只为了支持一个指甲盖大小的QPU。

制冷系统占据了D-Wave 2000Q的大部分物理体积。

量子效应的发生条件是非常严格的。

量子处理器(QPU)需要在绝对零度(-273.15℃)附近的温度才能运行——屏蔽磁场、隔离震动和外部因素的干扰都需要绝对零度的低温环境。

还要将量子计算机放到比地球磁场弱50000倍(基本相当于没有磁场)、大气压比地球小100亿倍(基本相当于真空)的环境中,以保持量子状态的稳定。

这些都是通过闭式循环冰箱实现的,它实现了0.015K(-273.135℃)的低温环境。

D-Wave的“干燥”稀释制冷机使用了液氦制冷剂。

温度由顶端的室温逐层递减,直到QPU部分接近绝对零度。

(50K:-223.15℃,4K:-269.15℃,1K:-272.15℃,100mK:-273.05℃,15mK:-273.135℃,绝对零度:-273.15℃)关于QPUD-Wave的QPU由容纳着若干铌制微型环的晶格组成,每个晶格是一个量子比特。

在低于9.2K的温度下,铌会成为超导体并显露量子力学效应。

在量子态下,电流会同时向两个方向流动,这代表量子比特正处于叠加状态,即同时处于“0”和“1”两个状态。

在问题解决过程的最末端,这种量子叠加态会坍缩回“0”或“1”两种状态的其中一种。

实现由单个量子比特到多个量子比特组成的QPU的进步,需要量子比特间的互连以进行信息交换。

量子比特之间通过耦合器相连,后者同样是超导体环。

量子比特和耦合器之间的互连,和管控磁场的控制电路共同创造了一个可编程的量子元件的集成结构。

当QPU得到问题的解决方案时,所有的量子比特会在它们的最终状态下稳定下来,而它们承载的数值将会以比特串的形式反馈给使用者。

D-Wave 2000Q系统最多能装下2048个量子比特和5600个耦合器。

为了实现这个规模,其使用了128000个约瑟夫逊结,这也让D-Wave 2000Q的QPU在当时成为了有史以来最为复杂的超导集成电路。

D-Wave的系统耗能低于25千瓦,其中大部分用于制冷及操控前端服务器。

水冷系统的需求和一个厨房龙头所能提供的水量相当,其所需的空调水平是同等规模系统的十分之一。

如今百万亿亿次级的超算的耗能大概等同于胡佛水坝所制造的。

退火算法与经典的计算方法截然不同,D-Wave 的量子计算机,运用量子退火算法来解决问题,即利用真实世界中量子系统的天然倾向来寻找低功耗的状态。

如果用一个高低不等的地形图来代表最优解问题,地形图上的每一个坐标代表一种可能的解决方案,而每一点的海拔代表它的功耗,那么最佳解决方案就在山谷最深处最低的那一点上。

计算过程通过将量子处理器(QPU)初始化至某一已知问题的基态,同时让系统朝着待解决问题进行退火而完成,这也让其在计算过程中能够自始至终保持低功耗的状态。

(广域寻找最低点)计算结束后,每个量子比特都以“0”或“1”的状态呈现,最终的状态就会是待解决问题的最优解或近似最优解。

如何编程D-Wave 2000Q系统提供了一个标准的网络API(基于RESTful服务),其客户端库向C/C++、Python、MATLAB语言开放。

操作接口允许用户将系统作为网络上的云资源来接入,同时用户也可以选择将其整合进自己的高性能计算环境及数据中心中。

为了对系统进行编程,用户得把要解决的问题,映射成在“广域寻找最低点”的模型。

用户可以以多种不同的方式向系统提交问题。

最终,问题将表现为一组数值,这组数值将与量子比特的权重和耦合器的强度相当。

系统会将这些数值和其他用户指定的参数囊括在内,并向QPU发送一道QMI指令。

问题的解决方案将会是量子比特所找到的最优配置,即“功耗地形图”上的最低点。

这些数值将被返回给网络上的用户程序。

量子计算机是概率性的而非确定性的,因此返回给用户的可能是多组数值,它不仅能提供系统寻找到的最佳解决方案,同时也提供其他可供选择的优秀替代方案。

用户可以指定系统向自己发送解决方案的数量。

D-Wave 系统旨在用于对古典计算机进行补充。

有很多量子计算机可以协助高性能计算系统(HPC)的例子。

另外,量子计算机非常合适离散优化,而HPC在大规模数值模拟中表现更好。

能力及应用D-Wave的旗舰产品,是有2000量子比特的D-Wave 2000Q量子计算机,这是世界上最先进的量子计算机之一。

这台计算机基于一个新型超导处理器,使用量子力学来大规模加速计算。

D-Wave 2000Q最适合解决许多领域中的复杂问题,例如:· 优化· 机器学习· 抽样/蒙特卡洛· 模式识别和异常检测· 网络安全· 图像分析· 财务分析· 软件/硬件检验和确认· 生物信息学/癌症研究D-Wave的首名客户是国防工业承包商洛克希德马丁。

这是一家美国航空航天制造厂商,并以开发、制造军用飞机闻名。

Lockheed Martin 购入了D-Wave的量子运算系统。

2013年,谷歌、NASA (美国航空航天局)和USRA(高校空间研究协会)共同创建了量子人工智能实验室,并在NASA的Ames研究中心安装了D-Wave的量子计算机。

科学家正在试图探索量子计算的潜力以及在复杂问题处理上的适用范围,如网页搜索、语音识别、规划和调度、空中交通管制、对其他行星的机器人任务的支持和控制。

2015年,谷歌通过对硬件优化的基础测试得到了结果。

在D-Wave系统上运行任务显示,“对于涉及近1000个二进制变量的计算中,可以看出量子计算机的性能完全优于传统计算机。

比传统的单核模拟计算机快了108倍”。

2016年,洛斯阿拉莫斯国家实验室(Los Alamos National Laboratory)申请到了用D-Wave系统研究量子退火技术的应用能力。

目前科学家在不同的程序集上已经取得了进展。

好啦,量子计算仍然是一个非常前沿的领域,还没有真正实现通用量子计算的程度。

所谓的量子霸权,只不过是希望量子计算机有朝一日,能够从性能上超过传统的经典计算机。

一切都在快速发展,今天量子位就强行解释到这。

责任编辑:白鑫_NT4464。