hadoop面试题汇总

- 格式:docx

- 大小:48.80 KB

- 文档页数:3

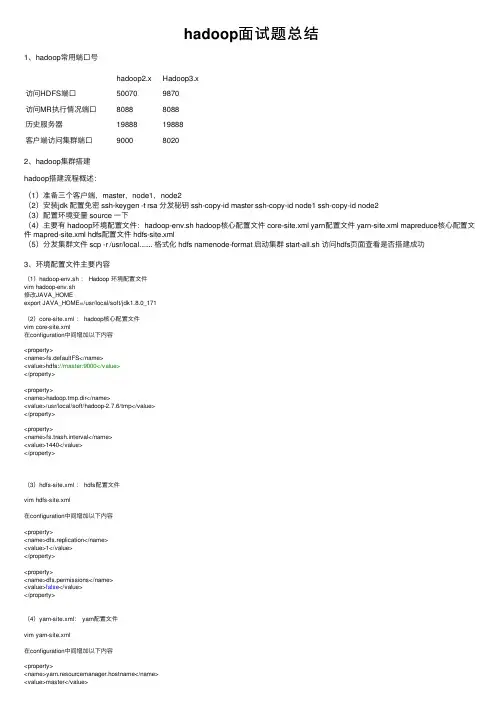

hadoop⾯试题总结1、hadoop常⽤端⼝号hadoop2.x Hadoop3.x访问HDFS端⼝50070 9870访问MR执⾏情况端⼝8088 8088历史服务器19888 19888客户端访问集群端⼝9000 80202、hadoop集群搭建hadoop搭建流程概述:(1)准备三个客户端,master,node1,node2(2)安装jdk 配置免密 ssh-keygen -t rsa 分发秘钥 ssh-copy-id master ssh-copy-id node1 ssh-copy-id node2(3)配置环境变量 source ⼀下(4)主要有 hadoop环境配置⽂件:hadoop-env.sh hadoop核⼼配置⽂件 core-site.xml yarn配置⽂件 yarn-site.xml mapreduce核⼼配置⽂件 mapred-site.xml hdfs配置⽂件 hdfs-site.xml(5)分发集群⽂件 scp -r /usr/local....... 格式化 hdfs namenode-format 启动集群 start-all.sh 访问hdfs页⾯查看是否搭建成功3、环境配置⽂件主要内容(1)hadoop-env.sh : Hadoop 环境配置⽂件vim hadoop-env.sh修改JAVA_HOMEexport JAVA_HOME=/usr/local/soft/jdk1.8.0_171(2)core-site.xml : hadoop核⼼配置⽂件vim core-site.xml在configuration中间增加以下内容<property><name>fs.defaultFS</name><value>hdfs://master:9000</value></property><property><name>hadoop.tmp.dir</name><value>/usr/local/soft/hadoop-2.7.6/tmp</value></property><property><name>fs.trash.interval</name><value>1440</value></property>(3)hdfs-site.xml : hdfs配置⽂件vim hdfs-site.xml在configuration中间增加以下内容<property><name>dfs.replication</name><value>1</value></property><property><name>dfs.permissions</name><value>false</value></property>(4)yarn-site.xml: yarn配置⽂件vim yarn-site.xml在configuration中间增加以下内容<property><name>yarn.resourcemanager.hostname</name><value>master</value></property><property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><name>yarn.log-aggregation-enable</name><value>true</value></property><property><name>yarn.log-aggregation.retain-seconds</name><value>604800</value></property><property><name>yarn.nodemanager.resource.memory-mb</name><value>20480</value></property><property><name>yarn.scheduler.minimum-allocation-mb</name><value>2048</value></property><property><name>yarn.nodemanager.vmem-pmem-ratio</name><value>2.1</value></property>(5)mapred-site.xml: mapreduce配置⽂件重命名mv mapred-site.xml.template mapred-site.xmlvim mapred-site.xml在configuration中间增加以下内容<property><name></name><value>yarn</value></property><property><name>mapreduce.jobhistory.address</name><value>master:10020</value></property><property><name>mapreduce.jobhistory.webapp.address</name><value>master:19888</value></property>3、hdfs读写流程写流程:1)客户端向namenode请求上传⽂件,namenode检查⽬标⽂件是否已存在,⽗⽬录是否存在。

hadoop常见面试问题

以下是一些Hadoop常见的面试问题:

1. Hadoop是什么?它在大数据领域中的作用是什么?

2. Hadoop的核心组件有哪些?它们各自的作用是什么?

3. HDFS是什么?它有哪些特点和优势?

4. MapReduce是什么?它是如何工作的?

5. YARN是什么?它在Hadoop中的作用是什么?

6. 在Hadoop中如何处理数据倾斜?有哪些常见的数据倾斜问题需要避免?

7. Hadoop集群的部署和配置需要注意哪些问题?

8. 如何优化Hadoop集群的性能?有哪些常见的性能调优方法?

9. 在Hadoop中如何进行数据迁移?有哪些常见的迁移策略?

10. 如何进行Hadoop的安全性配置和管理?有哪些常见的安全措施需要采取?

11. Hadoop和Spark的区别和联系是什么?在什么情况下应该选择Hadoop或Spark?

12. 在Hadoop中如何进行数据清洗和预处理?有哪些常用的工具和库可以使用?

13. 如何使用Hadoop进行机器学习和数据挖掘?有哪些常见的算法和应用场景?

14. Hadoop的版本演进和兼容性问题需要注意哪些方面?

15. 你如何在Hadoop上进行大数据实时流处理?有哪些常用的流处理框架可以选择和使用?。

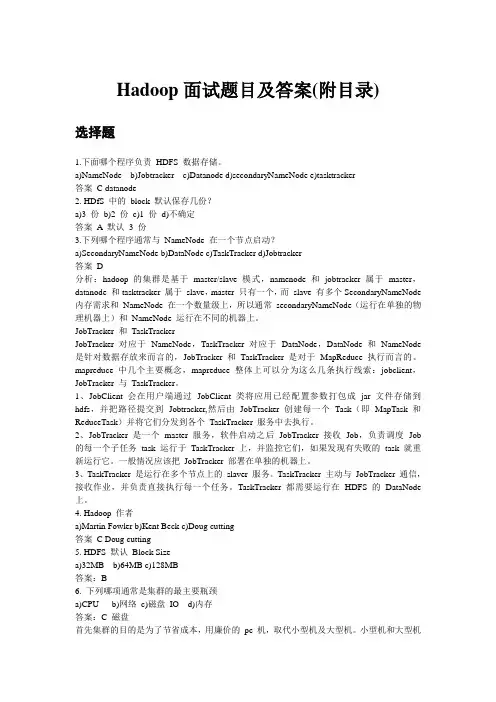

Hadoop面试题目及答案(附目录)选择题1.下面哪个程序负责HDFS 数据存储。

a)NameNode b)Jobtracker c)Datanode d)secondaryNameNode e)tasktracker答案C datanode2. HDfS 中的block 默认保存几份?a)3 份b)2 份c)1 份d)不确定答案A 默认3 份3.下列哪个程序通常与NameNode 在一个节点启动?a)SecondaryNameNode b)DataNode c)TaskTracker d)Jobtracker答案D分析:hadoop 的集群是基于master/slave 模式,namenode 和jobtracker 属于master,datanode 和tasktracker 属于slave,master 只有一个,而slave 有多个SecondaryNameNode 内存需求和NameNode 在一个数量级上,所以通常secondaryNameNode(运行在单独的物理机器上)和NameNode 运行在不同的机器上。

JobTracker 和TaskTrackerJobTracker 对应于NameNode,TaskTracker 对应于DataNode,DataNode 和NameNode 是针对数据存放来而言的,JobTracker 和TaskTracker 是对于MapReduce 执行而言的。

mapreduce 中几个主要概念,mapreduce 整体上可以分为这么几条执行线索:jobclient,JobTracker 与TaskTracker。

1、JobClient 会在用户端通过JobClient 类将应用已经配置参数打包成jar 文件存储到hdfs,并把路径提交到Jobtracker,然后由JobTracker 创建每一个Task(即MapTask 和ReduceTask)并将它们分发到各个TaskTracker 服务中去执行。

3.6误)3.7Hadoop支持数据的随机读写。

(错) (8)NameNode负责管理metadata,client端每次读写请求,它都会从磁盘中3.8读取或则会写入metadata信息并反馈client端。

(错误) (8)NameNode本地磁盘保存了Block的位置信息。

(个人认为正确,欢迎提出其它意见) (9)3.93.10 3.11DataNode通过长连接与NameNode保持通信。

(有分歧) (9)Hadoop自身具有严格的权限管理和安全措施保障集群正常运行。

(错误)93.12 3.13 3.14Slave节点要存储数据,所以它的磁盘越大越好。

(错误) (9)hadoop dfsadmin–report命令用于检测HDFS损坏块。

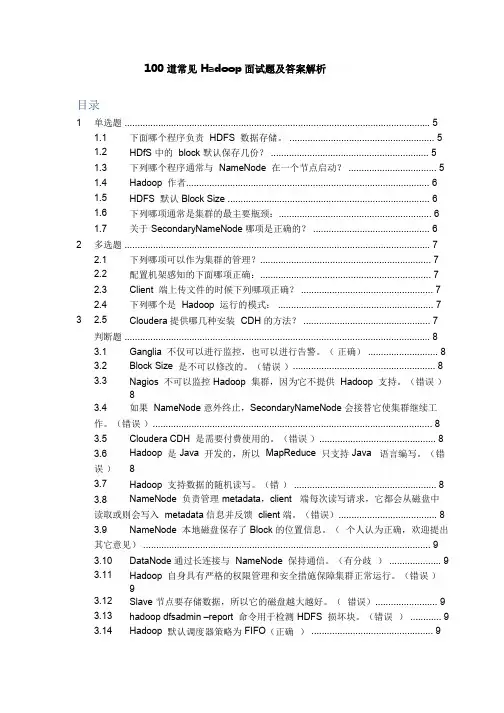

(错误) (9)Hadoop默认调度器策略为FIFO(正确) (9)100道常见Hadoop面试题及答案解析目录1单选题 (5)1.1 1.2 1.3 1.4 1.5 1.6 1.7下面哪个程序负责HDFS数据存储。

(5)HDfS中的block默认保存几份? (5)下列哪个程序通常与NameNode在一个节点启动? (5)Hadoop作者 (6)HDFS默认Block Size (6)下列哪项通常是集群的最主要瓶颈: (6)关于SecondaryNameNode哪项是正确的? (6)2 3多选题 (7)2.12.22.32.42.5下列哪项可以作为集群的管理? (7)配置机架感知的下面哪项正确: (7)Client端上传文件的时候下列哪项正确? (7)下列哪个是Hadoop运行的模式: (7)Cloudera提供哪几种安装CDH的方法? (7)判断题 (8)3.13.23.3Ganglia不仅可以进行监控,也可以进行告警。

(正确) (8)Block Size是不可以修改的。

(错误) (8)Nagios不可以监控Hadoop集群,因为它不提供Hadoop支持。

Hadoop常见⾯试笔试题⽬与参考答案⼩结1. namenode的重要性是什么?namenode的作⽤在Hadoop中⾮常重要。

它是Hadoop的⼤脑,主要负责管理系统上的分配块,还为客户提出请求时的数据提供特定地址2. 当NameNode关闭时会发⽣什么?如果NameNode关闭,⽂件系统将脱机。

3. 是否可以在不同集群之间复制⽂件?如果是的话,怎么能做到这⼀点?是的,可以在多个Hadoop集群之间复制⽂件,这可以使⽤分布式复制来完成。

Distcp是⼀个Hadoop复制⼯具,主要⽤于执⾏MapReduce作业来复制数据。

Hadoop环境中的主要挑战是在各集群之间复制数据,distcp也将提供多个datanode来并⾏复制数据。

4. 什么是检查点?对⽂件数据的修改不是直接写回到磁盘的,很多操作是先缓存到内存的Buffer中,当遇到⼀个检查点Checkpoint时,系统会强制将内存中的数据写回磁盘,当然此时才会记录⽇志,从⽽产⽣持久的修改状态。

因此,不⽤重放⼀个编辑⽇志,NameNode可以直接从FsImage加载到最终的内存状态,这肯定会降低NameNode启动时间5. 什么是机架感知?这是⼀种决定如何根据机架定义放置块的⽅法。

Hadoop将尝试限制存在于同⼀机架中的datanode之间的⽹络流量。

为了提⾼容错能⼒,名称节点会尽可能把数据块的副本放到多个机架上。

综合考虑这两点的基础上Hadoop设计了机架感知功能。

6. 投机性执⾏如果⼀个节点正在执⾏⽐主节点慢的任务。

那么就需要在另⼀个节点上冗余地执⾏同⼀个任务的⼀个实例。

所以⾸先完成的任务会被接受,另⼀个可能会被杀死。

这个过程被称为“投机执⾏”。

7. 是否可以在Windows上运⾏Hadoop?可以,但是最好不要这么做,Red Hat Linux或者是Ubuntu才是Hadoop的最佳操作系统。

在Hadoop安装中,Windows通常不会被使⽤,因为会出现各种各样的问题。

大数据面试题及答案汇总版第1部分选择题1.1 Hadoop选择题1.1.1 HDFS1.下面哪个程序负责 HDFS 数据存储?A.NameNodeB.JobtrackerC.DatanodeD.secondaryNameNodeE.tasktracker2. HDFS 中的 block 默认保存几份?A.3份B.2份C.1份D.4份3. 下列哪个程序通常与NameNode 在一个节点启动?A. SecondaryNameNodeB.DataNodeC.TaskTrackerD. Jobtracker4. HDFS 默认 Block Size(新版本)A. 32MBB.64MBC.128MBD.256MB5. Client 端上传文件的时候下列哪项正确A. 数据经过 NameNode 传递给 DataNodeB.Client 端将文件切分为Block,依次上传C.Client 只上传数据到一台 DataNode,然后由 NameNode 负责 Block 复制工作6. 下面与 HDFS 类似的框架是?A.NTFSB.FAT32C.GFSD.EXT37. 的8. 的1.1.2 集群管理1. 下列哪项通常是集群的最主要瓶颈A. CPUB.网络C.磁盘IOD.内存2. 关于SecondaryNameNode 哪项是正确的?A.它是 NameNode 的热备B.它对内存没有要求C.它的目的是帮助NameNode 合并编辑日志,减少NameNode 启动时间D.SecondaryNameNode 应与 NameNode 部署到一个节点3. 下列哪项不可以作为集群的管理?A. Puppet B.Pdsh C.ClouderaManager D.Zookeeper4. 配置机架感知的下面哪项正确A. 如果一个机架出问题,不会影响数据读写B.写入数据的时候会写到不同机架的 DataNode 中C.MapReduce 会根据机架获取离自己比较近的网络数据5. 下列哪个是 Hadoop 运行的模式A. 单机版B.伪分布式C.分布式6. Cloudera 提供哪几种安装 CDH 的方法A. Cloudera manager B.Tarball C.Yum D.Rpm7.1.2 Hbase选择题1.2.1 Hbase基础1. HBase 来源于哪篇博文? CA TheGoogle File SystemBMapReduceCBigTableD Chubby2. 下面对 HBase 的描述是错误的? AA 不是开源的B 是面向列的C 是分布式的D 是一种 NoSQL 数据库3. HBase 依靠()存储底层数据 AA HDFSB HadoopC MemoryDMapReduce4. HBase 依赖()提供消息通信机制 A AZookeeperB ChubbyC RPCD Socket5. HBase 依赖()提供强大的计算能力 DAZookeeperB ChubbyC RPCDMapReduce6. MapReduce 与 HBase 的关系,哪些描述是正确的? B、CA 两者不可或缺,MapReduce 是 HBase 可以正常运行的保证B 两者不是强关联关系,没有 MapReduce,HBase 可以正常运行CMapReduce 可以直接访问 HBaseD 它们之间没有任何关系7. 下面哪些选项正确描述了HBase 的特性? A、B、C、DA 高可靠性B 高性能C 面向列D 可伸缩8. 下面哪些概念是 HBase 框架中使用的?A、CA HDFSB GridFSCZookeeperD EXT39. D1.2.2 Hbase核心1. LSM 含义是?AA 日志结构合并树B 二叉树C 平衡二叉树D 长平衡二叉树2. 下面对 LSM 结构描述正确的是? A、CA 顺序存储B 直接写硬盘C 需要将数据 Flush 到磁盘D 是一种搜索平衡树3. LSM 更能保证哪种操作的性能?BA 读B 写C 随机读D 合并4. LSM 的读操作和写操作是独立的?AA 是。

大数据工程师面试题及答案在大数据领域,对工程师的要求越来越高。

以下是一些常见的大数据工程师面试题及答案,希望能为您的面试准备提供一些帮助。

一、基础知识1、请简要介绍一下 Hadoop 生态系统中的主要组件。

答案:Hadoop 生态系统主要包括 HDFS(分布式文件系统)用于存储大规模数据;YARN(资源管理框架)负责资源的分配和调度;MapReduce(分布式计算框架)用于处理大规模数据的计算任务。

此外,还有 Hive(数据仓库工具)、HBase(分布式数据库)、Sqoop(数据导入导出工具)等组件。

2、什么是数据仓库?与数据库有什么区别?答案:数据仓库是一个面向主题的、集成的、相对稳定的、反映历史变化的数据集合,用于支持管理决策。

数据库主要用于事务处理,强调实时性和一致性;而数据仓库侧重于数据分析和决策支持,数据量大、结构复杂,存储历史数据。

二、数据处理和分析1、如何处理数据倾斜问题?答案:数据倾斜通常是指某些键值的分布不均匀,导致某些任务处理的数据量远大于其他任务。

可以通过对倾斜的键进行加盐处理,或者使用 Combiner 函数在 Map 端进行局部聚合来缓解。

还可以对数据进行重新分区,或者调整并行度等方式来解决。

2、请介绍一下 Spark 的核心概念,如 RDD、DataFrame 和 Dataset。

答案:RDD(弹性分布式数据集)是 Spark 的基础数据结构,具有不可变、可分区、可并行操作等特点。

DataFrame 类似于关系型数据库中的表,具有列名和数据类型。

Dataset 是 DataFrame 的扩展,提供了类型安全和面向对象的编程接口。

三、数据存储1、介绍一下 HBase 的架构和工作原理。

答案:HBase 基于 Hadoop 的 HDFS 存储数据,采用主从架构。

HMaster 负责管理表的元数据,HRegionServer 负责存储和管理实际的数据。

数据按照行键进行排序和存储,通过 Region 进行划分和管理。

第1篇一、基础知识与理论1. 请简述大数据的概念及其与传统数据处理的区别。

2. 请解释什么是Hadoop,并简要说明其组成部分。

3. 请简述MapReduce的核心思想及其在Hadoop中的应用。

4. 请描述HDFS(Hadoop分布式文件系统)的工作原理及其优势。

5. 请说明YARN(Yet Another Resource Negotiator)的作用及其在Hadoop中的地位。

6. 请解释什么是Spark,以及它与传统的大数据处理技术相比有哪些优势。

7. 请描述Spark的架构及其核心组件。

8. 请说明什么是Hive,并简要介绍其作用。

9. 请解释什么是HBase,以及它在大数据中的应用场景。

10. 请说明什么是NoSQL,并列举几种常见的NoSQL数据库及其特点。

二、Hadoop生态系统1. 请介绍Hadoop生态系统中常用的数据处理工具,如Hive、Pig、Spark等。

2. 请说明Hadoop生态系统中常用的数据分析工具,如Elasticsearch、Kafka、Flume等。

3. 请解释Hadoop生态系统中数据存储解决方案,如HDFS、HBase、Cassandra等。

4. 请描述Hadoop生态系统中常用的数据仓库解决方案,如Apache Hudi、Delta Lake等。

5. 请说明Hadoop生态系统中常用的数据可视化工具,如Tableau、Power BI、D3.js等。

三、大数据技术1. 请简述大数据技术中的数据清洗、数据集成、数据存储、数据挖掘等基本概念。

2. 请介绍大数据技术中的数据挖掘算法,如聚类、分类、关联规则等。

3. 请说明大数据技术中的数据可视化方法及其在数据分析中的应用。

4. 请描述大数据技术中的实时数据处理技术,如流处理、事件驱动等。

5. 请介绍大数据技术中的机器学习算法及其在数据分析中的应用。

四、大数据应用案例1. 请列举大数据技术在金融、医疗、电商、物联网等领域的应用案例。

hadoop spark 面试题1. 介绍Hadoop的MapReduce框架及其工作流程MapReduce是Hadoop的核心组成部分,用于分布式计算与数据处理。

其工作流程如下:- Map阶段:将输入数据切分为固定大小的数据块,并由多个Mapper并行处理。

Mapper根据特定的映射函数,将输入数据中的每对键值对(key-value)转换成中间键值对(intermediate key-value)。

- Shuffle(洗牌)阶段:将Mapper输出的中间键值对根据键进行分组,将相同键的值集中在一起,以便进行后续的Reducer处理。

- Reduce阶段:Reducer并行处理经过Shuffle阶段后的中间键值对。

Reducer对每个键的值集合进行聚合操作,得到最终的输出结果。

2. 什么是Spark?它与Hadoop有何不同?Spark是一个快速且通用的大数据处理引擎,与Hadoop相比有以下不同之处:- 数据处理模型:Hadoop使用MapReduce作为编程模型,而Spark则采用了弹性分布式数据集(Resilient Distributed Dataset,简称RDD)来支持更丰富的数据处理模式,如Map、Reduce、Filter、Join等。

- 内存计算:相比Hadoop的磁盘存储和读写,Spark将数据存储在内存中,并利用内存计算加速数据处理过程,提供更高的性能。

- 执行速度:由于数据存储在内存中,Spark能够在迭代计算等需要多次访问数据的场景下显著提高执行速度。

- 多语言支持:Spark支持多种编程语言(如Java、Scala、Python)进行开发,而Hadoop主要使用Java语言。

3. 解释什么是RDD(弹性分布式数据集),并说明其特点和应用场景RDD(Resilient Distributed Dataset)是Spark中的核心抽象数据类型,代表分布式的、只读的、可容错的数据集合。

第1篇随着大数据技术的飞速发展,越来越多的企业开始重视大数据的应用,并将其作为提升企业竞争力的重要手段。

为了帮助求职者更好地准备应用大数据的面试,以下将提供一系列面试题目,涵盖大数据的核心概念、技术架构、数据处理、分析应用等多个方面。

一、大数据核心概念1. 请简要介绍大数据的五个V(Volume、Velocity、Variety、Veracity、Value)及其对大数据处理的影响。

2. 什么是Hadoop?请列举Hadoop的主要组件及其功能。

3. 解释MapReduce编程模型的工作原理,并说明其在处理大数据时的优势。

4. 什么是数据仓库?请描述数据仓库的基本架构和功能。

5. 什么是数据湖?它与数据仓库有什么区别?二、大数据技术架构1. 请列举大数据技术栈中常用的开源框架,并简要介绍它们的作用。

2. 什么是Spark?请说明Spark的架构和主要特性。

3. 什么是Flink?请描述Flink与Spark的主要区别。

4. 什么是Hive?请介绍Hive的架构和功能。

5. 什么是Kafka?请说明Kafka在数据处理中的作用。

三、数据处理与分析1. 请描述数据清洗的步骤和常见方法。

2. 什么是数据脱敏?请列举几种数据脱敏技术。

3. 什么是数据压缩?请介绍几种常用的数据压缩算法。

4. 什么是数据挖掘?请列举几种常见的数据挖掘算法。

5. 什么是机器学习?请介绍几种常见的机器学习算法。

四、大数据应用场景1. 请举例说明大数据在金融行业的应用场景。

2. 请举例说明大数据在医疗行业的应用场景。

3. 请举例说明大数据在零售行业的应用场景。

4. 请举例说明大数据在交通行业的应用场景。

5. 请举例说明大数据在政府领域的应用场景。

五、大数据项目经验1. 请描述你参与过的最大规模的大数据项目,包括项目背景、目标、技术选型、实施过程和成果。

2. 请描述你在项目中遇到的技术难题及其解决方案。

3. 请描述你在项目中如何进行数据治理和质量管理。

hadoop⾯试题(⾃⼰整理版)

1、 hadoop 运⾏原理

2、 mapreduce 原理

3、 mapreduce 的优化

4、举⼀个简单的例⼦说下 mapreduce 是怎么运⾏的

5、 hadoop 中 combiner 的作⽤

6、简述 hadoop 的安装

7、请列出 hadoop 的进程名

8、简述 hadoop 的调度器

9、列出你开发 mapreduce 的语⾔

10、我们开发 job 时是否可以去掉 reduce 阶段

11、 datanode 在什么情况下不会备份

12、 combiner 出现在哪个过程

13、 hdfs 的体系结构

14、 3 个 datanode 中有⼀个 datanode 出现错误会怎么样

15、描述⼀下 hadoop 中,有哪些地⽅⽤了缓存机制,作⽤分别是

什么?

16、如何确定 hadoop 集群的健康状况

17、 shuffe 阶段,你怎么理解

18、 mapreduce 的 map 数量和 reduce 数量怎么确定,怎么配置

19、简单说⼀下 mapreduce 的编程模型

20、 hadoop 的 TextInputFormatter 作⽤是什么,如何⾃定义实现

21、 hadoop 和 spark 都是并⾏计算,他们有什么相同和区别

22、为什么要⽤ flume 导⼊ hdfs, hdfs 的架构是怎样的

23、简单说⼀下 hadoop 和 spark 的 shuffle 过程

24、 hadoop ⾼并发

25、 map-reduce 程序运⾏的时候会有什么⽐较常见的问题。

hadoop hive面试题Hadoop Hive是一个用于查询和分析存储在Hadoop集群中的大数据集的数据仓库基础设施。

在面试过程中,面试官可能会问到一些与Hadoop Hive有关的问题,以测试您对Hive的理解和实际应用能力。

以下是一些常见的Hadoop Hive面试题及其答案。

1. 什么是Hadoop Hive?Hadoop Hive是一个开源工具,用于在Hadoop集群上进行数据仓库和分析操作。

它提供了一个类似SQL的语言,称为HiveQL,使得用户可以轻松地编写和执行各种查询。

2. Hive与HBase有什么区别?Hive是一个基于Hadoop的数据仓库基础设施,适用于处理结构化和半结构化数据,并支持SQL查询。

而HBase是一个分布式的面向列的NoSQL数据库,适用于处理海量的非结构化数据,并提供了对实时读写的支持。

3. 什么是Hive元数据?Hive元数据是描述Hive表结构和数据位置的信息。

它包含了表的名称、列名、数据类型、分区信息等。

元数据存储在一个关系数据库(如MySQL)中。

4. Hive的查询语言是什么?Hive查询语言称为HiveQL,它与传统SQL很类似,但也有一些区别。

HiveQL支持SELECT、FROM、WHERE、GROUP BY、ORDER BY等常见的SQL操作,同时还提供了自定义函数和表达式的功能。

5. Hive的表可以有多少列?Hive的表可以有很多列,但由于Hive的设计初衷是用于处理大规模的数据集,因此在实际应用中,表的列数应该适度控制,以免对查询性能产生不利影响。

6. Hive中的分区是什么?Hive中的分区是指将表的数据按照某个特定的列进行逻辑划分。

分区可以帮助提高查询性能,例如根据日期分区可以只查询某个时间范围内的数据。

7. Hive表的分桶是什么?Hive表的分桶是指将表的数据按照某个列的哈希值进行物理划分。

分桶可以让查询更加精确和高效,例如通过将数据按照用户ID进行分桶,可以在查询某个用户的数据时仅扫描相应的桶。

Hadoop面试中6个常见的问题及答案你准备好面试了吗?呀,需要Hadoop 的知识!!?不要慌!这里有一些可能会问到的问题以及你应该给出的答案。

Q1.什么是Hadoop?Hadoop 是一个开源软件框架,用于存储大量数据,并发处理/查询在具有多个商用硬件(即低成本硬件)节点的集群上的那些数据。

总之,Hadoop 包括以下内容:HDFS(Hadoop Distributed File System,Hadoop 分布式文件系统):HDFS 允许你以一种分布式和冗余的方式存储大量数据。

例如,1 GB(即1024 MB)文本文件可以拆分为16 * 128MB 文件,并存储在Hadoop 集群中的8 个不同节点上。

每个分裂可以复制3 次,以实现容错,以便如果1 个节点故障的话,也有备份。

HDFS 适用于顺序的“一次写入、多次读取”的类型访问。

MapReduce:一个计算框架。

它以分布式和并行的方式处理大量的数据。

当你对所有年龄> 18 的用户在上述1 GB 文件上执行查询时,将会有“8 个映射”函数并行运行,以在其128 MB 拆分文件中提取年龄> 18 的用户,然后“reduce”函数将运行以将所有单独的输出组合成单个最终结果。

YARN(Yet Another Resource Nagotiator,又一资源定位器):用于作业调度和集群资源管理的框架。

Hadoop 生态系统,拥有15 多种框架和工具,如Sqoop,Flume,Kafka,Pig,Hive,Spark,Impala 等,以便将数据摄入HDFS,在HDFS 中转移数据(即变换,丰富,聚合等),并查询来自HDFS 的数据用于商业智能和分析。

某些工具(如Pig 和Hive)是MapReduce 上的抽象层,而Spark 和Impala 等其他工具则是来自MapReduce 的改进架构/设计,用于显著提高的延迟以支持近实时(即NRT)和实时处理。

2025年招聘大数据开发工程师面试题与参考回答面试问答题(总共10个问题)第一题:请简述你对大数据处理和分析的基本概念,并举例说明在实际工作中你是如何应用这些技术的。

答案:大数据处理和分析是利用先进的计算技术和工具从海量数据中提取有价值的信息的过程。

它包括数据的收集、存储、处理、分析和可视化等多个步骤。

在实际工作中,我会使用Hadoop生态系统中的MapReduce、Spark等技术来处理大规模数据集;使用SQL查询优化器进行数据查询和统计;使用数据挖掘和机器学习算法进行数据模式识别和预测分析。

例如,在一个电商公司中,我通过使用Hadoop和Spark对用户行为数据进行分析,发现了用户的购物偏好和购买周期,从而帮助公司调整营销策略,提高了销售额。

第二题:请谈谈你在大数据处理方面,遇到的一个最具挑战性的项目经历,以及你是如何解决这个问题的?面试问答题:请描述你在大数据处理方面遇到的一个最具挑战性的项目经历,你是如何识别问题并给出解决方案的?请具体阐述你所采取的技术手段和实施过程。

参考回答:我在处理一个电商平台的海量用户行为数据时遇到了巨大的挑战。

这个项目的主要难点在于数据量大、数据类型多样,并且需要在短时间内完成数据处理和分析工作。

面对这个问题,我首先进行了深入的数据分析和需求调研,确定了数据的来源、结构和特点。

然后,我识别出主要挑战在于处理高并发数据流和进行实时数据分析。

为了解决这个问题,我采取了以下技术手段和实施过程:1.采用分布式存储和计算技术,如Hadoop和Spark,对海量数据进行分布式处理,提高了数据处理的速度和效率。

2.利用数据挖掘和机器学习算法,对用户行为数据进行深度分析,提取有价值的信息。

3.设计并实现了一个实时数据流处理系统,利用Kafka等消息队列技术,实现了数据的实时采集、处理和反馈。

4.优化数据存储方案,采用列式存储和压缩技术,有效节省了存储空间,并提高了查询性能。

通过上述技术手段和实施过程,我成功解决了这个挑战,实现了高效的数据处理和实时分析,为电商平台提供了有力的数据支持。

第1篇一、基础知识1. 请简述大数据的概念及其在当今社会中的重要性。

2. 什么是Hadoop?请简要介绍其架构和核心组件。

3. 请解释HDFS的工作原理,以及它在数据存储方面的优势。

4. 请说明MapReduce编程模型的基本原理和执行流程。

5. 什么是YARN?它在Hadoop生态系统中的作用是什么?6. 请描述Zookeeper在Hadoop集群中的作用和常用场景。

7. 什么是Hive?它与传统的数据库有什么区别?8. 请简述HBase的架构和特点,以及它在列式存储方面的优势。

9. 什么是Spark?它与Hadoop相比有哪些优点?10. 请解释Flink的概念及其在流处理方面的应用。

二、Hadoop集群搭建与优化1. 请描述Hadoop集群的搭建步骤,包括硬件配置、软件安装、配置文件等。

2. 请说明如何实现Hadoop集群的高可用性,例如HDFS和YARN的HA配置。

3. 请简述Hadoop集群的负载均衡策略,以及如何进行负载均衡优化。

4. 请解释Hadoop集群中的数据倾斜问题,以及如何进行数据倾斜优化。

5. 请说明如何优化Hadoop集群中的MapReduce任务,例如调整map/reduce任务数、优化Shuffle过程等。

6. 请描述Hadoop集群中的内存管理策略,以及如何进行内存优化。

7. 请简述Hadoop集群中的磁盘I/O优化策略,例如磁盘阵列、RAID等。

8. 请说明如何进行Hadoop集群的性能监控和故障排查。

三、数据存储与处理1. 请描述HDFS的数据存储格式,例如SequenceFile、Parquet、ORC等。

2. 请解释HBase的存储结构,以及RowKey和ColumnFamily的设计原则。

3. 请简述Hive的数据存储格式,以及其与HDFS的交互过程。

4. 请说明Spark的数据存储格式,以及其在内存和磁盘之间的数据交换过程。

5. 请描述Flink的数据流处理模型,以及其在数据流中的操作符和窗口机制。

大数据工程师常见面试题在当今数字化的时代,大数据工程师成为了热门职业之一。

当你准备应聘大数据工程师的岗位时,了解常见的面试题可以帮助你更好地应对面试,展现自己的专业能力。

以下是一些大数据工程师常见的面试题:一、基础理论知识1、什么是大数据?大数据是指无法在一定时间范围内用常规软件工具进行捕捉、管理和处理的数据集合,是需要新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。

2、请简要介绍 Hadoop 生态系统。

Hadoop 生态系统是一系列用于处理大数据的开源框架和工具的集合。

其中包括HDFS(Hadoop 分布式文件系统)用于存储大规模数据,YARN(Yet Another Resource Negotiator)用于资源管理和调度,MapReduce 用于分布式计算等。

此外,还有 Hive 用于数据仓库和查询处理,HBase 用于大规模的分布式数据库,Sqoop 用于在关系型数据库和 Hadoop 之间进行数据迁移等。

3、解释一下 CAP 定理。

CAP 定理指出,在一个分布式系统中,一致性(Consistency)、可用性(Availability)和分区容错性(Partition tolerance)这三个特性最多只能同时满足其中两个。

一致性指的是在分布式系统中,所有节点在同一时刻看到的数据是相同的;可用性指的是系统能够在正常响应时间内提供服务;分区容错性指的是系统在遇到网络分区等故障时仍能继续工作。

4、什么是数据仓库和数据集市?数据仓库是一个面向主题的、集成的、相对稳定的、反映历史变化的数据集合,用于支持管理决策。

数据集市则是数据仓库的一个子集,通常面向特定的业务部门或主题,规模较小,更专注于满足特定用户的需求。

二、数据处理与分析1、谈谈你对数据清洗的理解以及常见的数据清洗方法。

数据清洗是指处理和纠正数据中的错误、缺失值、重复值和不一致性等问题,以提高数据质量。

第1篇一、基础知识与概念理解1. 请简述大数据的概念及其与传统数据处理的区别。

2. 大数据通常具有哪些特征?请用“5V”模型进行解释。

3. 什么是Hadoop?它在大数据处理中扮演什么角色?4. HDFS(Hadoop Distributed File System)的主要功能和特点是什么?5. 请解释MapReduce的工作原理及其在Hadoop中的作用。

6. 什么是数据挖掘?它与数据分析有何区别?7. 什么是数据仓库?它与数据库有何不同?8. 请简述数据流处理的原理及其在实时数据分析中的应用。

9. 什么是机器学习?它在大数据分析中有什么应用?10. 什么是数据可视化?它在大数据分析中有什么重要性?二、Hadoop生态系统与工具11. Hadoop生态系统包含哪些主要组件?请分别简述其功能。

12. 请解释YARN(Yet Another Resource Negotiator)的作用和工作原理。

13. Hive和Pig在Hadoop中分别用于什么目的?14. 什么是HBase?它在Hadoop生态系统中的定位是什么?15. 请解释HDFS的命名空间管理。

16. Hadoop的容错机制有哪些?请举例说明。

17. Hadoop集群的常见故障有哪些?如何进行故障排查和解决?18. 请简述Hadoop的集群部署和维护过程。

三、数据存储与处理19. HDFS的数据块大小是多少?为什么选择这个大小?20. HDFS中数据副本的数量通常是多少?为什么需要副本?21. 请解释HDFS的垃圾回收机制。

22. HDFS支持哪些数据压缩格式?请介绍其中一种的压缩和解压缩过程。

23. Hadoop中的小文件问题有哪些?如何解决?24. 请解释Hadoop中的纠删码原理及其优势。

25. HDFS如何实现机架感知?取消机架感知可能带来哪些问题?26. HDFS常见的运维操作有哪些?哪些操作是高危的?如果高危操作出现问题,如何解决?27. HDFS常见的故障有哪些?如何处理?请给出三种预案来防范大部分常见故障。

Hadoop面试题汇总

一、知识点 (1)

二、经典题 (1)

三、选择题 (1)

一、知识点

了解MapReduce大致流程,map, shuffle, reduce

了解combiner, partition作用,设置compression

搭建hadoop集群,master/slave 都运行那些服务

HDFS,replica如何定位

版本0.20.2->0.20.203->0.20.205,0.21,0.23,1.0.1

新旧API不同

Hadoop参数调优,cluster level: JVM, map/reduce slots, job level: reducer #, memory, use combiner? use compression?

pig latin,Hive简单语法

HBase,zookeeper 搭建

关注cloudera, hortonworks blog

next generation MR2框架

高可靠性,namenode: avoid single point of failure.

数据流系统:streaming storm(twitter).

wordcount字典同位词

翻译sql语句 select count(x) from a group by b;

二、经典题

一、现有1亿个整数均匀分布,如果要得到前1K个最大的数,求最优的算法。

(先不考虑内存的限制,也不考虑读写外存,时间复杂度最少的算法即为最优算法)

二、编写一只爬虫,要求:1、可配置要爬取的网页URL格式 2、可定制要爬取的深度3、对爬取下来的页面可由后期调用的程序进行存储(即事件)

三、现有大批量url需要爬取,其中url的解析以及n层抓取已有服务端实现(多级深度),现在给定若干台服务器以及不断增加的客户机,各服务端的url任务已有机制保证平衡,爬虫url任务由客户机向服务器请求并完成。

请设计一个分布式框架,以完成单层的ur1抓取,并且每个服务器都能尽可能平均的获取客户机资源。

注意:服务器可能当机。

四、设计一套系统,使之能够从不断增加的不同的数据源中,提取指定格式的数据。

要求:1、运行结果要能大致得知提取效果,并可据此持续改进提取方法;

2、由于数据来源的差异性,请给出可弹性配置的程序框架;

3、数据来源可能有Mysql,sqlserver等;

4、该系统具备持续挖掘的能力,即,可重复提取更多信息;

五、编写一个工具,该工具能够根据不同的文档模板,生成提取格式化数据的正则表达式。

三、选择题

1.下面哪个程序负责 HDFS 数据存储。

a)NameNode b)Jobtracker c)Datanode d)secondaryNameNode e)tasktracker

答案 C datanode

2. HDfS 中的 block 默认保存几份?

a)3 份 b)2 份 c)1 份 d)不确定

答案 A 默认 3 份

3.下列哪个程序通常与 NameNode 在一个节点启动?

a)SecondaryNameNode b)DataNode c)TaskTracker d)Jobtracker

答案 D

分析:hadoop 的集群是基于 master/slave 模式,namenode 和 jobtracker 属于master,datanode 和tasktracker 属于 slave,master 只有一个,而 slave 有多个SecondaryNameNode 内存需求和NameNode 在一个数量级上,所以通常secondaryNameNode(运行在单独的物理机器上)和 NameNode 运行在不同的机器上。

JobTracker 和 TaskTracker

JobTracker 对应于 NameNode,TaskTracker 对应于 DataNode,DataNode 和 NameNode 是针对数据存放来而言的,JobTracker 和 TaskTracker 是对于 MapReduce 执行而言的。

mapreduce 中几个主要概念,mapreduce 整体上可以分为这么几条执行线索:jobclient,JobTracker 与 TaskTracker。

1、JobClient 会在用户端通过 JobClient 类将应用已经配置参数打包成 jar 文件存储到 hdfs,并把路径提交到 Jobtracker,然后由 JobTracker 创建每一个 Task(即MapTask 和ReduceTask)并将它们分发到各个 TaskTracker 服务中去执行。

2、JobTracker 是一个 master 服务,软件启动之后 JobTracker 接收 Job,负责调度Job 的每一个子任务 task 运行于 TaskTracker 上,并监控它们,如果发现有失败的task 就重新运行它。

一般情况应该把 JobTracker 部署在单独的机器上。

3、TaskTracker 是运行在多个节点上的slaver 服务。

TaskTracker 主动与JobTracker 通信,接收作业,并负责直接执行每一个任务。

TaskTracker 都需要运行在 HDFS 的 DataNode 上。

4. Hadoop 作者

a)Martin Fowler b)Kent Beck c)Doug cutting

答案 C Doug cutting

5. HDFS 默认 Block Size

a)32MB b)64MB c)128MB

答案:B

6. 下列哪项通常是集群的最主要瓶颈

a)CPU b)网络 c)磁盘 IO d)内存

答案:C 磁盘

首先集群的目的是为了节省成本,用廉价的 pc 机,取代小型机及大型机。

小型机和大型机有什么特点?

1.cpu 处理能力强

2.内存够大,所以集群的瓶颈不可能是 a 和 d

3.如果是互联网有瓶颈,可以让集群搭建内网。

每次写入数据都要通过网络(集群是内网),然后还要写入 3 份数据,所以 IO 就会打折扣。

7.关于 SecondaryNameNode 哪项是正确的?

a)它是 NameNode 的热备 b)它对内存没有要求

c)它的目的是帮助 NameNode 合并编辑日志,减少 NameNode 启动时间

d)SecondaryNameNode 应与 NameNode 部署到一个节点

答案 C。

多选题:

8. 下列哪项可以作为集群的管理?

a)Puppet b)Pdsh c)Cloudera Manager d)Zookeeper

答案 ABD

具体可查看什么是 Zookeeper,Zookeeper 的作用是什么,在 Hadoop 及 hbase 中具体作用是什么。

9. 配置机架感知的下面哪项正确

a)如果一个机架出问题,不会影响数据读写

b)写入数据的时候会写到不同机架的 DataNode 中

c)MapReduce 会根据机架获取离自己比较近的网络数据

答案 ABC

具体可以参考hadoop 机架感知--加强集群稳固性,该如何配置 hadoop 机架感知

10. Client 端上传文件的时候下列哪项正确

a)数据经过 NameNode 传递给 DataNode

b)Client 端将文件切分为 Block,依次上传

c)Client 只上传数据到一台 DataNode,然后由 NameNode 负责 Block 复制工作

答案 B

分析:Client 向 NameNode 发起文件写入的请求。

NameNode 根据文件大小和文件块配置情况,返回给 Client 它所管理部分 DataNode 的信息。

Client 将文件划分为多个Block,根据 DataNode 的地址信息,按顺序写入到每一个DataNode 块中。

具体查看HDFS 体系结构简介及优缺点。

11. 下列哪个是 Hadoop 运行的模式

a)单机版 b)伪分布式 c)分布式

答案 ABC 单机版,伪分布式只是学习用的。

12. Cloudera 提供哪几种安装 CDH 的方法

a)Cloudera manager b)Tarball c)Yum d)Rpm

答案:ABCD 具体可以参考Hadoop CDH 四种安装方式总结及实例指导。