视频追踪

- 格式:doc

- 大小:458.00 KB

- 文档页数:3

基于背景建模的视频目标追踪技术研究近年来,随着计算机技术的不断进步,视频监控这种技术应用的范畴也越来越广泛。

其中,视频目标追踪技术作为一种基础性技术,被广泛应用于智能交通、城市安防等领域,具有重要的实践意义。

背景建模是目标追踪技术中的一个重要环节,它能够将背景和目标区分开来,并将目标与背景进行有效的分离,从而实现视频图像中的目标跟踪。

在背景建模中,需要将视频序列分为背景和前景两部分,这样才能更好地实现目标的检测和跟踪。

下面,本文将从背景建模的原理、方法和优缺点等方面进行探讨。

一、背景建模的原理背景建模的基本原理是通过对视频中背景的建模,检测视频中的前景目标,实现目标的跟踪。

具体来说,背景建模技术是将一个视频序列分解成为背景和前景两部分,背景一般由静态背景和移动背景两个方面组成。

静态背景是指视频中相对静止的背景元素,如建筑物、固定物体等;移动背景则是指相对移动的背景元素,如车流、行人等。

对于静态背景的建模可以通过像素的平均值或中位数等方式进行,而对于移动背景则需要采用其他匹配算法,例如光流算法、级联匹配算法等。

在背景建模的过程中,还需要关注一些重要的参数,如背景更新率、背景噪声的大小等。

背景更新率是指在相同的时间间隔内,背景模型所修改的比例。

在实际应用中,应该根据实际的场景和对目标跟踪的要求确定合适的背景更新率。

另外,针对背景减除算法会产生噪声的特点,还需要采取一些噪声消除技术,例如小连通区域删除等方式,来确保跟踪效果的稳定性和准确性。

二、背景建模的方法目前,常用的背景建模方法主要包括传统的基于统计学的算法和基于深度学习的算法。

1. 基于统计学的方法基于统计学的方法是利用背景图像的统计特征来对背景进行建模,常用的算法有帧差法,基于高斯混合模型的背景建模和自适应背景建模算法等。

帧差法是一种简单有效的背景建模方法,它将当前帧与历史帧进行像素级的比较,并将像素差分结果进行二值化处理,从而得到前景目标。

但是在实际应用中容易受到光照变化、遮挡等因素的干扰,从而影响目标的检测和跟踪。

Final Cut Pro中的画面跟踪技巧Final Cut Pro是一款功能强大的视频编辑软件,它不仅可以帮助用户剪辑和处理视频,还提供了各种强大的特效和工具。

其中一个非常有用的功能就是画面跟踪技巧,它可以让用户在编辑过程中轻松追踪和调整视频中的运动对象。

本文将介绍几种在Final Cut Pro中实现有效画面跟踪的技巧。

第一种技巧是使用自动跟踪功能。

在Final Cut Pro中,有一个内置的自动跟踪功能,可以自动检测并跟踪视频中的运动对象。

要使用这个功能,首先选择视频片段,然后点击“特效”选项卡中的“画面跟踪”按钮。

接下来,点击“启动跟踪”按钮并等待软件完成跟踪过程。

一旦完成,你可以调整跟踪区域的大小和位置,或者选择应用不同的效果。

第二种技巧是手动跟踪。

有时候,自动跟踪功能不能准确地追踪对象,这时就需要手动调整。

在Final Cut Pro中,你可以使用“遮罩”工具来手动跟踪对象。

首先,选择视频片段,然后点击“特效”选项卡中的“画面跟踪”按钮。

接下来,在“遮罩”选项中选择“新建遮罩”并在视频中选择你想要跟踪的对象。

然后,使用遮罩工具精确地调整遮罩的位置和大小,以确保它紧密地围绕着对象。

最后,你可以选择应用不同的效果或调整遮罩的参数。

第三种技巧是使用关键帧。

关键帧是指在时间轴上选择某个特定时间点,并在此时间点上设置一个或多个属性值。

在Final Cut Pro中,你可以使用关键帧来在视频中创建运动效果。

首先,选择视频片段,然后在“查看”选项卡中勾选“视频动作编辑器”。

接下来,在动作编辑器中选择“位置”属性,并在时间轴上选择一个时间点。

然后,移动或调整视频的位置,软件会自动创建一个新的关键帧。

你可以在时间轴上的不同时间点添加更多的关键帧,从而创建更复杂的运动效果。

第四种技巧是使用外部插件。

除了内置的画面跟踪功能,Final Cut Pro还支持第三方插件,这些插件可以提供更多高级的画面跟踪功能。

视频人脸追踪:通过Adobe Premiere Pro实现人脸追踪效果Adobe Premiere Pro是一款强大的视频编辑软件,它提供了许多高级的特效和功能,可以帮助用户实现各种令人惊叹的效果。

其中之一就是人脸追踪功能,它能够自动识别视频中的人脸,并跟踪其移动和表情变化。

下面将介绍如何通过Adobe Premiere Pro实现人脸追踪效果。

首先,打开Adobe Premiere Pro软件并导入你想要编辑的视频素材。

确保视频中有明显的人脸。

接下来,拖动素材到时间轴上,然后选中你想要应用人脸追踪效果的视频片段。

在“效果”面板中,找到“视频效果”>“Keying”>“自动色调校正”。

将该效果拖动到视频片段上。

然后,在“控制”面板中,找到“效果控制”选项。

你将看到“自动色调校正”效果的各种参数。

将“执行自动色调校正”的开关打开。

软件将自动识别视频中的人脸并追踪其移动。

此时,你可以调整“最大追踪跟踪”和“最小追踪跟踪”参数来优化追踪效果。

你可以根据需要增加或减少这些参数的值,以获得最佳效果。

除了人脸追踪,你还可以使用其他效果和特效来增强视频的质量。

例如,你可以在“视频效果”>“变形”>“变形效果”中找到“膨胀”和“收缩”效果,用来改变人脸的形状和大小。

你还可以在“视频效果”>“调整”>“亮度和对比度”中找到“色彩曲线”效果,用来调整人脸的亮度和对比度。

另外,你还可以在“视频效果”>“调整”>“模糊和锐化”中找到“高斯模糊”效果,用来模糊或增强人脸的细节。

通过这些效果和特效,你可以实现各种独特的人脸追踪效果。

当完成人脸追踪效果的调整后,你可以在“导出”选项中选择合适的输出格式和设置,然后导出你编辑好的视频。

总结来说,通过Adobe Premiere Pro软件可以轻松实现视频人脸追踪效果。

使用自动色调校正和其他调整参数,你可以追踪人脸的移动,并通过添加特效和效果来增强视频的质量。

视频监控图像的移动目标检测与跟踪随着科技的不断进步,视频监控系统的应用越来越广泛。

在大型公共场所、企事业单位、交通枢纽等地,视频监控已经成为重要的安全管理措施之一。

视频监控系统利用摄像机采集实时场景图像,并通过图像处理和分析技术对图像内容进行检测与跟踪,以实现对目标行为的智能分析和预警。

视频监控图像的移动目标检测与跟踪是视频监控系统中的关键技术之一。

它主要通过对视频图像中的目标进行检测和跟踪,实现对目标的有效定位和追踪。

移动目标检测与跟踪技术可以广泛应用于安防领域、交通管理领域等,提高社会安全和管理水平。

移动目标检测是指从视频图像序列中检测出所有运动的目标物体,将其与背景相区分出来。

在实际应用中,移动目标通常包含行人、车辆等。

移动目标检测的原理可以基于背景建模、光流法、基于像素强度变化的方法等。

其中,背景建模是一种常用方法,它通过对图像序列中静态背景的建模,检测出与背景有明显变化的目标。

在移动目标检测的基础上,移动目标跟踪技术可以实现对目标的精确定位和轨迹追踪。

移动目标跟踪的主要任务是在视频图像序列中通过连续帧之间的相似性分析,追踪目标物体的位置、速度以及形状变化等信息。

在实际应用中,移动目标跟踪可以分为跟踪-by-detection和跟踪-by-regression等方法。

跟踪-by-detection方法是通过目标检测算法检测每一帧中的目标,再利用目标的位置信息进行跟踪。

而跟踪-by-regression方法则是利用目标的运动学模型和外观信息,在每一帧中更新目标的位置。

在移动目标检测与跟踪技术中,一些先进的深度学习算法被广泛应用。

深度学习网络可以自动从数据中学习特征,并具有强大的图像识别能力。

通过使用深度学习网络,可以有效地提高目标检测与跟踪的准确性和稳定性。

常用的深度学习模型包括卷积神经网络(Convolutional Neural Network, CNN)、循环神经网络(Recurrent Neural Network, RNN)等。

监控视频中的人物跟踪技术研究一、前言作为监控技术领域中的一项重要技术,在多领域中占据着核心地位、发挥着积极作用的视频跟踪技术,目前受到了广泛关注。

它的出现,为我们提供了一个全新的思路,使得我们在现代生活中的监控与控制方面,获得了更为丰富、更为前沿、更为实用的方法。

二、背景在今天,监控技术是处于不断发展之中的,其中视频监控是人们所普遍采用的监控手段。

利用监控视频中的人物跟踪技术,可以在监控视频中对某一对象进行追踪,可以根据其行为特点,对其进行动态的建模,并最终实现对其控制与引导。

三、相关技术1.视频跟踪技术的分类现如今的视频跟踪技术可以分为传统技术、半学习技术和深度学习技术。

其中传统技术的表现形式是基于一些常用算法的应用,如帧差法、背景差分法等;半学习技术则是通过人工干预设定模式,获取坐标的轨迹信息;而深度学习技术则是利用深度学习网络,通过大量实验数据进行训练,最终实现跟踪目标的功能。

2.视频跟踪技术的研究重点目前,研究人员在视频跟踪技术的研究中,主要关注以下几个方面:- 高准确率:在实际应用中,人物跟踪的准确率是至关重要的;- 高鲁棒性:跟踪过程中容易受到光照、自动对焦等因素的影响,因此视频跟踪技术的鲁棒性也备受关注;- 高时效性:跟踪不仅要求准确,而且要求快速,因此时效性也是必须考虑的因素之一;- 复杂场景下的跟踪:如丛林、人群、复杂光照等情景,这种情况下精确跟踪更是面临着非常大的挑战,因此如何应对这些挑战也是研究人员关注的问题。

3.融合多种技术为了提升人物跟踪技术的准确度和应对特殊情况,在跟踪过程中,多种不同技术的融合利用变得十分重要。

如利用物体识别技术进行物体定位、视频压缩技术等。

融合多项技术可以带来更好的人物跟踪效果。

四、未来展望视频跟踪技术,在现代生活中将会更加的普及,并能得到更为广泛的应用。

未来的发展方向将会更注重复杂情境下的应用,如车载电子司机等。

此外,在光照不好的情况下,进一步提高视频跟踪技术精度,以及将人物跟踪技术应用于无人机的航拍拍摄等领域,以获得对于整个场景的全面把握,也是我们需要关注的发展重点。

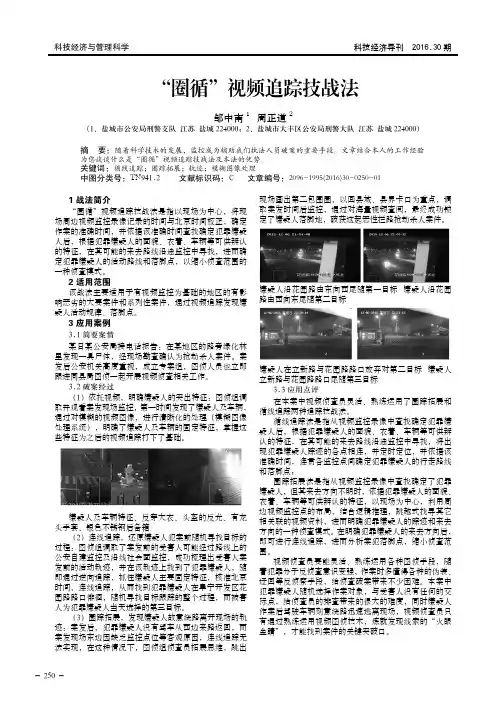

- 250 -科技经济与管理科学科技经济导刊 2016.30期“圈循”视频追踪技战法邹中南1 周正道2(1、盐城市公安局刑警支队 江苏 盐城224000;2、盐城市大丰区公安局刑警大队 江苏 盐城224000)1 战法简介“圈循”视频追踪技战法是指以现场为中心,将现场周边视频监控录像记录的时间与北京时间校正,确定作案的准确时间,并依据该准确时间查找确定犯罪嫌疑人后,根据犯罪嫌疑人的面貌、衣着、车辆等可供辨认的特征,在其可能的来去路线沿途监控中寻找,进而确定犯罪嫌疑人的活动路线和落脚点,以缩小侦查范围的一种侦查模式。

2 适用范围该战法主要适用于有视频监控为基础的地区的有影响恶劣的大要案件和系列性案件,通过视频追踪发现嫌疑人活动规律、落脚点。

3 应用案例3.1简要案情某日某公安局接电话报告:在某地区的路旁绿化林里发现一具尸体,经现场勘查确认为抢劫杀人案件。

案发后公安机关高度重视,成立专案组,图侦人员也立即跟进同县局图侦一起开展视频侦查相关工作。

3.2破案经过(1)依托视频,明确嫌疑人的突出特征:图侦组调取并观看案发现场监控,第一时间发现了嫌疑人及车辆,通过对模糊的视频图像,进行清晰化的处理(模糊图像处理系统),明确了嫌疑人及车辆的固定特征,掌握这些特征为之后的视频追踪打下了基础。

嫌疑人及车辆特征、反穿大衣、头盔的反光、有龙头手套、银色不锈钢后备箱(2)连线追踪,还原嫌疑人犯案前随机寻找目标的过程:图侦组调取了案发前的受害人可能经过路线上的公安自建监控及沿线社会面监控,成功梳理出受害人案发前的活动轨迹,并在该轨迹上找到了犯罪嫌疑人,随即通过逆向追踪,抓住嫌疑人主要固定特征,核准北京时间,连线追踪,从而找到犯罪嫌疑人在阜宁开发区花园路路口徘徊,随机寻找目标跟踪的整个过程,而被害人为犯罪嫌疑人当天选择的第三目标。

(3)圈踪拓展,发现嫌疑人故意绕路离开现场的轨迹:案发后,犯罪嫌疑人没有驾车从西边来路返回,而案发现场东边因缺乏监控点位等客观原因,连线追踪无法实现,在这种情况下,图侦组侦查员拓展思维,跳出现场画出第二包围圈,以回县城、县界卡口为重点,调取案发时间后监控,通过对海量视频查阅,最终成功锁定了嫌疑人落脚地,破获这起恶性拦路抢劫杀人案件。

基于图像分析的视频目标跟踪算法研究一、引言随着计算机视觉和图像分析技术的快速发展,视频目标跟踪算法成为了研究热点之一。

视频目标跟踪算法能够在视频中自动地追踪感兴趣的目标并提取出相关信息,对于实际应用具有重要意义。

本文将围绕基于图像分析的视频目标跟踪算法展开研究,对该算法的综述、发展与应用、关键问题与挑战以及研究方向进行深入探讨。

二、视频目标跟踪算法综述2.1 图像分析技术概述图像分析技术是计算机视觉领域中的一项重要技术,通过对图像进行预处理、特征提取、目标识别等操作,实现对图像中目标的自动识别和分析。

图像分析技术在视频目标跟踪算法中扮演着重要角色,为算法提供了必要的信息基础。

2.2 视频目标跟踪算法分类视频目标跟踪算法根据其实现原理和方法的不同可以分为多种类型,包括传统的基于特征提取的算法、基于机器学习的算法和基于深度学习的算法等。

每种算法都有其独特的优势和适用场景。

2.3 基于图像分析的视频目标跟踪算法基于图像分析的视频目标跟踪算法是利用图像分析技术,通过对视频帧的分析和处理,实现对目标在时间维度上的跟踪和定位。

该算法通常包括目标检测、目标跟踪和目标状态更新等步骤,通过将连续帧之间的信息进行关联,实现目标在视频中的连续追踪。

三、视频目标跟踪算法的发展与应用3.1 视频目标跟踪算法的发展历程视频目标跟踪算法经历了从传统的基于特征提取的算法到基于机器学习的算法再到基于深度学习的算法的演进过程。

随着计算机硬件能力和大数据技术的不断提升,视频目标跟踪算法在精度、实时性和鲁棒性等方面取得了显著进展。

3.2 视频目标跟踪算法的应用领域视频目标跟踪算法在安防监控、交通管理、智能车辆、人机交互等领域具有广泛的应用前景。

通过实时追踪感兴趣的目标,可以实现目标的识别、定位和分析,从而为智能系统提供决策支持。

四、视频目标跟踪算法的关键问题与挑战4.1 视频目标跟踪算法的精度问题视频目标跟踪算法在实际应用中需要具有较高的跟踪精度,但由于背景干扰、光照变化、目标遮挡等原因,目标跟踪的精度往往无法满足实际需求。

Final Cut Pro中的跟踪和稳定视频技巧跟踪和稳定视频是视频编辑过程中非常重要的环节。

通过使用Final Cut Pro中的跟踪和稳定功能,我们可以修复抖动的镜头,提升视频质量,并增加专业感。

在本教程中,我们将探讨Final Cut Pro中的跟踪和稳定视频的技巧和方法。

一、使用跟踪器Final Cut Pro中的跟踪器可以帮助我们追踪视频中的移动目标,并将其与特定的元素关联起来。

以下是跟踪器的使用步骤:1. 导入视频素材并将其拖放到时间轴上。

2. 在“浏览”选项卡中,选择“跟踪器”。

3. 在界面中选择“新建跟踪者”,并调整框选目标元素。

4. 在“设置” 中,选择正确的跟踪参数,如目标选择器或跟踪区域大小。

5. 点击“分析”开始跟踪,并等待跟踪结束。

6. 跟踪结束后,可以通过调整动画和关键帧属性来微调效果。

通过跟踪器功能,我们可以轻松地将字幕、标记或效果与移动目标保持一致,提升视频制作的专业度。

二、使用稳定视频稳定视频功能可以帮助我们消除抖动,使得镜头更加平稳和稳定。

以下是使用Final Cut Pro中的稳定视频功能的步骤:1. 将需要稳定的视频素材导入到时间轴上。

2. 在“浏览”选项卡中,选择“视频修剪”。

3. 在修剪器中,选择需要修剪的视频片段,并在右边的“栏”中选择“稳定”。

4. 启用稳定视频功能后,Final Cut Pro会自动分析抖动,并进行一些自动调整。

5. 可以通过调整参数来进一步调整稳定效果,如稳定度和修剪比例。

6. 立即预览并播放视频剪辑以查看稳定效果,并根据需要进行微调。

通过使用稳定视频功能,我们可以有效地去除镜头抖动,提高观看体验,使得视频内容更加专业。

三、使用关键帧Final Cut Pro中的关键帧功能可以帮助我们创建和调整各种效果和动画。

以下是使用关键帧的步骤:1. 导入视频素材并将其拖到时间轴上。

2. 在“视频修剪”选项卡中,选择需要应用关键帧的视频片段。

视频目标检测与跟踪实现代码目标检测和跟踪是计算机视觉中的重要任务,可以用于识别视频中的目标对象并追踪其运动轨迹。

下面是一个实现视频目标检测和跟踪的示例代码。

1.导入所需的库```pythonimport cv2import numpy as np```2.加载目标检测模型和跟踪器```pythondef load_detection_model(:#加载目标检测模型model = cv2.dnn.readNetFromCaffe(prototxt_path, model_path) return modeldef load_tracking_model(:#加载跟踪器tracker = cv2.TrackerMOSSE_createreturn tracker#检测模型的配置文件和权重文件路径prototxt_path = 'detection_model.prototxt'model_path = 'detection_model.caffemodel'```3.定义目标检测函数```pythondef detect_objects(frame, detection_model):# 将帧图像转换为 blob 形式# 将 blob 输入到模型中进行目标检测detection_model.setInput(blob)detections = detection_model.forward#解析检测结果num_detections = detections.shape[2]for i in range(num_detections):confidence = detections[0, 0, i, 2]if confidence > 0.5:class_id = int(detections[0, 0, i, 1])x1 = int(detections[0, 0, i, 3] * frame.shape[1]) y1 = int(detections[0, 0, i, 4] * frame.shape[0])x2 = int(detections[0, 0, i, 5] * frame.shape[1])y2 = int(detections[0, 0, i, 6] * frame.shape[0])cv2.rectangle(frame, (x1, y1), (x2, y2), (0, 255, 0), 2)label = f'Class: {class_id}, Confidence: {int(confidence * 100)}%'cv2.putText(frame, label, (x1, y1 - 10),cv2.FONT_HERSHEY_SIMPLEX, 0.9, (0, 255, 0), 2, cv2.LINE_AA) ```4.定义目标跟踪函数```pythondef track_objects(frame, bbox, tracker):#初始化跟踪器tracker.init(frame, bbox)while True:#读取下一帧图像success, frame = cap.readif not success:break#更新跟踪器success, bbox = tracker.update(frame)if success:#跟踪成功,绘制边界框x, y, w, h = [int(x) for x in bbox]cv2.rectangle(frame, (x, y), (x + w, y + h), (0, 255, 0), 2) else:#跟踪失败,输出失败消息cv2.putText(frame, "Tracking failure detected", (100,80), cv2.FONT_HERSHEY_SIMPLEX, 0.75, (0,0,255),2)#显示图像cv2.imshow("Tracking", frame)if cv2.waitKey(1) == ord('q'):break```5.主函数```pythonif __name__ == '__main__':#打开摄像头或视频文件cap = cv2.VideoCapture(0)#加载目标检测模型和跟踪器detection_model = load_detection_model tracker = load_tracking_modelwhile True:#读取下一帧图像success, frame = cap.readif not success:break#目标检测detect_objects(frame, detection_model) #显示图像cv2.imshow("Object Detection", frame) if cv2.waitKey(1) == ord('t'):#选择一个ROI来跟踪bbox = cv2.selectROI(frame, False)cv2.destroyAllWindows#开始目标跟踪track_objects(frame, bbox, tracker) break#释放资源cap.releasecv2.destroyAllWindows```这是一个简单的视频目标检测和跟踪实现的示例代码。

用Tracker 视频跟踪软件分析运动物体加速度马诗航 唐艳妮 李雪琴 刘 芯 何楚洹(火箭军工程大学,陕西 西安 710025)【摘 要】文章运用Tracker 视频跟踪软件分析运动物体的影像视频,获得其时间-位移数据,结合Excel 数据分析软件对所获取数据进行线性拟合,根据加速度、时间、位移的关系,求得斜面运动物体的加速度。

利用家中随处可见的物品和Tracker 等软件测量抽象的加速度,降低了数据探究的难度,增加了实验探究的自由度和趣味性。

【关键词】Tracker 视频跟踪软件;线性拟合;加速度;运动物体【中图分类号】G633.7 【文献标识码】A 【文章编号】1008-1151(2020)09-0027-03Analysis of Acceleration of Moving Objects with Tracker Video Tracking SoftwareAbstract: In this paper, Tracker video tracking software was used to analyze the videos images of moving objects to obtain time displacement data. The obtained data were linearly fitted with Excel data analysis software. The acceleration of the moving object on the inclined plane was obtained according to the relationship between acceleration, time and displacement. Abstract acceleration can be measured by objects that can be seen everywhere in the home and software such as Tracker, which reduces the difficulty of data exploration and increases the freedom and interest of experimental exploration.Key words: Tracker video tracking software; linear fitting; acceleration; moving objects引言加速度是一种描述物体运动快慢的物理量,在研究运动物体中具有重要的应用。

在视频侦查随着我国经济的快速发展,汽车保有量逐年增长,为公众出行带来极大的便利。

但是,汽车也被犯罪嫌疑人作为交通或运输作案工具用来实施违法犯罪行为(比如杀人抛尸案、绑架案、抢劫案等)。

如何利用视频侦查手段对涉案车辆进行分析和追踪,快速锁定犯罪嫌疑人是公安机关需要解决的关键问题。

一、对涉案车辆的确认和特征分析(一)对涉案车辆的确认对涉案车辆的确认是追踪和研判工作的第一步,也是关键一步。

要准确判定涉案嫌疑车辆,否则会导致整体案件侦查方向的错误,甚至使案件陷入僵局难以侦破。

办案人员可以通过犯罪嫌疑人进入车辆、犯罪嫌疑人从车辆下来、车辆进入案发现场、车辆从案发现场驶离、车辆室内有可疑物品、车辆在受害人住处或者受害人车辆旁有停留行为、车辆被受害人指认等来确认涉案嫌疑车辆,有时还要结合案发时间段进行二次确认。

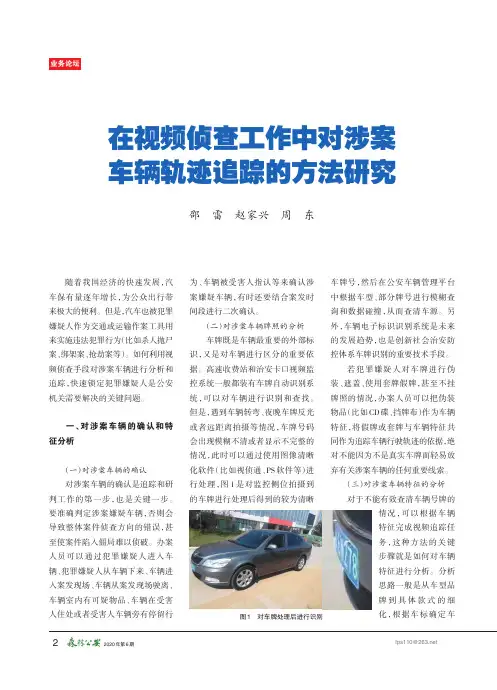

(二)对涉案车辆牌照的分析车牌既是车辆最重要的外部标识,又是对车辆进行区分的重要依据。

高速收费站和治安卡口视频监控系统一般都装有车牌自动识别系统,可以对车辆进行识别和查找。

但是,遇到车辆转弯、夜晚车牌反光或者远距离拍摄等情况,车牌号码会出现模糊不清或者显示不完整的情况,此时可以通过使用图像清晰化软件(比如视侦通、PS软件等)进行处理,图1是对监控侧位拍摄到的车牌进行处理后得到的较为清晰车牌号,然后在公安车辆管理平台中根据车型、部分牌号进行模糊查询和数据碰撞,从而查清车源。

另外,车辆电子标识识别系统是未来的发展趋势,也是创新社会治安防控体系车牌识别的重要技术手段。

若犯罪嫌疑人对车牌进行伪装、遮盖、使用套牌假牌,甚至不挂牌照的情况,办案人员可以把伪装物品(比如CD碟、挡牌布)作为车辆特征,将假牌或套牌与车辆特征共同作为追踪车辆行驶轨迹的依据,绝对不能因为不是真实车牌而轻易放弃有关涉案车辆的任何重要线索。

(三)对涉案车辆特征的分析对于不能有效查清车辆号牌的情况,可以根据车辆特征完成视频追踪任务,这种方法的关键步骤就是如何对车辆特征进行分析。

制作短视频时如何运用镜头的追踪和移动来展示特定的动作在制作短视频时,运用镜头的追踪和移动来展示特定的动作是非常重要的。

通过精确的镜头追踪和流畅的移动,可以提升视频的观赏性,传递更准确和生动的信息。

本文将介绍如何有效地运用镜头追踪和移动来展示特定的动作,从而使短视频更加吸引人。

一、镜头追踪的基本原理镜头追踪是指通过摄像机的移动或调整来追随或跟踪特定的运动物体。

在制作短视频时,通过镜头追踪可以突出特定的动作,使观众更加聚焦于关键的元素或人物。

镜头追踪可以通过稳定器、云台或运动控制等工具来实现。

二、追踪运动物体的技巧1.选择适当的拍摄角度:在追踪运动物体时,选择一个合适的拍摄角度非常重要。

要考虑物体的运动轨迹和动作特点,并选择能够完整展示动作过程的角度。

同时,要注意避免拍摄角度过远或过近,以免影响观众对动作的感知和理解。

2.使用追踪轨迹线:在视频编辑软件中,可以使用追踪轨迹线来模拟物体的运动轨迹。

通过在追踪物体周围添加轨迹线,能够清晰地向观众展示动作的方向和强度,增强观看体验。

三、镜头移动的技巧1.平稳流畅的移动:镜头移动时要保持流畅和平稳,避免拍摄时的抖动或剧烈晃动,这会影响观众的观看体验。

可以使用稳定器或云台等设备来获得更平稳的移动效果。

2.运用转场技巧:在镜头移动时,可以适当运用一些转场技巧,如推拉焦、快速切换视角等,来增加视频的节奏感和观赏性。

但要注意不要过度使用,以免影响观众对动作的理解。

四、合理运用追踪和移动1.突出关键动作:通过精确的镜头追踪和流畅的移动,可以突出视频中的关键动作,使其更加引人注目。

在追踪和移动过程中,要抓住关键动作的时机和角度,展示出动作的魅力和独特之处。

2.展示动作变化:通过追踪和移动,可以有效地展示动作的变化和发展过程。

可以适时调整镜头的位置和角度,以展示动作的连贯性和多样性。

这样能够给观众带来更好的观赏体验,并增强动作的表现力。

五、案例分析:短视频中的镜头追踪和移动下面以制作运动品牌宣传视频为例,介绍如何运用镜头追踪和移动来展示特定的动作。

视频图像分析中的行人检测与追踪随着科技的发展和智能化时代的到来,视频图像分析技术在各个领域的应用越来越广泛。

其中,行人检测与追踪是视频图像分析的一项重要任务。

行人检测与追踪技术不仅可以用于安防领域,还可以应用于智能交通、智慧城市等领域。

本文将介绍视频图像分析中的行人检测与追踪技术的原理和应用。

行人检测是指在视频图像中自动检测出行人目标的位置和轮廓。

行人追踪是指在连续的视频帧中跟踪行人目标的移动轨迹。

行人检测与追踪技术在视频监控系统中有着重要的应用,可以帮助监控人员快速识别行人目标,提醒异常情况并进行及时处理。

此外,行人检测与追踪技术还可以用于智能交通系统中,例如交通监控、交通流量分析等,提高道路交通的安全性和效率。

在视频图像分析中,行人检测与追踪的实现主要依靠计算机视觉和深度学习技术。

传统的行人检测方法主要基于特征提取和机器学习算法,例如Haar特征、HOG特征和SIFT特征等。

这些方法通过提取图像中与行人特征相关的特征向量,利用分类器进行判别,从而实现行人目标的检测。

然而,由于行人的外观和姿态的多样性,传统的方法在各种复杂场景下的检测效果有限。

近年来,深度学习技术的快速发展为行人检测与追踪带来了巨大的突破。

深度学习模型如卷积神经网络(CNN)和循环神经网络(RNN)等能够自动学习和提取图像的高级特征,提高行人检测与追踪的准确性和鲁棒性。

目前,基于深度学习的行人检测与追踪方法已经成为主流。

在行人检测中,常用的深度学习模型是基于CNN的目标检测网络,例如Faster R-CNN、YOLO(You Only Look Once)和SSD(Single Shot MultiBoxDetector)等。

这些方法可以实现对图像中的行人目标位置和轮廓的准确检测,并能够进行实时处理。

此外,还有一些基于特征提取的模型,如LSTM (Long Short-Term Memory)和GRU(Gated Recurrent Unit)等,可以捕捉行人目标在连续帧中的运动轨迹。

视频剪辑中的运动跟踪技巧与应用现代社会,随着科技的发展和智能手机的普及,视频剪辑已经成为我们生活中不可或缺的一部分。

在视频制作中,运动跟踪技术的应用越来越普遍。

本文将介绍运动跟踪技巧的基本概念、应用场景以及操作步骤,帮助读者更好地使用这一功能来创造出精彩的视频作品。

一、运动跟踪技巧的基本概念1.1 运动跟踪的定义运动跟踪是指对视频中的运动对象进行实时追踪和分析的技术。

通过运动跟踪,我们可以追踪物体的位置、速度、姿态等信息,从而实现对视频素材的更精细处理。

1.2 运动跟踪技术的原理运动跟踪技术的原理是通过计算机视觉和图像处理算法,将视频中的运动对象与背景进行分离,然后根据运动对象的变化轨迹进行跟踪和分析。

二、运动跟踪技巧的应用场景2.1 电影特效中的运动跟踪电影中使用运动跟踪技术可以将虚拟场景和真实场景进行混合,通过运动跟踪技术,可以实现特殊效果的创造,例如让人物在快速移动中飞过城市等。

2.2 运动广告中的运动跟踪在运动广告中,我们经常看到运动员精准地投篮、接球等动作,这些都是通过运动跟踪技术实现的。

运动跟踪可以记录运动员的动作轨迹,并将其与广告视频进行融合,使观众体验到更真实的运动场景。

2.3 运动教学中的运动跟踪运动跟踪技术在运动教学中也有广泛的应用。

通过运动跟踪,教练可以准确地分析学员的动作,找出问题并加以修正,从而提高学员的训练效果。

三、运动跟踪技巧的操作步骤3.1 导入视频素材在视频剪辑软件中,首先需要导入需要进行运动跟踪的视频素材。

可以通过拖拽文件或者选择文件导入的方式将视频导入到软件中。

3.2 选择运动对象在进行运动跟踪之前,需要选择一个运动对象作为跟踪目标。

在视频剪辑软件中,可以使用移动框或者遮罩工具将运动对象选中。

3.3 设置跟踪参数在设置跟踪参数时,需要根据具体需求调整参数。

常见的跟踪参数包括追踪的时长、准确度等。

3.4 进行跟踪与分析设置好参数后,就可以进行跟踪与分析了。

视频剪辑软件会根据选定的运动对象进行视频素材的分析和处理,生成跟踪效果。

视频剪辑:使用3D相机追踪效果在现代社会,视频剪辑已成为我们生活中不可或缺的一部分。

不论是制作个人作品、商业广告还是电影电视剧,相辅相成的视频剪辑技术都是不可缺少的。

Adobe Premiere Pro作为一款专业的视频剪辑软件,提供了丰富的功能和工具,其中3D相机追踪效果是提升视频剪辑质量和创意的重要技巧之一。

那么,什么是3D相机追踪效果呢?简单地说,3D相机追踪效果是指在视频中通过模拟3D相机的移动和视角变化,将图像或文本等元素与场景进行融合。

这种效果可以增加视频的真实感和动态感,让观众更好地沉浸在故事情节中。

在Adobe Premiere Pro中使用3D相机追踪效果,首先我们需要选择一个需要添加3D效果的片段。

接下来,在“效果”面板中找到“四角钥匙”工具,将其拖放到视频片段上。

这将自动启用3D相机追踪效果。

一旦启用了3D相机追踪效果,我们可以开始调整场景和元素之间的交互。

在“特效控制”面板中,可以找到“3D相机追踪”选项,并点击打开详细设置。

在详细设置中,我们可以调整相机视角、焦距和深度等参数,以便更好地匹配视频场景。

通过调整这些参数,我们可以使添加的元素在视频中更加真实和自然。

另外,在设置界面中还可以调整光照和阴影效果。

通过添加适当的光照和阴影,可以增加画面的层次感和立体感,使整个视频更加生动。

此外,Adobe Premiere Pro还提供了在3D相机追踪效果中添加动态文本和图像的功能。

通过在“图层”面板中选择“新建图层”,然后选择“文本”或“媒体”,我们可以将自己的文本和图像元素添加到视频中。

使用3D相机追踪效果时,我们还可以通过使用“遮罩”工具创建自定义的形状,以实现更加精细的效果。

通过将形状与视频场景进行匹配,可以使添加的元素更加融入整个场景中。

需要注意的是,在使用3D相机追踪效果时,建议先导入高质量的视频素材,以获得更好的效果。

同时,运用这项技巧时也要注意合理运用,避免过度使用,以免效果过于复杂,影响观看体验。

视频监控系统中的动态目标检测与跟踪随着科技的不断发展,视频监控系统已经成为我们生活中不可或缺的一部分。

而其中一个重要的功能就是动态目标检测与跟踪。

本文将对动态目标检测与跟踪在视频监控系统中的应用进行探讨。

动态目标检测是指在视频监控中,通过算法识别并定位出视频中的运动目标,并在目标发生运动时跟踪目标的位置。

这项技术对于保障公共安全、监控交通流量等方面起到了重要的作用。

在一个视频监控系统中,动态目标检测与跟踪的过程可以分为多个步骤。

首先是目标检测,即通过图像处理算法对视频中的每一帧图像进行分析,识别出其中的运动目标。

目标检测算法有很多种,其中常用的包括基于背景建模的方法、基于光流的方法和基于深度学习的方法等。

基于背景建模的目标检测方法是通过学习视频中的背景信息,将背景和前景目标分离,从而实现目标的检测。

这种方法适用于静态背景下的视频监控。

而基于光流的方法则是通过检测连续帧之间的图像运动信息来确定视频中的运动目标。

这种方法适用于动态背景下的视频监控。

而基于深度学习的方法则可以通过训练神经网络来实现目标的检测,这种方法在最近的几年中得到了广泛的应用。

目标检测完成后,接下来的步骤就是目标跟踪。

目标跟踪是指在视频中追踪目标的位置,并保持目标的标识,以便后续的分析与处理。

目标跟踪有多种方法,包括基于模板匹配的方法、基于特征提取的方法和基于学习的方法等。

基于模板匹配的目标跟踪方法是通过提取目标的特征,将其与模板进行匹配,从而实现目标的跟踪。

这种方法适用于目标形状和外观变化较小的情况。

基于特征提取的方法则是通过提取目标的颜色、纹理和形状等特征来实现目标的跟踪。

而基于学习的方法则是通过训练分类器来实现目标的跟踪,这种方法在大数据时代得到了广泛的应用。

动态目标检测与跟踪技术在视频监控系统中有着广泛的应用。

首先,它可以用于监控公共场所,如机场、火车站、商场等地,及时发现异常和可疑行为。

其次,它可以用于交通监控,如交通路口的车辆检测与追踪,以及道路拥堵的监测与预警等。

智能视频监控系统目标跟踪与分类算法研究

研究高实时性高准确

度的智能视觉分析算法、多目视觉数据融合以及最优化问题是智能视频监控系统

研究的关键。本文针对智能视频监控系统中的运动目标跟踪与分类问题—从运

动目标分割、跟踪和分类,到基于多目视觉数据融合的目标连续跟踪、跟踪优化

分配以及目标分类/跟踪互协作,进行了深入研究,并设计和实现了基于嵌入式

CPU和DSP相互协作的智能摄像机原型系统。

智能视频监控(Ivs,Intelligentvideosurvei一ance)技术源自计算机视觉(ev

eomputervision)与人工智能(Al,ArtifieialIntelligent)的研究,其发展目标在

于将图像与事件描述之间建立一种映射关系,借助计算机强大的数据处理能力过

滤掉图像中无用的干扰信息,自动分析、抽取视频源中的有用信息,使计算机从

纷繁的视频图像中分辨、识别出关键目标物体,从而使传统监控系统中的摄像机

不但成为人的眼睛,也使“智能视频分析”计算机成为人的大脑,并具有更为“聪

明”的学习思考方式。这一根本性的改变,极大地发挥与拓展了视频监控系统

作用与能力,使监控系统具有更高的智能化,大幅度降低了资源与人员配置,时必将全面

提升视频数据的分析效率和实时处理能力。

在普通图像序列中的运动检测,其他类型检测基本上

是普通图像序列检测方法的扩充,从方法上看有如下几类:

.背景减法 (Baekgroundsubtraction)

背景减法的原理如图 1.4所示,通过对背景像素进行建模,由当前图像与背景

图像模型之差得到运动前景图像。该方法是最受欢迎的运动目标检测方法之一

背景减法一般能够检测完全的目标前景特征数据,。该方法的关键在于如何自动获得场景的

静态背景模型,适用于背景已知的情况,而在场景中背景往往是

不固定的,它会随着光线、运动以及背景物体的移入/移出等变化而动态变化,

背景模型必须及时适应这些变化

.帧间差法(Tcmpora一Diffcrcnee)

帧间差法138,,42一,43]原理如图1.7,该方法主要利用时间信息,通过比较图像序

列中相邻帧间所有对应位置的像素点,并根据规则计算对应像素点的差值,

如果差值大于一定阀值,就认为该点对应位置有运动目标存在并提取该运动

目标。相邻帧差法采用单台摄像机,对动态环境有较强自适应性,但一般来

说使用该方法不能完全提取相关的特征像素点,得到的检测结果并非纯目标

.光流法(optiealFlow)

光流是图像亮度的运动信息描述,光流检测技术基于图像中相邻点的亮度相

似这一个前提,即图像中亮度变化平稳,在该前提下光流法将3维空间的图

像表面亮度点的速率信息映射为近似的2维运动场来进行计算。在目标检测

过程中,基于光流方法的运动检测139一40]应用运动目标随时间变化的流矢量特

性在图像序列中检测运动区城,如果图像中没有运动目标,则光流矢量在整

个图像区域是连续变化的。采用光流场信息可以得到完整的运动信息,能很

好的从背景中检测得到不同的运动目标等前景,甚至可以检测到运动目标的

一部分,因此可以实现单一摄像机运动过程中独立运动目标的检测。但是算

法要对所有帧中的所有像素进行计算,所以算法计算量大、复杂耗时,如果

没有专门的硬件设备支持,很难实现视频实时检测。