改进的基于密度方法的态势聚类显示算法

- 格式:pdf

- 大小:296.92 KB

- 文档页数:4

密度聚类(Density-Based Clustering)是一种基于密度的聚类算法,其主要思想是将样本空间划分为密度相连的区域,并将密度较大的区域划分为一个簇。

相比于传统的基于距离的聚类算法,密度聚类对簇形状和大小的假设更为宽松,能够更好地适应各种形状和密度不均匀的簇。

MATLAB作为一种强大的科学计算工具,提供了丰富的聚类算法实现,包括基于密度的聚类算法。

本文将针对MATLAB中基于密度的聚类算法的实现与使用进行介绍,分为以下几个方面:1.密度聚类算法的原理密度聚类算法的核心是基于样本点的密度来划分簇。

需要定义一个邻域的大小(ϵ)和邻域中最小样本点的个数(MinPts),然后通过计算每个样本点的密度来找到核心对象(密度大于MinPts)及其直接密度可达的样本点,最终将这些样本点划分为一个簇。

对于密度相连的簇,会被合并为一个整体。

2.MATLAB中基于密度的聚类算法实现MATLAB中提供了基于密度的聚类算法的实现,主要包括DBSCAN (Density-Based Spatial Clustering of Applications with Noise)和OPTICS(Ordering Points To Identify the Clustering Structure)两种算法。

其中,DBSCAN是一种基于密度的聚类算法,并且对样本点的簇结构进行了良好的定义。

OPTICS算法是对DBSCAN的扩展,通过计算样本点的可达距离将簇进行了有序排列,并能够有效地处理各向异性的数据。

3.基于密度的聚类算法在MATLAB中的使用在MATLAB中,可以借助Statistics and Machine Learning Toolbox提供的函数来实现基于密度的聚类算法。

通过使用fitcknn函数可以构建基于密度的K近邻分类器,利用knnsearch函数可以对新样本进行分类预测。

4.基于密度的聚类算法的优缺点相比于传统的基于距离的聚类算法,基于密度的聚类算法能够更好地适应各种形状和密度不均匀的簇。

聚类分析(五)——基于密度的聚类算法OPTICS 1 什么是OPTICS算法在前⾯介绍的DBSCAN算法中,有两个初始参数E(邻域半径)和minPts(E邻域最⼩点数)需要⽤户⼿动设置输⼊,并且聚类的类簇结果对这两个参数的取值⾮常敏感,不同的取值将产⽣不同的聚类结果,其实这也是⼤多数其他需要初始化参数聚类算法的弊端。

为了克服DBSCAN算法这⼀缺点,提出了OPTICS算法(Ordering Points to identify theclustering structure)。

OPTICS并不显⽰的产⽣结果类簇,⽽是为聚类分析⽣成⼀个增⼴的簇排序(⽐如,以可达距离为纵轴,样本点输出次序为横轴的坐标图),这个排序代表了各样本点基于密度的聚类结构。

它包含的信息等价于从⼀个⼴泛的参数设置所获得的基于密度的聚类,换句话说,从这个排序中可以得到基于任何参数E和minPts的DBSCAN算法的聚类结果。

2 OPTICS两个概念核⼼距离:对象p的核⼼距离是指是p成为核⼼对象的最⼩E’。

如果p不是核⼼对象,那么p的核⼼距离没有任何意义。

可达距离:对象q到对象p的可达距离是指p的核⼼距离和p与q之间欧⼏⾥得距离之间的较⼤值。

如果p不是核⼼对象,p和q之间的可达距离没有意义。

例如:假设邻域半径E=2, minPts=3,存在点A(2,3),B(2,4),C(1,4),D(1,3),E(2,2),F(3,2)点A为核⼼对象,在A的E领域中有点{A,B,C,D,E,F},其中A的核⼼距离为E’=1,因为在点A的E’邻域中有点{A,B,D,E}>3;点F到核⼼对象点A的可达距离为,因为A到F的欧⼏⾥得距离,⼤于点A的核⼼距离1.3 算法描述OPTICS算法额外存储了每个对象的核⼼距离和可达距离。

基于OPTICS产⽣的排序信息来提取类簇。

算法描述如下:算法:OPTICS输⼊:样本集D, 邻域半径E, 给定点在E领域内成为核⼼对象的最⼩领域点数MinPts输出:具有可达距离信息的样本点输出排序⽅法:1 创建两个队列,有序队列和结果队列。

基于密度方法的聚类密度方法是一种无参数的聚类算法,通过计算数据点周围的密度来确定聚类结构。

它不需要预设聚类数目,适用于各种类型的数据,具有较强的鲁棒性和灵活性。

本文将详细介绍密度方法的原理和算法流程,并讨论其优缺点以及应用领域。

密度方法聚类的核心思想是根据数据点周围的密度,将数据点划分到不同的聚类簇中。

密度是通过计算点在给定半径内邻近点的数量来衡量的。

在密度方法中,每个数据点被分为三种类型:核心点(core point)、边界点(border point)和噪声点(noise point)。

核心点是在给定半径内有足够数量邻近点的点,它们属于一个聚类簇的核心部分。

边界点是在给定半径内没有足够数量邻近点,但邻近点中包含核心点的点,边界点位于聚类簇的边界上。

噪声点是在给定半径内没有足够数量邻近点并且邻近点也不包含核心点的点,噪声点不属于任何聚类簇。

密度方法的算法流程如下:1.初始化点集D和给定半径ε。

2.遍历所有点p∈D,计算p的ε-邻域内的点的数量,如果数量大于等于给定阈值,将p标记为核心点。

3.将所有邻近核心点的点标记为边界点。

4.如果没有边界点,则算法结束。

5.如果存在边界点,则选取一个未被访问的边界点,将其加入当前聚类簇C,并递归地将其邻近核心点加入C。

6.重复步骤5,直到无法找到更多的邻近点,此时一个聚类簇形成。

7.将所有已被访问的点从D中删除,返回步骤2密度方法聚类的优点在于它可以自动发现任意形状的聚类簇,并且对噪声点具有较好的鲁棒性。

它不需要预设聚类数目,适用于各种类型的数据。

此外,密度方法还可以处理大规模数据集,具有较高的可扩展性。

然而,密度方法也存在一些缺点。

首先,密度方法对于参数的选择比较敏感,需要根据具体数据集进行调参。

其次,密度方法对于高维数据和密集型数据表现不佳,容易出现维度灾难。

此外,密度方法在处理不同密度之间的聚类问题时,可能会受到密度比例的影响。

密度方法聚类在多个领域和应用中得到了广泛的应用。

基于密度峰值的聚类算法基于密度峰值的聚类算法(Density Peak Clustering Algorithm)是一种非参数化的聚类算法,它通过计算样本之间的密度和距离来确定聚类的中心,并将样本分配到不同的聚类中。

该算法由Rodriguez和Laio于2024年提出,相比于传统的基于距离的聚类方法,密度峰值聚类算法能够更好地适应数据的分布特点,尤其适用于具有多个不同密度区域的数据集。

密度峰值聚类算法的核心思想是通过计算样本之间的密度和距离来确定聚类的中心。

首先,算法计算每个样本的局部密度,表示样本周围一定半径范围内的样本数量。

然后,对于每个样本,算法计算其到其他样本的最小距离,即距离最近的样本的距离。

最后,根据每个样本的局部密度和最小距离,算法确定每个样本的密度峰值,并将样本分配到不同的聚类中。

密度峰值聚类算法的具体步骤如下:1.计算每个样本的局部密度:对于每个样本,计算它周围一定半径范围内的样本数量,将该数量作为样本的局部密度。

2.计算每个样本的最小距离:对于每个样本,计算它到其他样本的最小距离,即距离最近的样本的距离。

3.确定样本的密度峰值:根据每个样本的局部密度和最小距离,计算一个可信度值。

该可信度值越大,表示该样本的密度峰值越高,即该样本越有可能是聚类的中心。

4.选择聚类的中心:根据每个样本的可信度值,选择具有较高可信度值的样本作为聚类的中心。

5.分配样本到聚类中:对于每个样本,将其分配到离其最近的可信度值较高的样本所属的聚类中。

6.删除噪声样本:将密度较低的样本划分为噪声,从聚类中移除。

密度峰值聚类算法相比于传统的基于距离的聚类方法具有以下优点:1.相对于传统的聚类方法,密度峰值聚类算法不需要预先指定聚类的个数,能够自动确定聚类的个数。

2.密度峰值聚类算法能够识别具有不同密度的样本簇,并将其分配到不同的聚类中,能够更好地适应数据的分布特点。

3.密度峰值聚类算法对噪声样本具有较好的鲁棒性,能够将噪声样本划分为独立的聚类或从聚类中移除。

《基于密度聚类算法的研究与改进》篇一一、引言随着大数据时代的到来,数据挖掘和数据分析技术得到了广泛的应用。

其中,聚类算法作为无监督学习的重要分支,被广泛应用于各种领域。

密度聚类算法是聚类算法中的一种,其基本思想是将数据空间划分为不同的密度区域,并通过高密度区域进行聚类。

本文旨在研究密度聚类算法的基本原理和实现方法,并提出相应的改进措施。

二、密度聚类算法的基本原理和实现方法2.1 基本原理密度聚类算法是一种基于密度的聚类方法,其基本思想是将数据空间划分为不同的密度区域,并通过高密度区域进行聚类。

该算法通过计算每个点的局部密度来确定其所属的聚类,并利用密度连通性来形成最终的聚类结果。

2.2 实现方法密度聚类算法的实现过程主要包括以下几个步骤:(1)计算每个点的局部密度;(2)根据局部密度确定每个点的邻域范围;(3)通过密度连通性将高密度区域连接起来形成聚类;(4)对形成的聚类进行后处理,如去除噪声点、合并小聚类等。

三、密度聚类算法的改进措施3.1 优化局部密度的计算方法局部密度的计算是密度聚类算法的关键步骤之一。

传统的局部密度计算方法往往只考虑了点的局部邻域内的密度信息,忽略了全局信息。

因此,我们可以采用基于全局信息的局部密度计算方法,如基于核密度的局部密度计算方法,以提高聚类的准确性和鲁棒性。

3.2 引入空间约束条件传统的密度聚类算法往往只考虑了数据点的密度信息,而忽略了空间约束条件。

因此,我们可以在算法中引入空间约束条件,如利用空间距离信息来调整局部密度的计算方法和邻域范围的确定等,以提高聚类的准确性和可解释性。

3.3 结合其他聚类算法的优点不同的聚类算法有其各自的优点和适用场景。

因此,我们可以将密度聚类算法与其他聚类算法相结合,如结合层次聚类、谱聚类等算法的优点,形成混合聚类算法,以提高聚类的效果和鲁棒性。

四、实验与分析为了验证上述改进措施的有效性,我们进行了实验分析。

实验结果表明,优化局部密度的计算方法、引入空间约束条件和结合其他聚类算法的优点等方法都可以有效地提高密度聚类算法的准确性和鲁棒性。

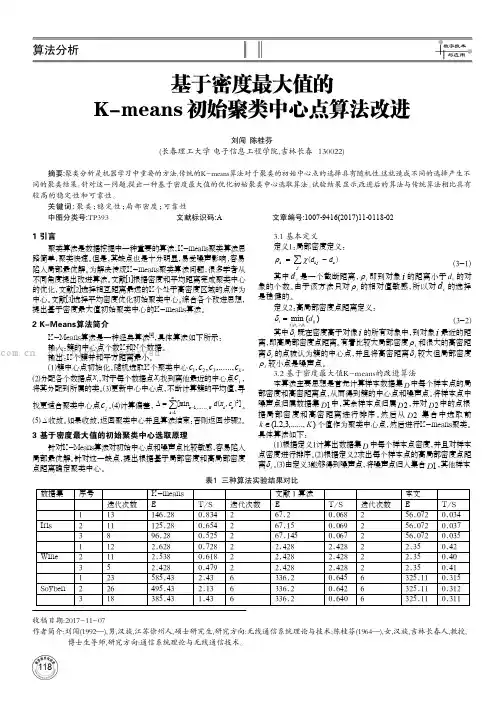

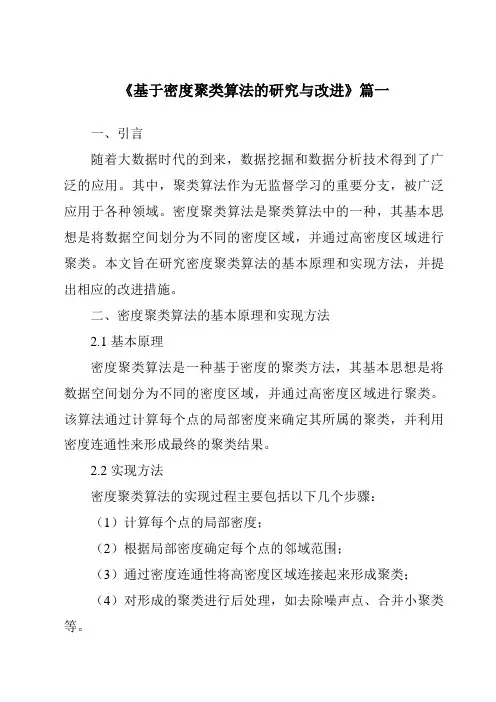

基于密度的K-means算法在轨迹数据聚类中的优化郝美薇;戴华林;郝琨【摘要】针对传统的K-means算法无法预先明确聚类数目,对初始聚类中心选取敏感且易受离群孤点影响导致聚类结果稳定性和准确性欠佳的问题,提出一种改进的基于密度的K-means算法.该算法首先基于轨迹数据分布密度和增加轨迹数据关键点密度权值的方式选取高密度的轨迹数据点作为初始聚类中心进行K-means聚类,然后结合聚类有效函数类内类外划分指标对聚类结果进行评价,最后根据评价确定最佳聚类数目和最优聚类划分.理论研究与实验结果表明,该算法能够更好地提取轨迹关键点,保留关键路径信息,且与传统的K-means算法相比,聚类准确性提高了28个百分点,与具有噪声的基于密度的聚类算法相比,聚类准确性提高了17个百分点.所提算法在轨迹数据聚类中具有更好的稳定性和准确性.%Since the traditional K-means algorithm can hardly predefine the number of clusters,and performs sensitively to the initial clustering centers and outliers,which may result in unstable and inaccurate results,an improved density-based K-means algorithm was proposed.Firstly,high-density trajectory data points were selected as the initial clustering centers to perform K-means clustering by considering the density of the trajectory data distribution and increasing the weight of the density of important points.Secondly,the clustering results were evaluated by the Between-Within Proportion (BWP) index of cluster validity function.Finally,the optimal number of clusters and clustering were determined according to the clustering results evaluation.Theoretical researches and experimental results show that the improved algorithm can be better at extracting the trajectory key pointsand keeping the key path information.The accuracy of clustering results was 28 percentage points higher than that of the traditional K-means algorithm and 17 percentage points higher than that of the Density-Based Spatial Clustering of Applications with Noise (DBSCAN) algorithm.The proposed algorithm has a better stability and a higher accuracy in trajectory data clustering.【期刊名称】《计算机应用》【年(卷),期】2017(037)010【总页数】6页(P2946-2951)【关键词】K-means算法;基于密度;车辆活动特征;密度权值;初始聚类中心;类内类外划分指标【作者】郝美薇;戴华林;郝琨【作者单位】天津城建大学计算机与信息工程学院,天津300384;天津城建大学计算机与信息工程学院,天津300384;天津城建大学计算机与信息工程学院,天津300384【正文语种】中文【中图分类】TP301.6伴随着大数据时代的到来,在移动定位服务的高速发展下,轨迹数据已经成为了一项重要的数字资源。

聚类算法的改进——DBSCANDBSCAN(Density-Based Spatial Clustering of Applicationswith Noise)是一种聚类算法,它基于数据点的密度进行聚类。

相对于传统的聚类算法,如K-means和层次聚类,DBSCAN具有以下几个优点:1.不需要预先指定簇的数量:传统的聚类算法需要提前指定聚类的数量,但在实际应用中,很难事先知道数据集的真正聚类数量。

DBSCAN通过定义邻域半径和最小密度来寻找密度高的区域,并以此为基础进行聚类,不需要预先指定簇的数量。

2.能够识别任意形状的聚类:传统的聚类算法通常只能识别凸形状的聚类,而对于非凸形状的聚类效果不佳。

DBSCAN通过定义邻域的概念,能够识别任意形状的聚类,包括凹凸形状的聚类。

3.能够处理噪声和异常值:在实际应用中,数据集中常常存在噪声和异常值,这些数据点不属于任何一个真正的聚类。

传统的聚类算法对于噪声和异常值的处理效果较差,容易将其错误地归类到其中一聚类中。

DBSCAN通过定义邻域密度,能够将噪声和异常值识别为孤立点,不将其归类到任何一个聚类中。

4.不受初始化的影响:传统的聚类算法对于初始的聚类中心的选择非常敏感,不同的初始值会得到不同的聚类结果。

而DBSCAN不需要初始化过程,仅根据数据点的密度和邻域信息进行聚类,不受初始化的影响。

然而,DBSCAN也存在一些不足之处,需要进行改进:1.对参数的敏感性:DBSCAN算法有两个重要的参数,即邻域半径和最小密度。

不同的参数设置会得到不同的聚类结果,但如何确定合适的参数值是一个难题。

目前常用的方法是通过经验或使用网格等调参方法来寻找最优的参数值。

如果没有选择合适的参数值,DBSCAN算法的聚类效果可能会较差。

2.对高维数据的低效性:DBSCAN算法在处理高维数据时,由于维数灾难的影响,计算邻域信息变得困难。

在高维数据中,样本点间的距离差异较小,容易导致样本点间的连接性变得模糊,导致聚类结果不准确。

基于密度的聚类算法

密度聚类算法是一种基于数据密度的聚类方法,主要特点是将数据点结合成聚类,旨在从数据集中查找最相近的点。

不同于传统的聚类算法,它更加侧重于计算空间内点的密度,而不是向量空间的距离。

密度聚类有很多类型,其中著名的算法有:DBSCAN(支持度基因聚类)、OPTICS(离散点优化视觉)以及DENCLUE (离散时间处理)等。

DBSCAN算法是一种基于密度的算法,它建立在空间数据点分布上,结合两个参数即半径(eps)和聚类最小数目(minPoints)来形成聚类。

它做的是,首先通过设定一个半径eps,将不同的点连接起来,组成相互之间距离小于eps的点构成一个新的聚类簇,然后将这些特征点的聚类扩大,直到形成一个稳定的聚类。

这就是DBSCAN算法。

而OPTICS算法则是基于密度的另一种聚类算法,它能够通过使用一个可变的半径来构建密度梯度,将离散点根据密度进行排序,并计算点间的可达距离。

根据密度梯度,它可以更好地分割空间中的离散点,并捕获出数据集中斑点和噪音的细节,从而得到比DBSCAN更具有有效性的结果。

最后,DENCLUE算法的主要思想是将数据由时间轴上的离散分布抽象出来,使用一个可变的高斯函数来计算每个点的密度,该可变半径适应于空间密度的可变程度,能够选择合适的结构来描述每个离散点,从而获取更好的聚类效果。

总而言之,基于密度的聚类算法是一种比较精准的聚类方法,通过设定半径和点的最小数目来形成聚类,从而使得空间中的点更加清晰准确的被整合在一起。