MACHINE LEARNING An Artificial Intelligence Approach Contributing authors

- 格式:pdf

- 大小:1.40 MB

- 文档页数:23

人工智能领域的学术期刊与研究机构介绍人工智能(Artificial Intelligence,简称AI)是近年来备受关注的一个热门领域,其对社会和经济发展产生了巨大的影响。

在人工智能领域进行学术研究的科学家和学者需要找到最新的研究成果和与同行交流的机会。

本文将介绍一些重要的学术期刊和研究机构,在这些平台上,人工智能研究者可以分享经验和思想,推动人工智能技术的发展。

一、学术期刊1.《人工智能》(Artificial Intelligence)《人工智能》是人工智能领域的顶级学术期刊,由国际人工智能学会(Association for the Advancement of Artificial Intelligence,AAAI)出版。

该期刊涵盖了人工智能领域的各个方面,包括机器学习、自然语言处理、计算机视觉等。

它是人工智能研究者发表原创研究成果的首选期刊之一。

2.《机器学习》(Machine Learning)《机器学习》期刊是机器学习领域的重要学术期刊,致力于发表关于机器学习理论、方法和应用的研究成果。

该期刊对机器学习领域的新兴技术和热点问题进行深入研究,对于推动机器学习领域的发展具有重要意义。

3.《人工智能研究进展》(AI Research)《人工智能研究进展》是中国人工智能学会主办的学术期刊,旨在推动国内外人工智能研究的交流与发展。

该期刊为人工智能领域的研究者提供了一个分享最新研究成果的平台,介绍了人工智能领域的前沿技术和应用。

二、研究机构1.麻省理工学院人工智能实验室(MIT Artificial Intelligence Laboratory)麻省理工学院人工智能实验室是全球最知名的人工智能研究机构之一。

成立于1959年,该实验室致力于开展人工智能的基础研究和应用研究,培养了众多优秀的人工智能科学家和工程师。

实验室的研究成果在学术界和工业界都具有重要影响力。

2.斯坦福人工智能实验室(Stanford Artificial Intelligence Laboratory)斯坦福人工智能实验室是斯坦福大学的一所研究机构,创建于1962年。

1956达特茅斯会议提出的概念1956年,达特茅斯会议(Dartmouth Conference)在美国新罕布什尔州达特茅斯学院(Dartmouth College)召开,聚集了一群领先的计算机科学家和人工智能研究者,共同探讨和交流计算机和人工智能领域的前沿问题。

在这次会议上,一系列重要的概念被提出并对计算机科学和人工智能领域的发展产生了深远的影响。

一、人工智能(Artificial Intelligence)达特茅斯会议是第一次正式提出“人工智能”(Artificial Intelligence)这一概念的重要场合。

人工智能是指利用计算机技术来模拟和实现人类智能的研究和应用领域。

与传统的计算机程序不同,人工智能系统可以从大量的数据中学习,具备感知、理解、推理、决策、自主行动等人类智能的基本能力。

二、机器学习(Machine Learning)在达特茅斯会议上,机器学习(Machine Learning)的概念也首次被提出。

机器学习是人工智能领域的一个重要分支,主要研究如何使计算机系统在无需明确编程的情况下自动学习和改进。

通过机器学习,计算机可以从数据中提取模式和规律,并利用这些知识来完成各种任务。

三、专家系统(Expert System)会议上还提出了专家系统(Expert System)的概念。

专家系统是一种基于知识库和推理机制的计算机程序,通过模拟人类专家的决策过程和知识判断能力,来解决特定的专业领域问题。

专家系统的出现为各个领域的决策和问题解决提供了新的途径。

四、自然语言处理(Natural Language Processing)自然语言处理(Natural Language Processing)也是达特茅斯会议上被提出的一个重要概念。

自然语言处理是人工智能领域涉及语言和计算机交互的一个子领域,研究如何使计算机能够理解、分析和处理人类自然语言。

该技术使得人与计算机之间的交流更加自然和高效。

人工智能知识点概述人工智能(Artificial Intelligence,简称AI)是计算机科学的一个分支,致力于使计算机可以模拟和模仿人类智能的思维和行为。

它通过使用算法和大量的数据,使计算机具备自主学习、推理、识别图像和语音、自然语言处理等能力。

在现代社会中,人工智能已经广泛应用于各个领域,对我们的生活产生了深远的影响。

人工智能领域涵盖了多个重要的知识点。

本文将对人工智能的核心概念、常见算法和应用领域进行概述,帮助读者初步了解人工智能的基本知识。

一、核心概念1. 机器学习(Machine Learning):机器学习是人工智能的核心技术之一,它通过训练模型,使计算机能够从数据中学习并自动改进性能。

机器学习分为监督学习、无监督学习和强化学习等多个子领域,常用算法包括决策树、支持向量机和神经网络等。

2. 深度学习(Deep Learning):深度学习是机器学习的一个分支,模拟人类神经网络的工作方式,通过多层次的神经网络结构进行模式识别和特征提取。

深度学习在图像识别、语音识别和自然语言处理等领域取得了显著成果。

3. 自然语言处理(Natural Language Processing,简称NLP):自然语言处理是研究计算机如何理解和处理人类自然语言的技术。

它包括语音识别、文本理解、机器翻译等任务,被广泛应用于智能助理、智能客服和机器翻译等场景。

4. 计算机视觉(Computer Vision):计算机视觉致力于使计算机能够理解和解释图像和视频。

它包括目标检测、图像分类、人脸识别等任务,广泛应用于智能监控、自动驾驶和医学图像分析等领域。

二、常见算法1. 决策树(Decision Tree):决策树是一种基于树状结构的分类器,通过一系列的判断条件对数据进行分类。

它简单易懂,可解释性强,常用于数据挖掘和模式识别任务。

2. 支持向量机(Support Vector Machine,简称SVM):支持向量机是一种二分类模型,通过在特征空间中找到一个最优的超平面来实现分类。

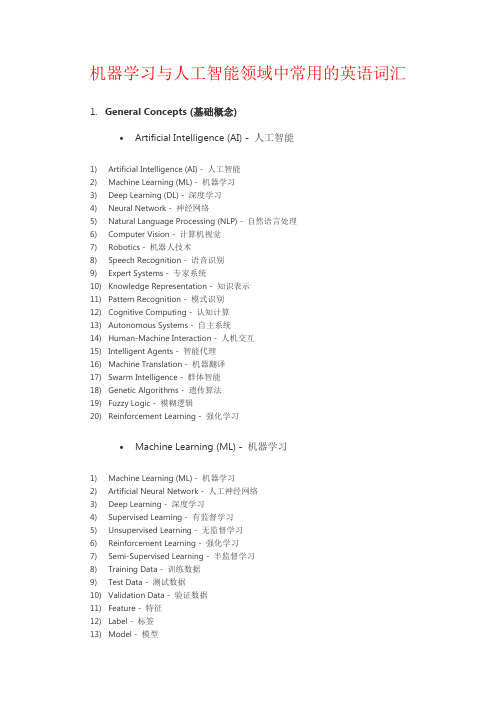

机器学习与人工智能领域中常用的英语词汇1.General Concepts (基础概念)•Artificial Intelligence (AI) - 人工智能1)Artificial Intelligence (AI) - 人工智能2)Machine Learning (ML) - 机器学习3)Deep Learning (DL) - 深度学习4)Neural Network - 神经网络5)Natural Language Processing (NLP) - 自然语言处理6)Computer Vision - 计算机视觉7)Robotics - 机器人技术8)Speech Recognition - 语音识别9)Expert Systems - 专家系统10)Knowledge Representation - 知识表示11)Pattern Recognition - 模式识别12)Cognitive Computing - 认知计算13)Autonomous Systems - 自主系统14)Human-Machine Interaction - 人机交互15)Intelligent Agents - 智能代理16)Machine Translation - 机器翻译17)Swarm Intelligence - 群体智能18)Genetic Algorithms - 遗传算法19)Fuzzy Logic - 模糊逻辑20)Reinforcement Learning - 强化学习•Machine Learning (ML) - 机器学习1)Machine Learning (ML) - 机器学习2)Artificial Neural Network - 人工神经网络3)Deep Learning - 深度学习4)Supervised Learning - 有监督学习5)Unsupervised Learning - 无监督学习6)Reinforcement Learning - 强化学习7)Semi-Supervised Learning - 半监督学习8)Training Data - 训练数据9)Test Data - 测试数据10)Validation Data - 验证数据11)Feature - 特征12)Label - 标签13)Model - 模型14)Algorithm - 算法15)Regression - 回归16)Classification - 分类17)Clustering - 聚类18)Dimensionality Reduction - 降维19)Overfitting - 过拟合20)Underfitting - 欠拟合•Deep Learning (DL) - 深度学习1)Deep Learning - 深度学习2)Neural Network - 神经网络3)Artificial Neural Network (ANN) - 人工神经网络4)Convolutional Neural Network (CNN) - 卷积神经网络5)Recurrent Neural Network (RNN) - 循环神经网络6)Long Short-Term Memory (LSTM) - 长短期记忆网络7)Gated Recurrent Unit (GRU) - 门控循环单元8)Autoencoder - 自编码器9)Generative Adversarial Network (GAN) - 生成对抗网络10)Transfer Learning - 迁移学习11)Pre-trained Model - 预训练模型12)Fine-tuning - 微调13)Feature Extraction - 特征提取14)Activation Function - 激活函数15)Loss Function - 损失函数16)Gradient Descent - 梯度下降17)Backpropagation - 反向传播18)Epoch - 训练周期19)Batch Size - 批量大小20)Dropout - 丢弃法•Neural Network - 神经网络1)Neural Network - 神经网络2)Artificial Neural Network (ANN) - 人工神经网络3)Deep Neural Network (DNN) - 深度神经网络4)Convolutional Neural Network (CNN) - 卷积神经网络5)Recurrent Neural Network (RNN) - 循环神经网络6)Long Short-Term Memory (LSTM) - 长短期记忆网络7)Gated Recurrent Unit (GRU) - 门控循环单元8)Feedforward Neural Network - 前馈神经网络9)Multi-layer Perceptron (MLP) - 多层感知器10)Radial Basis Function Network (RBFN) - 径向基函数网络11)Hopfield Network - 霍普菲尔德网络12)Boltzmann Machine - 玻尔兹曼机13)Autoencoder - 自编码器14)Spiking Neural Network (SNN) - 脉冲神经网络15)Self-organizing Map (SOM) - 自组织映射16)Restricted Boltzmann Machine (RBM) - 受限玻尔兹曼机17)Hebbian Learning - 海比安学习18)Competitive Learning - 竞争学习19)Neuroevolutionary - 神经进化20)Neuron - 神经元•Algorithm - 算法1)Algorithm - 算法2)Supervised Learning Algorithm - 有监督学习算法3)Unsupervised Learning Algorithm - 无监督学习算法4)Reinforcement Learning Algorithm - 强化学习算法5)Classification Algorithm - 分类算法6)Regression Algorithm - 回归算法7)Clustering Algorithm - 聚类算法8)Dimensionality Reduction Algorithm - 降维算法9)Decision Tree Algorithm - 决策树算法10)Random Forest Algorithm - 随机森林算法11)Support Vector Machine (SVM) Algorithm - 支持向量机算法12)K-Nearest Neighbors (KNN) Algorithm - K近邻算法13)Naive Bayes Algorithm - 朴素贝叶斯算法14)Gradient Descent Algorithm - 梯度下降算法15)Genetic Algorithm - 遗传算法16)Neural Network Algorithm - 神经网络算法17)Deep Learning Algorithm - 深度学习算法18)Ensemble Learning Algorithm - 集成学习算法19)Reinforcement Learning Algorithm - 强化学习算法20)Metaheuristic Algorithm - 元启发式算法•Model - 模型1)Model - 模型2)Machine Learning Model - 机器学习模型3)Artificial Intelligence Model - 人工智能模型4)Predictive Model - 预测模型5)Classification Model - 分类模型6)Regression Model - 回归模型7)Generative Model - 生成模型8)Discriminative Model - 判别模型9)Probabilistic Model - 概率模型10)Statistical Model - 统计模型11)Neural Network Model - 神经网络模型12)Deep Learning Model - 深度学习模型13)Ensemble Model - 集成模型14)Reinforcement Learning Model - 强化学习模型15)Support Vector Machine (SVM) Model - 支持向量机模型16)Decision Tree Model - 决策树模型17)Random Forest Model - 随机森林模型18)Naive Bayes Model - 朴素贝叶斯模型19)Autoencoder Model - 自编码器模型20)Convolutional Neural Network (CNN) Model - 卷积神经网络模型•Dataset - 数据集1)Dataset - 数据集2)Training Dataset - 训练数据集3)Test Dataset - 测试数据集4)Validation Dataset - 验证数据集5)Balanced Dataset - 平衡数据集6)Imbalanced Dataset - 不平衡数据集7)Synthetic Dataset - 合成数据集8)Benchmark Dataset - 基准数据集9)Open Dataset - 开放数据集10)Labeled Dataset - 标记数据集11)Unlabeled Dataset - 未标记数据集12)Semi-Supervised Dataset - 半监督数据集13)Multiclass Dataset - 多分类数据集14)Feature Set - 特征集15)Data Augmentation - 数据增强16)Data Preprocessing - 数据预处理17)Missing Data - 缺失数据18)Outlier Detection - 异常值检测19)Data Imputation - 数据插补20)Metadata - 元数据•Training - 训练1)Training - 训练2)Training Data - 训练数据3)Training Phase - 训练阶段4)Training Set - 训练集5)Training Examples - 训练样本6)Training Instance - 训练实例7)Training Algorithm - 训练算法8)Training Model - 训练模型9)Training Process - 训练过程10)Training Loss - 训练损失11)Training Epoch - 训练周期12)Training Batch - 训练批次13)Online Training - 在线训练14)Offline Training - 离线训练15)Continuous Training - 连续训练16)Transfer Learning - 迁移学习17)Fine-Tuning - 微调18)Curriculum Learning - 课程学习19)Self-Supervised Learning - 自监督学习20)Active Learning - 主动学习•Testing - 测试1)Testing - 测试2)Test Data - 测试数据3)Test Set - 测试集4)Test Examples - 测试样本5)Test Instance - 测试实例6)Test Phase - 测试阶段7)Test Accuracy - 测试准确率8)Test Loss - 测试损失9)Test Error - 测试错误10)Test Metrics - 测试指标11)Test Suite - 测试套件12)Test Case - 测试用例13)Test Coverage - 测试覆盖率14)Cross-Validation - 交叉验证15)Holdout Validation - 留出验证16)K-Fold Cross-Validation - K折交叉验证17)Stratified Cross-Validation - 分层交叉验证18)Test Driven Development (TDD) - 测试驱动开发19)A/B Testing - A/B 测试20)Model Evaluation - 模型评估•Validation - 验证1)Validation - 验证2)Validation Data - 验证数据3)Validation Set - 验证集4)Validation Examples - 验证样本5)Validation Instance - 验证实例6)Validation Phase - 验证阶段7)Validation Accuracy - 验证准确率8)Validation Loss - 验证损失9)Validation Error - 验证错误10)Validation Metrics - 验证指标11)Cross-Validation - 交叉验证12)Holdout Validation - 留出验证13)K-Fold Cross-Validation - K折交叉验证14)Stratified Cross-Validation - 分层交叉验证15)Leave-One-Out Cross-Validation - 留一法交叉验证16)Validation Curve - 验证曲线17)Hyperparameter Validation - 超参数验证18)Model Validation - 模型验证19)Early Stopping - 提前停止20)Validation Strategy - 验证策略•Supervised Learning - 有监督学习1)Supervised Learning - 有监督学习2)Label - 标签3)Feature - 特征4)Target - 目标5)Training Labels - 训练标签6)Training Features - 训练特征7)Training Targets - 训练目标8)Training Examples - 训练样本9)Training Instance - 训练实例10)Regression - 回归11)Classification - 分类12)Predictor - 预测器13)Regression Model - 回归模型14)Classifier - 分类器15)Decision Tree - 决策树16)Support Vector Machine (SVM) - 支持向量机17)Neural Network - 神经网络18)Feature Engineering - 特征工程19)Model Evaluation - 模型评估20)Overfitting - 过拟合21)Underfitting - 欠拟合22)Bias-Variance Tradeoff - 偏差-方差权衡•Unsupervised Learning - 无监督学习1)Unsupervised Learning - 无监督学习2)Clustering - 聚类3)Dimensionality Reduction - 降维4)Anomaly Detection - 异常检测5)Association Rule Learning - 关联规则学习6)Feature Extraction - 特征提取7)Feature Selection - 特征选择8)K-Means - K均值9)Hierarchical Clustering - 层次聚类10)Density-Based Clustering - 基于密度的聚类11)Principal Component Analysis (PCA) - 主成分分析12)Independent Component Analysis (ICA) - 独立成分分析13)T-distributed Stochastic Neighbor Embedding (t-SNE) - t分布随机邻居嵌入14)Gaussian Mixture Model (GMM) - 高斯混合模型15)Self-Organizing Maps (SOM) - 自组织映射16)Autoencoder - 自动编码器17)Latent Variable - 潜变量18)Data Preprocessing - 数据预处理19)Outlier Detection - 异常值检测20)Clustering Algorithm - 聚类算法•Reinforcement Learning - 强化学习1)Reinforcement Learning - 强化学习2)Agent - 代理3)Environment - 环境4)State - 状态5)Action - 动作6)Reward - 奖励7)Policy - 策略8)Value Function - 值函数9)Q-Learning - Q学习10)Deep Q-Network (DQN) - 深度Q网络11)Policy Gradient - 策略梯度12)Actor-Critic - 演员-评论家13)Exploration - 探索14)Exploitation - 开发15)Temporal Difference (TD) - 时间差分16)Markov Decision Process (MDP) - 马尔可夫决策过程17)State-Action-Reward-State-Action (SARSA) - 状态-动作-奖励-状态-动作18)Policy Iteration - 策略迭代19)Value Iteration - 值迭代20)Monte Carlo Methods - 蒙特卡洛方法•Semi-Supervised Learning - 半监督学习1)Semi-Supervised Learning - 半监督学习2)Labeled Data - 有标签数据3)Unlabeled Data - 无标签数据4)Label Propagation - 标签传播5)Self-Training - 自训练6)Co-Training - 协同训练7)Transudative Learning - 传导学习8)Inductive Learning - 归纳学习9)Manifold Regularization - 流形正则化10)Graph-based Methods - 基于图的方法11)Cluster Assumption - 聚类假设12)Low-Density Separation - 低密度分离13)Semi-Supervised Support Vector Machines (S3VM) - 半监督支持向量机14)Expectation-Maximization (EM) - 期望最大化15)Co-EM - 协同期望最大化16)Entropy-Regularized EM - 熵正则化EM17)Mean Teacher - 平均教师18)Virtual Adversarial Training - 虚拟对抗训练19)Tri-training - 三重训练20)Mix Match - 混合匹配•Feature - 特征1)Feature - 特征2)Feature Engineering - 特征工程3)Feature Extraction - 特征提取4)Feature Selection - 特征选择5)Input Features - 输入特征6)Output Features - 输出特征7)Feature Vector - 特征向量8)Feature Space - 特征空间9)Feature Representation - 特征表示10)Feature Transformation - 特征转换11)Feature Importance - 特征重要性12)Feature Scaling - 特征缩放13)Feature Normalization - 特征归一化14)Feature Encoding - 特征编码15)Feature Fusion - 特征融合16)Feature Dimensionality Reduction - 特征维度减少17)Continuous Feature - 连续特征18)Categorical Feature - 分类特征19)Nominal Feature - 名义特征20)Ordinal Feature - 有序特征•Label - 标签1)Label - 标签2)Labeling - 标注3)Ground Truth - 地面真值4)Class Label - 类别标签5)Target Variable - 目标变量6)Labeling Scheme - 标注方案7)Multi-class Labeling - 多类别标注8)Binary Labeling - 二分类标注9)Label Noise - 标签噪声10)Labeling Error - 标注错误11)Label Propagation - 标签传播12)Unlabeled Data - 无标签数据13)Labeled Data - 有标签数据14)Semi-supervised Learning - 半监督学习15)Active Learning - 主动学习16)Weakly Supervised Learning - 弱监督学习17)Noisy Label Learning - 噪声标签学习18)Self-training - 自训练19)Crowdsourcing Labeling - 众包标注20)Label Smoothing - 标签平滑化•Prediction - 预测1)Prediction - 预测2)Forecasting - 预测3)Regression - 回归4)Classification - 分类5)Time Series Prediction - 时间序列预测6)Forecast Accuracy - 预测准确性7)Predictive Modeling - 预测建模8)Predictive Analytics - 预测分析9)Forecasting Method - 预测方法10)Predictive Performance - 预测性能11)Predictive Power - 预测能力12)Prediction Error - 预测误差13)Prediction Interval - 预测区间14)Prediction Model - 预测模型15)Predictive Uncertainty - 预测不确定性16)Forecast Horizon - 预测时间跨度17)Predictive Maintenance - 预测性维护18)Predictive Policing - 预测式警务19)Predictive Healthcare - 预测性医疗20)Predictive Maintenance - 预测性维护•Classification - 分类1)Classification - 分类2)Classifier - 分类器3)Class - 类别4)Classify - 对数据进行分类5)Class Label - 类别标签6)Binary Classification - 二元分类7)Multiclass Classification - 多类分类8)Class Probability - 类别概率9)Decision Boundary - 决策边界10)Decision Tree - 决策树11)Support Vector Machine (SVM) - 支持向量机12)K-Nearest Neighbors (KNN) - K最近邻算法13)Naive Bayes - 朴素贝叶斯14)Logistic Regression - 逻辑回归15)Random Forest - 随机森林16)Neural Network - 神经网络17)SoftMax Function - SoftMax函数18)One-vs-All (One-vs-Rest) - 一对多(一对剩余)19)Ensemble Learning - 集成学习20)Confusion Matrix - 混淆矩阵•Regression - 回归1)Regression Analysis - 回归分析2)Linear Regression - 线性回归3)Multiple Regression - 多元回归4)Polynomial Regression - 多项式回归5)Logistic Regression - 逻辑回归6)Ridge Regression - 岭回归7)Lasso Regression - Lasso回归8)Elastic Net Regression - 弹性网络回归9)Regression Coefficients - 回归系数10)Residuals - 残差11)Ordinary Least Squares (OLS) - 普通最小二乘法12)Ridge Regression Coefficient - 岭回归系数13)Lasso Regression Coefficient - Lasso回归系数14)Elastic Net Regression Coefficient - 弹性网络回归系数15)Regression Line - 回归线16)Prediction Error - 预测误差17)Regression Model - 回归模型18)Nonlinear Regression - 非线性回归19)Generalized Linear Models (GLM) - 广义线性模型20)Coefficient of Determination (R-squared) - 决定系数21)F-test - F检验22)Homoscedasticity - 同方差性23)Heteroscedasticity - 异方差性24)Autocorrelation - 自相关25)Multicollinearity - 多重共线性26)Outliers - 异常值27)Cross-validation - 交叉验证28)Feature Selection - 特征选择29)Feature Engineering - 特征工程30)Regularization - 正则化2.Neural Networks and Deep Learning (神经网络与深度学习)•Convolutional Neural Network (CNN) - 卷积神经网络1)Convolutional Neural Network (CNN) - 卷积神经网络2)Convolution Layer - 卷积层3)Feature Map - 特征图4)Convolution Operation - 卷积操作5)Stride - 步幅6)Padding - 填充7)Pooling Layer - 池化层8)Max Pooling - 最大池化9)Average Pooling - 平均池化10)Fully Connected Layer - 全连接层11)Activation Function - 激活函数12)Rectified Linear Unit (ReLU) - 线性修正单元13)Dropout - 随机失活14)Batch Normalization - 批量归一化15)Transfer Learning - 迁移学习16)Fine-Tuning - 微调17)Image Classification - 图像分类18)Object Detection - 物体检测19)Semantic Segmentation - 语义分割20)Instance Segmentation - 实例分割21)Generative Adversarial Network (GAN) - 生成对抗网络22)Image Generation - 图像生成23)Style Transfer - 风格迁移24)Convolutional Autoencoder - 卷积自编码器25)Recurrent Neural Network (RNN) - 循环神经网络•Recurrent Neural Network (RNN) - 循环神经网络1)Recurrent Neural Network (RNN) - 循环神经网络2)Long Short-Term Memory (LSTM) - 长短期记忆网络3)Gated Recurrent Unit (GRU) - 门控循环单元4)Sequence Modeling - 序列建模5)Time Series Prediction - 时间序列预测6)Natural Language Processing (NLP) - 自然语言处理7)Text Generation - 文本生成8)Sentiment Analysis - 情感分析9)Named Entity Recognition (NER) - 命名实体识别10)Part-of-Speech Tagging (POS Tagging) - 词性标注11)Sequence-to-Sequence (Seq2Seq) - 序列到序列12)Attention Mechanism - 注意力机制13)Encoder-Decoder Architecture - 编码器-解码器架构14)Bidirectional RNN - 双向循环神经网络15)Teacher Forcing - 强制教师法16)Backpropagation Through Time (BPTT) - 通过时间的反向传播17)Vanishing Gradient Problem - 梯度消失问题18)Exploding Gradient Problem - 梯度爆炸问题19)Language Modeling - 语言建模20)Speech Recognition - 语音识别•Long Short-Term Memory (LSTM) - 长短期记忆网络1)Long Short-Term Memory (LSTM) - 长短期记忆网络2)Cell State - 细胞状态3)Hidden State - 隐藏状态4)Forget Gate - 遗忘门5)Input Gate - 输入门6)Output Gate - 输出门7)Peephole Connections - 窥视孔连接8)Gated Recurrent Unit (GRU) - 门控循环单元9)Vanishing Gradient Problem - 梯度消失问题10)Exploding Gradient Problem - 梯度爆炸问题11)Sequence Modeling - 序列建模12)Time Series Prediction - 时间序列预测13)Natural Language Processing (NLP) - 自然语言处理14)Text Generation - 文本生成15)Sentiment Analysis - 情感分析16)Named Entity Recognition (NER) - 命名实体识别17)Part-of-Speech Tagging (POS Tagging) - 词性标注18)Attention Mechanism - 注意力机制19)Encoder-Decoder Architecture - 编码器-解码器架构20)Bidirectional LSTM - 双向长短期记忆网络•Attention Mechanism - 注意力机制1)Attention Mechanism - 注意力机制2)Self-Attention - 自注意力3)Multi-Head Attention - 多头注意力4)Transformer - 变换器5)Query - 查询6)Key - 键7)Value - 值8)Query-Value Attention - 查询-值注意力9)Dot-Product Attention - 点积注意力10)Scaled Dot-Product Attention - 缩放点积注意力11)Additive Attention - 加性注意力12)Context Vector - 上下文向量13)Attention Score - 注意力分数14)SoftMax Function - SoftMax函数15)Attention Weight - 注意力权重16)Global Attention - 全局注意力17)Local Attention - 局部注意力18)Positional Encoding - 位置编码19)Encoder-Decoder Attention - 编码器-解码器注意力20)Cross-Modal Attention - 跨模态注意力•Generative Adversarial Network (GAN) - 生成对抗网络1)Generative Adversarial Network (GAN) - 生成对抗网络2)Generator - 生成器3)Discriminator - 判别器4)Adversarial Training - 对抗训练5)Minimax Game - 极小极大博弈6)Nash Equilibrium - 纳什均衡7)Mode Collapse - 模式崩溃8)Training Stability - 训练稳定性9)Loss Function - 损失函数10)Discriminative Loss - 判别损失11)Generative Loss - 生成损失12)Wasserstein GAN (WGAN) - Wasserstein GAN(WGAN)13)Deep Convolutional GAN (DCGAN) - 深度卷积生成对抗网络(DCGAN)14)Conditional GAN (c GAN) - 条件生成对抗网络(c GAN)15)Style GAN - 风格生成对抗网络16)Cycle GAN - 循环生成对抗网络17)Progressive Growing GAN (PGGAN) - 渐进式增长生成对抗网络(PGGAN)18)Self-Attention GAN (SAGAN) - 自注意力生成对抗网络(SAGAN)19)Big GAN - 大规模生成对抗网络20)Adversarial Examples - 对抗样本•Encoder-Decoder - 编码器-解码器1)Encoder-Decoder Architecture - 编码器-解码器架构2)Encoder - 编码器3)Decoder - 解码器4)Sequence-to-Sequence Model (Seq2Seq) - 序列到序列模型5)State Vector - 状态向量6)Context Vector - 上下文向量7)Hidden State - 隐藏状态8)Attention Mechanism - 注意力机制9)Teacher Forcing - 强制教师法10)Beam Search - 束搜索11)Recurrent Neural Network (RNN) - 循环神经网络12)Long Short-Term Memory (LSTM) - 长短期记忆网络13)Gated Recurrent Unit (GRU) - 门控循环单元14)Bidirectional Encoder - 双向编码器15)Greedy Decoding - 贪婪解码16)Masking - 遮盖17)Dropout - 随机失活18)Embedding Layer - 嵌入层19)Cross-Entropy Loss - 交叉熵损失20)Tokenization - 令牌化•Transfer Learning - 迁移学习1)Transfer Learning - 迁移学习2)Source Domain - 源领域3)Target Domain - 目标领域4)Fine-Tuning - 微调5)Domain Adaptation - 领域自适应6)Pre-Trained Model - 预训练模型7)Feature Extraction - 特征提取8)Knowledge Transfer - 知识迁移9)Unsupervised Domain Adaptation - 无监督领域自适应10)Semi-Supervised Domain Adaptation - 半监督领域自适应11)Multi-Task Learning - 多任务学习12)Data Augmentation - 数据增强13)Task Transfer - 任务迁移14)Model Agnostic Meta-Learning (MAML) - 与模型无关的元学习(MAML)15)One-Shot Learning - 单样本学习16)Zero-Shot Learning - 零样本学习17)Few-Shot Learning - 少样本学习18)Knowledge Distillation - 知识蒸馏19)Representation Learning - 表征学习20)Adversarial Transfer Learning - 对抗迁移学习•Pre-trained Models - 预训练模型1)Pre-trained Model - 预训练模型2)Transfer Learning - 迁移学习3)Fine-Tuning - 微调4)Knowledge Transfer - 知识迁移5)Domain Adaptation - 领域自适应6)Feature Extraction - 特征提取7)Representation Learning - 表征学习8)Language Model - 语言模型9)Bidirectional Encoder Representations from Transformers (BERT) - 双向编码器结构转换器10)Generative Pre-trained Transformer (GPT) - 生成式预训练转换器11)Transformer-based Models - 基于转换器的模型12)Masked Language Model (MLM) - 掩蔽语言模型13)Cloze Task - 填空任务14)Tokenization - 令牌化15)Word Embeddings - 词嵌入16)Sentence Embeddings - 句子嵌入17)Contextual Embeddings - 上下文嵌入18)Self-Supervised Learning - 自监督学习19)Large-Scale Pre-trained Models - 大规模预训练模型•Loss Function - 损失函数1)Loss Function - 损失函数2)Mean Squared Error (MSE) - 均方误差3)Mean Absolute Error (MAE) - 平均绝对误差4)Cross-Entropy Loss - 交叉熵损失5)Binary Cross-Entropy Loss - 二元交叉熵损失6)Categorical Cross-Entropy Loss - 分类交叉熵损失7)Hinge Loss - 合页损失8)Huber Loss - Huber损失9)Wasserstein Distance - Wasserstein距离10)Triplet Loss - 三元组损失11)Contrastive Loss - 对比损失12)Dice Loss - Dice损失13)Focal Loss - 焦点损失14)GAN Loss - GAN损失15)Adversarial Loss - 对抗损失16)L1 Loss - L1损失17)L2 Loss - L2损失18)Huber Loss - Huber损失19)Quantile Loss - 分位数损失•Activation Function - 激活函数1)Activation Function - 激活函数2)Sigmoid Function - Sigmoid函数3)Hyperbolic Tangent Function (Tanh) - 双曲正切函数4)Rectified Linear Unit (Re LU) - 矩形线性单元5)Parametric Re LU (P Re LU) - 参数化Re LU6)Exponential Linear Unit (ELU) - 指数线性单元7)Swish Function - Swish函数8)Softplus Function - Soft plus函数9)Softmax Function - SoftMax函数10)Hard Tanh Function - 硬双曲正切函数11)Softsign Function - Softsign函数12)GELU (Gaussian Error Linear Unit) - GELU(高斯误差线性单元)13)Mish Function - Mish函数14)CELU (Continuous Exponential Linear Unit) - CELU(连续指数线性单元)15)Bent Identity Function - 弯曲恒等函数16)Gaussian Error Linear Units (GELUs) - 高斯误差线性单元17)Adaptive Piecewise Linear (APL) - 自适应分段线性函数18)Radial Basis Function (RBF) - 径向基函数•Backpropagation - 反向传播1)Backpropagation - 反向传播2)Gradient Descent - 梯度下降3)Partial Derivative - 偏导数4)Chain Rule - 链式法则5)Forward Pass - 前向传播6)Backward Pass - 反向传播7)Computational Graph - 计算图8)Neural Network - 神经网络9)Loss Function - 损失函数10)Gradient Calculation - 梯度计算11)Weight Update - 权重更新12)Activation Function - 激活函数13)Optimizer - 优化器14)Learning Rate - 学习率15)Mini-Batch Gradient Descent - 小批量梯度下降16)Stochastic Gradient Descent (SGD) - 随机梯度下降17)Batch Gradient Descent - 批量梯度下降18)Momentum - 动量19)Adam Optimizer - Adam优化器20)Learning Rate Decay - 学习率衰减•Gradient Descent - 梯度下降1)Gradient Descent - 梯度下降2)Stochastic Gradient Descent (SGD) - 随机梯度下降3)Mini-Batch Gradient Descent - 小批量梯度下降4)Batch Gradient Descent - 批量梯度下降5)Learning Rate - 学习率6)Momentum - 动量7)Adaptive Moment Estimation (Adam) - 自适应矩估计8)RMSprop - 均方根传播9)Learning Rate Schedule - 学习率调度10)Convergence - 收敛11)Divergence - 发散12)Adagrad - 自适应学习速率方法13)Adadelta - 自适应增量学习率方法14)Adamax - 自适应矩估计的扩展版本15)Nadam - Nesterov Accelerated Adaptive Moment Estimation16)Learning Rate Decay - 学习率衰减17)Step Size - 步长18)Conjugate Gradient Descent - 共轭梯度下降19)Line Search - 线搜索20)Newton's Method - 牛顿法•Learning Rate - 学习率1)Learning Rate - 学习率2)Adaptive Learning Rate - 自适应学习率3)Learning Rate Decay - 学习率衰减4)Initial Learning Rate - 初始学习率5)Step Size - 步长6)Momentum - 动量7)Exponential Decay - 指数衰减8)Annealing - 退火9)Cyclical Learning Rate - 循环学习率10)Learning Rate Schedule - 学习率调度11)Warm-up - 预热12)Learning Rate Policy - 学习率策略13)Learning Rate Annealing - 学习率退火14)Cosine Annealing - 余弦退火15)Gradient Clipping - 梯度裁剪16)Adapting Learning Rate - 适应学习率17)Learning Rate Multiplier - 学习率倍增器18)Learning Rate Reduction - 学习率降低19)Learning Rate Update - 学习率更新20)Scheduled Learning Rate - 定期学习率•Batch Size - 批量大小1)Batch Size - 批量大小2)Mini-Batch - 小批量3)Batch Gradient Descent - 批量梯度下降4)Stochastic Gradient Descent (SGD) - 随机梯度下降5)Mini-Batch Gradient Descent - 小批量梯度下降6)Online Learning - 在线学习7)Full-Batch - 全批量8)Data Batch - 数据批次9)Training Batch - 训练批次10)Batch Normalization - 批量归一化11)Batch-wise Optimization - 批量优化12)Batch Processing - 批量处理13)Batch Sampling - 批量采样14)Adaptive Batch Size - 自适应批量大小15)Batch Splitting - 批量分割16)Dynamic Batch Size - 动态批量大小17)Fixed Batch Size - 固定批量大小18)Batch-wise Inference - 批量推理19)Batch-wise Training - 批量训练20)Batch Shuffling - 批量洗牌•Epoch - 训练周期1)Training Epoch - 训练周期2)Epoch Size - 周期大小3)Early Stopping - 提前停止4)Validation Set - 验证集5)Training Set - 训练集6)Test Set - 测试集7)Overfitting - 过拟合8)Underfitting - 欠拟合9)Model Evaluation - 模型评估10)Model Selection - 模型选择11)Hyperparameter Tuning - 超参数调优12)Cross-Validation - 交叉验证13)K-fold Cross-Validation - K折交叉验证14)Stratified Cross-Validation - 分层交叉验证15)Leave-One-Out Cross-Validation (LOOCV) - 留一法交叉验证16)Grid Search - 网格搜索17)Random Search - 随机搜索18)Model Complexity - 模型复杂度19)Learning Curve - 学习曲线20)Convergence - 收敛3.Machine Learning Techniques and Algorithms (机器学习技术与算法)•Decision Tree - 决策树1)Decision Tree - 决策树2)Node - 节点3)Root Node - 根节点4)Leaf Node - 叶节点5)Internal Node - 内部节点6)Splitting Criterion - 分裂准则7)Gini Impurity - 基尼不纯度8)Entropy - 熵9)Information Gain - 信息增益10)Gain Ratio - 增益率11)Pruning - 剪枝12)Recursive Partitioning - 递归分割13)CART (Classification and Regression Trees) - 分类回归树14)ID3 (Iterative Dichotomiser 3) - 迭代二叉树315)C4.5 (successor of ID3) - C4.5(ID3的后继者)16)C5.0 (successor of C4.5) - C5.0(C4.5的后继者)17)Split Point - 分裂点18)Decision Boundary - 决策边界19)Pruned Tree - 剪枝后的树20)Decision Tree Ensemble - 决策树集成•Random Forest - 随机森林1)Random Forest - 随机森林2)Ensemble Learning - 集成学习3)Bootstrap Sampling - 自助采样4)Bagging (Bootstrap Aggregating) - 装袋法5)Out-of-Bag (OOB) Error - 袋外误差6)Feature Subset - 特征子集7)Decision Tree - 决策树8)Base Estimator - 基础估计器9)Tree Depth - 树深度10)Randomization - 随机化11)Majority Voting - 多数投票12)Feature Importance - 特征重要性13)OOB Score - 袋外得分14)Forest Size - 森林大小15)Max Features - 最大特征数16)Min Samples Split - 最小分裂样本数17)Min Samples Leaf - 最小叶节点样本数18)Gini Impurity - 基尼不纯度19)Entropy - 熵20)Variable Importance - 变量重要性•Support Vector Machine (SVM) - 支持向量机1)Support Vector Machine (SVM) - 支持向量机2)Hyperplane - 超平面3)Kernel Trick - 核技巧4)Kernel Function - 核函数5)Margin - 间隔6)Support Vectors - 支持向量7)Decision Boundary - 决策边界8)Maximum Margin Classifier - 最大间隔分类器9)Soft Margin Classifier - 软间隔分类器10) C Parameter - C参数11)Radial Basis Function (RBF) Kernel - 径向基函数核12)Polynomial Kernel - 多项式核13)Linear Kernel - 线性核14)Quadratic Kernel - 二次核15)Gaussian Kernel - 高斯核16)Regularization - 正则化17)Dual Problem - 对偶问题18)Primal Problem - 原始问题19)Kernelized SVM - 核化支持向量机20)Multiclass SVM - 多类支持向量机•K-Nearest Neighbors (KNN) - K-最近邻1)K-Nearest Neighbors (KNN) - K-最近邻2)Nearest Neighbor - 最近邻3)Distance Metric - 距离度量4)Euclidean Distance - 欧氏距离5)Manhattan Distance - 曼哈顿距离6)Minkowski Distance - 闵可夫斯基距离7)Cosine Similarity - 余弦相似度8)K Value - K值9)Majority Voting - 多数投票10)Weighted KNN - 加权KNN11)Radius Neighbors - 半径邻居12)Ball Tree - 球树13)KD Tree - KD树14)Locality-Sensitive Hashing (LSH) - 局部敏感哈希15)Curse of Dimensionality - 维度灾难16)Class Label - 类标签17)Training Set - 训练集18)Test Set - 测试集19)Validation Set - 验证集20)Cross-Validation - 交叉验证•Naive Bayes - 朴素贝叶斯1)Naive Bayes - 朴素贝叶斯2)Bayes' Theorem - 贝叶斯定理3)Prior Probability - 先验概率4)Posterior Probability - 后验概率5)Likelihood - 似然6)Class Conditional Probability - 类条件概率7)Feature Independence Assumption - 特征独立假设8)Multinomial Naive Bayes - 多项式朴素贝叶斯9)Gaussian Naive Bayes - 高斯朴素贝叶斯10)Bernoulli Naive Bayes - 伯努利朴素贝叶斯11)Laplace Smoothing - 拉普拉斯平滑12)Add-One Smoothing - 加一平滑13)Maximum A Posteriori (MAP) - 最大后验概率14)Maximum Likelihood Estimation (MLE) - 最大似然估计15)Classification - 分类16)Feature Vectors - 特征向量17)Training Set - 训练集18)Test Set - 测试集19)Class Label - 类标签20)Confusion Matrix - 混淆矩阵•Clustering - 聚类1)Clustering - 聚类2)Centroid - 质心3)Cluster Analysis - 聚类分析4)Partitioning Clustering - 划分式聚类5)Hierarchical Clustering - 层次聚类6)Density-Based Clustering - 基于密度的聚类7)K-Means Clustering - K均值聚类8)K-Medoids Clustering - K中心点聚类9)DBSCAN (Density-Based Spatial Clustering of Applications with Noise) - 基于密度的空间聚类算法10)Agglomerative Clustering - 聚合式聚类11)Dendrogram - 系统树图12)Silhouette Score - 轮廓系数13)Elbow Method - 肘部法则14)Clustering Validation - 聚类验证15)Intra-cluster Distance - 类内距离16)Inter-cluster Distance - 类间距离17)Cluster Cohesion - 类内连贯性18)Cluster Separation - 类间分离度19)Cluster Assignment - 聚类分配20)Cluster Label - 聚类标签•K-Means - K-均值1)K-Means - K-均值2)Centroid - 质心3)Cluster - 聚类4)Cluster Center - 聚类中心5)Cluster Assignment - 聚类分配6)Cluster Analysis - 聚类分析7)K Value - K值8)Elbow Method - 肘部法则9)Inertia - 惯性10)Silhouette Score - 轮廓系数11)Convergence - 收敛12)Initialization - 初始化13)Euclidean Distance - 欧氏距离14)Manhattan Distance - 曼哈顿距离15)Distance Metric - 距离度量16)Cluster Radius - 聚类半径17)Within-Cluster Variation - 类内变异18)Cluster Quality - 聚类质量19)Clustering Algorithm - 聚类算法20)Clustering Validation - 聚类验证•Dimensionality Reduction - 降维1)Dimensionality Reduction - 降维2)Feature Extraction - 特征提取3)Feature Selection - 特征选择4)Principal Component Analysis (PCA) - 主成分分析5)Singular Value Decomposition (SVD) - 奇异值分解6)Linear Discriminant Analysis (LDA) - 线性判别分析7)t-Distributed Stochastic Neighbor Embedding (t-SNE) - t-分布随机邻域嵌入8)Autoencoder - 自编码器9)Manifold Learning - 流形学习10)Locally Linear Embedding (LLE) - 局部线性嵌入11)Isomap - 等度量映射12)Uniform Manifold Approximation and Projection (UMAP) - 均匀流形逼近与投影13)Kernel PCA - 核主成分分析14)Non-negative Matrix Factorization (NMF) - 非负矩阵分解15)Independent Component Analysis (ICA) - 独立成分分析16)Variational Autoencoder (VAE) - 变分自编码器17)Sparse Coding - 稀疏编码18)Random Projection - 随机投影19)Neighborhood Preserving Embedding (NPE) - 保持邻域结构的嵌入20)Curvilinear Component Analysis (CCA) - 曲线成分分析•Principal Component Analysis (PCA) - 主成分分析1)Principal Component Analysis (PCA) - 主成分分析2)Eigenvector - 特征向量3)Eigenvalue - 特征值4)Covariance Matrix - 协方差矩阵。

人工智能的核心知识点人工智能(Artificial Intelligence,简称AI)作为一门前沿的技术和学科,涵盖了广泛的领域和知识点。

本文将着重介绍人工智能的核心知识点,深入探讨其关键概念和应用领域。

一、机器学习(Machine Learning)机器学习是人工智能的核心方法论之一,它通过计算机系统自动学习和改进,从经验数据中提取知识,并基于这些知识进行预测和决策。

机器学习包括监督学习、无监督学习和强化学习等不同类型的学习算法。

监督学习通过输入训练数据和对应的标签,让机器学习预测输出结果,并根据预测结果和实际标签之间的差异来优化模型。

无监督学习则不需要标签,通过自动发现数据集中的模式和结构来进行学习。

强化学习则通过与环境的交互,根据行为的反馈来学习制定最佳的策略。

二、深度学习(Deep Learning)深度学习是机器学习领域的一个重要分支,模拟了人脑神经网络的结构和工作原理,通过多层次的神经网络模型来处理和学习数据。

深度学习在语音识别、图像识别、自然语言处理等领域取得了显著的成果。

其中,卷积神经网络(Convolutional Neural Network,简称CNN)适用于图像和视频处理任务,循环神经网络(Recurrent Neural Network,简称RNN)适用于序列数据和自然语言处理任务。

深度学习的关键技术包括激活函数、损失函数、优化算法等。

三、自然语言处理(Natural Language Processing,简称NLP)自然语言处理是研究计算机如何理解和处理人类语言的技术领域。

NLP主要包括文本分析、文本生成、情感分析和机器翻译等任务。

在自然语言处理中,词嵌入(Word Embedding)是常用的技术,它将文本中的单词映射为高维向量,以便计算机能够理解和处理。

另外,机器翻译也是NLP的重要应用,通过将一种语言的文本翻译为另一种语言,实现跨语言的交流和沟通。

四、计算机视觉(Computer Vision)计算机视觉是研究计算机如何理解和处理图像和视频的技术领域。

人工智能的前沿知识点人工智能(Artificial Intelligence,简称AI)是现今科技领域中备受瞩目的热门话题。

它涉及到计算机科学、机器学习、模式识别等多个学科的交叉,是一门致力于使机器能够像人类一样思考、学习和决策的科学。

本文将介绍人工智能领域的一些前沿知识点,包括机器学习、深度学习、自然语言处理和计算机视觉等。

1. 机器学习(Machine Learning)机器学习是人工智能的核心技术之一,旨在通过让计算机从数据中学习和改进性能,实现自主学习能力。

常见的机器学习算法包括监督学习、无监督学习和强化学习。

监督学习通过给定输入和对应的输出样本进行学习,建立输入到输出的映射关系;无监督学习是从无标签的数据中自动发现隐藏的结构和模式;强化学习则通过试错和奖励机制来培养智能体(Agent)的决策能力。

2. 深度学习(Deep Learning)深度学习是机器学习领域的一个分支,以构建和模拟人脑神经网络为基础,通过多层的神经网络模型进行学习和推理。

深度学习通过神经网络的层次化表示来解决复杂的模式识别和分类问题,其在语音识别、图像处理、自然语言处理等领域取得了显著的突破。

3. 自然语言处理(Natural Language Processing,简称NLP)自然语言处理是AI领域中与人类语言相关的研究,旨在让计算机可以理解、分析和生成自然语言。

NLP技术包括文本分析、语义理解、文本生成等,已广泛应用于机器翻译、智能客服、情感分析等领域。

近年来,深度学习的发展使得NLP技术取得重大突破,如BERT、GPT等语言模型的诞生。

4. 计算机视觉(Computer Vision)计算机视觉是人工智能领域的重要研究方向,旨在通过计算机对图像和视频进行感知和理解。

计算机视觉技术包括图像分类、目标检测、场景理解等,已在人脸识别、无人驾驶、智能监控等领域得到广泛应用。

深度学习的引入使得计算机视觉的性能大幅提升,如卷积神经网络(CNN)在图像分类任务上的成功应用。

如上图,最早出现的人工智能位于同心圆最外侧;其次是随后发展起来的机器学习,位于中间;最后是推动人工智能突飞猛进发展的深度学习,位于最内侧。

成王(King me):国际跳棋的电脑程序是早期人工智能的一个典型应用,在二十世纪五十年代曾掀起一阵风潮。

(译者注:国际跳棋棋子到达底线位置后,可以成王,成王棋子可以向后移动)。

健康食谱(Spam free diet):机器学习能够帮你过滤电子信箱里的(大部分)垃圾邮件。

(译者注:英文中垃圾邮件的单词spam来源于二战中美国曾大量援

放猫(Herding Cats):从YouTube视频里面寻找猫的图片是深度学习杰出性能的首次展现。

(译者注:herdingcats是英语习语,照顾一群喜欢自由,不喜欢驯服的猫,用来形容局面混乱,任务难以完成。

)

人工神经网络(Artificial Neural Networks)是早期机器学习中的一个重要的算法,历经数十年风风雨雨。

神经网络的原理是受我们大脑的生理结构——互。

2022年河南专升本英语考试真题2022 Henan Provincial College Entrance Examination for Adults English ExamPart I. Reading Comprehension (共20小题;每小题1.5分,共30分)Directions: There are four reading passages in this part. Each passage is followed by some questions or unfinished statements. For each of them there are four choices marked A, B, C and D. You should decide on the best choice and mark the corresponding letter on Answer Sheet Two with a single line through the center.Passage One(1) Artificial Intelligence (AI) is the simulation of human intelligence processes by machines, especially computer systems. These processes include learning (the acquisition of information and rules for using the information), reasoning (using rules to reach approximate or definite conclusions), and self-correction.(2) AI applications include expert systems, speech recognition, natural language processing, and machine vision. AI can be categorized as weak or strong. Weak AI, also known as narrow AI, is designed to perform a narrow task without humanhelp. Virtual personal assistants, such as Apple's Siri, are a form of weak AI. Strong AI, also known as artificial general intelligence, is an AI system with generalized human cognitive abilities. When presented with an unfamiliar task, a strong AI system can find a solution without human intervention.(3) There are many tools that support AI, including machine learning, neural networks, and deep learning. Machine learning is a method of data analysis that automates analytical model building. It is a branch of AI based on the idea that systems can learn from data, identify patterns, and make decisions with minimal human intervention.(4) Neural networks are systems with interconnected nodes that work like neurons in the human brain. They are structured in layers, with each layer performing a specific task. Deep learning is a type of machine learning that uses neural networks with many layers, making it possible to process large amounts of data and recognize patterns.1. What is the main idea of the passage?A. The history of artificial intelligence.B. The difference between weak AI and strong AI.C. The tools that support AI.D. The applications of AI.2. What is a virtual personal assistant an example of?A. Weak AIB. Strong AIC. Neural networksD. Deep learning3. Which of the following statements is true according to the passage?A. Machine learning is a type of artificial intelligence.B. Deep learning uses neural networks with few layers.C. Weak AI systems can perform tasks without human help.D. AI systems with generalized human cognitive abilities can't solve unfamiliar tasks.4. According to the passage, what is the purpose of neural networks in AI?A. To simulate human intelligence processes.B. To perform narrow tasks without human help.C. To identify patterns and make decisions.D. To process large amounts of data.Answers:1. D2. A3. C4. CPart II. Vocabulary and Structure (共40小题;每小题1.5分,共60分)Directions: There are 40 incomplete sentences in this part. For each sentence there are four choices marked A, B, C and D. Choose the one that best completes the statement and mark your answer on Answer Sheet Two with a single line through the center.1. Jack is good at mathematics, but his brother is good at ________.A. biologyB. chemistryC. EnglishD. history2. The hotel has a beautiful garden, in which you can enjoy the ________ of flowers.A. sightB. viewC. sceneD. scenery3. My brother drives very fast, but I ________ slowly and carefully.A. driveB. am drivingC. droveD. will drive4. Take an umbrella with you in case it ________ later.A. will rainB. is rainingC. rainsD. would rainAnswers:1. A2. D3. B4. CPart III. Cloze Test (共10小题;每小题1.5分,共15分)Directions: For each blank in the following passage there are four words or phrases marked A, B, C and D. Fill in each blank with the word or phrase that best completes the passage and mark your answer on Answer Sheet Two with a single line through the center.Artificial Intelligence (AI) is the simulation of human intelligence processes by machines, especially computer systems. These processes include learning, reasoning, and self-correction. AI applications include expert systems, speech recognition, natural language processing, and machine vision. AI can be categorized as weak or strong. Weak AI, also known as narrow AI, is designed to perform a narrow task without human help. Virtual personal assistants, such as Apple's Siri, are a form of weak AI. Strong AI, also known as artificial general intelligence, is an AI system with generalized human cognitive abilities. Whenpresented with an unfamiliar task, a strong AI system can find a solution without human intervention.Answers:ABDADCBDACPart IV. Writing (共1题,15分)Directions: For this part, you are allowed 30 minutes to write a short essay entitled “The Impact of Artificial Intelligence on So ciety”. You should write at least 150 words following the outline given below:1. Introduction: Define artificial intelligence and its significance.2. Body: Discuss the positive and negative impacts of AI on society, such as job displacement, improved healthcare, and increased efficiency.3. Conclusion: Offer your perspective on the overall impact of AI on society.Remember to write your essay in an organized and coherent manner.Conclusion:In conclusion, the 2022 Henan Provincial College Entrance Examination for Adults English Exam covers a wide range of topics related to artificial intelligence. From understanding the applications and tools of AI to analyzing its impact on society, this exam provides a comprehensive overview of this rapidly evolving field. As AI continues to reshape industries and transform our daily lives, it is important for individuals to stay informed and engaged with the latest developments in this area. With a strong foundation in English and a deep understanding of AI concepts, candidates can navigate the complexities of this new technological landscape with confidence and proficiency.Overall, the 2022 Henan Provincial College Entrance Examination for Adults English Exam offers valuable insights into the role of artificial intelligence in the modern world and prepares candidates to meet the challenges and opportunities of an AI-driven future. By mastering the skills and knowledge tested in this exam, individuals can position themselves for success in a rapidly changing global economy.。

考研计算机人工智能的重点知识点人工智能(Artificial Intelligence,简称AI)作为当下热门的领域之一,吸引了越来越多的学子投身其中。

对于计算机专业的考研生而言,人工智能更是一个不可忽视的重点知识点。

本文将重点介绍考研计算机人工智能方向的重点内容,帮助考生更好地准备考试。

一、机器学习机器学习(Machine Learning)是人工智能的核心内容之一,它通过让计算机从数据中学习,从而实现智能决策和预测能力。

在考研计算机人工智能的课程中,机器学习占据了相当大的比重。

在机器学习中,常见的算法包括线性回归、逻辑回归、决策树、随机森林、支持向量机、神经网络等。

考生需要熟悉这些算法的原理和应用场景,并了解它们的优缺点及适用范围。

此外,考生还需要了解特征工程、模型评估与选择、过拟合与欠拟合等相关概念。

同时,对于深度学习和神经网络的基本原理以及常见架构(如卷积神经网络、循环神经网络)也需要有一定的了解。

二、自然语言处理自然语言处理(Natural Language Processing,简称NLP)是人工智能的重要应用领域之一,涉及到计算机与人类语言之间的交互和理解。

在考研计算机人工智能的课程中,自然语言处理也是重点内容。

在自然语言处理中,常见的任务包括文本分类、命名实体识别、情感分析、机器翻译等。

考生需要了解这些任务的基本原理和常用算法,如朴素贝叶斯、最大熵模型、条件随机场等。

此外,对于词嵌入、语言模型、注意力机制等相关概念,考生也需要有一定的了解。

熟悉自然语言处理工具包的使用也是必要的,比如NLTK、StanfordNLP、spaCy等。

三、计算机视觉计算机视觉(Computer Vision)是人工智能的重要应用领域之一,涉及到计算机对图像和视频进行理解和处理。

在考研计算机人工智能的课程中,计算机视觉也是重点内容。

在计算机视觉中,常见的任务包括图像分类、目标检测、语义分割、人脸识别等。

人工智能名词解释考研Artificial Intelligence Terminology Explanation for Postgraduate Entrance Examination人工智能(Artificial Intelligence)是计算机科学的一个重要领域,致力于通过模拟和复制人类智能的方式,使计算机能够具备类似于人类的思维和行为能力。

随着科技的不断进步,人工智能已经成为考研中一个重要的知识点。

以下是一些与人工智能有关的重要名词解释。

1. 机器学习(Machine Learning):是人工智能的一个关键领域,旨在通过让计算机从数据中获取知识和经验,从而使其不需要明确编程即可自动进行学习和改进。

机器学习算法主要分为监督学习、无监督学习和强化学习。

2. 深度学习(Deep Learning):是机器学习的一个分支,通过构建和模拟人脑的神经网络,使计算机能够进行更深入、更复杂的学习和分析。

深度学习广泛应用于图像识别、语音识别以及自然语言处理等领域。

3. 自然语言处理(Natural Language Processing):是人工智能的一个重要组成部分,用于使计算机能够理解、分析和处理人类的自然语言。

自然语言处理涉及词法分析、句法分析、语义理解等技术,广泛应用于机器翻译、智能客服等领域。

4. 计算机视觉(Computer Vision):是使计算机能够通过图像和视频来感知和理解世界的能力。

计算机视觉的应用包括图像识别、目标检测和图像生成等领域。

5. 自动驾驶(Autonomous Driving):是人工智能技术在汽车领域的一种应用,通过传感器和算法,使汽车能够自动感知环境、理解路况并自主行驶。

自动驾驶技术涉及机器学习、计算机视觉等多个领域。

6. 人工智能伦理学(Ethics of Artificial Intelligence):是研究人工智能技术对社会和人类的影响以及相应伦理问题的学科。