信息论与编码_第一章

- 格式:ppt

- 大小:2.09 MB

- 文档页数:84

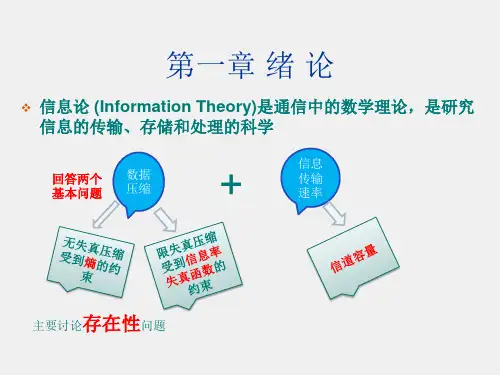

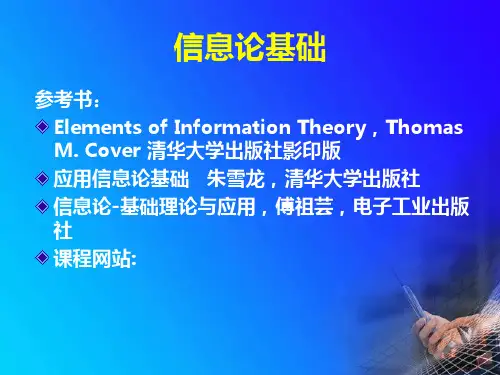

20XX年复习资料大学复习资料专业:班级:科目老师:日期:第1章绪论1.1信息论的形成与发展⏹信息论的发展过程✓20X X X X24年,H N y q u i s t,信息率与带宽联系✓20X X X X28年,R V H a r t l e y,引入非统计信息量✓20X X X X36年,E H A r m s t r o n g,带宽与抗干扰能力✓20X X X X36年,H D u d l e y,发明声码机✓40年代初,N W i e n e r,“控制论”✓20X X X X48年,S h a n n o n,“信息论”“A m a t h e m a t i c a l t h e o r y o fc o m m u n i c a t i o n s”信息时代的里程碑✓50年代开始,I R E成立信息论组,出版信息论汇刊⏹信息论的形成与发展✓20X X X X59年,S h a n n o n,信源压缩编码理论,“C o d i n g t h e o r e m f o r a d i s c r e t e s o u r c e w i t h a f i d e l i t y c r i t e r i o n”✓20X X X X0X X1年,S h a n n o n,“双路通信信道”,多用户理论✓20X X X X0X X2年,C o v e r,广播信道⏹三大定理⏹无失真信源编码定理(第一极限定理)⏹信道编码定理(第二极限定理)⏹限失真信源编定理(第三极限定理)S h a n n o n信息论:在噪声环境下,可靠地、安全地、有效地传送信息理论----狭义信息论⏹信息✓定义广义定义:信息是物质的普遍属性,所谓物质系统的信息是指它所属的物理系统在同一切其他物质系统全面相互作用(或联系)过程中,以质、能和波动的形式所呈现的结构、状态和历史概率信息:信息表征信源的不定度,但它不等同于不定度,而是为了消除一定的不定度必须获得与此不定度相等的信息量⏹信息✓性质信息是无形的信息是可共享的信息是无限的信息是无所不在的信息是可度量的⏹信息✓信息与消息、信号比较消息是信息的数学载体、信号是信息的物理载体信号:具体的、物理的消息:具体的、非物理的 信息:非具体的、非物理的 信息的定义和性质⏹ 信息、消息、信号u 信号最具体,它是一物理量,可测量、可显示、可描述,同时它又是载荷信息的实体 信息的物理层表达u 消息是具体的、非物理的,可描述为语言文字、符号、数据、图片,能够被感觉到,同时它也是信息的载荷体。

信息论与编码第⼀章1、信息,信号,消息的区别信息:是事物运动状态或存在⽅式的不确定性的描述消息是信息的载体,信号是消息的运载⼯具。

2、1948年以“通信的数学理论”(A mathematical theory of communication )为题公开发表,标志着信息论的正式诞⽣。

信息论创始⼈:C.E.Shannon(⾹农)第⼆章1、⾃信息量:⼀个随机事件发⽣某⼀结果后所带来的信息量称为⾃信息量,简称⾃信息。

单位:⽐特(2为底)、奈特、笛特(哈特)2、⾃信息量的性质(1)是⾮负值(2) =1时, =0, =1说明该事件是必然事件。

(3) =0时, = , =0说明该事件是不可能事件。

(4)是的单调递减函数。

3、信源熵:各离散消息⾃信息量的数学期望,即信源的平均信息量。

)(log )(])(1[log )]([)( 212i ni i i i a p a p a p E a I E X H ∑=-===单位:⽐特/符号。

(底数不同,单位不同)信源的信息熵;⾹农熵;⽆条件熵;熵函数;熵。

4、信源熵与信息量的⽐较(书14页例2.2.2)()log () 2.1.3 i i I a p a =-()5、信源熵的意义(含义):(1)信源熵H(X)表⽰信源输出后,离散消息所提供的平均信息量。

(2)信源熵H(X)表⽰信源输出前,信源的平均不确定度。

(3)信源熵H(X)反映了变量X 的随机性。

6、条件熵:(书15页例2.2.3) 7、联合熵:8、信源熵,条件熵,联合熵三者之间的关系:H(XY)= H(X)+H(Y/X) H(XY)= H(Y)+H(X/Y)条件熵⼩于⽆条件熵,H(Y/X)≤H(Y)。

当且仅当y 和x 相互独⽴p(y/x)=p(y),H(Y/X)=H(Y)。

两个条件下的条件熵⼩于⼀个条件下的条件熵H(Z/X,Y)≤H(Z/Y)。

当且仅当p(z/x,y)=p(z/y)时取等号。

联合熵⼩于信源熵之和, H(YX)≤H(Y)+H(X)当两个集合相互独⽴时得联合熵的最⼤值 H(XY)max =H(X)+H(Y) 9、信息熵的基本性质:(1)⾮负性;(2)确定性;(3)对称性;(4)扩展性(5)可加性 ( H(XY) = H(X)+ H(Y) X 和Y 独⽴ H (XY )=H (X )+ H (Y/X )H (XY )=H (Y )+ H (X/Y ) )(6)(重点)极值性(最⼤离散熵定理):信源中包含n 个不同离散消息时,信源熵H(X)有当且仅当X 中各个消息出现的概率全相等时,上式取等号。