神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

动态网络——Hopfield网络

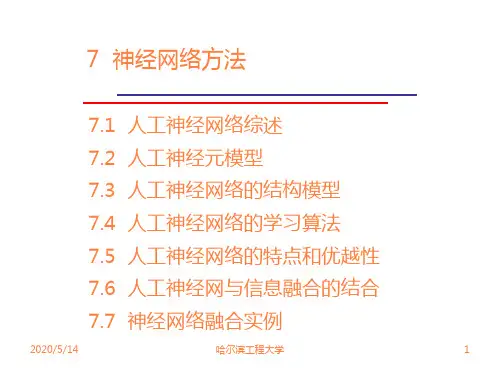

假设按照神经网络运转过程中的信息流向来分类, 那么一切网络都可分为前馈式网络和反响式网络,在前 一章中,主要引见了前馈式网络经过许多具有简单处置 才干的神经元的复协作用使整个网络具有复杂的非线性 映射才干。在那里,着重分析了网络学习算法,研讨的 重点是怎样尽快地得到网络的整体非线性处置才干。在 本章中,我们将集中讨论反响式网络,经过网络神经元 形状的变化而最终稳定于某一形状而得到联想存贮或神 经计算的结果。在这里,主要关怀的是网络稳定性的问 题,研讨的重点是怎样得到和利用稳定的反响式网络。

联想的定义

首先思索x类方式向量集合 (x1, x2, … , xp〕 及y类方式向量集合 (y1, y2, … , yp), 其中 xi=(x1i, x2i,… , xni ) , xi {-1, +1}n yi=(y1i, y2i,… , ymi ) , yi {-1, +1}m

联想的定义

定义3 吸引子的吸引域 对于某些特定的初始形状,网络按 一定的运转规那么最后能够都稳定在同一吸引子v(t)上。称可 以稳定在吸引子v(t)的一切初始形状集合为v(t)的吸引域。

Hopfield网络的联想原理

E= mc2 Newt

Newy

Einstan Newton

Newyear

Hopfield网络的联想原理

f1(x) = f2 (x) = … = fn (x) = sgn (x) 为以后分析方便,我们选各节点门限值相等,且等于0 ,即有 1= 2 = … = n = 0 同时,x = (x1, x2, …, xn ), x {-1, +1}n 为网络的输出, y = (y1, y2, …, yn ), y {-1, +1}n 为网络的输出 v (t) = (v1(t1), v2(t2), …, vn(tn)), v (t) {-1, +1}n 为网络在时辰 t的形状, 其中t (0,1,2,…)为离散时间变量,Wij为从Ni到Nj的衔接 权值, Hopfield网络是对称的,即Wij = Wji ,i, j {1,2, …, n} 。