人工智能第三章遗传算法、蚁群算法、粒子群算法

- 格式:ppt

- 大小:2.28 MB

- 文档页数:174

蚁群算法与粒子群算法优缺点蚁群算法(ACO)是受自然界中蚂蚁搜索食物行为的启发,是一种群智能优化算法。

它基于对自然界真实蚁群的集体觅食行为的研究,模拟真实的蚁群协作过程。

算法由若干个蚂蚁共同构造解路径,通过在解路径上遗留并交换信息素提高解的质量,进而达到优化的目的。

蚁群算法作为通用随机优化方法,已经成功的应用于TSP等一系列组合优化问题中,并取得了较好的结果。

但由于该算法是典型的概率算法,算法中的参数设定通常由实验方法确定,导致方法的优化性能与人的经验密切相关,很难使算法性能最优化。

蚁群算法中每只蚂蚁要选择下一步所要走的地方,在选路过程中,蚂蚁依据概率函数选择将要去的地方,这个概率取决于地点间距离和信息素的强度。

(t+n)=(t)+Δ(t+n)上述方程表示信息素的保留率,1-表示信息素的挥发率,为了防止信息的无限积累,取值范围限定在0~1。

Δij表示蚂蚁k在时间段t到(t+n)的过程中,在i到j的路径上留下的残留信息浓度。

在上述概率方程中,参数α和β:是通过实验确定的。

它们对算法性能同样有很大的影响。

α值的大小表明留在每个节点上信息量受重视的程度,其值越大,蚂蚁选择被选过的地点的可能性越大。

β值的大小表明启发式信息受重视的程度。

这两个参数对蚁群算法性能的影响和作用是相互配合,密切相关的。

但是这两个参数只能依靠经验或重复调试来选择。

在采用蚁群-粒子群混合算法时,我们可以利用PSO对蚁群系统参数α和β的进行训练。

具体训练过程:假设有n个粒子组成一个群落,其中第i个粒子表示为一个二维的向量xi=(xi1,xi2),i=1,2,⋯,n,即第i个粒子在搜索空间的中的位置是xi。

换言之,每个粒子的位置就是一个潜在的解。

将xi带入反馈到蚁群系统并按目标函数就可以计算出其适应值,根据适应值的大小衡量解的优劣。

蚁群算法的优点:蚁群算法与其他启发式算法相比,在求解性能上,具有很强的鲁棒性(对基本蚁群算法模型稍加修改,便可以应用于其他问题)和搜索较好解的能力。

智能仿生算法及其网络优化中的应用研究进展在当今数字化的时代,网络已经成为人们生活和工作中不可或缺的一部分。

随着网络规模的不断扩大和应用需求的日益复杂,如何优化网络性能、提高资源利用率和保障服务质量成为了亟待解决的关键问题。

智能仿生算法作为一种新兴的优化技术,为网络优化领域带来了新的思路和方法,并取得了显著的研究进展。

智能仿生算法是一类受生物系统启发而产生的计算方法,它们模拟了生物的智能行为和进化机制,具有自适应性、自组织性和全局搜索能力等优点。

常见的智能仿生算法包括遗传算法、蚁群算法、粒子群优化算法、模拟退火算法等。

这些算法在解决复杂优化问题方面表现出了强大的能力,逐渐在网络优化领域得到了广泛的应用。

遗传算法是一种基于自然选择和遗传变异原理的优化算法。

在网络优化中,遗传算法可以用于网络拓扑结构的设计、路由选择、资源分配等问题。

例如,在网络拓扑设计中,通过对节点的连接方式进行编码,利用遗传算法的选择、交叉和变异操作,可以搜索到最优的拓扑结构,以降低网络成本、提高网络可靠性。

在路由选择问题中,遗传算法可以根据网络的流量分布和链路状态,找到最优的路由路径,从而减少网络拥塞和延迟。

蚁群算法是受蚂蚁觅食行为启发而产生的一种算法。

蚂蚁在寻找食物的过程中,会通过释放信息素来引导其他蚂蚁的行动,从而形成最优的路径。

在网络优化中,蚁群算法可以应用于路由优化、任务调度等方面。

例如,在路由优化中,将网络中的节点和链路看作蚂蚁行走的路径,通过蚂蚁在路径上释放和感知信息素,可以找到最优的路由路径。

在任务调度问题中,蚁群算法可以根据任务的优先级和资源需求,合理分配计算资源,提高系统的性能。

粒子群优化算法是一种基于鸟群觅食行为的优化算法。

粒子在搜索空间中根据自身的经验和群体的最优位置来调整自己的速度和位置,从而实现全局最优解的搜索。

在网络优化中,粒子群优化算法可以用于网络参数的调整、带宽分配等问题。

例如,在网络参数调整中,通过将网络参数作为粒子的位置,利用粒子群优化算法的更新机制,可以找到最优的参数配置,以提高网络的性能。

人工智能优化算法引言人工智能(Artificial Intelligence,简称AI)已经取得了许多令人瞩目的进展,而优化算法作为AI领域的一个重要分支,在解决实际问题上发挥着重要作用。

本文将重点介绍人工智能优化算法的概念、分类以及在实际应用中的一些典型算法。

优化算法的概念优化算法是一类通过计算机模拟和人工智能方法,寻找目标函数的最优解或次优解的算法。

优化算法的目标是在给定的约束条件下,通过不断调整输入参数来寻找最佳参数组合,以实现最优或近似最优的解决方案。

优化算法的分类根据使用的优化策略和方法,优化算法可以分为多种类型。

以下是一些常见的优化算法分类:梯度下降法梯度下降法是一种常用的数值优化方法,通过计算目标函数的梯度来寻找最小化的方向,并在每一步沿着负梯度方向更新参数。

梯度下降法适用于连续可微、凸函数的优化问题。

遗传算法遗传算法是基于生物进化原理的一种优化算法。

通过模拟基因的交叉、变异和选择过程,遗传算法能够在解空间中搜索最优解。

遗传算法适用于解空间复杂、非线性的优化问题。

粒子群优化算法粒子群优化算法是通过模拟鸟群或鱼群的行为来进行优化的一种群体智能算法。

每个个体代表问题解空间中的一个候选解,通过学习和交流来不断调整自身位置,并寻找最优解。

粒子群优化算法适用于连续优化问题。

蚁群算法蚁群算法是模拟蚂蚁觅食行为而提出的一种算法。

通过模拟蚁群中蚂蚁释放信息素的行为,蚁群算法能够找到问题解空间中的优化路径。

蚁群算法适用于离散优化问题。

典型的人工智能优化算法深度学习深度学习是一种基于神经网络的机器学习方法,通过模拟人脑的神经网络结构来实现对大规模数据的分析和学习。

深度学习在计算机视觉、自然语言处理等领域中取得了许多重大突破。

模拟退火算法模拟退火算法是一种基于物理退火原理的优化算法。

通过模拟金属的退火过程,模拟退火算法可以在解空间中搜索全局最优解。

模拟退火算法适用于连续和离散的优化问题。

粒子群优化算法粒子群优化算法是一种通过模拟粒子群的行为寻找最优解的算法。

遗传算法,粒子群算法和蚁群算法的异同点

遗传算法、粒子群算法和蚁群算法是三种不同的优化算法,它们的异同点如下:

1. 原理不同:

遗传算法是一种模拟自然进化过程的优化算法,主要利用遗传和交叉等运算来产生下一代候选解,通过适应度函数来评价每个候选解的好坏,最终选出最优解。

粒子群算法基于对群体智能的理解和研究,模拟了鸟群或鱼群等动物群体的行为,将每个解看作一个粒子,粒子通过跟踪历史最佳解的方式来更新自己的位置与速度,直到达到最佳解。

蚁群算法是基于模拟蚂蚁在食物和家之间寻找最短路径的行为,将每个解看作一只蚂蚁,通过随机选择路径并留下信息素来搜索最优解。

2. 适用场景不同:

遗传算法适用于具有较大搜索空间、多个可行解且无法枚举的问题,如旅行商问题、无序机器调度问题等。

粒子群算法适用于具有连续参数、寻求全局最优解的问题,如函数优化、神经网络训练等。

蚁群算法适用于具有连续、离散或混合型参数的优化问题,如

路径规划、图像分割等。

3. 参数设置不同:

遗传算法的参数包括个体数、交叉概率、变异概率等。

粒子群算法的参数包括粒子数、权重因子、学习因子等。

蚁群算法的参数包括蚂蚁数量、信息素挥发率、信息素初始值等。

4. 收敛速度不同:

遗传算法需要较多的迭代次数才能得到较优解,但一旦找到最优解,一般能够较好地保持其稳定性,不太容易陷入局部最优。

粒子群算法的收敛速度较快,但对参数设置较为敏感,可能会陷入局部最优。

蚁群算法的收敛速度中等,能够较好地避免局部最优,但也容易出现算法早熟和陷入局部最优的情况。

人工智能的优化算法技术引言:当前人工智能技术正在飞速发展,深度学习和神经网络等技术的发展推动了人工智能在各个领域的应用。

然而,随着模型和数据的规模不断扩大,人工智能的算法优化成为了一个十分重要的问题。

本文将介绍一些常用的人工智能优化算法技术,包括遗传算法、粒子群算法、模拟退火算法、蚁群算法以及混合进化算法等。

一、遗传算法遗传算法是一种受到进化生物学启发的优化算法。

它通过模拟基因间的遗传机制来搜索最优解。

遗传算法的基本流程包括初始化种群、选择、交叉、变异和适应度评估等步骤。

种群中的个体通过选择、交叉和变异等操作,不断进化和优化,以适应输入数据和优化目标。

优点:1. 遗传算法在搜索空间大、多样性高的问题上具有较好的效果。

2. 遗传算法能够找到全局最优解,不容易陷入局部最优解。

3. 遗传算法相对简单易懂,易于实现和调整。

缺点:1. 遗传算法的效率相对较低,需要大量的计算资源和时间。

2. 遗传算法对问题的建模和问题域的知识要求较高,需要手动选择和设计适应度函数等。

二、粒子群算法粒子群算法是一种受到鸟群觅食行为启发的优化算法。

粒子群算法模拟了鸟群中鸟群成员通过信息传递不断寻找更好食物位置的过程。

在粒子群算法中,个体通过不断更新速度和位置,以找到最优解。

优点:1. 粒子群算法具有一定的全局搜索能力,能够在搜索空间中快速找到潜在的解。

2. 粒子群算法的收敛速度相对较快,能够加快优化过程。

3. 粒子群算法易于实现和调整。

缺点:1. 粒子群算法容易陷入局部最优解,全局搜索能力有限。

2. 粒子群算法对问题的建模和参数设置较为敏感,需要经验调整算法参数以达到最佳效果。

三、模拟退火算法模拟退火算法是一种受到固体物质退火原理启发的优化算法。

模拟退火算法模拟了固体物质在退火过程中逐渐减少温度,从而达到更低能量状态的过程。

在模拟退火算法中,个体通过接受差解以一定概率跳出局部最优解,并在搜索空间中发现更优解。

优点:1. 模拟退火算法具有一定的全局搜索能力,能够在搜索空间中寻找潜在的解。

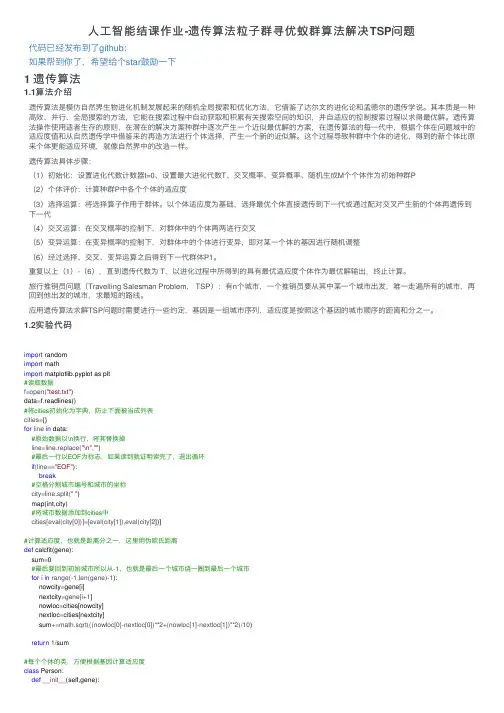

⼈⼯智能结课作业-遗传算法粒⼦群寻优蚁群算法解决TSP问题代码已经发布到了github:如果帮到你了,希望给个star⿎励⼀下1 遗传算法1.1算法介绍遗传算法是模仿⾃然界⽣物进化机制发展起来的随机全局搜索和优化⽅法,它借鉴了达尔⽂的进化论和孟德尔的遗传学说。

其本质是⼀种⾼效、并⾏、全局搜索的⽅法,它能在搜索过程中⾃动获取和积累有关搜索空间的知识,并⾃适应的控制搜索过程以求得最优解。

遗传算法操作使⽤适者⽣存的原则,在潜在的解决⽅案种群中逐次产⽣⼀个近似最优解的⽅案,在遗传算法的每⼀代中,根据个体在问题域中的适应度值和从⾃然遗传学中借鉴来的再造⽅法进⾏个体选择,产⽣⼀个新的近似解。

这个过程导致种群中个体的进化,得到的新个体⽐原来个体更能适应环境,就像⾃然界中的改造⼀样。

遗传算法具体步骤:(1)初始化:设置进化代数计数器t=0、设置最⼤进化代数T、交叉概率、变异概率、随机⽣成M个个体作为初始种群P(2)个体评价:计算种群P中各个个体的适应度(3)选择运算:将选择算⼦作⽤于群体。

以个体适应度为基础,选择最优个体直接遗传到下⼀代或通过配对交叉产⽣新的个体再遗传到下⼀代(4)交叉运算:在交叉概率的控制下,对群体中的个体两两进⾏交叉(5)变异运算:在变异概率的控制下,对群体中的个体进⾏变异,即对某⼀个体的基因进⾏随机调整(6)经过选择、交叉、变异运算之后得到下⼀代群体P1。

重复以上(1)-(6),直到遗传代数为 T,以进化过程中所得到的具有最优适应度个体作为最优解输出,终⽌计算。

旅⾏推销员问题(Travelling Salesman Problem, TSP):有n个城市,⼀个推销员要从其中某⼀个城市出发,唯⼀⾛遍所有的城市,再回到他出发的城市,求最短的路线。

应⽤遗传算法求解TSP问题时需要进⾏⼀些约定,基因是⼀组城市序列,适应度是按照这个基因的城市顺序的距离和分之⼀。

1.2实验代码import randomimport mathimport matplotlib.pyplot as plt#读取数据f=open("test.txt")data=f.readlines()#将cities初始化为字典,防⽌下⾯被当成列表cities={}for line in data:#原始数据以\n换⾏,将其替换掉line=line.replace("\n","")#最后⼀⾏以EOF为标志,如果读到就证明读完了,退出循环if(line=="EOF"):break#空格分割城市编号和城市的坐标city=line.split("")map(int,city)#将城市数据添加到cities中cities[eval(city[0])]=[eval(city[1]),eval(city[2])]#计算适应度,也就是距离分之⼀,这⾥⽤伪欧⽒距离def calcfit(gene):sum=0#最后要回到初始城市所以从-1,也就是最后⼀个城市绕⼀圈到最后⼀个城市for i in range(-1,len(gene)-1):nowcity=gene[i]nextcity=gene[i+1]nowloc=cities[nowcity]nextloc=cities[nextcity]sum+=math.sqrt(((nowloc[0]-nextloc[0])**2+(nowloc[1]-nextloc[1])**2)/10)return 1/sum#每个个体的类,⽅便根据基因计算适应度class Person:def__init__(self,gene):self.gene=geneself.fit=calcfit(gene)class Group:def__init__(self):self.GroupSize=100 #种群规模self.GeneSize=48 #基因数量,也就是城市数量self.initGroup()self.upDate()#初始化种群,随机⽣成若⼲个体def initGroup(self):self.group=[]i=0while(i<self.GroupSize):i+=1#gene如果在for以外⽣成只会shuffle⼀次gene=[i+1 for i in range(self.GeneSize)]random.shuffle(gene)tmpPerson=Person(gene)self.group.append(tmpPerson)#获取种群中适应度最⾼的个体def getBest(self):bestFit=self.group[0].fitbest=self.group[0]for person in self.group:if(person.fit>bestFit):bestFit=person.fitbest=personreturn best#计算种群中所有个体的平均距离def getAvg(self):sum=0for p in self.group:sum+=1/p.fitreturn sum/len(self.group)#根据适应度,使⽤轮盘赌返回⼀个个体,⽤于遗传交叉def getOne(self):#section的简称,区间sec=[0]sumsec=0for person in self.group:sumsec+=person.fitsec.append(sumsec)p=random.random()*sumsecfor i in range(len(sec)):if(p>sec[i] and p<sec[i+1]):#这⾥注意区间是⽐个体多⼀个0的return self.group[i]#更新种群相关信息def upDate(self):self.best=self.getBest()#遗传算法的类,定义了遗传、交叉、变异等操作class GA:def__init__(self):self.group=Group()self.pCross=0.35 #交叉率self.pChange=0.1 #变异率self.Gen=1 #代数#变异操作def change(self,gene):#把列表随机的⼀段取出然后再随机插⼊某个位置#length是取出基因的长度,postake是取出的位置,posins是插⼊的位置geneLenght=len(gene)index1 = random.randint(0, geneLenght - 1)index2 = random.randint(0, geneLenght - 1)newGene = gene[:] # 产⽣⼀个新的基因序列,以免变异的时候影响⽗种群 newGene[index1], newGene[index2] = newGene[index2], newGene[index1] return newGene#交叉操作def cross(self,p1,p2):geneLenght=len(p1.gene)index1 = random.randint(0, geneLenght - 1)index2 = random.randint(index1, geneLenght - 1)tempGene = p2.gene[index1:index2] # 交叉的基因⽚段newGene = []p1len = 0for g in p1.gene:if p1len == index1:newGene.extend(tempGene) # 插⼊基因⽚段p1len += 1if g not in tempGene:newGene.append(g)p1len += 1return newGene#获取下⼀代def nextGen(self):self.Gen+=1#nextGen代表下⼀代的所有基因nextGen=[]#将最优秀的基因直接传递给下⼀代nextGen.append(self.group.getBest().gene[:])while(len(nextGen)<self.group.GroupSize):pChange=random.random()pCross=random.random()p1=self.group.getOne()if(pCross<self.pCross):p2=self.group.getOne()newGene=self.cross(p1,p2)else:newGene=p1.gene[:]if(pChange<self.pChange):newGene=self.change(newGene)nextGen.append(newGene)self.group.group=[]for gene in nextGen:self.group.group.append(Person(gene))self.group.upDate()#打印当前种群的最优个体信息def showBest(self):print("第{}代\t当前最优{}\t当前平均{}\t".format(self.Gen,1/self.group.getBest().fit,self.group.getAvg())) #n代表代数,遗传算法的⼊⼝def run(self,n):Gen=[] #代数dist=[] #每⼀代的最优距离avgDist=[] #每⼀代的平均距离#上⾯三个列表是为了画图i=1while(i<n):self.nextGen()self.showBest()i+=1Gen.append(i)dist.append(1/self.group.getBest().fit)avgDist.append(self.group.getAvg())#绘制进化曲线plt.plot(Gen,dist,'-r')plt.plot(Gen,avgDist,'-b')plt.show()ga=GA()ga.run(3000)print("进⾏3000代后最优解:",1/ga.group.getBest().fit)1.3实验结果下图是进⾏⼀次实验的结果截图,求出的最优解是11271为避免实验的偶然性,进⾏10次重复实验,并求平均值,结果如下。

一、粒子群算法粒子群算法,也称粒子群优化算法(Particle Swarm Optimization),缩写为PSO,是近年来发展起来的一种新的进化算法((Evolu2tionary Algorithm - EA)。

PSO 算法属于进化算法的一种,和遗传算法相似,它也是从随机解出发,通过迭代寻找最优解,它也是通过适应度来评价解的品质,但它比遗传算法规则更为简单,它没有遗传算法的交叉(Crossover) 和变异(Mutation) 操作,它通过追随当前搜索到的最优值来寻找全局最优。

这种算法以其实现容易、精度高、收敛快等优点引起了学术界的重视,并且在解决实际问题中展示了其优越性。

优化问题是工业设计中经常遇到的问题,许多问题最后都可以归结为优化问题.为了解决各种各样的优化问题,人们提出了许多优化算法,比较著名的有爬山法、遗传算法等.优化问题有两个主要问题:一是要求寻找全局最小点,二是要求有较高的收敛速度.爬山法精度较高,但是易于陷入局部极小.遗传算法属于进化算法(EvolutionaryAlgorithms)的一种,它通过模仿自然界的选择与遗传的机理来寻找最优解.遗传算法有三个基本算子:选择、交叉和变异.但是遗传算法的编程实现比较复杂,首先需要对问题进行编码,找到最优解之后还需要对问题进行解码,另外三个算子的实现也有许多参数,如交叉率和变异率,并且这些参数的选择严重影响解的品质,而目前这些参数的选择大部分是依靠经验.1995年Eberhart博士和kennedy博士提出了一种新的算法;粒子群优化(ParticalSwarmOptimization-PSO)算法.这种算法以其实现容易、精度高、收敛快等优点引起了学术界的重视,并且在解决实际问题中展示了其优越性.粒子群优化(ParticalSwarmOptimization-PSO)算法是近年来发展起来的一种新的进化算法(Evolu2tionaryAlgorithm-EA).PSO算法属于进化算法的一种,和遗传算法相似,它也是从随机解出发,通过迭代寻找最优解,它也是通过适应度来评价解的品质.但是它比遗传算法规则更为简单,它没有遗传算法的交叉(Crossover)和变异(Mutation)操作.它通过追随当前搜索到的最优值来寻找全局最优二、遗传算法遗传算法是计算数学中用于解决最佳化的,是进化算法的一种。

遗传算法蚁群算法粒子群算法模拟退火算法《探究遗传算法、蚁群算法、粒子群算法和模拟退火算法》一、引言遗传算法、蚁群算法、粒子群算法和模拟退火算法是现代优化问题中常用的算法。

它们起源于生物学和物理学领域,被引入到计算机科学中,并在解决各种复杂问题方面取得了良好的效果。

本文将深入探讨这四种算法的原理、应用和优势,以帮助读者更好地理解和应用这些算法。

二、遗传算法1. 概念遗传算法是一种模拟自然选择过程的优化方法,通过模拟生物进化过程,不断改进解决方案以找到最优解。

其核心思想是通过遗传操作(选择、交叉和变异)来优化个体的适应度,从而达到最优解。

2. 应用遗传算法在工程优化、机器学习、生物信息学等领域有着广泛的应用。

在工程设计中,可以利用遗传算法来寻找最优的设计参数,以满足多种约束条件。

3. 优势遗传算法能够处理复杂的多目标优化问题,并且具有全局搜索能力,可以避免陷入局部最优解。

三、蚁群算法1. 概念蚁群算法模拟蚂蚁在寻找食物过程中释放信息素的行为,通过信息素的沉积和蒸发来实现最优路径的搜索。

蚁群算法具有自组织、适应性和正反馈的特点。

2. 应用蚁群算法在路径规划、网络优化、图像处理等领域有着广泛的应用。

在无线传感网络中,可以利用蚁群算法来实现路由优化。

3. 优势蚁群算法适用于大规模问题的优化,具有分布式计算和鲁棒性,能够有效避免陷入局部最优解。

四、粒子群算法1. 概念粒子群算法模拟鸟群中鸟类迁徙时的行为,通过个体间的协作和信息共享来搜索最优解。

每个粒子代表一个潜在解决方案,并根据个体最优和群体最优不断更新位置。

2. 应用粒子群算法在神经网络训练、函数优化、机器学习等领域有着广泛的应用。

在神经网络的权重优化中,可以利用粒子群算法来加速训练过程。

3. 优势粒子群算法对于高维和非线性问题具有较强的搜索能力,且易于实现和调整参数,适用于大规模和复杂问题的优化。

五、模拟退火算法1. 概念模拟退火算法模拟金属退火时的过程,通过接受劣解的概率来跳出局部最优解,逐步降低温度以逼近最优解。

信息科学中的智能决策模型与算法分析智能决策是信息科学领域中的重要研究方向,它涉及到以人工智能为基础的决策模型和算法的设计与分析。

在当今信息爆炸的时代,人类需要面对海量的数据和信息来做出正确的决策,这就需要智能决策模型和算法的支持。

本文将从智能决策的概念出发,探讨智能决策模型和算法在信息科学中的应用,并进行深入的分析。

一、智能决策的概念智能决策是指利用信息技术和人工智能方法来辅助人们进行决策的过程。

它可以帮助人们从庞大的数据和信息中提取有用的知识,并将其转化为决策的依据。

智能决策模型和算法是实现智能决策的关键,通过识别和利用数据的潜在规律,它们能够自动化地解决决策问题,减少人为因素的干扰,提高决策的准确性和效率。

二、智能决策模型智能决策模型是指对决策问题进行抽象和建模,以便于进行计算和分析的数学模型。

不同的决策问题需要采用不同的智能决策模型来进行描述和求解。

常见的智能决策模型包括机器学习模型、模糊逻辑模型和神经网络模型。

1. 机器学习模型机器学习是一种利用数据和统计方法来构建模型并进行决策的方法。

它通过对大量的样本数据进行学习和训练,自动发现数据中的规律和模式,并将其应用到未知数据的决策中。

常见的机器学习模型包括决策树、支持向量机和深度学习模型。

这些模型在分类、聚类和回归等决策问题中具有广泛的应用。

2. 模糊逻辑模型模糊逻辑是一种能够处理不确定性和模糊性信息的数学工具。

它将模糊的语言和概念用数学的方式进行描述,并利用模糊推理来进行决策。

模糊逻辑模型在模糊决策、模糊控制和模糊优化等问题中得到了广泛的应用。

它能够有效地处理实际决策中存在的模糊和不确定性,提高决策的适应性和鲁棒性。

3. 神经网络模型神经网络是一种模仿生物神经系统结构和功能的数学模型。

它由大量的神经元和它们之间的连接构成,能够以并行的方式进行信息处理和决策。

神经网络模型具有自学习和自适应的能力,通过训练和调整网络的连接权值,它能够将输入信息转化为输出决策。

一、粒子群算法粒子群算法,也称粒子群优化算法(Particle Swarm Optimization),缩写为PSO,是近年来发展起来的一种新的进化算法((Evolu2tionary Algorithm - EA)。

PSO 算法属于进化算法的一种,和遗传算法相似,它也是从随机解出发,通过迭代寻找最优解,它也是通过适应度来评价解的品质,但它比遗传算法规则更为简单,它没有遗传算法的交叉(Crossover) 和变异(Mutation) 操作,它通过追随当前搜索到的最优值来寻找全局最优。

这种算法以其实现容易、精度高、收敛快等优点引起了学术界的重视,并且在解决实际问题中展示了其优越性。

优化问题是工业设计中经常遇到的问题,许多问题最后都可以归结为优化问题.为了解决各种各样的优化问题,人们提出了许多优化算法,比较著名的有爬山法、遗传算法等.优化问题有两个主要问题:一是要求寻找全局最小点,二是要求有较高的收敛速度.爬山法精度较高,但是易于陷入局部极小.遗传算法属于进化算法(EvolutionaryAlgorithms)的一种,它通过模仿自然界的选择与遗传的机理来寻找最优解.遗传算法有三个基本算子:选择、交叉和变异.但是遗传算法的编程实现比较复杂,首先需要对问题进行编码,找到最优解之后还需要对问题进行解码,另外三个算子的实现也有许多参数,如交叉率和变异率,并且这些参数的选择严重影响解的品质,而目前这些参数的选择大部分是依靠经验.1995年Eberhart博士和kennedy博士提出了一种新的算法;粒子群优化(ParticalSwarmOptimization-PSO)算法.这种算法以其实现容易、精度高、收敛快等优点引起了学术界的重视,并且在解决实际问题中展示了其优越性.粒子群优化(ParticalSwarmOptimization-PSO)算法是近年来发展起来的一种新的进化算法(Evolu2tionaryAlgorithm-EA).PSO算法属于进化算法的一种,和遗传算法相似,它也是从随机解出发,通过迭代寻找最优解,它也是通过适应度来评价解的品质.但是它比遗传算法规则更为简单,它没有遗传算法的交叉(Crossover)和变异(Mutation)操作.它通过追随当前搜索到的最优值来寻找全局最优二、遗传算法遗传算法是计算数学中用于解决最佳化的,是进化算法的一种。

7.1 蚁群优化算法概述•7.1.1 起源•7.1.2 应用领域•7.1.3 研究背景•7.1.4 研究现状•7.1.5 应用现状7.1.1 蚁群优化算法起源20世纪50年代中期创立了仿生学,人们从生物进化的机理中受到启发。

提出了许多用以解决复杂优化问题的新方法,如进化规划、进化策略、遗传算法等,这些算法成功地解决了一些实际问题。

20世纪90年代意大利学者M.Dorigo,V.Maniezzo,A.Colorni等从生物进化的机制中受到启发,通过模拟自然界蚂蚁搜索路径的行为,提出来一种新型的模拟进化算法——蚁群算法,是群智能理论研究领域的一种主要算法。

背景:人工生命•“人工生命”是来研究具有某些生命基本特征的人工系统。

人工生命包括两方面的内容。

•研究如何利用计算技术研究生物现象。

•研究如何利用生物技术研究计算问题。

•现在关注的是第二部分的内容,现在已经有很多源于生物现象的计算技巧。

例如,人工神经网络是简化的大脑模型,遗传算法是模拟基因进化过程的。

•现在我们讨论另一种生物系统-社会系统。

更确切的是,在由简单个体组成的群落与环境以及个体之间的互动行为,也可称做“群智能”(swarm intelligence)。

这些模拟系统利用局部信息从而可能产生不可预测的群体行为(如鱼群和鸟群的运动规律),主要用于计算机视觉和计算机辅助设计。

•在计算智能(computational intelligence)领域有两种基于群智能的算法。

蚁群算法(ant colony optimization)和粒子群算法(particle swarm optimization)。

前者是对蚂蚁群落食物采集过程的模拟,已经成功运用在很多离散优化问题上。

•作为一种新兴演化计算技术,群智能已成为新的研究热点,它与人工生命,特别是进化策略和遗传算法有着极为特殊的联系,已完成的理论和应用研究证明群智能方法是一种能够有效解决大多数全局优化问题的新方法.••更为重要的是,群智能的潜在并行性和分布式特点为处理大量的以数据库形式存在的数据提供了技术保证.•因此无论是从理论研究还是应用研究的角度分析,群智能理论及其应用研究都是具有重要学术意义和现实价值的。