线性代数特征值和特征向量矩阵的对角化

- 格式:pptx

- 大小:376.79 KB

- 文档页数:43

特征值和特征向量特征值和特征向量是线性代数中非常重要的概念,在数学和工程领域中广泛应用。

它们与矩阵与向量的关系密切相关,可以用于解决许多实际问题。

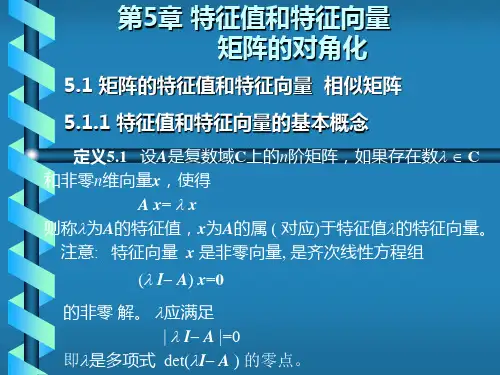

一、特征值与特征向量的定义特征值和特征向量是矩阵的固有性质,它们描述了矩阵在线性变换下的特殊性质。

特征值(eigenvalue)是一个数,表示矩阵变换后的向量与原向量方向相等或反向。

特征向量(eigenvector)则是与特征值对应的向量。

对于一个n维矩阵A和一个n维向量x,如果满足以下等式:Ax = λx其中λ为标量,称为特征值,x称为特征向量。

我们可以将这个等式分解为(A-λI)x=0,其中I为单位矩阵,如果矩阵A存在一个非零向量x使得等式成立,则说明λ为矩阵A的特征值,x为对应的特征向量。

特征值和特征向量总是成对出现,一个特征值可能对应多个特征向量。

二、特征值与特征向量的求解为了求解矩阵的特征值与特征向量,我们可以使用特征值问题的基本公式:det(A-λI) = 0其中,det表示行列式求值。

解这个方程可以得到矩阵A的特征值λ。

然后,我们将每个特征值代入方程(A-λI)x = 0,求解得到对应的特征向量x。

三、特征值与特征向量的意义特征值和特征向量在许多应用中起着重要的作用,它们可以帮助我们理解矩阵的几何性质和变换规律。

在线性代数中,特征值和特征向量有以下几个重要意义:1. 几何意义:特征向量表示了矩阵变换后不改变方向的向量。

特征值表示了特征向量在变换中的缩放因子。

通过分析特征向量和特征值,我们可以了解变换对向量空间的拉伸、压缩、旋转等操作。

2. 矩阵对角化:如果矩阵A有n个线性无关的特征向量,我们可以将这些特征向量组成一个矩阵P,并将其逆矩阵P^{-1}乘以A和AP^{-1},就可以得到一个对角矩阵D,D的对角线上的元素就是矩阵A的特征值。

这个过程称为矩阵的对角化,可以简化矩阵的运算和分析。

3. 矩阵的奇异值分解:特征值和特征向量也与矩阵的奇异值分解密切相关。

线性代数中的特征值和特征向量线性代数是一门研究向量空间和线性变换的数学分支。

在其核心概念之一中,常常涉及到特征值和特征向量。

特征值和特征向量是在变换下保持方向的向量,这样的向量在研究中经常被用到,因为它们描述了变换对向量空间的作用。

在特征值及其对应的特征向量方面,我们可以从以下几个方面来展开:一、特征值和特征向量的定义特征值是指线性变换作用于某一向量时,其结果与这个向量的数量关系,这个数量关系可以用一个数值来表示,这个数值就称为这个向量在该变换下的特征值。

特征向量是一条非零向量,变换作用在这个向量上时,仅改变向量的长度,而不改变它的方向。

也就是说,这个向量在该变换下的方向不变,只是相应地拉伸或缩短了。

二、特征值和特征向量的计算方法在计算特征值和特征向量时,可以采用以下方法:1.求解对角矩阵对于n阶矩阵A,如果存在一个列向量X,使得AX=kX,其中k为一个数,则称k是矩阵A的一个特征值,而X称为A的对应于特征值k的特征向量。

而一个矩阵的特征值和特征向量可以通过求解其对角化矩阵得到。

2.求解特征多项式特征多项式是矩阵的特征值所满足的多项式方程,我们可以通过求解这个方程来求解矩阵的特征值和特征向量。

对于一个n阶方阵,其特征多项式是由其任意一行(列)对角线上各元素和行(列)号交织奇偶性给出。

三、特征值和特征向量在实际应用中的作用特征值和特征向量在实际应用中有着广泛的应用。

比如说,在图像处理中,我们可以采用特征向量的方法来实现图像的压缩和去噪;在机器学习中,我们可以采用特征值和特征向量的方法来实现数据的降维和特征选择。

另外,在计算机图形学、信号处理、量子力学和金融等领域中,特征值和特征向量也被广泛运用,它们帮助我们将复杂的问题转化成简单的数学运算,提高了问题的解决效率和精度。

总之,特征值和特征向量是线性代数中的重要概念,在实际应用当中发挥着不可替代的作用。

了解它们的定义、计算方法和应用,对于我们掌握基本的数学分析能力和工程应用能力是必不可少的。

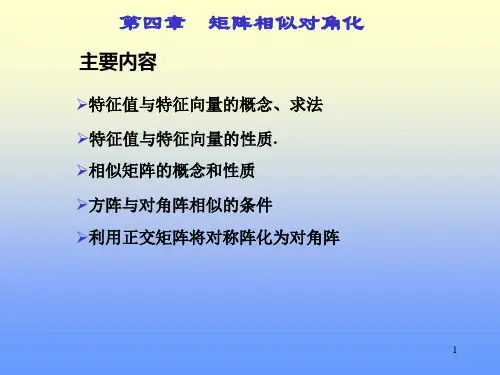

特征值和特征向量矩阵的相似对角化在线性代数中,矩阵是一个非常重要的数学对象。

特征值和特征向量则是矩阵中一组与矩阵相互关系紧密的特征。

矩阵的相似对角化是矩阵与特征值、特征向量之间的重要关系。

首先,我们来了解特征值和特征向量的概念。

设A是一个n阶矩阵,若存在一个非零向量X,使得满足AX=λX,其中λ是一个数,则称λ为矩阵A的特征值,X为特征值λ所对应的特征向量。

特征向量表示在进行矩阵变换时,只发生一个标量倍数的变化,特征值则表示这个标量倍数的大小。

接下来,我们来探讨一下矩阵的相似对角化。

对于一个n阶矩阵A,如果存在一个n阶可逆矩阵P,使得P−1AP是一个对角矩阵D,那么就称矩阵A相似于对角矩阵D,即A的相似对角化。

在相似对角化的过程中,矩阵A与D具有相同的特征值,而对角矩阵D的对角线上的元素即为矩阵A的特征值。

要进行矩阵的相似对角化,首先需要求得矩阵A的特征值和特征向量。

假设λ1,λ2,...,λn是矩阵A的n个特征值,对应的特征向量分别为X1,X2,...,Xn。

将这些特征向量按列排列,并组成一个矩阵P=[X1,X2,...,Xn],则P是一个可逆矩阵。

根据特征向量的定义,我们可以得到AX=PX,进一步可以得到AX=PX=PX[λ1,λ2,...,λn],即可以得到AP=P[λ1,λ2,...,λn]。

将矩阵A与对角矩阵D相乘,可以得到AP=PD。

根据上述推导,我们可以得到P−1AP=D,即A相似于对角矩阵D。

这个过程就是矩阵的相似对角化。

矩阵的相似对角化有很多应用。

一个重要的应用是简化矩阵的计算。

对于相似的矩阵,它们具有相同的特征值,因此在计算矩阵的n次幂、矩阵的指数函数等复杂运算时,可以先对矩阵进行相似对角化,再进行计算。

相似对角矩阵的计算更加简单,计算结果也更容易分析和理解。

另外,相似对角化还可以帮助我们研究线性系统的稳定性。

对于一个线性系统,其稳定性可以通过矩阵的特征值来判断。

若所有特征值的实部都小于零,则线性系统是稳定的,否则不稳定。

特征值和特征向量首先,我们先来了解一下矩阵。

矩阵是由一个矩形的数组组成的,其中的每个元素都可以是实数或复数。

例如,3x3的矩阵可以写为:A=[abc][def][ghi]Av=λv那么v就是矩阵A的特征向量,λ就是矩阵A的特征值。

换句话说,特征向量在矩阵的变换下只发生拉伸或缩放,而不发生旋转或扭曲。

特征值表示特征向量被拉伸或缩放的比例。

det(A - λI) = 0其中,det表示矩阵的行列式,I是单位矩阵。

通过解特征方程,我们可以求得特征值λ。

然后,我们可以将每个特征值代入原方程Av =λv中,从而求得对应的特征向量v。

1.矩阵的对角化:特征值和特征向量可以帮助我们将一个复杂的矩阵对角化,即将矩阵表示为对角矩阵的形式。

对角化后的矩阵更容易进行计算和分析,也更便于推导矩阵的性质。

2.矩阵的相似性:如果一个方阵A和B有相同的特征值和特征向量,那么A和B是相似的。

相似的矩阵在一些数学和物理问题中具有相同的性质和行为,因此,通过特征值和特征向量可以判断矩阵的相似性。

3.矩阵的主成分分析(PCA):主成分分析是一种常用的数据降维方法,它可以通过计算矩阵的特征值和特征向量,将高维数据降低到低维空间中。

通过PCA,我们可以找到数据中最重要的特征和主要方向,从而减少冗余信息。

4.矩阵的奇异值分解(SVD):奇异值分解是矩阵分解的一种重要方法,它可以将一个任意形状的矩阵表示为三个矩阵的乘积。

在奇异值分解中,矩阵的特征值和特征向量扮演了重要的角色。

5.线性变换和矩阵的谱:特征值和特征向量可以帮助我们理解和描述线性变换和矩阵的谱。

谱是矩阵A的特征值的集合,它可以提供关于矩阵的一些性质信息,比如矩阵的正定性、对称性、收敛性等。

总结起来,特征值和特征向量是矩阵理论中非常重要的概念。

它们可以帮助我们理解和描述矩阵的性质和变换,以及在许多实际问题中的应用。

特征值和特征向量的计算和应用对于数学、物理、工程和计算机科学等领域都有重要意义。

特征值特征向量与矩阵可对角化详解特征值特征向量与矩阵可对角化是线性代数中一个重要的概念,它在矩阵的理论研究和应用中有着广泛的应用。

本文将详细介绍特征值特征向量的定义、性质以及矩阵可对角化的条件和方法。

让我们一起来探索这一有趣而重要的概念。

首先,我们来介绍特征值和特征向量的定义。

设A是一个n阶矩阵,如果存在一个非零向量x,使得Ax=kx,其中k是一个常数,则k称为矩阵A的特征值,x称为矩阵A对应于特征值k的特征向量。

特征值和特征向量的定义看起来可能抽象,我们可以通过一个具体的例子来理解这个概念。

考虑一个2阶矩阵A=[[3,-2],[4,-1]],我们要找到它的特征值和特征向量。

首先,我们解方程A-λI=0,其中λ是特征值,I是单位矩阵。

这将得到一个关于λ的方程,我们解它可以找到特征值λ1=1和λ2=-1、然后,我们带入A-λI=0,解得对应于λ1的特征向量x1=[1,2]和对应于λ2的特征向量x2=[1,-1]。

所以,矩阵A的特征值是λ1=1和λ2=-1,对应的特征向量是x1=[1,2]和x2=[1,-1]。

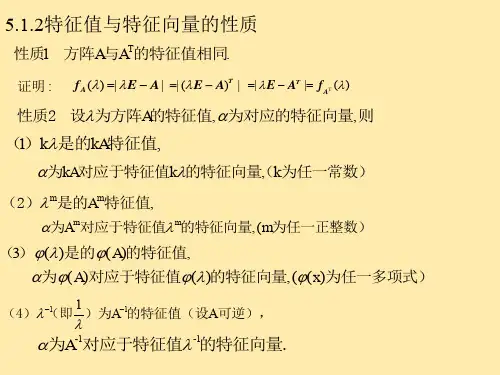

接下来,我们来介绍特征值特征向量的性质。

首先,特征值与矩阵的大小是相关的,一个n阶矩阵最多有n个不同的特征值。

此外,矩阵的特征值和对应的特征向量是成对出现的,一个特征值可以对应多个特征向量。

矩阵可对角化的条件是,矩阵A的n个特征向量x1,x2,...,xn都线性无关。

这又可以等价于矩阵A的n个特征向量x1,x2,...,xn都是线性独立的,即不存在一个非零向量x可以表示为这些特征向量的线性组合。

我们还可以通过矩阵的代数重数和几何重数来进一步讨论特征值的性质。

矩阵的代数重数是一个特征值λ在特征多项式中的重数,而几何重数是对应于特征值λ的特征向量的个数。

根据定理,矩阵的代数重数与几何重数之和等于矩阵的阶数。

当矩阵的代数重数等于几何重数时,我们称矩阵的特征值是简单的;当矩阵的代数重数大于几何重数时,我们称矩阵的特征值是重复的。

矩阵的特征多项式与对角化认识矩阵的特征多项式与对角化的计算方法矩阵是线性代数中重要的概念,我们经常会遇到矩阵的特征多项式与对角化的计算问题。

本文将从理论与计算两个方面对矩阵的特征多项式和对角化进行深入探讨。

一、特征多项式特征多项式是矩阵的一个重要性质,它能帮助我们求解矩阵的特征值和特征向量。

给定一个n阶矩阵A,我们可以定义其特征多项式为:P(λ) = |A - λI|其中,λ是一个变量,I为n阶单位矩阵。

我们可以将特征多项式展开,得到一个关于λ的多项式,通常称之为特征方程。

特征多项式的计算方法有很多种,最常用的是行列式的方法。

我们可以将矩阵A减去λI,然后求其行列式,得到特征多项式。

特征多项式的阶数为n,根据代数基本定理,特征多项式总共有n个根,也就是说特征多项式的所有根就是矩阵的特征值。

二、对角化对角化是线性代数中一个重要的概念,对角化能够将一个矩阵转化为一个对角矩阵,从而简化矩阵的计算。

对于一个n阶矩阵A,如果存在一个可逆矩阵P,使得P^-1 * A * P = D,其中D为对角矩阵,那么我们称矩阵A是可对角化的。

对角化的计算方法有很多种,其中最常用的是特征向量的方法。

当一个矩阵A是可对角化的时候,我们可以通过求解特征向量来计算对角矩阵D和可逆矩阵P。

首先,我们需要求解矩阵A的特征向量,然后将特征向量组成一个矩阵P,特征向量按列排列成矩阵P的列向量。

接着,我们将特征向量按照特征值的顺序排列,组成对角矩阵D。

最后,我们可以得到可逆矩阵P = [v1, v2, ..., vn],使得P^-1 * A * P = D。

需要注意的是,并非所有的矩阵都可以被对角化,只有满足一定条件的矩阵才能进行对角化操作。

对角化的条件主要包括:矩阵可逆、矩阵特征值互不相等、特征向量线性无关等。

结论本文详细介绍了矩阵的特征多项式与对角化的认识以及计算方法。

特征多项式是矩阵特征值和特征向量的关键,通过计算特征多项式可以获得矩阵的特征值。

判断矩阵是否可对角化的方法1.引言1.1 概述在线性代数中,矩阵的对角化是一种重要的研究方法,可以帮助我们简化矩阵的计算和分析。

通过对角化,我们可以将一个复杂的矩阵转化为一个对角矩阵,使得矩阵的运算变得更加简单和直观。

然而,并非所有的矩阵都可以进行对角化。

有些矩阵由于其特殊的性质或结构,无法被对角化。

因此,判断一个矩阵是否可以对角化成为一个重要的问题,在矩阵理论和应用中具有广泛的意义。

本文将介绍一些判断矩阵是否可对角化的方法。

这些方法包括变换法、特征值法和可对角化标准形等。

通过运用这些方法,我们可以确定一个矩阵是否可以对角化,以及找出对角化所需的相应变换矩阵和对角矩阵。

文章的正文部分将详细介绍这些方法。

首先,我们将详细描述变换法,并给出相应的步骤和注意事项。

然后,我们将介绍特征值法,它是判断矩阵可对角化的常用方法之一。

我们将解释特征值的概念,并提供相应的判断条件和计算方法。

最后,我们将介绍可对角化标准形,它是判断矩阵是否可对角化的一个重要的准则。

我们将详细介绍可对角化标准形的定义、性质和应用。

在结论部分,我们将对整篇文章进行总结,并充分展望未来对于判断矩阵是否可对角化的更深入研究方向。

研究和应用矩阵的对角化具有重要的理论和实际意义,因此为了进一步提高矩阵的运算效率和准确性,我们需要不断深化对矩阵可对角化性质的研究与理解。

通过本文的阅读,读者将能够了解判断矩阵是否可对角化的一些基本方法,并能够应用这些方法解决实际问题。

同时,我们也将为矩阵的对角化研究提供一些思路和参考,促进相关领域的深入发展和应用。

文章结构部分的内容可以这样编写:1.2 文章结构本篇文章主要围绕判断矩阵是否可对角化的方法展开讨论。

文章分为引言、正文和结论三个部分。

引言部分主要包括对本文的概述、文章结构以及研究目的的介绍。

首先,我们会概述矩阵对角化的重要性和应用背景。

接着,我们会介绍文章的整体结构,明确每个部分的主要内容和研究重点。