新教材DATASTAGE的介绍及基本操作.ppt

- 格式:ppt

- 大小:3.29 MB

- 文档页数:133

DataStage官方培训教程10DataStage是一个ETL工具,它提供了广泛的数据连接选项以及数据转换和清理功能,以帮助企业完成数据仓库构建和管理。

由于数据驱动的世界越来越重要,数据管理和ETL应用程序的需求也变得越来越迫切。

DataStage官方培训教程10涵盖了DataStage常见的任务和操作,为学习DataStage用户提供了完整的指导。

在本文中,我们将对DataStage官方培训教程10进行分析和实践,以帮助读者更好地了解和掌握DataStage。

DataStage官方培训教程10的结构和内容DataStage官方培训教程10是一本基于DataStage 11.7版本的官方培训教材。

该教材共包含15个单元,分为4个部分。

第一部分介绍了DataStage概述和安装过程,包括DataStage架构、组件、工作流程等。

第二部分介绍了DataStage的数据源定义、数据移动和数据变换。

第三部分主要介绍了DataStage的错误处理和调试,包括日志、报告、来源和目标检查等。

第四部分介绍了高级主题,如DataStage管理、性能调整、共享资源和集成JDBC驱动程序等。

DataStage官方培训教程10的学习方法和技巧DataStage官方培训教程10是一本详细的教材,需要耐心和时间来学习。

以下是一些学习方法和技巧,可以帮助读者更好地掌握DataStage。

1.按照教材结构进行学习按照各个部分和单元的结构进行学习,以便逐步深入理解每个主题。

特别是,在学习前两部分时需要仔细阅读和理解数据源定义、数据移动和数据变换的概念和操作指南,掌握其重要性和影响关系。

2.完整地跟随实例进行演示教材中提供了许多实例来示范DataStage的各个方面,读者可以用自己的DataStage环境进行实操,加深对DataStage的理解和熟练度。

值得注意的是,在学习高级主题时需要一定的实践经验和技能,否则可能会花费更多的时间和精力。

Datastage应用开发1 Datastage 简介Datastage包含四大部件:Administrator、Manager、Designer、Director。

1.用DataStage Administrator 新建或者删除项目,设置项目的公共属性,比如权限。

2.用DataStage Designer 连接到指定的项目上进行Job的设计;3.用DataStage Director 负责job的运行,监控等。

例如设置设计好的job的调度时间。

4.用DataStage Manager 进行Job的备份等job的管理工作。

2 设计一个JOB示例2.1 环境准备目标:将源表中数据调度到目标表中去。

1 数据库:posuser/posuser@WHORADB , ip: 192.168.100.882 源表:a_test_from3 目标表:a_test_to两者表结构一样,代码参考:create table A_TEST_FROM(ID INTEGER not null,CR_SHOP_NO CHAR(15),SHOP_NAME VARCHAR2(80),SHOP_TEL CHAR(20),YEAR_INCOME NUMBER(16,2),SHOP_CLOSE_DATE DATE,SHOP_OPEN_DATE DATE);alter table A_TEST_FROMadd constraint TEST primary key (ID);4. 示例数据:insert into A_TEST_FROM (ID, CR_SHOP_NO, SHOP_NAME, SHOP_TEL, YEAR_INCOME, SHOP_CLOSE_DATE, SHOP_OPEN_DATE)values (24402, '105420580990038', '宜昌市云集门诊部', '82714596 ', 1000, to_date('01-05-2008', 'dd-mm-yyyy'), to_date('01-06-2008', 'dd-mm-yyyy'));insert into A_TEST_FROM (ID, CR_SHOP_NO, SHOP_NAME, SHOP_TEL, YEAR_INCOME, SHOP_CLOSE_DATE, SHOP_OPEN_DATE)values (24403, '105420559982198', '于志良', '82714596 ', 2000, to_date('02-05-2008', 'dd-mm-yyyy'), to_date('02-06-2008', 'dd-mm-yyyy'));insert into A_TEST_FROM (ID, CR_SHOP_NO, SHOP_NAME, SHOP_TEL, YEAR_INCOME, SHOP_CLOSE_DATE, SHOP_OPEN_DATE)values (24404, '105420556410012', '阳光儿童广场', '82714596 ', 3000, to_date('03-05-2008', 'dd-mm-yyyy'), to_date('03-06-2008', 'dd-mm-yyyy'));insert into A_TEST_FROM (ID, CR_SHOP_NO, SHOP_NAME, SHOP_TEL, YEAR_INCOME, SHOP_CLOSE_DATE, SHOP_OPEN_DATE)values (24405, '105420580620033', '秭归县医疗中心', '82714596 ', 4000, to_date('04-05-2008', 'dd-mm-yyyy'), to_date('04-06-2008', 'dd-mm-yyyy'));insert into A_TEST_FROM (ID, CR_SHOP_NO, SHOP_NAME, SHOP_TEL, YEAR_INCOME, SHOP_CLOSE_DATE, SHOP_OPEN_DATE)values (24406, '105420559120063', '同德医药零售北门连锁店', '82714596 ', 5000, to_date('05-05-2008', 'dd-mm-yyyy'), to_date('05-06-2008', 'dd-mm-yyyy'));2.2 打开Designer任务:打开datastage designer,连接datastage服务器1.双击桌面datastage designer图标。

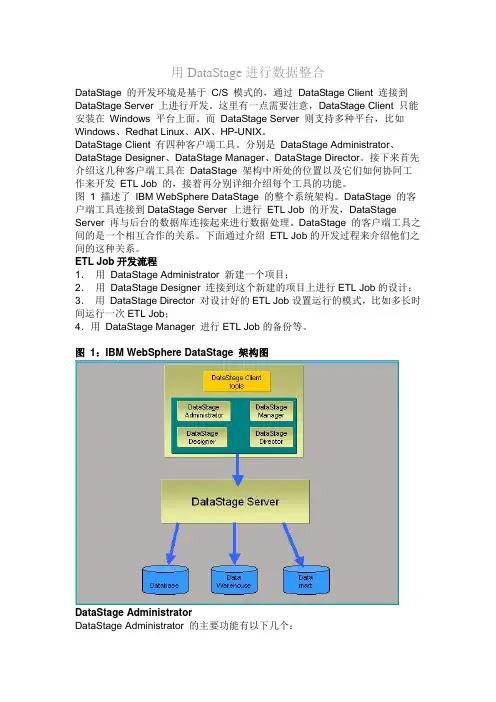

用DataStage进行数据整合DataStage 的开发环境是基于C/S 模式的,通过DataStage Client 连接到DataStage Server 上进行开发。

这里有一点需要注意,DataStage Client 只能安装在Windows 平台上面。

而DataStage Server 则支持多种平台,比如Windows、Redhat Linux、AIX、HP-UNIX。

DataStage Client 有四种客户端工具。

分别是DataStage Administrator、DataStage Designer、DataStage Manager、DataStage Director。

接下来首先介绍这几种客户端工具在DataStage 架构中所处的位置以及它们如何协同工作来开发ETL Job 的,接着再分别详细介绍每个工具的功能。

图1 描述了IBM WebSphere DataStage 的整个系统架构。

DataStage 的客户端工具连接到DataStage Server 上进行ETL Job 的开发,DataStage Server 再与后台的数据库连接起来进行数据处理。

DataStage 的客户端工具之间的是一个相互合作的关系。

下面通过介绍ETL Job的开发过程来介绍他们之间的这种关系。

ETL Job开发流程1.用DataStage Administrator 新建一个项目;2.用DataStage Designer 连接到这个新建的项目上进行ETL Job的设计;3.用DataStage Director 对设计好的ETL Job设置运行的模式,比如多长时间运行一次ETL Job;4.用DataStage Manager 进行ETL Job的备份等。

图1:IBM WebSphere DataStage 架构图DataStage AdministratorDataStage Administrator 的主要功能有以下几个:1.设置客户端和服务器连接的最大时间。

DATESTAGE 使用实用指南1.DataStage官方文档学习笔记1.1通过右键添加link鼠标右键点击起始stage,按住右键移动鼠标到目标stage。

还有一种方法就是把鼠标放在起始stage的边缘等到变为一个小圆圈里面有一个叉的时候拖动鼠标到目标stage。

1.2DataStage中默认和隐式类型转换时注意的问题当从源向目标映射数据时,如果类型不一致,对于有些类型我们需要在modify或transfomer stage中通过函数进行转换,对于有些系统会自动完成类型转换,在类型转换过程中,注意以下几点:1 在变长到固定长度字符串的默认转换中,parallel jobs用null(ASCII 0)字符来填充剩余长度。

联系到前面做的一个parallel job,当目标是变长时(当时源也是变长,但是好像源的精度要小些),但是字符串实际的长度没有指定的变长那么长的话,系统会自动用空格(ASCII 20)来填充(具体在哪个stage 填充的不知),而且环境变量APT_STRING_PADCHAR的默认值也是空格(ASCII 20)。

2 通过环境变量APT_STRING_PADCHAR可以改变默认的填充字符null(ASCII 0)。

注:联系上面两点,感觉文档讲的与实际不符,难道我们项目的administrator改变了该环境变量的默认值?3 有个PadString 函数可以用来用指定的字符来填充一个变长的字符串到指定的长度。

这个函数的参数不能使固定长度字符串,如果是固定长度的先转化为变长。

1.3Copy Stage作为占位符在job开发中,当你暂时不知道该使用哪个stage时,可以使用copy stage作为占位符,注意不要把Force 属性设为True,在不把Force设为True时,复制将在运行时进行优化。

使用Schema file来指定meta data1 可以通过列定义和schema file两种方式来指定meta data,值得注意的一点是Note that, if you usea schema file, you should ensure that runtime column propagation is turned on. Otherwise the column definitions specified in the stage editor will always override any schema file.即,如果想通过schema file来指定meta data,必须勾上runtime column propagation,否则总是使用列定义来作为meta data。

简介DataStage 使用了Client-Server 架构,服务器端存储所有的项目和元数据,客户端DataStage Designer 为整个ETL 过程提供了一个图形化的开发环境,用所见即所得的方式设计数据的抽取清洗转换整合和加载的过程。

Datastage 的可运行单元是Datastage Job ,用户在Designer 中对Datastage Job 的进行设计和开发。

Datastage 中的Job 分为Server Job, Parallel Job 和Mainframe Job ,其中Mainframe Job 专供大型机上用,常用到的Job 为Server Job 和Parallel Job 。

本文将介绍如何使用Server Job 和Parallel Job 进行ETL 开发。

Server Job一个Job 就是一个Datastage 的可运行单元。

Server Job 是最简单常用的Job 类型,它使用拖拽的方式将基本的设计单元-Stage 拖拽到工作区中,并通过连线的方式代表数据的流向。

通过Server Job,可以实现以下功能。

1.定义数据如何抽取2.定义数据流程3.定义数据的集合4.定义数据的转换5.定义数据的约束条件6.定义数据的聚载7.定义数据的写入Parallel JobServer Job 简单而强大,适合快速开发ETL 流程。

Parallel Job 与Server Job 的不同点在于其提供了并行机制,在支持多节点的情况下可以迅速提高数据处理效率。

Parallel Job 中包含更多的Stage 并用于不同的需求,每种Stage 使用上的限制也往往大于Server Job。

Sequence JobSequence Job 用于Job 之间的协同控制,使用图形化的方式来将多个Job 汇集在一起,并指定了Job 之间的执行顺序,逻辑关系和出错处理等。

数据源的连接DataStage 能够直接连接非常多的数据源,应用范围非常大,可连接的数据源包括:•文本文件•XML 文件•企业应用程序,比如SAP 、PeopleSoft 、Siebel 、Oracle Application•几乎所有的数据库系统,比如DB2 、Oracle 、SQL Server 、Sybase ASE/IQ 、Teradata 、Informix 以及可通过ODBC 连接的数据库等•Web Services•SAS 、WebSphere MQServer JobServer Job 中的Stage 综述Stage 是构成Datastage Job 的基本元素,在Server Job 中,Stage 可分为以下五种:1.General2.Database3.File4.Processing5.Real Time本节中将介绍如何使用Datastage 开发一个Server Job。

1、【第一章】datastage简介与工作原理1、简介数据中心(数据仓库)中的数据来自于多种业务数据源,这些数据源可能是不同硬件平台上,使用不同的操作系统,数据模型也相差很远,因而数据以不同的方式存在不同的数据库中。

如何获取并向数据中心(数据仓库)加载这些数据量大、种类多的数据,已成为建立数据中心(数据仓库)所面临的一个关键问题。

针对目前系统的数据来源复杂,而且分析应用尚未成型的现状,专业的数据抽取、转换和装载工具DataStage是最好的选择。

Websphere DataStage 是一套专门对多种操作数据源的数据抽取、转换和维护过程进行简化和自动化,并将其输入数据集市或数据中心(数据仓库)目标数据库的集成工具。

DataStage 能够处理多种数据源的数据,包括主机系统的大型数据库、开放系统上的关系数据库和普通的文件系统等,以下列出它所能处理的主要数据源:大型主机系统数据库:IMS,DB2,ADABAS,VSAM 等开放系统的关系数据库:Informix,Oracle,Sybase,DB2,Microsoft SQL Server等ERP 系统:SAP/R3,PeopleSoft系统等,普通文件和复杂文件系统,FTP 文件系统,XML等IIS,Netscape,Apache等Web服务器系统Outlook等Email系统。

DataStage 可以从多个不同的业务系统中,从多个平台的数据源中抽取数据,完成转换和清洗,装载到各种系统里面。

其中每步都可以在图形化工具里完成,同样可以灵活的被外部系统调度,提供专门的设计工具来设计转换规则和清洗规则等,实现了增量抽取、任务调度等多种复杂而实用的功能。

其中简单的数据转换可以通过在界面上拖拉操作和调用一些DataStage 预定义转换函数来实现,复杂转换可以通过编写脚本或结合其他语言的扩展来实现,并且DataStage 提供调试环境,可以极大提高开发和调试抽取、转换程序的效率。

DATASTAGE的介绍及基本操作DataStage的基本操作包括设计和开发数据集成任务、管理数据集成任务的执行、监控任务的运行状态和性能等。

下面将分别介绍DataStage 的设计和开发、任务管理和监控等方面的基本操作。

1.设计和开发数据集成任务:- 创建项目:在DataStage中创建一个新的项目,并指定项目的名称和存储位置。

-创建作业流:在项目中创建一个新的作业流,并指定作业流的名称和描述。

-添加源和目标:将源数据和目标数据的连接器添加到作业流中,并配置其连接属性。

-设计转换:使用图形化工具将数据转换逻辑以节点的方式添加到作业流中。

可以使用预定义的转换函数、过滤器和聚合函数,并自定义转换规则。

-配置作业参数:为作业流设置参数,例如源数据的路径、目标数据的路径等。

-配置作业调度:定义作业流的调度规则,例如每日、每周或每月执行一次。

2.任务管理:- 启动任务:在DataStage的用户界面中选择要执行的作业流,并单击启动按钮来启动任务。

-监控任务状态:查看任务的运行状态,例如正在运行、已完成或已失败。

-管理调度:可以根据需要修改任务的调度规则,例如修改任务的执行时间或频率。

-管理依赖关系:设置任务之间的依赖关系,例如一个任务的输出作为另一个任务的输入,确保任务按照正确的顺序执行。

3.监控任务:- 实时监控:在DataStage的用户界面中查看任务的实时执行情况,包括输入/输出数据的数量、处理速度、错误记录等。

-查看日志:查看任务执行的详细日志,包括每个节点的执行情况、输入/输出数据的详细信息、转换规则的执行结果等。

-分析性能:分析任务的性能指标,例如任务的执行时间、内存使用情况、CPU利用率等,以优化任务的运行效率。

DataStage还提供了其他高级功能,例如数据质量检查、数据变化捕获和增量加载等。

此外,DataStage与其他数据集成工具和平台的集成也是可能的,例如与大数据处理框架Hadoop、数据仓库工具Teradata等的集成。

简介DataStage 使用了Client-Server 架构,服务器端存储所有的项目和元数据,客户端DataStage Designer 为整个ETL 过程提供了一个图形化的开发环境,用所见即所得的方式设计数据的抽取清洗转换整合和加载的过程。

Datastage 的可运行单元是Datastage Job ,用户在Designer 中对Datastage Job 的进行设计和开发。

Datastage 中的Job 分为Server Job, Parallel Job 和Mainframe Job ,其中Mainframe Job 专供大型机上用,常用到的Job 为Server Job 和Parallel Job 。

本文将介绍如何使用Server Job 和Parallel Job 进行ETL 开发。

Server Job一个Job 就是一个Datastage 的可运行单元。

Server Job 是最简单常用的Job 类型,它使用拖拽的方式将基本的设计单元-Stage 拖拽到工作区中,并通过连线的方式代表数据的流向。

通过Server Job,可以实现以下功能。

1.定义数据如何抽取2.定义数据流程3.定义数据的集合4.定义数据的转换5.定义数据的约束条件6.定义数据的聚载7.定义数据的写入Parallel JobServer Job 简单而强大,适合快速开发ETL 流程。

Parallel Job 与Server Job 的不同点在于其提供了并行机制,在支持多节点的情况下可以迅速提高数据处理效率。

Parallel Job 中包含更多的Stage 并用于不同的需求,每种Stage 使用上的限制也往往大于Server Job。

Sequence JobSequence Job 用于Job 之间的协同控制,使用图形化的方式来将多个Job 汇集在一起,并指定了Job 之间的执行顺序,逻辑关系和出错处理等。

数据源的连接DataStage 能够直接连接非常多的数据源,应用范围非常大,可连接的数据源包括:∙文本文件∙XML 文件∙企业应用程序,比如SAP 、PeopleSoft 、Siebel 、Oracle Application∙几乎所有的数据库系统,比如DB2 、Oracle 、SQL Server 、Sybase ASE/IQ 、Teradata 、Informix 以及可通过ODBC 连接的数据库等∙Web Services∙SAS 、WebSphere MQServer JobServer Job 中的Stage 综述Stage 是构成Datastage Job 的基本元素,在Server Job 中,Stage 可分为以下五种:1.General2.Database3.File4.Processing5.Real Time本节中将介绍如何使用Datastage 开发一个Server Job。

DataStage简单介绍:一、DataStage的特性:DataStage是在构建数据仓库过程中进行数据清洗、数据转换的一套工具。

它的工作流程如下图所示:DataStage包括设计、开发、编译、运行及管理等整套工具。

通过运用DataStage 能够对来自一个或多个不同数据源中的数据进行析取、转换,再将结果装载到一个或多个目的库中。

通过DataStage的处理,最终用户可以得到分析和决策支持所需要的及时而准确的数据及相关信息。

DataStage支持不同种类的数据源和目的库,它既可以直接从Oracle、Sybase 等各种数据库中存取数据,也可以通过ODBC接口访问各种数据库,还支持Sequential file类型的数据源。

这一特性使得多个数据源与目标的连接变得非常简单,可以在单个任务中对多个甚至是无限个数据源和目标进行连接。

DataStage自带了超过300个的预定义库函数和转换,即便是非常复杂的数据转换也可以很轻松的完成。

它的图形化设计工具可以控制任务执行而无须任何脚本。

二、DataStage的架构:DataStage采用C/S模式工作,其结构如下:DatastageServerProjectManager Designer DirectorDataStage 支持多种平台,其Server 端可运行于以下平台:Windows 2000、Windows NT 、COMPAQ Tru64、HP-UX 、IBM AIX 、Sun Solaris ;Client 端支持以下平台:Win95、Win98、Winme 、Windows NT 、Windows 2000;三、功能介绍DataStage 的Server 端由Repository 、DataStage Server 及DataStage Package Installer 三部分组成,Client 端则由DataStage Manager 、DataStage Designer 、DataStage Driect 及DataStage Administrator 四部分组成。

DataStage基础及开发实践InfoSphere DataStage是IBM统一数据集成平台InfoSphere Information Server(IIS) 的重要组件,是业界主流的 ETL(Extract, Transform, Load) 工具。

DataStage执行从源系统到目标系统的批量和实时的数据转换和移动,它广泛支持各种异构平台的数据源和各种类型的数据格式(结构化、半结构化和非结构化数据);通过简单易用的图形化设计方式,并内置丰富的功能组件,从而支持从简单到高度复杂的数据结构中,对大量数据进行收集、清洗、整合和转换,具有满足最苛刻的数据集成需求所需的功能性、灵活性和可伸缩性。

本课程主要介绍InfoSphere DataStage的基本架构和产品特点,并基于实战案例详细讲解DataStage 的安装、配置、开发以及最佳实践。

课程大纲:第一课 IBM数据集成与治理方案简介第二课 Infosphere Datastage 架构、安装与配置第三课 Infosphere Datastage 管理与开发部署流程第四课 Infosphere Datastage 数据连接组件使用第五课 Infosphere Datastage 数据合并、排序与聚合组件使用第六课 Infosphere Datastage 数据转换组件使用第七课 Infosphere Datastage 自定义公共组件与过程第八课 Infosphere Datastage 作业序列和作业控制第九课 Infosphere Datastage 作业调试、调度与监控第十课 Infosphere Datastage 数据血源分析第十一课 Infosphere Datastage 性能调优和最佳实践第十二课 Infosphere Datastage 实战案例分享授课对象:本课程由浅入深,循序渐进地介绍DataStage的基本原理和开发实践,主要面向DataStage 的初学者以及基础开发运维人员。

Funnel阶段Funnel阶段是一个处理阶段。

它将多个输入数据集复制到单个数据集,该操作对于将单独数据集合并到单个大型数据集而言非常有用。

该阶段可以有众多输入链接和一个输出链接Funnel阶段能够以下列三种方式之一运行:1、连续传送以不可保证顺序合并输入数据的记录。

它依次从每个输入链接获取一条记录。

如果输入链接上的数据不可用,那么该阶段会跳至下一个链接,而不是等待。

2、排序传送按照一个或多个键列的值定义的顺序合并输入记录,输出记录的顺序由这绡排序键确定。

3、顺序将第一个输入数据集中的所有记录复制到输出数据集,然后将第二个输入数据集中的所有记录复制到输出数据集,依此类推。

对于所有方法,所有数据数据集的元数据都必须椒相同的。

排序传送方法对于其输入数据有一些特定要求。

所有输入数据集都必须根据Funnel操作的键列进行排序。

通常,排序传送操作的所有输入数据集在排序之前都是散列分区的(选择自动分区方法将确保完成这一操作).散列分区可确保具有相同键列值的所有记录都位于同一分区中,以便在同一个节点上处理。

如果在Funnel阶段之前在单独的阶段上执行排序和分区,那么必须保留该分区排序传送操作允许您设置一个主键和多个辅键以确定将输出的记录的顺序。

Funnel阶段:快速路径InfoSphere DataStage有许多缺省设置,这表示您能够载作业中轻松包含Funnel阶段。

本部分指定了要使Funnel阶段运行所需的最少步骤。

InfoSphere DataStage提供了多样化的用户界面,且提供了许多快捷方式供您达到特定目标,本部分描述了基本方法。

要使用Funnel阶段:1、在“阶段”页面的属性选项卡中,指定“传送类型”。

“连续传送”为缺省值,但也可以选择“顺序”或“排序传送”。

如果选择使用“排序传送”方法,则还需要指定对数据进行排序所依据的键。

可以重复使用键属性来指定组合键。

2、如果使用“顺序”方法,请在“阶段”页面的“链接排序”选项卡中,指定合并数据集的顺序。

1、【第一章】datastage简介与工作原理1、简介数据中心(数据仓库)中的数据来自于多种业务数据源,这些数据源可能是不同硬件平台上,使用不同的操作系统,数据模型也相差很远,因而数据以不同的方式存在不同的数据库中。

如何获取并向数据中心(数据仓库)加载这些数据量大、种类多的数据,已成为建立数据中心(数据仓库)所面临的一个关键问题。

针对目前系统的数据来源复杂,而且分析应用尚未成型的现状,专业的数据抽取、转换和装载工具DataStage是最好的选择。

Websphere DataStage 是一套专门对多种操作数据源的数据抽取、转换和维护过程进行简化和自动化,并将其输入数据集市或数据中心(数据仓库)目标数据库的集成工具。

DataStage 能够处理多种数据源的数据,包括主机系统的大型数据库、开放系统上的关系数据库和普通的文件系统等,以下列出它所能处理的主要数据源:大型主机系统数据库:IMS,DB2,ADABAS,VSAM 等开放系统的关系数据库:Informix,Oracle,Sybase,DB2,Microsoft SQL Server等ERP 系统:SAP/R3,PeopleSoft系统等,普通文件和复杂文件系统,FTP 文件系统,XML等IIS,Netscape,Apache等Web服务器系统Outlook等Email系统。

DataStage 可以从多个不同的业务系统中,从多个平台的数据源中抽取数据,完成转换和清洗,装载到各种系统里面。

其中每步都可以在图形化工具里完成,同样可以灵活的被外部系统调度,提供专门的设计工具来设计转换规则和清洗规则等,实现了增量抽取、任务调度等多种复杂而实用的功能。

其中简单的数据转换可以通过在界面上拖拉操作和调用一些DataStage 预定义转换函数来实现,复杂转换可以通过编写脚本或结合其他语言的扩展来实现,并且DataStage 提供调试环境,可以极大提高开发和调试抽取、转换程序的效率。