模糊C均值聚类程序

- 格式:doc

- 大小:127.00 KB

- 文档页数:8

模糊C均值聚类算法及实现摘要:模糊聚类是一种重要数据分析和建模的无监督方法。

本文对模糊聚类进行了概述,从理论和实验方面研究了模糊c均值聚类算法,并对该算法的优点及存在的问题进行了分析。

该算法设计简单,应用范围广,但仍存在容易陷入局部极值点等问题,还需要进一步研究。

关键词:模糊c均值算法;模糊聚类;聚类分析Fuzzy c-Means Clustering Algorithm and ImplementationAbstract: Fuzzy clustering is a powerful unsupervised method for the analysis of data and construction of models.This paper presents an overview of fuzzy clustering and do some study of fuzzy c-means clustering algorithm in terms of theory and experiment.This algorithm is simple in design,can be widely used,but there are still some problems in it,and therefore,it is necessary to be studied further.Key words: fuzzy c-Mean algorithm;fuzzy clustering;clustering analysis1 引言20世纪90年代以来,随着信息技术和数据库技术的迅猛发展,人们可以非常方便地获取和存储大量的数据。

但是,面对大规模的数据,传统的数据分析工具只能进行一些表层的处理,比如查询、统计等,而不能获得数据之间的内在关系和隐含的信息。

为了摆脱“数据丰富,知识贫乏”的困境,人们迫切需要一种能够智能地、自动地把数据转换成有用信息和知识的技术和工具,这种对强有力数据分析工具的迫切需求使得数据挖掘技术应运而生。

模糊c 均值算法

模糊c均值算法,也叫Fuzzy C Means算法,是一种无监督的聚类算法。

与传统的聚类算法不同的是,模糊C均值算法允许同一样本点被划分到不同的簇中,而且每个样本点到各个簇的距离(或者说相似度)用模糊数表示,因而能更好地处理样本不清晰或重叠的情况。

模糊c均值算法的步骤如下:

1. 初始化隶属度矩阵U,每个样本到每个簇的隶属度都为0-1之间的一个随机数。

2. 计算质心向量,其中每一项的值是所有样本的对应向量加权后的和,权重由隶属度矩阵决定。

3. 根据计算得到的质心向量计算新的隶属度矩阵,更新每个样本点到每个簇的隶属度。

4. 如果隶属度矩阵的变化小于一个预先设定的阈值或者达到了最大迭代次数,则停止;否则,回到步骤2。

模糊c均值算法是一种迭代算法,需要进行多次迭代,直到满足一定的停止条件。

同时,该算法对于隶属度矩阵的初始值敏感,不同的初始值可能会导致不

同的聚类结果。

FCM模糊c均值1、原理详解模糊c-均值聚类算法fuzzy c-means algorithm (FCMA)或称(FCM)。

在众多模糊聚类算法中,模糊C-均值(FCM)算法应用最广泛且较成功,它通过优化目标函数得到每个样本点对所有类中心的隶属度,从而决定样本点的类属以达到自动对样本数据进行分类的目的。

聚类的经典例子然后通过机器学习中提到的相关的距离开始进行相关的聚类操作经过一定的处理之后可以得到相关的cluster,而cluster之间的元素或者是矩阵之间的距离相对较小,从而可以知晓其相关性质与参数较为接近C-Means Clustering:固定数量的集群。

每个群集一个质心。

每个数据点属于最接近质心对应的簇。

1.1关于FCM的流程解说其经典状态下的流程图如下所示集群是模糊集合。

一个点的隶属度可以是0到1之间的任何数字。

一个点的所有度数之和必须加起来为1。

1.2关于k均值与模糊c均值的区别k均值聚类:一种硬聚类算法,隶属度只有两个取值0或1,提出的基本根据是“类内误差平方和最小化”准则,进行相关的必要调整优先进行优化看是经典的欧拉距离,同样可以理解成通过对于cluster的类的内部的误差求解误差的平方和来决定是否完成相关的聚类操作;模糊的c均值聚类算法:一种模糊聚类算法,是k均值聚类算法的推广形式,隶属度取值为[0 1]区间内的任何数,提出的基本根据是“类内加权误差平方和最小化”准则;这两个方法都是迭代求取最终的聚类划分,即聚类中心与隶属度值。

两者都不能保证找到问题的最优解,都有可能收敛到局部极值,模糊c均值甚至可能是鞍点。

1.2.1关于kmeans详解K-means算法是硬聚类算法,是典型的基于原型的目标函数聚类方法的代表,它是数据点到原型的某种距离作为优化的目标函数,利用函数求极值的方法得到迭代运算的调整规则。

K-means算法以欧式距离作为相似度测度,它是求对应某一初始聚类中心向量V最优分类,使得评价指标J最小。

模糊c均值聚类算法C均值聚类算法(C-Means Clustering Algorithm)是一种常用的聚类算法,目的是将一组数据点分成若干个类群,使得同一类群内的数据点尽可能相似,不同类群之间的数据点尽可能不相似。

与K均值聚类算法相比,C均值聚类算法允许一个数据点属于多个类群。

C均值聚类算法的基本思想是随机选择一组初始聚类中心,然后通过迭代的方式将数据点分配到不同的类群,并调整聚类中心,直到满足停止条件。

算法的停止条件可以是固定的迭代次数,或者是聚类中心不再改变。

具体而言,C均值聚类算法的步骤如下:1.随机选择k个初始聚类中心,其中k是预先设定的类群数量。

2.根据欧氏距离或其他距离度量方法,计算每个数据点到每个聚类中心的距离。

3.将每个数据点分配到距离最近的聚类中心的类群。

4.根据聚类中心的分配情况,更新聚类中心的位置。

如果一个数据点属于多个类群,则根据各个类群的权重计算新的聚类中心位置。

5.重复步骤2到4,直到满足停止条件。

C均值聚类算法的优点是灵活性高,可以允许一个数据点属于多个类群。

这在一些应用场景中非常有用,例如一个商品可以属于多个类别。

然而,C均值聚类算法的缺点是计算复杂度较高,对初始聚类中心的选择敏感,以及类群数量k的确定比较困难。

为了解决C均值聚类算法的缺点,可以采用如下方法进行改进:1.使用聚类效度指标来评估聚类结果的好坏,并选择最优的聚类中心数量k。

2. 采用加速算法来减少计算复杂度,例如K-means++算法可以选择初始聚类中心,避免随机选择的可能不理想的情况。

3.对数据进行预处理,例如归一化或标准化,可以提高算法的收敛速度和聚类质量。

4.针对特定应用场景的需求,可以根据数据属性来调整聚类中心的权重计算方式,以适应特定的业务需求。

总结起来,C均值聚类算法是一种常用的聚类算法,与K均值聚类算法相比,它可以允许一个数据点属于多个类群。

然而,C均值聚类算法也存在一些缺点,例如计算复杂度高,对初始聚类中心的选择敏感等。

在Matlab中使用模糊C均值聚类进行图像分析的技巧在图像分析领域,模糊C均值聚类(FCM)是一种常用的工具,它可以帮助我们发现图像中隐藏的信息和模式。

通过使用Matlab中的模糊逻辑工具箱,我们可以轻松地实现FCM算法,并进行图像分析。

本文将介绍在Matlab中使用FCM进行图像分析的技巧。

首先,让我们简要了解一下FCM算法。

FCM是一种基于聚类的图像分割方法,它将图像的像素分为不同的聚类,每个聚类代表一类像素。

与传统的C均值聚类算法不同,FCM允许像素属于多个聚类,因此能够更好地处理图像中的模糊边界。

在Matlab中使用FCM进行图像分析的第一步是加载图像。

可以使用imread函数将图像加载到Matlab的工作区中。

例如,我们可以加载一张名为“image.jpg”的图像:```matlabimage = imread('image.jpg');```加载图像后,可以使用imshow函数显示图像。

这可以帮助我们对图像有一个直观的了解:```matlabimshow(image);```接下来,我们需要将图像转换为灰度图像。

这是因为FCM算法通常用于灰度图像分析。

可以使用rgb2gray函数将彩色图像转换为灰度图像:```matlabgrayImage = rgb2gray(image);```在使用FCM算法之前,我们需要对图像进行预处理。

预处理的目的是消除图像中的噪声和不必要的细节,从而更好地提取图像中的特征。

常用的图像预处理方法包括平滑、锐化和边缘检测等。

Matlab中提供了许多图像预处理函数。

例如,可以使用imnoise函数向图像中添加高斯噪声:```matlabnoisyImage = imnoise(grayImage, 'gaussian', 0, 0.01);```还可以使用imfilter函数对图像进行平滑处理。

常见的平滑方法包括均值滤波和高斯滤波:```matlabsmoothImage = imfilter(noisyImage, fspecial('average', 3));```一旦完成预处理步骤,我们就可以使用模糊逻辑工具箱中的fcm函数执行FCM算法。

模糊聚类算法的原理和实现方法模糊聚类算法是一种数据分类和聚类方法,它在实际问题中有着广泛的应用。

本文将介绍模糊聚类算法的原理和实现方法,包括模糊C均值(FCM)算法和模糊神经网络(FNN)算法。

一、模糊聚类算法的原理模糊聚类算法是基于模糊理论的一种聚类方法,它的原理是通过对数据进行模糊分割,将每个数据点对应到多个聚类中心上,从而得到每个数据点属于各个聚类的置信度。

模糊聚类算法的原理可以用数学公式进行描述。

设有n个数据样本点X={x1, x2, ..., xn},以及m个聚类中心V={v1, v2, ..., vm}。

对于每个数据样本点xi,令uij为其属于第j个聚类中心的置信度,其中j=1,2,..., m,满足0≤uij≤1,且∑uij=1。

根据模糊理论,uij的取值表示了xi属于第j个聚类中心的隶属度。

为了达到聚类的目的,我们需要对聚类中心进行调整,使得目标函数最小化。

目标函数的定义如下:J = ∑∑(uij)^m * d(xi,vj)^2其中,m为模糊度参数,d(xi,vj)为数据点xi与聚类中心vj之间的距离,常用的距离度量方法有欧氏距离和曼哈顿距离。

通过不断调整聚类中心的位置,最小化目标函数J,即可得到模糊聚类的结果。

二、模糊C均值(FCM)算法的实现方法模糊C均值算法是模糊聚类算法中最经典的一种方法。

其具体实现过程如下:1. 初始化聚类中心:随机选取m个数据点作为初始聚类中心。

2. 计算隶属度矩阵:根据当前聚类中心,计算每个数据点属于各个聚类中心的隶属度。

3. 更新聚类中心:根据隶属度矩阵,更新聚类中心的位置。

4. 判断是否收敛:判断聚类中心的变化是否小于设定的阈值,如果是则停止迭代,否则返回第2步。

5. 输出聚类结果:将每个数据点分配到最终确定的聚类中心,得到最终的聚类结果。

三、模糊神经网络(FNN)算法的实现方法模糊神经网络算法是一种基于模糊理论和神经网络的聚类方法。

其实现过程和传统的神经网络类似,主要包括以下几个步骤:1. 网络结构设计:确定模糊神经网络的层数和每层神经元的个数。

模糊c均值聚类算法

模糊c均值聚类算法(Fuzzy C-Means Algorithm,简称FCM)是一种基于模糊集理论的聚类分析算法,它是由Dubes 和Jain于1973年提出的,也是用于聚类数据最常用的算法之

一。

fcm算法假设数据点属于某个聚类的程度是一个模糊

的值而不是一个确定的值。

模糊C均值聚类算法的基本原理是:将数据划分为k个

类别,每个类别有c个聚类中心,每个类别的聚类中心的模糊程度由模糊矩阵描述。

模糊矩阵是每个样本点与每个聚类中心的距离的倒数,它描述了每个样本点属于每个聚类中心的程度。

模糊C均值聚类算法的步骤如下:

1、初始化模糊矩阵U,其中每一行表示一个样本点,每

一列表示一个聚类中心,每一行的每一列的值表示该样本点属于该聚类中心的程度,U的每一行的和为

1.

2、计算聚类中心。

对每一个聚类中心,根据模糊矩阵U

计算它的坐标,即每一维特征值的均值。

3、更新模糊矩阵U。

根据每一个样本点与该聚类中心的距离,计算每一行的每一列的值,其中值越大,说明该样本点属于该聚类中心的程度就越大。

4、重复步骤2和步骤

3,直到模糊矩阵U不再变化,即收敛为最优解。

模糊C均值聚类算法的优点在于它可以在每一个样本点属于每一类的程度上,提供详细的信息,并且能够处理噪声数据,因此在聚类分析中应用十分广泛。

然而,其缺点在于计算量较大,而且它对初始聚类中心的选取非常敏感。

模糊 c 均值聚类算法概述模糊 c 均值聚类算法是一种基于模糊逻辑的聚类算法,其通过将每个数据点分配到不同的聚类中心来实现数据的分组。

与传统的 k-means 算法相比,模糊 c 均值聚类算法在处理数据集特征模糊和噪声干扰方面表现更好。

本文将详细介绍模糊 c 均值聚类算法的原理、优点和缺点,以及其在实际应用中的一些场景和方法。

原理模糊 c 均值聚类算法基于模糊集合理论,将每个数据点分配到不同的聚类中心,而不是像 k-means 算法一样将数据点硬性地分配到最近的聚类中心。

算法的核心是定义每个数据点属于每个聚类中心的权重,即模糊度。

具体而言,模糊 c 均值聚类算法的步骤如下:1.初始化聚类中心。

从输入数据中随机选择一些数据作为初始聚类中心。

2.计算每个数据点到每个聚类中心的距离。

可以使用欧氏距离或其他距离度量方法。

3.根据距离计算每个数据点属于每个聚类的模糊度。

模糊度是一个介于 0 和1 之间的值,表示某个数据点属于某个聚类的程度。

4.更新聚类中心。

根据数据点的模糊度重新计算每个聚类的中心位置。

5.重复步骤 2、3 和 4,直到聚类中心的位置不再发生明显变化或达到预定的迭代次数。

优点模糊 c 均值聚类算法相比传统的 k-means 算法具有以下优点:1.模糊度。

模糊 c 均值聚类算法可以为每个数据点分配一个模糊度值,这样可以更好地应对数据集中的噪声和模糊性。

而 k-means 算法仅将数据点硬性分配到最近的聚类中心。

2.灵活性。

模糊 c 均值聚类算法中的模糊度可以解释某个数据点同时属于多个聚类的情况,这在一些实际应用中可能是具有意义的。

3.鲁棒性。

模糊 c 均值聚类算法对初始聚类中心的选择相对不敏感,因此在大多数情况下能够获得较好的聚类结果。

缺点虽然模糊 c 均值聚类算法具有许多优点,但也存在一些缺点:1.计算复杂度。

模糊 c 均值聚类算法需要在每个迭代步骤中计算每个数据点与每个聚类中心的距离,这导致算法的计算复杂度较高。

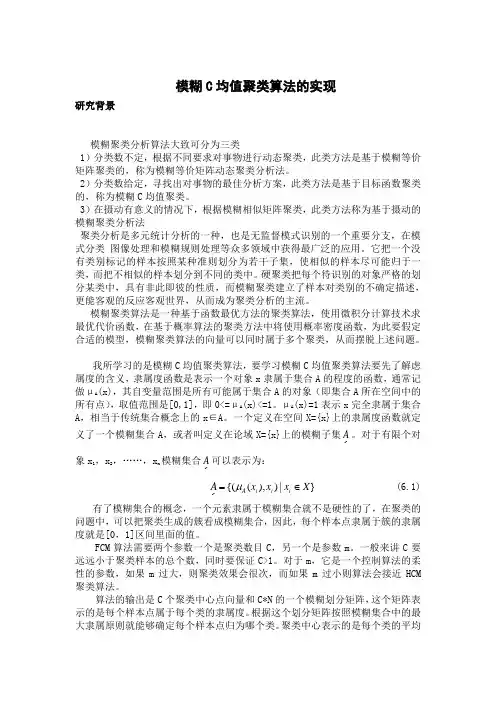

模糊C均值聚类算法的实现研究背景模糊聚类分析算法大致可分为三类1)分类数不定,根据不同要求对事物进行动态聚类,此类方法是基于模糊等价矩阵聚类的,称为模糊等价矩阵动态聚类分析法。

2)分类数给定,寻找出对事物的最佳分析方案,此类方法是基于目标函数聚类的,称为模糊C均值聚类。

3)在摄动有意义的情况下,根据模糊相似矩阵聚类,此类方法称为基于摄动的模糊聚类分析法聚类分析是多元统计分析的一种,也是无监督模式识别的一个重要分支,在模式分类图像处理和模糊规则处理等众多领域中获得最广泛的应用。

它把一个没有类别标记的样本按照某种准则划分为若干子集,使相似的样本尽可能归于一类,而把不相似的样本划分到不同的类中。

硬聚类把每个待识别的对象严格的划分某类中,具有非此即彼的性质,而模糊聚类建立了样本对类别的不确定描述,更能客观的反应客观世界,从而成为聚类分析的主流。

模糊聚类算法是一种基于函数最优方法的聚类算法,使用微积分计算技术求最优代价函数,在基于概率算法的聚类方法中将使用概率密度函数,为此要假定合适的模型,模糊聚类算法的向量可以同时属于多个聚类,从而摆脱上述问题。

我所学习的是模糊C均值聚类算法,要学习模糊C均值聚类算法要先了解虑属度的含义,隶属度函数是表示一个对象x隶属于集合A的程度的函数,通常记做μA(x),其自变量范围是所有可能属于集合A的对象(即集合A所在空间中的所有点),取值范围是[0,1],即0<=μA (x)<=1。

μA(x)=1表示x完全隶属于集合A,相当于传统集合概念上的x∈A。

一个定义在空间X={x}上的隶属度函数就定义了一个模糊集合A,或者叫定义在论域X={x}上的模糊子集~A。

对于有限个对象x1,x2,……,xn模糊集合~A可以表示为:}|)),({(~XxxxAiiiA∈=μ (6.1)有了模糊集合的概念,一个元素隶属于模糊集合就不是硬性的了,在聚类的问题中,可以把聚类生成的簇看成模糊集合,因此,每个样本点隶属于簇的隶属度就是[0,1]区间里面的值。

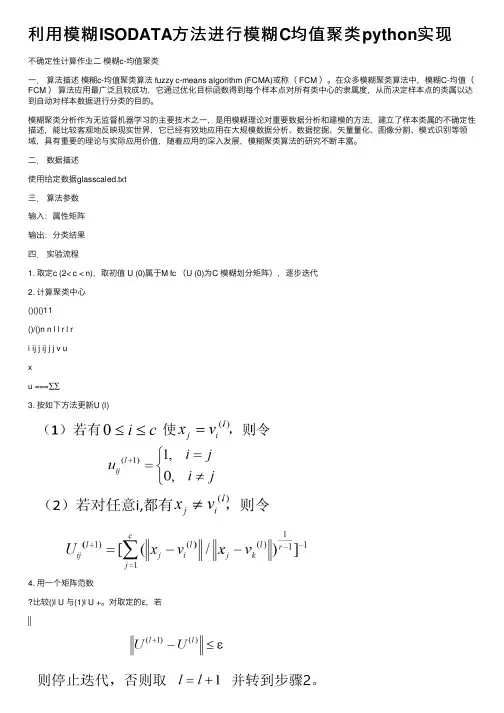

利⽤模糊ISODATA⽅法进⾏模糊C均值聚类python实现不确定性计算作业⼆模糊c-均值聚类⼀.算法描述模糊c-均值聚类算法 fuzzy c-means algorithm (FCMA)或称( FCM )。

在众多模糊聚类算法中,模糊C-均值(FCM )算法应⽤最⼴泛且较成功,它通过优化⽬标函数得到每个样本点对所有类中⼼的⾪属度,从⽽决定样本点的类属以达到⾃动对样本数据进⾏分类的⽬的。

模糊聚类分析作为⽆监督机器学习的主要技术之⼀,是⽤模糊理论对重要数据分析和建模的⽅法,建⽴了样本类属的不确定性描述,能⽐较客观地反映现实世界,它已经有效地应⽤在⼤规模数据分析、数据挖掘、⽮量量化、图像分割、模式识别等领域,具有重要的理论与实际应⽤价值,随着应⽤的深⼊发展,模糊聚类算法的研究不断丰富。

⼆.数据描述使⽤给定数据glasscaled.txt三.算法参数输⼊:属性矩阵输出:分类结果四.实验流程1. 取定c (2< c < n),取初值 U (0)属于M fc (U (0)为C 模糊划分矩阵),逐步迭代2. 计算聚类中⼼()()()11()/()n n l l r l ri ij j ij j j v uxu ===∑∑3. 按如下⽅法更新U (l)4. ⽤⼀个矩阵范数⽐较()l U 与(1)l U +。

对取定的ε,若五.实验结果六.讨论模糊聚类分析作为⽆监督机器学习的主要技术之⼀,是⽤模糊理论对重要数据分析和建模的⽅法,建⽴了样本类属的不确定性描述,能⽐较客观地反映现实世界,它已经有效地应⽤在⼤规模数据分析、数据挖掘、⽮量量化、图像分割、模式识别等领域,具有重要的理论与实际应⽤价值,随着应⽤的深⼊发展,模糊聚类算法的研究不断丰富。

模糊c均值聚类方法(一)模糊C均值聚类方法(Fuzzy C-Means Clustering Methods)简介模糊C均值聚类方法是一种基于模糊理论的聚类算法,它能够对数据集进行划分并确定每个数据点属于每个聚类的隶属度。

与传统的C 均值聚类方法相比,模糊C均值聚类方法能够更好地处理数据的不确定性和模糊性。

原理定义假设有一个包含n个数据点的数据集X = {x1, x2, …, xn},其中每个数据点x所属的聚类集合表示为U = {u(ij)},其中i表示数据点的索引,j表示聚类的索引。

在模糊C均值聚类方法中,聚类中心被表示为C = {c1, c2, …, ck},其中k表示聚类的数量。

每个数据点x(i)到各个聚类中心的隶属度u(ij)满足以下约束条件:1.u(ij) >= 02.sum(u(ij)) = 1 for all i目标函数模糊C均值聚类方法通过最小化以下目标函数来确定聚类中心和隶属度:J = sum(sum(u(ij)^m * ||x(i) - c(j)||^2))其中,m是一个控制聚类模糊程度的参数,通常取大于1的值。

算法步骤1.初始化隶属度矩阵U和聚类中心矩阵C。

2.对每个数据点x(i),计算其到每个聚类中心c(j)的隶属度u(ij)。

3.更新聚类中心矩阵C,计算每个聚类中心c(j)的新值。

4.如果聚类中心矩阵C的变化小于设定的阈值,跳转到步骤6;否则,跳转到步骤2。

5.输出聚类结果。

6.结束。

变体方法模糊C均值聚类方法有许多变体,下面介绍几种常见的变体方法:FCMFCM(Fuzzy C-Means)是模糊C均值聚类方法的最经典版本。

它通过在目标函数中引入欧氏距离来衡量数据点与聚类中心之间的相似度。

PCMPCM(Possibilistic C-Means)是一种允许数据点以不确定的隶属度属于多个聚类的模糊聚类方法。

它通过引入一个置信度变量来衡量每个数据点到每个聚类的归属程度。

模糊c-均值聚类算法模糊c-均值聚类算法聚类算法是机器学习领域中的一种非监督学习算法,其目的是将数据集中的数据分成不同的类别。

聚类是一项重要的数据分析技术,对于数据挖掘、可视化和特征提取等领域都有着广泛的应用。

模糊c-均值聚类算法(FCM)是聚类算法中的一种方法,它允许一个数据点属于不同的类别的程度表示为一个0到1之间的值。

模糊c-均值聚类算法是基于c-均值聚类算法的一种改进,c-均值聚类算法是一种经典的划分聚类算法,它将样本集合非随机地分为c个类。

c-均值聚类算法的基本思想是通过计算一组质心(即类别的均值)来分离数据。

这个算法的主要问题是它仅适用于识别在分离超平面上紧密且凸形成团的类别,因此不能很好地处理重叠的类别。

对于数据集中的每个数据点,模糊c-均值聚类算法允许给出改数据点属于不同的类别的程度表示为一个概率值。

这是因为该算法使用的是一种模糊逻辑,即一种可以量化事物不确定性的逻辑,可以被用于处理数据模糊化的问题。

在模糊c-均值聚类算法中,样本之间的距离是通过一种模糊分割矩阵来表示的,该矩阵中每个元素表示一个样本属于一个类别的程度,可以使用分割矩阵计算每个样本属于每个类别的概率。

模糊c-均值聚类算法的优点是它可以自适应地划分数据,使得该算法可以更好地处理数据的重叠和模糊性。

此外,模糊c-均值聚类算法也支持将数据点分配到多个类别中,这可以很好地解决当数据不仅仅具有单一特征时的问题。

同样,该算法还可以被用于图像分割和空间分析等领域。

在实际应用中,模糊c-均值聚类算法通常需要设置一些参数,例如类别数量c、模糊指数m和迭代次数k等。

这些参数的不同取值对算法的结果产生影响,因此需要通过实验和调参来调整这些参数。

总结来说,模糊c-均值聚类算法是一种非常强大的数据聚类算法,其能力在于用概率表示每个数据点属于不同类别的程度。

该算法处理数据重叠和模糊性方面表现良好,并且可以应用到数据挖掘、图像处理和空间分析等领域。

模糊c均值聚类算法伪代码模糊C均值聚类(FCM)算法是一种聚类算法,它可以处理某些情况下不适合使用传统的硬聚类算法,例如K均值聚类算法。

FCM算法基于模糊逻辑并使得每个数据点可能属于多个聚类中心。

在本文中,我们将探讨FCM算法的伪代码以及实现细节。

1. 算法背景和目的在进行聚类分析时,我们通常会选择一些硬聚类算法。

例如,K均值算法是其中的一种。

然而,这种算法对于一些数据集效果并不好,这些数据集可能会出现需要更多的类别来划分数据的情况。

在这种情况下,FCM算法是更好的选择。

2. 算法伪代码FCM算法的伪代码如下:输入: 1. X (N维实数向量的数据集) 2. c (聚类数) 3. m (模糊度) 4. e (停止准则)输出: 1. U (每个数据点属于每个类的隶属度矩阵) 2. C (被创建的聚类簇)1. 初始化隶属度矩阵 U = {(u_ij)} u_ij = random value between 0 to 1, 且保证每行之和为12. 迭代更新聚类中心while not converged: 2.1 对任意类心的计算C = {(c1, c2, ..., cn)} ci = sum_j (u_ij^m * x_j) / sum_j (u_ij^m)2.2 对任意数据点的隶属度矩阵的计算U = {(u_ij)} u_ij = [(sum_k { ||x_i - c_j||^2 / ||x_i - c_k||^2} ^ 1/(m-1))]^-12.3 判断是否收敛if ||U - U_last||< e: converged = True else: U_last = U3. 结束返回return (C, U)3. 算法实现细节在实现FCM算法的时候,我们需要注意以下几个细节:1. 初始化U矩阵在FCM算法中,我们需要初始化隶属度矩阵U。

对于每个数据点,在每个类中赋一个初始隶属度值。

每个隶属度值必须在0和1之间,并且每行之和必须为1。

实验二模糊C均值聚类

实验目的:

学会使用MATLAB软件进行模糊C均值聚类,学会如何进行迭代并观察迭代过程。

实验学时:4学时

实验内容:

1、认真阅读guide.doc文件,通过给出的英文的例子学习进行C均值聚类的具体步骤。

2、在学习完所给的例子后进行实际操作。

根据表格提供的固定资本和人力资本等进行聚类分布。

进一步熟悉和掌握熟悉FUZZY CLUSTERING.

实验日期:2013年4月24日

实验过程:

1、查看所给数据表格(如下),由经济学理论知,GDP的产出状况是由固定资本的投入和人力资源的投入决定的。

因此,实际上我们只需要选取固定资本和人力资源这两组数据进行处理就行了。

2、通过学习guide中的范例,将所给的defcm.m程序进行重新编辑。

其具体程序如下:

function [NCentres, M] = defcm(Centres, q)

Tiles = [

5.9489 1.3600 1

4.0308 1.3990 1

2.0314 0.3850 1

1.4208 1.2810 1

8.0396 1.7480 1

2.2450 1.0880 1

3.1038 0.8940 1

2.0523 1.1550 1

1.6534 0.9470 1

2.7298 1.0260 1

1.6223 0.8690 -1

1.0337 0.7960 -1

1.1099 0.9310 -1

0.3114 1.0220 -1

0.8112 0.6140 -1

0.7494 0.7850 -1

1.9210 0.6530 -1

1.3820 1.0000 -1

0.9171 0.6660 -1

0.8342 0.5460 -1

0.8127 0.6200 -1

0.8127 0.6200 -1

1.0410 0.5630 -1

0.5756 0.2990 -1

1.0166 0.4660 -1

1.3588 0.5240 -1

1.0307 0.5740 -1

0.8544 0.4590 -1

1.508 0.5500 -1

1.5036 0.5180 -1

2.0226 0.9110 -1

] ;

% 将固定资本和人力资本的数据按GDP的平均值进行分类,大于平均值的分为一类,记为1,小于平均值的分为一类,记为-1

Tiles(:, 1) = log(Tiles(:, 1)) ;

Tiles(:, 2) = log(Tiles(:, 2)) ;

clf ; hold off;

plot(Tiles(1:16, 1), Tiles(1:16, 2), 'ob') ;

axis([-1.5 2.5 -1.5 2.5]) ;

xlabel('固定资本') ;

ylabel('人力资本') ;

title('Tiles data: o = whole tiles, * = cracked tiles, x = centres') ;

hold on;

plot(Tiles(17:31, 1), Tiles(17:31, 2), '*b') ;

plot(Centres(:,1), Centres(:,2),'xr') ;

Object = Tiles(:,[1 2])' ;

Centres = Centres' ;

k = length(Centres(:,1));

D = dist(Object, Centres);

M = member(D, q) ;

ClustSums = sum(M) ;

[NoOfObs, NoOfCtrs] = size(M) ;

z = M ./ (ones(NoOfObs,1) * ClustSums) ;

NCentres = Centres' ;

for i = 1:NoOfCtrs,

w = z(:,i) * ones(1,2) ;

NCentres(i,:) = sum(Object' .* w) ;

end ;

3、将上述程序保存为defcm.m文件,然后在命令窗口中输入初始聚类中心Cts = [0.5 0.5; 0.8 0.8],即在这里面我们取了两个聚类中心点,c1=(0.5,0.5)、

c2=(0.8,0.8),并设q=2。

需要注意的是,q越接近1收敛速度越快,但若q=1则为硬C均值聚(HCM)。

然后不断调用函数defcm,[Cts, M] = defcm(Cts,q)。

即在Command窗口中输入:

Cts = [0.5 0.5; 0.8 0.8];

q = 2;

[Cts, M] = defcm(Cts,q)。

本次实验一共迭代了13次,M矩阵才不再变化,达到了最佳聚类中心。

迭代的仿真图形如下所示:

(迭代时只要将Command窗口中Cts中的值换成前一次迭代输出的值即可)第1次迭代仿真的图形

-1.5

-1-0.50

0.51 1.52 2.5

-1.5-1-0.500.51

1.52

2.5固定资本

人力资本

Tiles data: o = whole tiles, * = cracked tiles, x = centres

第6次迭代仿真的图像

-1.5

-1-0.50

0.51 1.52 2.5

-1.5-1-0.500.51

1.52

2.5固定资本

人力资本

Tiles data: o = whole tiles, * = cracked tiles, x = centres

第13次的迭代图形:

-1.5

-1-0.50

0.51 1.52 2.5

-1.5-1-0.500.51

1.52

2.5固定资本

人力资本

Tiles data: o = whole tiles, * = cracked tiles, x = centres

下面为最终的聚类中心和M 矩阵。

Cts =

0.0733 -0.4495 0.7166 -0.0713 M =

0.2683 0.7317 0.2094 0.7906 0.5422 0.4578 0.2945 0.7055 0.3096 0.6904 0.0382 0.9618 0.1241 0.8759 0.0570 0.9430 0.1187 0.8813 0.0780 0.9220 0.1822 0.8178 0.9066 0.0934 0.7226 0.2774 0.6688 0.3312 0.9268 0.0732 0.8565 0.1435 0.2787 0.7213

0.3759 0.6241

0.9650 0.0350

0.9244 0.0756

0.9274 0.0726

0.9274 0.0726

0.9770 0.0230

0.7501 0.2499

0.9048 0.0952

0.8426 0.1574

0.9818 0.0182

0.8865 0.1135

0.7317 0.2683

0.7387 0.2613

0.0012 0.9988

4、由于不能确保FCM收敛于一个最优解,所以我们可以采用不同的初始聚类中心启动该算法,以便用来比较结果。

在Command窗口中输入:

Cts = [0.5 1.0; 1.5 2.0];

q = 2;

[Cts, M] = defcm(Cts,q)

在这次实验一共迭代了15次,M矩阵才不再变化,达到了最佳聚类中心。

在这里只给出第15次,Command窗口中显示的聚类中心值Cts和M矩阵:

通过最终的迭代图可以看出:当初始聚类中心取值不同时,最后的聚类中心点的值也有细微的差别。

FCM是否收敛于一个最优解,不仅与初始聚类中心的选择有关,还与加权指数q有关。

由模糊集的知识我们知道,加权指数q取得过大,聚类效果会很差;q取得过小则算法会接近与HCM聚类算法。

所以下面的仿真中,其他数据不变,取:q=1.1,聚类中心为Cts = [0.5 0.5; 0.8 0.8]。

经过MATLAB仿真后知道,此时只需迭代8次就可达到了最佳聚类中心。

下面只给出第八次迭代的相关数据:

实验小结:

通过这次实验对模糊C均值聚类(FCM)有了近一步的了解,并且结合例子能够进行简单的聚类中心迭代,寻找最佳聚类中心。

另外,通过q取不同的值进行了比较,得到了更快更好的聚类中心。

通过观察实验结果,明确FCM算法的输出是C个聚类中心向量和C*N的一个模糊划分矩阵M,这个矩阵表示的是每个样本点属于每个类的隶属度。

根据这个划分矩阵按照模糊集合中的最大隶属原则就能确定每个样本归哪个类。

聚类中心表示的是每个类的平均特性,可以认为是这个类的代表点。

FCM算法因算法简单、收敛速度快、易于应用计算机实现等特点受到了越来越多人的关注,并应用于各个领域。