双目立体视觉动态角度测量

- 格式:pdf

- 大小:1.78 MB

- 文档页数:4

双目立体视觉测距原理双目立体视觉系统由两个相机组成,每个相机代表一个眼睛。

相机之间的距离通常被称为基线(baseline)。

在观察同一个目标时,两个相机会获取两个稍微不同的图像。

这是因为两个相机的位置不同,导致从不同角度观察到的目标图像有所偏移。

基于这个差异,我们可以使用视差原理来计算目标的距离。

视差是指两个眼睛在看同一个目标时,两个图像中相同物体之间的像素差异。

这个差异是由于目标在三维空间中的位置和相机的视角造成的。

我们可以通过比较两个图像的像素来计算出这个视差。

为了进行视差计算,我们首先需要进行图像配准。

这意味着将两个图像对齐,使得相同的物体在两个图像中位置相同。

这可以通过计算两个图像之间的特征点匹配来实现。

一旦图像对齐完成,我们就可以计算图像中像素之间的视差。

计算视差的常见方法是使用极线约束(Epipolar constraint)和匹配算法。

极线约束是指在双目视觉中,两个相机的对应像素点位于相应极线上。

换句话说,一个像素只能与另一个图像中相同视线上的像素匹配。

这个约束可以减少计算量并提高匹配的准确性。

匹配算法的选择取决于具体的应用需求和计算资源。

一些常见的匹配算法包括块匹配(block matching)、图像金字塔(image pyramid)和灰度共生矩阵(gray-level co-occurrence matrix)方法。

这些算法可以在图像中最佳匹配,并计算出视差值。

一旦获取了视差值,我们可以使用三角测量原理来计算目标的距离。

三角测量基于几何原理,通过知道基线长度和视差值,我们可以计算出目标的距离。

双目立体视觉测距原理有许多应用。

在工业领域,它可以用于机器人导航、三维重建和物体检测。

在医疗领域,双目视觉可以用于辅助手术和视觉康复。

在自动驾驶和无人机等领域,双目视觉可以帮助测量目标距离并进行障碍物检测。

总结起来,双目立体视觉测距原理利用两个相机观察同一目标,并计算出视差值来测量目标的距离。

双目立体视觉测距算法研究共3篇双目立体视觉测距算法研究1双目立体视觉测距算法研究随着机器视觉技术的不断发展,双目立体视觉测距算法逐渐成为了一种广泛应用的测距技术。

双目立体视觉测距算法是通过两个视点来获取立体信息,并计算物体真实距离的一种方法。

本文对双目立体视觉测距算法进行了研究,并分析其在应用中的优势和不足。

一、双目立体视觉测距算法原理双目立体视觉测距算法基于人眼的立体视觉原理,即通过两个视角获取物体的三维信息。

常用的双目立体视觉系统由左右两个相机组成,同时获取场景的两幅图像。

通过对这两幅图像进行处理,计算出物体在左右两幅图像上的像素位置差(视差),从而推算出物体的真实距离。

二、双目立体视觉测距算法优势1.高精度:相较于其他测距方法(如激光测距),双目立体视觉测距算法具有更高的精度,能够在一定范围内实现毫米级别的测距。

2.适用性广:该算法可以适用于多种物体,无论物体大小、形状、材质如何,都可以进行测距。

3.实时性高:双目立体视觉测距算法能够在几毫秒内完成图像处理和测距,实时性较高。

三、双目立体视觉测距算法不足1.对环境影响大:该算法对环境的变化比较敏感,如光照、颜色、纹理等变化会影响到视差计算的准确性。

2.算法复杂度高:该算法相较于其他测距方法具有更高的计算复杂度,需要较高的计算资源支持。

3.视野较小:双目立体视觉测距算法的视野范围相对较小,需要控制好摄像机的位置和摆放角度,否则会影响测距结果的准确性。

四、双目立体视觉测距算法在实际应用中的案例双目立体视觉测距算法已经在多个领域得到了成功应用,以下是一些案例:1.物流自动化:在物流自动化领域,通过双目立体视觉测距算法可以实现对货物的快速识别和分拣,提高分拣效率。

2.智能驾驶:在智能驾驶领域,通过双目立体视觉测距算法可以实现对车辆和行人的快速检测和识别,提高自动驾驶的安全性。

3.机器人制造:在机器人制造领域,通过双目立体视觉测距算法可以实现对工件和机器人的快速识别和定位,提高机器人的自动化程度和生产效率。

平行双目立体视觉是一种利用两个并行的摄像头来创建三维图像的技术。

它通过比较两个或更多摄像头捕获的图像来确定场景中的距离和形状。

这种技术通常用于计算机视觉和机器人视觉中,以实现物体识别、测量和导航。

基本构成:1. 摄像头:这是双目立体视觉系统的核心,它负责捕捉场景的图像。

通常,摄像头会安装在相同的距离和角度,以产生尽可能多的视差。

2. 图像处理:这部分包括对摄像头捕获的图像进行预处理,如去噪、对比度调整和色彩校正等。

这些处理步骤有助于提高后续图像分析的准确性。

3. 特征匹配:这一步骤涉及到将两个摄像头的图像进行匹配,以确定它们之间的视差。

通常使用特征检测算法,如SIFT(尺度不变特征变换)或SURF(加速稳健特征),来识别图像中的关键点。

4. 深度计算:基于匹配的特征点,系统会使用一种算法来估计它们在三维空间中的位置。

这通常涉及到三角测量,即通过两个摄像头的视差信息来计算深度。

5. 立体视觉系统:将两个摄像头的输出进行合并,形成一个立体视觉系统。

这个系统可以提供场景的三维视图,包括物体的距离、形状和纹理等信息。

测量原理:双目立体视觉的基本原理是基于视差,即两个不同角度观察到的图像之间的距离差异。

在双目立体视觉系统中,这种差异被用来创建深度信息。

具体来说:1. 双目立体视觉系统中的摄像头捕获同一场景的图像时,由于存在视角、距离和光线条件等因素的差异,导致图像中的特征点在两个摄像头中的位置略有不同。

2. 通过比较这两个图像的特征点,系统可以确定这些特征点在三维空间中的相对位置。

这个位置就是物体的距离和形状信息。

3. 基于这些信息,系统可以进一步推断出场景中其他物体的深度。

这是因为人类的视觉系统可以根据双眼接收到的视差信息来推断物体的距离和形状。

需要注意的是,双目立体视觉的准确性受到许多因素的影响,如光源条件、镜头畸变和噪声等。

因此,在实际应用中,通常会采用一些优化技术来提高系统的性能,如使用更先进的特征匹配算法、优化相机参数和采用稳健的深度计算方法等。

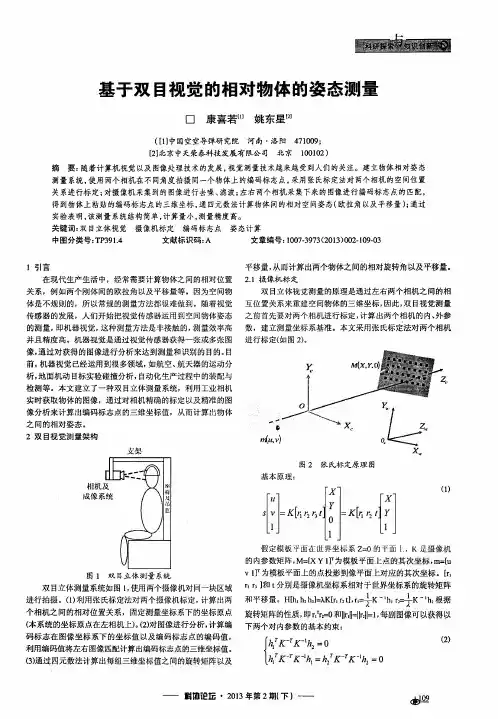

基于双目视觉的相对物体的姿态测量

基于双目视觉的相对物体的姿态测量是一种目前广泛应用于机器人控制和计算机视觉领域的高精度测量方法。

其主要思路是通过两个摄像机同时拍摄同一个物体,在一定的几何模型和运动估计算法的基础上,确定相机相对位置和物体的三维运动,进而计算出物体的姿态参数。

下面简单介绍一下双目视觉的相对物体的姿态测量的基本流程:

1. 对双目图像进行立体匹配:首先需要将左右两个摄像机拍摄的图像进行匹配,得到左右两个图像中同一点的对应关系。

这个过程通常需要处理镜头畸变、背景干扰等多种因素的影响。

2. 求解相机位姿:在确定左右两个图像中同一点的对应关系后,需要求解相机的相对位置。

该过程通常需要使用基础矩阵或本质矩阵等方法。

3. 计算相对运动:通过立体匹配得到左右两个图像中同一点的对应关系后,可以根据三角测量的原理,计算相对物体在三维空间中的运动轨迹。

4. 计算姿态参数:在求得相对运动轨迹后,通过运动估计算法,计算出物体的姿态参数,如位置、旋转角、姿态角等。

总之,基于双目视觉的相对物体的姿态测量可以实现对物体的高精度姿态参数测量,具有应用范围广泛、精度高等优点。

双目测量原理是指通过两个摄像头或相机来获取目标物体的三维空间信息。

它基于人类视觉系统的工作原理,利用两个视点之间的视差来计算目标物体的深度。

双目测量原理的基本步骤如下:

1. 采集图像:使用两个摄像头或相机同时拍摄目标物体的图像。

这两个摄像头或相机需要具有一定的间距,以模拟人类的双眼视觉。

2. 特征点提取:从两个图像中提取出一些特征点,例如角点、边缘等。

这些特征点在两个图像中具有一定的对应关系。

3. 视差计算:通过比较两个图像中特征点的位置差异,可以计算出它们之间的视差。

视差是指同一物体在两个视点下的像素位置差异。

4. 三角测量:利用视差和摄像头之间的几何关系,可以得到目标物体的深度信息。

三角测量是指利用两个视点和目标物体的特征点构成的三角形,通过几何关系计算出目标物体的空间位置。

双目测量原理的优点是可以获取目标物体的三维信息,可以用于距离测量、物体识别和姿态估计等应用。

但也存在一些限制,例如对于光照条件和纹理的要求较高,对于透明物体和反射物体的测量效果较差。

双目视觉测距原理双目视觉测距是一种通过两只眼睛来获取深度信息的方法,它模拟了人类的双眼立体视觉原理。

在人类的视觉系统中,两只眼睛分别观察到的景象有所不同,这种差异被大脑用来计算物体的距离和深度。

双目视觉测距原理正是基于这一原理而来的。

首先,我们需要了解双目视觉系统是如何获取深度信息的。

当物体位于不同位置时,它在两只眼睛中所形成的影像也会有所不同。

这种不同主要体现在两只眼睛所看到的物体的位置和角度上。

通过比较这种不同,我们可以计算出物体的距离和深度。

双目视觉测距的原理基于三角测量法。

在这种方法中,我们假设两只眼睛和被观察物体之间构成一个三角形,通过测量这个三角形的各个边和角度,我们就可以计算出物体的距离和深度。

具体来说,我们可以通过测量两只眼睛之间的距离、两只眼睛到物体的距离以及两只眼睛所看到的物体的角度来计算出物体的距离和深度。

双目视觉测距的原理还可以通过立体成像来解释。

在双目视觉系统中,两只眼睛所看到的景象有所不同,这种差异被大脑用来构建一个立体的视角,从而使我们能够感知到物体的距离和深度。

通过比较两只眼睛所看到的景象,我们可以获得一个立体的视角,从而感知到物体的立体形状和位置。

双目视觉测距原理的应用非常广泛。

在机器人领域,双目视觉测距被广泛应用于机器人的导航和避障系统中。

通过模拟人类的双目视觉系统,机器人可以感知到周围环境的深度信息,从而更加准确地进行导航和避障。

在自动驾驶汽车领域,双目视觉测距也被广泛应用于汽车的环境感知系统中,通过获取周围环境的深度信息,汽车可以更加准确地感知到周围道路和障碍物,从而提高行驶安全性。

总的来说,双目视觉测距原理是一种通过模拟人类双眼立体视觉原理来获取深度信息的方法。

它基于三角测量法和立体成像原理,通过比较两只眼睛所看到的景象来计算物体的距离和深度。

双目视觉测距原理在机器人导航、自动驾驶汽车等领域有着广泛的应用前景,将会在未来发挥越来越重要的作用。

双目立体视觉三维测量原理

1.前言戏说

双目立体视觉是基于视差原理,由多幅图像获取物体三维几何信息的方法。

在机器视觉系统中,双目视觉一般由双摄像机从不同角度同时获取周围景物

的两幅数字图像,或有由单摄像机在不同时刻从不同角度获取周围景物的两

幅数字图像,并基于视差原理即可恢复出物体三维几何信息,重建周围景物

的三维形状与位置。

双目视觉有的时候我们也会把它称为体视,是人类利用双眼获取环境三维信息的主要途径。

从目前来看,随着机器视觉理论的发展,双目立体视觉在

机器视觉研究中发回来看了越来越重要的作用。

本文主要研究了双目视觉的

数学原理。

2.双目立体视觉的数学原理

双目立体视觉是基于视差,由三角法原理进行三维信息的获取,即由两个摄像机的图像平面和北侧物体之间构成一个三角形。

一直两个摄像机之间的。

双目立体视觉测量原理双目立体视觉测量原理是基于人类双眼视觉的原理而设计的。

人类的双眼视觉是由于两只眼睛看到同一场景时,每只眼睛所看到的视角略微不同而产生的。

这种视角上的不同被称为视差,视差可以告诉我们观察的物体离我们有多远。

例如,当我们在街上看到一辆汽车时,我们的左眼和右眼所看到的视角略微不同,这种差异创造了视差,从而让我们知道汽车有多远。

基于这个原理,双目立体视觉测量系统利用两个相机模拟人眼的视觉,并借助计算机技术,解决了单眼视觉无法解决的某些问题。

通过对两只眼睛的视差图像进行处理,我们可以提取出三维信息,这样就可以进行测量。

在双目立体视觉测量系统中,主要有以下四个步骤:图像获取、校正、匹配、重建。

其中,图像获取是指通过两个相机获取同一物体的两幅图像;校正是指将两幅图像进行校正,使它们具有相同的视角和图像质量,从而进行匹配;匹配是指通过匹配两个图像中的像素点,得到它们之间的视差;最后,重建是指根据得到的视差图像,通过计算得到三维坐标。

图像获取是双目立体视觉测量中非常重要的一步,因为它决定了最终的测量精度。

在实际应用中,通常需要选择相机的参数、设置相机的位置和角度等,以便获得高质量的图像。

接下来的校正步骤是为了消除由两个相机拍摄角度不同和位置不同引起的视角畸变,这是为了方便生成精确的深度图像和三维坐标。

匹配是指计算两幅图像中像素的关联程度,以便测量像素之间的距离。

匹配通常采用区域匹配和特征匹配两种方法。

区域匹配是指在同一区域内找到最佳匹配的像素,而特征匹配是根据像素的特征来匹配像素。

匹配的结果是生成两个视差图像,它们显示了每个像素在水平方向上的距离。

最后,重建步骤是根据两个视差图像和相机的参数计算出每个像素的三维坐标。

这样就可以获得整个物体的三维形状和尺寸。

双目立体视觉测量系统在众多领域有广泛的应用,例如医疗、机器人、制造业、安防等。

在医疗方面,它可以帮助医生进行手术操作,提高手术精度。

在机器人领域,双目立体视觉测量系统可以帮助机器人精确测量物体的位置和形状。

双目立体视觉动态角度测量方法郭继平;李阿蒙;于冀平;宋涛;伍沛刚【摘要】为实现对大幅度动态摆角及运动过程中物体空间姿态角的在线测量,提出一种基于双目立体视觉技术的动态角度测量方法.通过标定好的双目系统实时跟踪采集被测物体的特征点图像,重建特征点的空间三维坐标,进而计算出待测物的动态摆角或空间姿态角.实验结果表明:该系统在测量摆角时示值误差为±0.02°,测量空间姿态角时示值误差为±0.12°,同时具有非接触的优点,适用于动态摆角的在线测量及运动物体的空间姿态跟踪.【期刊名称】《中国测试》【年(卷),期】2015(041)007【总页数】4页(P21-23,36)【关键词】动态角度测量;几何量计量;双目立体视觉;在线测量【作者】郭继平;李阿蒙;于冀平;宋涛;伍沛刚【作者单位】深圳市计量质量检测研究院,广东深圳518109;深圳大学光电工程学院,教育部光电子器件与系统重点实验室,广东深圳518060;深圳市计量质量检测研究院,广东深圳518109;深圳市计量质量检测研究院,广东深圳518109;深圳市计量质量检测研究院,广东深圳518109;深圳市计量质量检测研究院,广东深圳518109【正文语种】中文随着科技的进步,动态角测量需求越来越多,其中大空间范围内的动态角在线测量问题成为近年来的研究热点[1],如弯折试验机动态弯折角度测量、运动物体的空间姿态角定位跟踪等。

动态角度的大小随时间变化,因此要求其测量方法能够实时记录被测角在各个时间状态下的角度信息。

综观国内外报道,有多种方法可用于探测动态角度[2]。

其中,激光干涉测角方法测量准确度高,通常用于二维微小角度的精密测量[3]。

基于莫尔条纹技术的测角方法系统结构相对简单、分辨率高,但需借助特定的光路才能实现,应用受到一定限制[4]。

基于图像处理技术的测角方法便于进行实时测量,但其测量准确度有待提高,只能探测二维角度的变化[5-8]。

双目视觉检测概述双目视觉检测的原理是通过两个摄像头同时从不同的角度观察同一物体,然后计算物体在两个摄像头图像中的位置差异,从而得到物体的距离。

通过计算两个摄像头的基线、焦距和物体在图像中的像素位移,可以得到物体的实际距离。

双目视觉检测可以用于室内外环境中的机器人导航、物体识别、人脸识别、手势识别等多个领域。

双目视觉检测在物体识别领域也有广泛的应用。

通过获取物体的三维形状信息,可以更加准确地进行物体识别和分类。

与传统的单目视觉检测相比,双目视觉检测可以克服物体遮挡、投影变形等问题,提高物体识别的准确性和鲁棒性。

手势识别是双目视觉检测的另一个重要应用。

通过获取手部的三维形状信息,可以实现手势的实时识别和跟踪。

与传统的单目手势识别相比,双目视觉检测可以更加准确地获取手部的形状和位置信息,提高手势识别的准确性和实时性,进一步扩展了手势识别的应用领域。

双目视觉检测的发展还面临着一些挑战和问题。

首先,双目视觉系统的精度和鲁棒性需要进一步提高,以应对复杂环境中的干扰和噪声。

其次,对于快速移动的物体,双目视觉检测的实时性和准确性也需要改进。

此外,双目视觉检测的成本较高,对硬件设备和计算资源的要求较高,需要进一步降低成本和提高效率。

总之,双目视觉检测是一种应用广泛且具有前景的技术。

通过模仿人类的双眼视觉系统,双目视觉检测可以实现对物体的三维形状、距离、运动信息等的测量和分析。

在机器人导航、物体识别、人脸识别、手势识别等领域都有重要的应用价值。

随着硬件和算法的不断进步,双目视觉检测将会得到更广泛的应用和推广。

双目立体视觉测距原理双目视觉测距原理的基础是视差。

视差是指当两个眼睛观察同一物体时,由于视角的不同,物体在两个眼睛中的位置差异。

这种差异可以用来推算物体距离的远近。

视差的计算过程主要包括两个步骤:一是根据两个图像的相似性找到对应的点,即建立左右视差对应关系;二是通过计算视差值来推算物体的距离。

下面将详细介绍这两个步骤。

在实际应用中,首先需要对场景进行双目摄像机的标定。

这个过程通常包括获取标定板的图像、提取标定板的特征点、计算标定矩阵等步骤。

标定完成后,就可以进行双目视觉测距了。

第一步是建立左右视差对应关系。

通过双目摄像机获取到的两个图像,我们需要找到对应的特征点,从而建立左右视差对应关系。

常用的特征点匹配算法有SIFT、SURF、ORB等。

这些算法能够在两个图像中寻找到相似的特征点,从而找到对应的关系。

第二步是计算视差值。

在得到视差对应关系后,我们可以通过计算视差值来推算物体的距离。

视差值与物体距离之间存在着一定的数学关系,常用的计算方法是三角测量法。

具体而言,根据两个摄像机之间的基线长度、摄像机的焦距和视差值的大小,可以通过简单的数学关系计算出物体的距离。

双目立体视觉测距原理的优点是可以获得比单目视觉更精确的深度信息。

由于两个摄像机观察角度的差异,双目视觉可以获得更多的深度信息。

此外,双目视觉测距也具有一定的鲁棒性,即在一些复杂场景下仍然可以获得较准确的测距结果。

然而,双目视觉测距原理也存在一些局限性。

首先,双目系统的视差范围有限,当物体距离过远或过近时,视差值会超出可接受的范围,这会导致测量结果不准确。

其次,双目系统对环境光照条件和纹理特征的要求较高,如果环境光照变化大或者物体表面没有足够的纹理信息,会影响特征点的提取和匹配,从而降低测距的精度。

总结而言,双目立体视觉测距原理通过模拟人类双眼视觉系统来获得物体的深度信息。

它的基本原理是通过计算两个眼睛观察同一物体时的视差来推算物体的距离。

虽然存在一些局限性,但双目视觉测距技术已经在实际应用中取得了很大的成功,并且在未来的发展中有着广阔的应用前景。

双目视觉测量原理Stereo vision, also known as binocular vision, refers to the ability to perceive depth and three-dimensional structures by integrating the different images received by the left and right eyes. This is made possible by the brain using the differing signals received by each eye to calculate the distance and position of objects in the visual field. 双目视觉是指通过左右眼接收到的不同图像来感知深度和三维结构的能力。

这是通过大脑利用每只眼睛接收到的不同信号来计算视野中物体的距离和位置。

One of the key principles behind stereo vision is triangulation, wherein the brain uses the slight differences in the images receivedby the left and right eyes to calculate the distance to objects in the field of view. This is similar to the way in which surveyors use triangulation to measure distances and map out landscapes. 双目视觉的一个关键原理是三角测量,大脑利用左右眼接收到的图像之间的微小差异来计算视野中物体的距离。

这类似于测量员使用三角测量来测量距离和绘制出景观的方式。

双目视觉测距原理一、引言双目视觉测距是一种通过两个摄像头来获取深度信息的技术,它广泛应用于机器人、无人驾驶、AR/VR等领域。

本文将详细介绍双目视觉测距的原理。

二、基本原理双目视觉测距是基于三角测量原理实现的。

两个摄像头之间的距离已知,通过对同一个物体在两个视野中的像素坐标进行计算,可以得到该物体在空间中的位置。

三、立体匹配立体匹配是双目视觉测距中最关键的环节。

它指的是将左右两个图像中对应点进行匹配,找到它们之间的对应关系。

这个过程需要解决以下问题:1. 视差:左右眼看到同一个物体时,由于两个眼睛之间的距离不同,所以它们所看到的图像有所不同。

这种差异就是视差。

通过计算视差可以得到物体与摄像头之间的距离。

2. 匹配:如何找到左右图像中对应点?这需要考虑到光照、纹理等因素。

3. 多解性:当存在多个物体时,如何避免匹配出错?四、视差计算视差计算是双目视觉测距的核心。

它通过计算两个图像中对应点之间的像素差异来得到物体与摄像头之间的距离。

1. BM算法:BM算法是一种基于区域匹配的方法。

它将图像分成若干个小块,然后在每个小块内进行匹配。

这种方法适用于纹理丰富的场景。

2. SGM算法:SGM算法是一种快速而准确的立体匹配算法。

它将左右图像中的每个像素都看作一个节点,然后通过动态规划来求解最优路径。

3. CNN算法:近年来,深度学习技术在双目视觉测距中得到了广泛应用。

通过训练神经网络,可以实现更加准确和稳定的立体匹配。

五、误差分析双目视觉测距存在着多种误差,包括:1. 视差误差:由于光照、纹理等因素的影响,视差计算存在误差。

2. 系统误差:由于摄像头本身存在畸变等问题,会导致系统误差。

3. 运动误差:当物体或摄像头发生运动时,会导致视差计算出现误差。

六、应用场景双目视觉测距广泛应用于机器人、无人驾驶、AR/VR等领域。

具体应用场景包括:1. 机器人导航:通过双目视觉测距可以实现机器人的自主导航。

2. 无人驾驶:双目视觉测距可以用于无人车辆的障碍物检测和避障。