大数据经典算法c4.5讲解

- 格式:ppt

- 大小:303.50 KB

- 文档页数:22

c4.5算法的基本原理

C4.5算法是一种经典的决策树学习算法,它的基本原理是基于信息论的概念来构建决策树。

该算法使用信息增益作为选择最佳划分属性的标准,信息增益是指在得知一个属性的取值后,对分类的不确定性减少的程度。

具体来说,C4.5算法通过计算每个属性的信息增益,选择信息增益最大的属性作为当前节点的划分属性,然后递归地对每个子节点进行相同的操作,直到满足停止条件为止。

另外,C4.5算法在构建决策树的过程中使用了剪枝技术,以避免过拟合的问题。

剪枝是指对已生成的决策树进行修剪,去除一些不必要的节点,从而提高决策树的泛化能力。

此外,C4.5算法还支持处理缺失值和连续值属性,并可以处理多分类问题。

总的来说,C4.5算法的基本原理是基于信息论的概念,通过计算信息增益来选择最佳划分属性,并利用剪枝技术来构建泛化能力强的决策树模型。

基于决策树技术的数据挖掘方法分析和研究——C4.5算法的分析和实现摘要大数据时代已经到来,对数据的处理越来越受到人们的关注,人们迫切需要海量数据背后的重要信息和知识,发现数据中存在的关系和规则,获取有用的知识,并且根据现有数据对未来的发展做出预测。

决策树分类算法C4.5算法是数据挖掘中最常用、最经典的分类算法,能够以图形化的形式表现挖掘的结果,从而方便于使用者快速做出决定或预测。

决策树实际在各行业应用非常广泛,如客户资源管理(CRM)系统等。

本报告从决策树的各个方面对决策树进行分析,理解C4.5算法相对于ID3算法的改进,并对C4.5算法加以实现。

同时也指出C4.5算法还存在不足。

一、具体应用场景和意义决策树(Decision Tree)是用于分类和预测的主要技术,它着眼于从一组无规则的样例推理出决策树表示形式的分类规则,采用自顶向下的递归方式,在决策树的内部节点进行属性值的比较,并根据不同属性判断从该节点向下分支,在决策树的叶节点得到结论。

因此,从根节点到叶节点就对应着一条合理规则,整棵树就对应着一组表达式规则。

基于决策树算法的一个最大的优点是它在学习过程中不需要使用者了解很多背景知识,只要训练样例能够用属性-值对的方式表示出来,就能使用该算法进行学习。

决策树算法在很多方面都有应用,如决策树算法在医学、制造和生产、金融分析、天文学、遥感影像分类和分子生物学、机器学习和知识发现等领域得到了广泛应用。

决策树技术是一种对海量数据集进行分类的非常有效的方法。

通过构造决策树模型,提取有价值的分类规则,帮助决策者做出准确的预测已经应用在很多领域。

决策树算法是一种逼近离散函数值的方法。

它是一种典型的分类方法,首先对数据进行处理,利用归纳算法生成可读的规则和决策树,然后对新数据进行分析。

本质上决策树是通过一系列规则对数据进行分类的过程。

决策树的典型算法有ID3、C4.5和CART等,基于决策树的分类模型有如下几个特点:(1)决策树方法结构简单,便于理解;(2)决策树模型效率高,对训练集较大的情况较为适合;(3)决策树方法通常不需要接受训练集数据外的知识;(4)决策树方法具有较高的分类精确度。

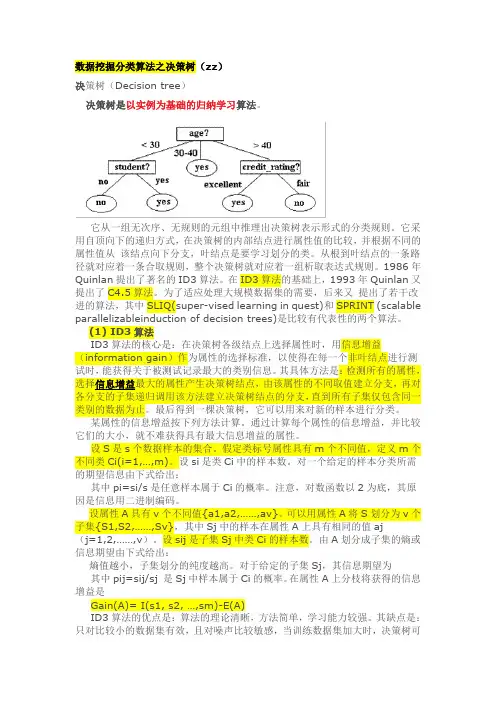

数据挖掘分类算法之决策树(zz)决策树(Decision tree)决策树是以实例为基础的归纳学习算法。

它从一组无次序、无规则的元组中推理出决策树表示形式的分类规则。

它采用自顶向下的递归方式,在决策树的内部结点进行属性值的比较,并根据不同的属性值从该结点向下分支,叶结点是要学习划分的类。

从根到叶结点的一条路径就对应着一条合取规则,整个决策树就对应着一组析取表达式规则。

1986年Quinlan提出了著名的ID3算法。

在ID3算法的基础上,1993年Quinlan又提出了C4.5算法。

为了适应处理大规模数据集的需要,后来又提出了若干改进的算法,其中SLIQ(super-vised learning in quest)和SPRINT (scalable parallelizableinduction of decision trees)是比较有代表性的两个算法。

(1) ID3算法ID3算法的核心是:在决策树各级结点上选择属性时,用信息增益(information gain)作为属性的选择标准,以使得在每一个非叶结点进行测试时,能获得关于被测试记录最大的类别信息。

其具体方法是:检测所有的属性,选择信息增益最大的属性产生决策树结点,由该属性的不同取值建立分支,再对各分支的子集递归调用该方法建立决策树结点的分支,直到所有子集仅包含同一类别的数据为止。

最后得到一棵决策树,它可以用来对新的样本进行分类。

某属性的信息增益按下列方法计算。

通过计算每个属性的信息增益,并比较它们的大小,就不难获得具有最大信息增益的属性。

设S是s个数据样本的集合。

假定类标号属性具有m个不同值,定义m个不同类Ci(i=1,…,m)。

设si是类Ci中的样本数。

对一个给定的样本分类所需的期望信息由下式给出:其中pi=si/s是任意样本属于Ci的概率。

注意,对数函数以2为底,其原因是信息用二进制编码。

设属性A具有v个不同值{a1,a2,……,av}。

c4.5决策树算法原理决策树是一种常用的机器学习算法,用于分类和回归问题。

C4.5算法是决策树算法中的一种改进型,相较于其他决策树算法,C4.5在生成决策树的过程中进行了优化,使其具有更高的分类准确率和性能。

**一、决策树算法简介**决策树是一种基于树形结构的分类模型,通过递归地将数据集划分为若干个子集,直到满足某种终止条件(如空子集或达到预设的停止条件)为止。

在每个划分节点处,根据数据特征进行分类或回归,并计算每个分支的代价和信息增益,以确定最优划分方式。

**二、C4.5算法原理**C4.5算法是对传统决策树算法的改进,主要包括以下几点:1. 剪枝策略:C4.5算法引入了剪枝策略,对生成的决策树进行优化,避免过拟合现象的发生。

通过设置停止条件和剪枝比例,可以控制决策树的复杂度,提高模型的泛化能力。

2. 适应度函数优化:C4.5算法在生成决策树的过程中,优化了适应度函数,使其更适用于连续值和离散值的分类问题。

通过对不同类型的数据进行不同的处理方式,可以提高分类准确率。

3. 考虑噪声和离群点:C4.5算法在生成决策树的过程中,会考虑噪声和离群点的存在。

通过对噪声进行平滑处理,对离群点进行特殊处理,可以提高决策树的鲁棒性。

4. 特征选择:C4.5算法在生成决策树的过程中,引入了特征选择机制,通过计算特征重要性得分,选择对分类影响最大的特征,以提高决策树的性能。

**三、应用场景**C4.5算法适用于各种分类和回归问题,尤其适用于数据量大、非线性可分的数据集。

在金融、医疗、保险、生物信息学等领域都有广泛的应用。

**四、总结**C4.5算法通过引入剪枝策略、优化适应度函数、考虑噪声和离群点以及特征选择等机制,对传统决策树算法进行了改进,提高了模型的分类准确率和性能。

在实际应用中,可以根据具体问题选择合适的算法和参数,以达到最佳的分类效果。

C4.5算法详解(非常仔细)...首先,C4.5是决策树算法的一种。

决策树算法作为一种分类算法,目标就是将具有p维特征的n个样本分到c个类别中去。

相当于做一个投影,c=f(n),将样本经过一种变换赋予一种类别标签。

决策树为了达到这一目的,可以把分类的过程表示成一棵树,每次通过选择一个特征pi来进行分叉。

那么怎样选择分叉的特征呢?每一次分叉选择哪个特征对样本进行划分可以最快最准确的对样本分类呢?不同的决策树算法有着不同的特征选择方案。

ID3用信息增益,C4.5用信息增益率,CART用gini系数。

下面主要针对C4.5算法,我们用一个例子来计算一下。

上述数据集有四个属性,属性集合A={ 天气,温度,湿度,风速},类别标签有两个,类别集合L={进行,取消}。

1. 计算类别信息熵类别信息熵表示的是所有样本中各种类别出现的不确定性之和。

根据熵的概念,熵越大,不确定性就越大,把事情搞清楚所需要的信息量就越多。

2. 计算每个属性的信息熵每个属性的信息熵相当于一种条件熵。

他表示的是在某种属性的条件下,各种类别出现的不确定性之和。

属性的信息熵越大,表示这个属性中拥有的样本类别越不“纯”。

3. 计算信息增益信息增益的 = 熵 - 条件熵,在这里就是类别信息熵 - 属性信息熵,它表示的是信息不确定性减少的程度。

如果一个属性的信息增益越大,就表示用这个属性进行样本划分可以更好的减少划分后样本的不确定性,当然,选择该属性就可以更快更好地完成我们的分类目标。

信息增益就是ID3算法的特征选择指标。

但是我们假设这样的情况,每个属性中每种类别都只有一个样本,那这样属性信息熵就等于零,根据信息增益就无法选择出有效分类特征。

所以,C4.5选择使用信息增益率对ID3进行改进。

4.计算属性分裂信息度量用分裂信息度量来考虑某种属性进行分裂时分支的数量信息和尺寸信息,我们把这些信息称为属性的内在信息(instrisic information)。

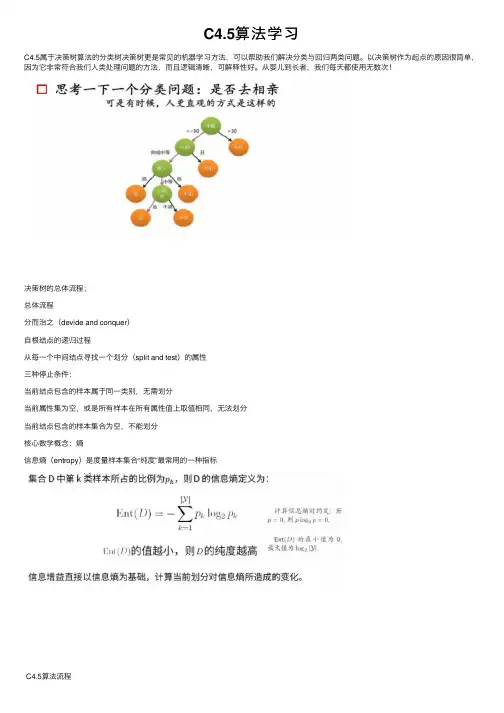

C4.5算法学习C4.5属于决策树算法的分类树决策树更是常见的机器学习⽅法,可以帮助我们解决分类与回归两类问题。

以决策树作为起点的原因很简单,因为它⾮常符合我们⼈类处理问题的⽅法,⽽且逻辑清晰,可解释性好。

从婴⼉到长者,我们每天都使⽤⽆数次!决策树的总体流程;总体流程分⽽治之(devide and conquer)⾃根结点的递归过程从每⼀个中间结点寻找⼀个划分(split and test)的属性三种停⽌条件:当前结点包含的样本属于同⼀类别,⽆需划分当前属性集为空,或是所有样本在所有属性值上取值相同,⽆法划分当前结点包含的样本集合为空,不能划分核⼼数学概念:熵信息熵(entropy)是度量样本集合“纯度”最常⽤的⼀种指标C4.5算法流程C4.5算法优缺点分析优点:(1)通过信息增益率选择分裂属性,克服了ID3算法中通过信息增益倾向于选择拥有多个属性值的属性作为分裂属性的不⾜;(2)能够处理离散型和连续型的属性类型,即将连续型的属性进⾏离散化处理;(3)构造决策树之后进⾏剪枝操作;(4)能够处理具有缺失属性值的训练数据。

缺点:(1)算法的计算效率较低,特别是针对含有连续属性值的训练样本时表现的尤为突出。

(2)算法在选择分裂属性时没有考虑到条件属性间的相关性,只计算数据集中每⼀个条件属性与决策属性之间的期望信息,有可能影响到属性选择的正确性。

算法详解:算法程序while(当前节点不纯)1.计算当前节点的类别熵Info(D)(以类别取值计算)2.计算当前节点的属性熵info(Ai)(按照当前属性取值下的类别取值计算)3.计算各个属性的信息增益Gain(Ai) = Info(D)-info(Ai)4.计算各个属性的分类信息度量H(Ai)(按照属性取值计算)5.计算各个属性的信息增益率 IGR = Gain(Ai)/H(Ai)and while当前节点设置为叶⼦节点。

基于决策树技术的数据挖掘方法分析和研究——C4.5算法的分析和实现摘要大数据时代已经到来,对数据的处理越来越受到人们的关注,人们迫切需要海量数据背后的重要信息和知识,发现数据中存在的关系和规则,获取有用的知识,并且根据现有数据对未来的发展做出预测。

决策树分类算法C4.5算法是数据挖掘中最常用、最经典的分类算法,能够以图形化的形式表现挖掘的结果,从而方便于使用者快速做出决定或预测。

决策树实际在各行业应用非常广泛,如客户资源管理(CRM)系统等。

本报告从决策树的各个方面对决策树进行分析,理解C4.5算法相对于ID3算法的改进,并对C4.5算法加以实现。

同时也指出C4.5算法还存在不足。

一、具体应用场景和意义决策树(Decision Tree)是用于分类和预测的主要技术,它着眼于从一组无规则的样例推理出决策树表示形式的分类规则,采用自顶向下的递归方式,在决策树的内部节点进行属性值的比较,并根据不同属性判断从该节点向下分支,在决策树的叶节点得到结论。

因此,从根节点到叶节点就对应着一条合理规则,整棵树就对应着一组表达式规则。

基于决策树算法的一个最大的优点是它在学习过程中不需要使用者了解很多背景知识,只要训练样例能够用属性-值对的方式表示出来,就能使用该算法进行学习。

决策树算法在很多方面都有应用,如决策树算法在医学、制造和生产、金融分析、天文学、遥感影像分类和分子生物学、机器学习和知识发现等领域得到了广泛应用。

决策树技术是一种对海量数据集进行分类的非常有效的方法。

通过构造决策树模型,提取有价值的分类规则,帮助决策者做出准确的预测已经应用在很多领域。

决策树算法是一种逼近离散函数值的方法。

它是一种典型的分类方法,首先对数据进行处理,利用归纳算法生成可读的规则和决策树,然后对新数据进行分析。

本质上决策树是通过一系列规则对数据进行分类的过程。

决策树的典型算法有ID3、C4.5和CART等,基于决策树的分类模型有如下几个特点:(1)决策树方法结构简单,便于理解;(2)决策树模型效率高,对训练集较大的情况较为适合;(3)决策树方法通常不需要接受训练集数据外的知识;(4)决策树方法具有较高的分类精确度。

C4.5算法的实现一.C4.5算法介绍C4.5算法是机器学习算法中的一种分类决策树算法,其核心算法是ID3算法.C4.5算法继承了ID3算法的优点,并在以下几方面对ID3算法进行了改进:1) 用信息增益率来选择属性,克服了用信息增益选择属性时偏向选择取值多的属性的不足;2) 在树构造过程中进行剪枝;3) 能够完成对连续属性的离散化处理;4) 能够对不完整数据进行处理。

C4.5算法有如下优点:产生的分类规则易于理解,准确率较高。

其缺点是:在构造树的过程中,需要对数据集进行多次的顺序扫描和排序,因而导致算法的低效。

二. 算法实现// C4.5_test.cpp : Defines the entry point for the console application.//#include "stdafx.h"#include <stdio.h>#include <math.h>#include "malloc.h"#include <stdlib.h>const int MAX = 10;int** iInput;int i = 0;//列数int j = 0;//行数void build_tree(FILE *fp, int* iSamples, int* iAttribute,int ilevel);//输出规则int choose_attribute(int* iSamples, int* iAttribute);//通过计算信息增益率选出test_attribute double info(double dTrue,double dFalse);//计算期望信息double entropy(double dTrue, double dFalse, double dAll);//求熵double splitinfo(int* list,double dAll);int check_samples(int *iSamples);//检查samples是否都在同一个类里int check_ordinary(int *iSamples);//检查最普通的类int check_attribute_null(int *iAttribute);//检查attribute是否为空void get_attributes(int *iSamples,int*iAttributeValue,int iAttribute);int _tmain(int argc, _TCHAR* argv[]){FILE *fp;FILE *fp1;char iGet;int a = 0;int b = 0;//a,b是循环变量int* iSamples;int* iAttribute;fp = fopen("c:\\input.txt","r");if (NULL == fp){printf("error\n");return 0;}iGet = getc(fp);while (('\n' != iGet)&&(EOF != iGet)) {if (',' == iGet){i++; }iGet = getc(fp); }i++;iAttribute = (int *)malloc(sizeof(int)*i); for (int k = 0; k<i; k++){iAttribute[k] = (int)malloc(sizeof(int)); iAttribute[k] = 1; }while (EOF != iGet){ if ('\n' == iGet){j++; }iGet = getc(fp); }j++;iInput = (int **)malloc(sizeof(int*)*j);iSamples = (int *)malloc(sizeof(int)*j);for (a = 0;a < j;a++){ iInput[a] = (int *)malloc(sizeof(int)*i); iSamples[a] = (int)malloc(sizeof(int));iSamples[a] = a; }a = 0;fclose(fp);fp=fopen("c:\\input.txt","r");iGet = getc(fp);while(EOF != iGet){ if ((',' != iGet)&&('\n' != iGet)){ iInput[a][b] = iGet - 48;b++; }if (b == i){ a++;b = 0;}iGet = getc(fp); }fp1 = fopen("d:\\output.txt","w");build_tree(fp1,iSamples,iAttribute,0);fclose(fp);return 0;}void build_tree(FILE * fp, int* iSamples, int* iAttribute,int level)//{ int iTest_Attribute = 0;int iAttributeValue[MAX];int k = 0;int l = 0;int m = 0;int *iSamples1;for (k = 0; k<MAX; k++){ iAttributeValue[k] = -1; }if (0 == check_samples(iSamples)){fprintf(fp,"result: %d\n",iInput[iSamples[0]][i-1];return; }if (1 == check_attribute_null(iAttribute)) {fprintf(fp,"result: %d\n",check_ordinary(iSamples));return; }iTest_Attribute = choose_attribute(iSamples,iAttribute);iAttribute[iTest_Attribute] = -1;get_attributes(iSamples,iAttributeValue,iTest_Attribute);k = 0;while ((-1 != iAttributeValue[k])&&(k < MAX)){ l = 0;m = 0;while ((-1 != iSamples[l])&&(l < j)){if(iInput[iSamples[l]][iTest_Attribute]==iAttributeValue[k]){ m++; }l++; }iSamples1 = (int *)malloc(sizeof(int)*(m+1));l = 0;m = 0;while ((-1 != iSamples[l])&&(l < j)){if(iInput[iSamples[l]][iTest_Attribute]==iAttributeValue[k]){ iSamples1[m] = iSamples[l];m++; }l++; }iSamples1[m] = -1;if (-1 == iSamples1[0]){fprintf(fp,"result: %d\n",check_ordinary(iSamples));return; }fprintf(fp,"level%d: %d = %d\n",level,iTest_Attribute,iAttributeValue[k]);build_tree(fp,iSamples1,iAttribute,level+1);k++; }}int choose_attribute(int* iSamples, int* iAttribute){ int iTestAttribute = -1;int k = 0;int l = 0;int m = 0;int n = 0;int iTrue = 0;int iFalse = 0;int iTrue1 = 0;int iFalse1 = 0;int iDepart[MAX];int iRecord[MAX];double dEntropy = 0.0;double dGainratio = 0.0;double test = 0.0;for (k = 0;k<MAX;k++){ iDepart[k] = -1;iRecord[k] = 0; }k = 0;while ((l!=2)&&(k<(i - 1))){ if (iAttribute[k] == -1){ l++; }k++; }if (l == 1){ for (k = 0;k<(k-1);k++){ if (iAttribute[k] == -1){ return iAttribute[k]; } } }for (k = 0;k < (i-1);k++){ l = 0;iTrue = 0;iFalse = 0;if (iAttribute[k] != -1){ while ((-1 != iSamples[l])&&(l < j)){ if (0 == iInput[iSamples[l]][i-1]){ iFalse++; }if (1 == iInput[iSamples[l]][i-1]){ iTrue++; }l++; }for (n = 0;n<l;n++)//计算该属性有多少不同的值并记录 { m = 0;while((iDepart[m]!=-1)&&(m!=MAX)){ if (iInput[iSamples[n]][iAttribute[k]] == iDepart[m]) {break; }m++; }if (-1 == iDepart[m]){ iDepart[m] = iInput[iSamples[n]][iAttribute[k]]; } } while ((iDepart[m] != -1)&&(m!=MAX)){ for (n = 0;n<l;n++){if (iInput[iSamples[n]][iAttribute[k]] == iDepart[m]) {if (1 == iInput[iSamples[n]][i-1]){ iTrue1++; }if (0 == iInput[iSamples[n]][i-1]){ iFalse1++; }iRecord[m]++; } }dEntropy += entropy((double)iTrue1,(double)iFalse1,(double)l);iTrue1 = 0;iFalse1 = 0;m++; }double dSplitinfo = splitinfo(iRecord,(double)l);if (-1 == iTestAttribute){iTestAttribute = k;dGainratio=(info((double)iTrue,(double)iFalse)-dEntropy)/dSplitinfo;} else{test=(info((double)iTrue,(double)iFalse)-dEntro py)/dSplitinfo;if (dGainratio < test){ iTestAttribute = k;dGainratio = test; }}} }return iTestAttribute;}double info(double dTrue,double dFalse){ double dInfo = 0.0;dInfo = ((dTrue/(dTrue+dFalse))*(log(dTrue/(dTrue+dFalse))/log(2 .0))+(dFalse/(dTrue+dFalse))*(log(dFalse/(dTrue+dFalse)) /log(2.0)))*(-1);return dInfo;}double entropy(double dTrue, double dFalse, double dAll) { double dEntropy = 0.0;dEntropy = (dTrue + dFalse)*info(dTrue,dFalse)/dAll;return dEntropy;}double splitinfo(int* list,double dAll){ int k = 0;double dSplitinfo = 0.0;while (0!=list[k]){dSplitinfo-=((double)list[k]/(double)dAll)*(log((double)li st[k]/(double)dAll));k++; }return dSplitinfo;}int check_samples(int *iSamples){ int k = 0;int b = 0;while ((-1 != iSamples[k])&&(k < j-1)){ if (iInput[k][i-1] != iInput[k+1][i-1]){b = 1;break; }k++; }return b;}11int check_ordinary(int *iSamples){ int k = 0;int iTrue = 0;int iFalse = 0;while ((-1 != iSamples[k])&&(k < i)){ if (0 == iInput[iSamples[k]][i-1]){iFalse++; }else{ iTrue++; }k++;}if (iTrue >= iFalse){ return 1;}else{ return 0; }}int check_attribute_null(int *iAttribute){ int k = 0;while (k < (i-1)){if (-1 != iAttribute[k]){ return 0;}k++; }return 1;}void get_attributes(int *iSamples,int12*iAttributeValue,int iAttribute){int k = 0;int l = 0;while ((-1 != iSamples[k])&&(k < j)){l = 0;while (-1 != iAttributeValue[l]){if (iInput[iSamples[k]][iAttribute] == iAttributeValue[l]) { break; }l++; }if (-1 == iAttributeValue[l]){iAttributeValue[l] = iInput[iSamples[k]][iAttribute];}k++;}}13。

c4.5决策树原理C4.5(也称为C5.0)是一种经典的决策树算法,由Ross Quinlan于1993年提出。

它是一种用于机器学习和数据挖掘的强大工具,主要用于分类问题。

以下是C4.5决策树算法的原理概述:1. 信息熵和信息增益:C4.5使用信息熵和信息增益来构建决策树。

信息熵是对数据集的纯度度量,信息增益表示通过某个属性对数据集进行划分所带来的纯度提升。

C4.5的目标是选择信息增益最大的属性作为划分依据。

2. 决策树构建过程:2.1 选择最佳属性:•对每个属性计算信息增益。

•选择信息增益最大的属性作为当前节点的划分属性。

2.2 划分数据集:•使用选定的属性对数据集进行划分,生成子节点。

•对于每个子节点,递归执行上述过程,直到满足停止条件。

2.3 停止条件:•数据集已经纯净(属于同一类别)。

•到达树的最大深度。

•不再有可用属性进行划分。

3. 剪枝:C4.5在决策树构建完成后执行剪枝,以避免过度拟合。

剪枝的目标是去除一些不必要的叶子节点,提高模型的泛化性能。

4. 缺失值处理:C4.5能够处理缺失值,当在某个节点上某个属性的值缺失时,它会考虑所有可能的取值,并按照缺失值所占比例计算信息增益。

5. 数值型属性处理:对于数值型属性,C4.5采用二分法进行处理。

它通过在属性上选择一个阈值,将数据集分为两个子集,然后选择信息增益最大的阈值进行划分。

6. 实例加权:在C4.5中,每个样本都有一个权重,这个权重可以用于调整每个样本在信息增益计算中的贡献度。

7. 优缺点:7.1 优点:•生成的决策树易于理解和解释。

•能够处理混合属性类型。

•能够处理缺失值。

•具有较好的泛化性能。

7.2 缺点:•对噪声敏感。

•生成的树可能过于复杂,需要进行剪枝。

•处理大量数据时可能效率较低。

8. 应用领域:C4.5广泛应用于分类问题,例如医学诊断、金融风险评估、客户分类等领域。

9.C4.5决策树算法通过利用信息熵和信息增益来构建树结构,是一种强大的分类工具。

一、概述决策树分类算法是数据挖掘和机器学习领域中常用的算法之一,它可以用于对数据进行分类和预测。

其中C4.5算法是决策树分类算法中的一种经典方法,它采用了信息增益作为划分属性的标准,具有较好的泛化能力和分类精度。

在实际应用中,C4.5算法被广泛应用于各种领域,本文将介绍C4.5算法的具体应用场景。

二、金融领域1. 信用评分在金融领域,银行和信用卡机构经常需要对客户的信用进行评分,以判断其是否具有偿还借款的能力。

C4.5算法可以根据客户的个人信息、贷款记录和其他相关数据构建决策树模型,用于预测客户的信用水平,帮助金融机构做出信贷决策。

2. 欺诈检测另外,C4.5算法也可以在金融领域用于欺诈检测。

金融交易中存在大量的欺诈行为,通过分析交易数据和客户行为特征,C4.5算法可以构建欺诈检测模型,帮助金融机构及时发现和防范欺诈风险。

三、医疗领域1. 疾病诊断在医疗领域,C4.5算法可以应用于疾病的诊断预测。

通过对医疗数据进行分析,包括患者的症状、体征、生化指标等信息,利用C4.5算法可以建立疾病的分类模型,帮助医生进行疾病诊断和预测,提高诊断的准确性和效率。

2. 药物治疗预测C4.5算法也可以用于预测患者对药物治疗的反应。

通过分析患者的遗传信息、生理特征和药物治疗记录等数据,C4.5算法可以构建个性化的药物治疗模型,帮助医生选择最适合患者的治疗方案,提高治疗效果。

四、市场营销领域1. 客户分类在市场营销领域,企业需要对客户进行分类,以制定针对不同客户裙体的营销策略。

C4.5算法可以根据客户的消费行为、偏好信息、地理位置等数据构建客户分类模型,帮助企业对客户进行精细化管理和营销。

2. 产品推荐C4.5算法还可以用于产品推荐。

通过分析客户的购物历史、浏览行为和偏好信息,C4.5算法可以构建产品推荐模型,帮助企业向客户推荐符合其偏好的产品,提高销售额和客户满意度。

五、交通领域1. 交通流量预测在交通领域,C4.5算法可以应用于交通流量的预测。

C4.5(决策树)C4.5是⼀系列⽤在机器学习和数据挖掘的分类问题中的算法。

它的⽬标是监督学习:给定⼀个数据集,其中的每⼀个元组都能⽤⼀组属性值来描述,每⼀个元组属于⼀个互斥的类别中的某⼀类。

C4.5的⽬标是通过学习,找到⼀个从属性值到类别的映射关系,并且这个映射能⽤于对新的类别未知的实体进⾏分类。

C4.5由J.Ross Quinlan在ID3的基础上提出的。

ID3算法⽤来构造决策树。

决策树是⼀种类似流程图的树结构,其中每个内部节点(⾮树叶节点)表⽰在⼀个属性上的测试,每个分枝代表⼀个测试输出,⽽每个树叶节点存放⼀个类标号。

⼀旦建⽴好了决策树,对于⼀个未给定类标号的元组,跟踪⼀条有根节点到叶节点的路径,该叶节点就存放着该元组的预测。

决策树的优势在于不需要任何领域知识或参数设置,适合于探测性的知识发现。

从ID3算法中衍⽣出了C4.5和CART两种算法,这两种算法在数据挖掘中都⾮常重要。

下图就是⼀棵典型的C4.5算法对数据集产⽣的决策树。

数据集如图1所⽰,它表⽰的是天⽓情况与去不去打⾼尔夫球之间的关系。

图1 数据集图2 在数据集上通过C4.5⽣成的决策树算法描述C4.5并不⼀个算法,⽽是⼀组算法—C4.5,⾮剪枝C4.5和C4.5规则。

下图中的算法将给出C4.5的基本⼯作流程:图3 C4.5算法流程我们可能有疑问,⼀个元组本⾝有很多属性,我们怎么知道⾸先要对哪个属性进⾏判断,接下来要对哪个属性进⾏判断?换句话说,在图2中,我们怎么知道第⼀个要测试的属性是Outlook,⽽不是Windy?其实,能回答这些问题的⼀个概念就是属性选择度量。

属性选择度量属性选择度量⼜称分裂规则,因为它们决定给定节点上的元组如何分裂。

属性选择度量提供了每个属性描述给定训练元组的秩评定,具有最好度量得分的属性被选作给定元组的分裂属性。

⽬前⽐较流⾏的属性选择度量有--信息增益、增益率和Gini指标。

先做⼀些假设,设D是类标记元组训练集,类标号属性具有m个不同值,m个不同类Ci(i=1,2,…,m),CiD是D中Ci类的元组的集合,|D|和|CiD|分别是D和CiD中的元组个数。

c4.5算法的基本原理-回复什么是C4.5算法?C4.5算法是机器学习领域中的一种决策树算法,是ID3算法的改进版本。

它由Ross Quinlan于1993年提出,是一种用于分类问题的监督学习算法。

C4.5算法的基本原理是通过对数据集进行划分来构建决策树,以实现对新样本进行分类。

下面将详细介绍C4.5算法的基本原理和步骤。

C4.5算法的基本原理是基于信息增益来选择最优特征进行划分。

在构建决策树的过程中,C4.5算法通过计算每个特征的信息增益比来选择最优特征,从而实现对数据集的划分。

信息增益是指在得知某个特征的取值后,对分类结果的不确定性减少的程度。

C4.5算法的步骤如下:1. 选择最优特征:计算每个特征的信息增益比,选择具有最大信息增益比的特征作为当前节点的划分特征。

2. 划分数据集:根据划分特征将数据集划分为多个子数据集,每个子数据集包含具有相同特征值的样本。

3. 递归构建子树:对每个子数据集递归地应用步骤1和步骤2,构建子树。

4. 停止划分:当数据集的所有属性都已经被使用或者数据集中的样本都属于同一类别时,停止划分,将当前节点标记为叶节点,并将叶节点标记为数据集中样本数最多的类别。

5. 构建决策树:将步骤3中得到的子树连接到当前节点,构成完整的决策树。

具体来说,C4.5算法的核心步骤是选择最优特征和划分数据集。

在选择最优特征时,C4.5算法通过计算每个特征的信息增益比来选择最优特征。

信息增益比是信息增益除以划分数据集的熵,熵是度量数据集的纯度的指标。

信息增益比能够避免特征取值较多而导致的信息增益偏大的问题,从而更加准确地选择最优特征。

划分数据集是将数据集根据划分特征的取值划分为多个子数据集,每个子数据集包含具有相同特征值的样本。

划分后的子数据集可以分别作为子树的训练数据,递归地构建子树。

每个子树的构建过程都是通过选择最优特征和划分数据集来实现的。

当数据集的所有属性都已经被使用或者数据集中的样本都属于同一类别时,停止划分,将当前节点标记为叶节点,并将叶节点标记为数据集中样本数最多的类别。