信息论基础-中国科学技术大学

- 格式:pdf

- 大小:1.68 MB

- 文档页数:56

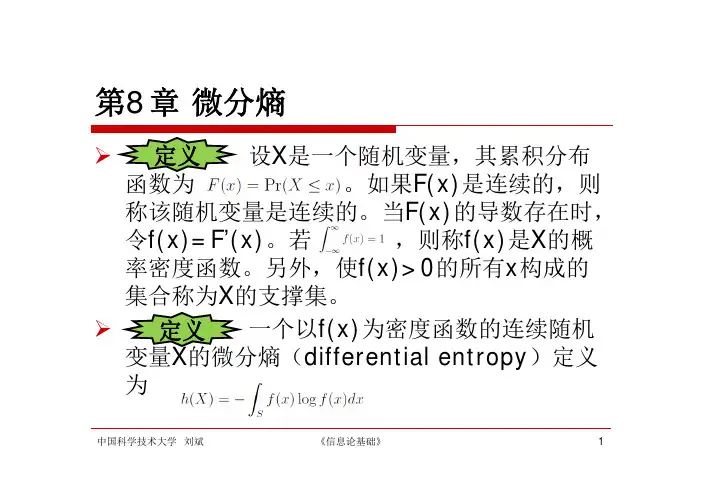

第8章微分熵设X是一个随机变量,其累积分布定义函数为。

如果F(x)是连续的,则称该随机变量是连续的。

当F(x)的导数存在时,令f(x)F(x)。

若,则称f(x)是X的概f(x)=F’(x)率密度函数。

另外,使f(x)>0的所有x构成的集合称为X的支撑集。

一个以f(x)为密度函数的连续随机定义变量X的微分熵(differential entropy)定义为《信息论基础》中国科学技术大学刘斌1第8章微分熵设X是一个随机变量,其累积分布定义函数为。

如果F(x)是连续的,则称该随机变量是连续的。

当F(x)的导数存在时,令f(x)F(x)。

若,则称f(x)是X的概f(x)=F’(x)率密度函数。

另外,使f(x)>0的所有x构成的集合称为X的支撑集。

一个以f(x)为密度函数的连续随机定义变量X的微分熵(differential entropy)定义为《信息论基础》中国科学技术大学刘斌2微分熵的例子[0,a]上的均匀分布:例✓a<1时,h(X)<01时h(X)0正态分布:例《信息论基础》中国科学技术大学刘斌3连续随机变量的AEPAEP :对于一个独立同分布的随机变量序列来说, 设是一个服从密度函数f(x)的独立同分布的随机变量序列,则定理定义 对及任意的n ,定义f(x)的典型集如下定义其中中国科学技术大学刘斌4《信息论基础》连续随机变量的典型集性质集合的体积Vol(A)定义为定义连续随机变量的典型集有如下的性质连续随机变量的典型集有如下的性质:1.对于充分大的n ,定理2.对于所有的n ,33.对于充分大的n ,中国科学技术大学刘斌5《信息论基础》微分熵和离散熵的区别如果随机变量X的密度函数f(x)是黎曼定理可积的,那么《信息论基础》中国科学技术大学刘斌6微分熵和离散熵的区别H(X)是离散意义的熵,是信息熵,无限大h(X)是连续意义的熵,是微分熵h()是连续意义的熵是微分熵微分熵h(X)不代表信源X的平均不确定度,也不代表X每取一个数值所提供的平均信息量,不含有信息度量的内涵《信息论基础》中国科学技术大学刘斌7微分熵和离散熵的区别连续随机变量X经过精确到小数点后n比特位的量化处理后,熵的值大约是h(X)+n般情况下,在精确到位的意义下,()一般情况下,在精确到n h(X)+n 是为了描述X所需的平均比特数。

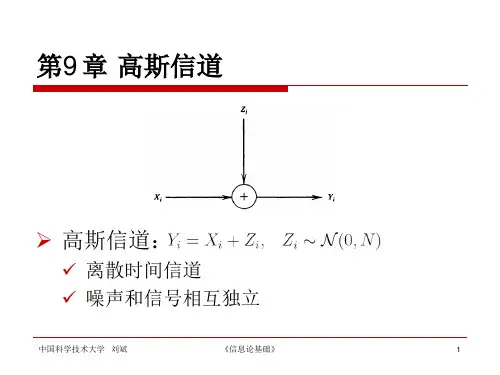

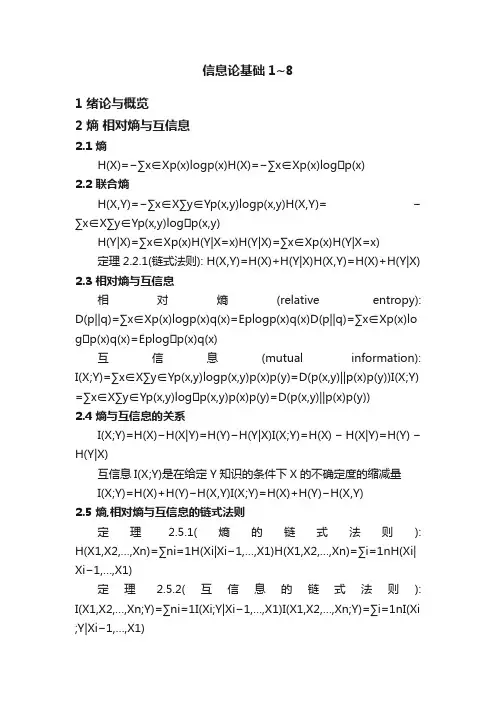

信息论基础1~81 绪论与概览2 熵相对熵与互信息2.1 熵H(X)=−∑x∈X p(x)logp(x)H(X)=−∑x∈Xp(x)logp(x)2.2 联合熵H(X,Y)=−∑x∈X∑y∈Y p(x,y)logp(x,y)H(X,Y)=−∑x∈X∑y∈Yp(x,y)logp(x,y)H(Y|X)=∑x∈X p(x)H(Y|X=x)H(Y|X)=∑x∈Xp(x)H(Y|X=x)定理2.2.1(链式法则): H(X,Y)=H(X)+H(Y|X)H(X,Y)=H(X)+H(Y|X) 2.3 相对熵与互信息相对熵(relative entropy): D(p||q)=∑x∈X p(x)logp(x)q(x)=Eplogp(x)q(x)D(p||q)=∑x∈Xp(x)lo gp(x)q(x)=Eplogp(x)q(x)互信息(mutual information): I(X;Y)=∑x∈X∑y∈Y p(x,y)logp(x,y)p(x)p(y)=D(p(x,y)||p(x)p(y))I(X;Y) =∑x∈X∑y∈Yp(x,y)logp(x,y)p(x)p(y)=D(p(x,y)||p(x)p(y))2.4 熵与互信息的关系I(X;Y)=H(X)−H(X|Y)=H(Y)−H(Y|X)I(X;Y)=H(X)−H(X|Y)=H(Y)−H(Y|X)互信息I(X;Y)是在给定Y知识的条件下X的不确定度的缩减量I(X;Y)=H(X)+H(Y)−H(X,Y)I(X;Y)=H(X)+H(Y)−H(X,Y)2.5 熵,相对熵与互信息的链式法则定理 2.5.1(熵的链式法则): H(X1,X2,...,X n)=∑ni=1H(Xi|X i−1,...,X1)H(X1,X2,...,Xn)=∑i=1nH(Xi| Xi−1, (X1)定理 2.5.2(互信息的链式法则): I(X1,X2,...,X n;Y)=∑ni=1I(Xi;Y|X i−1,...,X1)I(X1,X2,...,Xn;Y)=∑i=1nI(Xi ;Y|Xi−1, (X1)条件相对熵: D(p(y|x)||q(y|x))=∑x p(x)∑yp(y|x)logp(y|x)q(y|x)=Ep(x,y)logp(Y|X)q( Y|X)D(p(y|x)||q(y|x))=∑xp(x)∑yp(y|x)logp(y|x)q(y|x)=Ep(x,y)logp (Y|X)q(Y|X)定理 2.5.3(相对熵的链式法则): D(p(x,y)||q(x,y))=D(p(x)||q(x))+D(p(y|x)||q(y|x))D(p(x,y)||q(x,y))=D( p(x)||q(x))+D(p(y|x)||q(y|x))2.6 Jensen不等式及其结果定理2.6.2(Jensen不等式): 若给定凸函数f和一个随机变量X,则Ef(X)≥f(EX)Ef(X)≥f(EX)定理2.6.3(信息不等式): D(p||q)≥0D(p||q)≥0推论(互信息的非负性): I(X;Y)≥0I(X;Y)≥0定理2.6.4: H(X)≤log|X|H(X)≤log|X|定理2.6.5(条件作用使熵减小): H(X|Y)≤H(X)H(X|Y)≤H(X)从直观上讲,此定理说明知道另一随机变量Y的信息只会降低X的不确定度. 注意这仅对平均意义成立. 具体来说, H(X|Y=y)H(X|Y=y) 可能比H(X)H(X)大或者小,或者两者相等.定理 2.6.6(熵的独立界): H(X1,X2,…,X n)≤∑ni=1H(Xi)H(X1,X2,…,Xn)≤∑i=1nH(Xi)2.7 对数和不等式及其应用定理 2.7.1(对数和不等式): ∑ni=1ailogaibi≥(∑ni=1ai)log∑ni=1ai∑ni=1bi∑i=1nailogaibi≥(∑i =1nai)log∑i=1nai∑i=1nbi定理2.7.2(相对熵的凸性): D(p||q)D(p||q) 关于对(p,q)是凸的定理2.7.3(熵的凹性): H(p)是关于p的凹函数2.8 数据处理不等式2.9 充分统计量这节很有意思,利用统计量代替原有抽样,并且不损失信息.2.10 费诺不等式定理2.10.1(费诺不等式): 对任何满足X→Y→X^,X→Y→X^, 设Pe=Pr{X≠X^},Pe=Pr{X≠X^}, 有H(Pe)+Pe log|X|≥H(X|X^)≥H(X|Y)H(Pe)+Pelog|X|≥H(X|X^)≥H(X|Y)上述不等式可以减弱为1+Pe log|X|≥H(X|Y)1+Pelog|X|≥H(X|Y)或Pe≥H(X|Y)−1log|X|Pe≥H(X|Y)−1log|X|引理 2.10.1: 如果X和X’独立同分布,具有熵H(X),则Pr(X=X′)≥2−H(X)Pr(X=X′)≥2−H(X)3 渐进均分性4 随机过程的熵率4.1 马尔科夫链4.2 熵率4.3 例子:加权图上随机游动的熵率4.4 热力学第二定律4.5 马尔科夫链的函数H(Yn|Y n−1,…,Y1,X1)≤H(Y)≤H(Y n|Y n−1,…,Y1)H(Yn|Yn−1,…,Y1,X1)≤H(Y)≤H(Yn|Yn−1,…,Y1)5 数据压缩5.1 有关编码的几个例子5.2 Kraft不等式定理5.2.1(Kraft不等式): 对于D元字母表上的即时码,码字长度l1,l2,…,l m l1,l2,…,lm必定满足不等式∑iD−li≤1∑iD−li≤15.3 最优码l∗i=−log Dpili∗=−logDpi5.4 最优码长的界5.5 唯一可译码的Kraft不等式5.6 赫夫曼码5.7 有关赫夫曼码的评论5.8 赫夫曼码的最优性5.9 Shannon-Fano-Elias编码5.10 香农码的竞争最优性5.11由均匀硬币投掷生成离散分布6 博弈与数据压缩6.1 赛马6.2 博弈与边信息6.3 相依的赛马及其熵率6.4 英文的熵6.5 数据压缩与博弈6.6 英语的熵的博弈估计7 信道容量离散信道: C=maxp(x)I(X;Y)C=maxp(x)I(X;Y)7.1 信道容量的几个例子7.2 对称信道如果信道转移矩阵p(y|x)p(y|x) 的任何两行相互置换,任何两列也相互置换,那么称该信道是对称的.7.3 信道容量的性质7.4 信道编码定理预览7.5 定义7.6 联合典型序列7.7 信道编码定理7.8 零误差码7.9 费诺不等式与编码定理的逆定理7.10 信道编码定理的逆定理中的等式7.11 汉明码7.12 反馈容量7.13 信源信道分离定理8 微分熵8.1 定义h(X)=−∫Sf(x)logf(x)dxh(X)=−∫Sf(x)logf(x)dx均匀分布 h(X)=logah(X)=loga正态分布h(X)=1/2log2πeδ2h(X)=1/2log2πeδ2 8.2 连续随机变量的AEP8.3 微分熵与离散熵的关系8.4 联合微分熵与条件微分熵8.5 相对熵与互信息8.6 微分熵, 相对熵以及互信息的性质。

信息论基础

信息论是一门研究信息传输和处理的科学。

它的基础理论主要有以下几个方面:

1. 信息的定义:在信息论中,信息被定义为能够消除不确定性的东西。

当我们获得一条消息时,我们之前关于该消息的不确定性会被消除或减少。

信息的量可以通过其发生的概率来表示,概率越小,信息量越大。

2. 熵:熵是一个表示不确定性的量。

在信息论中,熵被用来衡量一个随机变量的不确定性,即随机变量的平均信息量。

熵越大,表示随机变量的不确定性越高。

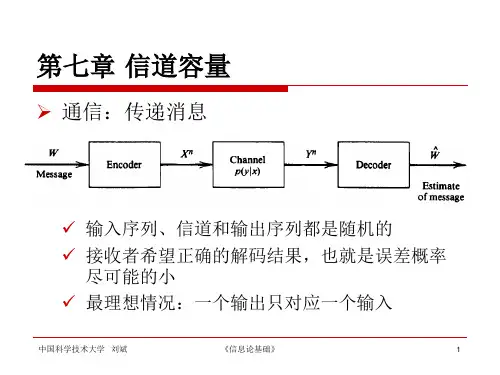

3. 信息的传输和编码:信息在传输过程中需要进行编码和解码。

编码是将消息转换为一种合适的信号形式,使其能够通过传输渠道传输。

解码则是将接收到的信号转换回原始消息。

4. 信道容量:信道容量是指一个信道能够传输的最大信息量。

它与信道的带宽、噪声水平等因素相关。

信道容量的

计算可以通过香浓定理来进行。

5. 信息压缩:信息压缩是指将信息表示为更为紧凑的形式,以减少存储或传输空间的使用。

信息压缩的目标是在保持

信息内容的同时,尽可能减少其表示所需的比特数。

信息论还有其他一些重要的概念和理论,如互信息、信道

编码定理等,这些都是信息论的基础。

信息论的研究不仅

在信息科学领域具有重要应用,还在通信、计算机科学、

统计学等领域发挥着重要作用。

信息论基础第二版习题答案信息论是一门研究信息传输和处理的学科,它的基础理论是信息论。

信息论的基本概念和原理被广泛应用于通信、数据压缩、密码学等领域。

而《信息论基础》是信息论领域的经典教材之一,它的第二版是对第一版的修订和扩充。

本文将为读者提供《信息论基础第二版》中部分习题的答案,帮助读者更好地理解信息论的基本概念和原理。

第一章:信息论基础1.1 信息的定义和度量习题1:假设有一个事件发生的概率为p,其信息量定义为I(p) = -log(p)。

求当p=0.5时,事件的信息量。

答案:将p=0.5代入公式,得到I(0.5) = -log(0.5) = 1。

习题2:假设有两个互斥事件A和B,其概率分别为p和1-p,求事件A和B 同时发生的信息量。

答案:事件A和B同时发生的概率为p(1-p),根据信息量定义,其信息量为I(p(1-p)) = -log(p(1-p))。

1.2 信息熵和条件熵习题1:假设有一个二进制信源,产生0和1的概率分别为p和1-p,求该信源的信息熵。

答案:根据信息熵的定义,信源的信息熵为H = -plog(p) - (1-p)log(1-p)。

习题2:假设有两个独立的二进制信源A和B,产生0和1的概率分别为p和1-p,求两个信源同时发生时的联合熵。

答案:由于A和B是独立的,所以联合熵等于两个信源的信息熵之和,即H(A,B) = H(A) + H(B) = -plog(p) - (1-p)log(1-p) - plog(p) - (1-p)log(1-p)。

第二章:信道容量2.1 信道的基本概念习题1:假设有一个二进制对称信道,其错误概率为p,求该信道的信道容量。

答案:对于二进制对称信道,其信道容量为C = 1 - H(p),其中H(p)为错误概率为p时的信道容量。

习题2:假设有一个高斯信道,信道的信噪比为S/N,求该信道的信道容量。

答案:对于高斯信道,其信道容量为C = 0.5log(1 + S/N)。

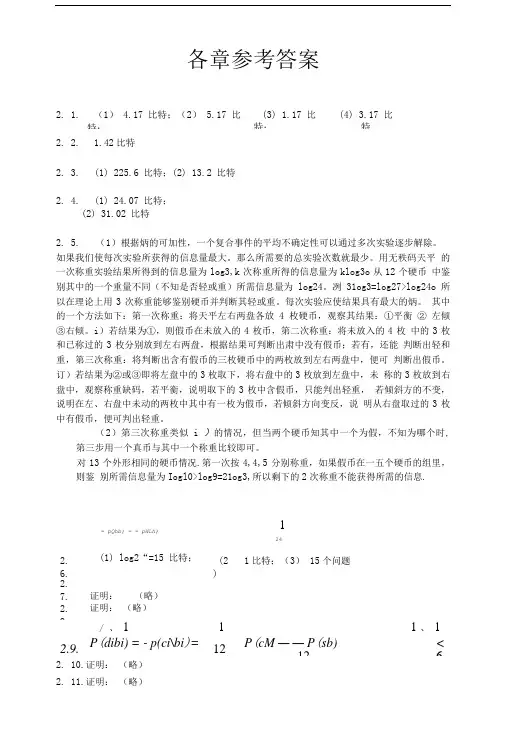

= pQhb) = = pWLh)124各章参考答案2. 1. (1) 4.17 比特;(2) 5.17 比特;(3) 1.17 比特; (4) 3.17 比特 2. 2. 1.42比特2. 3.(1) 225.6 比特;(2) 13.2 比特2. 4. (1) 24.07 比特;(2) 31.02 比特2. 5. (1)根据炳的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。

如果我们使每次实验所获得的信息量最大。

那么所需要的总实验次数就最少。

用无秩码天平 的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3o 从12个硬币 中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。

冽31og3=log27>log24o 所以在理论上用3次称重能够鉴别硬币并判断其轻或重。

每次实验应使结果具有最大的炳。

其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ② 左倾③右倾。

i )若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚 中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出肃中没有假币;若有,还能 判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可 判断出假币。

订)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未 称的3枚放到右盘中,观察称重缺码,若平衡,说明取下的3枚中含假币,只能判出轻重, 若倾斜方的不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说 明从右盘取过的3枚中有假币,便可判出轻重。

(2)第三次称重类似i )的情况,但当两个硬币知其中一个为假,不知为哪个时, 第三步用一个真币与其中一个称重比较即可。

对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在一五个硬币的组里,则鉴 别所需信息量为Iogl0>log9=21og3,所以剩下的2次称重不能获得所需的信息.2. 6. (1) log2“=15 比特;(2)1比特;(3) 15个问题2. 7. 证明: (略)2. 8.证明: (略)/ 、 111 、 12.9. P (dibi) = - p(ci\bi )= 12P (cM — — P (sb) < , 12 ,6,2. 10.证明: (略) 2. 11.证明: (略)2.12.证明: (略)2 [3.(1) H(X) = H(Y) = 1, H(Z) = 0.544, H(XZ) = 1.406, H(YZ) = 1.406,H(XKZ) = 1.812(2)H(X/Y) = H(Y/X) = 0.810f H(X/Z) = 0.862, H(Z/X) = H(Z/Y) =0.405 , H(Y/Z) = 0.862, H(X/YZ) = H(Y/XZ) = 0.405, H(Z/XY) =(3)1(X;K) = 0.188 Z(X;Z) = 0.138 Z(K;Z) = 0.138 7(X;Y/Z) =0.457 , I(Y;Z/X) = I(X;Z/Y) = 0.406(单位均为比特/符号)p 游(000) = 1)= Pg(l°l)=服z(l 1°)= 714. X 1 Z ■,(2)P加(°°°)=P宓(111)= !(3)P加(°°°)= 〃加(°。

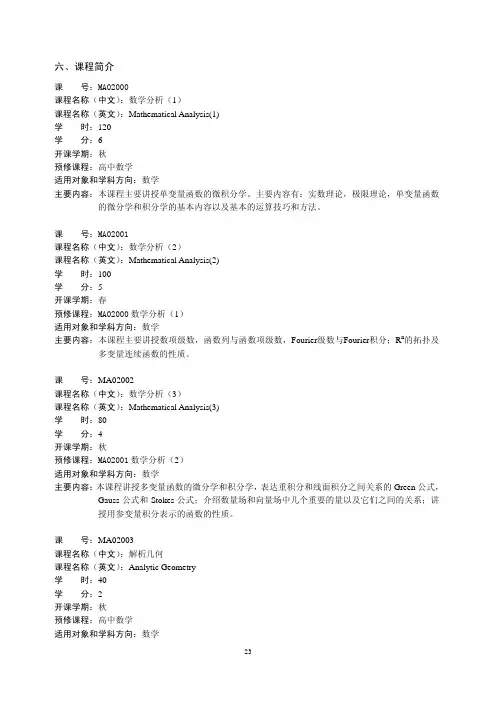

第25卷第2期大 学 数 学V ol.25,№.2 2009年4月COLLEGE M A TH EM A TICS Apr.2009中国科学技术大学数学系“信息与计算科学”专业建设探索张韵华, 邓建松, 岳兴业(中国科学技术大学数学系,合肥230026)1 中科大“信息与计算科学”专业情况简介一、专业名称的演变1952年高等学校在全国范围内进行了院系调整,设立了综合性大学13所、高等师范院校33所,这些高校均有数学系,专门培养数学专业人才和公共数学基础课程的教师.1955年,北京大学等高校开始在数学系里设立“计算数学”专业,60年代一批留学前苏联的回国学者如冯康院士、石钟慈院士、吴文达教授、苏煜城教授和李岳生教授等,他们是国内计算数学专业的开拓者和先驱,他们领导了国内计算数学专业的建设和发展.1984年按教育部要求“计算数学”专业更名为“计算数学及其应用软件”专业,这一阶段各高校按教育部要求对该专业增加了计算机课程的内容,例如,数据结构、数据库和软件工程等课程,为数学系计算数学毕业生到信息产业就业提供了机会和条件.为了进一步淡化专业、拓宽培养口径,1998年教育部对所有专业的数量与名称进行了统一的调整,将原来的八个数学学科专业合并为三个专业,即数学与应用数学专业、信息与计算科学专业,以及(与经济类的统计学合一的)统计学专业.“信息与计算科学专业”由信息科学、计算数学、运筹学和控制论四个主干专业方向整合而成.她是随着科学计算、信息科学、计算机科学与技术的发展,在数学学科内形成的一个新的重要学科分支.以科学计算为共性基础和联系纽带,由以前的计算数学专业、计算数学及应用软件专业、运筹学和控制等专业并融入信息学组建而成.其中计算数学所占比例最大.至1998年调整专业目录前,全国设立计算专业的学校约有70个,全国设立信息专业的学校还不足10个,专业点不足80个.一方面新专业的名称吸引了生源,另一方面信息产业逐步认识到数学基础训练对人才培养的重要性,“信息与计算”成了招生热门专业.从1998年全国不足80个专业到至2004年全国已有426所高校开办了该专业,当年招生人数约为27774人,成为所有理科专业中发展最快,人数最多的专业之一.目前该专业在各高校从属的院系也并不统一,大多数放在数学学院或数学系下,也有放在计算机系下;有的学校将运筹学与控制论方向放在信息与计算专业中,有的则放在“数学和应用数学”专业中.专业名称更名后很多学校增加了信息类课程,例如,信息论基础.近年来,许多院校都对信息科学专业的专业内涵、教学目标和课程设置等涉及人才培养的问题作了认真深入的研讨.全国高等学校教学研究中心、全国高等学校教学研究会、教育部数学教学指导委员会多次举办全国性有关信息和计算专业的教学研讨会. [收稿日期]2007-03-24 [基金项目]2005年安徽省教学研究重点项目(2005002)由教育部高等学校数学与统计学教学指导委员会和高等教育出版社共同多次在暑假举办“全国信息与计算科学专业教学改革研讨会暨骨干教师培训班”,培训班针对如何办好这一专业以及教师培训等问题进行研讨,聘请有关专家就“信息与计算科学专业”的专业内涵、专业规范、教学内容与课程体系作相关报告.例如,开设数学实验、数学建模、数字信号处理、信息论基础、分形与小波和偏微分方程数值解等课程,促进和提高了“信息与计算科学专业”的整体办学水平.二、我校“信息与计算科学”专业建设历程1958年中国科学技术大学数学系由著名数学家华罗庚教授亲自主持创办并任首届系主任,关肇直、吴文俊、冯康、林群等一大批知名专家曾在此任教.数学系建系之初,以科学院数学所为依托,从1958年建系起就设立了计算数学专业,冯康先生首任计算教研室主任.担任过计算教研室主任的还有石钟慈院士、常庚哲教授、李翊神教授、冯玉瑜教授和刘儒勋教授和奚梅成教授.经过近五十年的艰苦创业和求实创新的治学,现已形成一支有一定规模的专业师资队伍,拥有长江讲座教授舒其望,国家杰出青年基金获得者陈发来教授,在职和返聘教授9名,副教授和讲师8名,45岁以下的教员都具有博士学位.同时聘任石钟慈院士、鄂维南博士为华罗庚大师讲席教授,王东明博士为吴文俊大师讲席教授,聘请清华大学韩厚德教授为兼职教授.本专业培养了象余得浩、舒其望、鄂维南、王东明、蔡伟、杜强、陈发来等优秀的计算数学专业人才.科大数学系一直高度重视专业建设和人才培养,每学期定期召开教学研讨会,参加全国信息与计算科学方向的教学研讨会,不断对原教学计划与培养方案做了适应性的修改和完善.2004年申报省级教改项目:“信息与计算科学课程建设”.2 专业建设目标和培养方案一、人才培养的目标科大数学系从华罗庚创办之初就定下了加强基础的“宽、厚、实”的教学指导思想,并一直延续至今.科大数学系长期坚持淡化专业界限,注重基础知识的掌握和基本技能的训练,培养宽口径、有创新精神、适应能力强,知识、能力和素质全面发展的人才.学生在一到三年级不分专业,统一学习基础课,将加强基础落在实处.培养学生具有扎实的数学和应用数学的基础,全面的物理基础,掌握信息科学和计算科学的基本理论和方法,使学生初步具备从事科学研究、教学、解决实际问题及开发软件等能力.通过加强基础将部分学生培养成从事科学前沿、交叉学科和新兴学科的教学与研究工作的人才;通过计算机和软件开始的训练,将部分学生培养成从事科技、教育、信息、军事等领域的应用开发和管理技术人才.为毕业后到信息、金融和企业单位就业创造条件.二、课程培养方案本专业学制4年.弹性学制为3到6年.要求修读的课程由四部分组成,通修课、学科群基础课、专业课和高级课程(即本硕贯通课).本科生必须修满160学分,并且符合学分结构要求才能毕业,获得学士学位.优秀毕业生往往能修满180学分左右.下列各层次的课程设置.1.通修课(61学分)按照教育部对高等学校的课程设置规定,通修课包括政治、英语、物理、计算机类课程和电子类课程.其中物理课程涵盖普通物理及相关试验课程,总计16学分.计算机类包括C 语言、数据结构与数学库等课程.2.学科群基础课(69学分)其中有数学分析(15学分)、解析几何(3学分)、初等数论(3学分)、线性代数(8学分)、实变函数(4学分)、常微分方程(4学分)、近世代数(4学分)、微分几何(4学分)、复变函数(4学分)、拓扑学(4学分)、偏微分方程(4学分)、泛函分析(4学分)、数理统计(4学分)、概率论(4学分).对学生进行全面、系统的数学基础课程训练,贯彻了科大宽厚实的基础教学指导思想.5第2期 张韵华,等:中国科学技术大学数学系“信息与计算科学”专业建设探索6大 学 数 学 第25卷3.专业课(29学分)包括专业必修课(15学分)和专业选修课(选14学分)专业必修课:数学建模(3学分)、数值分析(3学分)、数值代数(3学分)、偏微分方程数值解(3学分)、Sobolev空间与有限元(3学分);专业选修课:数学实验(2学分)、数学基础(2学分)、符号计算系统(2学分)、软件工程(2学分)、理论力学(3学分)、整体微分几何(3学分)、信息论基础(3学分)、数学史(2学分)、代数编码(3学分)、控制论(3学分)、计算数论(2学分)、数理经济学(3学分)、网络安全(3学分)、计算数论(3学分)、高等几何(3学分).4.高级课程即本、硕贯通课(27学分)图论(3学分)、现代密码学(3学分)、计算机图形学(3学分)、控制论(3学分)、逼近论(3学分)、非线性数学导论(3学分)、并行算法(3学分).本、硕贯通课是科大专业课程的特色课程,即选定一部分专业课程为本、硕贯通课程,即供高年级本科生选修,也供低年级研究生选修.其课程设置、课程内容、授课课时从属于研究生课程体系.每年都有90多人次本科生选修本、硕贯通课程.5.大学生研究计划大学生研究计划有别于大学生的毕业论文(设计)工作,其主要宗旨是让学生通过参与教师或科研人员课题组工作,并在导师的指导下,掌握基本的科学研究方法及熟悉科学研究工作的全过程,让学生了解和参与科学研究的前沿,培养学生的科学研究能力.“大学生研究计划”分为学年和暑期两种,前者要求学生一年的课余时间,后者是利用暑假期间,在选定教师的指导下从事目标和任务明确的科研工作.利用科学院和科大“所系结合”的方针,大三暑假学生可去中科院北京研究生院、信息安全国家重点实验室、中科院数学与系统科学研究院、中科院各研究所参与实践、实习活动,并与大学生研究计划、毕业论文结合起来.3 科大“信息与计算科学专业”教学特色一、加强基础长期坚持加强基础教育的宽、厚、实,注重基础知识的掌握和基本技能的训练,通过分析、几何和代数的课程坚固学生的数学基础,重视学科群基础课的深度和广度.2006年教指委指定的“信息与计算科学”专业规范中规定各校可根据不同的培养方向在A类专业必修课选择不少于2—3门,A类专业必修课给出了数学基础课程的广度和深度,而我校将A类课程全部揽入到学科群基础课中.其中A类必修课:微分几何,实变函数论,泛函分析,抽象代数,拓扑学,复变函数论,常微分方程,数学物理方程.让学生在三年的基础课程学习中发现自己的兴趣和爱好,为他们在四年级选择适合个人发展的专业时做好了准备.有利于培养宽口径、有创新精神、适应能力强,知识、能力和素质全面发的人才.二、淡化专业淡化专业的措施:我系前三年不分“数学与应用数学”和“信息和计算科学”专业,统一学习数学基础课.第四年学生根据学生的志愿选择专业,并按基础数学专门人才和数学应用人才两种模式培养.通过开设专业选修课,学生自主选课,自然分流,适当引导和调整.除了完成本专业的必修课外,学生也可以选修任一方向的课程.目标是培养知识与能力并重,综合素质全面发展的人才.为培养具有全面素质及交叉学科的人才,在课程结构上做了大幅度的调整.加强了物理学,计算机学科及人文素质类课程的学习.增大学生选修其他学科的课程以及学习双学位课程.此外,开设了较多的专业选修课程,特别是一些交叉性学科,如数学物理,生物数学,金融数学,信息安全,信息论等等,以促进交叉学科人才的培养.在宽口径的培养计划中,两个数学专业所学课程只相差2—3门专业限选课,多数学校的限制性选修课又按数学与应用数学、信息和计算科学分为两类,学生需从两类中各选一定学分的课程.我系专业选修课没有分类,给学生提供了更大的选择课程范围.也为以后学生在本科和研究生阶段选择专业都提供了更大的选择范围,例如,鄂维南教授在本科选择基础数学,读研选择了计算数学.三、加强培养应用能力和意识在重视基础教育的同时,加强培养应用能力,一方面开设数学实验和数学建模等有明确应用目标课程和大学生研究计划,另一方面在数学分析和线性代数等数学基础课程中注重选择有应用背景的例题,贯穿应用数学的意识.例如常庚哲教授在讲授数学分析、陈发来教授在讲授线性代数课中都将基础知识与数学的应用结合起来,让数学基础课程生动起来,激发了学生的学习兴趣,受到学生的欢迎.四、本硕贯通课程选定一部分专业课程为本科、硕士贯通课程,即供高年级本科生选修,也供低年级研究生选修.其授课课时与研究生课程体系的衔接等做全面的研讨,开设贯通课程使得分流读研的学生有时间与精力去学习其它更多的课程,有利于打好基础,并尽早进入课题研究的前沿.开设贯通课程为获得推荐的读研学生和有专业兴趣的学生提供了选修研究生课程的机会,有利于激发和发现学生的专业兴趣,并为学生在读研期间尽早进入相关的科学研究方向打下基础.据统计,自1999年以来,每年都有90多人次本科生选修本硕贯通课程.五、研究型教学形式大学生研究计划是新型的研究型教学形式,是将教学和科研有机结合的形式,可以校内或校外做.利用科学院和科大“所系结合”的方针,近10年来每年暑假都有大三学生去中科院北京研究生院、信息安全国家重点实验室、中科院数学与系统科学研究院、中科院各研究所参加大学生研究计划.2005年暑假2002级16名学生到中科院及研究生院、国家安全实验室做大学生研究计划,从师于袁亚湘、高小山、曹礼群、尚在久等著名教授,这也给导师了解学生,学生选择读研方向提供了机会,其中有些学生重返科学院做毕业论文,有的推荐到他的导师下继续读研.例如,中科院数学与系统科学研究院李嘉禹教授、高小山教授,国家信息安全实验室冯登国教授都招收了去中科院做大研计划的学生.六、拓展优质教学资源每个学校的专业选修课程与该学校的专业教师方向紧密相关的.为了扩大学生的专业面,让他们了解最新专业进展,通过聘请国内外计算数学等方向的专家学者和校友到校讲课和专场讲座,拓展了优质教学资源.例如,2005年4月由布朗大学舒其望教授,普林斯顿鄂维南教授,北卡蔡伟教授、张智民教授,香港城市大学汤涛教授共同开设了80学时的高级数值分析课程,每人讲授一个专题,各专题的学时不等,面向高年级本科生和研究生.张上游教授利用轮休回国讲授了一学期的计算数学专业课程.聘请国内计算数学专家清华大学韩厚德教授、中科院计算数学与科学工程计算所王烈衡教授来校讲授计算专业课程.专家讲授的课程以及和专家的交流,受到学生的欢迎,使学生接触到学科最前沿的方向和成果,开阔了专业视野,得到了与国际一流水平接轨的培训.通过交流也促进了科大的专业建设.4 专业建设中需要研讨的问题一、人才培养目标每个学校都有自己的办学理念和特色,培养不同领域的专门人才.中科大一直按研究型大学类型发展,在人才培养中尤其加强基础训练.过去计划经济的体制下,数学系是专门培养数学研究和数学教学人才的.近5年来数学系每年约80名本科毕业生,按毕业后2年统计,85%的学生继续深造,在国内外读研,15%的直接就业,主要在信息和金融产业,再看毕业后10至20年的学生,不足15%的学生从事数学科研和教学工作,85%以数学和计算机为主要工具的国民经济各领域的应用型人才.怎样在制定专业人才培养方案中综合考虑近期目标和长远目标?7第2期 张韵华,等:中国科学技术大学数学系“信息与计算科学”专业建设探索8大 学 数 学 第25卷二、学科群基础课和专业课的关系学科群基础课和专业课的学时分配是一个长久的话题,在制定学科群基础课和专业课的教学计划时要与学生的毕业出路结合起来考虑.专业课程是以传授知识为主,基础课程是以训练和熏陶数学思维方式为主,“训练”比“传授”难度高,需要的时间更多,“训练”严谨的数学思维方式是培养数学创新能力基础.怎样处理好两者内在的衔接关系和外在的学时冲突?三、专业课程内容调整目前国内“信息与计算科学”专业课程体系特别是计算科学专业课程大都沿袭五六十年代前苏联的课程体系,内容较陈旧,未能反映信息与计算科学领域的最新成果.因此,现有的专业课程体系需要作较大的调整.例如,传统课程注重强调算法细节而忽略算法的思想与编程实现;一些问题有更好、更新的算法,一些旧的算法需要淘汰.专业课程调整内容过少达不到质的变化,调整内容再多也不能讲全所有新方法.怎样处理专业课程内容调整中质和量的关系?[参 考 文 献][1] 肖铁树.高等数学改革研究报告[M].北京:高等教育出版社,2000.[2] 周远清.建设高水平的高等理科教育体系[J].中国大学教学,2004(10):16-18.[3] 教育部教学指导委员会.信息与计算科学专业教学规范[J].大学数学,2003,19(1):6-10.。

信息论基础第二版习题答案

《信息论基础第二版习题答案》

信息论是一门研究信息传输、存储和处理的学科,它的理论基础是由克劳德·香农于1948年提出的。

信息论的发展对于现代通信、计算机科学和统计学等领域都有着重要的影响。

《信息论基础第二版》是信息论领域的经典教材,它系统地介绍了信息论的基本概念和原理,并提供了大量的习题来帮助读者加深对知识的理解。

在这本书中,作者对信息论的基本概念进行了详细的介绍,包括信息的度量、信道容量、编码理论等内容。

习题部分则是为了帮助读者巩固所学知识,提供了大量的练习题目,涵盖了各个方面的知识点。

下面我们就来看一下《信息论基础第二版》中的一些习题答案。

第一章习题1.1:什么是信息熵?请用公式表示。

答:信息熵是表示一个随机变量不确定性的度量,它的公式为H(X) = -

Σp(x)log2p(x),其中p(x)表示随机变量X取值为x的概率。

第二章习题2.3:什么是信道容量?如何计算信道容量?

答:信道容量是表示信道的传输能力,它的计算公式为C = Wlog2(1 + S/N),其中W表示信道带宽,S表示信号功率,N表示噪声功率。

第三章习题3.2:简要说明香农编码的原理。

答:香农编码是一种无损压缩编码方法,它利用信息的统计特性来减少信息的冗余,从而实现对信息的高效压缩。

以上是《信息论基础第二版》中的一些习题答案,通过学习这些习题,读者可以更好地理解信息论的基本概念和原理。

希望本书对广大读者在信息论领域的

学习和研究有所帮助。

信息论基础课后习题答案问题1问题:信息论的基本目标是什么?答案:信息论的基本目标是研究信息的传递、存储和处理的基本原理和方法。

主要关注如何量化信息的量和质,并通过定义信息熵、条件熵、互信息等概念来描述信息的特性和性质。

问题2问题:列举一些常见的信息论应用领域。

答案:一些常见的信息论应用领域包括:•通信领域:信息论为通信系统的性能分析和设计提供了基础方法,例如信道编码和调制调制等。

•数据压缩领域:信息论为数据压缩算法的研究和实现提供了理论依据,例如无损压缩和有损压缩等。

•隐私保护领域:信息论用于度量隐私保护方案的安全性和隐私泄露的程度,在隐私保护和数据共享中起着重要作用。

•机器学习领域:信息论被应用于机器学习中的特征选择、集成学习和模型评估等任务中,提供了许多有用的数学工具和概念。

•生物信息学领域:信息论被应用于分析DNA序列、蛋白质序列和生物网络等生物数据,发现其中的模式和规律。

问题3问题:信息熵是什么?如何计算信息熵?答案:信息熵是衡量一个随机变量的不确定性或信息量的度量值。

信息熵越大,表示随机变量的不确定性越高,每个可能的取值都相对等可能发生;反之,信息熵越小,表示随机变量的不确定性越低,某些取值较为集中或者出现的概率较大。

信息熵的计算公式如下所示:H(X) = -Σ P(x) * log2(P(x))其中,H(X) 表示随机变量 X 的信息熵,P(x) 表示随机变量X 取值为 x 的概率。

问题4问题:条件熵是什么?如何计算条件熵?答案:条件熵是在给定其他随机变量的条件下,一个随机变量的不确定性或信息量的度量。

条件熵基于条件概率定义,用于描述一个随机变量在给定其他相关随机变量的条件下的信息量。

条件熵的计算公式如下所示:H(Y|X) = -Σ P(x, y) * log2(P(y|x))其中,H(Y|X) 表示随机变量 Y 在给定随机变量 X 的条件下的条件熵,P(x, y) 表示随机变量 X 取值为 x 且随机变量 Y 取值为 y 的概率,P(y|x) 表示随机变量 Y 在给定随机变量 X 取值为x 的条件下取值为 y 的概率。