决策树决策过程流程图

- 格式:doc

- 大小:50.00 KB

- 文档页数:2

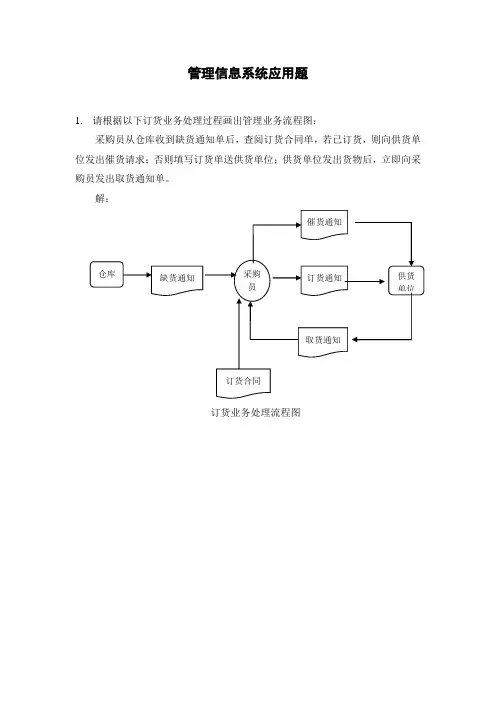

管理信息系统应用题1.请根据以下订货业务处理过程画出管理业务流程图:采购员从仓库收到缺货通知单后,查阅订货合同单,若已订货,则向供货单位发出催货请求;否则填写订货单送供货单位;供货单位发出货物后,立即向采购员发出取货通知单。

解:订货业务处理流程图2.请将下列决策处理过程用以决策树及决策表表示出来。

铁路货运收费标准如下:(1)若收货地点在本省以内,快件每公斤5元,慢件每公斤3元。

(2)若收货地点在外省,且重量小于或等于20公斤,快件每公斤7元,慢件每公斤5元;反之,若重量大于20公斤,超重部分每公斤加收1.5元。

解:决策树如下:决策表如下:3. 用图书、作者两个实体及其属性和联系构建E -R 图,并转化为关系数据模型。

答:E -R 图如下:转换成的关系数据模型如下:图书(ISBN ,书名,出版社,价格) 作者(身份证号,姓名,出生地) 写作(ISBN ,身份证号,定稿时间)4. 试根据以下储蓄所取款过程画出数据流程图:储户将填好的取款单及存折交储蓄所,经查对存款账,将不合格的存折和取款单退回储户,合格的存折和取款单被送交取款处理,处理时要修改存款账户和现金账,处理的结果是将存折、利息单和现金交储户,同时将取款单存档。

图书作者写作出版社ISBN书名姓名出生地身份证号定稿时间价格N M5.某企业负责处理订货单的部门每天能收到 40 份左右的来自顾客的订货单,订货单上的项目包括订货单编号、顾客编号、产品编号、数量、订货日期、交货日期等。

假定这些订单由:“订货单处理”处理逻辑进行处理。

试根据这一业务情况写出数据字典中的“订货单”数据流定义。

数据流名称:订货单编号DFO01简述:顾客送来的订货单数据流来源:“顾客”外部实体数据流去向:“订货单处理”处理逻辑数据流组成:订货单编号 + 顾客编号 + 产品编号 + 数量 + 订货日期 +交货日期流通量:40份左右/天6.试根据下述情况制出表格分配图。

采购部门准备的采购单为一式四份:第 1 张送供货方;第 2 张送交收货部门,用于登入待收货登记册;第 3 张交会计部门作应付款处理,记入应付账;第 4 张留在采购部门备查。

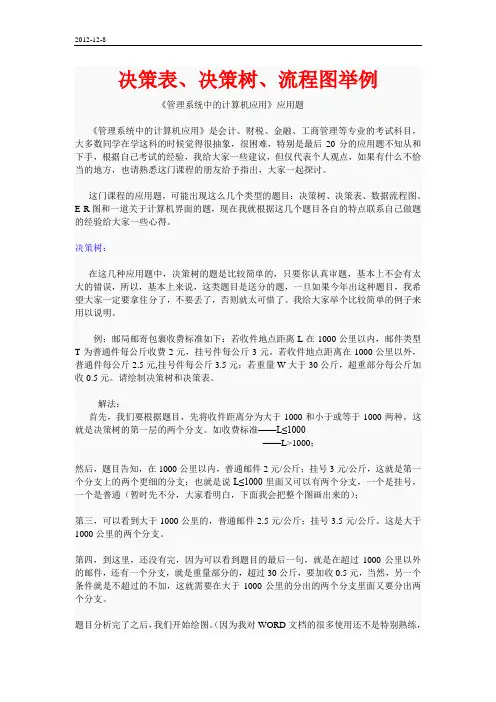

决策表、决策树、流程图举例《管理系统中的计算机应用》应用题《管理系统中的计算机应用》是会计、财税、金融、工商管理等专业的考试科目,大多数同学在学这科的时候觉得很抽象,很困难,特别是最后20分的应用题不知从和下手,根据自己考试的经验,我给大家一些建议,但仅代表个人观点,如果有什么不恰当的地方,也请熟悉这门课程的朋友给予指出,大家一起探讨。

这门课程的应用题,可能出现这么几个类型的题目:决策树、决策表、数据流程图、E-R图和一道关于计算机界面的题,现在我就根据这几个题目各自的特点联系自己做题的经验给大家一些心得。

决策树:在这几种应用题中,决策树的题是比较简单的,只要你认真审题,基本上不会有太大的错误,所以,基本上来说,这类题目是送分的题,一旦如果今年出这种题目,我希望大家一定要拿住分了,不要丢了,否则就太可惜了。

我给大家举个比较简单的例子来用以说明。

例:邮局邮寄包裹收费标准如下:若收件地点距离L在1000公里以内,邮件类型T为普通件每公斤收费2元,挂号件每公斤3元。

若收件地点距离在1000公里以外,普通件每公斤2.5元,挂号件每公斤3.5元;若重量W大于30公斤,超重部分每公斤加收0.5元。

请绘制决策树和决策表。

解法:首先,我们要根据题目,先将收件距离分为大于1000和小于或等于1000两种,这就是决策树的第一层的两个分支。

如收费标准——L≤1000——L>1000;然后,题目告知,在1000公里以内,普通邮件2元/公斤;挂号3元/公斤,这就是第一个分支上的两个更细的分支;也就是说L≤1000里面又可以有两个分支,一个是挂号,一个是普通(暂时先不分,大家看明白,下面我会把整个图画出来的);第三,可以看到大于1000公里的,普通邮件2.5元/公斤;挂号3.5元/公斤。

这是大于1000公里的两个分支。

第四,到这里,还没有完,因为可以看到题目的最后一句,就是在超过1000公里以外的邮件,还有一个分支,就是重量部分的,超过30公斤,要加收0.5元,当然,另一个条件就是不超过的不加,这就需要在大于1000公里的分出的两个分支里面又要分出两个分支。

业务流程图、数据流程图以及决策树练习1.业务流程图(1)、请绘制图书借阅业务流程图。

系统说明:读者将索书单交给借书员,核实之后,书库管理员取书并修改书库文件、登记借阅台帐,接着把书递给借书员。

还书员接受读者的还书条后核对借阅台帐、修改书库文件。

(2)。

成品库保管员按车间的入库单登记库存台帐。

发货时,发货员根据销售科送来的发货通知单将成品出库,并发货,同时填写三份出库单,其中一份交给成品库保管员,由他按此出库单登记库存台帐,出库单的另外两联分别送销售科和会计科。

试按以上业务过程画出业务流程图。

(3).储户将填好的存(取)单及存折送交分类处理处。

分类处理处按三种不同情况分别处理。

如果存折不符或存(取)单不合格,则将存折及存(取)单直接退还储户重新填写;如果是存款,则将存折及存款单送交存款处理处。

存款处理处取出底帐,登记后,将存折退还给储户;如果是取款,则将存折及取款单交取款处理处,该服务台取出底帐及现金,记帐后将存折与现金退给储户,从而完成存(取)款处理过程。

试按以上过程画出业务流程图.2。

数据流程图EX1:请根据以下销售过程画出数据流程图:用户将定货单交给某企业的业务经理,经检验后,对不合格的订单要由用户重填,合格的订单交仓库保管员做出库处理,即:查阅库存台帐,如果有货则向用户开票发货,如缺货,则通知采购员采购。

EX2:请根据以下定货过程画出数据流程图:采购员从仓库收到缺货通知单后立即进行定货处理,即,查阅订货合同单,若已定货,则向供货单位发出催货单,否则,填写定货单送供货单位。

供货单位发运货物后,立即向采购员发出取货通知。

EX3:请根据以下储蓄所存款过程画出数据流程图:储户将填写好的存款单、存折和存款交储蓄所,查对储户帐,将不合格的存款单退给储户重填,合格的存款单交存款处理,处理时要修改储户帐,并将存折交还储户,而将存款放入现金库。

EX4:某仓库管理系统按以下步骤进行信息处理,试画出数据流程图.(1) 保管员根据当日的出库单和入库单通过出、入库处理去修改库存台帐。

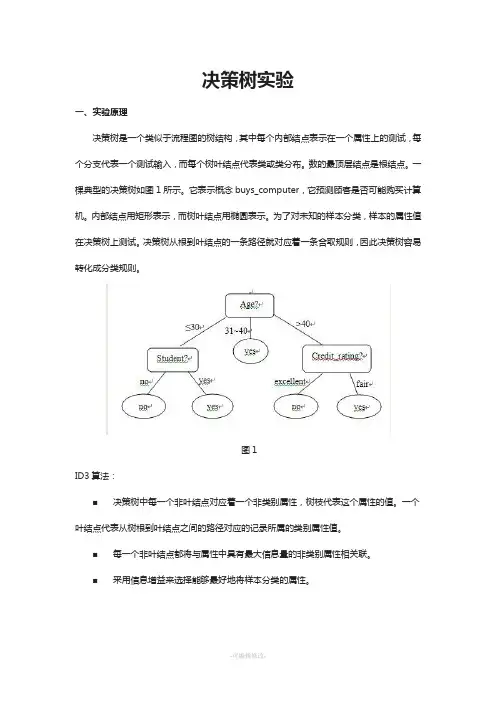

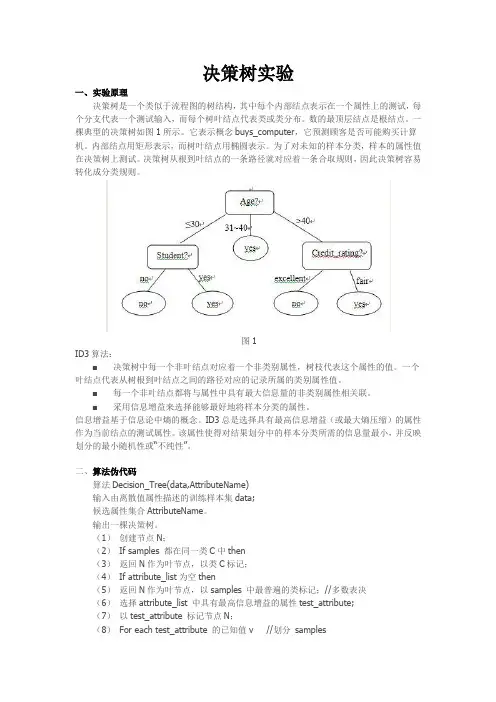

决策树实验一、实验原理决策树是一个类似于流程图的树结构,其中每个内部结点表示在一个属性上的测试,每个分支代表一个测试输入,而每个树叶结点代表类或类分布。

数的最顶层结点是根结点。

一棵典型的决策树如图1所示。

它表示概念buys_computer,它预测顾客是否可能购买计算机。

内部结点用矩形表示,而树叶结点用椭圆表示。

为了对未知的样本分类,样本的属性值在决策树上测试。

决策树从根到叶结点的一条路径就对应着一条合取规则,因此决策树容易转化成分类规则。

图1ID3算法:■决策树中每一个非叶结点对应着一个非类别属性,树枝代表这个属性的值。

一个叶结点代表从树根到叶结点之间的路径对应的记录所属的类别属性值。

■每一个非叶结点都将与属性中具有最大信息量的非类别属性相关联。

■采用信息增益来选择能够最好地将样本分类的属性。

信息增益基于信息论中熵的概念。

ID3总是选择具有最高信息增益(或最大熵压缩)的属性作为当前结点的测试属性。

该属性使得对结果划分中的样本分类所需的信息量最小,并反映划分的最小随机性或“不纯性”。

二、算法伪代码算法Decision_Tree(data,AttributeName)输入由离散值属性描述的训练样本集data;候选属性集合AttributeName。

输出一棵决策树。

(1)创建节点N;(2)If samples 都在同一类C中then(3)返回N作为叶节点,以类C标记;(4)If attribute_list为空then(5)返回N作为叶节点,以samples 中最普遍的类标记;//多数表决(6)选择attribute_list 中具有最高信息增益的属性test_attribute;(7)以test_attribute 标记节点N;(8)For each test_attribute 的已知值v //划分samples(9)由节点N分出一个对应test_attribute=v的分支;(10令S v为samples中test_attribute=v 的样本集合;//一个划分块(11)If S v为空then(12)加上一个叶节点,以samples中最普遍的类标记;(13)Else 加入一个由Decision_Tree(Sv,attribute_list-test_attribute)返回节点值。

决策树法的实施步骤1. 理解决策树法决策树是一种常用的机器学习算法,用于预测和分类问题。

它是一棵树状结构,其中每个内部节点表示一个特征,每个分支表示一个特征的取值,而每个叶节点表示一个预测的结果。

决策树法通过对数据进行划分,选择最佳的特征来构建树,并根据树的结构进行预测。

2. 收集和准备数据在实施决策树法之前,需要收集和准备数据。

这包括获取相关数据集,并进行数据清洗和预处理。

确保数据集中的数据完整、准确且适用于决策树算法的实施。

3. 划分数据集划分数据集是用于训练和测试决策树模型的重要步骤。

通常将数据集分为训练集和测试集两部分。

训练集用于构建决策树模型,而测试集用于评估决策树的性能和准确度。

4. 选择特征选择最佳的特征来构建决策树是决策树法的关键步骤。

通常使用特征选择算法,如信息增益、增益率或基尼指数等,来评估每个特征的重要性并选择最佳的划分特征。

5. 构建决策树通过递归的方式构建决策树。

从根节点开始,根据选择的特征进行划分,将数据集分成子集。

然后对每个子集递归进行子树的构建,直到满足停止条件,例如子集中的所有实例属于同一类别或子集中的特征已被完全使用。

6. 剪枝决策树的剪枝是为了避免过度拟合训练数据,提高决策树模型的泛化能力。

剪枝可以通过预剪枝或后剪枝来实现。

预剪枝是在构建树的过程中进行剪枝,而后剪枝是在构建完整树之后再进行剪枝。

7. 预测和评估构建完成决策树后,使用测试集对模型进行预测。

将测试集的特征输入决策树模型,根据决策树的判定规则得到预测结果。

然后与测试集的真实结果进行比较,评估决策树模型的准确度和性能。

8. 优化决策树模型通过评估决策树模型的性能,可以发现模型的不足之处。

根据评估结果,对决策树模型进行优化,如调整参数、增加特征等,提高决策树模型的准确度和泛化能力。

9. 应用决策树模型在完成决策树模型的优化后,可以将其应用于实际问题中。

利用已构建的决策树模型进行预测和分类,帮助解决具体的决策问题。

决策树实验一、实验原理决策树是一个类似于流程图的树结构,其中每个内部结点表示在一个属性上的测试,每个分支代表一个测试输入,而每个树叶结点代表类或类分布。

数的最顶层结点是根结点。

一棵典型的决策树如图1所示。

它表示概念buys_computer,它预测顾客是否可能购买计算机。

内部结点用矩形表示,而树叶结点用椭圆表示。

为了对未知的样本分类,样本的属性值在决策树上测试。

决策树从根到叶结点的一条路径就对应着一条合取规则,因此决策树容易转化成分类规则。

图1ID3算法:■决策树中每一个非叶结点对应着一个非类别属性,树枝代表这个属性的值。

一个叶结点代表从树根到叶结点之间的路径对应的记录所属的类别属性值。

■每一个非叶结点都将与属性中具有最大信息量的非类别属性相关联。

■采用信息增益来选择能够最好地将样本分类的属性。

信息增益基于信息论中熵的概念。

ID3总是选择具有最高信息增益(或最大熵压缩)的属性作为当前结点的测试属性。

该属性使得对结果划分中的样本分类所需的信息量最小,并反映划分的最小随机性或“不纯性”。

二、算法伪代码算法Decision_Tree(data,AttributeName)输入由离散值属性描述的训练样本集data;候选属性集合AttributeName。

输出一棵决策树。

(1)创建节点N;(2)If samples 都在同一类C中then(3)返回N作为叶节点,以类C标记;(4)If attribute_list为空then(5)返回N作为叶节点,以samples 中最普遍的类标记;//多数表决(6)选择attribute_list 中具有最高信息增益的属性test_attribute;(7)以test_attribute 标记节点N;(8)For each test_attribute 的已知值v //划分samples(9)由节点N分出一个对应test_attribute=v的分支;(10令S v为samples中test_attribute=v 的样本集合;//一个划分块(11)If S v为空then(12)加上一个叶节点,以samples中最普遍的类标记;(13)Else 加入一个由Decision_Tree(Sv,attribute_list-test_attribute)返回节点值。

决策树归纳算法流程决策树是一种常用的机器学习算法,它通过构建一棵树状结构来进行分类或回归。

决策树归纳算法的目标是根据已知的训练数据集,生成一颗能够对新样本进行准确预测的决策树模型。

本文将详细介绍决策树归纳算法的流程和步骤。

1. 数据准备我们需要准备一个包含已知标签的训练数据集。

每个样本都包含多个特征值和一个标签值,特征值用于描述样本的属性,而标签值表示样本所属的类别或结果。

决策树算法适用于离散型和连续型特征。

2. 特征选择特征选择是决策树算法中非常重要的一步,它决定了如何划分数据集以获得最佳分类结果。

常见的特征选择方法有信息增益、信息增益率、基尼指数等。

2.1 信息增益信息增益是一种衡量特征对于分类任务有多大贡献的指标。

计算信息增益需要先计算出初始数据集的信息熵,然后计算出每个特征的条件熵,最后用初始信息熵减去特征的条件熵得到信息增益。

信息增益越大,表示该特征对分类任务的贡献越大。

2.2 信息增益率信息增益率是在信息增益的基础上进行改进的一种方法。

它通过除以特征的固有值来对信息增益进行归一化,防止过多依赖于具有较多取值的特征。

2.3 基尼指数基尼指数是另一种衡量特征对分类任务有多大贡献的指标。

计算基尼指数需要先计算出初始数据集的基尼系数,然后计算出每个特征的条件基尼系数,最后用初始基尼系数减去特征的条件基尼系数得到基尼指数。

基尼指数越小,表示该特征对分类任务的贡献越大。

根据以上不同的特征选择方法,我们可以选择合适的方法来进行特征选择。

3. 构建决策树在决策树构建过程中,我们需要确定每个节点上所要选择的最佳分裂属性,并将数据集按照该属性值进行划分。

常见的决策树构建算法有ID3、C4.5和CART等。

3.1 ID3算法ID3算法是一种基于信息增益的决策树构建算法。

它通过计算每个特征的信息增益,选择信息增益最大的特征作为当前节点的划分属性。

然后将数据集按照该属性值进行划分,并递归地构建子树,直到满足终止条件。

决策表、决策树、流程图举例《管理系统中的计算机应用》应用题《管理系统中的计算机应用》是会计、财税、金融、工商管理等专业的考试科目,大多数同学在学这科的时候觉得很抽象,很困难,特别是最后20分的应用题不知从和下手,根据自己考试的经验,我给大家一些建议,但仅代表个人观点,如果有什么不恰当的地方,也请熟悉这门课程的朋友给予指出,大家一起探讨。

这门课程的应用题,可能出现这么几个类型的题目:决策树、决策表、数据流程图、E-R图和一道关于计算机界面的题,现在我就根据这几个题目各自的特点联系自己做题的经验给大家一些心得。

决策树:在这几种应用题中,决策树的题是比较简单的,只要你认真审题,基本上不会有太大的错误,所以,基本上来说,这类题目是送分的题,一旦如果今年出这种题目,我希望大家一定要拿住分了,不要丢了,否则就太可惜了。

我给大家举个比较简单的例子来用以说明。

例:邮局邮寄包裹收费标准如下:若收件地点距离L在1000公里以内,邮件类型T为普通件每公斤收费2元,挂号件每公斤3元。

若收件地点距离在1000公里以外,普通件每公斤2.5元,挂号件每公斤3.5元;若重量W大于30公斤,超重部分每公斤加收0.5元。

请绘制决策树和决策表。

解法:首先,我们要根据题目,先将收件距离分为大于1000和小于或等于1000两种,这就是决策树的第一层的两个分支。

如收费标准——L≤1000——L>1000;然后,题目告知,在1000公里以内,普通邮件2元/公斤;挂号3元/公斤,这就是第一个分支上的两个更细的分支;也就是说L≤1000里面又可以有两个分支,一个是挂号,一个是普通(暂时先不分,大家看明白,下面我会把整个图画出来的);第三,可以看到大于1000公里的,普通邮件2.5元/公斤;挂号3.5元/公斤。

这是大于1000公里的两个分支。

第四,到这里,还没有完,因为可以看到题目的最后一句,就是在超过1000公里以外的邮件,还有一个分支,就是重量部分的,超过30公斤,要加收0.5元,当然,另一个条件就是不超过的不加,这就需要在大于1000公里的分出的两个分支里面又要分出两个分支。

决策树(decision tree)

又名:决策过程流程图,逻辑图,工作图

概述

决策树是指通过一系列的问题得出正确的决策或问题的解决方案。

决策树是一种特殊的树图,但通常看起来像流程图。

一般来说,决策树是由那些对可能重复发生情况的具有专业知识的人而绘制的,然后被那些没有专业知识并且需要独立作出决策的人所使用。

适用场合

·当需要作出决策或需要解决方案的问题重复出现时;

·当作出决策的思维过程已知,并且能够分解成一系列的问题时;

·决策树的典型应用包括排解纷争、紧急处理,以及对那些复杂的、关键的或很少使用的步骤进行文档化。

实施步骤

1明确使用决策树的场合,并陈述需要作出的决定或需要解决的问题,然后写在卡片上放在水平工作台的最左端。

2用头脑风暴法来找出问题的答案。

对每个问题而言,找出所有可能的答案。

通常,答案可能有“是非”选择或是一系列的选择。

把每个问题和答案写在卡片上放在工作台上。

如果顺序有帮助的话,就按顺序排列问题,但是不需太在意顺序的正确性。

3确定问题是否需要按特定的顺序提问。

如果不需要,选择一组有效的顺序。

在工作台上通过重排卡片将问题排序,在答案和旁边的问题之间用箭头连接。

4检查决策树是否有遗漏的问题或答案,并且确信问题能够清楚地被理解和被正确地回答。

5测试树。

设想反映一系列不同状况的情景,运用决策树来解决。

当发现有问题时,对树进行改进。

6给没有专业知识的人设置一些情景并让他们使用决策树来作决策。

如果他们不能够得出正确的决策,识别出产生错误的问题并且对树进行改进。

示例

图表5.20控制图选择树和图表5.68图形方法的决策树都是决策树的应用例子。

注意事项

·通常情况下某些问题优先级高于其他问题。

·如果问题没有自然顺序,选择一个在大多数情况下能够迅速得出结论的顺序,使常见情况的问题排序优先于非常见情况的。

·在由一系列是非问题组成的决策树中,试着调整树使每个分枝中是与非的位置保持一致。

否则的话,当使用者没有注意到两者位置变换时就可能出错。

END。