通信原理——信源编码技术

- 格式:ppt

- 大小:1.56 MB

- 文档页数:92

信息论与编码原理信源编码

信息论是一门涉及了信息处理的学科,它研究信息生成、传输、接收、存储、利用等过程的一般性理论。

它探讨涉及信息的一切问题,强调掌握

信息所必需的体系性的体系知识,其主要内容有:信息的定义、信息测度,信息的熵,信息编码,信息的可计量性,信息传输,信息和随机性,信息

编译,信息安全,信息认证,解码准确性,信息的保密,校验,系统复杂性,信息的加密等。

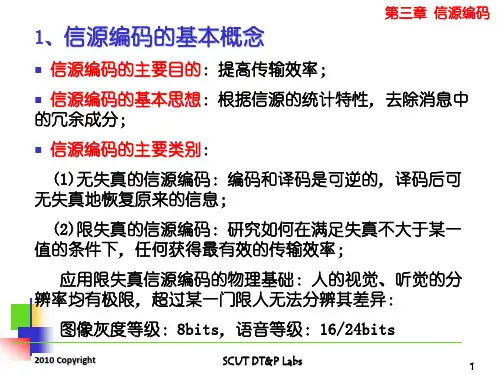

信源编码是一种在信息论中常用的编码技术,其目的是用最少的信息

量表示最多的信息内容,以提高信息发送效率。

它主要包括概率信息源编

码和确定性信息源编码两种。

概率信息源编码是根据一个信息源的发生概率来编码,是根据发出信

息的概率来决定编码方式的。

它根据一个消息源中发出的不同信息的概率

来决定信息的编码,并确定每种信息的编码长度。

在这种情况下,越高概

率的信息,编码长度越短。

确定性信息息源编码,是根据一个消息源中出现特定信息的概率确定

编码方式的。

在这种情况下,编码长度取决于消息源的熵,也就是期望的

信息量。

信源编码的基本思想是以最小的编码来传输最多的信息量。

第四章移动通信中的信源编码在当今这个信息爆炸的时代,移动通信已经成为我们生活中不可或缺的一部分。

无论是与亲朋好友的语音通话,还是观看精彩的视频直播,亦或是随时随地获取各种信息,都离不开移动通信技术的支持。

而在移动通信系统中,信源编码是一个至关重要的环节,它直接影响着通信的质量和效率。

那么,什么是信源编码呢?简单来说,信源编码就是将信源输出的信号转换成适合在信道中传输的形式。

在移动通信中,信源通常是指语音、图像、视频等各种信息。

由于这些原始信息的数据量往往非常庞大,如果直接进行传输,将会占用大量的信道资源,导致传输效率低下,甚至无法实现实时通信。

因此,需要通过信源编码对原始信息进行压缩和处理,减少数据量,提高传输效率。

信源编码的主要目的有两个:一是减少冗余信息,二是提高编码效率。

冗余信息是指那些在传输过程中不必要或者可以通过其他方式恢复的信息。

例如,在语音信号中,相邻的语音样本之间往往存在很强的相关性,这就意味着存在大量的冗余信息。

通过对这些冗余信息进行分析和处理,可以大大减少数据量。

同时,信源编码还需要考虑如何在保证一定质量的前提下,尽可能地提高编码效率,也就是用更少的比特数来表示相同的信息。

在移动通信中,常用的信源编码技术包括语音编码和图像编码。

语音编码是将语音信号转换为数字信号的过程。

目前,广泛应用的语音编码标准有 GSM 语音编码、CDMA 语音编码和 3GPP 语音编码等。

这些编码技术通过采用不同的算法和策略,对语音信号进行分析、建模和编码,在保证语音质量的前提下,实现了较高的压缩比。

例如,GSM 语音编码采用了规则脉冲激励长期预测(RPELTP)编码算法,将语音信号分成若干个帧,对每一帧进行分析和编码。

CDMA 语音编码则采用了可变速率码激励线性预测(QCELP)编码算法,根据语音的特征动态调整编码速率,从而在不同的信道条件下都能提供较好的语音质量。

3GPP 语音编码则引入了自适应多速率(AMR)技术,能够根据网络状况和用户需求自适应地选择不同的编码速率,进一步提高了语音通信的灵活性和效率。

信源编码的原理

信源编码是数字通信中的一种技术,用于将信源的离散信号转化为连续信号以便传输。

信源编码的主要原理是通过对信源进行编码来提高信息传输的效率,并减少传输所需的带宽。

下面就信源编码的原理进行具体描述:

信源编码的原理主要包括两个方面:信息熵和编码。

信息熵是指信源输出符号的平均信息量。

在信息论中,熵可以描述一个随机信源的不

确定性。

一个信源可以通过信息熵的度量来评估其具有的信息量。

信息熵的计算公式为:

H = -Σpilog2pi

其中,pi是信源输出符号的概率。

H表示信息熵,它的单位是比特。

常见的信源编码有霍夫曼编码、香农-费诺编码、赫夫曼分段编码、格雷码等。

其中,霍夫曼编码是在所有编码中使用最广泛的编码算法,它的基本思想是,将出现概率高的符

号用较短的码表示,出现概率低的符号用较长的码表示,这样可以使总的编码长度最短。

以二进制为例,设共有n种离散信源输出符号,则该n个符号的离散概率为pi,要对这n个符号进行编码,使得所有符号的码值长度和为L,则平均码长为:

通过对概率进行排序,对每个符号进行编码,可以构造一个符号-码字对的码表。

对

于给定的输入符号序列,可以通过码表中的对应关系将其转化为对应的码字序列。

发送方

发送的码字序列就成为了连续信号,接收方将其还原为离散符号序列进行解码即可。

总的来说,信源编码通过压缩信息内容,减少传输所需的带宽,提高了数据传输的效率,具有重要的意义和应用。