逐步回归法

- 格式:doc

- 大小:145.50 KB

- 文档页数:2

逐步向后回归方法逐步向后回归方法(stepwise regression)是一种逐步逼近的回归分析方法,它通过逐步选择回归变量来建立回归模型。

这种方法能够在给定的比较宽泛的特征集合中找到对响应变量最重要的特征,从而构建一个简化的模型。

本文将详细介绍逐步向后回归方法的原理、步骤和适用性。

逐步向后回归方法的原理是通过在每一步中选择与目标变量最相关的特征子集,并计算每个子集的回归模型的性能指标,如R方值或均方差。

然后,根据预先设定的标准,删除与目标变量关系最弱的特征,并保留与目标变量关系最强的特征。

这个过程会一直持续,直到无法进一步提升模型性能或特征集为空为止。

下面是逐步向后回归方法的步骤:1.初始化:选择一个初始特征子集,并计算初始模型的性能指标。

2.特征选择:在当前特征子集中,计算每个特征的性能指标,并选择对目标变量有最大贡献的特征作为最佳特征。

3.模型评估:在当前特征子集中,计算包含最佳特征和不包含最佳特征的两个模型的性能指标。

4.特征删除:根据预先设定的标准,删除与目标变量关系最弱的特征。

5.结束判断:如果删除了所有的特征或无法进一步提升模型性能,则停止算法;否则,返回第2步。

1.特征选择:自动选择与目标变量最相关的特征,能够排除无关变量,避免过拟合问题。

2.简化模型:通过逐步删除无关特征,得到一个更简化、更易解释的模型。

3.验证性能:在每一步中,通过计算性能指标来评估模型效果,可以在建模过程中不断验证模型的优劣。

1.特征维度较高:当特征维度较高时,逐步向后回归方法可以帮助筛选出最重要的特征,提高建模效率。

2.特征相关性较高:如果特征之间存在较高的相关性,逐步向后回归方法可以消除冗余的特征并提高模型的解释能力。

3.需要简化模型:如果需要一个简化、易解释的模型,逐步向后回归方法可以帮助找到相关的特征子集。

总之,逐步向后回归方法是一种有效的特征选择方法,能够在给定的特征集合中找到与目标变量最相关的特征,并构建一个简化的回归模型。

logit逐步回归法

Logit逐步回归法(Logistic stepwise regression)是一种统计建模方法,用于在具有多个自变量的二分类问题中选择最佳的预测模型。

它是逐步回归方法的一种变体,但针对的是逻辑回归模型。

逐步回归的目标是帮助确定哪些自变量对于解释因变量的变化最重要。

Logit逐步回归法在逻辑回归的背景下使用,适用于因变量为二分类变量的情况。

它通过逐步添加或删除自变量来优化模型的准确性和解释能力。

Logit逐步回归方法通常分为前向选择和后向剔除两种策略:

1.前向选择(Forward selection):从没有自变量的模型开始,

然后逐步添加一个自变量,每次选择能够最大程度地提高

模型拟合度的自变量,直到满足某个预定的终止准则。

2.后向剔除(Backward elimination):从包含所有自变量的完

全模型开始,然后逐步剔除一个自变量,每次剔除对模型

拟合度影响最小的自变量,直到满足某个预定的终止准则。

在每一步中,Logit逐步回归法通常使用一些统计指标(如AIC、BIC、p 值等)来评估模型的拟合度和变量的显著性。

根据这些指标,选择最佳的自变量组合,并在后续步骤中进行模型优化。

Logit逐步回归法的优点是可以自动选择最重要的自变量,减少了人为干预的主观性,并且可以避免过度拟合的问题。

然

而,它也存在一些限制,例如可能存在多重比较问题,进行变量选择时需要谨慎处理。

总之,Logit逐步回归法是一种有效的统计方法,在逻辑回归模型中帮助选择最佳的自变量组合,并提高预测模型的准确性和解释能力。

逐步回归检测法

逐步回归检测法(Stepwise Regression Analysis)是一种统计分析方法,用于确定多元线性回归模型中哪些自变量对应变量的预测具有显著影响。

它通过逐步添加或删除自变量,寻找最佳的预测模型。

逐步回归检测法可以帮助我们确定在多个自变量中,哪些是最重要的,以及它们与因变量之间的关系强度。

该方法一般包括前向选择、后向剔除和逐步选择三个步骤。

在前向选择中,我们从一个空模型开始,逐步添加最相关的自变量,直到达到预设的显著性水平或达到预设的自变量数量。

这个过程会不断重复,直到找到最佳模型。

在后向剔除中,我们从包含所有自变量的完整模型开始,然后逐步剔除不显著的自变量,直到达到预设的显著性水平或达到预设的自变量数量。

这个过程会不断重复,直到找到最佳模型。

在逐步选择中,我们将前向选择和后向剔除结合起来,既添加又删除自变量,直到达到预设的显著性水平或达到预设的自变量数量。

这个过程会不断重复,直到找到最佳模型。

逐步回归检测法的优点是它可以减少模型中不必要的自变量,提高模型的简洁性和解释力。

然而,这种方法也存在一些限制,如可能产生过拟合问题,需要选择适当的显著性水平和自变量数量等。

总之,逐步回归检测法是一种用于确定多元线性回归模型的重要工具,它通过逐步添加或删除自变量来寻找最佳模型,以实现对因变量的准确预测。

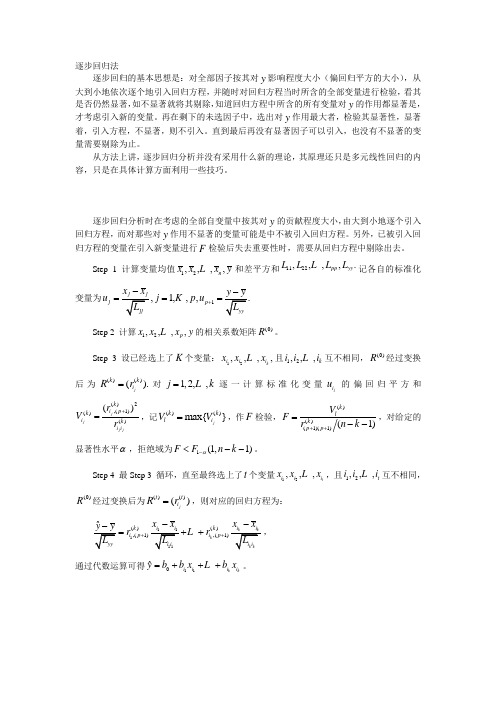

逐步回归法逐步回归的基本思想是:对全部因子按其对y 影响程度大小(偏回归平方的大小),从大到小地依次逐个地引入回归方程,并随时对回归方程当时所含的全部变量进行检验,看其是否仍然显著,如不显著就将其剔除,知道回归方程中所含的所有变量对y 的作用都显著是,才考虑引入新的变量。

再在剩下的未选因子中,选出对y 作用最大者,检验其显著性,显著着,引入方程,不显著,则不引入。

直到最后再没有显著因子可以引入,也没有不显著的变量需要剔除为止。

从方法上讲,逐步回归分析并没有采用什么新的理论,其原理还只是多元线性回归的内容,只是在具体计算方面利用一些技巧。

逐步回归分析时在考虑的全部自变量中按其对y 的贡献程度大小,由大到小地逐个引入回归方程,而对那些对y 作用不显著的变量可能是中不被引入回归方程。

另外,已被引入回归方程的变量在引入新变量进行F 检验后失去重要性时,需要从回归方程中剔除出去。

Step 1 计算变量均值12,,,,n x x x y 和差平方和1122,,,,.pp yy L L L L 记各自的标准化变量为1,1,,,.j j j p jj yyx x y y u j p u L L +--=== Step 2 计算12,,,,p x x x y 的相关系数矩阵(0)R 。

Step 3 设已经选上了K 个变量:12,,,,k i i i x x x 且12,,,k i i i 互不相同,(0)R 经过变换后为()()().jk k i R r =对1,2,,j k = 逐一计算标准化变量j i u 的偏回归平方和()2,(1)()()()j j j j k i p k i k i i r V r +=,记()()max{}jk k l i V V =,作F 检验,()()(1)(1)(1)k l k p p V F r n k ++=--,对给定的显著性水平α,拒绝域为1(1,1)F F n k α-<--。

python 逐步回归法一、什么是逐步回归法逐步回归法是一种多元回归分析的方法,它通过不断添加或删除自变量,逐步建立模型,以达到最佳的拟合效果。

逐步回归法的优点在于可以通过逐步选择自变量,提高模型的预测能力,并能够得到相对简化的模型。

二、逐步回归法的原理逐步回归法基于F统计量或T统计量,在每一步选择最佳的自变量进行模型拟合。

具体步骤如下:1. 初始化模型,包含一个常数项;2. 计算每个自变量与因变量的相关性,并选择与因变量相关性最高的自变量;3. 拟合模型,计算模型的拟合优度指标,如R方;4. 逐步添加其他自变量,并计算每次添加后的模型拟合优度指标;5. 根据预设的停止准则,判断是否继续添加自变量;6. 如果继续添加自变量,则选择与因变量相关性最高的自变量,并计算模型的拟合优度指标;7. 如果停止添加自变量,则逐步删除自变量,重新计算模型的拟合优度指标;8. 根据预设的停止准则,判断是否继续删除自变量;9. 如果继续删除自变量,则选择与因变量相关性最低的自变量,并10. 如果停止删除自变量,则得到最终的模型。

三、逐步回归法的应用场景逐步回归法可以用于各种回归分析的场景,特别适用于以下情况:1. 自变量较多,需要筛选出最相关的自变量;2. 希望得到相对简化的模型,提高模型的可解释性;3. 需要确定自变量对因变量的影响程度及方向。

四、使用Python进行逐步回归分析在Python中,可以使用statsmodels库中的ols函数进行逐步回归分析。

以下是使用Python进行逐步回归分析的步骤:1. 导入所需库,如pandas和statsmodels;2. 读取数据集,并进行数据预处理,如缺失值处理和数据标准化;3. 定义自变量和因变量;4. 使用ols函数拟合初始模型,并计算模型的拟合优度指标;5. 根据预设的停止准则,判断是否继续添加或删除自变量;6. 如果继续添加自变量,则选择与因变量相关性最高的自变量,并计算模型的拟合优度指标;7. 如果停止添加自变量,则逐步删除自变量,重新计算模型的拟合优度指标;8. 根据预设的停止准则,判断是否继续删除自变量;9. 如果继续删除自变量,则选择与因变量相关性最低的自变量,并10. 如果停止删除自变量,则得到最终的模型。

逐步回归方法

逐步回归是一种常用的回归分析方法,它通过逐步调整每个自变量的值来最小化残差平方和(sum of Squared Error,SSE)。

具体来说,逐步回归方法通过迭代计算每个自变量对目标变量的预测贡献,然后逐步调整每个自变量的值,直到

达到最小化SSE的目的。

逐步回归方法的基本原理是,通过逐步调整每个自变量的值,使得预测结果

与实际结果之间的残差平方和最小化。

在具体实现中,逐步回归方法通常包括以下步骤:

1. 确定目标变量和残差平方和的测量方式。

2. 初始化所有自变量的值,并计算每个自变量对目标变量的残差平方和的

贡献。

3. 确定每个自变量的最佳初始值,通常通过最小化残差平方和来寻找最佳值。

4. 逐步调整每个自变量的值,直到残差平方和不再发生变化。

5. 重复步骤3和4,直到所有自变量都被调整完毕。

逐步回归方法可以应用于多种回归分析场景,例如多元线性回归、多项式回归、逻辑回归等。

在实际应用中,逐步回归方法可以帮助研究人员更好地理解模型的结构,并优化模型的预测性能。

除了逐步回归方法,还有其他的回归分析方法,例如岭回归、局部线性回归等。

这些方法各有优缺点,应根据具体情况进行选择。

在回归分析中,还应该考虑数据预处理、特征选择等方法,以提高模型的预测性能和泛化能力。

多元逐步线性回归法的原理多元逐步线性回归是一种常用的回归分析方法,用于建立多个自变量与一个因变量之间的关系模型。

其主要目标是从所有可能的自变量中选择出对因变量具有显著影响的变量,并建立一个解释性最好的线性回归模型。

下面将详细介绍多元逐步线性回归的原理和步骤。

多元逐步线性回归的原理基于以下假设:在给定的自变量集合中,存在一些变量对因变量具有显著影响,而其他的变量则对因变量影响不大或可以忽略。

因此,我们希望能够通过逐步选择变量的方法,找到那些与因变量相关性最高的自变量,以建立一个较好的回归模型。

多元逐步线性回归的步骤如下:1. 设定显著性水平:首先,需要设定一个显著性水平,用于判断自变量的显著性。

通常情况下,显著性水平选择为0.05。

2. 构建起始模型:将所有自变量都纳入模型中构建起始模型。

这意味着初始模型中的所有自变量都被视为对因变量的预测有一定影响。

通过这一步骤可以看到各个自变量的初步影响以及它们的统计显著性。

3. 逐步选择变量:逐步选择变量是多元逐步线性回归的核心步骤。

在这一步骤中,根据显著性水平,选择具有最显著影响的自变量,并将其添加到模型中。

然后,再次检验模型中变量的显著性,如果有自变量的显著性低于设定的水平,则将其删除。

4. 回归系数的检验:在每一步骤中添加或删除自变量后,需要对模型中的回归系数进行检验。

通常,使用t检验或F检验来检验回归系数是否显著不等于0。

如果一个回归系数的p值小于设定的显著性水平,则说明对应的自变量在模型中具有显著影响。

5. 模型的评价:在逐步选择变量的过程中,需要对每一步所建立的模型进行评价。

常见的评价指标包括调整决定系数和残差分析。

调整决定系数表示自变量解释因变量的比例,而残差分析可以用来检验模型中的误差是否满足正态分布和同方差性等假设。

6. 终止条件:逐步选择变量的过程中,需要设定终止条件。

通常情况下,可以选择两种终止条件:一种是自变量的显著性均大于设定的显著性水平,此时不再继续添加新的自变量;另一种是当所有自变量都已纳入模型中,并且再添加新的自变量不能显著提高模型的解释能力时,终止逐步选择的过程。

统计学中的多元统计分析和逐步回归法在现代社会中,数据分析和建模已经成为非常重要的技能。

统计学是一个非常有用的工具,它能够帮助我们从数据中提取有用的信息,帮助我们理解和预测现实世界中的现象。

在统计学中,多元统计分析和逐步回归法是两个非常有用的技术,可以帮助我们处理更加复杂的数据集。

多元统计分析是一种分析多个变量之间关系的技术。

它可以帮助我们识别多个变量之间的相关性和相互作用。

例如,在社会科学研究中,我们可能会对多个因素对个体的生活满意度的影响进行研究。

这些因素可能包括家庭收入、教育水平、健康状况、社会支持等等。

通过多元统计分析,我们可以将这些因素纳入模型中,确定它们之间的关系,以及每个因素对生活满意度的贡献大小。

在多元统计分析中,最常用的技术之一是因子分析。

因子分析是一种将一组变量转化为几个不相关因子的技术。

这个过程可以帮助我们识别出变量中的通用因素,从而简化模型。

例如,在心理学研究中,我们可能会对多个问卷测量结果进行分析,希望确定这些测量结果中的共同因素。

通过因子分析,我们可以将这些测量结果转化为几个因子,这些因子代表了问卷中的共同主题,例如焦虑、压力、幸福感等等。

另一个非常有用的多元统计分析技术是聚类分析。

聚类分析是一种将一组对象分为相似群体的技术。

这个过程可以帮助我们在不需要先验知识的情况下发现数据中的任何模式。

例如,在市场研究中,我们可能会对消费者的购买行为进行分析,以确定他们之间的相似之处。

通过聚类分析,我们可以将消费者划分为不同的群体,这些群体具有相似的购买偏好和行为方式。

这些信息可以帮助我们更好地制定营销策略和调整产品定位。

逐步回归法是另一种统计学中非常有用的技术。

它是一种逐步选择变量的技术,用于建立变量间的线性关系模型。

逐步回归法可以帮助我们确定哪些变量对一个目标变量最有影响力,并排除那些没有贡献的变量。

例如,在经济学研究中,我们可能会对多个因素对国家经济增长的影响进行研究。

这些因素包括人口数量、教育水平、出口数量等等。

逐步回归分析在自变量很多时,其中有的因素可能对应变量的影响不是很大,而且x之间可能不完全相互独立的,可能有种种互作关系。

在这种情况下可用逐步回归分析,进行x因子的筛选,这样建立的多元回归模型预测效果会更较好。

逐步回归分析,首先要建立因变量y与自变量x之间的总回归方程,再对总的方程及每—个自变量进行假设检验。

当总的方程不显著时,表明该多元回归方程线性关系不成立;而当某—个自变量对y影响不显著时,应该把它剔除,重新建立不包含该因子的多元回归方程。

筛选出有显著影响的因子作为自变量,并建立“最优”回归方程。

回归方程包含的自变量越多,回归平方和越大,剩余的平方和越小,剩余均方也随之较小,预测值的误差也愈小,模拟的效果愈好。

但是方程中的变量过多,预报工作量就会越大,其中有些相关性不显著的预报因子会影响预测的效果。

因此在多元回归模型中,选择适宜的变量数目尤为重要。

逐步回归在病虫预报中的应用实例:以陕西省长武地区1984~1995年的烟蚜传毒病情资料、相关虫情和气象资料为例(数据见DATA6.xls),建立蚜传病毒病情指数的逐步回归模型,说明逐步回归分析的具体步骤。

影响蚜传病毒病情指数的虫情因子和气象因子一共有21个,通过逐步回归,从中选出对病情指数影响显著的因子,从而建立相应的模型。

对1984~1995年的病情指数进行回检,然后对1996~1998年的病情进行预报,再检验预报的效果。

变量说明如下:y:历年病情指数x1:前年冬季油菜越冬时的蚜量(头/株) x2:前年冬季极端气温x3:5月份最高气温x4:5月份最低气温 x11:5月份均温x12:5月份降水量x13:6月份均温x14:6月份降水量x15:第一次蚜迁高峰期百株烟草有翅蚜量x5:3~5月份降水量 x6:4~6月份降水量 x7:3~5月份均温 x8:4~6月份均温 x9:4月份降水量 x10:4月份均温 x16:5月份油菜百株蚜量 x17:7月份降水量x18:8月份降水量x19:7月份均温x20:8月份均温x21:元月均温1)准备分析数据在SPSS数据编辑窗口中,用“File→Open→Data”命令,打开“DATA6.xls”数据文件。

逐步回归的基本思想是:对全部因子按其对y 影响程度大小(偏回归平方的大小),从大到小地依次逐个地引入回归方程,并随时对回归方程当时所含的全部变量进行检验,看其是否仍然显著,如不显著就将其剔除,知道回归方程中所含的所有变量对y 的作用都显著是,才考虑引入新的变量。

再在剩下的未选因子中,选出对y 作用最大者,检验其显著性,显著着,引入方程,不显著,则不引入。

直到最后再没有显著因子可以引入,也没有不显著的变量需要剔除为止。

从方法上讲,逐步回归分析并没有采用什么新的理论,其原理还只是多元线性回归的内容,只是在具体计算方面利用一些技巧。

逐步回归分析时在考虑的全部自变量中按其对y 的贡献程度大小,由大到小地逐个引入回归方程,而对那些对y 作用不显著的变量可能是中不被引入回归方程。

另外,已被引入回归方程的变量在引入新变量进行F 检验后失去重要性时,需要从回归方程中剔除出去。

Step 1 计算变量均值12,,,,n x x x y L 和差平方和1122,,,,.pp yy L L L L L 记各自的标准化

变量为11,,,j p x x y u j p u +-===K Step 2 计算12,,,,p x x x y L 的相关系数矩阵(0)R 。

Step 3 设已经选上了K 个变量:12,,,,k i i i x x x L 且12,,,k i i i L 互不相同,(0)R 经过变换

后为()()().j k k i R r =对1,2,,j k =L 逐一计算标准化变量j i u 的偏回归平方和

()2,(1)()()()j j j j k i p k i k i i r V r +=,记()()

max{}j k k l i V V =,作F 检验,()()(1)(1)(1)k l k p p V F r n k ++=--,对给定的显著性水平α,拒绝域为1(1,1)F F n k α-<--。

Step 4 最Step 3 循环,直至最终选上了t 个变量12,,,t i i i x x x L ,且12,,,t i i i L 互不相同,(0)R 经过变换后为()()()j t t i R r =,则对应的回归方程为:

1()(),(1),(1)ˆk k k i p i p x x x x y r r ++--=++L ,

通过代数运算可得110ˆk k i i i i y

b b x b x =+++L 。