朴素贝叶斯的公式

- 格式:docx

- 大小:10.50 KB

- 文档页数:2

朴素贝叶斯分类器是一种基于贝叶斯定理和特征条件独立假设的分类方法。

以下是一个简单的例子来说明朴素贝叶斯分类器的工作原理。

假设我们有一个数据集,其中包含两个类别:感冒和过敏,以及两个特征:打喷嚏和职业。

根据先验概率,我们知道感冒的概率为0.5,过敏的概率为0.33。

现在,我们要根据一个人的特征和职业来预测他是否患有感冒或过敏。

首先,我们来看第一个特征“打喷嚏”。

如果一个打喷嚏的人是建筑工人,我们假设“打喷嚏”和“建筑工人”这两个特征是独立的,因此可以使用朴素贝叶斯公式来计算他患感冒的概率。

具体地,我们可以使用以下公式:

P(感冒|打喷嚏x建筑工人) = P(打喷嚏|感冒) x P(建筑工人|感冒) x P(感冒) / P(打喷嚏x建筑工人)

根据已知条件,我们可以将上述公式中的各个概率值代入计算,得到该建筑工人患感冒的概率为0.66。

同样地,我们可以使用朴素贝叶斯公式来计算该建筑工人患过敏的概率,具体公式为:

P(过敏|打喷嚏x建筑工人) = P(打喷嚏|过敏) x P(建筑工人|过敏) x P(过敏) / P(打喷嚏x建筑工人)

代入已知条件计算后,得到该建筑工人患过敏的概率为0.34。

因此,根据朴素贝叶斯分类器的判断,该建筑工人更有可能患有感冒。

以上就是一个简单的朴素贝叶斯分类器的例子。

需要注意的是,在实际应用中,数据集通常包含更多的特征和类别,计算也会更加复杂。

朴素贝叶斯分类边界1 简介朴素贝叶斯分类是一种基于贝叶斯定理和特征条件独立假设的分类方法。

相较于其他分类算法,朴素贝叶斯算法有着计算速度快,易于实现,对于小样本数据具有较高的精度等优点。

在文本分类、垃圾邮件过滤、情感分析等领域中有着广泛的应用。

2 贝叶斯定理贝叶斯定理是基于条件概率的计算法则,公式如下:P(A|B) = P(B|A) * P(A) / P(B)其中,P(A|B) 表示事件 B 发生的条件下,事件 A 发生的概率,P(A) 表示事件 A 发生的概率,P(B|A) 表示在事件 A 发生的条件下,事件 B 发生的概率,P(B) 表示事件 B 发生的概率。

利用贝叶斯定理,我们可以计算出在给定特征条件下某个类别的概率,从而对数据进行分类。

3 条件独立性假设条件独立性假设是朴素贝叶斯分类算法的关键假设之一。

该假设说明一个分类项的各个特征之间是相互独立的,即一个特征的出现不会影响其他特征的出现概率。

由于该假设的简化,朴素贝叶斯分类算法存在一定的误差,但是在大多数情况下该假设是有效的。

在文本分类中,每个文本可以表示为一个向量,其中向量的每个元素表示在该文本中某个特定词汇出现的次数或频率。

根据条件独立性假设,我们可以假设每个特征之间是独立的,从而可以得到每个类别下各个特征的概率分布。

4 朴素贝叶斯分类边界朴素贝叶斯分类边界是指将数据空间划分为不同类别区域的线或面。

对于二分类问题,该边界被称为决策边界。

决策边界的位置取决于训练数据的特征和参数选择。

具体地,在朴素贝叶斯分类中,我们可以利用贝叶斯定理计算每个类别在给定特征条件下的后验概率,然后选择概率最大的类别作为该数据点的分类结果。

因此,分类边界可以看作是不同分类区域的分隔线,根据分类规则将数据点分配到不同的分类区域中。

在文本分类中,分类边界通常是一个超平面,可以通过支持向量机等算法进行优化。

由于条件独立性假设的存在,朴素贝叶斯分类边界通常是线性的,因此对于非线性问题需要使用其他的分类方法。

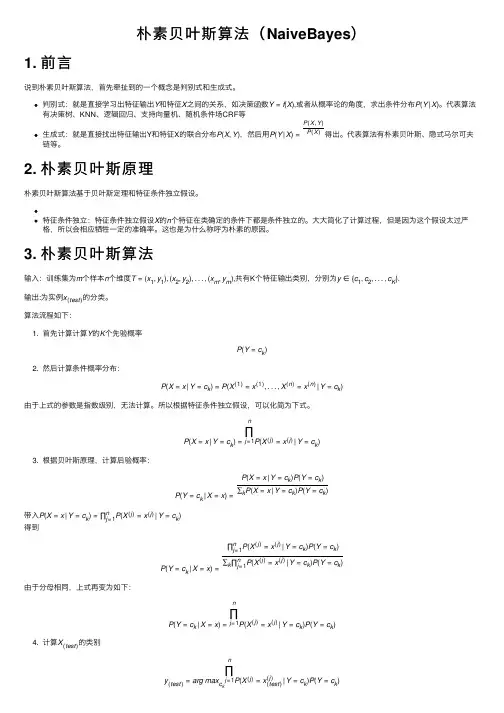

朴素贝叶斯算法(NaiveBayes)1. 前⾔说到朴素贝叶斯算法,⾸先牵扯到的⼀个概念是判别式和⽣成式。

判别式:就是直接学习出特征输出Y和特征X之间的关系,如决策函数Y=f(X),或者从概率论的⾓度,求出条件分布P(Y|X)。

代表算法有决策树、KNN、逻辑回归、⽀持向量机、随机条件场CRF等⽣成式:就是直接找出特征输出Y和特征X的联合分布P(X,Y),然后⽤P(Y|X)=P(X,Y)P(X)得出。

代表算法有朴素贝叶斯、隐式马尔可夫链等。

2. 朴素贝叶斯原理朴素贝叶斯算法基于贝叶斯定理和特征条件独⽴假设。

特征条件独⽴:特征条件独⽴假设X的n个特征在类确定的条件下都是条件独⽴的。

⼤⼤简化了计算过程,但是因为这个假设太过严格,所以会相应牺牲⼀定的准确率。

这也是为什么称呼为朴素的原因。

3. 朴素贝叶斯算法输⼊:训练集为m个样本n个维度T=(x1,y1),(x2,y2),...,(x m,y m),共有K个特征输出类别,分别为y∈{c1,c2,...,c K}.输出:为实例x(test)的分类。

算法流程如下:1. ⾸先计算计算Y的K个先验概率P(Y=c k)2. 然后计算条件概率分布:P(X=x|Y=c k)=P(X(1)=x(1),...,X(n)=x(n)|Y=c k)由于上式的参数是指数级别,⽆法计算。

所以根据特征条件独⽴假设,可以化简为下式。

P(X=x|Y=c k)=n∏j=1P(X(j)=x(j)|Y=c k)3. 根据贝叶斯原理,计算后验概率:P(Y=c k|X=x)=P(X=x|Y=c k)P(Y=c k)∑k P(X=x|Y=c k)P(Y=c k)带⼊P(X=x|Y=c k)=∏n j=1P(X(j)=x(j)|Y=c k)得到P(Y=c k|X=x)=∏n j=1P(X(j)=x(j)|Y=c k)P(Y=c k)∑k∏n j=1P(X(j)=x(j)|Y=c k)P(Y=c k)由于分母相同,上式再变为如下:P(Y=c k|X=x)=n∏j=1P(X(j)=x(j)|Y=c k)P(Y=c k)4. 计算X(test)的类别y(test)=arg max ckn∏j=1P(X(j)=x(j)(test)|Y=c k)P(Y=c k)从上⾯的计算可以看出,没有复杂的求导和矩阵运算,因此效率很⾼。

朴素贝叶斯分类贝叶斯分类是一类分类算法的总称,这类算法均以贝叶斯定理为基础,故统称为贝叶斯分类。

而朴素贝叶斯分类是贝叶斯分类中最简单,也是常见的一种分类方法。

一:贝叶斯原理朴素贝叶斯分类算法是一个典型的统计学习方法,主要的理论基础就是贝叶斯公式。

贝叶斯公式定义如下所示:先验概率:通过经验来判断事情发生的概率。

后验概率:后验概率就是发生结果之后,推测原因的概率。

条件概率:事件 A 在另外一个事件 B 已经发生条件下的发生概率,表示为 P(A|B),读作“在 B 发生的条件下 A 发生的概率”。

P(A|B)表示事件B已经发生的前提下,事件A发生的概率,叫做事件B发生下事件A的条件概率。

其基本求解公式为:P(AB)/P(B)。

但是在有些情况下,我们可以很容易直接得出P(A|B),P(B|A)则很难直接得出,但是我们更想要知道P(B|A)。

例如(通信接收机检测判决)将A,B,C 三个字母之一输入信道,输出为原字母的概率为α,而输出为其它一字母的概率都是(1-α)/2。

今将字母串AAAA,BBBB,CCCC 之一输入信道,输入AAAA,BBBB,CCCC 的概率分别为p1, p2, p3 (p1 +p2+p3=1),已知输出为ABCA,问输入的是AAAA 的概率是多少?(设信道传输每个字母的工作是相互独立的。

)在这个例子中,我们知道了结果,但是我们想要知道输入的概率,直接计算是非常困难的,但是通过贝叶斯公式就显得十分简单了。

换句话说,就是我们知道原因,推导结果是比较容易的,但是当我们知道结果,要反过来推导原因是十分困难的。

而贝叶斯公式就为我们知道结果后推导原因提供了一个捷径。

二:朴素贝叶斯分类在说完了贝叶斯原理之后,现在就来说朴素贝叶斯分类。

朴素贝叶斯分类之所以朴素,就是因为我们做了一个简单的假设,即类中特定特征的存在与任何其他特征的存在无关,这意味着每个特征彼此独立。

因此对实际情况有所约束,如果属性之间存在关联,分类准确率会降低。

朴素贝叶斯算法原理的简要概述朴素贝叶斯算法是一种基于概率统计的分类算法,它以贝叶斯定理为基础,通过计算待分类样本属于不同类别的概率来进行分类判定。

该算法的特点在于对特征之间的独立性进行了朴素的假设,这也是它名称的由来。

1. 贝叶斯定理的基础在介绍朴素贝叶斯算法之前,让我们先回顾一下贝叶斯定理的基础。

贝叶斯定理是由英国数学家托马斯·贝叶斯提出的,它描述了在已知先验概率的情况下,如何根据新的观察结果来更新概率估计。

贝叶斯定理的数学表达形式如下:P(A|B) = P(B|A) * P(A) / P(B)其中,P(A|B) 表示在事件 B 发生的条件下事件 A 发生的概率,P(B|A) 表示在事件 A 发生的条件下事件 B 发生的概率,P(A) 和 P(B) 分别表示事件 A 和事件 B 分别发生的概率。

2. 朴素贝叶斯算法的原理朴素贝叶斯算法的核心思想是基于贝叶斯定理,通过计算待分类样本在不同类别下的后验概率来进行分类。

假设我们有一个包含 n 个样本的数据集 D,其中每个样本都由 d 个特征构成,而每个样本又属于不同的类别。

我们的目标是根据已知样本的特征来预测待分类样本的类别。

朴素贝叶斯算法的步骤如下:2.1 计算先验概率先验概率是指在没有任何条件信息的情况下,某个事件发生的概率。

在朴素贝叶斯算法中,我们需要计算每个类别的先验概率。

对于某个类别 C,它的先验概率 P(C) 可以通过计算属于该类别的样本数量与总样本数量的比值得到。

2.2 计算条件概率条件概率是指在已知某个条件下,某个事件发生的概率。

在朴素贝叶斯算法中,我们需要计算每个特征在不同类别下的条件概率。

对于某个特征 A 和类别 C,它的条件概率 P(A|C) 可以通过计算在该类别下特征 A 出现的次数与该类别下样本的总数的比值得到。

2.3 计算后验概率后验概率是指在已知某个事件发生的条件下,另一个事件发生的概率。

在朴素贝叶斯算法中,我们需要计算待分类样本在不同类别下的后验概率。

贝叶斯算法总结一、前言贝叶斯算法是机器学习领域中的一种重要算法,其基本思想是根据已知数据和先验概率,通过贝叶斯公式计算出后验概率,从而进行分类或预测。

在实际应用中,贝叶斯算法具有许多优点,例如对于小样本数据具有较好的分类性能、能够处理多分类问题等。

本文将对贝叶斯算法进行全面详细的总结。

二、贝叶斯公式贝叶斯公式是贝叶斯算法的核心公式,它描述了在已知先验概率和条件概率的情况下,如何求解后验概率。

P(A|B) = P(B|A) * P(A) / P(B)其中,P(A|B)表示在B发生的条件下A发生的概率;P(B|A)表示在A 发生的条件下B发生的概率;P(A)表示A发生的先验概率;P(B)表示B发生的先验概率。

三、朴素贝叶斯分类器朴素贝叶斯分类器是一种基于贝叶斯定理和特征独立假设的分类方法。

其基本思想是将待分类样本向量中各个特征出现的次数作为条件概率的估计值,从而计算出各个类别的后验概率,最终将待分类样本分到后验概率最大的类别中。

朴素贝叶斯分类器具有训练速度快、分类效果好等优点,但是其假设特征之间相互独立的前提在实际应用中并不一定成立。

四、高斯朴素贝叶斯分类器高斯朴素贝叶斯分类器是一种基于朴素贝叶斯算法和高斯分布假设的分类方法。

其基本思想是将待分类样本向量中各个特征服从高斯分布的假设作为条件概率的估计值,从而计算出各个类别的后验概率,最终将待分类样本分到后验概率最大的类别中。

高斯朴素贝叶斯分类器适用于连续型特征数据,并且能够处理多维特征数据。

但是其对于离群点比较敏感。

五、多项式朴素贝叶斯分类器多项式朴素贝叶斯分类器是一种基于朴素贝叶斯算法和多项式分布假设的分类方法。

其基本思想是将待分类样本向量中各个特征出现的次数作为条件概率的估计值,从而计算出各个类别的后验概率,最终将待分类样本分到后验概率最大的类别中。

多项式朴素贝叶斯分类器适用于离散型特征数据,并且能够处理多维特征数据。

但是其对于连续型特征数据不适用。

通俗地理解贝叶斯公式(定理)朴素贝叶斯(Naive Bayesian algorithm)是有监督学习的一种分类算法,它基于“贝叶斯定理”实现,该原理的提出人是英国著名数学家托马斯·贝叶斯。

贝叶斯定理是基于概率论和统计学的相关知识实现的,因此在正式学习“朴素贝叶斯算法”前,我们有必要先认识“贝叶斯定理”。

贝叶斯定理贝叶斯定理的发明者托马斯·贝叶斯提出了一个很有意思的假设:“如果一个袋子中共有 10 个球,分别是黑球和白球,但是我们不知道它们之间的比例是怎么样的,现在,仅通过摸出的球的颜色,是否能判断出袋子里面黑白球的比例?”上述问题可能与我们高中时期所接受的的概率有所冲突,因为你所接触的概率问题可能是这样的:“一个袋子里面有 10 个球,其中 4 个黑球,6 个白球,如果你随机抓取一个球,那么是黑球的概率是多少?”毫无疑问,答案是 0.4。

这个问题非常简单,因为我们事先知道了袋子里面黑球和白球的比例,所以很容易算出摸一个球的概率,但是在某些复杂情况下,我们无法得知“比例”,此时就引出了贝叶斯提出的问题。

在统计学中有两个较大的分支:一个是“频率”,另一个便是“贝叶斯”,它们都有各自庞大的知识体系,而“贝叶斯”主要利用了“相关性”一词。

下面以通俗易懂的方式描述一下“贝叶斯定理”:通常,事件 A 在事件 B 发生的条件下与事件 B 在事件 A 发生的条件下,它们两者的概率并不相同,但是它们两者之间存在一定的相关性,并具有以下公式(称之为“贝叶斯公式”):看到上述公式,你可能一头雾水,不过不必慌张,下面我们来了解一下“贝叶斯”公式。

符号意义首先我们要了解上述公式中符号的意义:•P(A) 这是概率中最基本的符号,表示A 出现的概率。

比如在投掷骰子时,P(2) 指的是骰子出现数字“2”的概率,这个概率是六分之一。

•P(B|A) 是条件概率的符号,表示事件A 发生的条件下,事件B 发生的概率,条件概率是“贝叶斯公式”的关键所在,它也被称为“似然度”。

朴素贝叶斯详解朴素贝叶斯详解贝叶斯分类是⼀类分类算法的总称,这类算法均以贝叶斯定理为基础,故统称为贝叶斯分类。

⽽朴素贝叶斯分类是贝叶斯分类中最简单,也是常见的⼀种分类⽅法。

这篇⽂章我们从⼀个例⼦⼊⼿,详细的分析整个朴素贝叶斯的计算流程,以及如何完成分类的。

朴素贝叶斯的数学描述:从数学⾓度来说,分类问题可做如下定义:已知集合和,确定映射规则y = f(x),使得任意有且仅有⼀个,使得成⽴。

其中C叫做类别集合,其中每⼀个元素是⼀个类别,⽽I叫做项集合(特征集合),其中每⼀个元素是⼀个待分类项,f叫做分类器。

分类算法的任务就是构造分类器f。

分类算法的内容是要求给定特征,让我们得出类别,这也是所有分类问题的关键。

那么如何由指定特征,得到我们最终的类别,也是我们下⾯要讲的,每⼀个不同的分类算法,对应着不同的核⼼思想。

⼀、朴素贝叶斯的理论核⼼数学公式:换⼀种通俗的理解⽅式:我们最终求的p(类别|特征)即可!就相当于完成了我们的任务。

⼆、例题分析1.例⼦的简要说明现在给我们的问题是,如果⼀对男⼥朋友,男⽣想⼥⽣求婚,男⽣的四个特点分别是不帅,性格不好,⾝⾼矮,不上进,请你判断⼀下⼥⽣是嫁还是不嫁?这是⼀个典型的分类问题,转为数学问题就是⽐较p(嫁|(不帅、性格不好、⾝⾼矮、不上进))与p(不嫁|(不帅、性格不好、⾝⾼矮、不上进))的概率,谁的概率⼤,我就能给出嫁或者不嫁的答案!这⾥我们联系到朴素贝叶斯公式:我们需要求p(嫁|(不帅、性格不好、⾝⾼矮、不上进),这是我们不知道的,但是通过朴素贝叶斯公式可以转化为好求的三个量.p(不帅、性格不好、⾝⾼矮、不上进|嫁)、p(不帅、性格不好、⾝⾼矮、不上进)、p(嫁)(⾄于为什么能求,后⾯会讲,那么就太好了,将待求的量转化为其它可求的值,这就相当于解决了我们的问题!)2.例⼦的深⼊理解分析上⽂中的好求的三个量怎样求的?是根据已知训练数据统计得来,下⾯详细给出该例⼦的求解过程。

朴素贝叶斯算法1. 简介朴素贝叶斯算法(Naive Bayes)是一种基于贝叶斯定理和特征条件独立假设的分类算法。

它是一种简单但强大的算法,常用于文本分类、垃圾邮件过滤、情感分析等领域。

朴素贝叶斯算法的核心思想是利用已知类别的训练样本,通过计算样本特征的条件概率来进行分类。

2. 贝叶斯定理贝叶斯定理是概率论中的一个重要定理,描述了在已知某些条件下,事件的概率如何更新。

假设有两个事件A和B,贝叶斯定理可以表示为:P(A|B)=P(B|A)⋅P(A)P(B)其中,P(A|B)表示在事件B发生的条件下事件A发生的概率,P(B|A)表示在事件A 发生的条件下事件B发生的概率,P(A)和P(B)分别表示事件A和事件B的概率。

3. 朴素贝叶斯算法原理朴素贝叶斯算法基于特征条件独立性假设,即假设给定类别的情况下,各个特征之间相互独立。

这一假设大大简化了计算过程。

朴素贝叶斯算法的分类过程可以分为以下几个步骤:1.计算每个类别出现的概率P(C),即样本中每个类别的先验概率。

2.对于给定的输入样本,计算该样本在每个类别下的条件概率P(X|C),即样本在每个类别下的似然概率。

3.根据贝叶斯定理,计算每个类别下的后验概率P(C|X),即给定样本的条件下每个类别的概率。

4.选择后验概率最大的类别作为样本的分类结果。

4. 朴素贝叶斯算法的优缺点4.1 优点•朴素贝叶斯算法简单易懂,实现起来比较简单。

•对小规模数据表现良好,适用于多分类问题。

•对缺失数据不敏感,能够处理缺失数据的情况。

4.2 缺点•朴素贝叶斯算法假设特征之间相互独立,但在实际应用中,很多特征之间是相关的,这会影响分类的准确性。

•对输入数据的表达形式比较敏感,需要对数据进行预处理,如去除停用词、进行词干提取等。

•朴素贝叶斯算法对输入数据的分布做了严格的假设,如果输入数据的分布与假设不符,分类结果可能不准确。

5. 朴素贝叶斯算法的应用朴素贝叶斯算法在文本分类、垃圾邮件过滤、情感分析等领域有广泛的应用。

朴素贝叶斯分类算法介绍要介绍朴素贝叶斯算法(Naive Bayes),那就得先介绍贝叶斯分类算法,贝叶斯分类算法是统计分类算法的⼀种,他是⼀类利⽤概率统计知识进⾏的⼀种分类算法。

⽽朴素贝叶斯算法就是⾥⾯贝叶斯算法中最简单的⼀个算法。

为什么叫做朴素贝叶斯,因为他⾥⾯的各个类条件是独⽴的,所以⼀会在后⾯的计算中会起到很多⽅便的作⽤。

朴素贝叶斯算法原理⾸先在这⾥⽤到了⼀个概率公式:P(B|A)的意思是在A事件的情况下,发⽣B事件的概率,可以理解为概率论中的条件概率,⽽贝叶斯公式的巨⼤作⽤就是对因果关系进⾏了交换,通过上⾯的公式就可以计算P(A|B)的概率,只要通过上述的转换。

上⾯的资源地址上已经对朴素贝叶斯算法的原理描述的⾮常清楚了,我在他的基础上做了点注释⽅便于后⾯代码的理解:朴素贝叶斯分类的正式定义如下:1、设为⼀个待分类项,⽽每个a为x的⼀个特征属性。

(在后⾯的例⼦中x={"Youth", "Medium", "Yes", "Fair"},⾥⾯的4个因⼦为他的特征向量)2、有类别集合。

(在后⾯的类别中只有buy_computer的分类yes, no,C={yes, no})3、计算。

(在后⾯的计算的任务就是计算在X事件的条件下,yes和no事件的发⽣概率,P(Yes|X, P(No|X)))4、如果,则。

(计算出上⾯的结果值,拥有最⼤概率的值的yi就是他的分类,这个很好理解,在X条件下,那个分类类型概率⾼就属于哪个分类,在这⾥⽐的就是P(Yes|X, P(No|X))那么现在的关键就是如何计算第3步中的各个条件概率。

我们可以这么做:1、找到⼀个已知分类的待分类项集合,这个集合叫做训练样本集。

2、统计得到在各类别下各个特征属性的条件概率估计。

即。

3、如果各个特征属性是条件独⽴的,则根据贝叶斯定理有如下推导:因为分母对于所有类别为常数,因为我们只要将分⼦最⼤化皆可。

贝叶斯算法的基本原理和算法实现⼀. 贝叶斯公式推导 朴素贝叶斯分类是⼀种⼗分简单的分类算法,叫它朴素是因为其思想基础的简单性:就⽂本分类⽽⾔,它认为词袋中的两两词之间的关系是相互独⽴的,即⼀个对象的特征向量中每个维度都是相互独⽴的。

例如,黄⾊是苹果和梨共有的属性,但苹果和梨是相互独⽴的。

这是朴素贝叶斯理论的思想基础。

现在我们将它扩展到多维的情况: 朴素贝叶斯分类的正式定义如下: 1.设 x={a1,a2,…,am}为⼀个待分类项,⽽每个 a 为 x 的⼀个特征属性。

2.有类别集合 C={y1,y2,…,yn}。

3.计算 P( y1|x) ,P( y2|x),…, P( yn|x)。

4.如果 P( yk|x) =max{P( y1|x),P( y2|x),…, P( yn|x)},则 x∈yk。

那么现在的关键就是如何计算第 3 步中的各个条件概率。

我们可以这么做: (1) 找到⼀个已知分类的待分类项集合,也就是训练集。

(2) 统计得到在各类别下各个特征属性的条件概率估计。

即: P(a1|y1) , P(a2|y1),…, P(am|y1); P(a1|y2) , P(a2|y2),…, P(am|y2); P(am|yn) , P(am|yn),…, P(am|yn)。

(3) 如果各个特征属性是条件独⽴的(或者我们假设它们之间是相互独⽴的),则根据贝叶斯定理有如下推导: 因为分母对于所有类别为常数,只要将分⼦最⼤化皆可。

⼜因为各特征属性是条件独⽴的,所以有: 根据上述分析,朴素贝叶斯分类的流程可以表⽰如下:第⼀阶段:训练数据⽣成训练样本集:TF-IDF 第⼆阶段:对每个类别计算 P(yi) 第三阶段:对每个特征属性计算所有划分的条件概率第四阶段:对每个类别计算P( x | yi ) P( yi ) 第五阶段:以P( x | yi ) P( yi ) 的最⼤项作为 x 的所属类别 ⼆. 朴素贝叶斯算法实现 使⽤简单的英⽂语料作为数据集:def loadDataSet(): postingList=[['my', 'dog', 'has', 'flea', 'problems', 'help', 'please'], ['maybe', 'not', 'take', 'him', 'to', 'dog', 'park', 'stupid'], ['my', 'dalmation', 'is', 'so', 'cute', 'I', 'love', 'him','my'], ['stop', 'posting', 'stupid', 'worthless', 'garbage'], ['mr', 'licks', 'ate', 'my', 'steak', 'how', 'to', 'stop', 'him'], ['quit', 'buying', 'worthless', 'dog', 'food', 'stupid']] classVec = [0,1,0,1,0,1] #1 is abusive, 0 not return postingList,classVec postList 是训练集⽂本,classVec 是每个⽂本对应的分类。

朴素贝叶斯算法算法基础今天,你算法了没?0.来源说明作者:追寻的鹿出处:博客园1 贝叶斯定理的引入概率论中的经典条件概率公式:公式的理解为,P(X ,Y)= P(Y,X)<=> P(X | Y)P(Y)= P(Y | X)P (X),即 X 和 Y 同时发生的概率与 Y 和 X 同时发生的概率一样。

2 朴素贝叶斯定理朴素贝叶斯的经典应用是对垃圾邮件的过滤,是对文本格式的数据进行处理,因此这里以此为背景讲解朴素贝叶斯定理。

设D是训练样本和相关联的类标号的集合,其中训练样本的属性集为 X { X1,X2, ... , Xn },共有n 个属性;类标号为 C{ C1,C2, ... ,Cm }, 有m 中类别。

朴素贝叶斯定理:其中,P(Ci| X)为后验概率,P(Ci)为先验概率,P(X | Ci)为条件概率。

朴素贝叶斯的两个假设:1、属性之间相互独立。

2、每个属性同等重要。

通过假设1 知,条件概率P(X | Ci)可以简化为:3 朴素贝叶斯算法朴素贝叶斯算法的核心思想:选择具有最高后验概率作为确定类别的指标。

下面是以过滤有侮辱性的评论为例,介绍朴素贝叶斯利用Python 语言实现的过程,其本质是利用词和类别的联合概率来预测给定文档属于某个类别。

4 使用Python对文本分类4.1 建立文本数据文本数据用一个个对象组成,一个对象是由若干单词组成,每个对象对应一个确定的类别。

代码如下:1 # 文本数据集2 def loadDataList():3 postingList = [4 ['my','dog','has','flea','problems','help','please'],5 ['maybe','not','take','him','to','dog','park','stupid'],6 ['my','dalmation','is','so','cute','I','love','him'],7 ['stop','posting','stupid','worthless','garbage'],8 ['mr','licks','ate','my','steak','how','to','stop','him'],9 ['quit','buying','worthless','dog','food','stupid']]10 classVec = [0,1,0,1,0,1]11 return postingList ,classVec4.2 对文本数据的处理从文本数据中提取出训练样本的属性集,这里是属性集是由单词组成的词汇集。

朴素贝叶斯公式

朴素贝叶斯公式:p(B|C)=p(C|B)*P(B)/P(C)。

朴素贝叶斯公式是基于贝叶斯定理与特征条件独立假设的分类

方法。

最为广泛的两种分类模型是决策树模型和朴素贝叶斯模型(NBM)。

和决策树模型相比,朴素贝叶斯分类器(或NBC)发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率。

同时,NBC模型所需估计的参数很少,对缺失数据不太敏感,算法也比较简单。

理论上,NBC模型与其他分类方法相比具有最小的误差率。

但是实际上并非总是如此,这是因为NBC模型假设属性之间相互独立,这个假设在实际应用中往往是不成立的,这给NBC模型的正确分类带来了一定影响。

朴素贝叶斯的公式

朴素贝叶斯是一种常用的分类算法,其公式如下:

首先,根据贝叶斯定理,我们可以得到:

P(Y|X) = P(X|Y) * P(Y) / P(X)

其中,Y代表类别,X代表特征,P(Y|X)代表给定特征X时Y的概率,P(X|Y)代表在Y类别下,特征X的条件概率,P(Y)代表类别Y的先验概率,P(X)代表特征X的先验概率。

接下来,我们要假设所有特征是独立的,即给定类别Y时,所有特征之间没有任何关系,因此可以将P(X|Y)表示为所有特征的条件概率的乘积,即:

P(X|Y) = P(x1|Y) * P(x2|Y) * ... * P(xn|Y)

其中,x1, x2, ..., xn分别代表特征1, 特征2, ..., 特征n。

将上述公式代入贝叶斯定理公式中,我们可以得到:

P(Y|X) = P(x1|Y) * P(x2|Y) * ... * P(xn|Y) * P(Y) / P(X)

最后,我们需要比较所有类别Y的后验概率P(Y|X),选择概率最大的类别作为最终的分类结果。

以上便是朴素贝叶斯分类的公式解释,其中涉及到的概念需要深入理解和掌握。