信息论基础课程作业汇总

- 格式:docx

- 大小:75.71 KB

- 文档页数:4

二、填空(每空1分)(100道)1、在认识论层次上研究信息的时候,必须同时考虑到三个方面的因素。

2、 1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

3、按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

4、按照信息的地位,可以把信息分成客观信息和主观信息。

5、人们研究信息论的目的是为了地交换和利用各种各样的信息。

6、信息的可度量性是建立信息论的基础。

7、8、熵是香农信息论最基本最重要的概念。

9、事物的不确定度是用时间统计发生来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有比特、奈特和哈特。

13、必然事件的自信息是。

14、不可能事件的自信息量是∞。

15、两个相互独立的随机变量的联合自信息量等于两个自信息量之和。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量趋于变小。

17、离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的 N 倍。

??18、离散平稳有记忆信源的极限熵,H??N。

m19、对于n元m阶马尔可夫信源,其状态空间共有个不同的状态。

20、一维连续随即变量X在[a,b] 。

limH(X/XX?X)N12N?11log22?eP221、平均功率为P的高斯分布的连续信源,其信源熵,Hc(X)=。

22、对于限峰值功率的N维连续信源,当概率密度23、对于限平均功率的一维连续信源,当概率密度高斯分布时,信源熵有最大值。

24、对于均值为0,平均功率受限的连续信源,信源的冗余度决定于平均功率的限定值P和信源的熵功率P25、若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为。

26、m元长度为ki,i=1,2,···n的异前置码存在的充要条件是:i?1。

∶∶∶∶∶∶∶∶∶∶装∶∶∶∶∶∶∶∶∶∶∶订∶∶∶∶∶∶∶∶∶∶∶∶∶线∶∶∶∶∶∶∶∶∶∶∶∶∶∶∶∶试卷评分标准及标准答案(2013 — 2014 学年度第 1 学期)《课程(A 卷)一、选择题(本大题共6小题,每小题3分,共18分)1. 有一信源X,其概率分布为12341/41/81/81/2X x x x xP⎛⎫⎛⎫=⎪ ⎪⎝⎭⎝⎭,若对该信源进行二次扩展,则每二个符号的平均信息量是(A )A. 3.5bitB. 1.5bitC. 1.75bitD. 3bit2. 信源的概率密度为()1352xp x⎧≤≤⎪=⎨⎪⎩其它,则信源的差熵为(D )bit/自由度.A.1/2B.1/3C.1/5D.13. 某二元对称信源011/21/2XP⎛⎫⎛⎫=⎪ ⎪⎝⎭⎝⎭,失真矩阵0220d⎛⎫⎪⎝⎭=,则minD和maxD分别为( B )A. 1, 2B. 0, 1C. 1, 1D. 2, 24. 掷两粒骰子,当点数和为7时,该消息包含的信息量是(A )A. log6B. log36C. log18D. log35. 设信道输入用X表示,信道输出用Y表示。

在无噪无损信道中,()H X Y(C )0。

A. >B. <C. =D. 不确定6. 马氏源的转移概率如图所示,则其所对应的概率转移矩阵为(C )1/2A.1/201/201/21/21/302/3⎛⎫⎪⎪⎪⎝⎭B.1/211/21/21/21/21/302/3⎛⎫⎪⎪⎪⎝⎭C.1/32/3001/21/21/201/2⎛⎫⎪⎪⎪⎝⎭D.1/201/201/21/21/32/30⎛⎫⎪⎪⎪⎝⎭二、填空题(本大题共5小题,每小题3分,共15分)1. 信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2. 无失真信源编码定理(香农第一定理),可以简述为:存在无失真信源编码的充分必要条件是R H X()()R H X≥或信源编码码率不小于信源的熵()。

信息论基础试题及答案信息论基础试题及答案填空题(每题2分)1、信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的(可靠性)﹑(有效性)﹑保密性和认证性,使信息传输系统达到最优化。

(考点:信息论的研究目的)2、电视屏上约有500×600=3×105个格点,按每点有10个不同的灰度等级考虑,则可组成103?10个不同的画面。

按等概计算,平均每个画面可提供的信息量约为(106bit/画面)。

(考点:信息量的概念及计算)3、按噪声对信号的作用功能来分类信道可分为(加性信道)和(乘性信道)。

(考点:信道按噪声统计特性的分类)4、英文电报有32个符号(26个英文字母加上6个字符),即q=32。

若r=2,N=1,即对信源S的逐个符号进行二元编码,则每个英文电报符号至少要用(5)位二元符号编码才行。

(考点:等长码编码位数的计算)5、如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。

(考点:错误概率和译码准则的'概念)6、按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。

(考点:纠错码的分类)7、码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4,2))线性分组码。

(考点:线性分组码的基本概念)8、和离散信道一样,对于固定的连续信道和波形信道都有一个最大的信息传输速率,称之为(信道容量)。

(考点:连续信道和波形信道的信道容量)9、对于一个(n,k)分组码,其最小距离为d,那么,若能纠正t 个随机错误,同时能检测e(e≥t)个随机错误,则要求(d≥t+e+1)。

(考点:线性分组码的纠检错能力概念)判断题(每题2分)1、信源剩余度的大小能很好地反映离散信源输出的符号序列中符号之间依赖关系的强弱,剩余度越大,表示信源的实际熵越小。

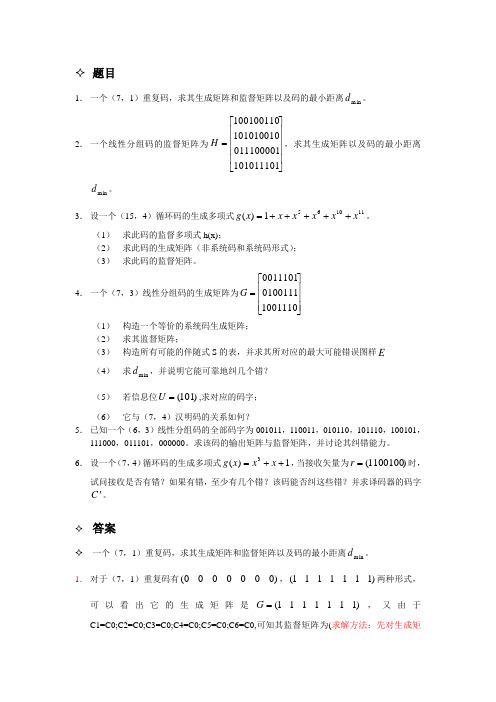

✧ 题目1. 一个(7,1)重复码,求其生成矩阵和监督矩阵以及码的最小距离min d 。

2. 一个线性分组码的监督矩阵为⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=101011101011100001101010010100100110H ,求其生成矩阵以及码的最小距离min d 。

3. 设一个(15,4)循环码的生成多项式1110651)(x x x x x x g +++++=。

(1) 求此码的监督多项式h(x);(2) 求此码的生成矩阵(非系统码和系统码形式); (3) 求此码的监督矩阵。

4. 一个(7,3)线性分组码的生成矩阵为⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=100111001001110011101G (1) 构造一个等价的系统码生成矩阵;(2) 求其监督矩阵;(3) 构造所有可能的伴随式S 的表,并求其所对应的最大可能错误图样E (4) 求min d ,并说明它能可靠地纠几个错?(5) 若信息位)101(=U ,求对应的码字; (6) 它与(7,4)汉明码的关系如何?5. 已知一个(6,3)线性分组码的全部码字为001011,110011,010110,101110,100101,111000,011101,000000。

求该码的输出矩阵与监督矩阵,并讨论其纠错能力。

6. 设一个(7,4)循环码的生成多项式1)(3++=x x x g ,当接收矢量为)1100100(=r 时,试问接收是否有错?如果有错,至少有几个错?该码能否纠这些错?并求译码器的码字C '。

✧答案✧ 一个(7,1)重复码,求其生成矩阵和监督矩阵以及码的最小距离min d 。

1. 对于(7,1)重复码有)0000000(,)1111111(两种形式,可以看出它的生成矩阵是)1111111(=G ,又由于C1=C0;C2=C0;C3=C0;C4=C0;C5=C0;C6=C0,可知其监督矩阵为(求解方法:先对生成矩阵转置,然后在其后面加上一单位矩阵即可)⎥⎥⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎢⎢⎣⎡=100000101000010010001000100100001010000011H ,7)0000000()1111111(min==d 2. 一个线性分组码的监督矩阵为⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=101011101011100001101010010100100110H ,求其生成矩阵以及码的最小距离min d 。

5.1设有信源⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛01.01.015.017.018.019.02.0)(7654321a a a a a a a X P X (1)求信源熵H(X)(2)编二进制香农码(3)计算其平均码长及编码效率解:(1)H(X)=-)(log )(21i ni i a p a p ∑=H(X)=-0.2log 20.2-0.19log 20.19-0.18log 20.18-0.17log 20.17-0.15log 20.15-0.log 20.1-0.01log 20.01H(X)=2.61(bit/sign)(2)ia i P(ai)jP(aj)ki码字a 001a 10.210.0030002a 20.1920.2030013a 30.1830.3930114a 40.1740.5731005a 50.1550.7431016a 60.160.89411107a 70.0170.9971111110(3)平均码长:-k =3*0.2+3*0.19+3*0.18+3*0.17+3*0.15+4*0.1+7*0.01=3.14(bit/sign)编码效率:η=R X H )(=-KX H )(=14.361.2=83.1%5.2对习题5.1的信源二进制费诺码,计算器编码效率。

⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛0.01 0.1 0.15 0.17 0.18 0.19 2.0 )(7654321a a a a a a a X P X 解:Xi)(i X P 编码码字ik 1X 0.2000022X 0.191001033X 0.18101134X 0.17101025X 0.151011036X 0.110111047X 0.01111114%2.9574.2609.2)()(74.2 01.0.041.0415.0317.0218.0319.032.02 )(/bit 609.2)(1.5=====⨯+⨯+⨯+⨯+⨯+⨯+⨯===∑KX H R X H X p k K sign X H ii i η已知由5.3、对信源⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛01.01.015.017.018.019.02.0)(7654321x x x x x x x X P X 编二进制和三进制赫夫曼码,计算各自的平均码长和编码效率。

信息论基础试题

以下是一些关于信息论基础的试题:

1. 什么是信息熵?请简要解释其概念和应用。

2. 请解释“信源”、“信源熵”和“平均码长”。

3. 假设一个信源有4个符号,每个符号出现的概率分别是0.3, 0.2, 0.25和0.25,求该信源的熵和平均码长。

4. 如果一个信源的熵为3比特,那计算出的平均码长是多少?

5. 请解释“信道容量”和“香农定理”。

6. 假设一个二进制对称信道的错误概率为0.1,那么该信道的容量是多少?

7. 请解释“数据压缩”以及数据压缩的原理和方法。

8. 假设有一个压缩算法可以将原始数据压缩至原来的85%,那么压缩率是多少?

9. 请解释“纠错码”以及纠错码的作用和原理。

10. 什么是哈夫曼编码?请简要解释其原理和应用。

请注意,以上问题只是信息论基础的一部分,信息论是一个较为复杂的学科领域,以上问题只涉及其中的一些基础概念和方法。

第四章 习题解答4-1、某一信源以概率1/2、1/4、1/8、1/16、1/32和1/32产生6种不同的符号1x 、2x 、3x 、4x 、5x 和6x ,每个符号出现是独立的,符号速率为1000(符号)/秒。

(1)请计算每个符号所含的信息量;(2)求信源的熵;(3)求单位时间内输出的平均信息量。

解:(1)按定义,各符号所含的信息量分别为()()()12121log log 12I x p x bit =-=-= ()()()22221log log 24I x p x bit =-=-= ()()()32321log log 38I x p x bit =-=-= ()()()42421log log 416I x p x bit =-=-= ()()()52521log log 532I x p x bit =-=-= ()()()62621log log 532I x p x bit =-=-=(2)信源的熵()()()()521222222log 111111111111log log log log log log 22448816163232323211345516168555025228163232323216i i i H X p x p x ==-=------++++=+++++===∑比特符号(3)单位时间内输出的平均信息量()()2510001562.516S I H X R ==⨯=比特4-2 一个离散信号源每毫秒发出4种符号中的一个,各相互独立符号出现的概率分别为0.4、0.3、0.2和0.1,求该信号源的平均信息量与信息速率。

解:信号源的平均信息量,即熵为:()()()()5212222log 0.4log 0.40.4log 0.40.4log 0.40.4log 0.41.864i i i H X p x p x ==-=----=∑比特 因为符号速率R S =1/10-3=103,信息速率R b()()31.86410b S R H X R ==⨯比特秒4-3 设有4个消息符号,其出现的概率分别是1/8、1/8、1/4和1/2,各消息符号的出现是相对独立的,求该符号集的平均信息量。

信息论基础课程作业汇总

2015/03/23 作业1

1. 查资料了解香农的研究生涯及其信息论的主要内容和应用。

作业2

1. 用微分或者积分中值定理证明基本对数不等式。

2. 用Jessen 不等式证明对数和不等式。

作业3

1. 在伪币称量问题中,若用天平比较两枚金币的重量,则三种结果的信息量分别是多少?

2. 在掷色子游戏中,当得知两个色子的点数之和为3时获得多少比特的信息?

3. 已知平均100人中有2人患有某种疾病,为了查明病情,必须进行某项指标的化验。

这

种化验的结果对于有病的人总是阳性的,对于健康的人来说有一半可能为阳性、一半可能为阴性。

若x 表示有这种病,y 表示化验结果为阳性,试计算I (x |y )与I (x ;y )并说明其含义。

4. 试证明()()() ;|I x y I x I x y =- 作业4

1. 中科大杨孝先版教材第52页,习题

2.3。

2. 设一条电线上串联了8个灯泡,如图所示。

假设其中有且只有一个灯泡坏了,并且各灯

泡的损坏概率相同,用万用电表通过测量断路找出坏灯泡。

(1)平均需要获得多少信息,才能找出其中的坏灯泡。

(2)一次测量所获得的信息的最大期望值是多少?

(3)试设计一个最佳测量方案,即测量次数的期望值最小的测量方案。

3. 伪币称量问题:今有12枚金币,其中1枚是伪币,其重量不同于真币。

(1) 要找出这枚伪币需获得多少信息? (2) 确定伪币比真币重还是轻需多少信息?

(3) 用一台无砝码的天平称量一次,平均最多可获得多少信息?

(4) 试设计一个称量方案,用3次称量找出伪币。

4. 程序设计1:输入有限概率分布,输出该分布的熵。

作业5

1. 设一个信源有6种信号,先后输出的信号是独立同分布的,其概率分布为 (1/2, 1/4, 1/8, 1/16, 1/32, 1/32) (1)该信源输出1个符号所提供的平均信息量。

(2)该信源输出100个符号所提供的平均信息量。

2. 在一段时间内,某城市交通的忙闲天数按天气阴晴和气温冷暖进行分类统计如下:

(1) 计算交通忙闲状态的无条件熵。

(2) 计算天气和气温状态下的条件熵。

(3) 计算从天气和气温状态所获得的关于交通状态的信息。

3. 世界职业棒球锦标赛为7场赛制,只要其中一队赢得4场,比赛就结束。

设随机变量X

代表在比赛中A 队和B 队较量的可能结果(X 的可能取值如AAAA ,BABABAB 和BBBAAAA ,其中A,B 分别表示A 队和B 对获胜)。

设Y 代表比赛的场数,取值范围为4到7。

假设A 队和B 队是同等水平的,且每场比赛相互独立。

试计算H(X),H(Y), H(Y|X)和H(X|Y)。

作业6

1. 设二元对称信道的误码率为1%,当输入符号的概率分布为均匀分布时,计算该信道的

损失熵和信息传输率,并说明其意义。

作业7

1. 证明平均符号熵序列是单调递减的,即对于任何n ,

1212+1()()

+1n n H X X X H X X X n n

晴

阴

暖 8天

忙

冷 27天 暖 16天

晴

阴

暖 15天

闲

冷 4天 暖 12天

冷 12天 冷 8天

2. 设X 是一个二元二阶马尔科夫信源,其条件概率矩阵P(X 3|X 1X 2)如下,试画出该信源的

隐马尔科夫模型的状态转移图,求其极限分布并计算信源熵率。

3. 程序设计2:构造英语字母的3-阶马尔科夫模型。

输入:英文语料(即英语文章,至少1万个单词,越多越好)。

输出:英语符号的2-阶条件概率矩阵。

作业8

1. 设X 为独立同分布的随机序列,其共同的概率分布为

11K K s s p p ⎡⎤⎢⎥⎣⎦

试计算1/12[()]

N

N P X X X 依概率收敛的极限。

2. 设X 为独立同分布的随机序列,其共同的概率分布为

10.250.75⎡⎤⎢⎥⎣⎦

试计算如下两种情形下长度为n 的ε-典型序列的概率。

(1)ε=0.10, n=100 (2)ε=0.05, n=10 作业11

1. 证明定理1.4:若信源S 是平稳的,则S 的N -次扩展信源也是平稳的,并且

()()N H S NH S ∞∞=

2. 设计编码方法,根据下列码长构造即时码。

log i i l p =-⎡⎤⎢⎥

作业12

1.设离散无记忆信源的符号概率分布为

(0.4, 0.2, 0.15, 0.15, 0.1)

试根据该分布构造二元霍夫曼码,并计算其平均码长和压缩率。

2.程序设计3:霍夫曼编码

功能:输入一个信源符号集的概率分布,输出该信源符号集的霍夫曼码本。

作业14

1.设某二元无记忆信源的符号概率分布为

p(0)=1/4,p(1)=3/4

试对信源序列110010进行2次扩展算术编码。

作业15

1.对cbbcbabcaa分别进行LZ78编码和LZW编码。

作业16

1.设二元对称信道传递符号的速率是1Mb/s,错误概率是0.01。

写出该信道的转移矩阵,并

计算信道容量。

2.设一个均匀分布的二元信源X,产生了一个大小为9Mb的数据w。

若直接用上述信道传输

该数据会导致大约1%的信息损失。

试说明,若对w进行信道编码再发送,能否在10秒钟内以任意小的错误概率发送完该数据。