淘宝技术框架分析报告

- 格式:docx

- 大小:244.55 KB

- 文档页数:15

淘宝的架构淘宝用的是JBoss,框架是iBATIS,缓存服务器是自己开发的,基本遵循SNA架构,水平扩展,数据库是Oracle,阿里集团的DBA几乎是国内最强悍的。

目前淘宝的系统架构正在重构,计划用两到三年时间重写,目标有两个:1、水平扩展已经不满足需求了,还需要水平加垂直扩展2、开放API,让店家可以把外部网站资源集成到淘宝,不必直接在淘宝开店淘宝首席架构师是原来JBoss的Ben Wang,现在正在招募技术高手加盟,从事这项很有挑战性的工作:设计下一代开放性、支撑数十亿访问量的在线电子商务网站淘宝架构更详细的情况就不方便透露了。

淘宝网,是一个在线商品数量突破一亿,日均成交额超过两亿元人民币,注册用户接近八千万的大型电子商务网站,是亚洲最大的购物网站。

那么对于淘宝网这样大规模的一个网站,我猜想大家一定会非常关心整个网站都采用了什么样的技术、产品和架构,也会很想了解在淘宝网中是否采用了开源的软件或者是完全采用的商业软件。

那么下面我就简单的介绍一下淘宝网中应用的开源软件。

对于规模稍大的网站来说,其IT必然是一个服务器集群来提供网站服务,数据库也必然要和应用服务分开,有单独的数据库服务器。

对于像淘宝网这样规模的网站而言,就是应用也分成很多组。

那么下面,我就从应用服务器操作系统、应用服务器软件、Web Server、数据库、开发框架等几个方面来介绍一下淘宝网中开源软件的应用。

操作系统我们首先就从应用服务器的操作系统说起。

一个应用服务器,从软件的角度来说他的最底层首先是操作系统。

要先选择操作系统,然后才是操作系统基础上的应用软件。

在淘宝网,我们的应用服务器上采用的是Linux操作系统。

Linux操作系统从1991年第一次正式被公布到现在已? ? 走过了十七个年头,在PC Server 上有广泛的应用。

硬件上我们选择PC Server而不是小型机,那么Server的操作系统供我们选择的一般也就是Linux,FreeBSD, windows 2000 Server或者Windows Server 2003。

淘宝技术框架分析报告淘宝作为国内首屈一指的大型电子商务网站,每天承载近30亿PV的点击量,拥有近50PB的海量数据,那么淘宝是如何确保其网站的高可用的呢?本文将对淘宝在构建大型网站过程中所使用到的技术框架做一个总结,并结合吉林银行现有技术框架进行对比分析。

另外,本文还会针对金融互联网以及公司未来技术发展方向给出个人看法。

淘宝技术分析CDN技术及多数据中心策略国内的网络由于运营商不同(分为电信、联通、移动),造成不同运营商网络之间的互访存在性能问题。

为了解决这个问题,淘宝在全国各地建立了上百个CDN节点,当用户访问淘宝网站时,浏览器首先会访问DNS服务器,通过DNS解析域名,根据用户的IP将访问分配到不同的入口。

如果客户的IP属于电信运营商,那么就会被分配到同样是电信的CDN节点,并且保证访问的(这里主要指JS、CSS、图片等静态资源)CDN节点是离用户最近的。

这样就将巨大的访问量分散到全国各地。

另外,面对如此巨大的业务请求,任何一个单独的数据中心都是无法承受的,所以淘宝在全国各主要城市都建立了数据中心,这些数据中心不但保证了容灾,而且各个数据中心都在提供服务。

不管是CDN技术还是多个数据中心,都涉及到复杂的数据同步,淘宝很好的解决了这个问题。

吉林银行现在正在筹建两地三中心,但主要目的是为了容灾,数据中心的利用率差,而淘宝的多个数据中心利用率为100%。

LVS技术淘宝的负载均衡系统采用了LVS技术,该技术目前由淘宝的章文嵩博士负责。

该技术可以提供良好的可伸缩性、可靠性以及可管理型。

只是这种负载均衡系统的构建是在Linux操作系统上,其他操作系统不行,并且需要重新编译Linux操作系统内核,对系统内核的了解要求很高,是一种软负载均衡技术。

而吉林银行则通过F5来实现负载均衡,这是一种硬负载均衡技术。

Session框架Session对于Web应用是至关重要的,主要是用来保存用户的状态信息。

但是在集群环境下需要解决Session共享的问题。

淘宝APP分析报告一、引言淘宝APP作为中国最大的电商平台之一,具有庞大的用户群体和丰富的商品资源。

本文以淘宝APP为研究对象,旨在通过分析其功能、用户体验以及市场竞争等方面,为淘宝APP的发展提供一些建议和参考。

二、功能分析淘宝APP作为一个电商平台,具有多样化的功能,旨在提供便捷的购物体验和丰富的商品选择。

主要功能包括:1.商品搜索和浏览:用户可以通过关键词搜索商品,通过筛选、排序等功能快速找到心仪的商品。

2.商品详情页:展示商品的详细信息、图片、规格、评价等,帮助用户做出购买决策。

3.购物车:用户可以将多个商品加入购物车,统一结算,提供便捷的购物流程。

4.订单管理:用户可以查看订单状态、物流信息,进行退款、评价等操作。

5.个人中心:提供用户的个人信息管理、收货地址管理等功能。

三、用户体验分析1. 界面设计淘宝APP的界面设计简洁明了,采用了符合用户习惯的布局和配色方案,使用户在使用过程中能够快速找到需要的功能模块。

2. 操作流程淘宝APP的操作流程简单直观,用户可以通过少量的点击和滑动完成购物流程,提高了用户的购物效率和体验。

3. 用户评价根据用户的反馈,淘宝APP的用户评价普遍较高。

用户认为淘宝APP的商品种类丰富,价格有竞争力,购物过程相对顺利,售后服务也比较到位。

四、市场竞争分析淘宝APP面临着激烈的市场竞争,主要竞争对手包括京东、拼多多等电商平台。

下面对比分析了淘宝APP和竞争对手的一些关键指标:指标淘宝APP 京东拼多多用户规模较大较大较大商品种类丰富丰富有限价格竞争力较高较高较低用户评价较好好一般从上表可以看出,淘宝APP在用户规模、商品种类和价格竞争力方面占据优势。

然而,拼多多以低价团购的形式吸引了一部分用户,并在用户评价方面有一定的竞争力。

五、改进建议基于对淘宝APP的分析和市场竞争的对比,提出以下改进建议:1.持续优化用户体验:进一步简化操作流程,提高页面加载速度,增强搜索和筛选功能的准确性和便利性,提升用户的购物体验。

淘宝技术框架分析报告淘宝作为国内首屈一指的大型电子商务网站,每天承载近30 亿PV 的点击量,拥有近50PB 的海量数据,那么淘宝是如何确保其网站的高可用的呢?本文将对淘宝在构建大型网站过程中所使用到的技术框架做一个总结,并结合吉林银行现有技术框架进行对比分析另外,本文还会针对金融互联网以及公司未来技术发展方向给出个人看法。

淘宝技术分析CDN 技术及多数据中心策略国内的网络由于运营商不同(分为电信、联通、移动),造成不同运营商网络之间的互访存在性能问题。

为了解决这个问题,淘宝在全国各地建立了上百个CDN 节点,当用户访问淘宝网站时,浏览器首先会访问DNS 服务器,通过DNS 解析域名,根据用户的IP 将访问分配到不同的入口。

如果客户的IP 属于电信运营商,那么就会被分配到同样是电信的CDN 节点,并且保证访问的(这里主要指JS CSS、图片等静态资源)CDN节点是离用户最近的。

这样就将巨大的访问量分散到全国各地。

另外,面对如此巨大的业务请求,任何一个单独的数据中心都是无法承受的,所以淘宝在全国各主要城市都建立了数据中心,这些数据中心不但保证了容灾,而且各个数据中心都在提供服务。

不管是CDN 技术还是多个数据中心,都涉及到复杂的数据同步,淘宝很好的解决了这个问题。

吉林银行现在正在筹建两地三中心,但主要目的是为了容灾,数据中心的利用率差,而淘宝的多个数据中心利用率为100% 。

LVS 技术淘宝的负载均衡系统采用了LVS 技术,该技术目前由淘宝的章文嵩博士负责。

该技术可以提供良好的可伸缩性、可靠性以及可管理型。

只是这种负载均衡系统的构建是在Linux操作系统上,其他操作系统不行,并且需要重新编译Linux 操作系统内核,对系统内核的了解要求很高,是一种软负载均衡技术。

而吉林银行则通过F5 来实现负载均衡,这是一种硬负载均衡技术。

Session 框架Session 对于Web 应用是至关重要的,主要是用来保存用户的状态信息。

淘宝技术框架分析报告淘宝作为国内首屈一指的大型电子商务网站,每天承载近30亿PV的点击量,拥有近50PB的海量数据,那么淘宝是如何确保其网站的高可用的呢?本文将对淘宝在构建大型网站过程中所使用到的技术框架做一个总结,并结合吉林银行现有技术框架进行对比分析。

另外,本文还会针对金融互联网以及公司未来技术发展方向给出个人看法。

淘宝技术分析CDN技术及多数据中心策略国内的网络由于运营商不同(分为电信、联通、移动),造成不同运营商网络之间的互访存在性能问题。

为了解决这个问题,淘宝在全国各地建立了上百个CDN节点,当用户访问淘宝网站时,浏览器首先会访问DNS服务器,通过DNS解析域名,根据用户的IP 将访问分配到不同的入口。

如果客户的IP属于电信运营商,那么就会被分配到同样是电信的CDN节点,并且保证访问的(这里主要指JS、CSS、图片等静态资源)CDN节点是离用户最近的。

这样就将巨大的访问量分散到全国各地。

另外,面对如此巨大的业务请求,任何一个单独的数据中心都是无法承受的,所以淘宝在全国各主要城市都建立了数据中心,这些数据中心不但保证了容灾,而且各个数据中心都在提供服务。

不管是CDN技术还是多个数据中心,都涉及到复杂的数据同步,淘宝很好的解决了这个问题。

吉林银行现在正在筹建两地三中心,但主要目的是为了容灾,数据中心的利用率差,而淘宝的多个数据中心利用率为100%。

LVS技术淘宝的负载均衡系统采用了LVS技术,该技术目前由淘宝的章文嵩博士负责。

该技术可以提供良好的可伸缩性、可靠性以及可管理型。

只是这种负载均衡系统的构建是在Linux操作系统上,其他操作系统不行,并且需要重新编译Linux操作系统内核,对系统内核的了解要求很高,是一种软负载均衡技术。

而吉林银行则通过F5来实现负载均衡,这是一种硬负载均衡技术。

Session框架Session对于Web应用是至关重要的,主要是用来保存用户的状态信息。

但是在集群环境下需要解决Session共享的问题。

淘宝数据魔方技术架构解析淘宝网拥有国内最具商业价值的海量数据。

截至当前,每天有超过30亿的店铺、商品浏览记录,10亿在线商品数,上千万的成交、收藏和评价数据。

如何从这些数据中挖掘出真正的商业价值,进而帮助淘宝、商家进行企业的数据化运营,帮助消费者进行理性的购物决策,是淘宝数据平台与产品部的使命。

为此,我们进行了一系列数据产品的研发,比如为大家所熟知的量子统计、数据魔方和淘宝指数等。

尽管从业务层面来讲,数据产品的研发难度并不高;但在“海量”的限定下,数据产品的计算、存储和检索难度陡然上升。

本文将以数据魔方为例,向大家介绍淘宝在海量数据产品技术架构方面的探索。

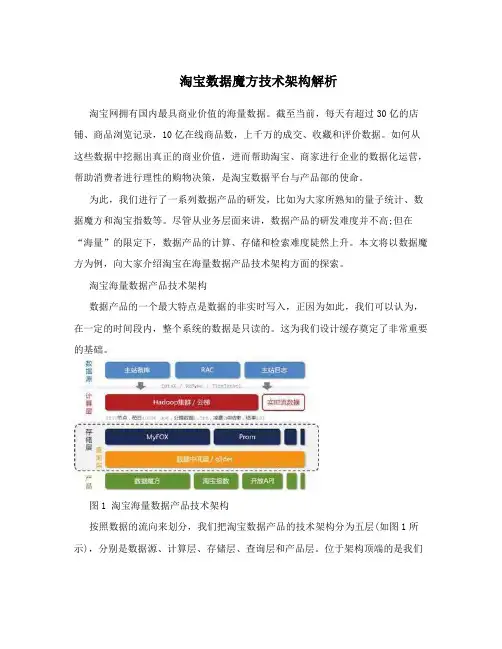

淘宝海量数据产品技术架构数据产品的一个最大特点是数据的非实时写入,正因为如此,我们可以认为,在一定的时间段内,整个系统的数据是只读的。

这为我们设计缓存奠定了非常重要的基础。

图1 淘宝海量数据产品技术架构按照数据的流向来划分,我们把淘宝数据产品的技术架构分为五层(如图1所示),分别是数据源、计算层、存储层、查询层和产品层。

位于架构顶端的是我们的数据来源层,这里有淘宝主站的用户、店铺、商品和交易等数据库,还有用户的浏览、搜索等行为日志等。

这一系列的数据是数据产品最原始的生命力所在。

在数据源层实时产生的数据,通过淘宝主研发的数据传输组件DataX、DbSync 和Timetunnel准实时地传输到一个有1500个节点的Hadoop集群上,这个集群我们称之为“云梯”,是计算层的主要组成部分。

在“云梯”上,我们每天有大约40000个作业对1.5PB的原始数据按照产品需求进行不同的MapReduce计算。

这一计算过程通常都能在凌晨两点之前完成。

相对于前端产品看到的数据,这里的计算结果很可能是一个处于中间状态的结果,这往往是在数据冗余与前端计算之间做了适当平衡的结果。

不得不提的是,一些对实效性要求很高的数据,例如针对搜索词的统计数据,我们希望能尽快推送到数据产品前端。

淘宝服务端技术架构详解目录一、前言 (3)二、单机架构 (4)三、多机部署 (4)四、分布式缓存 (5)五、Session 共享解决方案 (7)六、数据库读写分离 (9)七、CDN 加速与反向代理 (10)八、分布式文件服务器 (11)九、数据库分库分表 (11)十、搜索引擎与NoSQL (13)十一、后序 (13)一、前言以淘宝网为例,简单了解一下大型电商的服务端架构是怎样的。

如图所示最上面的就是安全体系系统,中间的就是业务运营系统,包含各个不同的业务服务,下面是一些共享服务,然后还有一些中间件,其中ECS 就是云服务器,MQS 是队列服务,OCS 是缓存等等,右侧是一些支撑体系服务。

除图中所示之外还包含一些我们看不到的,比如高可用的体现。

淘宝目前已经实现多机房容灾和异地机房单元化部署,为淘宝的业务也提供了稳定、高效和易于维护的基础架构支撑。

这是一个含金量非常高的架构,也是一个非常复杂而庞大的架构,当然这个架构不是一天两天演进成这样的,也不是一开始就设计并开发成这样的,对于初创公司而言,很难在初期就预估到未来流量千倍、万倍的网站架构会是怎样的状况,同时如果初期就设计成千万级并发的流量架构,也很难去支撑这个成本。

因此一个大型服务系统,都是从小一步一步走过来的,在每个阶段找到对应该阶段网站架构所面临的问题,然后不断解决这些问题,在这个过程中,整个架构会一直演进,同时内含的代码也就会演进,大到架构、小到代码都是在不断演进和优化的。

所以说高大上的项目技术架构和开发设计实现不是一蹴而就的,这是所谓的万丈高楼平地起。

二、单机架构从一个小网站说起,一般来说初始一台服务器就够了,文件服务器、数据库以及应用都部署在一台机器上。

也就是俗称的 allinone 架构。

这篇推荐看下:厉害了,淘宝千万并发,14 次架构演进…三、多机部署随着网站用户逐渐增多,访问量越来越大,硬盘、cpu、内存等开始吃紧,一台服务器难以支撑。

主持人:今天我们特别请来淘宝资深技术专家范禹给我们分享《淘宝业务发展及技术架构》,接下来时间交给范禹,大家欢迎!范禹:大家下午好,首先感谢刘警给我这个机会跟大家做技术交流,接下来我开始讲一下,花名叫范禹,现在在淘宝技术研发部产品技术业务平台团队,今天的主要内容分为下面几块,因为主题叫淘宝业务与技术发展,前面业务会简单提一下,然后介绍一下淘宝前期技术发展过程,然后是最近几次比较大的技术结构上的变化,还有当前面临的挑战和问题,最后是讨论时间。

淘宝业务很多,我们有主站交易,有搜索,有广告,数据平台等很多相关业务,我是做主站交易平台,主要是JAVA系统,我更多是讲这块,其他像开放平台、搜索、广告不大会涉及到,我看问题中有位同学问我P4P广告如何定位到目标用户的,这个我不太知道,如果有兴趣可以邀请相关同学给大家做一个交流。

淘宝是03年成立的,这是淘宝03年的页面,UED的同学发给我淘宝历年的首页,这个页面我第一次看到觉得还不错,很有欧美网站的风格,这就是03年淘宝刚创立时候的样子,里面像买家通道、卖家通道、淘宝者联盟,淘宝者联盟可能并不是现在的淘客,应该是那时候的一个社区,03年5月份的时候淘宝推出,那时候的页面是这样子,当时是比较简单的购物网站。

(Taobao@2004)接下来就到了04年,从右上角导航上看,其实主体框架已经定下来,我要买、我要卖、我的淘宝,这几块功能这么多年来都没有大的变化,可能是交互或者说用户体验上的改变,但是它的功能可能并没有特别大的变化。

04年在业务上我认为有两块比较重要的东西,一个是旺旺从贸易通改造成淘宝IM工具,成为方便买卖购物交流的IM工具,这是我认为业务上比较大变化的东西。

另外支付宝从淘宝慢慢发展,成为独立的一家公司。

我印象中04年业务上关注的PV跟UV比,就是每个用户在淘宝上停留的时间,因为以前淘宝刚成立的时候,很多门户网站跟Ebay签了排他协议,淘宝不能在大的网站上投广告,可能找一些网站联盟,他们是弹窗式的广告,平均每个用户在淘宝待几个页面,当时目标就是让用户多看几个页面。

从个人到淘宝网仰观Java时代淘宝的技术发展(1)引言光棍节的狂欢“时间到,开抢!”坐在电脑前早已等待多时的小美一看时间已到2011年11月11日零时,便迫不及待地投身于淘宝商城一年一度的大型网购促销活动——“淘宝双11购物狂欢节”。

小美打开早已收藏好的宝贝——某品牌的雪地靴,飞快的点击购买,付款,一回头发现3000双靴子已被抢购一空。

小美跳起来,大叫一声“欧耶!”小美不知道,就在11日零点过后的这一分钟,全国有342万人和她一起涌入淘宝商城。

当然,她更不知道,此时此刻,在淘宝的一间办公室里,灯火通明,这里是“战时指挥部”,淘宝技术部的一群工程师,正在紧盯着的流量和交易数据。

白板上是他们刚刚下的注,赌谁能最准确地猜中流量峰值和全天的交易总额。

他们的手边放着充足的食物和各类提神的饮料。

一阵急促的声响起来,是前线部门询问数据的,工程师大声报着:“第1分钟,进入淘宝商城的会员有342万”。

过一会工程师主动拿起:“交易额超过1亿了,现在是第8分钟。

”接下来,“第21分钟,刚突破2亿”。

“第32分钟,3亿了”。

“第1个小时,4.39亿”。

这些数据随后出现在微博上,引起一片惊呼。

“完蛋了!”突然有人大喝一声,所有的眼睛都紧的盯着他,只见他挠挠头,嘿嘿的笑道“我赌的少了,20亿轻松就能过了,我再加5亿”,他跑去白板边上把自己的赌注擦去,写上25,接下来有人写上28,有人写上30,有人跑到微博上开下盘口,同事们纷纷下注。

接下来的这24个小时,战时指挥部的工程师们都不能休息,他们盯着的各种监控指标,适时的调整机器和增减功能。

顶住第一波高峰之后,这些人开始忙里偷闲的给自己买东西,大家互相交流着哪家买的移动硬盘靠谱,哪家衣服适合自己的女朋友,不时的有人哀嚎宝贝被人抢了、信用卡额度不够了。

同时,旁边白板上的赌注越下越大。

11月11日,这个棍子最多的日子被网民自我调侃的变成了一个节日——“光棍节”。

而淘宝网又用疯狂的折扣促销给它赋予了另外一个意义——“购物狂欢节”。

淘宝网体系分析一、淘宝网的系统功能体系分析1、强大的管理功能。

在淘宝网的页面设计中,色彩用鲜艳的橙色、红色为主。

首页很整齐,有条理,有序,有层次感,并且体现了淘宝网的精神——简单、简约。

登陆淘宝网首页后,通过搜索引擎,可以直接又方便地在淘宝网淘到想要的宝贝;或者点击“高级搜索”,能缩小搜索范围,更方便地查找宝贝。

通过价格,通过店主名字,通过店铺名字都可以迅速找到想要的宝贝。

在后台有功能强大的二级栏目,包括我要买、我要卖、我的淘宝、社区(即互动论坛)、交易安全、帮助中心。

可以使买卖方快捷、方便交易。

正是有了强大的管理功能,所以淘宝网在面对竞争对手时,能更好地为用户服务。

2、方便的网上买卖系统。

通过电子商务平台为买卖双方提供了一个在线交易平台,卖方可以主动提供商品上网销售或拍卖,而买方可以自行选择商品进行竞价和购买,不再受时间和空间的限制,广泛方便的比价、议价、竞价过程节约了大量的市场沟通成本。

另一方面参与的群体庞大,选择的范围更广。

3、安全的支付系统——支付宝。

支付宝系统的引进在更深层次上为交易安全提供了保障。

在淘宝网的交易过程中,买家看好货物后,可以选择通过支付宝先将钱交给淘宝网,得到淘宝网确认到款后,卖家放心的向买家发货。

而淘宝网亦在买家确认商品满意度后将钱款打入卖家的帐号。

支付宝功能为监督买家和卖家的信用提供了完整的解决方案。

支付宝的实施过程中同样引入第三方监督机制,用户通过银行和淘宝网的B2C接口向淘宝网支付汇款,以银行为信用中介,淘宝网给客户提供了资金流向的监督保证。

通过与银行的携手合作,将达到客户、银行、淘宝网的三赢局面,而这种三赢,实质上就是客户、淘宝网与银行间建立的一种良性互动的诚信监督机制的外显。

据支付宝方面的统计,目前国内每100个在网上购物的人群中,平均有82个通过支付宝进行支付,高峰时这一数字达到了89个。

目前支持使用支付宝服务的外部商家数量已经超过46万家,涵盖了机票、虚拟游戏、数码通信以及商业服务等行业。

高性能电子商务网站-淘宝网技术架构研究2008年淘宝的交易额是1000亿规模,2009年的时候是2000亿规模,2010年淘宝网的交易额4000亿规模,如何构建一个支撑这么大交易规模的高性能、并发的电子商务平台网站呢?以下结合网络资料,研究一下淘宝网的技术架构变迁。

淘宝网从2003年开始建立的,从1.0到1.5的版本.2005年开始2.0的版本,2012年4.0的版本上线。

马云的创业团队共10个人,马云以及他的秘书,8个里面有3个开发人员,三丰、多龙(音)、虚竹,还有UED的二当家,三位运营人员,小宝、阿柯和破天,总经理是财神。

团队开始研发是2003年4月7日,一个月后的5月10日淘宝第一个版本上线。

这段时间,创业团队关在小区里面写代码,每天早上9点到晚上1、2点。

淘宝网第一个版本MALT架构,采用PHP+MySQL首先花2000美金买了一个MALT架构网站,很精典的LAMP技术架构,刚开始的编程语言和数据库是PHP+MySQL,然后配套开发后台管理系统。

一开始部署在一台单机服务器上,流量增长后,把发邮件功能部署在一台机器上,后来再增加机器出来。

2004年MySQL撑不住了,数据存储的引擎很大缺点会锁表,一读的话把表锁住了,读的量一上来经常会锁掉,然后重启。

MySQL撑不住了,开始考虑换Oracle,除了Oracle强大之外还有一个原因是阿里巴巴那些年03、04年Oracle 人才积累达到非常强大的水平。

那时Oracle给全球的研发人员发一个称号“ACE”,那时全球三百多位,那时中国十来位,而阿里巴巴有三位。

阿里巴巴在Oracle方面能力非常强大。

换了Oracle有一个问题,PHP跟Oracle很不搭的东西,PHP一个用户访问过来建立一个连接切掉一个连接,而Oracle提供的连接数量非常有限的,因为有连接池的功能。

怎么用PHP来连接Oracle?我们就抄袭别人看,eBay用的太贵,没有用。

找了一个日本的,但是上了一个当,总重启。

淘宝海量数据产品技术架构如下图2-1所示,即是淘宝的海量数据产品技术架构,咱们下面要针对这个架构来一一剖析与解读。

相信,看过本博客内其它文章的细心读者,定会发现,图2-1最初见于本博客内的此篇文章:从几幅架构图中偷得半点海量数据处理经验之上,同时,此图2-1最初发表于《程序员》8月刊,作者:朋春。

在此之前,有一点必须说明的是:本文下面的内容大都是参考自朋春先生的这篇文章:淘宝数据魔方技术架构解析所写,我个人所作的工作是对这篇文章的一种解读与关键技术和内容的抽取,以为读者更好的理解淘宝的海量数据产品技术架构。

与此同时,还能展示我自己读此篇的思路与感悟,顺带学习,何乐而不为呢?。

Ok,不过,与本博客内之前的那篇文章(几幅架构图中偷得半点海量数据处理经验)不同,本文接下来,要详细阐述这个架构。

我也做了不少准备工作(如把这图2-1打印了下来,经常琢磨):图2-1 淘宝海量数据产品技术架构好的,如上图所示,我们可以看到,淘宝的海量数据产品技术架构,分为以下五个层次,从上至下来看,它们分别是:数据源,计算层,存储层,查询层和产品层。

我们来一一了解这五层:1. 数据来源层。

存放着淘宝各店的交易数据。

在数据源层产生的数据,通过DataX,DbSync和Timetunel准实时的传输到下面第2点所述的“云梯”。

2. 计算层。

在这个计算层内,淘宝采用的是hadoop集群,这个集群,我们暂且称之为云梯,是计算层的主要组成部分。

在云梯上,系统每天会对数据产品进行不同的mapreduce计算。

3. 存储层。

在这一层,淘宝采用了两个东西,一个使MyFox,一个是Prom。

MyFox是基于MySQL的分布式关系型数据库的集群,Prom是基于hadoop Hbase技术的(读者可别忘了,在上文第一部分中,咱们介绍到了这个hadoop的组成部分之一,Hbase—在hadoop之内的一个分布式的开源数据库)的一个NoSQL的存储集群。

淘宝系统uml可行性分析淘宝系统是一个大型的在线购物平台,拥有众多的用户和商家。

对于淘宝系统进行uml可行性分析,可以从以下几个方面来考虑:系统的复杂性、系统的稳定性、系统的可扩展性、系统的可维护性以及系统的性能要求。

下面我将逐一分析这些方面。

首先是淘宝系统的复杂性。

淘宝系统包括了商品管理、订单管理、支付服务、物流服务等多个模块,每个模块都有自己的功能和业务逻辑。

在uml可行性分析中,需要对每个模块进行详细的分析,包括类的关系、类的属性与操作以及类之间的消息传递等。

对于复杂的系统来说,uml是一种非常有效的建模工具,它可以清晰地描述系统的结构和行为,帮助开发人员更好地理解和设计系统。

其次是淘宝系统的稳定性。

淘宝系统的稳定性对于用户来说非常重要,一旦系统出现故障或者中断,会对用户的购物体验造成很大的影响。

在uml可行性分析中,需要考虑系统的可靠性和可用性。

通过uml建模可以详细描述系统的各个模块的功能和互动流程,从而更好地发现系统中的潜在问题和风险点。

通过分析系统的uml模型,开发人员可以对系统的稳定性进行评估,并采取相应的措施来提高系统的可靠性和可用性。

再次是淘宝系统的可扩展性。

淘宝系统作为一个在线购物平台,需要应对不断增长的用户和商家数量。

在uml可行性分析中,需要考虑系统的可扩展性,即系统是否可以方便地进行扩展,以应对不断增长的业务需求。

通过uml建模可以清晰地描述系统的各个模块之间的依赖关系和接口规范,从而更好地分析系统的扩展性。

如果系统的uml模型中存在较强的耦合和依赖关系,那么可能需要通过重构系统的设计来提高系统的可扩展性。

然后是淘宝系统的可维护性。

淘宝系统作为一个大型的系统,需要进行不断的维护和升级。

在uml可行性分析中,需要考虑系统的可维护性,即在系统运行过程中是否容易进行bug修复、功能扩展和性能优化等工作。

通过uml建模可以清晰地描述系统的各个模块的功能和逻辑,从而更好地理解和维护系统。

淘宝技术框架分析报告淘宝作为国内首屈一指的大型电子商务网站,每天承载近30亿PV的点击量,拥有近50PB的海量数据,那么淘宝是如何确保其网站的高可用的呢?本文将对淘宝在构建大型网站过程中所使用到的技术框架做一个总结,并结合吉林银行现有技术框架进行对比分析。

另外,本文还会针对金融互联网以及公司未来技术发展方向给出个人看法。

淘宝技术分析CDN技术及多数据中心策略国内的网络由于运营商不同(分为电信、联通、移动),造成不同运营商网络之间的互访存在性能问题。

为了解决这个问题,淘宝在全国各地建立了上百个CDN节点,当用户访问淘宝网站时,浏览器首先会访问DNS服务器,通过DNS解析域名,根据用户的IP将访问分配到不同的入口。

如果客户的IP属于电信运营商,那么就会被分配到同样是电信的CDN节点,并且保证访问的(这里主要指JS、CSS、图片等静态资源)CDN节点是离用户最近的。

这样就将巨大的访问量分散到全国各地。

另外,面对如此巨大的业务请求,任何一个单独的数据中心都是无法承受的,所以淘宝在全国各主要城市都建立了数据中心,这些数据中心不但保证了容灾,而且各个数据中心都在提供服务。

不管是CDN技术还是多个数据中心,都涉及到复杂的数据同步,淘宝很好的解决了这个问题。

吉林银行现在正在筹建两地三中心,但主要目的是为了容灾,数据中心的利用率差,而淘宝的多个数据中心利用率为100%。

LVS技术淘宝的负载均衡系统采用了LVS技术,该技术目前由淘宝的章文嵩博士负责。

该技术可以提供良好的可伸缩性、可靠性以及可管理型。

只是这种负载均衡系统的构建是在Linux操作系统上,其他操作系统不行,并且需要重新编译Linux操作系统内核,对系统内核的了解要求很高,是一种软负载均衡技术。

而吉林银行则通过F5来实现负载均衡,这是一种硬负载均衡技术。

Session框架Session对于Web应用是至关重要的,主要是用来保存用户的状态信息。

但是在集群环境下需要解决Session共享的问题。

目前解决这个问题通常有三种方式,第一个是通过负载均衡设备实现会话保持,第二个是采用Session复制,第三个则是采用集中式缓存。

第二种方式严重制约了集群环境的可伸缩性,不利于集群的横向扩展,即使是采取两两复制也会造成集群内部网络负载严重,更别说采用广播的方式,会造成网络垃圾。

淘宝采用了第三种方式,因为第一种方式对于淘宝来说成本比较高,而且他们已经采用了LVS的负载均衡技术。

吉林银行由于采用F5来实现负载均衡,所以第一种方式是必然选择。

HSF框架HSF是淘宝的高性能服务框架,它是在淘宝进行应用拆分后诞生的。

应用拆分后,各系统变得更加“专业”,因此产生了很多服务调用者和服务提供者。

HSF框架就是负责协调服务调用者与服务提供者之间的通讯。

服务提供者在启动时会向HSF框架的ConfigServer注册服务信息(接口、版本、超时时间、序列化方式等),这样ConfigServer 上面就定义了所有可供调用的服务(同一个服务也可能有不同的版本);服务调用者启动时向ConfigServer注册对哪些服务感兴趣,当服务提供者的信息变化时,ConfigServer向相应的感兴趣的服务调用者推送新的服务信息列表;服务调用者则根据服务信息列表直接访问相应的服务提供者,无需经过ConfigServer。

由于服务的提供者大多是集群,HSF还可以提供软负载均衡,引导服务调用者调用负载状况比较轻的服务提供者。

HSF的作用很像是吉林银行的ESB,但是吉林银行的ESB要求事先做好服务的注册工作,而不是在服务提供者启动时向ESB自动注册;服务调用者也是事先就知道ESB所提供的服务接口,而不是等到启动时向ESB注册需要的服务。

另外,吉林银行的服务调用者和服务提供者之间的通讯必须经过ESB,也做不到对后端服务提供者进行软负载均衡,后端的服务提供者需要自己完成负载均衡。

可以看出HSF虽然在逻辑上将服务调用者与服务提供者进行了解耦,但是在实际操作上服务调用者和服务提供者是直接交互的,在通讯层面上并没有彻底解耦,如果服务调用者通讯协议改变,服务调用者也需要跟着改变,但是性能上的确比ESB要好。

Notify框架对于通知类的解决方案,莫过于采取消息中间件技术。

Notify框架就是淘宝根据自身业务需要量身定制的一款消息中间件。

它的架构与HSF框架一样,也有一个ConfigServer。

消息的客户端(Notify Client)通过ConfigServer订阅消息服务,消息的服务端(Notify Server)在ConfigServer上注册消息服务。

为了保证消息一定能发出且对方也一定能收到,消息数据本身就需要记录下来,而这些消息则保存在数据库中。

在Notify框架中消息具有中间状态(已发送、未发送等),所以应用系统可以通过Notify框架实现分布式事务。

说起消息中间件,吉林银行采用的是WebLogic JMS和IBM MQ。

这两款消息中间件对消息的持久化是采用文件的形式保存在本地,WebLogic JMS的横向扩展依赖于WebLogic的横向扩展,而IBM MQ的集群部署比较麻烦。

而Notify框架可以很容易地进行横向扩展,处理大量的消息。

TDDL框架一个大型网站在成长过程中,除了要对应用进行拆分外,还要对数据进行拆分。

数据拆分可以分为“垂直拆分”和“水平拆分”。

当数据库里有很多表,可以根据表之间的关联程度进行垂直拆分;当数据库的表的记录很多时,可以进行水平拆分。

通常情况下,数据拆分都指的是水平拆分。

但是数据拆分之后,会带来很多应用上的问题,例如应用程序需要知道哪些记录被拆分到了哪个数据库上,应用程序需要做很大的改动。

另外数据拆分也会不可避免地造成跨库查询,一旦跨库查询将严重损耗系统的性能。

为了解决以上问题,淘宝根据自身业务特点开发了TDDL框架,该框架屏蔽了数据拆分对应用程序的影响,通过缓存来解决跨库查询的问题,另外TDDL还支持搜索引擎。

吉林银行由于业务量不大,还谈不上数据拆分。

TFS框架在淘宝上有着大量的图片、商品描述以及评价信息,这些信息占据了淘宝的大部分数据存储。

而图片、商品描述、评价信息这种数据并不是传统意义上的结构化数据,用关系数据库或者一般的文件系统对这些数据进行存储并不合适。

这些非结构化数据特点是规模大、空间小,而对于大多数系统来说,最头疼的就是大规模小文件的读写,因为磁头需要频繁的寻道和换道,很容易带来延迟。

当并发量增大之后简直就是系统的噩梦。

为了解决这个问题,淘宝根据GFS(Google File System)自主研发了TFS。

TFS在架构上和Hadoop很像,因为他们都源自GFS。

TFS由一对Name Server和多台Data Server构成,以Block文件的形式存放数据文件(一个Block的大小一般为64MB),Block在多个Data Server上存储多份,这样做主要是为了冗余,保证数据安全。

Name Server主要是负责保存元数据,采取一对Name Server是为了避免单点失效。

应用程序在读写文件过程中直接与Data Server进行数据传输,不经过Name Server。

吉林银行在运营中心项目中采用了TFS,用它来保存影像信息。

由于吉林银行受限于业务要素,内部的数据大多是结构化数据,非结构化数据很少。

Tair框架缓存技术在淘宝可谓是用到了极致,无论是前端的Web应用还是后端的业务处理都采用了缓存。

可以这么说,淘宝之所以能够提供如此高并发的访问,缓存技术的使用占了大头,把几乎所有能缓存的数据都缓存起来。

Tair框架是淘宝基于memcached开发的一款Key-Value缓存,由一个中心控制点和多个服务节点组成。

控制节点用来维护服务节点的状态信息,而服务节点用来提供各种数据服务。

目前为了保证可用性,中心控制点采用一主一备的形式部署。

吉林银行并没有向淘宝这样一款全局性的缓存系统,缓存的使用情况也很少,即使使用也大多都局限于各个业务系统内部。

Hadoop技术前面说过,Hadoop与TFS在架构上基本一样,所以淘宝对于Hadoop的使用重点放在了对大数据的分析处理上,这也正是Hadoop 的强项,而TFS更专注于对非结构化数据的存储。

淘宝通过Dbsync 框架来实现从Oracle、Mysql数据库向Hadoop实时同步数据,这种同步是以增量方式进行的;通过TimeTunnel2框架来实现从日志文件向Hadoop实时同步数据,也是以增量方式进行。

另外,又通过DataX 将Oracle、Mysql数据库中的数据以全量非实时的方式同步到Hadoop 当中。

Hadoop利用MapReduce将同步过来的数据进行分析处理,然后将结果再通过DataX传回给Oracle、Mysql数据库。

吉林银行由于数据量小并且多为结构化数据,所以采用传统的数据仓库方式对数据进行联机分析处理(OLAP)。

另外,吉林银行现在对数据的处理还停留在OLAP阶段,并没有深入到数据挖掘阶段。

搜索引擎技术淘宝使用的搜索引擎技术与百度、Google这种通用搜索引擎不同,淘宝的搜索引擎更关注于网站自身的东西,例如商品搜索、店铺搜索等等。

所以,淘宝搜索引擎本质上是一款垂直搜索引擎。

淘宝的搜索引擎对时效性要求很高,例如,店铺发布了一款新的商品,不可能十几分钟之后还没有在搜索引擎上搜索到。

而百度、Google对时效性要求不高,当然这与通用搜索引擎采用的技术有关,一般来讲,通用搜索引擎是通过网络爬虫在网上搜索相关数据并建立索引供检索系统使用的,所以爬虫的收录周期决定了其时效性。

商品、店铺这些信息都是淘宝自身的数据,不需要网络爬虫,当这些数据生成时就可以建立索引供检索系统使用。

吉林银行还没有自己的垂直搜索引擎,将来有必要在这方面进行投入。

总结1.分布式从以上的分析来看,淘宝在处理大并发、大数据的时候总体思路是分布式。

无论是应用拆分还是数据拆分都是分布式技术的运用。

淘宝基于HSF框架和Notify框架搭建了自己的分布式通讯系统;基于TDDL框架搭建了自己的分布式数据库系统;基于TFS框架搭建了自己的分布式文件系统;基于Tair框架搭建了自己的分布式缓存系统。

可见分布式是解决高并发、大数据的最有效手段。

吉林银行目前根据业务也划分为很多系统,例如核心系统、信贷系统、卡系统、支付系统等,这本身就是分布式的思想。

遥想几年前采用的胖核心系统,什么都做什么都管,到现在的瘦核心系统只做账务处理,这不正是淘宝所做的应用拆分吗?2.Scale up与Scale out在谈这个问题之前我想先说一下数据拆分。

可能有人会说,即使一个表的记录有很多,我们不也可以通过分区来解决吗?为什么非要数据拆分不可,弄得那么复杂。