《信息论》(电子科大)复习资料

- 格式:doc

- 大小:553.00 KB

- 文档页数:12

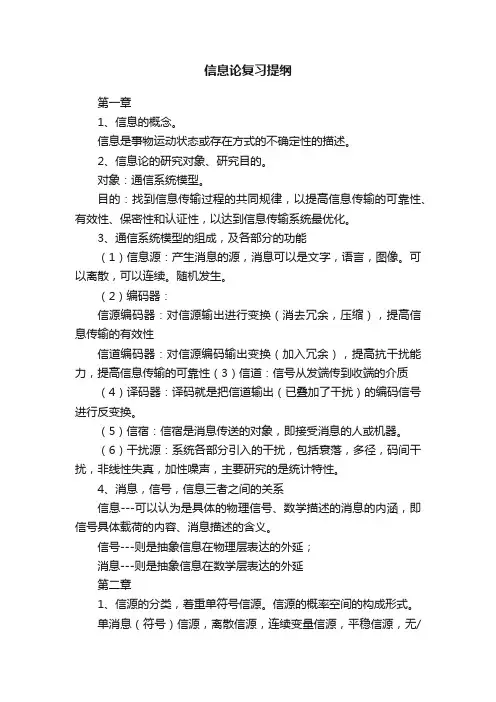

信息论复习提纲第一章1、信息的概念。

信息是事物运动状态或存在方式的不确定性的描述。

2、信息论的研究对象、研究目的。

对象:通信系统模型。

目的:找到信息传输过程的共同规律,以提高信息传输的可靠性、有效性、保密性和认证性,以达到信息传输系统最优化。

3、通信系统模型的组成,及各部分的功能(1)信息源:产生消息的源,消息可以是文字,语言,图像。

可以离散,可以连续。

随机发生。

(2)编码器:信源编码器:对信源输出进行变换(消去冗余,压缩),提高信息传输的有效性信道编码器:对信源编码输出变换(加入冗余),提高抗干扰能力,提高信息传输的可靠性(3)信道:信号从发端传到收端的介质(4)译码器:译码就是把信道输出(已叠加了干扰)的编码信号进行反变换。

(5)信宿:信宿是消息传送的对象,即接受消息的人或机器。

(6)干扰源:系统各部分引入的干扰,包括衰落,多径,码间干扰,非线性失真,加性噪声,主要研究的是统计特性。

4、消息,信号,信息三者之间的关系信息---可以认为是具体的物理信号、数学描述的消息的内涵,即信号具体载荷的内容、消息描述的含义。

信号---则是抽象信息在物理层表达的外延;消息---则是抽象信息在数学层表达的外延第二章1、信源的分类,着重单符号信源。

信源的概率空间的构成形式。

单消息(符号)信源,离散信源,连续变量信源,平稳信源,无/有记忆信源,马尔可夫信源,随机波形信源。

单消息(符号)信源:单消息(符号)信源--离散信源单消息(符号)信源--连续信源2、自信息的计算及物理含义,单位与底数的关系,含义。

计算:含义:当事件ai发生以前,表示事件ai发生的不确定性当事件ai发生以后表示事件ai所含有(所提供)的信息量单位与底数的关系:通信与信息中最常用的是以2为底,这时单位为比特(bit);理论推导中用以e为底较方便,这时单位为奈特(Nat);工程上用以10为底较方便,这时单位为哈特(Hart)。

它们之间可以引用对数换底公式进行互换。

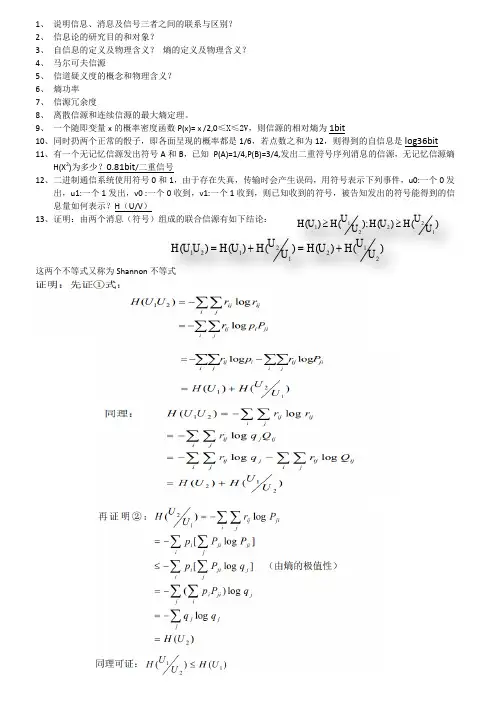

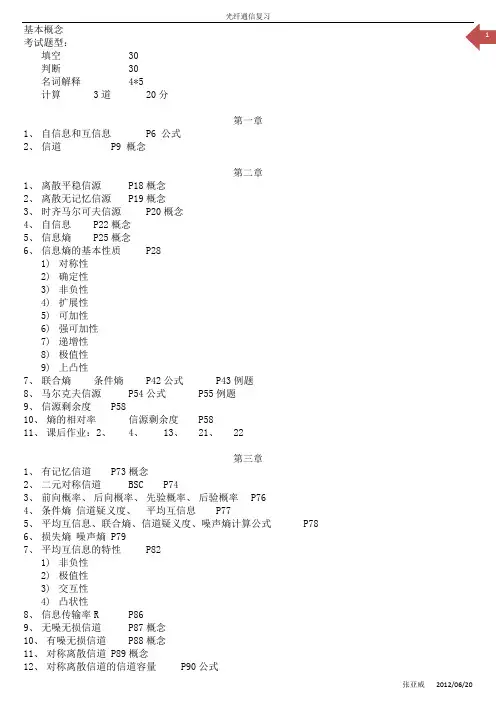

判断30名词解释4*5计算3道20分第一章1、自信息和互信息P6 公式2、信道P9 概念第二章1、离散平稳信源P18概念2、离散无记忆信源P19概念3、时齐马尔可夫信源P20概念4、自信息P22概念5、信息熵P25概念6、信息熵的基本性质P281)对称性2)确定性3)非负性4)扩展性5)可加性6)强可加性7)递增性8)极值性9)上凸性7、联合熵条件熵P42公式P43例题8、马尔克夫信源P54公式P55例题9、信源剩余度P5810、熵的相对率信源剩余度P5811、课后作业:2、4、13、21、22第三章1、有记忆信道P73概念2、二元对称信道BSC P743、前向概率、后向概率、先验概率、后验概率P764、条件熵信道疑义度、平均互信息P775、平均互信息、联合熵、信道疑义度、噪声熵计算公式P786、损失熵噪声熵 P797、平均互信息的特性P821)非负性2)极值性3)交互性4)凸状性8、信息传输率R P869、无噪无损信道P87概念10、有噪无损信道P88概念11、对称离散信道 P89概念12、对称离散信道的信道容量P90公式张亚威2012/06/20张亚威2012/06/2116、 数据处理定理 P113定理 17、 信道剩余度 P118公式 18、 课后作业:1、 3、 9第五章1、 编码:实质上是对信源的原始符号按一定的数学规则进行的一种变换。

2、 等长码 P172概念3、 等长信源编码定理 P1784、 编码效率 P1805、 克拉夫特不等式 P1846、 香农第一定理 P1917、 码的剩余度 P194第六章1、 最大后验概率准则 最小错误概率准则 P2002、 最大似然译码准则 P2013、 费诺不等式 P2024、 信息传输率(码率) P2055、 香农第二定理 P2156、 课后习题 3、第八章1、 霍夫曼码 最佳码 P2732、 费诺码 P2793、 课后习题 11、第八章1、 编码原则 译码原则 P3072、 定理9.1 P3133、 分组码的码率 P314公式4、 课后习题 3、一、 填空题1、 在现代通信系统中,信源编码主要用于解决信息传输中的 有效性 ,信道编码主要用于解决信息传输中的 可靠性 ,加密编码主要用于解决信息传输中的 安全性 。

第二章知识要点: 1.自信息量:(),)log ()i i i i p x p x =-设事件x 的概率为那么,他的自信息定义为I(x上定义式取对数的底为2,信息量的单位为比特 (bit); 上定义式取对数的底为e ,信息量的单位为奈特 (nat);上定义式取对数的底为10,信息量的单位为哈脱来(haitely---hat)。

2.互信息量:(|)(;)log ()11loglog()(|)i j i j i i i j p x y I x y p x p x p x y ==-3.平均自信息量(熵)1()[()][log ()]()log ()qi i i i i H X E I x E p x p x p x ===-=-∑3’.熵函数:12121X ,,...,()()(,,...,)log q qq i ii p p p H X H p H p p p p p ===-∑因为随机变量集的熵H(X)只是其概率分布的函数,所以熵函数又可记为4.条件熵:(|)()(|)()log (|)XYXYH Y X p xy I y x p xy p y x ==-∑∑5.联合熵(,)()()()log ()i j i j XYi j i j XYH X Y p x y I x y p x y p x y ==-∑∑6.平均互信息量(;)()(;)(|)()log()()(;)j j Yi j i j XYi i j i j XYI X Y p y I X y p x y p x y p x p x y I x y ===∑∑∑2.9 如有6行8列的棋型方格,若有2个质点A 和B ,分别以等概率落入任一方格内,且它们的坐标分别为(X A ,Y A )、(X B ,Y B ),但A ,B 不能落入同一方格内。

试求: (1)若仅有质点A ,求A 落入任一个方格的平均自信息量是多少? (2)若已知A 已人,求B 落人的平均自信息量。

A.信息技术复习题一、单选题1.关于信息,以下说法不正确的是( C )。

A.信息是有价值的 B.信息能减少对事物认识的不确定性C.信息具有滞后性 D.信息具有不可转换性2.查询信息在信息处理中所属于的阶段是( C )。

A.输入 B.加工 C.输出 D.输入和输出3.信息技术的发展趋势不会是( A )。

A.应用的复杂化 B.传输的高速化 C.信息的多媒体化 D.网络化4.对于信息社会,以下说法不正确的是( C )。

A.信息成为社会发展的重要资源 B.人们可以十分方便地获取各种资源C.人们都生活在虚拟的信息空间中 D.信息产业成为国民经济的重要产业5.直接获取信息的途径是( B )。

A.看电视 B.从事科学研究 C.听广播 D.上网浏览6.在信息处理过程中,以下属于数值信息处理的过程是( C )。

A.用Word制作一张小报 B.用扫描仪扫描一张图片C.用计算机解方程 D.用计算机录制一段声音7.信息技术的英文缩写是( A )。

A.IT B.IE C.OS D.I/O8.计算机与( D )是信息处理的核心。

A.电视机 B.传真机 C.打印机 D.网络9.现代计算机所采用的存储程序原理是由( C )提出的。

A.图灵 B.布尔 C.冯·诺依曼 D.爱因斯坦10.通常认为,第一台电子计算机诞生于( A )。

A.1946 B.1948 C.1950 D.195211.计算机发展阶段的划分是以( C )作为标志的。

A.程序设计语言 B.存储器 C.逻辑元件 D.运算速度12.第一代计算机主要采用( B )元器件。

A.晶体管 B.电子管 C.中小规模集成电路 D.超大规模集成电路13.计算机软件系统包括( C )。

A.编辑软件和连接程序 B.数据库软件和管理软件C.系统软件和应用软件 D.程序和数据14.在计算机硬件系统中,用于实施算术运算和逻辑判断的主要部件是( A )。

A.运算器 B.控制器 C.存储器 D.显示器15.以下不属于应用软件的是( A )。

信息论复习知识点(总11页) -CAL-FENGHAI.-(YICAI)-Company One1-CAL-本页仅作为文档封面,使用请直接删除1、平均自信息为表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。

平均互信息表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

2、最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

3、最大熵值为。

4、通信系统模型如下:5、香农公式为为保证足够大的信道容量,可采用(1)用频带换信噪比;(2)用信噪比换频带。

6、只要,当N足够长时,一定存在一种无失真编码。

7、当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。

8、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。

9、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

按照信息的地位,可以把信息分成客观信息和主观信息。

人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

信息的可度量性是建立信息论的基础。

统计度量是信息度量最常用的方法。

熵是香农信息论最基本最重要的概念。

事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为 其发生概率对数的负值 。

12、自信息量的单位一般有 比特、奈特和哈特 。

13、必然事件的自信息是 0 。

14、不可能事件的自信息量是 ∞ 。

15、两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量 趋于变小 。

第二章 信源熵一、自信息量1. 定义:一个随机事件发生某一结果后所带来的信息量称为自信息量,简称自信息。

定 义为其发生概率对数的负值。

若随机事件发生i a 的概率为)(i a p ,那么它的自信 息量为:)(log )(2i i a p a I -= (bit )2. 性质:在事件发生前,)(i a I 表示该事件发生的不确定性。

在事件发生后,)(i a I 表示事件发生所提供的信息量。

二、信源熵1. 定义: 已知单符号离散无记忆信源的数学模型我们定义信源各个离散消息的自信息量的数学期望为信源的平均信息量,一般称为信源的平均信息量: )(log )(])(1[log )]([)( 212i ni i i i a p a p a p E a I E X H ∑=-=== 2. 信源熵与平均自信息量之间的区别两者在数值上是相等的,但含义不同。

信源熵表征信源的平均不确定度,平均自信息量是消除不确定度所需要的信息的度量。

信源一定,不管它是否输出离散消息,只要这些离散消息具有一定的概率特性,必有信源的熵值,该熵值在总体平均的意义上才有意义,因而是一个确定值, 。

在离散信源的情况下,信源熵的值是有限的。

而信息量只有当信源输出离散消息并被接收后,才有意义,这就是给予接收者的信息度量。

3. 最大离散熵定理:信源X 中包含n 个不同离散消息时,信源熵H(X)有: n X H 2log )(≤当且仅当X 中各个消息出现的概率全相等时,上式取等号。

4. 扩展信源的信源熵:N 次扩展信源的信源熵:)()(X NH X H N=)(,),(,),(),( , , , ,,)( 2121⎭⎬⎫⎩⎨⎧=⎥⎦⎤⎢⎣⎡n i n i a p a p a p a p a a a a X P X三、平均互信息量 1. 定义:互信息),,2,1;,,2,1()/()()()(log );(2m j n i b a I a I a p b a p b a I j i i i j i j i ==-==在联合概率空间中的统计平均值。

信息论导论参考资料作者 龙非池第一章 概论● 在认识论层次研究信息时,把只考虑到形式因素的部分称为语法信息, 把只考虑到含义因素的部分称为语义信息;把只考虑到效用因素的部分称为语用信息。

目前,信息论中主要研究语法信息● 归纳起来,香农信息论的研究内容包括: 1) 信息熵、信道容量和信息率失真函数2) 无失真信源编码定理、信道编码定理和保真度准则下的信源编码定理 3) 信源编码、信道编码理论与方法● 一般认为,一般信息论的研究内容除香农信息论的研究内容外,还包括 维纳的微弱信号检测理论:包括噪声理论、信号滤波与预测、统计检测与估计理论、调制理论等。

信息科学以信息为研究对象,信息科学以信息运动规律为研究内容,信 息运动包括获取、传递、存储、处理和施用等环节。

第二章 离散信源及离散熵● 单符号离散信源的数学模型:1212()()()()n n x x x X P x P x P x P X ⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭自信息量:()log ()i x i I x P x =-,是无量纲的,一般根据对数的底来定义单位:当对数底为2时,自信息量的单位为比特(bit,binary unit);对数底为e 时,其单位为奈特(nat,nature unit);对数底为10时,其单位为哈特(Hart, Hartley)自信息量性质:I(x i )是随机量;I(x i )是非负值;I(x i )是P(x i )的单调递减函数。

● 单符号离散信源的离散熵:1()[()]()()ni i i i H X E I x P x lbP x ===-∑,单位是比特/符号(bit/symbol)。

离散熵的性质和定理:H(X)的非负性;H(X)的上凸性; 最大离散熵定理:()H X lbn ≤● 如果除概率分布相同外,直到N 维的各维联合概率分布也都与时间起点 无关,即:111111()()()()()()k l k k l l k k k N l l l N P X P X P X X P X X P X X X P X X X ++++-++-===则称该多符号离散信源为N 维离散平稳信源。

书中:1.信息科学,材料科学,能源科学仪器被称为当代的“三大支柱”。

2.带宽与数据传输速率信道带宽与数据传输速率的关系可以奈奎斯特(Nyquist)准则与香农(Shanon)定律描述。

奈奎斯特准则指出:如果间隔为π/ω(ω=2πf),通过理想通信信道传输窄脉冲信号,则前后码元之间不产生相互窜扰。

因此,对于二进制数据信号的最大数据传输速率Rmax 与通信信道带宽B (B=f,单位Hz)的关系可以写为:Rmax =2.f(bps);对于二进制数据若信道带宽B=f=3000Hz ,则最大数据传输速率为6000bps 。

香农定理则描述了有限带宽、有随机热噪声信道的最大传输速率与信道带宽、信噪比之间的关系。

香农定理指出:在有随机热噪声的信道上传输数据信号时,数据传输速率Rmax 与信道带宽B 、信噪比S/N 的关系为: Rmax =B.log2(1+S/N)3.自信息量的性质:非负性、必然事件信息量为0、不可能事件信息量为无穷、信息量是概率的单调递减函数。

4.当X 和Y 相互独立时,互信息为0.5.信源熵表征信源的平均不确定度,平均自信息量是消除信源不确定度所需要的信息的量度。

6信源熵H(X)与信息率R 和信道容量C 的关系:不论何种信道,只要信息率R 小鱼信道容量C ,总能找到一种编码,能在信道上以任意小的错误概率和任意接近于C 的传输率来传送信息。

反之,若R>C,则传输总要产生失真。

又由无失真信源编码定理可知,要做到几乎无失真信源编码,信息率R 必须大于信源熵H (X )。

故三者的关系为:H(x)<=R<=C7.保真度准则下的信源编码定理:即译码平均失真度大于允许失真度。

8.香农三个基本编码定理:无失真信源编码定理、信道编码定理和限失真信源编码定理。

三个基本概念:信源熵、信道容量和信息率失真函数。

9.信源编码、信道编码和安全编码信源编码是以提高通信有效性为目的的编码。

通常通过压缩信源的沉余度来实现。

信息论导论参考资料作者 龙非池第一章 概论● 在认识论层次研究信息时,把只考虑到形式因素的部分称为语法信息, 把只考虑到含义因素的部分称为语义信息;把只考虑到效用因素的部分称为语用信息。

目前,信息论中主要研究语法信息● 归纳起来,香农信息论的研究内容包括: 1) 信息熵、信道容量和信息率失真函数2) 无失真信源编码定理、信道编码定理和保真度准则下的信源编码定理 3) 信源编码、信道编码理论与方法● 一般认为,一般信息论的研究内容除香农信息论的研究内容外,还包括 维纳的微弱信号检测理论:包括噪声理论、信号滤波与预测、统计检测与估计理论、调制理论等。

信息科学以信息为研究对象,信息科学以信息运动规律为研究内容,信 息运动包括获取、传递、存储、处理和施用等环节。

第二章 离散信源及离散熵● 单符号离散信源的数学模型:1212()()()()n n x x x X P x P x P x P X ⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭自信息量:()log ()i x i I x P x =-,是无量纲的,一般根据对数的底来定义单位:当对数底为2时,自信息量的单位为比特(bit,binary unit);对数底为e 时,其单位为奈特(nat,nature unit);对数底为10时,其单位为哈特(Hart, Hartley)自信息量性质:I(x i )是随机量;I(x i )是非负值;I(x i )是P(x i )的单调递减函数。

● 单符号离散信源的离散熵:1()[()]()()ni i i i H X E I x P x lbP x ===-∑,单位是比特/符号(bit/symbol)。

离散熵的性质和定理:H(X)的非负性;H(X)的上凸性; 最大离散熵定理:()H X lbn ≤● 如果除概率分布相同外,直到N 维的各维联合概率分布也都与时间起点 无关,即:111111()()()()()()k l k k l l k k k N l l l N P X P X P X X P X X P X X X P X X X ++++-++-===则称该多符号离散信源为N 维离散平稳信源。

● N 维离散平稳信源的数学模型:12121212()()()()N N N n N n a a a X X X P a P a P a P X X X ⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭1212,,,,,{1,2,,}N i i i i N a x x x i i i n =∈其中 12121121()()()(/)(/)N N N i i i i i i i i i i i P a P x x x P x P x x P x x x x -==● 二维离散平稳信源的离散熵:2121211()()()()(/)n i i i H X X P a lbP a H X H X X ==-=+∑H(X 2/X 1 )称为条件熵,是条件信息量在联合概率上的数学期望,H(X 1X 2)称为联合熵,离散熵H(X 1)、 H(X 2)称为无条件熵,H 2(X 1X 2)称为平均符号熵且:212(/)()H X X H X ≤,2121211()()()2H X X H X X H X =≤● 对于,121211()()()N N N H X X X H X X X H X N=≤,当N→∞时,平均符号熵取极限值,称之为极限熵,用H ∞表示:121lim ()N N H H X X X N∞→∞=● 如果离散平稳信源发出的符号序列中各符号相互独立,则称该信源为离 散平稳无记忆信源。

N 维离散平稳无记忆信源(一维离散平稳信源的N 次扩展信源)的数学模型:1212()()()()N N N n N n a a a X p a p a p a P X ⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭1212,,,,,{1,2,,}N i i i i N a x x x i i i n =∈其中,12()()()()N i i i i p a p x p x p x =其离散熵:121()()()()()N N H X H X H X H X NH X =+++=信源的平均符号熵:11()()()N N N H X H X H X N==● 如果离散平稳信源发出的符号只与前面已经发出的m(<N)个符号相关, 则称该信源为m 阶马尔科夫信源。

可将m 阶马尔科夫信源发出的符号序列看成长度为m+1的一段段符号序列,m 阶马尔科夫信源的数学模型:111211212112/()()()(/)m m m m n m m n a a a X X X X p a p a p a P X X X X ++++⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭112112/()(/)m m m m i i i i i i i i i i a x x x x p a p x x x x ++==其中,,为强调m 阶马尔科夫信源的长度特征,一般将其极限熵H ∞记为H m+1,即:111()(/)(/)m mn n m i j i j i i j H H p e p e e lbp e e ∞+====-∑∑马尔科夫链的各态历经定理:11()()(/)1,2,,()0,()1mmn n m j i j i j j i j p e p e p e e j n p e p e ====>=∑∑,,其中第三章 离散信源无失真编码● 码字的每一个比特携带信息的效率即编码效率:()H X Kη=,K 平均码长 一般采用不等长编码,使平均码长接近离散熵,从而在无失真前提下提高编码效率;编码的基本原则是大概率符号元编成短码,小概率符号元编成长码如果所采用的不等长编码使接收端能从码序列中唯一地分割出对应与每一个符号元的码字,则称该不等长编码为单义可译码。

单义可译码中,如果能在对应与每一个符号元的码字结束时立即译出的称为即时码,如果要等到对应与下一个符号元的码字才能译出的称为延时码。

异前置码:任何一个码字都不是其他码字的前缀m 元长度为k i , i=1,2, …,n 的异前置码存在的充分必要条件是:11ink i m-=≤∑,(克拉夫特(Kraft)不等式)● 无失真编码定理:(香农第一定理)如果L 维离散平稳信源的平均符号熵为H L (X 1X 2…X L ),对信源符号进行m 元不等长组编码,一定存在一种无失真编码方法,当L 足够大时,使得每个信源符号所对应码字的平均比特数:1212()()L L L L KH X X X lbm H X X X Lεε≤<+,为任意给定的小数1212()()L L L L lbmKH X X X lbm H X X X L Lεε≥≤<+只要,无失真编码定理从理论上阐明了编码效率:1η→● L→∞时,1lim L H K lbm Lη∞→∞== 则极限熵H ∞是一个界限,通常也称为香农界对于L 维离散平稳无记忆信源,由于其平均符号熵H L (X 1X 2…X L ) =H(X),故对信源符号进行m 元不等长组编码,一定存在一种无失真编码方法,当L 足够大时,使得每个信源符号所对应码字的平均比特数:()()KH X lbm H X Lε≤<+,此时香农界为H(X)。

对离散平稳信源进行无失真编码,每个信源符号所对应码字的平均比特数平稳无记忆信源最多, m 阶马尔科夫信源次之,一般平稳信源最少。

● 二进制香农码的编码步骤如下: 1) 将符号元x i 按概率进行降序排列2) 令p(x 0)=0,计算第j-1个码字的累加概率:10()()1,2,,j a j i i p x p x j n -===∑,3) 确定第i 个码字的码长k i ,满足下列不等式:()()1i i i lbp x k lbp x -≤<-+ 4) 将p a (x j )用二进制表示,取小数点后k i 位作为符号元x i 的码字。

● 哈夫曼(Huffman)编码1) 将符号元按概率进行降序排列2) 为概率最小的符号元分配一个码元1,概率次小的符号元分配一个码元0 3)将概率最小的两个符号元合并成一个新的符号元,用两者概率之和作为该新符号元的概率;4) 重复以上三个步骤,直到最后合并出一个以1为概率的符号元哈弗曼码有两种排列方式,分前置和后置。

采用不同排列方法编出的哈夫曼码,其码字和码长可能完全不相同,但平均码长一定是相等的,因此编码效率不会因排列方法而改变。

但放在前面可以使短码得到充分利用第四章 离散信道及信道容量● 符号离散信道的数学模型可表示为:112111222212(/)(/)(/)(/)(/)(/)(/)(/)(/)(/)m m n n m n p y x p y x p y x p y x p y x p y x P Y X p y x p y x p y x ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎣⎦● 互信息量在有噪信道的情况下,将信源发出x i 而信宿接收到y j 所包含的信息量用I(y j ;x i )来表示并将其称为x i 对y j 的互信息量,则互信息量的定义为:(/)(;)()(/)()(/)()j i j i j j i j j i j p y x I y x I y I y x lbp y lbp y x lbp y =-=-+=I(y j /x i )称为条件信息量,表示信道给出的“信息”。

互信息量的性质:I(y j ;x i )是随机量,I(y j ;x i )可为正值也可为负值,I(y j ;x i )具有对称性● 单符号离散信道的平均互信息量:1111(/)(;)()(;)()()n m n mj i i j j i i j i j i j j p y x I Y X p x y I y x p x y lbp y ======∑∑∑∑(;)()(/)I Y X H Y H Y X =-,条件熵H(Y/X)是信道所给出的平均信息量,通常称为噪声熵(;)()(/)I Y X H X H X Y =-,条件熵H(X/Y)也是信道所给出的平均“信息”量,通常称为损失熵,也称为信道疑义度(;)()()()I Y X H X H Y H XY =+-● 平均互信息量的性质和定理: 1) I(Y;X)的对称性 2) I(Y;X)的非负性3) I(Y;X)的极值性:(;)()I Y X H Y ≤ (;)()I Y X H X ≤4) I(Y;X)的凸函数性当信道固定时,I(Y;X)是信源概率分布P(X)的上凸函数;当信源固定时,I(Y;X)是信道转移概率分布P(Y/X)的下凸函数 5) 数据处理定理:(;)(;)I Z X I Y X ≤ (;)(;)I X Z I Y Z ≤一个信息传递并进行数据处理的问题可看成是一个由串联信道进行信息传递的问题● 单符号离散信道的信道容量由于平均互信息量反映的是每传输一个符号在信道中流通的平均信息量,从这个意义上,可以将其理解为信道的信息传输率(不是信息传输速率!),即(;)R I Y X =。