最优化梯度法和共轭梯度法

- 格式:ppt

- 大小:1023.50 KB

- 文档页数:24

Matlab中的最优化问题求解方法近年来,最优化问题在各个领域中都扮演着重要的角色。

无论是在工程、经济学还是科学研究中,我们都需要找到最优解来满足特定的需求。

而Matlab作为一种强大的数值计算软件,在解决最优化问题方面有着广泛的应用。

本文将介绍一些Matlab中常用的最优化问题求解方法,并探讨其优缺点以及适用范围。

一. 无约束问题求解方法1. 最速下降法最速下降法是最简单且直观的无约束问题求解方法之一。

其基本思想是沿着梯度的反方向迭代求解,直到达到所需的精度要求。

然而,最速下降法的收敛速度通常很慢,特别是在局部极小值点附近。

2. 共轭梯度法共轭梯度法是一种改进的最速下降法。

它利用了无约束问题的二次函数特性,通过选择一组相互共轭的搜索方向来提高收敛速度。

相比于最速下降法,共轭梯度法的收敛速度更快,尤其适用于大规模优化问题。

3. 牛顿法牛顿法是一种基于二阶导数信息的优化方法。

它通过构建并求解特定的二次逼近模型来求解无约束问题。

然而,牛顿法在高维问题中的计算复杂度较高,并且需要矩阵求逆运算,可能导致数值不稳定。

二. 线性规划问题求解方法1. 单纯形法单纯形法是一种经典的线性规划问题求解方法。

它通过在可行域内进行边界移动来寻找最优解。

然而,当问题规模较大时,单纯形法的计算复杂度会大幅增加,导致求解效率低下。

2. 内点法内点法是一种改进的线性规划问题求解方法。

与单纯形法不同,内点法通过将问题转化为一系列等价的非线性问题来求解。

内点法的优势在于其计算复杂度相对较低,尤其适用于大规模线性规划问题。

三. 非线性规划问题求解方法1. 信赖域算法信赖域算法是一种常用的非线性规划问题求解方法。

它通过构建局部模型,并通过逐步调整信赖域半径来寻找最优解。

信赖域算法既考虑了收敛速度,又保持了数值稳定性。

2. 遗传算法遗传算法是一种基于自然进化过程的优化算法。

它模拟遗传操作,并通过选择、交叉和变异等操作来搜索最优解。

遗传算法的优势在于其适用于复杂的非线性规划问题,但可能需要较长的计算时间。

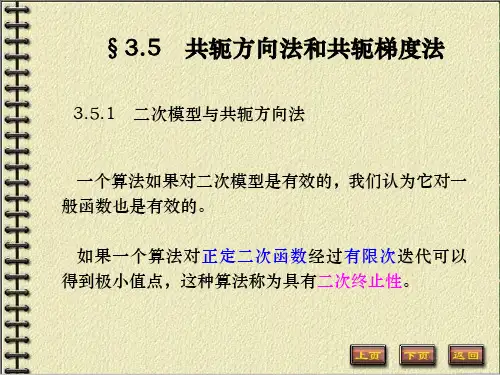

优化设计梯度法和共轭梯度法梯度法和共轭梯度法是常用的数值优化算法,用于求解非线性优化问题。

它们在工程领域中的应用广泛,能够有效解决很多实际问题。

本文将对优化设计梯度法和共轭梯度法进行介绍,并比较它们的优劣。

1. 优化设计梯度法优化设计梯度法是一种通过调整设计变量来最小化给定目标函数的方法。

它基于梯度下降的思想,每一步都会更新设计变量的取值,使得目标函数在设计变量的邻域内最小化。

优化设计梯度法的具体步骤如下:1)初始化设计变量;2)计算目标函数在当前设计变量取值下的梯度;3)根据梯度方向和步长因子更新设计变量;4)重复步骤2和步骤3,直到满足收敛条件。

优化设计梯度法的优点是简单易用,容易实现。

但是它也存在一些问题,比如容易陷入局部最小值,收敛速度慢等。

2. 共轭梯度法共轭梯度法是一种通过迭代算法求解线性方程组的方法,也可以用于非线性优化问题。

它的特点是每一步迭代都要寻找一个新的搜索方向,使得每一次迭代都能够有效利用之前的搜索历史。

共轭梯度法的具体步骤如下:1)初始化设计变量和搜索方向;2)计算目标函数在当前设计变量取值下的梯度;3)根据搜索方向和步长因子更新设计变量;4)计算新的搜索方向,使其与上一次的搜索方向共轭;5)重复步骤2到步骤4,直到满足收敛条件。

共轭梯度法的优点是能够在较少的迭代次数内收敛到最优解,且具有较好的数值稳定性。

然而,共轭梯度法在非精确线搜索时有一定局限性,并且对于非二次凸函数可能陷入非全局最小值。

3. 优化设计梯度法与共轭梯度法的比较在实际应用中,选择合适的优化算法对于问题的解决和效率的提高至关重要。

下面对优化设计梯度法和共轭梯度法进行比较。

(1)收敛速度:在一般情况下,共轭梯度法比优化设计梯度法收敛速度更快。

这是由于共轭梯度法在搜索方向上的选择更加优化。

(2)算法复杂度:优化设计梯度法通常较为简单,易于实现,而共轭梯度法则相对复杂一些,需要额外计算共轭方向。

(3)全局最优解:共轭梯度法在处理非二次凸函数时可能陷入局部最小值,而优化设计梯度法的表现相对较差。

最优化问题的算法迭代格式最优化问题的算法迭代格式最优化问题是指在一定的条件下,寻找使某个目标函数取得极值(最大值或最小值)的变量取值。

解决最优化问题的方法有很多种,其中较为常见的是迭代法。

本文将介绍几种常用的最优化问题迭代算法及其格式。

一、梯度下降法梯度下降法是一种基于负梯度方向进行搜索的迭代算法,它通过不断地沿着目标函数的负梯度方向进行搜索,逐步接近极值点。

该方法具有收敛速度快、易于实现等优点,在许多应用领域中被广泛使用。

1. 算法描述对于目标函数 $f(x)$,初始点 $x_0$ 和学习率 $\alpha$,梯度下降算法可以描述为以下步骤:- 计算当前点 $x_k$ 的梯度 $\nabla f(x_k)$;- 更新当前点 $x_k$ 为 $x_{k+1}=x_k-\alpha\nabla f(x_k)$;- 如果满足停止条件,则输出结果;否则返回第 1 步。

2. 算法特点- 沿着负梯度方向进行搜索,能够快速收敛;- 学习率的选择对算法效果有重要影响;- 可能会陷入局部极小值。

二、共轭梯度法共轭梯度法是一种基于线性方程组求解的迭代算法,它通过不断地搜索与当前搜索方向共轭的新搜索方向,并在该方向上进行一维搜索,逐步接近极值点。

该方法具有收敛速度快、内存占用少等优点,在大规模问题中被广泛使用。

1. 算法描述对于目标函数 $f(x)$,初始点 $x_0$ 和初始搜索方向 $d_0$,共轭梯度算法可以描述为以下步骤:- 计算当前点 $x_k$ 的梯度 $\nabla f(x_k)$;- 如果满足停止条件,则输出结果;否则进行下一步;- 计算当前搜索方向 $d_k$;- 在当前搜索方向上进行一维搜索,得到最优步长 $\alpha_k$;- 更新当前点为 $x_{k+1}=x_k+\alpha_k d_k$;- 计算新的搜索方向 $d_{k+1}$;- 返回第 2 步。

2. 算法特点- 搜索方向与前面所有搜索方向都正交,能够快速收敛;- 需要存储和计算大量中间变量,内存占用较大;- 可以用于非线性问题的求解。

人工智能中的优化算法主要用于寻找最优解或最优参数,可以应用于各种问题,如机器学习模型训练、路径规划、资源分配等。

以下是一些常见的优化算法的比较:

1. 梯度下降法:是最基础的优化算法之一,用于找到函数的最小值。

其中的随机梯度下降法(SGD)在处理大规模数据和模型时尤其有效。

2. 牛顿法:是一种寻找函数的零点的优化算法,优点是能快速找到函数的局部最小值,缺点是可能陷入局部最优。

3. 共轭梯度法:是一种在梯度下降法的基础上改进的算法,可以处理具有非凸函数和多个极小值的优化问题,但计算复杂度较高。

4. 遗传算法:是一种模拟自然选择和遗传学机制的优化算法,适用于大规模搜索和多峰概率问题,但可能找不到全局最优解。

5. 模拟退火算法:是一种寻找全局最优的优化算法,通过引入温度参数和退火机制,能够处理具有约束条件的优化问题,但温度参数的选择会影响算法的性能。

6. 蚁群优化算法:是一种受自然界中蚂蚁寻径行为启发的优化算法,适用于大规模搜索问题,但易陷入局部最优解。

这些算法各有优缺点,适用于不同的问题和场景。

在实际应用中,需要根据具体问题选择合适的算法,并进行相应的调整和优化。

同时,也可以将多种算法结合起来使用,以提高搜索效率和精度。

共轭梯度法在优化问题中的应用共轭梯度法是一种高效的优化算法,在许多优化问题中都得到了广泛的应用。

它是一种迭代方法,用于解决最小化二次函数的优化问题。

在本文中,我将介绍共轭梯度法的原理和算法,并探讨它在优化问题中的应用。

一、共轭梯度法的原理共轭梯度法的核心思想是通过迭代的方式,找到一个与之前迭代步骤方向相互垂直的搜索方向,以加快收敛速度。

在每一次迭代中,共轭梯度法根据当前的搜索方向更新搜索点,直到找到最优解或达到预定的收敛标准。

具体来说,共轭梯度法从一个初始搜索点开始,计算对应的梯度,并沿着负梯度方向进行搜索。

通过一定的方法找到一个与之前搜索方向相互垂直的新搜索方向,并以一定步长更新搜索点。

迭代过程将重复进行,直到满足收敛标准或达到最大迭代次数。

二、共轭梯度法的算法共轭梯度法的算法包括以下几个步骤:1. 初始化搜索点x0和梯度g0,设置迭代次数k=0。

2. 计算当前搜索方向d_k=-g_k(k为当前迭代次数)。

3. 通过一维搜索方法找到最佳步长α_k。

4. 更新搜索点x_k+1 = x_k + α_k * d_k。

5. 计算更新后的梯度g_k+1。

6. 判断是否满足收敛标准,若满足则算法停止,否则转到步骤7。

7. 计算新的搜索方向β_k+1。

8. 将迭代次数k更新为k+1,转到步骤3。

这个算法保证了每一次迭代中的搜索方向都是彼此相互垂直的,从而加快了收敛速度。

三、共轭梯度法的应用共轭梯度法在优化问题中有广泛的应用,特别是在二次规划、线性规划和非线性规划等领域。

在二次规划问题中,共轭梯度法可以高效地求解线性系统Ax=b,其中A是一个对称正定的矩阵。

由于共轭梯度法的特性,它只需要进行n 次迭代,其中n是问题的维度,就能得到精确的解。

这使得共轭梯度法在大规模线性系统求解中具有重要的应用价值。

在线性规划问题中,共轭梯度法可以用于求解带有线性约束的最小二乘问题。

共轭梯度法通过将线性约束转化为一系列的正交子空间,从而在求解最小二乘问题时能够更快地收敛。

共轭梯度法总结

共轭梯度法总结

一、什么是共轭梯度法

共轭梯度法(Conjugate Gradient Method),是一种用于求解线性方程组的迭代优化算法,它是一种搜索梯度的迭代算法。

共轭梯度法的基本思想是沿梯度的反方向搜索,并在每一步令搜索的方向接近更新的局部梯度。

它是一种非常有效的求解有约束的非线性优化问题的方法,是求解线性方程组的有效算法。

共轭梯度法可以看作是一种极小化函数的迭代方法,它最主要的思想是不断更新梯度的方向,从而寻找函数值最小的点。

二、共轭梯度法的原理

共轭梯度法是一种迭代优化算法,它以凸二次型函数为例,可以用来求解最小值问题。

它的基本思想是:

(1)首先求得函数的梯度,即每一步优化的搜索方向,使梯度变为最小;

(2)以梯度的反方向搜索,令搜索的方向接近更新的局部梯度,而不是与旧的梯度成正比的步长;

(3)逐步更新搜索的方向为新的梯度;

(4)重复这个过程,直到所有的自变量满足限制条件。

三、共轭梯度法的优缺点

共轭梯度法最大的优点是它具有收敛速度快,可以在有限的迭代步数内收敛到最优解;另外,它还具有计算量小,不需要计算精确的

Hessian矩阵的优点。

共轭梯度法的缺点是它不能用来求解非凸优化问题,因为它只能求解凸优化问题;另外,它也不能用于强不可约的优化问题。

求全局最优化的几种确定性算法全局最优化是一个在给定约束条件下寻找函数全局最小或最大值的问题。

确定性算法是指每次运行算法都能得到相同的结果,且结果能确保接近全局最优解。

以下是几种常见的确定性算法:1. 梯度下降法(Gradient Descent)梯度下降法是一种迭代优化算法,通过沿负梯度方向逐步调整参数值,直至找到函数的最小值或最大值。

该算法对于凸函数是有效的,但可能会陷入局部最优解。

可以通过调整学习率和选择不同的初始参数值来改进算法的效果。

2. 牛顿法(Newton's Method)牛顿法利用函数的二阶导数信息来找到函数的最小值或最大值。

它基于泰勒级数展开,通过使用当前点的一阶和二阶导数来逼近函数,然后迭代地更新参数值。

牛顿法通常比梯度下降法更快地收敛到全局最优解,但它可能需要计算和存储较大的二阶导数矩阵。

3. 共轭梯度法(Conjugate Gradient)共轭梯度法是一种迭代法,用于求解线性方程组或优化问题。

它利用问题的海森矩阵或其逼近的特殊性质,在有限次迭代后得到准确解。

共轭梯度法在解决大规模问题时具有可伸缩性,且不需要存储大规模矩阵。

4. BFGS算法(Broyden–Fletcher–Goldfarb–Shanno Algorithm)BFGS算法是一种拟牛顿法,用于解决无约束非线性优化问题。

它通过近似目标函数的海森矩阵的逆矩阵来逼近最优解,从而避免了计算海森矩阵的复杂性。

BFGS算法具有快速的收敛性和较好的全局收敛性。

5. 遗传算法(Genetic Algorithms)遗传算法是一种模拟生物进化过程的优化方法,通过模拟自然界的选择、交叉和变异过程来最优解。

它将问题表示成一个个基因型,通过使用选择、交叉和变异等操作来产生新的个体,并根据适应度函数评估每个个体的好坏。

遗传算法具有全局能力,可以处理非线性、非凸函数以及离散优化问题。

6. 粒子群优化算法(Particle Swarm Optimization)粒子群优化算法是一种模拟鸟群或鱼群行为的优化算法。

机器学习常见优化算法

1. 梯度下降法:梯度下降法是机器学习中最常用的优化算法,它的基本原理是通过计算梯度来更新参数,使得损失函数的值越来越小,从而使得模型的性能越来越好。

2. 随机梯度下降法:随机梯度下降法是梯度下降法的变种,它的基本原理是每次只用一个样本来更新参数,从而使得训练速度更快,但是可能会导致模型的泛化能力变差。

3. 拟牛顿法:拟牛顿法是一种基于牛顿法的优化算法,它的基本原理是通过迭代计算拟牛顿步长来更新参数,从而使得损失函数的值越来越小,从而使得模型的性能越来越好。

4. Adagrad:Adagrad是一种自适应学习率的优化算法,它的基本原理是根据每个参数的梯度大小来调整学习率,从而使得模型的性能越来越好。

5. Adadelta:Adadelta是一种自适应学习率的优化算法,它的基本原理是根据每个参数的更新量来调整学习率,从而使得模型的性能越来越好。

6. Adam:Adam是一种自适应学习率的优化算法,它的基本原理是根据每个参数的梯度和更新量来调整学习率,从而使得模型的性能越来越好。

7.共轭梯度法:共轭梯度法是一种迭代优化算法,它使用一阶导数和共轭梯度来求解最优解。

它的优点是计算速度快,缺点是可能不太稳定。

最优化问题共轭梯度法法代码x本文介绍了最优化问题共轭梯度法法的代码实现,以及如何使用代码解决最优化问题。

一、共轭梯度法简介共轭梯度法是一种常用的最优化算法,它是一种经典的迭代方法,用于求解凸函数的极值问题。

其基本思想是:在每一步,沿着梯度下降的方向迭代,直到梯度为零就停止迭代。

共轭梯度法的迭代公式为:$$x_{k+1}=x_k+alpha_k p_k$$其中,$alpha_k$ 是步长参数,$p_k$ 是当前搜索方向,$x_k$ 是当前点的位置。

二、代码实现1.函数定义```python# 共轭梯度法# 入参:函数func,梯度函数grad,初始点x0,步长参数alpha,精度epsilon# 出参:求解的最优点xdef conjugate_gradient_method(func, grad, x0, alpha, epsilon):```2.初始化搜索方向```python# 初始化搜索方向p_k = -grad(x_k)```3.更新迭代点```python# 更新迭代点x_k = x_k + alpha * p_k```4.更新搜索方向```python# 更新搜索方向beta_k = (grad(x_k) * grad(x_k)) / (grad(x_k_prev) * grad(x_k_prev))p_k = -grad(x_k) + beta_k * p_k_prev```5.检查终止条件```python# 检查终止条件if np.linalg.norm(grad(x_k)) < epsilon:break```6.完整代码```python# 共轭梯度法# 入参:函数func,梯度函数grad,初始点x0,步长参数alpha,精度epsilon# 出参:求解的最优点xdef conjugate_gradient_method(func, grad, x0, alpha, epsilon):x_k = x0p_k = -grad(x_k)while np.linalg.norm(grad(x_k)) > epsilon:x_k_prev = x_kp_k_prev = p_kline_search = line_search_method(func, grad, p_k, x_k, alpha)x_k = x_k + line_search * p_kbeta_k = (grad(x_k) * grad(x_k)) / (grad(x_k_prev) * grad(x_k_prev))p_k = -grad(x_k) + beta_k * p_k_prevreturn x_k```三、如何使用代码解决最优化问题1.确定问题首先,我们需要确定最优化问题,即构造一个函数,其中包含我们想要优化的目标函数以及约束条件。

共轭梯度法简介共轭梯度法是一种迭代的最优化算法,用于求解线性方程组或求解非线性优化问题。

它在解决大规模线性方程组时表现出色,尤其适用于对称正定矩阵的问题。

共轭梯度法结合了最速下降法和共轭方向法的优点,能够在有限次数的迭代中快速收敛到最优解。

背景在数值计算和优化问题中,线性方程组的求解是一个常见且重要的问题。

例如,在图像处理、数据分析和机器学习等领域,我们经常需要求解一个大规模的线性方程组。

然而,传统的直接方法,如高斯消元法或LU分解,对于大规模问题往往计算量巨大,耗时较长。

因此,我们需要寻找一种高效的迭代方法来解决这些问题。

共轭梯度法的核心思想是通过一系列共轭的搜索方向来逼近最优解。

具体来说,对于一个对称正定的线性方程组Ax=b,共轭梯度法的步骤如下:1.初始化解向量x0和残差x0=x−xx0。

2.计算初始搜索方向x0=x0。

3.进行共轭梯度迭代:重复以下步骤n次或直到收敛为止。

a.计算步长$\\alpha_k=\\frac{r_k^Tr_k}{d_k^TAd_k}$。

b.更新解向量$x_{k+1}=x_k+\\alpha_kd_k$。

c.更新残差$r_{k+1}=r_k-\\alpha_kAd_k$。

d.计算新的搜索方向$d_{k+1}=r_{k+1}+\\frac{r_{k+1}^Tr_{k+1}}{r_k^Tr_k}d_k$。

共轭梯度法与其他迭代方法相比有以下特点:1.高效性:共轭梯度法能够在有限次数的迭代中收敛到最优解,尤其适用于对称正定矩阵。

相比于直接方法,其计算量较小,具有更高的计算效率。

2.无需存储完整矩阵:共轭梯度法只需知道矩阵A的乘法运算结果,不需要存储完整的矩阵。

这对于大规模问题是一个很大的优势。

3.不需要计算矩阵的特征值:相比于其他迭代方法,共轭梯度法不需要计算矩阵的特征值,因此在实际问题中更加实用。

算法应用共轭梯度法广泛应用于各个领域的优化问题和线性方程组求解问题,包括:1.图像处理:共轭梯度法用于图像恢复、图像去噪和图像分割等问题。

共轭梯度法原理共轭梯度法是一种用于解决大规模线性方程组或非线性优化问题的迭代算法。

它的原理基于寻找一个向量的共轭方向,以便在每一步迭代中最大限度地减少误差。

在本文中,我们将详细介绍共轭梯度法的原理及其应用。

首先,让我们来了解一下共轭梯度法的基本原理。

在解决线性方程组Ax=b时,共轭梯度法的核心思想是通过寻找一组共轭的搜索方向来逐步逼近最优解。

这些共轭方向是相互正交的,这意味着它们不会在同一个方向上重复搜索,从而有效地加速了收敛速度。

在每一步迭代中,共轭梯度法都会沿着一个共轭方向进行搜索,以找到一个最优的步长,使得误差函数能够得到最大程度的减少。

通过不断地迭代,我们可以逐渐逼近最优解。

这种方法在解决大规模线性方程组时非常高效,尤其是在稀疏矩阵和对称正定矩阵的情况下效果更佳。

除了解决线性方程组外,共轭梯度法还被广泛应用于非线性优化问题。

在这种情况下,我们需要通过最小化一个目标函数来寻找最优解。

共轭梯度法同样可以通过寻找共轭方向来逐步逼近最优解,从而在非线性优化问题中取得良好的效果。

总的来说,共轭梯度法是一种非常高效的优化算法,它通过寻找共轭方向来逐步逼近最优解,特别适用于解决大规模线性方程组和非线性优化问题。

它的原理简单而又高效,因此在实际应用中得到了广泛的应用。

在实际应用中,共轭梯度法还有许多改进的版本,例如预处理共轭梯度法、共轭梯度法的共轭梯度法等,这些改进版本都在一定程度上提高了算法的收敛速度和稳定性,使其更加适用于不同类型的问题。

综上所述,共轭梯度法是一种非常重要的优化算法,它通过寻找共轭方向来逐步逼近最优解,特别适用于解决大规模线性方程组和非线性优化问题。

在实际应用中,它的高效性和稳定性使其成为了解决实际问题的重要工具。

希望本文对共轭梯度法的原理有所帮助,谢谢阅读!。

16梯度法和共轭梯度法基本原理和特点?梯度法又称最速下降法,基本原理是在迭代点附近采用使目标函数值下降最快的负梯度方向作为搜索方向,求目标函数的极小值,特点;迭代计算简单,只需求一阶偏导数,所占的存储单元少,对初始点的要求不高,在接近极小点位置时收敛速度很慢,共轭的特点为在梯度法靠近极值点收敛速度放慢时,它可以构造共轭方向使其收敛速度加快,迭代计算比较简单,效果好,在每一步迭代过程中都要构造共轭的、方向,比较繁琐。

17迭代终止准则有哪三种?1)当设计变量在相邻两点之间的移动距离充分小时,可用相邻两点的矢量差的模作为终止的判据,2)当相邻两点目标函数值之差达到充分小时,可用两次迭代的目标函数之差作为终止判据。

3)当迭代点逼近极值点时,目标函数在该点的梯度已达到充分小时,可用梯度的模作为终止判据。

18.无约束设计法,1)powell法,它是在下降迭代过运算中只需计算和比较目标函数值的大小,不需计算偏导数的方法,是较好的一种直接搜索算法。

2)梯度法,又称最速下降法,它是采用使目标函数值下降最快的负梯度方向作为搜索方向来求目标函数的极小值。

3)共轭梯度法,又称FR法,是利用目标函数的梯度确定共轭方向,使得计算简便而效果好,只需利用相邻两点的梯度就可以构造一个共轭方向,这种方式产生共轭方向并进行迭代的算法称为共轭梯度法。

4)变尺度法,又称DFP法,为了得到既有快速收敛的性质,又能避免计算二阶导数矩阵及逆矩阵,减少计算工作量。

迭代公式X=X+aS,19有约束设计法?1)复合形法,在可行域中选取k个设计点作为初始复合形的顶点,然后比较复合形个各项目标函数值的大小,其中目标函数值最大的点为坏点,以坏点之外其余各点的中心为映射中心,寻坏点的映射点,以映射点替换坏点,并与原复合型除坏点之外其余各点构成就k 顶点的新的复合型,这样反复迭代直到达到精度找到最优点,2)简约梯度法,用来解决线性约束非线性规划问题。

3)罚函数法,是把一个有约束的问题转化为一系列无约束的问题求解,逐渐逼近最优值。