偏最小二乘建模的全过程MATLAB程序与结果

- 格式:doc

- 大小:822.50 KB

- 文档页数:5

偏最小二乘法PLS回归NIPALS算法的Matlab程序及例子②function [T,P,W,Wstar,U,b,C,B_pls,...Bpls_star,Xori_rec,Yori_rec,...R2_X,R2_Y]=PLS_nipals(X,Y,nfactor)% USAGE: [T,P,W,Wstar,U,b,C,Bpls,Bpls_star,Xhat,Yhat,R2X,R2Y]=PLS_nipals(X,Y,nfact) % PLS regression NIPALS algorithm PLS回归NIPALS算法% Compute the PLS regression coefficients PLS回归系数的计算% X=T*P' Y=T*B*C'=X*Bpls X and Y being Z-scores% B=diag(b)% Y=X*Bpls_star with X being augmented with a col of ones% and Y and X having their original units% T'*T=I (NB normalization <> SAS)% W'*W=I%% Test for PLS regression% Herve Abdi November 2002/rev November 2004%%% Version with T, W, and C being unit normalized% U, P are not% nfact=number of latent variables to keep 保持潜在变量的数量% default = rank(X)X_ori=X;Y_ori=Y;if exist('nfactor')~=1;nfactor=rank(X);endM_X=mean(X);M_Y=mean(Y);S_X=std(X);S_Y=std(Y);X=zscore(X);Y=zscore(Y);[nn,np]=size(X) ;[n,nq]=size(Y) ;if nn~= n;error(['Incompatible # of rows for X and Y']);end% Precision for convergenceepsilon=eps;% # of components kepts% Initialistion% The Y setU=zeros(n,nfactor);C=zeros(nq,nfactor);% The X setT=zeros(n,nfactor);P=zeros(np,nfactor);W=zeros(np,nfactor);b=zeros(1,nfactor);R2_X=zeros(1,nfactor);R2_Y=zeros(1,nfactor);Xres=X;Yres=Y;SS_X=sum(sum(X.^2));SS_Y=sum(sum(Y.^2));for l=1:nfactort=normaliz(Yres(:,1));t0=normaliz(rand(n,1)*10);u=t;nstep=0;maxstep=100;while ( ( (t0-t)'*(t0-t) > epsilon/2) & (nstep < maxstep));nstep=nstep+1;disp(['Latent Variable #',int2str(l),' Iteration #:',int2str(nstep)]) t0=t;w=normaliz(Xres'*u);t=normaliz(Xres*w);% t=Xres*w;c=normaliz(Yres'*t);u=Yres*c;end;disp(['Latent Variable #',int2str(l),', convergence reached at step ',...int2str(nstep)]);%X loadingsp=Xres'*t;% b coefb_l=((t'*t)^(-1))*(u'*t);b_1=u'*t;% Store in matricesb(l)=b_l;P(:,l)=p;W(:,l)=w;T(:,l)=t;U(:,l)=u;C(:,l)=c;% deflation of X and YXres=Xres-t*p';Yres=Yres-(b(l)*(t*c'));R2_X(l)=(t'*t)*(p'*p)./SS_X;R2_Y(l)=(t'*t)*(b(l).^2)*(c'*c)./SS_Y;end%Yhat=X*B_pls;X_rec=T*P';Y_rec=T*diag(b)*C';%Y_residual=Y-Y_rec;%% Bring back X and Y to their original units%Xori_rec=X_rec*diag(S_X)+(ones(n,1)*M_X);Yori_rec=Y_rec*diag(S_Y)+(ones(n,1)*M_Y);%Unscaled_Y_hat=Yhat*diag(S_Y)+(ones(n,1)*M_Y);% The Wstart weights gives T=X*Wstar%Wstar=W*inv(P'*W);B_pls=Wstar*diag(b)*C';%% Bpls_star Y=[1|1|X]*Bpls_star%Bpls_star=[M_Y;[-M_X;eye(np,np)]*diag(S_X.^(-1))*B_pls*diag(S_Y)] Bpls_star=[[-M_X;eye(np,np)]*diag(S_X.^(-1))*B_pls*diag(S_Y)];Bpls_star(1,:)=Bpls_star(1,:)+M_Y;%%%%%%%%%%%%% FunctionsHere %%%%%%%%%%%%%%%%%%%%%%%function [f]=normaliz(F);%USAGE: [f]=normaliz(F);% normalize send back a matrix normalized by column% (i.e., each column vector has a norm of 1)[ni,nj]=size(F);v=ones(1,nj) ./ sqrt(sum(F.^2));f=F*diag(v);function z=zscore(x);% USAGE function z=zscore(x);% gives back the z-normalization for x% if X is a matrix Z is normalized by column% Z-scores are computed with% sample standard deviation (i.e. N-1)% see zscorepop[ni,nj]=size(x);m=mean(x);s=std(x);un=ones(ni,1);z=(x-(un*m))./(un*s);应用例子%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%% example_pls.m: PLS example% RM3 Fall 2004% November 16 2004%% This script shows how to run% a Partial least square regression% (PLS).% Need Programs: PLS_nipals plotxyha% The example is the% Wine example from Abdi H. (2003)% See /~herve %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%clearclc;disp(['Example of a PLS program. See Abdi H. (2003)']); %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%************************************************************%% -> This is your title.%% -> Change it to fit your dataze_title=['PLS. Wines. '];%% **********************************************************%% This is the data matrix of the Predictors (IV)%% -> Change it for your exampleX=[...7 7 13 74 3 14 710 5 12 516 7 11 313 3 10 3];%%% get the # of rows andcolumns %%%%%%%%%%%%%%%%%%%%%%%%%%[nI,nJ]=size(X);%************************************************************ %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%% -> These are your predictors names.% -> Change them to fit your data% You need as many names as mcX has columnsn=0;%n=n+1;nom_x(n)={' Price'};n=n+1;nom_x(n)={' Sugar'};n=n+1;nom_x(n)={' Alcohol'};n=n+1;nom_x(n)={' Acidity'};%%% Test the # of colums namesif nJ~=n;erreur(['Error -> (Wrong # of column names)!']);end%%*********************************************************** %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%% -> These are your observations names.% -> Change them to fit your datal=0;l=l+1;nom_r{l}={'W_1'};l=l+1;nom_r{l}={'W_2'};l=l+1;nom_r{l}={'W_3'};l=l+1;nom_r{l}={'W_4'};l=l+1;nom_r{l}={'W_5'};if nI~=l;erreur(['Error -> (Wrong # of row names)!']);end %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%% **********************************************************%% This is the data matrix of the Dependant Variables (DV)%% -> Change it for your exampleY=[...14 7 810 7 68 5 52 4 76 2 4];%%% get the # of rows andcolumns %%%%%%%%%%%%%%%%%%%%%%%%%%[nI2,nK]=size(Y);%************************************************************ %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%% -> These are your predictors names.% -> Change them to fit your data% You need as many names as mcX has columnsm=0;%m=m+1;nom_y(m)={' Hedonic'};m=m+1;nom_y(m)={' Meat'};m=m+1;nom_y(m)={' Dessert'};%%% Test the # of colums namesif nK~=m;erreur(['Error -> (Wrong # of column names)!']);end%%*********************************************************** %%%%%%%%%%%% Call PLS_nipals %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%nfact2keep=2 ;%%% nfact gives the number of latent variables%%% the default is equal to the rank of X[T,P,W,Wstar,U,b,C,Bpls,Bpls_star,Xhat,Yhat,R2X,R2Y]=...PLS_nipals(X,Y,nfact2keep)%%%%%%%%%%%% Plot the Observations (T vectors) %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%percent_of_inertiaX=100*R2X;percent_of_inertiaY=100*R2Y; %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%% The axes to keep for the plotsaxe_horizontal=1;axe_vertical=2; %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%le_taux=[...' {\tau_X}_',int2str(axe_horizontal),'=',...int2str(percent_of_inertiaX(axe_horizontal)),'%,', ...' {\tau_X}_',int2str(axe_vertical),'=',...int2str(percent_of_inertiaX(axe_vertical)),'%', ...' {\tau_Y}_',int2str(axe_horizontal),'=',...int2str(percent_of_inertiaY(axe_horizontal)),'%,', ...' {\tau_Y}_',int2str(axe_vertical),'=',...int2str(percent_of_inertiaY(axe_vertical)),'%'];%%%% Plothere %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%figure(1);clf %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% Now plot the Observations Scores T%%ze_tRC=[ze_title,' Observations (T).'];titre=[ze_tRC, le_taux];plotxyha(T,1,2,titre,nom_r');axis('equal') ; %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%% Now plot the X Scores W%%figure(2);clfze_tRC=[ze_title,' Predictors (W).'];titre=[ze_tRC, le_taux];plotxyha(W,1,2,titre,nom_x');axis('equal') ; %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%% Now plot the Y Scores U%%figure(3);clfze_tRC=[ze_title,' DV (C -> Non Ortho).'];titre=[ze_tRC, le_taux];plotxyha(C,1,2,titre,nom_y');% axis('equal') ; %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%作图函数plotxy定义function plotxy(F,axe1,axe2,titre,noms);% % ***** This is a Test Version *******% July 1998 Herve Abdi% Usage plotxy(F,axe1,axe2,title,names);% plotxy plots a MDS or PCA or CA graph of component #'Axe1' vs #'Axe2' % F is a matrix of coordinates% axe1 is the Horizontal Axis% axe2 is the Vertical Axis% title will be the title of the graph% Axes are labelled 'Principal Component number'% names give the names of the points to plot (def=numbers)nomdim='Dimension';[nrow,ncol]=size(F);if exist('noms')==0;noms{nrow,1}=[];for k=1:nrow;noms{k,1}=int2str(k);endendminx=min(F(:,axe1));maxx=max(F(:,axe1));miny=min(F(:,axe2));maxy=max(F(:,axe2));hold off; clf;hold on;rangex=maxx-minx;epx=rangex/10;rangey=maxy-miny;epy=rangey/10; axis('equal'); axis([minx-epx,maxx+epx,miny-epy,maxy+epy]) ; %axis('equal');%axis;plot ( F(:,axe1),F(:,axe2 ),'.');label=[nomdim,' '];labelx=[label, num2str(axe1) ];labely=[label, num2str(axe2) ];xlabel (labelx);ylabel (labely );plot([minx-epx,maxx+epx],[0,0] ,'b');% holdplot ([0,0],[miny-epy,maxy+epy],'b');for i=1:nrow,text(F(i,axe1),F(i,axe2),noms{i,1});end;title(titre);。

一、起源与发展偏最小二乘法(partial least squares method,PLS)是一种新型的多元统计数据分析方法,它于1983年由伍德(S.Wold)和阿巴诺(C.Albano)等人首次提出。

其实在早在70年代伍德(S.Wold)的父亲H Wold便在经济学研究中引入了偏最小二乘法进行路径分析,创建了非线性迭代偏最小二乘算法(Nonlinear Iterative Partial Least Squares algorithm,NIPALS),至今仍然是PLS中最常用和核心的算法。

PLS在20世纪90年代引入中国,在经济学、机械控制技术、药物设计及计量化学等方面有所应用,但是在生物医学上偏最小二乘法涉及相对较少。

对该方法的各种算法和在实际应用中的介绍也不系统,国内已有学者在这方面做了一些努力,但作为一种新兴的多元统计方法,还不为人所熟知。

PLS是一种数学优化技术,它通过最小化误差的平方和找到一组数据的最佳函数匹配。

用最简的方法求得一些绝对不可知的真值,而令误差平方之和为最小。

通常用于曲线拟合。

有人用下式来形容PLS:偏最小二乘回归≈多元线性回归分析+典型相关分析+主成分分析二、特点:与传统多元线性回归模型相比,偏最小二乘回归的特点是:(1) 能够在自变量存在严重多重相关性的条件下进行回归建模;(2) 允许在样本点个数少于变量个数的条件下进行回归建模;(3) 偏最小二乘回归在最终模型中将包含原有的所有自变量;(4) 偏最小二乘回归模型更易于辨识系统信息与噪声(甚至一些非随机性的噪声);(5) 在偏最小二乘回归模型中,每一个自变量的回归系数将更容易解释。

偏最小二乘法的Matlab源码(2008-09-21 09:31:21)所谓偏最小二乘法,就是指在做基于最小二乘法的线性回归分析之前,对数据集进行主成分分析降维,下面的源码是没有删减的/greensim)。

function [y5,e1,e2]=PLS(X,Y,x,y,p,q) %% 偏最小二乘回归的通用程序%注释以“基于近红外光谱分析的汽油组分建模”为例,但本程序的适用范围绝不仅限于此% % 输入参数列表% X 校正集光谱矩阵,n×k的矩阵,n个样本,k个波长% Y 校正集浓度矩阵,n×m的矩阵,n个样本,m个组分% x 验证集光谱矩阵% y 验证集浓度矩阵% p X的主成分的个数,最佳取值需由其它方法确定% q Y的主成分的个数,最佳取值需由其它方法确定%% 输出参数列表% y5 x对应的预测值(y为真实值)% e1 预测绝对误差,定义为e1=y5-y% e2 预测相对误差,定义为e2=|(y5-y)/y|%% 第一步:对X,x,Y,y进行归一化处理[n,k]=size(X);m=size(Y,2);Xx=[X;x];Yy=[Y;y];xmin=zeros(1,k);xmax=zeros(1,k);for j=1:kxmin(j)=min(Xx(:,j));xmax(j)=max(Xx(:,j));Xx(:,j)=(Xx(:,j)-xmin(j))/(xmax(j)-xmin(j));endymin=zeros(1,m);ymax=zeros(1,m);for j=1:mymin(j)=min(Yy(:,j));ymax(j)=max(Yy(:,j));Yy(:,j)=(Yy(:,j)-ymin(j))/(ymax(j)-ymin(j));endX1=Xx(1:n,:);x1=Xx((n+1):end,:);Y1=Yy(1:n,:);y1=Yy((n+1):end,:);%% 第二步:分别提取X1和Y1的p和q个主成分,并将X1,x1,Y1,y1映射到主成分空间[CX,SX,LX]=princomp(X1);[CY,SY,LY]=princomp(Y1);CX=CX(:,1:p);CY=CY(:,1:q);X2=X1*CX;Y2=Y1*CY;x2=x1*CX;y2=y1*CY;%% 第三步:对X2和Y2进行线性回归B=regress(Y2,X2,0.05);%第三个输入参数是显著水平,可以调整%% 第四步:将x2带入模型得到预测值y3y3=x2*B;%% 第五步:将y3进行“反主成分变换”得到y4y4=y3*pinv(CY);%% 第六步:将y4反归一化得到y5for j=1:my5(:,j)=(ymax(j)-ymin(j))*y4(:,j)+ymin(j);end%% 第七步:计算误差e1=y5-y;e2=abs((y5-y)./y);function [MD,ERROR,PRESS,SECV,SEC]=ExtraSim1(X,Y)%% 基于PLS方法的进一步仿真分析%% 功能一:计算MD值,以便于发现奇异样本%% 功能二:计算各种p取值情况下的ERROR,PRESS,SECV,SEC值,以确定最佳输入变量个数[n,k]=size(X);m=size(Y,2);pmax=n-1;q=m;ERROR=zeros(1,pmax);PRESS=zeros(1,pmax);SECV=zeros(1,pmax);SEC=zeros(1,pmax);XX=X;YY=Y;N=size(XX,1);for p=1:pmaxdisp(p);Err1=zeros(1,N);%绝对误差Err2=zeros(1,N);%相对误差for i=1:Ndisp(i);if i==1x=XX(1,:);y=YY(1,:);X=XX(2:N,:);Y=YY(2:N,:);elseif i==Nx=XX(N,:);y=YY(N,:);X=XX(1:(N-1),:);Y=YY(1:(N-1),:);elsex=XX(i,:);y=YY(i,:);X=[XX(1:(i-1),:);XX((i+1):N,:)];Y=[YY(1:(i-1),:);YY((i+1):N,:)];end[y5,e1,e2]=PLS(X,Y,x,y,p,q);Err1(i)=e1;Err2(i)=e2;endERROR(p)=sum(Err2)/N; PRESS(p)=sum(Err1.^2); SECV(p)=sqrt(PRESS(p)/n); SEC(p)=sqrt(PRESS(p)/(n-p)); end%%[CX,SX,LX]=princomp(X);S=SX(:,1:p);MD=zeros(1,n);for j=1:ns=S(j,:);MD(j)=(s')*(inv(S'*S))*(s); end。

matlab中的偏最小二乘法(pls)回归模型,离群点检测和变量选择一、引言随着数据科学的发展,偏最小二乘法(PLS)回归模型在人脸识别、图像处理、生物信息学等领域得到了广泛应用。

PLS回归模型是一种多元线性回归方法,能够有效地解决自变量多重共线性问题。

在实际应用中,数据分析过程中往往存在离群点和冗余变量,如何有效地检测离群点和选择变量对提高模型性能具有重要意义。

本文将介绍MATLAB中PLS回归模型的实现,以及离群点检测和变量选择的方法及应用。

二、MATLAB中PLS回归模型的实现1.数据准备与处理在进行PLS回归分析之前,首先需要准备一组数据。

这里我们以一个由自变量X和因变量Y组成的数据集为例。

接着,对数据进行预处理,包括去除缺失值、标准化等。

2.建立PLS回归模型在MATLAB中,可以使用PLS工具箱(PLS Toolbox)建立PLS回归模型。

通过PLS命令,可以对数据进行主成分分析,建立PLS回归模型,并计算模型参数。

3.模型参数估计与性能评估建立PLS回归模型后,需要对模型参数进行估计。

可以使用MATLAB中的PLS命令估计参数,并计算模型的决定系数(R)等性能指标,以评估模型质量。

三、离群点检测方法及应用1.离群点检测原理离群点是指数据集中与大部分数据显著不同的数据点。

离群点检测的目的是识别出这些异常数据,以便在后续分析中对其进行处理或剔除。

2.常见离群点检测方法介绍常见的离群点检测方法包括:基于统计量的方法(如Z分数、IQR等)、基于邻近度的方法(如K-近邻、LOF等)、基于聚类的方法(如K-means、DBSCAN等)等。

3.MATLAB中离群点检测方法的实现MATLAB提供了多种离群点检测函数,如zscore、iqr、knn、lof等。

通过调用这些函数,可以实现对数据集中离群点的检测。

四、变量选择方法及应用1.变量选择原理变量选择是指从多个自变量中筛选出对因变量影响显著的变量,以提高模型的解释性和减少过拟合风险。

一、概述在实际生活和工程应用中,经常会遇到三维数据拟合的问题,其中最小二乘拟合是一种常用的数据拟合方法。

Matlab作为一种强大的数学计算工具,可以方便地进行三维数据的最小二乘拟合。

二、matlab三维数据最小二乘拟合的基本原理最小二乘拟合是一种通过最小化观测数据与拟合函数之间的误差平方和来确定模型参数的方法。

在三维数据拟合中,我们通常使用三维曲面来拟合数据点,从而得到一个最优的拟合曲面。

Matlab提供了丰富的工具和函数,以便进行三维数据的最小二乘拟合计算。

三、matlab三维数据最小二乘拟合的具体步骤1. 数据准备:首先需要准备好三维数据点的坐标值,通常是以矩阵的形式存储。

2. 拟合模型选择:根据实际情况选择适合的三维曲面拟合模型,如平面拟合、曲面拟合等。

3. 拟合计算:利用Matlab提供的最小二乘拟合函数,对三维数据进行拟合计算,得到最优的拟合参数。

4. 拟合结果评估:对拟合结果进行评估,通常包括计算拟合误差、绘制拟合曲面等。

四、matlab三维数据最小二乘拟合的实例演示下面以一个具体的三维数据拟合实例进行演示,以展示Matlab如何进行最小二乘拟合计算。

假设有以下三维数据点:x = [1, 2, 3, 4, 5];y = [1, 2, 3, 4, 5];z = [1, 2, 3, 4, 5];将这些数据点转换成矩阵形式:data = [x', y', z'];然后利用Matlab提供的最小二乘拟合函数进行拟合计算:[p, S] = polyfitn(data, 2);对拟合结果进行评估并绘制拟合曲面:fit_surface = polyvaln(p, data);err = rmse(z, fit_surface);plot3(x, y, z, 'o', x, y, fit_surface, '-');xlabel('x');ylabel('y');zlabel('z');legend('Data Points', 'Fitted Surface');通过以上实例演示,可以看到Matlab在进行三维数据最小二乘拟合时的简洁、高效和准确性。

-531-第三十章 偏最小二乘回归在实际问题中,经常遇到需要研究两组多重相关变量间的相互依赖关系,并研究用一组变量(常称为自变量或预测变量)去预测另一组变量(常称为因变量或响应变量),除了最小二乘准则下的经典多元线性回归分析(MLR ),提取自变量组主成分的主成分回归分析(PCR)等方法外,还有近年发展起来的偏最小二乘(PLS)回归方法。

偏最小二乘回归提供一种多对多线性回归建模的方法,特别当两组变量的个数很多,且都存在多重相关性,而观测数据的数量(样本量)又较少时,用偏最小二乘回归建立的模型具有传统的经典回归分析等方法所没有的优点。

偏最小二乘回归分析在建模过程中集中了主成分分析,典型相关分析和线性回归分析方法的特点,因此在分析结果中,除了可以提供一个更为合理的回归模型外,还可以同时完成一些类似于主成分分析和典型相关分析的研究内容,提供更丰富、深入的一些信息。

本章介绍偏最小二乘回归分析的建模方法;通过例子从预测角度对所建立的回归模型进行比较。

§1 偏最小二乘回归考虑p 个变量p y y y ,,,21"与m 个自变量m x x x ,,,21"的建模问题。

偏最小二乘回归的基本作法是首先在自变量集中提出第一成分1t (1t 是m x x ,,1"的线性组合,且尽可能多地提取原自变量集中的变异信息);同时在因变量集中也提取第一成分1u ,并要求1t 与1u 相关程度达到最大。

然后建立因变量p y y ,,1"与1t 的回归,如果回归方程已达到满意的精度,则算法中止。

否则继续第二对成分的提取,直到能达到满意的精度为止。

若最终对自变量集提取r 个成分r t t t ,,,21",偏最小二乘回归将通过建立p y y ,,1"与r t t t ,,,21"的回归式,然后再表示为p y y ,,1"与原自变量的回归方程式,即偏最小二乘回归方程式。

%样本为n*p的矩阵,n为样本数,p为每个样本的自变量维度(自变量个数)%输出为n*m的矩阵,n为样本数,m为每个样本的因变量维度%交叉验证过程分别计算h个成分数的加扰动预测误差PRESS以及h-1个成分数的预测误差。

clc;clear;load('sample_alldata.mat');sample=10000*sample_alldata(:,2:end-1);wave_s=34;wave_e=464;data_train=sample(1:65,wave_s:wave_e);data_predict=sample(66:end,wave_s:wave_e);target_out=sample_alldata(1:65,end);%训练集data_predict=data_predict/max(data_predict);%测试predict_out=sample_alldata(66:end,end);num=size(data_train,1);%训练集样本数for i=1:num%数据标准化data_train(i,:)=zscore(data_train(i,:));endn=size(data_train,2);%自变量维度m=size(target_out,2);%因变量维度%for i=1:num-1%for j=1:num% [XL,YL,XS,YS,beta,PCTVAR,MSE]=plsregress(data_train,target_out,i);%end%endhandleofwaitbar=waitbar(0);%设置进度条便于观察%交叉验证SS=[];PRESS=[];Q=[];mse=[];for h=2:num-2 %分别验证选取不同的成分数时,成分数不能多于样本数ncomp=h;%成分数[XL,YL,XS,YS,beta,PCTVAR,MSE]=plsregress(data_train,target_out,ncomp-1);%所有的样本建模,但成分数少一(h-1个成分)yfit=[ones(size(data_train,1),1) data_train]*beta;%所有样本的模型预测值res=yfit-target_out;%误差向量SS_h1=sum(res.^2);%平方和mse=[mse sum(MSE(2,:).^2)];SS=[SS SS_h1];PRESS_h=0;for i=1:num; %所有样本都轮流抽出来一次data_train_cv=data_train;target_out_cv=target_out;data_train_cv(i,:)=[];%去掉一行(去掉一个样本)target_out_cv(i,:)=[];[XL,YL,XS,YS,beta,PCTVAR,MSE]=plsregress(data_train_cv,target_out_cv,ncomp);%减少一个参与建模的样本,但是增加一个成分来建模,同时,每次建模抽取未参与建模的一个样本来进行预测。

matlab最小二乘法编程

最小二乘法是一种常用的数学方法,可以用来求解数据拟合问题。

在MATLAB中,我们可以通过以下步骤编写最小二乘法程序:

1. 首先,我们需要准备数据。

我们可以使用MATLAB的数据导入工具来导入数据,也可以手动创建一个包含X和Y值的矩阵。

2. 接下来,我们需要定义模型函数。

在最小二乘法中,我们通常使用线性模型 y = a*x + b。

3. 然后,我们需要使用 MATLAB 的 polyfit 函数来求出 a 和 b 的值,并得到拟合直线的参数。

4. 最后,我们可以使用 polyval 函数来计算预测值,并将数据和预测值可视化。

下面是MATLAB的最小二乘法编程示例:

%准备数据

x = [1 2 3 4 5 6];

y = [1.1 1.9 3.1 4.0 5.2 6.1];

%定义模型函数 y = a*x + b

f = @(a,x)(a(1)*x + a(2));

%最小二乘法拟合

a_initial = [1 1];

a_fit = lsqcurvefit(f,a_initial,x,y);

%计算预测值

y_fit = f(a_fit,x);

%绘制数据和拟合直线

plot(x,y,'o',x,y_fit,'-');

legend('原始数据','拟合直线');

xlabel('X');

ylabel('Y');

title('最小二乘法拟合');。

最小二乘递推算法的MATLAB仿真针对辨识模型,有z(k)-+a1*z(k-1)+a2*z(k-2)=b1*u(k-1)+b2*u(k-2)+v(k)模型结构,对其进行最小二乘递推算法的MATLAB仿真,对比真值与估计值。

更改a1、a2、b1、b2参数,观察结果。

仿真对象:z(k)-1.5*z(k-1)+0.7*z(k-2)=u(k-1)+0.5*u(k-2)+v(k)程序如下:L=15;y1=1;y2=1;y3=1;y4=0; %四个移位寄存器的初始值for i=1:L; %移位循环x1=xor(y3,y4);x2=y1;x3=y2;x4=y3;y(i)=y4; %取出作为输出信号,即M序列if y(i)>0.5,u(i)=-0.03; %输入信号else u(i)=0.03;endy1=x1;y2=x2;y3=x3;y4=x4;endfigure(1);stem(u),grid onz(2)=0;z(1)=0;for k=3:15;z(k)=1.5*z(k-1)-0.7*z(k-2)+u(k-1)+0.5*u(k-2); %输出采样信号endc0=[0.001 0.001 0.001 0.001]'; %直接给出被识别参数的初始值p0=10^6*eye(4,4); %直接给出初始状态P0E=0.000000005;c=[c0,zeros(4,14)];e=zeros(4,15);for k=3:15; %开始求kh1=[-z(k-1),-z(k-2),u(k-1),u(k-2)]';x=h1'*p0*h1+1;x1=inv(x);k1=p0*h1*x1; %开始求k的值d1=z(k)-h1'*c0;c1=c0+k1*d1;e1=c1-c0;e2=e1./c0; %求参数的相对变化e(:,k)=e2;c0=c1;c(:,k)=c1;p1=p0-k1*k1'*[h1'*p0*h1+1]; %求出P(k)的值p0=p1;if e2<=E break;endendc,e %显示被辨识参数及其误差情况a1=c(1,:);a2=c(2,:);b1=c(3,:);b2=c(4,:);ea1=e(1,:);ea2=e(2,:);eb1=e(3,:);eb2=e(4,:);figure(2);i=1:15;plot(i,a1,'r',i,a2,':',i,b1,'g',i,b2,':')title('Parameter Identification with Recursive Least Squares Method')figure(3);i=1:15;plot(i,ea1,'r',i,ea2,'g',i,eb1,'b',i,eb2,'r:')title('Identification Precision')程序运行结果:p0 =1000000 0 0 00 1000000 0 00 0 1000000 00 0 0 1000000c =Columns 1 through 90.0010 0 0.0010 -0.4984 -1.2325 -1.4951 -1.4962 -1.4991 -1.49980.0001 0 0.0001 0.0001 -0.2358 0.6912 0.6941 0.6990 0.69980.0010 0 0.2509 1.2497 1.0665 1.0017 1.0020 1.0002 0.99990.0010 0 -0.2489 0.7500 0.5668 0.5020 0.5016 0.5008 0.5002Columns 10 through 15-1.4999 -1.5000 -1.5000 -1.5000 -1.4999 -1.49990.6999 0.7000 0.7000 0.7000 0.7000 0.70000.9998 0.9999 0.9999 0.9999 0.9999 0.99990.5002 0.5000 0.5000 0.5000 0.5000 0.5000e =1.0e+003 *Columns 1 through 90 0 0 -0.4994 0.0015 0.0002 0.0000 0.0000 0.00000 0 0 0 -2.3592 -0.0039 0.0000 0.0000 0.00000 0 0.2499 0.0040 -0.0001 -0.0001 0.0000 -0.0000 -0.00000 0 -0.2499 -0.0040 -0.0002 -0.0001 -0.0000 -0.0000 -0.0000Columns 10 through 150.0000 0.0000 0.0000 -0.0000 -0.0000 0.00000.0000 0.0000 -0.0000 0.0000 0.0000 0.0000-0.0000 0.0000 0.0000 0.0000 0.0000 -0.0000-0.0000 -0.0000 0.0000 -0.0000 0.0000 -0.0000程序运行曲线:图1.输入信号图2.a1,a2,b1,b2辨识仿真结果图3. a1,a2,b1,b2各次辨识结果收敛情况分析:由运行结果可看出,输出观测值没有任何噪声成分时,辨识结果最大相对误差达到3位数。

偏最小二乘法原理与matlab 应用偏最小二乘回归之所以被称为第二代回归方法,还由于它可以实现多种数据分析方法的综合应用。

由于偏最小二乘回归在建模的同时实现了数据结构的简化,因此,可以在二维平面图上对多维数据的特性进行观察,这使得偏最小二乘回归分析的图形功能十分强大。

在一次偏最小二乘回归分析计算后,不但可以得到多因变量对多自变量的回归模型,而且可以在平面图上直接观察两组变量之间的相关关系,以及观察样本点间的相似性结构。

这种高维数据多个层面的可视见性,可以使数据系统的分析内容更加丰富,同时又可以对所建立的回归模型给予许多更详细深入的实际解释。

一、 偏最小二乘回归的建模策略\原理\方法1.1建模原理设有 q 个因变量{q y y ,...,1}和p 自变量{p x x ,...,1}。

为了研究因变量和自变量的统计关系,我们观测了n 个样本点,由此构成了自变量与因变量的数据表X={p x x ,...,1}和.Y={q y y ,...,1}。

偏最小二乘回归分别在X 与Y 中提取出成分1t 和1u (也就是说, 1t 是p x x ,...,1 的线形组合, 1u 是q y y ,...,1 的线形组合).在提取这两个成分时,为了回归分析的需要,有下列两个要求:(1) 1t 和1u 应尽可能大地携带他们各自数据表中的变异信息; (2) 1t 与1u 的相关程度能够达到最大。

这两个要求表明,1t 和1u 应尽可能好的代表数据表X 和Y ,同时自变量的成分1t 对因变量的成分1u 又有最强的解释能力。

在第一个成分1t 和 1u 被提取后,偏最小二乘回归分别实施X 对 1t 的回归以及 Y 对1u 的回归。

如果回归方程已经达到满意的精度,则算法终止;否则,将利用 X 被1t 解释后的残余信息以及Y 被1t 解释后的残余信息进行第二轮的成分提取。

如此往复,直到能达到一个较满意的精度为止。

若最终对 X 共提取了 m 个成分1t ,…,mt ,偏最小二乘回归将通过实施 k y 对1t ,…,mt ,的回归,然后再表达成k y 关于原变量x1,…,xm,的回归方程,k=1,2,…,q 。

一.利用160组数据建PLS 回归模型。

>> clear >> load ysj>> X=ysj(:,1:8); >> Y=ysj(:,9:11); >> E0=stand(X); >> F0=stand(Y); >> A=rank(E0);>> [W,C,T,U,P,R]=bykpcr(E0,F0); W :自变量轴权重; C :因变量轴权重;T :自变量系统主成分得分; U :因变量系统主成分得分; P :模型效应载荷量; R :因变量载荷量。

(一).确定主成分个数三种方法: (1)复测定系数:2221()hkk k h tr R F =⨯=∑复测定系数表示所提取的主成分的可解释变异信息占总变异的百分比。

当 h m =,复测定系数的值足够大时,可再第m 步终止主成分的提取计算。

通常20.85m R ≥即可。

>> RA=plsra(T,R,F0,A)RA =0.3390 0.4831 0.5731 0.6358 0.6488 0.6522 0.6531 0.6537结论:利用这个方法,无法确定。

(2)类似典型相关分析中的精度分析方法:>> [Rdx,RdX,RdXt,Rdy,RdY ,RdYt]=plsrd(E0,F0,T,A) Rdx =0.3034 0.4348 0.0539 0.1326 0.0082 0.0132 0.0331 0.0208 0.2661 0.1918 0.0549 0.1932 0.1852 0.0001 0.0416 0.0671 0.0400 0.1010 0.3281 0.0191 0.4557 0.0529 0.0002 0.0030 0.0206 0.0813 0.4868 0.0492 0.0469 0.3026 0.0021 0.0104 0.0016 0.0472 0.5869 0.0921 0.0126 0.1955 0.0101 0.0540 0.2667 0.2229 0.2517 0.0002 0.0447 0.0638 0.0634 0.08660.2746 0.1859 0.0112 0.0041 0.0006 0.0434 0.4569 0.02330.5467 0.4430 0.0018 0.0001 0.0072 0.0003 0.0008 0.0001RdX =0.2150 0.2135 0.2219 0.0613 0.0951 0.0840 0.0761 0.0332 RdXt =1.0000Rdy =0.0092 0.0002 0.1325 0.0438 0.0195 0.0019 0.0002 0.00030.0761 0.0613 0.0112 0.0568 0.0001 0.0025 0.0001 0.00060.4591 0.1697 0.0009 0.0000 0.0013 0.0010 0.0011 0.0001 RdY =0.1814 0.0771 0.0482 0.0336 0.0070 0.0018 0.0005 0.0003 RdYt =0.3498>> [V]=LJRdX(RdX)V =0.2150 0.4284 0.6504 0.7117 0.8068 0.8908 0.9668 1.0000(3)累计贡献率:>> [U]=LJGXL(X,T,A)U =0.1756 0.3846 0.5791 0.6308 0.7198 0.7981 0.8711 0.9043(4) 交叉有效性由于不会编交叉有效性的MATLAB 程序,因此,没再验证。

最小二乘法原理及其MATLAB实现一、本文概述最小二乘法是一种广泛应用于数学、统计学、工程学、物理学等众多领域的数学优化技术。

其核心原理在于通过最小化误差的平方和来寻找最佳函数匹配,从而实现对数据的最佳逼近。

本文将对最小二乘法的原理进行详细阐述,并通过MATLAB编程实现,帮助读者深入理解并掌握这一强大的数据分析工具。

文章将首先介绍最小二乘法的基本原理,包括其历史背景、基本概念以及数学模型的构建。

然后,通过实例分析,展示如何应用最小二乘法进行线性回归模型的拟合,以及如何处理过拟合和欠拟合等问题。

接着,文章将详细介绍如何在MATLAB中实现最小二乘法,包括数据准备、模型构建、参数估计以及结果可视化等步骤。

文章还将对最小二乘法的优缺点进行讨论,并探讨其在不同领域的应用前景。

通过本文的学习,读者将能够全面理解最小二乘法的原理和应用,掌握其在MATLAB中的实现方法,为实际工作中的数据处理和分析提供有力支持。

二、最小二乘法原理最小二乘法(Least Squares Method)是一种数学优化技术,它通过最小化误差的平方和寻找数据的最佳函数匹配。

这种方法起源于19世纪的统计学,由数学家阿德里安-马里·勒让德(Adrien-Marie Legendre)和卡尔·弗里德里希·高斯(Carl Friedrich Gauss)分别独立发展。

建立模型:我们需要建立一个描述数据关系的数学模型。

这通常是一个线性方程,如 y = ax + b,其中 a和b是待求解的参数。

误差计算:对于给定的数据集,我们可以将每个数据点代入模型中进行计算,得到预测值。

预测值与真实值之间的差异就是误差。

平方误差和:为了衡量模型的拟合程度,我们需要计算所有误差的平方和。

这是因为平方误差和能够更好地反映误差的大小,尤其是在误差较大时。

最小化平方误差和:最小二乘法的核心思想是找到一组参数,使得平方误差和达到最小。

这通常通过求导和令导数等于零来实现,从而找到使平方误差和最小的参数值。

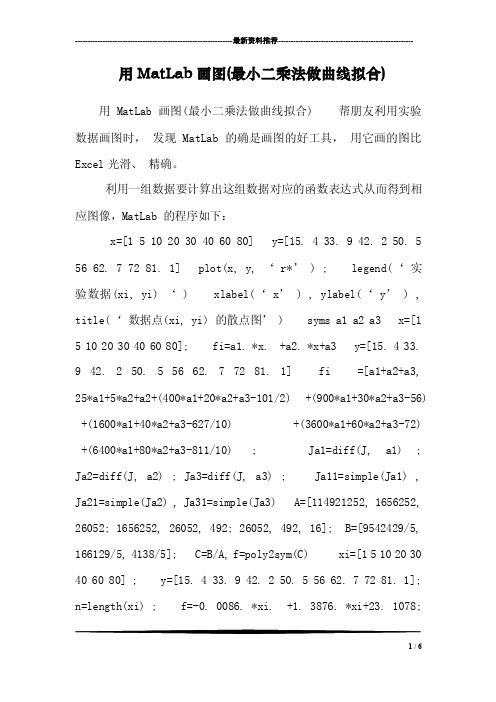

---------------------------------------------------------------最新资料推荐------------------------------------------------------ 用MatLab画图(最小二乘法做曲线拟合) 用 MatLab 画图(最小二乘法做曲线拟合) 帮朋友利用实验数据画图时,发现 MatLab 的确是画图的好工具,用它画的图比Excel光滑、精确。

利用一组数据要计算出这组数据对应的函数表达式从而得到相应图像,MatLab 的程序如下:x=[1 5 10 20 30 40 60 80] y=[15. 4 33. 9 42. 2 50. 556 62. 7 72 81. 1] plot(x, y, ‘ r*’ ) ; legend(‘ 实验数据(xi, yi) ‘ ) xlabel(‘ x’ ) , ylabel(‘ y’ ) , title(‘ 数据点(xi, yi) 的散点图’ ) syms a1 a2 a3 x=[15 10 20 30 40 60 80]; fi=a1. *x. +a2. *x+a3 y=[15. 4 33.9 42. 2 50. 5 56 62. 7 72 81. 1] fi =[a1+a2+a3,25*a1+5*a2+a2+(400*a1+20*a2+a3-101/2) +(900*a1+30*a2+a3-56) +(1600*a1+40*a2+a3-627/10) +(3600*a1+60*a2+a3-72)+(6400*a1+80*a2+a3-811/10) ; Ja1=diff(J, a1) ;Ja2=diff(J, a2) ; Ja3=diff(J, a3) ; Ja11=simple(Ja1) ,Ja21=simple(Ja2) , Ja31=simple(Ja3) A=[114921252, 1656252, 26052; 1656252, 26052, 492; 26052, 492, 16]; B=[9542429/5, 166129/5, 4138/5]; C=B/A, f=poly2sym(C) xi=[1 5 10 20 3040 60 80] ; y=[15. 4 33. 9 42. 2 50. 5 56 62. 7 72 81. 1]; n=length(xi) ; f=-0. 0086. *xi. +1. 3876. *xi+23. 1078;1 / 6x=1: 1/10: 80; F=-0. 0086. *x. +1. 3876. *x+23. 1078; fy=abs(f-y) ; fy2=fy. ; Ew=max(fy) , E1=sum(fy) /n,E2=sqrt((sum(fy2) ) /n) plot(xi, y, ‘ r*’ ) , hold on, plot(x, F, ‘ b-’ ) , hold off legend(‘ 数据点(xi, yi) ‘ , ‘ 拟合曲线f(x) = -0. 0086x +1. 3876x+23. 1078’ ) , xlabel(‘ x’ ) , ylabel(‘ y’ ) , title(‘ 实验数据点(xi, yi) 及拟合曲线f(x) ‘ ) 下图是程序运行后得到的:Su7Tw8VxaW ybXAcZB d#Cf!Eg%FhGj*Ik(Jl-Kn+M o0Np2Or3Ps4R t6Sv7Tw8VxaWzbXAcZBe#Cf! Eg%Fi Gj*Ik)Jl-Kn+Mo1Np2Or3Qs4Rt6Sv7 Uw8Vx aWzbYAc ZBe#Df!Eg%FiHj*Ik) Jm-Kn +Mo1Nq2Or3Qs 5Rt6Sv7Uw9VxaWzbYAdZBe#D f$Eg%F iHj(I k) Jm-Ln+Mo1Nq2Pr3Qs5Ru6S v7Uw9V yaWzbY AdZCe#Df$Eh%FiHj(Il) Jm-Ln0Mo1Nq2Pr4 Qs5Ru6Tv8Uw9VyaXzbYAdZCe !Df$Eh %GiHj (Il) Km-Ln0Mp1Nq2Pr4Qt5Ru 6Tv8U x9VyaXz cYAdZCe! Dg$Eh%Gi*Hj(Il) Km+Ln0M p1Oq2P r4Qt5Su6Tv8Ux9WyaXzcYBdZ Ce!Dg$Fh%Gi* Hk(Il) Km+Lo0Mp1Oq3Pr4Qt5 Su7Tv8Ux9Wyb XzcYBd#Ce!Dg$FhGi*Hk(Jl ) Km+L o0Np1Oq 3Ps4Rt 5Su7Tw8Ux9WybXAcY Bd#Cf!Dg$FhGj*Hk(Jl-Km+Lo0Np2Oq3Ps4 Rt6Su7Tw8Vx9 WybXAcZBd#Cf!Eg$FhGj*Ik (Jl-Kn +Lo0Np2Or3Ps4Rt6Sv7Tw8VxaWybXA cZBe#Cf!Eg%F hGj*Ik) Jl-K n+Mo0Np2Or3Q s4Rt6Sv 7Uw8V xaWzbXAcZBe# D f! Eg%FiGj* Ik) Jm- Kn+Mo1 Nq2Or3Qs5Rt6Sv7Uw9VxaWzb YAcZBe#Df$Eg %FiHj*Ik)---------------------------------------------------------------最新资料推荐------------------------------------------------------ Jm-Ln+Mo1Nq2Pr 3Qs5Ru 6Sv7Uw 9VyaWzbYAdZBe#Df$Eh%FiH j(Ik) J m-Ln0M o1Nq2Pr4Qs5Ru6Tv7Uw9VyaX zbYAdZC e#Df$ Eh%GiHj(Il) Jm-Ln0Mp1Nq2 Pr4Qt5Ru6Tv8 Uw9VyaXzcYAdZCe!Df$Eh%Gi *Hj(Il) Km+Ln 0Mp1Oq2Pr4Qt5Su6Tv8Ux9Vy aXzcYB dZCe!D g$Eh%Gi*Hk(Il) Km+Lo0Mp1O q3Pr4Qt5Su7Tv8Ux9WyaXzc Y Bd#Ce!Dg$Fh %Gi*Hk( Jl) Km +Lo0Np1Oq3Ps 4 Qt5Su7Tw8Ux 9WybXzcYBd#C f!Dg$FhGi*H k (Jl-Km+Lo0N p2Oq3Ps4Rt5S u7Tw8Vx9WybX AcYBd#Cf! Eg$ FhGj*Ik (Jl- Kn+Lo0Np2Or3 P s4Rt6Su7Tw8 VxaWybXA cZBd #Cf!Eg%FhGj * Ik) Jl-Kn+Mo 0Np2Or3Qs4Rt 6Sv7Tw8VxaWz bXAcZBe#Cf!E g%FiGj*Ik) J m-Kn+Mo1Np2O r 3Qs5Rt6Sv7U w8VxaWzbYAcZ Be#Df! Eg%Fi H j*Ik) Jm-Ln+ Mo1Nq2O r3Qs5 Ru6Sv7Uw9Vxa W zbYAdZBe#Df $Eh%Fi Hj(Ik ) Jm-Ln0Mo1Nq 2Pr3Qs5Ru6Tv 7Uw9Vya WzbYA dZCe#Df$Eh%G iHj(Il) Jm-L n0Mp1Nq2Pr4Q s5Ru6Tv8Uw9V ya XzbYAdZCe! Df$Eh%Gi*Hj( Il) Km-Ln0Mp1 Oq 2Pr4 Qt5Ru6Tv8Ux9Vy aXz cYAdZCe!Dg$E h%G i*Hk(Il) K m+Ln0Mp1O q3P r4Qt5Su6Tv8U x9WyaXzcYBd# Ce!Dg$Fh% Gi* Hk(Jl) Km+Lo0 Mp1Oq3Ps4Qt5 Su7Tv8Ux9Wyb XzcYBd#Cf! Dg $F hGi*Hk(Jl -Km+Lo0N p1Oq 3Ps4Rt5Su7Tw 8U x9WybXAcYB d#Cf!Eg$F hG j*Hk(Jl-Kn+Lo0Np2O q3Ps4Rt 6Su7Tw8Vx9WybXAcZBd#Cf!E g%FhGj*Ik(J l-Kn+Mo0Np2O r3Ps4Rt6Sv7T w8Vxa WzbXAcZ Be#Cf! Eg%Fi Gj*Ik) Jl-Kn+ Mo1Np2Or3Qs4 Rt6Sv7Uw8VxaWzbYAcZBe#Df !Eg%FiHj*Ik )3 / 6Jm-Kn+Mo1Nq2Or3Qs5Rt6Sv 7Uw9Vx aWzbYA dZBe#Df$Eg%FiHj(Ik) Jm-L n+Mo1Nq2Pr3Q s5Ru6Sv7Uw9VyaWzbYAdZCe# Df$Eh %FiHj( Il) Jm-Ln0Mo1Nq2Pr4Qs5Ru6 Tv8Uw9VyaXzb YAdZCe!Df$Eh%GiHj(Il) Km -Ln0Mp 1Nq2Pr 4Qt5Ru6Tv8Ux9VyaXzcYAdZC e!Dg$E h%Gi*H j(Il) Km+Ln0Mp1Oq2Pr4Qt5S u6Tv8U x9WyaX zcYBdZCe! Dg$Fh%Gi*Hk(Il) Km+Lo0Mp1Oq3 Pr4Qt5Su7Tv8Ux9WybXzcYBd #Ce!D g$FhGi *Hk(Jl ) Km+Lo0Np1Oq3Ps4R t5Su7Tw8Ux9T v7Uw9VyaXzbYAdZCe#Df$Eh% GiHj( Il) Jm- Ln0Mp1Nq2Pr4Qs5Ru6Tv8Uw9 VyaXzcY AdZCe !Df$Eh%Gi*Hj(Il) Km-Ln0Mp 1Oq2Pr 4Qt5Ru 6Tv8Ux9VyaXzcYBdZCe! Dg$E h%Gi*Hk(Il) K m+Ln0Mp1Oq3Pr4Qt5Su6Tv8U x9WyaX zcYBd# Ce!Dg$Fh%Gi*Hk(Jl) Km+Lo0 Mp1Oq3P s4Qt5 Su7Tw8Ux9Wyb X zcYBd#Cf!Dg $FhGi*Hk(Jl -Km+Lo0Np1Oq3Ps4Rt5Su7Tw 8Vx9Wy bXAcYB d#Cf! Eg$FhGj*Hk(Jl-Kn+L o0Np2O q3Ps4R t6Su7Tw8VxaWybXAcZBd#Cf! Eg%Fh Gj*Ik( Jl-Kn+Mo0Np2Or3Ps4Rt6Sv7 Tw8Vxa WzbXAc ZBe#Cf!Eg%FiGj*Ik) Jl-Kn +Mo1Np2Or3Qs 5Rt6Sv7Uw8Vx a WzbYAcZBe#D f! Eg%FiHj*Ik) Jm-Kn+Mo1 Nq 2Or3Qs5Ru6 Sv7Uw9Vx aWzb YAdZBe#Df$Eg %F iHj(Ik) Jm -Ln+Mo1N q2Pr 3Qs5Ru6Tv7Uw 9VyaWzbYAdZC e#Df$Eh%FiH j(Il) Jm-Ln0M o1Nq2Pr4Qs5R u6Tv8Uw9VyaX zbYAdZCe! Df$ E h%GiHj(Il) Km-Ln0Mp 1Oq2 Pr4Qt5Ru6Tv8 U x9VyaXzcYAd ZCe!Dg$E h%Gi *Hj(Il) Km+Ln 0Mp1Oq3Pr4Qt 5Su6Tv8Ux9Wy aXzcYBdZCe!D g $Fh%Gi*Hk(I l)---------------------------------------------------------------最新资料推荐------------------------------------------------------ Km+Lo0Mp1O q3Ps4Qt5Su7T v 8Ux9WybXzcY Bd#Ce! D g$Fh Gi*Hk(Jl) Km+ L o0Np1Oq3Ps4 Rt5Su7T w8Ux9 WybXAcYBd#Cf !Dg$FhGj*Hk (Jl-Km+ Lo0Np 2Oq3Ps4Rt6Su 7Tw8Vx9WybXA cZBd#Cf ! Eg$F hGj*Ik(Jl-K n+Mo0Np2Or3P s4Rt6Sv 7Tw8V xaWybXAcZBe# C f!Eg% FhGj*Ik) Jl-K n+Mo 1Np2Or3Qs4Rt 6Sv 7Uw8VxaWz bXAcZBe#D f!E g%FiGj*Ik) J m- Kn+Mo1Nq2O r3Qs5Rt6Sv7U w9VxaWzbYAcZ Be#Df$Eg%Fi Hj*Ik) Jm-Ln+ Mo1Nq2Pr3Qs5 Ru6Sv7Uw9Vya WzbYAdZBe#Df $Eh%FiHj(Il ) Jm -Ln0Mo1Nq 2Pr4Qs5Ru 6Tv 7Uw9VyaXzbYA dZCe#Df$Bd#C f! Eg%FhGj*I k(Jl-Kn+Mo0Np2O r3Qs4Rt 6Sv7Tw8VxaWzbXAcZBe#Cf!E g%FiGj*Ik) J l-Kn+Mo1Np2O r3Qs5Rt6Sv7U w8Vxa WzbYAcZ Be#Df! Eg%Fi Hj*Ik) Jm-Kn+ Mo1Nq2Or3Qs5 Ru6Sv7Uw9VxaWzbYAdZBe#Df $Eg%FiHj(Ik ) Jm-Ln0Mo1Nq2Pr3Qs5Ru6Tv 7Uw9Vy aWzbYA dZCe#Df$Eh%FiHj(Il) Jm-L n0Mp1Nq2Pr4Q s5Ru6Tv8Uw9VyaXzbYAdZCe! Df$Eh %GiHj( Il) Km-Ln0Mp1Oq2Pr4Qt5Ru6 Tv8Ux9VyaXzc YAdZCe!Dg$Eh%Gi*Hj(Il) Km +Ln0Mp 1Oq3Pr 4Qt5Su6Tv8Ux9WyaXzcYBdZC e!Dg$F h%Gi*H k(Jl) Km+Lo0Mp1Oq3Ps4Qt5S u7Ts5R u6Sv7U w9VyaWzbYAdZBe#Df$Eh%Fi Hj(Ik)Jm-Ln0 Mo1Nq2Pr4Qs5Ru6Tv7Uw9Vya XzbYA dZCe#Df $Eh%Gi Hj(Il) Jm-Ln0Mp1N q2Pr4Qt5Ru6T v8Uw9VyaXzcYAdZCe!Df$Eh% Gi*Hj( Il) Km- Ln0Mp1Oq2Pr4Qt5Su6Tv8Ux9 VyaXzcY BdZCe !Dg$Eh%Gi*Hk(Il) Km+Ln0Mp 1Oq3Pr4Qt5Su5 / 67Tv8Ux9WyaXzcYBd#Ce! Dg$F h%Gi*Hk (Jl) K m+Lo0Np1Oq3Ps4Qt5Su7Tw8U x9WybX zcYBd# Cf!Dg$FhGi*Hk(Jl-Km+Lo0 Np2Oq3Ps4Rt5 Su7Tw8Vx9WybXAcYBd#Cf!Eg $FhGj*Hk(Jl -Kn+Lo0Np2Or3Ps4Rt6Su7Tw 8VxaWy bXAcZB d#Cf! Eg%FhG j*Ik(Jl-Kn+M o0Np2O r3Qs4R t6Sr4Qt5Su6Tv8Ux9WyaXzcY BdZCe!Dg$Fh% Gi*Hk(Il) Km+Lo0Mp1Oq3Pr4 Qt5Su7Tv8Ux9 WybXzcYBd#Ce! Dg$FhGi*Hk (Jl) Km +Lo0Np 1Oq3Ps4Rt5Su7Tw8Ux9WybXA cYBd#Cf!Dg$FhGj*Hk(Jl- K m+Lo0Np2Oq3 Ps4Rt6Su7Tw8 Vx9WybXAcZBd # Cf!Eg$FhGj *Ik(Jl- Kn+Lo 0Np2Or3Ps4Rt 6Sv7Tw8VxaWy bXAcZBe#Cf!E g%FhGj*Ik) J l-Kn+Mo0Np2O r3Qs4Rt6Sv7U w8VxaWzbXAcZ B e#Df!Eg%Fi Gj*Ik) J m-Kn+ Mo1Nq2Or3Qs5 R t6Sv7Uw9Vxa WzbYAcZB e#Df $Eg%Ff! Dg$Fh Gi*Hk(Jl-Km +Lo0Np1Oq3Ps 4Rt5Su7Tw8Vx 9W ybXAcYBd#C f!Eg$Fh Gj*H k(Jl-Kn+Lo0N p2Oq3Ps4Rt6S u7Tw8Vxa WybX AcZBd#Cf!Eg% F hGj*Ik(Jl- Kn+Mo0N p2Or3 Ps4Rt6Sv7Tw8 V xaWzbXAcZBe #Cf!Eg% FiGj *Ik) Jl-Kn+Mo 1Np2Or3Qs5Rt 6Sv7Uw8V xaWz bYAcZBe#Df!E g%FiHj*Ik) J m-Kn+Mo1Nq2O r3Qs5Ru6Sv7U w9VxaW zbYAdZBe#Df$Eg %Fi Hj(Ik) Jm-Ln +M o1Nq2Pr3Qs 5Ru6Tv7U w9Vy aWzbYAdZCe#D f$Eh%FiHj(I l) Jm-Ln0Mo1N q2Pr4Qs5Or3P s4Rt6Su7Tw8V xaWybXAcZ Be# Cf! Eg%FhGj* I。

matlab偏最小二乘法

在MATLAB 中,偏最小二乘法(Partial Least Squares,PLS)可以通过使用PLS 工具箱来实现。

PLS 工具箱是一个用于执行偏最小二乘法和其他多元统计分析的MATLAB 工具箱。

以下是使用PLS 工具箱进行偏最小二乘法的基本步骤:

1. 安装PLS 工具箱:首先,确保你已经安装了PLS 工具箱。

你可以在MATLAB 中使用`help pls` 命令来确认是否安装了该工具箱。

2. 导入数据:将你的数据导入MATLAB 工作区。

数据应该是一个矩阵,其中每一行代表一个样本,每一列代表一个变量。

3. 调用PLS 函数:使用PLS 工具箱提供的函数来执行偏最小二乘法。

常用的PLS 函数包括`plsregress` 和`plsda`。

4. 设置参数:根据你的问题和数据集,设置PLS 函数的参数。

这些参数可能包括因变量的数量、自变量的数量、主成分的数量等。

5. 执行PLS:调用PLS 函数并传入设置的参数和数据集。

PLS 函数将返回偏最小二乘模型的结果,包括模型参数、预测值和其他统计信息。

6. 可视化结果:使用MATLAB 的绘图函数来可视化偏最小二乘模型的结果。

你可以绘制预测值与实际值的对比图、变量的重要性图等。

请注意,PLS 工具箱提供了丰富的功能和选项,具体的使用方法可能因版本和具体问题而有所不同。

建议参考PLS 工具箱的文档和示例来获取更详细的指导和示例代码。

偏最小二乘回归MATLAB程序代码单因变量functiony=pls(pz)[row,col]=size(pz);aver=mean(pz);stdcov=std(pz);%求均值和标准差rr=corrcoef(pz);%求相关系数矩阵%data=zscore(pz);%数据标准化stdarr=(pz-aver(ones(row,1),:))./stdcov(ones(row,1),:);%标准化数据结果与zscore()——致x0=pz(:,1:col-1);y0=pz(:,end);%提取原始的自变量、因变量数据e0=stdarr(:,1:col-1);f0=stdarr(:,end);%提取标准化后的自变量、因变量数据num=size(e0,1);%求样本点的个数temp=eye(col-1);%对角阵fori=1:col-1%以下计算w,w*和t的得分向量,w(:,i)=(e0'*f0)/norm(e0'*f0);t(:,i)=e0*w(:,i)%计算成分ti的得分alpha(:,i)=e0'*t(:,i)/(t(:,i)'*t(:,i))%计算alpha_i,其中(t(:,i)'*t(:,i))等价于norm(t(:,i))A2e=e0-t(:,i)*alpha(:,i)'%计算残差矩阵e0=e;%计算w*矩阵ifi==1w_star(:,i)=w(:,i);elseforj=1:i-1temp=temp*(eye(col-1)-w(:,j)*alpha(:,j)');endw_star(:,i)=temp*w(:,i);end%以下计算ss(i)的值beta=[t(:,1:i),ones(num,1)]\f0%求回归方程的系数beta(end,:)=[];%删除回归分析的常数项cancha=f0-t(:,1:i)*beta;%求残差矩阵ss(i)=sum(sum(cancha.A2));%求误差平方和%以下计算press(i)forj=1:numt1=t(:,1:i);f1=f0;she_t=t1(j,:);she_f=f1(j,:);%把舍去的第j个样本点保存起来t1(j,:)=[];f1(j,:)=[];%删除第j个观测值beta1=[t1,ones(num-1,1)]\f1;%求回归分析的系数beta1(end,:)=[];%删除回归分析的常数项cancha=she_f-she_t*beta1;%求残差向量press_i(j)=sum(cancha.A2);endpress(i)=sum(press_i)ifi>1Q_h2(i)=1-press(i)/ss(i-1)elseQ_h2(1)=1endifQ_h2(i)<0.0985fprintf('提出的成分个数r=%d',i);r=i;breakendendbeta_z=[t,ones(num,1)]\f0;%求标准化Y关于主成分得分向量t的回归系数beta_z(end,:)=[];%删除常数项xishu=w_star*beta_z;%求标准化丫关于X的回归系数,且是针对标准数据的回归系数, 每一列是一个回归方程mu_x=aver(1:col-1);mu_y=aver(end);sig_x=stdcov(1:col-1);sig_y=stdcov(end);ch0=mu_y-mu_x./sig_x*sig_y*xishu;%计算原始数据的回归方程的常数项xish=xishu'./sig_x*sig_y;%计算原始数据的回归方程的系数,每一列是一个回归方程Rc=corrcoef(x0*xish'+ch0,y0)sol=[ch0;xish']%显示回归方程的系数,每一列是一个方程,每一列的第一个数是常数项多因变量functiony=pls(pz,Xnum,Ynum)[row,col]=size(pz);aver=mean(pz);stdcov=std(pz);%求均值和标准差rr=corrcoef(pz);%求相关系数矩阵data=zscore(pz);%数据标准化stdarr=(pz-aver(ones(row,1),:))./stdcov(ones(row,1),:);%标准化自变量n=Xnum;m=Ynum;%n是自变量的个数,m是因变量的个数x0=pz(:,1:n);y0=pz(:,n+1:end);%提取原始的自变量、因变量数据e0=data(:,1:n);f0=data(:,n+1:end);%提取标准化后的自变量、因变量数据num=size(e0,1);%求样本点的个数temp=eye(n);%对角阵fori=1:n%以下计算w,w*和t的得分向量,matrix=e0'*f0*f0'*e0;[vec,val]=eig(matrix)%求特征值和特征向量val=diag(val);%提出对角线元素[val,ind]=sort(val,'descend');w(:,i)=vec(:,ind(1))%提出最大特征值对应的特征向量%计算成分ti的得分alpha(:,i)=e0'*t(:,i)/(t(:,i)'*t(:,i))%计算alpha_i,其中(t(:,i)'*t(:,i))等价于norm(t(:,i))A2 e=e0-t(:,i)*alpha(:,i)'%计算残差矩阵e0=e;%计算w*矩阵ifi==1w_star(:,i)=w(:,i);elseforj=1:i-1temp=temp*(eye(n)-w(:,j)*alpha(:,j)');endw_star(:,i)=temp*w(:,i);end%以下计算ss(i)的值beta=[t(:,1:i),ones(num,1)]\f0%求回归方程的系数beta(end,:)=[];%删除回归分析的常数项cancha=f0-t(:,1:i)*beta;%求残差矩阵ss(i)=sum(sum(cancha.A2));%求误差平方和%以下计算press(i)forj=1:numt1=t(:,1:i);f1=f0;she_t=t1(j,:);she_f=f1(j,:);%把舍去的第j个样本点保存起来t1(j,:)=[];f1(j,:)=[];%删除第j个观测值beta1=[t1,ones(num-1,1)]\f1;%求回归分析的系数beta1(end,:)=[];%删除回归分析的常数项cancha=she_f-she_t*beta1;%求残差向量press_i(j)=sum(cancha.A2);endpress(i)=sum(press_i)ifi>1Q_h2(i)=1-press(i)/ss(i-1)elseQ_h2(1)=1endifQ_h2(i)<0.0985fprintf('提出的成分个数r=%d',i);r=i;breakendendbeta_z=[t(:,1:r),ones(num,1)]\f0;%求标准化Y关于t的回归系数beta_z(end,:)=[];%删除常数项xishu=w_star(:,1:r)*beta_z;%求标准化Y关于X的回归系数,且是针对标准数据的回归系数,每一列是一个回归方程mu_x=aver(1:n);mu_y=aver(n+1:end);sig_x=stdcov(1:n);sig_y=stdcov(n+1:end);fori=1:mch0(i)=mu_y(i)-mu_x./sig_x*sig_y(i)*xishu(:,i);%计算原始数据的回归方程的常数项endfori=1:mxish(:,i)=xishu(:,i)./sig_x'*sig_y(i);%计算原始数据的回归方程的系数,每一列是一个回归方程endsol=[ch0;xish]%显示回归方程的系数,每一列是一个方程,每一列的第一个数是常数项。

一.利用160组数据建PLS 回归模型。

>> clear >> load ysj

>> X=ysj(:,1:8); >> Y=ysj(:,9:11); >> E0=stand(X); >> F0=stand(Y); >> A=rank(E0);

>> [W,C,T,U,P,R]=bykpcr(E0,F0); W :自变量轴权重; C :因变量轴权重;

T :自变量系统主成分得分; U :因变量系统主成分得分; P :模型效应载荷量; R :因变量载荷量。

(一).确定主成分个数三种方法: (1)复测定系数:

22

21

()

h

k

k k h t

r R F =⨯=

∑

复测定系数表示所提取的主成分的可解释变异信息占总变异的百分比。

当 h m =,复测定系数的值足够大时,可再第m 步终止主成分的提取计算。

通常20.85

m R ≥即可。

>> RA=plsra(T,R,F0,A)

RA =

0.3390 0.4831 0.5731 0.6358 0.6488 0.6522 0.6531 0.6537

结论:利用这个方法,无法确定。

(2)类似典型相关分析中的精度分析方法:

>> [Rdx,RdX,RdXt,Rdy,RdY ,RdYt]=plsrd(E0,F0,T,A) Rdx =

0.3034 0.4348 0.0539 0.1326 0.0082 0.0132 0.0331 0.0208 0.2661 0.1918 0.0549 0.1932 0.1852 0.0001 0.0416 0.0671 0.0400 0.1010 0.3281 0.0191 0.4557 0.0529 0.0002 0.0030 0.0206 0.0813 0.4868 0.0492 0.0469 0.3026 0.0021 0.0104 0.0016 0.0472 0.5869 0.0921 0.0126 0.1955 0.0101 0.0540 0.2667 0.2229 0.2517 0.0002 0.0447 0.0638 0.0634 0.0866

0.2746 0.1859 0.0112 0.0041 0.0006 0.0434 0.4569 0.0233

0.5467 0.4430 0.0018 0.0001 0.0072 0.0003 0.0008 0.0001

RdX =

0.2150 0.2135 0.2219 0.0613 0.0951 0.0840 0.0761 0.0332 RdXt =

1.0000

Rdy =

0.0092 0.0002 0.1325 0.0438 0.0195 0.0019 0.0002 0.0003

0.0761 0.0613 0.0112 0.0568 0.0001 0.0025 0.0001 0.0006

0.4591 0.1697 0.0009 0.0000 0.0013 0.0010 0.0011 0.0001 RdY =

0.1814 0.0771 0.0482 0.0336 0.0070 0.0018 0.0005 0.0003 RdYt =

0.3498

>> [V]=LJRdX(RdX)

V =

0.2150 0.4284 0.6504 0.7117 0.8068 0.8908 0.9668 1.0000

(3)累计贡献率:

>> [U]=LJGXL(X,T,A)

U =

0.1756 0.3846 0.5791 0.6308 0.7198 0.7981 0.8711 0.9043

(4) 交叉有效性

由于不会编交叉有效性的MATLAB 程序,因此,没再验证。

>> h=6;

(二).计算PLS 回归方程的系数

首先,求标准化变量010203,,F F F 关于0102030405060708,,,,,,,E E E E E E E E 的回归系数。

>> SCOEFF=pls(h,8,W,P,R)

SCOEFF =

-0.0103 -0.0119 0.0073 0.0114 0.0131 -0.0081 -0.0072 -0.0082 0.0051 0.0398 0.0458 -0.0284 -0.0282 -0.0324 0.0201 -0.0221 -0.0254 0.0157 -0.0048 -0.0055 0.0034

0.0007 0.0008 -0.0005

其次,求原始变量y1,y2,y3,关于x1,x2,x3,x4,x5,x6,x7,x8的回归系数。

>> [COEFF,INTERCEP]=plsiscoeff(X,Y ,SCOEFF)

COEFF =

-0.0000 -0.0000 0.0039 0.0001 0.0000 -0.0331 -0.1944 -0.0198 58.1193 0.0695 0.0071 -20.7671 -0.0192 -0.0019 5.7253 -0.0011 -0.0001 0.3146 -0.0013 -0.0001 0.3768 0.0000 0.0000 -0.0004

INTERCEP =

0.4371 0.0292 309.2128

(三).建立PLS 回归方程

x1-风量; x2-热风温度; x3-热风压; x4-透气性; x5-富氧率; x6-煤粉量; x7-料速(料批); x8-铁

量差;

y1-Si; y2-S; y3-铁元素还原速率;

10.4371010.000120.194430.069540.019250.001160.0013708

y x x x x x x x x =-+-+---+

20.029201020.019830.007140.001950.000160.0001708

y x x x x x x x x =-+-+---+

3309.21280.003910.0331255.1193320.76714 5.725350.314660.376870.00048

y x x x x x x x x =+-+-+++-二.利用40组数据来计算命中率。

Si —0.1; S--0.01;

铁元素还原速率—50。

[M]=mzl(XX,YY) M =

0.5250 0.3250 0.7250

若改成: Si —0.15; S--0.015;

铁元素还原速率—60。

[M]=mzl(XX,YY) M =

0.8000 0.8250 0.8750

三.给出预测值与实际值的折线图

四.李志玲建的模型

风量、风温、风压、透气性、富氧、喷煤、料速、铁量差; 铁水硅含量[Si]、铁水硫含量[S]、炉渣碱度[R]、铁还原率。