信息论复习资料

- 格式:pdf

- 大小:1.11 MB

- 文档页数:8

判断30名词解释4*5计算3道20分第一章1、自信息和互信息P6 公式2、信道P9 概念第二章1、离散平稳信源P18概念2、离散无记忆信源P19概念3、时齐马尔可夫信源P20概念4、自信息P22概念5、信息熵P25概念6、信息熵的基本性质P281)对称性2)确定性3)非负性4)扩展性5)可加性6)强可加性7)递增性8)极值性9)上凸性7、联合熵条件熵P42公式P43例题8、马尔克夫信源P54公式P55例题9、信源剩余度P5810、熵的相对率信源剩余度P5811、课后作业:2、4、13、21、22第三章1、有记忆信道P73概念2、二元对称信道BSC P743、前向概率、后向概率、先验概率、后验概率P764、条件熵信道疑义度、平均互信息P775、平均互信息、联合熵、信道疑义度、噪声熵计算公式P786、损失熵噪声熵 P797、平均互信息的特性P821)非负性2)极值性3)交互性4)凸状性8、信息传输率R P869、无噪无损信道P87概念10、有噪无损信道P88概念11、对称离散信道 P89概念12、对称离散信道的信道容量P90公式张亚威2012/06/20张亚威2012/06/2116、 数据处理定理 P113定理 17、 信道剩余度 P118公式 18、 课后作业:1、 3、 9第五章1、 编码:实质上是对信源的原始符号按一定的数学规则进行的一种变换。

2、 等长码 P172概念3、 等长信源编码定理 P1784、 编码效率 P1805、 克拉夫特不等式 P1846、 香农第一定理 P1917、 码的剩余度 P194第六章1、 最大后验概率准则 最小错误概率准则 P2002、 最大似然译码准则 P2013、 费诺不等式 P2024、 信息传输率(码率) P2055、 香农第二定理 P2156、 课后习题 3、第八章1、 霍夫曼码 最佳码 P2732、 费诺码 P2793、 课后习题 11、第八章1、 编码原则 译码原则 P3072、 定理9.1 P3133、 分组码的码率 P314公式4、 课后习题 3、一、 填空题1、 在现代通信系统中,信源编码主要用于解决信息传输中的 有效性 ,信道编码主要用于解决信息传输中的 可靠性 ,加密编码主要用于解决信息传输中的 安全性 。

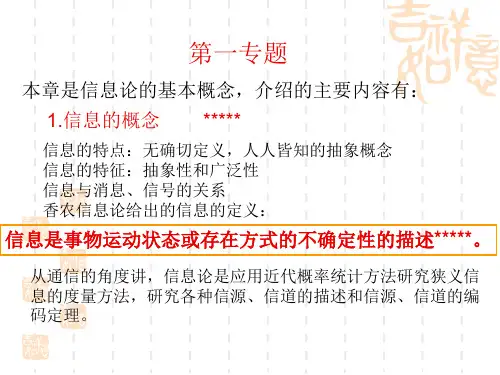

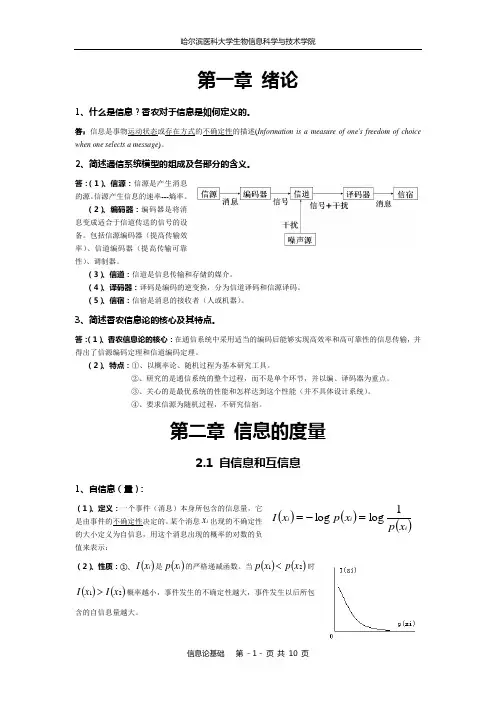

第一章 绪论1、什么是信息?香农对于信息是如何定义的。

答:信息是事物运动状态或存在方式的不确定性的描述(Information is a measure of one's freedom of choice when one selects a message )。

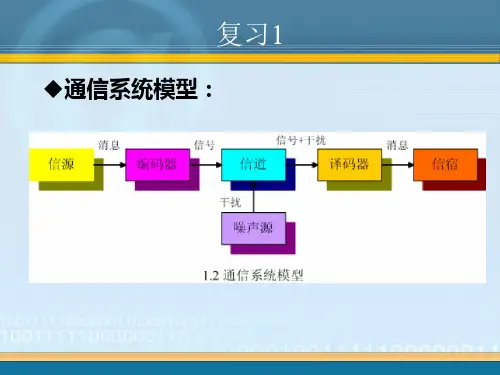

2、简述通信系统模型的组成及各部分的含义。

答:(1)、信源:信源是产生消息的源。

信源产生信息的速率---熵率。

(2)、编码器:编码器是将消息变成适合于信道传送的信号的设备。

包括信源编码器(提高传输效率)、信道编码器(提高传输可靠性)、调制器。

(3)、信道:信道是信息传输和存储的媒介。

(4)、译码器:译码是编码的逆变换,分为信道译码和信源译码。

(5)、信宿:信宿是消息的接收者(人或机器)。

3、简述香农信息论的核心及其特点。

答:(1)、香农信息论的核心:在通信系统中采用适当的编码后能够实现高效率和高可靠性的信息传输,并得出了信源编码定理和信道编码定理。

(2)、特点:①、以概率论、随机过程为基本研究工具。

②、研究的是通信系统的整个过程,而不是单个环节,并以编、译码器为重点。

③、关心的是最优系统的性能和怎样达到这个性能(并不具体设计系统)。

④、要求信源为随机过程,不研究信宿。

第二章 信息的度量2.1 自信息和互信息1、自信息(量):(1)、定义:一个事件(消息)本身所包含的信息量,它是由事件的不确定性决定的。

某个消息i x 出现的不确定性的大小定义为自信息,用这个消息出现的概率的对数的负值来表示: (2)、性质:①、()i x I是()i x p 的严格递减函数。

当()()21x p x p <时()()21x I x I >概率越小,事件发生的不确定性越大,事件发生以后所包含的自信息量越大。

()()()i i i x p x p x I 1loglog =-=②、极限情况下,当()0=i x p 时()∞→i x I ;当()1=i x p 时,()0→i x I 。

I□离散信源的不肯定程度表示某些随机事件是否会发生。

2□离散信源的不肯定性表示信源某时刻发不发送信源符号不能肯定。

3□离散信源的不肯定性表示信源某时刻发送某个信源符号的概率大小不能肯定。

4□离散信源的不肯定性表示信源某时刻发送哪个信源符号是不能绝对肯定的。

5□离散信源的不肯定程度表示某些随机事件是否会发生的难易程度。

6□不肯定程度仅与离散信源概率空间的状态数有关。

7□不肯定程度仅与离散信源概率空间的概率分布有关。

8□不肯定程度与离散信源概率空间的状态数及概率分布有关。

9□离散信源概率空间的概率分布差别越大时不肯定程度也越大。

10□离散信源概率空间的概率分布差别越小时不肯定程度就越大。

II□离散信源概率空间的概率分布为等概时不肯定程度最大。

12 □不肯定度用取对数的度量方法是因为不这样定义是错的。

13□不肯定度用取对数的度量方法是因为其符合人对信息量的直观理解。

14 □信息的多少定义为信息量。

15□信息量定义为不肯定程度的减小量。

16□先验概率分布和后验概率分布分别表示信源发送消息前后的概率分布。

17□先验概率分布和后验概率分布分别表示收信者收到消息前后的概率分布。

18 □信源输出所有消息的量叫做信源熵。

19□信源输出一个消息所提供的信息量叫做信源熵。

20□信源输出所有消息所提供的总的信息量叫做信源熵。

21口信源输出一个消息所提供的平均信息量叫做信源熵。

22口信源的不肯定度叫做信源熵。

23□离散信源熵不可能为负数。

24□信源如发送错误消息则其输出的熵为负数。

25□二元联合信源的共熵一定小于每个单独信源熵的和。

26□二元联合信源的共熵小于或等于每个单独信源熵的和。

27□二元联合信源的共熵有可能等于每个单独信源熵的和。

28□—个离散信源输出的符号前后无相关性时表示该信源无剩余。

29□—个离散信源输出的符号前后有相关性时其熵将减少。

30□—个离散信源输出的符号前后有相关性时表示该信源有剩余。

31□条件熵永远小于无条件熵。

第二章 信源熵一、自信息量1. 定义:一个随机事件发生某一结果后所带来的信息量称为自信息量,简称自信息。

定 义为其发生概率对数的负值。

若随机事件发生i a 的概率为)(i a p ,那么它的自信 息量为:)(log )(2i i a p a I -= (bit )2. 性质:在事件发生前,)(i a I 表示该事件发生的不确定性。

在事件发生后,)(i a I 表示事件发生所提供的信息量。

二、信源熵1. 定义: 已知单符号离散无记忆信源的数学模型我们定义信源各个离散消息的自信息量的数学期望为信源的平均信息量,一般称为信源的平均信息量: )(log )(])(1[log )]([)( 212i ni i i i a p a p a p E a I E X H ∑=-=== 2. 信源熵与平均自信息量之间的区别两者在数值上是相等的,但含义不同。

信源熵表征信源的平均不确定度,平均自信息量是消除不确定度所需要的信息的度量。

信源一定,不管它是否输出离散消息,只要这些离散消息具有一定的概率特性,必有信源的熵值,该熵值在总体平均的意义上才有意义,因而是一个确定值, 。

在离散信源的情况下,信源熵的值是有限的。

而信息量只有当信源输出离散消息并被接收后,才有意义,这就是给予接收者的信息度量。

3. 最大离散熵定理:信源X 中包含n 个不同离散消息时,信源熵H(X)有: n X H 2log )(≤当且仅当X 中各个消息出现的概率全相等时,上式取等号。

4. 扩展信源的信源熵:N 次扩展信源的信源熵:)()(X NH X H N=)(,),(,),(),( , , , ,,)( 2121⎭⎬⎫⎩⎨⎧=⎥⎦⎤⎢⎣⎡n i n i a p a p a p a p a a a a X P X三、平均互信息量 1. 定义:互信息),,2,1;,,2,1()/()()()(log );(2m j n i b a I a I a p b a p b a I j i i i j i j i ==-==在联合概率空间中的统计平均值。

信息论复习知识点本页仅作为文档封面,使用时可以删除This document is for reference only-rar21year.March1、平均自信息为表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。

平均互信息表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

2、最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

3、最大熵值为。

4、通信系统模型如下:5、香农公式为为保证足够大的信道容量,可采用(1)用频带换信噪比;(2)用信噪比换频带。

6、只要,当N足够长时,一定存在一种无失真编码。

7、当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。

8、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。

9、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

按照信息的地位,可以把信息分成客观信息和主观信息。

人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

信息的可度量性是建立信息论的基础。

统计度量是信息度量最常用的方法。

熵是香农信息论最基本最重要的概念。

事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有 比特、奈特和哈特 。

13、必然事件的自信息是 0 。

14、不可能事件的自信息量是 ∞ 。

15、两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量 趋于变小 。

《信息论》复习资料信息论导论参考资料第⼀章概论●在认识论层次研究信息时,把只考虑到形式因素的部分称为语法信息,把只考虑到含义因素的部分称为语义信息;把只考虑到效⽤因素的部分称为语⽤信息。

⽬前,信息论中主要研究语法信息●归纳起来,⾹农信息论的研究内容包括: 1) 信息熵、信道容量和信息率失真函数2) ⽆失真信源编码定理、信道编码定理和保真度准则下的信源编码定理 3) 信源编码、信道编码理论与⽅法●⼀般认为,⼀般信息论的研究内容除⾹农信息论的研究内容外,还包括维纳的微弱信号检测理论:包括噪声理论、信号滤波与预测、统计检测与估计理论、调制理论等。

信息科学以信息为研究对象,信息科学以信息运动规律为研究内容,信息运动包括获取、传递、存储、处理和施⽤等环节。

消息、信息、信号●消息是由图像、声⾳、⽂字、数字等符号组成的序列。

●承载消息的载体称为信号●信息是通信系统传输和处理的对象,泛指消息和信号的具体内容和意义. ●三者关系:通信系统传输的是信号,信号承载着消息,消息中的不确定成分是信息。

第⼆章离散信源及离散熵●单符号离散信源的数学模型:1212()()()()n n x x x X P x P x P x P X = ⾃信息量:()log ()i x i I x P x =-,是⽆量纲的,⼀般根据对数的底来定义单位:当对数底为2时,⾃信息量的单位为⽐特(bit,binary unit);对数底为e 时,其单位为奈特(nat,nature unit);对数底为10时,其单位为哈特(Hart, Hartley)⾃信息量性质:I(x i )是随机量;I(x i )是⾮负值;I(x i )是P(x i )的单调递减函数。

●单符号离散信源的离散熵:1()[()]()()ni i i i H X E I x P x lbP x ===-∑,单位是⽐特/符号(bit/symbol)。

离散熵的性质和定理:H(X)的⾮负性;H(X)的上凸性;最⼤离散熵定理:()H X lbn ≤(证明)●如果除概率分布相同外,直到N 维的各维联合概率分布也都与时间起点⽆关,即:111111()()()()()()k l k k l l k k k N l l l N P X P X P X X P X X P X X X P X X X ++++-++-===则称该多符号离散信源为N 维离散平稳信源。