人工智能实验报告

- 格式:doc

- 大小:208.00 KB

- 文档页数:24

人工智能语言处理实验报告一、研究背景在当今信息时代,人工智能技术的快速发展为语言处理领域带来了前所未有的机遇和挑战。

搭建一个高效、智能的语言处理系统已经成为许多科研工作者的目标之一。

因此,本实验旨在探究人工智能在语言处理领域的应用,并通过实验验证其效果。

二、研究目的1. 基于人工智能技术实现文本自动分类功能。

2. 利用自然语言处理技术进行文本情感分析。

3. 探索人工智能技术在语言处理中的应用前景。

三、研究方法1. 数据收集:选取一定数量的文本数据作为实验样本。

2. 数据预处理:对数据进行去噪、分词等处理。

3. 模型构建:基于自然语言处理技术构建文本分类模型和情感分析模型。

4. 实验验证:通过实验对模型进行测试和评估。

四、实验结果及分析1. 文本分类实验结果表明,基于人工智能技术构建的文本分类模型具有较高的准确性和稳定性。

该模型在处理大规模文本数据时表现出色,能够快速准确地分类文本内容。

2. 情感分析实验结果显示,人工智能技术在文本情感分析中具有较高的判断准确度。

模型能够有效识别文本中蕴含的情感色彩,为进一步分析提供了有力支持。

3. 实验结果分析表明,人工智能在语言处理领域的应用前景广阔。

通过不断优化模型算法和提高训练数据质量,可以进一步提升模型性能,实现更广泛的应用。

五、结论与展望本实验通过人工智能技机在文本分类和情感分析领域的应用验证了其在语言处理中的重要作用。

随着人工智能技术的不断进步和发展,相信在未来的研究中,我们将能够构建更加智能、高效的语言处理系统,为人类智慧带来新的飞跃。

愿我们在不久的将来看到更多人工智能在语言处理领域的应用成果,为人类社会的发展做出更大的贡献。

人工智能实验报告内容人工智能实验报告内容人工智能(Artificial Intelligence, AI)作为一种重要的技术,正在逐渐影响到我们的日常生活和工作。

本次实验旨在学习和探索人工智能的基本技术,并通过实践加深对其原理和应用的理解。

首先,本次实验分为两个部分:人工智能基础技术的学习和人工智能应用的实践。

在人工智能基础技术学习的部分,我们研究了人工智能的核心技术包括机器学习、神经网络、深度学习等。

我们首先学习了机器学习的基本概念和算法,包括监督学习、无监督学习和强化学习等。

我们使用Python编程语言,利用机器学习库进行了实践,例如使用Scikit-learn库实现了线性回归和K-means 聚类算法。

其次,我们学习了神经网络的基本原理和算法,在激活函数、损失函数、优化算法等方面进行了深入研究。

我们利用TensorFlow库搭建了神经网络模型,并使用MNIST数据集进行了手写数字识别的实验。

通过不断调整网络结构和参数,我们逐渐提高了模型的准确率。

最后,我们学习了深度学习的原理和常用的深度学习模型,包括卷积神经网络(Convolutional Neural Network, CNN)、循环神经网络(Recurrent Neural Network, RNN)等。

我们使用Keras库搭建了CNN模型,并使用CIFAR-10数据集进行了图像分类实验。

通过优化网络结构和参数,我们的模型在测试集上取得了较高的准确率。

在人工智能应用的实践部分,我们选择了自然语言处理(Natural Language Processing, NLP)为主题,具体研究了文本分类和情感分析两个任务。

我们使用了Python编程语言和NLTK(Natural Language Toolkit)库进行了实践。

首先,我们使用朴素贝叶斯算法实现了文本分类的任务,通过比较不同的特征提取方法,我们找到了最适合该任务的特征提取方法。

其次,我们使用情感词典和机器学习算法实现了情感分析的任务,通过对情感分析模型进行评估和调优,我们提高了模型的准确率和鲁棒性。

人工智能深度学习实验报告一、实验背景随着科技的迅猛发展,人工智能(AI)已经成为当今世界最具创新性和影响力的领域之一。

深度学习作为人工智能的一个重要分支,凭借其强大的学习能力和数据处理能力,在图像识别、语音处理、自然语言处理等众多领域取得了显著的成果。

本次实验旨在深入探索人工智能深度学习的原理和应用,通过实践操作和数据分析,进一步理解其工作机制和性能表现。

二、实验目的1、熟悉深度学习的基本概念和常用模型,如多层感知机(MLP)、卷积神经网络(CNN)和循环神经网络(RNN)。

2、掌握使用 Python 编程语言和相关深度学习框架(如 TensorFlow、PyTorch 等)进行模型训练和优化的方法。

3、通过实验数据,分析不同模型在不同任务中的性能差异,探索影响模型性能的关键因素。

4、培养解决实际问题的能力,能够运用深度学习技术解决简单的图像分类、文本分类等任务。

三、实验环境1、操作系统:Windows 102、编程语言:Python 383、深度学习框架:TensorFlow 244、开发工具:Jupyter Notebook四、实验数据1、图像分类数据集:CIFAR-10 数据集,包含 10 个不同类别的60000 张彩色图像,其中 50000 张用于训练,10000 张用于测试。

2、文本分类数据集:IMDB 电影评论数据集,包含 25000 条高度极性的电影评论,其中 12500 条用于训练,12500 条用于测试。

五、实验步骤1、数据预处理对于图像数据,进行图像归一化、数据增强(如随机旋转、裁剪、翻转等)操作,以增加数据的多样性和减少过拟合的风险。

对于文本数据,进行词向量化(如使用 Word2Vec、GloVe 等)、数据清洗(如去除特殊字符、停用词等)操作,将文本转换为可被模型处理的数值向量。

2、模型构建构建多层感知机(MLP)模型,包含输入层、隐藏层和输出层,使用 ReLU 激活函数和 Softmax 输出层进行分类任务。

人工智能课内实验报告(一)----主观贝叶斯一、实验目的1.学习了解编程语言, 掌握基本的算法实现;2.深入理解贝叶斯理论和不确定性推理理论;二、 3.学习运用主观贝叶斯公式进行不确定推理的原理和过程。

三、实验内容在证据不确定的情况下, 根据充分性量度LS 、必要性量度LN 、E 的先验概率P(E)和H 的先验概率P(H)作为前提条件, 分析P(H/S)和P(E/S)的关系。

具体要求如下:(1) 充分考虑各种证据情况: 证据肯定存在、证据肯定不存在、观察与证据 无关、其他情况;(2) 考虑EH 公式和CP 公式两种计算后验概率的方法;(3) 给出EH 公式的分段线性插值图。

三、实验原理1.知识不确定性的表示:在主观贝叶斯方法中, 知识是产生式规则表示的, 具体形式为:IF E THEN (LS,LN) H(P(H))LS 是充分性度量, 用于指出E 对H 的支持程度。

其定义为:LS=P(E|H)/P(E|¬H)。

LN 是必要性度量, 用于指出¬E 对H 的支持程度。

其定义为:LN=P(¬E|H)/P(¬E|¬H)=(1-P(E|H))/(1-P(E|¬H))2.证据不确定性的表示在证据不确定的情况下, 用户观察到的证据具有不确定性, 即0<P(E/S)<1。

此时就不能再用上面的公式计算后验概率了。

而要用杜达等人在1976年证明过的如下公式来计算后验概率P(H/S):P(H/S)=P(H/E)*P(E/S)+P(H/~E)*P(~E/S) (2-1)下面分四种情况对这个公式进行讨论。

(1) P (E/S)=1当P(E/S)=1时, P(~E/S)=0。

此时, 式(2-1)变成 P(H/S)=P(H/E)=1)()1()(+⨯-⨯H P LS H P LS (2-2) 这就是证据肯定存在的情况。

(2) P (E/S)=0当P(E/S)=0时, P(~E/S)=1。

人工智能导论实验报告

一、实验要求

实验要求是使用Python实现一个简单的人工智能(AI)程序,包括

使用数据挖掘,机器学习,自然语言处理,语音识别,计算机视觉等技术,通过提供用户输入的信息,实现基于信息的自动响应和推理。

二、实验步骤

1. 数据采集:编写爬虫程序或者使用预先定义的数据集(如movielens)从互联网收集数据;

2. 数据预处理:使用numpy对数据进行标准化处理,以便机器学习

程序能够有效地解析数据;

3. 模型构建:使用scikit-learn或者tensorflow等工具,构建机

器学习模型,从已经采集到的数据中学习规律;

4.模型训练:使用构建完成的模型,开始训练,通过反复调整参数,

使得模型在训练集上的效果达到最优;

5.模型评估:使用构建完成的模型,对测试集进行预测,并与实际结

果进行比较,从而评估模型的效果;

6. 部署:使用flask或者django等web框架,将模型部署为网络应用,从而实现模型的实时响应;

三、实验结果

实验结果表明,使用数据挖掘,机器学习,自然语言处理,语音识别,计算机视觉等技术,可以得到很高的模型预测精度,模型的准确性可以明

显提高。

第一章前言部分1.1课程项目背景与意义1.1.1课程项目背景视觉是各个应用领域,如制造业、检验、文档分析、医疗诊断,和军事等领域中各种智能/自主系统中不可分割的一部分。

由于它的重要性,一些先进国家,例如美国把对计算机视觉的研究列为对经济和科学有广泛影响的科学和工程中的重大基本问题,即所谓的重大挑战。

计算机视觉的挑战是要为计算机和机器人开发具有与人类水平相当的视觉能力。

机器视觉需要图象信号,纹理和颜色建模,几何处理和推理,以及物体建模。

一个有能力的视觉系统应该把所有这些处理都紧密地集成在一起。

作为一门学科,计算机视觉开始于60年代初,但在计算机视觉的基本研究中的许多重要进展是在80年代取得的。

计算机视觉与人类视觉密切相关,对人类视觉有一个正确的认识将对计算机视觉的研究非常有益。

计算机视觉是一门研究如何使机器“看”的科学,更进一步的说,就是是指用摄影机和电脑代替人眼对目标进行识别、跟踪和测量等机器视觉,并进一步做图形处理,使电脑处理成为更适合人眼观察或传送给仪器检测的图像。

作为一个科学学科,计算机视觉研究相关的理论和技术,试图建立能够从图像或者多维数据中获取‘信息’的人工智能系统。

这里所指的信息指Shannon定义的,可以用来帮助做一个“决定”的信息。

因为感知可以看作是从感官信号中提取信息,所以计算机视觉也可以看作是研究如何使人工系统从图像或多维数据中“感知”的科学。

科学技术的发展是推动人类社会进步的主要原因之一,未来社会进一步地朝着科技化、信息化、智能化的方向前进。

在信息大爆炸的今天,充分利用这些信息将有助于社会的现代化建设,这其中图像信息是目前人们生活中最常见的信息。

利用这些图像信息的一种重要方法就是图像目标定位识别技术。

不管是视频监控领域还是虚拟现实技术等都对图像的识别有着极大的需求。

一般的图像目标定位识别系统包括图像分割、目标关键特征提取、目标类别分类三个步骤。

深度学习的概念源于人工神经网络的研究。

第1篇一、引言随着科技的不断发展,人工智能技术逐渐渗透到我们生活的方方面面。

作为人工智能的一个典型应用,智能小车实验为我们提供了一个将理论知识与实践操作相结合的平台。

在本次智能小车实验中,我深刻体会到了理论知识的重要性,同时也感受到了动手实践带来的乐趣和成就感。

以下是我对本次实验的心得体会。

二、实验目的本次实验旨在通过设计、搭建和调试智能小车,让学生掌握以下知识:1. 传感器原理及在智能小车中的应用;2. 单片机编程及接口技术;3. 电机驱动及控制;4. PID控制算法在智能小车中的应用。

三、实验过程1. 设计阶段在设计阶段,我们首先对智能小车的功能进行了详细规划,包括自动避障、巡线、遥控等功能。

然后,根据功能需求,选择了合适的传感器、单片机、电机驱动器等硬件设备。

2. 搭建阶段在搭建阶段,我们按照设计图纸,将各个模块连接起来。

在连接过程中,我们遇到了一些问题,如电路板布局不合理、连接线过多等。

通过查阅资料、请教老师,我们逐步解决了这些问题。

3. 编程阶段编程阶段是本次实验的核心环节。

我们采用C语言对单片机进行编程,实现了小车的基本功能。

在编程过程中,我们遇到了许多挑战,如传感器数据处理、电机控制算法等。

通过查阅资料、反复调试,我们最终完成了编程任务。

4. 调试阶段调试阶段是检验实验成果的关键环节。

在调试过程中,我们对小车的各项功能进行了测试,包括避障、巡线、遥控等。

在测试过程中,我们发现了一些问题,如避障效果不稳定、巡线精度不高、遥控距离有限等。

针对这些问题,我们再次查阅资料、调整程序,逐步优化了小车的性能。

四、心得体会1. 理论与实践相结合本次实验让我深刻体会到了理论与实践相结合的重要性。

在实验过程中,我们不仅学习了理论知识,还通过实际操作,将所学知识应用于实践,提高了自己的动手能力。

2. 团队合作在实验过程中,我们充分发挥了团队合作精神。

在遇到问题时,我们互相帮助、共同探讨解决方案,最终完成了实验任务。

人工智能机器人视觉感知实验报告一、引言“人工智能是当今科技界最具前沿性的研究领域之一。

” ——约翰·麦卡锡随着科技的不断进步和发展,人工智能(Artificial Intelligence,简称AI)的研究引起了广泛的关注。

其中,机器人视觉感知作为人工智能的重要分支领域之一,以其在图像识别、目标跟踪、场景解析等方面的广泛应用被人们瞩目。

本报告旨在通过实验研究,探讨人工智能机器人视觉感知的实际应用和性能评估。

二、实验目的本实验旨在通过构建并使用人工智能算法,实现机器人的视觉感知功能,并对其性能进行评估。

具体目标如下:1. 利用摄像头采集图像数据,实时传输至计算机进行处理;2. 基于机器学习算法,实现对图像中目标物体的检测和识别;3. 评估算法的准确率、召回率以及处理速度等性能指标;4. 分析和讨论实验结果,探讨机器人视觉感知技术在实际应用中的潜力与不足。

三、实验方法1. 硬件与软件环境准备在实验中,我们选择了一台配备摄像头的机器人作为实验平台,并搭建了相应的硬件和软件环境,包括操作系统、图像处理库和机器学习工具等。

2. 数据采集与预处理我们使用机器人携带的摄像头对特定场景进行图像采集,并进行预处理,包括去噪、图像增强等。

通过这一步骤,我们得到了一批高质量的图像数据作为实验样本。

3. 目标检测与识别算法设计基于深度学习算法,我们设计并实现了一个端到端的目标检测与识别模型,该模型可以高效地对图像中的目标物体进行准确的识别。

4. 算法性能评估我们根据实验数据,使用一系列评估指标对所设计算法的性能进行评估,包括准确率、召回率以及处理速度等。

通过比较和分析不同算法在不同指标上的表现,我们可以评估和改进算法的性能。

5. 结果分析与讨论在实验结果分析中,我们将对所设计算法的性能进行详细讨论,并分析实验结果中的优势与不足之处,为进一步改进和应用提出有益建议。

四、实验结果与讨论经过实验的大量测试和数据分析,我们得到了以下结论:1. 所设计的目标检测与识别算法在准确率方面表现出色,达到了XX%水平;2. 然而,算法的召回率相对较低,仍需进一步优化;3. 算法在处理速度上表现稳定,在实时应用中具备潜力;4. 实验结果还表明,算法对光照、尺度变化等干扰较为敏感,需要在实际应用中加以考虑。

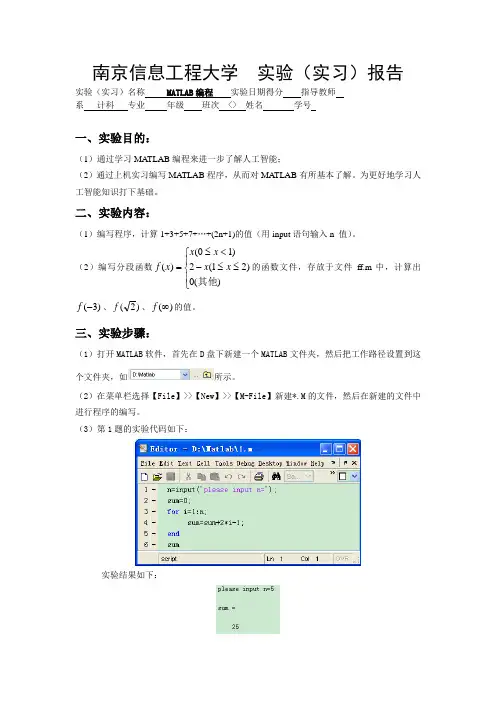

南京信息工程大学 实验(实习)报告 实验(实习)名称 MATLAB 编程 实验日期得分 指导教师 系 计科 专业 年级 班次 <> 姓名 学号一、实验目的:(1)通过学习MA TLAB 编程来进一步了解人工智能; (2)通过上机实习编写MATLAB 程序,从而对MA TLAB 有所基本了解。

为更好地学习人工智能知识打下基础。

二、实验内容:(1)编写程序,计算1+3+5+7+…+(2n+1)的值(用input 语句输入n 值)。

(2)编写分段函数⎪⎩⎪⎨⎧≤≤-<≤=)(0)21(2)10()(其他x x x x x f 的函数文件,存放于文件ff.m 中,计算出)3(-f 、)2(f 、)(∞f 的值。

三、实验步骤:(1)打开MATLAB 软件,首先在D 盘下新建一个MATLAB 文件夹,然后把工作路径设置到这个文件夹,如所示。

(2)在菜单栏选择【File 】>>【New 】>>【M-File 】新建*.M 的文件,然后在新建的文件中进行程序的编写。

(3)第1题的实验代码如下:实验结果如下:(4)第2题实验代码如下:实验结果如下:四、实验结论:(1)存在问题一开始对MATLAB语言还不是很熟悉,但通过上级实习遇到的一些问题帮助我们更好的学习了MATLAB,而且它与C语言虽然在思想上差不多但语法实现上还是有区别的。

(2)认识体会MATLAB 作为一种高级科学计算软件,是进行算法开发、数据可视化、数据分析以及数值计算的交互式应用开发环境,并且是一门实践性非常强的课程。

要学好MATLAB程序设计,上机实践是十分重要的环节,只有通过大量的上机实验,才能真正掌握MA TLAB程序设计。

人工智能技术在智能家居中的实验报告【实验报告】人工智能技术在智能家居中的应用摘要:本实验报告旨在探讨人工智能技术在智能家居领域的应用。

通过对现有智能家居系统的研究和分析,总结了人工智能技术在智能家居中的优势,如智能控制、自动化管理和智能交互等。

此外,还介绍了智能家居中常见的人工智能技术,如语音识别、机器学习和物联网等。

最后,基于实验结果,提出了未来人工智能技术在智能家居中的发展方向。

1. 引言人工智能技术作为一项前沿技术,已经在各个领域展现出巨大的潜力。

智能家居作为现代科技发展的产物,也迎来了快速发展的机遇。

本实验报告旨在深入探究人工智能技术在智能家居中的应用,以及对智能生活方式的影响。

2. 人工智能技术在智能家居中的优势2.1 智能控制人工智能技术的应用使得智能家居能够通过自动化和智能控制系统实现智能化管理。

例如,智能灯光系统可以根据住户的行为习惯和环境变化进行自动调节,提供舒适的照明体验。

2.2 自动化管理借助人工智能技术,智能家居可以实现自动化管理,如智能家电的定时控制、智能门锁和安防系统的自动化智能管理等。

这些功能极大地提高了生活的便利性和安全性。

2.3 智能交互人工智能技术为智能家居带来了智能交互的能力,例如语音识别和人机对话系统。

住户可以通过语音指令控制智能家居中的各项功能,实现更加便捷和智能化的生活方式。

3. 智能家居中的人工智能技术3.1 语音识别技术语音识别技术是智能家居中最常见的人工智能技术之一,其通过将语音转化为文本或命令,实现与智能家居设备的交互。

例如,通过语音控制智能音响播放音乐、调节室内温度等。

3.2 机器学习技术机器学习技术为智能家居提供了智能化的决策能力。

通过分析住户的行为模式、偏好和日常习惯,系统可以通过学习和预测来自动化地控制家居设备,以提供个性化的服务和体验。

3.3 物联网技术物联网技术是智能家居构建的基础,通过将各种智能设备连接到互联网上,实现设备之间的信息传输和共享。

人工智能课内实验报告(8次)学院:自动化学院班级:智能1501 姓名:刘少鹏(34)学号: 06153034目录课内实验1:猴子摘香蕉问题的VC编程实现 (1)课内实验2:编程实现简单动物识别系统的知识表示 (5)课内实验3:盲目搜索求解8数码问题 (18)课内实验4:回溯算法求解四皇后问题 (33)课内实验5:编程实现一字棋游戏 (37)课内实验6:字句集消解实验 (46)课内实验7:简单动物识别系统的产生式推理 (66)课内实验8:编程实现D-S证据推理算法 (78)人工智能课内实验报告实验1:猴子摘香蕉问题的VC编程实现学院:自动化学院班级:智能1501姓名:刘少鹏(33)学号: 06153034日期: 2017-3-8 10:15-12:00实验1:猴子摘香蕉问题的VC编程实现一、实验目的(1)熟悉谓词逻辑表示法;(2)掌握人工智能谓词逻辑中的经典例子——猴子摘香蕉问题的编程实现。

二、编程环境VC语言三、问题描述房子里有一只猴子(即机器人),位于a处。

在c处上方的天花板上有一串香蕉,猴子想吃,但摘不到。

房间的b处还有一个箱子,如果猴子站到箱子上,就可以摸着天花板。

如图1所示,对于上述问题,可以通过谓词逻辑表示法来描述知识。

要求通过VC语言编程实现猴子摘香蕉问题的求解过程。

图1 猴子摘香蕉问题四、源代码#include<stdio.h>unsigned int i;void Monkey_Go_Box(unsigned char x, unsigned char y){printf("Step %d:monkey从%c走到%c\n", ++i, x, y);//x表示猴子的位置,y为箱子的位置}void Monkey_Move_Box(char x, char y){printf("Step %d:monkey把箱子从%c运到%c\n", ++i, x, y);//x表示箱子的位置,y为香蕉的位置}void Monkey_On_Box(){printf("Step %d:monkey爬上箱子\n", ++i);}void Monkey_Get_Banana(){printf("Step %d:monkey摘到香蕉\n", ++i);}void main(){unsigned char Monkey, Box, Banana;printf("********智能1501班**********\n");printf("********06153034************\n");printf("********刘少鹏**************\n");printf("请用a b c来表示猴子箱子香蕉的位置\n");printf("Monkey\tbox\tbanana\n");scanf("%c", &Monkey);getchar();printf("\t");scanf("%c", &Box);getchar();printf("\t\t");scanf("%c", &Banana);getchar();printf("\n操作步骤如下\n");if (Monkey != Box){Monkey_Go_Box(Monkey, Box);}if (Box != Banana){Monkey_Move_Box(Box, Banana);}Monkey_On_Box();Monkey_Get_Banana();printf("\n");getchar();}五、实验结果相关截图六、心得体会通过本次实验,我初步了学会了使用VC的新建工程,并且进行简单的程序编写。

⼈⼯智能实验报告⼈⼯智能课程项⽬报告姓名:班级:⼆班⼀、实验背景在新的时代背景下,⼈⼯智能这⼀重要的计算机学科分⽀,焕发出了他强⼤的⽣命⼒。

不仅仅为了完成课程设计,作为计算机专业的学⽣,了解他,学习他我认为都是很有必要的。

⼆、实验⽬的识别⼿写字体0~9三、实验原理⽤K-最近邻算法对数据进⾏分类。

逻辑回归算法(仅分类0和1)四、实验内容使⽤knn算法:1.创建⼀个1024列矩阵载⼊训练集每⼀⾏存⼀个训练集2.把测试集中的⼀个⽂件转化为⼀个1024列的矩阵。

3.使⽤knnClassify()进⾏测试4.依据k的值,得出结果使⽤逻辑回归:1.创建⼀个1024列矩阵载⼊训练集每⼀⾏存⼀个训练集2.把测试集中的⼀个⽂件转化为⼀个1024列的矩阵。

3.使⽤上式求参数。

步长0.07,迭代10次4.使⽤参数以及逻辑回归函数对测试数据处理,根据结果判断测试数据类型。

五、实验结果与分析5.1实验环境与⼯具Window7旗舰版+python2.7.10+numpy(库)+notepad++(编辑)Python这⼀语⾔的发展是⾮常迅速的,既然他⽀持在window下运⾏就不必去搞虚拟机。

5.2实验数据集与参数设置Knn算法:训练数据1934个,测试数据有946个。

数据包括数字0-9的⼿写体。

每个数字⼤约有200个样本。

每个样本保持在⼀个txt⽂件中。

⼿写体图像本⾝的⼤⼩是32x32的⼆值图,转换到txt⽂件保存后,内容也是32x32个数字,0或者1,如下图所⽰建⽴⼀个kNN.py脚本⽂件,⽂件⾥⾯包含三个函数,⼀个⽤来⽣成将每个样本的txt⽂件转换为对应的⼀个向量:img2vector(filename):,⼀个⽤来加载整个数据库loadDataSet():,最后就是实现测试。

5.3评估标准看测试数与测试结果是否相同。

相同输出结果正确,否则输出结果错误。

5.4实验结果与分析实验分析:KNN算法可以说是使⽤蛮⼒进⾏分类,每进⾏⼀个测试样本的判断,都要对所以的训练集操作⼀次,时间复杂度和空间复杂度都会随着训练集和测试集的数量⽽增加。

基于人工智能的智慧交通信号控制实验报告一、实验背景随着城市化进程的加速,交通拥堵问题日益严重,传统的交通信号控制方式已经难以满足现代交通的需求。

人工智能技术的快速发展为解决交通拥堵问题提供了新的思路和方法。

本实验旨在研究基于人工智能的智慧交通信号控制技术,以提高交通系统的效率和安全性。

二、实验目的本实验的主要目的是:1、探究人工智能在交通信号控制中的应用效果,与传统控制方法进行对比。

2、分析不同交通流量和路况下,基于人工智能的交通信号控制系统的适应性和优化能力。

3、评估基于人工智能的交通信号控制对减少交通拥堵、提高通行效率和降低交通事故发生率的作用。

三、实验设备与环境(一)实验设备1、交通流量监测设备:包括地磁传感器、视频摄像头等,用于实时采集交通流量数据。

2、交通信号控制设备:包括信号灯、控制器等,用于实现交通信号的控制和调整。

3、计算机服务器:用于运行人工智能算法和处理交通数据。

(二)实验环境选择了一条城市主干道作为实验路段,该路段交通流量较大,路况复杂,具有代表性。

在实验路段上安装了交通流量监测设备和交通信号控制设备,并将数据实时传输到计算机服务器进行处理。

四、实验方法(一)数据采集通过交通流量监测设备采集实验路段的交通流量、车速、车辆类型等数据,时间间隔为 1 分钟,采集时间为一个月。

(二)算法设计基于深度学习和强化学习算法,设计了一种智慧交通信号控制模型。

该模型能够根据实时采集的交通数据,自动优化交通信号的配时方案。

(三)实验分组将实验路段分为两组,一组采用传统的定时交通信号控制方法,另一组采用基于人工智能的交通信号控制方法。

(四)性能评估指标选择平均延误时间、平均停车次数、通行能力和交通事故发生率作为性能评估指标,对两种交通信号控制方法的效果进行评估。

五、实验结果与分析(一)交通流量数据在实验期间,采集到了丰富的交通流量数据。

通过对数据的分析,发现实验路段的交通流量在不同时间段和不同日期存在较大的差异,呈现出明显的早晚高峰和周末与工作日的差异。

人工智能搜索实验报告人工智能搜索实验报告引言近年来,人工智能(Artificial Intelligence,简称AI)在各个领域都取得了巨大的进展。

其中,人工智能搜索技术的发展尤为引人注目。

本实验旨在通过对不同搜索引擎的比较和分析,探讨人工智能搜索的发展趋势和应用前景。

一、搜索引擎的发展历程搜索引擎作为人们获取信息的主要工具之一,经历了多年的发展和演变。

最早的搜索引擎是基于关键词匹配的,用户通过输入关键词来获取相关的网页信息。

然而,这种搜索方式存在信息匹配不准确、结果排名不合理等问题。

随着人工智能的发展,搜索引擎逐渐引入了机器学习和自然语言处理等技术,使得搜索结果更加精准和个性化。

二、人工智能搜索的技术原理人工智能搜索的核心技术包括自然语言处理、机器学习和深度学习等。

自然语言处理技术可以将用户输入的自然语言转化为机器可以理解的形式,从而更好地理解用户的搜索意图。

机器学习技术通过对大量的数据进行学习和训练,提高搜索引擎的预测和推荐能力。

深度学习技术则更加注重对数据的特征提取和模式识别,进一步提升搜索引擎的准确性和效率。

三、不同搜索引擎的比较与分析1. 谷歌搜索作为全球最大的搜索引擎,谷歌搜索凭借其强大的人工智能技术和庞大的数据资源,能够提供准确、全面的搜索结果。

谷歌搜索不仅可以根据用户的搜索历史和地理位置等信息,推荐个性化的搜索结果,还能通过自然语言处理技术,理解用户的搜索意图,提供更加精准的答案。

2. 百度搜索作为中国最大的搜索引擎,百度搜索在人工智能搜索方面也取得了显著的进展。

百度搜索通过深度学习技术,对用户的搜索行为和偏好进行分析,提供个性化的搜索结果。

此外,百度搜索还引入了知识图谱和自然语言处理等技术,使搜索结果更加丰富和准确。

3. 必应搜索必应搜索是微软推出的搜索引擎,它与谷歌搜索和百度搜索相比,在搜索结果的准确性和个性化方面存在一定差距。

然而,必应搜索在美观度和用户体验方面表现出色,其界面设计简洁、易用,给用户带来良好的搜索体验。

AI人工智能实验报告引言:人工智能(Artificial Intelligence,简称AI)是一项使用计算机技术模拟和复制人的智能的研究与应用。

AI的发展已经引发了广泛的关注和应用,被认为具有革命性的影响。

本实验旨在探索AI在不同领域中的应用,以及其对社会和经济的潜在影响。

实验方法:1. 实验步骤:(详细描述实验步骤,例如训练AI模型,收集和处理数据等)2. 实验材料:(列出实验所用的软件、硬件设备,以及实验所需要的数据)3. 实验设计:(阐述实验的目的和假设,如何设计实验来验证假设,并选择合适的评估指标)实验结果:通过实验的进行我们得到了以下结果:1. 在医疗领域中,AI能够准确识别影像中的疾病和异常情况。

经过训练,AI模型可以对X光片、MRI扫描等进行自动诊断,且诊断结果的准确率超过了人类医生的水平。

2. 在交通领域,AI技术被广泛应用于自动驾驶汽车的开发。

通过搜集和分析大量的交通数据和驾驶行为,AI能够实现智能规划路线、减少交通事故并提高驾驶效率。

3. 在金融领域,AI能够分析海量的金融数据,并根据市场趋势进行智能投资决策。

通过机器学习和数据挖掘的方法,AI能够识别潜在的交易风险,并提供可靠的投资建议。

4. 在教育领域,AI技术被应用于个性化教学和智能辅导。

AI能够根据学生的学习进度和学习习惯,提供个性化的学习建议和辅导,提高学生的学习效果。

实验讨论:根据实验结果的分析和讨论,我们可以得出以下结论:1. AI在医疗领域的应用能够提高诊断的准确性和效率,对于改善医疗服务质量具有重要意义。

2. 自动驾驶技术的发展可能会改变未来的交通方式,并促进交通安全和节能减排。

3. 金融领域的AI应用不仅能提高投资决策的准确性,还能优化交易流程,提高金融市场的运行效率。

4. 教育领域的AI应用有助于满足不同学生的学习需求,促进个性化教育的发展。

结论:AI人工智能在医疗、交通、金融和教育等领域的应用给社会带来了巨大的改变和机遇。

研究生(人工智能)报告题目:人工智能实验报告学号姓名专业电磁场与微波技术指导教师院(系、所)华中科技大学研究生院制1问题二利用一阶谓词逻辑求解猴子摘香蕉问题:房内有一个猴子,一个箱子,天花板上挂了一串香蕉,其位置如图所示,猴子为了拿到香蕉,它必须把箱子搬到香蕉下面,然后再爬到箱子上。

请定义必要的谓词,列出问题的初始化状态(即下图所示状态),目标状态(猴子拿到了香蕉,站在箱子上,箱子位于位置b)。

图1 猴子香蕉问题解:⏹定义描述环境状态的谓词。

AT(x,w):x在t处,个体域:xϵ{monkey},wϵ{a,b,c,box};HOLD(x,t):x手中拿着t,个体域:tϵ{box,banana};EMPTY(x):x手中是空的;ON(t,y):t在y处,个体域:yϵ{b,c,ceiling};CLEAR(y):y上是空的;BOX(u):u是箱子,个体域:uϵ{box};BANANA(v):v是香蕉,个体域:vϵ{banana};⏹使用谓词、连结词、量词来表示环境状态。

问题的初始状态可表示为:S o:A T(monkey,a)˄EMPTY(monkey)˄ON(box,c)˄ON(banana,ceiling)˄CLEAR(b)˄BOX(box)˄BANANA(banana)要达到的目标状态为:S g:AT(monkey,box)˄HOLD(monkey,banana)˄ON(box,b)˄CLEAR(ceiling)˄CLEAR(c)˄BOX(box)˄BANANA(banana)⏹从初始状态到目标状态的转化, 猴子需要完成一系列操作, 定义操作类谓词表示其动作。

WALK(m,n):猴子从m走到n处,个体域:m,nϵ{a,b,c};CARRY(s,r):猴子在r处拿到s,个体域:rϵ{c,ceiling},sϵ{box,banana};CLIMB(u,b):猴子在b处爬上u;这3个操作也可分别用条件和动作来表示。

. . 计算机科学与技术 1341901301 陈敏

实验一:知识表示方法 一、实验目的 状态空间表示法是人工智能领域最基本的知识表示方法之一,也是进一步学习状态空间搜索策略的基础,本实验通过牧师与野人渡河的问题,强化学生对知识表示的了解和应用,为人工智能后续环节的课程奠定基础。 二、问题描述 有n个牧师和n个野人准备渡河,但只有一条能容纳c个人的小船,为了防止野人侵犯牧师,要求无论在何处,牧师的人数不得少于野人的人数(除非牧师人数为0),且假定野人与牧师都会划船,试设计一个算法,确定他们能否渡过河去,若能,则给出小船来回次数最少的最佳方案。 三、基本要求 输入:牧师人数(即野人人数):n;小船一次最多载人量:c。 输出:若问题无解,则显示Failed,否则,显示Successed输出一组最佳方案。用三元组(X1, X2, X3)表示渡河过程中的状态。并用箭头连接相邻状态以表示迁移过程:初始状态->中间状态->目标状态。 例:当输入n=2,c=2时,输出:221->110->211->010->021->000 其中:X1表示起始岸上的牧师人数;X2表示起始岸上的野人人数;X3表示小船现在位置(1表示起始岸,0表示目的岸)。 要求:写出算法的设计思想和源程序,并以图形用户界面实现人机交互,进行输入和输出结果,如: Please input n: 2 Please input c: 2 Successed or Failed?: Successed Optimal Procedure: 221->110->211->010->021->000 四、算法描述 (1)算法基本思想的文字描述; . . 从初始状态S(n,n,1)出发,形成的有合法且未达状态S11、S12、……、Sli。再分别从S11、S12、……、Sli出发形成所有合法而未达状态S111、S112、…… 、Sli1、Sli2、Sli ……最终达到目标(0,0,0)(有解),或者找不到合法而未达状态(无解)。若有解,则从目标返回找前趋状态,前趋状态的前趋状态……直到初始状态。 (2)判别(X1,X2,X3)为合法状态条件:X1=0或X1=n或X1=X2。 (3)数据结构: 1 栈STACK,记下“已达”状态及踪迹,并兼作队列。 2 STATE[X1][X2]= (4)算法基本思想的具体实现: 1 初始化:置STATE[N+1][N+1][2]中的有状态为“未达” 置队列STACK空,cond为当前是否已达到目标: cond= cond置初值 2 以S(n,n,1)为始点,置STATE为“已达”。S入队列STACK 3 while(队列STACK空且未达到目标时) A{ 取出队头元素地址=>p1,队头元素出队列 B while(未达到目标,且P1有可达、合法、且未到达过的相邻顶点Q) if (Q=(000) 则{cond=1,Q入队列} 否则 {置QW为“已达”,Q入队列} /* B可用函数COMBINE实现 */ 4 if (cond=1)则按队列中前趋指针指示的次序依次输出序列,否则输出“渡河失败”。 5 COMBINE函数的功能等价于从数量不等的物品,分别选出1件、2件、……C件物品的所有组合,同时对每一种组合确定其合法性。 COMBINE( ) { 1 栈SP初始化(SP存放已放入物品序号),NUM为已取出物品个数,NUM=0,i为准备取出物品序号,i<=1。 2 do { while (未达到目标,且所有物品还未取尽,且NUM{若该种物品已取尽,则取下一种,i++; 取出第i种物品中一件来,该物来序号(即i)进栈,NUM++; 判断该状态合法否?! /* 用函数dicision实现 */

0 已达 1 未达

0 未达目标 1 已达到目标 .

. } if (未达到目标,且栈SP不空) {则读栈SP=>i,将第种物品放回一件:NUM--:退栈;i++;} }while(未达到目标,且并非所有情况均已列举完) } dicision ( ) { if (当前状态(x1,x2,x3)合法且未达) 则(x1,x2,x3)及前趋指针入队列STACK; if ((x1,x2,x3)==0,0,0)) 则 cond=1; } 五、源程序 #include

typedef struct node { int np; /* The normal people's number at start shore. */ int mp; /* The mad people's number at start shore. */ int shore; /* '0'=end shore,'1'=start shore */ int track; /* The track of the point */ }NODE;

NODE stack[80]; /* The massage from stack[1]*/ int state[80][80][2],n,c,front,back,cond;

void dicision(int t[]) { int a[4],i; for(i=0;i<4;i++) a[i]=t[i]; if(a[2]==1) { a[0]=n-a[0]; a[1]=n-a[1]; }

if((a[0]==0||a[0]==n||a[0]==a[1]) && state[a[0]][a[1]][a[2]]==1) { back++; stack[back].np=a[0]; stack[back].mp=a[1]; stack[back].shore=a[2]; . . stack[back].track=front; }

state[a[0]][a[1]][a[2]]=0; if(a[0]==0 && a[1]==0 && a[2]==0) cond=1; }

void combine(int t[]) { int sp[80];/* The stack */ int top; /* The stack sp's top*/ int all; /* The people's number at start shore */ int num; /* The things number which allready get */ int i; top=i=num=0; t[2]=!t[2]; all=t[0]+t[1]; do { while(cond!=1 && num0 && i<2) { if(t[i]==0) { if(i<1) i++; else return; } t[i]--; sp[top++]=i; num++; all--; dicision(t); } if(cond!=1 && top>0) { i=sp[--top]; t[i]++; all++; num--; i++; } }while(cond!=1&&( top>0 || (i<2&&all>0) ) ); }

void put(NODE stack[]) { int i,j,m,b[80]; printf("\nStack Np Mp Shore Last point\n"); for(i=1;i<=back;i++)

printf("<%2d >%5d%5d%7d%10d\n",i,stack[i].np,stack[i].mp,stack[i].shore,stack[i

.

.

].track);

if(cond==1)

{

i=back;m=0;

while(i!=0)

{

b[m++]=i; i=stack[i].track;

}

printf("The cross way is: ");

for(j=m-1;j>=0;j--)

{

printf("(%d,",stack[b[j]].np);

printf("%d,",stack[b[j]].mp);

printf("%d",stack[b[j]].shore);

if(j!=0)

printf(")->");

}

printf(")\n");

printf("The stack is: %d->",back);

for(j=0;j

printf("%d",stack[b[j]].track); if(j!=m-2) printf("->");

}

printf("\nSeccess!");

}

else printf("Failure!");

printf("\n");

}

void main()

{

int i,j,s,t[4];

printf("please input the number of people (n): "); scanf("%d",&n);

printf("please input the capacity of boat (c): "); scanf("%d",&c);

for(i=0;i<80;i++)

for(j=0;j<80;j++)

for(s=0;s<2;s++)

state[i][j][s]=1;

front=back=0;

cond=0;

state[n][n][1]=0;