网络音频基础

- 格式:pptx

- 大小:5.92 MB

- 文档页数:47

网络音视频基础知识考核题1.以下哪一项不是视频文件封装格式?Ca)AVIb)MP4c)AVCd)MPEG-TS2.以下哪一项不是音视频编码格式?Ba)Window Media Video Codec 9b)MPEG-PSc)HE-AACd)MPEG-23.以下哪一项为Flash Media Encoder录制文件格式?Da)MP4b)M4Vc)MOVd)F4V4.Adobe Flash Player不支持以下哪种音视频格式?Da)MP4:AVC+AACb)3GP:AVC+AMR-NBc)FLV:H263+MP3d)MOV: AVC+AAC5.Apple手持终端(iphone,ipod,ipad)本地播放器支持以下哪种视频编码?Ba)H.264+MP3b)H.264+AACc)OnVP6+MP3d)H.263+AAC6.以下哪一项不属于H.264视频编码标准框架(Profile)?Da)Baseline Profileb)Main Profilec)High Profiled)MEI Profile7.视频关键帧又称?Aa)I Frameb) B Framec)P Framed) A Frame8.如果设置视频编码帧速率为29.97fps,需要每秒2个关键帧,则每隔多少帧需设置一个关键帧?Aa)10b)15c)20d)309.以下哪套编码设置是Flash Media Encoder不支持的?Da)H.264+MP3,350K+32K,15fps,22050,320x240b)H.264+MP3,350K+32K,15fps,22050,320x240H.264+MP3,500K+64K,25fps,44100,480x320c)H.264+MP3,500K+64K,25fps,44100,480x320H.264+MP3,800K+64K,25fps,44100,640x480d)ONVP6+MP3,300K+32K,12fps,22050,480x320ONVP6+MP3,400K+32K,12fps,22050,320x240ONVP6+MP3,500K+32K,12fps,22050,240x18010.以下哪套编码设置是Wirecast不支持的?Da)H.264+AAC,350K+32K,15fps,22050,320x240b)H.264+AAC,350K+32K,15fps,22050,320x240H.263+MP3,500K+64K,25fps,44100,480x320c)H.264+AAC,500K+64K,25fps,44100,480x320H.264+AAC,800K+128K,15fps,22050,640x480d)H.264+AAC,300K+32K,12fps,22050,480x320H.264+AAC,500K+64K,15fps,44100,640x480WMV9+WMA9,500K+48K,25fps,29.97,320x24011.如果设置音视频编码码率为500kb+64kb,则录制一小时后文件预估大小为?Ca)150 MBb)200 MBc)250 MBd)300 MB12.Wowza Media Server不支持以下哪种播出协议?Da)RTMPb)RTSPc)HTTPd)TCP13.Wowza Media Server不支持以下哪种播放终端?Ca)Adobe Flash Player 9以上b)iOS Player 3.0以上c)Windows Media Player 11以上d)Sliverlight 3以上14.渐进式下载播放与流媒体播放都各自有什么特点?列举出至少三点。

音频,英文是AUDIO,也许你会在录像机或VCD的背板上看到过AUDIO输出或输入口。

这样我们可以很通俗地解释音频,只要是我们听得见的声音,就可以作为音频信号进行传输。

有关音频的物理属性由于过于专业,请大家参考其他资料。

自然界中的声音非常复杂,波形极其复杂,通常我们采用的是脉冲代码调制编码,即PCM编码。

PCM通过采样、量化、编码三个步骤将连续变化的模拟信号转换为数字编码。

一、音频基本概念1、什么是采样率和采样大小(位/bit)。

声音其实是一种能量波,因此也有频率和振幅的特征,频率对应于时间轴线,振幅对应于电平轴线。

波是无限光滑的,弦线可以看成由无数点组成,由于存储空间是相对有限的,数字编码过程中,必须对弦线的点进行采样。

采样的过程就是抽取某点的频率值,很显然,在一秒中内抽取的点越多,获取得频率信息更丰富,为了复原波形,一次振动中,必须有2个点的采样,人耳能够感觉到的最高频率为20kHz,因此要满足人耳的听觉要求,则需要至少每秒进行40k次采样,用40kHz表达,这个40kHz就是采样率。

我们常见的CD,采样率为。

光有频率信息是不够的,我们还必须获得该频率的能量值并量化,用于表示信号强度。

量化电平数为2的整数次幂,我们常见的CD位16bit的采样大小,即2的16次方。

采样大小相对采样率更难理解,因为要显得抽象点,举个简单例子:假设对一个波进行8次采样,采样点分别对应的能量值分别为A1-A8,但我们只使用2bit的采样大小,结果我们只能保留A1-A8中4个点的值而舍弃另外4个。

如果我们进行3bit的采样大小,则刚好记录下8个点的所有信息。

采样率和采样大小的值越大,记录的波形更接近原始信号。

2、有损和无损根据采样率和采样大小可以得知,相对自然界的信号,音频编码最多只能做到无限接近,至少目前的技术只能这样了,相对自然界的信号,任何数字音频编码方案都是有损的,因为无法完全还原。

在计算机应用中,能够达到最高保真水平的就是PCM编码,被广泛用于素材保存及音乐欣赏,CD、DVD以及我们常见的WAV文件中均有应用。

数字音频网络IP化的原理及应用1. 引言在数字化时代,音频领域也迎来了数字化的浪潮。

数字音频网络IP化成为了音频行业的重要趋势。

本文将介绍数字音频网络IP化的原理和应用,并深入探讨其优势和挑战。

2. 数字音频网络IP化的原理数字音频网络IP化是指将音频信号通过网络传输,并利用IP协议进行管理和控制的过程。

它基于数字音频技术和计算机网络技术,实现了音频信号的数字化和网络化。

2.1 数字音频技术数字音频技术将模拟音频信号转换为数字数据。

通过采样、量化和编码等过程,将连续的模拟音频信号转换为数字音频数据。

这种数字音频数据可以更加稳定地在网络中传输,并且可以方便地进行处理和存储。

2.2 计算机网络技术计算机网络技术提供了音频信号在网络中传输的基础。

通过建立网络连接和使用网络协议,可以将数字音频数据传输到目标设备。

IP协议是网络传输中常用的协议之一,它提供了数据的分组传输和路由选择功能,非常适合用于音频信号的传输。

2.3 数字音频网络IP化的原理数字音频网络IP化的原理包括两个方面:音频数据的数字化和网络传输的管理和控制。

2.3.1 音频数据的数字化音频数据的数字化是将模拟音频信号转换为数字音频数据的过程。

这一过程包括三个主要步骤:采样、量化和编码。

•采样:采样是指对模拟音频信号进行离散化处理,将连续的模拟信号转换为离散的数字信号。

采样率决定了采样点的数量,常用的采样率有44.1kHz、48kHz等。

•量化:量化是指将采样后的离散信号映射到有限的离散值上。

通过量化,可以将模拟音频信号的连续取值转换为离散的数字取值。

常用的量化位数有16位、24位等。

•编码:编码是将量化后的数字信号表示为二进制数据的过程。

常用的音频编码算法有PCM、MP3等。

2.3.2 网络传输的管理和控制网络传输的管理和控制是使用网络协议将数字音频数据传输到目标设备的过程。

IP协议可以提供数据分组的传输和路由选择功能,将音频数据从发送端传输到接收端。

本文详细介绍了组建AES67音频网络的几个基础及其需要注意的地方,对PTP 同步和组播数据的分发进行了深入分析,同时提出了构建该类AoIP 网络时需要注意的地方。

AES67 AoIP PTP 组播一 关键概念介绍AES67旨在采用COTS 通用交换机为基础架构,构建通用的音频数据交换网络。

假如网络配置正确,音频数据流和其他数据流可以共享在一个网络中,同时不会影响用户的整体使用体验。

AES67音频网络主要依靠以下四个基础来建立: z 同步; z 组播数据包传输; z 服务质量; z 会话信息。

1. 同步AES67网络实现同步的关键是在该网络的所有节点中传输精度足够高的参考时间(wall clock time ,指以PTP 纪元时间1970年1月1日零时为时基计算的参考时间数值),同时AES67标准规定了使用IEEE 1588-2008标准(亦称作PTP v2)传输同步时间。

这里要注意的是,PTP v2与PTP v1(IEEE 1588-2002)并不兼容。

PTP v2中包含最佳主时钟算法,它确保了最优时钟被选为网络中所有节点的主时钟。

当某节点与由主时钟衍生的参考时间同步后,任何地方所需的媒体时钟都可以由此节点生成。

如果网络同步的精度足够高,所有本地生成的媒体时钟将具有相同的采样频率,甚至它们还可以准确地相互锁定。

使用PTP 同步可以达到亚微秒级别范围内的精度(指的是本地时钟对于主时钟来说的偏差值),然而在大多数情况下这需要部署PTP 感知交换机来实现。

所幸的是,大多2. 组播数据包传输PTP 同步是基于组播数据包传输的,AES67标准要求组播流支持音频数据的传输。

一般通用交换机都支持组播流传输,但只有管理型交换机(Managed Switches )可以提供组播管理并有效避免网络风暴。

非管理型交换机(或配置不当的管理型交换机)会将组播流当成广播流进行处理,将所有输入的组播数据包转发到交换机的所有端口。

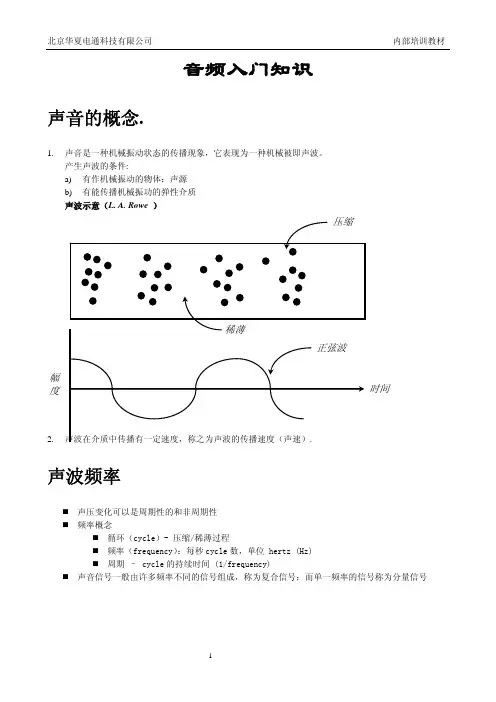

音频入门知识声音的概念.1. 声音是一种机械振动状态的传播现象,它表现为一种机械被即声波。

产生声波的条件:a) 有作机械振动的物体:声源 b) 有能传播机械振功的弹性介质 声波示意(L. A. Rowe )2.声波频率声压变化可以是周期性的和非周期性 频率概念循环(cycle)- 压缩/稀薄过程 频率(frequency):每秒cycle 数,单位 hertz (Hz) 周期 – cycle 的持续时间 (1/frequency)声音信号一般由许多频率不同的信号组成,称为复合信号;而单一频率的信号称为分量信号时间幅度频率范围频率小于20Hz 一般称为次声波(subsonic)人的听觉器官能感知的声音频率范围约为20Hz~20kHz的信号称为音频(Audio)信号人发音器官发声频率约是80~3400Hz,但人说话的信号频率约为300~3000Hz,即话音(speech)信号高于20kHz的信号称为超声波 (ultrasonic)超声波及次声波一般不能引起人听觉器官的感觉,但可借助一些仪器设备进行观察和测量乐音与噪音1.一般乐音指具有确定的基频以及与该基频有较小整数倍关系的各阶谐频(harmonic tone)2.频率比基音高的所有分音统称泛音(over tone),泛音的频率不必与基音成整数倍关系3.在主观上把令人不愉快或不需要的声音定义为噪音4.噪音的频谱较为复杂,具有无规则的振幅和波形的连续频谱声音三要素1.响度(音响)loudness到达人耳的声扰动振幅所产生的听觉的大小声振动能量是物理特性,可用声强(sound pressure)定义,单位:帕斯卡 (Pa)实用上通常都以对数方式的声压级 (sound pressure level)表示,单位:分贝(db)响度是主观量,不能用任何仪器正确地测量声音响度使用了以两个声强之比的对数为基础的相对标度,单位:宋(sone)2.音调(音高)pitch或tone人对声音刺激频率的主观判断与估量,称之为音调 (Pitch),单位:美(Mel)Frequency是物理量,而音调是人的感觉听觉经验一般女生的声音比男生高较大物体振动的音调较低3.音色(音质)timber由其频谱决定: 不同乐器发出同一音高的乐音,仍然可以分辨可以把音色描述为音的瞬时横截面,即用谐音(泛音)的数目、强度、分布和相位来描述。

AOIP网络音频技术在广播电台的应用摘要在传统的音频传输技术中,主要是将数字电缆以及光纤等进行点对点的连接,然而随着计算机技术的不断发展,网络技术的音频信号传输也更加的成熟。

这种传输技术极大的改变了媒体行业以及广播机构的音频传输基础架构,促进了相关行业的进一步发展。

本文主要围绕AOIP网络音频技术,就其在广播电台中的应用进行探究。

关键词AOIP;网络音频技术;广播电台前言为了迎合市场的需求,基于IP的网络音频传输技术取得了较大的发展,该技术是基于OSI的三层协议设计,故此能够进行跨网传输,甚至可以在WAN中传输,这种技术也被人们称为AOIP技术。

下文就该技术在广播电台中的应用进行分析。

1 AOIP技术的相关概述在阐述AOIP技术之前,就需要说到OSI网络模型。

从底层向上,OSI参考模型分为七层[1],主要为:①物理层、②数据链路层、③网络层、④传输层、⑤会话层、⑥表示层、⑦应用层。

物理层就是为硬件的物理链路提供电子特性,数据链路层就是逻辑连接,对网络的类型进行定义。

如,数据链路层定义这是一个异步传输模式网还是一个以太网。

数据链路分为以下两个子层:①逻辑链路控制层;②媒体访问控制层。

至于网络层,主要进行网络的路由操作,将数据打包或者分包,并且提供路由信息。

在这一层,其公共协议主要是Internet协议。

传输层主要提供了决定传送方式的协议。

AOIP网络音频技术就是在这四层基础上的应用,该音频技术具备跨网段传输的能力,甚至能够在广域网上进行传输。

AOIP就是以开放的标准技术为基础,充分利用现有的网络架构,或者是利用网络基础设施,从而达到音频数据的网络传输这一最终目的。

2 AOIP网络音频技术的应用2.1 远程的音频传输随着网络技术的不断发展,增强了市场的激烈竞争,这就使得网络设备的成本不断下降。

与传统的音频线缆的布线结构相比,采用AOIP网络音频技术节约了大量的线材,节省了施工工作量。

该技术应用了开放标准的网络技术,是以现有的网络架构为基础,在其中进行开发设计。

网络广播音频技术探讨周坚武戴胜侠颜伟国(温州市广播电视总台,浙江温州325000)4。

?ft l ‘睛要】音频广播自从1920年问世以来,历经了A M(调幅)、F M●调频),已经时^们的日常生活和人类社会的发展进步带来了深远的?,影响。

但是随着科学技术的发碾和生产力的提升,人们对生活品质的要求日益增高,作为主要信息媒体之一的声音广播就必然要适应这样的j殳蔽、瞵撼词]网络广播;音频技术;建议,71网络广播音频技术发展1.1音频广插韵发展音频广播自从1920年问世以来,历经了A M(调幅)、FM(调频),已经对人们的日常生活和人类社会的发展进步带来了深远的影响。

但是随着科学技术的发展和生产力的提升,人们对生活品质的要求日益增高,作为主要信息媒体之一的声音广播就必然要适应这样的发展。

然而传统的模拟调幅和调频广播制式存在着诸如:功耗大,信号差等缺点,己经越来越不适应^们对视听媒体日益增长的要求。

随着数字化技术的广泛应用,以数字处理为特征的数字音频广播逐渐发展成熟,随着半导体制造技术,多媒体技术的迅速发展数字广播技术正在越来越成为现在和以后研究的重点。

12网络广播优点实践证明,在互联网上,广播可以扬长避短,在竞争中利用网络优势增强实力。

主要表现在:1)全球覆盖优势。

广播一旦进入互联网,就是面对全球网络用户。

对传统广播而言,任何一家电台都无法做到全球覆盖,惟有网络具有这一优势。

2)自由选择优势。

受众可以按照自己的意愿选择节目,不受传统广播播出时间的限制。

3)信息资料优势.o 网络广播可以利用网络庞大的存储空间和强大的传输能力,大大扩展广播的信息容量,为受众提供—个丰富的信息资料库。

4J同步交流优势。

网络为受众提供广阔的发表意见的空间(电子邮件、电子论坛、聊天室等),最大限度地满足了受众参与节目的需求,改变了以往听众只有通迎熟线电话与电台联系的方式。

2网络音频编码原理数字音频编码的原理有波形编码和感知编码两大类。

网络音频技术的发展趋势和应用场景随着互联网的普及,网络音频技术的应用越来越广泛。

它不仅可以通过网络传输音频信号,而且可以实现音频的编解码、处理、存储等功能。

尤其是在近年来,随着音频内容的迅速增长,网络音频技术得到了极大的发展,并且在各个领域中得到了广泛应用。

那么,网络音频技术的发展趋势和应用场景是怎样的呢?下面我们从三个方面来论述。

一、网络音频编解码技术的发展趋势网络音频编解码(Codec)技术是当今网络音频技术中最核心的技术之一,其主要作用是将音频的模拟信号转换成数字信号,又将数字信号转换为模拟信号,以达到在网络上传输和存储音频的目的。

如今,网络音频编解码技术发展呈现以下趋势:1. 高效性网络音频技术要求编解码器在保留高质量音频的同时,必须保持高效。

因此,随着技术进步的发展,越来越多的音频编解码器开始更好地结合了质量和效率。

2. 实时性随着网络带宽的逐渐提高、延迟的逐渐降低,网络音频技术应用的领域不断扩大,对实时性的要求也越来越高。

声音在网络中的传输需要确保声音的信息不会因为延迟而丢失。

3. 跨平台网络音频技术面对的是各种不同的设备和平台,不同厂家之间的原始格式虽然有些差异,但是网络音频技术要满足不同设备和平台之间的互通性。

二、网络音频技术的应用场景网络音频技术的应用场景非常广泛,它已经成功地应用于音乐、广播、新媒体、在线教育、电商、智能汽车等领域。

下面列举了其中的几个应用场景:1. 在线音乐随着音乐产业的不断发展,越来越多的用户倾向于使用在线音乐服务,例如Spotify、Apple Music等。

利用网络音频技术,用户可以简便地从在线音乐服务中下载或流式播放高质量的音乐。

2. 在线广播在线广播也是网络音频技术的一个重要应用场景,其需要的声音传输和编解码技术相对比较简单,但是广播的内容涵盖面非常广泛,因此要求在传输和编解码中要有高效性和准确性。

3. 在线教育在线教育早已融入人们的学习生活。

网络音频技术的发展让媒体教学变得更加多样化和丰富,可以在课上直播和录播,每个人都可以在各自的时间和地点学习。

网络音视频与流媒体技术随着互联网的普及和带宽的提升,越来越多的人开始使用网络媒体来获取信息和娱乐。

网络音视频和流媒体技术是现代网络媒体的核心。

本文将介绍这两种技术的基本原理、应用和发展趋势。

一、网络音视频技术网络音视频是指通过网络传输音频和视频信号的技术。

它可以使人们随时随地获取娱乐、新闻、教育和其他内容。

网络音视频技术包括编解码、传输协议、网络设计等技术。

最常用的网络音视频传输协议是HTTP和RTSP。

HTTP传输协议被广泛应用于网页视频(例如YouTube和Facebook)。

当用户向服务器请求视频时,服务器将流式传输视频文件,以供播放器使用。

但HTTP协议的缺点是,它是一种非实时的传输方式,不能满足即时性要求。

RTSP传输协议是一种实时传输协议,常用于视频会议和流媒体。

RTSP将音视频文件分成多个数据包,每个数据包都有一个时间戳。

接收端接收数据包后,根据时间戳在正确的时间播放音视频。

这种传输方式可以满足实时性要求,但是需要更高的带宽和更低的延迟。

网络音视频技术的应用非常广泛。

它可以用于在线教育、网络直播、视频会议、在线游戏等领域。

在视频领域,网络音视频技术促进了互联网视频的兴起,也推动了高清视频的传播和普及。

二、流媒体技术流媒体技术是一种将音视频数据分解为流式传输的技术。

流媒体技术可以提高音视频数据的传输效率和质量。

它将音视频数据压缩并分成很多小的数据包,然后通过网络传输。

在接收端,这些数据包被组合在一起形成音视频数据流,并即时播放。

流媒体技术的优点在于,它能够通过网络播放高质量的音视频,即在下载的同时播放。

这意味着用户无需等待文件完全下载就可以开始观看或聆听音视频。

流媒体技术可以通过HTTP传输协议和RTSP传输协议来实现。

在流媒体技术中,最重要的是编解码技术。

编解码技术可以将音视频数据进行压缩和解压缩,以减小数据量并提高传输效率。

常用的编解码技术包括MPEG、H.264、AAC等。

流媒体技术的应用包括在线音乐和视频、网络电视、广播、视频监控等领域。

局域网组建中的网络音频传输设置一、引言随着技术的不断进步和应用的广泛推广,局域网组建成为了许多企业和机构所必备的基础设施之一。

局域网不仅可以提高内部信息互通的效率,还能够支持一系列的多媒体应用。

其中,网络音频传输作为局域网应用的重要组成部分,其设置对于保障音频传输的质量和稳定性具有关键作用。

本文将围绕局域网组建中的网络音频传输设置展开论述。

二、网络音频传输的基本原理在局域网环境中,音频传输主要通过IP网络实现,即将音频信号转化为网络数据包并通过局域网进行传输。

网络音频传输涉及到音频编解码、数据压缩和网络传输等多个环节。

在设置过程中,需要考虑以下几个方面:1. 音频编解码器的选择:选择适合局域网环境的音频编解码器,支持高质量音频传输和较低的带宽占用。

2. 数据压缩算法的优化:采用合适的音频数据压缩算法,可以减小网络带宽消耗,提高音频传输的效率。

3. 网络传输协议的选择:选择稳定可靠的网络传输协议,如TCP/IP 协议,以保证音频数据的可靠传输。

三、网络音频传输设置的关键要点在局域网组建中进行网络音频传输设置时,需要注意以下几个关键要点:1. 确定音频传输的优先级:鉴于局域网中可能存在多种数据传输需求,需要设置网络音频传输的优先级,保证其具有较高的传输带宽和优先级,避免出现卡顿或延迟等问题。

2. 配置网络设备的QoS功能:通过配置交换机或路由器的QoS (Quality of Service)功能,可以为音频数据设定相应的服务质量参数,确保音频传输的实时性和稳定性。

3. 确保网络带宽充足:音频传输对网络带宽的要求相对较低,但仍需确保网络的整体带宽能够满足音频传输的需求,避免带宽拥堵导致的音频质量下降。

4. 防火墙和安全设置:针对局域网中的网络音频传输,需要合理配置防火墙和安全策略,确保音频数据的安全性和传输稳定性。

5. 网络设备的优化设置:对于关键的网络设备,如交换机和路由器,需要进行优化设置,包括最佳的帧大小、网络缓冲区大小等,以提高音频传输的效率和稳定性。

网络音视频通讯技术的原理与应用随着信息技术的迅猛发展,网络音视频通讯技术已经成为人们日常生活中不可或缺的一部分。

网络音视频通讯技术的应用范围也越来越广泛,无论是日常的视频聊天、视频会议,还是远程教育、远程医疗等都离不开它。

那么网络音视频通讯技术到底是如何实现的呢?本文将从技术原理和应用两个方面来介绍网络音视频通讯技术。

一、技术原理网络音视频通讯技术的核心是通过网络传输音视频数据,让双方能够实时收听和观看对方的声音和画面。

在此过程中,需要实现音视频数据的采集、编码、传输和解码四个关键步骤。

1.音视频数据采集音视频数据采集是通过摄像头、麦克风等硬件设备收集用户的声音和画面。

将收集到的音视频数据进行处理,以便于后续的编码和传输。

2.音视频数据编码音视频数据编码是将采集到的音视频数据进行压缩处理,以减少数据传输时的带宽占用。

编码后的音视频数据在传输时能够更快、更稳定地传输,同时也能够减轻服务器对带宽的压力。

常见的音视频编码格式包括H.264、VP8、G.711、AAC等。

3.音视频数据传输音视频数据传输是指将编码后的音视频数据通过网络传输到对方。

在传输过程中需要实现数据的拆包、封包、传输控制等操作,以保证数据能够准确地传输到对方。

4.音视频数据解码音视频数据解码是接收方在接收到数据后进行的处理。

接收方需要将接收到的音视频数据进行解码处理,还原成原始数据,并通过播放器等硬件设备输出。

二、应用网络音视频通讯技术的应用范围非常广泛,随着互联网和智能手机的普及,越来越多的人选择使用网络音视频通讯来进行沟通交流。

1.远程教育远程教育是一种通过网络技术实现的教育方式,通过网络音视频通讯技术,教师和学生可以在不同的地方进行实时互动、教学和学习。

远程教育便于跨区域教学和跨界教学,拓展了教学的范围和方式。

2.视频会议视频会议是一种在线的会议形式,通过网络音视频技术来实现多方面的视频沟通。

它可以减少会议的成本和时间,避免不必要的出差和旅行。

互联网音频与在线音频平台随着互联网的快速发展,互联网音频正日益成为人们获取信息、娱乐消遣的重要方式之一。

同时,在线音频平台的崛起也为互联网音频的广泛传播提供了便利。

本文将探讨互联网音频的特点、在线音频平台的发展以及其对人们的影响。

一、互联网音频的特点互联网音频具有以下几个显著特点:1.便捷性:互联网音频可以随时随地通过网络进行播放和下载,用户可以在手机、电脑等设备上随意选择收听。

2.多样性:互联网音频内容涵盖广泛,包括音乐、有声读物、广播节目、专业知识讲座等各类类型,满足了不同用户的需求。

3.互动性:互联网音频平台常常提供评论、点赞等互动功能,用户可以与其他听众、主播进行交流和反馈。

4.个性化:用户可以根据自己的兴趣和喜好选择订阅感兴趣的频道或者制作自己的音频内容,从而打造个性化的音频体验。

二、在线音频平台的发展随着互联网音频的快速发展,许多在线音频平台逐渐崭露头角。

以下是几个知名的在线音频平台:1.喜马拉雅:喜马拉雅是中国领先的在线音频平台,提供了丰富的音频内容和个性化推荐服务,用户可以通过喜马拉雅平台听音乐、收听广播节目以及学习专业知识。

2.SoundCloud:SoundCloud是全球最大的音乐与音频流媒体平台之一,为音乐人、制作人和用户提供了一个互动的音乐社区,用户可以上传、分享和发现各类音乐作品。

3.蜻蜓FM:蜻蜓FM是中国知名的在线音频平台,提供了大量的有声读物、广播剧、商业新闻等内容,用户可以根据自己的兴趣进行订阅和收听。

4.Podcast:Podcast是一种通过订阅方式获取音频内容的传播方式,用户可以通过订阅自己感兴趣的节目来获取更新的音频内容。

三、互联网音频的影响互联网音频的快速发展对人们的生活产生了深远的影响。

首先,互联网音频丰富了人们的娱乐休闲方式。

用户可以随时随地通过在线音频平台收听音乐、有声读物等内容,极大地满足了人们对音乐和知识的追求。

其次,互联网音频促进了知识传播和学习。

在现代社会中,网络电视已经成为我们生活中不可或缺的一部分。

然而,对于许多人来说,网络电视的音质并不令人满意。

那么,如何调节网络电视的音频,以提升音质享受呢?首先,我们需要了解网络电视音频的基本知识。

网络电视的声音主要由两部分组成,即声音的频率和音量。

频率指声音的高低音调,音量则是声音的大小。

在音质方面的提升,我们主要从这两个方面入手。

其次,我们来谈谈如何提升网络电视音质的频率。

要想获得清晰而有力的音频,我们需要保持频率的平衡。

一方面,要确保低频音的充足,以增强声音的厚度和力度;另一方面,高频音的清晰度也是至关重要的。

为了达到这样的效果,我们可以尝试使用一些音效设备,如音箱或耳机。

这些设备可以增强低频的效果,并使高频的听感更清晰。

随着科技的发展,各种音效设备的种类也越来越多样化。

在选择音效设备时,我们应根据自己的实际需求和经济状况进行选择。

如果我们只是为了提升网络电视音质,那么简单的音箱就可以满足我们的需求。

但是,如果我们还想享受更加出色的音质,那么可以考虑购买高端的音响或耳机。

这些设备可能价格较高,但音质的提升将会是显著的。

除了选择适合的音效设备外,我们还可以通过调节网络电视的音量来提升音质。

音量的大小直接影响到听感的好坏。

如果音量过小,我们不仅听不清声音的细节,还会影响到整体的听感效果;而过大的音量则容易引起听力疲劳和邻里纷争。

因此,我们需要找到一个合适的音量来获得最佳听感。

调节音量时,我们可以参考一些经验法则。

一般来说,音量应该保持在合理的范围内,既不过小也不过大。

此外,也可以根据不同的节目内容来调节音量。

比如,对于电影或音乐类的内容,我们可以增加一些低频和高频的音量,以增强音效的震撼感;而对于新闻或讲座类的内容,我们可以适当降低音量,保持清晰度和舒适度。

最后,我们还可以通过使用一些音频调节软件来提升网络电视音质。

这些软件可以帮助我们调节声音的各个参数,如均衡器、混响等,以达到更好的音效效果。