第2章_离散信源及信息测度1

- 格式:pdf

- 大小:1.17 MB

- 文档页数:38

![信息论基础第2章离散信源及其信息度量[83页]](https://uimg.taocdn.com/a8bfc380a32d7375a5178051.webp)

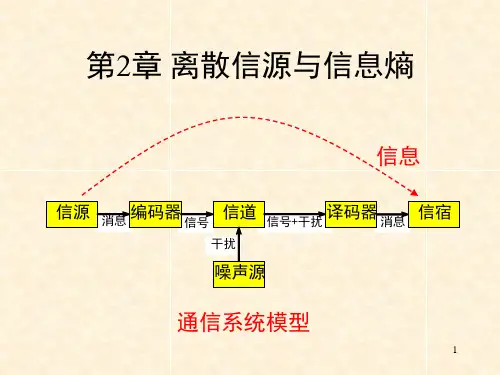

第2章离散信源与信息熵信号 信号+干扰 消息干扰消息 信源 编码器 信道 译码器 信宿 噪声源通信系统模型信息2.1 信源的分类和描述信源是信息的发源地,可以是人、生物、机器或其他事物。

信源的输出是包含信息的消息。

消息的形式可以是离散的或连续的。

信源输出为连续信号形式(如语音),可用连续随机变量描述。

连续信源←→模拟通信系统信源输出是离散的消息符号(如书信),可用离散随机变量描述。

离散信源←→数字通信系统离散信源…X i…X j…离散无记忆信源:输出符号Xi Xj之间相互无影响;离散有记忆信源:输出符号Xi Xj之间彼此依存。

3离散信源无记忆有记忆发出单个符号发出符号序列马尔可夫信源非马尔可夫信源y j将一粒棋子随意地放在棋盘中的某列;棋子放置的位置是一个随机事件;可看做一个发出单个符号的离散信源。

x i1212,,...,(),(),...,()m m x x x X P p x p x p x ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦就数学意义来讲,信源就是一个概率场,可用概率空间来描述信源。

由离散随机变量X 表示棋子位置:10()1,()1m i ii p x p x =≤≤=∑i x 其中,代表随机事件的某一结果。

2.2离散信源的信息熵信息的可度量性是信息论建立的基础;香农的信息论用事件发生概率的对数来描述事件的不确定性,得到消息的信息量,建立熵的概念。

2.2.1自信息量–定义2.1 任意随机事件x i 的自信息量定义为:i i i 1(x )log log (x )(x )I P P ==-小概率事件所包含的不确定性大,自信息量大。

大概率事件所包含的不确定性小,自信息量小。

概率为1的确定性事件,自信息量为零。

i i i 1(x )log log (x )(x )I P P ==-信息量的单位与公式中的对数取底有关。

以2为底,单位比特(bit );以e 为底,单位奈特(nat );()22log log ,log log ln log c a c b b x e x a==⋅–例:棋盘共8列,甲随手一放,将一枚棋子放在了第3列。