数据挖掘之经典算法

- 格式:pdf

- 大小:1.50 MB

- 文档页数:52

数据挖掘经典算法PrefixSpan的⼀个简单Python实现前⾔⽤python实现了⼀个没有库依赖的“纯” py-based PrefixSpan算法。

Github 仓库⾸先对韩⽼提出的这个数据挖掘算法不清楚的可以看下这个博客,讲解⾮常细致。

我的实现也是基本照着这个思路。

再简单提⼀下这个算法做了⼀件什么事。

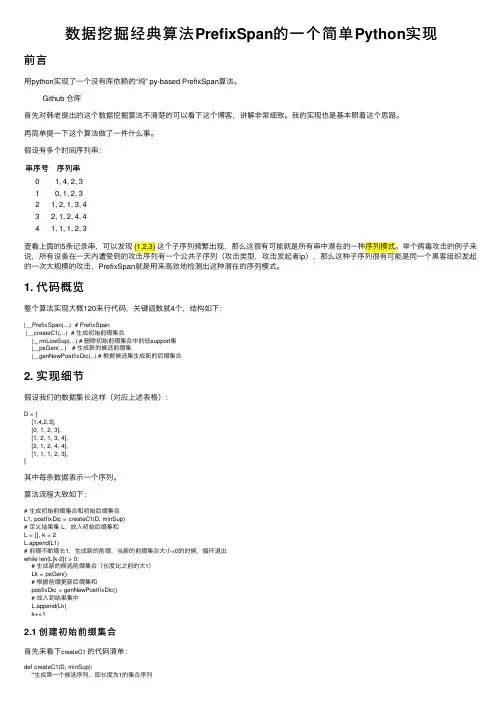

假设有多个时间序列串:串序号序列串01, 4, 2, 310, 1, 2, 321, 2, 1, 3, 432, 1, 2, 4, 441, 1, 1, 2, 3查看上⾯的5条记录串,可以发现 (1,2,3) 这个⼦序列频繁出现,那么这很有可能就是所有串中潜在的⼀种序列模式。

举个病毒攻击的例⼦来说,所有设备在⼀天内遭受到的攻击序列有⼀个公共⼦序列(攻击类型,攻击发起者ip),那么这种⼦序列很有可能是同⼀个⿊客组织发起的⼀次⼤规模的攻击,PrefixSpan就是⽤来⾼效地检测出这种潜在的序列模式。

1. 代码概览整个算法实现⼤概120来⾏代码,关键函数就4个,结构如下:|__PrefixSpan(...) # PrefixSpan|__createC1(...) # ⽣成初始前缀集合|__rmLowSup(...) # 删除初始前缀集合中的低support集|__psGen(...) # ⽣成新的候选前缀集|__genNewPostfixDic(..) # 根据候选集⽣成新的后缀集合2. 实现细节假设我们的数据集长这样(对应上述表格):D = [[1,4,2,3],[0, 1, 2, 3],[1, 2, 1, 3, 4],[2, 1, 2, 4, 4],[1, 1, 1, 2, 3],]其中每条数据表⽰⼀个序列。

算法流程⼤致如下:# ⽣成初始前缀集合和初始后缀集合L1, postfixDic = createC1(D, minSup)# 定义结果集 L,放⼊初始后缀集和L = [], k = 2L.append(L1)# 前缀不断增长1,⽣成新的前缀,当新的前缀集合⼤⼩=0的时候,循环退出while len(L[k-2]) > 0:# ⽣成新的候选前缀集合(长度⽐之前的⼤1)Lk = psGen()# 根据前缀更新后缀集和posfixDic = genNewPostfixDic()# 加⼊到结果集中L.append(Lk)k+=12.1 创建初始前缀集合⾸先来看下createC1的代码清单:def createC1(D, minSup):'''⽣成第⼀个候选序列,即长度为1的集合序列'''C1 = []postfixDic={}lenD = len(D)for i in range(lenD):for idx, item in enumerate(D[i]):if tuple([item]) not in C1:postfixDic[tuple([item])]={}C1.append(tuple([item]))if i not in postfixDic[tuple([item])].keys():postfixDic[tuple([item])][i]=idxL1, postfixDic = rmLowSup(D, C1, postfixDic, minSup)return L1, postfixDic参数:D:数据集minSup: PrefixSpan算法的关键参数min_support返回值:L1:剔除低support集后的候选前缀集合postfixDic: 对应候选集合的后缀集前缀集合C1初始前缀集合包含只含单个元素的集合,在调⽤rmLowSup⽅法前,上述代码的初始前缀集合C1的结果为:[(0,),(1,),(2),(3,),(4,)](其中每个前缀⽤tuple的形式,主要是为了能够hash);后缀集合postfixDicpostfixDic是前缀集合C1的后缀,它是⼀个Python字典,每个元素表⽰当前前缀在数据集中某⼀条序列中最早出现的结尾位置(这样处理,后续访问后缀的时候,就不需要从头开始遍历了),例如运⾏完上述代码后:postfixDic[(1,)]={0:0, 1:1, 2:0, 3:1, 4:0}回顾数据集D,可以发现1在每⼀⾏都出现了,且在第⼀⾏(下标为0)出现的结尾为0,第⼆⾏位置为1... (位置从0开始)依次类推:postfixDic[(1,2,3)]={0:3, 1:3, 2:3, 4:4}表⽰前缀(1,2,3)在第 0,1,2,4 ⾏都出现了,在第⼀⾏的结尾为3,第⼆⾏为3...同时我们可以发现调⽤len(postfixDic[prefix])就可以知道前缀prefix在多少序列中出现了,据此可以删除低support 前缀删除低support前缀rmLowSup函数清单如下:def rmLowSup(D,Cx, postfixDic,minSup):'''根据当前候选集合删除低support的候选集'''Lx = Cxfor iset in Cx:if len(postfixDic[iset])/len(D) < minSup:Lx.remove(iset)postfixDic.pop(iset)return Lx, postfixDic根据后缀集和postfixDic的说明,前缀prefix的⽀持度为:len(postfixDic[prefix])/len(D),例如上述前缀(1,2,3)的⽀持度为 4/5=0.8,低于阈值minSup的前缀和其相应在postfixDic中的key将被剔除。

大数据分析中的关联规则挖掘方法与工具推荐在大数据时代,数据成为了一种宝贵的资源。

然而,如何从海量的数据中提取有用的信息和洞察力,成为了许多企业和研究机构面临的挑战。

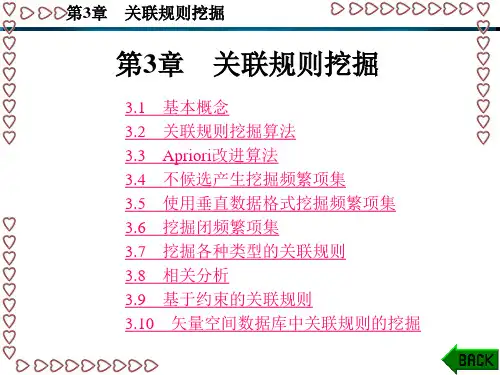

关联规则挖掘是一种广泛应用于大数据分析中的有效方法,它可以发现数据集中的潜在关联关系和模式。

本文将介绍关联规则挖掘的方法,并推荐几款常用的工具。

首先,我们来了解一下什么是关联规则挖掘。

关联规则挖掘是数据挖掘中的一种技术,它可以发现数据集中的频繁项集和强关联规则。

频繁项集指的是在数据集中经常同时出现的一组项的集合,而关联规则则是描述这些项集之间的关联关系。

通过挖掘关联规则,我们可以发现数据中隐藏的规律和关联关系,从而为决策和预测提供支持。

在关联规则挖掘中,最常用的算法是Apriori算法。

Apriori算法通过自底向上的方式逐步生成候选项集和频繁项集。

首先,通过寻找所有项的单个项集作为初始候选集,然后逐步生成更长的候选项集。

接下来,算法会扫描数据集,检查每个候选项集的支持度(即在数据集中出现的频率),并保留支持度高于阈值的项集作为频繁项集。

通过不断迭代这个过程,Apriori算法可以发现所有频繁项集和关联规则。

除了Apriori算法之外,还有其他一些关联规则挖掘算法,例如FP-growth算法和Eclat算法。

FP-growth算法通过构建一种称为FP树的数据结构来挖掘频繁项集。

它首先构建一颗完整的FP树,然后通过递归地将FP条件模式基与每个项结合起来生成更长的频繁项集。

Eclat算法是一种针对事务数据库的关联规则挖掘算法,它使用垂直数据表示来高效地挖掘频繁项集。

这些算法各有特点,在选择挖掘方法时可以根据数据集的特征和实际需求进行选择。

在实际应用中,有许多工具可以用于关联规则挖掘。

下面我将推荐几款常用的工具,供读者参考。

1. Weka:Weka是一个流行的数据挖掘工具,其中包含了各种关联规则挖掘算法。

它提供了直观的用户界面和丰富的功能,可以帮助用户进行数据预处理、建模和评估。

数据挖掘常用分类算法研究作者:王明星刘锋来源:《电脑知识与技术》2013年第34期摘要:数据库、数据仓库以及其他存储信息库中潜藏着很多与商业、科学研究等活动的决策有关的数据和知识。

对于数据挖掘中的数据分析,通常有两种常见的方法,即分类和预测,首先对数据库中的数据进行分类归纳,然后根据分类规则可以得到比较有价值的数据,然后我们可以根据这个数据来预测得到一些包含未来趋势的信息。

在常见的分类算法中,决策树算法是一个有着很好扩展性的算法,可以应用到大型数据库中,可以对多种数据类型进行处理,分类模式容易转化为分类规则,结果也十分的浅显易懂易于理解。

该文主要先介绍了几种常用的分类算法,然后具体介绍决策树算法的过程以及在分类算法实际应用中的优缺点。

关键词:数据挖掘;分类算法;人工智能;决策树中图分类号:TP311 文献标识码:A 文章编号:1009-3044(2013)34-7667-031 数据挖掘基本分类算法简要介绍数据分类技术在日常很多领域都有过应用,譬如银行经常要使用分类模型来进行相应的商业评估;学校的教务系统要使用分类模型对学生的成绩以及各种评价来进行评估;研究生、博士生等发表论文,使用数据挖掘分类模型来对各种期刊进行细致的分类,这样才能有效的评价科研能力的好坏;还有例如百度、谷歌这样的大型搜索引擎,提供的推荐功能,分类技术已经融入了我们日常生活的方方面面,各个领域也提出了很多分类算法理论。

最开始的数据挖掘分类算法都是基于内存的算法。

经过长时间的发展,数据挖掘算法也由使用内存开始逐步地使用外存以获得处理大数据的能力,以下对一些经典的分类算法进行介绍。

1)决策树分类算法决策树分类算法是数据挖掘十分经典的分类算法。

它使用自顶向下递归的方式构造决策树模型。

决策树上的每一个结点都采用信息增益度量来选择所要测试的属性。

也可以从已经生成的决策树上提取出分类规则。

2)向量空间模型VSM算法VSM的概念十分简单,就是把对文本内容的处理转化为对空间向量中的向量运算,而且可以使用空间中的相似度参数来表示文本中语义的相似度,非常的直观简单。

基于K-mean聚类的高频数据挖掘实例模型背景K-均值聚类算法,是数据挖掘十大经典算法之一。

其主要任务是根据样本数据的特征指标,把数据划分为k个类,使得同类的样本特征尽可能的相似,不同类的样本特征尽可能大的相异。

本模型将该算法应用于高频数据,提取上证50指数样本股,2013-03-04至2013-03-08共5天的15分时数据。

首先采用K-均值聚类算法,将前3天价格波动曲线相似的股票进行归类,这里将上证50指数成分股划分为4类。

其次,针对每类样本股票,以2013-03-07日开盘后1个小时内的成交量加权平均价买入,2013-03-08日收盘前1个小时的成交量加权平均价卖出,计算其收益率。

最后,找出收益率为正的类,观察该类的股票样本价格曲线形态,以便找出有利于投资决策的价格曲线形态或进一步的深入研究。

本模型作为了一个例子,旨在引导学生或教师或研究员更深入的研究该模型、学会金融高频数据的建模方法及应用于其他的实践案例。

本例子详细地介绍了时间序列数据特征的提取方法、基于关键点的降维方法、K-均值聚类算法的迭代过程、matlab绘制图形的编程技术等。

这些处理方法,均有matlab程序支持。

这里参考了研报《基于模式聚类的短线选股模型--数量化投资系列报告之四十二,国信证券,2011.8》以及期刊《一种基于关键点的时间序列聚类算法,计算机科学,2012年3月第3期》。

模型假设为了更好的使用K-mean聚类,对价格数据作了归一化处理。

模型公式K-均值聚类算法如下:A.随机初始化K个聚类中心,即K个类中心向量B.对每个样本,计算其与各个类中心向量的距离,并将该样本指派给距离最小的类C.更新每个类的中心向量,更新的方法为取该类所有样本的特征向量均值。

D.直到各个类的中心向量不再发生变化为止,这里采用0.01的误差,作为退出条件。

模型意义聚类为数据挖掘、数据分析、模型识别、量化投资相关领域的一项非常重要的任务。

K-mean均值聚类算法作为一个经典的算法,掌握其算法理论及实现技术,具有极其重要的意义。

一、前言Weka是一款流行的数据挖掘工具,其内置了多种经典的数据挖掘算法。

其中,Apriori算法是一种用于发现数据集中频繁项集的经典算法。

在本次实验中,我们将对Weka中的Apriori算法进行实验,并总结经验体会。

二、实验准备1. 数据集准备:选择一个符合Apriori算法输入要求的数据集,本次实验选取了一个包含购物篮信息的数据集,用于分析不同商品之间的关联规则。

2. Weka环境准备:确保Weka软件已经安装并能够正常运行。

三、实验步骤1. 数据集加载:我们将选取的数据集导入Weka软件中,确保数据集能够正确显示。

2. 参数设置:在Weka中,Apriori算法有一些参数需要设置,如最小支持度、最小置信度等。

根据实际需求,设置适当的参数。

3. 算法执行:执行Apriori算法,观察结果。

可以得到频繁项集、关联规则等信息。

4. 结果分析:根据算法输出的结果,分析不同项集之间的关联规则,并进行对比和总结。

四、实验结果1. 频繁项集分析:通过Apriori算法的执行,得到了数据集中的频繁项集信息。

可以发现一些商品之间的频繁组合,为进一步的关联规则分析提供了基础。

2. 关联规则分析:根据频繁项集,进一步推导出了一些关联规则。

如果购买了商品A,那么购买商品B的概率较大。

这对于商家进行商品搭配和促销活动有一定的指导作用。

3. 算法性能评估:除了得到具体的关联规则外,还可以对算法的性能进行评估。

包括算法执行时间、内存占用、参数敏感性等方面的评估。

五、实验体会1. 算法优缺点:经过实验,我们发现Apriori算法在处理大规模数据集时存在一定的计算复杂度,需要进行优化才能适应大规模数据挖掘的需求。

但在小规模数据集上,其表现仍然较为理想。

2. 参数选择经验:在实验中,我们也总结出了一些参数选择的经验,如支持度和置信度的合理选择范围,以及对于不同数据集的适应性。

3. 应用前景展望:关联规则挖掘在电商、市场营销等领域有着广泛的应用前景,我们相信在未来的实际工作中,能够将所学到的知识应用到真实的业务场景中。

⼤数据的常⽤算法(分类、回归分析、聚类、关联规则、神经⽹络⽅法、web数据挖掘)在⼤数据时代,数据挖掘是最关键的⼯作。

⼤数据的挖掘是从海量、不完全的、有噪声的、模糊的、随机的⼤型数据库中发现隐含在其中有价值的、潜在有⽤的信息和知识的过程,也是⼀种决策⽀持过程。

其主要基于,,模式学习,统计学等。

通过对⼤数据⾼度⾃动化地分析,做出归纳性的推理,从中挖掘出潜在的模式,可以帮助企业、商家、⽤户调整市场政策、减少风险、理性⾯对市场,并做出正确的决策。

⽬前,在很多领域尤其是在商业领域如、电信、电商等,数据挖掘可以解决很多问题,包括市场营销策略制定、背景分析、危机等。

⼤数据的挖掘常⽤的⽅法有分类、回归分析、聚类、关联规则、⽅法、Web 数据挖掘等。

这些⽅法从不同的⾓度对数据进⾏挖掘。

数据准备的重要性:没有⾼质量的挖掘结果,数据准备⼯作占⽤的时间往往在60%以上。

(1)分类分类是找出数据库中的⼀组数据对象的共同特点并按照分类模式将其划分为不同的类,其⽬的是通过分类模型,将数据库中的数据项映射到摸个给定的类别中。

可以应⽤到涉及到应⽤分类、趋势预测中,如淘宝商铺将⽤户在⼀段时间内的购买情况划分成不同的类,根据情况向⽤户推荐关联类的商品,从⽽增加商铺的销售量。

分类的⽅法:决策树——是最流⾏的分类⽅法特点:a、它的每次划分都是基于最显著的特征的;b、所分析的数据样本被称作树根,算法从所有特征中选出⼀个最重要的,⽤这个特征把样本分割成若⼲⼦集;c、重复这个过程,直到所有的分⽀下⾯的实例都是“纯”的,即⼦集中各个实例都属于同⼀个类别,这样的分⽀即可确定为⼀个叶⼦节点。

在所有⼦集变成“纯”的之后,树就停⽌⽣长了。

决策树的剪枝:a、如果决策树建的过深,容易导致过度拟合问题(即所有的分类结果数量基本⼀样,没有代表性);b、剪枝通常采⽤⾃上⽽下的⽅式。

每次找出训练数据中对预测精度贡献最⼩的那个分⽀,剪掉它;c、简⾔之,先让决策树疯狂⽣长,然后再慢慢往回收缩。

【数据挖掘技术】关联规则(Apriori算法)⼀、关联规则中的频繁模式关联规则(Association Rule)是在数据库和数据挖掘领域中被发明并被⼴泛研究的⼀种重要模型,关联规则数据挖掘的主要⽬的是找出:【频繁模式】:Frequent Pattern,即多次重复出现的模式和并发关系(Cooccurrence Relationships),即同时出现的关系,频繁和并发关系也称为关联(Association).⼆、应⽤关联规则的经典案例:沃尔玛超市中“啤酒和尿不湿”的经典营销案例购物篮分析(Basket Analysis):通过分析顾客购物篮中商品之间的关联,可以挖掘顾客的购物习惯,从⽽帮助零售商可以更好地制定有针对性的营销策略。

以下列举⼀个最简单也最经典的关联规则的例⼦:婴⼉尿不湿—>啤酒[⽀持度=10%,置信度=70%]这个规则表明,在所有顾客中,有10%的顾客同时购买了婴⼉尿不湿和啤酒,⽽在所有购买了婴⼉尿不湿的顾客中,占70%的⼈同时还购买了啤酒。

发现这个关联规则后,超市零售商决定把婴⼉尿不湿和啤酒摆在⼀起进⾏销售,结果明显提⾼了销售额,这就是发⽣在沃尔玛超市中“啤酒和尿不湿”的经典营销案例。

三、⽀持度(Support)和置信度(Confidence)事实上,⽀持度和置信度是衡量关联规则强度的两个重要指标,他们分别反映着所发现规则有⽤性和确定性。

【⽀持度】规则X->Y的⽀持度:事物全集中包含X U Y的事物百分⽐。

Support(A B)= P(A B)⽀持度主要衡量规则的有⽤性,如果⽀持度太⼩,则说明相应规则只是偶发事件,在商业实践中,偶发事件很可能没有商业价值。

【置信度】规则X->Y的置信度:既包括X⼜包括Y的事物占所有包含了X的事物数量的百分⽐。

Confidence(A B)= P(B|A)置信度主要衡量规则的确定性(可预测性),如果置信度太低,那么从X就很难可靠的推断出Y来,置信度太低的规则在实践应⽤中也没有太⼤⽤途。

聚类算法在数据挖掘中的应用随着信息时代的发展,数据量呈现爆炸式增长,如何高效地从海量数据中提取有价值的信息成为了数据挖掘领域面临的重要挑战之一。

在数据挖掘中,聚类算法是最为常用且经典的技术之一。

本文将着重探讨聚类算法的原理、常用的聚类算法及其应用,以及聚类算法未来的发展方向。

一、聚类算法原理聚类算法是一种非监督学习方法,其基本思想是将数据集中的对象按照相似性进行分组,使同一组中的对象相似度尽量高,不同组之间的相似度尽量低。

因此,在聚类算法中,相似度的度量是最为关键的一步。

常用的相似度度量方法包括欧氏距离、曼哈顿距离、余弦相似度等。

其中,欧氏距离是最常用的相似度度量方法,其公式如下:$$dist(x_i,x_j)=\sqrt{\sum_{m=1}^{n}(x_{im}-x_{jm})^2}$$在求出相似度矩阵后,聚类算法一般采用两种基本的策略进行聚类,分别是层次聚类和划分聚类。

层次聚类是先将每个数据点看作一个独立的簇,然后在它们之间逐步合并,直到达到指定的聚类数或者在距离矩阵中某些数据点距离超过阈值时停止。

层次聚类又可分为自下而上的凝聚聚类和自上而下的分裂聚类两种。

划分聚类则将数据集分成若干个子集,每个子集形成一个簇,通过不断递归地划分,直到达到指定的聚类数或最终簇的大小满足一定的条件时停止。

划分聚类又可分为划分式聚类和基于原型的聚类两种。

二、聚类算法常用方法及其应用1. K-meansK-means是一种基于划分的聚类算法,其通过迭代地移动簇的中心点,使簇内的数据点向中心点靠拢,不同簇之间的距离尽量大。

K-means聚类的流程如下:(1)从数据集中选取k个点作为初始的聚类中心;(2)将数据集中的每个点分配到距离最近的聚类中心所对应的簇中;(3)重新计算每个簇的中心点;(4)重复(2)和(3),直到聚类中心不再移动或达到指定的迭代次数。

K-means算法的优点在于简单易用,而且可扩展性强,但其缺点也比较明显,如对初始聚类中心的选择敏感、只能找到凸形簇等。

分类算法数据挖掘中有很多领域,分类就是其中之一,什么是分类,分类就是把一些新得数据项映射到给定类别的中的某一个类别,比如说当我们发表一篇文章的时候,就可以自动的把这篇文章划分到某一个文章类别,一般的过程是根据样本数据利用一定的分类算法得到分类规则,新的数据过来就依据该规则进行类别的划分。

分类在数据挖掘中是一项非常重要的任务,有很多用途,比如说预测,即从历史的样本数据推算出未来数据的趋向,有一个比较著名的预测的例子就是大豆学习。

再比如说分析用户行为,我们常称之为受众分析,通过这种分类,我们可以得知某一商品的用户群,对销售来说有很大的帮助。

分类器的构造方法有统计方法,机器学习方法,神经网络方法等等。

常见的统计方法有knn 算法,基于事例的学习方法。

机器学习方法包括决策树法和归纳法,上面讲到的受众分析可以使用决策树方法来实现。

神经网络方法主要是bp算法,这个俺也不太了解。

文本分类,所谓的文本分类就是把文本进行归类,不同的文章根据文章的内容应该属于不同的类别,文本分类离不开分词,要将一个文本进行分类,首先需要对该文本进行分词,利用分词之后的的项向量作为计算因子,再使用一定的算法和样本中的词汇进行计算,从而可以得出正确的分类结果。

在这个例子中,我将使用庖丁分词器对文本进行分词。

目前看到的比较全面的分类算法,总结的还不错.2.4.1 主要分类方法介绍解决分类问题的方法很多[40-42] ,单一的分类方法主要包括:决策树、贝叶斯、人工神经网络、K-近邻、支持向量机和基于关联规则的分类等;另外还有用于组合单一分类方法的集成学习算法,如Bagging和Boosting等。

(1)决策树决策树是用于分类和预测的主要技术之一,决策树学习是以实例为基础的归纳学习算法,它着眼于从一组无次序、无规则的实例中推理出以决策树表示的分类规则。

构造决策树的目的是找出属性和类别间的关系,用它来预测将来未知类别的记录的类别。

它采用自顶向下的递归方式,在决策树的内部节点进行属性的比较,并根据不同属性值判断从该节点向下的分支,在决策树的叶节点得到结论。

数据挖掘技术一.数据挖掘的含义和作用数据仓库的出现,带来了"数据丰富,但信息贫乏"的状况。

因此迫切需要一种新技术实现从企业海量的数据中发现有用的信息或知识,从而出现了数据挖掘(Data Mining)技术。

数据挖掘(Data Mining)就是应用一系列技术从大量的、不完全的、有噪声的、模糊的、随机的数据中,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。

提取的知识表示为概念(Concepts)、规则(Rules)、模式(Patterns)等形式。

这些数据可以是结构化的,如关系数据库中的数据,也可以是半结构化的,如文本,图形,图像数据,甚至是分布在网络上的异构型数据。

发现知识的方法可以是数学的,也可以是非数学的,可以是演绎的,也可以是归纳的。

发现了的知识可以被用于信息管理、查询优化、决策支持、过程控制等,还可以进行数据自身的维护。

数据挖掘借助了多年来数理统计技术和人工智能以及知识工程等领域的研究成果构建自己的理论体系,是一个交叉学科领域,可以集成数据数据库、人工智能、数理统计、可视化、并行计算等技术。

还有一个定义:数据挖掘就是从海量的数据中挖掘出可能有潜在价值的信息的技术。

这些信息是可能有潜在价值的,支持决策,可以为企业带来利益,或者为科学研究寻找突破口。

二、数据挖掘的目的它的目标是将大容量数据转化为有用的知识和信息。

数据挖掘并不专用于特定领域,它需要凝结各种技术和创造力去探索可能隐藏在数据中的知识。

在很多情况下,应用数据挖掘技术是为了实现以下三种目的:。

发现知识:知识发现的目标是从数据库存储的数据中发现隐藏的关系、模式和关联例如,在商业应用中数据挖掘可用于发现分割、分类、关联、喜好四种知识。

发现分割知识可以将客户记录分组,策划为客户度身定做的推销活动。

发现分类知识可以将输入的数据分配到预定义的类别中,发现和理解趋势以及对文本文档的进行分类等。

发现交叉销售的机会是一种关联知识,以及发现大部分客户的喜好的知识[4]。

apriori剪枝的原理理论说明1. 引言1.1 概述本文主要介绍了Apriori剪枝的原理及其在数据挖掘中的应用。

Apriori算法是一种常用的关联规则挖掘算法,它通过寻找频繁项集(即经常出现在数据集中的item组合)来发现数据集中的规律和关联性。

而剪枝作为提高Apriori算法效率的一种方法,通过减少候选项集中无意义和不可能成为频繁项集的候选项,从而减小计算量。

1.2 文章结构本文共分为五个部分进行讨论。

首先,在引言部分对Apriori剪枝的原理进行简要概述,并介绍了文章整体结构。

接着,在第二部分“Apriori剪枝的原理”中,我们将对Apriori算法进行简单介绍,并解释支持度和置信度的概念。

然后,我们将详细阐述Apriori剪枝策略及其实现方式。

在第三部分“理论说明”中,我们将深入解析Apriori剪枝的原理,并介绍基于先验知识的剪枝方法以及剪枝对算法性能的影响。

接下来,在第四部分“应用实例分析”中,我们将选择合适的数据集,并进行数据准备工作。

然后,通过实例演示和结果分析,展示Apriori 剪枝在真实数据集上的应用效果。

最后,在第五部分“结论与展望”中,我们将对全文进行总结,并提出未来进一步研究方向。

1.3 目的本文的目的是帮助读者更好地理解Apriori剪枝的原理及其在数据挖掘中的应用。

通过系统介绍Apriori算法、支持度和置信度的概念以及剪枝策略,读者能够了解Apriori剪枝背后的原理。

同时,通过实例分析和比较评估,读者可以更清晰地认识到剪枝策略对Apriori算法性能的影响。

最终,本文旨在为读者提供一个全面且深入的认识Apriori剪枝方法的指南,并为相关领域研究提供参考依据。

2. Apriori剪枝的原理:2.1 Apriori算法简介:Apriori算法是一种用于数据挖掘中频繁项集挖掘的经典算法。

它基于集合论中的先验知识,通过扫描事务数据库来发现频繁项集,并生成关联规则。

数据挖掘之经典算法 1 决策树算法 机器学习中,决策树是一个预测模型;它代表的是对象属性值与对象值之间的一种映射关系。树中每个节点表示某个对象,每个分叉路径则代表的某个可能的属性值,而每个叶结点则对应具有上述属性值的子对象。决策树仅有单一输出;若需要多个输出,可以建立独立的决策树以处理不同输出。 从数据产生决策树的机器学习技术叫做决策树学习, 通俗说就是决策树。 决策树学习也是数据挖掘中一个普通的方法。在这里,每个决策树都表述了一种树型结构,它由它的分支来对该类型的对象依靠属性进行分类。每个决策树可以依靠对源数据库的分割进行数据测试。这个过程可以递归式的对树进行修剪。当不能再进行分割或一个单独的类可以被应用于某一分支时,递归过程就完成了。另外,随机森林分类器将许多决策树结合起来以提升分类的正确率。 决策树同时也可以依靠计算条件概率来构造。决策树如果依靠数学的计算方法可以取得更加理想的效果。

1.1 决策树的工作原理 决策树一般都是自上而下的来生成的。 选择分割的方法有多种,但是目的都是一致的,即对目标类尝试进行最佳的分割。 从根节点到叶子节点都有一条路径,这条路径就是一条“规则”。 决策树可以是二叉的,也可以是多叉的。 对每个节点的衡量: 1) 通过该节点的记录数; 2) 如果是叶子节点的话,分类的路径; 3) 对叶子节点正确分类的比例。 有些规则的效果可以比其他的一些规则要好。

1.2 ID3算法 Y

Y Y Y N

N N N

w1Tx≥0

w4Tx≥0 w3Tx≥0 w2Tx≥0

二叉决策树框图 1.2.1 概念提取算法CLS 1) 初始化参数C={E},E包括所有的例子,为根; 2) 如果C中的任一元素e同属于同一个决策类则创建一个叶子节点YES终止;否则依启发式标准,选择特征Fi={V1, V2, V3,……, Vn}并创建判定节点,划分C为互不相交的N个

集合C1,C2,C3,……,Cn;

3) 对任一个Ci递归。

1.2.2 ID3算法 1) 随机选择C的一个子集W (窗口); 2) 调用CLS生成W的分类树DT(强调的启发式标准在后); 3) 顺序扫描C搜集DT的意外(即由DT无法确定的例子); 4) 组合W与已发现的意外,形成新的W; 5) 重复2)到4),直到无例外为止。 启发式标准: 只跟本身与其子树有关,采取信息理论用熵来量度。 熵是选择事件时选择自由度的量度,其计算方法为:P=freq(Cj,S)/|S|;

INFO(S)=-SUM(P*LOG(P));SUM()函数是求j从1到n的和。Gain(X)=Info(X)-Infox(X);Infox(X)=SUM( (|Ti|/|T|)*Info(X);

为保证生成的决策树最小,ID3算法在生成子树时,选取使生成的子树的熵(即Gain(S))最小的特征来生成子树。 ID3算法对数据的要求: 1) 所有属性必须为离散量; 2) 所有的训练例的所有属性必须有一个明确的值; 3) 相同的因素必须得到相同的结论且训练例必须唯一。

1.3 C4.5算法 由于ID3算法在实际应用中存在一些问题,于是Quilan提出了C4.5算法,严格上说C4.5只能是ID3的一个改进算法。 C4.5算法继承了ID3算法的优点,并在以下几方面对ID3算法进行了改进: 1) 用信息增益率来选择属性,克服了用信息增益选择属性时偏向选择取值多的属性的不足; 2) 在树构造过程中进行剪枝; 3) 能够完成对连续属性的离散化处理; 4) 能够对不完整数据进行处理。 C4.5算法有如下优点: 产生的分类规则易于理解,准确率较高。 C4.5算法有如下缺点: 在构造树的过程中,需要对数据集进行多次的顺序扫描和排序,因而导致算法的低效。此外,C4.5只适合于能够驻留于内存的数据集,当训练集大得无法在内存容纳时程序无法运行。 分类决策树算法: C4.5算法是机器学习算法中的一种分类决策树算法,其核心算法是ID3算法。 分类决策树算法是从大量事例中进行提取分类规则的自上而下的决策树。 决策树的各部分是: 根:学习的事例集; 枝:分类的判定条件; 叶:分好的各个类。 1.3.1 C4.5对ID3算法的改进 1) 熵的改进,加上了子树的信息。 Split_Infox(X)= -SUM( (|T|/|Ti|)*LOG(|Ti|/|T|));

Gain ratio(X)= Gain(X)/Split_Infox(X); 2) 在输入数据上的改进 ① 因素属性的值可以是连续量,C4.5对其排序并分成不同的集合后按照ID3算法当作离散量进行处理,但结论属性的值必须是离散值。 ② 训练例的因素属性值可以是不确定的,以?表示,但结论必须是确定的。 3) 对已生成的决策树进行裁剪,减小生成树的规模。

2 The k-means algorithm(k平均算法)

k-means algorithm是一个聚类算法,把n个对象根据它们的属性分为k个分割,k < n。它与处理混合正态分布的最大期望算法很相似,因为他们都试图找到数据中自然聚类的中心。它假设对象属性来自于空间向量,并且目标是使各个群组内部的均方误差总和最小。 假设有k个群组Si, i=1,2,...,k。μi是群组Si内所有元素xj的重心,或叫中心点。

k平均聚类发明于1956年,该算法最常见的形式是采用被称为劳埃德算法(Lloyd algorithm)的迭代式改进探索法。劳埃德算法首先把输入点分成k个初始化分组,可以是随机的或者使用一些启发式数据。然后计算每组的中心点,根据中心点的位置把对象分到离它最近的中心,重新确定分组。继续重复不断地计算中心并重新分组,直到收敛,即对象不再改变分组(中心点位置不再改变)。 劳埃德算法和k平均通常是紧密联系的,但是在实际应用中,劳埃德算法是解决k平均问题的启发式法则,对于某些起始点和重心的组合,劳埃德算法可能实际上收敛于错误的结果。(上面函数中存在的不同的最优解) 虽然存在变异,但是劳埃德算法仍旧保持流行,因为它在实际中收敛非常快。实际上,观察发现迭代次数远远少于点的数量。然而最近,David Arthur和Sergei Vassilvitskii提出存在特定的点集使得k平均算法花费超多项式时间达到收敛。 近似的k平均算法已经被设计用于原始数据子集的计算。 从算法的表现上来说,它并不保证一定得到全局最优解,最终解的质量很大程度上取决于初始化的分组。由于该算法的速度很快,因此常用的一种方法是多次运行k平均算法,选择最优解。 k平均算法的一个缺点是,分组的数目k是一个输入参数,不合适的k可能返回较差的结果。另外,算法还假设均方误差是计算群组分散度的最佳参数。

3 SVM(支持向量机)

支持向量机,英文为Support Vector Machine,简称SV机(论文中一般简称SVM)。它是一种监督式学习的方法,它广泛的应用于统计分类以及回归分析中。 支持向量机属于一般化线性分类器。它们也可以被认为是提克洛夫规范化(Tikhonov Regularization)方法的一个特例。这种分类器的特点是他们能够同时最小化经验误差与最大化几何边缘区。因此支持向量机也被称为最大边缘区分类器。 在统计计算中,最大期望(EM)算法是在概率(probabilistic)模型中寻找参数最大似然估计的算法,其中概率模型依赖于无法观测的隐藏变量(Latent Variable)。最大期望经常用在机器学习和计算机视觉的数据集聚(Data Clustering)领域。最大期望算法经过两个步骤交替进行计算,第一步是计算期望(E),也就是将隐藏变量像能够观测到的一样包含在内从而计算最大似然的期望值;另外一步是最大化(M),也就是最大化在 E 步上找到的最大似然的期望值从而计算参数的最大似然估计。M 步上找到的参数然后用于另外一个 E 步计算,这个过程不断交替进行。 Vapnik等人在多年研究统计学习理论基础上对线性分类器提出了另一种设计最佳准则。其原理也从线性可分说起,然后扩展到线性不可分的情况。甚至扩展到使用非线性函数中去,这种分类器被称为支持向量机(Support Vector Machine,简称SVM)。支持向量机的提出有很深的理论背景。支持向量机方法是在近年来提出的一种新方法,但是进展很快,已经被广泛应用在各个领域之中。 SVM的主要思想可以概括为两点:(1) 它是针对线性可分情况进行分析,对于线性不可分的情况,通过使用非线性映射算法将低维输入空间线性不可分的样本转化为高维特征空间使其线性可分,从而使得高维特征空间采用线性算法对样本的非线性特征进行线性分析成为可能;(2) 它基于结构风险最小化理论之上在特征空间中建构最优分割超平面,使得学习器得到全局最优化,并且在整个样本空间的期望风险以某个概率满足一定上界。 在学习这种方法时,首先要弄清楚这种方法考虑问题的特点,这就要从线性可分的最简单情况讨论起,在没有弄懂其原理之前,不要急于学习线性不可分等较复杂的情况,支持向量机在设计时,需要用到条件极值问题的求解,因此需用拉格朗日乘子理论,但对多数人来说,以前学到的或常用的是约束条件为等式表示的方式,但在此要用到以不等式作为必须满足的条件,此时只要了解拉格朗日理论的有关结论就行。 支持向量机将向量映射到一个更高维的空间里,在这个空间里建立有一个最大间隔超平面。在分开数据的超平面的两边建有两个互相平行的超平面。分隔超平面使两个平行超平面的距离最大化。假定平行超平面间的距离或差距越大,分类器的总误差越小。一个极好的指南是C.J.C Burges的《模式识别支持向量机指南》。van der Walt 和 Barnard 将支持向量机和其他分类器进行了比较。

有很多个分类器(超平面)可以把数据分开,但是只有一个能够达到最大分割。 我们通常希望分类的过程是一个机器学习的过程。这些数据点并不需要是中的点,

而可以是任意(统计学符号)中或者 (计算机科学符号) 的点。我们希望能够把这些点

通过一个n-1维的超平面分开,通常这个被称为线性分类器。有很多分类器都符合这个要求,但是我们还希望找到分类最佳的平面,即使得属于两个不同类的数据点间隔最大的那个面,该面亦称为最大间隔超平面。如果我们能够找到这个面,那么这个分类器就称为最大间隔分类器。