数字音频播放原理

一、驱动程序

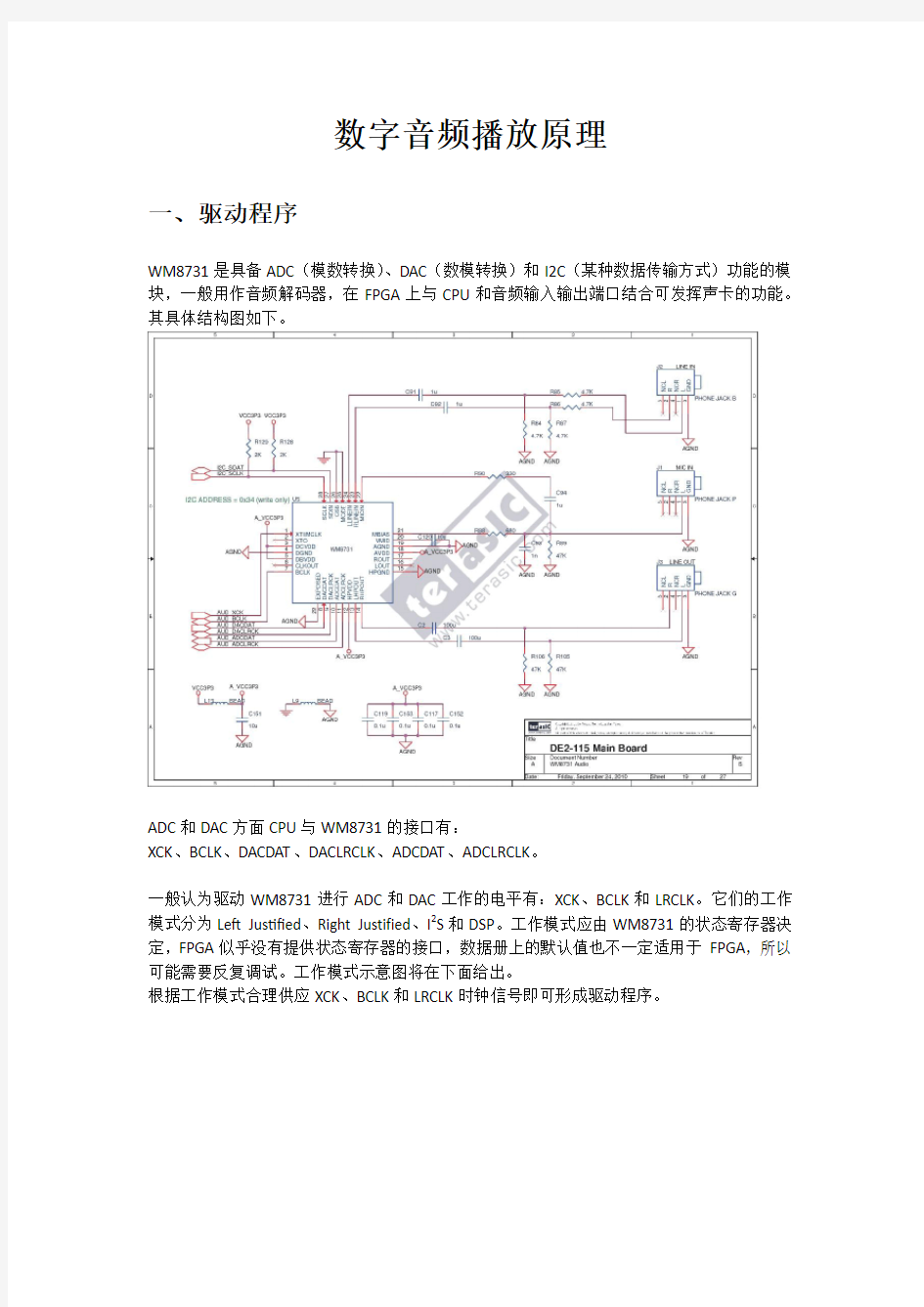

WM8731是具备ADC(模数转换)、DAC(数模转换)和I2C(某种数据传输方式)功能的模块,一般用作音频解码器,在FPGA上与CPU和音频输入输出端口结合可发挥声卡的功能。其具体结构图如下。

ADC和DAC方面CPU与WM8731的接口有:

XCK、BCLK、DACDAT、DACLRCLK、ADCDAT、ADCLRCLK。

一般认为驱动WM8731进行ADC和DAC工作的电平有:XCK、BCLK和LRCLK。它们的工作模式分为Left Justified、Right Justified、I2S和DSP。工作模式应由WM8731的状态寄存器决定,FPGA似乎没有提供状态寄存器的接口,数据册上的默认值也不一定适用于FPGA,所以可能需要反复调试。工作模式示意图将在下面给出。

根据工作模式合理供应XCK、BCLK和LRCLK时钟信号即可形成驱动程序。

以上是LRCLK和BCLK驱动WM8731对ADCDAT(模数转换串行数据)或DACDAT(数模转换串行数据)进行传递和采样的过程。LRCLK由不同电位决定是向左声道传递还是向右声道传递。串行数据有字长要求,通过更改状态寄存器,有8、12、16和24位四种字长可供选择。具体选择需要调试。

以上示意图为驱动程序的理想情况。实际上WM8731对驱动电平(和输出电平)有具体的延时情况和时间要求。这分为两种模式,master mode(主)和slave mode(从)。这里的概念大致如下图所示。

在实验中确实遇到了少量延迟(如case语句)就会带来驱动程序无法驱动WM8731工作的情况。实验中切换弹奏和自动演奏模式时也需要对驱动程序各时钟进行同步。

以上是采样中数据传递方面的讨论。下面将涉及到详细采样的过程,这需要主时钟(XCLK 或MCLK)来完成。具体要求由下表给出。fs是一个与LRCLK对应的值,个人理解是即在一轮24位数据传递中完成模数转换或数模转换的次数(该次数将会被均分到24位数据中每一位的传递上)。对主时钟的频率要求是:

f MCLK=fs×f LRCLK

结合以上信息可大致做成WM8731驱动程序。

二、音频运算

一般DAC是要和ADC相结合的。当然,只是需要一个波形的话,CPU的运算可以替代ADC 过程。

为了产生单频声音,需要正弦函数的波形数据。这以数据可由24位字长的变量给出。我们将正弦函数的一个周期均分成了48份,因此LRCLK的频率(所谓“单帧采样率”)和声波的频率可表达如下:

f LRCLK=f sound×48

该公式指出可以通过更改LRCLK的频率改变声音的频率。这是一个相对简易的做法。本次实验采用了这种方法。

我们在未来希望实现这样的方法,即固定LRCLK的频率,通过变更波形数据(这一般通过重新模仿模数转换即“重采样”来实现)来变更音调。设周期性波形数据的周期为T,重采样率为fps,数模转换的“单帧采样率”均为f DAC,最终声波频率为f sound,则在该方法下它们的关系预计是:

1 f sound =

T

T×fps

T×f DAC

=

f DAC

fps

×T

固定LRCLK的频率,驱动程序中所有时钟的频率也将固定,这十分有利于时钟的同步运行。

具体实现时,通过对系统时钟CLOCK进行分频来得到不同频率的时钟信号。如果采用变更LRCLK频率的方法,那么CLOCK的分频计数x应表达如下:

x=f CLOCK

MCLK

=

f CLOCK

sound

中央C和其临近音高D的频率是分别是523Hz和587Hz,如果f CLOCK=50MHz,那么这两个音高需要的x值如下:

x C=5.187

x D=4.621

这两个值在整型运算中是区分不出来的。当音调升高时x的变动还会更小。因此需要将系统时钟提高到一个更快的频率。这一步由锁相环倍频电路实现。

最后将获得的24位波形数据跟随驱动程序传递给WM8731即可实现播放。

数字音频作业及其答 案

第一次作业: 1:、声音可分为两种:纯音和复合音,平常人们说话的声音属于哪一种?语音的频率范围是多少?音频通常包括哪几种声音信号?其频率范围是多少? 2、请说明音频信号数字化的三个步骤? 3、如何理解“量化是信号数字化过程中重要的一步,而这一过程又是引入噪声的主要根源”这句话的含义?通过哪些途径可以减小量化误差? 4对双极性信号若采用均匀量化,则量化信噪比SNR与量化比特数之间的关系为:SNR=6.02xN+1.76dB,试分析此式对实际量化与编码的指导意义? 5:、A/D、D/A转换器的技术指标有哪些? 答:1:人们说话的声音为复合音,语言的频率范围为300HZ-3000HZ。音频暴多语音、音乐、效果声等声音信号,频率范围为20HZ-20KHZ。 2:1取样:对连续信号按一定的时间间隔取样。奈奎斯特取样定理认为,只要取样频率大于等于信号中所包含的最高频率的两倍,则可以根据其取样完全恢复出原始信号,这相当于当信号是最高频率时,每一周期至少要采取两个点。但这只是理论上的定理,在实际操作中,人们用混叠波形,从而使取得的信号更接近原始信号。2量化:取样的离散音频要转化为计算机能够表示的数据范围,这个过程称为量化。量化的等级取决于量化精度,也就是用多少位二进制数来表示一个音频数据。一般有8位,12位或16位。量化精度越高,声音的保真度越高。以8位的举例稍微说明一下其中的原理。若一台计算机能够接收八位二进制数据,则相当于能够接受256个十进制的数,即有256个电平数,用这些数来代表模拟信号的电平,可以有256种,但是实际上采样后的某一时刻信号的电平不一定和256个电平某一个相等,此时只能用最接近的数字代码表

视频服务器的基本结构、原理、特点 1、基本结构 前面说到的视频服务器其实是编码器,既然是编码器就必然对应着有解码器。编码器是按照一定的压缩标准,把模拟信号编码成可以在计算机网络中传输的数字信号;而视频解码器(Video-Decoder)则是把数字信号还原成模拟信号,通过模拟视频输出接口(NTSC/PAL)与电视墙连接,实现在电视机/监视器上显示。当我们用电视墙显示的时候需要配置视频解码器。 我们可以把视频服务器可以看作是不带硬盘的数字视频机,由一个或多个模拟视频输入口、图像数字处理器、压缩芯片和具有网络功能的Web 服务器、RJ-45网络接入口组成。 2、基本原理 在Web服务器嵌入了实时操作系统,摄像机的视频信号经过模拟/数字转换,由高效压缩芯片压缩,通过内部总线传送到Web服务器,配置好IP地址、网关、路由后,网络上用户可以直接用IE浏览器访问Web服务器浏览现场视频图像,可以进行镜头的变焦、变倍操作,控制摄像机云台的旋转。 3、基本功能特点 ·采用嵌入式设计,产品体积小,集成度高,可安装于多种场所,便于组网 ·支持PAL/NTSC复合视频 ·支持D1高清晰MPEG4视频压缩,向下支持CIF、HalfD1格式

·支持MP3音频压缩 ·通过网络进行人脸识别、截取、存储,大大增强后期取证时的判断准确度·系统集成Web Server,使用Web页面便可轻松实现远程监看、控制、设置·支持多种网络的远程升级,使维护轻松简便 ·支持动态IP地址,支持局域网、Internet(ADSL、有线通) ·支持多种无线传输,802.11g无线局域网、CDMA、GPRS ·双向语音对讲,使远程通话成本大大降低 ·网络自适应技术,根据网络带宽自动调整视频帧率 ·视频码率16Kbps-4Mbps连续可调,帧率1-30 (1-25)连续可调 ·画面延迟小于200毫秒(局域网) ·视频遮挡、移动侦测、探头等报警功能(可设区域和灵敏度) ·RS-422/485串口,支持透明串口传输、支持云台控制、高速球机或摄像机等外置设备 ·支持多用户同时访问,多级用户密码权限管理 ·录像文件可直接使用Microsoft Media Player播放 ·异常自动恢复功能,网络中断后可自动连接

第一次作业: 1:、声音可分为两种: 纯音和复合音,平常人们说话的声音属于哪一种?语音的频率范围是多少?音频通常包括哪几种声音信号?其频率范围是多少? 2、请说明音频信号数字化的三个步骤? 3、如何理解量化是信号数字化过程中重要的一步,而这一过程又是引入噪声的主要根源”这句话的含义?通过哪些途径可以减小量化误差? 4对双极性信号若采用均匀量化,则量化信噪比SNR与量化比特数之间的关系为: SNR=6.02xN+1.76dB试分析此式对实际量化与编码的指导意义? 5:、A/ D、D/A转换器的技术指标有哪些? 答:1:人们说话的声音为复合音,语言的频率范围为300HZ-3000HZ音频 暴多语音、音乐、效果声等声音信号,频率范围为20HZ-20KHZ 2: 1取样: 对连续信号按一定的时间间隔取样。奈奎斯特取样定理认为,只要取样频率大于等于信号中所包含的最高频率的两倍,则可以根据其取样完全恢复出原始信号,这相当于当信号是最高频率时,每一周期至少要采取两个点。但这只是理论上的定理,在实际操作中,人们用混叠波形,从而使取得的信号更接近原始信号。2量化: 取样的离散音频要转化为计算机能够表示的数据范围,这个过程称为量化。量化的等级取决于量化精度,也就是用多少位二进制数来表示一个音频数据。一般有8位,12位或16位。量化精度越高,声音的保真度越高。以8位的举例稍微说明一下其中的原理。若一台计算机能够接收八位二进制数据,则相当于能够接受256个十进制的数,即有256个电平数,用这些数来代表模拟信 号的电平,可以有256种,但是实际上米样后的某一时刻信号的电平不一定和256个电

平某一个相等,此时只能用最接近的数字代码表示取样信号电平。3编码: 对音频信号取样并量化成二进制,但实际上就是对音频信号进行编码,但用不同的取样频率和不同的量化位数记录声音,在单位时间中,所需存贮空间是不一样的。波形声音的主要参数包括: 取样频率.量化位数.声道数.压缩编码方案和数码率等,未压缩前,波形声音的码率计算公式为: 波形声音的码率=取样频率*量化位数*声道数/8。波形声音的码率一般比较大,所以必需对转换后的数据进行压缩。 3:量化是按四舍五入对采样的样本值进行计量的,这个过程会产生误差可对噪声进行整形,提高采样频率等方法减小量化误差 4:量化比特数增加一位,则信噪比提高6dB,信噪比提高意味着声音动态范围的加宽,若采用量化比特N=16的A/D变换器的数字声记录在磁带上可以扩展到98dB,接近于交响乐动态范围,若将量化比特提高到N=20,可扩至人儿的122dB动态范围。 5: A/D的技术指标有: 分辨率、转换速率、量化误差、偏移误差、满刻度误差和线性度误差等。D/A转换器的技术指标有: 分辨率和建立时间。 第二次作业: 1. 什么叫最小可闻阈?什么叫掩蔽阈?什么叫频域掩蔽?什么叫时域掩蔽?掩蔽效应的一般规律是什么? 2. 何谓临界频带?简述它在音频编码中的应用。 3. 音频编码通常分为哪几类?它们各有什么优缺点? 4. 声音压缩的依据是什么?MPEG-1音频编码利用了听觉系统的什么特

视频原理与MediaCoder软件使用通用入门 配套软件下载:https://www.doczj.com/doc/bd12989329.html,/dlfull_zh.htm 一、软件作用: 以下是官方网站的说明 MediaCoder是一个免费的通用音频/视频批量转码工具,它将众多来自开源社区的优秀音频视频编解码器和工具整合为一个通用的解决方案,可以将音频、视频文件在各种格式之间进行转换。MediaCoder具备一个可扩展的架构和丰富的功能,可满足各种场合下的转码需求。目前,MediaCoder已经拥有上百万分布在全世界170多个国家的用户。 功能和特点 ?基于优秀的众多的开源编解码后台,能够解码和编码的格式多 ?极为丰富的可调整的编码参数 ?全部编解码器自带,不依赖于系统的编解码器和任何组件 ?良好的可扩展的程序架构,快速适应新的需求,不断增加新的格式的支持 ?利用脚本语言扩展的界面,有支持众多影音设备(如PSP、iPod)的专用界面 ?高性能,特别在双核处理器上表现优异 典型应用 ?提高影音文件压缩率,减小其文件尺寸 ?转换至可在各种影音设备上播放的影音文件,如MP3播放器、MP4播放器、手机、PDA、VCD/DVD播放机 ?提取视频文件中的音轨并转换成MP3、AAC、WMA等音频文件 ?修复和改善一些损坏的、部分下载的或质量不佳的影音文件 支持格式 ?MP3, Vorbis, AAC, AAC+, AAC+v2, MusePack, Speex, AMR, WMA, RealAudio, mp3PRO* ?FLAC, WavPack, Monkey's Audio, OptimFrog, AAC Lossless, WMA Lossless, WAV/PCM ?H.264, Xvid, MPEG1/2/4, Theora, Flash Video, Dirac, 3ivx*, RealVideo*, Windows Media Video ?AVI, MPEG/VOB, Matroska, MP4, RealMedia*, ASF, Quicktime*, OGM* ?CD, VCD, DVD, CUE Sheet* 随着软件的更新可能支持更多的格式,以软件主页介绍为准。 *仅支持输入简而言之,你可以用MediaCoder转换各种视频、音频文件。一般在以下几种常见的情况下需要转换:

实验13、CoolEdit数字音频处理 实验课时: 课内:2课时;课外:1课时 实验目的: 了解音频数据的特性及其获取和处理的方法,学会使用音频编辑工具CoolEdit进行音频数据的录制、编辑和播放 实验内容: 操作准备 1.在D:或E:分区创建一个以你的“完整学号+姓名”命名的文件夹(名称应类似: 198009010001文立斌),我们把这个文件夹简称为“你的文件夹” 2.以下操作步骤中所涉及的198009010001、文立斌均应替换成你的学号、姓名 3.准备好音频实验环境,个别人物需要准备麦克风、音箱(或耳机) 任务一、音频提取 1.打开CoolEditPro软件 2.如下图所示,单击工具栏最左边的按钮切换到波形编辑界面 → 3.依次执行菜单命令【文件】→【从视频文件中提取】,通过系统显示的“选择视频文件” 对话框选定“说唱脸谱.dat”文件后单击【打开】按钮,系统开始从“说唱脸谱.dat” 中提取音频 4.等待系统提取音频结束后,执行菜单命令【文件】→【另存为】,将提取到的波形保存 为类似“文立斌A.wma”(.wma格式)的文件 任务二、淡入淡出 1.打开CoolEditPro软件 2.如下图所示,单击工具栏最左边的按钮切换到波形编辑界面 → 3.依次执行菜单命令【文件】→【打开】,通过系统显示的“打开波形文件”对话框选定 “最炫民族风.mp3”文件后单击【打开】按钮打开该文件,原始波形编辑面板类似:

4.单击视窗左下角录播工具面板中的播放按钮,试听歌曲,确定演唱(人声)从何时(第 几秒)开始——大约是第23秒! 5.如下图所示,在波形编辑面板中以鼠标拖拽的方式选定最前面23秒波形: 如果需要精确选定波形区域,您还可以借助视窗右下角的如下面板,直接输入始末时间: 6.依次执行菜单命令【效果】→【波形振幅】→【渐变】,如下图所示,在“波形振幅” 对话框中,选择“Fade in”(淡入),然后单击【确定】按钮: 7.系统进行淡入处理后的波形类似: 您应该对照一下处理前后的前23秒波形的异同 8.试听,您应该能听到淡入处理的效果(音量越来越大)才对! 9.从4分20秒位置开始选定直到音频结束处的波形,为选定的波形添加淡出效果,处理 第2页

一、基本概念 1 比特率:表示经过编码(压缩)后的音频数据每秒钟需要用多少个比特来表示,单位常为kbps。 2 响度和强度:声音的主观属性响度表示的是一个声音听来有多响的程度。响度主要随声音的强度而变化,但也受频率的影响。总的说,中频纯音听来比低频和高频纯音响一些。 3 采样和采样率:采样是把连续的时间信号,变成离散的数字信号。采样率是指每秒钟采集多少个样本。 Nyquist采样定律:采样率大于或等于连续信号最高频率分量的2倍时,采样信号可以用来完美重构原始连续信号。 二、常见音频格式 1. WAV格式,是微软公司开发的一种声音文件格式,也叫波形声音文件,是最早的数字音频格式,被Windows平台及其应用程序广泛支持,压缩率低。 2. MIDI是Musical Instrument Digital Interface的缩写,又称作乐器数字接口,是数字音乐/电子合成乐器的统一国际标准。它定义了计算机音乐程序、数字合成器及其它电子设备交换音乐信号的方式,规定了不同厂家的电子乐器与计算机连接的电缆和硬件及设备间数据传

输的协议,可以模拟多种乐器的声音。MIDI文件就是MIDI格式的文件,在MIDI文件中存储的是一些指令。把这些指令发送给声卡,由声卡按照指令将声音合成出来。 3. MP3全称是MPEG-1 Audio Layer 3,它在1992年合并至MPEG规范中。MP3能够以高音质、低采样率对数字音频文件进行压缩。应用最普遍。 4. MP3Pro是由瑞典Coding科技公司开发的,其中包含了两大技术:一是来自于Coding 科技公司所特有的解码技术,二是由MP3的专利持有者法国汤姆森多媒体公司和德国Fraunhofer集成电路协会共同研究的一项译码技术。MP3Pro可以在基本不改变文件大小的情况下改善原先的MP3音乐音质。它能够在用较低的比特率压缩音频文件的情况下,最大程度地保持压缩前的音质。 5. MP3Pro是由瑞典Coding科技公司开发的,其中包含了两大技术:一是来自于Coding 科技公司所特有的解码技术,二是由MP3的专利持有者法国汤姆森多媒体公司和德国Fraunhofer集成电路协会共同研究的一项译码技术。MP3Pro可以在基本不改变文件大小的情况下改善原先的MP3音乐音质。它能够在用较低的比特率压缩音频文件的情况下,最大程度地保持压缩前的音质。 6. WMA (Windows Media Audio)是微软在互联网音频、视频领域的力作。WMA格式是以减少数据流量但保持音质的方法来达到更高的压缩率目的,其压缩率一般可以达到1:18。此外,WMA还可以通过DRM(Digital Rights Management)保护版权。 7. RealAudio是由Real Networks公司推出的一种文件格式,最大的特点就是可以实时传输音频信息,尤其是在网速较慢的情况下,仍然可以较为流畅地传送数据,因此RealAudio 主要适用于网络上的在线播放。现在的RealAudio文件格式主要有RA(RealAudio)、RM (RealMedia,RealAudio G2)、RMX(RealAudio Secured)等三种,这些文件的共同性在于随着网络带宽的不同而改变声音的质量,在保证大多数人听到流畅声音的前提下,令带宽较宽敞的听众获得较好的音质。 8. Audible拥有四种不同的格式:Audible1、2、3、4。https://www.doczj.com/doc/bd12989329.html,网站主要是在互联网上贩卖有声书籍,并对它们所销售商品、文件通过四种https://www.doczj.com/doc/bd12989329.html, 专用音频格式中的一种提供保护。每一种格式主要考虑音频源以及所使用的收听的设备。格式1、2和3采用不同级别的语音压缩,而格式4采用更低的采样率和MP3相同的解码方式,所得到语音吐辞更清楚,而且可以更有效地从网上进行下载。Audible 所采用的是他们自己的桌面播放工具,这就是Audible Manager,使用这种播放器就可以播放存放在PC或者是传输到便携式播放器上的Audible格式文件

MAXIDRIVER3.4数字音频处理器 ALTO MAXIDRIVER3.4数字处理器是集增益、噪声门、参数均衡、分频、压缩限 幅、延时为一体的全功能数字音频处理器,具有2个输入通道和6个输出通道,本机内设10种工厂预设的分频模式,64个用户程序数据库位置以及利用多媒体卡(MMC)进行128个用户程序外置储存的功能。MAXIDRIVER3.4是新一代全数字音 频处理器,采用分级菜单形式,操作非常方便。 功能键介绍 前面板 1、MODE---分级菜单选择,按动时循环选择PRESET(预设)、DELAY(延时)、EDIT(编辑)、UTILITY(系统设置)菜单功能。同时相对应的LED指示灯会被点亮。这时可以进入所选择的菜单进行参数编辑。 2、LED指示灯---当你用MODE键选择需要编辑的菜单时,相对应的LED指示 灯会被点亮。 3、2X16位LCD显示屏---显示正在编辑或查看的系统参数或系统状态。 4、数据轮---转动这个数据轮可以调节需要编辑的参数的数值,顺时针旋转提高数值,逆时针旋转减低数值。 5、PREV/NEXT---前翻/后翻键,每个主菜单下面都有若干个子菜单,通过按动这两个按键可以向前或向后选择所需要进行编辑的子菜单。 6、NAVIGATION CURSOR KEYS---光标移动键,每个子菜单中都有若干个可以 编辑的参数选择,按动这两个键,可以选择需要编辑的参数,选中的参数会闪烁。 7、CARD---储存卡插入口,在这个插口插入MMC储存卡,利用PRESET(预设) 菜单下,可以对该储存卡进行写入、读出等操作。 8、ENTER---确认键,按此键可以对所选择的菜单或编辑的参数数值进行确认。 9、ESC---取消键,按此键可以对所选择的菜单或编辑的参数数值进行取消操作,返回上一级菜单。 10、输入电平指示表,实时指示A/B两个输入通道输入电平的强弱数值。 11、MUTE---静音按键,按下后将关闭相应输出通道的输出信号,相对应的 红色LED指示灯将点亮。 12、输出电平指示表,显示每个输出通道输出电平大小数值,这里显示的数 值不是绝对的输出电平数值,而是与该列LED指示灯中的LIMIT(限幅)指示为基础相比较的数值。

万方数据

DSP在数字音频处理技术中的应用 作者:陈兴刚, 金鑫 作者单位:陈兴刚(贵州大学,电子科学与信息技术学院,贵州,贵阳,550025), 金鑫(云南大学软件学院,云南,昆明,650200) 刊名: 黑龙江科技信息 英文刊名:HEILONGJIANG SCIENCE AND TECHNOLOGY INFORMATION 年,卷(期):2008,(31) 引用次数:0次 参考文献(5条) 1.谢铿基于DSP的数字音频系统[学位论文] 2002 2.陆牧基于DSP的数字音效系统研究[学位论文] 2002 3.韩纪庆.冯涛.郑贵滨音频信息处理技术 2007 4.博创科技MP3播放器与U盘设计 2004 5.卢官明.宗昉数字音频原理及应用 2005 相似文献(9条) 1.会议论文陈佳.董金明StarCore SC140优化技术分析2006 软件优化是软件开发的重要部分.本文针对运行于StarCoreSC140平台的点对点数字音频系统,对该系统的软件部分的优化进行了分析,分别探讨了C语言优化和汇编语言优化的具体实现方法.通过优化,大大缩短了代码的运行周期,提高了运行效率,证明了优化方法的有效性. 2.学位论文曹承涛基于TMS320C5402 DSP的数字音频系统的研究2002 该论文首先简要介绍了TI公司的TMS320C54x系列DSP.之后,详细叙述了论文作者设计研制的一种基于DSP的数字音频系统.该系统以 TMS320C5402(DSP)为中央处理器,可完成MP3音频数字信号的分析和处理,并通过串行A/D/A芯片实现对外界模拟音频信号的采集和发送.该系统配有大容量FLASH和硬盘,用于程序和音频数据的存储,128K字节高速RAM作为数据缓冲区.同时,通过USB控制芯片完成系统与PC机之间的数据通信.系统中的大量控制信号由一片CPLD产生,该文也对CPLD的设计进行了描述.论文对ISO/IEC11172标准中的LayerⅢ音频算法和基本原理进行了介绍.在对关键解压算法技术,如霍夫曼解码,反量化的快速算法进行深入研究的基础上,提出基于DSP汇编语言的快速算法实现方案. 3.期刊论文王林章.李双田多路实时数字音频系统中的PCI通信-电声技术2003(6) 介绍一个多路实时数字音频系统的PCI通信,包括Windows管理体系,静态和动态设备内存映射方法,PCI配置寄存器的访问方法,以及PC机和DSP之间通信方法等必须的关键技术. 4.期刊论文白若冰.朱善安基于OMAP5912的数字音频系统-电子技术2005,32(9) OMAP5912处理器是由TI应用最为广泛的TMS320C55x DSP内核与低功耗、高性能的ARM926EJ-S微处理器组成的双核应用处理器.C55x系列可支持低功耗应用的实时多媒体处理,ARM926可满足控制和接口方面的处理需要.基于双核结构,OMAP5912采用开放式、易于开发的软件设施. 5.学位论文谢铿基于DSP的数字音频系统2002 该文首先综述了数字音频和数字信号处理器(DSP)的发展概况以及DSP技术在数字音频领域的应用情况.然后简单介绍了音频系统和组成,叙述了扬声器的频率响应特性及其对音质的影响,提出使用均衡器补偿扬声器频响特性的方法;动态范围压缩器、扩展器、限制器在音频系统中也起着重要的作用,该文也对其做出了介绍,并阐述了它们的用途和使用方法.在介绍数字音频系统结构的同时,还提到现时最新的数字功放技术.在系统的控制部分,介绍了TAS300X系列芯片所使用的控制总线—I<'2>C总线,及由德州仪器公司出口的MSP430超低功耗单片机,阐述了如何合作使用MSP430单片机通过 I<'2>C总线来控制TAS300X系列数字音频处理器实现各种功能.最后是使用TAS3001EVM评估板和MSP430单片机FLASH系列的FET开发工具制作出来的实验装置对扬声器进行频率响应补偿实验,实验结果显示与仿真结果相符,扬声器的音质得到在很大的改善. 6.期刊论文孙冬.王新金.许爽.SUN Dong.WANG Xin-jin.XU Shuang DSP与数字功放芯片DPPC2006的接口设计-电子器件2008,31(5) 介绍了专业数字音频功放芯片DPPC2006和DSP TMS320VC5409芯片的主要特点.数字音频处理系统使用了TI公司的通用DSP 作为声场处理器,根据系统和IIS数字音频格式的要求,设计了DSP与DPPC2006的数字音频接口电路,并给出了DSP的McBSP串口软件设置程序.该设计实现了DSP在数字音频系统中的应用,增强了系统的灵活性,并经实验验证了该接口电路的可靠性. 7.期刊论文潘涛涛.张正炳.夏振华.PAN Tao-tao.ZHANG Zheng-bing.XIA Zhen-hua OMAP5912双核通信及其数字音频系统实现-电声技术2008,32(1) 根据OMAP5912双核的特点,详细叙述了双核间通信的几种方式和基础应用程序.并以基于OMAP5912的数字音频系统为例,介绍OMAP双核问通信的具体应用. 8.期刊论文曾荣.严国萍.陆牧基于Motorola DSP的数字音效处理系统-电声技术2002(12) 提出一种基于Motorola DSP56364的数字音效处理系统的设计方案.文中首先讨论数字音频系统设计需要注意的事项,接着分析DSP56364的ESAI接口通过I2S协议与外部A/D、D/A进行无缝连接的问题,并给出系统的流程和硬件结构框图.最后以典型的回声音效算法为例,说明基于该系统平台的软件处理流程.实验证明在该系统平台上可以很好的运行多种音效处理算法. 9.学位论文董志刚基于DSP的数字音频处理系统的设计与实现2008 数字信号处理是伴随数值计算技术和计算机技术的发展而迅速发展起来的新兴学科,特别是数字信号处理器(DSP)的出现,使其理论得以广泛应用于实际系统之中。MPEG 1-LAYERS是MPEG-1国际标准音频(ISO/IEC 11172)第三层编码/解码算法,它具有压缩比例高,还原音质好等诸多优点。利用这种标准制作的MP3格式音乐,己经在网络上得到极大流行。但是目前市场上的MP3播放器大都是基于专用ASIC,因此存在着功能单一,灵活性不够的特点。

视频原理 21世纪进入了信息化时代。随着信息技术的数字化、网络化、宽带化和综合化,使视频技术得到了长足的发展。在进入多媒体时代的今天,到处都可以见到各式各样的图像和视频产品,它们使我们的生活变得丰 富多彩。 图象与视频是两个既有联系又有区别的概念:静止的图片称为图象(Image),运动的图象称为视频(Video)。图象的输入要靠扫描仪、数字照相机或摄象机等;而视频的输入只能是摄象机、录象机、影碟机以及电视接收机等可以输出连续图象信号的设备。 本文将针对视频图像这一领域作一个概括的介绍,希望对大家进一步了解视频技术方面的知识有所帮助。 下面先对一些视频技术名词作一下简单解释。 视频信号的分类和基本概念 一、模拟视频信号 根据三基色原理,在视频领域利用R(红)、G(绿)、B(蓝)三色不同比例的混合来表现丰富多采的现实世界。首先,通过摄像机的光敏器件像CCD(电荷耦合器件),将光信号转换成RGB三路电信号;其次,在电视机或监视器内部也使用RGB信号分别控制三支电子枪轰击荧光屏以产生影象。这样,由于 摄像机中原始信号和电视机、监视器中的最终信号都是RGB信号,因此直接使用RGB信号作为视频信号的传输和记录方式会获得极高的信号质量。但这样做会极大地加宽视频带宽从而增加设备成本,且这也与 现行黑白电视不兼容,因此,在实际应用中不这样做,而是按亮度方程Y=0.39R+0.5G+0.11B(PAL制)RGB信号转换成亮度信号Y和两个色差信号U(B-Y)、V(R-Y),形成YUV分量信号。 此种信号利用人眼对亮度细节分辨率高而对色度细节分辨率低的特点,对U、V信号带宽压缩。U、V信号还可进一步合成一个色度信号C,进而形成Y/C记录方式。由于记录时对C信号采取降频处理,因此也称彩色降频方式。Y和C又可进一步形成复合视频(Composite),即彩色全电视信号,这种方式便于传输 和电视信号的发射。将RGB信号转换成YUV信号、Y/C信号直至composite信号的过程称为编码,逆过程则为解码。由此可看出,由于转换步骤的多少,视频输出质量由YUV端口到Y/C端口到Composite端 口依次降低。因此,在视频捕捉或输出时选择合适的输入、输出端口可提高视频质量。另外,还应提供同 步信号以保证传送图象稳定再现。 视频影像是由一系列被称为帧的单个静止画面组成。一般帧率在24-30帧/秒时,视频运动非常平滑,而低于15帧/秒时就会有停顿感。 NTSC:国家电视标准委员会(National Television Standards Commitee)的缩写。是中北美洲及日本通用的电视制式,与欧洲的PAL制式和法国的SECAM只是相对。他的垂直分辨率有525线,帧速为30(29.97)FPS。 PAL:逐行倒相(Phase Alteration Line)的缩写,是中国及欧洲大多数国家通用的电视制式。具有更高的垂直分辨率(625线),但是帧速相对慢于NTSC(25FPS)。 分量视频信号(Separate Video) :将画面按三个颜色通道(RGB)分成红、绿和蓝(附加亮度信号)三个单独信号通道。产生的画面质量较高,一般在广播级视频设备中被采用。 复合视频信号(Composite Video) :将彩色信号、亮度信号和同步信号混合在一个信号通道内,在家 用视频设备中被大量采用。

实验报告 课程名称数字音视频原理 实验题目MATLAB音频文件处理 专业电子信息工程 班级3班 学号09080323 学生姓名王志愿 实验成绩 指导教师吴娱 2012年3月 一、实验目的 1、掌握录制语音信号的基本过程; 2、掌握MATLAB编程对语音信号进行简单处理的方法并分析结果。 二、实验要求

上机完成实验题目,独立完成实验报告。 三、实验内容 1、问题的提出:数字语音是信号的一种,我们处理数字语音信号,也就是对一种信号的处理,那信号是什么呢? 信号是传递信息的函数。离散时间信号(序列)——可以用图形来表示。 按信号特点的不同,信号可表示成一个或几个独立变量的函数。例如,图像信号就是空间位置(二元变量)的亮度函数。一维变量可以是时间,也可以是其他参量,习惯上将其看成时间。信号有以下几种: (1)连续时间信号:在连续时间范围内定义的信号,但信号的幅值可以是连续数值,也可以是离散数值。当幅值为连续这一特点情况下又常称为模拟信号。实际上连续时间信号与模拟信号常常通用,用以说明同一信号。 (2)离散时间信号:时间为离散变量的信号,即独立变量时间被量化了。而幅度仍是连续变化的。 (3)数字信号:时间离散而幅度量化的信号。 语音信号是基于时间轴上的一维数字信号,在这里主要是对语音信号进行频域上的分析。在信号分析中,频域往往包含了更多的信息。对于频域来说,大概有8种波形可以让我们分析:矩形方波,锯齿波,梯形波,临界阻尼指数脉冲波形,三角波,余弦波,余弦平方波,高斯波。对于各种波形,我们都可以用一种方法来分析,就是傅立叶变换:将时域的波形转化到频域来分析。 2、设计方案: 首先要对声音信号进行采集,Windows自带的录音机程序可驱动声卡来采集语音信号,并能保存成.WAV格式文件,供MATLAB相关函数直接读取、写入或播放。 利用MATLAB中的wavread命令来读入(采集)语音信号,将它赋值给某一向量。再将该向量看作一个普通的信号,对其进行FFT变换实现频谱分析,再依据实际情况对它进行滤波。对于波形图与频谱图(包括滤波前后的对比图)都可以用MATLAB画出。我们还可以通过sound/wavplay命令来对语音信号进行回放,以便在听觉上来感受声音的变化。 3、主体部分: (1)语音的录入与打开: [x,fs,bits]=wavread('d:\1.wav');%用于读取语音,采样值放在向量x中,fs 表示采样频率(Hz),bits表示量化位数。

BIAMP Nexia CS数字音频处理器 [会议系统]适用于需要大量话筒的应用环境,诸如法庭,会议室,理事会等场合。 Nexia CS是一台数字信号处理器,配有10路话筒/线路输入和6路独立的混合输出,可满足会议室、法庭和理事会等场合的会议应用。Nexia的设计软件中提供了大量的路由选择、信号处理等模块,用户可以通过PC软件来对系统进行搭积木式的设计。通过控制软件的屏幕、RS-232接口或者其他兼容的遥控设备可以对Nexia CS进行控制。利用以太网和NexLink数字音频接口,多台Nexia 设备可以联机构成大系统工作。 特性: 10路平衡式话筒/线路输入,采用裸线接口端子。 6路平衡式输出,采用裸线接口端子。 以太网接口用于软件设置/控制。 串行接口用于第三方RS-232远程控制。 远程控制母线用于特制的控制面板。 NexLink接口用于多台设备联机工作。 NEXIA软件,可工作在WindowsNT4.0/2000/XP。 固定数量的输入输出接口,内部处理可自由设定。 具有混合、线路交换、组合、均衡、延时、控制等多种功能。 CE认证标志,通过CSA UL6500标准测试。 设计师和工程师用指标说明 数字会议系统应该具备10路配有裸线接口端子的平衡式话筒/线路输入和6路配有裸线接口端子的平衡式线路输出。输入输出都是模拟信号,设备内部采用24-bit量化、48kHz取样频率进行模拟/数字和数字/模拟转换。所有的内部处理都是数字处理。采用NexLink连接后,允许在多台设备间共享数字音频信

号。 可以用软件来创建或者连接每一台硬件设备中数字信号处理组件。可选用的系统组件应该包括(并不限定于):调音台、均衡器、分频器、动态增益控制器,路由选择、延时器、远程控制器、电平表、信号发生器以及诊断器。软件设置和控制可通过以太网连接进行操作。设定完成之后,处理器可以通过软件显示屏进行控制。第三方RS-232控制系统和第三方遥控设备都可以用来控制本设备。软件可以在一台工作在Windows NT4.0/2000/XP下,配有网卡的个人电脑下运行。 Nexia CS就是满足以上要求的数字会议系统。 各模块界面: (1)输入/输出模块界面 输入/输出10进6出界面 (2)其它模块界面与Nexia SP相同。

视频编码的基本原理及基本框架 视频图像数据有极强的相关性,也就是说有大量的冗余信息。其中冗余信息可分为空域冗余信息和时域冗余信息。压缩技术就是将数据中的冗余信息去掉(去除数据之间的相关性),压缩技术包含帧内图像数据压缩技术、帧间图像数据压缩技术和熵编码压缩技术。 去时域冗余信息 使用帧间编码技术可去除时域冗余信息,它包括以下三部分: -运动补偿 运动补偿是通过先前的局部图像来预测、补偿当前的局部图像,它是减少帧序列冗余信息的有效方法。 -运动表示 不同区域的图像需要使用不同的运动矢量来描述运动信息。运动矢量通过熵编码进行压缩。-运动估计 运动估计是从视频序列中抽取运动信息的一整套技术。 注:通用的压缩标准都使用基于块的运动估计和运动补偿 去空域冗余信息 主要使用帧内编码技术和熵编码技术: -变换编码 帧内图像和预测差分信号都有很高的空域冗余信息。变换编码将空域信号变换到另一正交矢量空间,使其相关性下降,数据冗余度减小。 -量化编码 经过变换编码后,产生一批变换系数,对这些系数进行量化,使编码器的输出达到一定的位率。这一过程导致精度的降低。

熵编码是无损编码。它对变换、量化后得到的系数和运动信息,进行进一步的压缩。 视频编码的基本框架 H.261 H.261标准是为ISDN设计,主要针对实时编码和解码设计,压缩和解压缩的信号延时不超过150ms,码率px64kbps(p=1~30)。 H.261标准主要采用运动补偿的帧间预测、DCT变换、自适应量化、熵编码等压缩技术。只有I帧和P帧,没有B帧,运动估计精度只精确到像素级。支持两种图像扫描格式:QCIF 和CIF。 H.263 H.263标准是甚低码率的图像编码国际标准,它一方面以H.261为基础,以混合编码为核心,其基本原理框图和H.261十分相似,原始数据和码流组织也相似;另一方面,H.263也吸收了MPEG等其它一些国际标准中有效、合理的部分,如:半像素精度的运动估计、PB帧预测等,使它性能优于H.261。 H.263使用的位率可小于64Kb/s,且传输比特率可不固定(变码率)。H.263支持多种分辨率:SQCIF(128x96)、QCIF、CIF、4CIF、16CIF。 与H.261和H.263相关的国际标准 与H.261有关的国际标准 H.320:窄带可视电话系统和终端设备; H.221:视听电信业务中64~1 920Kb/s信道的帧结构; H.230:视听系统的帧同步控制和指示信号; H.242:使用直到2Mb/s数字信道的视听终端的系统。 与H.263有关的国际标准 H.324:甚低码率多媒体通信终端设备; H.223:甚低码率多媒体通信复合协议; H.245:多媒体通信控制协议; G.723.1.1:传输速率为5.3Kb/s和6.3Kb/s的语音编码器。 JPEG 国际标准化组织于1986年成立了JPEG(Joint Photographic Expert Group)联合图片专家小组,主要致力于制定连续色调、多级灰度、静态图像的数字图像压缩编码标准。常用的基于离散余弦变换(DCT)的编码方法,是JPEG算法的核心内容。

怎样使用数字音频处理器现在数字音频处理器越来越多地运用到工程当中了,对于有基础有经验的人来说,处理器是一个很好用的工具,但是,对于一些经验比较欠缺的朋友来说,看着一台处理器,又是一大堆英文,不免有点无从下手。其实不用慌,我来介绍一下处理器使用步骤,以一个2进4出的处理器控制全频音箱+超低音音箱的系统为例 1、首先是用处理器连接系统,先确定好哪个输出通道用来控制全频音箱,哪个输出通道用来控制超低音音箱,比如你用输出1、2通道控制超低音,用输出3、4通道控制全频。接好线了,就首先进入处理器的编辑(EDIT)界面来进行设置,进入编辑界面不同的产品的方法不同,具体怎么进入,去看说明书。 2、利用处理器的路由(ROUNT)功能来确定输出通道的信号来自哪个输入通道,比如你用立体声方式扩声形式,你可以选择输出通道1、3的信号来自输入A,输出通道的2、4的信号来自输入B。信号分配功能不同的产品所处的位置不同,有些是在分频模块里,有些是在增益控制模块里,这个根据说明书的指示去找。 3、根据音箱的技术特性或实际要求来对音箱的工作频段进行设置,也就是设置分频点。处理器上的分频模块一般用CROSSOVER或X-OVER表示,进入后有下限频率选择(HPF)和上限频率选择(LPF),还要滤波器模式和斜率的选择。首先先确定工作频段,比如超低音的频段是40-120赫兹,你就把超低音通道的HPF设置为40,LPF设置为120。全频音箱如果你要控制下限,就根据它的低音单元口径,设置它的HPF大约在50-100Hz,。处理器滤波器形式选择一般有三种,bessel,butterworth和linky-raily,我以前有帖子专门说明过三种滤波器的不同之处,这里不赘述。常用的是butterworth和linky-raily两种,然后是分频斜率的选择,一般你选24dB/oct就可以满足大部分的用途了。 4、这个时候你需要检查一下每个通道的初始电平是不是都在0dB位置,如果有不是0的,先把它们都调到0位置上,这个电平控制一般在GAIN功能里,DBX的处理器电平是在分频器里面的,用G表示。 5、现在就可以接通信号让系统先发出声音了,然后用极性相位仪检查一下音箱的极性是否统一,有不统一的,先检查一下线路有没有接反。如果线路没接反,而全频音箱和超低音的极性相反了,可以利用处理器输出通道的极性翻转功能(polarity或pol)把信号的极性反转,一般用Nomal或“+”表示正极性,用INV或“-”表示负极性。 6、接下来就要借助SIA这类工具测量一下全频音箱和超低音的传输时间,一般来说是会有差异的,比如测到全频的传输时间是10ms,超低音是18ms,这个时候就要利用处理器的延时功能对全频进行延时,让全频和低音的传输时间相同。处理器的延时用DELAY或DLY表示,有些用m(米)有些用MS(毫秒)来显示延时量,SIA软件也同时提供了时间和距离的量,你可以选择你需要的数据值来进行延时 7、接下来就该进行均衡的调节了,可以配合测试工具也可以用耳朵来调,处理器的均衡用EQ来表示,一般都是参量均衡(PEQ),参量均衡有3个调节量,频率(F),带宽(Q 或OCT),增益(GAIN或G)。具体怎么调,就根据产品特性、房间特性和主观听觉来调了,这个就自己去想了。 8、均衡调好后,就要进行限幅器的设置了,处理器的限幅器用LIMIT来表示,进去以后一般有限幅电平(THRESHOLD),压缩比(RA TIO)的选项,你要做限幅就要先把压缩比RA TIO设置为无穷大(INF),然后配合功放来设置限幅电平,变成限幅器后,启动时间A TTACK和恢复时间RELEASE就不用去理了。DBX处理器的限幅器用PEAKSTOP来表示,启动后,直接设置限幅电平就可以了,至于怎么调限幅器,我有专门的帖子,自己去看。 9、都调好了就要保存数据,处理器的保存一般用STORE或SA VE表示,怎么存,就看产品说明书了。

1. 扩声系统升级改造 (1)新增2台数字音频处理器。该处理器需要和原有视频会议系统、数字会议系统、讲台话筒、现场图传背包TVU系统、无线麦克风、控制室电脑、有线电视等信号源(原调音台连接图附件1图1所示)和新增录播系统进行音频集成,实现各系统音频信号的任意路由和控制。处理器具备12进8出,12路输入通道带AEC回声消除功能,拥有AVB网络接口,支持多达128X128AVB网络,具备 Speech Sense (语音触发技术)和 Sona AEC (回声消除技术)的新型处理算法,信号处理可通过软件直观的配置和控制,如:信号路由和混音、均衡、滤波、动态处理、延迟等。 (2)新增会场前后方音箱。在大厅前方选用2只柱状线列阵音箱,铰接列阵与线性列阵技术的结合,在大厅中后场两侧柱子上壁挂两只补声音箱,以满足中后场的声压级。 整个扩声系统改造后需要符合会场声学环境要求,声音清楚无回声,声音大小符合会场扩声需求。声学特性指标按中华人民共和国国家标准GB50371-2006《厅堂扩声系统设计规范》要求,列表如下: 2. 中控系统升级改造 新购一套中控系统,系统需具有双网卡功能,局域网端口用于连接主机到外部网络,ICSLAN端口连接AMX设备或其他第三方A/V设备使其独立于主要网络;同时支持IPv6和802.1X网络标准和特性;支持灵活的编程应用实现(RPM,NetLinx和Java);具有向后和跨平台的兼容性;具有自动诊断功能,能自动检测断线或连接错误的串口和红外端口;程序文件支持从USB驱动器导入/导出。 中控系统需要和原有及新增系统高度集成,将音频、视频、灯光、升降器、大屏控制等进行集中控制管理,能完成所有原系统控制部分的操作,支持一键式的模式切换,同时可支持此项目新购系统的统一控制。原中控系统连接示意图如下图所示:

Audio 系统构架 摘要:本课题主要研究音频的构架以及原理。这里的音频构架主要针对笔记本codec以及HAD LINK。通过对CODEC初始化,工作原理以及Azalia协议的描述来说明笔记本音频系统的构架。另外通过采样,D/A转换,编码,DSP处理,硬声卡等一系列的描述来体现整个音频系统的原理。 目录 第一章codec的介绍 (2) 1.1audio codec 2 1.2ALC662 2 1.3ALC662外围电路设计 3 第二章controller and LINK Protocol (7) 2.1 controller及其构架7 2.2 LINK上的流和频道8 2.3codec地址分配和握手方式11 第三章HDA controller和codec的初始化 (12) 3.1controller初始化12 3.2 codec的配置13 3.3CORB与RIRB 13 第四章采样和AD转换 (16) 4.1采样定理16 4.2采样电路18 4.3AD转换21 第五章音频信号的编码 (22) 5.1音频编码的由来23 5.2心里声学模型23 5.3 PE 值的计算27 5.3位元的分配以及帧格式28 5.5MP3的编码过程30 5.6子带滤波器31 5.7MDCT 32 5.8量化编码33

5.9总结36 第六章DSP, 硬声卡的简单介绍 (36) 6.1 DSP 36 6.2 硬声卡37 第一章codec的介绍 1.1audio codec Codec意思是数字信号编码器,其使用范围很广泛,在这里我们只讨论audio codec。audio codec在笔记本中其根本的作用主要是D/A,A/D转换。audio codec 从HAD LINK上接受到的是纯正的一帧一帧的音频采样信号(后续会对此详细描述),他就是通过对这些采样信号D/A转化得到最后的模拟声音信号的输出。当然audio codec也可以通过MIC,LINEIN等端口接受到模拟的音频信号,然后对这些信号进行A/D转换,再传输到上层编码,最后储存或者传输。下面我们以ALC662为列对CODEC做详细的描述。 1.2ALC662 ALC662是一款5.1声道的codec,包括:前声道左右,后声道左右,中间声道,再加一个低音炮一共为5.1声道。ALC662 LQFP48 pin封装,可以划分为数字部分和模拟部分两块。数字部分是与HDALINK连接的部分,有REST#,BITCLK,SYNC,SDOUT,SDIN,当然还有两个数字电以及数字地。REST#信号使CODEC进入一个上电完成状态,其内部寄存器恢复默认或保留值,另外REST#至少持续100us来使得BCLK跑到一个正确的值(内部PLL锁频需要的时间)。REST#是由HDA controller发出的,连接到HAD LINK上所有的device。当power up PCI reset或者软件通过CRST寄存器初始化link的时候都会产生REST#。BITCLK是有HAD controller发出的连接到link上所有设备的工作24M 参考时钟。SYNC是48KHZ流同步信号,每一帧中会包含一个到几个的流,给不同的设备,每个流的stream tag就是包含在SYNC信号中。SDOUT是有HDA controller发送到codec的数字信号,支持一对多连接,即LINK几个设备可以公用一个SDOUT。SDOUT是在clock上升和下降沿都采样的信号,一次其速率为