信息论的由来发展

科学技术的发展是人类正在进入一个新的时代,这个时代的主要特征之一就是对信息的需求和利用,因此有人称之为信息时代。而迄今为止,人们对信息都没有确切定义,但是它是一种人人皆知、不言自明的抽象概念。信息虽无确切定义,但是却有两个明显的特征:广泛性与抽象性,信息时组成客观世界并促进社会发展的最基本的三大要素之一(物质、能量和信息)。它依附于物质和能量,但又不同于物质和能量。没有信息就不能更好地利用物质和能量,人类利用信息和知识改造物质,创造新物质,提高能量利用效率,发现新能量形式。信息也是客观存在的,它是人类认识、改造客观世界的主要动力,是人类认识客观世界的更高层次。人类社会的生存和发展无时无刻都离不开信息的获取、传递、处理、再生、控制和利用。

信息论正是一门把信息作为研究对象,以揭示信息的本质特征和规律为基础,应用概率论、随机过程和数理统计等方法来研究信息的存储、传输、处理、控制和利用等一般规律的科学。自从1948年贝尔研究所的香农发表了《通信的数学理论》一文,宣告了信息论作为一门独立的、全新的学科成立。自此以后,信息理论本身得到不断地发展和深化,尤其是在信息理论的指导下,信息技术也获得飞快发展。这又使信息的研究冲破了香农狭义信息的范畴,几乎渗透到自然科学与社会科学的所有领域,从而形成了一门具有划时代意义的新兴学科——信息科学。信息科学是人们在对信息的认识与利用不断扩大的过程中,在信息论、电子学、计算机科学、人工智能、系统工程学、自动化技术等多学科基础上发展起来的一门边缘性新学科。它的任务主要是研究信息的性质,研究机器、生物和人类关于各种信息的获取、变换、传输、处理、利用和控制的一般规律,设计和研制各种信息机器和控制设备,实现操作自动化,以便尽可能地把人脑从自然力的束缚下解放出来,提高人类认识世界和改造世界的能力。信息科学在安全问题的研究中也有着重要应用。

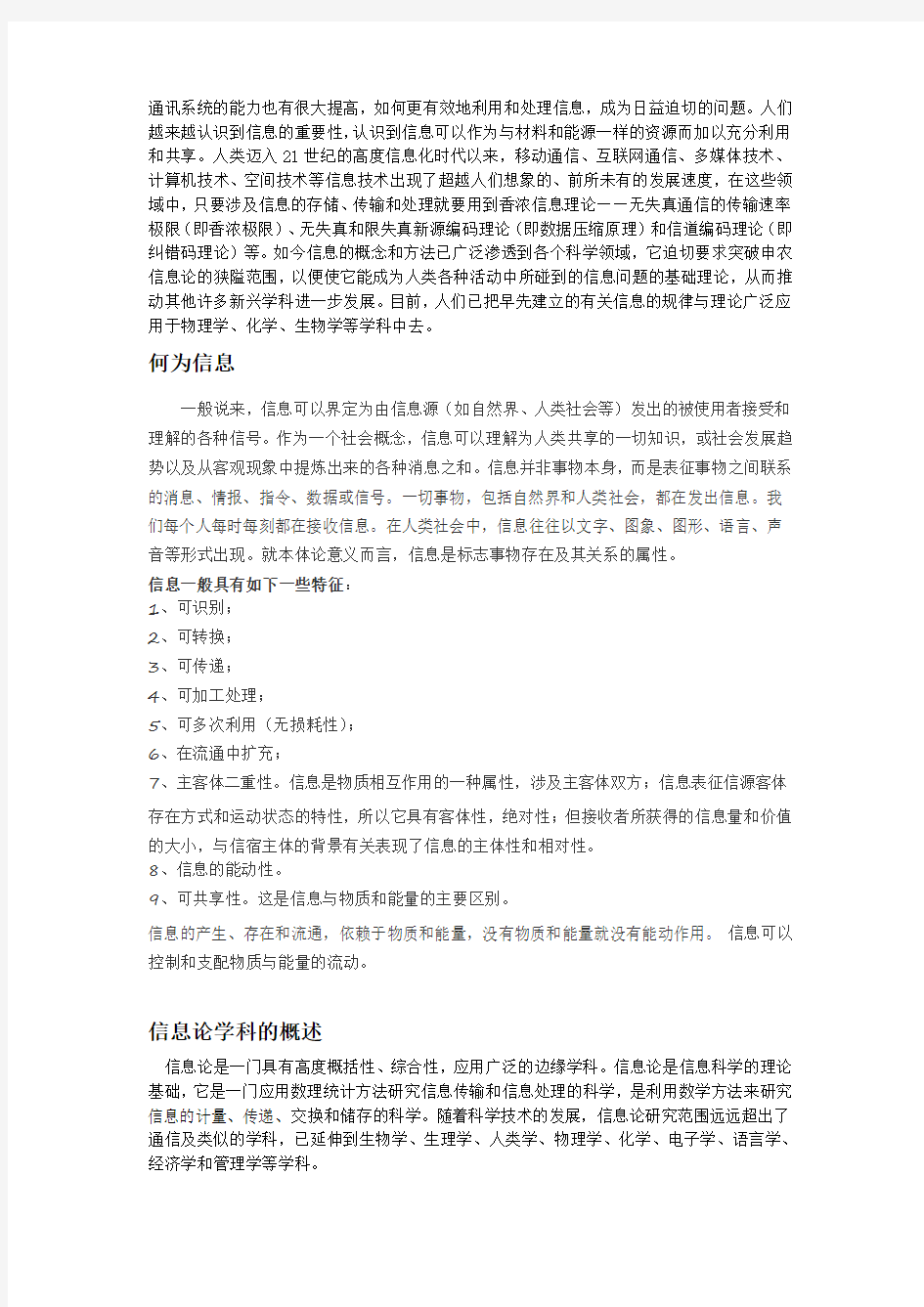

1924年H.Nyquist开始分析电报信号传输中脉冲速率与信道带宽的关系

1928年R.V.L.Hartley提出信息应该由随机事件样本空间中元素的个数的对数值来衡量

1930年N.Wiener开始把傅里叶分析方法全面引入随机时间信号的研究中来

1936年 E.H.Armstrong提出频率调制

1939年H.Dudley发明了声码器

1948年N.Wiener发表《控制论》

1948年 C.E.Shannon发表《通信的数学理论》

1952年 D.A.Huffman提出了Huffman编码

1954年P.Elias提出了卷积码

1959年S.K.Kullback提出了鉴别信息的概念

1961年 C.E.Shannon提出了多用户信息论

1963年P.Elias提出了算术编码

1965年 A.N.Kolmogorov提出了通用编码

1982年G.Ungerboeck实现了网格编码调制

1993年Turbo码的性能已经非常接近于理论极限

上表记录了科学家们再信息科学发展中的重要贡献,反映了信息科学的发展历程。香农在论文《通讯的数学理论》中系统地提出了关于信息的论述,创立了信息论。维纳提出的关于度量信息量的数学公式开辟了信息论的广泛应用前景。1951年美国无线电工程学会承认信息论这门学科,此后得到迅速发展。20世纪50年代是信息论向各门学科冲击的时期,60年代信息论不是重大的创新时期,而是一个消化、理解的时期,是在已有的基础上进行重大建设的时期。研究重点是信息和信源编码问题。到70年代,由于数字计算机的广泛应用,

通讯系统的能力也有很大提高,如何更有效地利用和处理信息,成为日益迫切的问题。人们越来越认识到信息的重要性,认识到信息可以作为与材料和能源一样的资源而加以充分利用和共享。人类迈入21世纪的高度信息化时代以来,移动通信、互联网通信、多媒体技术、计算机技术、空间技术等信息技术出现了超越人们想象的、前所未有的发展速度,在这些领域中,只要涉及信息的存储、传输和处理就要用到香浓信息理论——无失真通信的传输速率极限(即香浓极限)、无失真和限失真新源编码理论(即数据压缩原理)和信道编码理论(即纠错码理论)等。如今信息的概念和方法已广泛渗透到各个科学领域,它迫切要求突破申农信息论的狭隘范围,以便使它能成为人类各种活动中所碰到的信息问题的基础理论,从而推动其他许多新兴学科进一步发展。目前,人们已把早先建立的有关信息的规律与理论广泛应用于物理学、化学、生物学等学科中去。

何为信息

一般说来,信息可以界定为由信息源(如自然界、人类社会等)发出的被使用者接受和理解的各种信号。作为一个社会概念,信息可以理解为人类共享的一切知识,或社会发展趋势以及从客观现象中提炼出来的各种消息之和。信息并非事物本身,而是表征事物之间联系的消息、情报、指令、数据或信号。一切事物,包括自然界和人类社会,都在发出信息。我们每个人每时每刻都在接收信息。在人类社会中,信息往往以文字、图象、图形、语言、声音等形式出现。就本体论意义而言,信息是标志事物存在及其关系的属性。

信息一般具有如下一些特征:

1、可识别;

2、可转换;

3、可传递;

4、可加工处理;

5、可多次利用(无损耗性);

6、在流通中扩充;

7、主客体二重性。信息是物质相互作用的一种属性,涉及主客体双方;信息表征信源客体存在方式和运动状态的特性,所以它具有客体性,绝对性;但接收者所获得的信息量和价值的大小,与信宿主体的背景有关表现了信息的主体性和相对性。

8、信息的能动性。

9、可共享性。这是信息与物质和能量的主要区别。

信息的产生、存在和流通,依赖于物质和能量,没有物质和能量就没有能动作用。信息可以控制和支配物质与能量的流动。

信息论学科的概述

信息论是一门具有高度概括性、综合性,应用广泛的边缘学科。信息论是信息科学的理论基础,它是一门应用数理统计方法研究信息传输和信息处理的科学,是利用数学方法来研究信息的计量、传递、交换和储存的科学。随着科学技术的发展,信息论研究范围远远超出了通信及类似的学科,已延伸到生物学、生理学、人类学、物理学、化学、电子学、语言学、经济学和管理学等学科。

信息科学是人们在对信息的认识与利用不断扩大的过程中,在信息论、电子学、计算机科学、人工智能、系统工程学、自动化技术等多学科基础上发展起来的一门边缘性新学科。它的任务主要是研究信息的性质,研究机器、生物和人类关于各种信息的获取、变换、传输、处理、利用和控制的一般规律,设计和研制各种信息机器和控制设备,实现操作自动化,以便尽可能地把人脑从自然力的束缚下解放出来,提高人类认识世界和改造世界的能力。信息科学在安全问题的研究中也有着重要应用。

信息论的研究对象

信源

产生消息的源,消息可以是文字,语言,图像。可以离散,可以连续。随即发生。研究的主要问题是消息的统计特性和产生信息的速率。

编码器

编码是把消息变换成信号的措施,而译码就是编码的发变换。编码器输出的是适合信道传输的信号,信号携带着消息,它是消息的载荷者。其中,编码器分为信源编码器和信道编码器。

信源编码器:对信源输出进行变换,求得有效性

信道编码器:对信源编码输出变换,提高抗干扰性

调制器:将信道编码输出变成适合信道传输的方式

信道

通信系统把载荷消息的信号从甲地传输到乙地的媒介或通道

干扰源

系统各部分引入的干扰,包括衰落,多径,码间干扰,非线性失真,加性噪声,这要是统计特性

信道的中心问题是研究信道的统计特性和传信能力,即信道容量

译码器

编码器的逆变换

中心问题是研究各种可实现的解调和译码的方法

信宿

信息的接收者,信源和信宿可处于不同地点和不同时刻

信息论研究的目的

研究通信系统的目的就是要找到信息传输过程的共同规律,以提高信息传输的可靠性。有效性。保密性和认证性,以达到信息传输系统最优化。

可靠性高,就是要使信源发出的消息经过信道传输以后,尽可能准确地。不失真地再现在接收端。

有效性高,就是经济效果好,即用尽可能短的时间和尽可能少的设备来传送一定数量的信息。

保密性,就是隐蔽和保护通信系统中传送的消息,使它只能被授权接收者获取,而不能被未授权者接受和理解。

认证性,就是接收者能正确判断所接收的消息的正确性,验证消息的完整性,而不是伪造的和被窜改的。

信息论研究的内容

信息论是一门用数理统计方法来研究信息的度量、传递和变换规律的科学。它主要是研究通讯和控制系统中普遍存在着信息传递的共同规律以及研究最佳解决信息的获限、度量、变换、储存和传递等问题的基础理论。

信息论的研究范围极为广阔。一般把信息论分成三种不同类型:

(1)狭义信息论是一门应用数理统计方法来研究信息处理和信息传递的科学。它研究存在于通讯和控制系统中普遍存在着的信息传递的共同规律,以及如何提高各信息传输系统的有效性和可靠性的一门通讯理论。

(2)一般信息论主要是研究通讯问题,但还包括噪声理论、信号滤波与预测、调制与信息处理等问题。其中维纳和香农等人都是运用概率和统计数学的方法来研究准确或近似地再现信息的问题,都是为了使信息传送和接收最优化。维纳研究的重点是在接收端。研究一个信号如果在传输过程中被某些因素所干扰后,在接收端怎样把它恢复、再现,从干扰中提取出来。在此基础上,创立了最佳线性滤波理论、统计检测和估计理论、噪声理论等。而香农研究的对象则是从信源到信宿之间的全过程,是收、发端联合最优化问题,其重点放在编码。他指出,只要在传输前后对消息进行适当的编码和译码,就能保证在干扰的存在下,最佳地传送和准确或近似地再现消息。为此发展了信息测度理论、信道容量理论和编码理论等。

(3)广义信息论不仅包括狭义信息论和一般信息论的问题,而且还包括所有与信息有关的领域,如心理学、语言学、神经心理学、语义学等。

信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信息传输定理、信源-信道隔离定理相互联系。

最后介绍一下信息论中衡量信息的几个重要的概念:

信息量——信息论中量度信息多少的一个物理量。它从量上反映具有确定概率的事件发生时所传递的信息。

信息熵(Entropy):是信息论中用于度量信息量的一个概念。一个系统越是有序,信息熵就越低;是一个数学上颇为抽象的概念,在这里不妨把信息熵理解成某种特定信息的出现概率。

条件熵(Conditional entropy):是信息论中信息熵的一种度量,它表示如果已经完全知道第二个随机变量 X 的前提下,随机变量 Y 的信息熵还有多少。也就是基于 X 的 Y 的信息熵。

相对熵(KL-Divergence):表示实际信源比理想信源的缩减程度.

互信息(Mutual information):它是指两个事件集合之间的相关性。

香农三大定理是信息论的基础理论。香农三大定理是存在性定理,虽然并没有提供具体的编码实现方法,但为通信信息的研究指明了方向。香农第一定理是可变长无失真信源编码定理。香农第二定理是有噪信道编码定理。香农第三定理是保失真度准则下的有失真信源编码定理。具体如下:

一:香农第一定理(可变长无失真信源编码定理)

设信源S的熵[shāng]H(S),无噪离散信道的信道容量为C,于是,信源的输出可以进行这样的编码,使得信道上传输的平均速率为每秒(C/H(S)-a)个信源符号.其中a可以是任意小的正数, 要使传输的平均速率大于(C/H(S))是不可能的。

二:香农第二定理(有噪信道编码定理)

设某信道有r个输入符号,s个输出符号,信道容量为C,当信道的信息传输率R码长N足够长,总可以在输入的集合中(含有r^N个长度为N的码符号序列),找到M

(M<=2^(N(C-a))),a为任意小的正数)个码字,分别代表M个等可能性的消息,组成一

个码以及相应的译码规则,使信道输出端的最小平均错误译码概率Pmin达到任意小。

三:香农第三定理(保失真度准则下的有失真信源编码定理)

设R(D)为一离散无记忆信源的信息率失真函数,并且选定有限的失真函数,对于

任意允许平均失真度D>=0,和任意小的a>0,以及任意足够长的码长N,则一定存在一

种信源编码W,其码字个数为M<=EXP{N[R(D)+a]},而编码后码的平均失真度

D'(W)<=D+a。

信息论的应用举例

---------信息论在网络集成教学中的应用

经过近半个世纪许多科学家的深入研究和发展,使得信息论已成为通信工程方面较为系统完整的理论基础。虽然这些新的概念和方法总的来说还不成熟,但这种新思路、新方法给复杂系统的研究带来了希望。人们运用信息观点和方法来解释物理学、光学、化学、生物学、心理学及社会管理学、经济学等领域中的问题,取得了扎实的进展。我们下面以网络集成教学为例,看看信息论在其中的应用。

一、网络集成课程准备阶段的信息论应用

课程准备包括教学内容准备、教学环节准备、教学方法准备、教学评价准备等几个方面。课程的准备实质是信息资源的处理,它是依赖人的理解能力的概念化的内容,学生通过阅读、聆听、感知等认知方法处理接收到的信息。教师在课程准备阶段就要考虑到所要传递的信息的形式、性质、编码形式等因素。

网络集成教学内容包括网络设计与网络管理、网络标准与标准化、网络施工与测试及新产品开发等内容。现在的教材都有一个普遍不足,就是滞后于现实网络的发展。另外在当今这样一个信息时代,学生获取网络集成信息的渠道很广,所以时常出现学生掌握的某些网络知识深于教材、广于教材的现象,所以一味的按照教材准备课程会很被动。

(一)在教学内容准备上,根据信息论的理论,若某一事件产生的概率是P,此时的

信息量为:H=-log2p。事件发生的概率越小,所含信息量越大[3]。教学内容的准备是对小概率内容的编码,即对专业性、技术性强的知识点进行组合、构造,以便保证充足的信息量,并且安排适当的信息点密度。

(二)在教学环节准备上,根据信息编码的原理,建议采用哈夫曼编码。哈夫曼编码是一种无损压缩编码,它的编码思想是对于出现概率高的信息,编码长度较短,即可以简单表示或不表示;对于出现概率低的内容(即独特的网络特征)应重点表示,以达到用最经济的成本实现最大的信息到达率。

(三)在教学方法准备上,根据信息传输原理中的香农公式C=Wlog(1+S/N),S/N是信噪比,C是教学效果,W是教学方法。根据这个公式可知,要提高有效信息,就必须抑制噪声,减小干扰。为了实现这个目标,应该对传递信息的信道加以甄选。

(四)在教学评价准备上,改革课程的评价方式,是课程改革的关键环节。传统的网络集成课程考核形式较为单一,主要是闭卷笔试,不能全面反映出学生对网络集成的知识和技能的真正掌握情况,特别是技能方面的能力在闭卷笔试中往往是很难得体现出来的。按照信息论原理对学生接收、掌握的信息量进行评价,主要运用概率理论。具体的评价方法应该是多元化的,比如形成性考核、笔试、实训考核及论文考核等形式,综合运用这些评价方法可以有效地检测出学生对课程掌握的真实情况。

课程准备阶段是教学环节中关键阶段,不仅要针对教学内容、教学方法、教学方法进行准备,还应该针对不同的专业实际需要,针对不同的学生特点有重点的、分层次备课。在学时安排、具体教学内容上要体现差异性,改变过去单纯追求网络集成课程体系自身的系统性和完整性情况。

二、网络集成课程课堂教学阶段的信息论应用

教学过程是一种教师与学生间以语言进行信息传递的过程,教学过程可以通过教师与学生语言序列的记录来表述。在对教学过程中教师与学生的语言进行统计分析时,发现传统的讲授方法,存在信息量小、传输方式呆板、模式陈旧的缺点。

所以当今的课堂教学应注重转变传统教学模式,进行形式丰富、贴近实际的教学改革,以符合现代教育培养人才的标准。新的标准不是以掌握理论知识和传统的课程体系来衡量,而是以分析问题解决问题的能力及实践动手能力的强弱为标准。因而传统的教学方式已不能满足需要,教学改革成为必然。根据信息论原理中的香农公式C=Wlog(1+S/N),教学效果C随着教学方法W改善,但是C与W的关系是非线性的,W→∞时,C→1.44,而不是∞[3]。结论是改革教学方法,可以提高教学效果,但不可能无限提高教学效果。我们应该一方面改革教学方法,另一方面通过完善教学大纲、充实教学内容等多种渠道来进一步提高教学水平。

信息论基础发展史 信息论(information theory)是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。是专门研究信息的有效处理和可靠传输的一般规律的科学,是研究通讯和控制系统中普遍存在着信息传递的共同规律以及研究最佳解决信息的获限、度量、变换、储存和传递等问题的基础理论。信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信息传输定理、信源-信道隔离定理相互联系。 信息论从诞生到今天,已有五十多年历史,是在20世纪40年代后期从长期通讯实践中总结出来的,现已成为一门独立的理论科学,回顾它的发展历史,我们可以知道理论是如何从实践中经过抽象、概括、提高而逐步形成的。它是在长期的通信工程实践和理论研究的基础上发展起来的。 通信系统是人类社会的神经系统,即使在原始社会也存在着最简单的通信工具和通信系统,这方面的社会实践是悠久漫长的。电的通信系统(电信系统)已有100多年的历史了。在一百余年的发展过程中,一个很有意义的历史事实是:当物理学中的电磁理论以及后来的电子学理论一旦有某些进展,很快就会促进电信系统的创造发明或改进。 当法拉第(M.Faraday)于1820年--1830年期间发现电磁感应的基本规律后,不久莫尔斯(F.B.Morse)就建立起电报系统(1832—1835)。1876年,贝尔(A.G.BELL)又发明了电话系统。1864年麦克斯韦(Maxell)预言了电磁波的存在,1888年赫兹(H.Hertz)用实验证明了这一预言。接着1895年英国的马可尼(G.Marconi)和俄国的波波夫(A.C.ΠoΠoB)就发明了无线电通信。本世纪初(1907年),根据电子运动的规律,福雷斯特(1,Forest)发明了能把电磁波

学号:201122010835 姓名:李毅 信息论在图像处理中的应用 摘要:把信息论的基本原理应用到图像处理中具有十分重要的价值。本文主要从评估图像捕捉部分性能的评估、图像分割算法这两个个方面阐述信息论在图像处理中的应用。 通过理论分析来说明使用信息论的基本理论对图像处理的价值。 关键字:信息论;图像捕捉;图像分割 第1章 引言 随着科学技术的不断发展,人们对图形图像认识越来越广泛,图形图像处理的应用领域也将随之不断扩大。为了寻找快速有效的图像处理方法,信息理论越来越多地渗透到图像处理技术中。文章介绍了信息论基本理论在图像处理中的应用,并通过理论分析说明其价值。把通信系统的基本理论信息论应用于采样成像系统,对系统作端到端的系统性能评价,从而优化采样成像系统的设计,是当前采样成像系统研究的分支之一。有些图像很繁杂,而我们只需要其中有意义的一部分,图像分割就是将图像分为一些有意义的区域,然后对这些区域进行描述,就相当于提取出某些目标区域图像的特征,随后判断这些图像中是否有感兴趣的目标。 第2章 图像捕捉部分性能评估 2.1 图像捕捉的数学模型 图像捕捉过程如图1所示。G 为系统的稳态增益,),(y x p 是图像捕捉设备的空间响应函数,),(y x n p 是光电探索的噪声。),(y x comb 代表采样网格函数,),(),,(y x s y x o 分别为输入、输出信号。 在这种模型下的输出信号 ),(),()],(),([),(y x n y x comb y x p y x Go y x s p +*= 其中,∑--= n m n y m x y x comb ,),(),(δ,代表在直角坐标系下,具有单位采样间隔的采样设备的采样函数。

模拟试题一 一、概念简答题(共10题,每题5分) 1.简述离散信源和连续信源的最大熵定理。 2.什么是平均自信息(信息熵)?什么是平均互信息?比较一下两个概念的异同之处。 3.解释等长信源编码定理和无失真变长信源编码定理,说明对于等长码和变长码,最佳码的每符号平均码长最小为多少?编码效率最高可达多少? 4.解释最小错误概率译码准则,最大似然译码准则和最小距离译码准则,说明三者的关系。 5.设某二元码字C={111000,001011,010110,101110}, ①假设码字等概率分布,计算此码的编码效率? ②采用最小距离译码准则,当接收序列为110110时,应译成什么码字? 6.一平稳二元信源,它在任意时间,不论以前发出过什么符号,都按 发出符号,求

和平均符号熵 7.分别说明信源的概率分布和信道转移概率对平均互信息的影响,说明平均互信息与信道容量的关系。 8.二元无记忆信源,有求: (1)某一信源序列由100个二元符号组成,其中有m个“1”,求其自信息量?

(2)求100个符号构成的信源序列的熵。 9.求以下三个信道的信道容量: , ,10.已知一(3,1,3)卷积码编码器,输入输出关系为:

试给出其编码原理框图。 二、综合题(共5题,每题10分) 1.二元平稳马氏链,已知P(0/0)=0.9,P(1/1)=0.8,求: (1)求该马氏信源的符号熵。 (2)每三个符号合成一个来编二进制Huffman码,试建立新信源的模型,给出编码结果。 (3)求每符号对应的平均码长和编码效率。 2.设有一离散信道,其信道矩阵为,求:(1)最佳概率分布?

1、平均自信息为 表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。 平均互信息 表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。 2、最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。 3、最大熵值为。 4、通信系统模型如下: 5、香农公式为为保证足够大的信道容量,可采用(1)用频带换信噪比;(2)用信噪比换频带。 6、只要,当N足够长时,一定存在一种无失真编码。 7、当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。 8、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。 9、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

按照信息的地位,可以把信息分成 客观信息和主观信息 。 人们研究信息论的目的是为了 高效、可靠、安全 地交换和利用各种各样的信息。 信息的 可度量性 是建立信息论的基础。 统计度量 是信息度量最常用的方法。 熵 是香农信息论最基本最重要的概念。 事物的不确定度是用时间统计发生 概率的对数 来描述的。 10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用 随机矢量 描述。 11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为 其发生概率对数的负值 。 12、自信息量的单位一般有 比特、奈特和哈特 。 13、必然事件的自信息是 0 。 14、不可能事件的自信息量是 ∞ 。 15、两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。 16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量 趋于变小 。 17、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍 。 18、离散平稳有记忆信源的极限熵,=∞H )/(lim 121-∞→N N N X X X X H Λ。 19、对于n 元m 阶马尔可夫信源,其状态空间共有 nm 个不同的状态。 20、一维连续随即变量X 在[a ,b]区间内均匀分布时,其信源熵为 log2(b-a ) 。 21、平均功率为P 的高斯分布的连续信源,其信源熵,Hc (X )=eP π2log 21 2。 22、对于限峰值功率的N 维连续信源,当概率密度 均匀分布 时连续信源熵具

信息的内涵与信息论发展简史学院:数学与统计学院专业:信息与计算科学学生:卢富毓学号:20101910072 内容摘要:信息论经过六十多年的发展,现在已经成为现代信息科学的一个重要组成部分,信息论是现代通信和信息技术的理论基础。本文详细从来阐述信息论的内涵以及发展史。 信息是什么?什么叫信息论? 信息泛指人类社会传播的一切内容。人通过获得、识别自然界和社会的不同信息来区别不同事物,得以认识和改造世界。在一切通讯和控制系统中,信息是一种普遍联系的形式。1948年,数学家香农在题为“通讯的数学理论”的论文中指出:“信息是用来消除随机不定性的东西”。美国数学家、控制论的奠基人诺伯特·维纳在他的《控制论——动物和机器中的通讯与控制问题》中认为,信息是“我们在适应外部世界,控制外部世界的过程中同外部世界交换的内容的名称”。英国学者阿希贝认为,信息的本性在于事物本身具有变异度。 由此可见在不同的领域,有着对信息的不同定义。 而如今比较首肯的是数学家香农给出的解释——信息是用来消除随机不定性的东西。 信息论是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。 信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信息传输定理、信源-信道隔离定理相互联系。 1948~1949年,香农(Shannon)在《贝尔系统技术杂志》上发表了论文《通信的数学理论》以及《噪声下的通信》。在这两篇论文中,他经典地阐明了通信的基本问题,提出了通信系统的模型,给出了信息量的数学表达式,解决了信道容量、信源统计特性、信源编码、信道编码等有关精确地传送通信符号的基本技术问题,并且开始创造性的定义了“信息”。这两篇论文成了现在信息论的奠基著作。而香农也一鸣惊人,成了这门新兴学科的奠基人。香农也因此被称为是“信息论之父”。 信息有什么内涵? 信息是现代社会的一种非常重要的资源,信息社会中的信息就像农业社会的土地,工业社会的资金和技术一样,将会成为人们竞相争夺的对象,从某种意义上来说,信息就是现代社会最重要的财富,谁掌握了信息,谁就掌握了未来。 信息的内涵是什么呢? 不同人对信息有着不同的理解。有人认为信息就是消息,传递信息就是传递消息。这种定义有一定道理,但不太准确。信息和消息是有区别的,一般来说,

一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。定义另一个二元随机变量Z,取Z=YX(一般乘积)。试计算: 1、H(Y)、H(Z); 2、H(YZ); 3、I(X;Y)、I(Y;Z); 二、如图所示为一个三状态马尔科夫信源的转移概率矩阵 1. 绘制状态转移图; 2、 求该马尔科夫信源的稳态分布; 3、 求极限熵 ; 三、在干扰离散对称信道上传输符号1与0,已知P(0)=1/4,P(1)=3/4,试求: 1. 信道转移概率矩阵P 2、信道疑义度 3、信道容量以及其输入概率分布 四、某信道的转移矩阵?? ????=1.006.03.001.03.06.0P ,求信道容量,最佳输入概率分布。 五、求下列各离散信道的容量(其条件概率P(Y/X)如下 :) 六、求以下各信道矩阵代表的信道的容量

答案 一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。定义另一个二元随机变量Z,取Z=YX(一般乘积)。试计算: 1、H(Y)、H(Z); 2、H(XY)、H(YZ); 3、I(X;Y)、I(Y;Z); 解:1、 2 i 11111H Y P y logP y log log 2222i i =??=-+????∑()=-()()=1bit/符号 Z=YX 而且X 与Y 相互独立 ∴ 1(1)(1)(1)P P X P Y P X ?=+=-?=-(Z =1)=P(Y=1)= 1111122222 ?+?= 2(1)(1)(1)P P X P Y P X ?=-+=-?=(Z =-1)=P(Y=1)= 1111122222 ?+?= 故H(Z)= i 2i 1(z )log (z )i P P =- ∑=1bit/符号 2、从上式可以瞧出:Y 与X 的联合概率分布为:

信息论的发展及应用 信息论是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。 信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信息传输定理、信源-信道隔离定理相互联系。信息论经过六十多年的发展,现在已经成为现代信息科学的一个重要组成部分,信息论是现代通信和信息技术的理论基础。现代信息论又是数学概率论与数理统计下年的一个分支学科。现在信息论已经成为国内数学系信息与计算科学专业的一门必须课程。作为信息论的奠基人克劳德·艾尔伍德·香农(Claude Elwood Shannon ),于1948 年和1949 年发表的两篇论文一起奠定了现代信息论的基础信息论的研究范围极为广阔。一般把信息论分成三种不同类型: (1)狭义信息论是一门应用数理统计方法来研究信息处理和信息传递的科学。它研究存在于通讯和控制系统中普遍存在着的信息传递的共同规律,以及如何提高各信息传输系统的有效性和可靠性的一门通讯理论。 (2)一般信息论主要是研究通讯问题,但还包括噪声理论、信号滤波与预测、调制与信息处理等问题。 (3)广义信息论不仅包括狭义信息论和一般信息论的问题,而且还包括所有与信息有关的领域,如心理学、语言学、神经心理学、语义学等。

信息论发展: 1924年,Nyquist提出信息传输理论; 1928年,Hartley提出信息量关系; 1932年,Morse发明电报编码; 1946年,柯切尼柯夫提出信号检测理论; 1948年,Shannon提出信息论,他发表的论文:“A mathematical theory of communication ”同时维纳提出了最佳滤波理论,成为信息论的一个重要分支。 1959年,香农为各种信息源编码的研究奠定基础,发表论文:“Coding theorems for a discrete source with a fidelity criterion”,数据压缩理论与技术成为信息论的重要分支 六十年代,信道编码技术有较大的发展,信道编码成为信息论重要分支。 1961年,香农的重要论文“双路通信信道”开拓了多用户信息理论的研究、 七十年代,有关信息论的研究,从点对点的单用户通信推广到多用户系统的研究。密码学成为信息论的重要分支。 详细介绍; 现代信息论其实是从上世纪二十年代奈奎斯特和哈特莱的研究开始的,他们最早开始研究了通信系统传输信息的能力,并且试图度量系统的信道容量。香农于1940 年在普林斯顿高级研究所期间开始思考信息论与有效通信系统的问题。经过8 年的努力,1948

简述通信行业的发展历程 摘要:本文简要叙述了通信技术的基本概念和主要发展历程,并以时间表的形式分析和记录了中国电信行业的主要发展史,并简要介绍了作为下一代通信技术的4G网络技术的基本原理和运用,并简要归纳了4G网络技术目前在国内的发展现状。 关键字:通信、通信技术、运营商、4G 一、通信的基本概念和主要发展历程 通信技术是当代生产力中最为活跃的技术因素,对生产力的发展和人类社会的进步起着直接的推动作用。通信最主要的目的就是传递信息。最早的通信包括最古老的文字通信以及我国古代的烽火台传信。而当今所谓的通信技术是指18世纪以来的以电磁波为信息传递载体的技术。通信技术的发展历史上主要经历了三个阶段: 初级通信阶段(以1839年电报发明为标志) 近代通信阶段(以1948年香农提出的信息论为标志) 现代通信阶段(以20世纪80年代以后出现的互联网、光纤通信、移动通信等技术为标志) 从1838年莫尔斯发明电报开始,通信技术经历了从架空明线、同轴电缆到光导纤维,从步进展、纵横制导数字程控交换机,从固定电话、卫星通信到移动电话、从模拟通信技术到数字通信技术的演进。通信技术每一次的重大进步,都极大地提升了通信网的能力和扩展了通信业务,如从过去的电报、传真、电话到现在的可视电话、即时通信(QQ&MSN)和电子邮件(E-mail)等,给通信行业发展注入了新活力,推动了社会通信服务水平的提高。现在通信技术和业务已

渗透到人们生活娱乐、工作学习的方方面面,深刻地改变了人类社会的生活形态和工作方式。随着社会的发展和进步,人类对信息通信的需求更加强烈,对其要求也越来越高。理想的目标就是实现任何人在任何时候、任何地方与任何人以及相关物体进行任何形式的信息通信。 百年以来,通信技术一直由西方国家主导其发展。直到世纪之交,历史才发生改变。2000年5月,由大唐电信科技产业集团(电信科学技术研究院)代表我国政府提出的具有自主知识产权的TD-SCDMA,被国际电信联盟(ITU)采纳为3G无线移动通信国际标准。2001年3月被3GPP采纳,这是我国通信百年历史上零的突破。移动通信从只支持语音通信的第一代模拟移动通信系统(1G),发展到到支持话音和低速数据(短信、GPRS)等的第二代数字移动通信系统(2G),再到支持视频通信、高速数据以及多媒体业务的第三代移动通信系统(3G)。当前,处在从2G到3G转折时期的通信行业正经历着一场前所未有的深刻变革,包括技术、网络、业务以及运营模式。电路交换技术与分组交换技术融合,将导致电信网、计算机网和有线电视网在技术、业务、市场、终端、网络乃至行业运行管理和政策方面的融合。在业务竞争中,各个电信运营商也在打破传统电信的思维或疆界,开拓新的市场。 二、中国电信行业发展历程 1、1949——1994 政府行政绝对垄断 从1949年11月1日邮电部成立到1978年,整个电信企业完全依靠行政垄断进行经营,在管理上采用政企合一的方式。政府无论从经营业务到资费方面都实行严格的控制,完全是计划经济,完全是政府定价,而且它的服务主要是面向党、政、军的,并没有考虑到为个人服务。举例说,直到改革开放初期的1979

一、(11’)填空题 (1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 (2)必然事件的自信息是 0 。 (3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的 N倍。 (4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。 (5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为 3 。 (6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码。(7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。 (8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。(9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关 三、(5')居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1.6米以上的占总数的一半。 假如我们得知“身高1.6米以上的某女孩是大学生”的消息,问获得多少信息量? 解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则 P(A)=0.25 p(B)=0.5 p(B|A)=0.75 (2分) 故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0.75*0.25/0.5=0.375 (2分) I(A|B)=-log0.375=1.42bit (1分) 四、(5')证明:平均互信息量同信息熵之间满足 I(X;Y)=H(X)+H(Y)-H(XY) 证明:

信息论发展 现代信息论是从上世纪二十年代奈奎斯特和哈特莱的研究开始的,他们最早开始研究了通信系统传输信息的能力,并且试图度量系统的信道容量。香农于1940年在普林斯顿高级研究所期间开始思考信息论与有效通信系统的问题。经过8年的努力,1948年,来自贝尔研究所的ClaudeShannon(克劳德·香农)的《通信的数学理论》论文公诸于世,从此宣告了崭新的一门关于信息发面的学科──信息论的诞生。1949年,香农又在该杂志上发表了另一著名论文《噪声下的通信》。在这两篇论文中,香农阐明了通信的基本问题,给出了通信系统的模型,提出了信息量的数学表达式,并解决了信道容量、信源统计特性、信源编码、信道编码等一系列基本技术问题。两篇论文成为了信息论的奠基性著作。这两篇论文一起阐述了现代信息论的基础。并且香农开始创造性的定义了“信息”。 信息论自从二十世纪四十年代中叶到二十一世纪初期,现已成为一门独立的理论科学,他给出一切传输、存储、处理信息系统的一般理论,并指出,实现有效、可靠地传输和存储信息的途径是走数字化的道路。这是通信技术领域数字化革命的数学或理论基础。1946年的计算机和1947年晶体管的诞生和相应技术的发展,是这一革命的物理或物质基础。信息论是在长期的通信工程实践和理论研究的基础上发展起来的。当物理学中的电磁理论以及后来的电子学理论一旦有某些进展,很快就会促进电信系统的创造发明或改进。这是因为通信系统对人类社会的发展,其关系实在是太密切了。日常生活、工农业生产、科学研究以及战争等等,一切都离不开消息传递和信息流动。通信系统是人类社会的神经系统,即使在原始社会也存在着最简单的通信工具和通信系统,这方面的社会实践是悠久漫长的。自从香农十九世纪四十年代末两篇论文发表后,前苏联和美国的科学家采取了不同的研究途径经一部发展了信息论。柯尔莫哥洛夫、宾斯基和达布鲁新为首的一批著名数学家致力于信息论的公理化体系和更一般更抽象的数学模型,对信息论的基本定理给出了更为普遍的结果,为信息论发展成数学的一个分支作出了贡献。而在美国测试有一批数学修养很高的工程技术人员致力于信息有效处理和可靠传输的可实现性,维信息论转化为信息技术作出了贡献。 20世纪50年代,信息论向各门学科发起冲击;60年代信息论进入一个消化、

论人工智能的发展历程 王鑫涛16151228 摘要:人工智能的发展、人工智能的应用、人工智能的未来 关键字:人工智能、阿尔法围棋、AI 正文:近几年,人工智能这个话题变得越来越热门,尤其是在今年三月份的一场举世瞩目的人机围棋大赛后,人工智能这个话题在人们之间也是越来越普遍地被谈论。2016年3月,阿尔法围棋(AlphaGo)与围棋世界冠军、职业九段选手李世石进行人机大战,并以4:1的总比分获胜,不少职业围棋手认为,阿尔法围棋的棋力已经达到甚至超过围棋职业九段水平,在世界职业围棋排名中,其等级分曾经超过排名人类第一的棋手柯洁。那么,阿尔法围棋是什么呢,为什么这么厉害?阿尔法围棋(AlphaGo)是一款围棋人工智能程序,由谷歌(Google)旗下DeepMind公司的戴密斯·哈萨比斯、大卫·席尔瓦、黄士杰和与他们的团队开发,其主要工作原理是“深度学习”。“深度学习”是指多层的人工神经网络和训练它的方法。一层神经网络会把大量矩阵数字作为输入,通过非线性激活方法取权重,再产生另一个数据集合作为输出。这就像生物神经大脑的工作机理一样,通过合适的矩阵数量,多层组织链接一起,形成神经网络“大脑”进行精准复杂的处理,就像人们识别物体标注图片一样。通过上述所所,可见现在的人工智能已发展到一个相当高相当先进的程度了,那么,人工智能又是怎么一步步发展到今天的呢,它的未来又会是如何?我在这里就说一下自己对人工智能浅薄的见解。

一、什么是人工智能 人工智能(Artificial Intelligence),英文缩写为AI,也称机器智能。“人工智能”一词最初是在1956年的Dartmouth学会上提出的。它是计算机科学、控制论、信息论、神经生理学、心理学、语言学等多种学科互相渗透而发展起来的一门综合性学科。从计算机应用系统的角度出发,人工智能是研究如何制造智能机器或智能系统来模拟人类智能活动的能力,以延伸人们智能的科学。 人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能与人类智能相似的方式做出反应的智能机器。人工智能的发展史是和计算机科学与技术的发展史联系在一起的,目前能够用来研究人工智能的主要物质手段以及能够实现人工智能技术的机器就是计算机,人工智能在21世纪必将为发展国民经济和改善人类生活做出更大的贡献。 人类的科学演变已从单一的“数值计算”发展到系统的“逻辑计算”。人类正在将信息工程学逐步提入到计算机系统中,从而出现了“信息管理”“和“信息交换”等科学的迫切需求。而加速扩大“信息处理”层面来说,现有的计算机的处理数据能力是匹配不了的,缺少领域专业“智能”。这样的“计算机科学”已无法适应信息科学的发展需求。全球的信息科学正在逐步形成,Al作为现代信息科学发展的核心。从古至今人们对提及智能相关的问题就很感兴趣,只不过在计算机没有发明之前,没有任何高科技辅助工具能解开智能的奥秘。

信息论试卷题目及答案

————————————————————————————————作者:————————————————————————————————日期: 2

中国海洋大学2008—2009学年第一学期 一、填空题(每空2分,共20分) 1、1948年,美国数学家 香农 发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 2、信源编码的目的是提高通信的有效性。信道编码的最终目的是提高信号传输的可靠性。 3、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的N 倍。 4、对于香农编码、费诺编码和哈夫曼编码,编码方法惟一的是香农编码。 5、信道输入与输出间的平均互信息是信道转移概率的 下凸 函数,是输入概率的 上凸 函数。 6、信道矩阵??????10002/12/1代表的信道的信道容量C=符号/1bit ,达到信道容量的条件是输入符号等概分布。 7、 设某二进制码{00011,10110,01101,11000,10010,10001},则码的最小距离是2 ,假设码字等概分布,则该码的码率为 0.517比特/符号 ,这时若通过二元对称信道接收码字为01100和00110时,应译为01101 , 10110 。。 二、判断题(每题2分,共10分) 1、必然事件和不可能事件的自信息量都是0 。(错) 2、最大后验概率准则与最大似然准则是等价的。(错) 3、如果信息传输速率大于信道容量,就不存在使传输差错率任意小的信道编码。(对) 4、连续信源和离散信源的熵都具有非负性。(错) 5、相同功率的噪声中,高斯噪声使信道容量最小。(对) 三、简答题(第1、2题各6分,第三题10分,共22分) 1、简述最大离散熵定理。对于一个有m 个符号的离散信源,其最大熵是什么? 答:最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。 (3分) 最大熵值为 m H 2max log = (3分) 2、对于任意概率事件集X 、Y 、Z ,证明下述三角不等式成立()()()Z X H Z Y H Y X H ≥+ 证:因为)|()|(Y X H YZ X H ≤ ,(3分) 所以: ) |()|()|() |,() |()|()|()|(Z Y H XZ Y H Z Y H Z Y X I YZ X H Z X H Y X H Z X H ≤-==-≤-(3分)

信息论之父—香农 20世纪中叶,信息论、控制论、系统论等标新立异的新理论相继问世,有力地“晃动”着传统的科学框架。克劳德·香农是一位美国数学工程师,作为信息论的创始人,人们认为他是20世纪最伟大的科学家之一。他在通信技术与工程方面的创造性工作,为计算机与远程通信奠定了坚实的理论基础。人们尊崇香农为信息论及数字通信时代的奠基之父。确实,他对人类的贡献超过了一般的诺贝尔获奖者。回顾20世纪的信息革命风暴,经他阐明的信息概念、连同“比特”这个单位已经深入人心,成为今天日常生活都离不开的词汇。 家庭背景 克劳德·香农(Claude Elwood Shannon,1916-2001)1916年4月30日诞生于美国密西根州的Petoskey。在Gaylord小镇长大,当时镇里只有三千居民。父亲是该镇的法官,他们父子的姓名完全相同,都是Claude Elwood Shannon。母亲是镇里的中学校长,姓名是Mabel Wolf Shannon。他生长在一个有良好教育的环境,不过父母给他的科学影响好像还不如祖父的影响大。香农的祖父是一位农场主兼发明家,发明过洗衣机和许多农业机械,这对香农的影响比较直接。此外,香农的家庭与大发明家爱迪生(Thomas Alva Edison,1847-1931)还有远亲关系。 香农的大部分时间是在贝尔实验室和MIT(麻省理工学院)度过的。在“功成名就”后,香农与玛丽(Mary Elizabeth Moore)1949年3月27日结婚,他们是在贝尔实验室相识的,玛丽当时是数据分析员。他们共有四个孩子:三个儿子Robert、James、Andrew Moore和一个女儿Margarita Catherine。后来身边还有两个可爱的孙女。

信息论发展史和展望 蒲鹤升(020150802) 一、信息论定义 信息论,顾名思义是一门研究信息的处理和传输的科学;即用概率论与数理统计方法来探究信息的度量、传递和变换规律的一门学科。它主要是研究通讯和控制系统中普遍存在着信息传递的共同规律以及研究最佳解决信息的获限、度量、变换、储存和传递等问题的基础理论。信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法,信息传输和信息压缩是信息论研究中的两大领域,这两个方面又由信息传输理论、信源-信道隔离定理相互联系。信息是系统传输和处理的对象,它载荷于语言、文字、图像、数据等之中。这就是现代信息论的出发点。 二、狭义与广义 狭义的信息论是应用数理统计方法来研究信息处理和信息传递的科学,它研究存在于通讯和控制系统中普遍存在着的信息传递的共同规体,以及如何提高各信息传输系统的有效性和可能性的一门通讯理论。狭义信息论是申农氏于1948年创立的,其主要内容就是研究信源、信宿、传递及编码问题,因此它主要应用于通讯工作。后来信息论发展很快,将申农氏信息论的观点做为研究一切问题的理论,即广义信息论。信息论是建立在信息基础上的理论,所谓信息,即人类凭借感觉器官感知的周围一切变化,都可称作信息。 三、相关人物贡献 20世纪通信技术的发展推动了信息理论的研究. 美国科学家H.Nyquist 于1924年解释了信号带宽和信息速率之间的关系 美国科学家L.V.R.Hartley 于1928年开始研究通信系统传输信息的能力,给出了信息的度量方法 美国科学家C.E.Shannon 于1948年发表的著名论文《通信的数学理论》 A Mathematical Theory of Communication奠定了信息论的理论基础 四、各发展阶段 第一阶段:1948年贝尔研究所的香农在题为《通讯的数学理论》的论文中系统地提出了关于信息的论述,创立了信息论. 第二阶段:20世纪50年代,信息论向各门学科发起冲击;60年代信息论进入一个消化、理解的时期,在已有的基础上进行重大建设的时期.研究重点是信息和信源编码问题.

《信息论基础》模拟试卷 一、填空题(共15分,每空1分) 1、信源编码的主要目的是 ,信道编码的主要目的是 。 2、信源的剩余度主要来自两个方面,一是 ,二是 。 3、三进制信源的最小熵为 ,最大熵为 。 4、无失真信源编码的平均码长最小理论极限制为 。 5、当 时,信源与信道达到匹配。 6、根据信道特性是否随时间变化,信道可以分为 和 。 7、根据是否允许失真,信源编码可分为 和 。 8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是 时,信源具有最大熵,其值为值 。 9、在下面空格中选择填入数学符号“,,,=≥≤?”或“?” (1)当X 和Y 相互独立时,H (XY ) H(X)+H(X/Y) H(Y)+H(X)。 (2)()() 1222 H X X H X = ()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y) 0, H(Y/X) 0,I(X;Y) H(X)。 二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。 三、(16分)已知信源 1234560.20.20.20.20.10.1S s s s s s s P ????=???????? (1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分) (3)计算编码信息率R ';(2分) (4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。(2分) 四、(10分)某信源输出A 、B 、C 、D 、E 五种符号,每一个符号独立出现,出现概率分别为1/8、1/8、1/8、1/2、1/8。如果符号的码元宽度为0.5s μ。计算: (1)信息传输速率t R 。(5分) (2)将这些数据通过一个带宽为B=2000kHz 的加性白高斯噪声信道传输,噪声的单边功率谱密度为 6010W n Hz -=。试计算正确传输这些数据最少需要的发送功率P 。(5分)

1. 在无失真的信源中,信源输出由 H (X ) 来度量;在有失真的信源中,信源输出由 R (D ) 来度量。 2. 要使通信系统做到传输信息有效、可靠和保密,必须首先 信源 编码, 然后_____加密____编码,再______信道_____编码,最后送入信道。 3. 带限AWGN 波形信道在平均功率受限条件下信道容量的基本公式,也就是有名的香农公式是log(1)C W SNR =+;当归一化信道容量C/W 趋近于零时,也即信道完全丧失了通信能力,此时E b /N 0为 -1.6 dB ,我们将它称作香农限,是一切编码方式所能达到的理论极限。 4. 保密系统的密钥量越小,密钥熵H (K )就越 小 ,其密文中含有的关于明文的信息量I (M ;C )就越 大 。 5. 已知n =7的循环码4 2 ()1g x x x x =+++,则信息位长度k 为 3 ,校验多项式 h(x)= 3 1x x ++ 。 6. 设输入符号表为X ={0,1},输出符号表为Y ={0,1}。输入信号的概率分布为p =(1/2,1/2),失真函数为d (0,0) = d (1,1) = 0,d (0,1) =2,d (1,0) = 1,则D min = 0 ,R (D min )= 1bit/symbol ,相应的编码器转移概率矩阵[p(y/x )]=1001?? ???? ;D max = 0.5 ,R (D max )= 0 ,相应的编码器转移概率矩阵[p(y/x )]=1010?? ? ??? 。 7. 已知用户A 的RSA 公开密钥(e,n )=(3,55),5,11p q ==,则()φn = 40 ,他的秘密密钥(d,n )=(27,55) 。若用户B 向用户A 发送m =2的加密消息,则该加密后的消息为 8 。 二、判断题 1. 可以用克劳夫特不等式作为唯一可译码存在的判据。 (√ ) 2. 线性码一定包含全零码。 (√ ) 3. 算术编码是一种无失真的分组信源编码,其基本思想是将一定精度数值作为序列的 编码,是以另外一种形式实现的最佳统计匹配编码。 (×) 4. 某一信源,不管它是否输出符号,只要这些符号具有某些概率特性,就有信息量。 (×) 5. 离散平稳有记忆信源符号序列的平均符号熵随着序列长度L 的增大而增大。 (×) 6. 限平均功率最大熵定理指出对于相关矩阵一定的随机矢量X ,当它是正态分布时具 有最大熵。 (√ ) 7. 循环码的码集中的任何一个码字的循环移位仍是码字。 (√ ) 8. 信道容量是信道中能够传输的最小信息量。 (×) 9. 香农信源编码方法在进行编码时不需要预先计算每个码字的长度。 (×) 10. 在已知收码R 的条件下找出可能性最大的发码i C 作为译码估计值,这种译码方 法叫做最佳译码。 (√ )

信息论与编码的发展与前景 摘要:信息论理论的建立,提出了信息、信息熵的概念,接着人们提出了编码定理。编码方法有较大发展,各种界限也不断有人提出,使多用户信息论的理论日趋完整,前向纠错码(FEC)的码字也在不断完善。但现有信息理论中信息对象的层次区分对产生和构成信息存在的基本要素、对象及关系区分不清,适用于复杂信息系统的理论比较少,缺乏核心的“实有信息”概念,不能很好地解释信息的创生和语义歧义问题。只有无记忆单用户信道和多用户信道中的特殊情况的编码定理已有严格的证明,其他信道也有一些结果,但尚不完善。但近几年来,第三代移动通信系统(3G)的热衷探索,促进了各种数字信号处理技术发展,而且Turbo码与其他技术的结合也不断完善信道编码方案。 关键词:信息论信道编码纠错编码信息理论的缺陷 3G Turbo码 一、信息论的形成和发展 信息论从诞生到今天,已有五十多年历史,现已成为一门独立的理论科学,回顾它的发展历史,我们可以知道理论是如何从实践中经过抽象、概括、提高而逐步形成的。 1.1信息论形成的背景与基础 信息论是在人们长期的通信工程实践中,由通信技术和概率论、随机过程和数理统计相结合而逐步发展起来的一门学科。人们公认的信息论的奠基人是当代伟大的数学家、美国贝尔实验室杰出的科学家香农,他在1948年发表了著名的论文《通信的数学理论》,为信息论奠定了理论基础。近半个世纪以来,以通信理论为核心的经典信息论,正以信息技术为物化手段,向高精尖方向迅猛发展,并以神奇般的力量把人类社会推入了信息时代。随着信息理论的迅猛发展和信息概念的不断深化,信息论所涉及的内容早已超越了狭义的通信工程范畴,进入了信息科学领域。 通信系统是人类社会的神经系统,即使在原始社会也存在着最简单的通信工具和通信系统,这方面的社会实践是悠久漫长的。 电的通信系统(电信系统)已有100多年的历史了。在一百余年的发展过程中,一个很有意义的历史事实是:当物理学中的电磁理论以及后来的电子学理论一旦有某些进展,很快就会促进电信系统的创造发明或改进。这是因为通信系统对人类社会的发展,其关系实在是太密切了。日常生活、工农业生产、科学研究以及战争等等,一切都离不开消息传递和信息流动。 例如,当法拉第(M.Faraday)于1820年--1830年期间发现电磁感应的基本规律后,不久莫尔斯(F.B.Morse)就建立起电报系统(1832—1835)。1876年,贝尔(A.G.BELL)又发明了电话系统。1864年麦克斯韦(Maxell)预言了电磁波的存在,1888年赫兹(H.Hertz)用实验证明了这一预言。接着1895年英国的马可尼(G.Marconi)和俄国的波波夫(A.C.ΠoΠoB)就发明了无线电通信。 本世纪初(1907年),根据电子运动的规律,福雷斯特(1,Forest)发明了能把电磁波进行放大的电子管。之后很快出现了远距离无线电通信系统。大功率超高频电子管发明以后,电视系统就建立起来了(1925—1927)。电子在电磁场运动过程中能量相互交换的规律被人们认识后,就出现了微波电子管(最初是磁控管,后来是速调管、行波管),接着,在三十年代末和四十年代初的二次世界大战初期,微波通信系统、微波雷达系统等就迅速发展起来。五十年代后期发明了量子放大器,六十年代初发明的激光技术,使人类进入了光纤通信的时代。

信息科学技术概论课程报告 姓名: 葛坤 专业: 11级电子信息工程A班 学号: 1115102016 日期2013年3月1日—2013年4月26日

一、研究内容 信息科学 信息科学是以信息为主要研究对象,以信息的运动规律和应用方法为主要研究内容,以计算机等技术为主要研究工具,以扩展人类的信息功能为主要目标的一门新兴的综合性学科。 信息科学由信息论、控制论、计算机科学、仿生学、系统工程与人工智能等学科互相渗透、互相结合而形成的。 信息科学技术主要研究信息的产生、获取、存储、传输、处理及其应用。其中以微电子、计算机、软件、通信讯技术为主导,微电子是基础,计算机及通信设施是载体,而软件是核心,是计算机的灵魂。 信息,既是信息科学的出发点,也是它的归宿。具体来说,信息科学的出发点是认识信息的本质和它的运动规律;它的归宿则是利用信息来达到某种具体的目的。 信息概念 信息是人类对自然世界的了解的物化形式,信息的概念可以在两个层次上定义: 1、本体论意义的信息是事物运动的状态和状态变化的方式,即事物内部结构和外部联系的状态和方式。 2、认识论意义的信息是认识主体所感知、表达的相应事物的运动状态及其变化方式,包括状态及其变化方式的形式、含义和效用。 信息并非事物本身,而是表征事物之间联系的消息、情报、指令、数据或信号。 信息的主要特征有:可量度、可识别、可转换、可存储、可处理传递、可再生、可压缩、可利用、可共享、主客体二重性等。 信息的产生、存在和流通,依赖于物质和能量,没有物质和能量就没有能动作用。信息可以控制和支配物质与能量的流动。 数据、信息、知识和智慧 数据是未加工过的“信息”; 信息通过将事实和给定的语境关联而导出; 知识将某语境中的信息和在不同语境中得到的信息相关联; 智慧是从完全不同的知识导出的一般性原理。 信息论概念 信息论是研究信息的产生、获取、变换、传输、存贮、处理识别及利用的学科。信息论还研究信道的容量、消息的编码与调制的问题以及噪声与滤波的理论等方面的内容。信息论还研究语义信息、有效信息和模糊信息等方面的问题。 信息论有狭义和广义之分。狭义信息论即申农早期的研究成果,它以编码理论为中心,主要研究信息系统模型、信息的度量、信息容量、编码理论及噪声理论等。广义信息论又称信息科学,主要研究以计算机处理为中心的信息处理的基本理论,包括评议、文字的处理、图像识别、学习理论及其各种应用。广义信息论则把信息定义为物质在相互作用中表征外部情况的一种普遍属性,

安徽大学2011—2012学年第1学期 《信息论》考试试卷(AB 合卷) 院/系 年级 专业 姓名 学号 一、填空题 1、接收端收到y 后,获得关于发送的符号是x 的信息量是 。 2、香农信息的定义 。 3、在已知事件z Z ∈的条件下,接收到y 后获得关于事件x 的条件互信息(;|)I x y z 的表达式为 。 4、通信系统模型主要分成五个部分分别为: 。 5、研究信息传输系统的目的就是要找到信息传输过程的共同规律,以提高信息传输的可靠性、有效性、 和 ,使信息传输系统达到最优化。 6、某信源S 共有32个信源符号,其实际熵H ∞=1.4比特/符号,则该信源剩余度为 。 7、信道固定的情况下,平均互信息(;)I X Y 是输入信源概率分布()P x 的 型凸函数。 信源固定的情况下,平均互信息(;)I X Y 是信道传递概率(|)P y x 的 型凸函数。 8、当信源与信道连接时,若信息传输率达到了信道容量,则称此信源与信道达到匹配。信道剩余度定义为 。 9、已知信源X 的熵H (X )=0.92比特/符号,则该信源的五次无记忆扩展信源X 5的信息熵 5()H X = 。

10、将∞H ,6H ,0H ,4H ,1H 从大到小排列为 。 11、根据香农第一定理,对于离散无记忆信源S ,用含r 个字母的码符号集对N 长信源符号序列进行变长编码,总能找到一种无失真的唯一可译码,使每个信源符号所需平均码长满足: 。 12、多项式剩余类环[]())q F x f x 是域的充要条件为 。 13、多项式剩余类环[](1)n q F x x -的任一理想的生成元()g x 与1n x -关系为 。 14、有限域12 2F 的全部子域为 。 15、国际标准书号(ISBN )由十位数字12345678910a a a a a a a a a a 组成(诸i a ∈11F ,满足: 10 1 0(mod11)i i ia =≡∑) ,其中前九位均为0-9,末位0-10,当末位为10时用X 表示。《Handbook of Applied Cryptography 》的书号为ISBN :7-121-01339- ,《Coding and Information Theory 》的书号为ISBN :7-5062-3392- 。 二、判断题 1、互信息(;)I x y 与平均互信息(;)I X Y 都具有非负性质。 ( ) 2、离散信源的信息熵是信源无失真数据压缩的极限值。 ( ) 3、对于无噪无损信道,其输入和输出有确定的一一对应关系。 ( ) 4、对于有噪无损信道,其输入和输出有确定的一一对应关系。 ( ) 5、设有噪信道的信道容量为C ,若信息传输率R C >,只要码长n 足够长,必存在一种信道编码和相应的译码规则,使译码平均错误概率E P 为任意小。反之,若R C <则不存在以R 传输信息而E P 为任意小的码。 ( ) 6、在任何信息传输系统中,最后获得的信息至多是信源所提供的信息。如果一旦在某一