基于深度图像技术的手势识别方法

曹雏清,李瑞峰,赵立军

(哈尔滨工业大学机器人技术与系统国家重点实验室,哈尔滨 150001)

摘 要:针对复杂环境下的手势识别问题,提出一种基于深度图像技术的手势识别方法。利用深度图像信息从复杂环境中提取手势区域,综合手势的表观特征,建立决策树实现手势的识别。对常见的9种手势在复杂背景条件下进行测试,实验结果表明,手势的平均识别率可达到98.4%,速度达到每秒25帧。

关键词:手势识别;深度图像;表观特征;复杂背景;决策树

Hand Posture Recognition Method Based on Depth Image Technoloy

CAO Chu-qing, LI Rui-feng, ZHAO Li-jun

(State Key Laboratory of Robotics and System, Harbin Institute of Technology, Harbin 150001, China)

【Abstract 】Aiming at the problem of hand posture recognition from complex backgrounds, this paper proposes a hand posture recognition method based on depth image technoloy. The hand posture region is extracted from complex background via depth image. Appearance features are integrated to build the decision tree for hand posture recognition. Nine common postures with complex background are tested. Experimental results demonstrate that recognition rate is 98.4% and speed rate achieves 25 frames per second.

【Key words 】hand posture recognition; depth image; appearance feature; complex background; decision tree DOI: 10.3969/j.issn.1000-3428.2012.08.006

计 算 机 工 程 Computer Engineering

第38卷 第

8期 V ol.38 No.8 2012年4月

April 2012

·博士论文· 文章编号:1000—3428(2012)08—0016—03文献标识码:A

中图分类号:TP391

1 概述

随着机器人技术的发展,智能服务机器人开始逐步融入人类的生活,人机交互技术的发展是智能服务机器人研究的重要组成部分。人机交互的研究方向主要有表情、声音和手势识别技术。其中,手势是一种自然直观的人机交流模式,在信息表达上比表情更明确、信息量更丰富。

在人机交互中,基于视觉的手势识别是实现新一代人机交互的关键技术。基于视觉的手势识别通过图像信息,让机器人获取人的手势姿态信息,对不同的手势信息进行分类。近年来,学者们对基于视觉的手势识别进行研究,文献[1]提出特征空间匹配法,文献[2]采用提取同类手势的SIFT 特征方法进行手势识别,文献[3]提出手势图解析分类法,文献[4]针对复杂背景采用空间分布特征对手势进行识别。

复杂背景下手势识别的研究[4-5]一般使用肤色模型实现手势区域分割,虽然可以区分肤色和非肤色区域,但是实际应用中图像都包含有肢体和面部肤色区域,它们对手势区域提取有着较大的影响,同时光线也直接影响肤色模型。现有的文献中并没有考虑强光和弱光环境下的手势识别情况,在实际应用中往往伴随光线的变化问题,这些问题都直接影响了人机交互的实际效果。本文提出一种基于深度图像技术的手势识别方法,从深度图像信息中提取手势区域,运用几何方法提取手势表观特征并分类,从而实现复杂环境下基于手势的人机交互。

2

2.1 手势识别系统

基于深度图像信息的手势识别系统框架如图1所示。深度图像的采集采用非接触测量方式,获取的场景中深度信息不受物体自身的颜色、纹理特征以及背景环境光线强弱的影响。本文选用微软公司的Kinect 进行深度图像的采集,获取

深度信息值,转换到灰度值图像,经过手势区域分割、特征提取、手势识别,转换为手势信息,提供人机交互使用。

图1 面向人机交互的手势识别框架

2.2 手势区域分割

2.2.1 深度图像成像原理

深度图像技术在近年来逐步得到广泛的关注,Kinect 采集640×480像素的深度图像速度可以达到30 f/s ,深度的分辨率在5 mm 左右。本文把Kinect 采集到的场景深度值转换到灰度值空间,实际场景的RGB 图像如图2所示。在深度图像中像素点灰度值的大小对应于场景中点的不同深度值,如图3所示,图像中的灰度值越大,表明该区域距离深度摄像头的距离越近。

图2 场景RGB 图像 图3 深度图像

基金项目:国家自然科学基金资助项目(61075081);机器人技术与 系统国家重点实验室课题基金资助项目(SKLRS200802A02)

作者简介:曹雏清(1982-),男,博士研究生,主研方向:模式识 别,人机交互;李瑞峰,教授、博士生导师;赵立军,讲师 收稿日期:2011-07-11 E-mail :caochuqing@https://www.doczj.com/doc/ab17679826.html,

灰度值

50

100

150200

250

0.0

0.51.01.52.02.50

图4 灰度直方图

图5 手势区域分割效果

2.3 特征提取

2.3.1 手势的表观特征

本文通过提取手势的表观特征,根据表征手势的指头数以及指间的夹角的不同对手势进行分类,实现手势在旋转缩放条件下的快速识别。相比于其他的手势特征提取方法,手势的表观特征具有更加直观、无需训练样本、适应性强、运算速度快实时性好等优点。

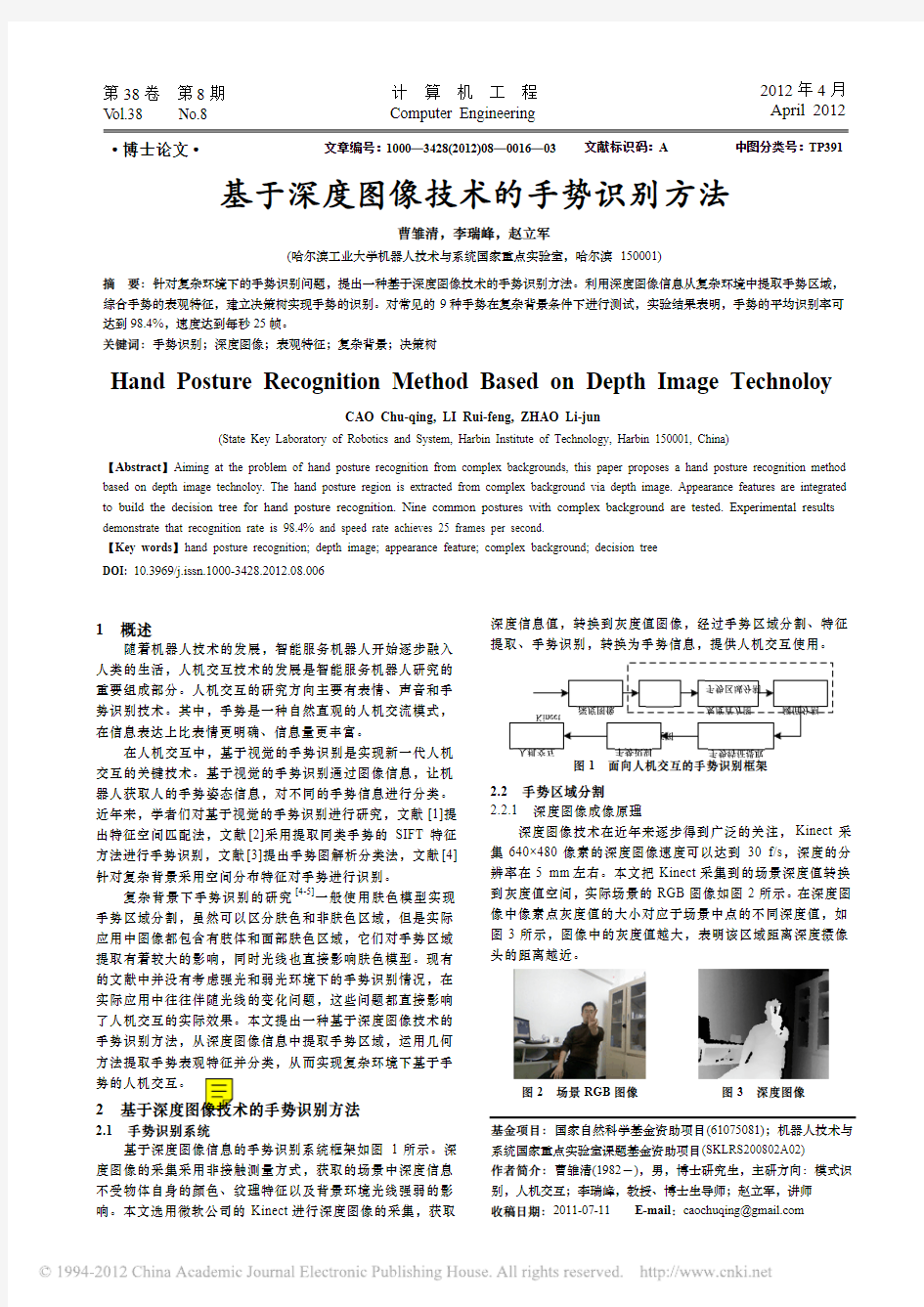

手势表观特征的提取步骤如下:

(1)通过数学形态学中的腐蚀操作[6]获取手势区域中心位置点。由于手掌作为手势表观的主要组成部分,在手势区域中它占有最大的面积而且点较为集中。通过连续的腐蚀操 作,可以消除手势区域的边界点,使手势区域逐步缩小,最终得到手势区域的中心位置点C 0,实际效果如图6所示。

图6 手势区域中心点

(2)计算出中心点与手势区域边缘的最大距离值l ,对距离进行10等分,以d=l/10。以手势区域中心点为圆心做出 圆轨迹,圆半径从d 开始到l ,每次递加值为d ,得到10个圆轨迹线,如图7所示。 C 0

P 42

P 41

P 51

P 52

Q 41Q 51

Q 42

Q 52

P 61P 62P 63P 64P 53

P 54P 55P 56P 43P 44P 45

P 46

Q 43Q 53Q 63

Q 64Q 44Q 54

Q 65Q 55

Q 45

Q 66Q 56

Q 46

P 71

Q 71

Q 72Q 73P 72P 73P 31

P 32

P 33

Q 32

Q 31

A 1A 2A 3

A 4

ij ij 不能表现手指的实际宽度值,所以当D ij 小于阈值δ时,删除对应的P ij 和Q ij 点,由图2可以看出一些手指的指间处P ij 和Q ij 点被去除,根据经验设置阈值为δ=d /4。

(5)每个轨迹圆上获得的j 最大值,为与手掌相连分支数量总和N=max(j )。由于分支中包含手指和手腕分支,则手指数量是N f =N ?1。

(6)由每个分支的平均值计算得到分支的平均宽度W j =D ij 。在手形上可知手腕宽度大于手指,在分支中手腕对应于最大宽度的分支。由除手腕分支外的其他分支在各自截取的最大轨迹圆上取P ij 和Q ij 的中点与中心位置点C 0连线,得到指间夹角A j -1。

2.3.2 旋转和缩放不变性

人机交互中需要自然的手势动作,而不局限于某些特定手势位姿或是特定手势区域大小。距离的远近以及手势的位姿会造成图像中手势大小以及旋转的问题。本文的特征提取方法,利用等分轨迹圆消除手势区域大小对特征提取的影 响,同时对轨迹上的变化点进行特征计算,提取的手指数量N f 和指间夹角A j -1特征都具有旋转和缩放的不变性,不受手势距离远近和旋转的影响。 2.4 手势识别

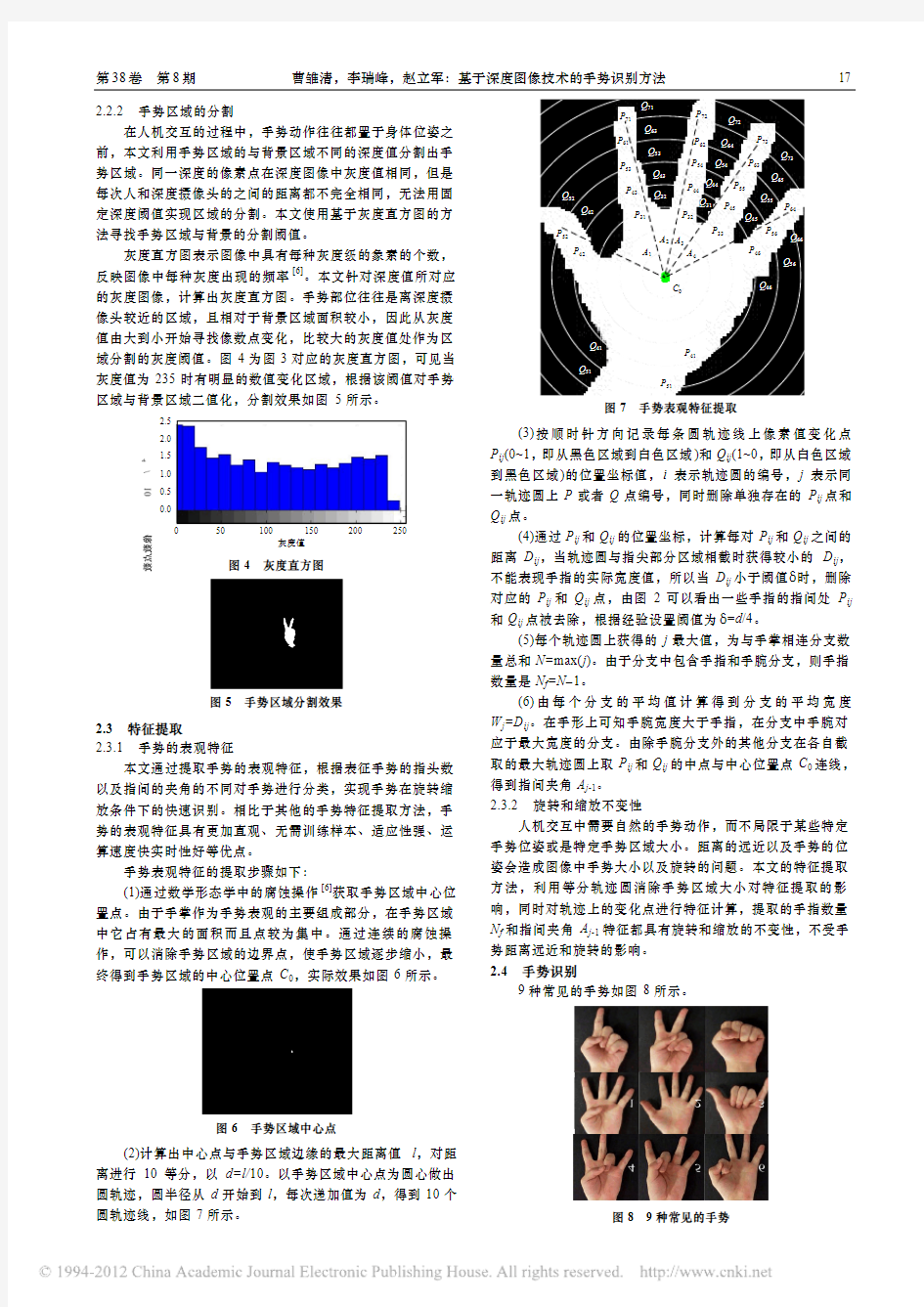

9种常见的手势如图8所示。

图8 9种常见的手势

18 计 算 机 工 程 2012年4月20日

本文通过提取手势的表观特征,建立决策树模型,对手势进行识别分类。决策树是通过对训练样本进行归纳学习, 生成决策树或决策规则,然后使用决策树或决策规则对新数据进行分类的一种数学方法[7]。决策树通过把实例从根节点排列到某个叶子节点来分类,叶子节点即为实例所属的分 类。构造好的决策树的关键在于如何选择恰当的逻辑判断或属性。

手势主要的提取特征是手指数量N f 和指间夹角A j -1特征,作为决策树的分类节点。不同手势之间手指数量特征区分比较明显,建立的决策树首先以手指数量N f 作为决策树的根节点,对于手指数相同的手势,再建立子节点对各个指间夹角A j -1差异情况进行区分。子节点上对于指间夹角A j -1, 通过小样本的测试训练获取分类条件,建立的决策树如图9所示。

图9 手势分类决策树

手势1、手势3、手势4、手势5的手指数量特征具有唯一性,可直接通过根节点分类;手势2和手势6的N f =2,下一层子节点通过判断指间夹角A 1大小加以区分;手势7、手势8、手势9的N f =3,需要通过2层子节点判断指间夹角A 1和A 1大小进行区分。

3 实验结果及分析

3.1 手势识别实验

为验证本文采用的实验方法,基于机器人平台,Kinect 通过USB 口与机器人主机进行数据通信,机器人主机的配 置是2.0 GHz 的CPU 和2 GB 的RAM ,当采样图片大小为640×480像素时,识别速度可以达到25 f/s ,达到实时手势识别的要求。

实验针对9种常见的手势进行识别,由5个人在强光、弱光和普通光线的背景条件对下每种手势测试200次,共计1 800次测试。手势识别结果如表1所示。

表1 手势识别结果

识别次数 测试 手势 手势1 手势2 手势3 手势4 手势5手势6 手势7 手势8 手势9识别率

/(%)手势1 200 0 0 0 0 0 0 0 0100.0手势2 0 200 0 0 0 0 0 0 0100.0手势3 0 0 200 0 0 0 0 0 0100.0手势4 0 0 0 200 0 0 0 0 0100.0手势5 0 0 0 0 200 0 0 0 0100.0手势6 1 5 0 0 0194 0 0

97.0手势7 0 0 0 0 0 0 190 10 0 95.0手势8 0 0 0 0 0 0 8 192 0 96.0手势9 0

2

3 195

97.5

从表1中可以看出,手势1~手势5的识别率都为100%。由于非特定人物对手势6~手势9表达差异,当手势的表达差异较大时会造成测试过程中的识别错误,但从整体上看,平均手势识别成功率达到98.4%,说明了本文手势识别方法的有效性。

3.2 复杂的背景条件 3.2.1 光照的强弱

环境中光线的变化是手势区域提取常见的难题之一,常见的手势区域分割方法多依赖于手势区域颜色,光线的强弱变化造成手势区域颜色较大的变化,当光线较强或者较弱 时,手势区域部分甚至完全与背景色相近,无法分割出手势区域,严重的影响了手势识别效果。

由于深度信息的获取主要通过于深度摄像头自身对非可见光信号的发射和采集,环境外部可见光的变化对深度图像的采集没有任何的影响,室内场景中光线的变化对手势区域分割效果如图10所示,即使在室外强光甚至室内几乎没有 光线的情况下,仍可以准确提取手势区域。

(a)室外强光条件 (b)室内弱光条件

图10 复杂背景下手势提取效果

3.2.2 肤色区域重合

肤色重合时的手势区域分割是比较常见的难题[4],如手势和脸部区域重合情况。在彩色图像中手势和脸部等肤色区域的重合影响了手势区域的分割效果。由于面部和手势区域颜色相近,无法通过肤色模型直接分割出手势区域,导致无法完整的提取出手势区域。在该情况下手势识别失败率很 高。然而在深度图像中,手势和脸部等区域通常处于不同的深度区域下,通过本文的深度图像分割方法可以实现非常好的分割效果,复杂的背景环境不会影响手势的识别效果。

4 结束语

本文针对复杂背景下手势识别存在的难点,综合利用深度图像信息以及手势的表观特征,解决了在光照及肤色区域重合时的手势区域分割问题,实时的手势识别不受手势旋转和缩放的影响。该手势识别系统已应用于机器人平台,实验结果证明了本文方法的实用性和稳定性。该方法对背景环境有很强的鲁棒性,能为多方式的人机交互提供快速有效的 信息。

(下转第21页)

第38卷 第8期 21

胡志刚,刘 艳:云环境下基于组合双向拍卖的动态资源定价 Step4 calculate allp i of Q i using formula (7); Step5 if allp i ≤budget i

assign Q i to C j when ask j t is minimal ;

else refuse Q i ;

Step6 output i and j; p i and allp i End

本文提出的定价算法使资源提供商代理的要价与工作负载呈正比,从而可避免用户任务超过截止时间仍无法完成的情况,同时在一定程度上可使用户花费最小。

4 实验结果与分析

4.1 实验环境设计

采用CloudSim 模拟器对本文提出的DSP 定价算法进行仿真,模拟的云计算环境包括100个用户和20个云资源提 供商,每个用户向云市场提交一个或多个独立的任务请求,共有200个。α表示工作负载对要价的影响程度,α={0.25, 0.5, 0.75, 1};β表示响应时间对出价的影响程度,β={0.25, 0.5, 0.75, 1}。实验进行16次,结果取16次实验的平均结果。

将DSP 算法与采用固定比例的定价算法(Fixed Pricing, FP)从下面的指标进行比较:

(1)用户利益:用户的出价与单位交易价格的差值。 (2)资源提供商的利益:单位交易价格与资源提供商的要价的差值。

4.2 性能分析

在不同工作负载情况下,DSP 算法与FP 算法得到的资源提供商利益的比较情况如图1所示。可以看出,资源提供商的利益随着工作负载的变化而逐渐增大,但FP 的资源提供商利益始终低于DSP ,这是由于FP 在调度中没有考虑工作负载的动态性。

图1 2种算法的资源提供商利益比较

DSP 算法与FP 算法的用户利益比较如图2所示。可以

看出,用户的利益随着响应时间与最大响应时间比值的增大

而逐渐增大,但DSP 算法明显优于FP 算法,这是因为DSP

考虑了用户的QoS 需求,在资源负载较重时,用户的某些服务由于受到截止时间的约束而不会推迟完成,从而可以提高用户的利益。

图2 2种算法的用户利益比较

5 结束语

本文提出一种云环境下基于组合双向拍卖机制的资源定价模型,并给出相应算法。仿真实验结果表明,本文算法在资源利用率、用户和资源提供商利益方面的性能明显优于固定比率定价算法。下一步将在模型中引入信任度以反映服务质量,进一步完善定价算法。

参考文献

[1] 程仕伟, 潘 郁. 云计算环境下基于可信性的动态资源分配策

略[J]. 计算机工程, 2011, 37(11): 45-48.

[2] Sui Xin, Leung Ho-Fung. An Adaptive Bidding Strategy in Multi-

round Combinatorial Auctions for Resource Allocation[C]//Proc. of International Conf. on Tools with Artificial Intelligence. Singapore: IEEE Computer Society, 2008.

[3] Teng Fei, Magoules F. Resource Pricing and Equilibrium Allo-

cation Policy in Cloud Computing[C]//Proc. of International Conf. on Computer and Information Technology. [S. l.]: IEEE Computer Society, 2010.

[4] Mihailescu M, Teo Y M. Dynamic Resource Pricing on Federated

Clouds[C]//Proc. of International Conf. on Cluster, Cloud and Grid Computing. [S. l.]: IEEE Computer Society, 2010.

[5] Shang Shifeng, Jiang Jinlei, Wu Yongwei, et al. DABGPM: A

Double Auction Bayesian Game-based Pricing Model in Cloud Market[C]//Proc. of International Federation for Information

Processing. Brisbane, Australia: [s. n.], 2010. 编辑 顾姣健~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~ (上接第18页)

参考文献

[1] Kelly D, McDonald J, Markham C. A Person Independent System

for Recognition of Hand Postures Used in Sign Language[J]. Pattern Recognition Letters, 2010, 31(11): 1359-1368.

[2] Wang Chieh-Chih, Wang Ko-Chih. Hand Posture Recognition Using

Adaboost with Sift for Human Robot Interaction[C]//Proc. of International Conference on Advanced Robotics. Jeju Island, Korea: [s. n.], 2007.

[3] Flasinski M, Myslinski S. On the Use of Graph Parsing for

Recognition of Isolated Hand Postures of Polish Sign Language[J]. Pattern Recognition, 2010, 43(6): 2249-2264.

[4] 杨 波, 宋晓娜, 冯志全. 复杂背景下基于空间分布特征的手

势识别算法[J]. 计算机辅助设计与图形学学报, 2010, 22(10): 1841-1848.

[5] 陈一民, 张云华. 基于手势识别的机器人人机交互技术研究[J].

机器人, 2009, 31(4): 351-356.

[6] 蓝章礼, 李益才. 数字图像处理与图像通信[M]. 北京: 清华大

学出版社, 2009.

[7] Witten I H, Frank E. Data Mining: Practical Machine Learning

Tools and Techniques[M]. Burlington, USA: Morgan Kaufmann Publishers, 2005.

编辑 顾姣健

基于深度的图像修复实验报告

————————————————————————————————作者:————————————————————————————————日期: 2

基于深度的图像修复 一.实验目的 1、学会单幅图像的修补 2、学会结合彩色图像和深度图像的图像修补 二.实验原理 1图像修补简介----单幅图像修补 图像中常有缺失或者损坏的部分,即空白区域或者有误的区域。图像修补就是根据这些区域周围的信息完成对空白区域的填充,以实现图像的恢复。 基本方法 图像修补的基本方法示例

示例方法2 选取空白点周围的一片区域,对区域内的参考点进行加权求和,其结果用于对空白点的修补。若所选窗口太小,即窗口中无参考点,则将窗口扩大。 2图像修补简介----利用深度图的图像修补 1图像的前景与背景

实际场景中存在前景与背景的区别,前景会遮挡背景,而且前景与背景往往差距比较大。 2深度图 用于表示3D空间中的点与成像平面距离的灰度图。0~255表示,灰度值越大,表示场景距离成像平面越近,反之,灰度值越小,表示场景距离成像平面越远。 前景的灰度值大,背景的灰度值小。 如下左彩色图,右深度图 3普通的图像修补区分不了图像的前景和背景,简单的加权求和填补空白点的方法会导致前景和背景的混杂。引入深度图之后,可以利用深度图区分图像的前景和背景,在对背景进行修补的时候,可以利用深度图滤除那些前景参考点的影响,从而使背景的空白点只由背景点加权求和得到,前景亦然。

三.实验步骤 1读入一个像素点,判断其是否为空白点。 2若不是空白点,则跳过该点,判断下一个点。 3若该点是空白点,则用前面所述的方法进行加权修补。 4对图像中的每一个点都进行如此处理,直至全图处理完毕,则图像修补完成。 四.实验要求 1独立编码完成实验单幅图像修补利用深度图的图像修补。 2 比较实验结果的差别,并分析原因,完成实验报告。 五.用MATLAB编写实验代码 对于单幅图像以及结合深度图像的修补,其实区别就是是否考虑了深度图像的灰度权重(其实就是0和1),虽然效果图区别很小,但是通过深度图还是可以反映出其立体三维空间的。为了能较好的对比,我把两种方法的比较融合在一条件语句中,在下面的深度图像代码中用红色字体标注。同时深度图像变量用绿色字体标注。

图像识别技术研究现状综述 简介: 图像识别是指图形刺激作用于感觉器官,人们辨认出它是经验过的某一图形的过程,也叫图像再认。在图像识别中,既要有当时进入感官的信息,也要有记忆中存储的信息。只有通过存储的信息与当前的信息进行比较的加工过程,才能实现对图像的再认。图像识别技术是以图像的主要特征为基础的,在图像识别过程中,知觉机制必须排除输入的多余信息,抽出关键的信息。在人类图像识别系统中,对复杂图像的识别往往要通过不同层次的信息加工才能实现。对于熟悉的图形,由于掌握了它的主要特征,就会把它当作一个单元来识别,而不再注意它的细节了。这种由孤立的单元材料组成的整体单位叫做组块,每一个组块是同时被感知的。图像在人类的感知中扮演着非常重要的角色,人类随时随处都要接触图像。随着数字图像技术的发展和实际应用的需要,出现了另一类问题,就是不要求其结果输出是一幅完整的图像,而是将经过图像处理后的图像,再经过分割和描述提取有效的特征,进而加以判决分类,这就是近20年来发展起来的一门新兴技术科学一图像识别。它以研究某些对象或过程的分类与描述为主要内容,以研制能够自动处理某些信息的机器视觉系统,代替传统的人工完成分类和辨识的任务为目的。 图像识别的发展大致经历了三个阶段:文字识别、图像处理和识别及物体识别:文字识别的研究是从1950年开始的,一般是识别字母、数字和符号,并从印刷文字识别到手写文字识别,应用非常广泛,并且已经研制了许多专用设备。图像处理和识别的研究,是从1965年开始的。过去人们主要是对照相技术、光学技术的研究,而现在则是利用计算技术、通过计算机来完成。计算机图像处理不但可以消除图像的失真、噪声,同时还可以进行图像的增强与复原,然后进行图像的判读、解析与识别,如航空照片的解析、遥感图像的处理与识别等,其用途之广,不胜枚举。物体识别也就是对三维世界的认识,它是和机器人研究有着密切关系的一个领域,在图像处理上没有特殊的难点,但必须知道距离信息,并且必须将环境模型化。在自动化技术已从体力劳动向部分智力劳动自动化发展的今天,尽管机器人的研究非常盛行,还只限于视觉能够观察到的场景。进入80年代,随着计算机和信息科学的发展,计算机视觉、人工智能的研究已成为新的动向 图像识别与图像处理的关系: 在研究图像时,首先要对获得的图像信息进行预处理(前处理)以滤去干扰、噪声,作几何、彩色校正等,以提供一个满足要求的图像。图像处理包括图像编码,图像增强、图像压缩、图像复原、图像分割等。对于图像处理来说,输入是图像,输出(即经过处理后的结果)也是图像。图像处理主要用来解决两个问题:一是判断图像中有无需要的信息;二是确定这些信息是什么。图像识别是指对上述处理后的图像进行分类,确定类别名称,它可以在分割的基础上选择需要提取的特征,并对某些参数进行测量,再提取这些特征,然后根据测量结果做出分类。为了更好地识别图像,还要对整个图像做结构上的分析,对图像进行描述,以便对图像的主要信息做一个好的解释,并通过许多对象相互间的结构关系对图像加深理解,以便更好帮助和识别。故图像识别是在上述分割后的每个部分中,找出它的形状及纹理特征,以便对图像进行分类,并对整个图像做结构上的分析。因而对图像识别环节来说,输入是图像(经过上述处理后的图像),输出是类别和图像的结构分析,而结构分析的结果则

手势识别技术综述 作者单位:河北工业大学计算机科学与软件学院 内容摘要: 手势识别是属于计算机科学与语言学的一个将人类手势通过数学算法针对人们所要表达的意思进行分析、判断并整合的交互技术。一般来说,手势识别技术并非针对单纯的手势,还可以对其他肢体动作进行识别,比如头部、胳臂等。

但是这其中手势占大多数。本文通过对手势识别的发展过程、使用工具、目的与市场等进行综述,梳理出手势识别发展的思路,让读者对手势识别有一个总体上的认识,同时也可以让读者在此基础上进行合理想象,对手势识别的未来有一个大体印象。 Abstract: Gesture recognition is an interactive technology using mathematical arithmetic to the analysis,judge and assembly meaning that people want to convey which belongs to computer science and Linguistics.In general, gesture recognition technology is not for simple gestures expressed by hands ,it can also aim to other body movement recognition, such as the head, arm and so on. But the gesture accounted for most of the analysis. In this paper, by describing the development process, tools used , objective and market of gesture recognition , we can sort out the ideas of the development of gesture recognition, and let readers have an overall understanding of gesture recognition. At the same time, it can let the reader imagine that on hand gesture recognition based on reason ,and have a general impression of its future. 1.定义 说到手势识别,首先要对手势识别中的手势有一个清晰的认知。手势在不同的学科中有不同含义,而在交互设计方面,手势与依赖鼠标、键盘等进行操控的区别是显而易见的,那就是手势是人们更乐意接受的、舒适而受交互设备限制小的方式,而且手势可供挖掘的信息远比依赖键盘鼠标的交互模式多。在学术界,人们试图对手势定义一个抽象、明确而简洁的概念以为手势及其应用的研究提供依据。1990年Eric Hulteen和Gord Kurtenbach曾发表的题为“Gestures in Human-Computer Communication”中定义:“手势为身体运动的一部分,它包括一部分信息,而且是一种能被观察到的有意义的运动。挥手道别是一种手势,而敲击键盘不是一种手势,因为手指的运动没有被观察,也不重要,它只表示键盘

基于深度图像技术的手势识别方法 曹雏清,李瑞峰,赵立军 (哈尔滨工业大学机器人技术与系统国家重点实验室,哈尔滨 150001) 摘 要:针对复杂环境下的手势识别问题,提出一种基于深度图像技术的手势识别方法。利用深度图像信息从复杂环境中提取手势区域,综合手势的表观特征,建立决策树实现手势的识别。对常见的9种手势在复杂背景条件下进行测试,实验结果表明,手势的平均识别率可达到98.4%,速度达到每秒25帧。 关键词:手势识别;深度图像;表观特征;复杂背景;决策树 Hand Posture Recognition Method Based on Depth Image Technoloy CAO Chu-qing, LI Rui-feng, ZHAO Li-jun (State Key Laboratory of Robotics and System, Harbin Institute of Technology, Harbin 150001, China) 【Abstract 】Aiming at the problem of hand posture recognition from complex backgrounds, this paper proposes a hand posture recognition method based on depth image technoloy. The hand posture region is extracted from complex background via depth image. Appearance features are integrated to build the decision tree for hand posture recognition. Nine common postures with complex background are tested. Experimental results demonstrate that recognition rate is 98.4% and speed rate achieves 25 frames per second. 【Key words 】hand posture recognition; depth image; appearance feature; complex background; decision tree DOI: 10.3969/j.issn.1000-3428.2012.08.006 计 算 机 工 程 Computer Engineering 第38卷 第 8期 V ol.38 No.8 2012年4月 April 2012 ·博士论文· 文章编号:1000—3428(2012)08—0016—03文献标识码:A 中图分类号:TP391 1 概述 随着机器人技术的发展,智能服务机器人开始逐步融入人类的生活,人机交互技术的发展是智能服务机器人研究的重要组成部分。人机交互的研究方向主要有表情、声音和手势识别技术。其中,手势是一种自然直观的人机交流模式,在信息表达上比表情更明确、信息量更丰富。 在人机交互中,基于视觉的手势识别是实现新一代人机交互的关键技术。基于视觉的手势识别通过图像信息,让机器人获取人的手势姿态信息,对不同的手势信息进行分类。近年来,学者们对基于视觉的手势识别进行研究,文献[1]提出特征空间匹配法,文献[2]采用提取同类手势的SIFT 特征方法进行手势识别,文献[3]提出手势图解析分类法,文献[4]针对复杂背景采用空间分布特征对手势进行识别。 复杂背景下手势识别的研究[4-5]一般使用肤色模型实现手势区域分割,虽然可以区分肤色和非肤色区域,但是实际应用中图像都包含有肢体和面部肤色区域,它们对手势区域提取有着较大的影响,同时光线也直接影响肤色模型。现有的文献中并没有考虑强光和弱光环境下的手势识别情况,在实际应用中往往伴随光线的变化问题,这些问题都直接影响了人机交互的实际效果。本文提出一种基于深度图像技术的手势识别方法,从深度图像信息中提取手势区域,运用几何方法提取手势表观特征并分类,从而实现复杂环境下基于手势的人机交互。 2 2.1 手势识别系统 基于深度图像信息的手势识别系统框架如图1所示。深度图像的采集采用非接触测量方式,获取的场景中深度信息不受物体自身的颜色、纹理特征以及背景环境光线强弱的影响。本文选用微软公司的Kinect 进行深度图像的采集,获取 深度信息值,转换到灰度值图像,经过手势区域分割、特征提取、手势识别,转换为手势信息,提供人机交互使用。 图1 面向人机交互的手势识别框架 2.2 手势区域分割 2.2.1 深度图像成像原理 深度图像技术在近年来逐步得到广泛的关注,Kinect 采集640×480像素的深度图像速度可以达到30 f/s ,深度的分辨率在5 mm 左右。本文把Kinect 采集到的场景深度值转换到灰度值空间,实际场景的RGB 图像如图2所示。在深度图像中像素点灰度值的大小对应于场景中点的不同深度值,如图3所示,图像中的灰度值越大,表明该区域距离深度摄像头的距离越近。 图2 场景RGB 图像 图3 深度图像 基金项目:国家自然科学基金资助项目(61075081);机器人技术与 系统国家重点实验室课题基金资助项目(SKLRS200802A02) 作者简介:曹雏清(1982-),男,博士研究生,主研方向:模式识 别,人机交互;李瑞峰,教授、博士生导师;赵立军,讲师 收稿日期:2011-07-11 E-mail :caochuqing@https://www.doczj.com/doc/ab17679826.html,

毕业设计文献综述 题目:基于matlab的图像预处理技术研究 专业:电子信息工程 1前言部分 众所周知,MATLAB在数值计算、数据处理、自动控制、图像、信号处理、神经网络、优化计算、模糊逻辑、小波分析等众多领域有着广泛的用途,特别是MATLAB的图像处理和分析工具箱支持索引图像、RGB 图像、灰度图像、二进制图像,并能操作*.bmp、*.jpg、*.tif等多种图像格式文件如。果能灵活地运用MATLAB提供的图像处理分析函数及工具箱,会大大简化具体的编程工作,充分体现在图像处理和分析中的优越性。 图像就是用各种观测系统观测客观世界获得的且可以直接或间接作用与人眼而产生视觉的实体。视觉是人类从大自然中获取信息的最主要的手段。拒统计,在人类获取的信息中,视觉信息约占60%,听觉信息约占20%,其他方式加起来才约占20%。由此可见,视觉信息对人类非常重要。同时,图像又是人类获取视觉信息的主要途径,是人类能体验的最重要、最丰富、信息量最大的信息源。通常,客观事物在空间上都是三维的(3D)的,但是从客观景物获得的图像却是属于二维(2D)平面的。 图像存在方式多种多样,可以是可视的或者非可视的,抽象的或者实际的,适于计算机处理的和不适于计算机处理的。 图像处理它是指将图像信号转换成数字信号并利用计算机对其进行处理的过程。图像处理最早出现于20世纪50年代,当时的电子计算机已经发展到一定水平,人们开始利用计算机来处理图形和图像信息。图像处理作为一门学科大约形成于20世纪60年代初期。早期的图像处理的目的是改善图像的质量,它以人为对象,以改善人的视觉效果为目的。图像处理中,输入的是质量低的图像,输出的是改善质量后的图像,常用的图像处理方法有图像增强、复原、编码、压缩等。首次获得实际成功应用的是美国喷气推进实验室(JPL)。他们对航天探测器徘徊者7号在 1964 年发回的几千张月球照片使用了图像处理技术,如几何校正、灰度变换、去除噪声等方法进行处理,并考虑了太阳位置和月球环境的影响,由计算机成功地绘制出月球表面地图,获得了巨大的成功。随后又对探测飞船发回的近十万张照片进行更为复杂的图像处理,以致获得了月球的地形图、彩色图及全景镶嵌图,获得了非凡的成果,为人类登月创举奠定了坚实的基础,也推动

基于手势识别的智能电视交互专利技术综述 智能电视具有操作系统,支持第三方应用资源实现功能扩展,支持多网络接入功能,具备人机交互、与其他智能设备进行交互等。随着计算机视觉的发展和人机交互的需要,手势识别研究取得了蓬勃的发展,通过手势识别对智能电视进行控制和操作,能够更轻松、高效地使用电视设备。文章利用专利数据库对智能电视手势识别技术进行了数据统计和分析,对该领域的专利申请趋势等情况做了归纳总结。 标签:智能电视;手势识别;发展状况;专利 Abstract:Intelligent TV has the operating system,which supports the third party application resources to realize the function expansion,supports the multi-network access function,has the man-machine interaction,and carries on the interaction with other intelligent devices. With the development of computer vision and the need of human-computer interaction,the research of gesture recognition has made great progress. By controlling and operating intelligent TV through gesture recognition,one can more easily and more efficiently use TV equipment. This paper makes use of patent database to analyze the data of intelligent TV gesture recognition technology,and summarizes the trend of patent application in this field. Keywords:intelligent TV;gesture recognition;development status;patent 引言 电视是家庭娱乐休闲必不可少的家用电器。如今,电视依然是最为普及的信息传播载体,用户在观看普通节目的同时,还可以上网、娱乐等。从用户的角度出发,通过自然简单、人性化的方式完成交互,无疑是用户完成电视操作的最佳方式。而手势具有直观、自然、丰富的特点,是一种符合人们日常习惯的交互手段,是表達信息和特定意图的良好载体,由于手势具有上述特性,因此在对智能电视进行操控中得到了良好的运用,实现了对智能电视自然灵活地操作。 1 基于手势识别的智能电视控制技术发展状态分析 1.1 技术分解 本文通过检索获得的专利申请进行统计分析,对基于手势识别的智能电视控制所涉及的具体技术和应用领域进行分解。 根据手势采集设备可以将手势识别系统大致分为基于数据手套和基于视觉的两种手势识别系统。其中,数据手套通过多个传感器反馈各关节的数据,并通过位置跟踪器返回人手所在的三维坐标,从而获取手势在三维空间中的位置信息和手指的运动信息。通过数据手套可以直接获取人手在三维空间中的位置和运动

2018年TI杯大学生电子设计竞赛手势识别装置(D题) 2018年7月23日

手势识别装置(D题) 【本科组】 摘要 手势识别作为人机交互的重要组成部分,其研究发展影响着人机交互的自然性和灵活性。 为了满足手势识别的设计要求,本次设计使用以测量电路为核心的系统。主要由五个模块组成,包括测量电路模块、传感器模块、显示模块、控制模块、电源模块组成。控制模块采用的是独立按键和MSP430F5529单片机,用以控制工作模式(训练和判决);测量电路模块采用的是MSP430F5529单片机;传感器模块采用的是FDC2214电容传感器;显示模块采用12864LCD液晶显示屏;电源模块采用220V转5V的USB接口输出模块。本装置通过FDC2214电容传感器和MSP430F5529单片机测量频率值,再通过频率值判断手势,并显示在LCD液晶显示屏上。 关键词:手势识别MSP430F5529FDC2214 12864LCD

目录 一、系统方案 (1) 1.测量电路模块的选择 (1) 2.显示模块的选择 (1) 3.传感器模块 (1) 4.电源模块 (2) 5.方案确定 (2) 二、理论分析与计算 (2) 1.理论分析 (2) 2.计算 (2) 三、电路与程序设计 (3) 1.电路设计 (3) (1)系统总体框图 (3) (2)控制模块系统框图 (4) 2.程序设计 (4) (1)程序流程图 (4) (2)判决的流程图 (4) 四、测试方案与测试结果 (5) 1.测试方案 (5) (1)硬件测试 (5) (2)软件仿真测试 (5) (3)硬件软件联调 (5) 2.测试条件与仪器 (5) 五、测试结果 (6) 1.测试结果 (6) 2.误差分析 (6) 六、心得 (6) 七、参考文献 (7) 附录:电路原理图 (8) 一、

简单手势识别

一、背景 随着计算机的发展,人机交互技术由传统的鼠标键盘时代发展到了以语音输入、动作识别等技术为代表的自然交互时代n1。特别是视觉计算技术的发展,使计算机获得了初步视觉感知的能力,能“看懂”用户的动作。手势识别作为一种直观自然的输入方式,把人们从传统接触性的输入装置中解放出来,可以以一种更自然的方式与计算机交互,使计算机界面变得更加易‘引。 手势主要分为静态手势和动态手势两种,动态手势可以看作是连续的静态手势序列。动态手势具有丰富和直观的表达能力,与静态手势结合在一起,能创造出更丰富的语义。利用动态手势识别构建新型的交互界面,是新一代的人机交互界面对输入方式自然性的要求,可以弥补传统交互方式的不足。基于视觉和手势识别研究正处于蓬勃发展的阶段,仍存着的许多值得研究的问题。研究基于视觉的动态手势识别对于构建更加好友的人机交互界面很有意义。

二、手势识别概述 2.1、手势识别的概念 手势是姿势的一个子集,姿势这个概念没有精确的定义。一般认为,手势概念经过人的手转化为的手势动作,观察者看到的是手势动作的图像。手势的产生过程如图2-1所示。 图2-1 手势的产生过程 手势识别的过程则找一个从图像V到概念动作G的变换而,如图2-2所示。

2.2、手势识别流程 随着计算机的发展,人机交互技术由传统的鼠标键盘时代发展到了以语音输入、动作识别等技术为代表的自然交互时代n1。特别是视觉计算技术的发展,使计算机获得了初步视觉感知的能力,能“看懂”用户的动作。手势识别作为一种直观自然的输入方式,把人们从传统接触性的输入装置中解放出来,可以以一种更自然的方式与计算机交互,使计算机界面变得更加容易。 手势主要分为静态手势和动态手势两种,动态手势可以看作是连续的静态手势序列。动态手势具有丰富和直观的表达能力,与静态手势结合在一起,能创造出更丰富的语义。利用动态手势识别构建新型的交互界面,是新一代的人机交互界面对输入方式自然性的要求,可以弥补传统交互方式的不足。基于视觉和手势识别研究正处于蓬勃发展的阶段,仍存着的许多值得研究的问题。研究基于视觉的动态手势识别对于构建更加好友的人机交互界面很有意义。

图像处理技术的研究现状和发展趋势 庄振帅 数字图像处理又称为计算机图像处理,它是指将图像信号转换成数字信号并利用计算机对其进行处理的过程。数字图像处理最早出现于20世纪50年代,当时的电子计算机已经发展到一定水平,人们开始利用计算机来处理图形和图像信息。数字图像处理作为一门学科大约形成于20世纪60年代初期。早期的图像处理的目的是改善图像的质量,它以人为对象,以改善人的视觉效果为目的。图像处理中,输入的是质量低的图像,输出的是改善质量后的图像,常用的图像处理方法有图像增强、复原、编码、压缩等。首次获得实际成功应用的是美国喷气推进实验室(JPL)。他们对航天探测器徘徊者7号在1964年发回的几千张月球照片使用了图像处理技术,如几何校正、灰度变换、去除噪声等方法进行处理,并考虑了太阳位置和月球环境的影响,由计算机成功地绘制出月球表面地图,获得了巨大的成功。随后又对探测飞船发回的近十万张照片进行更为复杂的图像处理,以致获得了月球的地形图、彩色图及全景镶嵌图,获得了非凡的成果,为人类登月创举奠定了坚实的基础,也推动了数字图像处理这门学科的诞生。在以后的宇航空间技术,如对火星、土星等星球的探测研究中,数字图像处理都发挥了巨大的作用。数字图像处理取得的另一个巨大成就是在医学上获得的成果。1972年英国EMI公司工程师Housfield发明了用于头颅诊断的X射线计算机断层摄影装置,也就是我们通常所说的CT(Computer Tomograph)。CT的基本方法是根据人的头部截面的投影,经计算机处理来重建截面图像,称为图像重建。1975年EMI公司又成功研制出全身用的CT 装置,获得了人体各个部位鲜明清晰的断层图像。1979年,这项无损伤诊断技术获得了诺贝尔奖,说明它对人类作出了划时代的贡献。与此同时,图像处理技术在许多应用领域受到广泛重视并取得了重大的开拓性成就,属于这些领域的有航空航天、生物医学过程、工业检测、机器人视觉、公安司法、军事制导、文化艺术等,使图像处理成为一门引人注目、前景远大的新型学科。随着图像处理技术的深入发展,从70年代中期开始,随着计算机技术和人工智能、思维科学研究的迅速发展,数字图像处理向

0 引言 操作控制器作为一种人机交互设备有着广泛的应用,比如在日常生活中,各种家电玩具的遥控器、触摸屏等,在工业生产领域各种仪器仪表设备的操作、设置和校验等。传统的操作控制器主要是通过人机接触的方式进行操作,比如按键,触摸屏等,这种操作方式容易产生静电,对于敏感的精密仪器设备影响较大,产生干扰[1]。有些设备会安置在高温高压或者有辐射的环境中,人机接触会给人体带来伤害,安全性低。市面上有些仪器仪表配有手持操作设备可以通过无线通信的方式进行操作,这种方式成本高,手持操作设备携带不方便。本文基于ARM 处理器芯片和光学数组式传感器设计了一种非接触的手势识别操作器,可将手势动作转化为控制信号,对于目标设备进行操作,安全便捷,可靠性高,具有广泛的应用场景[2]。 1 系统总体设计 本文设计的手势识别操作控制器系统总体分为三大模块,如图1所示,分别是手势检测模块,系统控制模块,和信号传输模块。 手势检测模块的主要任务是实时感应监测范围内的手 势活动,将感应到的手势活动信息转化为电信号并传输给控制系统模块。控制系统模块的功能是根据接收到的手势检测模块的电信号,经过处理识别具体的手势动作并转化为数字信号生成控制信息,通过信号传输模块对于目标设备进行操作[3]。 2 系统硬件设计 2.1 手势检测模块 手势识别传感器模块采用了采用原相科技(Pixart)公司的PAJ7620U2芯片,芯片结构如图2所示,该芯片内部集成了光学数组式传感器,以使复杂的手势和光标模式输出,可以检测出九种手势动作,支持上、下、左、右、前、后、顺时针旋转、逆时针旋转和挥动的手势动作识别,以及支持物体接近检测等功能。芯片结构功能如图所示,该芯片具体积小、灵敏度高、支持中断输出、兼容3.3V/5V 系统、使用方便等特点。 手势检测模块电路设计如图3所示,通过两个3.3V 超低压差稳压芯片,给PAJ7620芯片供电,外部分供电电源使用5V。IIC 通信时钟线IIC_SCL、IIC 通信数据线IIC_SDA 和中断输出引脚配有4.7引上拉电阻用于稳定信号输出。PAJ7620内部自带LED 驱动器,传感器感应阵列、目标信息提取阵列和手势识别阵列。PAJ7620工作时通过内部LED 驱动 器,驱动红外LED 向外发射红外线信号,当传感器阵列在有效的距离中探测到物体时,目标信息提取阵列会对探测目标进行特征原始数据的 获取,获取的数据会存在寄存器中,同时手势识 are operated by recognizing gesture movements. The application shows that the design is easy to operate, small size, high security, and can be widely used in scenarios.Key words : gesture recognition; sensor; STM32; operator 图1 系统结构图

摘要 对图像进行精确识别,具有非常重要的研究意义,图像识别技术在医药学、航天、军事、工农业等诸多方面发挥着重要的作用。当前图像识别方法大多采用人工提取特征,不仅费时费力,而且提取困难;而深度学习是一种非监督学习,学习过程中可以不知道样本的标签值,整个过程无需人工参与也能提取到好的特征。近年来,将深度学习用于图像识别成为了图像识别领域的研究热点,已取得了良好的效果,并且有广阔的研究空间。 本文基于深度学习在图像识别的相关理论,分析了深度学习的基本模型和方法,并在相关图像数据集上实验论证;另外鉴于深度学习多用于大样本集,本文基于小样本提出了一种改进算法,具体工作内容如下: (1)分析深度学习中卷积神经网络(Convolutional Neural Networks,CNNs)的基本原理,研究其训练过程和模型结构。其中卷积层通过卷积运算,可以使原信号增强,并且降低噪声,提高信噪比;降采样对卷积层的图像进行子抽样,在保证了有用信息不降低的基础上,减少数据处理量。将其在 MNIST手写字体数据集上进行实验,通过对比分析了该方法和其他经典算法在识别率和时间方面的优劣。 (2)针对于卷积神经网络训练时间过长这一缺陷,分析了深度学习中深度信念网络(Deep Belief Networks,DBNs)的基本原理、训练过程和模型结构。DBNs的分层训练机制大大减少了训练难度,减少了训练时间。引入Softmax作为模型的分类器,将其在MNIST手写字体数据集上进行实验,实验表明:深度信念网络在识别率上和卷积神经网络持平,但训练方法的改善使得消耗时间大大减少。此外,该方法在自然场景CIFAR-10库上也有较好的实验效果。 (3)鉴于深度学习多适用于较大的数据集,针对小样本提出了一种改进的深度信念网络结构:深度信念网络整个过程可以分为预训练和参数微调两个阶段,改进的算法在预训练阶段对样本进行降采样;在参数微调阶段引入随机隐退(Dropout),将隐含层的结点随机清零掉一部分,保持其权重不更新。将改进的模型在MNIST子集和ORL数据集上进行实验,实验表明:在小样本中,引入降采样和随机隐退后,深度信念网络在识别率和耗时方面都有不错的改善,过拟合现象得到有效缓解。 关键字:深度学习图像识别卷积神经网络深度信念网络小样本集 I

龙源期刊网 https://www.doczj.com/doc/ab17679826.html, 基于深度图像技术的手势识别方法 作者:付学娜 来源:《电子技术与软件工程》2015年第04期 所谓手势是指人手或手臂同人手结合而产生的动作或姿势,作为人机交互的一项重要技术,手势识别通过在人手安置相关的硬件设备,并通过硬件设备中的计算模块对人手的位置和速度等信息进行获取,对于识别过程中的定位和跟踪均都具有良好的指导和保障作用。本文通过对手势识别系统与深度图像的成像原理进行阐述,进而结合手势区域分割的相关理论,对基于深度图像技术的手势识别方法展开了深入研究。 【关键词】深度图像技术手势识别圆形轨迹像素值变化点 随着科技的不断发展,基于视觉的手势识别已成为新一代人机交互中的核心技术。在借助相关图像信息的基础上,计算机可以对人手的各种姿态信息以及不同的手势信息尽心准确识别,有效提高了识别的速度与质量。本文以基于深度图像技术的手势识别作为研究对象,通过对手势识别系统及深度图像成像原理进行分析,从手势区域分割以及手势特征提取两方面出发,对深度图像技术下手势识别的方法做出了详细分析。 1 手势识别系统与深度图像成像原理 基于深度图像技术的手势识别系统主要包括了手势、深度图像、手势区域分割、手势特征提取以及手势识别和人机交互等,深度图像以非接触测量的方式对场景中的深度信息进行采集,而所采集的深度信息具有较强的稳定性和可靠性,即不受物体(人手)自身颜色、背景环境和纹理特征等因素的影响。本文以微软的Kinect作为图像采集和获取深度信息的工具,进而对手势识别展开分析。 基于Kinect下的深度图像技术下所采集的640×480深度图像信息的速度可达30f/s,且信息的分辨率维持在5mm左右,在应用方面具有较强的合理性。通过在相关场景采集的场景深度值进行转换,使其转移到灰度值空间,并使深度图像中所有的像素点灰度值大小与实际场景中不同的深度值相对应,进而显示成像。值得注意的是品拍摄区域与深度摄像头之间的距离与图像中的灰度值呈现出明显的负相关关系,即灰度值越大,距离越近。 2 基于深度图像技术的手势识别 2.1 手势区域分割 虽然具有相同深度的像素点,其在深度图像中所具有的灰度值也具有较高的一致性,但由于在每次对人手手势进行拍摄时,人手同深度摄像头间的距离存在差异。因此,无法利用单一的固定阈值对手势区域进行分割,故本文以灰度值直方图作为主要研究方法,进而确定出相关背景及手势区域分割的阈值。由于人手做出相关姿势的区域距离深度摄像头较近,且相对于整

基于摄像头的手势识别技术 1、手势识别的概念 手势是姿势的一个子集,姿势这个概念没有精确的定义。一般认为,手势概念经过人的于转化为的于势动作,观察者看到的是于势动作的图像雎1。手势的产生过程如图1-1所示。 图1-1 手势识别的过程则找一个从图像V到概念动作G的变换而,如图下所示。 2、手势识别流程 手势识别流程包手势图像获取、手势分割、手势特征提取、手势识别四大部分,如图2-1所示。 图2-1

3. 手势建模 在手势识别框架中,手势模型是一个最基本的部分。根据不同的应用背景,于势识别采用的模型会有不同,而对于不同的手势模型,采用的手势检测与跟踪算法、特征提取、识别技术也会有差别。手势建模主要分为基于表观的手势模型与基于三维的于势模型。 基于表观的手势建模是一种二维建模,从二维平面观察得到的平面图像信息描述于的特征。 基于表观的手势模型主要包括基于颜色的模型与基于轮廓的模型两种。 基于颜色的手势模型是把手势图像看作像素颜色的集合,通过提取手部的颜色的特征来描述手势。 基于颜色的手势模型的常用特征是颜色直方图。基于轮廓的手势模型是把手看作一个轮廓,通过提取手部图像中手的轮廓的几何特征来描述手势。 4. 手势检测与跟踪 手势检测与跟踪是手势识别处理流程中最前端的处理部分,它处理从摄像头获取到手势图像(序列),从中检测和分割手势对象。如果是动态手势识别,还要对手进行跟踪。 基于运动信息的方法: 基于运动信息的方法是假设在视频中只有手是运动物体。 其中一种方法是背景减法。 它要求背景静止不变,把视频中的每帧与背景相减,背景相同的部分变为零,不同的部分就认为是运动的物体,即手。

关于计算机视觉的手势识别综述 蒋指挥 (江苏科技大学江苏镇江 213022) 摘要:计算机技术的高速发展也产生了许多新领域,在此对以计算机视觉为基础的手势检测识别技术展开综述。主要阐述该技术的发展历程、实现方法、研究现状以及其存在的不足之处和发展方向。结果表明简单的可穿戴设备的手势识别和深度视觉传感器的手势识别和多方法交叉融合的手势识别是未来该领域的发展方向。 关键词:计算机视觉;手势识别;人机交互 A survey of gesture recognition in computer vision//Jiang Zhi Hui Abstract;With the rapid development of computer technology, a lot of new fields have been developed. In this paper, the technology of gesture detection and recognition based on computer vision is reviewed. This paper describes the development of the technology, the realization method, the research status and its shortcomings and development direction. The results show that the simple wearable device for hand gesture recognition and depth vision sensor for hand gesture recognition and multi method cross fusion for gesture recognition is the future direction of the development of the field. Key words:Computer vision; gesture recognition; human-computer interaction 计算机在我们的生活中越来越不可或缺,我们同时也对计算机提出了更高的要求,计算机视觉的手势识别正是对计算机应用拓展的重要途径,例如现在的VR技术,就是应用了手势识别才实现的。ABIResearch公司高级分析师约书亚·弗拉德(JoshuaFlood)指出:“免提操作或手势识别很快将成为高端旗舰智能手机、媒体平板电脑和智能眼镜区别于其他同类产品的一个关键因素。三星电子最新推出银河S4已经将这项技术用于其手机中,并以其全新的用户体验获得用户交口称赞。此外,在一系列新型智能眼镜产品即将发布之时,不难想象这类技术将被采用。”其实手势识别技术涵盖了许多领域,比如物理学、生物学等,实现手势识别的方式有很多种从一开始的二维手型识别、二维手势识别到后来的三维手势识别,正是计算机视觉技术的发展使得手势识别的实现方式更加多样。但目前的技术仍然很繁琐,冗杂的可穿戴设备就直接影响了使用者的舒适感,其还有很大的发展空间。 1、手势识别的发展历程及其实现方法

? 159 ? ELECTRONICS WORLD ? 技术交流 系统采用了STM32作为核心控制芯片,使用FDC2214芯片获取电容值,通过滤波后,与样本数据对比,找到最短的k 个样本,判断其类型数量,达到识别手势的目的。 1.总体设计 系统总体设计框架如图1所示,采用了STM32F103ZET6作为核心控制芯片,而核心检测芯片则采用的是TI 公司的FDC2214来处理极板与手之间的容值。得到的数据通过卡尔曼滤波和knn 算法来判断出不同手势之间的区别。 以独立按键来调节菜单和录入手势模板,通过oled 显示屏做出反馈并显示结果。 将手势录入一边,系统会自动处理好数据,再进入判决模式就 可以识别手势。 图1 系统总体设计框架 2.系统硬件设计 2.1 控制部分 本系统的控制核心采用了STM32单片机,它具有72M 主频,64K RAM 和512K ROM ,拥有多达14个定时器,自带PWM ,ADC ,DA,实时时钟等功能。非常满足作为嵌入式系统的控制需求。2.2 检测部分 电容检测部分是整个系统中最为重要的一部分,它决定了系统的识别率高低与否,整个系统的数据采样与检测都是建立在电容检测芯片的准确性上,因此选取TI 公司的FDC2214芯片来做为电容检测芯片,这是一种非接触式电容传感器,还有一个重要特性就是采用了EMI (抗电磁干扰)架构,因此它可以屏蔽高噪声环境干扰,在复杂环境确保传感器数据的准确性(周孟强,刘会衡,基于FDC2214手势识别装置的设计与实现:电子制作,2019)。2.3 极板部分 极板采用的是三层结构,最下面一层使用亚克力板,主要用作 的oled 显示屏,它小巧精致,分辨率高,相比液晶屏幕它更加节能,非常适合作为系统的显示模块。 输入部分由4个独立按键组成。4个独立按键分别作为切换键,确认键,返回键和系统复位键。 2.5 供电部分 电源部分采用了两块锂电池作为电源,使用稳压模块将电压降为5v 并后接入整个系统。 3.系统软件设计 软件系统流程图如图3所示。3.1 数据滤波算法设计数据滤波是去除噪音干扰的有 基于FDC2214的手势识别系统设计与实现 杨凌职业技术学院 陈 阳 图2 极板实物图支撑。中间一层使用铝箔胶带作为极板的金属层。最上面一层采用硬质透明塑料膜,有防止手直接和铝箔接触和保护极板的作用(郭霞,谭亚丽,申淼,基于FDC2214的手势识别系统:传感器与微系统,2018)。这样的设计好处在于可以很方便的自行调整和更换极板上的铝箔来达到不同的检测要求。2.4 人机交互部分 人机交互部分由显示部分和按键输入组成,分别采用oled 显示屏和独立按键组成。 显示部分采用了0.96 英寸 图3 系统软件流程图 效方法,本系统采用卡尔曼滤波算法,这是一种当下使用非常广泛的滤波算法,它有计算量小,易于计算机实现等特点(张辉,卜雯意,施豪,基于FDC2214电容传感器的手势识别装置的设计与实现:巢湖学院学报,2018 )。将极板上采集的数据进行实时的处理,将数据中 图4 系统整机实物图的噪音清除,把误差降到最小。3.2 数据分类算法 kNN (k 最近邻算法)是一种数据分类方法,在学习模式下,将多次手势进行采样并滤波后,获取其特征向量作为样本数据,之后进入判定模式,系统会实时采样当数据稳定后,得到其特征向量,计算其特征向量与样 本数据之间的欧氏距离,找到相 距最短的k 个样本,判断其类型,即可识别手势(张硕,基于KNN 算法的空间手势识别研究与应用:吉林大学,2017)。 表1 石头,剪刀,布手势测试结果 手势实测结果石头石头正确石头石头正确石头石头正确石头石头正确石头石头正确剪刀剪刀正确剪刀剪刀正确剪刀剪刀正确剪刀剪刀正确剪刀剪刀正确布布正确布布正确布布正确布布正确布布 正确 正确率:100%