第五章 聚类分析

5.1 判别分析和聚类分析有何区别?

答:即根据一定的判别准则,判定一个样本归属于哪一类。具体而言,设有n 个样本,对每个样本测得p 项指标(变量)的数据,已知每个样本属于k 个类别(或总体)中的某一类,通过找出一个最优的划分,使得不同类别的样本尽可能地区别开,并判别该样本属于哪个总体。聚类分析是分析如何对样品(或变量)进行量化分类的问题。在聚类之前,我们并不知道总体,而是通过一次次的聚类,使相近的样品(或变量)聚合形成总体。通俗来讲,判别分析是在已知有多少类及是什么类的情况下进行分类,而聚类分析是在不知道类的情况下进行分类。

5.2 试述系统聚类的基本思想。

答:系统聚类的基本思想是:距离相近的样品(或变量)先聚成类,距离相远的后聚成类,过程一直进行下去,每个样品(或变量)总能聚到合适的类中。

5.3 对样品和变量进行聚类分析时, 所构造的统计量分别是什么?简要说明为什么这样构造?

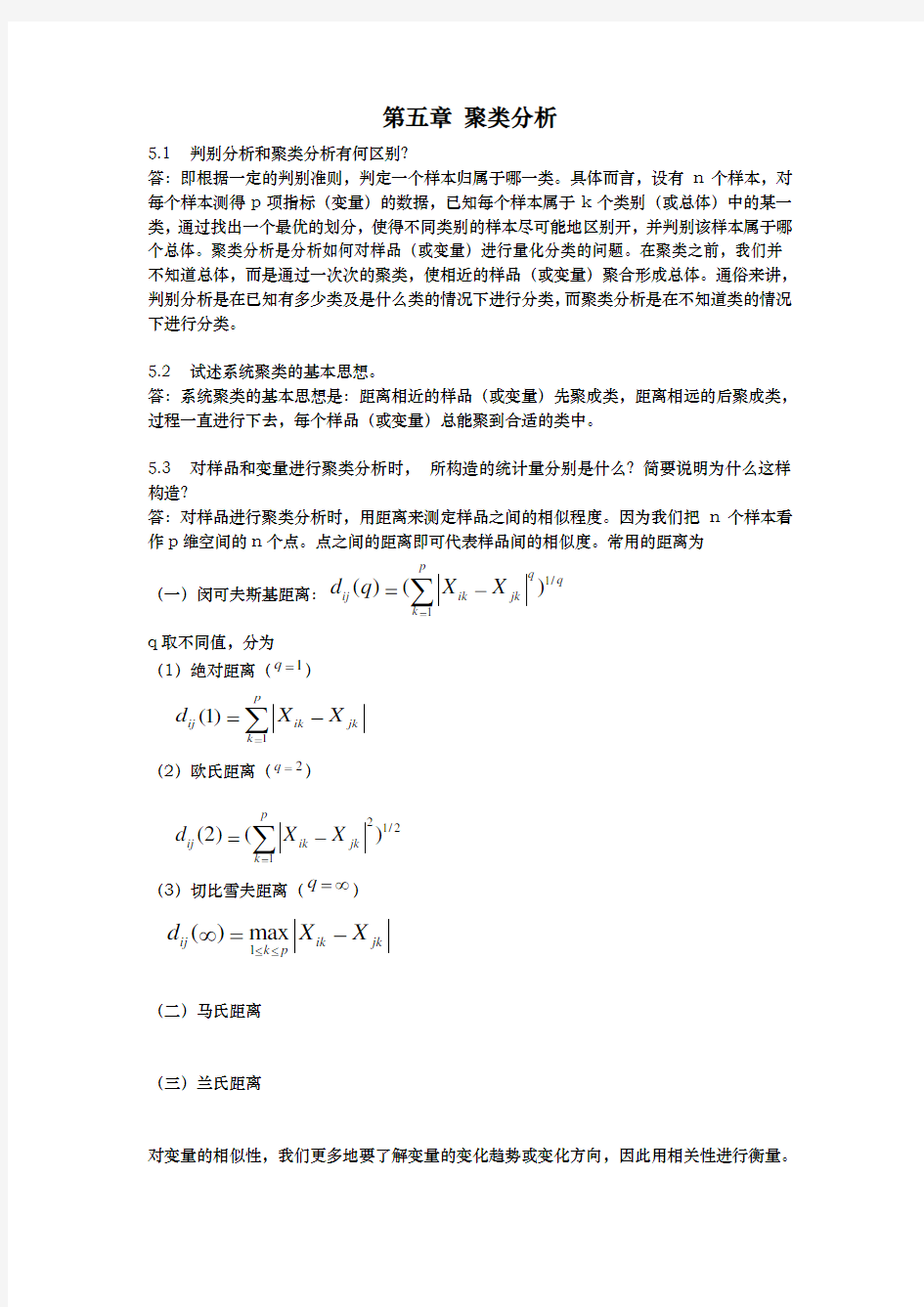

答:对样品进行聚类分析时,用距离来测定样品之间的相似程度。因为我们把n 个样本看作p 维空间的n 个点。点之间的距离即可代表样品间的相似度。常用的距离为 (一)闵可夫斯基距离:1/1

()()

p

q q

ij ik jk k d q X X ==-∑

q 取不同值,分为 (1)绝对距离(1q =)

1

(1)p

ij ik jk k d X X ==-∑

(2)欧氏距离(2q =)

21/2

1

(2)()

p

ij ik jk k d X X ==-∑

(3)切比雪夫距离(q =∞)

1()max ij ik jk

k p

d X X ≤≤∞=-

(二)马氏距离

(三)兰氏距离

对变量的相似性,我们更多地要了解变量的变化趋势或变化方向,因此用相关性进行衡量。

将变量看作p 维空间的向量,一般用 (一)夹角余弦

(二)相关系数

5.4 在进行系统聚类时,不同类间距离计算方法有何区别?选择距离公式应遵循哪些原则?

答: 设d ij 表示样品X i 与X j 之间距离,用D ij 表示类G i 与G j 之间的距离。 (1). 最短距离法

,min

i k j r

kr ij X G X G D d ∈∈=

min{,}kp kq D D =

(2)最长距离法

,max

i p j q

pq ij X G X G D d ∈∈=

,max

i k j r

kr ij X G X G D d ∈∈=

max{,}kp kq D D =

(3)中间距离法

其中

(4)重心法

2()()pq p q p q D X X X X '=--

)(1

q q p p r

r X n X n n X +=

22222

p q p q kr

kp

kq

pq r

r

r n n n n D D D D n n n =

+

-

(5)类平均法

221

i p j j

pq ij

X G X G p q

D d n n ∈∈=

∑∑

221

i k j r

kr ij

X G X G k r

D d n n ∈∈=

∑∑

2

2

p q kp kq

r

r

n n D D n n =+

(6)可变类平均法

其中是可变的且 <1

(7)可变法

2222

1()2

kr kp kq pq D D D D ββ-=

++ 其中是可变的且 <1 (8)离差平方和法

1

()()t

n t it t it t t S X X X X ='=--∑

2222

k p k q k kr

kp

kq pq r k

r k

r k

n n n n n D D D D n n n n n n ++=

+

-

+++

通常选择距离公式应注意遵循以下的基本原则:

(1)要考虑所选择的距离公式在实际应用中有明确的意义。如欧氏距离就有非常明确的空间距离概念。马氏距离有消除量纲影响的作用。

(2)要综合考虑对样本观测数据的预处理和将要采用的聚类分析方法。如在进行聚类分析之前已经对变量作了标准化处理,则通常就可采用欧氏距离。

(3)要考虑研究对象的特点和计算量的大小。样品间距离公式的选择是一个比较复杂且带有一定主观性的问题,我们应根据研究对象的特点不同做出具体分折。实际中,聚类分析前不妨试探性地多选择几个距离公式分别进行聚类,然后对聚类分析的结果进行对比分析,以确定最合适的距离测度方法。

5.5试述K 均值法与系统聚类法的异同。

答:相同:K —均值法和系统聚类法一样,都是以距离的远近亲疏为标准进行聚类的。

不同:系统聚类对不同的类数产生一系列的聚类结果,而K —均值法只能产生指定类数的聚类结果。

具体类数的确定,离不开实践经验的积累;有时也可以借助系统聚类法以一部分样品为

2222

(1)()p q

kr kp kq pq

r r

n n D D D D n n ββ=-+

+

对象进行聚类,其结果作为K —均值法确定类数的参考。

5.6 试述K 均值法与系统聚类有何区别?试述有序聚类法的基本思想。

答:K 均值法的基本思想是将每一个样品分配给最近中心(均值)的类中。系统聚类对不同的类数产生一系列的聚类结果,而K —均值法只能产生指定类数的聚类结果。具体类数的确定,有时也可以借助系统聚类法以一部分样品为对象进行聚类,其结果作为K 均值法确定类数的参考。

有序聚类就是解决样品的次序不能变动时的聚类分析问题。如果用)()2()1(,,,n X X X Λ表示

n 个有序的样品,则每一类必须是这样的形式,即)()1()(,,,j i i X X X Λ+,其中,1n i ≤≤且

n j ≤,简记为},,1,{j i i G i Λ+=。在同一类中的样品是次序相邻的。一般的步骤是(1)

计算直径{D (i,j )}。(2)计算最小分类损失函数{L[p(l,k)]}。(3)确定分类个数k 。(4)最优分类。

5.7 检测某类产品的重量, 抽了六个样品, 每个样品只测了一个指标,分别为1,2,3,6,9,11.试用最短距离法,重心法进行聚类分析。 (1)用最短距离法进行聚类分析。 采用绝对值距离,计算样品间距离阵

1 0

2 1 0

5 4 3 0

8 7 6 3 0

10 9 8 5 2 0 由上表易知 中最小元素是 于是将,,聚为一类,记为 计算距离阵

3 0

6 3 0 8 5 2 0

中最小元素是=2 于是将,聚为一类,记为 计算样本距离阵 0

3 0

6 3 0

中最小元素是 于是将,聚为一类,记为 因此,

(2)用重心法进行聚类分析

计算样品间平方距离阵

1 0

4 1 0

25 16 9 0

64 49 36 9 0

100 81 64 25 4 0 易知中最小元素是于是将,,聚为一类,记为计算距离阵

16 0

49 9 0

81 25 4 0

注:计算方法,其他以此类推。

中最小元素是=4 于是将,聚为一类,记为

计算样本距离阵

16 0

64 16 0

中最小元素是于是将,聚为一类,记为

因此,

5.8 下表是15个上市公司2001年的一些主要财务指标,使用系统聚类法和K-均值法分

公司编号净资产

收益率

每股净

利润

总资产

周转率

资产负

债率

流动负

债比率

每股净

资产

净利润增

长率

总资产

增长率

1 11.09 0.21 0.05 96.98 70.53 1.86 -44.04 81.99

2 11.96 0.59 0.74 51.78 90.7

3 4.95 7.02 16.11

3 0 0.03 0.03 181.99 100 -2.98 103.33 21.18

4 11.58 0.13 0.17 46.07 92.18 1.14 6.5

5 -56.32

5 -6.19 -0.09 0.03 43.3 82.24 1.52 -1713.5 -3.36

6 10 0.4

7 0.4

8 68.4 86 4.7 -11.56 0.85

7 10.49 0.11 0.35 82.98 99.87 1.02 100.23 30.32

8 11.12 -1.69 0.12 132.14 100 -0.66 -4454.39 -62.75

9 3.41 0.04 0.2 67.86 98.51 1.25 -11.25 -11.43

10 1.16 0.01 0.54 43.7 100 1.03 -87.18 -7.41

11 30.22 0.16 0.4 87.36 94.88 0.53 729.41 -9.97

12 8.19 0.22 0.38 30.31 100 2.73 -12.31 -2.77

13 95.79 -5.2 0.5 252.34 99.34 -5.42 -9816.52 -46.82

14 16.55 0.35 0.93 72.31 84.05 2.14 115.95 123.41

15 -24.18 -1.16 0.79 56.26 97.8 4.81 -533.89 -27.74

解:令净资产收益率为X1,每股净利润X2,总资产周转率为X3,资产负债率为X4,流动负债比率为X5,每股净资产为X6,净利润增长率为X7,总资产增长率为X8,用spss 对公司聚类分析的步骤如下:

a)系统聚类法:

1.在SPSS窗口中选择Analyze→Classify→Hierachical Cluster,调出

系统聚类分析主界面,并将变量X8

-

X1移入Variables框中。在Cluster 栏中选择Cases单选按钮,即对样品进行聚类(若选择Variables,则

对变量进行聚类)。在Display栏中选择Statistics和Plots复选框,

这样在结果输出窗口中可以同时得到聚类结果统计量和统计图。

图5.1 系统分析法主界面

2.点击Statistics按钮,设置在结果输出窗口中给出的聚类分析统计量。

我们选择Agglomeration schedule与Cluster Membership中的Range of solution 2-4,如图5.2所示,点击Continue按钮,返回主界面。

(其中,Agglomeration schedule表示在结果中给出聚类过程表,显示系统聚类的详细步骤;Proximity matrix 表示输出各个体之间的距离矩阵;Cluster Membership 表示在结果中输出一个表,表中显示每个个体被分配到的类别,Range of solution 2-4即将所有个体分为2至4类。)

3.点击Plots按钮,设置结果输出窗口中给出的聚类分析统计图。选中

Dendrogram复选框和Icicle栏中的None单选按钮,如图5.3,即只给出聚类树形图,而不给出冰柱图。单击Continue按钮,返回主界面。

图5.2 Statistics子对话框图5.3 Plots子对话框

4.点击Method按钮,设置系统聚类的方法选项。Cluster Method下拉

列表用于指定聚类的方法,这里选择Between-group inkage(组间平

均数连接距离);Measure栏用于选择对距离和相似性的测度方法,选

择Squared Euclidean distance(欧氏距离);单击Continue按钮,返回主界面。

图5.4 Method子对话框图5.5 Save子对话框

5.点击Save按钮,指定保存在数据文件中的用于表明聚类结果的新变量。

None表示不保存任何新变量;Single solution表示生成一个分类变量,

在其后的矩形框中输入要分成的类数;Range of solutions表示生成多

个分类变量。这里我们选择Range of solutions,并在后面的两个矩形

框中分别输入2和4,即生成三个新的分类变量,分别表明将样品分为

2类、3类和4类时的聚类结果,如图5.5。点击Continue,返回主界

面。

6.点击OK按钮,运行系统聚类过程。

聚类结果分析:

下面的群集成员表给出了把公司分为2类,3类,4类时各个样本所属类别的情况,另外,从右边的树形图也可以直观地看到,若将15个公司分为2类,则13独自为一类,其余的为一类;若分为3类,则公司8分离出来,自成一类。以此类推。

表5.1 各样品所属类别表

图5.6 聚类树形图

b)K均值法的步骤如下:

1.在SPSS窗口中选择Analyze→Classify→K-Means Cluster,调出K

均值聚类分析主界面,并将变量X1-X8移入Variables框中。在Method

框中选择Iterate classify,即使用K-means算法不断计算新的类中心,并替换旧的类中心(若选择Classify only,则根据初始类中心进行聚类,在聚类过程中不改变类中心)。在Number of Cluster后面的矩形框中

输入想要把样品聚成的类数,这里我们输入3,即将15个公司分为3

类。

(Centers按钮,则用于设置迭代的初始类中心。如果不手工设置,则

系统会自动设置初始类中心,这里我们不作设置。)

图5.7K均值聚类分析主界面

2.点击Iterate按钮,对迭代参数进行设置。Maximum Iterations参数

框用于设定K-means算法迭代的最大次数,输入10,Convergence Criterion参数框用于设定算法的收敛判据,输入0,只要在迭代的过程中先满足了其中的参数,则迭代过程就停止。单击Continue,返回主界面。

图5.8 Iterate子对话框

3.点击Save按钮,设置保存在数据文件中的表明聚类结果的新变量。我

们将两个复选框都选中,其中Cluster membership选项用于建立一个代表聚类结果的变量,默认变量名为qcl_1;Distance from cluster center选项建立一个新变量,代表各观测量与其所属类中心的欧氏距离。单击Continue按钮返回。

图5.9Save子对话框

4.点击Options按钮,指定要计算的统计量。选中Initial cluster centers

和Cluster information for each case复选框。这样,在输出窗口中

将给出聚类的初始类中心和每个公司的分类信息,包括分配到哪一类和该公司距所属类中心的距离。单击Continue返回。

图5.10Options子对话框

5.点击OK按钮,运行K均值聚类分析程序。

聚类结果分析:

以下三表给出了各公司所属的类及其与所属类中心的距离,聚类形成的类的中心的各变量值以及各类的公司数。由以上表格可得公司13与公司8各自成一类,其余的公司为一类。

通过比较可知,两种聚类方法得到的聚类结果完全一致。

5.9下表是某年我国16个地区农民支出情况的抽样调查数据,每个地区调查了反映每人平均生活消费支出情况的六个经济指标。试通过统计分析软件用不同的方法进行系统聚类分

地区食品衣着燃料住房交通和

通讯娱乐教育文化

北京190.33 43.77 9.73 60.54 49.01 9.04

天津135.2 36.4 10.47 44.16 36.49 3.94

河北95.21 22.83 9.3 22.44 22.81 2.8

山西104.78 25.11 6.4 9.89 18.17 3.25

内蒙128.41 27.63 8.94 12.58 23.99 2.27

辽宁145.68 32.83 17.79 27.29 39.09 3.47

吉林159.37 33.38 18.37 11.81 25.29 5.22

黑龙江116.22 29.57 13.24 13.76 21.75 6.04

上海221.11 38.64 12.53 115.65 50.82 5.89

江苏144.98 29.12 11.67 42.6 27.3 5.74

浙江169.92 32.75 12.72 47.12 34.35 5

安徽135.11 23.09 15.62 23.54 18.18 6.39

福建144.92 21.26 16.96 19.52 21.75 6.73

江西140.54 21.5 17.64 19.19 15.97 4.94

山东115.84 30.26 12.2 33.6 33.77 3.85

河南101.18 23.26 8.46 20.2 20.5 4.3

为X5,娱乐教育文化支出为X6,用spss对16各地区聚类分析的步骤如5.8题,不同的方法在第4个步骤的Method子对话框中选择不同的Cluster method。

1.Between-group inkage(组间平均数连接距离)

上表给出了把全国16个地区分为2类、3类和4类时,各地区所属的类别,另外从右边的树形图也可以直观地观察到,若用组间平均数连接距离将这些地区分为3类,则9(上海)独自为一类,1(北京)和11(浙江)为一类,剩余地区为一类。

2.Within-group linkage(组内平均连接距离)

若用组内平均数连接距离将这些地区分为3类,则9(上海)独自为一类,1(北京)独自为一类,剩余地区为一类。

3.Nearest neighbor(最短距离法)

若用最短距离法将这些地区分为3类,则9(上海)独自为一类,1(北京)独自为一类,剩余地区为一类。

4.Furthest neighbor(最远距离法)

若用最远距离法将这些地区分为3类,则9(上海)独自为一类,1(北京)和11(浙江)为一类,剩余地区为一类。

5.Centroid cluster(重心法)

若用重心法将这些地区分为3类,则9(上海)独自为一类,1(北京)和11(浙江)为一类,剩余地区为一类。

6.Median cluster(中位数距离)

若用中位数距离法将这些地区分为3类,则9(上海)独自为一类,1(北京)和11(浙江)为一类,剩余地区为一类。

7.Ward method(离差平方和)

若用离差平方和法将这些地区分为3类,则9(上海),1(北京)和11(浙江)为一类,2(天津)、6(辽宁)、7(吉林)、10(江苏)、12(安徽)、13(福建)和14(江西)为一类,剩余地区为一类。

5.10 根据上题数据通过SPSS统计分析软件进行快速聚类运算,并与系统聚类分析结果进行比较。

解:快速聚类运算即K均值法聚类,具体步骤同5.8,聚类结果如下:

聚类的结果为9(上海)独自为一类,1(北京)、2(天津)、6(辽宁)、7(吉林)、10(江苏)、11(浙江)、13(福建)和14(江西)为一类,剩余地区为一类。

5.11下表是2003年我国省会城市和计划单列市的主要经济指标:人均GDP 1x (元)、人均工业产值2x (元)、客运总量3x (万人)、货运总量4x (万吨)、地方财政预算内收入5x (亿元)、固定资产投资总额6x (亿元)、在岗职工占总人口的比例7x (%)、在岗职工人均工资额8x (元)、城乡居民年底储蓄余额9x (亿元)。试通过统计分析软件进行系统聚类分城市 1x

2x

3x

4x

5x

6x

7x

8x

9x

北京 31886 33168 3052

0 30671 593 2000 37.8 25312 6441 天津 26433 43732 3507 34679 205 934 18.8 18648 1825 石家庄 15134 13159 11843 10008 49 416 9.5 12306 1044 太原 15752 15831 2975 15248 33 197 22.8 12679 660 呼和浩特 18991 11257 3508 4155 21 182 13.5 14116 255 沈阳 23268 15446 6612 14636 81 557 14.8 14961 1423 大连 29145 27615 11001 21081 111 407 14.7 17560 1310 长春 18630 21045 6999 10892 46 294 12.5 13870 831 哈尔滨 14825 7561 6458 9518 76 423 17.7 12451 1154 上海 46586 77083 7212 63861 899 2274 21.0 27305 6055 南京 27547 43853 16790 14805 136 794 15.4 22190 1134 杭州

32667

49823

2134

1681

15

717

11.8

2466

146

解:用spss对37个地区聚类分析的步骤如5.8题,不同的方法在第4个步骤的Method 子对话框中选择不同的Cluster method。

1.Between-group inkage(组间平均数连接距离)

从上面的树形图可以直观地观察到,若用组间平均数连接距离将这些地区分为3类,则24(深圳)独自为一类,10(上海)和16(厦门)为一类,剩余地区为一类。

2.Within-group linkage(组内平均连接距离)

若用组内平均数连接距离将这些地区分为3类,则24(上海)独自为一类,27(重庆)和28(成都)为一类,剩余地区为一类。

3. Nearest neighbor(最短距离法)

若用最短距离法将这些地区分为2类,则24(深圳)独自为一类,剩余地区为一类。

4.Furthest neighbor(最远距离法)

若用最远距离法将这些地区分为3类,则24(深圳)独自为一类,1(北京)、2(天津)、7(大连)、10(上海)、11(南京)、12(杭州)、13(宁波)、16(厦门)、19(青岛)、23(广州)、36(海宁)和37(海口)为一类,剩余地区为一类。

5.Centroid cluster(重心法)

若用重心法将这些地区分为3类,则24(深圳)独自为一类,10(上海)和16(厦门)为一类,剩余地区为一类。

6.Median cluster(中位数距离)

若用中位数距离法将这些地区分为3类,则24(深圳)独自为一类,1(北京)、2(天津)、7(大连)、10(上海)、11(南京)、12(杭州)、13(宁波)、16(厦门)、19(青岛)、23(广州)、36(海宁)和37(海口)为一类,剩余地区为一类。

7.Ward method(离差平方和)

一、填空题: 1、多元统计分析是运用数理统计方法来研究解决多指标问题的理论和方法. 2、回归参数显著性检验是检验解释变量对被解释变量的影响是否著. 3、聚类分析就是分析如何对样品(或变量)进行量化分类的问题。通常聚类分析分为 Q型聚类和 R型聚类。 4、相应分析的主要目的是寻求列联表行因素A 和列因素B 的基本分析特征和它们的最优联立表示。 5、因子分析把每个原始变量分解为两部分因素:一部分为公共因子,另一部分为特殊因子。 6、若 () (,), P x N αμα ∑=1,2,3….n且相互独立,则样本均值向量x服从的分布 为_x~N(μ,Σ/n)_。 二、简答 1、简述典型变量与典型相关系数的概念,并说明典型相关分析的基本思想。 在每组变量中找出变量的线性组合,使得两组的线性组合之间具有最大的相关系数。选取和最初挑选的这对线性组合不相关的线性组合,使其配对,并选取相关系数最大的一对,如此下去直到两组之间的相关性被提取完毕为止。被选出的线性组合配对称为典型变量,它们的相关系数称为典型相关系数。 2、简述相应分析的基本思想。 相应分析,是指对两个定性变量的多种水平进行分析。设有两组因素A和B,其中因素A包含r个水平,因素B包含c个水平。对这两组因素作随机抽样调查,得到一个rc的二维列联表,记为。要寻求列联表列因素A和行因素B的基本分析特征和最优列联表示。相应分析即是通过列联表的转换,使得因素A

和因素B 具有对等性,从而用相同的因子轴同时描述两个因素各个水平的情况。把两个因素的各个水平的状况同时反映到具有相同坐标轴的因子平面上,从而得到因素A 、B 的联系。 3、简述费希尔判别法的基本思想。 从k 个总体中抽取具有p 个指标的样品观测数据,借助方差分析的思想构造一个线性判别函数 系数: 确定的原则是使得总体之间区别最大,而使每个总体内部的离差最小。将新样品的p 个指标值代入线性判别函数式中求出 值,然后根据判别一定的规则,就可以判别新的样品属于哪个总体。 5、简述多元统计分析中协差阵检验的步骤 第一,提出待检验的假设 和H1; 第二,给出检验的统计量及其服从的分布; 第三,给定检验水平,查统计量的分布表,确定相应的临界值,从而得到否定域; 第四,根据样本观测值计算出统计量的值,看是否落入否定域中,以便对待判假设做出决策(拒绝或接受)。 协差阵的检验 检验0=ΣΣ 0p H =ΣI : /2 /21exp 2np n e tr n λ???? =-?? ? ???? S S 00p H =≠ΣΣI : /2 /2**1exp 2np n e tr n λ???? =-?? ? ???? S S

数据挖掘聚类问题(Plants Data Set)实验报告 1.数据源描述 1.1数据特征 本实验用到的是关于植物信息的数据集,其中包含了每一种植物(种类和科属)以及它们生长的地区。数据集中总共有68个地区,主要分布在美国和加拿大。一条数据(对应于文件中的一行)包含一种植物(或者某一科属)及其在上述68个地区中的分布情况。可以这样理解,该数据集中每一条数据包含两部分内容,如下图所示。 图1 数据格式 例如一条数据:abronia fragrans,az,co,ks,mt,ne,nm,nd,ok,sd,tx,ut,wa,wy。其中abronia fragrans是植物名称(abronia是科属,fragrans是名称),从az一直到wy 是该植物的分布区域,采用缩写形式表示,如az代表的是美国Arizona州。植物名称和分布地区用逗号隔开,各地区之间也用逗号隔开。 1.2任务要求 聚类。采用聚类算法根据某种特征对所给数据集进行聚类分析,对于聚类形成的簇要使得簇内数据对象之间的差异尽可能小,簇之间的差距尽可能大。 2.数据预处理 2.1数据清理 所给数据集中包含一些对聚类过程无用的冗余数据。数据集中全部数据的组织结构是:先给出某一科属的植物及其所有分布地区,然后给出该科属下的具体植物及其分布地区。例如: ①abelmoschus,ct,dc,fl,hi,il,ky,la,md,mi,ms,nc,sc,va,pr,vi ②abelmoschus esculentus,ct,dc,fl,il,ky,la,md,mi,ms,nc,sc,va,pr,vi ③abelmoschus moschatus,hi,pr 上述数据中第①行给出了所有属于abelmoschus这一科属的植物的分布地区,接下来的②③两行分别列出了属于abelmoschus科属的两种具体植物及其分布地区。从中可以看出后两行给出的所有地区的并集正是第一行给出的地区集

聚类分析和判别分析练习题 一、选择题 1.需要在聚类分析中保序的聚类分析是( )。 A.两步聚类 B.有序聚类 C.系统聚类 D.k-均值聚类 2.在系统聚类中2R 是( )。 A.组内离差平方和除以组间离差平方和 B.组间离差平方和除以组内离差平方和 C.组间离差平方和除以总离差平方和 D.组间均方除以总均方。 3.系统聚类的单调性是指( )。 A.每步并类的距离是单调增的 B.每步并类的距离是单调减的 C.聚类的类数越来越少 D.系统聚类2R 会越来越小 4.以下的系统聚类方法中,哪种系统聚类直接利用了组内的离差平方和。( ) A.最长距离法 B.组间平均连接法 C.组内平均连接法 D.WARD 法 5.以下系统聚类方法中所用的相似性的度量,哪种最不稳健( )。 A.2 1()p ik jk k x x =-∑ B. 1p ik jk k ik jk x x x x =-+∑ C. 21p k =∑ D. 1()()i j i j -'x -x Σx -x 6. 以下系统聚类方法中所用的相似性的度量,哪种考虑了变量间的相关性( )。A.2 1()p ik jk k x x =-∑ B. 1 p ik jk k ik jk x x x x =-+∑ C. 21 p k =∑ D. 1()()i j i j -'x -x Σx -x 7.以下统计量,可以用来刻画分为几类的合理性统计量为( )? A.可决系数或判定系数2R B. G G W P P -

C.()/(1) /() G G W P G P n G -- - D.() G W P W - 8.以下关于聚类分析的陈述,哪些是正确的() A.进行聚类分析的统计数据有关于类的变量 B.进行聚类分析的变量应该进行标准化处理 C.不同的类间距离会产生不同的递推公式 D.递推公式有利于运算速度的提高。D(3)的信息需要D(2)提供。 9.判别分析和聚类分析所要求统计数据的不同是() A.判别分析没有刻画类的变量,聚类分析有该变量 B.聚类分析没有刻画类的变量,判别分析有该变量 C.分析的变量在不同的样品上要有差异 D.要选择与研究目的有关的变量 10.距离判别法所用的距离是() A.马氏距离 B. 欧氏距离 C.绝对值距离 D. 欧氏平方距离 11.在一些条件同时满足的场合,距离判别和贝叶斯判别等价,是以下哪些条件。 () A.正态分布假定 B.等协方差矩阵假定 C.均值相等假定 D.先验概率相等假定 12.常用逐步判别分析选择不了的标准是() A.Λ统计量越小变量的判别贡献更大 B.Λ统计量越大变量的判别贡献更大 C.判定系数越小变量的判别贡献更大 D.判定系数越大变量的判别贡献更大 二、填空题 1、聚类分析是建立一种分类方法,它将一批样本或变量按照它们在性质上的_______________进行科学的分类。 2.Q型聚类法是按_________进行聚类,R型聚类法是按_______进行聚类。 3.Q型聚类相似程度指标常见是、、,而R型聚类相似程度指标通常采用_____________ 、。 4.在聚类分析中需要对原始数据进行无量纲化处理,以消除不同量纲或数量级的影响,达到数据间

实验三 K-Means聚类算法 一、实验目的 1) 加深对非监督学习的理解和认识 2) 掌握动态聚类方法K-Means 算法的设计方法 二、实验环境 1) 具有相关编程软件的PC机 三、实验原理 1) 非监督学习的理论基础 2) 动态聚类分析的思想和理论依据 3) 聚类算法的评价指标 四、算法思想 K-均值算法的主要思想是先在需要分类的数据中寻找K组数据作为初始聚类中心,然后计算其他数据距离这三个聚类中心的距离,将数据归入与其距离最近的聚类中心,之后再对这K个聚类的数据计算均值,作为新的聚类中心,继续以上步骤,直到新的聚类中心与上一次的聚类中心值相等时结束算法。 实验代码 function km(k,A)%函数名里不要出现“-” warning off [n,p]=size(A);%输入数据有n个样本,p个属性 cid=ones(k,p+1);%聚类中心组成k行p列的矩阵,k表示第几类,p是属性 %A(:,p+1)=100; A(:,p+1)=0; for i=1:k %cid(i,:)=A(i,:); %直接取前三个元祖作为聚类中心 m=i*floor(n/k)-floor(rand(1,1)*(n/k)) cid(i,:)=A(m,:); cid; end Asum=0; Csum2=NaN; flags=1; times=1; while flags flags=0; times=times+1; %计算每个向量到聚类中心的欧氏距离 for i=1:n

for j=1:k dist(i,j)=sqrt(sum((A(i,:)-cid(j,:)).^2));%欧氏距离 end %A(i,p+1)=min(dist(i,:));%与中心的最小距离 [x,y]=find(dist(i,:)==min(dist(i,:))); [c,d]=size(find(y==A(i,p+1))); if c==0 %说明聚类中心变了 flags=flags+1; A(i,p+1)=y(1,1); else continue; end end i flags for j=1:k Asum=0; [r,c]=find(A(:,p+1)==j); cid(j,:)=mean(A(r,:),1); for m=1:length(r) Asum=Asum+sqrt(sum((A(r(m),:)-cid(j,:)).^2)); end Csum(1,j)=Asum; end sum(Csum(1,:)) %if sum(Csum(1,:))>Csum2 % break; %end Csum2=sum(Csum(1,:)); Csum; cid; %得到新的聚类中心 end times display('A矩阵,最后一列是所属类别'); A for j=1:k [a,b]=size(find(A(:,p+1)==j)); numK(j)=a; end numK times xlswrite('data.xls',A);

第五章 聚类分析 判别分析和聚类分析有何区别 答:即根据一定的判别准则,判定一个样本归属于哪一类。具体而言,设有n 个样本,对每个样本测得p 项指标(变量)的数据,已知每个样本属于k 个类别(或总体)中的某一类,通过找出一个最优的划分,使得不同类别的样本尽可能地区别开,并判别该样本属于哪个总体。聚类分析是分析如何对样品(或变量)进行量化分类的问题。在聚类之前,我们并不知道总体,而是通过一次次的聚类,使相近的样品(或变量)聚合形成总体。通俗来讲,判别分析是在已知有多少类及是什么类的情况下进行分类,而聚类分析是在不知道类的情况下进行分类。 试述系统聚类的基本思想。 答:系统聚类的基本思想是:距离相近的样品(或变量)先聚成类,距离相远的后聚成类,过程一直进行下去,每个样品(或变量)总能聚到合适的类中。 对样品和变量进行聚类分析时, 所构造的统计量分别是什么简要说明为什么这样构造 答:对样品进行聚类分析时,用距离来测定样品之间的相似程度。因为我们把n 个样本看作p 维空间的n 个点。点之间的距离即可代表样品间的相似度。常用的距离为 (一)闵可夫斯基距离:1/1 ()() p q q ij ik jk k d q X X ==-∑ q 取不同值,分为 (1)绝对距离(1q =) 1 (1)p ij ik jk k d X X ==-∑ (2)欧氏距离(2q =) 21/2 1 (2)() p ij ik jk k d X X ==-∑ (3)切比雪夫距离(q =∞) 1()max ij ik jk k p d X X ≤≤∞=- (二)马氏距离 (三)兰氏距离 对变量的相似性,我们更多地要了解变量的变化趋势或变化方向,因此用相关性进行衡量。 将变量看作p 维空间的向量,一般用 2 1()()()ij i j i j d M -'=--X X ΣX X 11()p ik jk ij k ik jk X X d L p X X =-=+∑

对数据进行聚类分析实验报告 1.方法背景 聚类分析又称群分析,是多元统计分析中研究样本或指标的一种主要的分类方法,在古老的分类学中,人们主要靠经验和专业知识,很少利用数学方法。随着生产技术和科学的发展,分类越来越细,以致有时仅凭经验和专业知识还不能进行确切分类,于是数学这个有用的工具逐渐被引进到分类学中,形成了数值分类学。近些年来,数理统计的多元分析方法有了迅速的发展,多元分析的技术自然被引用到分类学中,于是从数值分类学中逐渐的分离出聚类分析这个新的分支。结合了更为强大的数学工具的聚类分析方法已经越来越多应用到经济分析和社会工作分析中。在经济领域中,主要是根据影响国家、地区及至单个企业的经济效益、发展水平的各项指标进行聚类分析,然后很据分析结果进行综合评价,以便得出科学的结论。 2.基本要求 用FAMALE.TXT、MALE.TXT和/或test2.txt的数据作为本次实验使用的样本集,利用C均值和分级聚类方法对样本集进行聚类分析,对结果进行分析,从而加深对所学内容的理解和感性认识。 3.实验要求 (1)把FAMALE.TXT和MALE.TXT两个文件合并成一个,同时采用身高和体重数据作为特征,设类别数为2,利用C均值聚类方法对数据进行聚类,并将聚类结果表示在二维平面上。尝试不同初始值对此数据集是否会造成不同的结果。 (2)对1中的数据利用C均值聚类方法分别进行两类、三类、四类、五类聚类,画出聚类指标与类别数之间的关系曲线,探讨是否可以确定出合理的类别数目。 (3)对1中的数据利用分级聚类方法进行聚类,分析聚类结果,体会分级聚类方法。。(4)利用test2.txt数据或者把test2.txt的数据与上述1中的数据合并在一起,重复上述实验,考察结果是否有变化,对观察到的现象进行分析,写出体会 4.实验步骤及流程图 根据以上实验要求,本次试验我们将分为两组:一、首先对FEMALE 与MALE中数据组成的样本按照上面要求用C均值法进行聚类分析,然后对FEMALE、MALE、test2中数据组成的样本集用C均值法进行聚类分析,比较二者结果。二、将上述两个样本用分即聚类方法进行聚类,观察聚类结果。并将两种聚类结果进行比较。 (1)、C均值算法思想

毕业论文(设计)论文(设计)题目:PAM聚类算法的分析与实现 系别: 专业: 学号: 姓名: 指导教师: 时间:

毕业论文(设计)开题报告 系别:计算机与信息科学系专业:网络工程 学号姓名高华荣 论文(设计)题目PAM聚类算法的分析与实现 命题来源□√教师命题□学生自主命题□教师课题 选题意义(不少于300字): 随着计算机技术、网络技术的迅猛发展与广泛应用,人们面临着日益增多的业务数据,这些数据中往往隐含了大量的不易被人们察觉的宝贵信息,为了得到这些信息,人们想尽了一切办法。数据挖掘技术就是在这种状况下应运而生了。而聚类知识发现是数据挖掘中的一项重要的内容。 在日常生活、生产和科研工作中,经常要对被研究的对象经行分类。而聚类分析就是研究和处理给定对象的分类常用的数学方法。聚类就是将数据对象分组成多个簇,同一个簇中的对象之间具有较高的相似性,而不同簇中的对象具有较大的差异性。 在目前的许多聚类算法中,PAM算法的优势在于:PAM算法比较健壮,对“噪声”和孤立点数据不敏感;由它发现的族与测试数据的输入顺序无关;能够处理不同类型的数据点。 研究综述(前人的研究现状及进展情况,不少于600字): PAM(Partitioning Around Medoid,围绕中心点的划分)算法是是划分算法中一种很重要的算法,有时也称为k-中心点算法,是指用中心点来代表一个簇。PAM算法最早由Kaufman和Rousseevw提出,Medoid的意思就是位于中心位置的对象。PAM算法的目的是对n个数据对象给出k个划分。PAM算法的基本思想:PAM算法的目的是对成员集合D中的N个数据对象给出k个划分,形成k个簇,在每个簇中随机选取1个成员设置为中心点,然后在每一步中,对输入数据集中目前还不是中心点的成员根据其与中心点的相异度或者距离进行逐个比较,看是否可能成为中心点。用簇中的非中心点到簇的中心点的所有距离之和来度量聚类效果,其中成员总是被分配到离自身最近的簇中,以此来提高聚类的质量。 由于PAM算法对小数据集非常有效,但对大的数据集合没有良好的可伸缩性,就出现了结合PAM的CLARA(Cluster LARger Application)算法。CLARA是基于k-中心点类型的算法,能处理更大的数据集合。CLARA先抽取数据集合的多个样本,然后用PAM方法在抽取的样本中寻找最佳的k个中心点,返回最好的聚类结果作为输出。后来又出现了CLARNS(Cluster Larger Application based upon RANdomized

5.2酿酒葡萄的等级划分 5.2.1葡萄酒的质量分类 由问题1中我们得知,第二组评酒员的的评价结果更为可信,所以我们通过第二组评酒员对于酒的评分做出处理。我们通过excel计算出每位评酒员对每支酒的总分,然后计算出每支酒的10个分数的平均值,作为总的对于这支酒的等级评价。 通过国际酿酒工会对于葡萄酒的分级,以百分制标准评级,总共评出了六个级别(见表5)。 在问题2的计算中,我们求出了各支酒的分数,考虑到所有分数在区间[61.6,81.5]波动,以原等级表分级,结果将会很模糊,不能分得比较清晰。为此我们需要进一步细化等级。为此我们重新细化出5个等级,为了方便计算,我们还对等级进行降序数字等级(见表6)。 通过对数据的预处理,我们得到了一个新的关于葡萄酒的分级表格(见表7):

考虑到葡萄酒的质量与酿酒葡萄间有比较之间的关系,我们将保留葡萄酒质量对于酿酒葡萄的影响,先单纯从酿酒葡萄的理化指标对酿酒葡萄进行分类,然后在通过葡萄酒质量对酿酒葡萄质量的优劣进一步进行划分。 5.2.2建立模型 在通过酿酒葡萄的理化指标对酿酒葡萄分类的过程,我们用到了聚类分析方法中的ward 最小方差法,又叫做离差平方和法。 聚类分析是研究分类问题的一种多元统计方法。所谓类,通俗地说,就是指相似元素的集合。为了将样品进行分类,就需要研究样品之间关系。这里的最小方差法的基本思想就是将一个样品看作P 维空间的一个点,并在空间的定义距离,距离较近的点归为一类;距离较远的点归为不同的类。面对现在的问题,我们不知道元素的分类,连要分成几类都不知道。现在我们将用SAS 系统里面的stepdisc 和cluster 过程完成判别分析和聚类分析,最终确定元素对象的分类问题。 建立数据阵,具体数学表示为: 1111...............m n nm X X X X X ????=?????? (5.2.1) 式中,行向量1(,...,)i i im X x x =表示第i 个样品; 列向量1(,...,)'j j nj X x x =’,表示第j 项指标。(i=1,2,…,n;j=1,2,…m) 接下来我们将要对数据进行变化,以便于我们比较和消除纲量。在此我们用了使用最广范的方法,ward 最小方差法。其中用到了类间距离来进行比较,定义为: 2||||/(1/1/)kl k l k l D X X n n =-+ (5.2.2) Ward 方法并类时总是使得并类导致的类内离差平方和增量最小。 系统聚类数的确定。在聚类分析中,系统聚类最终得到的一个聚类树,如何确定类的个数,这是一个十分困难但又必须解决的问题;因为分类本身就没有一定标准,人们可以从不同的角度给出不同的分类。在实际应用中常使用下面几种

一、聚类分析的基本思想: 我们认为,所研究的样品或指标之间存在着程度不同的相似性。根据一批样品的多个观测指标,具体找出一些能够度量样品或指标之间的相似程度的统计量,以这些统计量为划分类型的依据,把一些相似程度较大的样品聚合为一类,把另一些彼此之间相似程度较大的样品又聚合到另外一类。把不同的类型一一划分出来,形成一个由小到大的分类系统。最后,用分群图把所有的样品间的亲疏关系表示出来。 二、聚类分析的方法 系统聚类法、模糊聚类法、K-均值法、有序样品的聚类、分解法、加入法 三、系统聚类法的种类 最短距离法、最长距离法、重心法、类平均法、离差平方和法 四、判别分析的基本思想 判别分析用来解决被解释变量是非度量变量的情形,预测和解释影响一个对象所属类别。识别一个个体所属类别的情况下有着广泛的应用 判别分析将对象进行分析,通过人们选择的解释变量来预测或者解释每个对象的所属类别。 五、判别分析的假设条件 判别分析的假设条件之一是每一个判别变量不能是其他判别变量的线性组合;判别分析的假设之二是各组变量的协方差矩阵相等。判别分析最简单和最常用的形式是采用线性判别函数。判别分析的假设之三是各判别变量之间具有多元正态分布,即每个变量对于所有其他变量的固定值有正态分布。当违背该假设时,计算的概率将非常的不准确。 六、判别分析的方法 距离判别法、Bayes判别法、Fisher判别法、逐步判别法

七、距离判别法的判别准则 设有两个总体1G 和2G ,x 是一个p 维样品,若能定义样品到总体1G 和2G 的距离d (x ,1G )和d (x ,2G ),则用如下规则进行判别:若样品x 到总体1G 的距离小于到总体2G 的距离,则认为样品x 属于总体1G ,反之,则认为样品x 属于总体样品x 属于总体2G ,若样品x 到总体1G 和2G 的距离相等,则让它待判。 八、Fisher 判别的思想 Fisher 判别的思想是投影,将k 组p 维数据投影到某一个方向,使的它们的投影与组之间尽可能地分开。 九、Bayes 判别的思想 Bayes 统计的思想是:假定对研究的对象已有一定的认识,常用先验概率分布来描述这种认识,然后我们取得一个样本,用样本来修正已有的认识,得到后验概率分布,各种统计推断都通过后验概率分布来进行。将Bayes 统计的思想用于判别分析,就得到Bayes 判别。 十、判别分析的方法和步骤 1.判别分析的对象 2.判别分析的研究设计 3.判别分析的假定 4.估计判别模型和评估整体拟合 5.结果的解释 6.结果的验证 十一、提取主成分的原则 1.累计方差贡献率大于85%, 2.特征根大于1 ,3碎石图特征根的变化趋势。 十二、因子分析的步骤 1.根据研究问题选取原始变量。 2.对原始变量进行标准化并求其相关阵,分析变量之间的相关性。 3.求解初始公共因子及因子载荷矩阵。 4.因子旋转。 5.因子得分。 6.根据因子得分值进行进一步分析。

K-均值聚类算法报告 摘要 K-均值是聚类方法中长用的一种划分方法,有很多优点,本文主要对K-均值是聚类方法的产生,工作原理,一般步骤,以及它的源码进行简单的介绍,了解K-均值是聚类!!! (一)课题名称:K-均值聚类(K-means clustering) (二)课题分析: J.B.MacQueen 在 1967 年提出的K-means算法[22]到目前为止用于科学和工业应用的诸多聚类算法中一种极有影响的技术。它是聚类方法中一个基本的划分方法,常常采用误差平方和准则函数作为聚类准则函数,误差平方和准则函数定义为: K-means 算法的特点——采用两阶段反复循环过程算法,结束的条件是不再有数据元素被重新分配: ① 指定聚类,即指定数据到某一个聚类,使得它与这个聚类中心的距离比它到其它聚类中心的距离要近。 ② 修改聚类中心。 优点:本算法确定的K 个划分到达平方误差最小。当聚类是密集的,且类与类之间区别明显时,效果较好。对于处理大数据集,这个算法是相对可伸缩和高效的,计算的复杂度为O(NKt),其中N是数据对象的数目,t是迭代的次数。一般来说,K< (1)从 n个数据对象任意选择 k 个对象作为初始聚类中心; (2)循环(3)到(4)直到每个聚类不再发生变化为止; (3)根据每个聚类对象的均值(中心对象),计算每个对象与这些中心对象的距离;并根据最小距离重新对相应对象进行划分; (4)重新计算每个(有变化)聚类的均值(中心对象) k-means 算法接受输入量 k ;然后将n个数据对象划分为 k个聚类以便使得所获得的聚类满足:同一聚类中的对象相似度较高;而不同聚类中的对象相似度较小。聚类相似度是利用各聚类中对象的均值所获得一个“中心对象”(引力中心)来进行计算的。 k-means 算法的工作过程说明如下:首先从n个数据对象任意选择 k 个对象作为初始聚类中心;而对于所剩下其它对象,则根据它们与这些聚类中心的相似度(距离),分别将它们分配给与其最相似的(聚类中心所代表的)聚类;然后再计算每个所获新聚类的聚类中心(该聚类中所有对象的均值);不断重复这一过程直到标准测度函数开始收敛为止。一般都采用均方差作为标准测度函数. k个聚类具有以下特点:各聚类本身尽可能的紧凑,而各聚类之间尽可能的分开。 (三)总体检索思路: 利用goole,百度,搜狗等搜索引擎及校内的一些数据库进行相关内容的检索。主要检索内容为K-均值聚类算法的工作原理,一般步骤,源码。 (四)检索过程记录: 关键词:K-均值聚类算法 搜索引擎:百度 检索内容:①K-均值聚类算法工作原理 ②K-均值聚类算法的一般步骤 ③K-均值聚类算法的源码 《应用多元统计分析》 ——报告 班级: 学号: 姓名: 聚类分析的案例分析 摘要 本文主要用SPSS软件对实验数据运用系统聚类法和K均值聚类法进行聚类分析,从而实现聚类分析及其运用。利用聚类分析研究某化工厂周围的几个地区的 气体浓度的情况,从而判断出这几个地区的污染程度。 经过聚类分析可以得到,样本6这一地区的气体浓度值最高,污染程度是最严重的,样本3和样本4气体浓度较高,污染程度也比较严重,因此要给予及时的控制和改善。 关键词:SPSS软件聚类分析学生成绩 一、数学模型 聚类分析的基本思想是认为各个样本与所选择的指标之间存在着不同程度的相 似性。可以根据这些相似性把相似程度较高的归为一类,从而对其总体进行分析和总结,判断其之间的差距。 系统聚类法的基本思想是在这几个样本之间定义其之间的距离,在多个变量之间定义其相似系数,距离或者相似系数代表着样本或者变量之间的相似程度。根据相似程度的不同大小,将样本进行归类,将关系较为密切的归为一类,关系较为疏远的后归为一类,用不同的方法将所有的样本都聚到合适的类中,这里我们用的是最近距离法,形成一个聚类树形图,可据此清楚的看出样本的分类情况。 K 均值法是将每个样品分配给最近中心的类中,只产生指定类数的聚类结果。 二、数据来源 《应用多元统计分析》第一版164 页第6 题 我国山区有一某大型化工厂,在该厂区的邻近地区中挑选其中最具有代表性的 8 个大气取样点,在固定的时间点每日 4 次抽取6 种大气样本,测定其中包含的8 个取样点中每种气体的平均浓度,数据如下表。试用聚类分析方法对取样点及 大气污染气体进行分类。 三、建立数学模型 一、运行过程 第五章 聚类分析 5.1 判别分析和聚类分析有何区别? 答:即根据一定的判别准则,判定一个样本归属于哪一类。具体而言,设有n 个样本,对每个样本测得p 项指标(变量)的数据,已知每个样本属于k 个类别(或总体)中的某一类,通过找出一个最优的划分,使得不同类别的样本尽可能地区别开,并判别该样本属于哪个总体。聚类分析是分析如何对样品(或变量)进行量化分类的问题。在聚类之前,我们并不知道总体,而是通过一次次的聚类,使相近的样品(或变量)聚合形成总体。通俗来讲,判别分析是在已知有多少类及是什么类的情况下进行分类,而聚类分析是在不知道类的情况下进行分类。 5.2 试述系统聚类的基本思想。 答:系统聚类的基本思想是:距离相近的样品(或变量)先聚成类,距离相远的后聚成类,过程一直进行下去,每个样品(或变量)总能聚到合适的类中。 5.3 对样品和变量进行聚类分析时, 所构造的统计量分别是什么?简要说明为什么这样构造? 答:对样品进行聚类分析时,用距离来测定样品之间的相似程度。因为我们把n 个样本看作p 维空间的n 个点。点之间的距离即可代表样品间的相似度。常用的距离为 (一)闵可夫斯基距离:1/1()()p q q ij ik jk k d q X X ==-∑ q 取不同值,分为 (1)绝对距离(1q =) 1 (1)p ij ik jk k d X X ==-∑ (2)欧氏距离(2q =) 21/2 1 (2)() p ij ik jk k d X X ==-∑ (3)切比雪夫距离(q =∞) 1()max ij ik jk k p d X X ≤≤∞=- (二)马氏距离 (三)兰氏距离 对变量的相似性,我们更多地要了解变量的变化趋势或变化方向,因此用相关性进行衡量。 将变量看作p 维空间的向量,一般用 (一)夹角余弦 (二)相关系数 5.4 在进行系统聚类时,不同类间距离计算方法有何区别?选择距离公式应遵循哪些原则? 答: 设d ij 表示样品X i 与X j 之间距离,用D ij 表示类G i 与G j 之间的距离。 (1). 最短距离法 21()()()ij i j i j d M -'=--X X ΣX X 11()p ik jk ij k ik jk X X d L p X X =-=+∑ cos p ik jk ij X X θ= ∑ ()() p ik i jk j ij X X X X r --= ∑ ij G X G X ij d D j j i i ∈∈= ,min 聚类算法的种类: --------------------------------------------------------- 几种常用的聚类算法从可伸缩性、适合的数据类型、高维性(处理高维数据的能力)、异常数据的抗干扰度、聚类形状和算法效率6个方面进行了综合性能评价,评价结果如表1所示: --------------------------------------------------------- 目前聚类分析研究的主要内容: 对聚类进行研究是数据挖掘中的一个热门方向,由于以上所介绍的聚类方法都 存在着某些缺点,因此近些年对于聚类分析的研究很多都专注于改进现有的聚 类方法或者是提出一种新的聚类方法。以下将对传统聚类方法中存在的问题以 及人们在这些问题上所做的努力做一个简单的总结: 1 从以上对传统的聚类分析方法所做的总结来看,不管是k-means方法,还是CURE方法,在进行聚类之前都需要用户事先确定要得到的聚类的数目。然而在 现实数据中,聚类的数目是未知的,通常要经过不断的实验来获得合适的聚类 数目,得到较好的聚类结果。 2 传统的聚类方法一般都是适合于某种情况的聚类,没有一种方法能够满足各 种情况下的聚类,比如BIRCH方法对于球状簇有很好的聚类性能,但是对于不 规则的聚类,则不能很好的工作;K-medoids方法不太受孤立点的影响,但是 其计算代价又很大。因此如何解决这个问题成为当前的一个研究热点,有学者 提出将不同的聚类思想进行融合以形成新的聚类算法,从而综合利用不同聚类 算法的优点,在一次聚类过程中综合利用多种聚类方法,能够有效的缓解这个 问题。 3 随着信息时代的到来,对大量的数据进行分析处理是一个很庞大的工作,这 就关系到一个计算效率的问题。有文献提出了一种基于最小生成树的聚类算法,该算法通过逐渐丢弃最长的边来实现聚类结果,当某条边的长度超过了某个阈值,那么更长边就不需要计算而直接丢弃,这样就极大地提高了计算效率,降 低了计算成本。 4 处理大规模数据和高维数据的能力有待于提高。目前许多聚类方法处理小规 模数据和低维数据时性能比较好,但是当数据规模增大,维度升高时,性能就 会急剧下降,比如k-medoids方法处理小规模数据时性能很好,但是随着数据 量增多,效率就逐渐下降,而现实生活中的数据大部分又都属于规模比较大、 维度比较高的数据集。有文献提出了一种在高维空间挖掘映射聚类的方法PCKA (Projected Clustering based on the K-Means Algorithm),它从多个维度中选择属性相关的维度,去除不相关的维度,沿着相关维度进行聚类,以此对 高维数据进行聚类。 5 目前的许多算法都只是理论上的,经常处于某种假设之下,比如聚类能很好 的被分离,没有突出的孤立点等,但是现实数据通常是很复杂的,噪声很大, 因此如何有效的消除噪声的影响,提高处理现实数据的能力还有待进一步的提高。 k-means聚类”——数据分析、数据挖掘 一、概要 分类作为一种监督学习方法,要求必须事先明确知道各个类别的信息,并且断言所有待分类项都有一个类别与之对应。但是很多时候上述条件得不到满足,尤其是在处理海量数据的时候,如果通过预处理使得数据满足分类算法的要求,则代价非常大,这时候可以考虑使用聚类算法。聚类属于无监督学习,相比于分类,聚类不依赖预定义的类和类标号的训练实例。本文介绍一种常见的聚类算法——k 均值和k 中心点聚类,最后会举一个实例:应用聚类方法试图解决一个在体育界大家颇具争议的问题——中国男足近几年在亚洲到底处于几流水平。 二、聚类问题 所谓聚类问题,就是给定一个元素集合D,其中每个元素具有n 个可观察属性,使用某种算法将D 划分成k 个子集,要求每个子集内部的元素之间相异度尽可能低,而不同子集的元素相异度尽可能高。其中每个子集叫做一个簇。 与分类不同,分类是示例式学习,要求分类前明确各个类别,并断言每个元素映射到一个类别,而聚类是观察式学习,在聚类前可以不知道类别甚至不给定类别数量,是无监督学习的一种。目前聚类广泛应用于统计学、生物学、数据库技术和市场营销等领域,相应的算法也非常的多。本文仅介绍一种最简单的聚类算法——k 均值(k-means)算法。 三、概念介绍 区分两个概念: hard clustering:一个文档要么属于类w,要么不属于类w,即文档对确定的类w是二值的1或0。 soft clustering:一个文档可以属于类w1,同时也可以属于w2,而且文档属于一个类的值不是0或1,可以是这样的小数。 K-Means就是一种hard clustering,所谓K-means里的K就是我们要事先指定分类的个数,即K个。 k-means算法的流程如下: 1)从N个文档随机选取K个文档作为初始质心 2)对剩余的每个文档测量其到每个质心的距离,并把它归到最近的质心的类 3)重新计算已经得到的各个类的质心 4)迭代2~3步直至满足既定的条件,算法结束 在K-means算法里所有的文档都必须向量化,n个文档的质心可以认为是这n 个向量的中心,计算方法如下: 这里加入一个方差RSS的概念: RSSk的值是类k中每个文档到质心的距离,RSS是所有k个类的RSS值的和。 算法结束条件: 1)给定一个迭代次数,达到这个次数就停止,这好像不是一个好建议。 聚类分析K-means算法综述 摘要:介绍K-means聚类算法的概念,初步了解算法的基本步骤,通过对算法缺点的分析,对算法已有的优化方法进行简单分析,以及对算法的应用领域、算法未来的研究方向及应用发展趋势作恰当的介绍。 关键词:K-means聚类算法基本步骤优化方法应用领域研究方向应用发展趋势 算法概述 K-means聚类算法是一种基于质心的划分方法,输入聚类个数k,以及包含n个数据对象的数据库,输出满足方差最小标准的k个聚类。 评定标准:同一聚类中的对象相似度较高;而不同聚类中的对象相似度较小。聚类相似度是利用各聚类中对象的均值所获得一个“中心对象”(引力中心)来进行计算。 解释:基于质心的划分方法就是将簇中的所有对象的平均值看做簇的质心,然后根据一个数据对象与簇质心的距离,再将该对象赋予最近的簇。 k-means 算法基本步骤 (1)从n个数据对象任意选择k 个对象作为初始聚类中心 (2)根据每个聚类对象的均值(中心对象),计算每个对象与这些中心对象的距离;并根据最小距离重新对相应对象进行划分 (3)重新计算每个(有变化)聚类的均值(中心对象) (4)计算标准测度函数,当满足一定条件,如函数收敛时,则算法终止;如果条件不满足则回到步骤(2) 形式化描述 输入:数据集D,划分簇的个数k 输出:k个簇的集合 (1)从数据集D中任意选择k个对象作为初始簇的中心; (2)Repeat (3)For数据集D中每个对象P do (4)计算对象P到k个簇中心的距离 (5)将对象P指派到与其最近(距离最短)的簇; (6)End For (7)计算每个簇中对象的均值,作为新的簇的中心; (8)Until k个簇的簇中心不再发生变化 对算法已有优化方法的分析 (1)K-means算法中聚类个数K需要预先给定 这个K值的选定是非常难以估计的,很多时候,我们事先并不知道给定的数据集应该分成多少个类别才最合适,这也是K一means算法的一个不足"有的算法是通过类的自动合并和分裂得到较为合理的类型数目k,例如Is0DAIA算法"关于K一means算法中聚类数目K 值的确定,在文献中,根据了方差分析理论,应用混合F统计量来确定最佳分类数,并应用了模糊划分嫡来验证最佳分类数的正确性。在文献中,使用了一种结合全协方差矩阵RPCL算法,并逐步删除那些只包含少量训练数据的类。文献中针对“聚类的有效性问题”提出武汉理工大学硕士学位论文了一种新的有效性指标:V(k km) = Intra(k) + Inter(k) / Inter(k max),其中k max是可聚类的最大数目,目的是选择最佳聚类个数使得有效性指标达到最小。文献中使用的是一种称为次胜者受罚的竞争学习规则来自动决定类的适当数目"它的思想是:对每个输入而言不仅竞争获胜单元的权值被修正以适应输入值,而且对次胜单元采用惩罚的方法使之远离输入值。 (2)算法对初始值的选取依赖性极大以及算法常陷入局部极小解 不同的初始值,结果往往不同。K-means算法首先随机地选取k个点作为初始聚类种子,再利用迭代的重定位技术直到算法收敛。因此,初值的不同可能导致算法聚类效果的不稳定,并且,K-means算法常采用误差平方和准则函数作为聚类准则函数(目标函数)。目标函数往往存在很多个局部极小值,只有一个属于全局最小,由于算法每次开始选取的初始聚类中心落入非凸函数曲面的“位置”往往偏离全局最优解的搜索范围,因此通过迭代运算,目标函数常常达到局部最小,得不到全局最小。对于这个问题的解决,许多算法采用遗传算法(GA),例如文献中采用遗传算法GA进行初始化,以内部聚类准则作为评价指标。 (3)从K-means算法框架可以看出,该算法需要不断地进行样本分类调整,不断地计算调整后的新的聚类中心,因此当数据量非常大时,算法的时间开销是非常大 所以需要对算法的时间复杂度进行分析,改进提高算法应用范围。在文献中从该算法的时间复杂度进行分析考虑,通过一定的相似性准则来去掉聚类中心的候选集,而在文献中,使用的K-meanS算法是对样本数据进行聚类。无论是初始点的选择还是一次迭代完成时对数据的调整,都是建立在随机选取的样本数据的基础之上,这样可以提高算法的收敛速度。 聚类分析 引言 俗话说:“物以聚类,人以群分”,在现实世界中存在着大量的分类问题。例如,生物可以分成动物和植物,动物又可分为脊椎动物和无脊椎动物等;人按年龄可分为少年、青年、中年、老年,对少年的身体形态、身体素质及生理功能的各项指标进行测试,据此对少年又可进行分类;在环境科学中,我们可以对按大气污染的轻重分成几类区域;在经济学中,根据人均国民收入、人均工农业产值和人均消费水平等多项指标对世界上所有国家的经济发展状况进行分类;在产品质量管理中,要根据各产品的某些重要指标可以将其分为一等品,二等品等。 研究事物分类问题的基本方法有两种:一是判别分析,二是聚类分析。若已知总体的类别数目及各类的特征,要对类别未知的个体正确地归属其中某一类,这时需要用判别分析法。若事先对总体到底有几种类型无从知晓,则要想知道观测到的个体的具体的分类情况,这时就需要用聚类分析法。 聚类分析的基本思想:首先定义能度量样品(或变量)间相似程度(亲疏关系)的统计量,在此基础上求出各样品(或变量)间相似程度的度量值;然后按相似程度的大小,把样品(或变量)逐一归类,关系密切的聚集到一个小的分类单位,关系疏远的聚合到一个大的分类单位,直到所有的样品(或变量)都聚合完毕,把不同的类型一一划分出来,形成一个由小到大的分类系统;最后根据整个分类系统画出一副分群图,称之为亲疏关系谱系图。 聚类分析给人们提供了丰富多彩的分类方法,大致可归为: ⑴系统聚类法:首先,将n 个样品看成n 类,然后将性质最接近的两类合并成一个新类,得到1 n 类,合并后重新计算新类与其它类的距离与相近性测度。这一过程一直继续直到所有对象归为一类为止,并且类的过程可用一张谱系聚类图描述。 ⑵动态聚类法(调优法):首先对n 个对象初步分类,然后根据分类的损失函数尽可能小的原则进行调整,直到分类合理为止。 ⑶有序样品聚类法(最优分割法):开始将所有样品看成一类,然后根据某种最优准则将它们分割为二类、 嵌入式方向工程设计实验报告 学院班级:130712 学生学号:13071219 学生姓名:杨阳 同作者:无 实验日期:2010年12月 聚类算法分析研究 1 实验环境以及所用到的主要软件 Windows Vista NetBeans6.5.1 Weka3.6 MATLAB R2009a 2 实验内容描述 聚类是对数据对象进行划分的一种过程,与分类不同的是,它所划分的类是未知的,故此,这是一个“无指导的学习” 过程,它倾向于数据的自然划分。其中聚类算法常见的有基于层次方法、基于划分方法、基于密度以及网格等方法。本文中对近年来聚类算法的研究现状与新进展进行归纳总结。一方面对近年来提出的较有代表性的聚类算法,从算法思想。关键技术和优缺点等方面进行分析概括;另一方面选择一些典型的聚类算法和一些知名的数据集,主要从正确率和运行效率两个方面进行模拟实验,并分别就同一种聚类算法、不同的数据集以及同一个数据集、不同的聚类算法的聚类情况进行对比分析。最后通过综合上述两方面信息给出聚类分析的研究热点、难点、不足和有待解决的一些问题等。 实验中主要选择了K 均值聚类算法、FCM 模糊聚类算法并以UCI Machine Learning Repository 网站下载的IRIS 和WINE 数据集为基础通过MATLAB 实现对上述算法的实验测试。然后以WINE 数据集在学习了解Weka 软件接口方面的基础后作聚类分析,使用最常见的K 均值(即K-means )聚类算法和FCM 模糊聚类算法。下面简单描述一下K 均值聚类的步骤。 K 均值算法首先随机的指定K 个类中心。然后: (1)将每个实例分配到距它最近的类中心,得到K 个类; (2)计分别计算各类中所有实例的均值,把它们作为各类新的类中心。 重复(1)和(2),直到K 个类中心的位置都固定,类的分配也固定。 在实验过程中通过利用Weka 软件中提供的simpleKmeans (也就是K 均值聚类算法对WINE 数据集进行聚类分析,更深刻的理解k 均值算法,并通过对实验结果进行观察分析,找出实验中所存在的问题。然后再在学习了解Weka 软件接口方面的基础上对Weka 软件进行一定的扩展以加入新的聚类算法来实现基于Weka 平台的聚类分析。 3 实验过程 3.1 K 均值聚类算法 3.1.1 K 均值聚类算法理论 K 均值算法是一种硬划分方法,简单流行但其也存在一些问题诸如其划分结果并不一定完全可信。K 均值算法的划分理论基础是 2 1 min i c k i k A i x v ∈=-∑∑ (1) 其中c 是划分的聚类数,i A 是已经属于第i 类的数据集i v 是相应的点到第i 类的平均距离,即聚类分析的案例分析(推荐文档)

应用多元统计分析习题解答-聚类分析

聚类算法总结

聚类分析实例

聚类分析K-means算法综述

多元统计分析第九章聚类分析

聚类算法分析报告汇总