神经网络算法简介

()

人工神经网络(artificial neural network,缩写ANN),简称神经网络(neural network,缩写NN),是一种模仿生物神经网络的结构和功能的数学模型或计算模型。神经网络由大量的人工神经元联结进行计算。大多数情况下人工神经网络能在外界信息的基础上改变内部结构,是一种自适应系统。现代神经网络是一种非线性统计性数据建模工具,常用来对输入和输出间复杂的关系进行建模,或用来探索数据的模式。

神经网络是一种运算模型[1],由大量的节点(或称“神经元”,或“单元”)和之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重(weight),这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

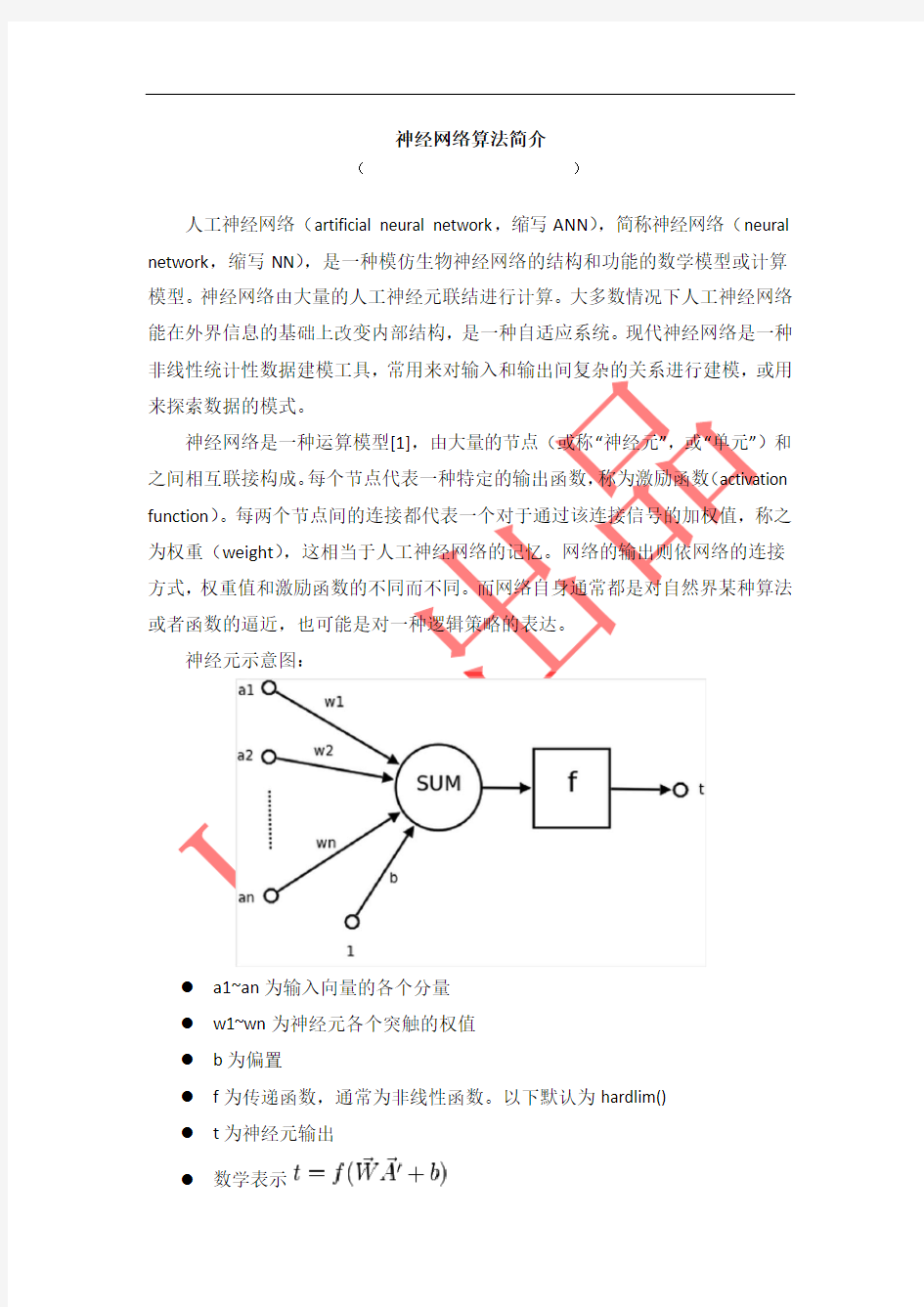

神经元示意图:

●a1~an为输入向量的各个分量

●w1~wn为神经元各个突触的权值

●b为偏置

●f为传递函数,通常为非线性函数。以下默认为hardlim()

●t为神经元输出

●数学表示

●为权向量

●为输入向量,为的转置

●为偏置

●为传递函数

可见,一个神经元的功能是求得输入向量与权向量的内积后,经一个非线性传递函数得到一个标量结果。

单个神经元的作用:把一个n维向量空间用一个超平面分割成两部分(称之为判断边界),给定一个输入向量,神经元可以判断出这个向量位于超平面的哪一边。

该超平面的方程:

权向量

偏置

超平面上的向量

单层神经元网络是最基本的神经元网络形式,由有限个神经元构成,所有神经元的输入向量都是同一个向量。由于每一个神经元都会产生一个标量结果,所以单层神经元的输出是一个向量,向量的维数等于神经元的数目。示意图:

通常来说,一个人工神经元网络是由一个多层神经元结构组成,每一层神经元拥有输入(它的输入是前一层神经元的输出)和输出,每一层(我们用符号记做)Layer(i)是由Ni(Ni代表在第i层上的N)个网络神经元组成,每个Ni上的网络

神经元把对应在Ni-1上的神经元输出做为它的输入,我们把神经元和与之对应的神经元之间的连线用生物学的名称,叫做神经轴突的突触,在数学模型中每个突触有一个加权数值,我们称做权重,那么要计算第i层上的某个神经元所得到的势能等于每一个权重乘以第i-1层上对应的神经元的输出,然后全体求和得到了第i层上的某个神经元所得到的势能,然后势能数值通过该神经元上的激励函数(activation function,常是en:Sigmoid function以控制输出大小,因为其可微分且连续,方便en:Delta rule处理。)求出该神经元的输出,注意的是该输出是一个非线性的数值,也就是说通过激励函数求的数值根据极限值来判断是否要激活该神经元,换句话说我们对一个神经元网络的输出是否线性不感兴趣。

基本结构:

一种常见的多层结构的前馈网络(Multilayer Feedforward Network)由三部分组成,

输入层(Input layer),众多神经元(Neuron)接受大量非线形输入信息。输入的信息称为输入向量。

输出层(Output layer),信息在神经元链接中传输、分析、权衡,形成输出结果。输出的信息称为输出向量。

隐藏层(Hidden layer),简称“隐层”,是输入层和输出层之间众多神经元和链接组成的各个层面。隐层可以有多层,习惯上会用一层。隐层的节点(神经元)数目不定,但数目越多神经网络的非线性越显著,从而神经网络的强健性(robustness)(控制系统在一定结构、大小等的参数摄动下,维持某些性能的特性。)更显著。习惯上会选输入节点1.2至1.5倍的节点。

神经网络的类型已经演变出很多种,这种分层的结构也并不是对所有的神经网络都适用。

人工神经网络(ANN)又称神经网络,是在现代神经科学研究成果的基础上,对生物神经系统的结构和功能进行数学抽象、简化和模仿而逐步发展起来的一种新型信息处理和计算系统。由于人工神经网络具有自学习、高容错、高度非线性描述能力等优点,现已广泛应用于经济、机器人和自动控制、军事、医疗、化学等领域[l ~ 3],并取得了许多成果。本文简要介绍人工神经网络的原理和特点,论述人工神经网络在高分子科学与工程领域的应用。 橡胶配方是决定橡胶制品性能的关键因素,由于材料配方与制品性能之间存在很复杂的非线性关系,多数情况下无法建立完整精确的理论模型,只能借助于回归方法得到经验公式。 传统的回归方法存在以下局限性: (1)使用不同的回9j方法可获得不同的经验公式,导致经验公式的繁多和不一致; (2)当配方项目及性能指标项目较多时,采用回归公式无法完全再现实验数据; (3)当实验进一步完善,实验数据增多的时候.其他人员再进行回归时,如果无法找到原来的回归方法、程序和实验数据,原来的回归公式将不能被利用,造成一定的浪费。随着计箅机的发展而出现的人工神经网络是人工智能方法.它不像回归方法那样,需预先给定基本函数,而是以实验数据为基础.经过有限次的迭代计算而获得的一个反映实验数据内在联系的数学模型,具有极强的非线性处理、自组织调整、自适应学习及容错抗噪能力,特别适用于研究像材料配方与制品性能之间关系的复杂非线性系统特性【¨】。因此,人们开始将人工神经网络应用于橡胶配方设计”J。 随着橡胶制品在各领域应用的拓展,橡胶配方设计变得越来越重要。人们进行橡胶配方设计主要有3个目的:提高制品的性能;改善加工工艺;降低生产成本。传统的橡胶配方设计方法有全因素设计、正交试验设计n_3]、均匀设计[4‘60等,而这些配方设计试验数据的处理方法无外乎方差分析和回归分析口]。由于材料的配方和性能之问存在非常复杂的非线性关系,回归分析只适合于单目标优化数据处理的模型,对于不同的性能,需要建立不同的模型,因此将其应用于配方设计有一定的局限性。近年来,发展日趋成熟的人工神经网络技术,尤其是BP神经网络凭借其结构简单、收敛速度快、预测精度高等优势越来越多地应用到橡胶配方设计试验中。 1橡胶配方设计 1.1橡胶配方设计概述 配方设计¨J是橡胶工业中的首要技术问题,在橡胶工业中占有重要地位。所谓配方设计,就是根据产品的性能要求和工艺条件,通过试验、优化、鉴定,合理地选用原材料,确定各种原材料的用量配比关系。 橡胶配方人员的主要工作就是要确定一系列变量对橡胶各项性能的定量或定性影响。变量可以是硫化剂、促进剂、填充剂、防老剂等,也可以是加工:[艺条件(如硫化温度、硫化时间等),总之是配方人员可能控制或测得的变量。橡胶各项基本性能包括拉伸强度、撕裂强度、硬度、定伸应力等物理机械性能,以 及加工性能、光洁度、外观等。 橡胶配方设计常常是多变量的试验设计,配方设计理论和试验设计方法对于 配方设计具有重要意义。

人工神经网络 1.简介 人工神经网络(ANN)技术是一种信息处理范式,灵感来自于生物神经系统的方式,如大脑、处理信息。这拍拉的DIGM关键的元素是一款新颖的结构的信息处理系统。它是由大量的高度互连处理单元(神经元都)工作在和谐中要解决的具体问题。像人一样,学习结合起来,通过实例说明。一个人工神经网络被配置为某一特定的应用,如模式识别或数据分类,通过一个学习的过程。学习在生物体系需要调整突触连接之间的神经元都存在。结合起来,这是有据可查的。在更多的实际统计数据的模糊神经网络的非线性建模工具。它们能被用于模型复杂的输入-输出关系或发现模式在数据。本文将简要介绍有关知识安和打好基础,为进一步研究。 2.人工神经网络的特点 神经网络模型,拥有的卓越的能力也衍生意义是从复杂的或不精确数据,可被用于提取模式和趋势发现太过于复杂以致难以被任何人类或其它计算机技术注意到。一个受过训练的神经网络可以被认为是一个“专家”在信息范畴内,才能来来作分析。这位专家就可以被用来提供给测感和给定新的有兴趣环境,然后提问“假如如此”的问题。 神经网络的其他优点包括: 自适应学习能力:学习如何做任务的基础上,给出了初始数据训练或经验。 自组织:一个人工神经网络可以创造自己的组织或表示它收到的信息时的学习时间。 实时操作:安计算可以对并联,和特殊的硬件设备被设计和制造,充分利用这一能力。 通过冗余信息容错编码:局部破坏网络导致相应的降解性能。然而,一些网络能力甚至可以保留与主要网络伤害。 3.一个简单的神经元和复杂的神经元 一个简单神经元 一种人工神经元是一种装置与许多输入和一个输出,如图。3-26。神经元的有两种模式的操作:培养模式和使用模式。在训练模式中,神经元可以训练的射击(或没有),为特定的输入方式。在使用模式,当一个教输入模式检测到输入、输出成为其关联的输出电流。如果输入模式不属于这教的名单输入方式、烧成规则是用来确定是否发生火灾或不是。 射击规则是在神经网络的一个重要概念。一个射击规则决定了一个人如何计算一个神经

科技信息 2011年第 3期 SCIENCE &TECHNOLOGY INFORMATION 人工神经网络是模仿生理神经网络的结构和功能而设计的一种信息处理系统。大量的人工神经元以一定的规则连接成神经网络 , 神经元之间的连接及各连接权值的分布用来表示特定的信息。神经网络分布式存储信息 , 具有很高的容错性。每个神经元都可以独立的运算和处理接收到的信息并输出结果 , 网络具有并行运算能力 , 实时性非常强。神经网络对信息的处理具有自组织、自学习的特点 , 便于联想、综合和推广。神经网络以其优越的性能应用在人工智能、计算机科学、模式识别、控制工程、信号处理、联想记忆等极其广泛的领域。 1986年 D.Rumelhart 和 J.McCelland [1]等发展了多层网络的 BP 算法 , 使BP 网络成为目前应用最广的神经网络。 1BP 网络原理及学习方法 BP(BackPropagation 网络是一种按照误差反向传播算法训练的多层前馈神经网络。基于 BP 算法的二层网络结构如图 1所示 , 包括输入层、一个隐层和输出层 , 三者都是由神经元组成的。输入层各神经元负责接收并传递外部信息 ; 中间层负责信息处理和变换 ; 输出层向 外界输出信息处理结果。神经网络工作时 , 信息从输入层经隐层流向输出层 (信息正向传播 , 若现行输出与期望相同 , 则训练结束 ; 否则 , 误差反向进入网络 (误差反向传播。将输出与期望的误差信号按照原连接通路反向计算 , 修改各层权值和阈值 , 逐次向输入层传播。信息正向传播与误差反向传播反复交替 , 网络得到了记忆训练 , 当网络的全局误差小于给定的误差值后学习终止 , 即可得到收敛的网络和相应稳定的权值。网络学习过程实际就是建立输入模式到输出模式的一个映射 , 也就是建立一个输入与输出关系的数学模型 :

B P神经网络算法步骤 SANY GROUP system office room 【SANYUA16H-

传统的BP 算法简述 BP 算法是一种有监督式的学习算法,其主要思想是:输入学习样本,使用反向传播算法对网络的权值和偏差进行反复的调整训练,使输出的向量与期望向量尽可能地接近,当网络输出层的误差平方和小于指定的误差时训练完成,保存网络的权值和偏差。具体步骤如下: (1)初始化,随机给定各连接权[w],[v]及阀值θi ,rt 。 (2)由给定的输入输出模式对计算隐层、输出层各单元输出 (3)计算新的连接权及阀值,计算公式如下: (4)选取下一个输入模式对返回第2步反复训练直到网络设输出误差达到要求结束训练。 第一步,网络初始化 给各连接权值分别赋一个区间(-1,1)内的随机数,设定误差函数e ,给定计 算精度值 和最大学习次数M 。 第二步,随机选取第k 个输入样本及对应期望输出 ()12()(),(),,()q k d k d k d k =o d ()12()(),(),,()n k x k x k x k =x 第三步,计算隐含层各神经元的输入和输出 第四步,利用网络期望输出和实际输出,计算误差函数对输出层的各神经元的偏导数()o k a δ 第五步,利用隐含层到输出层的连接权值、输出层的()o k δ和隐含层的输出计算误差函数对隐含层各神经元的偏导数()h k δ 第六步,利用输出层各神经元的()o k δ和隐含层各神经元的输出来修正连接权值()ho w k 第七步,利用隐含层各神经元的()h k δ和输入层各神经元的输入修正连接权。 第八步,计算全局误差211 1(()())2q m o o k o E d k y k m ===-∑∑ ε

https://www.doczj.com/doc/6d2727578.html,/s/blog_5bbd6ec00100b5nk.html 人工神经网络算法(2008-11-20 17:24:22) 标签:杂谈 人工神经网络算法的作用机理还是比较难理解,现在以一个例子来说明其原理。这个例子是关于人的识别技术的,在门禁系统,逃犯识别,各种验证码破译,银行预留印鉴签名比对,机器人设计等领域都有比较好的应用前景,当然也可以用来做客户数据的挖掘工作,比如建立一个能筛选满足某种要求的客户群的模型。 机器识别人和我们人类识别人的机理大体相似,看到一个人也就是识别对象以后,我们首先提取其关键的外部特征比如身高,体形,面部特征,声音等等。根据这些信息大脑迅速在内部寻找相关的记忆区间,有这个人的信息的话,这个人就是熟人,否则就是陌生人。 人工神经网络就是这种机理。假设上图中X(1)代表我们为电脑输入的人的面部特征,X(2)代表人的身高特征X(3)代表人的体形特征X(4)代表人的声音特征W(1)W(2)W(3)W(4)分别代表四种特征的链接权重,这个权重非常重要,也是人工神经网络起作用的核心变量。 现在我们随便找一个人阿猫站在电脑面前,电脑根据预设变量提取这个人的信息,阿猫面部怎么样,身高多少,体形胖瘦,声音有什么特征,链接权重初始值是随机的,假设每一个W均是0.25,这时候电脑按这个公式自动计 算,Y=X(1)*W(1)+X(2)*W(2)+X(3)*W(3)+X(4)*W(4)得出一个结果Y,这个Y要和一个门槛值(设为Q)进行比较,如果Y>Q,那么电脑就判定这个人是阿猫,否则判定不是阿猫.由于第一次计算电脑没有经验,所以结果是随机的.一般我们设定是正确的,因为我们输入的就是阿猫的身体数据啊. 现在还是阿猫站在电脑面前,不过阿猫怕被电脑认出来,所以换了一件衣服,这个行为会影响阿猫的体形,也就是X(3)变了,那么最后计算的Y值也就变了,它和Q比较的结果随即发生变化,这时候电脑的判断失误,它的结论是这个人不是阿猫.但是我们告诉它这个人就是阿猫,电脑就会追溯自己的判断过程,到底是哪一步出错了,结果发现原来阿猫体形X(3)这个 体征的变化导致了其判断失误,很显然,体形X(3)欺骗了它,这个属性在人的识别中不是那 么重要,电脑自动修改其权重W(3),第一次我对你是0.25的相信,现在我降低信任值,我0.10的相信你.修改了这个权重就意味着电脑通过学习认为体形在判断一个人是否是自己认识的人的时候并不是那么重要.这就是机器学习的一个循环.我们可以要求阿猫再穿一双高跟皮鞋改变一下身高这个属性,让电脑再一次进行学习,通过变换所有可能变换的外部特征,轮换让电脑学习记忆,它就会记住阿猫这个人比较关键的特征,也就是没有经过修改的特征.也就是电脑通过学习会总结出识别阿猫甚至任何一个人所依赖的关键特征.经过阿猫的训练电脑,电脑已经非常聪明了,这时你在让阿猫换身衣服或者换双鞋站在电脑前面,电脑都可以迅速的判断这个人就是阿猫.因为电脑已经不主要依据这些特征识别人了,通过改变衣服,身高骗不了它.当然,有时候如果电脑赖以判断的阿猫关键特征发生变化,它也会判断失误.我们就

深度学习 卷积神经网络算法简介 李宗贤 北京信息科技大学智能科学与技术系 卷积神经网络是近年来广泛应用在模式识别、图像处理领域的一种高效识别算法,具有简单结构、训练参数少和适应性强的特点。它的权值共享网络结构使之更类似与生物神经网络,降低了网络的复杂度,减少了权值的数量。以二维图像直接作为网络的输入,避免了传统是被算法中复杂的特征提取和数据重建过程。卷积神经网络是为识别二维形状特殊设计的一个多层感知器,这种网络结构对于平移、比例缩放、倾斜和其他形式的变形有着高度的不变形。 ?卷积神经网络的结构 卷积神经网络是一种多层的感知器,每层由二维平面组成,而每个平面由多个独立的神经元组成,网络中包含一些简单元和复杂元,分别记为C元和S元。C元聚合在一起构成卷积层,S元聚合在一起构成下采样层。输入图像通过和滤波器和可加偏置进行卷积,在C层产生N个特征图(N值可人为设定),然后特征映射图经过求和、加权值和偏置,再通过一个激活函数(通常选用Sigmoid函数)得到S层的特征映射图。根据人为设定C层和S层的数量,以上工作依次循环进行。最终,对最尾部的下采样和输出层进行全连接,得到最后的输出。

卷积的过程:用一个可训练的滤波器fx去卷积一个输入的图像(在C1层是输入图像,之后的卷积层输入则是前一层的卷积特征图),通过一个激活函数(一般使用的是Sigmoid函数),然后加一个偏置bx,得到卷积层Cx。具体运算如下式,式中Mj是输入特征图的值: X j l=f?(∑X i l?1?k ij l+b j l i∈Mj) 子采样的过程包括:每邻域的m个像素(m是人为设定)求和变为一个像素,然后通过标量Wx+1加权,再增加偏置bx+1,然后通过激活函数Sigmoid产生特征映射图。从一个平面到下一个平面的映射可以看作是作卷积运算,S层可看作是模糊滤波器,起到了二次特征提取的作用。隐层与隐层之间的空间分辨率递减,而每层所含的平面数递增,这样可用于检测更多的特征信息。对于子采样层来说,有N 个输入特征图,就有N个输出特征图,只是每个特征图的的尺寸得到了相应的改变,具体运算如下式,式中down()表示下采样函数。 X j l=f?(βj l down (X j l?1) +b j l)X j l) ?卷积神经网络的训练过程 卷积神经网络在本质上是一种输入到输出的映射,它能够学习大量的输入和输出之间的映射关系,而不需要任何输入和输出之间的精确数学表达式。用已知的模式对卷积网络加以训练,网络就具有了输

介绍人工神经网络的发展历程和分类 1943年,心理学家W.S.McCulloch 和数理逻辑学家W.Pitts 建立了神经网络和数学模型,称为MP 模型。他们通过MP 模型提出了神经元的形式化数学描述和网络结构方法,证明了单个神经元能执行逻辑功能,从而开创了人工神经网络研究的时代。1949年,心理学家提出了突触联系强度可变的设想。60年代,人工神经网络的到了进一步发展,更完善的神经网络模型被提出。其中包括感知器和自适应线性元件等。M.Minsky 等仔细分析了以感知器为代表的神经网络系统的功能及局限后,于1969年出版了《Perceptron 》一书,指出感知器不能解决高阶谓词问题。他们的论点极大地影响了神经网络的研究,加之当时串行计算机和人工智能所取得的成就,掩盖了发展新型计算机和人工智能新途径的必要性和迫切性,使人工神经网络的研究处于低潮。在此期间,一些人工神经网络的研究者仍然致力于这一研究,提出了适应谐振理论(ART 网)、自组织映射、认知机网络,同时进行了神经网络数学理论的研究。以上研究为神经网络的研究和发展奠定了基础。1982年,美国加州工学院物理学家J.J.Hopfield 提出了Hopfield 神经网格模型,引入了“计算能量”概念,给出了网络稳定性判断。 1984年,他又提出了连续时间Hopfield 神经网络模型,为神经计算机的研究做了开拓性的工作,开创了神经网络用于联想记忆和优化计算的新途径,有力地推动了神经网络的研究,1985年,又有学者提出了波耳兹曼模型,在学习中采用统计热力学模拟退火技术,保证整个系统趋于全局稳定点。1986年进行认知微观结构地研究,提出了并行分布处理的理论。人工神经网络的研究受到了各个发达国家的重视,美国国会通过决议将1990年1月5日开始的十年定为“脑的十年”,国际研究组织号召它的成员国将“脑的十年”变为全球行为。在日本的“真实世界计算(RWC )”项目中,人工智能的研究成了一个重要的组成部分。 人工神经网络的模型很多,可以按照不同的方法进行分类。其中,常见的两种分类方法是,按照网络连接的拓朴结构分类和按照网络内部的信息流向分类。按照网络拓朴结构分类网络的拓朴结构,即神经元之间的连接方式。按此划分,可将神经网络结构分为两大类:层次型结构和互联型结构。层次型结构的神经网络将神经

人工神经网络与其发展和应用的介绍 发表时间:2018-05-02T11:39:29.337Z 来源:《科技中国》2017年11期作者:卓一凡 [导读] 摘要:人工神经网络是人工智能的重要分支,自其创始伊始便成为了人工智能领域的研究热点。本文从人工神经网络的发展历史开始,介绍了其在医学,信息,控制等方面的应用及其现状,对其中的优缺点进行了简要的分析。并对人工神经网络未来的发展作简要的展望。 摘要:人工神经网络是人工智能的重要分支,自其创始伊始便成为了人工智能领域的研究热点。本文从人工神经网络的发展历史开始,介绍了其在医学,信息,控制等方面的应用及其现状,对其中的优缺点进行了简要的分析。并对人工神经网络未来的发展作简要的展望。关键词:人工神经网络,应用,优缺点,发展 1:人工神经网络的发展 纵观整个人工神经网络发展,大体经历了四个时期:启蒙,低潮,振兴,发展。 1.1:启蒙时期 人工神经网络和数学模型于1943年由W.S.McCulloch和W.Pitts建立,称为MP模型,证明了单个神经元能执行逻辑功能,人工神经网络的研究由此开始。1951年,心理学家 Donala O. Hebb提出了Hebb 法则:在神经网络中,信息在连接权中进行储存,突触之间的联系强度是可以变化的,而这种变化建立起了神经元间的连接。Hebb法则成为了构造具有学习功能的神经网络模型的基础。1954 年,生物学家Eccles提出了真实突触的分流模型,为神经网络模拟突触的功能提供了原理和生理学的依据。1956 年,Uttley 发明了一种由处理单元组成的推理机,用于模拟行为及条件反射。1958年,Rosenblatt将学习机制增加到了原有的MP模型上,首次把神经网络理论付诸实现。正是由于他的成功,引起了学者们对人工神经网络的研究兴趣。 1.2:低潮时期 当许多学者抱着极大的热忱去研究人工神经网络的时候,Minsky 和Papert 从数学角度对以感知器为代表的网络系统功能及其局限性进行了深入的研究,并在1969年出版《Percep2trons》一书。该书提出当前的网络只能对简单的线性问题进行解决,而对复杂的多层神经网络无能为力。这一结论使得许多国家的此类项目被暂停资助,自此开始了神经网络的低潮期。但不久后,转机出现。就在1972年,欧洲和美洲的两位学者:芬兰的Kohonen教授,美国的Anderson分别提出了自组织映射SOM(Self2Organizingfeature map)理论和一个名叫“交互存储器 ”的理论。而两者之间竟有着许多相似之处,不由得让人惊讶。但Kohonen的研究是目前所使用神经网络的主要依据。正是由于这些研究,引导了以后人工神经网络的振兴。 1.3:振兴时期 1982年,美国物理学家Hopfield博士发表了Hopfield模型理论,对人工神经网络的研究产生了深远的影响。如下图 Hopfield模型理论证明:神经网络并非不能达到稳定的状态,只是需要一定条件。而他的研究也让许多学者对人工神经网络的研究重新产生了兴趣。1986年,由美国的 Rumelhart 和 McCkekkand主编并撰写的《Parallel Distributed Processing : Ex2ploration in the Microstructures of Cognition》一书出版,提出了 PDP(Parallel Distributed Processing)网络思想,再一次推动了神经网络的发展。20世纪 90 年代, Edelman提出Darwinism 模型。1995 年,Jenkins等人进行了光学神经网络(PNN)的研究 .神经网络的研究重回人们的视野。 1.4:发展时期 20世纪80年代,人工神经网络在世界范围内全面复苏,这也引起了国家对神经网络的重视。“中国神经网络首届学术会议”于1990年2月由国内8个顶尖学会联合在北京召开。 1992年举办了中国第二届神经网络学术大会,中国神经网络学会便由此诞生。我国的“863”计划,“攀登”计划中,都有关于人工神经网络研究的内容。国际上,1987 年,在美国加洲举行了首届国际神经网络学会. 此后每年召开两次.至此,人工神经网络的研究得到了长足的发展。 2.人工神经网络的基本原理 自生物学发展伊始,大脑便是无数科学家研究的重点,人们想要弄清楚大脑是如何运作的?其机理是什么?人工神经网络便应运而生,它的目的是想要对人类神经网络进行开发与测试 2.1:人工神经网络的生物学基础 人工神经网络是人类神经网络的仿生学模拟。我们如果想要了解人工神经网络,就要先了解生物的神经元,如下图:

学习方式 根据数据类型的不同,对一个问题的建模有不同的方式。在机器学习或者人工智能领域,人们首先会考虑算法的学习方式。在机器学习领域,有几种主要的学习方式。将算法按照学习方式分类是一个不错的想法,这样可以让人们在建模和算法选择的时候考虑能根据输入数据来选择最合适的算法来获得最好的结果。 监督式学习: 在监督式学习下,输入数据被称为“训练数据”,每组训练数据有一个明确的标识或结果,如对防垃圾邮件系统中“垃圾邮件”“非垃圾邮件”,对手写数字识别中的“1“,”2“,”3“,”4“等。在建立预测模型的时候,监督式学习建立一个学习过程,将预测结果与“训练数据”的实际结果进行比较,不断的调整预测模型,直到模型的预测结果达到一个预期的准确率。监督式学习的常见应用场景如分类问题和回归问题。常见算法有逻辑回归(Logistic Regression)和反向传递神经网络(Back Propagation Neural Network) 非监督式学习:

在非监督式学习中,数据并不被特别标识,学习模型是为了推断出数据的一些内在结构。常见的应用场景包括关联规则的学习以及聚类等。常见算法包括Apriori算法以及k-Means算法。 半监督式学习: 在此学习方式下,输入数据部分被标识,部分没有被标识,这种学习模型可以用来进行预测,但是模型首先需要学习数据的内在结构以便合理的组织数据来进行预测。应用场景包括分类和回归,算法包括一些对常用监督式学习算法的延伸,这些算法首先试图对未标识数据进行建模,在此基础上再对标识的数据进行预测。如图论推理算法(Graph Inference)或者拉普拉斯支持向量机(Laplacian SVM.)等。 强化学习:

5.4 神经网络与遗传算法简介 在本节中,我们将着重讲述一些在网络设计、优化、性能分析、通信路由优化、选择、神经网络控制优化中有重要应用的常用的算法,包括神经网络算法、遗传算法、模拟退火算法等方法。用这些算法可以较容易地解决一些很复杂的,常规算法很难解决的问题。这些算法都有着很深的理论背景,本节不准备详细地讨论这些算法的理论,只对算法的原理和方法作简要的讨论。 5.4.1 神经网络 1. 神经网络的简单原理 人工神经网络(Artificial Neural Networks,简写为ANNs)也简称为神经网络(NNs)或称作连接模型(Connectionist Model),是对人脑或自然神经网络(Natural Neural Network)若干基本特性的抽象和模拟。人工神经网络以对大脑的生理研究成果为基础的,其目的在于模拟大脑的某些机理与机制,实现某个方面的功能。所以说, 人工神经网络是由人工建立的以有向图为拓扑结构的动态系统,它通过对连续或断续的输入作出状态相应而进行信息处理。它是根据人的认识过程而开发出的一种算法。假如我们现在只有一些输入和相应的输出,而对如何由输入得到输出的机理并不清楚,那么我们可以把输入与输出之间的未知过程看成是一个“网络”,通过不断地给这个网络输入和相应的输出来“训练”这个网络,网络根据输入和输出不断地调节自己的各节点之间的权值来满足输入和输出。这样,当训练结束后,我们给定一个输入,网络便会根据自己已调节好的权值计算出一个输出。这就是神经网络的简单原理。 2. 神经元和神经网络的结构 如上所述,神经网络的基本结构如图5.35所示: 隐层隐层2 1 图5.35 神经网络一般都有多层,分为输入层,输出层和隐含层,层数越多,计算结果越精确,但所需的时间也就越长,所以实际应用中要根据要求设计网络层数。神经网络中每一个节点叫做一个人工神经元,他对应于人脑中的神经元。人脑神经元由细胞体、树突和轴突三部分组成,是一种根须状蔓延物。神经元的中心有一闭点,称为细胞体,它能对接受到的信息进行处理,细胞体周围的纤维有两类,轴突是较长的神经纤维,是发出信息的。树突的神经纤维较短,而分支众多,是接收信息的。一个神经元的轴突末端与另一神经元的树突之间密

课程设计作业——翻译 课题:介绍遗传算法神经网络 穆姣姣 0808490233 物流08-班

介绍遗传算法神经网络 理查德·坎普 1. 介绍 一旦一个神经网络模型被创造出来,它常常是可取的。利用这个模型的时候,识别套输入变量导致一个期望输出值。大量的变量和非线性性质的许多材料模型可以使找到一个最优组输入变量变得困难。 在这里,我们可以用遗传算法并试图解决这个问题。 遗传算法是什么?遗传算法是基于搜索algo-rithms力学的自然选择和遗传观察到生物的世界。他们使用两个方向(\适者生存”),在这种条件下,探索一个强劲的功能。重要的是,采用遗传算法,这不是必需要知道功能的形式,就其输出给定的输入(图1)。 健壮性我们这么说是什么意思呢?健壮性是效率和效能之间的平衡所使用的技术在许多不同的环境中。帮助解释这个问题,我们可以比其他搜索和优化技术,如calculus-based,列举,与随机的求索。 方法Calculus-based假设一个光滑,无约束函数和要么找到点在衍生为零(知易行难)或者接受一个方向梯度与当地日当地一所高中点(爬山)。研究了这些技术已经被重点研究、扩展、修改,但展现自己缺乏的鲁棒性是很简单的。 考虑如图2所示的功能。利用Calculus-based在这里发现极值是很容易的(假定派生的函数可以发现…!)。然而,一个更复杂的功能(图3)显示该方法是当地——如果搜索算法,在该地区的一个开始,它就会错过低高峰目标,最高的山峰。 图1 使用网络神经算法没必要知道它的每一项具体功能。 一旦一个局部极大时,进一步改进需要一个随机的重启或类似的东西。同时,假设一个函数光滑,可导,并明确知道很少尊重现实。许多真实世界充满了间断模型和设置在嘈杂的多通道搜索空间(图4)。 虽然calculus-based方法在某些环境中至非常有效的,但内在的假

机器学习中有一个重要的算法,那就是人工神经网络算法,听到这个名称相信大家能够想到 人体中的神经。其实这种算法和人工神经有一点点相似。当然,这种算法能够解决很多的问题,因此在机器学习中有着很高的地位。下面我们就给大家介绍一下关于人工神经网络算法 的知识。 1.神经网络的来源 我们听到神经网络的时候也时候近一段时间,其实神经网络出现有了一段时间了。神经网络 的诞生起源于对大脑工作机理的研究。早期生物界学者们使用神经网络来模拟大脑。机器学 习的学者们使用神经网络进行机器学习的实验,发现在视觉与语音的识别上效果都相当好。 在BP算法诞生以后,神经网络的发展进入了一个热潮。 2.神经网络的原理 那么神经网络的学习机理是什么?简单来说,就是分解与整合。一个复杂的图像变成了大量 的细节进入神经元,神经元处理以后再进行整合,最后得出了看到的是正确的结论。这就是 大脑视觉识别的机理,也是神经网络工作的机理。所以可以看出神经网络有很明显的优点。 3.神经网络的逻辑架构 让我们看一个简单的神经网络的逻辑架构。在这个网络中,分成输入层,隐藏层,和输出层。输入层负责接收信号,隐藏层负责对数据的分解与处理,最后的结果被整合到输出层。每层

中的一个圆代表一个处理单元,可以认为是模拟了一个神经元,若干个处理单元组成了一个层,若干个层再组成了一个网络,也就是”神经网络”。在神经网络中,每个处理单元事实上 就是一个逻辑回归模型,逻辑回归模型接收上层的输入,把模型的预测结果作为输出传输到 下一个层次。通过这样的过程,神经网络可以完成非常复杂的非线性分类。 4.神经网络的应用。 图像识别领域是神经网络中的一个著名应用,这个程序是一个基于多个隐层构建的神经网络。通过这个程序可以识别多种手写数字,并且达到很高的识别精度与拥有较好的鲁棒性。可以 看出,随着层次的不断深入,越深的层次处理的细节越低。但是进入90年代,神经网络的发展进入了一个瓶颈期。其主要原因是尽管有BP算法的加速,神经网络的训练过程仍然很困难。因此90年代后期支持向量机算法取代了神经网络的地位。 在这篇文章中我们大家介绍了关于神经网络的相关知识,具体的内容就是神经网络的起源、 神经网络的原理、神经网络的逻辑架构和神经网络的应用,相信大家看到这里对神经网络知 识有了一定的了解,希望这篇文章能够帮助到大家。

神经网络算法详解 第0节、引例 本文以Fisher的Iris数据集作为神经网络程序的测试数据集。Iris数据集可以在https://www.doczj.com/doc/6d2727578.html,/wiki/Iris_flower_data_set 找到。这里简要介绍一下Iris数据集: 有一批Iris花,已知这批Iris花可分为3个品种,现需要对其进行分类。不同品种的Iris花的花萼长度、花萼宽度、花瓣长度、花瓣宽度会有差异。我们现有一批已知品种的Iris花的花萼长度、花萼宽度、花瓣长度、花瓣宽度的数据。 一种解决方法是用已有的数据训练一个神经网络用作分类器。 如果你只想用C#或Matlab快速实现神经网络来解决你手头上的问题,或者已经了解神经网络基本原理,请直接跳到第二节——神经网络实现。 第一节、神经网络基本原理 1. 人工神经元( Artificial Neuron )模型 人工神经元是神经网络的基本元素,其原理可以用下图表示: 图1. 人工神经元模型 图中x1~xn是从其他神经元传来的输入信号,wij表示表示从神经元j到神经元i的连接权值,θ表示一个阈值( threshold ),或称为偏置( bias )。则神经元i的输出与输入的关系表示为:

图中yi表示神经元i的输出,函数f称为激活函数 ( Activation Function )或转移函数( Transfer Function ) ,net称为净激活(net activation)。若将阈值看成是神经元i的一个输入x0的权重wi0,则上面的式子可以简化为: 若用X表示输入向量,用W表示权重向量,即: X = [ x0 , x1 , x2 , ....... , xn ] 则神经元的输出可以表示为向量相乘的形式: 若神经元的净激活net为正,称该神经元处于激活状态或兴奋状态(fire),若净激活net 为负,则称神经元处于抑制状态。 图1中的这种“阈值加权和”的神经元模型称为M-P模型 ( McCulloch-Pitts Model ),也称为神经网络的一个处理单元( PE, Processing Element )。 2. 常用激活函数 激活函数的选择是构建神经网络过程中的重要环节,下面简要介绍常用的激活函数。 (1) 线性函数 ( Liner Function ) (2) 斜面函数 ( Ramp Function ) (3) 阈值函数 ( Threshold Function )

5.4 神经网络的基本原理 ()网络是1986年由和为首的科学家小组提 出,是一种按误差逆传播算法训练的多层前馈网 络,是目前应用最广泛的神经网络模型之一。网 络能学习和存贮大量的输入-输出模式映射关 系,而无需事前揭示描述这种映射关系的数学方 程。它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。神经网络模型拓扑结构包括输入层()、隐层( )和输出层( )(如图5.2所示)。 5.4.1 神经元 图5.3给出了第j个基本神经元(节点),它只模仿了生物神经元所具有的三个最基本也是最重要的功能:加权、求和与转移。其中x1、x2……分别代表来自神经元1、2…i…n的输入;1、2……则分别表示神经元1、2…i…n与第j个神经元的连接强度,即权值;为阈值;f(·)为传递函数;为第j个神经元的输出。 第j个神经元的净输入值为: (5.12)

其中: 若视,,即令及包括及,则 于是节点j的净输入可表示为: (5.13)净输入通过传递函数()f (·)后,便得到第j个神经元的输出: (5.14)式中f(·)是单调上升函数,而且必须是有界函数,因为细胞传递的信号不可能无限增加,必有一最大值。 5.4.2 网络 算法由数据流的前向计算(正向传播)和误差信号的反向传播两个过程构成。正向传播时,传播方向为输入层→隐层→输出层,每层神经元的

状态只影响下一层神经元。若在输出层得不到期望的输出,则转向误差信号的反向传播流程。通过这两个过程的交替进行,在权向量空间执行误差函数梯度下降策略,动态迭代搜索一组权向量,使网络误差函数达到最小值,从而完成信息提取和记忆过程。 5.4.2.1 正向传播 设网络的输入层有n个节点,隐层有q个节点,输出层有m个节点,输入层与隐层之间的权值为,隐层与输出层之间的权值为,如图5.4所示。隐层的传递函数为f1(·),输出层的传递函数为f2(·),则隐层节点的输出为(将阈值写入求和项中): 1,2,…… q (5.15)输出层节点的输出为: 1,2,…… m (5.16)至此网络就完成了n维空间向量对m维空间的近似映射。

2008年第22期(总第500期) 学理论 XUELILUN No.22,2008 General.No.500 浅谈BP人工神经网络 柴燕茹马岩 (哈尔滨商业大学 管理学院,哈尔滨 150028) 摘要:人工神经网络有很多模型,但是目前应用最广泛的、基本思想最直观、最容易理解的是前馈神经网络 中的误差逆传播学习算法(ErrorBackPropagation),简称为BP神经网络。它是前馈神经网络中的核心部分,也是最精华的部分。 关键词:神经元;神经网络;局限性 文献标志码:A文章编号:1002—2589(2008)22—39—02中图分类号: Q983+.6 一、人工神经网络的基本原理 人工神经网络或称作连接模型(Connectfonist-Model),是对人脑或自然神经网络(NaturalNeuralNet-work)若干基本特性的抽象和模拟。人工神经网络以大脑的生理研究成果为基础,其目的在于模拟大脑的某些机理与机制,实现某个方 参照生物神经元网络发展起来的人工神经网络现面的功能。 已有许多种类型,但它们中的神经元结构是基本相同的。 (一)生物神经元的结构与功能 1.生物神经元的结构。生物神经元有一条轴突和若干树突,它通过轴突与其它细胞的树突相连接。树突是脑神经元的输入器,轴突则是信息传递的通道。生物神经元有兴奋和抑制两种状态,每一个神经元都是在与之相连的兴奋性突触和抑制性突触共同作用下活动的。它本身的兴奋和抑制作用又对其他神经元产生作用。当神经元接受到大量的兴奋性突触传来的信息时,信息被综合处理后神经元膜电位升高,超过一定阈值时,神经元被激活,细胞体产生 但神经元没有接收到信息或者接收到信息经综输出信息。 合后没能超过阈值,神经元则处于抑制状态。只有神经元所有输入的总效应达到阈值电平,它才能开始工作。无论什么时候达到阈值电平,神经元就产生一个全强度的输出脉冲,从细胞体经轴突进入轴突分枝。这时的神经元就称

BP 神经网络算法 三层 BP 神经网络如图: 目标输出向量 传递函数 g 输出层,输出向量 权值为 w jk 传递函数 f 隐含层,隐含层 输出向量 输 入 层 , 输 入 向量 设网络的输入模式为 x (x 1 , x 2 ,...x n )T ,隐含层有 h 个单元,隐含层的输出为 y ( y 1 , y 2 ,...y h )T ,输出 层有 m 个单元,他们的输出为 z (z 1 , z 2 ,...z m )T ,目标输出为 t (t 1 ,t 2 ,..., t m )T 设隐含层到输出层的传 递函数为 f ,输出层的传递函数为 g n n 于是: y j f ( w ij x i ) f ( w ij x i ) :隐含层第 j 个神经元的输出;其中 w 0 j , x 0 1 i 1 i 0 h z k g( w jk y j ) :输出层第 k 个神经元的输出 j 此时网络输出与目标输出的误差为 1 m (t k z k ) 2 ,显然,它是 w ij 和 w jk 的函数。 2 k 1 下面的步骤就是想办法调整权值,使 减小。 由高等数学的知识知道:负梯度方向是函数值减小最快的方向 因此,可以设定一个步长 ,每次沿负梯度方向调整 个单位,即每次权值的调整为: w pq w pq , 在神经网络中称为学习速率 可以证明:按这个方法调整,误差会逐渐减小。

BP 神经网络(反向传播)的调整顺序为:1)先调整隐含层到输出层的权值 h 设 v k为输出层第k个神经元的输入v k w jk y j j 0 ------- 复合函数偏导公式 1 g'(u k ) e v k 1 (1 1 ) z k (1 z k ) 若取 g ( x) f (x) 1 e x,则(1e v k) 2 1e v k 1e v k 于是隐含层到输出层的权值调整迭代公式为:2)从输入层到隐含层的权值调整迭代公式为: n 其中 u j为隐含层第j个神经元的输入: u j w ij x i i 0 注意:隐含层第j 个神经元与输出层的各个神经元都有连接,即涉及所有的权值w ij,因此 y j m (t k z k )2 z k u k m y j k 0 z k u k y j (t k z k ) f '(u k )w jk k 0 于是: 因此从输入层到隐含层的权值调整迭代为公式为: 例: 下表给出了某地区公路运力的历史统计数据,请建立相应的预测模型,并对给出的 2010 和 2011 年的数据,预测相应的公路客运量和货运量。 人数 ( 单位:机动车数公路面积 ( 单公路客运量公路货运量 时间( 单位:万位:万平方公( 单位:万( 单位:万万人 ) 辆 ) 里) 人 ) 吨 ) 1990 20.55 0.6 0.09 5126 1237 1991 22.44 0.75 0.11 6217 1379 1992 25.37 0.85 0.11 7730 1385 1993 27.13 0.9 0.14 9145 1399 1994 29.45 1.05 0.2 10460 1663 1995 30.1 1.35 0.23 11387 1714 1996 30.96 1.45 0.23 12353 1834 1997 34.06 1.6 0.32 15750 4322 1998 36.42 1.7 0.32 18304 8132 1999 38.09 1.85 0.34 19836 8936 2000 39.13 2.15 0.36 21024 11099 2001 39.99 2.2 0.36 19490 11203 2002 41.93 2.25 0.38 20433 10524 2003 44.59 2.35 0.49 22598 11115 2004 47.3 2.5 0.56 25107 13320 2005 52.89 2.6 0.59 33442 16762 2006 55.73 2.7 0.59 36836 18673

神经网络算法简介 () 人工神经网络(artificial neural network,缩写ANN),简称神经网络(neural network,缩写NN),是一种模仿生物神经网络的结构和功能的数学模型或计算模型。神经网络由大量的人工神经元联结进行计算。大多数情况下人工神经网络能在外界信息的基础上改变内部结构,是一种自适应系统。现代神经网络是一种非线性统计性数据建模工具,常用来对输入和输出间复杂的关系进行建模,或用来探索数据的模式。 神经网络是一种运算模型[1],由大量的节点(或称“神经元”,或“单元”)和之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重(weight),这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。 神经元示意图: ●a1~an为输入向量的各个分量 ●w1~wn为神经元各个突触的权值 ●b为偏置 ●f为传递函数,通常为非线性函数。以下默认为hardlim() ●t为神经元输出 ●数学表示

●为权向量 ●为输入向量,为的转置 ●为偏置 ●为传递函数 可见,一个神经元的功能是求得输入向量与权向量的内积后,经一个非线性传递函数得到一个标量结果。 单个神经元的作用:把一个n维向量空间用一个超平面分割成两部分(称之为判断边界),给定一个输入向量,神经元可以判断出这个向量位于超平面的哪一边。 该超平面的方程: 权向量 偏置 超平面上的向量 单层神经元网络是最基本的神经元网络形式,由有限个神经元构成,所有神经元的输入向量都是同一个向量。由于每一个神经元都会产生一个标量结果,所以单层神经元的输出是一个向量,向量的维数等于神经元的数目。示意图: 通常来说,一个人工神经元网络是由一个多层神经元结构组成,每一层神经元拥有输入(它的输入是前一层神经元的输出)和输出,每一层(我们用符号记做)Layer(i)是由Ni(Ni代表在第i层上的N)个网络神经元组成,每个Ni上的网络

人工神经网络算法 学习是要透过我们的头脑,因而研究大脑神经细胞的运作,可以帮助我们了解学习在脑神经是如何完成的,进而可以模拟神经细胞的运作以达到類似学习的功能。据估计人脑约有一千亿(1011)个神经细胞,每个神经细胞约有一千(103)根連结与其它神经细胞相連,因此人脑中约有一百万亿(1014)根連结,形成一个高度連结网狀的神经网路(neural network)。科学家们相信:人脑的信息处理工作即是透过这些連结來完成的 [葉怡成1993]。 神经细胞的形狀与一般的细胞有很大的不同,它包括:细胞体(soma):神经细胞中呈核狀的处理机构;轴突(axon):神经细胞中呈轴索狀的输送机构;树狀突(dendrites):神经细胞中呈树枝狀的输出入机构;与突触(synapse):树狀突上呈点狀的連结机构。根据神经学家的研究发现:当神经细胞透过神经突触与树狀突从其它神经元输入脉波讯号后,经过细胞体处理,产生一个新的脉波讯号。如果脉波讯号够强,将产生一个约千分之一秒100 毫伏的脉波讯号。这个讯号再经过轴突传送到它的神经突触,成为其它神经细胞的输入脉波讯号。如果脉波讯号是经过兴奋神经突触(excitatory synapse),则会增加脉波讯号的速率;相反的,如果脉波讯号是经过抑制神经突触(inhibitory synapse),则会减少脉波讯号的速率。因此,脉波讯号的速率是同时取决于输入脉波讯号的速率,以及神经突触的强度。而神经突触的强度可视为神经网路储存信息之所在,神经网路的学习即在调整神经突触的强度。 類神经网路(artificial neural networks),或译为人工神经网路,则是指模仿生物神经网路的信息处理系统,它是由许多人工神经细胞(又称为類神经元、人工神经元、与处理单元)所组成,