本公开涉及计算机数据处理领域。本公开的实施例公开了基于神经网络的信息处理方法和装置、电子设备和计算机可读介质。该基于神经网络的信息处理方法包括:获取输入信息;基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。该方法实现了基于输入信息的主神经网络的参数的自动动态调整。

权利要求书

1.一种基于神经网络的信息处理方法,包括:

获取输入信息;

基于所述输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,所述参

数存储器是预先基于主神经网络的全连接层构建的;

基于所述参数存储器中的各参数的概率分布,确定所述主神经网络的全连接层关于所述输入信息的参数组合模式;

基于所述全连接层关于所述输入信息的参数组合模式,更新所述主神经网络的全连接层,并基于更新全连接层之后的主神经网络对所述输入信息进行处理,得到所与所述输入信息对应的输出信息。

2.根据权利要求1所述的方法,其中,所述方法还包括:

利用主神经网络的特征提取层对所述输入信息进行特征提取,得到所述输入信息的抽象表示;以及

所述基于所述输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,包括:

基于所述输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布;

所述基于更新全连接层之后的主神经网络对所述输入信息进行处理,包括:

基于更新后的全连接层对所述输入信息的抽象表示进行处理。

3.根据权利要求2所述的方法,其中,所述基于所述输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布,包括:

将所述输入信息的抽象表示作为所述元神经网络的动态参数,利用包含所述动态参数的元神经网络预测参数存储器中的各参数的概率分布。

4.根据权利要求1所述的方法,其中,所述基于所述参数存储器中的各参数的概率分布,确定所述主神经网络的全连接层关于所述输入信息的参数组合模式,包括:

将所述概率分布中的概率值作为所述全连接层中的对应参数所表征的权重系数,基于所述权重系数对所述主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到所述主神经网络的全连接层关于所述输入信息的参数组合模式。

5.根据权利要求1-4任一项所述的方法,其中,所述主神经网络是基于与所述输入信息同类型的样本信息预先训练得到的。

6.一种基于神经网络的信息处理装置,包括:

获取单元,被配置为获取输入信息;

预测单元,被配置为基于所述输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,所述参数存储器是预先基于主神经网络的全连接层构建的;

确定单元,被配置为基于所述参数存储器中的各参数的概率分布,确定所述主神经网络的全连接层关于所述输入信息的参数组合模式;

处理单元,被配置为基于所述全连接层关于所述输入信息的参数组合模式,更新所述主神经网络的全连接层,并基于更新全连接层之后的主神经网络对所述输入信息进行处理,得到所与所述输入信息对应的输出信息。

7.根据权利要求6所述的装置,其中,所述装置还包括:

提取单元,被配置为利用主神经网络的特征提取层对所述输入信息进行特征提取,得到所述输入信息的抽象表示;以及

所述预测单元进一步被配置为:

基于所述输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布;

所述处理单元进一步被配置为:

基于更新后的全连接层对所述输入信息的抽象表示进行处理。

8.根据权利要求7所述的装置,其中,所述预测单元进一步被配置为:

将所述输入信息的抽象表示作为所述元神经网络的动态参数,利用包含所述动态参数的元神经网络预测参数存储器中的各参数的概率分布。

9.根据权利要求6所述的装置,其中,所述确定单元进一步被配置为按照如下方式确定所述主神经网络的全连接层关于所述输入信息的参数组合模式:

将所述概率分布中的概率值作为所述全连接层中的对应参数所表征的权重系数,基于所述权重系数对所述主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到所述主神经网络的全连接层关于所述输入信息的参数组合模式。

10.根据权利要求6-9任一项所述的装置,其中,所述主神经网络是基于与所述输入信息同类型的样本信息预先训练得到的。

11.一种电子设备,包括:

一个或多个处理器;

存储装置,用于存储一个或多个程序,

当所述一个或多个程序被所述一个或多个处理器执行,使得所述一个或多个处理器实现如权利要求1-5中任一所述的方法。

12.一种计算机可读介质,其上存储有计算机程序,其中,所述程序被处理器执行时实现如权利要求1-5中任一所述的方法。

技术说明书

基于神经网络的信息处理方法和装置

技术领域

本公开的实施例涉及计算机技术领域,具体涉及计算机数据处理技术领域,尤其涉及基于神经网络的信息处理方法和装置。

背景技术

复杂决策系统的目标通常需要由多个策略来完成。神经网络可以用于对复杂决策系统建模来表达其中各子系统之间的非线性关系。但是,复杂决策系统通常包含多种不同的策略,如果只使用一个具有固定参数的神经网络建模,无法在同一个网络中学习得到多种不同的参数组合方式。也即,复杂决策系统的输入通常是变化的,使用同一个神经网络无法实现不同输入的情况下的策略调整。

目前的方案是使用混合专家网络(Mixture of Expert,MOE),设置不同的专家网络对不同的策略建模,然后使用同一个门控矩阵从不同的专家网络中进行选择。

技术内容

本公开的实施例提出了基于神经网络的信息处理方法和装置、电子设备和计算机可读介质。

第一方面,本公开的实施例提供了一种基于神经网络的信息处理方法,包括:获取输入信息;基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;基于全连接层关于输入信息的参数

组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。

在一些实施例中,上述方法还包括:利用主神经网络的特征提取层对输入信息进行特征提取,得到输入信息的抽象表示;以及上述基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,包括:基于输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布;上述基于更新全连接层之后的主神经网络对输入信息进行处理,包括:基于更新后的全连接层对输入信息的抽象表示进行处理。

在一些实施例中,上述基于输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布,包括:将输入信息的抽象表示作为元神经网络的动态参数,利用包含动态参数的元神经网络预测参数存储器中的各参数的概率分布。

在一些实施例中,上述基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式,包括:将概率分布中的概率值作为全连接层中的对应参数所表征的权重系数,基于权重系数对主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到主神经网络的全连接层关于输入信息的参数组合模式。

在一些实施例中,上述主神经网络是基于与输入信息同类型的样本信息预先训练得到的。

第二方面,本公开的实施例提供了一种基于神经网络的信息处理装置,包括:获取单元,被配置为获取输入信息;预测单元,被配置为基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;确定单元,被配置为基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;处理单元,被配置为基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。

在一些实施例中,上述装置还包括:提取单元,被配置为利用主神经网络的特征提取层对输入信息进行特征提取,得到输入信息的抽象表示;以及上述预测单元进一步被配置为:基于输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布;上述处理单

元进一步被配置为:基于更新后的全连接层对输入信息的抽象表示进行处理。

在一些实施例中,上述预测单元进一步被配置为:将输入信息的抽象表示作为元神经网络的动态参数,利用包含动态参数的元神经网络预测参数存储器中的各参数的概率分布。

在一些实施例中,上述确定单元进一步被配置为按照如下方式确定主神经网络的全连接层关于输入信息的参数组合模式:将概率分布中的概率值作为全连接层中的对应参数所表征的权重系数,基于权重系数对主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到主神经网络的全连接层关于输入信息的参数组合模式。

在一些实施例中,上述主神经网络是基于与输入信息同类型的样本信息预先训练得到的。

第三方面,本公开的实施例提供了一种电子设备,包括:一个或多个处理器;存储装置,用于存储一个或多个程序,当一个或多个程序被一个或多个处理器执行,使得一个或多个处理器实现如第一方面提供的基于神经网络的信息处理方法。

第四方面,本公开的实施例提供了一种计算机可读介质,其上存储有计算机程序,其中,程序被处理器执行时实现第一方面提供的基于神经网络的信息处理方法。

本公开的上述实施例的基于神经网络的信息处理方法和装置、电子设备及计算机可读介质,通过获取输入信息,随后基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的,然后基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式,根据参数组合模式调整主神经网络的全连接层的参数,之后基于调整全连接层的参数之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息,实现了基于输入信息的主神经网络的参数的自动动态调整,可以针对不同的输入使用不同的参数组合模式来执行神经网络的信息处理任务,解决了单一策略的模型表达能力差的问题,针对复杂任务可以达到良好的处理效果。

附图说明

通过阅读参照以下附图所作的对非限制性实施例所作的详细描述,本公开的其它特征、目的和优点将会变得更明显:

图1是本公开的实施例可以应用于其中的示例性系统架构图;

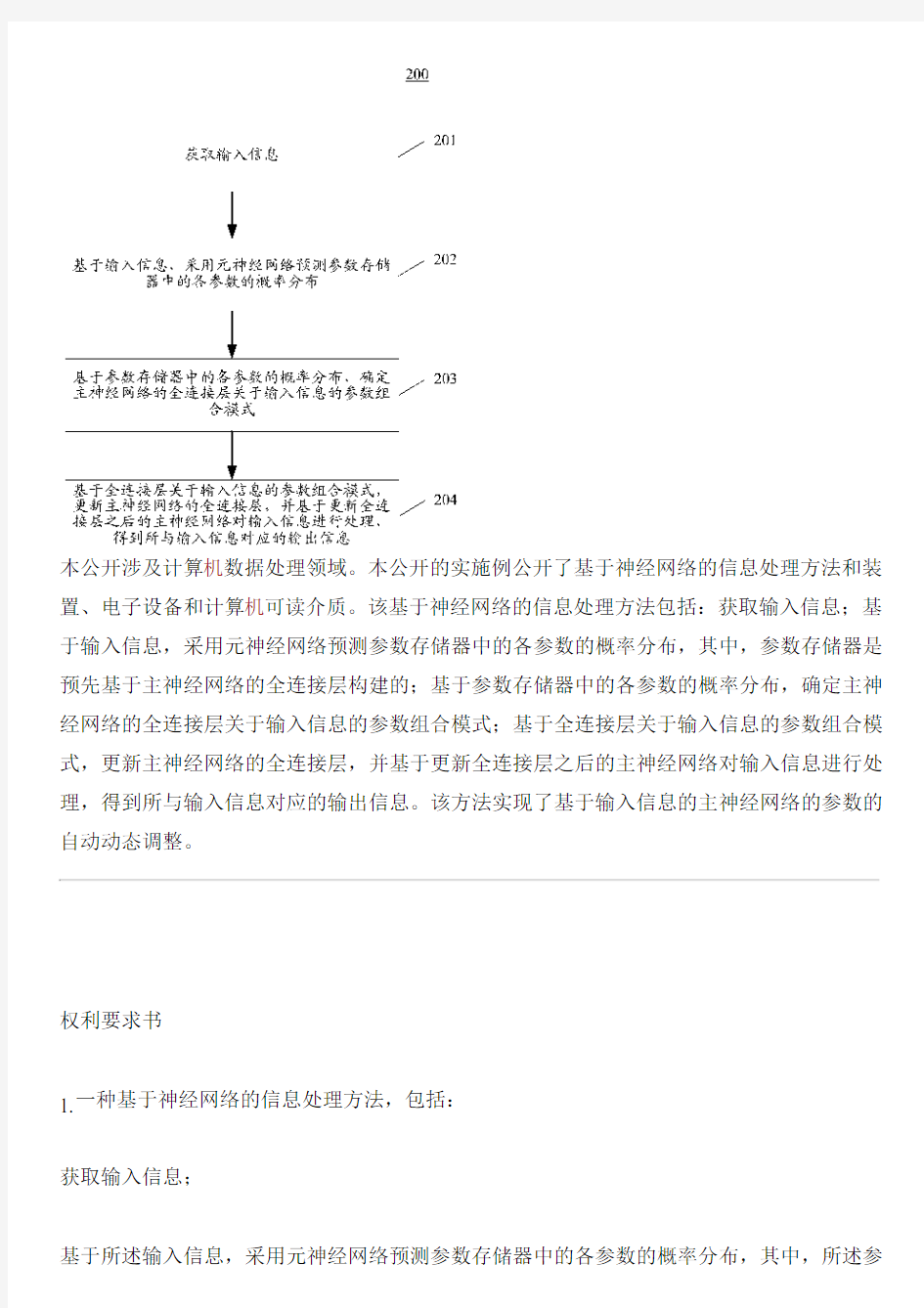

图2是根据本公开的基于神经网络的信息处理方法的一个实施例的流程图;

图3是根据本公开的基于神经网络的信息处理方法的另一个实施例的流程图;

图4是根据本公开的基于神经网络的信息处理方法所使用的算法原理示意图;

图5是本公开的基于神经网络的信息处理装置的一个实施例的结构示意图;

图6是适于用来实现本公开实施例的电子设备的计算机系统的结构示意图。

具体实施方式

下面结合附图和实施例对本公开作进一步的详细说明。可以理解的是,此处所描述的具体实施例仅仅用于解释相关技术,而非对该技术的限定。另外还需要说明的是,为了便于描述,附图中仅示出了与有关技术相关的部分。

需要说明的是,在不冲突的情况下,本公开中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本公开。

图1示出了可以应用本公开的基于神经网络的信息处理方法或基于神经网络的信息处理装置的示例性系统架构100。

如图1所示,系统架构100可以包括如图1所示,系统架构100可以包括终端设备101、102、103,网络104和服务器105。网络104用以在终端设备101、102、103和服务器105之间提供通信链路的介质。网络104可以包括各种连接类型,例如有线、无线通信链路或者光纤电缆等等。

终端设备101、102、103通过网络104与服务器105交互,以接收或发送消息等。终端设备101、102、103上可以安装有各种客户端应用。例如,图像处理类应用、信息分析类应用、语音助手类应用、购物类应用、金融类应用等。

终端设备101、102、103可以是硬件,也可以是软件。当终端设备101、102、103为硬件时,可以是各种电子设备,包括但不限于智能手机、平板电脑、电子书阅读器、膝上型便携计算机和台式计算机等等。当终端设备101、102、103为软件时,可以安装在上述所列举的电子设备中。其可以实现成多个软件或软件模块(例如用来提供分布式服务的多个软件或软件模块),也可以实现成单个软件或软件模块。在此不做具体限定。

服务器105可以是提供各种服务的服务器,例如为终端设备101、102、103上安装的应用提供后端支持的后端服务器。例如,服务器105可以接收终端设备101、102、103发送的待处理的信息,使用基于神经网络的模型执行信息处理任务,并将处理结果返回至终端设备101、102、103。

在一些具体的示例中,终端设备101、102、103可以向服务器105发送与语音识别、文本分类、对话行为分类、图像识别等任务相关的信息处理请求。服务器105上可以运行已针对相应的任务训练得到的神经网络模型,利用该神经网络模型来处理信息。

需要说明的是,本公开的实施例所提供的基于神经网络的信息处理方法一般由服务器105执行,相应地,基于神经网络的信息处理装置一般设置于服务器105中。

还需要指出的是,在一些场景中,服务器105可以从数据库、存储器或其他设备获取待处理的信息,这时,示例性系统架构100可以不存在终端设备101、102、103和网络104。

需要说明的是,服务器105可以是硬件,也可以是软件。当服务器105为硬件时,可以实现成多个服务器组成的分布式服务器集群,也可以实现成单个服务器。当服务器105为软件时,可以实现成多个软件或软件模块(例如用来提供分布式服务的多个软件或软件模块),也可以实现成单个软件或软件模块。在此不做具体限定。

应该理解,图1中的终端设备、网络和服务器的数目仅仅是示意性的。根据实现需要,可以具有任意数目的终端设备、网络和服务器。

继续参考图2,其示出了根据本公开的基于神经网络的信息处理方法的一个实施例的流程200。该基于神经网络的信息处理方法,包括以下步骤:

步骤201,获取输入信息。

在本实施例中,上述基于神经网络的信息处理方法的执行主体可以首先从发出信息处理请求的电子设备获取待处理的信息作为输入信息,或者可以从数据库或存储器中读取待处理的信息作为输入信息。该输入信息是待输入至主神经网络、利用主神经网络执行处理任务的信息,可以包括文本、图像、或音视频等数据。

在实践中,上述执行主体可以是用于执行指定的信息处理任务的设备。在这里,指定的信息处理任务可以例如为语音识别、语音合成、语义分析、图像识别、目标跟踪、行为意图分析、趋势预测等可以使用神经网络模型建模的任务。输入信息可以是指定的信息处理任务的处理对象,例如在语音识别任务中,输入信息为语音信号,在图像识别任务中,输入信息为图像。

步骤202,基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布。

其中,参数存储器是预先基于主神经网络的全连接层构建的。主神经网络是用于执行信息处理任务的多层神经网络,可以包括特征提取层和全连接层。其中特征提取层用于提取输入主神经网络的数据的特征,全连接层依照一定的策略将特征提取层提取出的特征综合起来,从而将提取出的不同维度的特征整合。

上述执行主体可以预先基于主神经网络的全连接层的参数构建参数存储器。参数存储器包括主神经网络的全连接层的所有参数。在一些可选的实现方式中,参数存储器可以是二维的参数矩阵,矩阵中每个元素对应全连接层的一个参数。

可以基于输入信息,采用主神经网络之外的元神经网络来预测主神经网络的全连接层中各参

数的概率分布,即利用元神经网络来预测主神经网络中的全连接层对应于当前的输入信息的各参数的取值。

在本实施例中,元神经网络可以对输入信息进行预处理,例如提取特征之后,对输入信息进行预处理之后,元神经网络输出参数存储器中的各参数的概率分布。

元神经网络可以预先经过训练。在训练元神经网络时可以获取针对不同的输入信息动态调整的全连接层参数来构建样本集,基于样本集、采用有监督或无监督的学习方式训练元神经网络。

步骤203,基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式。

全连接层的参数是其上一层的各个节点的权重,全连接层的每个节点通过将上一层的多个节点加权求和来整合上一层的数据。通常全连接层的上一层的节点数量和全连接层的节点数量较多,因此全连接层的参数数量较多。在本实施例中,全连接层的参数的取值(即对应于全连接层的上一层的各个节点的权重)随输入信息动态变化。由此,全连接层的参数的不同组合模式可以表征主神经网络在对特征提取层提取出的特征进行进一步处理得到最后结果时所采用的不同的策略模式。在这里,参数组合模式是指全连接层的上一层各节点与其在全连接层中对应的权重的组合。具体来说,全连接层的上一层包括m个节点x1、x2、…、xm,全连接层包括n个节点y1、y2、…、yn,则全连接层至少包括m×n个参数,表示为二维参数矩阵Wm×n,参数组合模式为二维参数矩阵Wm×n的不同取值与对应的上一层节点和本层节点的组合。

例如,以全连接层的上一层包含3个节点x1、x2、x3,全连接层包括两个节点y1、y2为例,全连接层的参数表示为w11、w12、w13,w21、w22、w23,全连接层的参数组合模式为:y1=w11×x1+w12×x2+w13×x3,y2=w21×x1+w22×x2+w23×x3。

在本实施例中,可以将元神经网络输出的概率分布中各参数对应的概率值作为参数存储器中各参数的取值,与该参数对应的节点组合起来生成全连接层关于当前输入信息的参数组合模式。也即,根据预测出的概率分布,对上述参数矩阵Wm×n中的参数赋值,将Y=Wm×nX作

为关于输入信息的参数组合模式,其中,Y={y1、y2、…、yn},X={x1、x2、…、xm}。

在本实施例的一些可选的实现方式中,可以将概率分布中的概率值作为全连接层中的对应参数所表征的权重系数,基于权重系数对主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到主神经网络的全连接层关于输入信息的参数组合模式。

具体地,在将元神经网络输出的概率分布中各参数对应的概率值作为参数存储器中各参数(即全连接层的各权重系数)的取值,对全连接层的上一层节点利用对应的权重系数加权求和后,还可以做非线性变换,例如采用sigmoid,tanh、Relu等激活函数做非线性变换,使得全连接层的输出是可导的,这样可以确保可对全连接层的输出求导,从而确保主神经网络可以利用梯度下降法来迭代训练。

步骤204,基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。

可以将步骤203确定出的主神经网络的全连接层关于输入信息的参数组合模式作为更新后的全连接层的策略模式。利用该更新后的全连接层的策略模式处理特征提取层的输出,得到特征的整合结果。然后可以在主神经网络中对特征整合结果进行分类,计算其分别属于每一个预定类别的概率,得到输入信息对应的输出信息;或者可以在主神经网络中对特征整合结果进行回归,得到输入信息对应的输出信息。

由于在确定参数存储器中各参数的概率分布时利用了获取到的输入信息,所以,本公开的上述实施例可以基于不同的输入信息生成全连接层参数的不同概率分布,由此实现了主神经网络的参数随输入信息的变换动态更新。通过动态地基于输入信息调整主神经网络的参数,能够使主神经网络更适应输入信息的变化,提升主神经网络对输入信息进行处理的处理效果。并且,上述针对输入信息动态调整参数的信息处理方法能够使得主神经网络提供多种策略逻辑的信息处理模式,从而解决了单一策略的模型表达能力差的问题,针对复杂任务可以达到良好的处理效果。

在本实施例的一些可选的实现方式中,上述主神经网络可以基于与输入信息同类型的样本信

息预先训练得到。可以首先确定主神经网络所执行的任务类型,例如语音识别、图像识别,然后根据任务类型确定相应的输入信息的数据类型和输出信息的数据类型。例如在语音识别任务中,输入信息是语音数据,输出信息是文本数据,则可以获取语音类的样本数据来构建用于训练主神经网络的样本集。还可以获取语音类的样本数据对应的文本类标注信息作为样本集的标注信息。这样,在训练完成后,主神经网络可以对与训练过程中输入的样本信息同类型的输入信息进行信息处理。

在本实施例的另一些可选的实现方式中,上述主神经网络还可以是利用与输入信息不同类型的样本信息预先训练得到的。这时,可以通过上述实施例的基于神经网络的信息处理方法,动态地调整主神经网络的参数,使其适应于对不同于训练过程中所使用的样本信息的类型的输入信息的处理。

继续参考图3,其示出了根据本公开的基于神经网络的信息处理方法的另一个实施例的流程图。如图3所示,本实施例的基于神经网络的信息处理方法的流程300,包括以下步骤:

步骤301,获取输入信息。

本实施例的步骤301与前述实施例的步骤201相同,步骤301的具体实现方式可以参考前述步骤201的描述,此处不再赘述。

步骤302,利用主神经网络的特征提取层对输入信息进行特征提取,得到输入信息的抽象表示。

在利用元神经网络预测参数存储器中各参数的概率分布之前,可以首先对输入信息进行特征提取,将输入信息转换为对应的抽象表示。

主神经网络可以例如是卷积神经网络,其中特征提取层可以包括卷积层、反卷积层、池化层中的至少一种。在实践中,特征提取层通常包括多个层,每层包括多个节点,可以将特征提取层中每一层的输出组合起来作为输入信息的抽象表示,或者可以将特征提取层中最后一层的输出作为输入信息的抽象表示。

步骤303,基于输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布。

在本实施例中,元神经网络可以基于步骤302得到的输入信息的抽象表示来预测参数存储器中各参数的概率分布。其中,参数存储器可以是预先基于主神经网络的全连接层的参数构建的。参数存储器包括主神经网络的全连接层的所有参数。在一些可选的实现方式中,参数存储器可以是二维的参数矩阵,矩阵中每个元素对应全连接层的一个参数。

可选地,可以将输入信息的抽象表示作为元神经网络的动态参数,利用包含动态参数的元神经网络预测参数存储器中的各参数的概率分布。

将输入信息表示为xi,特征提取层提取出的输入信息的抽象表示为F(xi),主神经网络中的全连接层Zi可以表示为:

Zi=WTF(xi)+b (1)

其中W∈RH×C表示全连接层的参数,H×C表示全连接层的参数所属参数空间的尺寸,b表示全连接层的偏差。

可以构建元神经网络GW(F((xi),θG)来预测主神经网络中全连接层的参数的概率分布,θG表示元神经网络的参数,该元神经网络GW(F(xi),θG)预测得出的概率分布可以作为全连接层中各对应参数的参数值。则公式(1)改写为:

Zi=GW(F(xi),θG)TF(xi)+b (2)

参数存储器可以表示为一个二维矩阵M∈RK×(H×C),其中,K×(H×C)表示二维矩阵的尺寸。则可以将元神经网络表示为:

GW(F(xi),θG)=ψ(MTQ(F(xi),θQ)) (3)

其中,ψ是非线性变换函数,例如激活函数identity、Relu、sigmoid、tanh,等等;

Q(F(xi),θQ)是一个神经网络模型,其中θQ表示该神经网络模型的参数,该神经网络模型可以是多层感知器模型、卷积神经网络模型或循环神经网络模型。

可以利用上述公式(3)来计算参数矩阵M中各参数的概率分布。

步骤304,基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式。

本实施例的步骤304与前述实施例的步骤203一致,步骤304的具体实现方式可以参考前述对步骤203的描述,此处不再赘述。

步骤305,基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新后的全连接层对输入信息的抽象表示进行处理,得到所与输入信息对应的输出信息。

在确定出主神经网络的全连接层关于输入信息的参数组合模式之后,可以将该参数组合模式作为更新后的全连接层的参数组合模式,或者说将该参数组合模式作为更新后的全连接层对特征提取层的输出进行计算的策略模式,利用更新后的全连接层的策略模式对步骤302中得到的输入信息的抽象表示进行计算,具体可以利用步骤303得到的参数的概率分布作为全连接层的对应权重参数的值,基于权重参数对输入信息的抽象表示进行加权求和之后,做非线性变换,例如采用Relu、softmax、sigmoid等函数做非线性变换,并对非线性变换的结果进行分类或回归,得到输入信息的处理结果,即得到与输入信息对应的输出信息。

本实施例中对输入信息进行特征提取得到输入信息的抽象表示,能够提取出输入信息的有效特征,使得元神经网络利用输入信息的抽象表示来预测参数存储器中的参数的概率分布时能够高效地得出较为准确的预测结果。由于元神经网路不需要对输入信息进行特征提取,有效提升了元神经网络的预测速度,从而提升了主神经网络中全连接层的参数动态更新速度,进而提升了信息处理效率。

继续参考图4,其示出了根据本公开的基于神经网络的信息处理方法所使用的算法原理示意图。如图4所示,在第(1)步中,首先在主神经网络中将输入信息x转换为对应的抽象表示

F(x);然后在第(2)步中,将输入信息x的抽象表示F(x)传输至元神经网络G,利用多层感知器

Q预测参数矩阵M中各参参数的概率分布,并与参数矩阵M整合得到主神经网络中的参数组合模式,其中多层感知器Q将输入信息x的抽象表示F(x)作为动态参数;之后在第(3)步中,将参数组合模式应用至主神经网络的全连接层得到全连接层的参数W(x);在第(4)步中基于全连接层对输入信息的抽象F(x)进一步处理得到输出信息Ly。

从图4可以看出,本公开的上述实施例的方法中,在主神经网络的基础上增加了元神经网络和参数存储器来实现对已训练完成的主神经网络参数的动态调整,实施方式较为简单,不会增加过多的计算量。该方法可动态地根据输入信息设置多种逻辑模式,能够解决单一模型无法表达复杂系统的逻辑模式的问题。

进一步参考图5,作为对上述基于神经网络的信息处理方法的实现,本公开提供了一种基于神经网络的信息处理装置的一个实施例,该装置实施例与图2和图3所示的方法实施例相对应,该装置具体可以应用于各种电子设备中。

如图5所示,本实施例的基于神经网络的信息处理装置500包括:获取单元501、预测单元502、确定单元503以及处理单元504。其中,获取单元501被配置为获取输入信息;预测单元502被配置为基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;确定单元503被配置为基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;处理单元504被配置为基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。

在一些实施例中,上述装置还包括:提取单元,被配置为利用主神经网络的特征提取层对输入信息进行特征提取,得到输入信息的抽象表示;以及上述预测单元502进一步被配置为:基于输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布;上述处理单元504进一步被配置为:基于更新后的全连接层对输入信息的抽象表示进行处理。

在一些实施例中,上述预测单元502进一步被配置为:将输入信息的抽象表示作为元神经网络的动态参数,利用包含动态参数的元神经网络预测参数存储器中的各参数的概率分布。

在一些实施例中,上述确定单元503进一步被配置为按照如下方式确定主神经网络的全连接层关于输入信息的参数组合模式:将概率分布中的概率值作为全连接层中的对应参数所表征的权重系数,基于权重系数对主神经网络的全连接层的上一层的各节点进行加权求和之后做非线性变换,得到主神经网络的全连接层关于输入信息的参数组合模式。

在一些实施例中,上述主神经网络是基于与输入信息同类型的样本信息预先训练得到的。

应当理解,装置500中记载的诸单元与参考图2和图3描述的方法中的各个步骤相对应。由此,上文针对基于神经网络的信息处理方法描述的操作和特征同样适用于装置500及其中包含的单元,在此不再赘述。

本公开的上述实施例的基于神经网络的信息处理装置500,通过获取单元获取输入信息,随后预测单元基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的,然后确定单元基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式,根据参数组合模式调整主神经网络的全连接层的参数,之后处理单元基于调整全连接层的参数之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息,实现了基于输入信息的主神经网络的参数的动态调整,可以针对不同的输入使用不同的参数组合模式来执行神经网络的信息处理任务,解决了单一策略的模型表达能力差的问题,针对复杂任务可以达到良好的处理效果。

下面参考图6,其示出了适于用来实现本公开的实施例的电子设备(例如图1所示的服务

器)600的结构示意图。图6示出的电子设备仅仅是一个示例,不应对本公开的实施例的功能和使用范围带来任何限制。

如图6所示,电子设备600可以包括处理装置(例如中央处理器、图形处理器等)601,其可以根据存储在只读存储器(ROM)602中的程序或者从存储装置608加载到随机访问存储器(RAM)603中的程序而执行各种适当的动作和处理。在RAM 603中,还存储有电子设备600操作所需的各种程序和数据。处理装置601、ROM 602以及RAM 603通过总线604彼此相连。输入/输出(I/O)接口605也连接至总线604。

通常,以下装置可以连接至I/O接口605:包括例如触摸屏、触摸板、键盘、鼠标、摄像头、麦克风、加速度计、陀螺仪等的输入装置606;包括例如液晶显示器(LCD)、扬声器、振动器等的输出装置607;包括例如硬盘等的存储装置608;以及通信装置609。通信装置609可以允许电子设备600与其他设备进行无线或有线通信以交换数据。虽然图6示出了具有各种装置的电子设备600,但是应理解的是,并不要求实施或具备所有示出的装置。可以替代地实施或具备更多或更少的装置。图6中示出的每个方框可以代表一个装置,也可以根据需要代表多个装置。

特别地,根据本公开的实施例,上文参考流程图描述的过程可以被实现为计算机软件程序。例如,本公开的实施例包括一种计算机程序产品,其包括承载在计算机可读介质上的计

算机程序,该计算机程序包含用于执行流程图所示的方法的程序代码。在这样的实施例中,该计算机程序可以通过通信装置609从网络上被下载和安装,或者从存储装置608被安装,或者从ROM 602被安装。在该计算机程序被处理装置601执行时,执行本公开的实施例的方法中限定的上述功能。需要说明的是,本公开的实施例所描述的计算机可读介质可以是计

算机可读信号介质或者计算机可读存储介质或者是上述两者的任意组合。计算机可读存储介质例如可以是——但不限于——电、磁、光、电磁、红外线、或半导体的系统、装置或器件,或者任意以上的组合。计算机可读存储介质的更具体的例子可以包括但不限于:具有一个或多个导线的电连接、便携式计算机磁盘、硬盘、随机访问存储器(RAM)、只读存储器(ROM)、可擦式可编程只读存储器(EPROM或闪存)、光纤、便携式紧凑磁盘只读存储器(CD-ROM)、光存储器件、磁存储器件、或者上述的任意合适的组合。在本公开的实施例中,计算机可读存储介质可以是任何包含或存储程序的有形介质,该程序可以被指令执行系统、装置或者器件使用或者与其结合使用。而在本公开的实施例中,计算机可读信号介质可以包括在基带中或者作为载波一部分传播的数据信号,其中承载了计算机可读的程序代码。这种传播的数据信号可以采用多种形式,包括但不限于电磁信号、光信号或上述的任意合适的组合。计算机可读信号介质还可以是计算机可读存储介质以外的任何计算机可读介质,该计算机可读信号介质可以发送、传播或者传输用于由指令执行系统、装置或者器件使用或者与其结合使用的程序。计算机可读介质上包含的程序代码可以用任何适当的介质传输,包括但不限于:电线、光缆、RF(射频)等等,或者上述的任意合适的组合。

上述计算机可读介质可以是上述电子设备中所包含的;也可以是单独存在,而未装配入该电子设备中。上述计算机可读介质承载有一个或者多个程序,当上述一个或者多个程序被该电

子设备执行时,使得该电子设备:获取输入信息;基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。

可以以一种或多种程序设计语言或其组合来编写用于执行本公开的实施例的操作的计算机程序代码,程序设计语言包括面向对象的程序设计语言—诸如Java、Smalltalk、C++,还包括常规的过程式程序设计语言—诸如“C”语言或类似的程序设计语言。程序代码可以完全地在用户计算机上执行、部分地在用户计算机上执行、作为一个独立的软件包执行、部分在用户计算机上部分在远程计算机上执行、或者完全在远程计算机或服务器上执行。在涉及远程计算机的情形中,远程计算机可以通过任意种类的网络——包括局域网(LAN)或广域网(WAN)——连接到用户计算机,或者,可以连接到外部计算机(例如利用因特网服务提供商来通过因特网连接)。

附图中的流程图和框图,图示了按照本公开各种实施例的系统、方法和计算机程序产品的可能实现的体系架构、功能和操作。在这点上,流程图或框图中的每个方框可以代表一个模块、程序段、或代码的一部分,该模块、程序段、或代码的一部分包含一个或多个用于实现规定的逻辑功能的可执行指令。也应当注意,在有些作为替换的实现中,方框中所标注的功能也可以以不同于附图中所标注的顺序发生。例如,两个接连地表示的方框实际上可以基本并行地执行,它们有时也可以按相反的顺序执行,这依所涉及的功能而定。也要注意的是,框图和/或流程图中的每个方框、以及框图和/或流程图中的方框的组合,可以用执行规定的功能或操作的专用的基于硬件的系统来实现,或者可以用专用硬件与计算机指令的组合来实现。

描述于本公开的实施例中所涉及到的单元可以通过软件的方式实现,也可以通过硬件的方式来实现。所描述的单元也可以设置在处理器中,例如,可以描述为:一种处理器包括获取单元、预测单元、确定单元和处理单元。其中,这些单元的名称在某种情况下并不构成对该单元本身的限定,例如,获取单元还可以被描述为“获取输入信息的单元”。

以上描述仅为本公开的较佳实施例以及对所运用技术原理的说明。本领域技术人员应当理解,本公开中所涉及的技术范围,并不限于上述技术特征的特定组合而成的技术方案,同时也应涵盖在不脱离上述技术构思的情况下,由上述技术特征或其等同特征进行任意组合而形成的其它技术方案。例如上述特征与本申请中公开的(但不限于)具有类似功能的技术特征进行互相替换而形成的技术方案。

信息融合算法 1 概述 信息融合又称数据融合,是对多种信息的获取、表示及其内在联系进行综合处理和优化的技术。经过融合后的传感器信息具有以下特征:信息冗余性、信息互补性、信息实时性、信息获取的低成本性。 1、组合:由多个传感器组合成平行或互补方式来获得多组数据输出的一种处理方法,是一种最基本的方式,涉及的问题有输出方式的协调、综合以及传感器的选择。在硬件这一级上应用。 2、综合:信息优化处理中的一种获得明确信息的有效方法。 例:在虚拟现实技术中,使用两个分开设置的摄像机同时拍摄到一个物体的不同侧面的两幅图像,综合这两幅图像可以复原出一个准确的有立体感的物体的图像。 3、融合:当将传感器数据组之间进行相关或将传感器数据与系统内部的知识模型进行相关,而产生信息的一个新的表达式。 4、相关:通过处理传感器信息获得某些结果,不仅需要单项信息处理,而且需要通过相关来进行处理,获悉传感器数据组之间的关系,从而得到正确信息,剔除无用和错误的信息。 相关处理的目的:对识别、预测、学习和记忆等过程的信息进行综合和优化。

2 技术发展现状 信息融合技术的方法,概括起来分为下面几种: 1)组合:由多个传感器组合成平行或互补方式来获得多组数据 输出的一种处理方法,是一种最基本的方式,涉及的问题有 输出方式的协调、综合以及传感器的选择。在硬件这一级上 应用。 2)综合:信息优化处理中的一种获得明确信息的有效方法。例: 在虚拟现实技术中,使用两个分开设置的摄像机同时拍摄到 一个物体的不同侧面的两幅图像,综合这两幅图像可以复原 出一个准确的有立体感的物体的图像。 3)融合:当将传感器数据组之间进行相关或将传感器数据与系 统内部的知识模型进行相关,而产生信息的一个新的表达式。 4)相关:通过处理传感器信息获得某些结果,不仅需要单项信 息处理,而且需要通过相关来进行处理,获悉传感器数据组 之间的关系,从而得到正确信息,剔除无用和错误的信息。 相关处理的目的:对识别、预测、学习和记忆等过程的信息 进行综合和优化。 3 算法描述 3.1 Bayes融合 Bayes融合是融合静态环境中多传感器低层数据的一种常用方法。

神经网络与智能信息处理 概率搜索和最优化方法。是模拟自然淘汰和遗传现象的工程模型。 GA的历史可追溯到1960年,明确提出遗传算法的是1975年美国Michigan大学的Holland博士,他根据生物进化过程的适应现象,提出如下的GA模型方案: 1.将多个生物的染色体(Chromosmoe)组成的符号集合,按文字进行编码,称为个体。 2.定义评价函数,表示个体对外部环境的适应性。其数值大的个体表示对外部环境的适应性高,它的生存(子孙的延续)的概率也高。 3.每个个体由多个“部分”组合而成,每个部分随机进行交叉及突然变异等变化,并由此产生子孙(遗传现象)。 4.个体的集合通过遗传,由选择淘汰产生下一代。 遗传算法提出之后,很快得到人工智能、计算机、生物学等领域科学家的高度重视,并在各方面广泛应用。1989年美国Goldberg博士发表一本专著:“Genetic Algorithms in Search,Optimization and Machine Learning”。出版后产生较大影响,该书对GA的数学基础理论,GA的基本定理、数理分析以及在搜索法、最优化、机器学习等GA应用方面进行了深入浅出的介绍,并附有Pascal模拟程序。 1985年7月在美国召开第一届“遗传算法国际会议”(ICGA)。以后每隔两年召开一次。近年来,遗传算法发展很快,并广泛应用于信息技术的各个领域,例如: 智能控制:机器人控制。机器人路径规划。 工程设计:微电子芯片的布局、布线;通信网络设计、滤波器设计、喷气发动机设计。 图象处理:图象恢复、图象识别、特征抽取。 调度规划:生产规划、调度问题、并行机任务分配。 优化理论:TSP问题、背包问题、图划分问题。

龙源期刊网 https://www.doczj.com/doc/5114890941.html, 信息融合方法研究进展 作者:陈慈张敬磊盖姣云王云 来源:《科技视界》2019年第17期 【摘要】从信息融合的起源,功能模型,数学模型,在民事上的应用以及发展趋势对多 源信息融合进行介绍,指出该领域的研究趋势,为信息融合的研究发展提供一些借鉴和启示。 【关键词】信息融合;功能模型;数学模型;综述 中图分类号: TP202 文献标识码: A 文章编号: 2095-2457(2019)17-0032-002 DOI:10.19694/https://www.doczj.com/doc/5114890941.html,ki.issn2095-2457.2019.17.014 Research Progress on Information Fusion Methods CHEN Ci ZHANG Jing-lei GAI Jiao-yun WANG Yun (School of Transportation and Vehicle Engineering

第1讲:神经网络信息处理方法 人工神经网络是一种旨在模仿人脑结构及其功能的信息处理系统 人工神经网络特点:1.大规模并行处理2.分布式存储3.自适应(学习)过程 人工神经网络的基本要素:神经元功能函数、神经元之间的连接形式和网络的学习(训练)。 1.神经元功能函数 神经元在输入信号作用下产生输出信号的规律由神经元功能函数f (Activation Function)给出,也称激活函数,或称转移函数,这是神经元模型的外特性。

2 神经元之间的连接形式 *前向网络(前馈网络) 网络可以分为若干“层”,各层按信号传输先后顺序依次排列,第i层的神经元只接受第(i-1)层神经元给出的信号,各神经元之间没有反馈。======前馈型网络可用一有向无环路图表示. *反馈网络 典型的反馈型神经网络每个节点都表示一个计算单元,同时接受外加输入和其它各节点的反馈输入,每个节点也都直接向外部输出。 Hopfield网络即属此种类型。在某些反馈网络中,各神经元除接受外加输入与其它各节点反馈输入之外,还包括自身反馈。有时,反馈型神经网络也可表示为一张完全的无向图. 3. 人工神经网络的学习(训练) Hebb 有例子,δ学习规则,感知器学习,Hidrow_Hoff,胜者为王 第2讲:BP神经网络模型 BP神经网络其基本思想是: 学习过程由信号的正向传播与误差的反向传播两个过程组成。 正向传播时,输入样本从输入层传入,经隐层逐层处理后,传向输出层。若输出层的实际输出与期望输出(教师信号)不符,则转向误差的反向传播阶段。 误差的反向传播是将输出误差以某种形式通过隐层向输入层逐层反传,并将误差分摊给各层的所有单元,从而获得各层单元的误差信号,此误差信号即作为修正各单元权值的依据。 这种信号正向传播与误差反向传播的各层权值调整过程,是周而复始地进行的。权值不断调整过程,也就是网络的学习训练过程。此过程一直进行到网络输出的误差减少到可以接受的程度,或进行到预先设定的学习次数为止。 BP神经网络的缺陷:

BP神经网络原理及应用 1 人工神经网络简介 1.1生物神经元模型 神经系统的基本构造是神经元(神经细胞),它是处理人体内各部分之间相 互信息传递的基本单元。据神经生物学家研究的结果表明,人的大脑一般有1011 个神经元。每个神经元都由一个细胞体,一个连接其他神经元的轴突1010 和一些向外伸出的其它较短分支——树突组成。轴突的功能是将本神经元的输出信号(兴奋)传递给别的神经元。其末端的许多神经末梢使得兴奋可以同时送给多个神经元。树突的功能是接受来自其它神经元的兴奋。神经元细胞体将接受到的所有信号进行简单地处理后由轴突输出。神经元的树突与另外的神经元的神经末梢相连的部分称为突触。 1.2人工神经元模型 神经网络是由许多相互连接的处理单元组成。这些处理单元通常线性排列成组,称为层。每一个处理单元有许多输入量,而对每一个输入量都相应有一个相关 联的权重。处理单元将输入量经过加权求和,并通过传递函数的作用得到输出量,再传给下一层的神经元。目前人们提出的神经元模型已有很多,其中提出最早且影 响最大的是1943年心理学家McCulloch和数学家Pitts在分析总结神经元基本特

性的基础上首先提出的M-P 模型,它是大多数神经网络模型的基础。 )()(1∑=-=n i j i ji j x w f t Y θ (1.1) 式(1.1)中为神经元单元的偏置(阈值),ji w 为连接权系数(对于激发状态, ji w 取正值,对于抑制状态,ji w 取负值) ,n 为输入信号数目,j Y 为神经元输出,t 为时间,f()为输出变换函数,有时叫做激发或激励函数,往往采用0和1二值函数或S形函数。 1.3人工神经网络的基本特性 人工神经网络由神经元模型构成;这种由许多神经元组成的信息处理网络具有并行分布结构。每个神经元具有单一输出,并且能够与其它神经元连接;存在许多(多重)输出连接方法,每种连接方法对应一个连接权系数。严格地说,人工神经网络是一种具有下列特性的有向图: (1)对于每个节点存在一个状态变量xi ; (2)从节点i 至节点j ,存在一个连接权系数wji ; (3)对于每个节点,存在一个阈值; (4)对于每个节点,定义一个变换函数(,,),j i ji j f x w i j θ≠,对于最一般的情况,此函数取()j ji i j i f w x θ-∑形式。 1.4 人工神经网络的主要学习算法 神经网络主要通过两种学习算法进行训练,即指导式(有师)学习算法和非指导式(无师)学习算法。此外,还存在第三种学习算法,即强化学习算法;可把它看做有师学习的一种特例。 (1)有师学习 有师学习算法能够根据期望的和实际的网络输出(对应于给定输入)间的差来调整神经元间连接的强度或权。因此,有师学习需要有个老师或导师来提供期望或目标输出信号。有师学习算法的例子包括规则、广义规则或反向传播算法以及LVQ 算法等。 (2)无师学习 无师学习算法不需要知道期望输出。在训练过程中,只要向神

设备制造流程及制作周期 设备制造工艺流程图 (1) 材料入库 材料、零部件 材料进厂检查 材料领用 材料 切割 组对 焊接☆ 整型 表面毛刺处理 零(原)部件 检测 分组 测试 组装 调试 非标件 下料 整理 车床加工 检验 清理 喷漆☆ 成品检查 产品调试 产品整装 包装作业 铭牌、标签☆ 入库 激光打标 无损检测、理化检验☆

设备制造工艺流程表(2) NO 工程名称 作业内容 管理项目 记录 操作人员 1 材料、零部件 材料零部件入 库 先入先出 原材料入库表 仓库检验 保管员 2 材料进厂检查 实施进厂检查 N/A 外部采购合同书,输入 检验报告 3 材料入库 移动至材料仓 库保管 分规格保管 作业日志 4 材料领用 原材料工程投 入 先入先出 原材料出库表 5 材料 产品的加工 按顺序进行 作业日志 车间 技术人员 6 切割 材料切割 尺寸 生产作业指导书 7 组对 产品的精密加 工 尺寸 生产作业指导书 8 焊接 产品的加工 尺寸 生产作业指导书 9 整型 校正 尺寸 生产作业指导书 10 表面毛刺处理 表面毛刺处理 去除毛刺 生产作业指导书 11 无损、理化检验 仪器检测 焊接质量 生产作业指导书 12 喷漆 表面着色 外周检验 生产作业指导书 13 产品整装 产品整装 产品的结合 性 作业日志 14 产品调试 产品检验 产品性能 作业日志 15 成品检查 最终检查 N/A 检验报告 检验员 16 包装作业 包装作业 包装状态 作业日志 内外包装 操作工 17 铭牌、标签 打制铭牌、加贴 标签 N/A 作业日志 18 入库 包装成品 N/A 成品入库表 仓库检验保管员 注:在工艺流程图中带☆标记是主要控制项目和控制点及关键和特殊工序 有关制造工艺流程图的详细说明 ○ 将材料切割成所需的大小及形状。 ○ 利用切割机分料初步加工之后,接着利用攻螺丝机加工螺孔。 ○ 加工后的材料做为产品以成形,但为了提高表面粗度,进行抛丸清理。 ○ 抛丸清理后进行喷漆作业,该工艺属关键和特殊工序。 ○ 完成成品检查后打制铭牌、加贴标签入库。该工艺属关键和特殊工序。 ※从原料入库到成品入库,根据产品标准书的标准要求规定,全程记录及管理。

基于多传感器信息融合的 数控机床故障诊断研究 1.引言 数控机床具有加工柔性好、加工精度高、加工质量稳定、生产率高等诸多特点,但其结构和运行工况也很复杂,一旦机床发生故障,引起故障的因素众多,有机械方面的,有电气方面的,同时同一种故障往往有不同的表现,同一种症状又常常是几种故障共同作用的结果,故障的多样性、复杂性和各故障之间的复杂联系构成了数控机床故障诊断中的重点和难点。每个传感器都有一定的功能和测量范围,单个传感器的数据从某个侧面反应被测对象或系统的情况,难免带有一定的局限性。仅仅通过单一传感器的特征提取和诊断分析将无法成功完成对数控机床的故障诊断任务。因此多传感器数据融合技术显得尤为重要,它能克服传感器使用的局限性和传感器信息的不准确性,充分地、综合地、更有效地利用多传感器信息,减少信息的模糊性,增加决策可信度,提高对数控机床的故障诊断的准确率。 多传感器数据融合是一种重要的传感器信息处理方法,它起源于20世纪70年代,最早被应用于军事领域,用于解决目标识别与跟踪、状态与身份估计、态势和威胁估计等技术问题。它能充分利用不同时间与空间的多传感器数据资源,在一定准则下进行分析、综合、支配和使用,得到对被测对象的一致性解释和描述,并做出相应的判断、估计和决策。 多传感器数据融合有多种算法,其中,D-S证据理论方法的应用最为广泛。本文主要建立了基于多传感器信息融合的数控机床二级故障诊断系统:基于自适应加权算法的一级融合,基于D-S证据理论的二级融合。然后利用某一论文中的数控机床的测量数据,通过MATLAB软件对其进行分析计算,最后得出结论。 2.基于多传感器信息融合的二级故障诊断系统 本文介绍了一种基于多传感器信息融合的二级故障诊断系统:基于自适应加权算法的一级融合,基于D-S证据理论的二级融合,如图1所示。

五个基本的学习算法:误差—修正学习;基于记忆的学习;Hebb 学习;竞争学习和Boltzmann 学习。误差修正学习植根于最优滤波。基于记忆的学习通过明确的记住训练数据来进行。Hebb 学习和竞争学习都是受了神经生物学上的考虑的启发。Boltzmann 学习是建立在统计学力学借来的思想基础上。 1. 误差修正学习 神经元k 的输出信号)(n y k 表示, )(n d k 表示的是期望响应或目标 输出比较。由此产生)(n e k 表示的误差信号,有 )()()(n y n d n e k k k -= 这一目标通过最小化代价函数或性能指标 )(n ξ来实现。定义如下 )(2 1)(2 n e n k = ξ 也就是说)(n ξ是误差能量的瞬时值。这种对神经元k 的突触权值步步逼近的调节将持续下去,直到系统达到稳定状态。这时,学习过程停止。根据增量规则,在第n 时间步作用于突触权值的调节量)(n w kj ?定义如下: )()()(n x n e n w j k kj η=? 2. 基于记忆的学习 在一个简单而有效的称作最近邻规则的基于记忆的学习类型中, 局部邻域被定义为测试向量test X 的直接邻域的训练实例,特别,向量 {}N N X X X X ,,,21' ???∈ 被称作test X 的最邻近,如果 ),(),(min ' test N test i i X X d X X d = 这里,),(test i X X d 是向量i X 和test X 的欧几里德距离。与最短距离相关的类别,也 就是向量'N X 被划分的类别。 3. Hebb 学习 我们定义Hebb 突触为这样一个突触,它使用一个依赖时间的、 高度局部的和强烈交互的机制来提高突触效率为前突触和后突触活动间的相互关系的一个函数。可以得出Hebb 突触特征的4个重要机制:时间依赖机制;局部机制;交互机制;关联或相关机制。 4. 竞争学习 获胜神经元k 的输出信号k y 被置 为1;竞争失败的所有神经元 输出信号被置为0。这样,我们有 ?? ?≠>=否则对于所有如果, 0,,1k j j v v y j k k 其中,诱导局部域k v 表示结合所有达到神经元k 的前向和反馈输入的动作。 令kj w 表示连接输入节点j 到神经元k 的突触权值。假定每个神经元被分配固定 量的突触权值,权值分布在它的节点之中;也就是 k w kj j 对于所有的 ,1=∑ 然后神经元通过将突触权值从它的不活跃 输入移向活跃输入来进行学习。如果神经元对一个特定输入模式不响应,那么没有学习发生在那个神经元上。如果一个特定神经元赢得了竞争,这个神经元的每个输入节点经一定的比例释放它的突触权值,释放的权值然后平均分布到活跃输入节点上。作用于突触权值kj w 的改变量kj w ?定

神经网络控制 公司标准化编码 [QQX96QT-XQQB89Q8-NQQJ6Q8-MQM9N]

人工神经网络控制 摘要: 神经网络控制,即基于神经网络控制或简称神经控制,是指在控制系统中采用神经网络这一工具对难以精确描述的复杂的非线性对象进行建模,或充当控制器,或优化计算,或进行推理,或故障诊断等,亦即同时兼有上述某些功能的适应组合,将这样的系统统称为神经网络的控制系统。本文从人工神经网络,以及控制理论如何与神经网络相结合,详细的论述了神经网络控制的应用以及发展。 关键词: 神经网络控制;控制系统;人工神经网络 人工神经网络的发展过程 神经网络控制是20世纪80年代末期发展起来的自动控制领域的前沿学科之一。它是智能控制的一个新的分支,为解决复杂的非线性、不确定、不确知系统的控制问题开辟了新途径。是(人工)神经网络理论与控制理论相结合的产物,是发展中的学科。它汇集了包括数学、生物学、神经生理学、脑科学、遗传学、人工智能、计算机科学、自动控制等学科的理论、技术、方法及研究成果。 在控制领域,将具有学习能力的控制系统称为学习控制系统,属于智能控制系统。神经控制是有学习能力的,属于学习控制,是智能控制的一个分支。神经控制发展至今,虽仅有十余年的历史,已有了多种控制结构。如神经预测控制、神经逆系统控制等。 生物神经元模型 神经元是大脑处理信息的基本单元,人脑大约含1012个神经元,分成约1000种类型,每个神经元大约与 102~104个其他神经元相连接,形成极为错综复杂而又灵活多变的神经网络。每个神经元虽然都十分简单,但是如此大量的神经元之间、如此复杂的连接却可以演化出丰富多彩的行为方式,同时,如此大量

设备生产流程 Company Document number:WUUT-WUUY-WBBGB-BWYTT-1982GT

设备生产流程图 合 格 成 品 根据购买计划购进的原材料和外协加工件,经质检实验室检测合格后办理入库手续。检测配件质量、外形尺寸、材质达到生产设备配件要求。 二、装配部流程 (一)按照生产计划填写领料单,领用配件有装配工保管安装使用。 (二)打开机箱盖进行设备组装 1、电磁阀的组装:将840电磁阀与210mm 波纹管连接、波纹管要用橡胶密封垫、锥形橡胶密封垫、用15/24外丝对接、用16变24的对丝对接、安装喷嘴 。 注意各部件连接时的先后顺序,喷嘴安装时要滴加螺纹胶密封。 2、电磁阀与机箱的连接: 电磁阀用M4*6的不锈钢螺丝连接,注意波纹管的弯曲角度。(注意;锥形密封垫要卡入中间隔板,保证机箱燃烧室与控制室隔离)

3、燃烧杯的组装:注意弹垫的位置,组装时避免波纹管扭曲受力。 4、风压测压口宝塔件的安装(确保螺纹处滴有5071密封胶,螺纹上到底) 5、指示灯的安装,注:螺纹为塑料材质,注意用力不要过猛,橡胶密封圈要加在机箱外延。 6、隔热陶瓷垫与观火孔的安装,观火孔安装时要注意从一边慢慢的往机箱观火孔槽上卡,确保安装的牢固和美观。隔热陶瓷垫在安装时要提前折好,注意用力不要过大,以免对陶瓷垫产生破损。 7、点火针的安装。采用M4的不锈钢螺丝安装,机壳与点火针之间加装陶瓷隔热垫,注意点火针的安装方向。 8、风压开关的安装。采用M4*10的不锈钢螺丝连接,注意安装的方向,风压开关一般调至40pa。 9、风压测压管的安装。长度不宜过长,长度控制在风压管不受力,不打结为准。 10、橡胶密封垫的粘贴。保证机箱盖与机箱接触的部位都要黏贴上,以保证燃烧控制室的密封环境。 11、机箱下侧盖的安装,用M4的不锈钢螺丝连接,确保螺丝上紧。 12、机箱组线的连接,注意每根线的接法和位置,注意接线方式按接线图 13、控制板的安装,将控制板放人注塑方盒内,将组线与控制板连接,注意插口的方向,确保地线连接良好,用螺丝固定好盒盖后安装在机箱内。 14、机箱上盖的安装,用M4的不锈钢螺丝连接,确保螺丝上紧。 (三)设备组装完成的检测 外观检查 1、机箱外壳表面涂层应光滑,色泽均匀,不应有斑痕,划痕及凹陷。 2、各焊接螺帽无松动,连接尺寸符合设计要求。 启动设备检验 1、不开燃气阀进行启动检验:

本公开涉及计算机数据处理领域。本公开的实施例公开了基于神经网络的信息处理方法和装置、电子设备和计算机可读介质。该基于神经网络的信息处理方法包括:获取输入信息;基于输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,参数存储器是预先基于主神经网络的全连接层构建的;基于参数存储器中的各参数的概率分布,确定主神经网络的全连接层关于输入信息的参数组合模式;基于全连接层关于输入信息的参数组合模式,更新主神经网络的全连接层,并基于更新全连接层之后的主神经网络对输入信息进行处理,得到所与输入信息对应的输出信息。该方法实现了基于输入信息的主神经网络的参数的自动动态调整。 权利要求书 1.一种基于神经网络的信息处理方法,包括: 获取输入信息; 基于所述输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,其中,所述参

数存储器是预先基于主神经网络的全连接层构建的; 基于所述参数存储器中的各参数的概率分布,确定所述主神经网络的全连接层关于所述输入信息的参数组合模式; 基于所述全连接层关于所述输入信息的参数组合模式,更新所述主神经网络的全连接层,并基于更新全连接层之后的主神经网络对所述输入信息进行处理,得到所与所述输入信息对应的输出信息。 2.根据权利要求1所述的方法,其中,所述方法还包括: 利用主神经网络的特征提取层对所述输入信息进行特征提取,得到所述输入信息的抽象表示;以及 所述基于所述输入信息,采用元神经网络预测参数存储器中的各参数的概率分布,包括: 基于所述输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布; 所述基于更新全连接层之后的主神经网络对所述输入信息进行处理,包括: 基于更新后的全连接层对所述输入信息的抽象表示进行处理。 3.根据权利要求2所述的方法,其中,所述基于所述输入信息的抽象表示,采用元神经网络预测参数存储器中的各参数的概率分布,包括: 将所述输入信息的抽象表示作为所述元神经网络的动态参数,利用包含所述动态参数的元神经网络预测参数存储器中的各参数的概率分布。 4.根据权利要求1所述的方法,其中,所述基于所述参数存储器中的各参数的概率分布,确定所述主神经网络的全连接层关于所述输入信息的参数组合模式,包括:

设备生产制造工艺流程图 主要部件制造要求和生产工艺见生产流程图: 1)箱形主梁工艺流程图 原材料预处理划线下料清理 材质单与喷涂划划数半剪清割坡 钢材上炉丸富出出控自除渣口 号批号一除锌拱外自动焊等打 一对应油底度形动气切区打磨 锈线线气割 割 校正对接拼焊无损探伤装配焊接清理 达度埋超X 确垂内工清焊到要弧声光保直部电除渣平求自波拍隔度先焊内杂直动片板用接腔物 焊手 检验装配点焊四条主缝焊接清理校正 内焊装成用Φ清磨修修振腔缝配箱埋HJ431 除光正正动检质下形弧直焊焊拱旁消验量盖主自流渣疤度弯除板梁动反应 焊接力自检打钢印专检待装配 操专质 作检量 者,控 代填制 号写表

2)小车架工艺流和 原材料预处理划线下料清理 材质单与喷涂划划数半剪清割坡 钢材上炉丸富出出控自除渣口 号批号一除锌拱外自动焊等打 一对应油底度形动气切区磨 锈线线气割 校正对接拼焊无损探伤装配焊接清理 达度埋超X 确垂内工清焊 到要弧声光保直部电除渣 平求自波拍隔度先焊内杂 直动片板用接腔物 焊手 检验装配点焊主缝焊接清理校正 内焊清磨修修振应腔缝除光正正动力检质焊焊拱旁消验量渣疤度弯除 自检划线整体加工清理 A表A表 行车行车 适用适用 自检打钢印专检待装配 操专质

作检量 者,控 代填制 号写表 3)车轮组装配工艺流程图 清洗检测润滑装配 煤清轮确尺轴部 油洗孔认寸承位 或轴等各及等加 洗承部种公工润 涤,位规差作滑 剂轴格剂 自检打钢印专检待装配 操 作 者 代 号 4)小车装配工艺流程图 准备清洗检测润滑 场按领煤清轴确尺轴加最注 地技取于油洗及认寸承油后油 清术各或轴孔各及内减 理文件洗承等件公、速件涤齿部规差齿箱 剂轮位格面内 装配自检空载运行检测标识入库 螺手起行噪 钉工升走音 松盘机机震 紧动构构动

神经网络在传感信号处理中的应用 一、基本原理 神经网络是一种不需要选取基函数系的非线性函数逼近方法。本文利用神经网络的高度非线性描述能力, 实现传感信号的处理。由于神经网络是根据对象的输入2输出信息, 不断地对网络参数进行学习, 以实现从输入参数到输出参数的非线性映射; 还可以根据来自机理模型和实际运行对象的新数据样本进行自适应学习, 尤其是通过不断的实时学习, 可以适应对象参数的缓慢变化。因此, 这种方法克服了机理建模所存在的困难。神经网络可以完成大量的信息处理任务, 其应用涉及相当广泛的领域。归纳起来, 神经网络的信息处理任务主要包括: (1) 数学上的映射逼近。开发一种合适的函数f :A < R n T < R n ,以自组织的方式响应以下的样本集:(x i , y i) , ( x2 , y2) , ? , ( x i , y i)(这里y i = f ( x i)或y i =f (x i) + n o ,(其中n o为噪声))。象识别和分类等计算都可以抽象成这样的一种近似的数学映射。 (2) 联想记忆。是指实现模式完善、恢复相关模式的相互回忆等。神经网络的信息分布式存储于连接权系数中, 使网络具有很高的容错性和鲁棒性, 而模式识别中往往存在噪声干扰或输入模式的部分损失,网络的这一特点使其成功地用于模式识别问题。 将神经网络应用到传感信号处理涉及到两个重要的问题: 模式预处理变换和模式识别。预处理变换是指接受一种形式模式, 应用神经网络把它转换为更多想要或可用形式的模式; 而模式识别则是把一模式映射到其它类型或类别的操作。可见, 神经网络在传感信号处理应用的基础是神经网络的函数逼近能力, 并 利用这一能力对传感器进行建模。已有许多文献对神经网络的函数逼近能力进行了研究, 而基于神经网络的传感系统的建模有直接逆系统建模法、正2逆系统建模法、逆2逆系统建模法。

BP神经网络的学习 王贵腾 摘要:人工神经网络是近年来的热点研究领域,是人类智能研究的重要组成部分。BP神经网络作为目前应用较多的一种神经网络结构,具有良好的逼近性能,且结构简单,性能优良。但仍存在收敛速度慢,易陷入局部极小值的问题,通过附加动量项法、自适应学习率法、数据归一化法、遗传算法等,可大幅度改善其性能,可广泛应用于多输入多输出的非线性系统。 关键词:BP神经网络;BP算法;动量项;自适应学习率;归一化;遗传算法 1.绪论 1.1人工神经网络概述 人工神经网络(Artificial Neural Network),简称神经网络(NN),是由大量处理单元(神经元)组成的非线性大规模自适应系统。它具有自组织,自适应和自学习能力,以及具有非线性、非局域性,非定常性和非凸性等特点。它是在现代神经科学研究成果的基础上提出的,试图通过模拟大脑神经网络处理,记忆信息的方式设计一种新的机器使之具有人脑那样的信息处理能力。 神经网络作为计算智能与控制的重要分支,在控制领域具有如下优点: 1)能逼近任意L2范数上的非线性函数; 2)信息分布式存储与处理,鲁棒性和容错性强; 3)便于处理多输入多输出问题; 4)具有实现高速并行计算的潜力;

5)具有学习能力,对环境变化具有自适应性,对模型依赖性不强,主要用于解决非线性系统的控制问题。 同时,神经网络控制在多种控制结构中得到应用,如PID控制、模型参考自适应控制、前馈反馈控制、内模控制、逆系统控制、预测控制等。 目前神经网络的研究主要集中在三个方面:理论研究、实现技术研究、应用研究。 1.2 BP神经网络概述 BP神经网络是1986年由Rumelhart和McClelland一同提出的一种多层前馈神经网络。该网络采用BP算法——一种误差反向传播(Back Propagation)算法,其方法是依据负梯度下降方向迭代调整网络的权值和阀值以实现训练误差目标函数的最小化。 由于BP神经网络在实际应用中存在着收敛速度慢、网络结构难以确定、容易陷入局部极小值、泛化能力不强的缺陷,近年来,许多学者为满足实际应用中需要提出了许多改进方法,在网络自身性能的改善方面做了大量而有实际意义的工作,并且在BP神经网络的理论方面的研究和实际问题上应用也取得了丰硕的成果。对BP神经网络的理论研究,概括起来大致分为三个方面:改进激励函数,权值选取优化和网络拓扑结构。 1.3本文研究内容 本文从神经网络出发,研究其中应用最为广泛的BP神经网络模型,分析其缺点和不足,提出改进措施,并探讨其应用。具体研究内

4.1.1人工神经网络三要素 人工神经网络是对生物神经系统的某种抽象、简化与模拟,是由许多并行互联的相同神经元模型组成。网络的信息处理由神经元之间的相互作用来实现;知识与信息存储在处理单元相互间的物理连接上;网络的学习和识别决定于各神经元连接权系数的动态演化过程。一个神经网络模型描述了一个网络如何将它的输入矢量转化为输出矢量的过程。通常,神经网络模型由网络模型的神经元特性、拓补结构和学习或训练规则三个要素确定。 一、神经元特性 作为神经网络基本单元的神经元模型也有其三个基本要素:l)一组连接权;2)一个求和单元:3)一个非线性激励函数。神经元是神经网络的基本处理单元,它一般是多输入单输出的非线性器件,其结构模型如图4一1所示。 式中j x (1,2,,)j p =???为输入信号, kj w (1,2,,)j p =???为神经元j 到神经元k 的连接权值,1p k kj j j u w x ==∑为线性组合结果,k θ为阈值。?为神经元激励函数,k y 为神经元的输出。 1. 激活函数 (Activation Functions) (1) 线性激活函数 x x purelin x f ==)()( (2) 硬限幅激活函数 ???<≥==0 ,00 ,1)lim()(x x x hard x f x

(3)对称的硬限幅激活函数 ???<-≥==0 ,10 ,1 )(lim )(x x x s hard x f (4)Sigmoid (S 形)激活函数 x e x sig x f λ-+==11)(log )(,0>λ 具有平滑和渐进性,并保持单调性,参数λ可控制其斜率。 )(x f 性质:? ??+∞→→无穷阶光滑λ ),lim()(x hard x f 二、神经网络结构 神经网络由大量并行分布的神经元广泛互联构成。网络的拓补结构是神经网络的一个重要特征,从连接方式看神经网络结构主要有两种。 (l)前馈型网络 前馈网络中神经元是分层排列的,每个神经元只与前一层的神经元相连。输 入层和输出层与外界相连,其它中间层称为隐层,隐层可为一层或多层。除了通 用的前馈网络外,还存在其变型,如前馈内层互连网络,网络在同一层内相互连 接,互相制约,从外部看还是一个前馈网络,很多自组织网络存在此种结构。 单隐层网络:常用;三、四层网络:特殊的目的;四层以上网络:罕见。 (2)反馈型网络 所有节点都是计算单元,也可接受输入,并向外界输出。网络的任意两个神经元之间都可能存在连接,信息在各神经元之间反复传递至趋于某一稳定状态。 三、神经网络的学习方法 1、学习方式 网络的学习可以分为3种基本类型:1)网络权值的学习;2)网络节点函数的 学习;3)网络拓补结构的学习。其中,网络权值的学习最为简单,目前大多数文 献中所谓的网络学习指的就是网络权值的学习。下文的介绍也围绕网络权值的 学习进行。学习的过程就是按某种预定的度量通过调节自身参数(如权值)来达到 性能改养的过程。学习方式有三种: (l)监督学习(有教师学习) 输入层 隐层 输出层 …… …… ……

1.钢结构加工制作 1.1.常用加工制作设备 1.1.1.焊接H型钢加工设备 数控火焰切割机[QSH40];有效切割厚度:6-100mm;有效切割宽度:3200mm;切割速度:50- 1000mm/min。 H/T型钢焊接机龙门焊H型钢翼缘矫正机

H型钢组立机电渣焊机 H型钢焊接机[MHT];焊接速度:240- 2400MM/MIN;腹板高度:140-2000mm;翼板宽 度:140-800mm。 H型钢翼缘矫正机[YTJ-60];翼板厚度:≤ 60mm;腹板高度:≥350mm;翼板宽度: 200mm-1000mm;矫正速度:6.3m/min。 1.1. 2.箱型钢加工设备

箱型埋弧焊接机;焊接速度:240- 2400mm/min;腹板高度:140-2000mm;翼板宽 度:140-2000mm; 悬臂式电渣焊机[JZD150A];适用工件截面: 300~1500mm;适用板材厚度:14~65mm。 U型、箱型一体机龙门式移动平面钻床 1.1.3.直缝焊管圆管加工设备

三辊卷板机;最小卷管直径: 800mm;最大卷 管板厚:120mm。 悬臂式全自动埋弧焊;焊接速度:240— 2400mm/min上下行程:800mm;左右行程: 500mm;焊丝尺寸:3.2—5mm。 1.1.4.管桁架生产线 相贯线切割机[LMGQ/P-A];切割管子外径范围:60mm~600mm;工件长度:600~12000mm。 1.1.5.无缝钢管加工设备 无缝矩形管加工设备机床

无缝圆管加工设备机床1.1.6.螺旋管加工设备

1.1.7.钢筋桁架楼承板生产线 放线架钢筋调直机机

BP神经网络信息融合技术中的应用 宋志英 辽宁工程技术大学测绘与地理科学学院,辽宁阜新(123000) 摘要:主要介绍了组合导航系统中GPS/INS(卫星导航定位/惯性系统制导)中的传感器信息融合方法,并提出了多源图像融合制导的思想与方法.本文指出比较有应用前景的信息融合研究方法是基于模糊逻辑、小波分析等方法。为此提出了引入Elman神经网络,描述了它的状态估计的设计方法。,进而用Matlab程序实现神经网络的训练过程。 关键词:多传感器;组合导航;信息融合;BP神经网络;卡尔曼滤波 1. 引言 全球定位系统(GPS)是一种高精度的全球实时的卫星导航定位系统, 它是当前应用最为广泛的卫星导航定位系统,使用方便、成本低廉,操作简便。但它存在着动态响应能力较差, 易受外界信号干扰、动态环境中可靠性差以及数据输出频率低及等及完善性较差的缺点。惯性导航系统(INS)由于工作的完全自主性,成为目前航行体上的主要导航设备之一,但存在着误差会随时间增大的缺点。为克服这些缺点,根据INS和GPS导航功能优势互补的特点,以适当的方法将两者组合起来提高系统的整体导航精度。GPS接收机在惯导位置和速度信息的辅助下,也将改善捕获、跟踪和再捕获的能力,并在卫星分布条件差或可见星少的情况下导航精度不致下降过大[1]。由于优点显著,GPS/INS组合系统被一致认为是飞行载体最理想的组合导航系统,GPS和INS数据融合算法中最常用的工具是卡尔曼滤波器[2],但是在使用卡尔曼滤波器时,尚有许多问题有待解决,如处理速度等。本文设计了实现车载GPS/INS组合导航系统最优综合的联合卡尔曼滤波器,并给出了滤波算法。提出了一种自适应联合卡尔曼滤波器结构及其算法,并应用于GPS/INS组合导航系统的最优综合校正中。因此,将GPS的长期高精度特性与INS的短期高精度特性进行有机结合,使两者的组合起到优势互补的作用。 2. INS/GPS组合系统模糊推理规则 由于GPS/INS的系统误差以及外界干扰的影响,因此,组合导航系统模型的系统误差和量测噪声事先是未知的或难以精确确定的信号。模糊推理(如图1所示)是以模糊逻辑为基础模拟人的思维并进行知识处理,模糊系统的隶属度函数等设计参数依靠经验进行。通常,卡尔曼滤波器用于解决导航系统的参数估计问题,它可以从被噪声污染的观测值中实时地估计出系统的状态。但是,实际系统是一个复杂的非线性系统模型,难以用精确的数学模型描述。由于惯性元器件、GPS接收机输出数据误差的不确定性,系统噪声和量测噪声是事先未知或不能确定的信号。因此,使用卡尔曼滤波进行导航参数的估计时,系统参数估计的精度及可靠性受到很大的限制。模糊聚类多用于图像融合与图像边缘检测.聚类是按照一定的标准对用一组参数表示的样本群进行分类的过程.其中比较常用的是模糊c-均值聚类算法.模糊聚类的过程,也就是样本中的特征参数被融合、样本按标准被分类的过程.当选定一种相似性度量、差别检验以及停止规则后,就可得到一种特定的聚类分析算法.一般来讲,相似性度量的定义、聚类算法的选择、数据的排列方位,甚至输入数据的次序,都可能影响聚类的结果.因此,在使用聚类分析法时,应对其有效性和可重复性进行分析,已形成有意义的属性聚类结果.

不合格设备生产流程图 原材料、外协加工件 合 件不合格格 入厂检验 合格 仓库 原材料 切割打磨 合格 合 格 成 设备装配部设备安装部 品 出厂检验客户安装使用 设备生产流程 1、原材料的入库 根据购买计划购进的原材料和外协加工件,经质检实验室检测合格后办理入库手续。检测配件质量、外形尺寸、材质达到生产设备配件要求。 2、装配部流程 (一)按照生产计划填写领料单,领用配件有装配工保管安装使用。 (二)打开机箱盖进行设备组装 1、电磁阀的组装:将840电磁阀与210mm波纹管连接、波纹管要用橡胶密封垫、锥形橡胶密封垫、用15/24外丝对接、用16变24的对丝对接、安装喷

嘴。注意各部件连接时的先后顺序,喷嘴安装时要滴加螺纹胶密封。 2、电磁阀与机箱的连接:电磁阀用M4*6的不锈钢螺丝连接,注意波纹管的弯曲角度。(注意;锥形密封垫要卡入中间隔板,保证机箱燃烧室与控制室隔离) 3、燃烧杯的组装:注意弹垫的位置,组装时避免波纹管扭曲受力。 4、风压测压口宝塔件的安装(确保螺纹处滴有5071密封胶,螺纹上到底) 5、指示灯的安装,注:螺纹为塑料材质,注意用力不要过猛,橡胶密封圈要加在机箱外延。 6、隔热陶瓷垫与观火孔的安装,观火孔安装时要注意从一边慢慢的往机箱观火孔槽上卡,确保安装的牢固和美观。隔热陶瓷垫在安装时要提前折好,注意用力不要过大,以免对陶瓷垫产生破损。 7、点火针的安装。采用M4的不锈钢螺丝安装,机壳与点火针之间加装陶瓷隔热垫,注意点火针的安装方向。 8、风压开关的安装。采用M4*10的不锈钢螺丝连接,注意安装的方向,风压开关一般调至40pa。 9、风压测压管的安装。长度不宜过长,长度控制在风压管不受力,不打结为准。 10、橡胶密封垫的粘贴。保证机箱盖与机箱接触的部位都要黏贴上,以保证燃烧控制室的密封环境。 11、机箱下侧盖的安装,用M4的不锈钢螺丝连接,确保螺丝上紧。 12、机箱组线的连接,注意每根线的接法和位置,注意接线方式按接线图 13、控制板的安装,将控制板放人注塑方盒内,将组线与控制板连接,注意插口的方向,确保地线连接良好,用螺丝固定好盒盖后安装在机箱内。 14、机箱上盖的安装,用M4的不锈钢螺丝连接,确保螺丝上紧。 (三)设备组装完成的检测 外观检查 1、机箱外壳表面涂层应光滑,色泽均匀,不应有斑痕,划痕及凹陷。 2、各焊接螺帽无松动,连接尺寸符合设计要求。 启动设备检验 1、不开燃气阀进行启动检验: (1)将风压开关调整至40pa。

机组生产工艺流程 一、主机生产工艺流程图: 具体生产步骤: 1、原材料采购 公司原材料采购有严格执行的工作流程:专业采购人员首先收集原材料的消耗需求,将必备的原料质量标准和采购数量向《合格供应商名录》范围内的同类货品供应商广泛发出询价议价通知,然后将收集到的各供应商提交原材料样本送检,筛选出合格样本,再进行具体的询价议价后,提交采购决策人进行采购决策;组织安排与供应商的合同,并封存样本作为合同执行的辅助材料;货物到厂后,经过检测和化验合格后,组织入库,而对检验不合格的原材料一律不得使用,由采购人员安排退货。公司还在制度中严格规定,财务部门安排付款时,必须收到合格的检化验单,否则不得支付货款;生产部门必须取得合格的检化验单后,才能将相关货品投入生产使用。 2、进货检验

原材料到厂后,由厂内熟悉产品性能的技术人员对其进行严格检验,保证进厂的产品均为合格产品。 3、下料 根据生产要求合理安排人手,产线工人根据设计图纸要求,进行下料作业。4、焊接成型 由持有上岗证的技术工人对下料进行焊接。焊接要求:铜管之间的焊接使用铜焊丝,铜件与钢件、钢件与钢件的焊接使用高银焊丝,氧气与乙炔共同燃烧基础上,在150°高温下,使焊丝溶解成液态,在铜件与铜件及铜件与钢件或钢件与钢件的焊口处焊接,要求不出现焊眼,确保其气密性。 5、打压试漏 打压试漏:为确保空调主机的内循环系统的密闭性,需使用打压设备以氮气为媒介打压试漏。用压力表为测压工具,根据不同机型而达到不同的压力标准。在保压24小时后,应无降压情况。 6、抽真空 抽真空:在完全封闭,内部系统畅通的情况下,使用真空泵抽机组内空气,根据真空表指示,30分钟,30Pa以下, 确保主机内处于真空状态。 7、冷媒充注 冷媒充注:在作抽真空工序后,充注氟。在充注前确保主机各个阀门完全关闭。充注过程中,氟瓶高于主机机身,而且确保氟瓶、充注管、和主机的连接无漏气现象。 8、整机调试 8.1空负荷试车