随机过程理论在语音识别中的应用

第一章语音识别总述

1.1语音识别技术简介

语音识别技术就是让机器通过识别和理解过程,把语音信号转变为相应的文本或命令的技术。在当下流行的即时通讯软件(如:微信、QQ等)里,语音识别技术得到了非常广泛的应用。当对方发来一段语音信息而自己不方便收听时便可以使用语音转化功能将语音信息转化成文字信息。此外,在许多输入法(如:讯飞输入法)中也可以使用语音输入功能。用户只需要对着麦克风说话,输入法便可以将语音转换为文字填入输入框,在方便用户的同时也提高了文字输入效率。

语音识别涉及的领域包括:数字信号处理、声学、语音学、计算机科学、心理学、人工智能等,是一门涵盖多个学科领域的交叉科学技术。

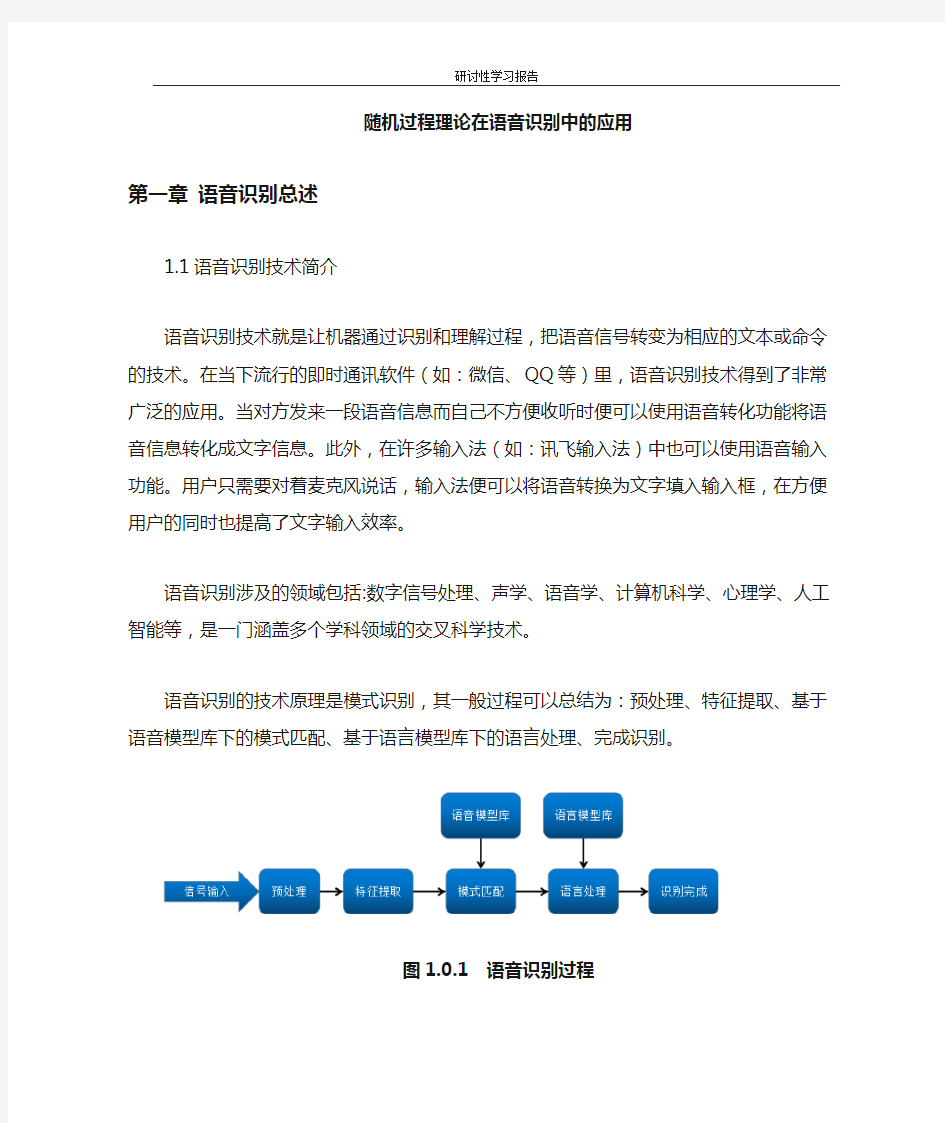

语音识别的技术原理是模式识别,其一般过程可以总结为:预处理、特征提取、基于语音模型库下的模式匹配、基于语言模型库下的语言处理、完成识别。

图1.0.1 语音识别过程

第二章预处理

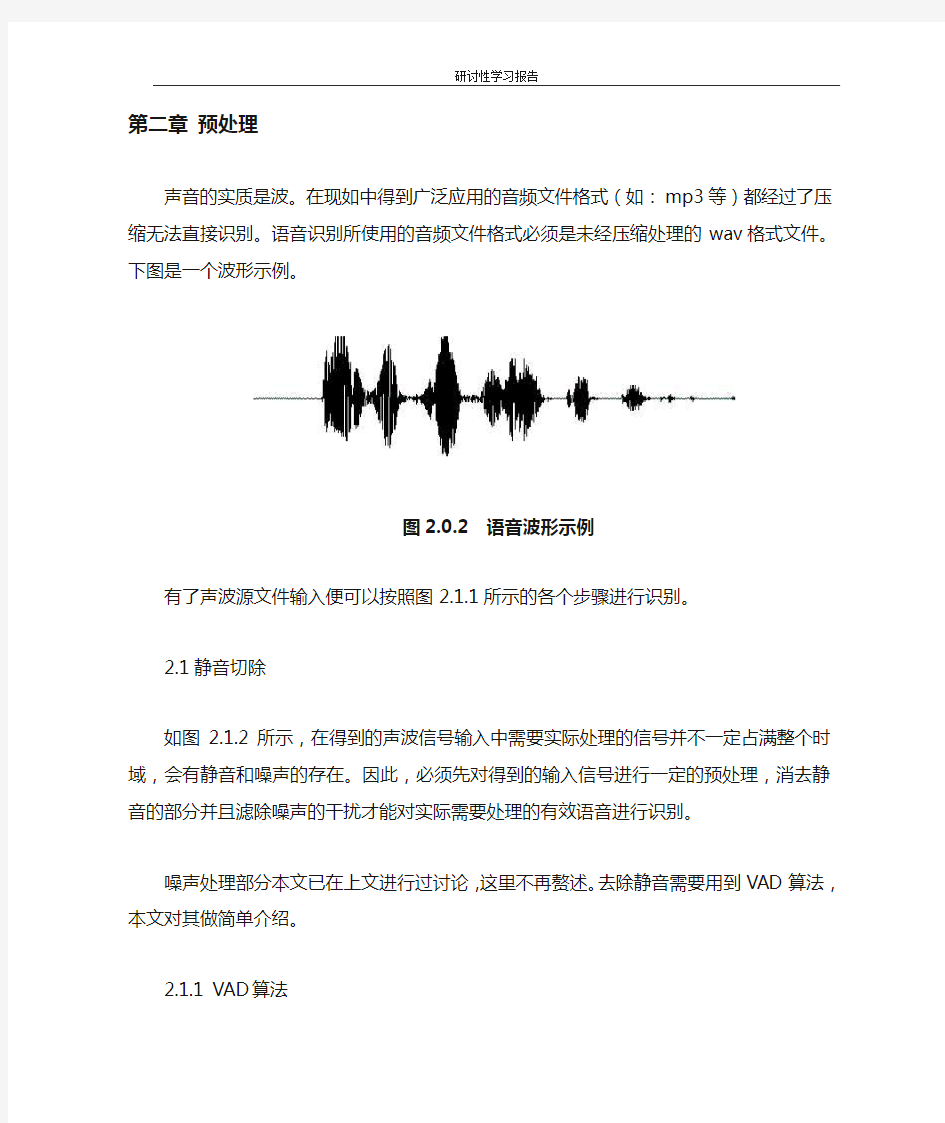

声音的实质是波。在现如中得到广泛应用的音频文件格式(如:mp3等)都经过了压缩无法直接识别。语音识别所使用的音频文件格式必须是未经压缩处理的wav格式文件。下图是一个波形示例。

图2.0.2 语音波形示例

有了声波源文件输入便可以按照图2.1.1所示的各个步骤进行识别。

2.1静音切除

如图2.1.2所示,在得到的声波信号输入中需要实际处理的信号并不一定占满整个时域,会有静音和噪声的存在。因此,必须先对得到的输入信号进行一定的预处理,消去静音的部分并且滤除噪声的干扰才能对实际需要处理的有效语音进行识别。

噪声处理部分本文已在上文进行过讨论,这里不再赘述。去除静音需要用到V AD算法,本文对其做简单介绍。

2.1.1 V AD算法

V AD算法全称为V oice Activity Detection,又称语音边界检测。其可实现的功能有对语音信号进行打断、去除语音信号中的静音部分从而获取有效语音,还可以去除一部分噪声对后续语音识别过程造成的干扰。V AD主要是对输入语音信号的一些时域或频域特征判断其是否属于静音部分。本文只对这些参数做简要介绍,具体算法不属于本文重点因而不在此做细致讨论。

2.1.2时域参数

时域参数是通过对输入信号在时域上的特征参量进行区分。在信噪比较高的环境下使用时域参数进行区分效果显著。

1.相关性分析

通过对足够短的时间范围内的语音信号进行相关性检测可以初步判定该时间范围内的信号是否属于静音部分。在实际应用中,静音的部分实际上会混有各种各样的噪声,因此并非绝对意义上静音。噪声在各个时间范围内的相关性比较低,而人说话的语音相关性则比较强。因此,在高信噪比的条件下区分成功率很

高。然而,由于噪声多种多样,因此相关性分析只适用于区分小部分噪声与语音,这是其局限性所在。

2.时域能量

静音部分的噪声能量相较于有效语音能量而言要少得多,因此可以通过比较短时间范围内的输入信号能量来判定该段信号是否输入静音部分。而在实际生活中,会出现高能量噪声的情况,此时再用时域能量参数就显得爱莫能助。.

3.

2.1.2频域参数

频域参数的抗噪性能要优于时域参数,但是由于需要用到傅立叶变换等变换方法进行分析域转换,因此相应的计算复杂度较高,花费时间也较长。

1.谱熵

熵本是源于热力学的参数,用于描述系统的混乱度。在信息论中用于描述信息源的不确定性。

图2.1.1 噪声谱图2.1.2语音谱在实际应用中,噪声谱较为平坦,谱熵较大。而语音能量集中在低频段,谱熵较小,因此可通过谱熵来判断信号属于噪声还是有效语音。谱熵的可靠性不会受信号大小的影响,其大小只与信噪比有关。

2.自适应子带

即使在很低的信噪比下,语音帧仍然具有较高信噪比的子带,而噪声帧却没有。因此可以根据每帧信号的最小频带所占的该帧总能量的概率来自适应选择子带的多少。

2.2分帧

2.2.1分帧简介

如图2.0.2的有效语音信号波形在时域上是无法对其进行识别的的。因此必须算出有效语音信号在频域上的分布情况,因而需要对有效语音信号做傅立叶变换从而得到其在频域上的分布情况。

图2.2.1有效语音信号波形图

傅立叶变换的前提是输入信号是平稳的,而如图2.2.1所示的有效语音信号的前三分之一和后三分之二明显不一样,这是由于发音者的发音姿态变换而导致的,所以整体来看语音信号不平稳。但如果取适量小的时间范围内(如图中矩形框圈出的时间范围),仅在该时间范围内做分析的话,发声者的发声姿态基本不变,语音信号就可以看成平稳的,就可以截取出来做傅立叶变换了。将有效语音信号的截取成一帧一帧的平稳信号的过程就称为分帧。

2.2.1分帧时长

由上述的讨论可知,通过分帧操作所得到的每一帧信号需满足如下两个条件:

1.它必须足够短来保证帧内信号是平稳的。上文提到过,发音者发音姿态的变化是导致信号不平稳的原因,所以在一帧的期间内发音姿态不能有明显变化。即一帧的长度应当小于一个音素的长度。正常语速下,音素的持续时间大约是 50至200 ms,所以帧长一般取为小于 50 ms。

2.每一帧信号又必须包括足够多的振动周期,因为傅立叶变换是对信号的频域进行分析,只有每一个频率成分在时域重复振动足够多次才能分析频率。语音的基频,男声在 100 Hz左右,女声在 200 Hz左右,换算成周期就是 10 ms和5 ms。既然一帧要包含多个周期,所以一般取至少 20 ms。

通过以上的讨论,帧长一般取为 20 至50 ms,20、25、30、40、50 都是比较常用的数值。

2.3加窗

为了提高傅立叶变换所得频谱的分辨率,取出来的一帧信号,在做傅立叶变换之前,要先进行加窗的操作,即与一个窗函数相乘,如图2.3.1所示。

图2.3.1(a) 原信号图2.3.1(b) 汉明窗函数

图2.3.1(c) 加窗处理结果

加窗的目的是让一帧信号的幅度在两端渐变到 0从而提高傅立叶变换结果频谱的分辨率。

由加窗处理过程可以看出,信号两端的部分被逐渐削弱至0,因此在该帧信号中无法计入频谱。在实际处理时,往往通过不同帧之间进行重叠来弥补加窗处理带来的损失。

图2.3.2 重叠分帧

如图2.2.1所示,每一帧信号时长为25ms,以10ms作为帧移取下一段信号。由此第一帧信号后15ms的波形便会在下一帧信号前15ms中出现。

2.4傅立叶变换

对一帧信号做傅立叶变换,得到信号频谱如下:

图2.4.1 信号频谱图

如图 2.4.1,从信号频谱图中可知该帧语音信号呈现出的精细结构和包络两

种模式。平滑连接每一个精细结构的小峰便得到包络。又由包络可以得到共振峰,

图中能看出四个,分别在 500、1700、2450、3800 Hz 附近。它代表了发音者的

口型,对此特征进行提取便可只发音者发出的是哪个音。

第三章 声学特征提取

人通过声道产生声音,声道的形状决定了发出怎样的声音。声道的形状包括

舌头,牙齿等。如果我们可以准确的知道这个形状,那么我们就可以对产生的音

素进行准确的描述。声道的形状在语音短时可以由功率谱的包络中显示出来。因

此,准确描述这一包络的特征就是声学特征识别步骤的主要功能。

接收端接收到的语音信号经过上文的预处理以后便得到有效的语音信号,对

每一帧波形进行声学特征提取便可以得到一个多维向量。这个向量便包含了一帧

波形的内容信息,为后续的进一步识别做准备。

本文主要介绍使用最多的MFCC 声学特征。

3.1 MFCC 简介

MFCC (Mel Frequency Cepstrum Coefficient )特征是基于人耳对声音的敏感特

性而提出的。人耳听声音时,耳蜗相当于一组滤波器。当声音频率在1KHz 以下

时,人耳的感知能力与频率成线性关系,但在1KHz 以上时,人耳的感知能力与

声音频率更接近对数关系。这也就解释了为什么人耳对于低频声音的感知比高频

声音更敏感。

MFCC 是Mel 频率倒谱系数的缩写。Mel 频率是基于人耳听觉特性提出来的,其计算公式为:)700

1(log 259510f m +=它与Hz 频率成非线性对应关系。Mel 频率

倒谱系数(MFCC)则是利用它们之间的这种关系,计算得到的Hz 频谱特征。由于

Mel 频率与Hz 频率之间非线性的对应关系,使得MFCC 随着频率的提高,其计算

精度随之下降。因此,在应用中常常只使用低频MFCC ,而丢弃中高频MFCC 。

3.2MFCC 的一般过程

MFCC 特征提取的一般过程如下:

图3.2.1 MFCC 特征提取的一般过程

图中的分帧加窗以及FFT 已经在预处理部分中提到,这里不再赘述。

3.2.1 Mel 滤波器组

假设原信号经过预加重、分帧加窗后的DFT 为

N k e

n x k X N n N k j a ≤≤=∑-=-0,)()(102π

式中x(n)为输入的语音信号,N 表示傅立叶变换的点数。式中x(n)为输入

的语音信号,N 表示傅立叶变换的点数。

将能量谱通过一组Mel 尺度的三角形滤波器组,定义一个有M 个滤波器的滤

波器组(滤波器的个数和临界带的个数相近),采用的滤波器为三角滤波器,中

心频率为 。M 通常取22-26。各)(m f 之间的间隔随着m 值的减小而缩小,随着

m 值的增大而增宽,如图所示:

图3.2.2 Mel 频率滤波器组

三角滤波器的频率响应定义为:

式中:∑-==101

)(M m m k H

此处使用三角带通滤波器有两个目的:第一、使得到的频谱变得平滑,并且

可以去除谐波的干扰从而凸显出原语音信号的共振峰。因此,一段语音的音调并

不会由MFCC 特征表示出来。换句话说,语音信号的音调不会对MFCC 的参数产

生影响。第二、可以有效减少运算量。

计算每个滤波器组输出的对数能量为:

M m k H k X m s N k m a ≤≤=∑-=0],)(|)(|ln[)(1

02

经离散余弦变换(DCT )得到MFCC 系数:

L n M m n m s n C N m ,...,2,1,))5.0(cos(

)()(10=-=∑-=π

将上述的对数能量带入离散余弦变换,求出L 阶的Mel-scale Cepstrum 参数。

L 阶指MFCC 系数阶数,通常取12-16。这里M 是三角滤波器个数。

3.2.2 对数能量

语音信号的能量表现为音量的大小,每一帧信号的能量也是语音信号的一个

重要特征,而这个参数非常容易计算得到,因此,通常在已经得到的参数基础上

再加上一帧的对数能量。对数能量的定义为:

)(log 10E 10一帧内信号的平方和=

如此就使得每一帧语音信号特征向量又多了一个维度。在此阶段也可加入其

它语音特征。例如:音高、过零率以及共振峰等。

3.2.3 动态差分参数的提取(包括一阶差分和二阶差分)

标准的倒谱参数MFCC 只反映了语音参数的静态特性,语音的动态特性可

以用这些静态特征的差分谱来描述。实验证明:把动、静态特征结合起来才能有

效提高系统的识别性能。差分参数的计算可以采用下面的公式:

式中,t d 表示第t 个一阶差分;t C 表示第t 个倒谱系数;Q 表示倒谱系数的阶

数;K 表示一阶导数的时间差,可取1或2。将上式中结果再代入就可以得到二

阶差分的参数。

3.2.4 特征提取结果

总而言之,MFCC 的全部组成其实是:N 维MFCC 参数(N/3MFCC 系数+ N/3

一阶差分参数+ N/3二阶差分参数)+帧能量(此项可根据需求替换)

声音信号经过MFCC 特征提取后便可得到描述其内容信息特征的向量。为方

便后续说明,我们假设经过特征提取后每一帧的信号都变换为一个12维的向量,

并用色块颜色的深浅来表示向量值的大小。

图3.2.3 原波形

图3.2.4 信号声学特征图

第四章模式匹配

模式匹配也即是解码过程。它是对上文得到的经过处理的声音信号与已有的语音模型库进行匹配以达到识别的目的。经过特征识别,我们已经得到了描述声音内容信息特征的向量。接下来的解码过程就是在给定语音模型的情况下,找到最可能对应的发音的过程。

图4.0.1 语音识别全过程

本文主要介绍隐马尔科夫模型在模式匹配环节中的作用。

4.1马尔科夫模型与隐马尔科夫模型

按照维基百科的说法,到目前为止语音识别的技术都没有脱离隐马尔可夫模型框架。可见隐马尔科夫模型在语音识别中的重要性。

为了透彻阐述隐马尔科夫模型,有必要同时简单介绍一下马尔科夫模型与隐马尔科夫模型。

4.1.1 马尔科夫模型

马尔科夫模型通过研究事物发生以及相互转化的概率从而对未来事物的状态进行预测。在马尔科夫模型中,事物当前的状态只与上一个状态而与其它任何时候的状态均无关。用马尔科夫的一句富含哲理的话说:“过去发生的所有信息

都汇集在今天,而明天如何,只取决于今天,与历史再无关联。”

为加深理解,以预测天气为例。假设每天天气只有三种状态:晴天、雨天、

多云。若第一天为晴天,则第二天也为晴天的概率为0.5,为多云的概率为0.375,

为雨天的概率为0.125。同样也定义若第一天为雨天或多云,第二天为其它状态

的天气之间的转移概率。

图4.1.1 不同天气之间的转移概率

假设第一个观察天(即昨天)为晴天,并由此预测今天的天气情况。

到此,我们建立了一个一阶马尔科夫模型。它包含三个状态(即:晴天、多

云、雨天)、各个状态之间的转换概率(如图4.1.1所示)以及初始概率(即:

昨天的天气)晴天。

既然已知昨天为晴天,则初始晴天概率1

P、初始多云概率

初始晴天

(=

)

(=

初始雨天

)

P。

P、0

)

(=

初始多云

则据此预测今天的天气:

多云转晴天

初始多云

晴天转晴天

初始雨天

+

初始晴天

?

=雨天转晴天

P

P

P

P

P

P

?

今天晴天P

)

(

)

(

)

(

5.0

+

)

) )

?

(

(

(=

(

)

初始多云

多云转多云

=雨天转多云

晴天转多云

+

?

?

P

P

P

+

P

P

今天多云P

P

初始晴天

初始雨天

)

(

)

(

)

?

.0

(

375

)

)

(=

)

(

(

(

)

初始雨天

初始多云

多云转雨天

+

?

+

?

=雨天转雨天

P

P

P

?

P

P

今天雨天P

P

初始晴天

晴天转雨天

(

)

(

)

25

.1

)

(

)

(

)

(

)

)

(

(=

由此可知,今天为晴天的概率最大。

既然已知今天的天气概率情况,又可以据此预测明天的天气情况:

多云转晴天

今天多云

今天雨天

=雨天转晴天

?

+

?

晴天转晴天

+

P

P

P

P

P

明天晴天P

P

今天晴天

(

)

(

)

(

)

375

.0

)

(

)

(= (

)

)

(

?

今天雨天

多云转多云

今天多云

=雨天转多云

?

?

+

今天晴天

明天多云P

P

P

28125

P

P

P

P

+

晴天转多云

)

(

(

(

)

.0

?

)

)

(

(

(=

)

)

(

)

多云转雨天

?

今天雨天

今天多云

?

晴天转雨天

+

=雨天转雨天

P

P

P

+

P

P

明天雨天P

P

今天晴天

(

)

(

)

(

)

34375

.0

?

(

)

(= (

)

)

(

)

以此类推,后天的天气情况只与明天有关而与昨天,今天都无关。

4.1.2 隐马尔科夫(HMM)模型

在隐马尔科夫模型中,必备的三个要素分别初始概率、转移概率、输出概率。

其中,初始概率与转移概率的含义与马尔科夫模型中相同,输出概率是指状态值

映射到对应观测值的概率。例如:若当前的天气情况不能直接获得,只能通过测

量空气湿度间接获得。同样举预测天气的例子,定义以下输出概率。

图4.1.2不同天气之间对应空气湿度的输出概率

若观测到连续三天,空气的潮湿程度分别为干燥,干燥,潮湿,则这三天最

有可能是哪种天气情况。这里的隐马尔科夫链:

P(干燥、干燥、潮湿|HMM)=P(干燥、干燥、潮湿|晴天、晴天、晴天)+P(干燥、

干燥、潮湿|晴天、晴天、多云)+P(干燥、干燥、潮湿|晴天、晴天、雨天)+P(干

燥、干燥、潮湿|晴天、多云、晴天)+……+P(干燥、干燥、潮湿|雨天、雨天、

雨天)。

采用穷举的办法可以找到概率最大的天气排序情况。这种由观测值推知状态

值的方法就是隐马尔科夫模型。它可以用来描述含有隐含位置参数的马尔科夫过

程。

4.2语音模型库

以中文为例进行后续说明。中文的发音由声母、韵母和整体认读音节组合而

成。因而将每一个声母,韵母,整体认读音节称作“音素”。每一个音素都有一定的发音规律,可以将这个发音实现经过特征提取后编算成计算机可存储的声学特征作为已知的语音模型库以方便后续的模式匹配。

除了音素的存储之外,语音模型库还存储了大量单字,单词,成语等语句元素所对应的语音输出概率。(例如:当接收到语音信号“sui ji”时,这个信号识别为“随即”二字的概率为0.3,识别为“随机”二字的概率为0.5)这类似于隐马尔科夫模型中状态值映射到观测值的输出概率。

4.3隐马尔科夫模型在模式匹配中的应用

在完成特征提取后,就可以对未知语音帧序列进行识别了。完成模式匹配识别有两个步骤:

(1)使用隐马尔科夫模型,构建一个状态量足够多的状态网络。

状态网络的搭建是由单词级别的网络展开成音素网络,再展开成状态网络。例如下图。

图4.3.1 状态路径

图中,以中文单词“随机”为例,将其拆分为音素“s”、“ui”、“j”、“i”,并由此生成对应的状态路径“S1->S2->S3->S4->S5->S6->S7->S8->S9->S10-> S11->S12”。

(2)从状态网络中寻找与声音最匹配的路径,即在所有可能的路径中选择一条概率最大的路径作为识别结果。这个要求可由相应的搜索算法(如:Viterbi 算法)满足。

本文着重阐述涉及隐马尔科夫模型的第一个步骤。

由于说话语速的不同,每一个音素的持续帧数也不相同,所以可能会出现一

帧或者几帧属于一个音素的情况,因此将音素又继续细分为更小的单位:状态。在隐马尔科夫模型,状态是隐变量,语音是观测值。

通过预处理、特征提取,我们将语音信号进行了分帧,并且也得到了用于描述每一帧语音信号声学特征的多维向量,这个过程的最终结果对应在隐马尔科夫模型中获得了观测值。

此后,将之前分割的每一帧语音片段的声学特征与语音模型库中已知音素的状态的声学特征进行对比。得到当前观测值对应隐变量的输出概率。

图4.3.2获得输出概率

图中,每个小竖条代表一帧。经过条件概论公式计算,发现图中箭头所指向的帧在状态S3上的概论最大,则将该帧识别为状态S3。以此类推识别每一帧信号的状态。

图4.3.3状态组成音素

通过计算概率最大的隐马尔科夫链便可以判定当前一帧或几帧最大概率属于哪一个状态,再由得到的状态凑成一个音素。

若干帧语音识别为一个状态(如图中的S1029状态、S124状态),每三个状态组合成一个音素(如:图中的ay音素),若干个音素组合成一个单词。由此看出只要知道每帧语音所对应的状态即可得到语音识别的结果。

第五章语言处理

语言处理部分没有过多涉及随机过程的相关内容,本文只进行简单介绍。

在实际应用中通常是在给定了根据语法、字典对马尔科夫模型进行连接后的搜索的网络(网络的每个节点可以是一个词组等)后,在所有可能的搜索路径中选择一条或多条最优(通常是最大后验概率)路径(字典中出现词组的词组串)作为识别结果。在一定的语法规则下,可以极大的减少隐马尔科夫模型的计算,提高准确度的同时减少时间,可谓是一举两得。

【参考文献】

[1]吴启晖,王金龙.基于谱熵的语音检测[J].电子与信息学报,2001,(10):989-993.

[2]李金宝,屈百达,刘立星,周小祥2006 - 中国自动化学会第21届青年学术年会

[3]MFCC简介https://https://www.doczj.com/doc/3515965428.html,/item/MFCC/18681230

[4]知乎作者:王赟https://https://www.doczj.com/doc/3515965428.html,/question/52093104/answer/225983811

[5]语音特征参数MFCC提取过程详解https://www.doczj.com/doc/3515965428.html,/jojozhangju/article/details/18678861

[6]CSDN博客GMM-HMM语音识别模型原理篇

语音识别技术综述

语音识别技术综述 电子信息工程2010级1班郭珊珊 【摘要】随着计算机处理能力的迅速提高,语音识别技术得到了飞速发展,该技术的发展和应用改变了人们的生产和生活方式,正逐步成为计算机处理技术中的关键技术。语音技术的应用已经成为一个具有竞争性的新兴高技术产业。 【关键词】语音识别;语音识别原理;语音识别发展;产品 语音识别是以语音为研究对象,通过语音信号处理和模式识别让机器人自动识别和理解人类口述的语言。语音识别技术就是让机器通过识别和理解过程把语音信号转变为相应的命令或文本的高新技术。 1 语音识别的原理 语音识别系统本质是一种模式识别系统,包括特征提取、模式匹配、参考模式库等三个基本单位元。未知语音经过话筒变换成电信号后加载识

别系统的输入端,首先经过预处理,再根据人的语音特点建立语音模型,对输入的语音信号进行分析,并抽取所需特征,在此基础上建立语音识别所需的模板。 计算机在识别过程中要根据语音识别的模型,将计算机中存放的语音模板与输入的语音信号的特征进行比较,根据一定的搜索和匹配策略,找出一系列最优的与输入语音匹配的模板。然后根据此模板的定义,通过查表可给出计算机的识别结果。这种最优的结果与特征的选择、语音模型的好坏、模板是否准确都有直接的关系。 2 语音识别系统的分类 语音识别系统可以根据对输入语音的限制加以分类。 2.1从说话者与识别系统的相关性考虑 可以将识别系统分为3类:(1)特定人语音识别系统:仅考虑对于专人的话音进行识别;(2)非特定人语音系统:识别的语音与人无关,通常要用大量不同人的语音数据库对识

别系统进行学习;(3)多人的识别系统:通常能识别一组人的语音,或者成为特定组语音识别系统,该系统仅要求对要识别的那组人的语音进行训练。 2.2从说话的方式考虑 也可以将识别系统分为3类:(1)孤立词语音识别系统:孤立词识别系统要求输入每个词后要停顿;(2)连接词语音识别系统:连接词输入系统要求对每个词都清楚发音,一些连音现象开始出现;(3)连续语音识别系统:连续语音输入是自然流利的连续语音输入,大量连音和变音会出现。 2.3从识别系统的词汇量大小考虑 也可以将识别系统分为3类:(1)小词汇量语音识别系统。通常包括几十个词的语音识别系统。(2)中等词汇量的语音识别系统。通常包括几百个词到上千个词的识别系统。(3)大词汇量语音识别系统。通常包括几千到几万个词的语音识别系统。随着计算机与数字信号处理器运算能力以及识别系统精度的提高,识别

语音识别系统实验报告 专业班级:信息安全 学号: 姓名:

目录 一、设计任务及要求 (1) 二、语音识别的简单介绍 2.1语者识别的概念 (2) 2.2特征参数的提取 (3) 2.3用矢量量化聚类法生成码本 (3) 2.4VQ的说话人识别 (4) 三、算法程序分析 3.1函数关系 (4) 3.2代码说明 (5) 3.2.1函数mfcc (5) 3.2.2函数disteu (5) 3.2.3函数vqlbg (6)

3.2.4函数test (6) 3.2.5函数testDB (7) 3.2.6 函数train (8) 3.2.7函数melfb (8) 四、演示分析 (9) 五、心得体会 (11) 附:GUI程序代码 (12) 一、设计任务及要求 实现语音识别功能。 二、语音识别的简单介绍

基于VQ的说话人识别系统,矢量量化起着双重作用。在训练阶段,把每一个说话者所提取的特征参数进行分类,产生不同码字所组成的码本。在识别(匹配)阶段,我们用VQ方法计算平均失真测度(本系统在计算距离d时,采用欧氏距离测度),从而判断说话人是谁。 语音识别系统结构框图如图1所示。 图1 语音识别系统结构框图 2.1语者识别的概念 语者识别就是根据说话人的语音信号来判别说话人的身份。语音是人的自然属性之一,由于说话人发音器官的生理差异以及后天形成的行为差异,每个人的语音都带有强烈的个人色彩,这就使得通过分析语音信号来识别说话人成为可能。用语音来鉴别说话人的身份有着许多独特的优点,如语音是人的固有的特征,不会丢失或遗忘;语音信号的采集方便,系统设备成本低;利用电话网络还可实现远程客户服务等。因此,近几年来,说话人识别越来越多的受到人们的重视。与其他生物识别技术如指纹识别、手形识别等相比较,说话人识别不仅使用方便,而且属于非接触性,容易被用户接受,并且在已有的各种生物特征识别技术中,

中国中文信息学会第七次全国会员代表大会 暨学会成立30周年学术会议 语音识别发展现状与展望中科院自动化研究所徐波 2011年12月4日

报告提纲 ?语音识别技术现状及态势?语音识别技术的行业应用?语音识别技术研究方向?结论与展望

2010年始语音识别重新成为产业热点?移动互联网的兴起成为ASR最重要的应用环境。在Google引领下,互联网、通信公司纷纷把语音识别作为重要研究方向 –Android系统内嵌语音识别技术,Google语音 翻译等; –iPhone4S 上的Siri软件; –百度、腾讯、盛大、华为等都进军语音识别领 域; –我国语音技术领军企业讯飞2010年推出语音云识别、讯飞口讯 –已有的QQ2011版语音输入等等

成熟度分析-技术成熟度曲线 ?美国市场调查咨询公司Gartner于2011年7月发布《2011新兴技术成熟度曲线》报告:

成熟度分析-新兴技术优先矩阵?Gartner评出了2011年具有变革作用的技术,包括语音识别、语音翻译、自然语言问答等。其中语音翻译和自然语言问答有望在5-10年内获得大幅利用,而语音识别有望在2-5年内获得大幅利用;

三十年语音识别技术发展 ---特征提取与知识方面?MFCC,PLP,CMS,RASTA,VTLN;?HLDA, fMPE,neural net-based features ?前端优化 –融入更多特征信息(MLP、TrapNN、Bottle Neck Features等) ?特征很大特点有些是跟模型的训练算法相匹配?大规模FSN图表示,把各种知识源集中在一起–bigram vs. 4-gram, within word dependencies vs. cross-word

目前主流的语音识别技术是基于统计模式识别的基本理论。一个完整的语音识别系统可大致分为三部分: (1)语音特征提取: (2)声学模型与模式匹配(识别算法) (3)语义理解:计算机对识别结果进行语法、语义分析。 语音识别技术,也被称为自动语音识别Automatic Speech Recognition,(ASR), 语音识别的发展简史 1952年AT& T Bell实验室实现了一个单一发音人孤立发音的十个英文数字的语音识别系统,到现在的人机语音交互。语音识别研究从二十世纪50年代开始到现在历半个多世纪的蓬勃发展,在这期间获得了巨大的进展。 现代语音识别技术研究重点包括即兴口语的识别和理解,自然口语对话,以及多语种的语音同声翻译。 语音识别应用的特点 1.语音识别系统必须覆盖的功能包括: (1)语音识别系统要对用户有益(希望它是能检测到的)。例如提高生产率,容易使用,更好的人机界面,或更自然的信息交流模式。 (2)语音识别系统要对用户“友好”。这种“友好”的含义是:用户在和系统进行语音对话时感到舒适;系统的语音提示既有帮助,又很亲近。 (3)语音识别系统必须有足够的精度 (4)语音识别系统要有实时处理能力;例如系统对用户询问的响应时间要很短。 2. 语音识别错误的处理 有以下四种方式可以处理这个问题。 (1)错误弱化法。这种处理仅仅花费用户很少一点时间,对用户几乎没什么其它不利影响。 (2)错误自检纠正法 系统利用已知任务的限制自动地检测并纠正错误。 (3)确认或多层次判定

(4)拒绝/转向人工座席。系统对其中通常较易导致系统识别错误的极少部分语音指令拒绝做出识别决定,而是将其转给人工座席。 在很多情况下,语音识别技术可以充分发挥出RFID的潜能: 1.积压产品、脱销产品 2.被废弃、被召回或已过期产品 3.回收的商品 4.促销产品 RFID系统在利用原有语音导向投资的情况下可以大大增加收益 语音识别技术在邮件分拣中的应用 现代化分拣设备在邮政上的应用大大提高了邮件处理的效率。但是,并不是所有的邮件都能上分拣机处理,那些需要人工处理的邮件成了邮政企业实现自动化的瓶颈。邮政使用人工标码技术以及先进的计算机软件 系统来处理不能上机的邮件,仍需要大量的劳动力。 由MailCode公司开发并准备申请专利的Spell-ItTM软件技术通过提高系统数据库能力的方式对语音识别自动化设备进行了革命性的变革。这种技术提供了无限的数据库能力,并且保证分拣速度不会因数据库的增大而减小。由各大语音引擎公司开发的系统还支持世界上的各种主要语言,这样,语音技术就成为世界性的产品。 以英语语音识别系统为例,系统建立了36个可识别字符26个字母加上0~9的10个数字,同时还建立了一套关键词。Spell-It软件使用这些字符来识别成千上万的口语词汇和无数的词语组合。 对于大公司的邮件收发中心来说,使用MailCode公司的Spell-It软件技术,分拣员实际上只需发出几个字符的音来找到和数据库中相对应的词。例如:碰到了寄给Joseph Schneider的邮件,操作员只需发出“J”、“S”、“C”和“H”几个音就可以得到准确的分拣信息。 姓名和邮箱编码:Jennifer Schroeder, 软件工程部;Joseph Schneider, 技术操作部;Josh Schriver, 技术操作部,因为这三个姓名全都符合(J,S,C,H)的发音标准。邮件中心的操作员知道邮件实际上是寄给Joseph Schneider的,就可以把邮件投入Joseph Schneide的信箱了。 邮局要把邮件按投递路线分发,分拣员必须熟悉长长的投递段列表以及各种各样的国际邮件投递信息。Spell-It技术把地址、投递路线等信息都存入了系统,这样就大大方便了分拣工作。 例如,有一件寄往Stonehollow 路2036号的邮件。使用语音识别技术,分拣员仅仅需要发出“2”、“0”、“S”、“T”和“O”几个音,如表2所示,数据库就会给出所有可能和这几

WT7010语音识别芯片 1.WT7010语音识别芯片概述 WT7010语音芯片内建8bit DSP核心,它能提供高分辨率ADC模拟采样和高质量的差分音频输入及麦克风输入,配备数学处理器以精确处理高压缩语音编解码或语音识别。该芯片有NAND接口和SPI总线用于外部存储器,提供2线串口用于连接其它设备或MCU。语音输入方面配备差分放大器用以麦克风输入以及AGC(自动增益控制)以便提供更好的SNR (信噪比)语音信号输入。芯片不单止嵌入前置放大也提供高品质的DAC和AB类扬声器放大器可以驱动输出高品质的声音。 2. WT7010功能特性 (1)内置8bitDSP核心,内部操作频率最高达48MHz(典型值:40MHz); (2)内置麦克风差分前置放大器,包括AGC功能,16级增益控制功能; (3)最长可记录10秒语音; (4)内置8欧姆/0.5瓦电路,可直接驱喇叭或蜂鸣器,拥有16级音量控制,PWM音频输出方式; (5)低电压复位功能(LVR); (6)内建看门狗(WDT); (7)具有24 I/O; (8)内建有NAND-Flash接口及SPI主从总线接口; (9)数字部分工作电压:2.4V ~ 3.6V;模拟部分工作电压2.4V~4.5V; (10)休眠电流<3.0uA WT7010语音识别芯片为广州唯创新研发特定语音识别芯片,还有未尽的各项其他功能正在加紧研发中,有需求时可接受定制。 3. 应用举例 在语音ic应用范围上,特定语音识别可以做简短语音识别系统,体现个性化服务,如: ? 语音电子锁; ? 智能家居开关,如WT系列智能语音识别开关; ? 特定报警器、家庭防盗报警器; ? 高级玩具,如鹦鹉学舌、TOM汤姆猫 4. 应用电路示例 (1)特定人语音识别(学习型) 特定人语音识别(学习型),是指预先对说话人进行语音输入,由语音识别芯片进行特征提取,然后进行存储。当语音输入时,语音芯片会将输入的声音特征和参考模块库内的特征进行匹配,匹配成功则输出成功值。 (a)示例电路

语音识别技术概述 摘要:本文简要介绍了语音识别技术理论基础及分类方式,所采用的关键技术以及所面临的困难与挑战,最后讨论了语音识别技术的发展前景和应用。 关键词:语音识别;特征提取;模式匹配;模型训练 Abstract:This text briefly introduces the theoretical basis of the speech-identification technology,its mode of classification,the adopted key technique and the difficulties and challenges it have to face.Then,the developing prospect ion and application of the speech-identification technology are discussed in the last part. Keywords:Speech identification;Character Pick-up;Mode matching;Model training 一、语音识别技术的理论基础 语音识别技术:是让机器通过识别和理解过程把语音信号转变为相应的文本或命令的高级技术。语音识别以语音为研究对象,它是语音信号处理的一个重要研究方向,是模式识别的一个分支,涉及到生理学、心理学、语言学、计算机科学以及信号处理等诸多领域,甚至还涉及到人的体态语言(如人在说话时的表情、手势等行为动作可帮助对方理解),其最终目标是实现人与机器进行自然语言通信。 不同的语音识别系统,虽然具体实现细节有所不同,但所采用的基本技术相似,一个典型语音识别系统主要包括特征提取技术、模式

语音识别是以语音为研究对象,通过语音信号处理和模式识别让机器自动识别和理解人类口述的语言。语音识别技术就是让机器通过识别和理解过程把语音信号转变为相应的文本或命令的高技术。语音识别是一门涉及面很广的交叉学科,它与声学、语音学、语言学、信息理论、模式识别理论以及神经生物学等学科都有非常密切的关系。语音识别技术正逐步成为计算机信息处理技术中的关键技术,语音技术的应用已经成为一个具有竞争性的新兴高技术产业。 1语音识别的基本原理 语音识别系统本质上是一种模式识别系统,包括特征提取、模式匹配、参考模式库等三个基本单元,它的基本结构如下图所示: 未知语音经过话筒变换成电信号后加在识别系统的输入端,首先经过预处理,再根据人的语音特点建立语音模型,对输入的语音信号进行分析,并抽取所需的特征,在此基础上建立语音识别所需的模板。而计算机在识别过程中要根据语音识别的模型,将计算机中存放的语音模板与输入的语音信号的特征进行比较,根据一定的搜索和匹配策略,找出一系列最优的与输入语音匹配的模板。然后根据此模板的定义,通过查表就可以给出计算机的识别结果。显然,这种最优的结果与特征的选择、语音模型的好坏、模板是否准确都有直接的关系。2语音识别的方法 目前具有代表性的语音识别方法主要有动态时间规整技术(DTW)、隐马尔可夫模型(HMM)、矢量量化(VQ)、人工神经网络(ANN)、支持向量机(SVM)等方法。 动态时间规整算法(Dynamic Time Warping,DTW)是在非特定人语音识别中一种简单有效的方法,该算法基于动态规划的思想,解决了发音长短不一的模板匹配问题,是语音识别技术中出现较早、较常用的一种算法。在应用DTW算法进行语音识别时,就是将已经预处理和分帧过的语音测试信号和参考语音模板进行比较以获取他们之间的相似度,按照某种距离测度得出两模板间的相似程度并选择最佳路径。 隐马尔可夫模型(HMM)是语音信号处理中的一种统计模型,是由Markov链演变来的,所以它是基于参数模型的统计识别方法。由于其模式库是通过反复训练形成的与训练输出信号吻合概率最大的最佳模型参数而不是预先储存好的模式样本,且其识别过程中运用待识别语音序列与HMM参数之间的似然概率达到最大值所对应的最佳状态序列作为识别输出,因此是较理想的语音识别模型。 矢量量化(Vector Quantization)是一种重要的信号压缩方法。与HMM相比,矢量量化主要适用于小词汇量、孤立词的语音识别中。其过程是将若干个语音信号波形或特征参数的标量数据组成一个矢量在多维空间进行整体量化。把矢量空间分成若干个小区域,每个小区域寻找一个代表矢量,量化时落入小区域的矢量就用这个代表矢量代替。矢量量化器的设计就是从大量信号样本中训练出好的码书,从实际效果出发寻找到好的失真测度定义公式,设计出最佳的矢量量化系统,用最少的搜索和计算失真的运算量实现最大可能的平均信噪比。在实际的应用过程中,人们还研究了多种降低复杂度的方法,包括无记忆的矢量量化、有记忆的矢量量化和模糊矢量量化方法。 人工神经网络(ANN)是20世纪80年代末期提出的一种新的语音识别方法。其本质上是一

关于语音识别的研究 网络工程专业网络C071班贾鸿姗 076040 摘要:语音识别技术的广泛应用 1前言: 语音识别技术也被称为自动语音识别 (ASR),其目标是将人类的语音中的词汇内容转换为计算机可读的输入,例如按键、二进制编码或者字符序列。与说话人识别及说话人确认不同,后者尝试识别或确认发出语音的说话人而非其中所包含的词汇内容。语音识别是一门交叉学科。近二十年来,语音识别技术取得显著进步,开始从实验室走向市场。人们预计,未来10年内,语音识别技术将进入工业、家电、通信、汽车电子、医疗、家庭服务、消费电子产品等各个领域。语音识别技术所涉及的领域包括:信号处理、模式识别、概率论和信息论、发声机理和听觉机理、人工智能等等。 早在计算机发明之前,自动语音识别的设想就已经被提上了议事日程,早期的声码器可被视作语音识别及合成的雏形。而1920年代生产的"Radio Rex"玩具狗可能是最早的语音识别器,当这只狗的名字被呼唤的时候,它能够从底座上弹出来。最早的基于电子计算机的语音识别系统是由AT&T 贝尔实验室开发的Audrey语音识别系统,它能够识别10个英文数字。其识别方法是跟踪语音中的共振峰。该系统得到了98%的正确率。。到1950年代末,伦敦学院(Colledge of London)的Denes 已经将语法概率加入语音识别中。 1960年代,人工神经网络被引入了语音识别。这一时代的两大突破是线性预测编码Linear Predictive Coding (LPC),及动态时间弯折Dynamic Time Warp技术。 语音识别技术的最重大突破是隐含马尔科夫模型Hidden Markov Model的应用。从Baum提出相关数学推理,经过Labiner等人的研究,卡内基梅隆大学的李开复最终实现了第一个基于隐马尔科夫模型的大词汇量语音识别系统Sphinx。。此后严格来说语音识别技术并没有脱离HMM框架。 尽管多年来研究人员一直尝试将“听写机”推广,语音识别技术在目前还无法支持无限领域,无限说话人的听写机应用。 2 正文 2.1应用领域 2.1.1.电话通信的语音拨号 特别是在中、高档移动电话上,现已普遍的具有语音拨号的功能。随着语音识别芯片的价格降低,普通电话上也将具备语音拨号的功能。 2.1.2.汽车的语音控制 由于在汽车的行驶过程中,驾驶员的手必须放在方向盘上,因此在汽车上拨打电话,需要使用具有语音拨号功能的免提电话通信方式。此外,对汽车的卫星导航定位系统(GPS)的操作,汽车空调、照明以及音响等设备的操作,同样也可以由语音来方便的控制。 工业控制及医疗领域。当操作人员的眼或手已经被占用的情况下,在增加控制操作时,最好的办法就是增加人与机器的语音交互界面。由语音对机器发出命令,机器用语音做出应答。 2.1.3数字助理 个人数字助理(Personal Digital Assistant,PDA)的语音交互界面。PDA的体积很小,人机界面一直是其应用和技术的瓶颈之一。由于在PDA上使用键盘非常不便,因此,现多采用手写体识别的方法输入和查询信息。但是,这种方法仍然让用户感到很不方便。现在业界一致认为,PDA的最佳人机交互界面是以语音作为传输介质的交互方法,并且已有少量应用。随着语音识别技术的提高,可以预见,在不久的将来,语音将成为PDA主要的人机交互界面。 智能玩具 通过语音识别技术,我们可以与智能娃娃对话,可以用语音对玩具发出命令,让其完成一些简单的任务,甚至可以制造具有语音锁功能的电子看门狗。智能玩具有很大的市场潜力,而其关键在

随机过程理论在语音识别中的应用 第一章语音识别总述 1.1语音识别技术简介 语音识别技术就是让机器通过识别和理解过程,把语音信号转变为相应的文本或命令的技术。在当下流行的即时通讯软件(如:微信、QQ等)里,语音识别技术得到了非常广泛的应用。当对方发来一段语音信息而自己不方便收听时便可以使用语音转化功能将语音信息转化成文字信息。此外,在许多输入法(如:讯飞输入法)中也可以使用语音输入功能。用户只需要对着麦克风说话,输入法便可以将语音转换为文字填入输入框,在方便用户的同时也提高了文字输入效率。 语音识别涉及的领域包括:数字信号处理、声学、语音学、计算机科学、心理学、人工智能等,是一门涵盖多个学科领域的交叉科学技术。 语音识别的技术原理是模式识别,其一般过程可以总结为:预处理、特征提取、基于语音模型库下的模式匹配、基于语言模型库下的语言处理、完成识别。 图1.0.1 语音识别过程 第二章预处理 声音的实质是波。在现如中得到广泛应用的音频文件格式(如:mp3等)都经过了压缩无法直接识别。语音识别所使用的音频文件格式必须是未经压缩处理的wav格式文件。下图是一个波形示例。

图2.0.2 语音波形示例 有了声波源文件输入便可以按照图2.1.1所示的各个步骤进行识别。 2.1静音切除 如图2.1.2所示,在得到的声波信号输入中需要实际处理的信号并不一定占满整个时域,会有静音和噪声的存在。因此,必须先对得到的输入信号进行一定的预处理,消去静音的部分并且滤除噪声的干扰才能对实际需要处理的有效语音进行识别。 噪声处理部分本文已在上文进行过讨论,这里不再赘述。去除静音需要用到V AD算法,本文对其做简单介绍。 2.1.1 V AD算法 V AD算法全称为V oice Activity Detection,又称语音边界检测。其可实现的功能有对语音信号进行打断、去除语音信号中的静音部分从而获取有效语音,还可以去除一部分噪声对后续语音识别过程造成的干扰。V AD主要是对输入语音信号的一些时域或频域特征判断其是否属于静音部分。本文只对这些参数做简要介绍,具体算法不属于本文重点因而不在此做细致讨论。 2.1.2时域参数 时域参数是通过对输入信号在时域上的特征参量进行区分。在信噪比较高的环境下使用时域参数进行区分效果显著。 1.相关性分析 通过对足够短的时间范围内的语音信号进行相关性检测可以初步判定该时间范围内的信号是否属于静音部分。在实际应用中,静音的部分实际上会混有各种各样的噪声,因此并非绝对意义上静音。噪声在各个时间范围内的相关性比较低,而人说话的语音相关性则比较强。因此,在高信噪比的条件下区分成功率很

语音识别技术概述(一) 作者:刘钰马艳丽董蓓蓓 摘要:本文简要介绍了语音识别技术理论基础及分类方式,所采用的关键技术以及所面临的困难与挑战,最后讨论了语音识别技术的发展前景和应用。 关键词:语音识别;特征提取;模式匹配;模型训练 Abstract:Thistextbrieflyintroducesthetheoreticalbasisofthespeech-identificationtechnology,itsmo deofclassification,theadoptedkeytechniqueandthedifficultiesandchallengesithavetoface.Then,the developingprospectionandapplicationofthespeech-identificationtechnologyarediscussedinthelast part. Keywords:Speechidentification;CharacterPick-up;Modematching;Modeltraining 一、语音识别技术的理论基础 语音识别技术:是让机器通过识别和理解过程把语音信号转变为相应的文本或命令的高级技术。语音识别以语音为研究对象,它是语音信号处理的一个重要研究方向,是模式识别的一个分支,涉及到生理学、心理学、语言学、计算机科学以及信号处理等诸多领域,甚至还涉及到人的体态语言(如人在说话时的表情、手势等行为动作可帮助对方理解),其最终目标是实现人与机器进行自然语言通信。 不同的语音识别系统,虽然具体实现细节有所不同,但所采用的基本技术相似,一个典型语音识别系统主要包括特征提取技术、模式匹配准则及模型训练技术三个方面。此外,还涉及到语音识别单元的选取。 (一)语音识别单元的选取 选择识别单元是语音识别研究的第一步。语音识别单元有单词(句)、音节和音素三种,具体选择哪一种,由具体的研究任务决定。 单词(句)单元广泛应用于中小词汇语音识别系统,但不适合大词汇系统,原因在于模型库太庞大,训练模型任务繁重,模型匹配算法复杂,难以满足实时性要求。 音节单元多见于汉语语音识别,主要因为汉语是单音节结构的语言,而英语是多音节,并且汉语虽然有大约1300个音节,但若不考虑声调,约有408个无调音节,数量相对较少。因此,对于中、大词汇量汉语语音识别系统来说,以音节为识别单元基本是可行的。 音素单元以前多见于英语语音识别的研究中,但目前中、大词汇量汉语语音识别系统也在越来越多地采用。原因在于汉语音节仅由声母(包括零声母有22个)和韵母(共有28个)构成,且声韵母声学特性相差很大。实际应用中常把声母依后续韵母的不同而构成细化声母,这样虽然增加了模型数目,但提高了易混淆音节的区分能力。由于协同发音的影响,音素单元不稳定,所以如何获得稳定的音素单元,还有待研究。 (二)特征参数提取技术 语音信号中含有丰富的信息,但如何从中提取出对语音识别有用的信息呢?特征提取就是完成这项工作,它对语音信号进行分析处理,去除对语音识别无关紧要的冗余信息,获得影响语音识别的重要信息。对于非特定人语音识别来讲,希望特征参数尽可能多的反映语义信息,尽量减少说话人的个人信息(对特定人语音识别来讲,则相反)。从信息论角度讲,这是信息压缩的过程。 线性预测(LP)分析技术是目前应用广泛的特征参数提取技术,许多成功的应用系统都采用基于LP技术提取的倒谱参数。但线性预测模型是纯数学模型,没有考虑人类听觉系统对语音的处理特点。 Mel参数和基于感知线性预测(PLP)分析提取的感知线性预测倒谱,在一定程度上模拟了人耳对语音的处理特点,应用了人耳听觉感知方面的一些研究成果。实验证明,采用这种技术,语音识别系统的性能有一定提高。

语音AgentNet 的整体实现张宇伟

摘要: 本文论述了一个人机对话应用的实现(我命名它为AgentNet)。其应用实例为一种新的整合了语音技术的智能代理网络服务。 服务器端开发使用了微软SQL SERVER 7.0技术,客户端使用了微软Agent ,微软Specch SDK5语音合成,和语音识别技术。网络连接使用了SOCKET 技术,并论述了高层网络协议的实现。 [关键词] 人机对话,MS-AGENT,语音合成,语音识别,网络编程 [Abstract] This paper discuss a new actualization of man-machine conversation application, which is based on a modal of network service. And I name this service with the name of AgentNet. The development of this service used Microsoft SQL SERVER 7.0. And the client used the technology of Microsoft Agent, TTS (Text To Speech),SR(Speech Recognition).Also the client and the server connect with SOCKET. On the SOCKET, the paper discuss the development of High-Level net protocol. [Key Words] Man-Machine Conversation, MS-AGENT, TTS , SR ,Net Work Programming

语音识别服务平台产品概述

目录 产品介绍产品简介 (3) 产品优势 (4) 海量数据积累 (4) 算法业界领先 (4) 支持多平台设备 (4) 支持语种丰富 (4) 噪声环境识别佳 (4) 海量内外部业务验证 (4) 应用场景 (5) 语音输入法 (5) 语音消息转写 (5) 字幕生成 (5) 会议纪要 (5) 电话质检 (5)

产品介绍 产品简介 20-01-13 15:38:17 语音识别(Automatic Speech Recognition,ASR)为开发者提供语音转文字服务的最佳体验,开放实时语音识别、一句话识别和录音文件识别三种服务形式,满足不同类型开发者需求,具备识别准确率高、接入便捷、性能稳定等特点。 产品简介详情请观看视频: 点击查看视频 产品功能 实时语音识别 对实时音频流进行识别,达到“边说边出文字”的效果,可应用于语音输入、电话机器人等实时音频流场景。 一句话识别 对60秒之内的短音频文件进行识别,达到快速准确识别较短语音的效果,可应用于语音消息转写等场景。 录音文件识别 对录音文件进行识别,达到识别较长的非实时语音的效果,可用于字幕生成、录音资料转写等场景。

产品优势 20-01-13 15:38:44 产品优势详情请观看视频: 点击查看视频 海量数据积累 立足于腾讯庞大的社交数据平台,积累了数十万小时的语音标注数据,拥有丰富多样的语料库,为高识别率奠定数据基础。 算法业界领先 基于多种序列神经网络结构(LSTM、Attention Model、DeepCNN),采用 Multitask 训练方法,结合T/S方式,在通用以及垂直领域有业内领先的识别精度。 支持多平台设备 提供 REST API 和 SDK,支持智能硬件、移动应用、网站、桌面客户端和物联网等多种设备终端。 支持语种丰富 现阶段已经支持中文普通话语音识别、英语语音识别和粤语语音识别,后续将陆续开放其他语种或方言的识别能力。 噪声环境识别佳 语音识别模型鲁棒性佳,识别精度高,抗噪声的干扰能力强,能够识别来自嘈杂环境的音频信息,不需要客户进行降噪处理。 海量内外部业务验证 经过微信、腾讯视频、王者荣耀等内部业务充分验证,也在大量互联网、金融、教育等领域的外部客户业务场景成功落地,日服务亿级用户,性能稳定。

智能机器人语音识别技术 姓名:李占博 学号:201215715

关键词:智能机器人;语音识别;隐马尔可夫模型 DSP 摘要:给出了一种由说话者说出控制命令,机器人进行识别理解,并执行相应动作的实现技术。在此,提出了一种高准确率端点检测算法、高精度定点DSP动态指数定标算法,以解决定点DSP实现连续隐马尔科夫模型CHMM识别算法时所涉及的大量浮点小数运算问题,提高了定点DSP实现的实时性、精度,及其识别率。 关键词:智能机器人;语音识别;隐马尔可夫模型;DSP 1 语音识别概述 语音识别技术最早可以追溯到20世纪50年代,是试图使机器能“听懂”人类语音的技术。按照目前主流的研究方法,连续语音识别和孤立词语音识别采用的声学模型一般不同。孤立词语音识别一般采用DTW动态时间规整算法。连续语音识别一般采用HMM模型或者HMM与人工神经网络ANN相结合。 语音的能量来源于正常呼气时肺部呼出的稳定气流,喉部的声带既是阀门,又是振动部件。语音信号可以看作是一个时间序列,可以由隐马尔可夫模型(HMM)进行表征。语音信号经过数字化及滤噪处理之后,进行端点检测得到语音段。对语音段数据进行特征提取,语音信号就被转换成为了一个向量序列,作为观察值。在训练过程中,观察值用于估计HMM 的参数。这些参数包括观察值的概率密度函数,及其对应的状态,状态转移概率等。当参数估计完成后,估计出的参数即用于识别。此时经过特征提取后的观察值作为测试数据进行识别,由此进行识别准确率的结果统计。训练及识别的结构框图如图1所示。

1. 1 端点检测 找到语音信号的起止点,从而减小语音信号处理过程中的计算量,是语音识别过程中一个基本而且重要的问题。端点作为语音分割的重要特征,其准确性在很大程度上影响系统识别的性能。 能零积定义:一帧时间范围内的信号能量与该段时间内信号过零率的乘积。 能零积门限检测算法可以在不丢失语音信息的情况下,对语音进行准确的端点检测,经过450个孤立词(数字“0~9”)测试准确率为98%以上,经该方法进行语音分割后的语音,在进入识别模块时识别正确率达95%。 当话者带有呼吸噪声,或周围环境出现持续时间较短能量较高的噪声,或者持续时间长而能量较弱的噪声时,能零积门限检测算法就不能对这些噪声进行滤除,进而被判作语音进入识别模块,导致误识。图2(a)所示为室内环境,正常情况下采集到的带有呼气噪声的数字“0~9”的语音信号,利用能零积门限检测算法得到的效果示意图。最前面一段信号为呼气噪声,之后为数字“0~9”的语音。

语音识别技术的发展与未来-标准化文件发布号:(9456-EUATWK-MWUB-WUNN-INNUL-DDQTY-KII

语音识别技术的发展与未来 与机器进行语音交流,让它听明白你在说什么。语音识别技术将人类这一曾经的梦想变成了现实。语音识别就好比“机器的听觉系统”,该技术让机器通过识别和理解,把语音信号转变为相应的文本或命令。 在1952年的贝尔研究所,Davis等人研制了世界上第一个能识别10个英文数字发音的实验系统。1960年英国的Denes等人研制了第一个计算机语音识别系统。 大规模的语音识别研究始于上世纪70年代以后,并在小词汇量、孤立词的识别方面取得了实质性的进展。上世纪80年代以后,语音识别研究的重点逐渐转向大词汇量、非特定人连续语音识别。 同时,语音识别在研究思路上也发生了重大变化,由传统的基于标准模板匹配的技术思路开始转向基于统计模型的技术思路。此外,业内有专家再次提出了将神经网络技术引入语音识别问题的技术思路。 上世纪90年代以后,在语音识别的系统框架方面并没有什么重大突破。但是,在语音识别技术的应用及产品化方面出现了很大的进展。比如,DARPA是在上世界70年代由美国国防部远景研究计划局资助的一项计划,旨在支持语言理解系统的研究开发工作。进入上世纪90年代,DARPA计划仍在持续进行中,其研究重点已转向识别装置中的自然语言处理部分,识别任务设定为“航空旅行信息检索”。 我国的语音识别研究起始于1958年,由中国科学院声学所利用电子管电路识别10个元音。由于当时条件的限制,中国的语音识别研究工作一直处于缓慢发展的阶段。直至1973年,中国科学院声学所开始了计算机语音识别。 进入上世纪80年代以来,随着计算机应用技术在我国逐渐普及和应用以及数字信号技术的进一步发展,国内许多单位具备了研究语音技术的基本条件。与此同时,国际上语音识别技术在经过了多年的沉寂之后重又成为研究的热点。在这种形式下,国内许多单位纷纷投入到这项研究工作中去。 1986年,语音识别作为智能计算机系统研究的一个重要组成部分而被专门列为研究课题。在“863”计划的支持下,中国开始组织语音识别技术的研究,并决定了每隔两年召开一次语音识别的专题会议。自此,我国语音识别技术进入了一个新的发展阶段。 自2009年以来,借助机器学习领域深度学习研究的发展以及大数据语料的积累,语音识别技术得到突飞猛进的发展。

浅谈语音识别技术的应用和发展 摘要语音识别技术就是让机器通过识别和理解过程把语音信号转变为相应的文本或命令的技术,其最终目标是实现人与机器进行自然语言通信。语音作为一个交叉学科,具有深远的研究价值,近50年的研究发展,语音识别技术已经有了极大的发展。本文介绍了语音识别技术的基本原理和应用,并且对语音识别技术的发展趋势进行了展望。 关键词语音识别;应用;发展 0 引言 语音是人类互相之间进行交流时使用最多、最自然、最基本、最重要的信息载体。在高度信息化的今天,语音处理的一系列技术及其应用已经成为信息社会不可缺少的组成部分。语音的产生是一个复杂的过程,包括心理和生理等方面的一系列因素。当人们需要通过语音表达某种信息时,首先是这种信息以某种抽象的形式表现在说话人的大脑里,然后转换为一组神经信号,这些神经信号作用于发声器官,从而产生携带信息的语音信号。 1 语音识别的研究历史及现状 在国外语音识别的研究工作可以追溯到上世纪50年代。1952年AT&T贝尔实验室的Audry系统是第一个可以识别十个英文数字的语音识别系统。 上世纪60年代末70年代初出现了语音识别方面几种基本思想,其中重要成果是提出了信号线性预测编码(LPC)技术和动态时间规整(DTW)技术,有效的解决了语音信号特征提取和不等长语音匹配问题,同时,还提出了矢量量化(VQ)和隐马尔可夫模型(HMM)理论。 上世纪80年代语音识别研究进一步走向深入,其显著特征是隐马尔可夫模型(HMM)和人工神经网络(ANN)在语音识别中的成功应用。上世纪90年代,在计算机技术、电信应用等领域飞速发展的带动下,迫切的要求语音识别系统从实验室走向实际应用。具代表性的是IBM的Via V oice和Dragon公司的Dragon Dictate 系统,这些语音识别系统具有说话人自适应能力,新用户不需要对全部词汇进行训练便可在使用中不断提高识别率[1]。

摘要:语音识别技术是一门涉及面很广的交叉学科。随着新理论的提出和应用,语音识别技术取得了很大的进步,许多产品已经得以实际的应用,但在其进一步的发展进程中,还有许多棘手的问题有待解决。 关键词:语音识别;动态时间规整算法;人工神经元网络 1 背景介绍 语言是人类特有的功能,是人们思维最重要的寄托体,是人类交流最主要的途径。语音是语言的声学表现,是人类交流信息最自然、最有效、最方便的手段。语言和语音与人类 社会科学文化发展紧密相连。 语音识别技术是让机器接收,识别和理解语音信号,并将其转换成相应的数字信号的 技术。它是一门交叉学科,涉及到语音语言学、数理统计、计算机、信号处理等一系列学科。 2 发展历史 1952年贝尔实验室的Davis等人研制成功了能识别十个英文数字发音的Audry系统,标志着语音识别技术研究工作开始。20世纪60年代计提出了动态规划(Dynamic programming)和线性预测分析技术(Liner Predictive)等重要成果。20世纪70年代,语音识别领域取得了突破。实现了基于线性预测倒谱和DTW技术的特定人孤立语音识别 系统。20世纪80年代语音识别研究进一步走向深入, 基于特定人孤立语音技术的系统研 制成功, 隐马尔可夫模型和人工神经元网络(Artificial Neural Network)在语音识别中的成 功应用。进入20世纪90年代后语音识别系统开始从实验室走向实用。我国对语音识别的研究开始于20世纪80年代,近年来发展迅速,并取得了一系列的成果。 3 具体应用 随着计算机技术、模式识别等技术的发展,适应不同场合的语音识别系统相继被开发 出来,语音识别及处理技术已经越来越突现出其强大的技术优势。近三十年来,语音识别 在计算机、信息处理、通信与电子系统、自动控制等领域的应用越来越广泛。 在许多政府部门、商业机构,语音识别技术的应用,可免除大量操作人员的重复劳动,既经济又方便。如:语音邮件、IP电话和IP传真、电子商务、自动语音应答系统、自动 语音信箱、基于IP的语音、数据、视频的CTI系统、综合语音、数据服务系统、自然语音识别系统、专家咨询信息服务系统、寻呼服务、故障服务、秘书服务、多媒体综合信息服务、专业特别服务号(168自动信息服务系统,112、114、119等信息查询系统)等。许多特定环境下,如工业控制方面,在一些工作环境恶劣、对人身有伤害的地方(如地下、深水及辐射、高温等)或手工难以操作的地方,均可通过语音发出相应的控制命令,让设备完成各种工作。

语音识别的应用 语音识别可以应用的领域大致分为大五类:办公室或商务系统。典型的应用包括:填写数据表格、数据库管理和控制、键盘功能增强等等。制造业:在质量控制中,语音识别系统可以为制造过程提供一种“不用手”、“不用眼”的检控(部件检查)。电信:相当广泛的一类应用在拨号电话系统上都是可行 的,包括话务员协助服务的自动化、国 际国内远程电子商务、语音呼叫分配、 语音拨号、分类订货。医疗:这方面的 主要应用是由声音来生成和编辑专业的 医疗报告。其他:包括由语音控制和操 作的游戏和玩具、帮助残疾人的语音识 别系统、车辆行驶中一些非关键功能的 语音控制, 如车载交通路况控制系统、 音响系统。 当语音识别技术应用到计算机桌面 的时候,这看起来似乎是一个好主意。 但是,对于大多数人来说,语音识别还 不能取代键盘和鼠标。现在,语音技术 正用于一个全新的环境:手机。语音识 别技术在手机中的应用将进一步推动这 语音识别是以语音为研究对象, 通过语音信号处理和模式识别让机器自动识别和理解人类口述的语言。语音识别技术就是让机器通过识别和理解过程把语音信号转变为相应的文本或命令的高技术。语音识别是一门涉及面很广的交叉学科,它与声学、语音学、语言学、信息理论、模式识别理论以及神经生物学等学科都有非常密切的关系。语音识别技术正逐步成为计算机信息处理技术中的关键技术,语音技术的应用已经成为一个具有竞争性的新兴高技术产业。 语音识别技术在手机中的应用

专题报道2011年第7期 种技术向新的方向发展和应用。这是语音识别技术在台式电脑应用中从来没有涉足的方向。 IBM在60年代初期创建了一个名为“Shoebox”的试验性的语音识别系统。这个系统解决了口语算法问题。语音识别技术是在50年代作为一项早期的技术第一次出现的,当时主要是由于好奇。在60年代初,IBM的“Shoebox”设备能够识别出16个口语单词并且能够回答简单的数学问题,如“3 + 4 =?”。 Dragon Systems在80年代初为DOS计算机推出的DragonDictate可能是第一个语音识别应用程序。这个应用程序只能识别单个单词,每次只说一个单词。随着时间的推移,这个应用程序已经发展成为名为“Dragon NaturallySpeaking”(目前是第11个版本,由Nuance通讯公司所有)的产品。这个应用程序能够翻译以正常的会话语音和速度读出的文本。 语音识别技术在台式电脑中的应用有两个制约因素。第一,为了使这个应用程序以更高的准确性工作,这个应用程序必须要进行训练以便识别用户的语音特征。Windows Vista和Windows 7操作系统中的本地语音转换文本技术和Dragon NaturallySpeaking等第三方产品仍然都需要一个用户训练期才能使用。 第二个制约因素是键盘的流行程度。大多数人已经习惯于键盘打字而不是讲话,因此,语音控制面临Dvorak键盘布局同样的应用障碍。当简单的老式QWERTY键盘供货充足并且工作的很好的时候,为什么要学习使用Dvorak键盘呢? 微软TellMe团队是负责为多媒体环境开发语音识别技术的部门。TellMe团队高级产品经理Abhi Rele指出,在台 式电脑环境,用户有方便的人机交流模 式,如键盘和鼠标。因此,语音的使用 主要是针对语音爱好者的。 语音控制的计算更广泛的应用需要 两件事情:更好的方便的应用和主要使 用语音的地方。手机正是很长时间以来 一直在增长的这种地方。 Nuance负责产品管理和营销的副总 裁Matt Revis解释说,台式电脑和移动环 境的区别是这样的:台式电脑是一个固 定的环境,重点完全在于台式电脑的使 用情况。因此,台式电脑的语音技术主 要执行如下任务:支持办公应用程序、 网络浏览、通讯等。在移动方面,语音 更多地用于支持各种生活方式方面:移 动中的专业人员、户外的有趣活动、免 提电话等等。 Gartner分析师Tuong Nguyen赞同这 个观点:语音在移动环境中更有意义。 他说,从使用的角度看,掌上设备的语 音识别功能价值更大。它增加了用户友 好的、方便的输入方式。 Nguyen补充说,如果不用 语音技术说出一个简单的说明语 句,而是翻动许多菜单或者努力 地在小显示屏键盘上进行输入, 语音识别的价值就显现出来了。 随着触摸屏设备(没有物理键 盘)应用的增长,语音识别技术 将用来增强数据输入和输出。语 音识别还支持免提要求或者法律 要求。 在移动设备方面 因为移动设备一般仅支持 台式电脑的一部分存储和处理功 能,语音处理需要一些时间才能 以基本的形式出现在手机中。 语音处理Springer手册解释了手机 在2000年代初的情况。尽管那时还有 一些局限性,但是,手机经过编程之后 能够识别逐个数字的拨号语音,在某种 程度上还能识别人的名字。主要问题是 内存,因此,大多数手机一次只能识别 10个数字或者名字。但是,这些作者指 出的另一个问题是这个功能使用的比较 少,可能是因为手机厂商在这方面的营 销很糟糕。 随着手机的增加内存和增强处理能 力,普通手机的识别能力也增强了。三 星电子在2005年发布的售价99美元的 SCH-p-207型手机增加了语音至文本的 听写功能和语音拨号功能。随着内存达 到数百MB和存储容量达到数GB,目前 这一代智能手机很少受到限制。 另一个关键的进步是网络速度。 速度更快的无线网络浪潮抬高了许多大 船,包括最新一代的语音处理技术。速 度更快的网络能够把语音处理任务从网 络迁移到远程服务器。 谷歌语音搜索产品经理Amir Mane