Abstract Cache and Bandwidth Aware Matrix Multiplication on the GPU

- 格式:pdf

- 大小:140.99 KB

- 文档页数:6

专利名称:Bandwidth sharing发明人:Setsuko Watanabe,Brant L. Candelore申请号:US11415828申请日:20060502公开号:US07721306B2公开日:20100518专利内容由知识产权出版社提供专利附图:摘要:A method for bandwidth sharing between first and second satellite television networks involves receiving a shared video data stream shared between the satellitetelevision networks; receiving advertisement metadata forming a part of the shared video data stream, the advertisement meta-data containing identifying information thatidentifies the advertisement as being associated with one of the satellite television networks; determining which of the satellite television networks the advertisement is associated with by reading the identifying information; if the first satellite television network is identified as associated with the advertisement, then outputting the advertisement as a video signal; and if the second satellite television network is identified as associated with the advertisement, then identifying an advertisement that is possibly stored in an advertisement cache, retrieving the advertisement from the advertisement cache and outputting the stored advertisement as a video signal. This abstract is not to be considered limiting.申请人:Setsuko Watanabe,Brant L. Candelore地址:San Diego CA US,Escondido CA US国籍:US,US代理机构:Miller Patent Services代理人:Jerry A. Miller更多信息请下载全文后查看。

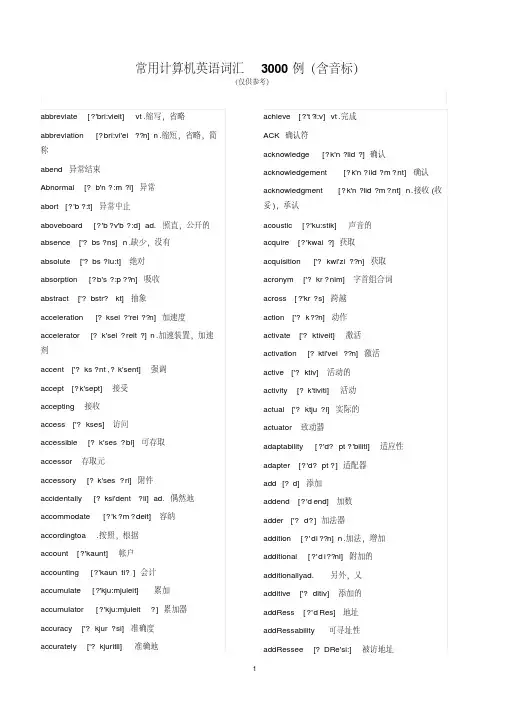

常用计算机英语词汇3000例(含音标)(仅供参考)abbreviate[?'bri:vieit]vt.缩写,省略abbreviation[?bri:vi'ei??n]n.缩短,省略,简称abend异常结束Abnormal[?b'n?:m?l]异常abort[?'b?:t]异常中止aboveboard[?'b?v'b?:d]ad. 照直,公开的absence['?bs?ns]n.缺少,没有absolute['?bs?lu:t]绝对absorption[?b's?:p??n]吸收abstract['?bstr?kt]抽象acceleration[?ksel?'rei??n]加速度accelerator[?k'sel?reit?]n.加速装置,加速剂accent['?ks?nt,?k'sent]强调accept[?k'sept]接受accepting接收access['?kses]访问accessible[?k'ses?bl]可存取accessor存取元accessory[?k'ses?ri]附件accidentally[?ksi'dent?li]ad. 偶然地accommodate[?'k?m?deit]容纳accordingtoa.按照,根据account[?'kaunt]帐户accounting[?'kaun ti?]会计accumulate[?'kju:mjuleit]累加accumulator[?'kju:mjuleit?]累加器accuracy['?kjur?si]准确度accurately['?kjuritli]准确地achieve[?'t?i:v]vt.完成ACK确认符acknowledge[?k'n?lid?]确认acknowledgement[?k'n?lid?m?nt]确认acknowledgment[?k'n?lid?m?nt]n.接收(收妥),承认acoustic[?'ku:stik]声音的acquire[?'kwai?]获取acquisition['?kwi'zi??n]获取acronym['?kr?nim]字首组合词across[?'kr?s]跨越action['?k??n]动作activate['?ktiveit]激活activation[?kti'vei??n]激活active['?ktiv]活动的activity[?k'tiviti]活动actual['?ktju?l]实际的actuator致动器adaptability[?'d?pt?'biliti]适应性adapter[?'d?pt?]适配器add[?d]添加addend[?'d end]加数adder['?d?]加法器addition[?'di??n]n.加法,增加additional[?'d i??nl]附加的additionallyad. 另外,又additive['?ditiv]添加的addRess[?'d Res]地址addRessability可寻址性addRessee[?DRe'si:]被访地址addRessing寻址adequate['?dikwit] a.足够的,充分的adjacency[?'d?eisnsi]邻近adjacent[?'d?eis?nt]邻近的adjust[?'d??st]调整adjustment[?'d??stm?nt]调整administration[?dminis'trei??n]管理administrative[?d'ministr?tiv]管理的administrator[?d'ministreit?]管理员advance[?d'va:ns]v.进展advanced[?d'va:nst]高级的affect[?'fekt]vt.影响,改变,感动affected[?'fektid] a.受了影响的again[?'gein,?'gen]再次aggregate['?grigeit]聚集aid[eid]n.帮助,辅助程序airflow['/?flou]气流aisle[ail]通道alarm[?'la:m]警报alert[?'l?:t]报警algebraic代数algorithm['?lg?rie m]算法alias['eili?s]别名aliasing别名判别align[?'lain]v.定位,对齐aligneda.对齐的,均衡的aligner调整器alignment[?'lainm?nt]数据对齐all[?:l]全部allocate['?l?keit]分配allocation[?l?'kei??n]分配allocator分配器allow[?'lau]允许allowable[?'lau?bl] a.容许的,承认的allowance[?'lau?ns]允许alloweda.容许的ally['?lai,?'lai]v.联合,与...关联alpha['?lf?]n.希腊字母α,未知数alphabet['?lf?bit]字母alphabetic[?lf?'betik]字母的alphabetical[?lf?'betik?l]a.字母(表)的,ABC的alphabetically[?lf?'betikli]ad. 按字母表顺序alphameric字母数字的alphanumeric字母数字的alter['?:lt?]改变alteration[?:lt?'rei??n]改动alternate[?:l't?:nit]替代alternately[?:l't?:nitli]ad. 交替地,轮流地alternative[?:l't?:n?tiv]替代项amber['?mb?]琥珀色amount[?'maunt]金额amp安培ampere['?mp/?]安培ampersand['?mp?s?nd]n.&号(and)amplifier['?mplifait]放大器amplitude['?mplitju:d]振幅analog['?n?l?g]模拟analogue['?n?l?g]模拟Download [da?n'l??d][,da?n'lod]下载analysis[?'n?l?sis]分析analyst['?n?list]分析员analyze['?n?laiz]分析analyzer分析机ancestor['?nsist?]祖先AnD[?nd,?nd]与angle['??gl]角度Angstrom['??str?m]埃animate['?nimeit]动画绘制Animation[?n?'mei??n]动画annotate['?n?uteit]注释annotation[?nou'tei??n]注释announce[?'nauns]vt.发表,宣布announcement[?'naunsm?nt]宣布announciator报警器anode['?n?ud]阳极another[?'n?e?]另一个AnSIn.美国国家标准协会answering['a:ns?ri?]应答antialiasing排斥假名anticipate[?n'tisipeit]vt.预先考虑,抢...先antistatic防静电aperture['?p?tju?]小孔apostrophe[?'p?str?fi]单引号appear[?'pi?]出现append[?'pend]附加appendix[?'pendiks]n.附录Apple['?pl]n.苹果公司applicable['?plik?bl] a.可适用的,合适的application[?pli'kei??n]应用(程序)applied[?'plaid] a.适用的,外加的apply[?'plai]应用appropriate[?'pr?upriit]适当的appropriatelyad. 适当地apron['eipr?n]附表architecture['a:kitekt??]体系结构archive归档area['?ri?]区argument['a:gju:m?nt]参数arithmetic[?'riθm?tik]算术arrange[?'reind?]排列arrangement[?'reind?m?nt]排列array[?'rei]数组arrow['?r?u]箭头article['a:tikl]物件ascend[?'send]上升ascending[?'sendi?]升序ASCIIn.美国信息交换标准码assemble[?'sembl]汇编assembled组装assembler汇编程序assembly[?'sembli]汇编assertion[?'s?:??n]断言asset['?set]资产Assign[?'sain]分配assigneda.指定的,赋值的assignment[?'sainm?nt]赋值assist[?'sist]辅助assistance[?'sist?ns]辅助associate[?'s?u?ieit]v.相联,联想,关联associated关联的association[?s?usi'ei??n]关联associativity关联性assortment[?'s?:tm?nt]n.种类,花色品种assume[?'sju:m]假设assumed[?'sju:md] a.假定的asterisk['?st?risk]星号async异步asynchronous异步atom['?t?m]原子atomicity[?t?'misiti]原子性attach[?'t?t?]连接attacheda.附加的attachment[?'t?t?m?nt]连接附件attempt[?'tempt]试图attention[?'ten??n]n.注意(信号) attenuation[?tenju'ei??n]衰减attenuator衰减器attractive[?'tr?ktiv]吸引人的attribute['?tribju:t]属性audio['?:diou]声频audit['?:dit]审查augend['?:d?end]被加数augment[?:g'ment,'?:gm?nt]v.增加,添加,扩充authentication[?:θenti'kei??n]认证authenticator[?:'θentikeit?]认证器author['?:θ?]n.程序设计者,作者authority[?:'θ?riti]权限authorization[?:θ?rai'zei??n]权限authorize['?:θ?raiz]授权authorized['?:θ?raizd]特许的auto['?:t?u] a.自动的autodialer自动拔号器autoindexn.自动变址(数)automata[?:'t?m?t?]自动机automatic[?:t?'m?tik]自动的automatically[?:t?'m?tik?li]ad. 自动地,机械地automation[?:t?'mei??n]自动化automaton[?:'t?m?t?n]自动机autonumber自动号autopush自动推autostart自动启动auxiliary[?:g'zilj?ri]辅助的availability[?veil?'biliti]可用性available[?'veil?bl]可用的average['?v?rid?]平均avoid[?'v?id]vt.避免,取消,无效babble['b?bl]串音backbone['b?kb?un]主干backend后端backflush逆算法background['b?kgraund]后台backlog待办事项backscrolling反卷backslash反斜线backspace['b?kspeis]退格backtab退格制表backup['b?k?p]备份backward['b?kw?d]反向badge[b?d?]标记balance['b?l?ns]平衡band[b?nd]区bandwidth带宽bank[b??k]存储单元banking['b??ki?]出界bar[ba:]条base[beis]基数baseband基带baseline基线basename基名basic['beisik]基本basis['beisis]基础bass[beis]低音部batch[b?t?]批处理battery['b?t?ri]电池baud波特beacon['bi:k?n]信标beam[bi:m]束beep[bi:p]n.蜂鸣声,嘀嘀声beeper蜂鸣器begin[bi'gin]开始behavior[bi'heivj?]行为bel贝尔bell[bel]响铃bellfast快贝尔below[bi'l?u]下面benchmark基准beyond[bi'j?nd]prep.超过,那边bias['bai?s]偏离bibliography[bibli'?gr?fi]书目bid[bid]请求bidder['bid?]请求者bill[bil]票据billing['bili?]开票binary['bain?ri]二进制bind[baind]联接binder['baind?]联接器binding['baindi?]联接bionics[bai'?niks]仿生学BIOS n.基本输入/输出系统bipolar[bai'poul?]双极性的biquinary[bi'kwin?ri]二五混合进制(的)bistable双稳态的bit[bit]位bitmap位图blank[bl??k]空格blanket['bl??kit]涂层blink[bli?k]闪烁blinking闪烁blip[blip](缩微胶卷画面上的光点)标志blit位块传送block[bl?k]块blocking['bl?ki?]分块blower['blou?]鼓风机board[b?:d]n.板,插件板body['b?di]主体boldface['bouldfeis]黑体book[buk]书籍bookmark['bukma:k]书签Boolean布尔boot[bu:t]引导Bootable可引导bootstrap['bu:tstr?p]自举border['b?:d?]边框borrow['b?r?u]借位bottleneck['b?tlnek]瓶颈bottom['b?t?m]底部bounce[bauns]弹回bound[baund]界限boundary['baund?ri]边界box[b?ks]框bpi位/英寸bps位/秒brace[breis]花括号braces花括号bracket['br?kit]方括号bracketed['br?k?tid] a.加括号的brackets方括号branch[bra:nt?]分支break[breik]中断breakpoint断点breve[bri:v]短音符号bridge[brid?]网桥bridging[brid?i?]桥接bright[brait]明亮brightness[braitnis]亮度broadband宽频带broadcast['br?:dka:st]广播browse[brauz]浏览Browser['brauz?]浏览器bucket['b?kit]存储桶buffer['b?f?]缓冲区buffering缓冲bug[b?g]错误build[bild]构建bulb[b?lb]灯泡bumper['b?mp?]保险杆burst[b?:st]脉冲串bus[b?s]总线business['biznis]商业bussback反馈busy['bizi]忙button['b?tn]按钮buyer['bai?]采购人员buzzer['b?z?]蜂鸣器bypass['bai-pa:s]旁路byte[bait]字节cable['keibl]电缆cabling布线cache[k??]高速缓存caching高速缓存CAD[k?d]计算机辅助设计cage[keid?]盒子calculate['k?lkjuleit]计算calculation[k?lkju'lei??n]n.计算,统计,估计calculator['k?lkjuleit?]计算器calendar['k?lind?]日历calibrate['k?libreit]校准call[k?:l]调用callback['k?:lb?k]回叫caller['k?:l?]调用程序calling['k?:li?]调用callout调出camcorder便携式摄像机cancel['k?ns?l]取消candidate['k?ndidit]候选cannot['k?n?t]不能canvas['k?nv?s]画布capability[keip?'biliti]能力capable['keip?bl]有能力的capacitor[k?'p?sit?]电容capacity[k?'p?siti]能力capital['k?pitl]大写capitalizeda.大写的caption[k?p??n]图表说明capture['k?pt??]捕捉card[ka:d]卡caret['k?r?t]插入记号carousel[k?ru'zel]n.圆盘传送带carriage['k?rid?]托架carrier['k?ri?]载波carry['k?ri]进位cartridge['ka:trid?]盒式磁带cascade[k?s'keid]级联case[keis]n.情况,场合cash[k??]n.现金cassette[ka:'set]盒式磁带cast[ka:st]强制转型catalog['k?t?l?g]编目catalogue['k?t?l?g]编目catch[k?t?]捕捉category['k?tig?ri]种类cation['k?tai?n]n.正离子,阳离子cause[k?:z]原因caution['k?:??n]注意CD光盘,激光唱片cedilla[si'dil?]变音符cell[sel]单元Celsius摄氏center['sent?]中心centering['sent?ri?]向中对齐centerline中线centimeter厘米central['sentr?l]中央的centrex中央交换机century['sent?uri]n.世纪certain['s?:t?n] a.确实的,确定的certainty['s?:tnti]n.必然,确实certification[s?:tifi'kei??n]确证chain[t?ein]链chained[t?eind]链接chaining链接chamber['t?eimb?]箱change[t?eind?]更改channel['t??nl]通道channelizing沟道效应chapter['t??pt?]章char[t?a:]字符character['k?rikt?]字符characteristic[k?rikt?'ristik]特性charge[t?a:d?]费用charging充电chart[t?a:t]图表chassis['??si]机壳check[t?ek]检查checker['t?ek?]检查器checkout检出checkpoint['t?ekp?int]检查点child[t?aild]儿子节点children['t?ildR?n]子女chip[t?ip]芯片choice[t??is]选项choose[t?u:z]v.挑选,选择,选定chord[k?:d]弦chunk[t???k]n.厚块,大部分ciphertext密码文本circle['s?:kl]n.圆,圈,循环,周期circuit['s?:kit]电路circular['s?:kjul?]循环circumflex['s?:k?mfleks]弯曲circumstance['s?:k?mst?ns]n.情况,环境,细节citation[sai'tei??n]引用city['siti]城市clamp[kl?mp]夹class[kla:s]类classify['kl?sifai]分类clause[kl?:z]子句clear[kli?]清除clearinghouse['kli?ri?haus]清除库clerk[kla:k,kl?:k]职员click[klik]单击client['klai?nt]客户clip[klip]裁剪clipboard['klipb?:d]裁剪板cliping裁剪clipper['klip?]n.剪刀clock[kl?k]时钟clocking定时clockwise['kl?kwaiz]顺时针方向Close[kl?uz,kl?us]关闭closed[kl?uzd] a.关闭的,闭迹closely['kl?usli] a.精密地,仔细地cluster['kl?st?]群集coalesce[kou?'les]结合coating涂层coax[k?uks]同轴coaxial同轴的code[k?ud]代码coder['koud?]编码器codeset代码集coding编码coefficient[k?ui'fi??nt]系数coexist['kouig'zist]共存coexistence['kouig'zist?ns]共存coffret传输接口collapse[k?'l?ps]崩溃collate[k?'leit]整理collation[k?'lei?n,k?-]整理collator[k?'leit?]整理器collection[k?'lek??n]堆集collision[k?'li?(?)n]冲突colon['koul?n]冒号colour['k?l?]颜色column['k?l?m]列combination[k?mbi'nei??n]组合combine[k?m'bain]组合comboboxn.组合框comma['k?m?]逗号command[k?'ma:nd]命令comment['k?ment]注解commercial[k?'m?:??l]a.商业的,经济的commit[k?'mit]落实commitment[k?'mitm?nt]落实commodity[k?'m?diti]商品common['k?m?n]公共的communicate[k?'mju:nikeit]通信communication[k?'mju:nikei??n]n.通信compact['k?mp?kt,k?m'p?kt]压缩compaction压缩company['k?mp?ni]公司comparand比较字comparator['k?mp?reit?]比较器compare[k?m'p/?]比较comparison[k?m'p?risn]比较compatibility兼容性compatible[k?m'p?t?bl]兼容的compilation[k?mpi'lei??n]编译compile[k?m'pail]编译compiler[k?m'pail?]编译器complement['k?mplim?nt]补码complementer反相器complete[k?m'pli:t]完成completely[k?m'pli:tli]ad. 十分,完全,彻底completion[k?m'pli:??n]完成complex['k?mpleks]复杂的complexities复杂性complexity[k?m'pleksiti]复杂程度complicated['k?mplikeitid]v.使复杂化,使混乱component[k?m'p?un?nt]部件components部件compose[k?m'p?uz]组成composing[k?m'p ouzi?]组成composite['k?mp?zit]合成composition[k?mp?'zi??n]组合compress[k?m'pres]压缩compression[k?m'pre??n]压缩compressor[k?mpres?]压缩器comprise[k?m'praiz]vt.包括,由...组成compute[k?m'pju:t]计算computer[k?m'pju:t?]计算机computing计算concatenate[k?n'k?tineit]并置concatenation[k?n'k?t?'nei??n]并置concentration[k?ns?n'trei??n]集中concentrator['k?nsentreit?]集线器concept['k?nsept]n.概念concordance[k?n'k?:d?ns]重要语汇索引concurrent[k?n'k?r?nt]同时的condense[k?n'd ens]压缩condition[k?n'di??n]条件conditional[k?n'd i??nl]条件的conditioning调节conductor[k?n'd?kt?]导线conduit['k?ndit]护线管confidential[k?nfi'den??l]机密configuration[k?nfigju'rei??n]配置configurator配置程序configure[k?n'fig?]配置confirm[k?n'f?:m]确认confirmation[k?nf?'mei??n]确认conflict['k?nflikt,k?n'flikt]v.冲突,碰头conflicting[k?n'flikti?]冲突conform[k?n'f?:m]vi.遵从,符合confuse[k?n'fju:z]vt.使混乱,干扰congestion[k?n'd?est??n]拥塞conjunction[k?n'd???k??n]与connect[k?'nekt]连接connected[k?'nektid]连接connection[k?'nek??n]连接connective[k?'nektiv]连接词connectivity连通性connector[k?'nekt?]连接器consecutive[k?n'sekjutiv]连续的consent[k?n'sent]插座consequently['k?nsikw?ntli]ad. 因此,从而consider[k?n'sid?]考虑consideration[k?nsid?'rei??n]n.考虑,研究,讨论considered[k?n'sid?d]a.考虑过的,被尊重的consist[k?n'sist]vi.符合,包括consistency[k?n'sist?nsi]一致性consistent[k?n'sist?nt]一致的console[k?n's?ul]控制台consolidate[k?n's?lideit]合并constn.常数constant['k?nst?nt]常量constantly['k?nst?ntli]ad. 不变地,经常地constraint[k?n'streint]约束constructing构造constructor构造成员consult[k?n's?lt]v.咨询,顾问consumable[k?m'sju:m?bl]消费品consume[k?n'sju:m]v.消耗,使用contact['k?nt?kt,k?n't?kt]联系contain[k?n'tein]包含container[k?n'tein?]容器containment包含content['k?ntent,k?n'tent]内容contention[k?n'ten??n]争用context['k?ntekst]上下文contextual[k?n'tekst?u?l]上下文的contiguous[k?n'tigju?s]相连的continue[k?n'tinju(:)]继续continued[k?n'tinju:d]接上页continuously[k?n'tinju?sli]ad. 连续不断地contractor[k?n'tr?kt?]承包方contrast['k?ntr?st,k?n'tr?st]反差control[k?n'tr?ul]控制controllability可控制性controlled[k?n'trould] a.受控制的,受操纵的controller[k?n'troul?]控制器convegence收敛convenience[k?n'vi:nj?ns]n.方便,便利convenient[k?n'vi:nj?nt] a.方便的,便利的convention[k?n'ven??n]约定conventional[k?n'ven??nl] a.常规的,习惯的converg收敛converged收敛的conversation[k?nv?'sei??n]对话conversational[k?nv?'sei??nl]会话式conversion[k?n'v?:??n]转换convert[k?n'v?:t,'k?nv?:t]转换converted[k?n'v?:tid]转换的converter转换器coordinate[k?u'?dinit]坐标coordinator[kou'?:dineit?]协调程序coprocessor协处理器copy['k?pi]复制copying复制copyright['k?pirait]n.版权cord[k?:d]n.绳子,电线core[k?:]核心coresidency共存corner['k?:n?]角corona[k?'roun?]电晕correct[k?'rekt]正确correction[k?'rek??n]n.校正,修正correctly[k?'rektli]正确correlator相关因子correspond[k?ris'p?nd]vi.通信(联系) corresponding[k?ris'p?ndi?]相应的corrupt[k?'r?pt]v.有毛病的corrupted毁坏的cosine['kousain]余弦cost[k?st]成本costing['k?:sti?]成本法Coulomb[ku:'l?m]库仑count[kaunt]计数counter['kaunt?]计数器counterclockwise[kaunt?kl?kwaiz]反时针方向country['k?ntri]国家coupler['k?pl?]耦合器coupling['k?p li?]耦合courier['kuri?]信使course[k?:s]n.过程,航向,课程cover['k?v?]盖CpU控制处理部件crank[kr??k]曲柄crash[kr??]崩溃craze[kreiz]n.开裂create[kri(:)'eit]建立creation[kri'ei??n]n.创造,创作creator[kri(:)'eit?]建立者credentials凭证credit['kredit]信用crew[kru:]组员criteria[krai'tiri?]标准criterion[krai'ti?ri?n]n.标准,判据,准则critical['kritik?l]临界的crop[kr?p]v.切,剪切cross[kr?s]跨crossfoot交叉结算crowding拥挤cryogenics低温学cryotron低温管cryptographic[kript?'gr?fik]密码cryptography[krip't?gr?fi]密码术CUA公共用户存取访问culling['k?li?]挑选cumulative['kjumjuleitiv]累积的current['k?r?nt]当前currently['k?r?ntli]ad. 目前,现在cursor['k?:s?]光标curtate卡片部分cushion['ku??n]缓冲器custom['k?st?m] a.用户customation定制customer['k?st?m?]用户customize定制cut[k?t]剪下cutoff['k?t?f]截止cutout['k?taut]开口cybernetics['saib?:'netiks]控制论cycle['saikl]循环cyclinder柱面cyrill西里尔daemon守护程序daily[deili] a.每日的,日常的damage['d?mid?]损坏damping阻尼dark[da:k]黑暗DASD直接存取存储器data[deit?]数据database数据库datagram数据报date[deit]日期datum[deit?m]数据day[dei]天db分贝deactivate[di:'?ktiveit]释放deactivated释放deactivation释放deadlock[dedl?k]死锁deal[di:l]v.处理,分配,交易dealer[di:l?]经销商deallocate释放dearly[di?li]ad. 极,非常,昂贵地death[deθ]n.毁灭,消灭debit[debit]借额deblock解块deblocking解块debug[di:'b?g]调试debugger调试器deca十(词头)deci十分之一(词头)decibel[desibel]分贝decide[di'said]v.(使)判定,判断decimal[desim?l]十进制decipher[di'saif?]译码decision[di'si??n]判定deck[dek]叠declaration[dekl?'rei??n]说明declarative[di'kl?r?tiv]说明的declarator说明符declare[di'kl/?]说明declared[di'kl/?d] a.承认的,申报的decode[di:'koud]译码decoder译码器decollate[di'k?leit]分开decompression还原deconcentration[di:k?ns?n'trei??n]分散deconcentrator分线器decrease[di'kri:s,'di:kri:s]v.减少,降低,缩短decreasing递减decrement[dekrim?nt]减decrypt译码decurl去卷曲dedicate[dedikeit]专用dedicated[dedikeitid]专用的dedication[dedi'kei??n]专用deduction[di'd?k??n]扣除default[di'f?:lt]缺省defect[di'fekt]缺陷defective[di'fektiv] a.故障的,有毛病的definable[di'fain?bl] a.可定义的,可确定的define[di'fain]定义definition[defi'ni??n]定义限定deflect[di'flekt]转向degrade[di'greid]v.降低,减少,递降degree[di'gri:]度delay[di'lei]延迟deleave拆散delegation[deli'gei??n]授权delete[di'li:t]删除deletion[di'li:??n]n.删去(部分),删除delimit[di:'limit]定界delimiter定界符delinquent[di'li?kw?nt]拖欠帐款deliver[di'liv?]传递(回叫)delivery[di'liv?ri]传递demand[di'ma:nd]需求demangling识别解码demodulate[di:'m?djuleit]解调demodulation[di:m?dju'lei??n]解调demodulator解调器demographic[di:m?gr?fik]人口统计的demon[di:m?n]精灵程序demonstrate[dem?nstreit]v.论证,证明,证实demonstration[dem?n'strei??n]示范demount[di:'maunt]卸下demultiplex多路分用demultiplexer多路分用器denary[di:n?ri]十进制的denormal非正常表示的denote[di'n?ut]表示density[densiti]密度deny[di'nai]否认department[di'pa:tm?nt]n.部门,门类,系depend[di'pend]取决于dependent[di'pend?nt]从属dependents从属depress[di'pres]按下depth[depθ]深度deque双队列dequeue离队derivation[deri'vei??n]派生descend[di'send]下降descendant[di'send?nt]子代describe[dis'kraib]描述descrieda.被看到的,被发现的description[dis'krip??n]n.描述descriptor描述信息块deselect取消选择deserialize串行变并行deserializer串并转换器design[di'zain]设计designate[dezigneit]指定designateda.指定的,特指的designation[dezig'nei??n]指定designlist设计表desirable[di'zai?r?bl] a.所希望的,称心的desire[di'zai?]v.期望desired期望的desk[desk]n.书桌,控制台,面板desktop桌面desposition支配权destage离台destination[desti'nei??n]目的地destroy[dis'tr?i]毁坏destructor[di'str?kt?]析构成员detached[di't?t?t]分离的detail[di:teil]细节detailed[di:teild]详细的detect[di'tekt]检测detent[di:'tent]稳定装置deter[di't?:]vt.阻止,拦住,妨碍determinant行列式值determine[di't?:min]确定develop[di'vel?p]开发developer[di'vel?p?]开发者developing开发development[di'vel?pm?nt]n.开发,研制deviation[di:vi'ei??n]偏差device[di'vais]设备diacritic[dai?'kritik]发音符号diacritical[dai?'kritikl] a.区分的,辩别的diaeresis分音符diagnose[dai?gn?uz]诊断diagnostic[dai?g'n?stik]诊断的diagnostics['dai?g'n?stiks]诊断diagonal[dai'?g?nl]对角的diagonally[dai'?g?nli]ad. 斜(对) diagram['dai?gr?m]图表dial[dai?l]拨号dialing拨号dialog[dai?l?g]对话dibit双位dictionary[dik??n?ri]字典differ[dif?]vi.不同,不一致difference[difr?ns]差different[difr?nt]不同的differentiate[dif?'ren?ieit]v.区别,分辨differentiator微分器digest[di'd?est,'daid?est]整理digit[did?it]数字digital[did?itl]数字digitize[did?itaiz]数字化dimension[di'men??n]维dimensionaln....维的dimensionality[di'men??'n?liti,dai-]维数diode[daioud]二极管diphthong[di fθ??]元音连字dipping浸渍法direct[di'rekt]直接的direction[di'rek??n]指导directly[di'rektli]ad. 直接地,立即director[di'rekt?]导向器directory[di'rekt?ri]目录dirid目录标识符dirname目录名Dirve驱动器disable[dis'eibl]禁用disabled[dis'eibld]禁用的disappear[dis?'pi?]vi.消失disassembler反汇编器disc[disk]磁盘discard[dis'ka:d]v.删除,废除,放弃discarded废弃的discipline[disiplin]规程disconnect[disk?'nekt]断开disconnection[disk?'nek?n]断开discrete[di'skrit]离散的discriminant判别式discriminator[dis'krimineit?]鉴别器disjunction[dis'd???k??n]析取disk[disk]磁盘diskette软盘dismount[dis'maunt]卸下dispatch[dis'p?t?]分派dispatcher[di'sp?t??]调度器dispersant[dis'p?:s?nt]分散剂displacement[dis'pleism?nt]位移display[dis'plei]显示dispose[dis'p?uz]配置disposition[disp?'zi??n]配置disregard[disri'ga:d]vt.轻视,把..忽略不计dissector[di'sekt?]析象器distinction[dis'ti?k??n]n.区别,相异,特性distinguish[dis'ti?gwi?]v.区别,辨识distort[dis't?:t]失真distortion[dis't?:??n]失真distribute[dis'tribju:t]vt.分布,配线,配给distributed分布的distribution[distri'bju:??n]分发dithering抖动ditto[dit?u]同上diversion[dai'v?:??n]转换divide[di'vaid]v.除dividend[dividend]被除数division[di'vi??n]部分divisor[di'vaiz?]除数DLL动态连接库DOcument['d?kjum?nt]文档DOcumentation[d?kjumen'tei??n]文档编制DOcumenting记录DOmain[d?'mein]域DOS磁盘操作系统DOt[d?t]点DOuble['d?bl] a.两倍的,成双的DOublet['d?blit]二位字节DOubleword双字DOwn[daun]向下DOwnload卸载DOwnstream[daunstri:m]顺流DRaft[DRa:ft]草稿DRag[DR?g]拖曳DRawable['DR?:?bl]可绘制的DRift[DRift]漂移DRive[DRaiv]驱动器DRiver['DRaiv?]驱动程序DRop[DR?p]放下DRum[DR?m]磁鼓DRyer['DRai?]干燥器DUal['dju:?l]a.对偶的,双的DUe[dju:]到期DUmb[d?m]哑的DUmmy['d?mi]哑的DUmp[d?mp]转储DUodecimal[dju:?'d esiml]十二进制的DUplex双工DUplicate['dju:plikit]重复DUplication[dju:pli'kei??n]复制DUplicator['dju:plikeit?]复印机DUrability['dju?r?'biliti]耐用性DUration[dju?'rei??n]持续时间DUring['dju?ri?]在期间DYnamic[dai'n?mik]动态DYnamicizer动态转换器each[i:t?]每个echo['ek?u]回显edge[ed?]边edit['edit]编辑editing编辑edition[i'di??n]版本editor['edit?]编辑器effect[i'fekt]n.效率,作用,效能effective[i'fektiv] a.有效的effectivity有效性efficiency[i'fi??nsi]效率efficiently[i'fi??ntli]ad. 有效地eigenvalue['aig?nv?lju:]特征值eject[i:'d?ekt]弹出edaboration[il?b?'rei??n]加工edapsedvi.经过edectronic[ilek'tr?nik]电子的edectronics[ilek'tr?niks]电子学edement['edim?nt]元素ediminate[i'limineit]消去edlipse[i'lips]椭圆edlipsis[i'lipsis]n.省略符号,省略(法) embedded嵌入的embedding嵌入emboldening增亮embossment[im'b?sm?nt]凸起emphasis['emf?sis]强调emphasize['emf?saiz]v.强调,着重,增强empty['empti] a.空,零,未占用emulate['emjuleit]仿真emulation[emju'lei??n]仿真emulator['emjuleit?]仿真器emulsion[i'm???n]感光乳剂enable[i'neibl]允许encapsulation封装encipher[in'saif?]加密器enclave[en'cleiv]程序集enclose[in'kl?uz]vt.封闭,密封,包装enclosure[in'kl?u??]安装箱encode[in'koud]编码encoder[in'koud?]编码器encounter[in'kaunt?]遇到encrypt加密encryption加密end[end]末端endian字节存储次序endpoint端点engineering[end?i'ni?ri?]工程enhance[in'ha:ns]增强enlargement放大enqueue排队enquiry询问enroll[in'r?ul]报名ensure[in'?u?]保证enter['ent?]输入enterprise['ent?praiz]企业entire[in'tai?]a.总体entirely[in'tai?li]ad. 完全地,彻底地entity['entiti]实体entrance['entr?ns]入口entropy['entr?pi]熵entry['entri]项目enumerator[i'nju:m?reit?]枚举符environ[in'vair?n]vt.围绕,包围environment[in'vai?r?nm?nt]环境environmental[invai?r?n'mntl] a.周围的,环境的epilogue['epil?g]结尾epoch['i:p?k]戳记equal['i:kw?l]等于equalization[i:kw?lai'zei??n]均衡equalizer['i:kw?laiz?]均衡器equally['i:kw?li]ad. 相等地,相同地equation[i'kwei??n]方程式equipment[i'kwipm?nt]装置equivalence[i'kwiv?l?ns]等价equivalent[i'kwiv?l?nt]等价的equivocation[ikwiv?'kei??n]条件信息量总平均值erase[i'reiz]擦除eraser[i'reiz?]擦除器ergoromics人类工程学erlang厄兰error['er?]错误escalation[esk?'lei??n]逐步上升escape[is'keip]跳出esoteric[es?u'terik]机密的especially[is'pe??li]ad. 特别(是),尤其essentially[i'sen??li]ad. 实质上,本来establish[is't?bli?]建立establishment[is't?bli?m?nt]建立ethernet以太网evaluate[i'v?ljueit]估计event[i'vent]事件every['evri]每个examine[ig'z?min]v.检验,考试,审查example[ig'za:mpl]例子exceed[ik'si:d]超过exceededa.过度的,非常的except[ik'sept]prep.除...之外,除非exception[ik'sep??n]异常excerpt['eks?:pt]摘录exchange[iks't?eind?]交换exclamation[ekskl?'mei??n]n.惊叹(号) exclude[iks'klu:d]排除exclusive[iks'klu:siv]互斥的executablea.可执行的execute['eksikju:t]执行execution[eksi'kju:??n]执行exerciser['eks?saiz?]试验程序exhaust[ig'z?:st]v.取尽,用完exist[ig'zist]存在existing现存的exit['eksit]退出expand[iks'p?nd]扩充expander[iks'p?nd?]扩充器expanding[iks'p?ndi?]a.扩展的,扩充的expansion[iks'p?n??n]n.展开,展开式expect[iks'pekt]vt.期望,期待,盼望expenditure[iks'pendit?]支出expenses费用experience[iks'pi?ri?ns]vt.试验experiment[iks'perim?nt]n.实验,试验(研究) experimentation[eksperimen'tei??n]n.实验(工作,法)expertise[eksp?'ti:z]专门知识expire[iks'pai?]v.终止,期满explain[iks'plein]说明explanation[ekspl?'nei??n]说明explanatory[iks'pl?n?t?ri] a.解释(性)的expletive[ek'spli:tiv]虚词explicitlyad. 明显地,显式地exponent[iks'poun?nt]指数exponential[ekspou'nen??l]指数的exponentiation取幂export[eks'p?:t,'eksp?:t]调出exporter[iks'p?:t?]出口服务器exposing曝光exposure[iks'p?u??]曝光度express[iks'pres] a.快速的expression[iks'pre??n]表达式expunge[eks'p?nd?]vt.擦除,删掉extend[iks'tend]扩展extension[iks'ten??n]扩充extent[iks'tent]范围external[eks't?:nl]外部的extra['ekstr?]a.特别的,额外的extract[iks'tr?kt,'ekstr?kt]抽取extremely[iks'tri:mli]ad. 极端地,非常extremity[iks'tremiti]极限eyecatcher识别序列face[feis]n.面,表面facilities设施facility[f?'siliti]n.设施,装备,便利facsimile[f?k'simili]传真factor['f?kt?]因子factorial[f?k't?:ri?l]阶乘factoring因式分解factorization['f?kt?rai'zei?n]因式分解fail[feil]失败failure['feilj?]失败fallback撤退false[f?:ls] a.假(布尔值),错误familiar[f?'milj?]a.熟悉的,惯用的familiarize[f?milj?raiz]vt.使熟悉,使通俗化family['f?mili]系列fancy['f?nsi]n.想象(的),精制的fast[fa:st]快速fastbackn.快速返回fasten['fa:sn]固定fastselect快速选择father['fa:e?]n.父,上层(树节点的)fault[f?:lt]故障feature['fi:t??]特征成份feed[fi:d]馈送feedback['fi:db?k]反馈feedboard供纸板feeder['fi:d?]输电线feminine['feminin]阴性ferrite['ferait]铁氧体ferromagnetics磁学fetch[fet?]取fiber['faib?]纤维field[fi:ld]字段figure['fig?]图file[fail]文件filename文件名fileset文件集filespace文件空间filetab文件标记filingn.(文件的)整理汇集fill[fil]填充filler['fil?]填充符film[film]薄膜filter['filt?]筛选程序final['fainl]最后的finally['fain?li]ad. 终于,最后find[faind]寻找finish['fini?]完成first[f?:st]首先fix[fiks]修订fixed[fikst]固定的fixing['fi ksi?]定影flag[fl?g]标志flashing['fl??i?]闪亮flat[fl?t]平面的flexibility[fl/ks?'bil?ti]灵活性flicker['flik?]闪烁floating['fl?uti?]浮动floppy['fl?pi]n.软磁盘flourescent荧光的flow[fl?u]流动fluerics流体学fluidic射流的fluidics[flu:'d iks]射流技术flush[fl??]清仓flyback回扫fold[f?uld]折叠。

******************************* <计算机专业术语大全(中~英文版)> ******************************* #include <iostream.h>class Myclas{private:int m-number;publicvoid setNumber(int number){m-number = number;}int getNumber(){return m-number}};void showMe(){cout<<"我是一个类"<<endl;}};void main (){Myclass mc;//mc.m_number=10;mc.setNumber(10);cout<<mc.showMe()<<endl;}AGP(Accelerated Graphics Port) -图形加速接口Access Time-存取时间Address-地址ANSI (American National Standards Institute) 美国国家标准协会ASCII 〔American Standard Code for Information Interchange〕Async SRAM-异步静态存BSB (Backside Bus)Bandwidth-带宽Bank -存库Bank Schema -存储体规划Base Rambus -初级的Rambus存Baud -波特BGA (Ball Grid Array)-球状引脚栅格阵列封装技术Binary -二进制BIOS (Basic Input-Output System) -根本输入/输出系统Bit-位、比特BLP-底部引出塑封技术Buffer-缓冲区Buffered Memory-带缓冲的存BEDO (Burst EDO RAM) -突发模式EDO随机存储器Burst Mode-突发模式Bus-总线Bus Cycle-总线周期Byte-字节Cacheability-高速缓存能力Cache Memory-高速缓存存储器CAS (Column Address Strobe)-列地址选通脉冲CL〔CAS Latency 〕-列地址选通脉冲时间延迟CDRAM 〔Cache DRAM〕-快取动态随机存储器Checksum-检验和,校验和Chipset-芯片组Chip-Scale Package (CSP)-芯片级封装pact Flash-紧凑式闪存Concurrent Rambus-并发式总线式存Continuity RIMM (C-RIMM)-连续性总线式存模组CMOS〔plementary Metal-O*ide-Semiductor〕-互补金属氧化物半导体用于晶体管CPU (Central Processing Unit)-中央处理单元Credit Card Memory -信用卡存DDR(Double Data Rate SDRAM)-双数据输出同步动态存储器。

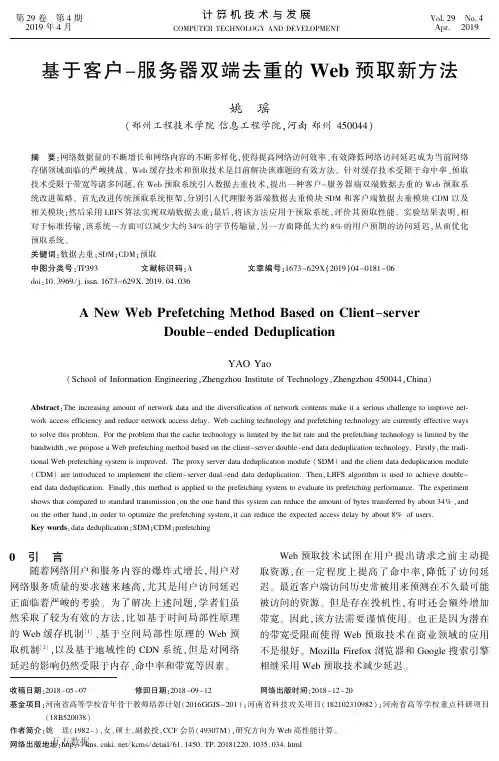

收稿日期:2018-05-07 修回日期:2018-09-12 网络出版时间:2018-12-20基金项目:河南省高等学校青年骨干教师培养计划(2016GGJS -201);河南省科技攻关项目(182102310982);河南省高等学校重点科研项目(18B 520038)作者简介:姚 瑶(1982-),女,硕士,副教授,CCF 会员(49307M ),研究方向为Web 高性能计算㊂网络出版地址:http :// /kcms /detail /61.1450.TP.20181220.1035.034.html基于客户-服务器双端去重的Web 预取新方法姚 瑶(郑州工程技术学院信息工程学院,河南郑州450044)摘 要:网络数据量的不断增长和网络内容的不断多样化,使得提高网络访问效率㊁有效降低网络访问延迟成为当前网络存储领域面临的严峻挑战㊂Web 缓存技术和预取技术是目前解决该难题的有效方法㊂针对缓存技术受限于命中率㊁预取技术受限于带宽等诸多问题,在Web 预取系统引入数据去重技术,提出一种客户-服务器端双端数据去重的Web 预取系统改进策略㊂首先改进传统预取系统框架,分别引入代理服务器端数据去重模块SDM 和客户端数据去重模块CDM 以及相关模块;然后采用LBFS 算法实现双端数据去重;最后,将该方法应用于预取系统,评价其预取性能㊂实验结果表明,相对于标准传输,该系统一方面可以减少大约34%的字节传输量,另一方面降低大约8%的用户预期的访问延迟,从而优化预取系统㊂关键词:数据去重;SDM;CDM;预取中图分类号:TP393 文献标识码:A 文章编号:1673-629X (2019)04-0181-06doi:10.3969/j.issn.1673-629X.2019.04.036A New Web Prefetching Method Based on Client -serverDouble -ended DeduplicationYAO Yao(School of Information Engineering ,Zhengzhou Institute of Technology ,Zhengzhou 450044,China )Abstract :The increasing amount of network data and the diversification of network contents make it a serious challenge to improve net-work access efficiency and reduce network access delay.Web caching technology and prefetching technology are currently effective ways to solve this problem.For the problem that the cache technology is limited by the hit rate and the prefetching technology is limited by the bandwidth ,we propose a Web prefetching method based on the client -server double -end data deduplication technology.Firstly ,the tradi-tional Web prefetching system is improved.The proxy server data deduplication module (SDM )and the client data deduplication module (CDM )are introduced to implement the client -server dual -end data deduplication.Then ,LBFS algorithm is used to achieve double -end data deduplication.Finally ,this method is applied to the prefetching system to evaluate its prefetching performance.The experiment shows that compared to standard transmission ,on the one hand this system can reduce the amount of bytes transferred by about 34%,and on the other hand ,in order to optimize the prefetching system ,it can reduce the expected access delay by about 8%of users.Key words :data deduplication ;SDM ;CDM ;prefetching0 引 言随着网络用户和服务内容的爆炸式增长,用户对网络服务质量的要求越来越高,尤其是用户访问延迟正面临着严峻的考验㊂为了解决上述问题,学者们虽然采取了较为有效的方法,比如基于时间局部性原理的Web 缓存机制[1]㊁基于空间局部性原理的Web 预取机制[2],以及基于地域性的CDN 系统,但是对网络延迟的影响仍然受限于内存㊁命中率和带宽等因素㊂Web 预取技术试图在用户提出请求之前主动提取资源,在一定程度上提高了命中率,降低了访问延迟㊂最近客户端访问历史常被用来预测在不久最可能被访问的资源㊂但是存在投机性,有时还会额外增加带宽㊂因此,该方法需要谨慎使用㊂也正是因为潜在的带宽受限而使得Web 预取技术在商业领域的应用不是很好㊂Mozilla Firefox 浏览器和Google 搜索引擎相继采用Web 预取技术减少延迟㊂第29卷 第4期2019年4月 计算机技术与发展COMPUTER TECHNOLOGY AND DEVELOPMENTVol.29 No.4Apr. 2019万方数据利用数据去重技术分析数据的冗余度,从而适当减少网络数据传输量,由此释放被占用的带宽资源[3]㊂该技术可以利用数据对象之间的信息冗余,获得远高于传统压缩方法及增量备份方法的空间利用率㊂数据去重技术早期应用在存储系统和备份系统中,目前是云存储应用中一种重要的存储优化技术[4-7]㊂基于存储系统内在的数据相似性和数据重复访问的特点,数据去重技术还被应用于内存性能优化和延长SSD使用寿命等方面㊂随着人们不断利用其数据缩减优势来改进和优化现有存储和网络系统的不足,数据去重技术的应用将会越来越广泛㊂文献[8]提出基于网页正文结构和特征串的相似网页去重算法,虽然取得了较高的去重率,但是应用于预取系统时导致延迟较高,并且降低了预测准确率㊂在云计算环境下,文献[9]提出了一种基于流水线的数据读取模型,但是随着冗余率增加,系统速度降低,影响了预取性能㊂文献[10]在客户端实现重复数据删除技术,通过对文件进行分块和在备份过程中去除重复数据块,减少了客户端与服务期间需要传输的数据量,使得文件备份的速度获得较大提高,也降低了网络带宽要求,显著提高了网络备份系统的性能,但却没有考虑预取㊂Web预取技术受限于带宽,而数据去重技术由于减少转移数据的体积从而释放部分占用带宽㊂所以,将预取技术与数据去重技术结合起来在减少网络延迟方面有重大意义㊂文中首先改进了Web预取系统,其次通过移植数据去重模块实现了预取系统的双端去重,最后通过实验所提方法进行验证㊂1 基于数据去重的Web预取系统对传统的Web预取系统框架进行改进,引入了客户端重复数据去重模块(CDM)和代理服务器端重复数据去重模块(SDM),实现了双端数据去重㊂1.1 Web预取系统架构1.1.1 代理服务器端改进后的代理服务器端增加了响应重组模块㊁SDM模块和响应拦截模块等,如图1所示㊂图1 改进的代理服务器端体系结构服务器连接模块:主要负责直接连接客户端和服务器端,尤其是在处理响应的时候,该模块第一时间接收最原始HTTP响应消息报头,并传递给客户端㊂然后把从服务器端接收的所有资源数据原封不动地传递给客户端㊂文中所提方法对HTTP响应消息报头做了进一步的改进㊂报头信息不仅仅包括现有保证连接的附加标题信息,而且涉及修改了标题值㊂例如,需要修改Content-Length㊂此外,由于该系统需要对消息实体做拆分处理,所以需要第一时间从服务器端接收完整的消息实体㊂当该过程终止时,再把修正过的实体内数据回传给客户端㊂响应拦截模块:由于改变了代理服务器端HTTP 响应报文的处理方式,故新设一个响应拦截模块,拦截来自服务器端的最原始的HTTP响应报文,存储在临时缓冲区内并做预处理,判断传输方式是标准数据还是分块方式㊂该模块的具体工作:第一,检查是否存在ETag(被请求变量实体的值),如果存在取出其值;第二,检查Content-Length和Transfer-Encoding字段,如果是前者存在并有效,则HTTP服务器响应的报文必须和消息内容的传输长度完全一致㊂对于动态的内容或者在发送数据前不能判定长度的情况下,可以使用分块的方法传送编码㊂该模块检索客户端缓存关联资源的自定义报头的㊁以数组形式存储的资源标识符㊂然后把装有存储的响应头㊁实体消息数据和资源标识符数组的缓冲区传送给代理服务器数据去重模块SDM㊂SDM模块:对响应拦截模块转交过来的消息实体的数据执行拆分㊂分两个步骤完成:块划分和数据去重㊂该模块存储的主要字段是ETag㊁Chunk和Ver-sions Historic㊂ETag存储唯一ETag资源标识符,由资㊃281㊃计算机技术与发展第29卷万方数据源版本号索引㊂Chunk存储块元信息,SDM模块处理的所有资源版本号的所有块,由块哈希索引㊂Versions Historic存储了所有资源版本号的Chunk的链接队列,由资源版本号索引㊂SDM模块首先检查ETag的状态,如果是新资源,则生成一个新的资源标识符存储于ETag中,使用分块算法为资源分块,生成块链表,存储在Versions His-toric中㊂如果ETag已经存在,意味着该资源先前已经被SDM处理过,不需要重新分块,仅检索Versions Historic中存储的资源版本号的块链表㊂接下来,SDM 执行数据去重算法,使用两个缓冲区分别存储元数据和非冗余数据㊂SDM模块遍历块链表,试图找到一个匹配的散列块内的客户端参考源㊂如果不匹配,SDM 模块在已经被处理过的当前资源版本块中再做一次查找(例如:自冗余数据案例)㊂如果找到一个匹配成功的冗余块,SDM模块添加块的元信息到对应缓冲区㊂对于非冗余块,实体消息数据需要添加到非冗余缓冲区㊂SDM模块建立了元数据和非冗余内容的最终组合,通知重组响应模块数据拆分过程已经完成㊂响应重组模块:准备和发送回传的响应报文㊂响应报头信息进行重组,更新/创建Content-Length附加上新的实体消息数据长度;添加两个新的报头信息X-vrs(资源版本号标识符)和X-mtd(元数据长度)㊂响应重组模块通过附加非冗余内容块到元数据块之后重组新的实体内容数据块(entity content data block),最终重组后的回传响应报文包含报头和消息实体内容㊂组合过的响应报文被多功能的服务器连接模块拦截,背负式(piggybacks the hintlist)报头信息并丢弃未改变的实体消息块,最终重组过的HTTP响应报文传递给客户㊂预测引擎模块:主要任务是在每一次资源被请求的时候预测即将可能访问的页面㊂该模块依据预测算法将产生一系列最近被访问频率最高的资源的URL,并将结果放入决策数据库中㊂1.1.2 客户端改进后的客户端引入了Resource Versions数据文件模块㊁CDM模块,体系结构如图2所示㊂图2 改进的客户端体系结构Resource Versions数据文件:客户端新增的模块,用来存储重组的消息实体数据,由资源标识符索引㊂实质上担任了客户端浏览器的角色㊂数据存储文件中的资源信息与Fetched Objects中的信息是同步的,存储的是资源关联而不是具体的消息实体㊂资源版本号(Resource Versions)由客户端数据去重模块CDM 保存㊂CDM模块:拦截客户端UserRequests或者是Pre-fetch Requests模块发送的HTTP请求报文㊂具体工作:查询Resource Versions数据存储文件,获得客户端缓存中的所有资源的资源标识符㊂CDM通知Com-munications Interceptor(通信拦截)模块对报文做继续处理㊂CDM分配一个缓冲区,采用块划分算法重组来自服务器的原始资源㊂CDM检查元数据,每一chunk 由一个元组引用,复制Resource Versions数据存储中的消息实体数据到重组缓冲区㊂当数组和chunk之间不匹配时,CDM复制非冗余数据块,维持原chunk的顺序㊂通过这种方法,原资源版本被重组㊂CDM在Resource Version数据存储中存储最新的资源版本号,如果发现相同资源较早的版本出现,则替换出去,保证客户端总能保证资源最新的版本㊂预取管理模块(Prefetch Manager Block):预取引擎位于客户端则会有较好的预取效果㊂故在客户端添加预取管理模块㊂通过读取记录模块的访问队列,检查预取对象池(Fetched Objects),确认资源是否已经预取过㊂若没有预取过,则把请求发送给服务器,预取管理模块创建多个User Request线程并等待一个新的请求㊂当从服务器接收到响应资源时,预取管理模块检查其URL是否在预取队列中,若在则移除URL并插入到预取对象池㊂预取模块同时检查请求队列是否为空,若为空,当一个新用户请求入队时直接被送至服务器㊂当一个新的客户端请求入队时,预取管理模块暗示删除已经预取过的资源并清空Hint List数据存储㊂User Requests模块接收来自预取管理模块的请求,再传递给Request模块㊂为了避免后来资源的预㊃381㊃第4期姚瑶等:基于客户-服务器双端去重的Web预取新方法万方数据取,当从服务器接收到一个响应资源时,User Requests 把响应报头的hint 插入到预取队列(Prefetch List )数据存储中,把资源的URL 插入到预取对象池中㊂1.2 数据去重模块基本原理文中采用的数据去重系统来源于dedupHTTP 系统㊂其中,CDM 和SDM 分别工作在客户端和代理服务器端㊂双端数据去重系统架构如图3所示㊂图3 双端数据去重架构具体工作流程如下:当SDM 接收到一个给定的资源请求,检索由CDM 发送的参考源标识符的一个自定义的请求报头㊂然后SDM 从服务器中取出该资源㊂接收过充分响应的报头和数据后,SDM 给资源分配一个新的标识符㊂将资源数据划分为块,块的元信息存储在数据存储文件中㊂在这个数据存储库中SDM 保证了块的哈希索引的元信息资源的所有版本的所有块㊂SDM 遍历资源所有块㊂对每个资源块,将在参考源具有相同散列块㊂如果有一块没有匹配的参考源,SDM 会在当前响应资源块中搜索㊂因此,冗余检测不仅在资源在CDM 的高速缓存执行,而且在资源被送交CDM 时也执行㊂SDM 组合最终响应资源发给CDM ㊂响应由元数据段开始㊂元数据的大小(字节)存储在一个自定义HTTP 响应报头中㊂元数据的内容从响应的资源标识符开始㊂在每个参考源中包含了四元组,每个元组包含的信息是CDM 能够在缓存中找到每一个冗余块的必需信息㊂具体包含的字段是当前响应的偏移量Offset ,资源标识符Resource identifier ,资源内部的偏移量InOffset 和块的长度㊂数组按照在原始响应中相应块的顺序排列㊂在元数据块的结尾,附加上非冗余数据内容,仍然保持原响应中的顺序㊂由于对该元组和非冗余数据的顺序维护,CDM 仅需数组的第一偏移量就可知道如何在非冗余数据附加上冗余数据㊂当CDM 收到响应后,为所有的数据重建原有的资源,包括从本地缓存资源中复制块引用信息和复制接收到响应的非冗余数据内容㊂CDM 并不存储任何一块元信息,也不需要发送或存储哈希㊂通信拦截模块:负责对CDM 和请求端信息做语法处理㊂当Communications Interceptor 接收到CDM 的通知时,该模块为信息添加自定义报头 X -vrs ,即客户端参考源的X -vrs 报头就包含了资源标识符㊂Communications Interceptor 把报头信息附加在HTTP 请求报头上,给Requests 模块,最后传给服务器㊂当从代理服务器端接收到HTTP 响应报文,Com-munications Interceptor 模块对报头进行语法分析,分别从X -vrs 和X -mtd 报头提取资源标识符和元数据的长度㊂为了进一步处理拆分数据,分别进入三个不同的缓冲区,一个缓冲区存放报头信息,一个存放元数据,一个存放非冗余数据㊂最后又将所有数据传给CDM ㊂1.3 基于滑动窗口的数据块划分基于滑动窗口的数据块划分方法主要依据块的内容划分,该方法的查重率高㊁分块更为合理有效[11-12]㊂SDM 模块采用LBFS 算法将服务器响应给客户端的每一个资源版本号划分为索引数据chunk ㊂第一步:当客户端发出一个请求时,服务器将资源划分为若干索引chunk ㊂判断出该资源的哪些部分客户端已经存在,哪些部分是新的㊁需要发送的㊂令c i 为第i 个资源流的字节,k 为Karp -Rabin 块的长度,b 为进制的基数㊂Karp -Rabin 块[13]的哈希如下:H (c i c i +k )=c i ˑb k -1+c i +1ˑb k -2+ +c k -1ˑb +c k其中,b 是一个常数㊂函数的应激性允许计算下一个字节的哈希,如下:H (c i +1 c i +1+k )={[H (c i c i +k )-c i ˑb k ]+c k +1}ˑb第二步:选择代表资源的哈希㊂为了节省内存空间,选择合适的哈希作为较大数据块的边界㊂选择窗口机制,能够提供更好的冗余检测㊂分别确定最小和最大的chunk 尺寸,对比期望chunk 大小,基于文中方法的内容可能会造成过大的chunk 或者过小的chunk ㊂块哈希表的查找复杂度是O (p /k ),其中p 是参考源中块的数量,k 是一个常数㊂最坏情况下,参考源中不存在块信息㊂SDM 的哈希查找算法的复杂度是O (n *m *p ),其中n 是当前处理的块数量,m 是参考源的数量㊂当m 相当小,例如最终用户并且缓存中只剩下很少的资源数量,大文件小容量块,将得到n *p ≫m ,可见算法复杂度的决定性影响因子是块的大小㊂2 实验与结果分析2.1 实验参数系统的评价标准分别是字节节省率和延迟㊂前者㊃481㊃ 计算机技术与发展 第29卷万方数据是指每次请求所节省的字节传输作为冗余块的总和,即没有从代理发送客户端而是从客户机获得引用资源的数据块的字节数的总和㊂后者指对于一个给定资源,从客户端GET请求直到客户端响应该资源的时间间隔㊂客户端机器配置:Intel Pentium4,2.16GHz,4GB 内存,操作系统Linux Mint14-32b㊂服务器配置:Intel Pentium4,3.20GHz,6GB内存,操作系统Linux Mint 14-32b㊂实验运行在带宽为54MB/s的局域网㊂限制带宽下测试,模拟蓝牙有效带宽2.1Mb/s㊂工作负载中应用的各种测试是通过下载一个典型的新闻网站(www.dn.pt)3个层次的深度的文件㊂实验中,请求所有的工作文件,相当于客户机-服务器之间传输约20MB的文件㊂具体地,最大的字节数为214595,最小字节数为298,平均字节数29672,总大小为19.8MB㊂客户端请求自动使用Wget实用程序㊂为了模拟一个真正的用户发起Web导航,引入用户请求允许预取操作之间的空闲时间,使用了Wget开关 -w10 和 randomwait ,主要为了引入一个5㊁15秒请求之间的随机延迟㊂2.2 实验结果分析实验一:重点分析当执行数据去重时,冗余检测效率对块大小的依赖情况㊂预取(PF)和数据去重(DDP)同时执行(PFON-DDPON),块的平均尺寸依次设置为32㊁64㊁128㊁256㊁512㊁1024和2048个字节㊂一般情况下,设置最小块的大小等于平均块尺寸的1/ 4,块的最大尺寸等于平均块大小的2倍㊂实验结果参见图4和图5㊂图4 PFON DDPON相对于PFON DDPOFF字节节省率(带宽54Mbs)图4显示了PFON DDPON时刻相对于PFON DDPOFF时刻的字节节省率㊂结果表明,最好的冗余检测获得的块大小为128字节,节省了34.2%的字节数量㊂图5 相对于标准HTTP传输情况(PFON DDPON,带宽54Mbs)图5显示延迟时间和块大小成反比关系㊂原因是随着块尺寸的增加,块的数量减少,那么数据去重的计算开销也要增加㊂因此数据去重算法执行时间也要兼顾㊂为了获得更高的字节节省率,设置块大小为128字节㊂具体实验对比了PFOFF DDPOFF和PFOFF DDPON,PFON DDPOFF和PFON DDPON㊂带宽设置为54Mbs,在字节节省率方面,PFOFF DDPON方法比PFOFF DDPOFF方法节省了34.1%,PFON DDPON方法比PFON DDPOFF方法节省了34.2%㊂结果表明,引入数据去重技术可以节省34%的字节传输㊂实验二:使用该系统传输每种资源的延迟时间与标准HTTP传输时延迟的比值对比如图6所示㊂对比标准HTTP传输,仅有去重时能够减少大约8%的延迟,有预取时减少的延迟更明显,分别减少14.7%和8.9%㊂差别的原因在于数据去重算法存在一定的计算开销㊂综合考虑可见,当使用预取和数据去重时,数据去重保证了一定的字节节省率,但是以适度增加的等待时间为代价,保证了系统的整体性能㊂图6 相对于标准HTTP传输延迟情况实验三:评估在可达到的冗余值中对不同带宽的影响效果㊂分别在LAN条件(54Mbs)和蓝牙条件㊃581㊃第4期姚瑶等:基于客户-服务器双端去重的Web预取新方法万方数据(2.1Mbs)下进行PFON DDPON操作的比较测试,如表1所示㊂表1 不同带宽下相对于HTTP标准传输的延迟%指标LAN Bluetooth 字节节省率34.234.3资源延迟91.195.6结果表明,带宽对字节节省率基本无影响㊂在蓝牙情况下每个资源的延迟时间减少的幅度是LAN情况下减少的一半,分别为4.4%和8.9%㊂由于预取频度依赖于用户请求之间的空闲时间,增加的延迟意味着请求需要更长的时间完成,因此可以减少空闲时间,从而减少预取请求启动的机会㊂3 结束语提出一种基于客户-服务器端双端去重的Web预取系统的设计方法,旨在提高网络访问效率,改善用户预期的延迟㊂实验结果表明,该系统一方面相对于正常传输的字节数传输量显著减少,节约了大约34%;另一方面可以实现减少大约8%的用户预期的延迟,即使因为网络的客观条件影响实际效果,也能够保证降低4%的延迟㊂未来将进一步研究如何更准确地判定数据去重阶段的相似块以及如何降低数据去重算法的时间开销㊂参考文献:[1] 程龙泉.基于预测模型和缓存替换策略的网络资源访问研究[J].科技通报,2017,33(10):134-136.[2] 姚瑶,王战红,石磊.一种基于页面聚类的Web概念化建模新方法[J].微电子学与计算机,2015,32(1):156-160.[3] ARONOVICHA L,ASHERB R,HARNIK D,et al.Similari-ty based deduplication with small data chunks[J].Discrete Applied Mathematics,2016,212:10-22.[4] ZHANG Panfeng,HUANG Ping,HE Xubin,et al.Resem-blance and mergence based indexing for high performance data deduplication[J].Journal of Systems and Software, 2017,128:11-24.[5]HIRSCHA M,ISH-SHALOMA A,KLEINB S T.Optimalpartitioning of data chunks in deduplication systems[J].Dis-crete Applied Mathematics,2016,212:104-114. [6] WIDODO R N S,LIM H,ATIQUZZAMAN M.SDM:smartdeduplication for mobile cloud storage[J].Future Generation Computer Systems,2017,70:64-73.[7] 王闪,谭良.Web大数据环境下的相似重复数据清理[J].计算机工程与设计,2017,38(3):646-651. [8] 熊忠阳,牙漫,张玉芳.基于网页正文结构和特征串的相似网页去重算法[J].计算机应用,2013,33(2):554-557.[9] 李超,王树鹏,云晓春,等.一种基于流水线的重复数据删除系统读性能优化方法[J].计算机研究与发展,2013, 50(1):90-100.[10]孙爱玲,冉禄纯.一种基于重复数据删除的网络文件备份系统设计与实现[J].计算机应用与软件,2014,31(10):86-90.[11]WIDODO R N S,LIM H,ATIQUZZAMAN Z.A new con-tent-defined chunking algorithm for data deduplication in cloud storage[J].Future Generation Computer Systems, 2017,71:145-156.[12]王红梅,李芬田,王泽儒.基于滑动窗口数据流频繁项集挖掘模型综述[J].长春工业大学学报,2017,38(5):484-490.[13]王歧,卢毓海,刘洋,等.支持模式串动态更新的多模式匹配Karp-Rabin算法[J].计算机工程与应用,2017,53(4):39-44.㊃681㊃计算机技术与发展第29卷万方数据。

ACM Word Template for SIG Site1st Author1st author's affiliation1st line of address2nd line of address Telephone number, incl. country code 1st author's E-mail address2nd Author2nd author's affiliation1st line of address2nd line of addressTelephone number, incl. country code2nd E-mail3rd Author3rd author's affiliation1st line of address2nd line of addressTelephone number, incl. country code3rd E-mailABSTRACTA s network speed continues to grow, new challenges of network processing is emerging. In this paper we first studied the progress of network processing from a hardware perspective and showed that I/O and memory systems become the main bottlenecks of performance promotion. Basing on the analysis, we get the conclusion that conventional solutions for reducing I/O and memory accessing latencies are insufficient for addressing the problems.Motivated by the studies, we proposed an improved DCA combined with INIC solution which has creations in optimized architectures, innovative I/O data transferring schemes and improved cache policies. Experimental results show that our solution reduces 52.3% and 14.3% cycles on average for receiving and transmitting respectively. Also I/O and memory traffics are significantly decreased. Moreover, an investigation to the behaviors of I/O and cache systems for network processing is performed. And some conclusions about the DCA method are also presented.KeywordsKeywords are your own designated keywords.1.INTRODUCTIONRecently, many researchers found that I/O system becomes the bottleneck of network performance promotion in modern computer systems [1][2][3]. Aim to support computing intensive applications, conventional I/O system has obvious disadvantages for fast network processing in which bulk data transfer is performed. The lack of locality support and high latency are the two main problems for conventional I/O system, which have been wildly discussed before [2][4].To overcome the limitations, an effective solution called Direct Cache Access (DCA) is suggested by INTEL [1]. It delivers network packages from Network Interface Card (NIC) into cache instead of memory, to reduce the data accessing latency. Although the solution is promising, it is proved that DCA is insufficient to reduce the accessing latency and memory traffic due to many limitations [3][5]. Another effective solution to solve the problem is Integrated Network Interface Card (INIC), which is used in many academic and industrial processor designs [6][7]. INIC is introduced to reduce the heavy burden for I/O registers access in Network Drivers and interruption handling. But recent report [8] shows that the benefit of INIC is insignificant for the state of the art 10GbE network system.In this paper, we focus on the high efficient I/O system design for network processing in general-purpose-processor (GPP). Basing on the analysis of existing methods, we proposed an improved DCA combined with INIC solution to reduce the I/O related data transfer latency.The key contributions of this paper are as follows:▪Review the network processing progress from a hardware perspective and point out that I/O and related last level memory systems have became the obstacle for performance promotion.▪Propose an improved DCA combined with INIC solution for I/O subsystem design to address the inefficient problem of a conventional I/O system.▪Give a framework of the improved I/O system architecture and evaluate the proposed solution with micro-benchmarks.▪Investigate I/O and Cache behaviors in the network processing progress basing on the proposed I/O system.The paper is organized as follows. In Section 2, we present the background and motivation. In Section 3, we describe the improved DCA combined INIC solution and give a framework of the proposed I/O system implementation. In Section 4, firstly we give the experiment environment and methods, and then analyze the experiment results. In Section 5, we show some related works. Finally, in Section 6, we carefully discuss our solutions with many existing technologies, and then draw some conclusions.2.Background and MotivationIn this section, firstly we revise the progress of network processing and the main network performance improvement bottlenecks nowadays. Then from the perspective of computer architecture, a deep analysis of network system is given. Also the motivation of this paper is presented.2.1Network processing reviewFigure 1 illustrates the progress of network processing. Packages from physical line are sampled by Network Interface Card (NIC). NIC performs the address filtering and stream control operations, then send the frames to the socket buffer and notifies OS to invoke network stack processing by interruptions. When OS receives the interruptions, the network stack accesses the data in socket buffer and calculates the checksum. Protocol specific operations are performed layer by layer in stack processing. Finally, data is transferred from socket buffer to the user buffer depended on applications. Commonly this operation is done by memcpy, a system function in OS.Figure 1. Network Processing FlowThe time cost of network processing can be mainly broke down into following parts: Interruption handling, NIC driver, stack processing, kernel routine, data copy, checksum calculation and other overheads. The first 4 parts are considered as packet cost, which means the cost scales with the number of network packets. The rests are considered as bit cost (also called data touch cost), which means the cost is in proportion to the total I/O data size. The proportion of the costs highly depends on the hardware platform and the nature of applications. There are many measurements and analyses about network processing costs [9][10]. Generally, the kernel routine cost ranges from 10% - 30% of the total cycles; the driver and interruption handling costs range from 15% - 35%; the stack processing cost ranges from 7% - 15%; and data touch cost takes up 20% - 35%. With the development of high speed network (e.g. 10/40 Gbps Ethernet), an increasing tendency for kernel routines, driver and interruption handling costs is observed [3].2.2 MotivationTo reveal the relationship among each parts of network processing, we investigate the corresponding hardware operations. From the perspective of computerhardware architecture, network system performance is determined by three domains: CPU speed, Memory speed and I/O speed. Figure 2 depicts the relationship.Figure 2. Network xxxxObviously, the network subsystem can achieve its maximal performance only when the three domains above are in balance. It means that the throughput or bandwidth ofeach hardware domain should be equal with others. Actually this is hard for hardware designers, because the characteristics and physical implementation technologies are different for CPU, Memory and I/O system (chipsets) fabrication. The speed gap between memory and CPU – a.k.a “the memory wall” – has been paid special attention for more than ten years, but still it is not well addressed. Also the disparity between the data throughput in I/O system and the computing capacity provided by CPU has been reported in recent years [1][2].Meanwhile, it is obvious that the major time costs of network processing mentioned above are associated with I/O and Memory speeds, e.g. driver processing, interruption handling, and memory copy costs. The most important nature of network processing is the “producer -consumer locality” between every two consecutive steps of the processing flow. That means the data produced in one hardware unit will be immediately accessed by another unit, e.g. the data in memory which transported from NIC will be accessed by CPU soon. However for conventional I/O and memory systems, the data transfer latency is high and the locality is not exploited.Basing on the analysis discussed above, we get the observation that the I/O and Memory systems are the limitations for network processing. Conventional DCA or INIC cannot successfully address this problem, because it is in-efficient in either I/O transfer latency or I/O data locality utilization (discussed in section 5). To diminish these limitations, we present a combined DCA with INIC solution. The solution not only takes the advantages of both method but also makes many improvements in memory system polices and software strategies.3. Design MethodologiesIn this section, we describe the proposed DCA combined with INIC solution and give a framework of the implementation. Firstly, we present the improved DCA technology and discuss the key points of incorporating it into I/O and Memory systems design. Then, the important software data structures and the details of DCA scheme are given. Finally, we introduce the system interconnection architecture and the integration of NIC.3.1 Improved DCAIn the purpose of reducing data transfer latency and memory traffic in system, we present an improved Direct Cache Access solution. Different with conventional DCA scheme, our solution carefully consider the following points. The first one is cache coherence. Conventionally, data sent from device by DMA is stored in memory only. And for the same address, a different copy of data is stored in cache which usually needs additional coherent unit to perform snoop operation [11]; but when DCA is used, I/O data and CPU data are both stored in cache with one copy for one memory address, shown in figure 4. So our solution modifies the cache policy, which eliminated the snoopingoperations. Coherent operation can be performed by software when needed. This will reduce much memory traffic for the systems with coherence hardware [12].I/O write *(addr) = bCPU write *(addr) = aCacheCPU write *(addr) = a I/O write with DCA*(addr) = bCache(a) cache coherance withconventional I/O(b) cache coherance withDCA I/OFigure 3. xxxxThe second one is cache pollution. DCA is a mixed blessing to CPU: On one side, it accelerates the data transfer; on the other side, it harms the locality of other programs executed in CPU and causes cache pollution. Cache pollution is highly depended on the I/O data size, which is always quite large. E.g. one Ethernet package contains a maximal 1492 bytes normal payload and a maximal 65536 bytes large payload for Large Segment Offload (LSO). That means for a common network buffer (usually 50 ~ 400 packages size), a maximal size range from 400KB to 16MB data is sent to cache. Such big size of data will cause cache performance drop dramatically. In this paper, we carefully investigate the relationship between the size of I/O data sent by DCA and the size of cache system. To achieve the best cache performance, a scheme of DCA is also suggested in section 4. Scheduling of the data sent with DCA is an effective way to improve performance, but it is beyond the scope of this paper.The third one is DCA policy. DCA policy refers the determination of when and which part of the data is transferred with DCA. Obviously, the scheme is application specific and varies with different user targets. In this paper, we make a specific memory address space in system to receive the data transferred with DCA. The addresses of the data should be remapped to that area by user or compilers.3.2 DCA Scheme and detailsTo accelerate network processing, many important software structures used in NIC driver and the stack are coupled with DCA. NIC Descriptors and the associated data buffers are paid special attention in our solution. The former is the data transfer interface between DMA and CPU, and the later contains the packages. For farther research, each package stored in buffer is divided into the header and the payload. Normally the headers are accessed by protocols frequently, but the payload is accessed only once or twice (usually performed as memcpy) in modern network stack and OS. The details of the related software data structures and the network processing progress can be found in previous works [13].The progress of transfer one package from NIC to the stack with the proposed solution is illustrated in Table 1. All the accessing latency parameters in Table 1 are based on a state of the art multi-core processor system [3]. One thing should be noticed is that the cache accessing latency from I/O is nearly the same with that from CPU. But the memory accessing latency from I/O is about 2/3 of that from CPU due to the complex hardware hierarchy above the main memory.Table 1. Table captions should be placed above the tabletransfer.We can see that DCA with INIC solution saves above 95% CPU cycles in theoretical and avoid all the traffic to memory controller. In this paper, we transfer the NIC Descriptors and the data buffers including the headers and payload with DCA to achieve the best performance. But when cache size is small, only transfer the Descriptors and the headers with DCA is an alternative solution.DCA performance is highly depended on system cache policy. Obviously for cache system, write-back with write-allocate policy can help DCA achieves better performance than write-through with write non-allocate policy. Basing on the analysis in section 3.1, we do not use the snooping cache technology to maintain the coherence with memory. Cache coherence for other non-DCA I/O data transfer is guaranteed by software.3.3 On-chip network and integrated NICFootnotes should be Times New Roman 9-point, and justified to the full width of the column.Use the “ACM Reference format” for references – that is, a numbered list at the end of the article, ordered alphabetically and formatted accordingly. See examples of some typical reference types, in the new “ACM Reference format”, at the end of this document. Within this template, use the style named referencesfor the text. Acceptable abbreviations, for journal names, can be found here: /reference/abbreviations/. Word may try to automatically ‘underline’ hotlinks in your references, the correct style is NO underlining.The references are also in 9 pt., but that section (see Section 7) is ragged right. References should be published materials accessible to the public. Internal technical reports may be cited only if they are easily accessible (i.e. you can give the address to obtain thereport within your citation) and may be obtained by any reader. Proprietary information may not be cited. Private communications should be acknowledged, not referenced (e.g., “[Robertson, personal communication]”).3.4Page Numbering, Headers and FootersDo not include headers, footers or page numbers in your submission. These will be added when the publications are assembled.4.FIGURES/CAPTIONSPlace Tables/Figures/Images in text as close to the reference as possible (see Figure 1). It may extend across both columns to a maximum width of 17.78 cm (7”).Captions should be Times New Roman 9-point bold. They should be numbered (e.g., “Table 1” or “Figure 2”), please note that the word for Table and Figure are spelled out. Figure’s captions should be centered beneath the image or picture, and Table captions should be centered above the table body.5.SECTIONSThe heading of a section should be in Times New Roman 12-point bold in all-capitals flush left with an additional 6-points of white space above the section head. Sections and subsequent sub- sections should be numbered and flush left. For a section head and a subsection head together (such as Section 3 and subsection 3.1), use no additional space above the subsection head.5.1SubsectionsThe heading of subsections should be in Times New Roman 12-point bold with only the initial letters capitalized. (Note: For subsections and subsubsections, a word like the or a is not capitalized unless it is the first word of the header.)5.1.1SubsubsectionsThe heading for subsubsections should be in Times New Roman 11-point italic with initial letters capitalized and 6-points of white space above the subsubsection head.5.1.1.1SubsubsectionsThe heading for subsubsections should be in Times New Roman 11-point italic with initial letters capitalized.5.1.1.2SubsubsectionsThe heading for subsubsections should be in Times New Roman 11-point italic with initial letters capitalized.6.ACKNOWLEDGMENTSOur thanks to ACM SIGCHI for allowing us to modify templates they had developed. 7.REFERENCES[1]R. Huggahalli, R. Iyer, S. Tetrick, "Direct Cache Access forHigh Bandwidth Network I/O", ISCA, 2005.[2] D. Tang, Y. Bao, W. Hu et al., "DMA Cache: Using On-chipStorage to Architecturally Separate I/O Data from CPU Data for Improving I/O Performance", HPCA, 2010.[3]Guangdeng Liao, Xia Zhu, Laxmi Bhuyan, “A New ServerI/O Architecture for High Speed Networks,” HPCA, 2011. [4] E. A. Le´on, K. B. Ferreira, and A. B. Maccabe. Reducingthe Impact of the MemoryWall for I/O Using Cache Injection, In 15th IEEE Symposium on High-PerformanceInterconnects (HOTI’07), Aug, 2007.[5] A.Kumar, R.Huggahalli, S.Makineni, “Characterization ofDirect Cache Access on Multi-core Systems and 10GbE”,HPCA, 2009.[6]Sun Niagara 2,/processors/niagara/index.jsp[7]PowerPC[8]Guangdeng Liao, L.Bhuyan, “Performance Measurement ofan Integrated NIC Architecture with 10GbE”, 17th IEEESymposium on High Performance Interconnects, 2009. [9] A.Foong et al., “TCP Performance Re-visited,” IEEE Int’lSymp on Performance Analysis of Software and Systems,Mar 2003[10]D.Clark, V.Jacobson, J.Romkey, and H.Saalwen. “AnAnalysis of TCP processing overhead”. IEEECommunications,June 1989.[11]J.Doweck, “Inside Intel Core microarchitecture and smartmemory access”, Intel White Paper, 2006[12]Amit Kumar, Ram Huggahalli., Impact of Cache CoherenceProtocols on the Processing of Network Traffic[13]Wenji Wu, Matt Crawford, “Potential performancebottleneck in Linux TCP”, International Journalof Communication Systems, Vol. 20, Issue 11, pages 1263–1283, November 2007.[14]Weiwu Hu, Jian Wang, Xiang Gao, et al, “Godson-3: ascalable multicore RISC processor with x86 emulation,”IEEE Micro, 2009. 29(2): pp. 17-29.[15]Cadence Incisive Xtreme Series./products/sd/ xtreme_series.[16]Synopsys GMAC IP./dw/dwtb.php?a=ethernet_mac [17]ler, P.M.Watts, A.W.Moore, "Motivating FutureInterconnects: A Differential Measurement Analysis of PCILatency", ANCS, 2009.[18]Nathan L.Binkert, Ali G.Saidi, Steven K.Reinhardt.Integrated Network Interfaces for High-Bandwidth TCP/IP.Figure 1. Insert caption to place caption below figure.Proceedings of the 12th international conferenceon Architectural support for programming languages and operating systems (ASPLOS). 2006[19]G.Liao, L.Bhuyan, "Performance Measurement of anIntegrated NIC Architecture with 10GbE", HotI, 2009. [20]Intel Server Network I/O Acceleration./technology/comms/perfnet/downlo ad/ServerNetworkIOAccel.pdfColumns on Last Page Should Be Made As Close AsPossible to Equal Length。

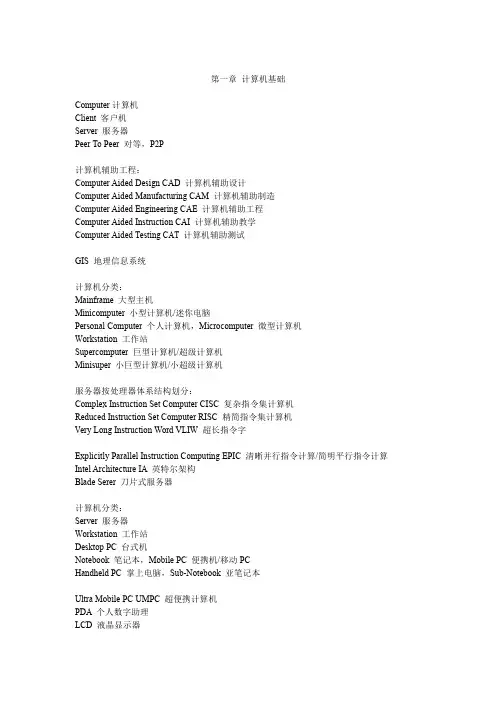

第一章计算机基础Computer计算机Client客户机Server服务器Peer To Peer对等,P2P计算机辅助工程:Computer Aided Design CAD计算机辅助设计Computer Aided Manufacturing CAM计算机辅助制造Computer Aided Engineering CAE计算机辅助工程Computer Aided Instruction CAI计算机辅助教学Computer Aided Testing CAT计算机辅助测试GIS地理信息系统计算机分类:Mainframe大型主机Minicomputer小型计算机/迷你电脑Personal Computer个人计算机,Microcomputer微型计算机Workstation工作站Supercomputer巨型计算机/超级计算机Minisuper小巨型计算机/小超级计算机服务器按处理器体系结构划分:Complex Instruction Set Computer CISC复杂指令集计算机Reduced Instruction Set Computer RISC精简指令集计算机Very Long Instruction Word VLIW超长指令字Explicitly Parallel Instruction Computing EPIC清晰并行指令计算/简明平行指令计算Intel Architecture IA英特尔架构Blade Serer刀片式服务器计算机分类:Server服务器Workstation工作站Desktop PC台式机Notebook笔记本,Mobile PC便携机/移动PCHandheld PC掌上电脑,Sub-Notebook亚笔记本Ultra Mobile PC UMPC超便携计算机PDA个人数字助理LCD液晶显示器Serial Advanced Technology Attachment SATA串行高级技术附件Serial Attached SCSI串行SCSI硬盘Redundant Array Of Independent Disks RIAD独立磁盘冗余阵列,Disk Array磁盘阵列计算机的技术指标:Million Instruction Per Second,MIPS,单字长定点指令的平均执行速度Million Floating Instruction Per Second,MFLOPS,单字长浮点指令的平均执行速度Bits Per Second,Bps,每秒传输位数Mean Time Between Failure,MTBF,平均无故障时间Mean Time To Repair,MTTR,平均故障修复时间奔腾芯片的技术特点:Superscalar超标量Superpipeline,超流水线Peripheral Component Interconnect,PCI,外围部件互联Video Electronic Standard Association,VESA,视频电子标准协会Streaming SIMD Extension,SSE,流式的单指令流、多数据流扩展指令Mainboard主板、主机板,Motherboard,母版Adapter Card网卡、适配卡软件按授权方式分类:Commercial-Ware商业软件Share Ware共享软件Freeware自由软件信息的形式:Number数字Text文本Graphic图形Image图像Sound声音Media媒体Multimedia多媒体Videodisk视频光盘Speech语音Audio音响Multimedia PC,MPC,多媒体计算机Media Player媒体播放器Sound Recorder录音机Object Linking And Embedding,OLE,对象链接和嵌入数据压缩编码方法:Source Coding源编码Hybrid Coding混合编码Entropy Coding信息熵编码法Huffman Coding哈尔曼编码Run Length Coding游程编码Arithmetic Coding算术编码Prediction Coding预测编码法Differential Pulse Code Modulation,DPCM,微分脉码调制Delta Modulation,DM,Δ调制Transformation Coding变换编码法Discrete Fourier Transform,DFT,离散傅里叶变换Discrete Cosine Transform,DCT,离散余弦变换Discrete Hadamard Transform,DHT,离散哈达玛变换Vector Quantization Coding矢量量化编码法Joint Photographic Experts Group,JPEG,联合图像专家组International Organization For Standardization,ISO,国际标准化组织CCITT国际电报电话咨询委员会Baseline Sequential Codec基线顺序编解码Moving Picture Experts Group,MPEG,运动图像专家组HDTV高清晰度电视ITU国际电信联盟ISDN综合业务数字网IECNode结点Link链接Streaming Media流媒体第二章网络技术基础Advanced Research Projects Agency,ARPA,美国国防部高级研究计划局System Network Architecture,SNA,系统网络体系结构Distributed Computer Architecture,DCA,数字网络体系结构Open System Interconnection,OSI,开放系统互连Ethernet以太网Token Bus令牌总线Token Ring令牌环Fiber Distributed Data Interface,FDDI,光纤分布式数据接口National Information Infrastructure,NII,国家信息基础设施Global Information Infrastructure Committee,GIIC,全球信息基础设施委员会B-ISDN宽带业务综合数据网ATM异步传输模式IEEE美国电子电气工程师协会PSTN公用电话交换网CNNIC中国互联网网络信息中心计算机网络按覆盖的地理范围分类:Local Area Network,LAN,局域网Metropolitan Area Network,MAN,城域网Wide Area Network,WAN,广域网CATV有线电视网Nyquist奈奎斯特Shannon香农Circuit Switching电路交换Store-And-Forward Switching存储转发交换Message Switching报文交换Packet Switching报文分组交换Datagram,DG,数据报Virtual Circuit,VC,虚电路Message报文Packet报文分组Protocol协议Network Architecture计算机网络体系结构Implementation实现Interconnection互连性Interoperation互操作性Portability可移植性Service Definition服务定义Protocol Specification协议规格说明Physical Layer物理层Data Link Layer数据链路层Network Layer网络层Transport Layer传输层Session Layer会话层Presentation Layer表示层Application Layer应用层End-To-End端到端User Agent用户代理FTAM文件传送访问和管理VT虚拟终端TP事务处理RDA远程数据库访问MMS制造业报文规范Intercommunication互通Internet Layer互联层Host-To-Network Layer主机-网络层Transport Control Protocol,TCP,传输控制协议User Datagram Protocol,UDP,用户数据报协议Byte Stream字节流Byte Segment字节段Telnet远程登录协议File Transfer Protocol,FTP,文件传输协议Simple Mail Transfer Protocol,SMTP,简单邮件传输协议Domain Name Service,DNS,域名服务Router Information Protocol,RIP,路由信息协议Network File System,NFS,网络文件系统Hypertext Transfer Protocol,HTTP,超文本传输协议Page页面Web Site Web站点CERN欧洲粒子物理实验室Podcast播客Blog,Weblog博客,网络日志,网志Internet Protocol Television,IPTV,互联网协议电视/网络电视:Video On Demand,VOD,视频点播技术Live TV直播电视Time Shift TV时移电视Instant Messaging,IM,即时通信Wireless MAN,WMAN,无线城域网Bluetooth蓝牙Personal Operating Space,POS,个人操作空间Personal Area Network,PAN,个人区域网络Wireless Personal Area Network,WPAN,无线个人区域网络Mobile Ad Hoc Network,MANET,移动Ad Hoc网络Wireless Sensor Network,WSN,无线传感器网络Packet Radio Network,PRNET,分组无线网第三章局域网基础Fast Ethernet,FE,快速以太网Gigabit Ethernet,GE,千兆以太网Collision冲突Media Access Control,MAC,介质访问控制Logical Link Control,LLC,逻辑链路控制WG工作组TAG技术行动组Carrier Sense Multiple Access With Collision Detection,CSMA/CD,带冲突检测的载波侦听多路访问Truncated Binary Exponential Backoff截止二进制指数后退延迟Unicast Address单一节点地址Multicast Address多点地址Broadcast Address广播地址FCS帧校验字段CRC循环冗余校验Registration Authority Committee,RAC,注册管理委员会Company-Id公司标识Organizationally Unique Identifier,OUI,机构唯一标识符Extended Unique Identifier扩展的唯一标识符EPROM网卡的只读存储器Share LAN共享式局域网Switched LAN交换式局域网Media Independent Interface,MII,介质独立接口Gigabit Media Independent Interface,GMII,千兆介质独立接口High Speed Study Group,HSSG,高速研究组Switched Ethernet交换式以太网Ethernet Switch以太网交换机Hub集线器Cut Through直通Store And Forward存储转发Virtual Network虚拟网络Virtual LAN,VLAN,虚拟局域网Nomadic Access漫游访问Infrared Radio,IR,红外无线Channel Encoder信道编码器Frequence Hopping Spread Spectum,FHSS,跳频扩频通信Direct Sequence Spread Spectrum,DSSS,直接序列扩频Point Coordination Function,PCF,点协调功能Distributed Coordination Function,DCF,分布协调功能Collision Avoidance,CA,冲突避免Interframe Space,IFS,帧间间隔Bridge网桥网桥按路由表的建立方法分类:Transparent Bridge透明网桥Source Routing Bridge源路由网桥Spanning Tree生成树Discovery Frame发现帧第四章服务器操作系统Network Operating System,NOS,网络操作系统Process进程File Handle文件句柄File Allocation Table,FAT,文件表Virtual File Allocation Table,VFAT,虚拟文件表High Performance File System,HPFS,高性能文件系统Basic Input/Output System,BIOS,基本输入/输出系统Graphics Device Interface,GDI,图形设备接口Application Programming Interface,API,应用编程接口Kernel内核Monolithic Kernel单内核Microkernel微内核Nanokernel超微内核Exokernel外核Hardware Abstract Layer,HAL,硬件抽象层Directory Service,DS,目录服务Network Server网络服务器Network Station网络工作站网络操作系统的基本功能:File Service文件服务Print Service打印服务Database Service数据库服务Communication Service通信服务Message Service信息服务Distributed Service分布式服务Network Management Service网络管理服务IntranetSQL结构化查询语言Graphic User Interface,GUI,图形用户界面Domain域Primary Domain Controller主域控制器Backup Domain Controller备份域控制器Thread线程Preemptive抢占式NDIS网络驱动接口规范TDI传输驱动接口Netbeui扩展用户接口Active Directory Manager活动目录管理Tree域树Forest域森林Organizational Unit,OU,组织单元Role角色DEP数据执行保护NAP网络访问保护NAT自动网络地址转换Server Core服务器内核Powershell外壳Business Intelligence,BI,商务智能Netware Core Protocol,NCP,Netware核心协议System Failure Tolerance,SFT,系统容错File Server Mirroring文件服务器镜像Transaction Tracking System,TTS,事物跟踪系统Novell Directory Services,NDS,Novell目录服务Swapping对换Independent Software Vendors,ISV,独立软件厂商Dynamic Logic Partition动态处理器备用SWA软件助手OE操作环境第五章Internet基础ISP互联网服务提供商Remote Access Server远程访问服务器Modem调制解调器ADSL非对称数字用户线路Hybrid Fiber Coaxial,HFC,混合光纤同轴电缆网Cable TV,CATV,有线电视网DDNATMNetid网络号Hosted主机号NATAddress Resolution Protocol,ARP,地址解析协议Dynamic Binding动态绑定Cache缓存区Datagram数据报Maximum Transmission Unit,MTU,最大传输单元源路由选项的分类:Strict Source Route严格源路由选项Loose Source Route松散源路由选项Time Stamp时间戳Universal Time格林尼治时间Internet Control Message Protocol,ICMP,互联网控制报文协议Source Quench源站抑制Routing路由选择Router路由器Metric度量值度量值中经常使用的特征:Hop Count跳数Bandwidth带宽Delay延迟Load负载Reliability可靠性Cost开销应用最广的路由选择协议:Routing Information Protocol,RIP,路由信息协议Open Shortest Path First,OSPF,开放式最短路径优先协议Vector-Distance,V-D,向量-距离,Bellman-FordLink-Status,L-S,链路-状态Convergence收敛CIDR无类域间寻址DHCP动态主机配置协议Qos服务质量保证TCP提供的服务的特征:Connection Orientation面向连接Complete Reliability完全可靠性Full Duplex Communication全双工通信Stream Interface流接口Reliable Connection Startup&Graceful Connection Shutdown连接的可靠建立和优雅关闭Retransmission重发Acknowledgement确认Round Trip Time,RTT,往返时间3-Way Handshake3次握手Window窗口Well-Known Port著名端口第六章Internet基本服务服务器处理多个并发请求的方案:Iterative Server重复服务器Concurrent Server并发服务器First In,First Out先进先出Daemon守护进程Master主服务器Slave从服务器Worm蠕虫互联网的命名机制:Flat Naming无层次命名机制Hierarchy Naming层次型命名机制Label标号Domain域域名解析的两种方式:Recursive Resolution递归解析Iterative Resolution反复解析资源记录的组成:Domain Name域名Time To Live,TTL,最大生存周期,有效期Type类型Class类别Value(域名的)具体值Network Virtual Terminal,NVT,网络虚拟终端Real Terminal实终端数据连接建立的模式:Active主动模式Passive被动模式电子邮件传输协议:Simple Mail Transfer Protocol,SMTP,简单邮件传输协议Post Office Protocol,POP,邮局协议Interactive Mail Access Protocol,IMAP,RFC822将电子邮件报文分为两部分:Mail Header邮件头Mail Body邮件体Multipurpose Internet Mail Extensions,MIME,多用途Internet邮件扩展MIME-Version版本号Content-Type数据类型Content-Transfer-Encoding数据编码类型Quoted-Printable打印编码World Wide Web,WWW,European Center For Nuclear Research,CERN,欧洲核物理研究中心Hyper Text Markup Language,HTML,超文本标记语言Uniform Resource Locator,URL,统一资源定位符History历史Bookmark书签Default默认状态Tag标记Attitude属性Secure Sockets Layer,SSL,安全套接层NTFS第七章网络管理与网络安全网络管理的功能:Configuration Management配置管理Fault Management故障管理Accounting Management计费管理Performance Management性能管理Security Management安全管理NME网管代理模块IETF Internet工程任务组SNMP简单网络管理协议Manager管理者Agent代理者Polling轮询Interrupt-Based基于中断MIB管理信息库Trap-Directed Polling陷入制导轮询方法CIMP公共管理信息协议Association Control Protocol,ACP,联系控制协议Remote Operation Protocol,ROP,远程操作协议Protocol Data Unit,PDU,协议数据单元NCSC国家计算机安全中心Trusted Computer Standard Evaluation Criteria可信任计算机标准评估准则Orange Book橘皮书Dos拒绝服务Ddos分布式拒绝服务DES数据加密标准DEA数据加密算法AES高级加密算法RSANIST美国国家标准和技术研究所Key Distribution Center,KDC,密钥分发中心Certification Authority,CA,认证中心信息完整性认证方法:Massage Authentication Code,MAC,消息认证码Manipulation Detection Code,MDC,篡改检测吗认证函数:Message Encryption Function,MEF,信息加密函数Massage Authentication Code,MAC,信息认证码Hash Function散列函数DSS数字签名标准Token持证MIT麻省理工学院安全电子邮件常用技术:Pretty Good Privacy,PGP,非常好的私密性Secure/Multipurpose Internet Mail Extension,S/MIME,安全/通用Internet邮件扩充Passphrase口令短语Clear-Signed透明签名Ipsec IP安全协议:Authentication Head,AH,身份认证头Encapsulation Security Payload,ESP,封装安全负载TLS运输层安全Internetwork Security Monitor,互联网安全监视器HAR主机审计记录Generic Decryption,GD,类属解密第八章网络应用技术Multicast Backbone,Mbone,组播主干网Unicast单播Broadcast广播Multicast组播IANA管理局组播的相关协议:Internet Group Management Protocol,IGMP,互联网组管理协议CGMPRouter-Port Group Management Protocol,RGMP,路由器-端口组管理协议Dense-Mode Multicast Routing Protocol密集模式组播路由协议Flooding洪泛Distance Vector Multicast Routing Protocol,DVMRP,距离矢量组播路由协议Multicast For Open Shortest Path First,MOSPF,开放最短路径优先的组播扩展协议Protocol Independent Multicast-Dense Mode,PIM-DM,独立组播密集模式Core Based Trees,CBT,基于核心的Multiprotocol Border Gateway Protocol,MBGP,多协议边界网关协议Multicast Source Discovery Protocol,MSDP,组播源发现协议Centralized Topology集中式拓扑结构Decentralized Unstructured Topology分布式非结构化拓扑Distributed Hash Table,DHT,分布式散列表Node ID结点标识符Object ID资源标识符Chum波动Hybrid Structure混合式结构Instant Messaging And Presence Protocol Working Group,IPPWG,IMPP工作小组Request For Comment,RFC,请求评论Internet Engineering Task Force,IETF,Internet工程任务组IM系统的附加功能:Voice/Video Chat音频/视频聊天Application Sharing应用共享File Transfer文件传输File Sharing文件共享Game Request游戏邀请Remote Assistance远程助理Whiteboard白板Session会话Session Initiation Protocol,SIP,会话初始化协议SIP For Instant Messaging And Presence Leverage Extension,SIMPLEExtensible Messaging And Presence Protocol,XMPP,SIP系统的组成:User Agent用户代理User Agent Client,UAC,用户代理客户机User Agent Server,UAS,用户代理服务器Proxy Server代理服务器Redirect Server重定向服务器Registrar注册服务器SIP消息的类型:Request请求Response响应SIP消息的组成:Start-Line起始行Field字段Message Body消息体Entity Header实体头Request-Line请求行Status-Line状态行Message Session Relay Protocol,MSRP,消息中断协议Presence Information呈现信息Presence Service呈现服务呈现服务包括:Presence User Agent,PUA,呈现用户代理Presence Agent,PA,呈现代理Presence Server,PS,呈现服务器Watcher申请者Set Top Box机顶盒Near Video On Demand,NVOD,就近式点播电视True Video On Demand,TVOD,真实点播电视Interactive Video On Demand,IVOD,交互式点播电视Voice Over IP,Voip,IP电话,Internet Protocol PhoneIP电话的实现方法:PC-to-PCPC-to-PhonePhone-to-PhoneIP电话的组成:Terminal终端设备Gateway网关Multipoint Control Unit,MCU,多点控制单元Gatekeeper网守Common Gate Interface,CGI,公共网关接口Page Rank网页等级Store Server存储服务器Searcher搜索器Spiders蜘蛛/搜索器Robot机器人/搜索器Crawlers爬虫/搜索器Indexer索引器Sorter排序器Repository知识库Work Stemming词干法Word Truncation截词Link popularity链接流行度Hyperlink超链接。