自动驾驶核心技术之三:环境感知

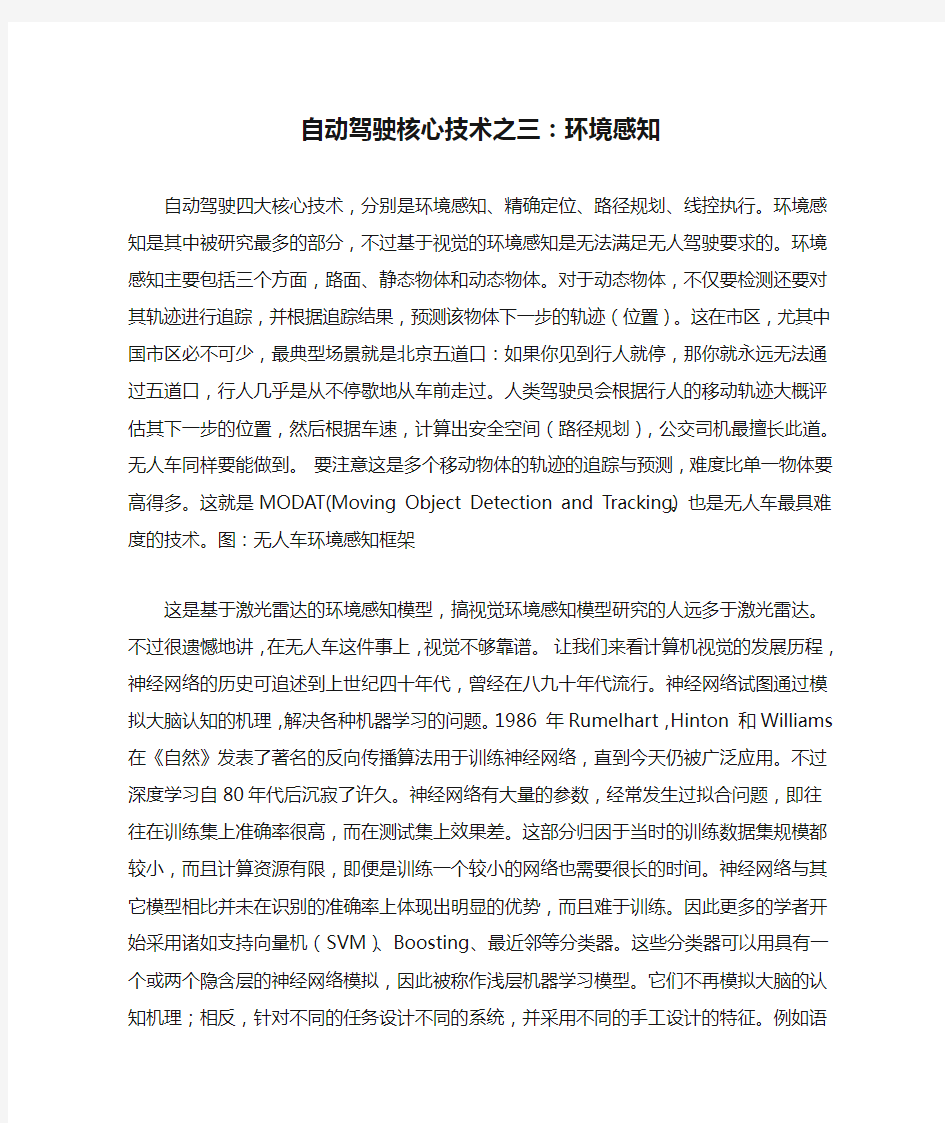

自动驾驶四大核心技术,分别是环境感知、精确定位、路径规划、线控执行。环境感知是其中被研究最多的部分,不过基于视觉的环境感知是无法满足无人驾驶要求的。环境感知主要包括三个方面,路面、静态物体和动态物体。对于动态物体,不仅要检测还要对其轨迹进行追踪,并根据追踪结果,预测该物体下一步的轨迹(位置)。这在市区,尤其中国市区必不可少,最典型场景就是北京五道口:如果你见到行人就停,那你就永远无法通过五道口,行人几乎是从不停歇地从车前走过。人类驾驶员会根据行人的移动轨迹大概评估其下一步的位置,然后根据车速,计算出安全空间(路径规划),公交司机最擅长此道。无人车同样要能做到。要注意这是多个移动物体的轨迹的追踪与预测,难度比单一物体要高得多。这就是MODAT(Moving Object Detection and Tracking)。也是无人车最具难度的技术。图:无人车环境感知框架

这是基于激光雷达的环境感知模型,搞视觉环境感知模型研究的人远多于激光雷达。不过很遗憾地讲,在无人车这件事上,视觉不够靠谱。让我们来看计算机视觉的发展历程,神经网络的历史可追述到上世纪四十年代,曾经在八九十年代流行。神经网络试图通过模拟大脑认知的机理,解决各种

机器学习的问题。1986 年Rumelhart,Hinton 和Williams 在《自然》发表了著名的反向传播算法用于训练神经网络,直到今天仍被广泛应用。不过深度学习自80年代后沉寂了许久。神经网络有大量的参数,经常发生过拟合问题,即往往在训练集上准确率很高,而在测试集上效果差。这部分归因于当时的训练数据集规模都较小,而且计算资源有限,即便是训练一个较小的网络也需要很长的时间。神经网络与其它模型相比并未在识别的准确率上体现出明显的优势,而且难于训练。因此更多的学者开始采用诸如支持向量机(SVM)、Boosting、最近邻等分类器。这些分类器可以用具有一个或两个隐含层的神经网络模拟,因此被称作浅层机器学习模型。它们不再模拟大脑的认知机理;相反,针对不同的任务设计不同的系统,并采用不同的手工设计的特征。例如语音识别采用高斯混合模型和隐马尔可夫模型,物体识别采用SIFT 特征,人脸识别采用LBP 特征,行人检测采用HOG 特征。2006年以后,得益于电脑游戏爱好者对性能的追求,GPU性能飞速增长。同时,互联网很容易获得海量训练数据。两者结合,深度学习或者说神经网络焕发了第二春。2012 年,Hinton 的研究小组采用深度学习赢得了ImageNet 图像分类的比赛。从此深度学习开始席卷全球,到今天,你不说深度学习都不好出街了。深度学习与传统模式识别方法的最大不同在于它是从大数据中自动学习特征,而非采用手工设

计的特征。好的特征可以极大提高模式识别系统的性能。在过去几十年模式识别的各种应用中,手工设计的特征处于统治地位。它主要依靠设计者的先验知识,很难利用大数据的优势。由于依赖手工调参数,特征的设计中只允许出现少量的参数。深度学习可以从大数据中自动学习特征的表示,其中可以包含成千上万的参数。手工设计出有效的特征是一个相当漫长的过程。回顾计算机视觉发展的历史,往往需要五到十年才能出现一个受到广泛认可的好的特征。而深度学习可以针对新的应用从训练数据中很快学习得到新的有效的特征表示。一个模式识别系统包括特征和分类器两个主要的组成部分,二者关系密切,而在传统的方法中它们的优化是分开的。在神经网络的框架下,特征表示和分类器是联合优化的。两者密不可分。深度学习的检测和识别是一体的,很难割裂,从一开始训练数据即是如此,语义级标注是训练数据的最明显特征。绝对的非监督深度学习是不存在的,即便弱监督深度学习都是很少的。因此视觉识别和检测障碍物很难做到实时。而激光雷达云点则擅长探测检测障碍物3D轮廓,算法相对深度学习要简单的多,很容易做到实时。激光雷达拥有强度扫描成像,换句话说激光雷达可以知道障碍物的密度,因此可以轻易分辨出草地,树木,建筑物,树叶,树干,路灯,混凝土,车辆。这种语义识别非常简单,只需要根据强度频谱图即可。而视觉来说要准确的识别,非常耗

时且可靠性不高。视觉深度学习最致命的缺点是对视频分析能力极弱,而无人车面对的视频,不是静态图像。而视频分析正是激光雷达的特长。视觉深度学习在视频分析上处于最初的起步阶段,描述视频的静态图像特征,可以采用从ImageNet 上学习得到的深度模型;难点是如何描述动态特征。以往的视觉方法中,对动态特征的描述往往依赖于光流估计,对关键点的跟踪,和动态纹理。如何将这些信息体现在深度模型中是个难点。最直接的做法是将视频视为三维图像,直接应用卷积网络,在每一层学习三维滤波器。但是这一思路显然没有考虑到时间维和空间维的差异性。另外一种简单但更加有效的思路是通过预处理计算光流场,作为卷积网络的一个输入通道。也有研究工作利用深度编码器(deep autoencoder)以非线性的方式提取动态纹理,而传统的方法大多采用线性动态系统建模。光流只计算相邻两帧的运动情况,时间信息也表述不充分。two-stream只能算是个过渡方法。目前CNN搞空域,RNN搞时域已经成共识,尤其是LSTM 和GRU结构的引入。RNN在动作识别上效果不彰,某些单帧就可识别动作。除了大的结构之外,一些辅助的模型,比如visual hard/soft attention model,以及ICLR2016上的压缩神经网络都会对未来的深度学习视频处理产生影响。目前深度学习对视频分析还不如手工特征,而手工特征的缺点,前面已经说过,准确率很低,误报率很高。未来恐怕也难以

提升。太多的坑要填。MODAT首先要对视频分析,实时计算出地平面,这对点云为主的激光雷达来说易如反掌,对视觉来说难比登天。

用分段平面拟合和RANSAC算法计算出真实地平面。实际单靠激光雷达的强度扫描成像,一样可以得出准确的地平面,这也是激光雷达用于遥感的主要原因,可以排除植被的干扰,获得准确的地形图,大地基准面。

用VOXEL GRID滤波器将动静物体分开,黑棕蓝绿是激光雷达发射到行人身上的每个时间段的假设,与动态物体比,静态物体捕获的点云数自然要多。

左边是深度学习领域人尽皆知的权威Kitti数据集的采集车,右边是数据集的数据格式和内容。Kitti对其Ground Truth有一段描述,To generate 3D object ground-truth we hired a set of annotators, and asked them to assign tracklets in the form of 3D bounding boxes to objects such as cars, vans, trucks,trams, pedestrians and cyclists. Unlike most existing benchmarks, we do not rely on online crowd-sourcing to perform the labeling. Towards this goal, we create a special purpose labeling tool, which displays 3D laser points as well as the camera images to increase the quality of the annotations.这里Kitti说的很明确,其训练数据的标签加注不是人工众包,而是打造了一个自动标签软件,这个软件把3D激光云点像光学图像一样显示出

来,以此来提高标注的质量。很简单,激光雷达是3D Object Detection的标准,即使视觉深度学习再强大,与激光雷达始终有差距。再来说一下Stixel(sticks above the ground in the image),中文一般叫棒状像素,这是2008年由奔驰和法兰克福大学Hern′an Badino教授推出的一种快速实时检测障碍物的方法,尤其适合检测行人,每秒可做到150甚至200帧,这也是奔驰和宝马双目的由来。Hern′an Badino后来被卡梅隆大学的机器人实验室挖走了,Uber的无人车主要就是基于卡梅隆大学机器人实验室开发的。Stixel的核心是计算棒状物的上下边缘和双目视差,构建一个Stixel,可以准确快速地检测障碍物,特别是行人。这是奔驰宝马大规模使用双目的主要原因,相对单目的行人识别,双目Stixel拥有碾压性优势。

激光雷达的3D距离信息更容易获得,也更准确,因此建立Steixel更加快捷准确。现在该说Tracking了,现在不少人把跟踪(tracking)和计算机视觉中的目标跟踪搞混了。前者更偏向数学,是对状态空间在时间上的变化进行建模,并对下一时刻的状态进行预测的算法。例如卡尔曼滤波,粒子滤波等。后者则偏向应用,给定视频中第一帧的某个物体的框,由算法给出后续帧中该物体的位置。最初是为了解决检测算法速度较慢的问题,后来慢慢自成一系。因为变成了应用问题,所以算法更加复杂,通常由好几个模块组成,其中也包括数

学上的tracking算法,还有提取特征,在线分类器等步骤。在自成一系之后,目标跟踪实际上就变成了利用之前几帧的物体状态(旋转角度,尺度),对下一帧的物体检测进行约束(剪枝)的问题了。它又变回物体检测算法了,但却人为地把首帧得到目标框的那步剥离出来。在各界都在努力建立

end-to-end系统的时候,目标跟踪却只去研究一个子问题,选择性无视'第一帧的框是怎么来的'的问题。激光雷达的Tracking则很容易做到,以IBEO为例,IBEO每一款激光雷达都会附送一个叫IBEO Object Tracking的软件,这是一个基于开曼滤波器的技术,最多可实时跟踪65个目标,是实时哟,这可是视觉类根本不敢想的事。Quanergy也有类似的软件,叫3D Perception。

感知、决策(路径规划)、定位都是基于传感器或软件系统的,这也是科技类厂家的强项,不过线控执行系统则是传统汽车产业(不一定是整车厂)的绝对强项,这也是科技类厂家注定无法独立造车的主要原因,无论是谷歌还是百度,都必须要与传统汽车产业联合,才能进军无人车领域。下一节,我们就说说线控执行。

近期活动:2016汽车传感器与汽车人工智能论坛(AUTOSAI)

时间:2016年11月24日-25日地点:北京圣龙翔会议中心一、部分特邀演讲嘉宾

二、论坛研讨主题三、报名方式:

项目二、智能网联汽车环境感知系统 【教学目标】 通过本章的学习,要求学生能够掌握智能网联汽车环境感知的定义、组成以及各种传感器的用途,熟悉超声波传感器、毫米波雷达、激光雷达和视觉传感器的类型、特点及应用;对道路识别、车辆识别、行人识别、交通标志识别和交通信号灯识别有一个初步了解。【教学要求】 未来智能网联汽车能够在道路上有序地安全行驶,特别是无人驾驶汽车,不依赖驾驶员,汽车也能安全行驶,如图2-1所示。 图2-1 无人驾驶汽车安全行驶 智能网联汽车或无人驾驶汽车依靠什么技术进行安全行驶的?如何对道路、车辆、行人、交通标志、交通信号灯等进行检测和识别?通过本章的学习,读者可以得到答案。

练习与实训 一、名词解释 1.超声波传感器 2.毫米波雷达 3.激光雷达 4.视觉传感器 5.传感器融合 二、填空题 道路识别。 三、选择题 1. L3级以上自动驾驶必不可少的传感器是()。 A.超声波传感器 B.毫米波雷达 C.激光雷达 D.视觉传感器 2.不适合作盲区监测系统传感器的是()。 A.近距离毫米波雷达 B.中距离毫米波雷达 C.远距离毫米波雷达 D.视觉传感器 3. 在基于特征的交通标志识别中,一般哪个不作为特征()。 A.颜色特征 B.形状特征 C.纹理特征 D.空间关系特征 4. 行人识别常用的传感器是()。 A.超声波传感器 B.毫米波雷达 C.激光雷达 D.视觉传感器 5.智能网联汽车最常见的传感器融合是()。

A.毫米波雷达与激光雷达的融合 B.毫米波雷达与超声波传感器的融合 C.毫米波雷达与视觉传感器的融合 D.激光雷达与视觉传感器的融合 四、问答题 1.智能网联汽车的环境感知系统中的惯性元件和定位导航,主要作用是什么? 2.毫米波雷达在智能网联汽车上的应用主要有哪些? 3. 少线束激光雷达和多线束激光雷达,在应用上有什么区别? 4. 视觉传感器在无人驾驶汽车上,能够实现哪些功能? 5. 运动车辆识别方法主要有哪些?

无人驾驶关键技术分析 无人驾驶技术是传感器、计算机、人工智能、通信、导航定位、模式识别、机器视觉、智能控制等多门前沿学科的综合体。按照无人驾驶汽车的职能模块,无人驾驶汽车的关键技术包括环境感知、导航定位、路径规划、决策控制等。 (1)环境感知技术 环境感知模块相当于无人驾驶汽车的眼和耳,无人驾驶汽车通过环境感知模块来辨别自身周围的环境信息。为其行为决策提供信息支持。环境感知包括无人驾驶汽车自身位姿感知和周围环境感知两部分。单一传感器只能对被测对象的某个方面或者某个特征进行测量,无法满足测量的需要。因而,必需采用多个传感器同时对某一个被测对象的一个或者几个特征量进行测量,将所测得的数据经过数据融合处理后。提取出可信度较高的有用信号。按照环境感知系统测量对象的不同,我们采用两种方法进行检测:无人驾驶汽车自身位姿信息主要包括车辆自身的速度、加速度、倾角、位置等信息。这类信息测量方便,主要用驱动电机、电子罗盘、倾角传感器、陀螺仪等传感器进行测量。 无人驾驶汽车周围环境感知以雷达等主动型测距传感器为主,被动型测距传感器为辅,采用信息融合的方法实现。因为激光、雷达、超声波等主动型测距传感器相结合更能满足复杂、恶劣条件下,执行任务的需要,最重要的是处理数据量小,实时性好。同时进行路径规划时可以直接利用激光返回的数据进行计算,无需知道障碍物的具体信息。 而视觉作为环境感知的一个重要手段,虽然目前在恶劣环境感知中存在一定问题。但是在目标识别、道路跟踪、地图创建等方面具有其他传感器所无法取代的重要性,而在野外环境中的植物分类、水域和泥泞检测等方面,视觉也是必不可少的手段。 (2)导航定位技术 无人驾驶汽车的导航模块用于确定无人驾驶汽车其自身的地理位置,是无人驾驶汽车的路径规划和任务规划的之支撑。导航可分为自主导航和网络导航两种。 自主导航技术是指除了定位辅助之外,不需要外界其他的协助,即可独立完成导航任务。自主导航技术在本地存储地理空间数据,所有的计算在终端完成,在任何情况下均可实现定位,但是自主导航设备的计算资源有限,导致计算能力差,有时不能提供准确、实时的导航服务。现有自主导航技术可分为三类:相对定位:主要依靠里程计、陀螺仪等内部感受传感器,通过测量无人车相对于初始位置的位移来确定无人车的当前位置。 绝对定位:主要采用导航信标.主动或被动标讽地图匹配或全球定位系统进行定位。 组合定位:综合采用相对定位和绝对定位的方法,扬长避短,弥补单一定位方法的不足。组合定位方案一般有GPs+地图匹配、GPs+航迹推算、GPs+航迹推算+地图匹配、GPs+GLONAss+惯性导航+地图匹配等。

人工智能或许会成为第四次工业革命的核心技术 现今,人工智能在世界范围内的重视程度早已不亚于能源研究了,而人工智能的普及也将成为科学发展的必然趋势,因此人工智能或许会成为第四次工业革命的核心技术,我相信未来巨大的投资机会就在其中。 今天的世界仍朝着美好的未来积极进取,而激烈的社会斗争却成为了人类美好愿望的绊脚石,经济危机的漩涡将世界搅得不得安宁,贫穷,战乱,饥饿在21世纪的今天仍随处可见。在国际关系混乱不堪,经济压力日益凸显,社会资源分配不均的今天,我们需要一次全面的工业革命来提高生产力,提高经济效益以应对目前尖锐的社会矛盾。 第一次工业革命将人类推向崭新的蒸汽动力时代,实现了机械自动化基本取代人力畜力,大大提高了社会生产力。而第二次工业革命则是将人类带入了新能源时代,电气,化石燃料第一次投入生产使用。第三次工业革命让人类全面走向科技时代,航天技术,生物克隆技术,信息技术在这一时代如雨后春笋般欣欣向荣,蓬勃发展。2014年德国汉诺威工业博览会提出,还未到来的第四次工业革命必将以深度网络化,数字化及机器自组织为核心内容,人类或许将由此进入数据时代。 人类生产不同类型的计算机,各司其职。某些特定功能的计算机可以通过一个新的专业维度感知周围事物,并获取主要信息,将之反馈到数据处理中心,通过人类收集的大数据不断计算,分析并得出最

优处理方案,然后通过输出特殊指令完成某项工作。不同的处理结果将再次反馈至数据处理中心,进行各项指令的微调。这样不断的调整使得计算机得出自己对指令的理解,当计算机拥有独特且准确的处理方案时,它便掌握了这项技能。计算机对不断分析数据、积累知识,它的智能水平也就越来越高。 各个简单的指令有序的组合即可完成某些复杂的程序,人工智能也能模拟人类自主思维甚至超越人类。谷歌人工智能系统“阿尔法围棋”终以4比1胜韩国职业棋手李世石九段的比赛,引起了世界的关注。这让人看到了人工智能技术的发展,真是到了让人震撼的程度。新的时代,机器通过不断地吃进数据和提高技能,能够取代很多电脑做的有智能的工作。机器人工智能的提高更好的为人类服务,另一方面也给人类带来深深地隐忧,到2020年将造成全球逾500万人失业。 除此之外,2014年谷歌公司宣布自动驾驶汽车成功行驶20万公里,并于2015年取得美国首个自动驾驶车辆许可证。这样的消息也推动了汽车行业的一次重要改革,同年中国互联网巨头百度公司也宣布与宝马公司合作研发自动驾驶技术。新型的自动化汽车或许将于不久后向市场推广,其优越的安全性能,低耗能将成功的吸引大众的眼球,这也预示着自动化汽车将会在世界范围内普及。 人工智能将会渗透入各个方面,机器翻译,智能控制,语言及图像理解,自动程序设计,航天应用,军事领域,信息储存,科学研究甚至其他的人类无法执行的复杂且庞大的任务。 人工智能将以其优越的服务能力基本取代人类服务,带来危险的

无人驾驶关键技术分析-标准化文件发布号:(9456-EUATWK-MWUB-WUNN-INNUL-DDQTY-KII

无人驾驶关键技术分析 无人驾驶技术是传感器、计算机、人工智能、通信、导航定位、模式识别、机器视觉、智能控制等多门前沿学科的综合体。按照无人驾驶汽车的职能模块,无人驾驶汽车的关键技术包括环境感知、导航定位、路径规划、决策控制等。 (1)环境感知技术 环境感知模块相当于无人驾驶汽车的眼和耳,无人驾驶汽车通过环境感知模块来辨别自身周围的环境信息。为其行为决策提供信息支持。环境感知包括无人驾驶汽车自身位姿感知和周围环境感知两部分。单一传感器只能对被测对象的某个方面或者某个特征进行测量,无法满足测量的需要。因而,必需采用多个传感器同时对某一个被测对象的一个或者几个特征量进行测量,将所测得的数据经过数据融合处理后。提取出可信度较高的有用信号。按照环境感知系统测量对象的不同,我们采用两种方法进行检测:无人驾驶汽车自身位姿信息主要包括车辆自身的速度、加速度、倾角、位置等信息。这类信息测量方便,主要用驱动电机、电子罗盘、倾角传感器、陀螺仪等传感器进行测量。 无人驾驶汽车周围环境感知以雷达等主动型测距传感器为主,被动型测距传感器为辅,采用信息融合的方法实现。因为激光、雷达、超声波等主动型测距传感器相结合更能满足复杂、恶劣条件下,执行任务的需要,最重要的是处理数据量小,实时性好。同时进行路径规划时可以直接利用激光返回的数据进行计算,无需知道障碍物的具体信息。 而视觉作为环境感知的一个重要手段,虽然目前在恶劣环境感知中存在一定问题。但是在目标识别、道路跟踪、地图创建等方面具有其他传感器所无法取代的重要性,而在野外环境中的植物分类、水域和泥泞检测等方面,视觉也是必不可少的手段。 (2)导航定位技术 无人驾驶汽车的导航模块用于确定无人驾驶汽车其自身的地理位置,是无人驾驶汽车的路径规划和任务规划的之支撑。导航可分为自主导航和网络导航两种。 自主导航技术是指除了定位辅助之外,不需要外界其他的协助,即可独立完成导航任务。自主导航技术在本地存储地理空间数据,所有的计算在终端完成,在任何情况下均可实现定位,但是自主导航设备的计算资源有限,导致计算能力差,有时不能提供准确、实时的导航服务。现有自主导航技术可分为三类: 相对定位:主要依靠里程计、陀螺仪等内部感受传感器,通过测量无人车相对于初始位置的位移来确定无人车的当前位置。 绝对定位:主要采用导航信标.主动或被动标讽地图匹配或全球定位系统进行定位。 组合定位:综合采用相对定位和绝对定位的方法,扬长避短,弥补单一定位方法的不足。组合定位方案一般有GPs+地图匹配、GPs+航迹推算、GPs+航迹推算+地图匹配、GPs+GLONAss+惯性导航+地图匹配等。

无人驾驶关键技术分析三篇 篇一:无人驾驶关键技术分析 无人驾驶技术是传感器、计算机、人工智能、通信、导航定位、模式识别、机器视觉、智能控制等多门前沿学科的综合体。按照无人驾驶汽车的职能模块,无人驾驶汽车的关键技术包括环境感知、导航定位、路径规划、决策控制等。(1)环境感知技术 环境感知模块相当于无人驾驶汽车的眼和耳,无人驾驶汽车通过环境感知模块来辨别自身周围的环境信息。为其行为决策提供信息支持。环境感知包括无人驾驶汽车自身位姿感知和周围环境感知两部分。单一传感器只能对被测对象的某个方面或者某个特征进行测量,无法满足测量的需要。因而,必需采用多个传感器同时对某一个被测对象的一个或者几个特征量进行测量,将所测得的数据经过数据融合处理后。提取出可信度较高的有用信号。按照环境感知系统测量对象的不同,我们采用两种方法进行检测:无人驾驶汽车自身位姿信息主要包括车辆自身的速度、加速度、倾角、位置等信息。这类信息测量方便,主要用驱动电机、电子罗盘、倾角传感器、陀螺仪等传感器进行测量。 无人驾驶汽车周围环境感知以雷达等主动型测距传感器为主,被动型测距传感器为辅,采用信息融合的方法实现。因为激光、雷达、超声波等主动型测距传感器相结合更能满足复杂、恶劣条件下,执行任务的需要,最重要的是处理数据量小,实时性好。同时进行路径规划时可以直接利用激光返回的数据进行计算,无需知道障碍物的具体信息。

而视觉作为环境感知的一个重要手段,虽然目前在恶劣环境感知中存在一定问题。但是在目标识别、道路跟踪、地图创建等方面具有其他传感器所无法取代的重要性,而在野外环境中的植物分类、水域和泥泞检测等方面,视觉也是必不可少的手段。 (2)导航定位技术 无人驾驶汽车的导航模块用于确定无人驾驶汽车其自身的地理位置,是无人驾驶汽车的路径规划和任务规划的之支撑。导航可分为自主导航和网络导航两种。 自主导航技术是指除了定位辅助之外,不需要外界其他的协助,即可独立完成导航任务。自主导航技术在本地存储地理空间数据,所有的计算在终端完成,在任何情况下均可实现定位,但是自主导航设备的计算资源有限,导致计算能力差,有时不能提供准确、实时的导航服务。现有自主导航技术可分为三类:相对定位:主要依靠里程计、陀螺仪等内部感受传感器,通过测量无人车相对于初始位置的位移来确定无人车的当前位置。 绝对定位:主要采用导航信标.主动或被动标讽地图匹配或全球定位系统进行定位。 组合定位:综合采用相对定位和绝对定位的方法,扬长避短,弥补单一定位方法的不足。组合定位方案一般有GPs+地图匹配、GPs+航迹推算、GPs+航迹推算+地图匹配、GPs+GLONAss+惯性导航+地图匹配等。 网络导航能随时随地通过无线通信网络、交通信息中心进行信息交互。移动设备通过移动通信网与直接连接于Internet的web GIs服务器相连,在服务器执行地图存储和复杂计算等功能,用户可以从服务器端下载地图数据。

汽车自动驾驶产业链深度报告:芯片及软件专题 核心观点: 巨头厂商底层技术突破,为汽车智能化带来质变 无论是造车新势力,还是传统车厂都在深度布局汽车智能化,座舱域、驾驶域的发展速度尤为惊人。目前智能座舱的新车型普及度持续攀升,智能驾驶的落地速度也有所加快。在汽车新四化浪潮下,车厂、芯片厂商、Tier1、OS 以及其他软硬件供应商积极投入研发,产品迭代速度显著加快。尤其巨头厂商在底层技术的突破,为市场带来质变。 硬件控制器集中化,SDV 已成为未来行业发展趋势 随着软硬件和新技术的共同发展,ECU 开发瓶颈问题日益突出,汽车行业由最初的“机械定义汽车”逐步转变为“软件定义汽车”。硬件控制器集中化,SDV 已成为未来行业发展趋势。在软件定义汽车时代,产品价值链被重塑,传统汽车核心竞争要素将会被硬件、软件和服务所取代,供应链生态也将变革,汽车行业的重点将从依靠硬件驱动的产品逐步进行转移,当下的新产品应当是由“硬件+软件”同步驱动的产品。 中国汽车智能化发展速度领先,A 股有望成为核心投资市场之一 汽车新四化的发展,OTA 市场增速迅猛,中国智能座舱作为首个核心应用市场潜力巨大,预计2025 年规模破千亿,市场政策双驱动,ADAS 获井喷发展。据中国产业调研网估计,2025 年全球ADAS 市场规模将达275 亿欧元,2015~2025 年均复合增长率高达17%。 终端软件解决方案提供商的盈利模式也有望发生转变 大部分传统汽车厂商缺少软件基因,在软件定义汽车领域需要寻求外部供应商的合作,且需求范围逐步扩大。供应商多以项目开发的形式开展业务,

智能座舱全产业链分为三大环节:1)Tier0.5 级供应商也可称为产业的下

深度学习人工智能在无人驾驶上的应用 公司内部编号:(GOOD-TMMT-MMUT-UUPTY-UUYY-DTTI-

深度学习人工智能在无人驾驶上的应用 摘要⑹錾疃妊习的概念及深度学习人工智能在环境感知技术上的应用,详细阐述深度学习的工作原理以及其应用前景。 关键词人工智能无人驾驶环境感知技术深度学习 中图分类号:TP29 文献标识码:A 机器深度学习是近年来在人工智能领域的重大突破之一,它在语音识别、自然语言处理、计算机视觉等领域都取得了不少成功。由于车辆行驶环境复杂,当前感知技术在检测与识别度方面无法满足无人驾驶发展需要,深度学习被证明在复杂环境感知方面有巨大优势。 视觉感知技术是无人驾驶的核心技术。 无人驾驶一般包括四个等级或者五个等级,不管哪个等级都会包含环境感知、规划决策和执行控制等三个方面。其中环境感知方式主要有视觉感知、毫米波雷达感知和激光雷达感知,其中的视觉感知是无人驾驶感知的最主要的方式。 中国的路况较为复杂,雨天、雾霾天以及下雪天。另外,像马车、吊车以及摩托车,还有摩托车拉猪、卡车拉树的现象在我们生活中经常遇到,这些场景对视觉是一个难题,提高这种复杂路况下的感知精度是无人驾驶研究的挑战。 1深度学习能够满足复杂路况下视觉感知的高精度需求 深度学习被认为是一种有效的解决方案,深度学习是模拟人的大脑,是近10年来人工智能取得一个较大的突破。深度学习在视觉感知中近几年应取得了较大的进展,相对于传统的计算机视觉,深度学习在视觉感知精度方面有比较大的优势。

特别是2011年以后,有报导指出深度学习如果算法和样本量足够的话,其准确率可以达到%以上,传统的视觉算法检测精度的极限在93%左右。而人的感知,也就是人能看到的准确率一般为95%,所以从这个方面看,深度学习在视觉感知方面是有优势的。 所谓深度学习,又名深度神经网络,相对于以前的神经网络来说是一种更多层和节点的神经网络机器学习算法,从这儿可以看出来,其实深度学习是一种机器学习,可以说是一种更智能的机器学习。深度学习主要类型一般包括5种类型,像CNN、RNN、LSTM、RBM和Autoencoder,其中我们主要的是用的CNN,CNN 另外一个名字叫卷积神经网络。卷积神经网络已经被证明在图像处理中有很好的效果。 其中,自学特征是深度学习的最大优势。例如智能驾驶需要识别狗,在以前的算法中如果要识别狗,对狗的特征要用程序来详细描述,深度学习这个地方如果采集到足够的样本,然后放在深度学习中训练,训练出来后的系统就可以识别这个狗。传统的计算机的视觉算法需要手工提取特征,很多时候需要专家的知识,算法的鲁棒性设计非常困难,很难保证鲁棒性,我们做视觉感知的时候就遇到很多困难。另外如果要保证这个稳定需要大量的调试,非常耗时。 深度学习一般包括四种类型的神经网络层,输入层、卷积层、池化层、输出层。网络的结构可以10层甚至上百层,一般层数越多检测精度会更精准。并且随着网络层数和节点数的增加,可以表达更细、更多的识别物的特征,这样的话可以为检测精度的提高打下基础。

自动驾驶核心技术之三:环境感知 自动驾驶四大核心技术,分别是环境感知、精确定位、路径规划、线控执行。环境感知是其中被研究最多的部分,不过基于视觉的环境感知是无法满足无人驾驶要求的。环境感知主要包括三个方面,路面、静态物体和动态物体。对于动态物体,不仅要检测还要对其轨迹进行追踪,并根据追踪结果,预测该物体下一步的轨迹(位置)。这在市区,尤其中国市区必不可少,最典型场景就是北京五道口:如果你见到行人就停,那你就永远无法通过五道口,行人几乎是从不停歇地从车前走过。人类驾驶员会根据行人的移动轨迹大概评估其下一步的位置,然后根据车速,计算出安全空间(路径规划),公交司机最擅长此道。无人车同样要能做到。要注意这是多个移动物体的轨迹的追踪与预测,难度比单一物体要高得多。这就是MODAT(Moving Object Detection and Tracking)。也是无人车最具难度的技术。图:无人车环境感知框架 这是基于激光雷达的环境感知模型,搞视觉环境感知模型研究的人远多于激光雷达。不过很遗憾地讲,在无人车这件事上,视觉不够靠谱。让我们来看计算机视觉的发展历程,神经网络的历史可追述到上世纪四十年代,曾经在八九十年代流行。神经网络试图通过模拟大脑认知的机理,解决各种

机器学习的问题。1986 年Rumelhart,Hinton 和Williams 在《自然》发表了著名的反向传播算法用于训练神经网络,直到今天仍被广泛应用。不过深度学习自80年代后沉寂了许久。神经网络有大量的参数,经常发生过拟合问题,即往往在训练集上准确率很高,而在测试集上效果差。这部分归因于当时的训练数据集规模都较小,而且计算资源有限,即便是训练一个较小的网络也需要很长的时间。神经网络与其它模型相比并未在识别的准确率上体现出明显的优势,而且难于训练。因此更多的学者开始采用诸如支持向量机(SVM)、Boosting、最近邻等分类器。这些分类器可以用具有一个或两个隐含层的神经网络模拟,因此被称作浅层机器学习模型。它们不再模拟大脑的认知机理;相反,针对不同的任务设计不同的系统,并采用不同的手工设计的特征。例如语音识别采用高斯混合模型和隐马尔可夫模型,物体识别采用SIFT 特征,人脸识别采用LBP 特征,行人检测采用HOG 特征。2006年以后,得益于电脑游戏爱好者对性能的追求,GPU性能飞速增长。同时,互联网很容易获得海量训练数据。两者结合,深度学习或者说神经网络焕发了第二春。2012 年,Hinton 的研究小组采用深度学习赢得了ImageNet 图像分类的比赛。从此深度学习开始席卷全球,到今天,你不说深度学习都不好出街了。深度学习与传统模式识别方法的最大不同在于它是从大数据中自动学习特征,而非采用手工设

深度剖析激光雷达核心技术 从四个维度深度剖析激光雷达核心技术 激光雷达(LiDAR)的产业化热潮来源于自动驾驶汽车的强烈需求。在美国汽车工程师学会(SAE)定义的L3级及以上的自动驾驶汽车之中,作为3D视觉传感器的激光雷达彰显了其重要地位,为自动驾驶的安全性提供了有力保障。因此,激光雷达成为了产业界和资本界追逐的“宠儿”,投资和并购消息层出不穷。很多老牌整车厂和互联网巨头都展开了车载激光雷达的“军备竞赛”。近期,MEMS激光雷达技术发展最为活跃,并且吸引了大多数投资,同时宝马宣布将于2021年推出集成MEMS激光雷达的自动驾驶汽车。 不同自动驾驶等级对传感器的需求分析(数据来源:Yole) 伴随着自动驾驶热度上升,激光雷达相关新闻铺天盖地袭来。但是这项在自动驾驶领域尚不成熟的3D视觉技术,不仅公开技术资料稀缺,而且企业和媒体关于各种激光雷达的分类和称谓表达五花八门,例如:机械式、固态、全固态、混合固态;又如:MEMS(微机电系统)、OPA(光学相控阵)、Flash(闪光);亦如:FMCW(调频连续波)、脉冲波;还如:飞行时间法、三角测距法等。这些称谓常常让圈内圈外的人士感到困惑。不用担心,麦姆斯咨询为您答疑解惑,本报告从“测距原理、光源、光束操纵、探测器”四个维度对激光雷达核心技术及分类进行了分析,力求让读者对激光雷达错综复杂的技术脉络有清晰的认知。 当我们在交流“直接/间接飞行时间法、三角测距法”等概念时,这实际上是激光雷达的“测距原理”维度;而谈及“机械式、MEMS、OPA、Flash”等关键词时,这属于激光雷达的“光束操纵”维度;无论是905nm还是1550nm的波长,还是边发射激光器(EEL)或垂直腔面发射激光器(VCESL),这是从激光雷达的“光源”维度交流问题;而涉及PIN、APD(雪崩光电二极管)/SPAD(单光子雪崩二极管)、SiPM(硅光电培增管),或是单点、线阵、面阵,则是从激光雷达的“探测器”维度分析技术。 掌握不同类型激光雷达技术路线及“硬核”

自动驾驶的核心技术之四:线控技术 线控执行 简单地说,线控执行主要包括线控制动、转向和油门。某些高级车上,悬挂也是可以线控的。线控执行中制动是最难的部分。 线控油门相当简单,且已经大量应用,也就是电子油门,凡具备定速巡航的车辆都配备有电子油门。电子油门通过用线束(导线)来代替拉索或者拉杆,在节气门那边装一只微型电动机,用电动机来驱动节气门开度。一般而言,增减油门就是指通过油门踏板改变发动机节气门开度,从而控制可燃混合气的流量,改变发动机的转速和功率,以适应汽车行驶的需要。传统发动机节气门操纵机构是通过拉索或者拉杆,一端联接油门踏板,另一端联接节气门连动板而工作。但这种传统油门应用范畴受到限制并缺乏精确性。电子油门的主要功能是把驾驶员踩下油门踏板的角度转换成与其成正比的电压信号,同时把油门踏板的各种特殊位置制成接触开关,把怠速、高负荷、加减速等发动机工况变成电脉冲信号输送给电控发动机的控制器ECU,以达到供油、喷油与变速等的优化自动控制。 电子油门控制系统主要由油门踏板、踏板位移传感器、ECU(电控单元)、数据总线、伺服电动机和节气门执行机构组成。位移传感器安装在油门踏板内部,随时监测油门踏板的位置。当监测到油门踏板高度位置有变化,会瞬间将此信息送往ECU,ECU对该信息和其它系统传来的数据信息进行运算处理,计算出一个控制信号,通过线路送到伺服电动机继电器,伺服电动机驱动节气门执行机构,数据总线则是负责系统ECU与其它ECU之间的通讯。在自适应巡航中,则由ESP (ESC)中的ECU来控制电机,进而控制进气门开合幅度,最终控制车速。博世和大陆都有全套的电子油门系统出售。 线控转向也已经得到实际应用,这就是日产旗下的英菲尼迪Q50。实际目前的电子助力转向(EPS)非常接近线控转向了。EPS与线控转向之间的主要差异就是线控转向取消了方向盘与车轮之间的机械连接,用传感器获得方向盘的转角数据,然后ECU将其折算为具体的驱动力数据,用电机推动转向机转动车轮。而EPS则根据驾驶员的转角来增加转向力。线控转向的缺点是需要模拟一个方向盘的力回馈,因为方向盘没有和机械部分连接,驾驶者感觉不到路面传导来的阻力,会失去路感,不过在无人车上,就无需考虑这个了。在Q50L上线控转向还保留机械装置,保证即使电子系统全部失效,依然可以正常转向。 线控制动是最关键的也是难度最高的。要了解线控制动,首先要了解汽车的刹车原理。轻型 车通常采用液压制动。 传统制动系统主要由真空助力器、主缸、储液壶、轮缸、制动鼓或制动碟构成。当踩下刹车 踏板时,储液壶中的刹车油进入主缸,然后进入轮缸。 轮缸两端的活塞推动制动蹄向外运动进而使得摩擦片与刹车鼓发生摩擦,从而产生制动力。 当驾驶者踩下制动踏板时,机构会通过液压把驾驶人脚上的力量传递给车轮。但实际上要想让车停下来必须要一个很大的力量,这要比人腿的力量大很多。所以制动系统必须能够放大腿部的力量,要做到这一点有两个办法:?杠杆作用?利用帕斯卡定律,用液力放大。制动系统把力量传递给车轮,给车轮一个摩擦力,然后车轮也相应的给地面一个摩擦力。

智能汽车 智能车辆是一个集环境感知、规划决策、多等级辅助驾驶等功能于一体的综合系统,它集中运用了计算机、现代传感、信息融合、通讯、人工智能及自动控制等技术,是典型的高新技术综合体。 目前对智能车辆的研究主要致力于提高汽车的安全性、舒适性,以及提供优良的人车交互界面。近年来,智能车辆己经成为世界车辆工程领域研究的热点和汽车工业增长的新动力,很多发达国家都将其纳入到各自重点发展的智能交通系统当中。 目录 1概述 2基本结构 3特点 4发展现状 5阶段层次 6国内进展 7国外进展 8未来预测 9商业模式 10体系架构 概述 所谓“智能车辆”,就是在普通车辆的基础上增加了先进的传感器(雷达、摄像)、控制器、执行器等装置,通过车载传感系统和信息终端实现与人、车、路等的智能信息交换,使车辆具备智能的环境感知能力,能够自动分析车辆行驶的安全及危险状态,并使车辆按照人的意愿到达目的地,最终实现替代人来操作的目的。 智能汽车与一般所说的自动驾驶有所不同,它指的是利用多种传感器和智能公路技术实现的汽车自动驾驶。智能汽车首先有一套导航信息资料库,存有全国高速公路、普通公路、城市道路以及各种服务设施(餐饮、旅馆、加油站、景点、停车场)的信息资料;其次是GPS定位系统,利用这个系统精确定位车辆所在的位置,与道路资料库中的数据相比较,确定以后的行驶方向;道路状况信息系统,由交通管理中心提供实时的前方道路状况信息,如堵车、事故等,必要时及时改变行驶路线;车辆防碰系统,包括探测雷达、信息处理系统、驾驶控制系统,控制与其他车辆的距离,在探测到障碍物时及时减速或刹车,并把信息传给指挥中心和其他车辆;紧急报警系统,如果出了事故,自动报告指挥中心进行救援;无线通信系统,用于汽车与指挥中心的联络;自动驾驶系统,用于控制汽车的点火、改变速度和转向等。 通常对车辆的操作实质上可视为对一个多输入、多输出、输入输出关系复杂多变、不确定多干扰源的复杂非线性系统的控制过程。驾驶员既要接受环境如道路、拥挤、方向、行人等的信息,还要

一、无人驾驶汽车传感器的研究背景和意义 无人驾驶汽车是人工智能的一个非常重要的验证平台,近些年成为国内外研究热点.无人驾驶汽车作为一种陆地轮式机器人,既与普通机器人有着很大的相似性,又存在着很大的不同.首先它作为汽车需保证乘员乘坐的舒适性和安全性,这就要求对其行驶方向和速度的控制更加严格;另外,它的体积较大,特别是在复杂拥挤的交通环境下,要想能够顺利行驶,对周围障碍物的动态信息获取就有着很高的要求。无人驾驶的研究目标是完全或部分取代驾驶员,是人工智能的一个非常重要的实现平台,同时也是如今前沿科技的重要发展方向。当前,无人驾驶技术具有重大的应用价值,生活和工程中,能够在一定程度上减轻驾驶行为的压力;在军事领域内,无人驾驶技术可以代替军人执行侦查、排雷、以及战场上危险环境中的任务;在科学研究的领域,无人驾驶技术可以实现外星球等极端环境下的勘探活动。无人驾驶车辆技术,又称智能车辆,即利用将无人驾驶的技术应用于车辆的控制中。 国外的无人驾驶车辆技术大多通过分析激光传感器数据进行动态障碍物的检测。代表有斯坦福大学的智能车“Junior”,利用激光传感器对跟踪目标的运动几何特征建模,然后用贝叶斯滤波器分别更新每个目标的状态;卡耐基?梅隆大学的“BOSS”智能车从激光传感器数据中提取障碍物特征,通过关联不同时刻的激光传感器数据对动态障碍物进行检测跟踪。牛津大学研制的无人车辆“WildCat”,不使用GPS,使用激光雷达和相机监控路面状况。我国相关技术开展较晚,国防科学技术大学研制的自主车“开路雄狮”,采用三维激光雷达Velodyne作为主要传感器,将Velodyne获取的相邻两激光数据作差,并在获得的差分图像上进行聚类操作,对聚类结果建立方盒模型。 无人驾驶车辆是一项融合了认知科学、人工智能、机器人技术与车辆工程等多学科的技术,涉及到电子电路,计算机视觉,自动控制,信号处理等多学科技术。无人驾驶汽车的出现从根本上改变了传统的“人——车——路”闭环控制方式,将无法用规则严格约束的驾驶员从该闭环系统中请出去,从而大大提高了交通系统的效率和安全性,是汽车工业发展的革命性产物。

近日,上汽、宝马、滴滴出行成为了中国最先获得政府许可,能够进行自动驾驶出租车试运行的企业。发放许可证的是上海市政府,试运行的地点划在了上海市的嘉定区。根据政府规定,第一轮试运行为期6个月。在此期间,每家获得政府许可的公司最多可投放50辆车。如果说在第一轮的试运行期间没有发生任何的交通事故,那么6个月后,这些公司有望能够加大他们的汽车投放量。另外,这些自动驾驶汽车上必须配有司机,以便在特殊情况下能够随时切换到手动驾驶,以保证乘客的生命安全。而且自动驾驶汽车公司也必须为他们的乘客购买保险。SAIC,a Chinese automaker,along with BMW and Didi have recently become the first companies in China to receive permits from the government for lunching their self driving taxi pilot services.To be more specific.The permits are issued by the Shanghai government,and the services will be offered in the Jiading district of shanghai based on government regulations.During the first round of the pilot test,which will last for about six months.Each licensed company can run as many as50self driving cars.If there were no accidents during the first round,these companies can expand their fleets later.What's more,there has to be a driver on board so that they can take over when needed to protect the passengers.Service providers will also have to buy insurances for the passengers. 在自动驾驶汽车初步测试的阶段,当时所谓乘客实际不过就是这些测试公司自家的员工。而现在,凡是符合条件的普罗大众,只要愿意,均可乘坐这些自动驾驶的出租车。而这个条件嘛,就是首先,当然你得身体健康。其次,年龄应该是18到70岁之间。 Prior to this,only employees of the testing companies were allowed to be on board.But now anyone that is in good health and is between18and70years old can volunteer and take a ride on one of those self driving cars. 上海实际上在自动驾驶方面一直都是走在全中国最前面的。在2018年,上海是全中国首个开展自动驾驶汽车测试的城市。而这一次上海市政府发放许可证,开放试运行,同样也是全中国第一个。此举,无论是对于上海乃至全中国的自动驾驶产业,都可谓是具有里程碑意义。当然了,其他城市也不甘落后。现在在长沙广州等多地城市都有投放自动驾驶出租车的计划。Shanghai has always been a leader in promoting self driving vehicles.It is

浅析自动驾驶核心技术的路径规划 无人车的技术路线实际早已确定,那就是轮式机器人的技术路线。这已经从 2007年的DARPA大赛到谷歌福特百度的无人车,超过十年的验证,轮式机器人技术完全适用于无人车。目前所有无人车基础算法的研究都源自机器人技术。 首先来说明三个概念,路径规划、避障规划、轨迹规划。 路径规划通常指全局的路径规划,也可以叫全局导航规划,从出发点到目标点之间的纯几何路径规划,无关时间序列,无关车辆动力学。 避障规划又叫局部路径规划,又可叫动态路径规划,也可以叫即时导航规划。主要是探测障碍物,并对障碍物的移动轨迹跟踪( Moving Object Detection and Tracking ,一般缩写为MODAT)做出下一步可能位置的推算,最终绘制出一幅包含现存碰撞风险和潜在碰撞风险的障碍物地图,这个潜在的风险提示是100毫秒级,未来需要进一步提高,这对传感器、算法的效率和处理器的运算能力都是极大的挑战,避障规划不仅考虑空间还考虑时间序列,在复杂的市区运算量惊人,可能超过30TFLOPS,这是无人车难度最高的环节。未来还要加入V2X地图,避障规划会更复杂,加入V2X地图,基本可确保无人车不会发生任何形式的主动碰撞。 轨迹规划则源自机器人研究,通常是说机械臂的路径规划。在无人车领域,轨迹规划的定义感觉不统一。有人将避障规划与轨迹规划混淆了。轨迹规划应该是在路径规划和避障规划的基础上,考虑时间序列和车辆动力学对车辆运行轨迹的规划,主要是车纵向加速度和车横向角速度的设定。将设定交给执行系统,转向、油门、刹车。如果有主动悬挂,那么轨迹规划可能还要考虑地形因素。 三大规划是无人车最复杂的部分,算法多不胜数,让人眼花缭乱,这也是百度、谷歌和苹果科技巨头要切入无人车领域的主要原因,这些科技巨头最擅长的就是算法的优化整合。当然传统车厂如福特和丰田,拥有对车辆动力学的绝对优势,在此领域实力并不比科技巨头要差,尤其是丰田,从开源 SLAM到KITTI,软件实力丝毫不次于谷歌。 全局型路径规划不算复杂,前提是有拓扑级地图,这对地图厂家来说很容易的。对于非地

Clean Vehicles Consortium 智能车环境感知及高精度导航技术 High Precision Environment Perception, Positioning and Navigation for Automated Vehicles DIANGE YANG 杨殿阁教授 Professor, Ph.D Vice Director of State Key Laboratory of Automotive Safety, Department of Automotive Engineering, Tsinghua University

Clean Vehicles Consortium Review of Automated Vehicles Key Technologies of Automated Vehicle Research Work of Tsinghua University on Connected Automated Vehicle

Clean Vehicles Consortium Review of Automated Vehicles 智能汽车的发展历史 1953年GM 和RCA 的无人智能驾驶 1925年,美国Houdina Radio Control 公司的“无人”驾驶汽车American Wonder 1939年,通用汽车公司赞助,Bel Geddes 的“Magic Motorways”和他的无人驾驶概念车 1960年,英国运输与道路实验室的CITROEN 无人驾驶汽车,以130公里的时速在各种天气状况下进行了实验

《智能车辆》课程报告 报告题目: 无人车环境感知与智能控制 学生姓名:*** 班级:***班 学号:200****** 任课老师:*** 20**年**月15日

目录 1.无人车简介 (1) 2.研究无人车的意义 (1) 3.研究无人车的现状 (2) 3.1国外现状 (2) 3.2国内现状 (3) 4.无人车关键技术之环境感知 (4) 4.1研究环境感知的目的 (4) 4.2环境感知的对象 (5) 4.3环境感知的方法 (5) 5.无人车关键技术之智能控制 (8) 5.1智能控制技术概述 (8) 5.2模糊控制 (8) 5.3神经网络控制 (8) 5.4专家控制 (8) 5.5学习控制 (9) 5.6综合智能控制技术 (9) 6.课程总结 (10) 7.参考文献 (11)

无人车环境感知与智能控制 1.无人车简介 智能车辆因其从轮式移动机器人的研究中汲取了大量的营养,许多研究者将智能车辆与轮式移动机器人等同。所以,智能车辆(Intelligent Vehicle,IV)又称为轮式移动机器人,是一个集环境感知、规划决策、多等级辅助驾驶等功能于一体的综合系统。它集中地运用了计算机、现代传感、导航、防撞、信息融合、通讯、人工智能及自动控制等技术,是典型的高新技术综合体。智能车辆致力于提高汽车的安全性、舒适性和提供优良的人车交互界面,是目前各国重点发展的智能交通系统中一个重要组成部分,也是世界车辆工程领域研究的热点和汽车工业增长的新动力。 智能车辆技术是一个新兴的学科领域,它融合了机器人技术,人工智能技术,计算机科学技术,通信与信号处理技术,自动化与控制技术以及机器视觉技术等。智能车辆的许多新思想、解决方案得益于其他技术邻域的进步和支持。 目前的智能车辆技术的发展有两个方向:其一是用于室内的环境,智能车辆具备自主导航的能力,车辆体积小,速度相对不高,当遇到突发事件时,可根据实际情况做出决策,改变自身位置以跟踪检测出的道路行走;其二是用于室外的环境,智能车辆高速行驶,利用各种传感器检测环境的信息,以判断车辆的行驶情况,这时要求计算机具有很强的处理能力,传感器也要有很高的灵敏度。 2.研究无人车的意义 随着经济和社会的迅速发展,交通基础设施的瓶颈制约作用越来越明显。这种制约不仅体现在交通堵塞问题日益突出,同时还体现在由于交通不畅而造成的环境污染问题及相对落后的道路和先进的车辆对人们的生命、财产所形成的安全隐患。正因为如此,智能交通系统(Intelligent Transportation Systems,ITS)日益受到欧洲、日本、美国等发达国家的重视并成为研究热点。他们相继启动了各种以智能交通系统为目标的研究与开发项目。如欧洲的PROMETHEUS和DRIVE 项目,日本的VICS和ARTS项目,美国的IVHS项目等。各国家各地区研究的项目内容,对智能交通系统的定义不尽相同,各项目的重点也有所不同,但目标都是综合利用新的信息技术、计算机技术、自动化技术、管理技术等,来提高道路和车辆的利用效率,提高安全性,减少污染及阻塞的发生。

自动驾驶四大核心技术的环境感知的详细概述 人类驾驶员会根据行人的移动轨迹大概评估其下一步的位置,然后根据车速,计算出安全空间(路径规划),公交司机最擅长此道。无人驾驶汽车同样要能做到。要注意这是多个移动物体的轨迹的追踪与预测,难度比单一物体要高得多。这就是环境感知,也是无人驾驶汽车最具难度的技术。 今天介绍一下环境感知的内容。环境感知也被称为MODAT(Moving Object Detection andTracking)。 自动驾驶四大核心技术,分别是环境感知、精确定位、路径规划、线控执行。环境感知是其中被研究最多的部分,不过基于视觉的环境感知是无法满足无人汽车自动驾驶要求的。实际的无人驾驶汽车面对的路况远比实验室仿真或者试车场的情况要复杂很多,这就需要建立大量的数学方程。而良好的规划必须建立对周边环境,尤其是动态环境的深刻理解。环境感知主要包括三个方面,路面、静态物体和动态物体。对于动态物体,不仅要检测还要对其轨迹进行追踪,并根据追踪结果,预测该物体下一步的轨迹(位置)。这在市区,尤其中国市区必不可少,最典型场景就是北京五道口:如果你见到行人就停,那你就永远无法通过五道口,行人几乎是从不停歇地从车前走过。人类驾驶员会根据行人的移动轨迹大概评估其下一步的位置,然后根据车速,计算出安全空间(路径规划),公交司机最擅长此道。无人驾驶汽车同样要能做到。要注意这是多个移动物体的轨迹的追踪与预测,难度比单一物体要高得多。这就是 MODAT(Moving Object Detectionand Tracking)。也是无人驾驶汽车最具难度的技术。 下图是一个典型的无人驾驶汽车环境感知框架: 这是基于激光雷达的环境感知模型,目前来说,搞视觉环境感知模型研究的人远多于激光雷达。不过很遗憾地讲,在无人驾驶汽车这件事上,视觉肯定是不够的,长远来说,激光雷达配合毫米波雷达,再加上视觉环境感知的综合方案才能真正做到无人驾驶。 让我们来看计算机视觉的发展历程,神经网络的历史可追述到上世纪四十年代,曾经在八