1.什么是模式及模式识别?模式识别的应用领域主要有哪些?

模式:存在于时间,空间中可观察的事物,具有时间或空间分布的信息; 模式识别:用计算机实现人对各种事物或现象的分析,描述,判断,识别。 模式识别的应用领域:(1)字符识别;(2) 医疗诊断;(3)遥感; (4)指纹识别 脸形识别;(5)检测污染分析,大气,水源,环境监测; (6)自动检测;(7 )语声识别,机器翻译,电话号码自动查询,侦听,机器故障判断; (8)军事应用。

2.模式识别系统的基本组成是什么?

(1) 信息的获取:是通过传感器,将光或声音等信息转化为电信息;

(2) 预处理:包括A\D,二值化,图象的平滑,变换,增强,恢复,滤波等, 主要指图

象处理;

(3) 特征抽取和选择:在测量空间的原始数据通过变换获得在特征空间最能反映分类

本质的特征;

(4) 分类器设计:分类器设计的主要功能是通过训练确定判决规则,使按此类判决规

则分类时,错误率最低。把这些判决规则建成标准库; (5) 分类决策:在特征空间中对被识别对象进行分类。

3.模式识别的基本问题有哪些? (1)模式(样本)表示方法:(a )向量表示;(b )矩阵表示;(c )几何表示;(4)基元(链码)表示;

(2)模式类的紧致性:模式识别的要求:满足紧致集,才能很好地分类;如果不满足紧致集,就要采取变换的方法,满足紧致集

(3)相似与分类;(a)两个样本x i ,x j 之间的相似度量满足以下要求: ① 应为非负值

② 样本本身相似性度量应最大 ③ 度量应满足对称性

④ 在满足紧致性的条件下,相似性应该是点间距离的 单调函数

(b)

用各种距离表示相似性

(4)特征的生成:特征包括:(a)低层特征;(b)中层特征;(c)高层特征 (5) 数据的标准化:(a)极差标准化;(b)方差标准化

4.线性判别方法

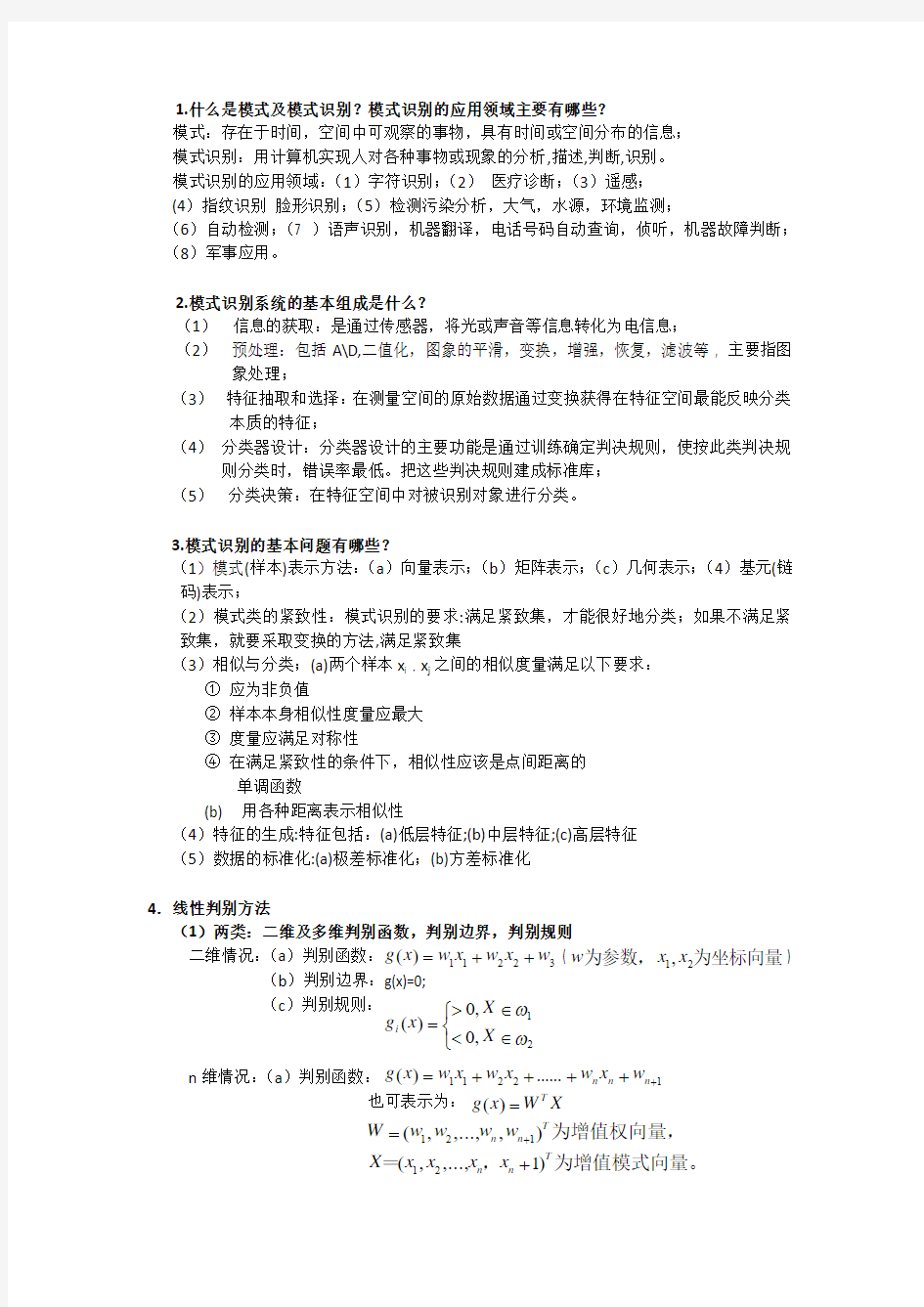

(1)两类:二维及多维判别函数,判别边界,判别规则 二维情况:(a )判别函数: ( ) (b )判别边界:g(x)=0; (c

n 维情况:(a )判别函数:

也可表示为: 32211)(w x w x w x g ++=为坐标向量为参数,21,x x w 12211......)(+++++=n n n w x w x w x w x g X W x g T =)(为增值模式向量。

,=为增值权向量,T

n n T n n x x x x X w w w w W )1,...,,(),,...,,(21121+=+

(b )判别边界:g 1(x ) =W T X =0 (c )判别规则:

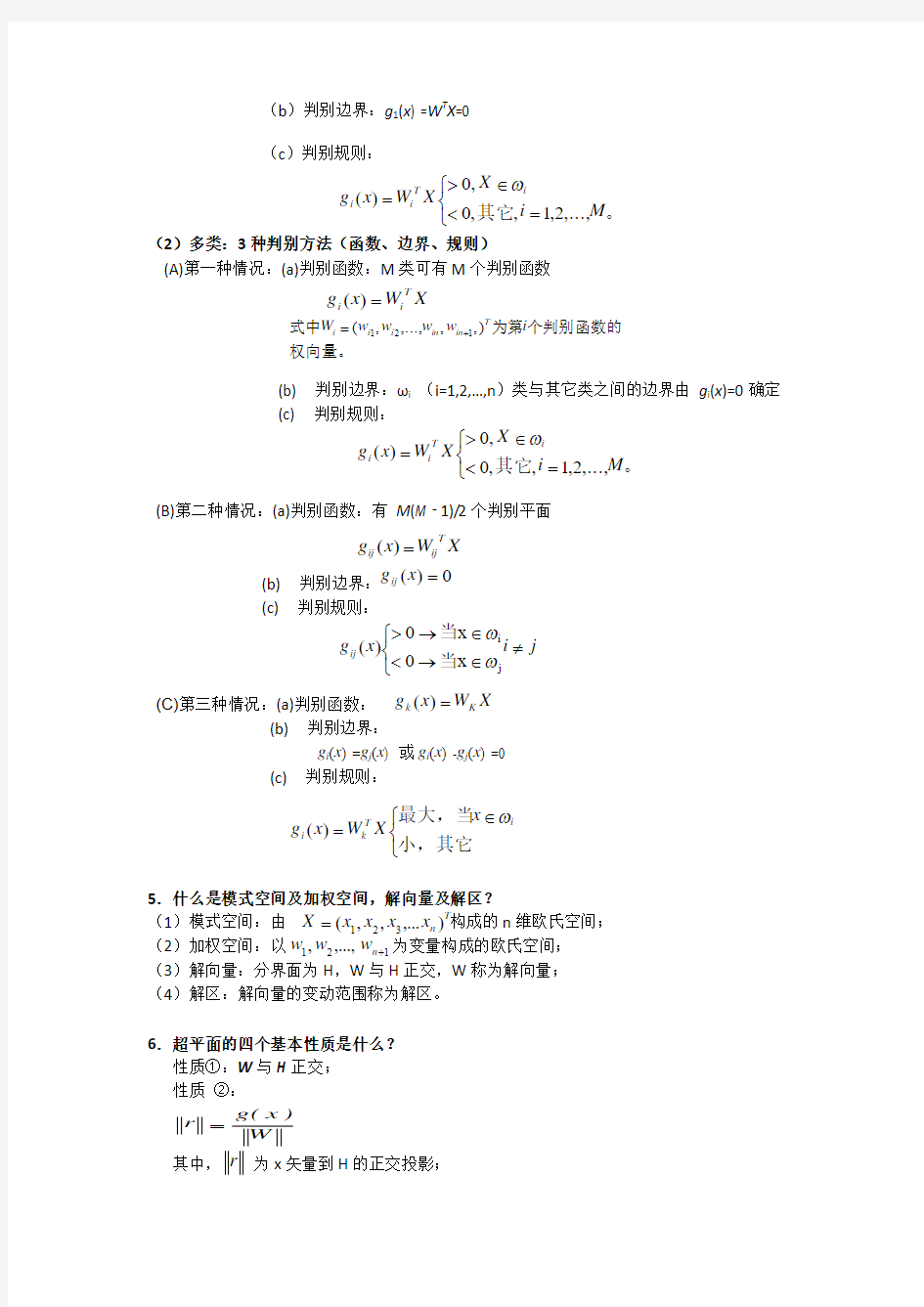

(2)多类:3种判别方法(函数、边界、规则)

(A)第一种情况:(a)判别函数:M 类可有M 个判别函数

(b) 判别边界:ωi

(i=1,2,…,n )类与其它类之间的边界由 g i

(x )=0确定 (c)

(B)第二种情况:(a)判别函数:有 M (M _ 1)/2个判别平面

(b) 判别边界: (c)

判别规则:

(C)第三种情况:(a)判别函数: (b) 判别边界:

g i (x ) =g j (x ) 或g i (x ) -g j (x ) =0

(c)

判别规则:

5.什么是模式空间及加权空间,解向量及解区? (1)模式空间:由 构成的n 维欧氏空间; (2)加权空间:以 为变量构成的欧氏空间; (3)解向量:分界面为H ,W 与H 正交,W 称为解向量; (4)解区:解向量的变动范围称为解区。

6.超平面的四个基本性质是什么? 性质①:W 与H 正交; 性质 ②:

W

)x (g r =

其中,

为x 矢量到H 的正交投影; X

W x g T

ij ij =)(0)(=x g ij

j

i x g ij ≠?

??∈→<∈→>j i

x 0x 0)(ωω当当权向量。

个判别函数的

为第i w T in in i i i ),,121+X

W x g K k =)(??

?∈=小,其它最大,当i T k i x X W x g ω

)(T n x x x x X ),...,,(321=121,...,,+n w w w r

性质③:

性质④:

7.二分法能力如何表示?

N 个样品线性可分数目(条件:样本分布良好):

线性可分概率:

8.广义线性判别方法 (1)非线性→线性

一个非线性判别函数通过映射,变换成线性判别函数:

(2)线性判别 成正比

的距离与原点到11,++=n n W H W W q 通过原点。,说明超平面则若在原点负侧。则在原点正侧,若则若H x W x g W H W H W T n n n ==<>+++)(,0,0,0111???

??+>+<=∑

=-n k k

N N n N C n N n N D 011,21

,2),(若若为特征数为样本数其中n N k N k N C k

N ,,])!1(![)!1(1---=

-强。说明样本少时二分能力范围,即在。时,线性可分概率为

时,即值,对于任意。处出现明显的门限效应时,曲线急剧下降,在由当,1),(),1(22:)(2

1

),()1(22:)(21:)(≈+<<=+===∞→n N P n N c n N P n N n b n a λλλ.

2),1(2:)(,),1(22:)(0是最好情况即二分能力)的估计:个样本的线性可分性(对多线性可分能力越差。说明样品越线性可分概率急剧下降范围,即在=+=+>>λλn N N e n N d )(,)(...)()()(,...)()()(21211

1

增广模式向量。广义权向量其中:空间变换空间??

??

????????=?????

???????==??????→?=→→+=∑

x f x f x f Y w w w W Y g Y W x f w x g k k T y x k i i i 0=Y W T 判别平面:??

?∈<∈>=2

1

,0,0)(ωω

x x Y g Y W T

9.分段线性判别方法

1)基于距离:(1)子类,类判别函数 (2)判别规则

(1)子类:把ωi 类可以分成l i 个子类:

∴ 分成l 个子类。 子类判别函数:

在同类的子类中找最近的均值 (2)判别规则: 这是在M 类中找最近均值。则把x 归于ωj 类完成分类

2)基于函数:(1)子类,类判别函数 (2)判别规则

(1)子类类判别函数:对每个子类定义一个线性判别函数为:

(2)判别规则:在各子类中找最大的判别函数作为此类的代表,则对于M 类,可定义M 个判别函数g i (x ),i =1,2,…..M,因此,决策规则

3)基于凹函数的并:(1)析取范式,合取范式,凹函数

(2) 判别规则

(1) 析取范式:P=(L 11∧L 12∧…∧L 1m )

∨…∨(L q 1∧L q 2∧…∧L q m )

合取范式:Q= (L 11 ∨ L 12 ∨ … ∨ L 1m ) ∧ … ∧(L q 1 ∨ L q 2 ∨ … ∨ L q m )

凹函数:P i =L i 1∧L i 2∧…∧L i m (2) 判别规则:设第一类有q 个峰,

则有q 个凹函数。 即P=P 1∨P 2∨……∨P q

10.非线性判别方法 (1)1ω集中,2ω分散

),...,,(21l

i i i i ωωωω=l

i l

l i x x g μ-==,...,2,1m in )(M

i x g x g i j ,...,2,1),(min )(==子类的权向量。为其中l

i l i l i l i w x w x g ω,)(=j

i M i j x x g x g ω∈==则),(max )(,.....,2,1???=∈<=∈>=。每个子类的判别函数数子类。

m j x q i x x w L ij ij ,...,2,1,,0,...,2,1,,021ωω??

?∈≤∈>21

,0,0ωωx P x P 则则判别规则:协方差

为均值,为其中:大小。的大小,决定超平面的

判别函数定义1

1

1

1

1

1

1

121,)()

()(:ωωμμμω∑∑---=-k x x k x g T

(2)1ω, 2ω均集中

11.分类器的设计

(1)梯度下降法(迭代法):准则函数,学习规则

(a )准则函数:J(W)≈J(W k )+ ▽J T (W- W k )+(W- W k )T D(W- W k )T /2

其中D 为当W = W k 时 J(W)的二阶偏导数矩阵

(b )学习规则:从起始值W 1开始,算出W 1处目标函数的梯度矢量▽J(W 1),则下一步的w 值为:W 2 = W 1-ρ1▽J(W 1) 其中W 1为起始权向量, ρ1为迭代步长,J(W 1) 为目标函数,▽J(W 1)为W 1处的目标函数的梯度矢量 在第K 步的时候

W k+1 = W k -ρk ▽J(W k ) 最佳步长为ρk =||▽J||2/▽J T D ▽J 这就是梯度下降法的迭代公式。 (2)感知器法:准则、学习规则(批量,样本) (a )准则函数: 其中x 0为错分样本

(b )学习规则:

1.错误分类修正w k

如w k T x≤0并且x ∈ω1 w k+1= w k +ρk x

如w k T

x≥0并且x ∈ω2 w k+1= w k -ρk x 2.正确分类 ,w k 不修正 如w k T x >0并且x ∈ω1 如w k T x <0并且x ∈ω2 w k+1= w k

(3)最小平方误差准则法(MSE 法)(非迭代法):准则、权向量解

(a)准则函数: (b)权向量解:

协方差

,为均值,,为其中:,两个判别函数:都比较集中,那么定义,如果212112212,1)()()(ωωωωμμμωω∑∑=---=-i i i i T i i i i x x k x g 。

可用来调整二类错误率判别规则:判别平面方程:21212221212211111221111211221,,0,0)(0

)()()(2)()

()()(k k x x x g k k x x x x g x g x g T T T T ??

?∈<∈>=-+---+--=-=∑∑∑∑∑∑------ωωμμμμμμ(

)

∑∈-=0)(X X X W W J T (

)

∑-

==-==N i b i

X i W T b XW e W J 1

2

22||||||||)(()

b X b X X X T W T +-==1

(4)韦—霍氏法(LMS 法)(迭代法):准则,学习规则 (a)准则函数: (b)学习规则: W 1任意 ,W k+1=W k +ρk (b k -W k T X k ) X k

ρk 随迭代次数k 而减少,以保证算法收敛于满意的W 值

(5)何—卡氏法(H-K 法)(迭代法):准则,b ,W 的学习规则

(a)准则: 它的解为:

(b )b ,W 的学习规则:

其中 c 为矫正系数,e k 为误差矢量,e k =XW k -b k 初始条件 W 1=X +b 1并且b 1>0 迭代时检测

如果e k ≥0时,XW >b ,系统线性可分,迭代收敛 如果e k <0时,XW

(6)Fisher 分类法:准则函数的建立,W 权值计算,0W 的选择

(a)准则函数的建立:投影样本之间的类间分离性越大越好,投影样本的总离散度越小越好。 即可表示为:

其中S w 为类内散布矩阵, S b 为类间散布矩阵

(b)W 权值计算:

(c)W 0的选择 :

()

的伪逆(规范矩阵)称为其中X X X X T X T =-+1

(

)

∑-

==-==N i b i

X i W T b XW e W J 12

22||||||||)(k

1

K ρρ=取(

)

∑-

==-==N i b i

X i W T b XW e W J 12

22||||||||)(()

b X b X X

X T W T +-==1

k k k b b b b δ+=+1前后两次迭代后,对的增量

为其中b b k δ]|[][|11k K k k K k K K k e e X c W b X b X b b X b X W ++=+=+==+++++++δδ|]

|[k k k e e C b +=δ()2212212

||)(σσ+-=Y Y W J Fisher 准则函数有所以W

S W W

S W )(w T

b T

=W J (

)

X X S W W J w 211

)(-=-求极值得对2.12

10Y Y W +=2

1212

12102122.2N N X W N X W N N N Y N

Y N W T

T ++=

++=

12w S S S =+(

)()

1111T S X X X X X N =-∈-

∑(

)()

222

2

T

S X X X X

X N =-∈-∑()()

1212T

b

X X X X S =--

Y ki 表示第i 类中第k 个样本的投影值

N 1为ω1样本数 N 2为ω2样本数 (7)电位函数分类器:电位函数,累积电位的计算

(a)电位函数:电位分布函数有如下三种形式:

α为系数 x k 为某一特定点

(b)累计电位的计算: K k+1(x)= K k (x)+r k+1K(x,x k )

其中: x k+1∈ω1并且K k (x k+1)>0时 r k+1= 0 x k+1∈ω1并且K k (x k+1) ≤ 0时 r k+1= 1 x k+1∈ω2并且K k (x k+1)<0时 r k+1= 0 x k+1∈ω2并且K k (x k+1) ≥ 0时 r k+1= -1

12.1)二类问题的贝叶斯判别

(1)判别函数的四种形式 (2)决策规则 (3)决策面方程 (4)决策系统的结构 (1)判别函数的四种形式: (2)判别规则:

()

()()∑

∑∑

===-+---+=N Y Y N Y Y N Y Y Y Y Y W k k k k k k 2

2111

11211

22112112

0)

(.3}||||ex p{- )K( 1.2k k x x XX -=α||||11

)K( 2.2

k k x x XX -+=α|||||||||sin |)K( 3.22

k k k x x x x XX --=αα)(,)

()

(ln )()(ln )()()(,)()

()()()()()(),()()()()()()

(),()()()(12211

22

1221121取对数方法似然比形式类条件概率密度后验概率ωωωωωωωωωωωωωωP P x P x P x g D P P x P x P x g C P x P P x P x g B x P x P x g A -=-=-=-=2112212

1122121

22112121)

()

(ln )()(ln )()()()()()

()()()()()()()()()(ωωωωωωωωωωωωωωωωωωωωω∈?<>=∈?<>∈?<>

∈

?<>x P P x P x P x g D x P P x P x P C x P x P P x P B x x P x P A

(3)决策面方程:g (x )=0 (4)决策系统的结构

(A )向量特征(B )判别计算(C )阈值单元(D )决策

2)多类问题的贝叶斯判别 (1)判别函数的四种形式 (2)决策规则 (3)决策面方程 (4)决策系统的结构

(1)判别函数的四种形式:M 类有M 个判别函数g 1(x ), g 2(x ),…, g m (x ).

(2)决策规则:

另一种形式:

(3)决策面方程:

(4)决策系统的结构:

(a)特征向量;(b)判别计算;(c)最大选择器;(d)决策

)

(,)()

(ln )()(ln )()()(,)

()

()()()()()(),()()()()()()(),()()()(12211221221121取对数方法似然比形式类条件概率密度后验概率ωωωωωωωωωωωωωP P x P x P x g D P P x P x P x g C P x P P x P x g B x P x P x g A -=-=-=-=)

,...,2,1(,)()(max )

()()(1M i x P x P P x P x g i j j M

j i i i =∈?==≤≤ωωωωω{}i

i j M

j i i i x P x P P x P x g ωωωω∈?+=+=≤≤)(ln )(ln max )

(ln )(ln )(10)()(),()(=-=x g x g x g x g j i j i 即

13.三种最小错误率贝叶斯分类器(正态分布):判别函数,判别规则,决策面方程 (1)第一种情况:各个特征统计独立,且同方差情况。(最简单情况) (a)判别函数:

(b)判别规则:

(c)决策面方程:

(2)第二种情况:Σi = Σ相等,即各类协方差相等。 (a)判别函数:

(b)判别规则:

(c)决策面方程:

(3)第三种情况(一般情况):Σ?为任意,各类协方差矩阵不等,二次项x T Σ? x 与i 有关。所以判别函数为二次型函数。

(a)判别函数: (b)判别规则: (c)决策面方程:

14.最小风险贝叶斯分类器:判别函数,判别规则 (1)判别函数: 条件风险:

αi :表示把模式x 判决为ωi 类的一次动作

)

(ln 21,21)(,)(2

02

i i T i i i i i T i

i

P w w w x w x

g ωμμδ

μδ

+-

==

+=其中:线性判别函数{}

i

j T j M

w i T i i x w x w w x w x g ω∈?+=+=≤≤010max )(())()(ln

)(21

0)(0

)()(200j i j

i j i j i j i j i P P x W x x W x g x g ωωμμμμδμμμμ---+=-==-=-其中)(ln 21,)(101

0i i T i i i

i i T i i P w W w x W x g ωμμμ+-==+=∑

∑

--其中(线性函数){}

i

j T j M j i T i i x w x W w x W x g ω∈?+=+=≤≤010m ax )(0

)()(=-∴x g x g j

i j i 相邻与若ωω)()()

()()

(ln )(21)(,0)(1

010j i T j i j i j

i j i j i T P P x W x x W μμμμμμωωμμμμ-----=-==-∴∑∑--。

其中)(ln ln 2

121)()(,2

1,)(101

10i i i

i T i i i i i i i i T

i i T i P w n W n n W w x W x W x x g ωμμμ+--==?-=++=∑

∑∑∑

---,维列向量矩阵其中{}

i j T j j T M j i T i i T i x w x W x W x w x W x W x x g ω∈?++=++=≤≤010

max )(()()[]()()

).(,...,2,1,1

M a a i x P E x R j M j j i j i i <===∑=ωωαλωαλα()()())

(,平均风险dx x P x x R R ?=α

期望风险:

(2)判别规则: :

15.聂曼—皮尔逊判决:(二类):准则,判别规则,阈值的确定 (1)准则: (2)判别规则:

(3)阈值的确定:

16.最小最大损失准则判决(二类):准则,判别规则,*

1()P ω的确定

(1)准则:讨论在P(ωi )变化时如何使最大可能风险最小; (2)判别规则:风险

通过最小风险与先验概率的关系曲线 ,确定最大风险,使最大风险最小。

(3)*

1()P ω的确定:

17.什么是序贯分类?

序贯:随着时间的推移可以得到越来越多的信息。 序贯分类决策规则

()()k i M

i k x x R x R ωαα∈==则若

,min ,...,2,1最小,使为常数时在取1022,,εεεε=.)()(2121T x T x P x P 值皮尔逊规则归结为找阈∴∈?<

>

ωωωω最小一定这时可确定,为常数时,的函数在取为的分界线作时当1222222121,)(.,)()

(εεεεωεωT T dx x P T T x P x P T

∴=ΩΩ=?

∞

-()()()()()()()()?

?

?

Ω

ΩΩ---+-=-+=+=1

2

2

2221211121221122212221dx x P dx x P b dx

x P a bP a R ωλλλλλλωλλλω其中:()()()()()()()()?

?

?ΩΩΩ-+===---+-=ΩΩ21

22221222222121112122111210

.,0,dx

x P a R dx x P dx x P P R b λλλωλλλλλλω,这时候最大风险为最小即无关与使如果选择???????

?

?<<∈-=≤∈-=≥时,继续观察时时A X P X P B X e P e P B X P X P X e P e P A X P X P i i i i i i )()

()(1)()()()()(1)()(212212112121ωωωωωωωω

18.什么是参数估计,非参数估计,监督学习,无监督学习?

参数估计:先假定研究的问题具有某种数学模型,如正态分布,二项分布,再用已知类别的

学习样本估计里面的参数;

非参数估计:不假定数学模型,直接用已知类别的学习样本的先验知识直接估计数学模型; 监督学习:在已知类别样本指导下的学习和训练,参数估计和非参数估计都属于监督学习。 无监督学习:不知道样本类别,只知道样本的某些信息去估计,如:聚类分析。 19.(1)最大似然估计算法思想:准则,求解过程 (1)准则:第i 类样本的类条件概率密度: P(X i /ωi )= P(X i /ωi ﹒θi ) = P(X i /θi )

原属于i 类的学习样本为X i =(X 1 , X 2 ,…X N ,)T i=1,2,…M

求θi 的最大似然估计就是把P(X i /θi )看成θi 的函数,求出使它最大时的θi 值

(2)求解过程:

∵学习样本独立从总体样本集中抽取的

N 个学习样本出现概率的乘积 取对数:

对θi 求导,并令它为0:

(2)正态分布情况下:μ, ∑的计算

① ∑已知, μ未知,估计μ

② ∑, μ均未知

A 一维情况:n=1对于每个学习样本只有一个特征的简单情况:

即学习样本的算术平均

样本方差 ∏===N k i X k P i X P i i X P i i 1

)

|()|().|(θθθω∑∏===N

k i k i

k N

k X P X P 1

1

)

|(log )|(log θθ0)|(log (1)

1=???

???????????????∑

=N

k i k p X P θθθ????????

?

=??

=?

?∑

∑

==0)|(log ..................0)|(log 111

θθθθi k N k p

i k N k X P X P ∧

∧θθθθ=,即为的估值利用上式求出i

i ∑

=∧==N

k k X N 1

1μμ∑

=∧∧==N k k

X N 1

111

μθ()

∑

=∧∧∧-==N k X k N 1

22121μσθ

B 多维情况:n 个特征 估计值:

20.(1)贝叶斯估计算法思想:准则,求解过程

(A)准则:通过对第i 类学习样本X i 的观察,使概率密度分布P(X i /θ)转化为 后验概率P(θ/X i ) ,再求贝叶斯估计;

(B)求解过程: ① 确定θ的先验分布P(θ),待估参数为随机变量。

② 用第i 类样本x i =(x 1, x 2,…. x N )T 求出样本的联合概率密度分布P(x i |θ),它是

θ的函数。

③ 利用贝叶斯公式,求θ的后验概率

④

(2)正态分布情况下:μ的计算

对μ的估计为

若令P(μ)=N(μ0, σ02 )=N(0,1)

21.(1)贝叶斯学习概念

求出μ的后验概率之后,直接去推导总体分布即

当N↑,μN 就反映了观察到N 个样本后对μ的最好推测,而σN 2反映了这种推测的不确定性, N↑, σN 2↓,σN 2 随观察样本增加而单调减小,且当N →∞, σN 2 →0

当N↑,P(μ|x i )越来越尖峰突起;N→∞, P(μ|x i )→σ函数,这个过程成为贝叶斯学习。

(2)正态分布情况下()i

P x X 的计算

(A)一维正态:已知σ2,μ未知

∑=∧∧==N

k k X N 1

11μθ()()

∧=∧∧∧--=∑=∑μμθX T X N

k N

k k 1

21?=θθθθθθθd P X P P X P X P i i

i )()|()

().|()|(?

=∧

θ

θθθθd X P i )|(求贝叶斯估计020********μσσσσσσμμ+++==∑=∧

N X N N k k N N ∑

=∧+=

N

k k X N N 1

11μμμμθθθd X P X P d X P X P X X P i

i i )|()|()|()|()|(?

?==μμμθθθd x P x P d x P x P x x P i i i )|()|()|()|()|(?=?=?

?

()

()

?----=μ

σμμσπσμσπd x N N N ]21ex p[21]21ex p[212

2(

)(

)

?++-?+-+--=μσ

σμσσμσσσσσσμσσπd x x N N N N N N N N

]21exp[21exp[212

2222222

2222]21

exp[2122222??

? ??+--+=σσμσσπN N N x

(B)多维正态( 已知Σ,估计μ ):

22.非参数估计的条件密度计算公式

(1)Parzen 窗口估计的三种形式,条件密度的计算

(A )窗口的选择:(A )方窗函数;(B )正态窗函数;(C )指数窗函数

(B )条件密度的计算:

(2)K-近邻估计的基本思想及用K-近邻法作后验概率估计的方法

(A )基本思想:以x 为中心建立空胞,使v↑,直到捕捉到K N 个样本为止。 (B )用K-近邻法作后验概率估计的方法:由K N 近邻估计知N 个已知类别样 本落入V N 内为K N 个样本的概率密度估计为

N 个样本落入V N 内有K N 个,K N 个样本内有K i 个样本属于ωi 类,则联合概率密度:

根据Bayes 公式可求出后验概率:

为正态函数

),(2

2σσμ+=N N N μμ0

1

0101)1(1)1(01∑∑∑∑∑??? ??∑∑+-=-++=N N x N N k k N N 分类器就可以设计代入将Bayes d x P x P x x P i

i N ?

=μμμμ)|()|()|(???

??≤=其他.021||,1)(u u ?}21ex p{21)(2u u -=π?|}|exp{)(u u -=?∑

=-==N i N i N N N N h x x V N V N K x P 1)

||(11)(?V N

k x P N

N N =)()()|(),(ωωωi i N i

i N P x P v N k x P ==∑

∑===??=M j i N i N N

i i i i i i N x P x P P x P P x P x P 1

1),()

,()()|()()|()|(ωωωωωωωk k x P N i

i N =)|(ω后验概率的估计:

23. 分类与聚类的区别是什么?

分类:用已知类别的样本训练集来设计分类器(监督学习); 聚类(集群):用事先不知样本的类别,而利用样本的先验知识来构造分类器(无监督学习)。

24.(1)聚合聚类(系统聚类)的算法

思想:先把每个样本作为一类,然后根据它们间的相似性和相邻性聚合。

若有n 个样本:(A )设全部样本分为n 类; (B )作距离矩阵D(0); (C )求最小元素;

(D )将距离平方最小的元素归为一类; (E )以新类从新分类,作距离矩阵D(1); (F )若合并的类数没有达到要求,转(C ),否则停止。

(2)分解聚类的算法

思想:把全部样本作为一类,然后根据相似性、相邻性分解。 目标函数:两类均值方差

N :总样本数, :ω1类样本数 :ω2类样本数,

(3)动态聚类的算法(K-均值算法)

① 先选定某种距离作为样本间的相似性的度量; ② 确定评价聚类结果的准则函数;

③ 给出某种初始分类,用迭代法找出使准则函数取极值的最好的聚类结果。 25.(1)什么是模糊集,α-水平截集? (A )模糊集:假设论域E={x }(讨论的区间),模糊集A 是由隶属函数μA (x )描述。其中,μA (x )是定义在E 上在闭区间{0,1}中取值的一个函数,反映x 对模糊集的隶属程度。 (B )α-水平截集:设A 为E=(x )中的模糊集,则A={x | μA (x )≥α}称为模糊集A 的α水平集, α为阈值在(0,1)间取值。

(2)什么是模糊集的并,交,补运算? 设:A,B 为E=(x )上的两个模糊集 并集:μA ∪ B (x )=max(μA (x ) ,μB (x )) 交集: μA ∩ B (x )=min(μA (x ) ,μB (x )) 补集: =1- μA (x ) , μA (x ) ,μB (x ) 分别为A 、B 的隶属函数

)

()(212121x x x x T N N N E --=

1N 两类均值:,21x x 2

N )(x A μ

(3)什么是模糊关系及其变换运算?

(A)模糊关系:设U,V 为两个模糊集,则u ,v 的笛卡儿乘积集记为:U×V={(u,v )|u ∈U,v ∈V}, (u,v )是 U,V 元素间的一种无约束搭配,若把这种搭配加某种限制, U,V 间的这种特殊关系叫模糊关系R 。 (B)变换运算:

(4)什么是相似关系,等价关系?

(A )相似关系:具有自反性对称性的模糊关系称为相似关系(或类似关系); (B )等价关系:具有自反性、对称性、传递性的模糊关系称为等价关系。

26.模糊识别方法

(1)隶属原则识别法的基本思想

设: A 1, A 2,…. ,A n 是E 中的n 个模糊子集, x 0为E 中的一个元素,若有隶属函数 μi (x o ) =max(μ1(x o ), μ2(x o ),….. μn (x o )),则x o ∈ μi 。 则x o ∈A i

若有了隶属函数μ (x ),我们把隶属函数作为判别函数使用即可。

(2)择近原则识别法的基本思想 (a )贴近度的计算:

(b )设:E 上有n 个模糊子集 及另一模糊子集 。若贴近度

27.模糊聚类分析方法 1)基于等价关系 (1)α-水平截阵 (2)等价划分

(1)α水平截阵: R α =[x | μA (x )≥α] (2)等价划分:若 是E 上的一个等价关系。则对任意阈值α(0≤ α ≤1)则模糊水平集R α

也是E 上的一个等价关系;由小到大选取阈值α(0≤ α ≤1),将矩阵中相同的行的特征归为一类,得到分类;逐渐增大阈值,则分类增多,知道满足分类数目为止。

()()维模糊矩阵是=维模糊矩阵;是=r m s S m n r R ik ij ??~

~[

]

”表示求最小值”表示求最大值,“;式中“令∧∨==∧∨==),...,2,1;,...,2,1(,1

r k n i s r t jk ij m

i ik 。

的最大-最小合成关系与上式表示S R ()~~~~~~S R T S R t T ik =的复合矩阵,记作对为=)]1[21)(~~~~~~B A B A B A ⊙(-+=? ”表示求最小。

”表示求最大,“符号“的内积和外积。与分别称为⊙式中∧∨∨∧=∧∨=∈∈~~~

~~~~~~~))

()(()),()((,B A x B x A B A x B x A B A E x E x ~~2~1,......,,n A A A ~

B 方法。,这就是择近原则识别类则最贴近与则称=..)

(max )(~~~

~1~~i

i j n j i A B A B A B A B ∈??≤≤~

R

2)基于相似关系

(1)求传递闭包 等价 (2)利用等价关系聚类

(1)把相似关系(相似矩阵) 变成等价关系方法为: 取 的乘幂为

(2)选择适当α值,取等价关系R 的α水平集,根据水平集确定样本的类别

另:

1.所有作业涉及的计算问题!

2.分段线性判别方法中的基于凸函数的交方法?

3.结构模式识别中的形式语言、文法推断、句法分析、自动机理论等问题!

~

R ~R ......,,8

~4~2~R R R 4

~4~8~2~2~4~~

~2

~~~2k ~k ~,.

R R R R R R R R R R R R R ===就是模糊等价关系。且则==若在某一步有

模 式 识 别 非 学 位 课 考 试 试 题 考试科目: 模式识别 考试时间 考生姓名: 考生学号 任课教师 考试成绩 一、简答题(每题6分,12题共72分): 1、 监督学习和非监督学习有什么区别? 参考答案:当训练样本的类别信息已知时进行的分类器训练称为监督学习,或者由教师示范的学习;否则称为非监督学习或者无教师监督的学习。 2、 你如何理解特征空间?表示样本有哪些常见方法? 参考答案:由利用某些特征描述的所有样本组成的集合称为特征空间或者样本空间,特征空间的维数是描述样本的特征数量。描述样本的常见方法:矢量、矩阵、列表等。 3、 什么是分类器?有哪些常见的分类器? 参考答案:将特征空中的样本以某种方式区分开来的算法、结构等。例如:贝叶斯分类器、神经网络等。 4、 进行模式识别在选择特征时应该注意哪些问题? 参考答案:特征要能反映样本的本质;特征不能太少,也不能太多;要注意量纲。 5、 聚类分析中,有哪些常见的表示样本相似性的方法? 参考答案:距离测度、相似测度和匹配测度。距离测度例如欧氏距离、绝对值距离、明氏距离、马氏距离等。相似测度有角度相似系数、相关系数、指数相似系数等。 6、 你怎么理解聚类准则? 参考答案:包括类内聚类准则、类间距离准则、类内类间距离准则、模式与类核的距离的准则函数等。准则函数就是衡量聚类效果的一种准则,当这种准则满足一定要求时,就可以说聚类达到了预期目的。不同的准则函数会有不同的聚类结果。 7、 一种类的定义是:集合S 中的元素x i 和x j 间的距离d ij 满足下面公式: ∑∑∈∈≤-S x S x ij i j h d k k )1(1 ,d ij ≤ r ,其中k 是S 中元素的个数,称S 对于阈值h ,r 组成一类。请说明, 该定义适合于解决哪一种样本分布的聚类? 参考答案:即类内所有个体之间的平均距离小于h ,单个距离最大不超过r ,显然该定义适合团簇集中分布的样本类别。 8、 贝叶斯决策理论中,参数估计和非参数估计有什么区别? 参考答案:参数估计就是已知样本分布的概型,通过训练样本确定概型中的一些参数;非参数估计就是未知样本分布概型,利用Parzen 窗等方法确定样本的概率密度分布规律。 9、 基于风险的统计贝叶斯决策理论中,计算代价[λij ]矩阵的理论依据是什么?假设这个矩阵是 M ?N ,M 和N 取决于哪些因素?

模式识别与机器学习期末考查 试卷 研究生姓名:入学年份:导师姓名:试题1:简述模式识别与机器学习研究的共同问题和各自的研究侧重点。 答:(1)模式识别是研究用计算机来实现人类的模式识别能力的一门学科,是指对表征事物或现象的各种形式的信息进行处理和分析,以对事物或现象进行描述、辨认、分类和解释的过程。主要集中在两方面,一是研究生物体(包括人)是如何感知客观事物的,二是在给定的任务下,如何用计算机实现识别的理论和方法。机器学习则是一门研究怎样用计算机来模拟或实现人类学习活动的学科,是研究如何使机器通过识别和利用现有知识来获取新知识和新技能。主要体现以下三方面:一是人类学习过程的认知模型;二是通用学习算法;三是构造面向任务的专用学习系统的方法。两者关心的很多共同问题,如:分类、聚类、特征选择、信息融合等,这两个领域的界限越来越模糊。机器学习和模式识别的理论和方法可用来解决很多机器感知和信息处理的问题,其中包括图像/ 视频分析(文本、语音、印刷、手写)文档分析、信息检索和网络搜索等。 (2)机器学习和模式识别是分别从计算机科学和工程的角度发展起来的,各自的研究侧重点也不同。模式识别的目标就是分类,为了提高分类器的性能,可能会用到机器学习算法。而机器学习的目标是通过学习提高系统性能,分类只是其最简单的要求,其研究更

侧重于理论,包括泛化效果、收敛性等。模式识别技术相对比较成熟了,而机器学习中一些方法还没有理论基础,只是实验效果比较好。许多算法他们都在研究,但是研究的目标却不同。如在模式识别中研究所关心的就是其对人类效果的提高,偏工程。而在机器学习中则更侧重于其性能上的理论证明。试题2:列出在模式识别与机器学习中的常用算法及其优缺点。答:(1)K 近邻法算法作为一种非参数的分类算法,它已经广泛应用于分类、 回归和模式识别等。在应用算法解决问题的时候,要注意的两个方面是样本权重和特征权重。 优缺点:非常有效,实现简单,分类效果好。样本小时误差难控制,存储所有样本,需要较大存储空间,对于大样本的计算量大。(2)贝叶斯决策法 贝叶斯决策法是以期望值为标准的分析法,是决策者在处理 风险型问题时常常使用的方法。 优缺点:由于在生活当中许多自然现象和生产问题都是难以完全准确预测的,因此决策者在采取相应的决策时总会带有一定的风险。贝叶斯决策法就是将各因素发生某种变动引起结果变动的概率凭统计资料或凭经验主观地假设,然后进一步对期望值进行分析,由于此概率并不能证实其客观性,故往往是主观的和人为的概率,本身带有一定的风险性和不肯定性。虽然用期望的大小进行判断有一些风险,但仍可以认为贝叶斯决策是一种兼科学性和实效性于一身的比较完善的用于解决风险型决策问题的方法,在实际中能够广泛应

xx学校 2012—2013学年度第二学期期末试卷 考试课程:《人工智能》考核类型:考试A卷 考试形式:开卷出卷教师: 考试专业:考试班级: 一单项选择题(每小题2分,共10分) 1.首次提出“人工智能”是在(D )年 A.1946 B.1960 C.1916 D.1956 2. 人工智能应用研究的两个最重要最广泛领域为:B A.专家系统、自动规划 B. 专家系统、机器学习 C. 机器学习、智能控制 D. 机器学习、自然语言理解 3. 下列不是知识表示法的是 A 。 A:计算机表示法B:“与/或”图表示法 C:状态空间表示法D:产生式规则表示法 4. 下列关于不确定性知识描述错误的是 C 。 A:不确定性知识是不可以精确表示的 B:专家知识通常属于不确定性知识 C:不确定性知识是经过处理过的知识 D:不确定性知识的事实与结论的关系不是简单的“是”或“不是”。 5. 下图是一个迷宫,S0是入口,S g是出口,把入口作为初始节点,出口作为目标节点,通道作为分支,画出从入口S0出发,寻找出口Sg的状态树。根据深度优先搜索方法搜索的路径是 C 。 A:s0-s4-s5-s6-s9-sg B:s0-s4-s1-s2-s3-s6-s9-sg C:s0-s4-s1-s2-s3-s5-s6-s8-s9-sg D:s0-s4-s7-s5-s6-s9-sg 二填空题(每空2分,共20分) 1.目前人工智能的主要学派有三家:符号主义、进化主义和连接主义。 2. 问题的状态空间包含三种说明的集合,初始状态集合S 、操作符集合F以及目标

状态集合G 。 3、启发式搜索中,利用一些线索来帮助足迹选择搜索方向,这些线索称为启发式(Heuristic)信息。 4、计算智能是人工智能研究的新内容,涉及神经计算、模糊计算和进化计算等。 5、不确定性推理主要有两种不确定性,即关于结论的不确定性和关于证据的不确 定性。 三名称解释(每词4分,共20分) 人工智能专家系统遗传算法机器学习数据挖掘 答:(1)人工智能 人工智能(Artificial Intelligence) ,英文缩写为AI。它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器,该领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等 (2)专家系统 专家系统是一个含有大量的某个领域专家水平的知识与经验智能计算机程序系统,能够利用人类专家的知识和解决问题的方法来处理该领域问题.简而言之,专家系统是一种模拟人类专家解决领域问题的计算机程序系统 (3)遗传算法 遗传算法是一种以“电子束搜索”特点抑制搜索空间的计算量爆炸的搜索方法,它能以解空间的多点充分搜索,运用基因算法,反复交叉,以突变方式的操作,模拟事物内部多样性和对环境变化的高度适应性,其特点是操作性强,并能同时避免陷入局部极小点,使问题快速地全局收敛,是一类能将多个信息全局利用的自律分散系统。运用遗传算法(GA)等进化方法制成的可进化硬件(EHW),可产生超出现有模型的技术综合及设计者能力的新颖电路,特别是GA独特的全局优化性能,使其自学习、自适应、自组织、自进化能力获得更充分的发挥,为在无人空间场所进行自动综合、扩展大规模并行处理(MPP)以及实时、灵活地配置、调用基于EPGA的函数级EHW,解决多维空间中不确定性的复杂问题开通了航向 (4)机器学习 机器学习(Machine Learning)是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科。专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身的性能。它是人工智能的核心,是使计算机具有智能的根本途径,其应用遍及人工智能的各个领域,它主要使用归纳、综合而不是演绎 (5)数据挖掘 数据挖掘是指从数据集合中自动抽取隐藏在数据中的那些有用信息的非平凡过程,这些信息的表现形式为:规则、概念、规律及模式等。它可帮助决策者分析历史数据及当前数据,并从中发现隐藏的关系和模式,进而预测未来可能发生的行为。数据挖掘的

一、填空与选择填空(本题答案写在此试卷上,30分) 1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择 和模式分类。 2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。 3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。 (1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法 4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。 (1)(2) (3) (4) 6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。 (1)二维空间(2)一维空间(3)N-1维空间 7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。 (1)感知器算法(2)H-K算法(3)积累位势函数法 8、下列四元组中满足文法定义的有(1)(2)(4)。 (1)({A, B}, {0, 1}, {A→01, A→ 0A1 , A→ 1A0 , B→BA , B→ 0}, A) (2)({A}, {0, 1}, {A→0, A→ 0A}, A) (3)({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S) (4)({A}, {0, 1}, {A→01, A→ 0A1, A→ 1A0}, A) 9、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类间距离门限、预定的 类别数目))。 10、欧式距离具有( 1、2 );马式距离具有(1、2、3、4 )。 (1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性 11、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别界面法向量指向的 正(负)半空间中;绝对值正比于样本点到判别界面的距离。)。 12、感知器算法1。 (1)只适用于线性可分的情况;(2)线性可分、不可分都适用。

《模式识别原理与技术》课程大纲 课程名称(中文):模式识别原理与技术 课程名称(英文):Pattern Recognition Principles and Techniques 课程编码:Y0703034C 开课单位:电气信息学院 授课对象: 任课教师:郑胜 学时:32 学分:2 学期:2 考核方式:平时成绩占百分之30,考试成绩(可开卷)占百分之70 先修课程:概率论、线性代数、数字信号处理等 课程简介: 一、教学目的与基本要求:(150字以内) 这门课的教学目的是让学生掌握模式识别的基本原理和方法。本课程的主要任务是,通过对模式识别的基本理论和方法、应用实例的学习,使学生掌握模式识别的基本理论与方法,培养学生利用模式识别方法、运用技能解决本专业及相关领域实际问题的能力,为将来继续深入学习或进行科学研究打下坚实的基础。 通过各教学环节,本课程应达到下列要求:认识模式识别的目的和意义,了解模式识别的过程;理解统计分类法的基本思想,掌握几何分类法和概率分类法的几种典型算法;理解聚类分析的基本思想,掌握聚类分析的几种典型算法。 二、课程内容与学时分配 1、课程主要内容:(200字以内) 1)绪论 2)贝叶斯决策理论 3)概率密度函数的估计 4)线性判别函数 5)聚类分析 6)特征提取/选择 7)人工神经网络及支持向量机在模式识别中的应用 2、课程具体安排:(按教学章节编写,重点章节下划线)

三、实验、实践环节及习题内容与要求 四、教材及主要参考文献(顺序为:文献名,作者,出版时间,出版单位): 1. 模式识别导论. 李金宗. 1994年. 高等教育出版社 2. 模式识别. 边肇祺. 2000年1月第2版. 清华大学出版社 3. Pattern Recognition(第二版). Sergios Theodoridis. Konstantinos Koutroumbas. 机械工业出版社. 2006年 撰写人:郑胜 学位分委员会签字: 学院主管研究生教学院长签字:

中国科学技术大学模式识别试题 (2012年春季学期) 姓名:学号:成绩: 一、填空与选择填空(本题答案写在此试卷上,30分) 1、模式识别系统的基本构成单元包括:、 和。 2、统计模式识别中描述模式的方法一般使用;句法模式识别中模式描述方法一般 有、、。 3、聚类分析算法属于;判别域代数界面方程法属于。 (1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法 4、若描述模式的特征量为0-1二值特征量,则一般采用进行相似性度量。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 5、下列函数可以作为聚类分析中的准则函数的有。 (1) (4) 6、Fisher线性判别函数的求解过程是将N维特征矢量投影在中进行。 (1)二维空间(2)一维空间(3)N-1维空间 7、下列判别域界面方程法中只适用于线性可分情况的算法有;线性可分、不可分都适用的 有。 (1)感知器算法(2)H-K算法(3)积累位势函数法 8、下列四元组中满足文法定义的有。 (1)({A, B}, {0, 1}, {A→01, A→ 0A1 , A→ 1A0 , B→BA , B→ 0}, A) (2)({A}, {0, 1}, {A→0, A→ 0A}, A) (3)({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S) (4)({A}, {0, 1}, {A→01, A→ 0A1, A→ 1A0}, A) 二、(15分)简答及证明题 (1)影响聚类结果的主要因素有那些? (2)证明马氏距离是平移不变的、非奇异线性变换不变的。 (3)画出对样本集 ω1:{(0,0,0)T, (1,0,0)T, (1,0,1)T, (1,1,0)T,} PDF 文件使用 "pdfFactory Pro" 试用版本创建https://www.doczj.com/doc/0a8844255.html,

题型: 1.填空题5题 填空题 2.名词解释4题 3.问答题4题 4.计算作图题3题 5.综合计算题1题 备注1:没有整理第一章和第六章,老师说不考的 备注2:非线性判别函数相关概念P69 概率相关定义、性质、公式P83以后 最小错误率贝叶斯决策公式P85 最小风险贝叶斯P86 正态贝叶斯P90 综合计算有可能是第六次作业 一、填空题 物以类聚人以群分体现的是聚类分析的基本思想。 模式识别分类:1.从实现方法来分模式识别分为监督分类和非监督分类;2.从理论上来分,有统计模式识别,统计模式识别,模糊模式识别,神经网络模式识别法 聚类分析是按照不同对象之间的差异,根据距离函数的规律做模式分类的。 模式的特性:可观察性、可区分性、相似性 模式识别的任务:一是研究生物体(包括人)是如何感知对象的,二是如何用计算机实现模式识别的理论和方法。 计算机的发展方向:1.神经网络计算机--模拟人的大脑思维;2.生物计算机--运用生物工程技术、蛋白分子作芯片; 3.光计算机--用光作为信息载体,通过对光的处理来完成对信息的处理。 训练学习方法:监督学习、无监督学习(无先验知识,甚至类别数也未知)。 统计模式识别有:1.聚类分析法(非监督);2.判决函数法/几何分类法(监督);3.基于统计决策的概率分类法 - 以模式集在特征空间中分布的类概率密度函数为基础,对总体特征进行研究,以取得分类的方法 数据的标准化目的:消除各个分量之间数值范围大小对算法的影响 模式识别系统的基本构成:书P7 聚类过程遵循的基本步骤:特征选择;近邻测度;聚类准则;聚类算法;结果验证;结果判定。 相似测度基础:以两矢量的方向是否相近作为考虑的基础,矢量长度并不重要。 确定聚类准则的两种方式:阈值准则,函数准则 基于距离阈值的聚类算法——分解聚类:近邻聚类法;最大最小距离聚类法 类间距离计算准则:1)最短距离法2)最长距离法3)中间距离法4)重心法5)类平均距离法6)离差平方和法P24 系统聚类法——合并的思想 用于随机模式分类识别的方法,通常称为贝叶斯判决。 BAYES 决策常用的准则:最小错误率;最小风险 错误率的计算或估计方法:①按理论公式计算;②计算错误率上界;③实验估计。

模式识别张长水2007.7.1 14:00-16:00 1 (15分)两类分类问题,P(w1)=1/4,P(w2)=3/4。样本有两个特征,分别是x和y。两类?的概率密度函数:w1,在0<=x<=3、0<=y<=3中均匀分布,其余为0;w2,在2<=x<=5、1<=y<=7 中均匀分布,其余为0。请设计做小错误率贝叶斯分类器,并计算误分率。 2 (20分)支持向量机通过二次最优化得到支持向量。现在有一个两类分类问题,共有N 个 样本,样本有d维特征空间,样本集合是线性可分的。试使用遗传算法求解支持向量,说明算法步骤和使用的遗传算子。使用遗传算法求解支持向量有什么优缺点? 3 (20分)两类分类问题,有3个特征x,y,z,共有N个样本。通过经验知道将3个特征进行加权相加得到的特征将具有更好的分类性能,但是不知道如何得到各个特征的权重。试回答? 如何得到各个特征的权重。给出必要的计算和推导过程。 4 (15分)使用多级聚类算法对下面的样本进行聚类,使用最近距离量度。给出计算过程,多级聚类树。问应该分成几类,为什么?举例说明使用最近距离量度聚类和使用最远距离量度聚类各自的优缺点。 (1,0) (2,0) (0,2) (1,3) (0,5) 5 (20分)距离是模式识别中的重要概念,试说明贝叶斯分类器、近邻法、Fisher投影法、C均值算法是否受不同距离量度选择的影响。如果不是,说明原因;如果是,举例说明受什么影响。 6 (10分)一个袋子中装有红、绿、蓝三种颜色的球,采用有放回的取球方法,取出N个球 ,其中有n1个红色球、n2个绿色球和n3个蓝色球的概率为 p(n1,n2,n3)=(N!/(n1!n2!n3!))*p1^n1*p2^n2*p3^n3 其中n1+n2+n3=N,p1+p2+p3=1 已知概率模型如下:p1=1/4 p2=1/4+p/4 p3=1/2-p/4 如果一个人是红绿色盲,分不清红色球和绿色球,那么他只能知道他取了m1=n1+n2个红/绿 球,和m2=n3个蓝色球。试通过这些数据估计概率模型中的p,并估计红色球和绿色球的数? 。 -------------------------------- 不出意外的话应该是在清华最后一门考试了,复习的时候又极其痛苦,500+张ppt, 很多公式要理解要背,所以得纪念一下,粗略回忆一下今天考的内容,给后面的同

《模式识别基础》课程标准 (执笔人:刘雨审阅学院:电子科学与工程学院)课程编号:08113 英文名称:Pattern Recognition 预修课程:高等数学,线性代数,概率论与数理统计,程序设计 学时安排:40学时,其中讲授32学时,实践8学时。 学分:2 一、课程概述 (一)课程性质地位 模式识别课基础程是军事指挥类本科生信息工程专业的专业基础课,通信工程专业的选修课。在知识结构中处于承上启下的重要位置,对于巩固已学知识、开展专业课学习及未来工作具有重要意义。课程特点是理论与实践联系密切,是培养学生理论素养、实践技能和创新能力的重要环节。是以后工作中理解、使用信息战中涉及的众多信息处理技术的重要知识储备。 本课程主要介绍统计模式识别的基本理论和方法,包括聚类分析,判别域代数界面方程法,统计判决、训练学习与错误率估计,最近邻方法以及特征提取与选择。 模式识别是研究信息分类识别理论和方法的学科,综合性、交叉性强。从内涵讲,模式识别是一门数据处理、信息分析的学科,从应用讲,属于人工智能、机器学习范畴。理论上它涉及的数学知识较多,如代数学、矩阵论、函数论、概率统计、最优化方法、图论等,用到信号处理、控制论、计算机技术、生理物理学等知识。典型应用有文字、语音、图像、视频机器识别,雷达、红外、声纳、遥感目标识别,可用于军事、侦探、生物、天文、地质、经济、医学等众多领域。 (二)课程基本理念 以学生为主体,教师为主导,精讲多练,以用促学,学以致用。使学生理解模式识别的本质,掌握利用机器进行信息识别分类的基本原理和方法,在思、学、用、思、学、用的循环中,达到培养理论素养,锻炼实践技能,激发创新能力的目的。 (三)课程设计思路 围绕培养科技底蕴厚实、创新能力突出的高素质人才的目标,本课程的培养目标是:使学生掌握统计模式识别的基本原理和方法,了解其应用领域和发展动态,达到夯实理论基础、锻炼理论素养及实践技能、激发创新能力的目的。 模式识别是研究分类识别理论和方法的学科,综合性、交叉性强,涉及的数学知识多,应用广。针对其特点,教学设计的思路是:以模式可分性为核心,模式特征提取、学习、分类为主线,理论上分层次、抓重点,方法上重比较、突出应用适应性。除了讲授传统的、经典的重要内容之外,结合科研成果,介绍不断出现的新理论、新方法,新技术、新应用,开拓学生视野,激发学习兴趣,培养创新能力。 教学设计以章为单元,用实际科研例子为引导,围绕基本原理展开。选择两个以上基本方法,辅以实验,最后进行对比分析、归纳总结。使学生在课程学习中达到一个思、学、用、

2013–2014 学年度 模式识别 课程期末考试试题 一、计算题 (共20分) 在目标识别中,假定类型1ω为敌方目标,类型2ω为诱饵(假目标),已知先验概率P (1ω)=0.2和P (2ω)=0.8,类概率密度函数如下: ??? ??≤≤-<≤=其它021210)(1x x x x x p ω ?? ? ??≤≤-<≤=其它0323211-)(2x x x x x p ω 1、求贝叶斯最小误判概率准则下的判决域,并判断样本x =1.5属于哪一类; 2、求总错误概率p (e ); 3、假设正确判断的损失λ11=λ22=0,误判损失分别为λ12和λ21,若采用最小损失判决准则,λ12和λ21满足怎样的关系时,会使上述对x =1.5的判断相反? 解:(1)应用贝叶斯最小误判概率准则如果 )()()(2112ωω=x p x p x l <>)() (12ωωP P 则判 ???ωω∈21 x (2分) 得 l 12(1.5)=1 < )() (12ωωP P =4,故 x=1.5属于ω2 。(2分) (2)P(e)= 212121)()()(εω+εω=P P e P ??ΩΩωω+ωω=1 2 )()()()(2211x d x p P x d x p P = dx x x x ??-+- 1.2 1 2 1.2 10.8d )2(0.2)(=0.08 (算式正确2分,计算错误扣1~2分) (3) 两类问题的最小损失准则的似然比形式的判决规则为:

如果 ) )(())(()()(111212221221λ-λωλ-λω< >ωωP P x p x p 则判 ???ωω∈21 x 带入x=1.5得到 λ12≥4λ21 二、证明题(共20分) 设p(x)~N (μ,σ),窗函数?(x)~N (0,1),试证明Parzen 窗估计1 1 ?()( )N i N i N N x x p x Nh h ?=-= ∑ 有如下性质:22 ?[()](,)N N E p x N h μσ+ 。 证明:(1)(为书写方便,以下省略了h N 的下标N ) 22 22 22 2222222222 222211()()()()]22111exp[()()]2221111exp{[()2()]}221 1111exp[()]exp{()[2222y x y x y p y dy dy h h y x y dy h x x y y dy h h h x y h h μ?σμπσσ μμπσσσσ μπσσσ∞ ∞ -∞ -∞∞ -∞∞ -∞ ∞ -∞---=----=--= -+-+++=-+-+-? ??? ?2222()]}x h y dy h σμσ++ 222222 2222222222221 1()exp[(exp()22()2 11()exp[22()1()]2()x x h y dy h h h x h x h μσμπσσσσμπσσμσ∞ +=-+--+-=-+-=-+? (1-1) 121211?[()][()](,,...,)N i N N N i x x E p x p x x x dx dx dx Nh h ?∞ =-∞ -=∑??? 因为样本独立 121211?[()][()]()()...()N i N N N i x x E p x p x p x p x dx dx dx Nh h ?∞ =-∞ -=∑???

北京邮电大学2016——2017学年第二学期 《模式识别》期末考试试题(A卷) ①写出后验概率的表达式,描述它和先验概率的区别。 ②写出线性判别函数的表达式,画图指出参数的物理意义,描述它和神经元模型的联系。 ③为什么说SVM是最优线性分类器,它相比感知器算法的优点是? ④Logistic Regression的优化表达式,它的功能与SVM的作用有什么区别?

⑤单层神经网络有什么局限性?如何将其扩展处理复杂的非线性分类问题? ⑥多层神经网络的主流参数学习算法是什么?试用个公式说明参数学习的原理。 ⑦针对图像处理和识别设计的神经网络是什么?为什么它的参数数量远小于全连接网络? ⑧主成分分析获得的特征有什么特点?主成分投影基向量与博里叶变换基函数有什么区别? ⑨当误差数值的符合什么分布时,我们常用的均方误差是理论最优的?为什么? ⑩当需要衡量两个分布的误差时,一般采用什么物理量作为损失函数?试写出该函数形式。

二、技术应用速答题(每题答案不超过10字,1分*10): ①根据用户画像(上网特征)预测用户购买某类商品的概准,用什么方法? ②为了获得两类分类任务中最靠谱的投影特征,用什么方法? ③两类特征的类条件密度函数未知,对测试样本分类并求出后验概率,用什么方法? ④在训练样本数量较少的两类分类任务中,一般认为什么方法是最靠谱的? ⑤在高维数据分析任务中,什么方法是最常用的数据进行降维方法? ⑥系统要对多类样本进行分类,而手上的分类器只能处理两类,如何扩展? ⑦当采用线性SVM分类器的分类效果较差,应该首先试验什么改进分类器? ⑧我们常用的正态分布的均值和方差公式,是用什么算法估计出来的?. ⑨得到一批无标记(类别标签的)数据,用什么算法可以对其进行自动“分类” ⑩深度学习或者深度神经网络中的“深度”是指

《模式识别》试题库 一、基本概念题 1.1 模式识别的三大核心问题是:、、。 1.2、模式分布为团状时,选用聚类算法较好。 1.3 欧式距离具有。马式距离具有。 (1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性 1.4 描述模式相似的测度有:。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 1.5 利用两类方法处理多类问题的技术途径有:(1);(2); (3)。其中最常用的是第个技术途径。 1.6 判别函数的正负和数值大小在分类中的意义 是:, 。 1.7 感知器算法。 (1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 1.8 积累位势函数法的判别界面一般为。 (1)线性界面;(2)非线性界面。 1.9 基于距离的类别可分性判据有:。 (1) 1 [] w B Tr S S - (2) B W S S (3) B W B S S S + 1.10 作为统计判别问题的模式分类,在()情况下,可使用聂曼-皮尔逊判决准则。 1.11 确定性模式非线形分类的势函数法中,位势函数K(x,x k)与积累位势函数K(x)的关系为 ()。 1.12 用作确定性模式非线形分类的势函数法,通常,两个n维向量x和x k的函数K(x,x k)若同时满足下列三个条件,都可作为势函数。 ①();

②( ); ③ K(x,x k )是光滑函数,且是x 和x k 之间距离的单调下降函数。 1.13 散度J ij 越大,说明ωi 类模式与ωj 类模式的分布( )。当ωi 类模式与ωj 类模式的分布相同时,J ij =( )。 1.14 若用Parzen 窗法估计模式的类概率密度函数,窗口尺寸h1过小可能产生的问题是( ),h1过大可能产生的问题是( )。 1.15 信息熵可以作为一种可分性判据的原因 是: 。 1.16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最小错误判决规则是等价的。 1.17 随机变量l(x ρ)=p( x ρ|ω1)/p( x ρ|ω2),l( x ρ)又称似然比,则E {l( x ρ)|ω2}= ( )。在最小误判概率准则下,对数似然比Bayes 判决规则为( )。 1.18 影响类概率密度估计质量的最重要因素是 ( )。 1.19 基于熵的可分性判据定义为 )] |(log )|([1 x P x P E J i c i i x H ρ ρωω∑=-=,J H 越( ),说明模式的 可分性越强。当P(ωi | x ρ) =( )(i=1,2,…,c)时,J H 取极大值。 1.20 Kn 近邻元法较之于Parzen 窗法的优势在于 ( )。 上述两种算法的共同弱点主要是( )。 1.21 已知有限状态自动机Af=(∑,Q ,δ,q0,F),∑={0,1};Q={q0,q1}; δ:δ(q0,0)= q1,δ(q0,1)= q1,δ(q1,0)=q0,δ(q1,1)=q0;q0=q0;F={q0}。现有输入字符串:(a) 00011101011,(b) 1100110011,(c) 101100111000,(d)0010011,试问,用Af 对上述字符串进行分类的结果为( )。 1.22 句法模式识别中模式描述方法有: 。 (1)符号串 (2)树 (3)图 (4)特征向量

《模式识别》期末考试试题( A ) 一、填空题( 15 个空,每空 2 分,共 30 分) 1 .基于机器学习的模式识别系统通常由两个过程组成 , 即( )和分类判决。 2 .统计模式识别把观察对象表达为一个随机向量 (即特征向量 ), 将 ( ) 表达为由有穷或无穷个具有相似数值特性的 模式组成的集合。 3 .特征一般有两种表达方法 : (1)将特征表达为 ( ); (2)将特征表达为基元。 4 .特征提取是指采用变换或映射实现由模式测量空间向 ( )的转变。 5 .同一类模式类样本的分布比较集中,没有或临界样本很少,这样的模式类称为 ( )。 6 .加权空间的所有 ( )都通过坐标原点。 7.线性多类判别: 若每两个模式类间可用判别平面分开, 在这种情况下, M 类有 ( )个判别函数 ,存在有不确定 区域。 8 .当取 ( )损失函数时 , 最小风险贝叶斯判决准则等价于最大后验概率判决准则。 9.Neyman-Pearson 决策的基本思想是 ( )某一错误率,同时追求另一错误率最小。 10.聚类 /集群:用事先不知样本的类别,而利用样本的先验知识来构造分类器属于 ( )学习。 11.相似性测度、 ( )和聚类算法称为聚类分析的三要素。 12. K/C 均值算法使用的聚类准则函数是 ( )准则,通过反复迭代优化聚类结果,使所有样本到各自所属类别的中 心的距离平方和达到最小。 13.根据神经元的不同连接方式,可将神经网络分为分层网络和相互连接型网络两大类。其中分层网络可细分为前向网 络、具有反馈的前向网络和 ( )三种互连方式。 14.神经网络的特性及能力主要取决于 ( )及学习方法。 15. BP 神经网络是采用误差反向传播算法的多层前向网络,其中,神经元的传输函数为 是一种 ( )映射关系。 二、简答题( 2 题,每小题 10 分,共 20 分) S 型函数,网络的输入和输出 1.简述有监督分类方法和无监督分类方法的主要区别。 1 1/ 2 2.已知一组数据的协方差矩阵为 ,试问: 1/2 1 (1) 协方差矩阵中各元素的含义是什么? (2) K-L 变换的最佳准则是什么? (3) 为什么说经 K-L 变换后消除了各分量之间的相关性? 三、计算题(2 题,每小题 13 分,共 26 分 ) 1.设有两类样本,两类样本的类内离散度矩阵分别为 S 1 1/ 2 , S 1 1/ 2 ,各类样本均值分别为 1 1/ 2 1 2 1/ 2 1 T T μ1 2 0 和 μ2 2 2 ,试用 Fisher 准则求其决策面方程。 2.设有两类正态分布的样本集,第一类均值 μ1 T 1 1/ 2 T 20,方差 1 1/ 2 ,第二类均值 μ2 22,方差 1 1 1/ 2 p( 2 ) 。试按最小错误率 Bayes 决策求两类的分界面。 2 1/ 2 ,先验概率 p( 1 ) 1

《模式识别》试题答案(A卷) 一、填空与选择填空(本题答案写在此试卷上,30分) 1、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类间距离门限、预定 的类别数目))。 2、欧式距离具有( 1、2 );马式距离具有(1、2、 3、4 )。(1)平移不变性(2)旋转不 变性(3)尺度缩放不变性(4)不受量纲影响的特性 3、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别界面法向量指向的 正(负)半空间中;绝对值正比于样本点到判别界面的距离。)。 4、感知器算法1。(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 5、积累势函数法较之于H-K算法的优点是(该方法可用于非线性可分情况(也可用于线性可分情 况));位势函数K(x,x k)与积累位势函数K(x)的关系为( ∑ ∈ = X x x x K x K ~ k k k ) , ( ) ( α )。 6、在统计模式分类问题中,聂曼-皮尔逊判决准则主要用于(某一种判决错误较另一种判决错误更 为重要)情况;最小最大判决准则主要用于(先验概率未知的)情况。 7、“特征个数越多越有利于分类”这种说法正确吗?(错误)。特征选择的主要目的是(从n个特 征中选出最有利于分类的的m个特征(m

模式识别课程设计

模式识别课程设计 聚类图像分割 一.图像分割概述 图像分割是一种重要的图像分析技术。在对图像的研究和应用中,人们往往仅对图像中的某些部分感兴趣。这些部分常称为目标或前景(其他部分称为背景)。它们一般对应图像中特定的、具有独特性质的区域。为了辨识和分析图像中的目标,需要将它们从图像中分离提取出来,在此基础上才有可能进一步对目标进行测量,对图像进行利用。图像分割就是把图像分成各具特性的区域并提取出感兴趣目标的技术和过程。现有的图像分割方法主要分以下几类:基于阈值的分割方法、基于区域的分割方法、基于边缘的分割方法以及基于特定理论的分割方法等。近年来,研究人员不断改进原有的图像分割方法并把其它学科的一些新理论和新方法用于图像分割,提出了不少新的分割方法。 图象分割是图象处理、模式识别和人工智能等多个领域中一个十分重要且又十分困难的问题,是计算机视觉技术中首要的、重要的关键步骤。图象分割应用在许多方面,例如在汽车车型自动识别系统中,从CCD摄像头获取的图象中除了汽车之外还有许多其他的物体和背景,为了进一步提取汽车特征,辨识车型,图象分割是必须的。因此其应用从小到检查癌细胞、精密零件表面缺陷检测,大到处理卫星拍摄的地形地貌照片等。在所有这些应用领域中,最终结

果很大程度上依赖于图象分割的结果。因此为了对物体进行特征的提取和识别,首先需要把待处理的物体(目标)从背景中划分出来,即图象分割。但是,在一些复杂的问题中,例如金属材料内部结构特征的分割和识别,虽然图象分割方法已有上百种,但是现有的分割技术都不能得到令人满意的结果,原因在于计算机图象处理技术是对人类视觉的模拟,而人类的视觉系统是一种神奇的、高度自动化的生物图象处理系统。目前,人类对于视觉系统生物物理过程的认识还很肤浅,计算机图象处理系统要完全实现人类视觉系统,形成计算机视觉,还有一个很长的过程。因此从原理、应用和应用效果的评估上深入研究图象分割技术,对于提高计算机的视觉能力和理解人类的视觉系统都具有十分重要的意义。 二.常用的图像分割方法 1.基于阈值的分割方法 包括全局阈值、自适应阈值、最佳阈值等等。阈值分割算法的关键是确定阈值,如果能确定一个合适的阈值就可准确地将图像分割开来。阈值确定后,将阈值与像素点的灰度值比较和像素分割可对各像素并行地进行,分割的结果直接给出图像区域。全局阈值是指整幅图像使用同一个阈值做分割处理,适用于背景和前景有明显对比的图像。它是根据整幅图像确定的:T=T(f)。但是这种方法只考虑像素本身的灰度值,一般不考虑空间特征,因而对噪声很敏感。常用的全局阈值选取方法有利用图像灰度直方图的峰谷法、最小误差法、最大类间方差法、最大熵自动阈值法以及其它一些方法。

《模式识别》试题库 一、基本概念题 1模式识别的三大核心问题是:( )、( )、( )。 2、模式分布为团状时,选用( )聚类算法较好。 3 欧式距离具有( )。马式距离具有( )。(1)平移不变性(2)旋转不 变性(3)尺度缩放不变性(4)不受量纲影响的特性 4 描述模式相似的测度有( )。(1)距离测度 (2)模糊测度 (3)相似测度 (4) 匹配测度 5 利用两类方法处理多类问题的技术途径有:(1) (2) (3) 。其中最常用的是第( )个技术途径。 6 判别函数的正负和数值大小在分类中的意义是:( )。 7 感知器算法 ( )。(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 8 积累位势函数法的判别界面一般为( )。(1)线性界面;(2)非线性界面。 9 基于距离的类别可分性判据有:( ).(1)1[]w B Tr S S - (2) B W S S (3) B W B S S S + 10 作为统计判别问题的模式分类,在( )情况下,可使用聂曼-皮尔逊判决准则。 11 确定性模式非线形分类的势函数法中,位势函数K(x,xk)与积累位势函数K(x)的关系为 ( )。 12 用作确定性模式非线形分类的势函数法,通常,两个n 维向量x 和xk 的函数K(x,xk)若 同时满足下列三个条件,都可作为势函数。①( ); ②( );③ K(x,xk)是光滑函数,且是x 和xk 之间距离的单调下降函数。 13 散度Jij 越大,说明i 类模式与j 类模式的分布( )。当i 类 模式与j 类模式的分布相同时,Jij=( )。 14 若用Parzen 窗法估计模式的类概率密度函数,窗口尺寸h1过小可能产生的问题是 ( ),h1过大可能产生的问题是( )。 15 信息熵可以作为一种可分性判据的原因是:( )。 16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最 小错误判决规则是等价的。 17 随机变量l(x )=p(x 1)/p(x 2),l(x )又称似然比,则E l( x )2= ( )。在最小误判概率准则下,对数似然比Bayes 判决规则为 ( )。 18 影响类概率密度估计质量的最重要因素( )。 19 基于熵的可分性判据定义为)]|(log )|([1x P x P E J i c i i x H ωω∑=-=,JH 越( ),说 明模式的可分性越强。当P(i| x ) =( )(i=1,2,…,c)时,JH 取极大值。 20 Kn 近邻元法较之于Parzen 窗法的优势在于( )。上 述两种算法的共同弱点主要是( )。 21 已知有限状态自动机Af=(,Q ,,q0,F),={0,1};Q={q0,q1};:(q0, 0)= q1,(q0,1)= q1,(q1,0)=q0,(q1,1)=q0;q0=q0;F={q0}。 现有输入字符串:(a) 000,(b) 11,(c) ,(d)0010011,试问,用Af 对上述字符串进行分