第三讲

分类与回归树

如果一个人必须去选择在很大范围的情形下性能都好的、同时不需要应用开发者付出很多的努力并且易于被终端用户理解的分类技术的话,那么Brieman, Friedman, Olshen 和Stone (1984)提出的分类树方法是一个强有力的竞争者。我们将首先讨论这个分类的过程,然后在后续的节中我们将展示这个过程是如何被用来预测连续的因变量。Brieman 等人用来实现这些过程的程序被称为分类和回归树(CART )方法。

分类树

在分类树下面有两个关键的思想。第一个是关于递归地划分自变量空间的想法;第二个想法是用验证数据进行剪枝。

递归划分

让我们用变量表示因变量(分类变量),用表示自变量。通过递归的方式把关于变量y p x x x ,...,,21x 的维空间划分为不重叠的矩形。这个划分是以递归方式完成的。首先,一个自变量被选择,比如和的一个值,比方说选择把维空间为两部分:一部分是维的超矩形,其中包含的点都满足p i x i x i s i s p ?p i i s x ≤,另一个?p 维超矩形包含所有的点满足。接着,这两部分中的一个部分通过选择一个变量和该变量的划分值以相似的方式被划分。这导致了三个矩形区域(从这里往后我们把超矩形都说成矩形)。随着这个过程的持续,我们得到的矩形越来越小。这个想法是把整个i i s x >x 空间划分为矩形,其中的每个小矩形都尽可能是同构的或“纯”的。“纯”的意思是(矩形)所包含的点都属于同一类。我们认为包含的点都只属于一个类(当然,这不总是可能的,因为经常存在一些属于不同类的点,但这些点的自变量有完全相同的值)。让我们例示递归划分的过程。

例1(Johnson 和Wichern )

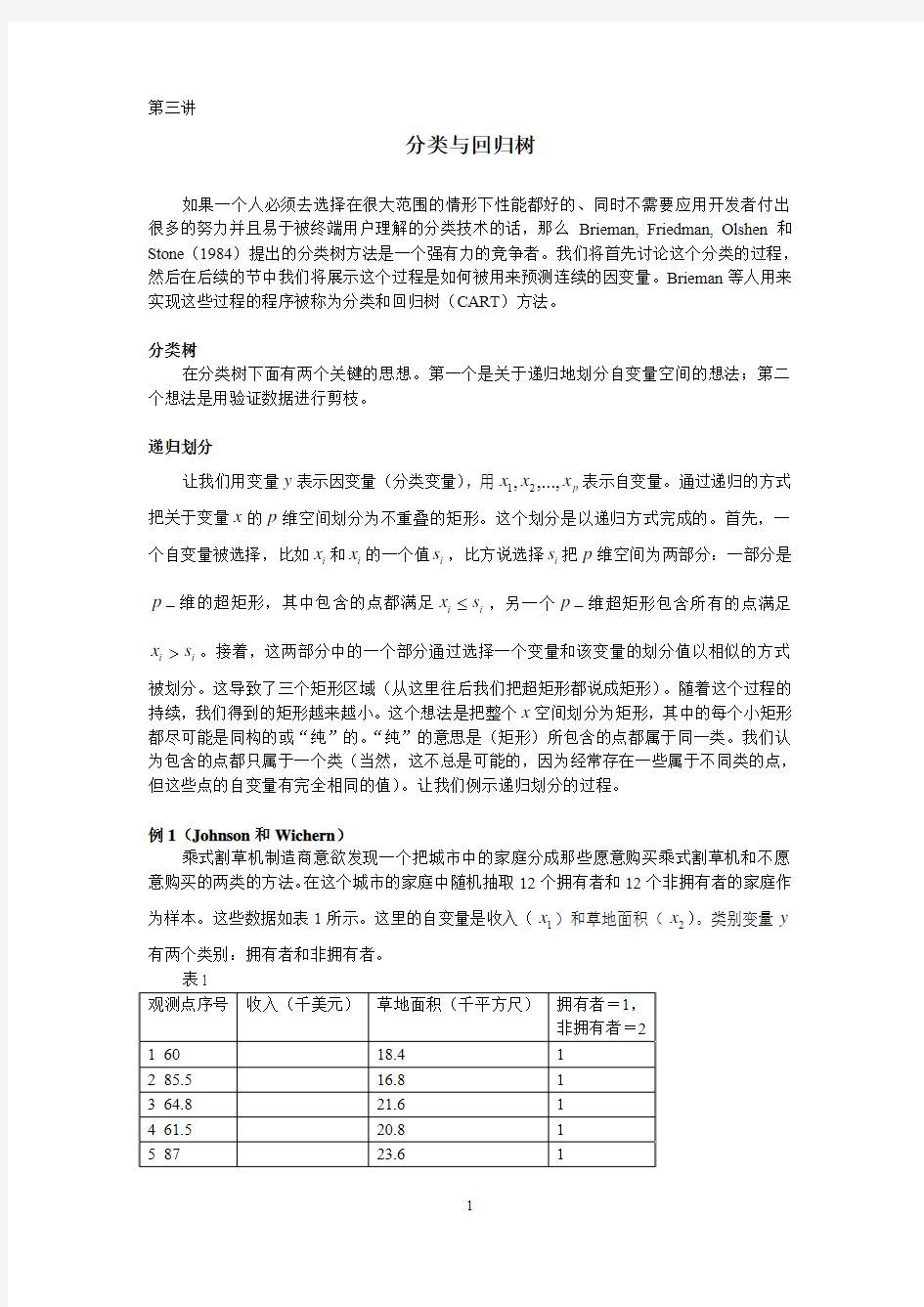

乘式割草机制造商意欲发现一个把城市中的家庭分成那些愿意购买乘式割草机和不愿意购买的两类的方法。在这个城市的家庭中随机抽取12个拥有者和12个非拥有者的家庭作为样本。这些数据如表1所示。这里的自变量是收入()和草地面积()。类别变量有两个类别:拥有者和非拥有者。

1x 2x y 表1 观测点序号 收入(千美元) 草地面积(千平方尺)

拥有者=1,非拥有者=21 60 18.4 1

2 85.5 16.8 1

3 64.8 21.6 1

4 61.

5 20.8 1

5 87

23.6 1

6 110.1 19.2 1

7 108

17.6 1 8 82.8 22.4 1 9 69

20 1 10 93

20.8 1 11 51

22 1 12 81

20 1 13 75

19.6 2 14 52.8

20.8 2 15 64.8

17.2 2 16 43.2

20.4 2 17 84

17.6 2 18 49.2

17.6 2 19 59.4

16 2 20 66

18.4 2 21 47.4

16.4 2 22 33

18.8 2 23 51

14 2 24 63

14.8 2

如果我们用CRAT 方法处理这些数据,它将会选择192=x 做第一次分割。由组),(21x x

成的空间现在按分成草地面积了192≤x 和两个矩形。如图2所示。

192>

x

注意到分裂为两个矩形后的每个矩形比原来分裂之前更同质。上面的矩形包括的点绝大多数是拥有者(9个拥有者,3个非拥有者),而下面的矩形包含绝大多数的非拥有者(9个非拥有者,3个拥有者)。

CART 是如何做这个特殊的划分的?它检查每个变量和该变量所有可能用来划分的值来发现最好的划分。对于一个变量来说,可能划分的值是什么?它们是在一对连续的变量值的中点。对来说可能的划分点是{38.1,45.3,50.1,…,109.5},对来说{14.4,15.4,16.2,…,23}。这些划分点被按照它们能减少杂质(合成物中的异质,不同成分)的多少来分级。杂质的减少被定义为划分前的矩形的杂质减去划分后两个矩形的杂质之和。有很多方法来让我们度量杂质。我们描述最流行的杂质度量方法:Gini 指标。如果我们用,来表示类,其中,C 是对于变量y 的类的总数目,矩形A 的Gini 不纯度可定义为:

1x 2x k C k ,...,2,1=∑=?=C

k k p A I 121)(

其中,是观测点中属于类的比例。注意到当I(A)=0时,如果所有的观测点属于一个类,且有当所有的类在矩形A 中以相同的概率出现时,I(A)被最大化。它的最大值为(C-1)/C 。

k p k 下一个划分点是收入变量。图3再一次表示了CART 的过程,通过灵活地、75.841=x

对划分矩形的不同选择来增加划分后的矩形的纯度。左下角的矩形包含满足和的点,其中除了一个是非拥有者之外包含了其他所有的拥有者。右下角的矩形包含满足和的点,包含了被排除的两个拥有者。

75.841≤x 192≤x 75.841>x 192≤

x 下一次分裂可表示如下:

我们能看到递归划分是如何精炼候选的矩形,使之变得更纯的算法过程。最后阶段的递归分析如图5所示。

注意到现在每个矩形是纯的——所包含的点都是来自这两个类中的某一个。

这个方法被称为分类树算法的原因是每次划分都可以描述为把一个节点分成两个后续节点。第一次分裂表示为树的根节点的分支,如图6所示。

树的前三次划分如图7所示。

整个树如下图8所示。我们用圆来表示带有后续节点的节点。选作划分的变量的名字在圆的下面,在圆中的数是作为划分的点的变量的值。在决策点左侧的数表示在这个决策点的变量的值都小于或等于这个划分的值,在右侧的点的该变量的值大于这个划分的值。这些被称为决策点是因为如果我们用一个树来对新的、仅知道自变量的值的观测样本进行分类时,就是以这样的方式进行的,在每个决策点选择一个正确的分支直到没有后续节点的节点。这种终端的节点被称为树叶。每个叶节点对应一个最终的矩形,x空间被划分,并被描述为一个矩形的节点。当观测点沿着所有到叶节点的路径向下移动时,可将观测点的类别简单地预测为与属于该叶节电的所有训练数据大部分都相同的类别,即采取投票的方式。具有最高选票的类是我们预测新观测点所属的类。在叶节点下面的数表示在训练集中属于这个类的样本占总样本的比例。注意到用CART(称为二叉树)方法得出的树具有如下性质是非常有用的,叶节点的数目刚好比决策点的数目多1。

剪枝

在CART过程中第二个关键的思想是用独立的验证数据集对根据训练集生长的树进行剪枝,这的确是一个创新。以前,这个方法基于递归划分的思想构造出来,但他们不得不用规则来阻止树的过分增长和对训练数据的过适应。例如,CHAID(Chi-平方自动交互检测)是一种在CART前几年出现的递归划分的方法,并被广泛用于数据库营销中。它用著名的统计测试(chi-平方独立性检验)通过显著性去评估是否某一节点能提高分类纯度。如果测试不能表明显著提高,那就不进行划分,CART用验证数据对由训练数据过拟和生成的树进行修剪。

在剪枝背后的思想是承认一个很大的树会过拟和训练数据。在我们的例子中,最后几个划分导致矩形中有很少的点(事实上有4个矩形只包含一个点)。我们能直观地看到这些后面的划分可能只是把训练集中的噪声捕捉到,而不是反映在将来数据中可能发生的模式。剪枝包含后续的选择决策点和当叶节点被砍掉时的重新设计。剪枝过程需要在验证数据集中的误分和对被剪枝的树中决策点数目之间进行权衡与折衷,以得到既能反映数据模式又排除了训练数据中噪声的影响。它用一种被称为“成本复杂性”的标准去生成后续的树,该树的成本复杂性比在该节点只有一个根节点的要小(一个树只有一个节点的分类规则是什么?)。我们于是挑选一个最好的树,它对验证数据具有最小的误分。

CART用的成本复杂性标准是分类树的简单误分(基于验证数据的)加上一个对树的大小的惩罚因素。惩罚因素是基于参数的,让我们用α来表示,每个节点的惩罚。成本复杂性标准对于一个树来说就是Err(T)+α|L(T)|,其中Err(T)是验证数据被树误分部分,L(T)是树T

的叶节点数,α是每个节点惩罚成本:一个从0向上变动的数字。当α=0对于树有太多的节点是没有惩罚,用成本复杂性标准的是完全生长的没有剪枝的树。当我们增加α到一个很大的值时,对误分的惩罚成本部分淹没在成本复杂性方程中,而得到的最小树是一个简单的带有最少叶子的树,也就是只有一个节点。当我们从0增加α到某一值时,我们首先会遇到一个情形,对一些树T1通过在决策点剪掉子树得到的,和额外增加误分(由于有更少的叶子)而导致的成本与导致的惩罚成本的节约相平衡。我们剪掉在这个节点的子树来修剪整个树,并重新设计这个节点为叶节点。把这时的树称为T1。我们现在对T1重复先前用于整个树的过程,通过进一步增加α的值。持续这种方式,我们产生一些连续的带有节点数目减少的树直到只有一个节点的树。

从这个序列的树,从其中选择一个在验证数据集上具有最小误分的树是一个很自然的。我们把这个树称为最小错误树。

让我们用Boston Housing数据来例示。下面是当用训练数据在树的生长阶段的算法时,XLMiner产生的输出。

表训练记录

表训练误分汇总

上面的表通过在每一行中树的决策点的数目和相应的对训练数据的误分记录了树生长的阶段。我们看到随着决策点的从0(就是树只包含了根节点)增加到30的过程中误分的错误稳步减少。刚开始错误急剧减少,从误分率从36%减小到3%,而决策点只从0增加到

3。其后,随着我们增加树的规模,改进变慢了。最后,我们在有30个决策点的整个树(相当于31个叶子)停止下来,这时对训练数据没有误分。这也在混淆表和分类的错误报告中表现出来。

通过XLMiner在剪枝阶段产生的输出如下表所示:

决策点训练误差验证误差

30 0.00% 15.84%

29 0.00% 15.84%

28 0.01% 15.84%

27 0.02% 15.84%

26 0.03% 15.84%

25 0.03% 15.84%

24 0.05% 15.84%

23 0.08% 15.84%

22 0.09% 15.84%

21 0.09% 16.34%

20 0.09% 15.84%

19 0.15% 15.84%

18 0.21% 15.84%

17 0.22% 15.84%

16 0.25% 15.84%

15 0.32% 15.84%

14 0.34% 15.35%

13 0.35% 14.85%

12 0.42% 14.85%

11 0.49% 15.35%

10 0.59% 14.85% ?最小错误剪枝标准差0.02501957

9 0.63% 15.84%

8 1.20% 15.84%

7 1.26% 16.83%

6 1.42% 16.83%

?最佳剪枝

5 1.88% 15.84%

4 2.94% 21.78%

3 3.29% 21.78%

2 5.75% 30.20%

33.66%

1 15.64%

注意到当决策点的数目下降时,在验证数据中的误分有一个缓慢下降的趋势(带有一点波动)直到14.85%误分率和10个决策点。这从下面的图中可容易地看出。其后,当树还是较小时,误分急剧地上升。有10个决策点的最小误分的树被选择(为什么不选具有13个决策点时的树?)。

最小误分树如下图9所示。

你也许会注意到从剪枝阶段XLMiner 输出突出了除了最小错误树的另一个树。这是最佳剪枝树,这个树有5个决策点。这个树很重要,因为它是在剪枝序列中含有误差在最小误差树的一个标准差之内最小的树。我们从验证数据中估计的误差是:它是一个估计。如果我们有另一个验证数据集最小误差将会不同。我们算出的最小误差率能被看作一个带有标准差的(估计的标准偏差)等于val N E E )1(min min ?的随机变量的观测值,其中E min 对最小误差树的错误率(作为一部分),N val 是验证数据集的数目。对我们的例子E min =0.1485,N val =202,因此标准差是0.025。最佳剪枝树如下图10所示:

最佳剪枝树的混淆表和分类错误总结如下:验证误分总结:

注意到我们在分类中已经使用了验证数据是很重要的,严格地说,直接把上面的错误率和其它只用训练数据来构建分类规则的分类过程进行对比是不公平的。一个公平的比较是将训练数据(TDother)进一步划分为训练(TDtree)和测试数据(VDtree)。用TDtree构建的分类树,用VDtree修剪这个树,这时可以和用验证数据的其它分类器(VDother)相比。

从树中得出的分类规则

树分类器非常流行的一个原因是他们能提供易于理解的分类规则(至少是在树不是很大的情况时)。每个叶子相当于一个分类规则。例如,在上面最佳剪枝树的左上叶子,给我们如下规则:

如果(LSTAT<=15.145)和(ROOM<=6.5545),那么类=2

这样的规则和诸如判别函数等其它的分类器输出相比,容易被管理者和操作人员解释。和神经网络中的权值相比,它的逻辑当然更透明。

分类树方法是一种好的不用定制的分类器选择

我们在这章的开头说,分类树要求开发者付出相对小的努力。让我们给出这个表述的理由。树不需要调整参数。不需要对变量进行转换(任何对变量所做的单调的转换会给出同样的树)。由于变量子集的选择是划分选择的一部分,因此这是自动的;在我们的例子中注意到最佳剪枝树自动地从13个变量中选择了三个变量(LSTAT,RM,CRIM)。树对于例外也有一定的鲁棒性,选择划分时依靠观测点的值的顺序而不是按照这些值的绝对大小。

最后,CART过程易于修改去处理丢失数据,而不必归因于数值或删除有缺失值的观测点。这个方法也能被延伸到对变量按照他们对分类质量的影响进行级别重要性的划分。

注意:

1、我们没有描述类别的自变量在CART中是如何被处理。原则上,这没有什么困难。对分类变量的划分选择通常在可以被分成两个子集的类别值中选择。例如,一个类别变量有4个类别值,比如说,{1,2,3,4},划分为两个子集可以有7中不同的分法:{1}和{2,3,4}、{2}和{1,3,4}、{3}和{1,2,4}、{4}和{1,2,3}、{1,2}和{3,4}、{1,3}和{2,4}、{1,4}{2,3}等。当分类的数目较大,划分的数目也变得非常大。XLMiner仅支持二值变量(被编码为数字)。如果一个类别自变量有两个以上的值,需要用一些虚拟的二值变量替代它,这些二值变量和在回归中的虚拟变量有相同的使用方式。

2、在上面描述的基本的递归划分方案中有一些变化。一个通常的变化是允许用不与坐标轴相垂直的直线来划分x变量空间(对p=3的平面和p>3的超平面)。这会导致当用线性分类函数进行分类时,整个树有很少的特殊节点,使得整个树很纯。然而这个提高是有代价的。首先,分类树的易解释性消失了,因为我们现在是在自变量的权重和的基础上进行划分的,而这个权重不容易解释。其次,早期树的对于自变量进行单调变换而保持树不便的显著属性不在成立了。

3、除了CHAID,另一个常用的分类树是ID3方法(和它后续的一些方法C4.5)。这个方法由Quinlan领导的机器学习研究者们提出的,并被拥有机器学习背景的分类器开发者推

广。

在回归中我们通常用y 表示因变量(类别变量),用等表示自变量。分类树的关键思想在回归树中稍加修改即可。 p x x x x ,...,,321

数据挖掘整理(熊熊整理-----献给梦中的天涯) 单选题 1.下面哪种分类方法是属于神经网络学习算法?() A. 判定树归纳 B. 贝叶斯分类 C. 后向传播分类 D. 基于案例的推理 2.置信度(confidence)是衡量兴趣度度量( A )的指标。 A、简洁性 B、确定性 C.、实用性 D、新颖性 3.用户有一种感兴趣的模式并且希望在数据集中找到相似的模式,属于数据挖掘哪一类任务?(A) A. 根据内容检索 B. 建模描述 C. 预测建模 D. 寻找模式和规则 4.数据归约的目的是() A、填补数据种的空缺值 B、集成多个数据源的数据 C、得到数据集的压缩表示 D、规范化数据 5.下面哪种数据预处理技术可以用来平滑数据,消除数据噪声? A.数据清理 B.数据集成 C.数据变换 D.数据归约 6.假设12个销售价格记录组已经排序如下:5, 10, 11, 13, 15, 35, 50, 55, 72, 92, 204, 215 使用如下每种方法将它们划分成四个箱。等频(等深)划分时,15在第几个箱子内?(B) A 第一个 B 第二个 C 第三个 D 第四个 7.下面的数据操作中,()操作不是多维数据模型上的OLAP操作。 A、上卷(roll-up) B、选择(select) C、切片(slice) D、转轴(pivot) 8.关于OLAP和OLTP的区别描述,不正确的是: (C) A. OLAP主要是关于如何理解聚集的大量不同的数据.它与OTAP应用程序不同. B. 与OLAP应用程序不同,OLTP应用程序包含大量相对简单的事务. C. OLAP的特点在于事务量大,但事务内容比较简单且重复率高. D. OLAP是以数据仓库为基础的,但其最终数据来源与OLTP一样均来自底层的数据库系统,两者面对的用户是相同的 9.下列哪个描述是正确的?() A、分类和聚类都是有指导的学习 B、分类和聚类都是无指导的学习

数据挖掘分类算法比较 分类是数据挖掘、机器学习和模式识别中一个重要的研究领域。通过对当前数据挖掘中具有代表性的优秀分类算法进行分析和比较,总结出了各种算法的特性,为使用者选择算法或研究者改进算法提供了依据。 一、决策树(Decision Trees) 决策树的优点: 1、决策树易于理解和解释.人们在通过解释后都有能力去理解决策树所表达的意义。 2、对于决策树,数据的准备往往是简单或者是不必要的.其他的技术往往要求先把数据一般化,比如去掉多余的或者空白的属性。 3、能够同时处理数据型和常规型属性。其他的技术往往要求数据属性的单一。 4、决策树是一个白盒模型。如果给定一个观察的模型,那么根据所产生的决策树很容易推出相应的逻辑表达式。 5、易于通过静态测试来对模型进行评测。表示有可能测量该模型的可信度。 6、在相对短的时间内能够对大型数据源做出可行且效果良好的结果。 7、可以对有许多属性的数据集构造决策树。 8、决策树可很好地扩展到大型数据库中,同时它的大小独立于数据库的大小。 决策树的缺点: 1、对于那些各类别样本数量不一致的数据,在决策树当中,信息增益的结果偏向于那些具有更多数值的特征。 2、决策树处理缺失数据时的困难。 3、过度拟合问题的出现。 4、忽略数据集中属性之间的相关性。 二、人工神经网络 人工神经网络的优点:分类的准确度高,并行分布处理能力强,分布存储及学习能力强,对噪声神经有较强的鲁棒性和容错能力,能充分逼近复杂的非线性关系,具备联想记忆的功能等。 人工神经网络的缺点:神经网络需要大量的参数,如网络拓扑结构、权值和阈值的初始值;不能观察之间的学习过程,输出结果难以解释,会影响到结果的可信度和可接受程度;学习时间过长,甚至可能达不到学习的目的。

分类技术在很多领域都有应用,例如可以通过客户分类构造一个分类模型来对银行贷款进行风险评估;当前的市场营销中很重要的一个特点是强调客户细分。客户类别分析的功能也在于此,采用数据挖掘中的分类技术,可以将客户分成不同的类别,比如呼叫中心设计时可以分为:呼叫频繁的客户、偶然大量呼叫的客户、稳定呼叫的客户、其他,帮助呼叫中心寻找出这些不同种类客户之间的特征,这样的分类模型可以让用户了解不同行为类别客户的分布特征;其他分类应用如文献检索和搜索引擎中的自动文本分类技术;安全领域有基于分类技术的入侵检测等等。机器学习、专家系统、统计学和神经网络等领域的研究人员已经提出了许多具体的分类预测方法。下面对分类流程作个简要描述: 训练:训练集——>特征选取——>训练——>分类器 分类:新样本——>特征选取——>分类——>判决 最初的数据挖掘分类应用大多都是在这些方法及基于内存基础上所构造的算法。目前数据挖掘方法都要求具有基于外存以处理大规模数据集合能力且具有可扩展能力。 神经网络 神经网络是解决分类问题的一种行之有效的方法。神经网络是一组连接输入/输出单元的系统,每个连接都与一个权值相对应,在将简单的单元连接成较复杂的系统后,通过并行运算实现其功能,其中系统的知识存储于网络结构和各单元之间的连接权中。在学习阶段,通过调整神经网络的权值,达到对输入样本的正确分类。神经网络有对噪声数据的高承受能力和对未经训练数据的模式分类能力。神经网

络概括性强、分类精度高,可以实现有监督和无监督的分类任务,所以神经网络在分类中应用非常广泛。 在结构上,可以把一个神经网络划分为输入层、输出层和隐含层(见图4)。网络的每一个输入节点对应样本一个特征,而输出层节点数可以等于类别数,也可以只有一个,(输入层的每个节点对应一个个的预测变量。输出层的节点对应目标变量,可有多个)。在输入层和输出层之间是隐含层(对神经网络使用者来说不可见),隐含层的层数和每层节点的个数决定了神经网络的复杂度。 除了输入层的节点,神经网络的每个节点都与很多它前面的节点(称为此节点的输入节点)连接在一起,每个连接对应一个权重Wxy,此节点的值就是通过它所有输入节点的值与对应连接权重乘积的和作为一个函数的输入而得到,我们把这个函数称为活动函数或挤压函数。如图5中节点4输出到节点6的值可通过如下计算得到:

全面解析数据挖掘的分类及各种分析方法 1.数据挖掘能做以下六种不同事情(分析方法): ?分类(Classification) ?估值(Estimation) ?预言(Prediction) ?相关性分组或关联规则(Affinitygroupingorassociationrules) ?聚集(Clustering) ?描述和可视化(DescriptionandVisualization) ?复杂数据类型挖掘(Text,Web,图形图像,视频,音频等) 2.数据挖掘分类 以上六种数据挖掘的分析方法可以分为两类:直接数据挖掘;间接数据挖掘?直接数据挖掘 目标是利用可用的数据建立一个模型,这个模型对剩余的数据,对一个特定的变量(可以理解成数据库中表的属性,即列)进行描述。 ?间接数据挖掘 目标中没有选出某一具体的变量,用模型进行描述;而是在所有的变量中建立起某种关系。 ?分类、估值、预言属于直接数据挖掘;后三种属于间接数据挖掘 3.各种分析方法的简介 ?分类(Classification) 首先从数据中选出已经分好类的训练集,在该训练集上运用数据挖掘分类的技术,建立分类模型,对于没有分类的数据进行分类。 例子: a.信用卡申请者,分类为低、中、高风险 b.分配客户到预先定义的客户分片 注意:类的个数是确定的,预先定义好的 ?估值(Estimation) 估值与分类类似,不同之处在于,分类描述的是离散型变量的输出,而估值处理连续值的输出;分类的类别是确定数目的,估值的量是不确定的。 例子: a.根据购买模式,估计一个家庭的孩子个数 b.根据购买模式,估计一个家庭的收入 c.估计realestate的价值

数据挖掘常用的方法 在大数据时代,数据挖掘是最关键的工作。大数据的挖掘是从海量、不完全的、有噪 声的、模糊的、随机的大型数据库中发现隐含在其中有价值的、潜在有用的信息和知 识的过程,也是一种决策支持过程。其主要基于人工智能,机器学习,模式学习,统 计学等。通过对大数据高度自动化地分析,做出归纳性的推理,从中挖掘出潜在的模式,可以帮助企业、商家、用户调整市场政策、减少风险、理性面对市场,并做出正 确的决策。目前,在很多领域尤其是在商业领域如银行、电信、电商等,数据挖掘可 以解决很多问题,包括市场营销策略制定、背景分析、企业管理危机等。大数据的挖 掘常用的方法有分类、回归分析、聚类、关联规则、神经网络方法、Web 数据挖掘等。这些方法从不同的角度对数据进行挖掘。 (1)分类。分类是找出数据库中的一组数据对象的共同特点并按照分类模式将其划分为不同的类,其目的是通过分类模型,将数据库中的数据项映射到摸个给定的类别中。 可以应用到涉及到应用分类、趋势预测中,如淘宝商铺将用户在一段时间内的购买情 况划分成不同的类,根据情况向用户推荐关联类的商品,从而增加商铺的销售量。 (2)回归分析。回归分析反映了数据库中数据的属性值的特性,通过函数表达数据映射的关系来发现属性值之间的依赖关系。它可以应用到对数据序列的预测及相关关系的 研究中去。在市场营销中,回归分析可以被应用到各个方面。如通过对本季度销售的 回归分析,对下一季度的销售趋势作出预测并做出针对性的营销改变。 (3)聚类。聚类类似于分类,但与分类的目的不同,是针对数据的相似性和差异性将一组数据分为几个类别。属于同一类别的数据间的相似性很大,但不同类别之间数据的 相似性很小,跨类的数据关联性很低。 (4)关联规则。关联规则是隐藏在数据项之间的关联或相互关系,即可以根据一个数据项的出现推导出其他数据项的出现。关联规则的挖掘过程主要包括两个阶段:第一阶 段为从海量原始数据中找出所有的高频项目组;第二极端为从这些高频项目组产生关联规则。关联规则挖掘技术已经被广泛应用于金融行业企业中用以预测客户的需求,各 银行在自己的ATM 机上通过捆绑客户可能感兴趣的信息供用户了解并获取相应信息来改善自身的营销。 (5)神经网络方法。神经网络作为一种先进的人工智能技术,因其自身自行处理、分布存储和高度容错等特性非常适合处理非线性的以及那些以模糊、不完整、不严密的知 识或数据为特征的处理问题,它的这一特点十分适合解决数据挖掘的问题。典型的神 经网络模型主要分为三大类:第一类是以用于分类预测和模式识别的前馈式神经网络 模型,其主要代表为函数型网络、感知机;第二类是用于联想记忆和优化算法的反馈式神经网络模型,以Hopfield 的离散模型和连续模型为代表。第三类是用于聚类的自组

第三讲 分类与回归树 如果一个人必须去选择在很大范围的情形下性能都好的、同时不需要应用开发者付出很多的努力并且易于被终端用户理解的分类技术的话,那么Brieman, Friedman, Olshen 和Stone (1984)提出的分类树方法是一个强有力的竞争者。我们将首先讨论这个分类的过程,然后在后续的节中我们将展示这个过程是如何被用来预测连续的因变量。Brieman 等人用来实现这些过程的程序被称为分类和回归树(CART )方法。 分类树 在分类树下面有两个关键的思想。第一个是关于递归地划分自变量空间的想法;第二个想法是用验证数据进行剪枝。 递归划分 让我们用变量表示因变量(分类变量),用表示自变量。通过递归的方式把关于变量y p x x x ,...,,21x 的维空间划分为不重叠的矩形。这个划分是以递归方式完成的。首先,一个自变量被选择,比如和的一个值,比方说选择把维空间为两部分:一部分是维的超矩形,其中包含的点都满足p i x i x i s i s p ?p i i s x ≤,另一个?p 维超矩形包含所有的点满足。接着,这两部分中的一个部分通过选择一个变量和该变量的划分值以相似的方式被划分。这导致了三个矩形区域(从这里往后我们把超矩形都说成矩形)。随着这个过程的持续,我们得到的矩形越来越小。这个想法是把整个i i s x >x 空间划分为矩形,其中的每个小矩形都尽可能是同构的或“纯”的。“纯”的意思是(矩形)所包含的点都属于同一类。我们认为包含的点都只属于一个类(当然,这不总是可能的,因为经常存在一些属于不同类的点,但这些点的自变量有完全相同的值)。让我们例示递归划分的过程。 例1(Johnson 和Wichern ) 乘式割草机制造商意欲发现一个把城市中的家庭分成那些愿意购买乘式割草机和不愿意购买的两类的方法。在这个城市的家庭中随机抽取12个拥有者和12个非拥有者的家庭作为样本。这些数据如表1所示。这里的自变量是收入()和草地面积()。类别变量有两个类别:拥有者和非拥有者。 1x 2x y 表1 观测点序号 收入(千美元) 草地面积(千平方尺) 拥有者=1,非拥有者=21 60 18.4 1 2 85.5 16.8 1 3 64.8 21.6 1 4 61. 5 20.8 1 5 87 23.6 1

《数据挖掘分类实验报告》 信息安全科学与工程学院 1120362066 尹雪蓉数据挖掘分类过程 (1)数据分析介绍 本次实验为典型的分类实验,为了便于说明问题,弄清数据挖掘具体流程,我们小组选择了最经典的决策树算法进行具体挖掘实验。 (2)数据准备与预处理 在进行数据挖掘之前,我们首先要对需要挖掘的样本数据进行预处理,预处理包括以下步骤: 1、数据准备,格式统一。将样本转化为等维的数据特征(特征提取),让所有的样 本具有相同数量的特征,同时兼顾特征的全面性和独立性 2、选择与类别相关的特征(特征选择) 3、建立数据训练集和测试集 4、对数据集进行数据清理 在本次实验中,我们选择了ILPD (Indian Liver Patient Dataset) 这个数据集,该数据集已经具有等维的数据特征,主要包括Age、Gender、TB、DB、Alkphos、Sgpt、Sgot、TP、ALB、A/G、classical,一共11个维度的数据特征,其中与分类类别相关的特征为classical,它的类别有1,2两个值。 详见下表: 本实验的主要思路是将该数据集分成训练集和测试集,对训练集进行训练生成模型,然后再根据模型对测试集进行预测。 数据集处理实验详细过程:

●CSV数据源处理 由于下载的原始数据集文件Indian Liver Patient Dataset (ILPD).csv(见下图)中间并不包含属性项,这不利于之后分类的实验操作,所以要对该文件进行处理,使用Notepad文件,手动将属性行添加到文件首行即可。 ●平台数据集格式转换 在后面数据挖掘的实验过程中,我们需要借助开源数据挖掘平台工具软件weka,该平台使用的数据集格式为arff,因此为了便于实验,在这里我们要对csv文件进行格式转换,转换工具为weka自带工具。转换过程为: 1、打开weka平台,点击”Simple CLI“,进入weka命令行界面,如下图所示: 2、输入命令将csv文件导成arff文件,如下图所示: 3、得到arff文件如下图所示: 内容如下:

朴素贝叶斯: 有以下几个地方需要注意: 1. 如果给出的特征向量长度可能不同,这是需要归一化为通长度的向量(这里以文本分类为例),比如说是句子单词的话,则长度为整个词汇量的长度,对应位置是该单词出现的次数。 2. 计算公式如下: 其中一项条件概率可以通过朴素贝叶斯条件独立展开。要注意一点就是的计算方法,而由朴素贝叶斯的前提假设可知, = ,因此一般有两种,一种是在类别为ci的那些样本集中,找到wj出现次数的总和,然后除以该样本的总和;第二种方法是类别为ci的那些样本集中,找到wj出现次数的总和,然后除以该样本中所有特征出现次数的总和。 3. 如果中的某一项为0,则其联合概率的乘积也可能为0,即2中公式的分子为0,为了避免这种现象出现,一般情况下会将这一项初始化为1,当然为了保证概率相等,分母应对应初始化为2(这里因为是2类,所以加2,如果是k类就需要加k,术语上叫做laplace 光滑, 分母加k的原因是使之满足全概率公式)。 朴素贝叶斯的优点: 对小规模的数据表现很好,适合多分类任务,适合增量式训练。 缺点: 对输入数据的表达形式很敏感。 决策树: 决策树中很重要的一点就是选择一个属性进行分枝,因此要注意一下信息增益的计算公式,并深入理解它。 信息熵的计算公式如下:

其中的n代表有n个分类类别(比如假设是2类问题,那么n=2)。分别计算这2类样本在总样本中出现的概率p1和p2,这样就可以计算出未选中属性分枝前的信息熵。 现在选中一个属性xi用来进行分枝,此时分枝规则是:如果xi=vx的话,将样本分到树的一个分支;如果不相等则进入另一个分支。很显然,分支中的样本很有可能包括2个类别,分别计算这2个分支的熵H1和H2,计算出分枝后的总信息熵H’=p1*H1+p2*H2.,则此时的信息增益ΔH=H-H’。以信息增益为原则,把所有的属性都测试一边,选择一个使增益最大的属性作为本次分枝属性。 决策树的优点: 计算量简单,可解释性强,比较适合处理有缺失属性值的样本,能够处理不相关的特征; 缺点: 容易过拟合(后续出现了随机森林,减小了过拟合现象); Logistic回归: Logistic是用来分类的,是一种线性分类器,需要注意的地方有: 1. logistic函数表达式为: 其导数形式为: 2. logsitc回归方法主要是用最大似然估计来学习的,所以单个样本的后验概率为: 到整个样本的后验概率:

国际权威的学术组织the IEEE International Conference on Data Mining (ICDM) 2006年12月评选出了数据挖掘领域的十大经典算法:C4.5, k-Means, SVM, Apriori, EM, PageRank, AdaBoost, kNN, Naive Bayes, and CART. 不仅仅是选中的十大算法,其实参加评选的18种算法,实际上随便拿出一种来都可以称得上是经典算法,它们在数据挖掘领域都产生了极为深远的影响。 1. C4.5 C4.5算法是机器学习算法中的一种分类决策树算法,其核心算法是ID3算法. C4.5算法继承了ID3算法的优点,并在以下几方面对ID3算法进行了改进: 1) 用信息增益率来选择属性,克服了用信息增益选择属性时偏向选择取值多的属性的不足; 2) 在树构造过程中进行剪枝; 3) 能够完成对连续属性的离散化处理; 4) 能够对不完整数据进行处理。 C4.5算法有如下优点:产生的分类规则易于理解,准确率较高。其缺点是:在构造树的过程中,需要对数据集进行多次的顺序扫描和排序,因而导致算法的低效。 2. The k-means algorithm 即K-Means算法 k-means algorithm算法是一个聚类算法,把n的对象根据他们的属性分为k个分割,k < n。它与处理混合正态分布的最大期望算法很相似,因为他们都试图找到数据中自然聚类的中心。它假设对象属性来自于空间向量,并且目标是使各个群组内部的均方误差总和最小。 3. Support vector machines 支持向量机,英文为Support Vector Machine,简称SV机(论文中一般简称SVM)。它是一种監督式學習的方法,它广泛的应用于统计分类以及回归分析中。支持向量机将向量映射到一个更高维的空间里,在这个空间里建立有一个最大间隔超平面。在分开数据的超平面的两边建有两个互相平行的超平面。分隔超平面使两个平行超平面的距离最大化。假定平行超平面间的距离或差距越大,分类器的总误差越小。一个极好的指南是C.J.C Burges的《模式识别支持向量机指南》。van der Walt 和 Barnard 将支持向量机和其他分类器进行了

首都师范大学 硕士学位论文 数据挖掘分类算法的研究与应用 姓名:刘振岩 申请学位级别:硕士 专业:计算机应用技术 指导教师:王万森 2003.4.1

首都师范入学硕.卜学位论Z数据挖掘分类算法的研究与应用 摘要 , f随着数据库技术的成熟应用和Internet的迅速发展,人类积累的数据量正在以指数速度增长。科于这些数据,人{}j已经不满足于传统的查询、统计分析手段,而需要发现更深层次的规律,对决策或科研工作提供更有效的决策支持。正是为了满足这种要求,从大量数据中提取出隐藏在其中的有用信息,将机器学习应用于大型数据库的数据挖掘(DataMining)技术得到了长足的发展。 所谓数据挖掘(DataMining,DM),也可以称为数据库中的知识发现(KnowledgeDiscoverDat曲鹅e,KDD),就是从大量的、不完全的、有噪声的、模糊的、随机的数据r},,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。发现了的知识可以被用于信息管理、查询优化、决策支持、过程控制等,还可以用于数据自身的维护。因此,数据挖掘是数据库研究中的一个很有应用价值的新领域,它又是一门广义的交叉学科,融合了数据库、人工智能、机器学习、统计学等多个领域的理论和技术。 分类在数据挖掘中是一项非常重要的任务,目前在商业上应用最多。分类的目的是学会一个分类函数或分类模型,该模型能把数据库中的数据项映射到给定类别中的某一个。{乍多分类的方法已被机器学习、专家系统、统计学和神经生物学方面的研究者提}H。本论文主要侧重数据挖掘中分类算法的研究,并将分类算法划分为急切分类和懒散分类,全部研究内容基本围绕着这种划分方法展开。.1本文的主要研究内容:, l,讨论了数掂挖掘中分类的基本技术,包括数据分类的过程,分类数据所需的数据预处理技术,以及分类方法的比较和评估标准;比较了几种典 型的分类算法,包括决策树、k.最近邻分类、神经网络算法:接着,引 出本文的研究重点,即将分类算法划分为急切分类和懒散分类,并基于 这种划分展歼对数据挖掘分类算法的研究。 2.结合对决簸树方法的研究,重点研究并实现了一个“懒散的基于模型的分类”思想的“懒散的决策树算法”。在决策树方法的研究中,阐述了决 策树的基本概念以及决策树的优缺点,决策树方法的应用状况,分析了 决策树算法的迸一步的研究重点。伪了更好地满足网络环境下的应用需 求,结合传统的决策树方法,基于Ⅶ懒散的基于模型的分类”的思想, 实现了一个网络环境下基于B/S模式的“懒散的决策树算法”。实践表明: 在WEB应fH程序叶i采用此算法取得了很好的效果。、 ≯ 3.选取神经H络分类算法作为急切分类算法的代表进行深入的研究。在神经网络中,重点分析研究了感知器基本模型,包括感知器基本模型的构 造及其学习算法,模型的几何意义及其局限性。并针对该模型只有在线 性可分的情况一F彳‘能用感知器的学习算法进行分类的这一固有局限性, 研究并推广了感知器模型。

数据挖掘中的文本挖掘的分类算法综述 摘要 随着Internet上文档信息的迅猛发展,文本分类成为处理和组织大量文档数据的关键技术。本文首先对数据挖掘进行了概述包括数据挖掘的常用方法、功能以及存在的主要问题;其次对数据挖掘领域较为活跃的文本挖掘的历史演化、研究现状、主要内容、相关技术以及热点难点问题进行了探讨;在第三章先分析了文本分类的现状和相关问题,随后详细介绍了常用的文本分类算法,包括KNN 文本分类算法、特征选择方法、支持向量机文本分类算法和朴素贝叶斯文本分类算法;;第四章对KNN文本分类算法进行深入的研究,包括基于统计和LSA降维的KNN文本分类算法;第五章对数据挖掘、文本挖掘和文本分类的在信息领域以及商业领域的应用做了详细的预测分析;最后对全文工作进行了总结和展望。 关键词:数据挖掘,文本挖掘,文本分类算法 ABSTRACT With the development of Web 2.0, the number of documents on the Internet increases exponentially. One important research focus on how to deal with these great capacity of online documents. Text classification is one crucial part of information management. In this paper we first introduce the basic information of data mining, including the methods, contents and the main existing problems in data mining fields; then we discussed the text mining, one active field of data mining, to provide a basic foundation for text classification. And several common algorithms are analyzed in Chapter 3. In chapter 4 thorough research of KNN text classification algorithms are illustrated including the statistical and dimension reduction based on LSA and in chapter 5 we make some predictions for data mining, text mining and text classification and finally we conclude our work. KEYWORDS: data mining, text mining, text classification algorithms,KNN 目录 摘要 (1) ABSTRACT (1) 目录 (1)

数据挖掘分类算法研究综述 程建华 (九江学院信息科学学院软件教研室九江332005 ) 摘要:随着数据库应用的不断深化,数据库的规模急剧膨胀,数据挖掘已成为当今研究的热点。特别是其中的分类问题,由于其使用的广泛性,现已引起了越来越多的关注。对数据挖掘中的核心技术分类算法的内容及其研究现状进行综述。认为分类算法大体可分为传统分类算法和基于软计算的分类法两类。通过论述以上算法优缺点和应用范围,研究者对已有算法的改进有所了解,以便在应用中选择相应的分类算法。 关键词:数据挖掘;分类;软计算;算法 1引言 1989年8月,在第11届国际人工智能联合会议的专题研讨会上,首次提出基于数据库的知识发现(KDD,Knowledge DiscoveryDatabase)技术[1]。该技术涉及机器学习、模式识别、统计学、智能数据库、知识获取、专家系统、数据可视化和高性能计算等领域,技术难度较大,一时难以应付信息爆炸的实际需求。到了1995年,在美国计算机年会(ACM)上,提出了数据挖掘[2](DM,Data Mining)的概念,由于数据挖掘是KDD过程中最为关键的步骤,在实践应用中对数据挖掘和KDD这2个术语往往不加以区分。 基于人工智能和信息系统,抽象层次上的分类是推理、学习、决策的关键,是一种基础知识。因而数据分类技术可视为数据挖掘中的基础和核心技术。其实,该技术在很多数据挖掘中被广泛使用,比如关联规则挖掘和时间序列挖掘等。因此,在数据挖掘技术的研究中,分类技术的研究应当处在首要和优先的地位。目前,数据分类技术主要分为基于传统技术和基于软计算技术两种。 2传统的数据挖掘分类方法 分类技术针对数据集构造分类器,从而对未知类别样本赋予类别标签。在其学习过程中和无监督的聚类相比,一般而言,分类技术假定存在具备环境知识和输入输出样本集知识的老师,但环境及其特性、模型参数等却是未知的。 2.1判定树的归纳分类 判定树是一个类似流程图的树结构,其中每个内部节点表示在一个属性上的测试,每个分支代表一个测试输出,而每个树叶节点代表类或类分布。树的最顶层节点是根节点。由判定树可以很容易得到“IFTHEN”形式的分类规则。方法是沿着由根节点到树叶节点的路径,路径上的每个属性-值对形成“IF”部分的一个合取项,树叶节点包含类预测,形成“THEN”部分。一条路径创建一个规则。 判定树归纳的基本算法是贪心算法,它是自顶向下递归的各个击破方式构造判定树。其中一种著名的判定树归纳算法是建立在推理系统和概念学习系统基础上的ID3算法。 2.2贝叶斯分类 贝叶斯分类是统计学的分类方法,基于贝叶斯公式即后验概率公式。朴素贝叶斯分类的分类过程是首先令每个数据样本用一个N维特征向量X={X1,X2,?X n}表示,其中X k是属性A k的值。所有的样本分为m类:C1,C2,?,C n。对于一个类别的标记未知的数据记录而言,若P(C i/X)>P(C j/X),1≤ j≤m,j≠i,也就是说,如果条件X下,数据记录属于C i类的概率大于属于其他类的概率的话,贝叶斯分类将把这条记录归类为C i类。 建立贝叶斯信念网络可以被分为两个阶段。第一阶段网络拓扑学习,即有向非循环图的——————————————————— 作者简介:程建华(1982-),女,汉族,江西九江,研究生,主要研究方向为数据挖掘、信息安全。

一、实验目的 使用数据挖掘中的分类算法,对数据集进行分类训练并测试。应用不同的分类算法,比较他们之间的不同。与此同时了解Weka平台的基本功能与使用方法。 二、实验环境 实验采用Weka 平台,数据使用Weka安装目录下data文件夹下的默认数据集。 Weka是怀卡托智能分析系统的缩写,该系统由新西兰怀卡托大学开发。Weka使用Java 写成的,并且限制在GNU通用公共证书的条件下发布。它可以运行于几乎所有操作平台,是一款免费的,非商业化的机器学习以及数据挖掘软件。Weka提供了一个统一界面,可结合预处理以及后处理方法,将许多不同的学习算法应用于任何所给的数据集,并评估由不同的学习方案所得出的结果。 三、数据预处理 Weka平台支持ARFF格式和CSV格式的数据。由于本次使用平台自带的ARFF格式数据,所以不存在格式转换的过程。实验所用的ARFF格式数据集如图1所示 图1 ARFF格式数据集 对于iris数据集,它包含了150个实例(每个分类包含50个实例),共有sepal length、

sepal width、petal length、petal width和class五种属性。期中前四种属性为数值类型,class属性为分类属性,表示实例所对应的的类别。该数据集中的全部实例共可分为三类:Iris Setosa、Iris Versicolour和Iris Virginica。 实验数据集中所有的数据都是实验所需的,因此不存在属性筛选的问题。若所采用的数据集中存在大量的与实验无关的属性,则需要使用weka平台的Filter(过滤器)实现属性的筛选。 实验所需的训练集和测试集均为。 四、实验过程及结果 应用iris数据集,分别采用LibSVM、决策树分类器和朴素贝叶斯分类器进行测试和评价,分别在训练数据上训练出分类模型,找出各个模型最优的参数值,并对三个模型进行全面评价比较,得到一个最好的分类模型以及该模型所有设置的最优参数。最后使用这些参数以及训练集和校验集数据一起构造出一个最优分类器,并利用该分类器对测试数据进行预测。 1、LibSVM分类 Weka 平台内部没有集成libSVM分类器,要使用该分类器,需要下载并导入到Weka中。 用“Explorer”打开数据集“”,并在Explorer中将功能面板切换到“Classify”。点“Choose”按钮选择“functions,选择LibSVM分类算法。 在Test Options 面板中选择Cross-Validatioin folds=10,即十折交叉验证。然后点击“start”按钮:

数据挖掘中客户的特征化及其划分(一) 摘要]良好客户关系已成为电子商务时代制胜的关键。在激烈的市场竞争中,客户关系管理逐渐成为企业关注的焦点。深入研究客户和潜在客户是在市场中保持竞争力的关键。本文通过对客户行为的特征化分析,以数据挖掘为分析工具,对客户关系管理进行了讨论,给出了相应的划分方法,使用这些划分方法,对客户进行分析是有意义的。 关键词]客户关系管理数据挖掘聚类分析 一、引言 在激烈的市场竞争中,客户关系管理(CustomerRelationshipManagement)逐渐成为各企业关注的焦点。一个成熟的CRM系统要能够有效地获取客户的各种信息,识别客户与企业间的关系及所有交互操作,寻找其中的规律,为客户提供个性化的服务,为企业决策提供支持。 在企业与客户的交互操作中,“二八原则”是值得借鉴的,即20%的客户对企业做出80%的利润贡献。但究竟谁是那20%的客户?又如何确定特定消费群体的消费习惯与消费倾向,进而推断出相应消费群体或个体下一步的消费行为?这都是企业需要认真研究的问题。 二、客户的特征化及其划分 企业认识客户和潜在客户是在市场保持竞争力的关键。特征分析是了解客户和潜在客户的极好方法,包括对感兴趣对象范围进行一般特征的度量。一旦知道带来最大利润客户的特征和行为,就可以直接将其应用到寻找潜在客户之中。有效寻找客户,认识哪些人群像自己的客户。因此,在争取客户的活动中,对感兴趣对象进行特征化及其划分是很有意义的。 对客户的特征化,顾名思义就是用数据来描述或给出客户(潜在客户)特征的活动。特征化可以在数据库(或数据库的不同部分)上进行。这些不同部分也称为划分,通常他们互不包含。 划分分析(SegmentationAnalysis)通常用于根据利润和市场潜力划分客户。如:零售商按客户在所有零售商店的总体购买行为,将客户划分为若干描述他们各自购买行为的区域,这样零售商可以评估哪些客户有最大利润。划分是把数据库分成互不相交部分或分区的活动。一般有两种方法:市场驱动法和数据驱动法。市场驱动法需要决定那些对业务有重要影响的特征,即需要预先选择一些特征变量(属性),以最终定义得到划分。数据驱动法是利用数据挖掘中的聚类技术或要素分析技术寻找同质群体。 三、数据挖掘的概念 数据挖掘(DataMining)是从大型数据库或数据仓库中提取人们感兴趣的知识,这些知识是隐含的、事先未知的潜在有用信息。通过数据挖掘提取的知识表示为概念、规则、规律、模式等,它对企业的趋势预测和行为决策提供支持。 1.分类分析 分类是指将数据映射到预先定义好的群组或类。分类要求基于数据属性值来定义类别,通过数据特征来描述类别。根据它与预先定义好的类别相似度,划分到某一类中去。分类的主要应用是导出数据的分类模型,然后使用模型预测。 2.聚类分析 聚类是对抽象样本集合分组的过程。与分类不同之处在于聚类操作要划分的类是事先未知。按照同一类中对象之间较高相似度原则进行划分,目的是使同一类别个体之间距离尽可能小,不同类别中个体间距离尽可能大。类的形成是由数据驱动的。 3.关联规则 关联规则是从大量的数据中挖掘出有价值的描述数据项之间相互关联的知识。关联规则中有两个重要概念:支持度(Support)和信任度(Confidence)。它们是两个度量有关规则的方法,描述了被挖掘出规则的有用性和确定性。关联规则挖掘,希望发现事务数据库中数据项之间的关联,这些规则往往能反映客户的购买行为模式。

数据挖掘之七种常用的方法 利用数据挖掘进行数据分析常用的方法主要有分类、回归分析、聚类、关联规则、特征、变化和偏差分析、Web页挖掘等,它们分别从不同的角度对数据 进行挖掘。 1.分类 分类是找出数据库中一组数据对象的共同特点并按照分类模式将其划分为 不同的类,其目的是通过分类模型,将数据库中的数据项映射到某个给定的类别。 它可以应用到客户的分类、客户的属性和特征分析、客户满意度分析、客户的购买趋势预测等,如一个汽车零售商将客户按照对汽车的喜好划分成不同的类,这样营销人员就可以将新型汽车的广告手册直接邮寄到有这种喜好的客户手中,从而大大增加了商业机会。 2.回归分析 回归分析方法反映的是事务数据库中属性值在时间上的特征,产生一个将数据项映射到一个实值预测变量的函数,发现变量或属性间的依赖关系,其主要研究问题包括数据序列的趋势特征、数据序列的预测以及数据间的相关关系等。 它可以应用到市场营销的各个方面,如客户寻求、保持和预防客户流失活动、产品生命周期分析、销售趋势预测及有针对性的促销活动等。 3.聚类 聚类分析是把一组数据按照相似性和差异性分为几个类别,其目的是使得属于同一类别的数据间的相似性尽可能大,不同类别中的数据间的相似性尽可能小。 它可以应用到客户群体的分类、客户背景分析、客户购买趋势预测、市场的细分等。 4.关联规则 关联规则是描述数据库中数据项之间所存在的关系的规则,即根据一个事务中某些项的出现可导出另一些项在同一事务中也出现,即隐藏在数据间的关联或相互关系。 在客户关系管理中,通过对企业的客户数据库里的大量数据进行挖掘,可以从大量的记录中发现有趣的关联关系,找出影响市场营销效果的关键因素,为产品定位、定价与定制客户群,客户寻求、细分与保持,市场营销与推销,营销风险评估和诈骗预测等决策支持提供参考依据。 5.特征 特征分析是从数据库中的一组数据中提取出关于这些数据的特征式,这些特征式表达了该数据集的总体特征。如营销人员通过对客户流失因素的特征提取,可以得到导致客户流失的一系列原因和主要特征,利用这些特征可以有效地预防客户的流失。

数据挖掘之分类算法的研究 摘要:对分类算法中需要解决的关键问题进行了分析;综述了不同分类算法的思想和特性,决策树分类算法能够很好地处理噪声数据,但只能对规模较小的训练样本集有效;贝叶斯分类算法精度高、速度快、错误率低、但分类不够准确;传统的基于关联规则算法分类算法准确率高,但容易受硬件内存的制约;支持向量机算法分类准确率高、复杂性低,但速度慢。并且针对决策树分类算法的缺点进行了改进。 关键字:数据挖掘,分类算法,决策树 0 引言 数据挖掘是从海量数据中获取有用知识和价值的过程,是数据库技术自然演化的结果。数据挖掘已广泛应用于零售、金融、保险、医疗、通讯等行业,并展现出了其强大的知识发现的能力。在数据挖掘的研究与应用中,分类( Classification) 算法一直受学术界的关注,它是一种有监督的学习,通过对已知类别训练集的分析,从中发现分类规则,以此预测新数据的类别。数据分类算法中,为建立模型而被分析的数据元组组成的数据集合称为训练数据集,训练数据集中的单个样本( 或元组) 称为训练样本。分类算法是将一个未知样本分到几个已存在类的过程,主要包含两个步骤: 第1 步,根据类标号已知的训练数据集,训练并构建一个模型,用于描述预定的数据类集或概念集; 第2 步,使用所获得的模型,对将来或未知的对象进行分类。 1 分类算法中的关键问题 不同的分类算法有不同的特性,完成不同的任务。目前很多分类算法被机器学习、专家系统、统计学和神经生物学等的研究者从不同角度提出,判断不同分类算法的好坏可以由准确率、速度、健壮性、可伸缩性、可解释性等几个标准来衡量。另外,分类算法的效果通常和数据的特点有关,有的数据有空缺值,有的噪声大,有的分部稀疏,有的属性是连续的,有的则是离散或混合的。经典的分类算法都有在不同的领域取得成功,比如决策树分类算法用于医疗诊断、金融分析、评估贷款申请的信用风险等广阔领域; 支持向量机分类算法应用于模式识别、基因分析、文本分类、语音识别、回归分析等领域; 由于对噪声数据具有很好的承受能力,神经网络广泛应用在字符识别、分子生物学、语音识别和人脸识别等

《数据挖掘》总复习题 1.数据挖掘系统可以根据什么标准进行分类? 答:根据挖掘的数据库类型分类、根据挖掘的知识类型分类、根据挖掘所用的技术分类、根据应用分类 2.知识发现过程包括哪些步骤? 答:数据清理、数据集成、数据选择、数据变换、数据挖掘、模式评估、知识表示 3.什么是概念分层? 答:一个映射序列,将低层概念映射到更一般的较高层概念。 4.多维数据模型上的 OLAP 操作包括哪些? 答:上卷、下钻、切片和切块、转轴 / 旋转、其他OLAP操作5.OLAP 服务器类型有哪几种? 答:关系OLAP 服务器(ROLAP)、多维OLAP 服务器(MOLAP)、混合 OLAP 服务器 (HOLAP)、特殊的 SQL 服务器 6.数据预处理技术包括哪些? 答:聚集、抽样、维规约、特征子集选择、特征创建、离散化和二元化、变量变换。 7.什么是数据清理? 答:填写缺失的值,平滑噪声数据,识别、删除离群点,解决不一致性 8.什么是数据集成? 答:集成多个数据库、数据立方体或文件 9.什么是数据归约? 答:得到数据集的压缩表示,它小得多,但可以得到相同或相近的结果 10.数据清理的内容包括哪些? 答:缺失值、噪声数据、数据平滑、聚类、回归 11.将下列缩略语复原 OLAP——on-line analytical processing DM——data mining KDD——knowledge discovery in databases OLTP——on-line transaction processing DBMS——database management system DWT——discrete wavelet transform (DMQL)--Data Mining Query Language 12.什么是数据挖掘? 答:简单地说,数据挖掘是从大量数据中提取或挖掘知识。具体地

大数据理论与技术读书报告 -----K最近邻分类算法 指导老师 : 陈莉 学生姓名 : 李阳帆 学号 : 201531467 专业 : 计算机技术 日期 : 2016年8月31日

摘要 数据挖掘是机器学习领域内广泛研究的知识领域,是将人工智能技术和数据库技术紧密结合,让计算机帮助人们从庞大的数据中智能地、自动地提取出有价值的知识模式,以满足人们不同应用的需要。K 近邻算法(KNN)是基于统计的分类方法,是大数据理论与分析的分类算法中比较常用的一种方法。该算法具有直观、无需先验统计知识、无师学习等特点,目前已经成为数据挖掘技术的理论和应用研究方法之一。本文主要研究了 K 近邻分类算法,首先简要地介绍了数据挖掘中的各种分类算法,详细地阐述了K 近邻算法的基本原理和应用领域,最后在matlab环境里仿真实现,并对实验结果进行分析,提出了改进的方法。 关键词:K 近邻,聚类算法,权重,复杂度,准确度

1.引言 (1) 2.研究目的与意义 (1) 3.算法思想 (2) 4.算法实现 (2) 4.1 参数设置 (2) 4.2数据集 (2) 4.3实验步骤 (3) 4.4实验结果与分析 (3) 5.总结与反思 (4) 附件1 (6)

1.引言 随着数据库技术的飞速发展,人工智能领域的一个分支—— 机器学习的研究自 20 世纪 50 年代开始以来也取得了很大进展。用数据库管理系统来存储数据,用机器学习的方法来分析数据,挖掘大量数据背后的知识,这两者的结合促成了数据库中的知识发现(Knowledge Discovery in Databases,简记 KDD)的产生,也称作数据挖掘(Data Ming,简记 DM)。 数据挖掘是信息技术自然演化的结果。信息技术的发展大致可以描述为如下的过程:初期的是简单的数据收集和数据库的构造;后来发展到对数据的管理,包括:数据存储、检索以及数据库事务处理;再后来发展到对数据的分析和理解, 这时候出现了数据仓库技术和数据挖掘技术。数据挖掘是涉及数据库和人工智能等学科的一门当前相当活跃的研究领域。 数据挖掘是机器学习领域内广泛研究的知识领域,是将人工智能技术和数据库技术紧密结合,让计算机帮助人们从庞大的数据中智能地、自动地抽取出有价值的知识模式,以满足人们不同应用的需要[1]。目前,数据挖掘已经成为一个具有迫切实现需要的很有前途的热点研究课题。 2.研究目的与意义 近邻方法是在一组历史数据记录中寻找一个或者若干个与当前记录最相似的历史纪录的已知特征值来预测当前记录的未知或遗失特征值[14]。近邻方法是数据挖掘分类算法中比较常用的一种方法。K 近邻算法(简称 KNN)是基于统计的分类方法[15]。KNN 分类算法根据待识样本在特征空间中 K 个最近邻样本中的多数样本的类别来进行分类,因此具有直观、无需先验统计知识、无师学习等特点,从而成为非参数分类的一种重要方法。 大多数分类方法是基于向量空间模型的。当前在分类方法中,对任意两个向量: x= ) ,..., , ( 2 1x x x n和) ,..., , (' ' 2 ' 1 'x x x x n 存在 3 种最通用的距离度量:欧氏距离、余弦距 离[16]和内积[17]。有两种常用的分类策略:一种是计算待分类向量到所有训练集中的向量间的距离:如 K 近邻选择K个距离最小的向量然后进行综合,以决定其类别。另一种是用训练集中的向量构成类别向量,仅计算待分类向量到所有类别向量的距离,选择一个距离最小的类别向量决定类别的归属。很明显,距离计算在分类中起关键作用。由于以上 3 种距离度量不涉及向量的特征之间的关系,这使得距离的计算不精确,从而影响分类的效果。