协方差及相关系数分解

- 格式:ppt

- 大小:1.10 MB

- 文档页数:32

协方差与相关系数公式详解了解变量之间的关联程度协方差与相关系数公式详解:了解变量之间的关联程度在统计学中,协方差和相关系数是了解变量之间关联程度的重要指标。

它们能够帮助我们判断两个或多个变量之间的关系以及它们对彼此的影响程度。

本文将详细解释协方差和相关系数的公式以及如何使用它们来进行分析。

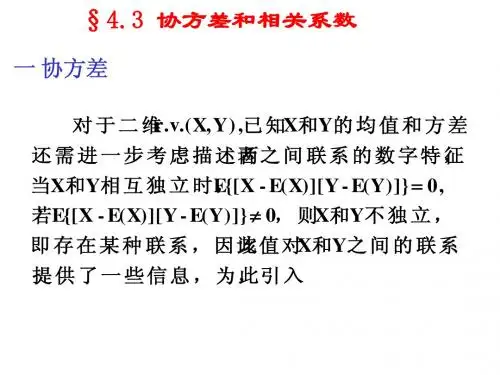

一、协方差协方差用于衡量两个变量的总体误差。

它的公式如下:协方差= Σ[(Xi- X均) * (Yi - Y均)] / N其中,Xi和Yi是样本的观测值,X均和Y均是样本的均值,N是样本量。

协方差具有以下几个性质:1. 如果两个变量的协方差大于0,则它们正相关;如果协方差小于0,则它们负相关;如果协方差等于0,则它们不相关。

2. 协方差的绝对值大小不能反映出变量之间的强度和方向。

3. 协方差受到变量单位的影响,不便于比较不同数据集之间的关联程度。

二、相关系数相关系数用于衡量两个变量之间的线性关系强度和方向,它可以消除变量单位的影响。

最常用的是皮尔逊相关系数,其计算公式如下:相关系数 = 协方差 / (X标准差 * Y标准差)其中,X标准差和Y标准差分别是X和Y的标准差。

相关系数取值范围在-1到1之间,具有以下特点:1. 相关系数为1时,表示两个变量完全正相关,即存在着线性关系。

2. 相关系数为-1时,表示两个变量完全负相关,即一个变量的增加与另一个变量的减小呈线性关系。

3. 相关系数接近0时,表示两个变量之间关系较弱,接近随机关系。

4. 若相关系数为0,表示两个变量之间不存在线性关系。

通过计算相关系数,我们可以了解到变量之间关联程度的强弱。

然而,需要注意的是相关系数只能衡量线性关系,若变量之间存在非线性关系,则相关系数可能无法准确刻画它们之间的关系。

三、协方差和相关系数的应用协方差和相关系数广泛应用于金融学、经济学、社会科学等领域。

它们能够提供关于变量之间关系的重要信息,有助于数据分析和决策制定。

在金融领域,协方差和相关系数可用于评估资产之间的风险和收益关系。

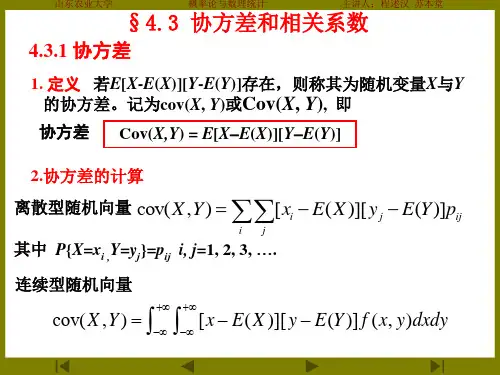

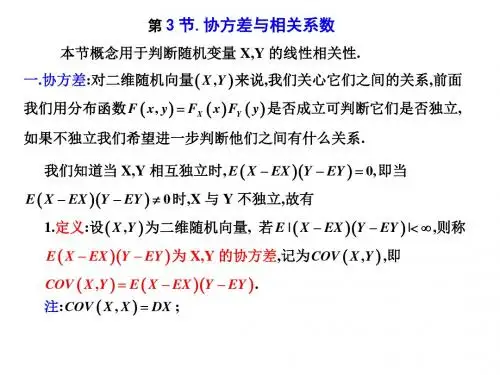

协⽅差与相关系数协⽅差与相关系数协⽅差⼆维随机变量(X,Y),X与Y之间的协⽅差定义为:Cov(X,Y)=E{[X-E(X)][Y-E(Y)]}其中:E(X)为分量X的期望,E(Y)为分量Y的期望协⽅差Cov(X,Y)是描述随机变量相互关联程度的⼀个特征数。

从协⽅差的定义可以看出,它是X的偏差【X-E(X)】与Y的偏差【Y-E(Y)】的乘积的数学期望。

由于偏差可正可负,因此协⽅差也可正可负。

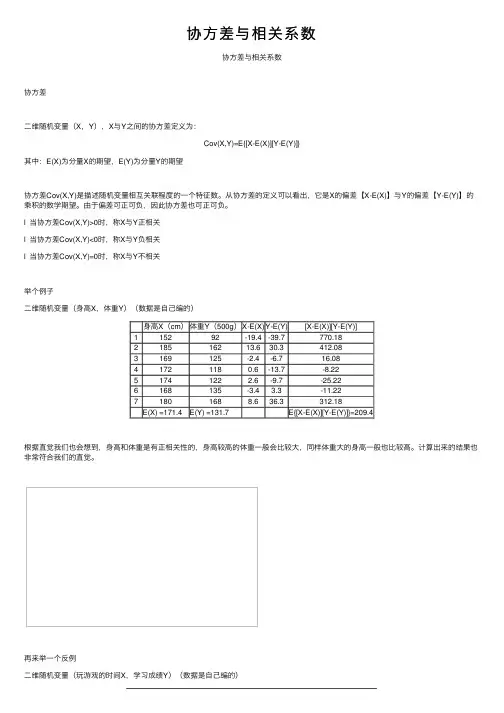

l 当协⽅差Cov(X,Y)>0时,称X与Y正相关l 当协⽅差Cov(X,Y)<0时,称X与Y负相关l 当协⽅差Cov(X,Y)=0时,称X与Y不相关举个例⼦⼆维随机变量(⾝⾼X,体重Y)(数据是⾃⼰编的)⾝⾼X(cm)体重Y(500g)X-E(X)Y-E(Y)[X-E(X)][Y-E(Y)]115292-19.4-39.7770.18218516213.630.3412.083169125-2.4-6.716.0841721180.6-13.7-8.225174122 2.6-9.7-25.226168135-3.4 3.3-11.2271801688.636.3312.18E(X) =171.4E(Y) =131.7E{[X-E(X)][Y-E(Y)]}=209.4根据直觉我们也会想到,⾝⾼和体重是有正相关性的,⾝⾼较⾼的体重⼀般会⽐较⼤,同样体重⼤的⾝⾼⼀般也⽐较⾼。

计算出来的结果也⾮常符合我们的直觉。

再来举⼀个反例⼆维随机变量(玩游戏的时间X,学习成绩Y)(数据是⾃⼰编的)游戏时间游戏时间X(h/天)学习成绩Y X-E(X)Y-E(Y)[X-E(X)][Y-E(Y)] 1095-1.3620.7-28.152 2165-0.36-9.3 3.348 3370 1.64-4.3-7.052 42550.64-19.3-12.3525 2.565 1.14-9.3-10.602 60.580-0.86 5.7-4.902 70.590-0.8615.7-13.502E(X) =1.36E(Y) =74.3E{[X-E(X)][Y-E(Y)]}= -10.5同样根据直觉我们也会觉得,⼩朋友玩游戏的时间越长,学习成绩越差的可能性就越⼤,计算结果也很好的符合我们的直觉。

协方差与相关系数深度剖析在统计学和数据分析领域,协方差和相关系数是描述随机变量之间关系的重要工具。

虽然它们可能被新手混淆,但它们有着各自独特的定义和用途。

在本文中,我们将对协方差和相关系数进行深度剖析,讨论它们的计算方法、性质、应用场合及其相互关系。

一、协方差的定义及计算协方差是用来衡量两个随机变量之间的共同变化程度的指标。

它可以告诉我们当一个随机变量增加时,另一个随机变量是增加还是减少。

1.1. 协方差的数学表达对于两个随机变量 (X) 和 (Y),它们的协方差 ((X, Y)) 可以用以下公式计算:[ (X, Y) = E[(X - _X)(Y - _Y)] ]其中,(E) 表示期望,(_X) 和 (_Y) 分别是随机变量 (X) 和(Y) 的期望值。

1.2. 协方差的性质正协方差:如果((X, Y) > 0),说明 (X) 和 (Y) 同向变化,即一个增加时另一个也增加。

负协方差:如果((X, Y) < 0),那么 (X) 和 (Y) 反向变化,即一个增加时另一个减少。

零协方差:如果 ((X, Y) = 0),表示两个变量之间没有线性关系。

二、相关系数的定义及计算相关系数是标准化的协方差,用以衡量两个变量之间线性关系强度的度量。

相关系数的取值范围在 -1 到 1 之间。

2.1. 相关系数的数学表达皮尔逊相关系数(Pearson correlation coefficient)通常用字母 (r) 表示,可以通过以下公式计算:[ r = ]其中,(_X) 和 (_Y) 分别是随机变量 (X) 和 (Y) 的标准差。

2.2. 相关系数的性质取值范围:当 (r = 1),表示完全正相关。

当 (r = -1),表示完全负相关。

当 (r = 0),表示没有线性关系。

无量纲性:因为相关系数是标准化的,所以它不依赖于数据的尺度或单位。

三、协方差与相关系数的关系尽管协方差和相关系数都有助于理解两个随机变量之间的关系,但二者之间存在重要区别。

协方差公式相关系数

协方差(covariance)定义为:

cov(x,x)=var(x)协方差是对x与y之间联动关系的一种测度,即测量x与y的同步性。

当x与y同时出现较大值或者较小值时,cov>0,二者正相关。

若x出现较大值时y出现较小值,cov<0,二者负相关。

该相关关系并不意味着因果关系

计算方式:

e为期望算子,\mu 为总体平均值。

从该式中我们可以发现,cov的大小与x、y的大小有关。

为

了无量纲化,要对其进行标准化。

就有了相关系数的概念。

相关系数定义为:

就是协方差除了xy各自的标准差,这样才能刻画xy之间联动性的强弱。

这里需要注意的是,相关系数应该叫线性相关系数,它只能反映线性关系。

为何只能是线性关系的测度?

证明:

给出一个线性函数,y=a+bx (b \ne0 ,x的方差存在)

则,

所以,当x与y完全线性的时候,总有相关系数为1或者为-1.

扩展到一般线性模型:y=a+bx+ \varepsilon

其中, \varepsilon满足e(\varepsilon)=0,var (\varepsilon)=\sigma^{2}

同理可证,

这里,相关系数与1之间的偏离程度就受

\sigma_{\varepsilon}^{2}/\sigma_{x}^{2} 的影响。

所以它衡量的只是线性关系,绝对值不会超过1。

协方差和相关分析1.协方差协方差是用来衡量两个变量之间线性关系强度的统计量。

在协方差计算中,我们需要计算两个变量(X和Y)的每一对观测值的差异,然后将这些差异相乘求和得到最终的协方差。

协方差的计算公式如下:cov(X,Y) = Σ((xᵢ - μₓ)(yᵢ - μᵧ))/n其中,X和Y分别是两个变量的观测值,xᵢ和yᵢ分别是这两个变量的第i个观测值,μₓ和μᵧ分别是X和Y的均值,n是观测值的数量。

协方差的结果可以是正值、负值或者零。

正值表示两个变量呈正相关关系,即X增加时Y也会增加。

负值表示两个变量呈负相关关系,即X增加时Y会减少。

零表示两个变量之间没有线性关系。

2.相关分析相关分析是一种用于测量两个变量之间关系强度和方向的统计分析方法。

与协方差类似,相关系数也可以是正值、负值或者零。

相关系数的取值范围是-1到1之间,取值越接近于-1和1,表示两个变量之间的关系越强。

相关系数的计算方法有多种,其中最常用的是皮尔逊相关系数。

皮尔逊相关系数的计算公式如下:r = cov(X,Y)/(σₓ * σᵧ)其中,r是相关系数,cov(X,Y)是X和Y的协方差,σₓ和σᵧ分别是X和Y的标准差。

相关系数的取值范围如下:-1<=r<=1当r=1时,表示两个变量完全正相关;当r=-1时,表示两个变量完全负相关;当r=0时,表示两个变量没有线性关系。

3.协方差和相关分析的意义(1)揭示变量之间的关系:协方差和相关系数可以帮助我们了解两个变量之间的关系强度和方向,从而揭示出变量之间的相互作用规律,对于理解问题的本质和推断未知事物具有重要价值。

(2)预测和预测:通过分析变量之间的协方差或相关系数,我们可以进行预测和预测。

如果两个变量之间的相关性强,那么我们可以根据一个变量的观测值来估计另一个变量的值。

(3)排除冗余信息:协方差和相关系数可以帮助我们排除掉冗余信息,找到影响问题的最重要的变量。

通过分析变量之间的关系强度,我们可以识别出不必要的变量,从而提供更简单和更有效的模型。