一种鲁棒的聚类算法

- 格式:pdf

- 大小:380.44 KB

- 文档页数:4

基于鲁棒性的聚类算法研究鲁棒性是指系统在面对异常情况或噪声干扰时能够保持稳定性和可靠性的能力。

在聚类算法中,鲁棒性是一个重要的考量因素,因为数据中常常存在噪声和异常值。

为了提高聚类算法的稳定性和可靠性,研究者们提出了许多基于鲁棒性的聚类算法。

本文将对基于鲁棒性的聚类算法进行研究,探讨其原理、方法和应用。

首先,我们将介绍聚类算法的基本原理。

聚类是一种无监督学习方法,其目标是将数据集划分为若干个具有相似特征的组或簇。

常用的聚类算法包括K均值、层次聚类、密度聚类等。

然而,在实际应用中,数据往往存在噪声和异常值,这些因素会对传统聚类算法产生严重影响。

接下来,我们将探讨传统聚类算法在面对噪声和异常值时存在的问题,并介绍基于鲁棒性改进方法。

传统聚类算法对噪声和异常值非常敏感,在数据集中存在少量异常值时,会导致聚类结果严重偏离真实情况。

为了解决这一问题,研究者们提出了一系列基于鲁棒性的聚类算法。

这些算法通过引入鲁棒性度量指标或采用鲁棒性优化策略,提高了聚类算法的稳定性和可靠性。

其中,基于鲁棒性度量指标的聚类算法是一种常见的改进方法。

通过引入鲁棒度量指标,可以对数据集中的噪声和异常值进行判别和筛选。

常用的鲁棒度量指标包括中位数绝对偏差、Huber损失函数等。

这些指标可以有效地降低噪声和异常值对聚类结果的影响,并提高算法的稳定性。

另外,基于鲁棒性优化策略的聚类算法也是一种重要方法。

这些方法通过优化目标函数或采用特定策略来提高聚类算法对噪声和异常值的容忍度。

常见的优化策略包括离群点检测、数据修复、权重调整等。

这些策略可以有效地降低噪声和异常值对聚类结果造成的干扰,提高算法的鲁棒性。

基于鲁棒性的聚类算法在许多领域都有广泛的应用。

例如,在图像处理领域,基于鲁棒性的聚类算法可以对图像进行分割和分类。

在金融领域,基于鲁棒性的聚类算法可以对金融数据进行分析和预测。

在生物信息学领域,基于鲁棒性的聚类算法可以对生物序列进行分类和比对。

聚类算法:K-Means和DBSCAN的比较K-Means和DBSCAN是两种常见的聚类算法,它们在数据挖掘和机器学习领域具有重要的应用价值。

本文将比较这两种算法的优缺点、适用场景等方面,以期帮助读者更好地理解它们的特点和区别。

1. K-Means算法K-Means算法是一种基于距离的聚类算法,它的基本思想是将数据集划分为K个簇,使得每个样本点都属于与其最近的簇。

具体来说,K-Means算法的工作流程如下:(1)随机初始化K个中心点;(2)将每个样本点分配到距离最近的中心点所对应的簇中;(3)更新每个簇的中心点,即将该簇内所有样本点的均值作为新的中心点;(4)重复执行步骤(2)和(3),直到中心点不再发生变化或达到迭代次数上限。

K-Means算法的优点包括实现简单、计算高效等,适用于数据量较大的情况。

但它也存在一些缺点,比如对初始中心点的选择敏感,容易陷入局部最优解,不适用于发现非凸簇等情况。

2. DBSCAN算法DBSCAN(Density-Based Spatial Clustering of Applications with Noise)算法是一种基于密度的聚类算法,它的核心思想是通过样本点的密度来发现聚类簇。

DBSCAN算法的具体步骤如下:(1)以任意顺序选择一个未访问的样本点;(2)计算该样本点的邻域内的样本点个数,若超过预设的阈值,则标记为核心点,否则标记为噪声点;(3)将与核心点密度相连的样本点放入同一个簇中,并继续递归地扩展该簇;(4)重复执行步骤(1)和(2),直到所有样本点都被访问为止。

DBSCAN算法的优点在于可以发现任意形状的簇,并且对噪声数据具有鲁棒性,不受初始参数的影响。

但它也存在一些局限性,比如对密度不同的簇难以处理,对参数的敏感性较强等。

3. K-Means和DBSCAN的比较K-Means和DBSCAN是两种不同的聚类算法,它们在很多方面存在明显的差异。

下面将分别从适用场景、对数据特点的适应性、算法复杂度等方面对它们进行比较。

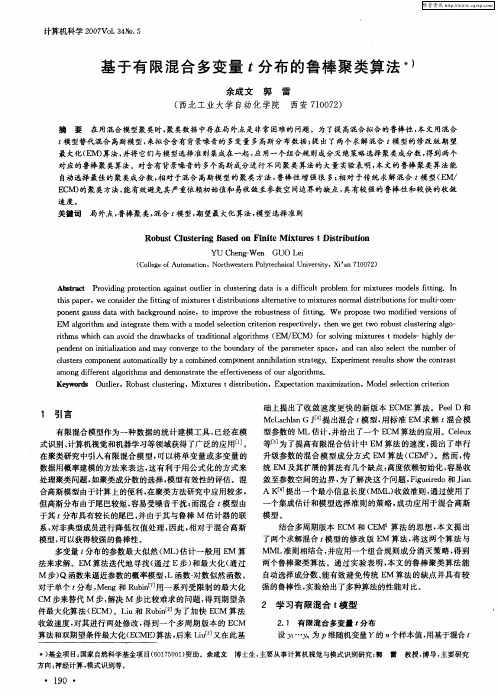

第28卷㊀第5期2023年10月㊀哈尔滨理工大学学报JOURNAL OF HARBIN UNIVERSITY OF SCIENCE AND TECHNOLOGY㊀Vol.28No.5Oct.2023㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀一种CCA -层次聚类的基因聚类算法林倩闽(厦门理工学院电气工程与自动化学院,福建厦门361024)摘㊀要:针对基因芯片技术带来的海量基因表达数据,为了充分挖掘其蕴含的生物信息和潜在的生物机制,提出一种基于CCA -层次聚类的基因聚类算法(CCA-Hc )㊂该算法在层次聚类的基础上引入典型相关分析,优化相似性矩阵计算方法㊂首先,利用典型相关分析方法结合基因的多个特征信息进行基因相关性度量,得到基因相似性矩阵㊂然后将该相似性矩阵作为层次聚类的邻近矩阵进行凝聚层次聚类㊂在Oryza sativa L.(水稻)的基因表达数据集上进行CCA-Hc 聚类效果测试实验,结果表明,与采用欧式距离的传统层次聚类算法(EUC-Hc )相比,CCA-Hc 的内部稳定性指标和生物功能性指标均优于EUC-Hc ,具有更佳的鲁棒性和聚类准确性,更有利于去发现基因间的共表达关系㊂关键词:基因表达数据;聚类算法;典型相关分析;层次聚类DOI :10.15938/j.jhust.2023.05.011中图分类号:TP391文献标志码:A文章编号:1007-2683(2023)05-0085-06A Gene Clustering Algorithm Based on the CCA-Hierarchical ClusteringLIN Qianmin(School of Electrical Engineering and Automation,Xiamen University of Technology,Xiamen 361024,China)Abstract :Aiming at the massive gene expression data brought by gene chip technology,in order to fully mine the biological information and potential biological mechanisms contained in it,this paper proposes a gene clustering algorithm based on CCA-hierarchical clustering (CCA-Hc).The algorithm introduces canonical correlation analysis on the basis of hierarchical clustering,and optimizes the calculation method of similarity matrix.First,the canonical correlation analysis method is used to measure the gene correlation by combining the multiple feature information of the gene,and the gene similarity matrix is obtained.Then the similarity matrix is used as the neighbor matrix of hierarchical clustering for agglomerative hierarchical clustering.The CCA-Hc clustering effect test experiment was performed on the gene expression dataset of Oryza sativa L.(rice).The results show that,compared with the traditional hierarchical clustering algorithm using Euclidean distance (EUC-Hc),CCA-Hc is superior to EUC-Hc in both internal stability index and biological functional index,and has better robustness and clustering accuracy.It is more conducive to discoveringthe co-expression relationship between genes.Keywords :gene expression data;clustering algorithm;canonical correlation analysis;hierarchical clustering㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀收稿日期:2022-06-08基金项目:福建省科技厅引导性项目(2019H0039);福建省中青年教师教育科研项目(JAT210341).通信作者:林倩闽(1992 ),女,硕士,助理实验师,E-mail:1023447133@.0㊀引㊀言随着高通量测序技术的不断快速发展,出现越来越多复杂度高㊁数据量大的生物数据㊂不同测序技术可以得到不同水平的生物数据,如通过基因组测序得到DNA 水平的生物数据,转录组测序得到RNA 水平的生物数据㊂基因表达数据是通过DNA微阵列技术(又称为基因芯片技术)检测得到,是不同细胞在不同条件下的基因动态表达水平[1]㊂基因是携带遗传物质的DNA片段,在不同细胞中会有不同的表达方向[2],从而可以控制不同的性状㊂为此基因表达数据蕴含着丰富且重要的生物机制,具有很大的研究价值㊂在基因表达数据分析中,聚类分析方法被广大研究者选用,用以发现具有相似表达行为的基因集,基因间的共表达㊁共调控关系等,对于推断未知的基因功能及在疾病诊断方面具有重要意义[2]㊂目前基因聚类算法根据聚类对象可以分为基于基因㊁基于样本聚类以及基于基因样本的双聚类[3-4]㊂根据聚类方式的不同,又可以分为以K-means算法[5]㊁K-MEDOIDS[6]为代表的基于分区的聚类算法,以BIRCH算法[7]㊁CURE算法[8]为代表的基于层次的聚类算法,以DBSCAN算法[9]㊁OPTICS算法[10]为代表的基于密度的聚类算法和以CLIQUE算法[11]为代表的基于网格的聚类算法㊂在对基因表达数据进行聚类分析时,主要是度量基因之间的相关性,把相关性程度高的基因聚在一起㊂很多基因聚类研究中把皮尔森相关系数㊁欧式距离㊁曼哈顿距离等作为相关性程度的度量方式[12]㊂这些度量方式是基于基因的整体表达水平进行的,即一个基因只由一个一维的数据矩阵表示㊂而在实际的的测序过程中,往往会在不同的细胞周期进行实验测量基因的表达水平,使得一个基因会有多组数据,每组数据代表该基因的一个特征㊂大部分的研究中采用求和的方式把基因多个特征的数据进行累加,进而分析基因之间的相关性㊂这种方法存在的问题是忽略了基因各个特征对表达水平的影响,从而对聚类结果造成影响㊂为了解决上述问题,本文把典型相关分析(Ca-nonical Correlation Analysis,CCA)引入到层次聚类中来,搭建出基于CCA-层次聚类的基因聚类算法(CCA-Hc)㊂典型相关分析是一种计算变量之间相关性的统计学分析方法,能结合变量的多个特征,得到变量的整体相关性[13]㊂利用典型相关分析度量基因之间的相关性,能充分考虑基因的多个特征信息,使得聚类结果中的基因集相似性程度更高㊂同时采用凝聚层次聚类,可以从聚类树状图中直观地分析聚类结果,从而整体上提高聚类效果㊂最后用GEO数据库上的基因数据集来验证CCA-Hc算法的有效性㊂1㊀CCA-Hc算法设计1.1㊀典型相关分析给定基因微阵列数据矩阵A nˑm=(G,T),n表示基因个数,m表示条件的种类数㊂每个基因可以看成是一个变量,使用典型相关分析方法分析变量相关性时,假设变量X有p个特征,变量Y有q个特征,pɤq,每个特征均对应m个不同条件的数据,则X=[x1, ,x p]T(1) Y=[y1, ,y q]T(2)变量X的数据矩阵为x11x12x13 x1mx21x22x23 x2mx31x32x33 x3m︙︙︙︙x p1x p2x p3 x pméëêêêêêêêùûúúúúúúú变量Y的数据矩阵为y11y12y13 y1my21y22y23 y2my31y32y33 y3m︙︙︙︙y q1y q2y q3 y qméëêêêêêêêùûúúúúúúú变量X和变量Y的协方差矩阵为ð=Cov(X,Y)=Var(X)Cov(X,Y)Cov(Y,X)Var(Y)()=ð11ð12ð21ð22()(3)变量X和变量Y的线性表达式记为U㊁V,表示为:U=a1x1+a2x2+ +a p x p=a T X(4) V=b1y1+b2y2+ +b q y q=b T Y(5)变量X和变量Y进行典型相关性分析时,可用这两个变量的线性表达式U㊁V之间相关系数的最大值来度量变量之间的相关性程度,即max a,b corr(U,V)=a Tð12b(a Tð11aˑb Tð22b)1/2(6)在求解上述最值表达式时,运用拉格朗日数乘法求解瑞利熵矩阵(ð-111ð12ð-122ð21)得到p个特征值,68哈㊀尔㊀滨㊀理㊀工㊀大㊀学㊀学㊀报㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀第28卷㊀记为λ1,λ2 λp ㊂这p 个特征值即变量X 和变量Y之间的典型相关系数㊂每一个相关系数再应用卡方检验进行显著性检验,得到p 个卡方检验p-value 值,记为p 1,p 2 p p ㊂为了更好地表示变量之间的典型相关程度,引入一个关于典型相关系数和p-value 值的权重函数W 来表示,定义为:W =ðp i =1λi I (log P i )ðp i =1I (log P i )(7)其中I (log P i )=0P >0.05-log PP ɤ0.05{这样每两个变量之间就能得到一个w 值来度量它们的相关性程度㊂对基因表达数据的n 个基因进行如上方法的典型相关分析后,最终得到一个n ˑn 的相似性矩阵㊂1.2㊀层次聚类目前常用的聚类算法有基于分区㊁基于层次㊁基于密度和基于网络4种类型[2],其中基于层次聚类的算法因原理通俗易懂㊁结果直观且精度高等优点而被广泛使用[14]㊂层次聚类分为自下而上的凝聚聚类和自上而下的分裂聚类两种[15],其中凝聚层次聚类运用最为广泛,同时凝聚层次聚类在无预先定义类别数的分类中具有明显优势[16]㊂故本文采用的是凝聚层次聚类,可以用树状图和嵌套簇图来表示,例如图1所示㊂图1㊀凝聚层次聚类的树状图和嵌套簇图Fig.1㊀Dendrogram and Nested Cluster Diagramfor Agglomerative Hierarchical Clustering下面介绍凝聚层次聚类的聚类过程:步骤1:视每一个数据点(如基因变量)为一个集群;步骤2:计算邻近矩阵,把类间距离最接近的两个集群进行合并;步骤3:重复步骤2,直到所有数据点合并完成㊂步骤2中的类间距离即两个集群之间的距离,传统的层次聚类类间距离计算方法有如下几种[17]:1)两个集群中距离最近的两个样本距离;2)两个集群中距离最远的两个样本距离;3)两个集群中所有样本之间的距离再求平均值;完成所有聚类步骤后会生产一个树状图(又叫聚类树)㊂采用不同的变量相关性程度度量方式和不同的类间距离计算方法都将对聚类结果造成影响㊂1.3㊀CCA-HC 算法传统的层次聚类算法其计算复杂度为O (n 3),由于在聚类过程中需要不断地重复计算类间距离㊁不断地更新邻近矩阵,从而消耗大量的时间与资源[18]㊂对于数据量庞大的基因微阵列数据,迫切需要对算法进行优化,降低复杂度㊂本文提出了一种基于CCA 和层次聚类的基因聚类算法(CCA-HC),优化相似性矩阵计算方法,把典型相关分析的输出作为层次聚类的输入,即把典型相关分析得到的相似性矩阵作为层次聚类的邻近矩阵㊂CCA-HC 在度量基因相关性程度时采用典型相关分析的方法,在层次聚类方式上选择自下而上的凝聚层次聚类㊂CCA-HC 充分利用了典型相关分析和层次聚类的优点,能够结合基因的多个特征来量化基因之间的相关性,使得聚类结果中的基因集相似性程度更高,也能自主选择集群数目以得到更佳的聚类效果[18]㊂2㊀实验与结果分析2.1㊀实验数据为了评价章节一中提出算法的聚类效果,在GEO 数据库上下载Oryza sativa L.(水稻)的基因表达数据集,得到的原始数据集共有45063个基因,样本数为41㊂由于原始数据集基因数庞大,对其计算分析时不论在存储空间还是计算程序上都提出了较高的要求,为此进行适当的数据预处理显得尤为重要㊂本文在数据预处理方面开展的主要工作有:把基因名未知的数据剔除;过滤掉样本表达量过低的基因;采用log2的对数函数对原始数据进行标准化处理等㊂经过如上处理后得到4564ˑ41的数据矩阵,用于后续的实验分析㊂预处理后的实验数据集78第5期林倩闽:一种CCA -层次聚类的基因聚类算法统计情况如表1所示㊂表1㊀预处理后的实验数据集统计情况表Tab.1㊀Statistical table of experimental dataset after preprocessing数据集基因数样本数基因功能类别Oryza sativa L.456441881.5㊀评价标准基因表达数据的聚类效果可以从聚类结果中同一集群的相关性程度以及聚类算法的稳定性等方面进行评价,用生物功能性指标和内部稳定性指标来描述㊂1.生物功能性指标生物同源性指标(biological homogeneity index, BHI)是用来评估聚类集群在生物功能意义上的同源性程度[19]㊂在基因本体(gene ontology,GO)数据库上下载水稻的基因功能类数据,可以得知每个水稻基因所对应的生物组织功能,用来分析同一聚类集群中的基因在功能上的相关性㊂BHI公式计算如下:BHI(K,B)=1KðK k=11nk(n k-1)ðiʂjɪC k I(B(i)=B(j))(8)式中:C为聚类结果中的任一集群;B为基因功能类集合,当基因i和基因j所对应的功能类存在交集,则I(B(i)=B(j))=1,否则为0㊂最终得到的BHI 是介于0~1的值,BHI值越大,表示基因聚类集群的生物功能相关性越大,聚类效果更佳[19]㊂2.内部稳定性指标内部稳定性指标在于评价聚类算法的鲁棒性,通过改变基因微阵列数据的某几列进行聚类,进而比较基于不同数据的聚类结果㊂优值系数(figure of merit,FOM)是内部稳定性指标中的一种,表示数据列改变后基因之间的平均群内方差[20]㊂FOM公式计算如下:FOM(l,K)=1NðK k=1ðiɪC k(l)dist(x i,l, x C k(l))(9)式中:FOM的取值范围是0到无穷大,FOM值越小表示该聚类算法的稳定性越好[20]㊂2.3㊀结果与分析为验证CCA-Hc的聚类效果,对比采用欧式距离的传统层次聚类算法(EUC-Hc),运用相同数据集进行实验㊂为了获得更加准确的聚类效果,本实验设置不同的聚类集群参数,确定聚类集群数目K 分别为2㊁4㊁6㊁7㊁9㊁11㊁12这7组实验,并通过BHI 和FOM指标对这7组实验的聚类结果进行评估, BHI和FOM指标值分别见表2和表3㊂表2㊀不同聚类集群数目下的BHI指标值Tab.2㊀BHI index values under different number of clusters 算法类型\集群数目CCA-Hc EUC-Hc差异率K=20.4660.233100.05%K=40.4630.34633.77%K=60.4670.37723.90%K=70.4670.41213.34%K=90.4650.4357.12%K=110.4640.4512.72%K=120.4630.456 1.48%表3㊀不同聚类集群数目下的FOM指标值Tab.3㊀FOM index values under different number of clusters算法类型\集群数目CCA-Hc EUC-Hc差异率K=22.6974.633-41.78%K=42.6974.298-37.26%K=62.6964.047-33.37%K=72.6963.995-32.52%K=92.6963.816-29.35%K=112.6953.693-27.03%K=12 2.695 3.636-25.89%㊀㊀表2中的差异率指的是CCA-Hc的BHI指标比EUC-Hc的BHI指标相差的百分比,同理可以计算表3中的差异率㊂根据表2和表3的实验指标数据发现,对于7组不同的聚类集群数目实验,本文提出的CCA-Hc 的BHI指标均高于EUC-Hc,FOM指标均低于EUC-Hc,这表明CCA-Hc的鲁棒性更好,聚类结果中同一集群的基因相关性更大,聚类效果更加显著㊂同时还发现,集群数目对CCA-Hc的影响较小,K选不同的值,BHI指标值稳定在0.463~0.467之间,FOM88哈㊀尔㊀滨㊀理㊀工㊀大㊀学㊀学㊀报㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀第28卷㊀指标值稳定在2.695~2.697之间,而集群数目对EUC-Hc 算法的影响相对比较明显㊂图2为CCA-Hc 在Oryza sativa L.数据集的聚类树状图,可以自行在所需的层级对树状图进行 剪枝 操作以获得合适的聚类效果[21]㊂图2㊀CCA-Hc 在Oryza sativa L.数据集的聚类树状图Fjg.2㊀Clustering dendrogram of CCA-Hc in Oryzasativa L.dataset3㊀结㊀论本文为了充分有效地挖掘基因表达数据所蕴含的生物机制,提出一种基于CCA -层次聚类的基因聚类算法(CCA-Hc)㊂把典型相关分析方法引入到凝聚层次聚类中来进行多特征基因的聚类分析,成为本文的创新之处㊂该算法利用典型相关分析方法度量基因之间的相关性程度,能够充分考虑基因的多个特征信息㊂同时采用凝聚层次聚类可自主选择聚类集群数目,直观显示聚类结果㊂基于Oryza sativa L.(水稻)的基因表达数据集,本文对比了CCA-Hc 和EUC-Hc 的聚类效果,使用BHI 和FOM 两个评价指标进行衡量,结果表明CCA-Hc 的鲁棒性和聚类准确性均更好,更有利于去探索基因表达数据潜在的生物机制㊂参考文献:[1]㊀欧阳玉梅.基因表达数据聚类分析技术及其软件工具[J].生物信息学,2010,8(2):104.OUYANG Yumei.Gene Expression Data Cluster Analysis Technology and Software Tools [J ].Bioinformatics,2010,8(2):104.[2]㊀高华成.基于数据降维框架的基因聚类算法[D].南京:南京邮电大学,2021.[3]㊀姚登举,詹晓娟,张晓晶.一种加权K -均值基因聚类算法[J ].哈尔滨理工大学学报,2017,22(2):112.YAO Dengju,ZHAN Xiaojuan,ZHANG Xiaojing.A Weighted K-Means Gene Clustering Algorithm[J].Jour-nal of Harbin University of Science and Technology,2017,22(2):112.[4]㊀方匡南,陈远星,张庆昭,等.双向聚类方法综述[J].数理统计与管理,2020,39(1):22.FANG Kuangnan,CHEN Yuanxing,ZHANG Qingzhao,et al.Review of Bidirectional Clustering Methods [J].Journal of Applied Statistics and Management,2020,39(1):22.[5]㊀吴明阳,张芮,岳彩旭,等.应用K-means 聚类算法划分曲面及实验验证[J].哈尔滨理工大学学报,2017(1):54.WU Mingyang,ZHANG Rui,YUE Caixu,et al.Appli-cation of K-means Clustering Algorithm for Surface Divi-sion and Experimental Verification[J].Journal of HarbinUniversity of Science and Technology,2017(1):54.[6]㊀LACKO D,HUYSMANS T,VLEUGELS J,et al.ProductSizing with 3D Anthropometry and K-medoids Clustering[J].Computer-Aided Design,2017:S0010448517301173.[7]㊀ZHANG T,RAMAKRISHNAN R,LIVNY M.BIRCH:ANew Data Clustering Algorithm and Its Applications[J].Data Mining and Knowledge Discovery,1997,1(2):141.[8]㊀FUSHIMI T,MORI R.High-Speed Clustering of Region-al Photos Using Representative Photos of Different Re-gions[C].2018IEEE /WIC /ACM International Confer-ence on Web Intelligence (WI),IEEE,2018:520.[9]㊀Al-MAMORY S O,KAMIL I S.A New Density BasedSampling to Enhance DBSCAN Clustering Algorithm[J].Journal of Computer Science,2019,32(4):315.[10]ANKERST M,BREUNIG M M,KRIEGEL H P,et al.OPTICS:Ordering Points to Identify the Clustering Struc-ture[C]//SIGMOD 1999,Proceedings ACM SIGMOD International Conference on Management of Data,June 1-3,1999,Philadelphia,Pennsylvania,USA.ACM,1999:2008,99.[11]王飞,王国胤,李智星,等.一种基于网格的密度峰值聚类算法[J ].小型微型计算机系统,2017(5):1034.WANG Fei,WANG Guoyin,LI Zhixing,et al.A Grid-based Density Peak Clustering Algorithm[J].Journal of98第5期林倩闽:一种CCA -层次聚类的基因聚类算法Chinese Computer Systems,2017(5):1034. [12]YAO J,CHANG C,SALMI M L,et al.Genome-scaleClusteranalysis of Replicated Microarrays Using ShrinkageCorrelation Coefficient[J].BMC Bioinformatics,2008,9:288.[13]HONG S,CHEN X,JIN L,et al.Canonical CorrelationAnalysis for RNA-seq Co-expression Networks[J].Nu-cleic Acids Res,2013,41(8):e95.[14]万静,郑龙君,何云斌,等.高维数据的高密度子空间聚类算法[J].哈尔滨理工大学学报,2020,25(4):84.WAN Jing,ZHENG Longjun,HE Yunbin,et al.High-Density Subspace Clustering Algorithm for High-Dimen-sional Data[J].Journal of Harbin University of Scienceand Technology,2020,25(4):84.[15]刘昊.基于聚类算法的生物分析软件的设计与实现[D].上海:复旦大学,2013.[16]乔锦荣,原新鹏,梁旭东,等.凝聚层次聚类方法在降水预报评估中的应用[J].干旱气象,2022,40(4):690.QIAO Jinrong,YUAN Xinpeng,LIANG Xudong,et al.Application of Agglomerative Hierarchical ClusteringMethod in Precipitation Forecast Evaluation[J].AridMeteorology,2022,40(4):690.[17]JASKOWIAK P A,CAMPELLO R J,COSTA I G.Onthe Selection of Appropriate Distances for Gene Expres-sion Data Clustering[J].BMC Bioinformatics,2014,15(2):1.[18]季姜帅,裴颂文.面向异质基因数据的智能层次聚类算法研究[J].小型微型计算机系统,2021,43(9):1808.JI Jiangshuai,PEI Songwen.Research on Intelligent Hi-erarchical Clustering Algorithm for Heterogeneous GeneticData[J].Journal of Chinese Computer Systems,2021,43(9):1808.[19]DATTA S,DATTA S.Methods for Evaluating ClusteringAlgorithms for Gene Expression Data Using a ReferenceSet of Functional Classes[J].BMC Bioinformatics,2006,7(1):1.[20]DATTA parisons and Validation of Statistical Clus-tering Techniques for Microarray Gene Expression Data[J].Bioinformatics,2003,19(4):459. [21]HULOT A,CHIQUET J,JAFFRÉZIC F,et al.Fast TreeAggregation for Consensus Hierarchical Clustering[J].BMC Bioinformatics,2020,21(1):12.(编辑:温泽宇)09哈㊀尔㊀滨㊀理㊀工㊀大㊀学㊀学㊀报㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀第28卷㊀。

gmm算法理解摘要:1.算法背景2.算法原理3.算法应用领域4.优缺点分析5.总结正文:【算法背景】GMM(Gaussian Mixture Model,高斯混合模型)算法是一种聚类方法,主要用于对由多个高斯分布组成的数据集进行建模。

该算法通过拟合数据集的混合分布,找到数据的最佳表示形式。

GMM算法广泛应用于语音识别、图像处理、自然语言处理等领域。

【算法原理】GMM算法基于高斯分布的性质,假设数据集是由多个高斯分布混合而成的。

每个高斯分布表示数据集中的一个子集,即一个聚类。

在训练过程中,算法通过迭代计算每个数据点的概率,从而得到每个数据点属于各个聚类的概率。

最终,根据这些概率,可以将数据点分为若干个聚类。

具体来说,GMM算法分为两个阶段:1.初始化阶段:随机选择K个中心点(均值点),作为K个高斯分布的初始均值。

2.训练阶段:对于每个数据点,计算其属于各个高斯分布的概率,即计算各高斯分布的参数(均值、协方差矩阵)与数据点之间的距离。

根据这些概率,更新各高斯分布的均值和协方差矩阵。

重复这一过程,直至收敛。

【算法应用领域】GMM算法在许多领域都有广泛应用,例如:1.语音识别:在语音信号处理中,GMM算法可以用于提取声道特征,用于后续的说话人识别和语音识别任务。

2.图像处理:GMM可以用于图像分割,将图像划分为多个区域,从而实现图像的分析和理解。

3.自然语言处理:在文本聚类和主题模型中,GMM算法可以用于对文本数据进行建模,挖掘文本数据中的潜在主题。

【优缺点分析】优点:1.GMM算法具有较好的聚类性能,尤其在处理高维数据时,表现优于一些传统的聚类算法。

2.GMM算法可以自动处理数据中的噪声,对于异常值具有一定的鲁棒性。

缺点:1.GMM算法对初始参数敏感,不同的初始参数可能导致不同的聚类结果。

2.算法计算复杂度较高,尤其是在大规模数据集上,计算量会随着数据量的增长而显著增加。

【总结】GMM算法是一种基于高斯分布的聚类方法,具有良好的聚类性能和鲁棒性。

k-medoids聚类算法k-medoids聚类算法是一种常用的非监督机器学习算法,用于将一组对象分成不同的群组。

与k-means算法类似,k-medoids也是一种基于距离的聚类算法,但它相比于k-means算法更加鲁棒,具有更好的稳定性。

在这篇文章中,我们将介绍k-medoids聚类算法的工作原理、算法流程以及其应用。

首先,让我们来了解一下k-medoids算法是如何工作的。

k-medoids算法通过计算每个数据点与聚类中心之间的距离,将数据点分配到最近的聚类中心。

与k-means算法不同的是,k-medoids算法选择的聚类中心是实际数据点,而不是数据的均值。

这些实际数据点被称为“medoids”,因为它们代表着每个聚类的代表性样本。

接下来,我们将介绍k-medoids算法的具体流程。

首先,我们需要选择k个初始聚类中心。

这些初始聚类中心可以根据一些预定义的规则选择,例如随机选择或者根据一些先验知识选择。

然后,我们计算每个数据点与这些初始聚类中心之间的距离,将每个数据点分配到距离最近的聚类中心。

在数据点分配完毕后,我们需要重新计算每个聚类中心的位置。

对于每个聚类,我们计算该聚类中的每个数据点到其他数据点的总距离,并将其中距离最小的点作为新的聚类中心。

这个过程不断迭代直到聚类中心不再变化或达到预定的迭代次数。

最后,我们将得到k个聚类中心以及它们对应的聚类。

每个聚类都由一组数据点组成,这些数据点与自己所属的聚类中心之间的距离最小。

这些聚类可以用于分析数据集,发现隐藏在数据中的模式和关系。

k-medoids算法具有一些优点。

首先,与k-means算法相比,k-medoids算法对异常值更加鲁棒,因为它选择的聚类中心是实际的数据点。

其次,k-medoids算法适用于任意距离度量,而k-means算法只适用于欧氏距离。

此外,k-medoids算法相对简单,易于实现和理解。

k-medoids算法在许多领域都有广泛的应用。

omlsa算法摘要:1.OMLSA算法简介2.OMLSA算法原理3.OMLSA算法应用4.OMLSA算法优缺点5.结论与展望正文:一、OMLSA算法简介OMLSA(One-class Multiple Local Scattering Algorithm)算法是一种基于样本的异常检测方法,主要用于挖掘数据集中的局部结构。

与传统的聚类算法不同,OMLSA仅需使用正常样本数据进行训练,从而实现对异常数据的检测。

该算法具有较强的适应性和鲁棒性,已广泛应用于各种领域。

二、OMLSA算法原理OMLSA算法主要基于多局部散射(Multiple Local Scattering)思想。

在训练过程中,算法将正常样本数据划分为多个局部区域,并计算每个局部区域的中心。

接下来,通过计算正常样本与局部区域中心的距离来判断新样本是否属于正常类别。

若距离超出预设阈值,则将该样本标记为异常。

三、OMLSA算法应用1.金融欺诈检测:通过分析用户交易数据,识别出异常交易行为,从而防范欺诈风险。

2.网络入侵检测:分析网络流量数据,检测潜在的恶意攻击行为。

3.医疗诊断:分析病人病历数据,发现异常病例,提高诊断准确性。

4.工业监控:对生产过程中的数据进行实时监测,发现异常情况,确保生产安全。

四、OMLSA算法优缺点优点:1.适应性强:能够应对数据分布的多样性,具有较强的普适性。

2.鲁棒性高:对于噪声数据和异常值具有较强的抗干扰能力。

3.计算效率较高:相较于一些聚类算法,OMLSA具有较快的收敛速度。

缺点:1.参数选择:OMLSA算法需要选取合适的参数,以达到最佳的异常检测效果。

2.阈值设定:确定合适的阈值对于算法性能至关重要,若阈值设置不当,可能导致误报或漏报。

五、结论与展望OMLSA算法作为一种高效、实用的异常检测方法,在许多领域取得了良好的应用效果。

然而,如何选取合适的参数和阈值以提高算法性能仍是一个值得探讨的问题。

未来研究可以针对这一方向进行优化,进一步提高OMLSA算法的检测性能。

k-medoids算法k-medoids算法是一种用于聚类分析的算法。

它与k-means算法相似,但有一些不同之处。

在k-means算法中,每个聚类的中心点是所属聚类中的所有样本的均值。

而在k-medoids算法中,每个聚类的中心点是聚类中的一个实际样本点,也称为medoid。

1. 随机选择k个样本作为初始medoids。

2. 对于每个样本,计算其与每个medoid的距离,并将其分配到距离最近的medoid所属的聚类中。

3. 对于每个聚类,计算其中所有样本与其medoid的总距离。

选取总距离最小的样本作为新的medoid。

4. 重复步骤2和步骤3,直到medoid不再改变或达到最大迭代次数。

5.得到最终的聚类结果。

1. 对于离群点更加鲁棒:由于medoid是聚类中的实际样本点,而不是均值点,因此k-medoids算法对于存在离群点的数据集更加鲁棒。

2. 可以应用于非欧几里德距离度量:k-means算法基于欧几里德距离,而k-medoids算法可以灵活地使用非欧几里德距离度量,例如曼哈顿距离或闵可夫斯基距离。

3. 可解释性更强:由于medoid是具体的样本点,而不是均值点,这意味着聚类结果更容易理解和解释。

k-medoids算法的应用广泛。

例如,在医学领域,它可以用于将患者分为不同的疾病类别,从而有助于疾病的诊断和治疗。

在市场营销中,它可以用于消费者分组,以便制定个性化的推广策略。

在图像处理领域,它可以用于图像分割,将相似的像素聚类在一起。

然而,k-medoids算法也存在一些局限性。

首先,由于需要计算样本之间的距离,如果数据集非常大,计算成本会很高。

其次,k-medoids算法对于数据集中选择medoids的敏感度较高,不同的初始medoids可能会导致不同的聚类结果。

此外,k-medoids算法无法直接处理高维数据,需要使用降维方法来减少维度。

为了克服这些局限性,研究人员提出了一些改进的k-medoids算法,如PAM算法和CLARA算法。