各种聚类算法的比较

- 格式:doc

- 大小:47.00 KB

- 文档页数:4

各种聚类算法的比较聚类算法是一种将数据按照相似性分组的无监督学习方法。

在数据分析和机器学习中,聚类算法被广泛应用于数据挖掘、模式识别、图像处理等领域。

本文将介绍几种常见的聚类算法,并对它们进行比较。

1. K-means算法K-means算法是最常见的聚类算法之一,它将数据划分为K个集群,每个集群包含最接近其均值的数据点。

该算法迭代地更新集群的均值,直到满足收敛条件。

K-means算法简单、高效,适用于大型数据集。

然而,它对异常值和噪声敏感,并且对初始聚类中心的选择非常敏感。

2.层次聚类算法层次聚类算法是一种自底向上或自顶向下的聚类方法,它通过计算数据点之间的相似性构建一个聚类层次结构。

这种层次结构可以以树状图的形式表示,称为树状图聚类。

层次聚类算法的优点是不需要指定聚类个数,且能够处理任意形状的聚类。

然而,该算法的计算复杂度较高,并且对输入数据的规模和噪声敏感。

3.密度聚类算法密度聚类算法通过计算数据点周围的密度来确定聚类结构。

DBSCAN是最常见的密度聚类算法之一,它通过指定半径和邻域密度来定义聚类。

DBSCAN能够识别任意形状的聚类,并且对噪声和异常值具有较高的鲁棒性。

然而,密度聚类算法对参数的选择非常敏感,并且对高维数据和不同密度的聚类效果较差。

4.基于概率的聚类算法基于概率的聚类算法假设数据服从其中一种概率分布,并通过最大化似然函数来进行聚类。

GMM (Gaussian Mixture Model) 是一种常见的基于概率的聚类算法,它假设数据由多个高斯分布组成。

GMM算法能够分离具有不同协方差的聚类,适用于高维数据和非球状的聚类。

然而,该算法对初始参数的选择敏感,并且计算复杂度较高。

5.划分聚类算法划分聚类算法将数据划分为互斥的聚类,然后通过迭代地重新分配数据点来优化聚类质量。

PAM (Partitioning Around Medoids) 和CLARA (Clustering Large Applications)是常见的划分聚类算法。

k-means聚类和fcm聚类的原理概念摘要:一、聚类分析概述1.定义与作用2.常用的聚类算法二、K-means 聚类原理1.算法基本思想2.计算过程3.特点与优缺点三、FCM 聚类原理1.算法基本思想2.计算过程3.特点与优缺点四、K-means 与FCM 聚类的比较1.相似之处2.不同之处3.适用场景正文:一、聚类分析概述聚类分析是一种无监督学习方法,通过将相似的数据对象归为一类,从而挖掘数据集的潜在结构和模式。

聚类分析在数据挖掘、模式识别、图像处理、生物学研究等领域具有广泛应用。

常用的聚类算法有K-means 聚类和FCM 聚类等。

二、K-means 聚类原理1.算法基本思想K-means 聚类是一种基于划分的聚类方法,通过迭代计算数据点与当前中心点的距离,将数据点分配到距离最近的中心点所属的簇,然后更新中心点。

这个过程持续进行,直到满足停止条件。

2.计算过程(1)随机选择k 个数据点作为初始中心点。

(2)计算其他数据点与初始中心点的距离,将数据点分配到距离最近的簇。

(3)计算每个簇的中心点。

(4)重复步骤2 和3,直到中心点不再发生变化或达到最大迭代次数。

3.特点与优缺点特点:简单、易于实现,适用于大规模数据集。

优点:可以处理大规模数据集,对噪声数据具有一定的鲁棒性。

缺点:对初始中心点敏感,可能导致局部最优解;计算过程中需要反复计算距离,计算量较大。

三、FCM 聚类原理1.算法基本思想FCM 聚类是一种基于模糊划分的聚类方法,通过计算数据点与当前中心点的模糊距离,将数据点分配到距离最近的簇。

模糊距离是基于隶属度函数计算的,可以反映数据点对簇的隶属程度。

2.计算过程(1)随机选择k 个数据点作为初始中心点。

(2)计算其他数据点与初始中心点的模糊距离,将数据点分配到距离最近的簇。

(3)计算每个簇的中心点。

(4)重复步骤2 和3,直到中心点不再发生变化或达到最大迭代次数。

3.特点与优缺点特点:考虑了数据点对簇的隶属程度,具有更好的全局优化性能。

各种聚类算法的优缺点在机器学习领域中,聚类(cluster)是最基本的无监督学习问题之一。

聚类算法是指把具有相似性质的数据对象分组的算法,被广泛应用于数据挖掘、模式识别等领域。

本文将介绍几种常见的聚类算法、它们的优缺点,并与之间做出比较。

一、K-Means聚类算法K-Means算法又称为K均值算法,是最为普及的一种聚类算法。

该算法通过将 n 个对象分到 k 个类的方法来使每个数据对象都与所属类的均值最为接近。

K-Means聚类算法有以下优缺点:优点:1.简单、易于实现。

2.计算速度快。

缺点:1.需要预先设定数据类别数量,且对初始化比较敏感。

2.数据集分布不均匀或聚类类别的数量差别较大时,聚类效果较差。

二、层次聚类算法层次聚类算法是一种基于树形结构的聚类方法,可以得到不同类别的层次结构。

该算法的核心思想就是通过计算每个数据对象间的距离并逐步将他们聚合成层次结构。

层次聚类算法的优缺点如下:优点:1.可以帮助我们发现数据对象之间的内部关系和层次结构。

2.不需要预先设定聚类类别数量。

缺点:1.计算复杂度较高,不适合大规模数据集。

2.聚类的结果可能会很大,难以在可视化方面得到较好的展示效果。

三、DBSCAN聚类算法DBSCAN是基于密度的聚类算法。

该算法将具有密度连接的数据点视为一组,并且可以在其它密度较低的区域中选择单个数据点。

DBSCAN聚类算法的优缺点如下:优点:1.不需要预设聚类类别数量。

2.能够发现任意形态的聚类。

缺点:1.初始化比较敏感,对参数设置等因素较为敏感。

2.难以解决密度分布不均一、噪音点分布不规律的问题。

四、BIRCH聚类算法BIRCH算法是基于描述的聚类方法,是聚类中的层次算法。

BIRCH的全称是Balanced Iterative Reducing and Clustering using Hierarchies,它采用一种合并聚类方式,通过类的层次结构来简化聚类过程。

BIRCH聚类算法的优缺点如下:优点:1.该算法能够处理海量数据。

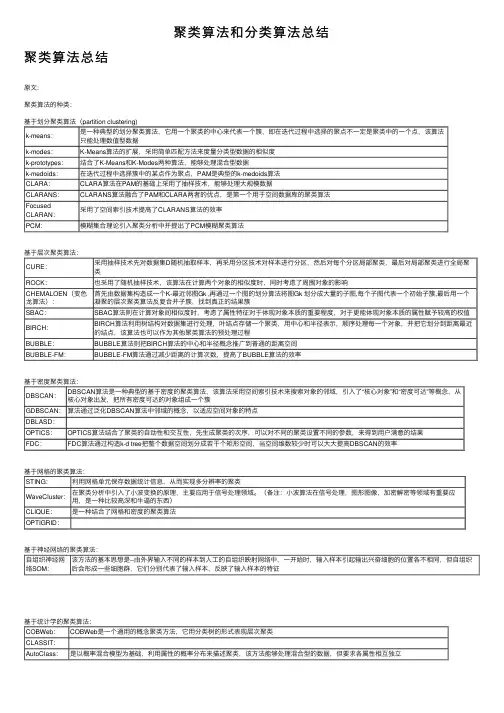

聚类算法和分类算法总结聚类算法总结原⽂:聚类算法的种类:基于划分聚类算法(partition clustering)k-means:是⼀种典型的划分聚类算法,它⽤⼀个聚类的中⼼来代表⼀个簇,即在迭代过程中选择的聚点不⼀定是聚类中的⼀个点,该算法只能处理数值型数据k-modes:K-Means算法的扩展,采⽤简单匹配⽅法来度量分类型数据的相似度k-prototypes:结合了K-Means和K-Modes两种算法,能够处理混合型数据k-medoids:在迭代过程中选择簇中的某点作为聚点,PAM是典型的k-medoids算法CLARA:CLARA算法在PAM的基础上采⽤了抽样技术,能够处理⼤规模数据CLARANS:CLARANS算法融合了PAM和CLARA两者的优点,是第⼀个⽤于空间数据库的聚类算法FocusedCLARAN:采⽤了空间索引技术提⾼了CLARANS算法的效率PCM:模糊集合理论引⼊聚类分析中并提出了PCM模糊聚类算法基于层次聚类算法:CURE:采⽤抽样技术先对数据集D随机抽取样本,再采⽤分区技术对样本进⾏分区,然后对每个分区局部聚类,最后对局部聚类进⾏全局聚类ROCK:也采⽤了随机抽样技术,该算法在计算两个对象的相似度时,同时考虑了周围对象的影响CHEMALOEN(变⾊龙算法):⾸先由数据集构造成⼀个K-最近邻图Gk ,再通过⼀个图的划分算法将图Gk 划分成⼤量的⼦图,每个⼦图代表⼀个初始⼦簇,最后⽤⼀个凝聚的层次聚类算法反复合并⼦簇,找到真正的结果簇SBAC:SBAC算法则在计算对象间相似度时,考虑了属性特征对于体现对象本质的重要程度,对于更能体现对象本质的属性赋予较⾼的权值BIRCH:BIRCH算法利⽤树结构对数据集进⾏处理,叶结点存储⼀个聚类,⽤中⼼和半径表⽰,顺序处理每⼀个对象,并把它划分到距离最近的结点,该算法也可以作为其他聚类算法的预处理过程BUBBLE:BUBBLE算法则把BIRCH算法的中⼼和半径概念推⼴到普通的距离空间BUBBLE-FM:BUBBLE-FM算法通过减少距离的计算次数,提⾼了BUBBLE算法的效率基于密度聚类算法:DBSCAN:DBSCAN算法是⼀种典型的基于密度的聚类算法,该算法采⽤空间索引技术来搜索对象的邻域,引⼊了“核⼼对象”和“密度可达”等概念,从核⼼对象出发,把所有密度可达的对象组成⼀个簇GDBSCAN:算法通过泛化DBSCAN算法中邻域的概念,以适应空间对象的特点DBLASD:OPTICS:OPTICS算法结合了聚类的⾃动性和交互性,先⽣成聚类的次序,可以对不同的聚类设置不同的参数,来得到⽤户满意的结果FDC:FDC算法通过构造k-d tree把整个数据空间划分成若⼲个矩形空间,当空间维数较少时可以⼤⼤提⾼DBSCAN的效率基于⽹格的聚类算法:STING:利⽤⽹格单元保存数据统计信息,从⽽实现多分辨率的聚类WaveCluster:在聚类分析中引⼊了⼩波变换的原理,主要应⽤于信号处理领域。

1.聚类定义“聚类是把相似的对象通过静态分类的方法分成不同的组别或者更多的子集(subset),这样让在同一个子集中的成员对象都有一些相似的属性”——wikipedia“聚类分析指将物理或抽象对象的集合分组成为由类似的对象组成的多个类的分析过程。

它是一种重要的人类行为。

聚类是将数据分类到不同的类或者簇这样的一个过程,所以同一个簇中的对象有很大的相似性,而不同簇间的对象有很大的相异性。

”——百度百科说白了,聚类(clustering)是完全可以按字面意思来理解的——将相同、相似、相近、相关的对象实例聚成一类的过程。

简单理解,如果一个数据集合包含N个实例,根据某种准则可以将这N 个实例划分为m个类别,每个类别中的实例都是相关的,而不同类别之间是区别的也就是不相关的,这个过程就叫聚类了。

2.聚类过程:1) 数据准备:包括特征标准化和降维.2) 特征选择:从最初的特征中选择最有效的特征,并将其存储于向量中.3) 特征提取:通过对所选择的特征进行转换形成新的突出特征.4) 聚类(或分组):首先选择合适特征类型的某种距离函数(或构造新的距离函数)进行接近程度的度量;而后执行聚类或分组.5) 聚类结果评估:是指对聚类结果进行评估.评估主要有3 种:外部有效性评估、内部有效性评估和相关性测试评估.3聚类算法的类别没有任何一种聚类技术(聚类算法)可以普遍适用于揭示各种多维数据集所呈现出来的多种多样的结构,根据数据在聚类中的积聚规则以及应用这些规则的方法,有多种聚类算法.聚类算法有多种分类方法将聚类算法大致分成层次化聚类算法、划分式聚类算法、基于密度和网格的聚类算法和其他聚类算法,如图1 所示的4 个类别.3.聚类算法基于层次聚类算法:基于划分聚类算法(partition clustering)基于密度聚类算法:基于网格的聚类算法:STING :利用网格单元保存数据统计信息,从而实现多分辨率的聚类WaveCluster:在聚类分析中引入了小波变换的原理,主要应用于信号处理领域。

一,什么是聚类?聚类: - 将一个对象的集合分割成几个类,每个类内的对象之间是相似的,但与其他类的对象是不相似的。

评判聚类好坏的标准: 1 ,能够适用于大数据量。

2 ,能应付不同的数据类型。

3 ,能够发现不同类型的聚类。

4 ,使对专业知识的要求降到最低。

5 ,能应付脏数据。

6 ,对于数据不同的顺序不敏感。

7 ,能应付很多类型的数据。

8 ,模型可解释,可使用。

二,聚类所基于的数据类型。

聚类算法通常基于“数据矩阵”和“ Dissimilarity矩阵”。

怎么样计算不同对象之间的距离?1 ,数值连续的变量(体重,身高等):度量单位的选取对于聚类的结果的很重要的。

例如将身高的单位从米变为尺,将体重的单位从公斤变为磅将对聚类的结果产生很大的影响。

为了避免出现这种情况,我们必须将数据标准化:将数据中的单位“去掉”。

A, 计算绝对背离度。

B, 计算标准量度。

下面我们考虑怎样来计算两个对象之间的差异。

1 ,欧几里得距离。

2 ,曼哈顿距离。

这两种算法有共同之处: d(i,j)>=0,d(i,i)=0,d(i,j)=d(j,i),d(i,j)=<d(i,h)+d(h,j) 。

3 , Minkowski 距离。

这是上述两种算法的通式。

并且对于不同的变量,我们可以给它赋于不同的 weight.2 ,二元数据变量:如果还是用上面的方法来计算的话,肯定会出现错误。

这儿分两种情况,对称的与非对称的。

3 , Nominal 变量: ( 例如红,黄,绿,蓝….)4 , ordinal 变量(例如科长,处长,局长…. )5 , ratio-scaled 变量:6, 以上几种混合的变量(多数情况是这样的):三,分割的的方法。

1,K 均值算法:给定类的个数 K ,将 n 个对象分到 K 个类中去,使得类内对象之间的相似性最大,而类之间的相似性最小。

缺点:产生类的大小相差不会很大,对于脏数据很敏感。

改进的算法: k—medoids 方法。

数据挖掘中的聚类分析方法数据挖掘是一种通过智能计算和算法挖掘数据价值的技术。

而数据挖掘中的聚类分析方法则是其中的一个重要分支。

聚类分析是指将相似的数据组合在一起,不同的数据分开,形成不同的类别。

聚类分析在机器学习、数据分析、数据挖掘、图像处理等领域有广泛的应用。

本文将从聚类分析的定义、算法、分类等方面进行讲解。

一、聚类分析的定义聚类分析是一种无监督学习算法,它主要用于将样本根据各自的相似性分成若干类别。

聚类分析主要有两种方法:层次聚类和划分聚类。

层次聚类是一种自下而上的聚类方法,将每个样本视为一个初始聚类,然后将聚类依次合并,形成更大的聚类,直到所有样本都组成一个聚类。

层次聚类的结果是一个聚类树状结构,通过剪枝可以获得不同的聚类结果。

划分聚类是一种自上而下的聚类方法,将所有样本看作一个大的聚类,然后逐渐将其划分成更小的聚类,最终得到所需的聚类数目。

划分聚类主要有K均值聚类和高斯混合模型聚类二、聚类分析的算法(一) 层次聚类算法层次聚类常用的算法是自底向上的聚合算法和自顶向下的分裂算法。

自底向上的聚合算法是指先构造n个初始聚类,然后迭代合并最接近的两个聚类,直到达到某个停止条件。

这个停止条件可以是达到了所需的聚类数目,也可以是聚类之间距离的最大值。

自顶向下的分裂算法则是从所有样本开始,将其划分成两个聚类,然后逐步分裂聚类,得到所需的聚类数目。

(二) K均值聚类K均值聚类是一种划分聚类算法,它需要先指定K个聚类中心,然后根据距离来将样本点分配给不同的聚类中心。

然后将每个聚类内部的样本的均值作为该聚类的新中心,重新计算每个样本点和聚类中心的距离,直到聚类中心不再改变或达到一定的迭代次数。

K均值聚类的优势在于简单快速,具有很好的可扩展性和聚类效果。

但是这种算法需要预先确定聚类中心数,且对初始聚类中心的选择比较敏感。

(三) 高斯混合模型聚类高斯混合模型聚类是一种基于概率密度估计的算法,它假设每个聚类的密度函数是一个高斯分布。

复杂⽹络中聚类算法总结⽹络,数学上称为图,最早研究始于1736年欧拉的哥尼斯堡七桥问题,但是之后关于图的研究发展缓慢,直到1936年,才有了第⼀本关于图论研究的著作。

20世纪60年代,两位匈⽛利数学家Erdos和Renyi建⽴了随机图理论,被公认为是在数学上开创了复杂⽹络理论的系统性研究。

之后的40年⾥,⼈们⼀直讲随机图理论作为复杂⽹络研究的基本理论。

然⽽,绝⼤多数的实际⽹络并不是完全随机的。

1998年,Watts及其导师Strogatz在Nature上的⽂章《Collective Dynamics of Small-world Networks》揭⽰了复杂⽹络的⼩世界性质。

随后,1999年,Barabasi及其博⼠⽣Albert在Science上的⽂章《Emergence of Scaling in Random Networks》⼜揭⽰了复杂⽹络的⽆标度性质(度分布为幂律分布),从此开启了复杂⽹络研究的新纪元。

随着研究的深⼊,越来越多关于复杂⽹络的性质被发掘出来,其中很重要的⼀项研究是2002年Girvan和Newman在PNAS上的⼀篇⽂章《Community structure in social and biological networks》,指出复杂⽹络中普遍存在着聚类特性,每⼀个类称之为⼀个社团(community),并提出了⼀个发现这些社团的算法。

从此,热门对复杂⽹络中的社团发现问题进⾏了⼤量研究,产⽣了⼤量的算法,本⽂试图简单整理⼀下复杂⽹络中聚类算法,希望对希望快速了解这⼀部分的⼈有所帮助。

本⽂中所谓的社团跟通常我们将的聚类算法中类(cluster)的概念是⼀致的。

0. 预备知识为了本⽂的完整性,我们⾸先给出⼀些基本概念。

⼀个图通常表⽰为G=(V,E),其中V表⽰点集合,E表⽰边集合,通常我们⽤n表⽰图的节点数,m表⽰边数。

⼀个图中,与⼀个点的相关联的边的数量称为该点的度。

各种聚类算法的比较聚类算法是一种无监督学习方法,用于将样本划分为具有相似特征的不同组别。

在机器学习和数据挖掘中被广泛应用。

有许多不同的聚类算法可供选择,每个算法有其独特的优点和适用范围。

在本文中,我们将比较几种常用的聚类算法,以帮助选择最适合特定问题和数据集的算法。

1.K均值聚类算法:K均值算法是一种经典的聚类算法。

它将数据点分为K个不同的簇,使得同一簇内的数据点之间的距离尽可能小,不同簇之间的距离尽可能大。

该算法计算复杂度较低,适用于大数据集。

然而,该算法对初始聚类中心的选择非常敏感,并且只能处理数值型数据。

2.层次聚类算法:层次聚类算法通过计算数据点之间的相似性将它们逐步聚类成树状结构。

该算法不需要事先指定聚类个数,并且可以处理各种数据类型。

然而,该算法在处理大数据集时计算复杂度较高,并且结果的质量受到相似性度量的影响。

3.密度聚类算法:密度聚类算法使用数据点密度来识别簇。

该算法可以处理不规则形状的簇,并且对初始聚类中心的选择不敏感。

DBSCAN是一种常用的密度聚类算法。

然而,该算法对密度参数的选择敏感,并且在处理高维数据时效果可能不好。

4.基于模型的聚类算法:基于模型的聚类算法将数据点建模为一些概率分布的样本。

该算法可以处理不同形状和大小的簇,并且能够进行概率推断。

高斯混合模型(GMM)是一种常用的基于模型的聚类算法。

然而,该算法对模型的选择和参数估计比较困难。

5.谱聚类算法:谱聚类算法通过矩阵分解来对数据进行聚类。

该算法可以处理非线性可分的数据,并且不需要事先指定聚类个数。

然而,该算法在处理大数据集时计算开销较大,并且对相似度矩阵的构建方法敏感。

以上只是一些常见的聚类算法,实际上还有许多其他聚类算法可供选择,如affinity propagation、BIRCH、OPTICS等。

每种算法都有其独特的特点和适用范围。

在选择聚类算法时,需要考虑数据集的规模、维度、特征类型以及问题的特殊需求等因素。

用于客户细分的不同聚类算法的比较分析。

客户细分是指将客户群体按照特定的标准或属性划分为若干个具有相似特征的子群体,目的是更好地了解客户需求、优化营销策略和提升客户满意度。

聚类算法是一种常用的客户细分方法,它能够根据客户的行为、购买偏好、地理位置等特征将客户分为不同的群组。

本文将对以下几种常见的聚类算法进行比较分析:K-means聚类算法、层次聚类算法、DBSCAN聚类算法和高斯混合模型聚类算法。

1. K-means聚类算法:K-means是一种常见的迭代聚类算法,其主要思想是通过计算样本之间的距离将样本划分为K个不重叠的簇。

该算法的步骤包括初始化簇中心、计算样本与簇中心的距离、将样本分配到最近的簇以及更新簇中心。

K-means算法具有较高的效率和可扩展性,适用于大规模数据集的聚类。

2. 层次聚类算法:层次聚类算法是一种自底向上或自顶向下的聚类方法,它通过计算样本之间的相似度或距离来构建一个层次化的聚类结构。

该算法能够生成完整的聚类层次,并且不需要预先指定聚类簇的个数。

层次聚类算法的优点是能够发现数据中的潜在结构和异类样本,但计算复杂度较高,不适用于大规模数据集。

3. DBSCAN聚类算法:DBSCAN是一种基于密度的聚类算法,它通过定义样本的领域密度来划分簇。

该算法能够发现任意形状和大小的聚类,并能够识别噪声点。

DBSCAN的优点是不需要预先指定聚类簇的个数,适用于大规模数据集和高维数据。

但在处理样本密度差异较大的数据集时,可能会产生较多的噪声点。

4. 高斯混合模型聚类算法:高斯混合模型(GMM)聚类算法假设样本属于多个高斯分布的混合,并通过最大似然估计来估计每个簇的参数。

该算法能够发现潜在的数据生成过程,并能够处理样本存在重叠的情况。

GMM聚类算法的优点是能够生成软聚类结果,且对异常值不敏感。

但计算复杂度较高,对参数的初始化敏感。

根据以上分析,可以看出不同的聚类算法在客户细分中具有不同的优缺点。

最新各种聚类算法介绍及对比聚类是一种常用的机器学习算法,它将数据集中的样本分成若干个“类别”或“簇”,使得同一类别内的样本相似度高,而不同类别之间的相似度较低。

聚类算法有很多种,每种算法都有其特点和适用条件。

下面将对几种常见的聚类算法进行介绍和对比。

1.K均值聚类算法K均值聚类是一种迭代算法,它将数据集中的样本划分为K个簇,使得同一簇内样本之间的距离最小。

它首先随机选择K个样本作为簇的中心,然后将每个样本分配到与其距离最近的簇中,再更新各个簇的中心点,重复这一过程直到簇的中心点不再发生变化。

该算法的优点是简单易用,计算效率高,但需要预先设定簇的数量K。

2.层次聚类算法层次聚类是一种自底向上或自顶向下的聚类算法,它通过计算样本之间的相似度来构建一个样本之间的树形结构。

自底向上的层次聚类称为凝聚式层次聚类,它从每个样本作为一个簇开始,不断合并相似度最高的簇,直到达到指定的簇的数目。

自顶向下的层次聚类称为分裂式层次聚类,它从所有样本作为一个簇开始,将簇分割成较小的子簇,不断递归地进行下去。

该算法的优点是不需要预先指定簇的数量,但计算复杂度较高。

3.密度聚类算法密度聚类是一种基于样本之间的密度区域来划分簇的算法,它将样本划分为高密度的核心对象、低密度的边界对象和噪声对象。

其中最著名的密度聚类算法是DBSCAN(Density-Based Spatial Clustering ofApplications with Noise),它以每个样本周围的密度可达距离作为核心对象的判定条件,通过不断扩展核心对象的邻域来确定簇的边界。

4.谱聚类算法谱聚类是一种基于图论的聚类算法,它首先构建数据样本之间的相似度矩阵,然后将其转化为拉普拉斯矩阵,再通过对拉普拉斯矩阵进行特征分解来得到特征向量,最后将特征向量聚类为指定数量的簇。

谱聚类不仅可以处理线性可分的数据,还可以处理非线性可分的数据,且对噪音和异常值具有较好的鲁棒性。

一、层次聚类1、层次聚类的原理及分类1层次法Hierarchical methods先计算样本之间的距离;每次将距离最近的点合并到同一个类;然后,再计算类与类之间的距离,将距离最近的类合并为一个大类;不停的合并,直到合成了一个类;其中类与类的距离的计算方法有:最短距离法,最长距离法,中间距离法,类平均法等;比如最短距离法,将类与类的距离定义为类与类之间样本的最短距离;层次聚类算法根据层次分解的顺序分为:自下底向上和自上向下,即凝聚的层次聚类算法和分裂的层次聚类算法agglomerative和divisive,也可以理解为自下而上法bottom-up和自上而下法top-down;自下而上法就是一开始每个个体object都是一个类,然后根据linkage寻找同类,最后形成一个“类”;自上而下法就是反过来,一开始所有个体都属于一个“类”,然后根据linkage排除异己,最后每个个体都成为一个“类”;这两种路方法没有孰优孰劣之分,只是在实际应用的时候要根据数据特点以及你想要的“类”的个数,来考虑是自上而下更快还是自下而上更快;至于根据Linkage判断“类”的方法就是最短距离法、最长距离法、中间距离法、类平均法等等其中类平均法往往被认为是最常用也最好用的方法,一方面因为其良好的单调性,另一方面因为其空间扩张/浓缩的程度适中;为弥补分解与合并的不足,层次合并经常要与其它聚类方法相结合,如循环定位;2Hierarchical methods中比较新的算法有BIRCHBalanced Iterative Reducing and Clustering Using Hierarchies利用层次方法的平衡迭代规约和聚类主要是在数据量很大的时候使用,而且数据类型是numerical;首先利用树的结构对对象集进行划分,然后再利用其它聚类方法对这些聚类进行优化;ROCKA Hierarchical Clustering Algorithm for Categorical Attributes主要用在categorical 的数据类型上;ChameleonA Hierarchical Clustering Algorithm Using Dynamic Modeling里用到的linkage是kNNk-nearest-neighbor算法,并以此构建一个graph,Chameleon的聚类效果被认为非常强大,比BIRCH好用,但运算复杂度很高,On^2;2、层次聚类的流程凝聚型层次聚类的策略是先将每个对象作为一个簇,然后合并这些原子簇为越来越大的簇,直到所有对象都在一个簇中,或者某个终结条件被满足;绝大多数层次聚类属于凝聚型层次聚类,它们只是在簇间相似度的定义上有所不同;这里给出采用最小距离的凝聚层次聚类算法流程:1 将每个对象看作一类,计算两两之间的最小距离;2 将距离最小的两个类合并成一个新类;3 重新计算新类与所有类之间的距离;4 重复2、3,直到所有类最后合并成一类;聚类的效果如下图,黑色是噪音点:另外我们可以看出凝聚的层次聚类并没有类似基本K均值的全局目标函数,没有局部极小问题或是很难选择初始点的问题;合并的操作往往是最终的,一旦合并两个簇之后就不会撤销;当然其计算存储的代价是昂贵的;3、层次聚类的优缺点优点:1,距离和规则的相似度容易定义,限制少;2,不需要预先制定聚类数;3,可以发现类的层次关系;4,可以聚类成其它形状缺点:1,计算复杂度太高;2,奇异值也能产生很大影响;3,算法很可能聚类成链状r语言中使用hclustd, method = "complete", members=NULL:进行层次聚类;d为距离矩阵;method 表示类的合并方法,single最短距离法,complete最长距离法,median中间距离法,mcquitty相似法,average类平均法,centroid重心法,ward离差平方和法;members为NULL或d长度的矢量;二、划分聚类法k-means基于划分的方法Partition-based methods:其原理简单来说就是,想象你有一堆散点需要聚类,想要的聚类效果就是“类内的点都足够近,类间的点都足够远”;首先你要确定这堆散点最后聚成几类,然后挑选几个点作为初始中心点,再然后依据预先定好的启发式算法heuristic algorithms给数据点做迭代重置iterative relocation,直到最后到达“类内的点都足够近,类间的点都足够远”的目标效果;Partition-based methods聚类多适用于中等体量的数据集,但我们也不知道“中等”到底有多“中”,所以不妨理解成,数据集越大,越有可能陷入局部最小;1、Kmeans算法的原理k-means算法以k为参数,把n个对象分成k个簇,使簇内具有较高的相似度,而簇间的相似度较低;k-means算法的处理过程如下:首先,随机地选择k个对象,每个对象初始地代表了一个簇的平均值或中心,即选择K个初始质心;对剩余的每个对象,根据其与各簇中心的距离,将它赋给最近的簇;然后重新计算每个簇的平均值; 这个过程不断重复,直到准则函数收敛,直到质心不发生明显的变化;通常,采用平方误差准则,误差的平方和SSE作为全局的目标函数,即最小化每个点到最近质心的欧几里得距离的平方和;此时,簇的质心就是该簇内所有数据点的平均值;选择K个点作为初始质心repeat将每个点指派到最近的质心,形成K个簇重新计算每个簇的质心until簇不发生变化或达到最大迭代次数时间复杂度:OtKmn,其中,t为迭代次数,K为簇的数目,m为记录数,n为维数空间复杂度:Om+Kn,其中,K为簇的数目,m为记录数,n为维数K-Means 算法的详细过程从上图中,我们可以看到,A, B, C, D, E 是五个在图中点;而灰色的点是我们的种子点,也就是我们用来找点群的点;有两个种子点,所以K=2;然后,K-Means的算法如下:①随机在图中取K这里K=2个种子点;②然后对图中的所有点求到这K个种子点的距离,假如点Pi离种子点Si最近,那么Pi属于Si点群;我们可以看到A,B属于上面的种子点,C,D,E属于下面中部的种子点③接下来,我们要移动种子点到属于他的“点群”的中心;见图上的第三步④然后重复第2和第3步,直到,种子点没有移动我们可以看到图中的第四步上面的种子点聚合了A,B,C,下面的种子点聚合了D,E;聚类的效果如下图,折线是历次循环时3个簇的质心的更新轨迹,黑点是初始质心:我们查看基本K均值算法实现步骤及上面的聚类效果可以发现,该聚类算法将所有数据点都进行了指派,不识别噪音点;另外选择适当的初试质心是基本K均值过程的关键;2、k均值的优缺点及分类优点:1,简单,易于理解和实现;2,时间复杂度低缺点:1kmeans要手工输入类数目,对初始值的设置很敏感;所以有了k-means++、intelligent k-means、genetic k-means;2k-means对噪声和离群值非常敏感,所以有了k-medoids和k-medians;3k-means只用于numerical类型数据,不适用于categorical类型数据,所以k-modes;4k-means不能解决非凸non-convex数据,所以有了kernel k-means;5k-means主要发现圆形或者球形簇,不能识别非球形的簇;3、k-means与DBSCAN的区别k-means聚类算法的初始点选择不稳定,是随机选取的,这就引起聚类结果的不稳定;k-means属于动态聚类,往往聚出来的类有点圆形或者椭圆形;kmeans对于圆形区域聚类效果较好,dbscan基于密度,对于集中区域效果较好;对于不规则形状,kmeans完全无法用,dbscan可以起到很好的效果;4、k-means注意问题1K如何确定kmenas算法首先选择K个初始质心,其中K是用户指定的参数,即所期望的簇的个数;这样做的前提是我们已经知道数据集中包含多少个簇,但很多情况下,我们并不知道数据的分布情况,实际上聚类就是我们发现数据分布的一种手段;如何有效的确定K值,这里大致提供几种方法:①与层次聚类结合2经常会产生较好的聚类结果的一个有趣策略是,首先采用层次凝聚算法决定结果粗的数目,并找到一个初始聚类,然后用迭代重定位来改进该聚类;②稳定性方法3稳定性方法对一个数据集进行2次重采样产生2个数据子集,再用相同的聚类算法对2个数据子集进行聚类,产生2个具有k个聚类的聚类结果,计算2个聚类结果的相似度的分布情况;2个聚类结果具有高的相似度说明k个聚类反映了稳定的聚类结构,其相似度可以用来估计聚类个数;采用次方法试探多个k,找到合适的k值;③系统演化方法3系统演化方法将一个数据集视为伪热力学系统,当数据集被划分为K个聚类时称系统处于状态K;系统由初始状态K=1出发,经过分裂过程和合并过程,系统将演化到它的稳定平衡状态Ki,所对应的聚类结构决定了最优类数Ki;系统演化方法能提供关于所有聚类之间的相对边界距离或可分程度,适用于明显分离的聚类结构和轻微重叠的聚类结构;④使用canopy算法进行初始划分4基于Canopy Method的聚类算法将聚类过程分为两个阶段Stage1、聚类最耗费计算的地方是计算对象相似性的时候,Canopy Method在第一阶段选择简单、计算代价较低的方法计算对象相似性,将相似的对象放在一个子集中,这个子集被叫做Canopy ,通过一系列计算得到若干Canopy,Canopy之间可以是重叠的,但不会存在某个对象不属于任何Canopy的情况,可以把这一阶段看做数据预处理;Stage2、在各个Canopy 内使用传统的聚类方法如K-means,不属于同一Canopy 的对象之间不进行相似性计算;从这个方法起码可以看出两点好处:首先,Canopy 不要太大且Canopy 之间重叠的不要太多的话会大大减少后续需要计算相似性的对象的个数;其次,类似于K-means这样的聚类方法是需要人为指出K 的值的,通过Stage1得到的Canopy 个数完全可以作为这个K值,一定程度上减少了选择K的盲目性;其他方法如贝叶斯信息准则方法BIC可参看文献5;2初始质心的选取选择适当的初始质心是基本kmeans算法的关键步骤;常见的方法是随机的选取初始质心,但是这样簇的质量常常很差;处理选取初始质心问题的一种常用技术是:多次运行,每次使用一组不同的随机初始质心,然后选取具有最小SSE误差的平方和的簇集;这种策略简单,但是效果可能不好,这取决于数据集和寻找的簇的个数;第二种有效的方法是,取一个样本,并使用层次聚类技术对它聚类;从层次聚类中提取K个簇,并用这些簇的质心作为初始质心;该方法通常很有效,但仅对下列情况有效:1样本相对较小,例如数百到数千层次聚类开销较大;2K相对于样本大小较小第三种选择初始质心的方法,随机地选择第一个点,或取所有点的质心作为第一个点;然后,对于每个后继初始质心,选择离已经选取过的初始质心最远的点;使用这种方法,确保了选择的初始质心不仅是随机的,而且是散开的;但是,这种方法可能选中离群点;此外,求离当前初始质心集最远的点开销也非常大;为了克服这个问题,通常该方法用于点样本;由于离群点很少多了就不是离群点了,它们多半不会在随机样本中出现;计算量也大幅减少;第四种方法就是上面提到的canopy算法;3距离的度量常用的距离度量方法包括:欧几里得距离和余弦相似度;两者都是评定个体间差异的大小的;欧几里得距离度量会受指标不同单位刻度的影响,所以一般需要先进行标准化,同时距离越大,个体间差异越大;空间向量余弦夹角的相似度度量不会受指标刻度的影响,余弦值落于区间-1,1,值越大,差异越小;但是针对具体应用,什么情况下使用欧氏距离,什么情况下使用余弦相似度从几何意义上来说,n维向量空间的一条线段作为底边和原点组成的三角形,其顶角大小是不确定的;也就是说对于两条空间向量,即使两点距离一定,他们的夹角余弦值也可以随意变化;感性的认识,当两用户评分趋势一致时,但是评分值差距很大,余弦相似度倾向给出更优解;举个极端的例子,两用户只对两件商品评分,向量分别为3,3和5,5,这两位用户的认知其实是一样的,但是欧式距离给出的解显然没有余弦值合理;4质心的计算对于距离度量不管是采用欧式距离还是采用余弦相似度,簇的质心都是其均值,即向量各维取平均即可;5算法停止条件一般是目标函数达到最优或者达到最大的迭代次数即可终止;对于不同的距离度量,目标函数往往不同;当采用欧式距离时,目标函数一般为最小化对象到其簇质心的距离的平方和;当采用余弦相似度时,目标函数一般为最大化对象到其簇质心的余弦相似度和;6空聚类的处理如果所有的点在指派步骤都未分配到某个簇,就会得到空簇;如果这种情况发生,则需要某种策略来选择一个替补质心,否则的话,平方误差将会偏大;一种方法是选择一个距离当前任何质心最远的点;这将消除当前对总平方误差影响最大的点;另一种方法是从具有最大SSE的簇中选择一个替补的质心;这将分裂簇并降低聚类的总SSE;如果有多个空簇,则该过程重复多次;另外,编程实现时,要注意空簇可能导致的程序bug;三、基于密度的聚类基于密度的方法Density-based methods:k-means解决不了不规则形状的聚类;于是就有了Density-based methods来系统解决这个问题;该方法同时也对噪声数据的处理比较好;基于密度聚类的思想:思路就是定一个距离半径,最少有多少个点,然后把可以到达的点都连起来,判定为同类;其原理简单说画圈儿,其中要定义两个参数,一个是圈儿的最大半径,一个是一个圈儿里最少应容纳几个点;最后在一个圈里的,就是一个类;DBSCAN Density-Based Spatial Clustering of Applications with Noise就是其中的典型,可惜参数设置也是个问题,对这两个参数的设置非常敏感;DBSCAN的扩展叫OPTICSOrdering Points To Identify Clustering Structure通过优先对高密度high density进行搜索,然后根据高密度的特点设置参数,改善了DBSCAN的不足;1、DBSCAN的概念dbscan基于密度,对于集中区域效果较好,为了发现任意形状的簇,这类方法将簇看做是数据空间中被低密度区域分割开的稠密对象区域;一种基于高密度连通区域的基于密度的聚类方法,该算法将具有足够高密度的区域划分为簇,并在具有噪声的空间数据中发现任意形状的簇;DBSCAN中的几个定义:Ε邻域:给定对象半径为Ε内的区域称为该对象的Ε邻域;核心对象:如果给定对象Ε领域内的样本点数大于等于MinPts,则称该对象为核心对象;直接密度可达:对于样本集合D,如果样本点q在p的Ε领域内,并且p为核心对象,那么对象q从对象p直接密度可达;密度可达:对于样本集合D,给定一串样本点p1,p2….pn,p= p1,q= pn,假如对象pi从pi-1直接密度可达,那么对象q从对象p密度可达;注意:密度可达是单向的,密度可达即可容纳同一类;密度相连:存在样本集合D中的一点o,如果对象o到对象p和对象q都是密度可达的,那么p和q密度相联;密度可达是直接密度可达的传递闭包,并且这种关系是非对称的;密度相连是对称关系;DBSCAN目的是找到密度相连对象的最大集合;有了以上的概念接下来就是算法描述了:DBSCAN通过检查数据库中每点的r邻域来搜索簇;如果点p 的r邻域包含的点多于MinPts个,则创建一个以p为核心对象的新簇;然后,DBSCAN迭代的聚集从这些核心对象直接密度可达的对象,这个过程可能涉及一些密度可达簇的合并;当没有新的点可以添加到任何簇时,该过程结束;例如:Eg: 假设半径Ε=3,MinPts=3,点p的E领域中有点{m,p,p1,p2,o}, 点m的E领域中有点{m,q,p,m1,m2},点q的E领域中有点{q,m},点o的E领域中有点{o,p,s},点s的E领域中有点{o,s,s1}.那么核心对象有p,m,o,sq不是核心对象,因为它对应的E领域中点数量等于2,小于MinPts=3;点m从点p直接密度可达,因为m在p的E领域内,并且p为核心对象;点q从点p密度可达,因为点q从点m直接密度可达,并且点m从点p直接密度可达;点q到点s密度相连,因为点q从点p密度可达,并且s从点p密度可达;2、簇的生成原理及过程1DBSCAN聚类算法原理的基本要点:确定半径eps的值①DBSCAN算法需要选择一种距离度量,对于待聚类的数据集中,任意两个点之间的距离,反映了点之间的密度,说明了点与点是否能够聚到同一类中;由于DBSCAN算法对高维数据定义密度很困难,所以对于二维空间中的点,可以使用欧几里德距离来进行度量;②DBSCAN算法需要用户输入2个参数:一个参数是半径Eps,表示以给定点P为中心的圆形邻域的范围;另一个参数是以点P为中心的邻域内最少点的数量MinPts;如果满足:以点P为中心、半径为Eps 的邻域内的点的个数不少于MinPts,则称点P为核心点;③DBSCAN聚类使用到一个k-距离的概念,k-距离是指:给定数据集P={pi; i=0,1,…n},对于任意点Pi,计算点Pi到集合D的子集S={p1, p2, …, pi-1, pi+1, …, pn}中所有点之间的距离,距离按照从小到大的顺序排序,假设排序后的距离集合为D={d1, d2, …, dk-1, dk, dk+1, …,dn},则dk就被称为k-距离;也就是说,k-距离是点pi到所有点除了pi点之间距离第k近的距离;对待聚类集合中每个点pi都计算k-距离,最后得到所有点的k-距离集合E={e1, e2, …, en};④根据经验计算半径Eps:根据得到的所有点的k-距离集合E,对集合E进行升序排序后得到k-距离集合E’,需要拟合一条排序后的E’集合中k-距离的变化曲线图,然后绘出曲线,通过观察,将急剧发生变化的位置所对应的k-距离的值,确定为半径Eps的值;⑤根据经验计算最少点的数量MinPts:确定MinPts的大小,实际上也是确定k-距离中k的值,DBSCAN 算法取k=4,则MinPts=4;⑥另外,如果觉得经验值聚类的结果不满意,可以适当调整Eps和MinPts的值,经过多次迭代计算对比,选择最合适的参数值;可以看出,如果MinPts不变,Eps取得值过大,会导致大多数点都聚到同一个簇中,Eps过小,会导致一个簇的分裂;如果Eps不变,MinPts的值取得过大,会导致同一个簇中点被标记为噪声点,MinPts过小,会导致发现大量的核心点;我们需要知道的是,DBSCAN算法,需要输入2个参数,这两个参数的计算都来自经验知识;半径Eps的计算依赖于计算k-距离,DBSCAN取k=4,也就是设置MinPts=4,然后需要根据k-距离曲线,根据经验观察找到合适的半径Eps的值;2连通核心点生成簇核心点能够连通有些书籍中称为:“密度可达”,它们构成的以Eps长度为半径的圆形邻域相互连接或重叠,这些连通的核心点及其所处的邻域内的全部点构成一个簇;假设MinPts=4,则连通的核心点示例,如下图所示:计算连通的核心点的思路是,基于广度遍历与深度遍历集合的方式:从核心点集合S中取出一个点p,计算点p与S集合中每个点除了p点是否连通,可能会得到一个连通核心点的集合C1,然后从集合S中删除点p和C1集合中的点,得到核心点集合S1;再从S1中取出一个点p1,计算p1与核心点集合S1集中每个点除了p1点是否连通,可能得到一个连通核心点集合C2,再从集合S1中删除点p1和C2集合中所有点,得到核心点集合S2,……最后得到p、p1、p2、……,以及C1、C2、……就构成一个簇的核心点;最终将核心点集合S中的点都遍历完成,得到所有的簇;参数eps的设置,如果eps设置过大,则所有的点都会归为一个簇,如果设置过小,那么簇的数目会过多;如果MinPts设置过大的话,很多点将被视为噪声点;3、根据数据点的密度分为三类点:1核心点:该点在邻域内的密度超过给定的阀值MinPs;2边界点:该点不是核心点,但是其邻域内包含至少一个核心点;3噪音点:不是核心点,也不是边界点;有了以上对数据点的划分,聚合可以这样进行:各个核心点与其邻域内的所有核心点放在同一个簇中,把边界点跟其邻域内的某个核心点放在同一个簇中;聚类的效果如下图,黑色是噪音点:初识聚类算法:因为DBSCAN使用簇的基于密度的定义,因此它是相对抗噪音的,并且能处理任意形状和大小的簇;但是如果簇的密度变化很大,例如ABCD四个簇,AB的密度大大大于CD,而且AB附近噪音的密度与簇CD 的密度相当,这是当MinPs较大时,无法识别簇CD,簇CD和AB附近的噪音都被认为是噪音;当MinPs 较小时,能识别簇CD,但AB跟其周围的噪音被识别为一个簇;这个问题可以基于共享最近邻SNN的聚类结局;4、DBSCAN的优缺点:优点:1. 与K-means方法相比,DBSCAN不需要事先知道要形成的簇类的数量;2. 与K-means方法相比,DBSCAN可以发现任意形状的簇类;3. 同时,DBSCAN能够识别出噪声点;对于数据库中样本的顺序不敏感,即Pattern的输入顺序对结果的影响不大;但是,对于处于簇类之间边界样本,可能会根据哪个簇类优先被探测到而其归属有所摆动;缺点:1. DBScan不能很好反映高尺寸数据;2. DBScan不能很好反映数据集变化的密度;3.对于高维数据,点之间极为稀疏,密度就很难定义了;。

各种聚类算法介绍及对比聚类算法是一种无监督学习的方法,目标是将数据集中的样本分成不同的组或簇,使得同一个簇内的样本相似度高,而不同簇之间的相似度低。

聚类算法主要有层次聚类、K-means、DBSCAN、谱聚类和密度聚类等。

下面将介绍这些聚类算法,并进行一些对比分析。

1. 层次聚类(Hierarchical Clustering)层次聚类算法可分为自上而下的凝聚聚类和自下而上的分裂聚类。

凝聚聚类从所有样本开始,逐步合并相似的样本,形成一个层次树状结构。

分裂聚类从一个单独的样本开始,逐步分裂为更小的簇,形成一个层次树状结构。

层次聚类的优点是可以根据需要选择得到任意数量的簇,但计算复杂度较高。

2. K-meansK-means是一种划分聚类算法,其步骤为:首先随机选择K个簇中心点,然后根据样本与簇中心的距离将样本划分至最近的簇,接着根据划分结果重新计算簇中心,重复上述过程直到算法收敛。

K-means算法简单高效,但对于非球形簇的数据集表现一般。

3. DBSCAN(Density-Based Spatial Clustering of Applications with Noise)DBSCAN是一种基于密度的聚类算法,不需要预先指定簇的数量。

DBSCAN将样本分为核心对象、边界对象和噪声对象,根据样本之间的密度和可达性关系进行聚类。

核心对象周围一定距离内的样本将被划分为同一个簇。

DBSCAN适用于有噪声数据和不规则形状簇的聚类,但对密度差异较大的数据集效果可能较差。

4. 谱聚类(Spectral Clustering)谱聚类算法先通过样本之间的相似度构建相似度矩阵,然后选取相似度矩阵的前k个最大特征值对应的特征向量作为样本的新表示。

接着将新表示的样本集采用K-means等方法进行聚类。

谱聚类算法在处理复杂几何结构、高维数据和大规模数据时表现出色,但需要选择合适的相似度计算方法和簇的数量。

5. 密度聚类(Density-Based Clustering)密度聚类算法通过估计样本的局部密度来发现簇。

各种密度聚类算法密度聚类是一种非参数化的聚类算法,它可以根据样本之间的密度信息将数据点聚集成簇。

与传统的基于距离的聚类算法(如K-means)不同,密度聚类算法可以自动识别出不同形状和大小的簇,适用于处理高维、非线性、噪声较多的数据。

以下是几种常见的密度聚类算法:1. DBSCAN(Density-Based Spatial Clustering of Applications with Noise):DBSCAN是一种基于密度的聚类算法,通过根据密度划分核心对象、边界对象和噪声对象来形成簇。

DBSCAN使用两个参数,即邻域半径ε和最小邻域点数MinPts,可以在不同的数据集上找到具有不同形状和大小的簇。

2. OPTICS(Ordering Points to Identify the Clustering Structure):OPTICS是对DBSCAN的改进,它针对DBSCAN需要事先设定参数的问题进行了改进。

OPTICS通过计算每个点与其邻域点之间的距离来构建一个邻域距离的有序列表,从而识别出密度相似的簇。

OPTICS还引入了核心距离和可达距离的概念,可以更好地识别不同密度的簇。

3. DENCLUE(DENsity-based CLUstEring):DENCLUE是一种基于密度梯度的聚类算法,它假设样本的分布在高密度区域具有概率较大,并利用样本之间的密度梯度信息来聚类。

DENCLUE使用高斯核函数来估计样本的密度,并通过不断更新密度梯度来逐步聚类。

DENCLUE可以处理具有多个密度峰值的数据集。

4. GDBSCAN(Generalized Density-Based Spatial Clustering of Applications with Noise):GDBSCAN是对DBSCAN的改进,它通过在DBSCAN中引入参数来调整密度阈值来解决DBSCAN对密度参数的敏感性问题。

GDBSCAN可以对密度变化较大的数据集进行聚类,并可以灵活地调整簇的形状和大小。

各种聚类算法的优缺点聚类算法是机器学习领域中常用的一种无监督学习方法,其主要目的是将数据集中的样本划分成若干个类别或簇,使得同一类别内部的相似度较高,而不同类别之间的相似度较低。

不同的聚类算法具有不同的优缺点,下面我们分别介绍一下。

1. K-means聚类算法K-means聚类算法是一种较为简单的聚类算法,其基本思想是将数据集划分成K个簇,使得同一簇内部的样本距离之和最小。

优点是算法简单易懂,计算速度快,缺点是对于不同密度、不同大小的簇无法处理,且对于初始聚类中心的选择非常敏感。

2. 层次聚类算法层次聚类算法又称为分级聚类算法,其主要思想是将数据集中的样本逐步合并成越来越大的簇。

优点是不需要提前确定聚类数目,且对于不同密度、不同大小的簇都可以处理,缺点是计算时间较长,且不适合处理大规模数据集。

3. DBSCAN聚类算法DBSCAN聚类算法是一种基于密度的聚类算法,其主要思想是将数据集中的样本分为核心点、边界点和噪声点,核心点之间的距离小于一定的阈值,边界点与核心点的距离也小于这个阈值,而噪声点则无法被划分到任何一个簇中。

优点是可以处理不同大小、不同密度的簇,且对于噪声点具有较强的鲁棒性,缺点是需要对距离阈值和密度阈值进行合理的选择。

4. GMM聚类算法GMM聚类算法是一种基于高斯分布的聚类算法,其主要思想是将数据分为若干个高斯分布模型,其中每个模型代表一个簇。

优点是可以处理不同的数据分布形态,且对于不同大小、不同密度的簇都可以处理,缺点是计算复杂度较高,需要进行EM算法迭代优化。

总的来说,不同的聚类算法适用于不同的场景,需要根据具体的数据集特点进行选择。

当然,也可以将多种算法进行组合使用,以获取更好的聚类效果。

聚类,也被称为Clustering,是一种无监督学习方法,用于将数据集分割成不同的类或簇。

每个簇内的数据对象的相似性尽可能大,而不在同一个簇中的数据对象的差异性也尽可能地大。

以下是一些常见的聚类方法及其简要描述:1. K-Means: K-Means聚类算法是最常用的聚类方法之一,它将数据点分为K个簇,每个簇的中心点是其所有成员的平均值。

例如,可以使用K-Means对顾客按照购买行为进行分组。

2. Affinity Propagation: 这是一种基于图论的聚类算法,旨在识别数据中的"exemplars" (代表点)和"clusters" (簇)。

例如,可以使用Affinity Propagation来识别新闻文章中的主题。

3. Agglomerative Clustering (凝聚层次聚类): 这是一种自底向上的聚类算法,它将每个数据点视为一个初始簇,并将它们逐步合并成更大的簇,直到达到停止条件为止。

例如,可以使用Agglomerative Clustering来对基因进行分类。

4. Mean Shift Clustering: 此算法根据数据的密度来进行聚类。

例如,可以使用Mean Shift 对天气数据进行空间分区。

5. Bisecting K-Means: 它是K-Means的衍生算法,通过不断地将当前簇一分为二来找到更好的聚类效果。

例如,可以使用Bisecting K-Means对文档进行主题分类。

6. DBSCAN: DBSCAN是一个基于密度的聚类算法,它可以识别出任意形状的簇,并且可以处理噪声数据。

例如,可以使用DBSCAN对地理空间数据进行区域划分。

各种密度聚类算法密度聚类(Density-based clustering)是一种基于密度的聚类算法,它将数据集分为不同的密度高低区域,从而实现聚类。

相比于基于距离的聚类算法(如K均值聚类),密度聚类算法更适合处理具有不规则形状和噪声的数据。

在本文中,我们将介绍几种常见的密度聚类算法。

1. DBSCAN(Density-Based Spatial Clustering of Applications with Noise)算法是最常用的密度聚类算法之一、它基于样本的密度来确定聚类,将高密度区域划分为一个簇,将低密度区域作为噪声。

该算法通过定义半径和邻域内的最小样本数来确定核心点、边界点和噪声点。

核心点是在半径内有足够数量的邻居的点,边界点是在半径内邻居数量不够但可以连接到核心点的点,噪声点是不在任何簇中的点。

2. OPTICS(Ordering Points To Identify the Clustering Structure)算法是DBSCAN的改进版本。

与DBSCAN不同,OPTICS算法可以自动确定最佳的半径参数。

它通过计算核心距离和可达距离来构建一个可达性图,从而描述数据的聚类结构。

通过分析可达性图中点的密度和可达距离,我们可以提取出具有不同密度的聚类。

3. HDBSCAN(Hierarchical Density-Based Spatial Clustering of Applications with Noise)算法是一种基于密度的层次聚类算法。

它结合了密度聚类和层次聚类的优点,可以自动识别不同密度的聚类,并且对噪声点具有较强的鲁棒性。

HDBSCAN通过创建一棵聚类层次树来表示数据的聚类结构,通过分析聚类簇的稳定性来确定最佳聚类结果。

4. DENCLUE(DENsity CLUstering)算法是一种基于核密度估计的密度聚类算法。

它将每个点表示为高斯核的加权线性组合,通过迭代优化核心点的位置和权重来聚类数据。

各种聚类算法的比较

聚类的目标是使同一类对象的相似度尽可能地小;不同类对象之间的相似度尽可能地大。

目前聚类的方法很多,根据基本思想的不同,大致可以将聚类算法分为五大类:层次聚类算法、分割聚类算法、基于约束的聚类算法、机器学习中的聚类算法和用于高维度的聚类算法。

摘自数据挖掘中的聚类分析研究综述这篇论文。

1、层次聚类算法

1.1聚合聚类

1.1.1相似度依据距离不同:Single-Link:最近距离、Complete-Link:最远距离、Average-Link:平均距离

1.1.2最具代表性算法

1)CURE算法

特点:固定数目有代表性的点共同代表类

优点:识别形状复杂,大小不一的聚类,过滤孤立点

2)ROCK算法

特点:对CURE算法的改进

优点:同上,并适用于类别属性的数据

3)CHAMELEON算法

特点:利用了动态建模技术

1.2分解聚类

1.3优缺点

优点:适用于任意形状和任意属性的数据集;灵活控制不同层次的聚类粒度,强聚类能力

缺点:大大延长了算法的执行时间,不能回溯处理

2、分割聚类算法

2.1基于密度的聚类

2.1.1特点

将密度足够大的相邻区域连接,能有效处理异常数据,主要用于对空间数据的聚类

1)DBSCAN:不断生长足够高密度的区域

2)DENCLUE:根据数据点在属性空间中的密度进行聚类,密度和网格与处理的结合

3)OPTICS、DBCLASD、CURD:均针对数据在空间中呈现的不同密度分不对DBSCAN作了改进

2.2基于网格的聚类

2.2.1特点

利用属性空间的多维网格数据结构,将空间划分为有限数目的单元以构成网格结构;

1)优点:处理时间与数据对象的数目无关,与数据的输入顺序无关,可以处理任意类型的数据

2)缺点:处理时间与每维空间所划分的单元数相关,一定程度上降低了聚类的质量和准确性

2.2.2典型算法

1)STING:基于网格多分辨率,将空间划分为方形单元,对应不同分辨率2)STING+:改进STING,用于处理动态进化的空间数据

3)CLIQUE:结合网格和密度聚类的思想,能处理大规模高维度数据4)WaveCluster:以信号处理思想为基础

2.3基于图论的聚类

2.3.1特点

转换为组合优化问题,并利用图论和相关启发式算法来解决,构造数据集的最小生成数,再逐步删除最长边

1)优点:不需要进行相似度的计算

2.3.2两个主要的应用形式

1)基于超图的划分

2)基于光谱的图划分

2.4基于平方误差的迭代重分配聚类

2.4.1思想

逐步对聚类结果进行优化、不断将目标数据集向各个聚类中心进行重新分配以获最优解

1)概率聚类算法

期望最大化、能够处理异构数据、能够处理具有复杂结构的记录、能够连续处理成批的数据、具有在线处理能力、产生的聚类结果易于解释

2)最近邻聚类算法——共享最近邻算法SNN

特点:结合基于密度方法和ROCK思想,保留K最近邻简化相似矩阵和个数

不足:时间复杂度提高到了O(N^2)

3)K-Medioids算法

特点:用类中的某个点来代表该聚类

优点:能处理任意类型的属性;对异常数据不敏感

4)K-Means算法

1》特点:聚类中心用各类别中所有数据的平均值表示

2》原始K-Means算法的缺陷:结果好坏依赖于对初始聚类中心的选择、容易陷入局部最优解、对K值的选择没有准则可依循、对异常数据较为敏感、只能处理数值属性的数据、聚类结构可能不平衡

3》K-Means的变体

Bradley和Fayyad等:降低对中心的依赖,能适用于大规模数据集

Dhillon等:调整迭代过程中重新计算中心方法,提高性能

Zhang等:权值软分配调整迭代优化过程

Sarafis:将遗传算法应用于目标函数构建中

Berkh in等:应用扩展到了分布式聚类

还有:采用图论的划分思想,平衡聚类结果,将原始算法中的目标函数对应于一个各向同性的高斯混合模型

5)优缺点

优点:应用最为广泛;收敛速度快;能扩展以用于大规模的数据集

缺点:倾向于识别凸形分布、大小相近、密度相近的聚类;中心选择和噪声聚类对结果影响大

3、基于约束的聚类算法

3.1约束

对个体对象的约束、对聚类参数的约束;均来自相关领域的经验知识

3.2重要应用

对存在障碍数据的二维空间按数据进行聚类,如COD(Clustering with Obstructed Distance):用两点之间的障碍距离取代了一般的欧式距离

3.3不足

通常只能处理特定应用领域中的特定需求

4、用于高维数据的聚类算法

4.1困难来源因素

1)无关属性的出现使数据失去了聚类的趋势

2)区分界限变得模糊

4.2解决方法

1)对原始数据降维

2)子空间聚类

CACTUS:对原始空间在二维平面上的投影

CLIQUE:结合基于密度和网格的聚类思想,借鉴Apriori算法

3)联合聚类技术

特点:对数据点和属性同时进行聚类

文本:基于双向划分图及其最小分割的代数学方法

4.3不足:不可避免地带来了原始数据信息的损失和聚类准确性的降低

5、机器学习中的聚类算法

5.1两个方法

1)人工神经网络方法

自组织映射:向量化方法,递增逐一处理;映射至二维平面,实现可视化基于投影自适应谐振理论的人工神经网络聚类

2)基于进化理论的方法

缺陷:依赖于一些经验参数的选取,并具有较高的计算复杂度

模拟退火:微扰因子;遗传算法(选择、交叉、变异)

5.2优缺点

优点:利用相应的启发式算法获得较高质量的聚类结果

缺点:计算复杂度较高,结果依赖于对某些经验参数的选择。