线性回归方程中的相关系数r教学教材

- 格式:doc

- 大小:1.89 MB

- 文档页数:19

线性回归方程中的相关系数rr=∑(Xi-X的平均数)(Yi-Y平均数)/根号下[∑(Xi-X平均数)^2*∑(Yi-Y平均数)^2]R2就是相关系数的平方,R在一元线性方程就直接是因变量自变量的相关系数,多元则是复相关系数判定系数R^2也叫拟合优度、可决系数。

表达式是:R^2=ESS/TSS=1-RSS/TSS该统计量越接近于1,模型的拟合优度越高。

问题:在应用过程中发现,如果在模型中增加一个解释变量,R2往往增大这就给人一个错觉:要使得模型拟合得好,只要增加解释变量即可。

——但是,现实情况往往是,由增加解释变量个数引起的R2的增大与拟合好坏无关,R2需调整。

这就有了调整的拟合优度:R1^2=1-(RSS/(n-k-1))/(TSS/(n-1))在样本容量一定的情况下,增加解释变量必定使得自由度减少,所以调整的思路是:将残差平方和与总离差平方和分别除以各自的自由度,以剔除变量个数对拟合优度的影响:其中:n-k-1为残差平方和的自由度,n-1为总体平方和的自由度。

总是来说,调整的判定系数比起判定系数,除去了因为变量个数增加对判定结果的影响。

R = R接近于1表明Y与X1,X2 ,…,Xk之间的线性关系程度密切;R接近于0表明Y与X1,X2 ,…,Xk之间的线性关系程度不密切相关系数就是线性相关度的大小,1为(100%)绝对正相关,0为0%,-1为(100%)绝对负相关相关系数绝对值越靠近1,线性相关性质越好,根据数据描点画出来的函数-自变量图线越趋近于一条平直线,拟合的直线与描点所得图线也更相近。

如果其绝对值越靠近0,那么就说明线性相关性越差,根据数据点描出的图线和拟合曲线相差越远(当相关系数太小时,本来拟合就已经没有意义,如果强行拟合一条直线,再把数据点在同一坐标纸上画出来,可以发现大部分的点偏离这条直线很远,所以用这个直线来拟合是会出现很大误差的或者说是根本错误的)。

分为一元线性回归和多元线性回归线性回归方程中,回归系数的含义一元:Y^=bX+a b表示X每变动(增加或减少)1个单位,Y平均变动(增加或减少)b各单位多元:Y^=b1X1+b2X2+b3X3+a 在其他变量不变的情况下,某变量变动1单位,引起y平均变动量以b2为例:b2表示在X1、X3(在其他变量不变的情况下)不变得情况下,X2每变动1单位,y平均变动b2单位就一个reg来说y=a+bx+ea+bx的误差称为explained sum of squaree的误差是不能解释的是residual sum of square总误差就是TSS所以TSS=RSS+ESS判定系数也叫拟合优度、可决系数。

线性回归相关系数R线性回归(LinearRegression)是一种用来分析两种变量间关系的统计技术,其中一个变量是解释变量,另一个变量是结果变量。

在学习线性回归时,一个非常重要的指标是相关系数r,也叫作Pearson 相关系数。

本文将介绍线性回归相关系数R,以及它对线性回归的重要性以及如何计算它。

什么是线性回归相关系数R?线性回归相关系数R是一种有效的度量两个变量之间相关性的指标。

它是一种可以评估变量之间在回归方程中的度量,它可以告诉我们两个变量之间是否有线性关系或接近线性关系,以及它们之间的线性度。

线性回归相关系数R取值范围线性回归相关系数r的取值范围为-1到1。

当r的值等于1时,代表两个变量之间有很强的线性关系;当r的值等于0时,代表两个变量之间没有线性关系;当r的值等于-1时,代表两个变量之间有强烈的负线性关系。

线性回归相关系数R的重要性线性回归相关系数r是研究两个变量间相关性的重要指标,它能反映变量之间关系的强弱,并可用于确定线性回归方程的系数。

它可以帮助研究者识别出研究中变量之间有趣的关系,并可以用来把变量之间的线性关系转换成数学表达式。

如何计算线性回归相关系数R?线性回归相关系数R可以用下式来计算:R=∑(xix)(yiy)/√(∑(xix)^2)(∑(yiy)^2)其中,x为x变量的平均值,y为y变量的平均值。

xi为x变量的实际值,yi为y变量的实际值。

总结线性回归相关系数R是评估变量之间关系强弱的一种重要指标,它的值可以在-1到1之间变化。

研究者可以通过上述公式计算线性回归相关系数R,从而分析出变量之间的关系。

而且,线性回归相关系数R也可以用来确定线性回归方程的系数以及变量之间的线性关系。

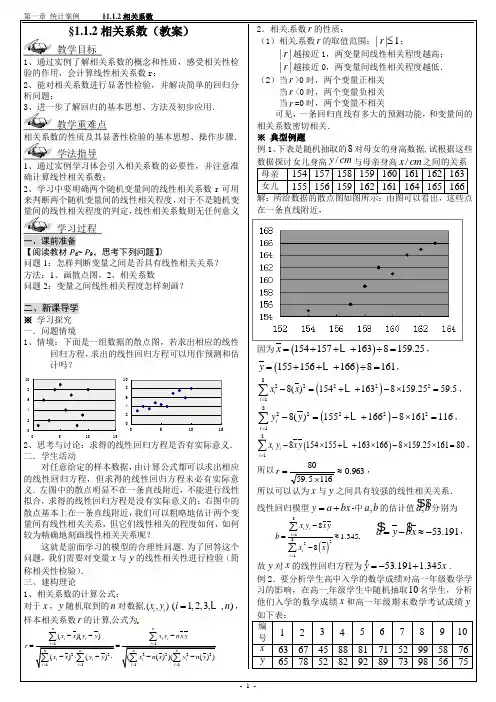

高中数学备课教案数理统计中的线性回归与相关系数高中数学备课教案:数理统计中的线性回归与相关系数引言:在数理统计中,线性回归与相关系数是非常重要的概念和工具。

线性回归可以用来建立变量之间的线性关系模型,帮助我们预测或解释变量之间的关系;相关系数则能够衡量变量之间的相关性强弱。

本教案将针对高中数学的教学要求,详细介绍线性回归与相关系数的概念、计算方法以及实际应用。

一、线性回归的概念和原理1.1 线性回归的基本概念线性回归是一种建立自变量与因变量之间线性关系的模型。

在数理统计中,我们常常使用最小二乘法来拟合线性回归模型,即找到一条直线使得实际观测数据点到该直线的距离最小。

1.2 线性回归的原理线性回归的原理基于统计学中的回归分析。

我们利用已知数据点进行拟合,并通过方程预测或解释变量之间的关系。

通过最小二乘法,我们可以求得斜率和截距,进而建立线性回归模型。

二、线性回归的计算方法2.1 线性回归的计算步骤1)收集数据:收集自变量和因变量的观测数据。

2)计算相关系数:通过相关系数判断自变量和因变量之间的相关性。

3)计算斜率和截距:利用最小二乘法计算斜率和截距。

4)建立回归模型:根据计算结果,建立线性回归方程。

2.2 线性回归的实际应用线性回归可以应用于各种实际问题,例如预测房价、分析销售趋势等。

通过建立适当的自变量和因变量之间的模型,我们可以进行有效的预测和决策。

三、相关系数的计算方法3.1 相关系数的基本概念相关系数是衡量两个变量之间线性相关性强弱的统计量。

相关系数的取值范围在-1到+1之间,接近-1表示负相关,接近+1表示正相关,接近0表示无相关。

3.2 相关系数的计算步骤1)计算协方差:计算两个变量的协方差,衡量两个变量的总体变化趋势是否一致。

2)计算标准差:分别计算两个变量的标准差。

3)计算相关系数:通过协方差和标准差计算相关系数。

四、线性回归与相关系数的联系和区别线性回归和相关系数都能够衡量变量之间的关系,但二者有一些区别。

线性回归方程中的相关系数rr=∑(Xi-X的平均数)(Yi-Y平均数)/根号下[∑(Xi-X平均数)^2*∑(Yi-Y平均数)^2]R2就是相关系数的平方,R在一元线性方程就直接是因变量自变量的相关系数,多元则是复相关系数判定系数R^2也叫拟合优度、可决系数。

表达式是:R^2=ESS/TSS=1-RSS/TSS该统计量越接近于1,模型的拟合优度越高。

问题:在应用过程中发现,如果在模型中增加一个解释变量,R2往往增大这就给人一个错觉:要使得模型拟合得好,只要增加解释变量即可。

——但是,现实情况往往是,由增加解释变量个数引起的R2的增大与拟合好坏无关,R2需调整。

这就有了调整的拟合优度:R1^2=1-(RSS/(n-k-1))/(TSS/(n-1))在样本容量一定的情况下,增加解释变量必定使得自由度减少,所以调整的思路是:将残差平方和与总离差平方和分别除以各自的自由度,以剔除变量个数对拟合优度的影响:其中:n-k-1为残差平方和的自由度,n-1为总体平方和的自由度。

总是来说,调整的判定系数比起判定系数,除去了因为变量个数增加对判定结果的影响。

R = R接近于1表明Y与X1,X2 ,…,Xk之间的线性关系程度密切;R接近于0表明Y与X1,X2 ,…,Xk之间的线性关系程度不密切相关系数就是线性相关度的大小,1为(100%)绝对正相关,0为0%,-1为(100%)绝对负相关相关系数绝对值越靠近1,线性相关性质越好,根据数据描点画出来的函数-自变量图线越趋近于一条平直线,拟合的直线与描点所得图线也更相近。

如果其绝对值越靠近0,那么就说明线性相关性越差,根据数据点描出的图线和拟合曲线相差越远(当相关系数太小时,本来拟合就已经没有意义,如果强行拟合一条直线,再把数据点在同一坐标纸上画出来,可以发现大部分的点偏离这条直线很远,所以用这个直线来拟合是会出现很大误差的或者说是根本错误的)。

分为一元线性回归和多元线性回归线性回归方程中,回归系数的含义一元:Y^=bX+a b表示X每变动(增加或减少)1个单位,Y平均变动(增加或减少)b各单位多元:Y^=b1X1+b2X2+b3X3+a 在其他变量不变的情况下,某变量变动1单位,引起y平均变动量以b2为例:b2表示在X1、X3(在其他变量不变的情况下)不变得情况下,X2每变动1单位,y平均变动b2单位就一个reg来说y=a+bx+ea+bx的误差称为explained sum of squaree的误差是不能解释的是residual sum of square总误差就是TSS所以TSS=RSS+ESS判定系数也叫拟合优度、可决系数。

线性回归⽅程中的相关系数r教学教材线性回归⽅程中的相关系数r线性回归⽅程中的相关系数rr=∑(Xi-X的平均数)(Yi-Y平均数)/根号下[∑(Xi-X平均数)^2*∑(Yi-Y平均数)^2]R2就是相关系数的平⽅,R在⼀元线性⽅程就直接是因变量⾃变量的相关系数,多元则是复相关系数判定系数R^2也叫拟合优度、可决系数。

表达式是:R^2=ESS/TSS=1-RSS/TSS该统计量越接近于1,模型的拟合优度越⾼。

问题:在应⽤过程中发现,如果在模型中增加⼀个解释变量, R2往往增⼤这就给⼈⼀个错觉:要使得模型拟合得好,只要增加解释变量即可。

——但是,现实情况往往是,由增加解释变量个数引起的R2的增⼤与拟合好坏⽆关,R2需调整。

这就有了调整的拟合优度:R1^2=1-(RSS/(n-k-1))/(TSS/(n-1))在样本容量⼀定的情况下,增加解释变量必定使得⾃由度减少,所以调整的思路是:将残差平⽅和与总离差平⽅和分别除以各⾃的⾃由度,以剔除变量个数对拟合优度的影响:其中:n-k-1为残差平⽅和的⾃由度,n-1为总体平⽅和的⾃由度。

总是来说,调整的判定系数⽐起判定系数,除去了因为变量个数增加对判定结果的影响。

R = R接近于1表明Y与X1, X2 ,…,Xk之间的线性关系程度密切;R接近于0表明Y与X1, X2 ,…,Xk之间的线性关系程度不密切相关系数就是线性相关度的⼤⼩,1为(100%)绝对正相关,0为0%,-1为(100%)绝对负相关相关系数绝对值越靠近1,线性相关性质越好,根据数据描点画出来的函数-⾃变量图线越趋近于⼀条平直线,拟合的直线与描点所得图线也更相近。

如果其绝对值越靠近0,那么就说明线性相关性越差,根据数据点描出的图线和拟合曲线相差越远(当相关系数太⼩时,本来拟合就已经没有意义,如果强⾏拟合⼀条直线,再把数据点在同⼀坐标纸上画出来,可以发现⼤部分的点偏离这条直线很远,所以⽤这个直线来拟合是会出现很⼤误差的或者说是根本错误的)。

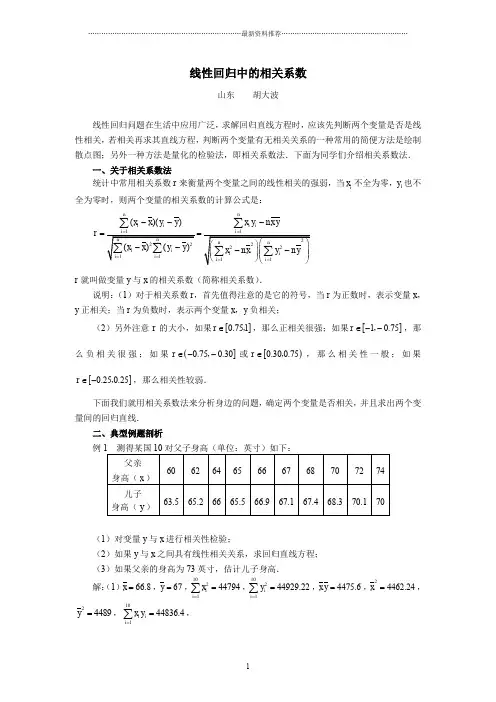

⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯最新料介绍⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯⋯线性回归中的有关系数山东胡大波线性回归问题在生活中应用宽泛,求解回归直线方程时,应当先判断两个变量是不是线性有关,若有关再求其直线方程,判断两个变量有无有关关系的一种常用的简易方法是绘制散点图;此外一种方法是量化的查验法,即有关系数法.下边为同学们介绍有关系数法.一、对于有关系数法统计中常用有关系数r 来权衡两个变量之间的线性有关的强弱,当x不全为零, y i 也不i全为零时,则两个变量的有关系数的计算公式是:n n(x i x)( y i y) x i y i nx yr i 1 i 1n n n n 2nx 2(x i x)2 ( y i y)2 x i2 y i2 nyi 1 i 1 i 1 i 1r 就叫做变量 y 与 x 的有关系数(简称有关系数).说明:( 1)对于有关系数r ,第一值得注意的是它的符号,当r 为正数时,表示变量x,y 正有关;当 r 为负数时,表示两个变量x, y 负有关;( 2)此外注意r 的大小,假如 r ,,那么正有关很强;假如r 1,,那么负相关很强;如果 r ,或 r ,,那么有关性一般;假如r,0.25 ,那么有关性较弱.下边我们就用有关系数法来解析身旁的问题,确立两个变量能否有关,而且求出两个变量间的回归直线.二、典型例题解析例 1 测得某国10 对父子身高(单位:英寸)以下:父亲60 62 64 65 66 67 68 70 72 74身高(x )儿子66 70身高(y )(1)对变量 y 与 x 进行有关性查验;(2)假如 y 与 x 之间拥有线性有关关系,求回归直线方程;(3)假如父亲的身高为 73 英寸,预计儿子身高.10 102x i2 y i2 44929.22 ,x y解:( 1)x 66.8 , y 67 ,44794 ,4475.6 ,x 4462.24 ,i 1 i 1102x i y i 44836.4 ,y 4489,i 110x i y i nx y因此 r i 110 n 22 2 2nx y i nyx ii 1 i 110(44794 44890),因此 y 与 x 之间拥有线性有关关系.10x i y i 10xy 44756( 2)设回归直线方程为y a bx ,则 b i 1 ,1022 4479410xx ii 1a y bx 67 66.8 35.7042 .故所求的回归直线方程为y 35.7042 .( 3)当x 73 英寸时, y 69.9047 ,因此当父亲自高为73 英寸时,预计儿子的身高约为69.9 英寸.评论:回归直线是对两个变量线性有关关系的定量描绘,利用回归直线,能够对一些实际问题进行解析、展望,由一个变量的变化能够推断出另一个变量的变化.这是此类问题常见题型.例 2 10 名同学在高一和高二的数学成绩以下表:x 74 71 72 68 76 73 67 70 65 74y 76 75 71 70 76 79 65 77 62 72 此中 x 为高一数学成绩,y 为高二数学成绩.(1)y 与 x 能否拥有有关关系;(2)假如 y 与 x 是有关关系,求回归直线方程.解:(1)由已知表格中的数据,利用计算器进行计算得101010x i 710 ,y i 723 , x 71, y 72.3 ,x i y i 51467 .i 1 i 1 i 110 10x i2 50520 ,y i2 52541 .i 1 i 110x i y i 10x yr i 1102 102x2 y 210x 10 yi ii1 i 151467 71 100.78 .(50520 10 712 )(52541 102 )因为 r ,由知,有很大的掌握以为x 与 y 之间拥有线性有关关系.( 2)y 与 x 拥有线性有关关系,设回归直线方程为y a bx ,则10i 1 x i y i 10x y51467 10 71b 1.22 ,10 10x 50520 2x2 10 712ii 1a y bx 1.22 71 .因此 y 对于 x 的回归直线方程为 y 14.32 .评论:经过以上两例能够看出,回归方程在生活中应用宽泛,要明确这种问题的计算公式、解题步骤,并会经过计算确立两个变量能否拥有有关关系.。

线性回归方程中的相关系数r线性回归方程中的相关系数rr=∑(Xi-X的平均数)(Yi-Y平均数)/根号下[∑(Xi-X平均数)^2*∑(Yi-Y平均数)^2]R2就是相关系数的平方,R在一元线性方程就直接是因变量自变量的相关系数,多元则是复相关系数判定系数R^2也叫拟合优度、可决系数。

表达式是:R^2=ESS/TSS=1-RSS/TSS该统计量越接近于1,模型的拟合优度越高。

问题:在应用过程中发现,如果在模型中增加一个解释变量, R2往往增大这就给人一个错觉:要使得模型拟合得好,只要增加解释变量即可。

——但是,现实情况往往是,由增加解释变量个数引起的R2的增大与拟合好坏无关,R2需调整。

这就有了调整的拟合优度:R1^2=1-(RSS/(n-k-1))/(TSS/(n-1))在样本容量一定的情况下,增加解释变量必定使得自由度减少,所以调整的思路是:将残差平方和与总离差平方和分别除以各自的自由度,以剔除变量个数对拟合优度的影响:其中:n-k-1为残差平方和的自由度,n-1为总体平方和的自由度。

总是来说,调整的判定系数比起判定系数,除去了因为变量个数增加对判定结果的影响。

R = R接近于1表明Y与X1, X2 ,…,Xk之间的线性关系程度密切;R接近于0表明Y与X1, X2 ,…,Xk之间的线性关系程度不密切相关系数就是线性相关度的大小,1为(100%)绝对正相关,0为0%,-1为(100%)绝对负相关相关系数绝对值越靠近1,线性相关性质越好,根据数据描点画出来的函数-自变量图线越趋近于一条平直线,拟合的直线与描点所得图线也更相近。

如果其绝对值越靠近0,那么就说明线性相关性越差,根据数据点描出的图线和拟合曲线相差越远(当相关系数太小时,本来拟合就已经没有意义,如果强行拟合一条直线,再把数据点在同一坐标纸上画出来,可以发现大部分的点偏离这条直线很远,所以用这个直线来拟合是会出现很大误差的或者说是根本错误的)。

分为一元线性回归和多元线性回归线性回归方程中,回归系数的含义一元:Y^=bX+a b表示X每变动(增加或减少)1个单位,Y平均变动(增加或减少)b各单位多元:Y^=b1X1+b2X2+b3X3+a 在其他变量不变的情况下,某变量变动1单位,引起y平均变动量以b2为例:b2表示在X1、X3(在其他变量不变的情况下)不变得情况下,X2每变动1单位,y平均变动b2单位就一个reg来说y=a+bx+ea+bx的误差称为explained sum of squaree的误差是不能解释的是residual sum of square总误差就是TSS所以TSS=RSS+ESS判定系数也叫拟合优度、可决系数。

表达式是该统计量越接近于1,模型的拟合优度越高。

问题:在应用过程中发现,如果在模型中增加一个解释变量, R2往往增大这就给人一个错觉:要使得模型拟合得好,只要增加解释变量即可。

——但是,现实情况往往是,由增加解释变量个数引起的R2的增大与拟合好坏无关,R2需调整。

这就有了调整的拟合优度在样本容量一定的情况下,增加解释变量必定使得自由度减少,所以调整的思路是:将残差平方和与总离差平方和分别除以各自的自由度,以剔除变量个数对拟合优度的影响:其中:n-k-1为残差平方和的自由度,n-1为总体平方和的自由度。

总是来说,调整的判定系数比起判定系数,除去了因为变量个数增加对判定结果的影响。

顺便补充一下:一般做回归的时候要求拟合优度(实际值与拟合值相关系数的平方)越高越好,可以通过增加解释变量来实现,可是解释变量多了后很多解释变量的系数T检验不显著了,而且增加很多变量后模型的自由度就减少了,这些情况狂的存在往往使得模型预测不精确;修正拟合优度就是将残差平方和跟总离差平方和分别除以各自的自由度,这样就剔除了变量个数对其影响了。

首先有一个恒等式:TSS = ESS + RSS即总偏差平方和 = 回归平方和 + 残差平方和通常情况,我们都是讨论解释变量对总效应的贡献,使用一个叫“拟合优度”(或者叫“判定系数”)的指标其定义为:回归平方和 / 总偏差平方和 =ESS/TSS = (TSS-RSS)/TSS =(923-325)/923如果说随机误差对总效应的贡献,那可以直接 RSS/TSS因为 1 - (TSS-RSS)/TSS 就可以化为 RSS / TSSSPSS中pearson(皮尔逊相关系数)看r值还是P值,确定相关性两个值都要看,r值表示在样本中变量间的相关系数,表示相关性的大小;p值是检验值,是检验两变量在样本来自的总体中是否存在和样本一样的相关性。

SPSS回归系数 SIG在SPSS软件统计结果中,不管是回归分析还是其它分析,都会看到“SIG”,SIG=significance,意为“显著性”,后面的值就是统计出的P值,如果P值0.01<P<0.05,则为差异显著,如果P<0.01,则差异极显著sig是指的的显著性水平,就是p值,一般来说接近0.00越好,过大的话只能说不显著,sig是F检验的结果,<0.01代表方程通过检验,进行回归分析是有效的F表示数据的方差,sig表示显著性,也就是对F检验的结果,如果sig>0.05则说明模型受误差因素干扰太大不能接受。

R是复相关系数,表示观测值和模型描述值之间的线性相关系数,越大越好。

R方通俗的说就是解释率,就是说你的自变量能够解释多少因变量的变化。

具体到你这个就是模型不能接受,自变量解释了22.1%,剩下的只能用误差解释。

spss软件的线性回归分析中,输出了一个anova表,表中的回归、残差、平方和、df、均方、F、sig分别代表什么回归是方法残差是实测与预计值的差值平方和有很多个,不同的平方和的意思不一样df是自由度均方是方差除以自由度f是f分布的统计量sig是p值anova表中的“回归平方和”表示反应变量的变异中的回归模式中所包含的自变量所能解释的部分。

“残差平方和”代表反应变量的变异中没有被回归模型所包含的变量解释的部分。

这两个值与样本量及模型中自变量的个数有关,样本量越大,相应变异就越大。

df是自由度,是自由取值的变量个数,F为F检验统计量,用于检验该回归方程是否有意义,当Sig对应的值小于0.05(当显著性水平为0.05时)时,说明所建立的回归方程具有统计学意义,即自变量和因变量之间存在线性关系。

多元线性回归分析中,t检验与F检验有何不同t检验常能用作检验回归方程中各个参数的显著性,而f检验则能用作检验整个回归关系的显著性。

各解释变量联合起来对被解释变量有显著的线性关系,并不意味着每一个解释变量分别对被解释变量有显著的线性关系F检验主要是检验因变量同多个自变量的整体线性关系是否显著,在k个自变量中,只要有一个自变量同因变量的线性关系显著,t检验则是对每个回归系数分别进行单独的检验,以判断每个自变量对因变量的影响是否显著。

计算结果肺活量例子对数据标准化,即将原始数据减去相应变量的均数后再除以该变量的标准差,计算得到的回归方程称为标准化回归方程,相应得回归系数为标准化回归系数。

标准化回归系数(Beta值)在多元回归中被用来比较变量间的重要性B是指回归系数,beta是指标准回归系数,beta=B/S(B),beta是用来比较各个系数之间的绝对作用或者贡献的大小,B值是不能判断的绝对贡献的。

t值是对该回归系数B做假设检验的结果,P值小于0.05才可以认为有意义,但是具体问题要具体分析,有的时候要考虑交互作用等常数项为负 p值0.04,拒绝常数项为0的假设,统计显著,没问题beta coefficient就是标准回归系数,它是首先把各个自变量进行Z转换(数据值-数据平均值然后除以标准差)之后再进行回归,此时得出的回归系数称为标准化回归系数。

Z转换可以把各个自变量的数级、量纲统一标准化,也就可以根据标准化回归系数的大小比较出各个自变量在回归方程中的效应大小。

标准回归系数standardizedregressioncoefficient或standardregressioncoefficient消除了因变量y和自变量x1,x2,…xn所取单位的影响之后的回归系数,其绝对值的大小直接反映了xi对y的影响程度计算方法对数据标准化,即将原始数据减去相应变量的均数后再除以该变量的标准差,计算得到的回归方程称为标准化回归方程,相应得回归系数为标准化回归系数。

公式若假定回归方程的形式如下:Y=b0+b1X1+b2X2+…+bjXj+…+bJXJ(Y是估计值)其中,回归参数b0,b1,…,bJ通过最小二乘法求得。

则标准化回归系数bj'=bj*(Xj的标准差/Y的标准差)理解方法标准化回归系数(Beta值)在多元回归中被用来比较变量间的重要性。

但是由于重要性这一词意义的含糊性,这一统计常被误用。

有时人们说重要性,是指同样的条件下,哪一个东西更有效。

在提高教学质量上,是硬件条重要还是师资更重要?如果是师资更重要,那么同样的物力投在师资上就可以更快地提高教学质量。

但是这里要比较的两者必须有同样的测量单位,如成本(元)。

如果变量的单位不同,我们不能绝对地说那个变量更重要。

不同单位的两个东西是不能绝对地比出高低轻重来。

要想进行绝对地比较,就需要两个东西有着共同的测度单位,否则无法比较。

而标准化回归系数说的重要性则与上面的意义不同,这是一种相对的重要性,与某一特定的情况下,自变量间的离散程度有关。

比如说,虽然我们不能绝对地说出教育和年资在决定收入上那一个一定是重要的,但如果现在大家的教育程度比较相似,那么在收入的决定上,工作年数就是决定因素;反之,如果工作年数没有太大区别,那么教育就成为了重要原因。

这里的重要性是相对的,是根据不同情况而改变的。

再举一个通俗的例子,研究者研究的是遗传因素和后天因素对于人成长的影响。

那么在一个社会境遇悬殊巨大的环境中,有人在贫民窟成长,有人在贵族学校上学,那么我们会发现人格的大部分差异会从后天环境因素得到解释,而遗传的作用就相对较小;相反,如果儿童都是在一个相差不大的环境中长大的,你会发现,遗传会解释大部分的人格差异。

这种意义上的重要性,不仅与这一自变量的回归系数有关系,而且还与这个自变量的波动程度有关系:如果其波动程度较大,那么就会显得较为重要;否则,就显得不太重要。

标准化回归系数正是测量这种重要性的。

从标准化回归系数的公式中也可看出,Beta值是与自变量的标准差与成正比的,自变量波动程度的增加,会使它在这一具体情况下的重要性增加。

但是如果将两种重要性混同,就会得到误导性结论。

如环境因素的Beta值比遗传因素的Beta值大,就认为在个体的人格发展上应更注意环境因素,而轻视遗传因素,在目前对于Beta值的错误观念非常流行,甚至是一些高手中。