[1010] Training(3)-解题报告

- 格式:ppt

- 大小:508.50 KB

- 文档页数:29

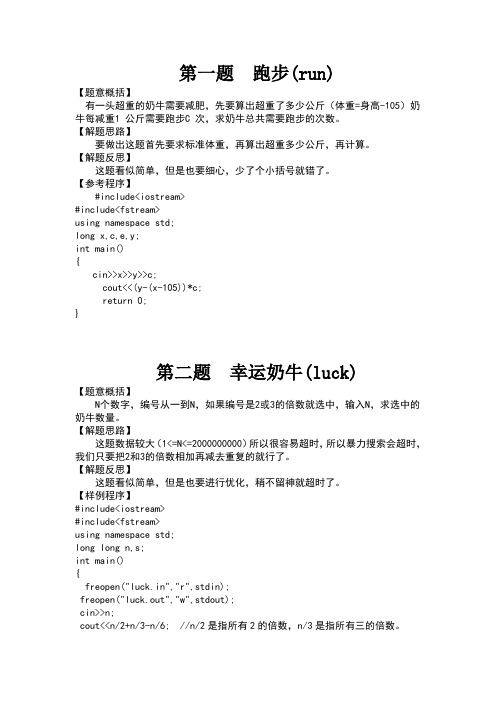

第一题跑步(run)【题意概括】有一头超重的奶牛需要减肥,先要算出超重了多少公斤(体重=身高-105)奶牛每减重1 公斤需要跑步C 次,求奶牛总共需要跑步的次数。

【解题思路】要做出这题首先要求标准体重,再算出超重多少公斤,再计算。

【解题反思】这题看似简单,但是也要细心,少了个小括号就错了。

【参考程序】#include<iostream>#include<fstream>using namespace std;long x,c,e,y;int main(){cin>>x>>y>>c;cout<<(y-(x-105))*c;return 0;}第二题幸运奶牛(luck)【题意概括】N个数字,编号从一到N,如果编号是2或3的倍数就选中,输入N,求选中的奶牛数量。

【解题思路】这题数据较大(1<=N<=2000000000)所以很容易超时,所以暴力搜索会超时,我们只要把2和3的倍数相加再减去重复的就行了。

【解题反思】这题看似简单,但是也要进行优化,稍不留神就超时了。

【样例程序】#include<iostream>#include<fstream>using namespace std;long long n,s;int main(){freopen("luck.in","r",stdin);freopen("luck.out","w",stdout);cin>>n;cout<<n/2+n/3-n/6; //n/2是指所有2的倍数,n/3是指所有三的倍数。

return 0; // n/6是指重复的2和3的倍数。

所以要减去它。

}第三题排名(rank)【题意概括】有两头奶牛(A奶牛和B奶牛)的信息学比赛成绩,现在要为它们排名,排名规则是:1、总分高的排在前面。

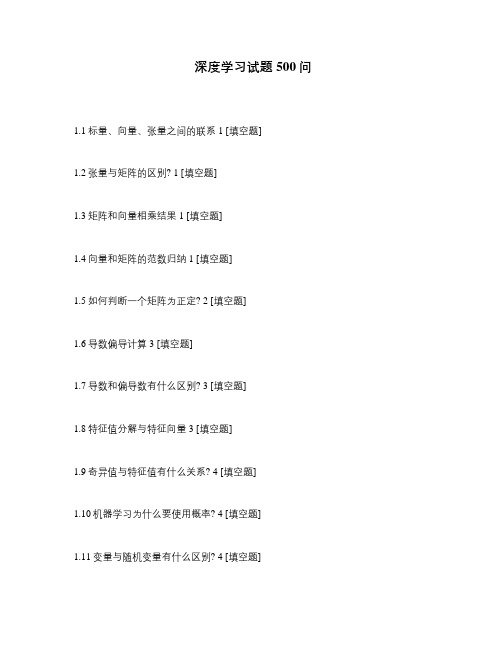

深度学习试题500问1.1标量、向量、张量之间的联系 1 [填空题]_________________________________1.2张量与矩阵的区别? 1 [填空题]_________________________________1.3矩阵和向量相乘结果 1 [填空题]_________________________________1.4向量和矩阵的范数归纳 1 [填空题]_________________________________1.5如何判断一个矩阵为正定? 2 [填空题]_________________________________1.6导数偏导计算 3 [填空题]_________________________________1.7导数和偏导数有什么区别? 3 [填空题]_________________________________1.8特征值分解与特征向量 3 [填空题]_________________________________1.9奇异值与特征值有什么关系? 4 [填空题]_________________________________1.10机器学习为什么要使用概率? 4 [填空题]_________________________________1.11变量与随机变量有什么区别? 4 [填空题]_________________________________1.12常见概率分布? 5 [填空题]_________________________________1.13举例理解条件概率 9 [填空题]_________________________________1.14联合概率与边缘概率联系区别? 10 [填空题]_________________________________1.15条件概率的链式法则 10 [填空题]_________________________________1.16独立性和条件独立性 11 [填空题]_________________________________1.17期望、方差、协方差、相关系数总结 11 [填空题] *_________________________________2.1 各种常见算法图示 14 [填空题]_________________________________2.2监督学习、非监督学习、半监督学习、弱监督学习? 15 [填空题] _________________________________2.3 监督学习有哪些步骤 16 [填空题]_________________________________2.4 多实例学习? 17 [填空题]_________________________________2.5 分类网络和回归的区别? 17 [填空题]_________________________________2.6 什么是神经网络? 17 [填空题]_________________________________2.7 常用分类算法的优缺点? 18 [填空题]_________________________________2.8 正确率能很好的评估分类算法吗? 20 [填空题]_________________________________2.9 分类算法的评估方法? 20 [填空题]_________________________________2.10 什么样的分类器是最好的? 22 [填空题]_________________________________2.11大数据与深度学习的关系 22 [填空题]_________________________________2.12 理解局部最优与全局最优 23 [填空题]_________________________________2.13 理解逻辑回归 24 [填空题]_________________________________2.14 逻辑回归与朴素贝叶斯有什么区别? 24 [填空题] _________________________________2.15 为什么需要代价函数? 25 [填空题]_________________________________2.16 代价函数作用原理 25 [填空题]_________________________________2.17 为什么代价函数要非负? 26 [填空题]_________________________________2.18 常见代价函数? 26 [填空题]_________________________________2.19为什么用交叉熵代替二次代价函数 28 [填空题]_________________________________2.20 什么是损失函数? 28 [填空题]_________________________________2.21 常见的损失函数 28 [填空题]_________________________________2.22 逻辑回归为什么使用对数损失函数? 30 [填空题] _________________________________0.00 对数损失函数是如何度量损失的? 31 [填空题] _________________________________2.23 机器学习中为什么需要梯度下降? 32 [填空题] _________________________________2.24 梯度下降法缺点? 32 [填空题]_________________________________2.25 梯度下降法直观理解? 32 [填空题]_________________________________2.23 梯度下降法算法描述? 33 [填空题]_________________________________2.24 如何对梯度下降法进行调优? 35 [填空题]_________________________________2.25 随机梯度和批量梯度区别? 35 [填空题]_________________________________2.26 各种梯度下降法性能比较 37 [填空题]_________________________________2.27计算图的导数计算图解? 37 [填空题]_________________________________2.28 线性判别分析(LDA)思想总结 39 [填空题] _________________________________2.29 图解LDA核心思想 39 [填空题]_________________________________2.30 二类LDA算法原理? 40 [填空题]_________________________________2.30 LDA算法流程总结? 41 [填空题]_________________________________2.31 LDA和PCA区别? 41 [填空题]_________________________________2.32 LDA优缺点? 41 [填空题]_________________________________2.33 主成分分析(PCA)思想总结 42 [填空题] _________________________________2.34 图解PCA核心思想 42 [填空题]_________________________________2.35 PCA算法推理 43 [填空题]_________________________________2.36 PCA算法流程总结 44 [填空题]_________________________________2.37 PCA算法主要优缺点 45 [填空题]_________________________________2.38 降维的必要性及目的 45 [填空题]_________________________________2.39 KPCA与PCA的区别? 46 [填空题]_________________________________2.40模型评估 47 [填空题]_________________________________2.40.1模型评估常用方法? 47 [填空题]_________________________________2.40.2 经验误差与泛化误差 47 [填空题]_________________________________2.40.3 图解欠拟合、过拟合 48 [填空题]_________________________________2.40.4 如何解决过拟合与欠拟合? 49 [填空题] _________________________________2.40.5 交叉验证的主要作用? 50 [填空题]_________________________________2.40.6 k折交叉验证? 50 [填空题]_________________________________2.40.7 混淆矩阵 50 [填空题]_________________________________2.40.8 错误率及精度 51 [填空题]_________________________________2.40.9 查准率与查全率 51 [填空题]_________________________________2.40.10 ROC与AUC 52 [填空题]_________________________________2.40.11如何画ROC曲线? 53 [填空题]_________________________________2.40.12如何计算TPR,FPR? 54 [填空题]_________________________________2.40.13如何计算Auc? 56 [填空题]_________________________________2.40.14为什么使用Roc和Auc评价分类器? 56 [填空题]_________________________________2.40.15 直观理解AUC 56 [填空题]_________________________________2.40.16 代价敏感错误率与代价曲线 57 [填空题]_________________________________2.40.17 模型有哪些比较检验方法 59 [填空题]_________________________________2.40.18 偏差与方差 59 [填空题]_________________________________2.40.19为什么使用标准差? 60 [填空题]_________________________________2.40.20 点估计思想 61 [填空题]_________________________________2.40.21 点估计优良性原则? 61 [填空题]_________________________________2.40.22点估计、区间估计、中心极限定理之间的联系? 62 [填空题] _________________________________2.40.23 类别不平衡产生原因? 62 [填空题]_________________________________2.40.24 常见的类别不平衡问题解决方法 62 [填空题] _________________________________2.41 决策树 64 [填空题]_________________________________2.41.1 决策树的基本原理 64 [填空题]_________________________________2.41.2 决策树的三要素? 64 [填空题]_________________________________2.41.3 决策树学习基本算法 65 [填空题]_________________________________2.41.4 决策树算法优缺点 65 [填空题]_________________________________2.40.5熵的概念以及理解 66 [填空题]_________________________________2.40.6 信息增益的理解 66 [填空题]_________________________________2.40.7 剪枝处理的作用及策略? 67 [填空题]_________________________________2.41 支持向量机 67 [填空题]_________________________________2.41.1 什么是支持向量机 67 [填空题]_________________________________2.25.2 支持向量机解决的问题? 68 [填空题]_________________________________2.25.2 核函数作用? 69 [填空题]_________________________________2.25.3 对偶问题 69 [填空题]_________________________________2.25.4 理解支持向量回归 69 [填空题]_________________________________2.25.5 理解SVM(核函数) 69 [填空题]_________________________________2.25.6 常见的核函数有哪些? 69 [填空题]_________________________________2.25.6 软间隔与正则化 73 [填空题]_________________________________2.25.7 SVM主要特点及缺点? 73 [填空题]_________________________________2.26 贝叶斯 74 [填空题]_________________________________2.26.1 图解极大似然估计 74 [填空题]_________________________________2.26.2 朴素贝叶斯分类器和一般的贝叶斯分类器有什么区别? 76 [填空题] _________________________________2.26.4 朴素与半朴素贝叶斯分类器 76 [填空题]_________________________________2.26.5 贝叶斯网三种典型结构 76 [填空题]_________________________________2.26.6 什么是贝叶斯错误率 76 [填空题]_________________________________2.26.7 什么是贝叶斯最优错误率 76 [填空题]_________________________________2.27 EM算法解决问题及实现流程 76 [填空题] _________________________________2.28 为什么会产生维数灾难? 78 [填空题]_________________________________2.29怎样避免维数灾难 82 [填空题]_________________________________2.30聚类和降维有什么区别与联系? 82 [填空题] _________________________________2.31 GBDT和随机森林的区别 83 [填空题]_________________________________2.32 四种聚类方法之比较 84 [填空题] *_________________________________3.1基本概念 88 [填空题]_________________________________3.1.1神经网络组成? 88 [填空题]_________________________________3.1.2神经网络有哪些常用模型结构? 90 [填空题] _________________________________3.1.3如何选择深度学习开发平台? 92 [填空题] _________________________________3.1.4为什么使用深层表示 92 [填空题]_________________________________3.1.5为什么深层神经网络难以训练? 93 [填空题]_________________________________3.1.6深度学习和机器学习有什么不同 94 [填空题]_________________________________3.2 网络操作与计算 95 [填空题]_________________________________3.2.1前向传播与反向传播? 95 [填空题]_________________________________3.2.2如何计算神经网络的输出? 97 [填空题]_________________________________3.2.3如何计算卷积神经网络输出值? 98 [填空题]_________________________________3.2.4如何计算Pooling层输出值输出值? 101 [填空题] _________________________________3.2.5实例理解反向传播 102 [填空题]_________________________________3.3超参数 105 [填空题]_________________________________3.3.1什么是超参数? 105 [填空题]_________________________________3.3.2如何寻找超参数的最优值? 105 [填空题]_________________________________3.3.3超参数搜索一般过程? 106 [填空题]_________________________________3.4激活函数 106 [填空题]_________________________________3.4.1为什么需要非线性激活函数? 106 [填空题]_________________________________3.4.2常见的激活函数及图像 107 [填空题]_________________________________3.4.3 常见激活函数的导数计算? 109 [填空题]_________________________________3.4.4激活函数有哪些性质? 110 [填空题]_________________________________3.4.5 如何选择激活函数? 110 [填空题]_________________________________3.4.6使用ReLu激活函数的优点? 111 [填空题]_________________________________3.4.7什么时候可以用线性激活函数? 111 [填空题]_________________________________3.4.8怎样理解Relu(<0时)是非线性激活函数? 111 [填空题] _________________________________3.4.9 Softmax函数如何应用于多分类? 112 [填空题]_________________________________3.5 Batch_Size 113 [填空题]_________________________________3.5.1为什么需要Batch_Size? 113 [填空题]_________________________________3.5.2 Batch_Size值的选择 114 [填空题]_________________________________3.5.3在合理范围内,增大 Batch_Size 有何好处? 114 [填空题] _________________________________3.5.4盲目增大 Batch_Size 有何坏处? 114 [填空题]_________________________________3.5.5调节 Batch_Size 对训练效果影响到底如何? 114 [填空题] _________________________________3.6 归一化 115 [填空题]_________________________________3.6.1归一化含义? 115 [填空题]_________________________________3.6.2为什么要归一化 115 [填空题]_________________________________3.6.3为什么归一化能提高求解最优解速度? 115 [填空题]_________________________________3.6.4 3D图解未归一化 116 [填空题]_________________________________3.6.5归一化有哪些类型? 117 [填空题]_________________________________3.6.6局部响应归一化作用 117 [填空题]_________________________________3.6.7理解局部响应归一化公式 117 [填空题]_________________________________3.6.8什么是批归一化(Batch Normalization) 118 [填空题] _________________________________3.6.9批归一化(BN)算法的优点 119 [填空题]_________________________________3.6.10批归一化(BN)算法流程 119 [填空题]_________________________________3.6.11批归一化和群组归一化 120 [填空题]_________________________________3.6.12 Weight Normalization和Batch Normalization 120 [填空题] _________________________________3.7 预训练与微调(fine tuning) 121 [填空题]_________________________________3.7.1为什么无监督预训练可以帮助深度学习? 121 [填空题]_________________________________3.7.2什么是模型微调fine tuning 121 [填空题]_________________________________3.7.3微调时候网络参数是否更新? 122 [填空题]_________________________________3.7.4 fine-tuning模型的三种状态 122 [填空题]_________________________________3.8权重偏差初始化 122 [填空题]_________________________________3.8.1 全都初始化为0 122 [填空题]_________________________________3.8.2 全都初始化为同样的值 123 [填空题]_________________________________3.8.3 初始化为小的随机数 124 [填空题]_________________________________3.8.4用1/sqrt(n)校准方差 125 [填空题]_________________________________3.8.5稀疏初始化(Sparse Initialazation) 125 [填空题]_________________________________3.8.6初始化偏差 125 [填空题]_________________________________3.9 Softmax 126 [填空题]_________________________________3.9.1 Softmax定义及作用 126 [填空题]_________________________________3.9.2 Softmax推导 126 [填空题]_________________________________3.10 理解One Hot Encodeing原理及作用? 126 [填空题] _________________________________3.11 常用的优化器有哪些 127 [填空题]_________________________________3.12 Dropout 系列问题 128 [填空题]_________________________________3.12.1 dropout率的选择 128 [填空题]_________________________________3.27 Padding 系列问题 128 [填空题] *_________________________________4.1LetNet5 129 [填空题]_________________________________ 4.1.1模型结构 129 [填空题]_________________________________ 4.1.2模型结构 129 [填空题]_________________________________ 4.1.3 模型特性 131 [填空题]_________________________________ 4.2 AlexNet 131 [填空题]_________________________________ 4.2.1 模型结构 131 [填空题]_________________________________ 4.2.2模型解读 131 [填空题]_________________________________ 4.2.3模型特性 135 [填空题]_________________________________ 4.3 可视化ZFNet-解卷积 135 [填空题] _________________________________ 4.3.1 基本的思想及其过程 135 [填空题] _________________________________ 4.3.2 卷积与解卷积 136 [填空题]_________________________________ 4.3.3卷积可视化 137 [填空题]_________________________________ 4.3.4 ZFNe和AlexNet比较 139 [填空题] _________________________________4.4 VGG 140 [填空题]_________________________________ 4.1.1 模型结构 140 [填空题]_________________________________ 4.1.2 模型特点 140 [填空题]_________________________________ 4.5 Network in Network 141 [填空题] _________________________________ 4.5.1 模型结构 141 [填空题]_________________________________ 4.5.2 模型创新点 141 [填空题]_________________________________ 4.6 GoogleNet 143 [填空题]_________________________________ 4.6.1 模型结构 143 [填空题]_________________________________ 4.6.2 Inception 结构 145 [填空题]_________________________________ 4.6.3 模型层次关系 146 [填空题]_________________________________ 4.7 Inception 系列 148 [填空题]_________________________________ 4.7.1 Inception v1 148 [填空题]_________________________________4.7.2 Inception v2 150 [填空题]_________________________________4.7.3 Inception v3 153 [填空题]_________________________________4.7.4 Inception V4 155 [填空题]_________________________________4.7.5 Inception-ResNet-v2 157 [填空题]_________________________________4.8 ResNet及其变体 158 [填空题]_________________________________4.8.1重新审视ResNet 159 [填空题]_________________________________4.8.2残差块 160 [填空题]_________________________________4.8.3 ResNet架构 162 [填空题]_________________________________4.8.4残差块的变体 162 [填空题]_________________________________4.8.5 ResNeXt 162 [填空题]_________________________________4.8.6 Densely Connected CNN 164 [填空题]_________________________________4.8.7 ResNet作为小型网络的组合 165 [填空题] _________________________________4.8.8 ResNet中路径的特点 166 [填空题]4.9为什么现在的CNN模型都是在GoogleNet、VGGNet或者AlexNet上调整的? 167 [填空题] *_________________________________5.1 卷积神经网络的组成层 170 [填空题]_________________________________5.2 卷积如何检测边缘信息? 171 [填空题]_________________________________5.2 卷积的几个基本定义? 174 [填空题]_________________________________5.2.1卷积核大小 174 [填空题]_________________________________5.2.2卷积核的步长 174 [填空题]_________________________________5.2.3边缘填充 174 [填空题]_________________________________5.2.4输入和输出通道 174 [填空题]_________________________________5.3 卷积网络类型分类? 174 [填空题]_________________________________5.3.1普通卷积 174 [填空题]_________________________________5.3.2扩张卷积 175 [填空题]_________________________________5.3.3转置卷积 176 [填空题]5.3.4可分离卷积 177 [填空题]_________________________________5.3 图解12种不同类型的2D卷积? 178 [填空题]_________________________________5.4 2D卷积与3D卷积有什么区别? 181 [填空题]_________________________________5.4.1 2D 卷积 181 [填空题]_________________________________5.4.2 3D卷积 182 [填空题]_________________________________5.5 有哪些池化方法? 183 [填空题]_________________________________5.5.1一般池化(General Pooling) 183 [填空题]_________________________________5.5.2重叠池化(OverlappingPooling) 184 [填空题]_________________________________5.5.3空金字塔池化(Spatial Pyramid Pooling) 184 [填空题] _________________________________5.6 1x1卷积作用? 186 [填空题]_________________________________5.7卷积层和池化层有什么区别? 187 [填空题]_________________________________5.8卷积核一定越大越好? 189 [填空题]_________________________________5.9每层卷积只能用一种尺寸的卷积核? 189 [填空题]_________________________________5.10怎样才能减少卷积层参数量? 190 [填空题]_________________________________5.11卷积操作时必须同时考虑通道和区域吗? 191 [填空题]_________________________________5.12采用宽卷积的好处有什么? 192 [填空题]_________________________________5.12.1窄卷积和宽卷积 192 [填空题]_________________________________5.12.2 为什么采用宽卷积? 192 [填空题]_________________________________5.13卷积层输出的深度与哪个部件的个数相同? 192 [填空题]_________________________________5.14 如何得到卷积层输出的深度? 193 [填空题]_________________________________5.15激活函数通常放在卷积神经网络的那个操作之后? 194 [填空题] _________________________________5.16 如何理解最大池化层有几分缩小? 194 [填空题]_________________________________5.17理解图像卷积与反卷积 194 [填空题]_________________________________5.17.1图像卷积 194 [填空题]_________________________________5.17.2图像反卷积 196 [填空题]_________________________________5.18不同卷积后图像大小计算? 198 [填空题]_________________________________5.18.1 类型划分 198 [填空题]_________________________________5.18.2 计算公式 199 [填空题]_________________________________5.19 步长、填充大小与输入输出关系总结? 199 [填空题] _________________________________5.19.1没有0填充,单位步长 200 [填空题]_________________________________5.19.2零填充,单位步长 200 [填空题]_________________________________5.19.3不填充,非单位步长 202 [填空题]_________________________________5.19.4零填充,非单位步长 202 [填空题]_________________________________5.20 理解反卷积和棋盘效应 204 [填空题]_________________________________5.20.1为什么出现棋盘现象? 204 [填空题]_________________________________5.20.2 有哪些方法可以避免棋盘效应? 205 [填空题]_________________________________5.21 CNN主要的计算瓶颈? 207 [填空题]_________________________________5.22 CNN的参数经验设置 207 [填空题]_________________________________5.23 提高泛化能力的方法总结 208 [填空题]_________________________________5.23.1 主要方法 208 [填空题]_________________________________5.23.2 实验证明 208 [填空题]_________________________________5.24 CNN在CV与NLP领域运用的联系与区别? 213 [填空题] _________________________________5.24.1联系 213 [填空题]_________________________________5.24.2区别 213 [填空题]_________________________________5.25 CNN凸显共性的手段? 213 [填空题]_________________________________5.25.1 局部连接 213 [填空题]_________________________________5.25.2 权值共享 214 [填空题]_________________________________5.25.3 池化操作 215 [填空题]_________________________________5.26 全卷积与Local-Conv的异同点 215 [填空题]_________________________________5.27 举例理解Local-Conv的作用 215 [填空题]_________________________________5.28 简述卷积神经网络进化史 216 [填空题] *_________________________________6.1 RNNs和FNNs有什么区别? 218 [填空题]_________________________________6.2 RNNs典型特点? 218 [填空题]_________________________________6.3 RNNs能干什么? 219 [填空题]_________________________________6.4 RNNs在NLP中典型应用? 220 [填空题]_________________________________6.5 RNNs训练和传统ANN训练异同点? 220 [填空题] _________________________________6.6常见的RNNs扩展和改进模型 221 [填空题]_________________________________6.6.1 Simple RNNs(SRNs) 221 [填空题]_________________________________6.6.2 Bidirectional RNNs 221 [填空题]_________________________________6.6.3 Deep(Bidirectional) RNNs 222 [填空题]_________________________________6.6.4 Echo State Networks(ESNs) 222 [填空题]_________________________________6.6.5 Gated Recurrent Unit Recurrent Neural Networks 224 [填空题] _________________________________6.6.6 LSTM Netwoorks 224 [填空题]_________________________________6.6.7 Clockwork RNNs(CW-RNNs) 225 [填空题] *_________________________________7.1基于候选区域的目标检测器 228 [填空题]_________________________________7.1.1滑动窗口检测器 228 [填空题]_________________________________7.1.2选择性搜索 229 [填空题]_________________________________7.1.3 R-CNN 230 [填空题]_________________________________7.1.4边界框回归器 230 [填空题]_________________________________7.1.5 Fast R-CNN 231 [填空题]_________________________________7.1.6 ROI 池化 233 [填空题]_________________________________7.1.7 Faster R-CNN 233 [填空题]_________________________________7.1.8候选区域网络 234 [填空题]_________________________________7.1.9 R-CNN 方法的性能 236 [填空题]_________________________________7.2 基于区域的全卷积神经网络(R-FCN) 237 [填空题] _________________________________7.3 单次目标检测器 240 [填空题]_________________________________7.3.1单次检测器 241 [填空题]_________________________________7.3.2滑动窗口进行预测 241 [填空题]_________________________________7.3.3 SSD 243 [填空题]_________________________________7.4 YOLO系列 244 [填空题]_________________________________7.4.1 YOLOv1介绍 244 [填空题]_________________________________7.4.2 YOLOv1模型优缺点? 252 [填空题]_________________________________7.4.3 YOLOv2 253 [填空题]_________________________________7.4.4 YOLOv2改进策略 254 [填空题]_________________________________7.4.5 YOLOv2的训练 261 [填空题]_________________________________7.4.6 YOLO9000 261 [填空题]_________________________________7.4.7 YOLOv3 263 [填空题]_________________________________8.1 传统的基于CNN的分割方法缺点? 269 [填空题]_________________________________8.1 FCN 269 [填空题]_________________________________8.1.1 FCN改变了什么? 269 [填空题]_________________________________8.1.2 FCN网络结构? 270 [填空题]_________________________________8.1.3全卷积网络举例? 271 [填空题]_________________________________8.1.4为什么CNN对像素级别的分类很难? 271 [填空题]_________________________________8.1.5全连接层和卷积层如何相互转化? 272 [填空题]_________________________________8.1.6 FCN的输入图片为什么可以是任意大小? 272 [填空题]_________________________________8.1.7把全连接层的权重W重塑成卷积层的滤波器有什么好处? 273 [填空题] _________________________________8.1.8反卷积层理解 275 [填空题]_________________________________8.1.9跳级(skip)结构 276 [填空题]_________________________________8.1.10模型训练 277 [填空题]_________________________________8.1.11 FCN缺点 280 [填空题]_________________________________8.2 U-Net 280 [填空题]_________________________________8.3 SegNet 282 [填空题]_________________________________8.4空洞卷积(Dilated Convolutions) 283 [填空题] _________________________________8.4 RefineNet 285 [填空题]_________________________________8.5 PSPNet 286 [填空题]_________________________________8.6 DeepLab系列 288 [填空题]_________________________________8.6.1 DeepLabv1 288 [填空题]_________________________________8.6.2 DeepLabv2 289 [填空题]_________________________________8.6.3 DeepLabv3 289 [填空题]_________________________________8.6.4 DeepLabv3+ 290 [填空题]_________________________________8.7 Mask-R-CNN 293 [填空题]_________________________________8.7.1 Mask-RCNN 的网络结构示意图 293 [填空题]_________________________________8.7.2 RCNN行人检测框架 293 [填空题]_________________________________8.7.3 Mask-RCNN 技术要点 294 [填空题]_________________________________8.8 CNN在基于弱监督学习的图像分割中的应用 295 [填空题] _________________________________8.8.1 Scribble标记 295 [填空题]_________________________________8.8.2 图像级别标记 297 [填空题]_________________________________8.8.3 DeepLab+bounding box+image-level labels 298 [填空题]_________________________________8.8.4统一的框架 299 [填空题] *_________________________________9.1强化学习的主要特点? 301 [填空题]_________________________________9.2强化学习应用实例 302 [填空题]_________________________________9.3强化学习和监督式学习、非监督式学习的区别 303 [填空题] _________________________________9.4 强化学习主要有哪些算法? 305 [填空题]_________________________________9.5深度迁移强化学习算法 305 [填空题]_________________________________9.6分层深度强化学习算法 306 [填空题]_________________________________9.7深度记忆强化学习算法 306 [填空题]_________________________________9.8 多智能体深度强化学习算法 307 [填空题]_________________________________9.9深度强化学习算法小结 307 [填空题] *_________________________________10.1 什么是迁移学习? 309 [填空题]_________________________________10.2 什么是多任务学习? 309 [填空题]_________________________________10.3 多任务学习有什么意义? 309 [填空题]_________________________________10.4 什么是端到端的深度学习? 311 [填空题]_________________________________10.5 端到端的深度学习举例? 311 [填空题]_________________________________10.6 端到端的深度学习有什么挑战? 311 [填空题] _________________________________10.7 端到端的深度学习优缺点? 312 [填空题] *_________________________________13.1 CPU和GPU 的区别? 314 [填空题]_________________________________13.2如何解决训练样本少的问题 315 [填空题]_________________________________13.3 什么样的样本集不适合用深度学习? 315 [填空题]_________________________________13.4 有没有可能找到比已知算法更好的算法? 316 [填空题]_________________________________13.5 何为共线性, 跟过拟合有啥关联? 316 [填空题]_________________________________13.6 广义线性模型是怎被应用在深度学习中? 316 [填空题]_________________________________13.7 造成梯度消失的原因? 317 [填空题]_________________________________13.8 权值初始化方法有哪些 317 [填空题]_________________________________13.9 启发式优化算法中,如何避免陷入局部最优解? 318 [填空题]_________________________________13.10 凸优化中如何改进GD方法以防止陷入局部最优解 319 [填空题] _________________________________13.11 常见的损失函数? 319 [填空题]_________________________________13.14 如何进行特征选择(feature selection)? 321 [填空题]_________________________________13.14.1 如何考虑特征选择 321 [填空题]_________________________________13.14.2 特征选择方法分类 321 [填空题]_________________________________13.14.3 特征选择目的 322 [填空题]_________________________________13.15 梯度消失/梯度爆炸原因,以及解决方法 322 [填空题]_________________________________13.15.1 为什么要使用梯度更新规则? 322 [填空题]_________________________________13.15.2 梯度消失、爆炸原因? 323 [填空题]_________________________________13.15.3 梯度消失、爆炸的解决方案 324 [填空题]_________________________________13.16 深度学习为什么不用二阶优化 325 [填空题]_________________________________13.17 怎样优化你的深度学习系统? 326 [填空题]_________________________________13.18为什么要设置单一数字评估指标? 326 [填空题]_________________________________13.19满足和优化指标(Satisficing and optimizing metrics) 327 [填空题] _________________________________13.20 怎样划分训练/开发/测试集 328 [填空题]_________________________________13.21如何划分开发/测试集大小 329 [填空题]_________________________________13.22什么时候该改变开发/测试集和指标? 329 [填空题]_________________________________13.23 设置评估指标的意义? 330 [填空题]_________________________________13.24 什么是可避免偏差? 331 [填空题]_________________________________13.25 什么是TOP5错误率? 331 [填空题]_________________________________13.26 什么是人类水平错误率? 332 [填空题]_________________________________13.27 可避免偏差、几大错误率之间的关系? 332 [填空题] _________________________________13.28 怎样选取可避免偏差及贝叶斯错误率? 332 [填空题] _________________________________13.29 怎样减少方差? 333 [填空题]_________________________________13.30贝叶斯错误率的最佳估计 333 [填空题]_________________________________13.31举机器学习超过单个人类表现几个例子? 334 [填空题] _________________________________13.32如何改善你的模型? 334 [填空题]_________________________________13.33 理解误差分析 335 [填空题]_________________________________13.34 为什么值得花时间查看错误标记数据? 336 [填空题] _________________________________13.35 快速搭建初始系统的意义? 336 [填空题]_________________________________13.36 为什么要在不同的划分上训练及测试? 337 [填空题] _________________________________13.37 如何解决数据不匹配问题? 338 [填空题]_________________________________13.38 梯度检验注意事项? 340 [填空题]_________________________________13.39什么是随机梯度下降? 341 [填空题]_________________________________13.40什么是批量梯度下降? 341 [填空题]_________________________________13.41什么是小批量梯度下降? 341 [填空题]_________________________________13.42怎么配置mini-batch梯度下降 342 [填空题]_________________________________13.43 局部最优的问题 343 [填空题]_________________________________13.44提升算法性能思路 346 [填空题] *_________________________________14.1 调试处理 358 [填空题]_________________________________14.2 有哪些超参数 359 [填空题]_________________________________14.3 如何选择调试值? 359 [填空题]_________________________________14.4 为超参数选择合适的范围 359 [填空题]_________________________________14.5 如何搜索超参数? 359 [填空题] *_________________________________15.1 什么是正则化? 361 [填空题]_________________________________15.2 正则化原理? 361 [填空题]_________________________________15.3 为什么要正则化? 361 [填空题]_________________________________15.4 为什么正则化有利于预防过拟合? 361 [填空题] _________________________________15.5 为什么正则化可以减少方差? 362 [填空题]_________________________________15.6 L2正则化的理解? 362 [填空题]_________________________________15.7 理解dropout 正则化 362 [填空题]_________________________________15.8 有哪些dropout 正则化方法? 362 [填空题]_________________________________15.8 如何实施dropout 正则化 363 [填空题]_________________________________。

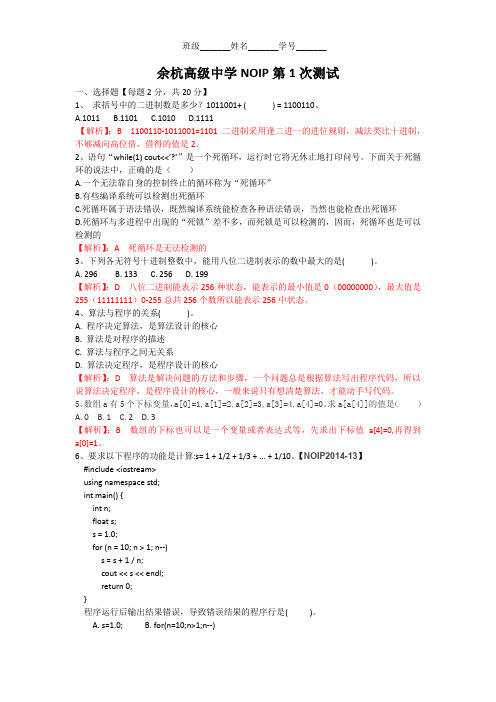

余杭高级中学NOIP第1次测试一、选择题【每题2分,共20分】1、求括号中的二进制数是多少?1011001+ ( ) = 1100110。

A.1011B.1101C.1010D.1111【解析】:B 1100110-1011001=1101 二进制采用逢二进一的进位规则,减法类比十进制,不够减向高位借,借得的值是2。

2、语句“while(1) cout<<’?’”是一个死循环,运行时它将无休止地打印问号。

下面关于死循环的说法中,正确的是()A.一个无法靠自身的控制终止的循环称为“死循环”B.有些编译系统可以检测出死循环C.死循环属于语法错误,既然编译系统能检查各种语法错误,当然也能检查出死循环D.死循环与多进程中出现的“死锁”差不多,而死锁是可以检测的,因而,死循环也是可以检测的【解析】:A 死循环是无法检测的3、下列各无符号十进制整数中,能用八位二进制表示的数中最大的是( )。

A. 296B. 133C. 256D. 199【解析】:D 八位二进制能表示256种状态,能表示的最小值是0(00000000),最大值是255(11111111)0-255总共256个数所以能表示256中状态。

4、算法与程序的关系( )。

A. 程序决定算法,是算法设计的核心B. 算法是对程序的描述C. 算法与程序之间无关系D. 算法决定程序,是程序设计的核心【解析】:D 算法是解决问题的方法和步骤,一个问题总是根据算法写出程序代码,所以说算法决定程序,是程序设计的核心,一般来说只有想清楚算法,才能动手写代码。

5、数组a有5个下标变量,a[0]=1,a[1]=2,a[2]=3,a[3]=4,a[4]=0。

求a[a[4]]的值是()A. 0B. 1C. 2D. 3【解析】:B 数组的下标也可以是一个变量或者表达式等,先求出下标值a[4]=0,再得到a[0]=1。

6、要求以下程序的功能是计算:s= 1 + 1/2 + 1/3 + ... + 1/10。

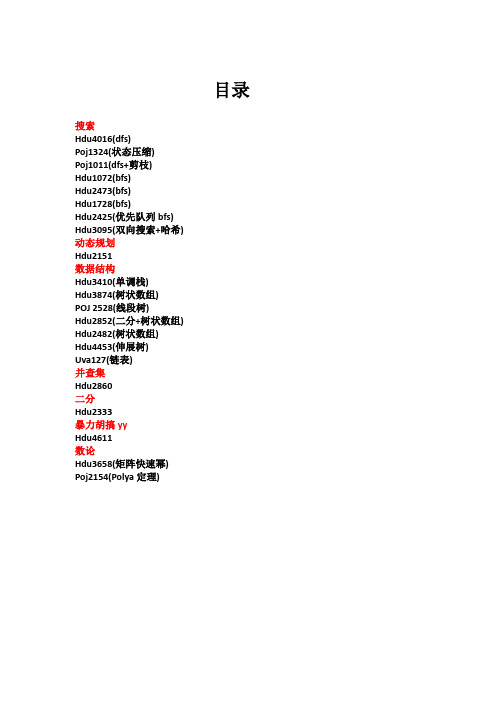

目录搜索Hdu4016(dfs)Poj1324(状态压缩)Poj1011(dfs+剪枝)Hdu1072(bfs)Hdu2473(bfs)Hdu1728(bfs)Hdu2425(优先队列bfs)Hdu3095(双向搜索+哈希)动态规划Hdu2151数据结构Hdu3410(单调栈)Hdu3874(树状数组)POJ 2528(线段树)Hdu2852(二分+树状数组)Hdu2482(树状数组)Hdu4453(伸展树)Uva127(链表)并查集Hdu2860二分Hdu2333暴力胡搞yyHdu4611数论Hdu3658(矩阵快速幂)Poj2154(Polya定理)搜索Hdu4016 Magic Bitwise And Operation题意:给n个最多2^60的数,求其中m个的最小与(&)和思路:关键在于与运算的规律:一个数不断参与与运算一定是越变越小另外要注意的并不一定前m小的数的与和最小,例子:(二进制)1011,0011,1100所以这题是dfs加剪枝剪枝:1. 一边dfs一边更新ans,因为ans不可能变大2. 当当前值与剩余数的与和作与运算的结果大于ans,说明参与与运算到最后肯定大于等于ans注意点:一开始需要对当前值赋值,只有用数的二进制表示的位里全为1的数才不会影响后面的计算,即最大值=0x7fffffffffffffff;代码(借鉴了别人的写法,其实用循环写dfs也行):#include<iostream>#include<cstdio>#include<cstdlib>#include<string>#include<iomanip>#include<cmath>#include<cstring>#include<algorithm>#include<stack>#include<queue>#include<vector>#include<set>#include<map>using namespace std;//A B D E K L G Jtypedef long longll;constint MAXN = 60;constll INF=0x7fffffffffffffff;llorig[MAXN],str[MAXN];llans;int n, m;bool cmp(lla,ll b){return a<b;}void dfs(intnum,intpos,llval){if(ans>val)ans=val;if(num==m||pos==n)return;if((val&str[pos])>=ans)return;dfs(num+1,pos+1,(val&orig[pos]));dfs(num,pos+1,val);}intmain(){int T;scanf("%d",&T);for(int t=1;t<=T;t++){scanf("%d%d",&n,&m);//memset(str,0,sizeof str);for (inti = 0; i< n; i++){scanf("%lld", &orig[i]);}sort(orig,orig+n,cmp);str[n-1]=orig[n-1];for(inti=n-2;i>=0;i--)str[i]=(str[i+1]&orig[i]);ans=INF;dfs(0,0,INF);printf("Case #%d: %lld\n",t,ans);}return 0;}POJ 1324Holedox Moving这是一道很有意义的题(对我而言),它帮我更好的理解了我一直恐惧的状态压缩题意:给出蛇头和蛇身(蛇身分为若干节,用坐标连起来,当然蛇头也是一个坐标)给出终点坐标,障碍物坐标,问蛇能不能到达终点(蛇头到达)分析:蛇身的移动是根据蛇头来的,所以以蛇头进行BFS搜索,我最初很单纯的用二维vis将蛇头走过的点标记,然后使劲wa,后来问了某大厦才顿悟,蛇头在同一点但是蛇身可能不同啊,这样引起的结果就不同,也就是说,vis数组还需要将整个蛇身保存下来!!!怎么保存?把蛇占据的坐标全部记录下来?那太不现实了!当我们模拟蛇移动的时候会发现,假设将蛇身分为0,1,2...i....节,那么在蛇移动的过程中,第i节将走的原本第i-1节的位置(设蛇头为0),反正意思就是是跟着蛇头走的这点可以利用试想,如果我们有蛇头的坐标,和每一节蛇身的方向,能不能确定蛇身,显然是可以的!为什么这样记录呢,蛇身的坐标可选太多了,而蛇身移动的方向只有4个蛇身也不长,所以完全可以用四进制记录蛇身,四进制的话每一位可以有0,1,2,3四个数字,就可以很好的描述四个方向之所以说这题让我不再恐惧状压是因为,我发现其实所谓的二进制,完全可以看成一个数组,比如01101010就可以看成长度为8的数组a,a[0] = 0,a[1] = 1,a[2] = 1...这个特殊的数组保存了每个物品的状态,并用一个十进制数保存下来,比正常的数组更省空间,而要用好这个数组关键在于如何从数组中取元素,如何将更新后的值重新构建成新的数组这就是要用各种逻辑运算符了。

一、选择题1.在进行模型训练前,数据预处理的主要目的是什么?A.提高模型的准确率B.减少模型训练时间C.使数据集更符合实际业务需求D.以上都是(答案)2.下列哪项不是特征工程中的常见方法?A.数据归一化B.类别特征编码C.数据增强D.缺失值处理(答案)3.在深度学习中,为了防止过拟合,可以采取以下哪种策略?A.增加模型复杂度B.减少训练数据C.使用Dropout技术(答案)D.提高学习率4.下列哪个算法属于监督学习?A.K-means聚类B.主成分分析(PCA)C.支持向量机(SVM)(答案)D.DBSCAN5.在训练神经网络时,损失函数(loss function)的作用是?A.评估模型的预测误差(答案)B.决定模型的结构C.控制训练的速度D.决定数据的分割方式6.下列哪项技术常用于处理序列数据,如文本或时间序列?A.卷积神经网络(CNN)B.循环神经网络(RNN)(答案)C.生成对抗网络(GAN)D.深度信念网络(DBN)7.在模型评估阶段,准确率(Accuracy)高但召回率(Recall)低,可能表明模型存在什么问题?A.模型过于复杂B.类别不平衡问题(答案)C.训练数据不足D.过拟合8.以下哪种方法可以用来优化神经网络的超参数?A.梯度下降法B.网格搜索(答案)C.反向传播D.批量归一化9.在进行模型部署时,以下哪项不是常见的考虑因素?A.模型的推理速度B.模型的存储需求C.模型的训练时间(答案)D.模型的可解释性10.对于不平衡数据集,以下哪种策略可能有助于改善模型的性能?A.欠采样多数类(答案)B.过采样少数类C.增加数据集的大小D.以上都是。

(完整word版)机器学习练习题与答案《机器学习》练习题与解答1.⼩刚去应聘某互联⽹公司的算法⼯程师,⾯试官问他“回归和分类有什么相同点和不同点”,他说了以下⾔论,请逐条判断是否准确。

1)回归和分类都是有监督学习问题[单选题] [必答题]○对○错参考答案:对。

解析:这道题只有⼀个同学做错。

本题考察有监督学习的概念。

有监督学习是从标签化训练数据集中推断出函数的机器学习任务。

有监督学习和⽆监督学习的区别是:机器学习算法的图谱如下:在回归问题中,标签是连续值;在分类问题中,标签是离散值。

具体差别请看周志华《机器学习》书中的例⼦,⼀看便懂:2.背景同上题。

请判断2)回归问题和分类问题都有可能发⽣过拟合 [单选题] [必答题]○对○错答案:对解析:这题有两个同学做错。

过拟合的英⽂名称是 Over-fitting(过拟合)。

为了说清楚“过”拟合,⾸先说⼀下“拟合”【拟合的⼏何意义】:从⼏何意义上讲,拟合是给定了空间中的⼀些点,找到⼀个已知形式未知参数的连续曲线或曲⾯来最⼤限度地逼近这些点。

⼀个直观的例⼦,是下⾯的电阻和温度的例⼦。

我们知道在物理学中,电阻和温度是线性的关系,也就是R=at+b。

现在我们有⼀系列关于“温度”和“电阻”的测量值。

⼀个最简单的思路,取两组测量值,解⼀个线性⽅程组,就可以求出系数a、b了!但是理想是丰满的,现实是残酷的!由于测量误差等的存在,我们每次测量得到的温度值和电阻值都是有误差的!因此,为了提⾼测量精度,我们会测量多次,得到多组的值,这样就相当于得到⼆维平⾯上的多个点,我们的⽬标是寻找⼀条直线,让这条直线尽可能地接近各个测量得到的点。

拟合的数学意义:在数学的意义上,所谓拟合(fit)是指已知某函数的若⼲离散函数值{f1,f2,…,fn}(未必都是准确值,有个别可能是近似甚⾄错误值),通过调整该函数中若⼲待定系数f(λ1, λ2,…,λn),使得该函数与已知点集的差别(最⼩⼆乘意义)最⼩。

2021项目数据分析师理论考试真题模拟及答案(3)共501道题1、数据挖掘技术包括三个主要的部分()(单选题)A. 数据、模型、技术B. 算法、技术、领域知识C. 数据、建模能力、算法与技术D. 建模能力、算法与技术、领域知识试题答案:C2、下面有关HAVING子句的说法中正确的是()(多选题)A. HAVING子句必须与GROUP BY子句同时使用,不能单独使用B. 使用HAVING子句的同时不能使用WHERE子句C. 使用HAVING子句的同时可以使用WHERE子句D. 使用HAVING子句的作用是限定分组的条件试题答案:A,C,D3、如下表student中,如何筛选type为包含数学或语文的记录?()ID type score:A01数学78;A02语文76;A03英语90;A04数学68;A05英语84。

(多选题)A. select*from student where type=”数学”and type=”语文”B. select*from student where type=”数学”or type=”语文”C. select*from student where type in(”数学”,”语文”)D. select*from student where type in(”数学”、”语文”)试题答案:B,C4、以下哪个变量可以反映客户的忠诚度?()(单选题)A. 购买频次B. 购买金额C. 最后一次购买时间D. 购买金额波动率试题答案:A5、下列有关Apriori算法的说法中不正确的是()(单选题)A. Apriori算法是关联分析中最常用的算法之一B. 应用Apriori算法时,需要先设定模型的最小支持度、最小置信度等阈值C. 应用Apriori算法时,输入的数据可以是连续型数据也可以是离散型数据D. Apriori算法扫描数据库的次数依赖于最大频繁项集中项的数量试题答案:C6、关于产销量的盈亏平衡点正确的公式是()(单选题)A. 年总变动成本/(产品销售单价×(1-销售税率)-单位固定成本)B. 年总固定成本/(产品销售单价+单位变动成本+单位产品销售税额)C. 年总固定成本/(产品销售单价×(1-销售税率)+单位变动成本)D. 年总固定成本/(产品销售单价-单位变动成本-单位产品销售税额)试题答案:D7、Naive Bayes是属于数据挖掘中的什么方法?()(单选题)A. 聚类B. 分类C. 时间序列D. 关联规则试题答案:B8、当贴现率与内部收益率相等时()(多选题)A. 净现值等于0B. 现值指数等于0C. 净现值等于1D. 现值指数等于1试题答案:A,D9、ROC曲线凸向哪个角,代表模型越理想?()(单选题)A. 左上角B. 右上角C. 左下角D. 右下角试题答案:A10、在假设检验中,犯一类错误的概率和犯第二类错误的概率的关系是()(多选题)A. 只能直接控制,不能直接控制B. 和不可能同时减小C. 在其他条件不变的情况下,增大,必然后减小D. 在其他条件不变的情况下,增大,必然后增大E. 增加样本容量可以同时减小和试题答案:A,C,E11、下列度量不具有反演性的是()(单选题)A. 系数B. 几率C. Cohen度量D. 兴趣因子试题答案:D12、等年值法需要将参与比较的方案的收益现值按约定计算期折算为均匀序列的()(单选题)A. 永续年金B. 预付年金C. 普通年金D. 递延年金试题答案:C13、相关分析的任务有()。

DL101期末考试题及答案一、单项选择题(每题2分,共20分)1. 在DL101课程中,以下哪个算法是用于分类问题的?A. 线性回归B. 逻辑回归C. K-均值聚类D. 主成分分析答案:B2. 神经网络中的激活函数通常用于:A. 增加非线性B. 减少计算量C. 增加训练时间D. 减少模型复杂度答案:A3. 下列哪个选项是监督学习算法?A. K-均值聚类B. 决策树C. 线性回归D. 所有选项答案:D4. 在机器学习中,过拟合是指:A. 模型在训练数据上表现很好,但在新数据上表现不佳B. 模型在训练数据上表现不佳C. 模型在新数据上表现很好D. 模型在所有数据上表现都很好答案:A5. 交叉验证的主要目的是:A. 减少模型的偏差B. 减少模型的方差C. 评估模型的泛化能力D. 提高模型的训练速度答案:C6. 在机器学习中,特征缩放的目的是:A. 增加模型的计算量B. 加速模型的训练过程C. 改善模型的性能D. 减少模型的方差答案:C7. 以下哪个是无监督学习算法?A. 支持向量机B. 线性判别分析C. K-均值聚类D. 逻辑回归答案:C8. 随机森林算法中,每棵树的训练是基于:A. 全部数据B. 随机选择的特征子集C. 随机选择的数据子集D. 所有特征答案:C9. 在机器学习中,召回率是指:A. 正确识别的正例占所有实际正例的比例B. 正确识别的负例占所有实际负例的比例C. 正确识别的正例占所有预测为正例的比例D. 正确识别的负例占所有预测为负例的比例答案:A10. 梯度下降算法用于:A. 最小化损失函数B. 最大化损失函数C. 固定损失函数D. 随机改变损失函数答案:A二、多项选择题(每题3分,共15分)11. 以下哪些是机器学习中常用的优化算法?A. 梯度下降B. 牛顿法C. 随机梯度下降D. 遗传算法答案:A, B, C, D12. 在神经网络中,以下哪些是常见的损失函数?A. 均方误差B. 交叉熵C. 对数似然D. 绝对误差答案:A, B, C13. 以下哪些是深度学习模型中常用的激活函数?A. SigmoidB. ReLUC. TanhD. Softmax答案:A, B, C, D14. 在机器学习中,以下哪些是特征选择的目的?A. 减少模型的计算量B. 提高模型的解释性C. 提高模型的泛化能力D. 增加模型的复杂度答案:A, B, C15. 以下哪些是机器学习中的评估指标?A. 准确率B. 精确率C. 召回率D. F1分数答案:A, B, C, D三、填空题(每题3分,共15分)16. 在机器学习中,______是指模型在训练数据上表现很好,但在新数据上表现不佳的现象。

深度学习及其应用_复旦大学中国大学mooc课后章节答案期末考试题库2023年1.GAN中的Mode Collapse问题是指什么?答案:生成器只生成少数几种样本2.有关循环神经网络(RNN)变种的说法哪些是正确的?答案:RNN的变种增加了网络的复杂性,训练过程难度一般会大一些。

_RNN的变种可以在某些方面改进RNN的不足,例如减少梯度消失、输入句子词汇上文文语义获取等_这些RNN的变种结构都有一定的调整,但大多都可以处理时序数据的分类或预测问题。

3.以下说法错误的有哪些?答案:类似VGG、GoogLeNet等网络,AlexNet采用了卷积块的结构。

_为了获得不同尺度的特征,GoogLeNet采用了1X1,3X3,7X7等不同尺度的卷积核。

_ResNet卷积神经网络使用了批量标准化(BN)增加了网络的训练稳定性,并像VGG算法利用了skip链接减少信息的损失。

4.循环神经网络一般可以有效处理以下哪些序列数据?答案:随时间变化的数值型参数_声音_文本数据5.循环神经网络的损失函数是所有时刻的输出误差之和。

答案:正确6.长短期记忆网络(LSTM)通过遗忘门减少一般循环神经网络(RNN)的短期记忆不足,但增加算法的计算复杂度。

答案:正确7.循环神经网络的深度是由RNN cell的时刻数量,或者是隐层的数量确定的,2种说法都有一定的道理。

答案:正确8.循环神经网络(RNN)每一个时间步之间的迁移中使用了共享参数(权重等),与前馈神经网络比较更不容易引起梯度消失问题答案:错误9.以下有关生成对抗网络的说法哪个是错误的?答案:生成器和判别器的代价函数在训练过程中是同时优化的10.有关生成对抗网络(GAN)的代价函数,下面哪个说法是错误的?答案:一般来说,GAN通过训练总能达到代价函数的极小值11.在目标检测算法中,IoU(Intersection over Union)主要用于?答案:度量检测框和真实框的重叠程度12.下面哪种情况可能不能使用生成对抗网络实现?答案:机器人取名字13.对于生成对抗网络(GAN)的训练,下面哪个说法是正确的?答案:如果判别器发生了过拟合,那么生成器可能会生成一起很奇怪的样本14.在DCGAN中,判别器的激活函数可以使用Leaky ReLU,而不采用Sigmoid的原因是以下哪个?答案:防止判别器在训练过程中发生梯度消失,降低鉴别器的能力15.有关生成器和判别器的代价函数,以下哪个说法是错误的?答案:通过一同调整生成器和判别器的权重等参数,达到两者总的代价函数平衡16.有关生成器和判别器的交叉熵代价函数,以下哪个说法是错误的?答案:当训练生成器时,希望判别器的输出越逼近0越好17.有关获得较高质量生成样本的隐向量z的说法,下面说法错误的是哪个?答案:可以随机取值18.与卷积神经网络不同,循环神经网络因为固有的时序性,很难在GPU上做并行训练。