奇异值分解和改进PCA的视频人脸检索方法

- 格式:pdf

- 大小:1.01 MB

- 文档页数:6

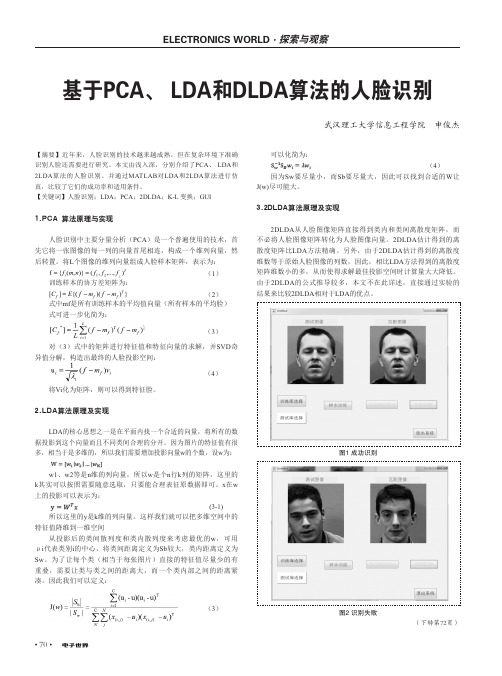

基于PCA、 LDA和DLDA算法的人脸识别武汉理工大学信息工程学院 申俊杰【摘要】近年来,人脸识别的技术越来越成熟,但在复杂环境下准确识别人脸还需要进行研究。

本文由浅入深,分别介绍了PCA 、 LDA 和2LDA 算法的人脸识别。

并通过MATLAB 对LDA 和2LDA 算法进行仿真,比较了它们的成功率和适用条件。

【关键词】人脸识别;LDA ;PCA ;2DLDA ;K-L 变换;GUI1.PCA 算法原理与实现人脸识别中主要分量分析(PCA )是一个普遍使用的技术,首先它将一张图像的每一列的向量首尾相连,构成一个维列向量,然后转置。

将L个图像的维列向量组成人脸样本矩阵,表示为:(1)训练样本的协方差矩阵为:(2)式中mf 是所有训练样本的平均值向量(所有样本的平均脸)式可进一步化简为:(3)对(3)式中的矩阵进行特征值和特征向量的求解,并SVD 奇异值分解,构造出最终的人脸投影空间:(4)将Vi 化为矩阵,则可以得到特征脸。

2.LDA算法原理及实现LDA 的核心思想之一是在平面内找一个合适的向量,将所有的数据投影到这个向量而且不同类间合理的分开。

因为图片的特征值有很多,相当于是多维的,所以我们需要增加投影向量w 的个数,设w为:w1、w2等是n 维的列向量,所以w 是个n 行k 列的矩阵,这里的k 其实可以按照需要随意选取,只要能合理表征原数据即可。

x 在w 上的投影可以表示为:(3-1)所以这里的y 是k 维的列向量。

这样我们就可以把多维空间中的特征值降维到一维空间从投影后的类间散列度和类内散列度来考虑最优的w ,可用μi 代表类别i 的中心,将类间距离定义为Sb 较大,类内距离定义为Sw 。

为了让每个类(相当于每张图片)直接的特征值尽量少的有重叠,需要让类与类之间的距离大,而一个类内部之间的距离紧凑。

因此我们可以定义:(3)可以化简为:(4)因为Sw 要尽量小,而Sb 要尽量大,因此可以找到合适的W 让 J(w)尽可能大。

奇异值矩阵分解算法改进设计与应用效果分析1.引言奇异值矩阵分解(Singular Value Matrix Factorization, SVD)是一种常用的矩阵分解算法,被广泛应用于推荐系统、图像压缩、自然语言处理等领域。

然而,在实际应用中,原始的SVD算法存在一些限制,如计算复杂度较高、容易产生过拟合等问题。

为了克服这些限制,研究者们提出了一系列的改进设计,本文将对这些改进进行分析,并评估其在实际应用中的效果。

2.奇异值矩阵分解算法2.1 基本原理SVD算法通过将矩阵分解为三个矩阵的乘积,实现对原始矩阵的降维和特征提取。

具体而言,对于一个m×n的矩阵A,SVD将其分解为U、S和V三个矩阵的乘积,即A=USV^T,其中U和V是正交矩阵,S是对角矩阵。

S的对角元素称为奇异值,表示矩阵A在对应的特征向量方向上的重要性。

2.2 算法流程传统的SVD算法主要包括以下几个步骤:(1)计算A^TA的特征向量和特征值,得到V;(2)计算AA^T的特征向量和特征值,得到U;(3)将A进行奇异值分解,得到S。

3.算法改进设计3.1 隐式反馈数据处理在许多应用场景中,用户对物品的喜好往往是隐式的,例如用户的点击、观看历史等。

传统的SVD算法无法直接利用这些隐式反馈数据,因此研究者们提出了一系列的改进方法,如隐反馈矩阵分解(Implicit Matrix Factorization, IMF)算法。

IMF算法通过将隐式反馈数据转化为正态分布的隐式评分进行计算,从而提升了推荐系统的性能。

3.2 正则化项引入SVD算法容易受到过拟合的影响,为了解决这个问题,研究者们引入了正则化项。

正则化项可以限制模型的复杂度,防止过拟合的发生。

常用的正则化项有L1正则化和L2正则化,通过最小化正则项与损失函数的和来求解优化问题,达到控制模型复杂度的目的。

3.3 基于深度学习的改进近年来,深度学习在推荐系统领域取得了巨大的成功。

Computer Engineering and Applications计算机工程与应用2010,46(7)1引言人脸识别是当前模式识别与人工智能领域的研究热点,研究者已经提出了很多用于人脸识别的方法,其中Turk和Pent-land利用重构权向量作为识别用的特征,提出了“特征脸”识别技术[1],从而人脸识别领域迎来了“基于表征”的子空间分析方法的研究热潮。

其中比较有代表性的有主成分分析(PCA)[1]、线性判别分析(LDA)[2]、独立成分分析(ICA)[3]、基于核技术的Kernel PCA[4]等等。

洪子泉等人首次利用奇异值分解(SVD)进行人脸识别[5],并与其他方法相结合,在ORL数据库上获得了不错的识别率。

但以上算法都有一个共同特点,即在进行特征提取时,只重视人脸的总体特征,而忽略了眼睛等作为人脸局部的存在。

事实上,人脸关键部位的局部特征也是重要的鉴别特征。

当然,由于人脸的各部位作为鉴别特征的重要性程度是不同的,因此,它们在人脸识别中能起到的作用也不同。

在此之前,Kalocsai等人用统计的方法比较了正面人脸不同的48个特征点在描述整个人脸模式中所起的作用,并据此赋予它们不同的权值[6]。

Pentland等人则提出“特征脸”、“特征鼻”、“特征嘴”的概念[7],并通过融合各“特征器官”以达到人脸识别的目的。

由于这些方法在赋予各局部特征权值时,并没有针对特定的训练集进行优化,而是采用一种笼统的加权策略,其权值是不会因为训练集的不同而改变的,因此,没有自适应能力无疑会对识别结果产生消极的影响。

正是在以上背景下提出了一种基于特征融合矩阵的人脸识别方法,该算法融合了人脸的全局特征与局部特征,并进行了权值的动态选择,同时在提取特征时采用的是改进的基于SVD的人脸特征提取方法。

该算法不仅解决了LDA的小样本问题和SVD识别率不高问题,而且训练时间短、速度较快、简单易用。

2基于SVD的特征提取奇异值分解为提取图像代数特征提供了新的手段,获得了广泛的应用。

基于主成分分析(PCA)的⼈脸识别技术本科期间做的⼀个课程设计,觉得⽐较好玩,现将之记录下来,实验所⽤。

1、实验⽬的(1)学习主成分分析(PCA)的基础知识;(2)了解PCA在⼈脸识别与重建⽅⾯的应⽤;(3)认识数据降维操作在数据处理中的重要作⽤;(4)学习使⽤MATLAB软件实现PCA算法,进⾏⼈脸识别,加深其在数字图像处理中解决该类问题的应⽤流程。

2、实验简介(背景及理论分析)近年来,由于恐怖分⼦的破坏活动发⽣越发频繁,包括⼈脸识别在内的⽣物特征识别再度成为⼈们关注的热点,各国均纷纷增加了对该领域研究的投⼊。

同其他⽣物特征识别技术,如指纹识别、语⾳识别、虹膜识别、DNA识别等相⽐,⼈脸识别具有被动、友好、⽅便的特点。

该技术在公众场合监控、门禁系统、基于⽬击线索的⼈脸重构、嫌疑犯照⽚的识别匹配等领域均有⼴泛应⽤。

⼈脸识别技术是基于⼈的脸部特征,对输⼊的⼈脸图像或者视频流,⾸先判断其是否存在⼈脸。

如果存在⼈脸,则进⼀步的给出每个脸的位置、⼤⼩和各个主要⾯部器官的位置信息。

其次并依据这些信息,进⼀步提取每个⼈脸中所蕴涵的⾝份特征,并将其与已知的⼈脸进⾏对⽐,从⽽识别每个⼈脸的⾝份。

⼴义的⼈脸识别实际包括构建⼈脸识别系统的⼀系列相关技术,包括⼈脸图像采集、⼈脸定位、⼈脸识别预处理、⾝份确认以及⾝份查找等;⽽狭义的⼈脸识别特指通过⼈脸进⾏⾝份确认或者⾝份查找的技术或系统。

我们在处理有关数字图像处理⽅⾯的问题时,⽐如经常⽤到的图像查询问题:在⼀个⼏万或者⼏百万甚⾄更⼤的数据库中查询⼀幅相近的图像。

其中主成分分析(PCA)是⼀种⽤于数据降维的⽅法,其⽬标是将⾼维数据投影到较低维空间。

PCA形成了K-L变换的基础,主要⽤于数据的紧凑表⽰。

在数据挖掘的应⽤中,它主要应⽤于简化⼤维数的数据集合,减少特征空间维数,可以⽤较⼩的存储代价和计算复杂度获得较⾼的准确性。

PCA法降维分类原理如下图所⽰:如上图所⽰,其中五⾓星表⽰⼀类集合,⼩圆圈表⽰另⼀类集合。

人工智能开发技术的奇异值分解方法人工智能开发技术的奇异值分解(Singular Value Decomposition,SVD)是一种重要的数学方法,被广泛应用于模式识别、推荐系统、数据压缩等多个领域。

SVD的原理简单明了,但其在人工智能领域的应用却非常广泛,对于我们理解和应用人工智能技术具有重要意义。

一、SVD的基本原理和定义奇异值分解是一种线性代数的分解方法,将一个矩阵分解为三个矩阵的乘积。

对于一个m × n的实数或复数矩阵A,可以将其分解为以下形式:A = UΣV^T其中,U是一个m × m的酉矩阵,Σ是一个m × n的矩阵,它的主对角线上的元素称为奇异值,其余元素均为0,V^T是一个n × n的酉矩阵的转置。

SVD的优势在于,它充分利用了矩阵的信息,并且可以选择性地保留重要信息。

通过对原始矩阵进行SVD分解,我们能够更好地理解和处理数据。

二、SVD在模式识别中的应用在模式识别领域,SVD被广泛应用于降维和特征提取。

通过SVD分解,我们可以获得数据的主要特征,从而减少数据的维度和复杂度。

这对于处理大规模数据集和优化机器学习模型的训练速度非常重要。

以人脸识别为例,SVD可以提取人脸图像的主要特征,去除图像中的噪声和冗余信息。

这样一来,就能够更准确地识别人脸,提高人脸识别系统的准确性和鲁棒性。

三、SVD在推荐系统中的应用在推荐系统中,SVD被用于对用户和物品进行特征提取,从而进行个性化推荐。

通过对用户与物品评分矩阵进行SVD分解,可以得到用户和物品的隐含特征向量,进而进行推荐。

以书籍推荐系统为例,通过SVD分解评分矩阵,我们可以得到用户和书籍的特征向量。

当用户对某一本书籍评分时,可以通过特征向量计算出其他用户对该书籍的评分,从而进行个性化的推荐。

这种基于SVD的推荐系统在电商平台和音乐平台上被广泛应用。

四、SVD在数据压缩中的应用SVD还可以用于数据压缩和信号处理。

随机过程PCA用于人脸识别附Matlab代码于琦2011/10/27学号:2009011149【摘要】人脸识别技术是近来非常活跃的研究领域,它综合多学科知识,且应用非常广泛。

采用主元分析法(PCA)进行人脸识别的经典方法之一。

本文利用Matlab在ORL人脸库上实现PCA初步人脸识别,包括图像特征提取、人脸重构与识别方法设计。

讨论了用奇异值分解等方法简化特征向量求解,并详细阐述其在Matlab中的实现过程。

结合ORL人脸库自身特点,通过对特征值和特征脸的分析进行合理取舍,提高了识别率。

【介绍】“人脸识别是一项热门的计算机技术研究领域,它属于生物特征识别技术,是对生物体(一般特指人)本身的生物特征来区分生物体个体。

更好的解决该问题将有助于身份确认和身份查找等应用、促进众多学科的发展。

”“目前,人脸识别的方法可以分为5类,分别为基于特征脸(PCA)的人脸识别方法,神经网络的人脸识别方法,弹性图匹配的人脸识别方法,线段Hausdorff 距离(LHD) 的人脸识别方法支持向量机(SVM) 的人脸识别方法。

其中给予特征脸的人脸识别是传统方法,基于K-L 变换(PCA)的人脸识别方法又叫特征脸方法、本征脸方法(Eigenface),最早由Turk 和Pentland 提出。

它有均方误差最小,降维减少计算量,主分量特性稳定等优点。

”“由于PCA较之于前几种方法相对简单,故本文对PCA算法进行研究并用Matlab 给出实现。

”“本文的结构安排如下:第二章模型(Model)及基本理论和方法(Basic Theory and Method),第三章方法(Method)及方法分析(Analysis of Method),第四章算法(Algorithm)及算法分析(Analysis of Algorithm),第五章数值结果及讨论(Discussion),第六章结论(Conclusion)。

第二章模型及基本理论和方法采用PCA对原始数据的处理,通常有三个方面的作用—降维、相关性去除、概率估计。

PCA人脸识别算法详解PCA算法的目标是通过提取人脸图像的主要特征来进行人脸识别。

主成分分析的核心思想是将高维数据转换为低维数据,同时保留最大的数据方差。

在人脸识别任务中,PCA将每个人脸图像映射到一个低维的特征空间,然后根据特征空间中的距离来判断人脸图像的身份。

1.数据预处理:首先需要将所有的人脸图像转换为相同的大小,并将所有的图像转换为灰度图像,以降低计算复杂度。

2.构建训练集:从原始图像库中随机选择一定数量的人脸图像,用于构建训练集。

同时,还需要提前知道每个人脸图像所对应的身份信息。

3.计算平均脸:将训练集中的所有人脸图像叠加在一起,然后计算它们的平均图像,得到平均脸。

平均脸代表了人脸图像的共同特征。

4.计算差异脸:将每个人脸图像与平均脸进行相减操作,得到差异脸。

差异脸反映了每个人脸与平均脸之间的差异。

5.计算特征向量:对差异脸进行特征向量分解,得到一组特征向量,每个特征向量对应一个主要的人脸特征。

通过选择特征值较大的特征向量,可以保留最重要的人脸特征。

6.训练分类器:使用训练集中的特征向量来构建一个分类器模型(如SVM、KNN等),用于表示每个人脸图像的特征。

每个人的脸图像在特征向量空间上的表示即为其特征向量的线性组合。

7.人脸识别:对于待识别的人脸图像,通过同样的数据预处理步骤,计算出它的特征向量。

然后将该特征向量与分类器模型进行比较,找到最相似的特征向量及其对应的身份信息,实现人脸识别。

1.PCA能够消除人脸图像中的冗余信息,提取出最主要的特征,提高了人脸识别的准确性。

2.PCA算法计算简单,能够快速处理大量的人脸图像数据。

1.PCA算法对光照、表情等变化较为敏感,当人脸图像间存在较大的变化时,算法的性能可能会降低。

2.当人脸图像库较大时,算法的计算和存储开销较高。

3.PCA算法不适用于非线性的人脸变化。

综上所述,PCA人脸识别算法是一种经典的人脸识别方法,其通过提取主要特征并消除冗余信息来实现人脸识别。