高分辨率遥感影像目标分类与识别研究进展

刘扬1,2,3,付征叶4,郑逢斌2,3*

(1.河南大学环境与规划学院,开封475004;2.河南大学空间信息处理实验室,开封475004;3.河南大学计算机与信息工程学院,开封475004;4.河南大学软件学院,开封475004)

摘要:高分辨率遥感影像的目标分类与识别,是对地观测系统进行图像分析理解,以及自动目标识别系统提取目标信息的重要手段。本文综述了当前国内外在可见光、红外、合成孔径雷达和合成孔径声纳等遥感影像的目标分类与识别的关键技术和最新研究进展。首先,讨论了高分辨率遥感影像的目标分类与识别问题的主要研究层次和内容;其次,深入分析了高分辨率遥感影像目标分类与识别,在滤波降噪、特征提取、目标检测、场景分类、目标分类和目标识别的关键技术及其所存在的问题;最后,结合并行计算、神经计算和认知计算等技术,讨论了目标分类与识别的可行性方案。具体包括:(1)高性能并行计算在高分辨率遥感图像处理的主流技术,并给出了基于Hadoop+OpenMP+CUDA 的高分辨率遥感影像混合并行处理架构;(2)深度学习对于提升目标分类和识别精度的应用前景,以及基于深度神经网络的多层次遥感影像目标识别方法;(3)认知计算在解决遥感影像大数据不确定性分析的模型与算法,并讨论了层次主题模型的多尺度遥感影像场景描述方案。此外,根据媒体神经认知计算的相关研究,探讨了遥感影像大数据的目标分类和识别的发展趋势和研究方向。关键词:目标分类与识别;媒体神经认知计算;并行计算;深度学习;主题模型DOI:10.3724/SP.J.1047.2015.01080

1引言

高分辨率遥感影像的目标分类与识别(Targets Classification and Recognition ,TCR ),是高分辨率对地观测系统(Earth Observing System ,EOS )和自动目标识别系统(Automatic Target Recognition ,ATR )的信息提取和处理的重要组成部分。TCR 是精确制导、武器防御、海情监控等军事ATR 系统的关键,也是提升减灾应急、交通监管、渔业海事,乃至无人车和机器人等民用系统智能化水平的核心技术。

随着EOS 的光谱和频谱分辨率增加,时间分辨率和空间分辨率的不断提升,可见光、红外、高光谱、雷达等不同种类的传感器,产生大量的多尺度遥感影像。目前,先进的高分辨率遥感影像光学影像分辨率可达分米级,星载SAR 已达米级,干涉雷达相对位移精度可到毫米级,高光谱影像的光谱分

辨率甚至可达纳米级,卫星重访周期已大幅缩短至天。高分辨率遥感影像具备海量、多源、异构的外部特征和高维、多尺度、非平稳内部特性,是名副其实的大数据。传统的中低分辨率遥感影像解译体系,无法有效地分析高分辨率遥感影像的复杂特征。高分辨率遥感影像作为关系着国计民生的应急和减灾应用的空间大数据[1],

对TCR 算法处理的精度、智能化水平[2-3]、实时性和处理效率[4]提出了较高的要求。然而,由于遥感影像背景的复杂性和对象的多样性,目前国内外TCR 相关方法大多针对特定时空条件,具有较大的局限性,距工程化应用尚有很大发展空间。因此,探索高效快速的TCR 方法和理论,是提高ATR 系统功能的重要需求,也是EOS 对遥感技术发展提出的科学难题之一。

在界定遥感影像TCR 问题描述基础上,本文探讨和回顾图像预处理、目标检测、场景分类、

目标分

V ol.17,No.9Sep.,2015

第17卷第9期2015年9月收稿日期:2014-12-12;修回日期:2015-02-14.

基金项目:国家自然科学基金项目(61305042、61202098);国防科技工业民用专项科研技术研究项目(2012A03A0939);河南

省教育厅科学技术研究重点项目(13A520071)。

作者简介:刘扬(1971-),男,河南信阳人,副教授,博士,主要从事媒体神经认知计算、时空信息高性能计算。

E-mail:ly.sci.art@https://www.doczj.com/doc/d5540467.html,

*通讯作者:郑逢斌(1963-),男,教授,博士生导师,研究方向为空间信息处理、自然语言处理。E-mail:zhengfb@https://www.doczj.com/doc/d5540467.html,

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展

类和目标识别等相关研究的现状,分析和总结TCR 研究存在的主要问题,并从解决遥感分类与识别的角度,结合神经计算、认知计算和并行计算相关技术,对TCR的应用与发展进行了综合分析。

2遥感影像TCR问题描述

目前,TCR系统研究的地物目标对象主要集中在舰船、飞机、战车、油库、桥梁、机场、港口等典型的重要战略目标。根据探测感知的手段不同,ATR 系统的信息源可来自微波、可见光、红外、毫米波、超声波等传感器。其中,红外图像、可见光图像、合成孔径雷达(Synthetic Aperture Radar,SAR)图像,是实现TCR的主要信息源。此外,还有水声图像,如合成孔径声纳(Synthetic Aperture Sonar,SAS)等。

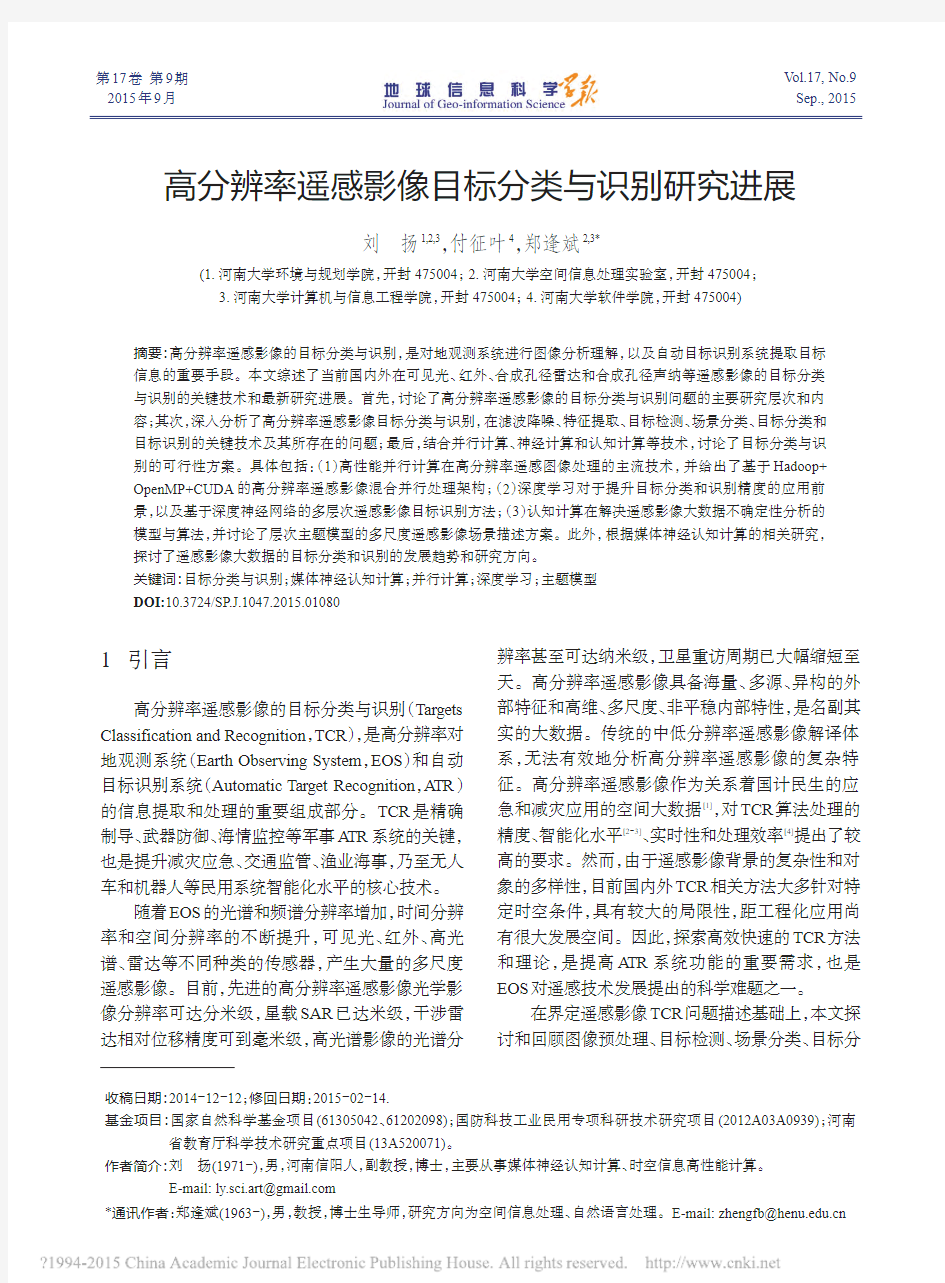

SAR图像具备全天时、全天候、可侧视成像等特点,具备一定的穿透性和形态探测能力,但对目标方位角、姿态角的变化很敏感。由于水声信号的多径传播,以及声波具备的透射特性,混响噪声干扰等原因,容易造成SAS影像的形状模糊。SAR和SAS的相干斑噪声会严重降低图像的可解译度,对其进行TCR处理前,必须抑制相干斑造成的图像质量下降问题。光学图像空间分辨率一般较高,内容丰富,目标结构明显,直观易于理解。但可见光图像易受光照、云雾等因素影响。红外传感器能捕获目标的热辐射特征,且无背景多径干扰问题。但红外图像的信噪比往往较低、对比度差,目标往往缺乏形状和纹理信息。如图1所示,高分辨率遥感影像TCR问题根据系统研究层次,一般可分为滤波降噪、图像分割(segmentation)、特征提取、潜在目标检测(detection)、虚警目标判别(discrimination)、目标类型分类(classification)、目标场景分类、目标识别(recognition)、目标身份鉴别(identification)、目标敌我确认(confirmation)、目标时空跟踪(track-ing)和目标显示(indication)等若干步骤和层次。

3遥感影像TCR研究进展

由于浓厚的军事背景等原因,在遥感影像的ATR研究中,关于SAR、SAS和红外TCR的成果文献总体较少。随着民用潜力的发掘和科技成果转化,相关研究也带来了巨大生机和活力,但相关设备成本、算法精度、复杂度、时效性、软件的重用性等所带来的研发问题也逐步显现。

3.1图像预处理

遥感影像预处理是实现图像特征提取、目标检测、分类和识别等后处理的基础。广义的遥感影像预处理包括图像的滤波、降噪、增强、定位、校正、配准、融合及特征的提取和降维等过程。狭义的预处理一般指降噪、增强、特征提取和降维等处理过程。

遥感影像滤波降噪一般利用噪声和有用信息之间的特征差异,选择性地保留有用信息,提升图像的信噪比。图像噪声一般分为加性噪声和乘性噪声,降噪是图像处理领域研究的最基础性问题。由于传感器的特性不同,遥感影像的滤波降噪算法有较大的区别,这是由于噪声源和成像机理不同造成的。遥感影像特征提取是TCR研究的重要前提,表1总结了遥感影像的典型噪声与滤波降噪方法。

遥感影像特征提取是TCR研究的重要内容。目标特征提取的本质是把信息冗余的高维度原始图像信息投影到有利于分类和识别的低维特征空间中。特征提取的结果会严重影响分类和识别算法的可行性、有效性,以及识别精度。表2总结了遥感场景和典型目标的特征类型。

目前,无论是统计特征、纹理和边缘特征普遍存在计算量大,特征分布稀疏,特征维度偏高等特点。而变换和滤波特征又存在表示能力不强,

语义

图1高分辨率遥感影像TCR问题的研究层次

Fig.1The research levels of high resolution remote sensing image of TCR

1081

地球信息科学学报2015年

不明确等问题。如何从遥感影像中提取具有描述

能力强、易于分类识别的图像特征,是智能图像处理需迫切解决的课题。

3.2目标检测

类似于人脸检测,目标检测要对场景内目标是否存在进行检测,是雷达区分目标和杂波的重要功能,在目标探测和显示中有广泛应用。作为预警雷达和声纳的重要功能,目标检测是静止和运动目标显示(Stationary and Moving Target Indication ,SMTI )(如GMTI 、AMTI 、MMTI ,以及水下运动目标显示)等应用的核心技术。根据高分辨率遥感影像中目标的形态特点,表3总结了遥感影像的典型地物目标检测方法。

在基于分布模型(如K 分布模型、联合分布模型等)的团块目标检测算法中,CFAR 检测方法[5]及其变种(如CA-CFAR 、SO-CFAR 、GO-CFAR 、OS-CFAR 、双参数CFAR 、K 分布CFAR 算法等),是雷达信号检测领域最常用和最有效的检测算法。其中,SAR 图像目标检测研究开展较早,SAR 舰船目标检测可利用舰船目标与水体的电磁散射差异,针对近岸SAR 图像船舶检测,文献[6]用MRF 方法来

实现海陆分割,利用CFAR 检测器实现近岸船舶检测任务。光学遥感影像的舰船目标检测起步稍晚,

技术相对滞后。近期,主题模型[7]、

分层自适应部分模型[8]、上下文分析[9]和多核学习算法[10]取得较好目标检测效果。视觉显著性[11]和流形学习[12]中目标检测中也有较好的应用。

目前,遥感影像目标检测研究存在的主要问题是目标检测针对性较强,缺乏通用和鲁棒性目标检测模型和算法。在复杂环境中,基于恒虚警率的目标检测方法虚警率过高不利于实时的应用。利用图像分割剔除干扰,是目标检测急需解决的问题,如舰船检测的海陆分割精度低会严重引起漏检。此外,目标的运动特性(如舰船的尾迹、潜艇的航迹)、SAR 和SAS 目标的阴影的利用、可见光的云层遮挡,以及红外的背景干扰需要有针对性的改进检测模型。建立适用性强的检测模型和多源融合的并行快速处理算法,才能实现目标检测和识别的实用化。

3.3场景分类和目标分类

遥感影像的目标分类和图像分类内涵不同。一般而言,遥感的图像分类是像元级的地物属性分

表1遥感影像的典型噪声与降噪方法

Tab.1Typical noise and reduction method of remote sensing

images

表2遥感影像场景和典型目标的特征

Tab.2The features of scene and typical targets of remote sensing

images

表3遥感影像目标检测方法

Tab.3Methods of target detection of remote sensing

images

目标类型

典型目标示例

目标特征

主要检测算法

1082

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展类,在图像处理领域里实质是图像分割。目标分类

任务类似语音识别和字符识别任务,按照目标的种类、等级或类型,对其自动分类或判断某个目标所属类别,是对象级的地物属性分类。场景分类隶属于整体的图像理解的研究范畴,场景分类要对图像场景进行分析、判断、解译和标注。表4总结了常用遥感影像场景分类和目标分类算法和特点。

3.3.1场景分类

场景分类是学习和发现图像与场景语义内容标签的一个映射过程[13]。场景通常包含多个目标,场景分类也是图像理解的关键课题。常见场景分类算法有局部语义的场景分类、中层语义的场景分类、语义主题模型的场景分类等。根据场景分类的层次又可分为低层特征描述和中层特征描述2大主流方法。由于低层特征描述往往泛化性能差,难用于处理训练集以外的图像分类,目前场景分类算法大部分集中在基于中层语义建模的场景分类。

中层特征是对低层特征的一种聚集和整合,其本质是利用统计分布建立特征与类别的联系。全局的低层特征往往无法反映局部对象,考虑局部低层特征描述、多局部特征融合及集成学习可提高场景分类的识别率。视觉词袋(Bag of Visual Words ,BoVW )模型的场景分类,是目前广泛采用的中层语义算法。BoVW 模型无需分析场景具体目标组成,根据场景低层特征统计特性建立视觉单词,然后利用图像的视觉单词分布来表达图像场景信息[14]。考虑视词的空间共生关系和上下文关系,将有助于提升场景结构语义的解释。但目前BoVW 模型的视词数量设置多少为宜尚无定论,且生成对象也往往与训练样本有较大相关度,而这是影响算法鲁棒性的重要因素。

统计学习理论是比较成熟的研究算法,在多传感器的融合遥感影像场景分类中,结构风险最小化原则的SVM [15]和利用bootsrap 重抽样的随机森林有相关报道。为实现机载雷达和多光谱图像的场景分类,随机森林往往结合经典的先验模型无监督图像分割工具MRF 进行分类[16]。近期源于文本分类研究的pLSA 、LDA 等语义主题模型,在星载滑坡[17]和机载航空摄影[18]的场景分类中得到较好的实验效果。

中层语义场景分类在一定程度上缓解语义鸿沟的问题,但对场景尺度变化、传感器拍摄角度和时间的差异、语义对象组合变化往往缺乏有效措施。稀疏编码和深度学习[19]较高的算法复杂度是制约其在遥感影像场景分类进一步应用的重要因素,尤其是对高分辨率遥感影像的场景分类这类数据量大、场景对象构造复杂的特殊问题,其算法的鲁棒性、复杂度问题仍有较大的提升空间。3.3.2目标分类

一般而言,一个场景是由多个目标组成,在语义特征上,场景语义要比目标语义复杂。但如果从场景的粗分类角度,其算法往往比目标分类简单,故可利用粗粒度的场景分类初步确定目标环境,然后进一步实现目标分类和识别。目标分类算法基本上与场景分类差别不大,但目标一般是在图像分割后的切片上进行。

针对SAS 图像的水下目标分类问题,文献[20]提出一种上下文相关的水下目标分类框架。考虑不同的水下环境的相关参数设置,采用RVM 实现水声图像的目标分类。对于SAR 图像还可利用其极化[21]特性进行目标分类研究。高分辨率光学遥感影像的目标分类一般都需利用其丰富的纹理和边缘信息。对光学图像土地覆盖目标分类问题,文献[22]采用EM 算法和考虑空间相关性的MRF 的迭代分类策略实现目标分类。文献[23]利用小波核函数构建小波模糊SVM ,实现遥感影像的的目标分类和识别。针对传统BoVW 模型缺乏空间语义描述、字典学习和特征编码的不足,基于稀疏编码[24]的BoVW 模型可减轻特征编码的自适应性,并减少字典长度对分类性能的敏感度。此外,面向对象[25-28]的思想在目标分类研究非常值得关注,诸如ENVI 、eCogition 等商业遥感分析软件都采用面向对象的思想进行图像分析,其算法流程和遥感影像的目标分类在本质上类似。

表4场景分类和目标分类算法

Tab.4Algorithms of scene classification and target

classification

1083

地球信息科学学报2015年

目前,遥感影像场目标分类存在的主要问题是,目标分类算法所利用的全局特征往往鲁棒性不强,局部特征缺乏空间描述,二者都存在较大的局限性,急需研究新颖的、描述能力强,计算复杂度低的特征来描述和表示目标的语义。需要进一步利用目标对象的视觉认知层次性,综合考虑对象的稀疏表示、语义主题特性,以及目标之间的空间语义,设计目标的认知分类模型,提升算法识别率和鲁棒性。3.4目标识别

类似于声纹识别和人脸识别任务,目标识别是在已知目标种类的情况,标识出目标的具体型号。目标分类将目标归为一种已知的物体类型,而目标识别则要进一步根据目标特征进行区分。

模板匹配法是目标识别早期使用的相对简单方法,在此基础上发展起来的基于模型的方法则从目标中抽取特征,将目标抽象为目标模型、背景模型或环境模型进行识别,如MRF 和CRF 等模型。较为成熟并获得广泛应用的目标识别分类器是统计模式识别技术,主要利用贝叶斯决策规则解决最优分类问题。常见的方法有判别函数法、近邻分类法、非线性映射法、特征分析法、主因子分析法、SVM 、STM [29]、半监督学习算法等。由于目标在不同传感器所生成的图像差异性较大,目标识别方法也有所不同,表5总结了常用的不同类型遥感影像的目标识别算法。

目标在光学图像中易受气候、日照、云雾等多种因素影响。光学遥感影像目标识别中常用的特征,主要采用目标的灰度统计特征、几何形状与边缘纹理特征[30]、视觉感知特征[31]、分形模型、模糊理论及粗糙集理论[32]等。视觉感知机理的方法多以视觉系统注意机制,提取显著区和视觉特征进行目标识别[30]。文献[33]利用PCA 和决策融合,实现超光谱图像的目标识别任务。作为海量数据挖掘的理论工具粗糙集理论[32]能有效运用于多属性的目

标识别。

红外图像属于目标的热辐射,受红外系统固有特性的影像,红外图像一般存在对比度低、目标边缘模糊和图像信噪比低等特点。常用灰度特征、分形特征和LBP 纹理特征进行目标识别[34]。红外图像在特征提取前,一般需进行图像增强处理。文献[35]提出对比度拉伸变换、Otsu 算子和形态学算子处理红外图像,并利用先验知识实现目标识别任务。

光学图像具备目标清晰、目标纹理和形状边缘,而SAR 图像往往包含大量的相干斑噪声,且方向性强,对于ROI 存在稀疏性的强散射中心。SAR 图像目标特征采用形状特征(如周长、面积、长度、细长度等)、纹理特征(如标准差、分形维数、加权填充比等)、电磁散射特征(如峰值特征、散射中心特征等)、变换特征(如小波变换、Radon 变换、PCA 、ICA 等)和局部不变特征(如SIFT 特征、Hu 矩、广义不变矩、微分不变量等)进行目标识别。利用多极化SAR 图像提取纹理描述子构造鲁棒的舰船分类识别表示方法,文献[36]提出了一种层次化的船舶识别方案。

和SAR 类似,SAS 图像目标识别常用几何特征进行处理。针对SAR 和SAS 图像的对比度低、分辨率低、噪声和杂波的存在问题,文献[37]考虑到图像边界先验知识,利用阴影形状的仿射变换构造目标的活动轮廓的形状特征。文献[38]针对各向异性扩散滤波消除斑点噪声,采用模糊形态学把图像分割为高反射区和阴影区并提取几何特征,最后利用MCMC 方法进行目标识别。

流形学习可用低维流形结构描述目标的高维数据分布的内在规律实现维数约简,能有效解决目标图像的特征抽取和识别问题。基于图理论和微分几何,文献[39]通过寻找SAS 图像的低维流形嵌入一个高维特征空间构成扩散映射的非线性降维的目标描述,提升了SAS 目标识别能力。此外,DS 证据理论也有助于SAS 图像目标识别性能提升[40]。

表5遥感影像的目标识别算法

Tab.5Target recognition algorithm of remote sensing

images

影像类型特征提取

主要识别算法

1084

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展

目标识别的本质是一个由原始数据模式空间或特征空间到高层对象或类别语义的映射过程。目标识别目前存在的主要问题,是遥感影像目标背景复杂、图像分辨率不同,特征表现出的差异较大。对于可见光和红外影像要有效消除复杂背景信息对识别的干扰;对SAR和SAS图像则需进一步寻求准确、稳健的特征描述,综合考虑目标轮廓和遮挡阴影,对目标进行分割和姿态估计。

4TCR研究的主要问题和研究方向

4.1当前研究存在的主要问题

从目前公开文献来看,TCR相关研究主要存在如下问题:

(1)在复杂背景容易造成目标检测虚警率过高问题,视觉显著性的利用是目标检测重要手段。降噪、特征提取和目标检测一般计算量大,并行计算架构对于提升检测性能具有重要意义。

(2)遥感影像场景分类和目标分类关键问题是分类器设计,视觉神经信息处理的层次性非常值得关注的,目前的图像分类器多以浅层结构进行,其变化范围和适应对象往往有限,深度学习在语音和图像的神经计算中取得的进展,是场景和目标分类器的重要探索方向。

(3)遥感影像目标识别的核心是建立图像低层特征和高层语义对应关系。几乎所有目标识别算法都是以自低向上的视觉数据驱动算法,而自顶向下的任务驱动在目标识别所起的重要性不容忽视。结合概率理论的认知模型构造新型目标识别架构,是实现高度自适应的目标识别算法重要途径。4.2进一步研究方向

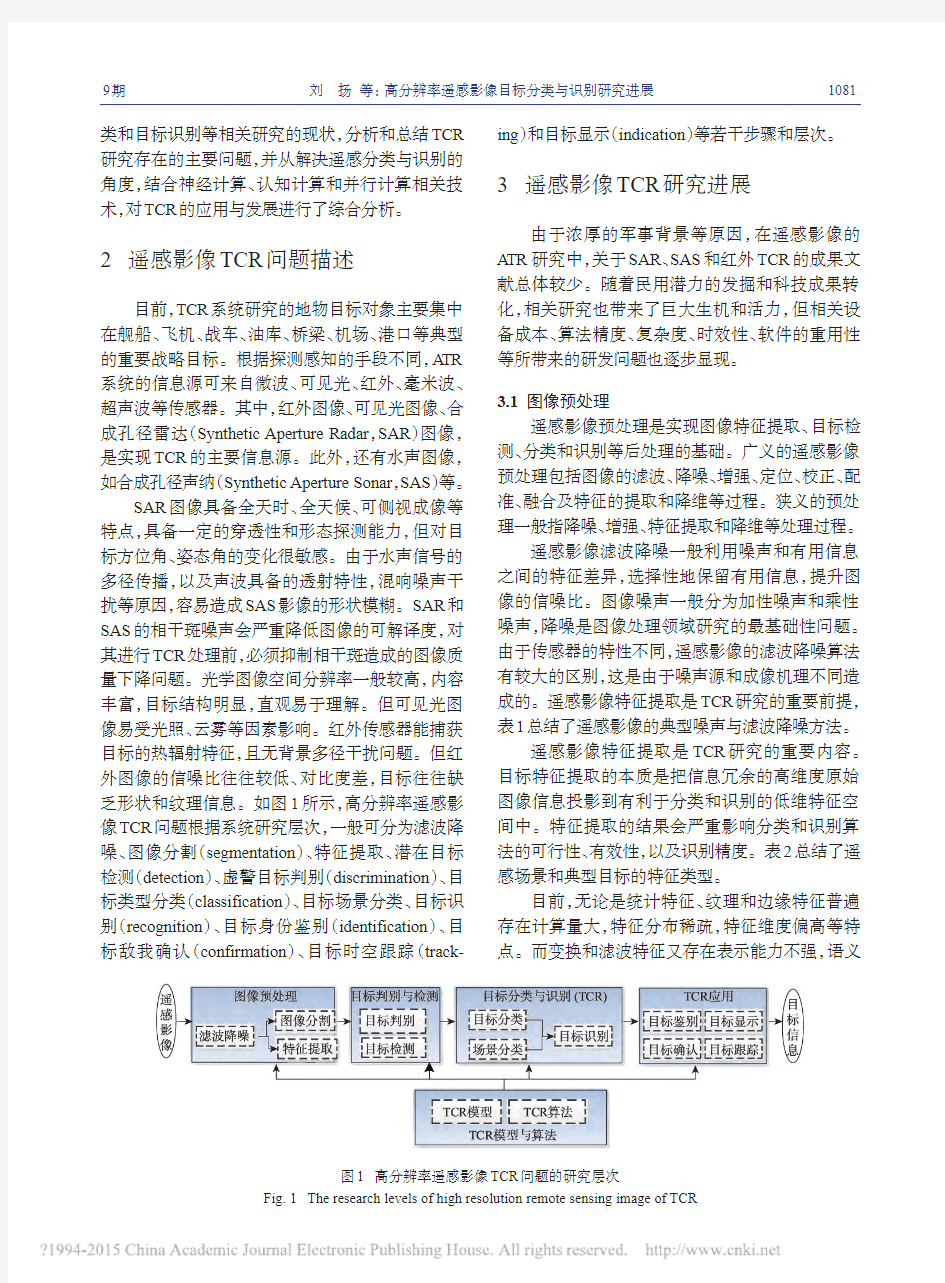

TCR的本质是现实世界的地物对象的时空认知,通过对图像感知和解译,再现和提取地物的现实信息过程。为适应未来发展需要,作者认为TCR 进一步研究将主要集中系统的性能、精度和速度3个方面(图2)。

(1)建立多尺度的高分辨率遥感影像场景认知模型,以满足TCR系统的性能需求。

(2)实现面向对象的多层次高分辨率影像目标识别处理,以提升遥感影像的“像元-对象-特征-目标-场景”复杂语义映射的精度问题。

(3)利用并行计算机制,建立快速高效的分类识别算法,以适应遥感影像大数据提供快速检测、分类和识别任务。

针对TCR上述3方面研究内容,下面结合神经计算、认知计算和并行计算相关技术,从遥感分类与识别的角度分析具体研究方向。

4.2.1基于异构混合并行的高性能遥感影像快速

目标检测处理

高性能并行计算技术,是提升遥感影像信息提取速度的重要途径。对于遥感影像的滤波、检测等处理,可采用图像分块等数据并行处理技术提升算法运行速度。对于复杂遥感影像处理算法,则可进一步考虑算法的任务并行性,合理设置任务并行粒度进行算法设计。

遥感影像并行处理可采用的面向多机并行处理系统[41]的MPI、面向多核并行处理系统[42]的多线程模式的OpenMP和面向GPU并行处理系统[43]的CUDA异构编程模式实现。MPI+OpenMP+CUDA 三级混合编程模型[44],是一种全新的多机、多核、

多

图2高分辨率遥感影像TCR问题的研究方向

Fig.2The research direction of high resolution remote sensing image of TCR

1085

地球信息科学学报2015年

线程、多GPU 混合异构的并行计算体系结构,具备计算能力强、性价比高和能耗低等优点,已逐渐成为新型高性能计算平台主流技术。目前,遥感影像并行研究大多集中在预处理算法方面,部分学者将GPU 技术应用到目标识别和分类中[45-46],将高性能并行计算运用到遥感影像处理是其发展趋势。

遥感影像处理系统性能提升的关键是并行体系结构的设计。文献[47]从系统结构、并行模型、数据分布策略和软件集成角度,阐述遥感应用并行计算的关键技术。针对大规模图像识别的监督和非监督子空间学习问题,文献[48]提出一种任务并行的子空间学习框架。遥感影像大数据并行计算研究的核心是大数据存储、并行处理和系统管理,具体存储方案可采用并行数据库[49]和流式数据访问模式的HDFS 等技术。由于图像矩阵的数据结构的可分块处理,非常易于运用Hadoop 相关MapRe-duce 技术进行图像的多机并行处理[50-53]。针对遥感大数据分块分布式存储方案,具备数据并行的特性,图3显示了一种基于Hadoop+OpenMP+CUDA 的高分遥感影像混合并行架构。

由于不同的并行处理算法在并行结构上差异性较大,造成并行程序通用性差,使TCR 并行算法设计存在一定困难。尽管采取“存储即计算”等策略,但频繁的进行多机之间、多核之间、GPU 之间,以及CPU 和GPU 之间的数据交互和通信开销,将严重影响系统的加速比和效率提升,目前尚无合理的通用解决方案。

4.2.2基于神经计算的多层次面向对象的高精度

目标识别

自1943年McCulloch 和Pitts 提出神经元模型,从感知机到BP 网络,ANN 发展几经波折。被称为第三代人工神经网络的大规模的脉冲神经网络

(Spiking Neural Networks ,SNN )

[54]

系统架构,具备低能耗、实时的多目标检测和分类能力。由于SNN 的信息处理不仅依据给定时间窗口内脉冲发放的数目(频率),而且考虑脉冲发放的时刻,使其可有效处理视听系统的时空变化信息。结合忆阻器的记忆特性和LIF 脉冲神经元,SNN 具备图像边缘提取[55]、视觉注意模拟[56]等能力。但SNN 训练目前主流是在BP 算法基础上改进的SpikeProp 算法,尚缺有效的算法进行网络训练[57]。

作为模拟人脑的分层结构的神经计算模型,深度学习构建多层神经网络来抽取目标特征[58],是TCR 重要研究方向。传统BP 算法对网络参数采用随机初始化,容易陷入局部极值和梯度弥散的训练失败问题。深度学习则能从原数据自动进行特征学习,通过多层非线性网络逼近复杂分类问题,从海量的大数据里寻找和发现图像目标的内部结构和关系。目前,深度学习算法在图像识别[59]和语音识别[60]等应用取得前所未有的成果。深度学习在TCR 的应用引起广泛重视,并在字符识别[61]、自然图像分类[62]、高光谱图像分类[63]等取得显著性成效。深度学习一般需海量的训练样本,才容易提取其特征,

这与遥感图像大数据的特性不谋而合。图

图3基于Hadoop+OpenMP+CUDA 的高分辨率遥感影像混合并行处理架构

Fig.3Hybrid parallel architecture of high resolution remote sensing image processing based on Hadoop+OpenMP+CUDA

1086

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展4显示了采用深度神经网络,进行遥感影像目标识别的深度学习算法设计方案。系统在做监督学习前,要先逐层做非监督学习,然后将非监督学习学到的权值当作监督学习的初值进行BP 算法训练。

神经计算在低级视觉研究取得一定成果,但在高级视觉和神经推理研究,以及高级视觉对中、低级视觉的反馈影响方面尚缺完善的模型。遥感影像内含大量语义信息,缺乏复杂图像结构的分析和表示,以及综合整体认知和局部分析的神经推理框架。仅靠现有神经计算技术无法整体实现图像理解的表示、存储、认知、学习、推理和理解等过程,必须和高层次的认知计算结合才能有效解决TCR 问题。4.2.3基于认知计算提升多尺度的遥感影像大数据

TCR 处理性能

认知计算作为借鉴人类的认知机理和模型的计算方法早已存在,但最近不断取得了突破。IBM 基于Deep QA 和迁移学习的Watson 系统[64]可模仿人脑的学习、思考和决策等认知过程,并可构成大数据分析处理的云计算服务系统。利用认知计算探索遥感影像大数据的特征表示,特性降维、信息提取,实现智能遥感影像智能解译,是当前遥感大数据研究的热点问题。认知理论和模型在医学影像解译、分析和推理取得满意的成果[65]。文献[66]认为地学认知问题是遥感地学理解和分析的核心,并给出遥感地学智能图解的层次化的认知模型。文献[67]采用K-Means 和K-SVD 算法的字典学习算法,解决了稀疏时空大数据的遥感分析问题。

基于图论和概率统计理论的PGM ,是复杂认知系统建模的有力工具。影像解译往往需要结合认知理论进行,统计学习认知模型的视觉认知计算系统,将有助于影像自动解译的理论研究和算法设

计。近年来,在影像自动解译有较大影响的PGM

类型有:主题模型、Gaussian 和Dirichlet 过程的层次Bayesian 模型。相关学者将主题模型中的LDA 模

型[18]、

pLSA [17]、ATM [68]等概率生成模型引入影像智能解译工作中。主题模型的一般方法是通过BoVW 模型来提取的遥感影像局部语义特征,统计分析遥感影像中的主题,利用贝叶斯推理达到影像解译分析的目的。图5给出了多尺度遥感影像基于层次主题模型(Hierarchical Topic Model ,HTM )的场景描

述方案,对不同尺度的遥感场景目标采用层次化的主题综合进行描述。其中,T 是场景层次结构的主题树,L 是场景层次标签树的高度,N 是在一个场景中的视词的个数,M 是在场景集合中场景的总个数,c i 是在层次结构中的第i 层,η、α和μci 是Dirichlet 先验参数,γ是在层次结构中的所有路径上的一个多项式分布,β是在词集上的多项式分布,θ是某个场景上的主题分布,w 是一个观察到的视词,z 是赋予给w 的主题。

遥感影像的地学属性具备复杂的不确定性的

层次语义,遥感影像所反映地学的对象信息不完备。现有的认知架构存在片面性和不完整性,尚缺乏针对遥感影像TCR 的认知模型。因此,考虑地学信息深层次规律、不完备的遥感影像信息和人类认知特性,建立合理的遥感影像认知计算模型,是实现遥感影像智能信息处理的一个挑战。

5结论

综上所述,国内外学者对遥感影像的TCR 开展了卓有成效的研究,

同时也在实际环境中构建了一

图4基于深度神经网络的多层次遥感影像目标识别Fig.4Multi-level remote sensing image target recognition

based on the deep neural

network

图5基于层次主题模型的多尺度遥感影像场景描述Fig.5Multi-scale remote sensing image scene description

based on hierarchical topic model

1087

地球信息科学学报2015年

些实用系统。由于遥感影像智能解译涉及的认知模型的复杂性、图像理解存在的困难和计算的复杂度,针对高分辨率遥感影像TCR研究,需构造适应多层次的场景认知模型,以适应系统功能需求;设计面向对象的多尺度的识别处理算法,以提升算法精度;需大幅度提升处理速度,以适应遥感影像大数据的任务实时性。进一步利用低层的神经计算机制和高层的认知计算架构,研究适应高分辨率遥感影像TCR问题的媒体神经认知计算(Multi-me-dia Neural and Cognitive Computing,MNCC)模型,构建并行的MNCC模型的遥感影像的TCR算法,具有重要理论意义和应用价值。

参考文献:

[1]郭华东,王力哲,陈方,等.科学大数据与数字地球[J].科学

通报,2014,59(12):1047-1054.

[2]李德仁,姚远,邵振峰.智慧城市中的大数据[J].武汉大学

学报(信息科学版),2014,39(6):631-640.

[3]李德毅,郑思仪.大数据时代的创新思维[J].北京联合大

学学报,2014,28(4):1-6.

[4]李小文.汶川震灾中遥感的应急与反思[J].遥感学报,

2008,12(6):838.

[5]Di Bisceglie M,Galdi C.CFAR detection of extended ob-

jects in high-resolution SAR images[J].IEEE Transac-tions on Geoscience and Remote Sensing,2005,43(4): 833-843.

[6]Zhao H Y,Wang Q,Huang J J,et al.Method for inshore

ship detection based on feature recognition and adaptive background window[J].Journal of Applied Remote Sens-ing,2014,8(1):1-14.

[7]冯卫东,孙显,王宏琦.基于空间语义模型的高分辨率遥

感图像目标检测方法[J].电子与信息学报,2013,35(10): 2518-2523.

[8]何楚,张宇,廖紫纤,等.基于分层自适应部分模型的遥感

图像飞机目标检测[J].武汉大学学报(信息科学版), 2013,38(6):656-660.

[9]蒋李兵,王壮,郁文贤.基于属性滤波和上下文分析的高

分辨遥感图像建筑物提取方法[J].电子与信息学报, 2012,34(12):2985-2991.

[10]李湘眷,孙显,王宏琦.基于多核学习的高分辨率遥感图

像目标检测方法[J].测绘科学,2013,38(5):84-87.

[11]Han J W,Zhou P C,Zhang D W,et al.Efficient,simulta-

neous detection of multi-class geospatial targets based on visual saliency modeling and discriminative learning of sparse coding[J].ISPRS Journal of Photogrammetry and Remote Sensing,2014,89(1):37-48.

[12]Zhang L F,Zhang L P,Tao D C,et al.Sparse Transfer

Manifold Embedding for Hyperspectral Target Detection [J].IEEE Transactions on Geoscience and Remote Sens-ing,2014,52(2):1030-1043.

[13]Bosch A,Zisserman A,Munoz X.Scene classification us-

ing a hybrid generative/discriminative approach[J].IEEE Transactions on Pattern Analysis and Machine Intelli-gence,2008,30(4):712-727.

[14]Zhao L J,Tang P,Huo L Z.A2-D wavelet decomposition-

based bag-of-visual-words model for land-use scene clas-sification[J].International Journal of Remote Sensing, 2014,35(6):2296-2310.

[15]Li J,Liu Z.The Study of Scene Classification in the Mul-

tisensor Remote Sensing Image Fusion[J].Mathematical Problems in Engineering,2013,2013(2013):1-10.

[16]Guo L,Chehata N,Mallet C,et al.Relevance of airborne

lidar and multispectral image data for urban scene classifi-cation using Random Forests[J].ISPRS Journal of Photo-grammetry and Remote Sensing,2011,66(1):56-66. [17]Cheng G,Guo L,Zhao T Y,et al.Automatic landslide de-

tection from remote-sensing imagery using a scene classi-fication method based on BoVW and pLSA[J].Interna-tional Journal of Remote Sensing,2013,34(1):45-59. [18]Zhao B,Zhong Y F,Zhang L P.Scene classification via la-

tent Dirichlet allocation using a hybrid generative/dis-criminative strategy for high spatial resolution remote sensing imagery[J].Remote Sensing Letters,2013,4(12): 1204-1213.

[19]Gong Y,Wang L,Guo R,et al.Multi-scale orderless pool-

ing of deep convolutional activation features[C].13th Eu-ropean Conference on Computer Vision(ECCV),SEP06-12,2014:392-407.

[20]Williams D P,Fakiris E.Exploiting environmental infor-

mation for improved underwater target classification in Sonar imagery[J].IEEE Transactions on Geoscience and Remote Sensing,2014,52(10):6284-6297.

[21]殷君君,安文韬,杨健.基于极化散射参数与Fisher-OPCE

的监督目标分类[J].清华大学学报(自然科学版),2011,1

(12):1782-1786.

[22]Marconcini M,Fernandez-Prieto D.A novel approach to

targeted land-cover classification of remote-sensing imag-es[C].2012IEEE International Geoscience and Remote Sensing Symposium,2012:7345-7348.

[23]He W,Zhou W,Su P.Research on Classification and Tar-

get Recognition of Remote Sensing Image Based on Im-proved Support Vector Machine[J].Remote Sensing In-formation,2010(6):6-8,13.

[24]Dai D X,Yang W.Satellite Image Classification via two-

layer sparse coding with biased image representation[J].

1088

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展

IEEE Geoscience and Remote Sensing Letters,2011,8(1): 173-176.

[25]Luo L,Hu Y.Explorations on object-oriented classifica-

tion for ground targets from high-resolution image[C].

International Forum on Information Technology and Ap-plications(IFITA2009),2009:139-143.

[26]李雪轲,王晋年,张立福,等.面向对象的航空高光谱图像

混合分类方法[J].地球信息科学学报,2014,16(6):941-948.

[27]Blaschke T,Hay G J,Kelly M,et al.Geographic object-

based image analysis-towards a new paradigm[J].ISPRS Journal of Photogrammetry and Remote Sensing,2014,87

(1):180-191.

[28]李德仁,童庆禧,李荣兴,等.高分辨率对地观测的若干前

沿科学问题[J].中国科学:地球科学,2012,42(6):805-813.

[29]Zhang L F,Zhang L P,Tao D C,et al.A multifeature ten-

sor for remote-sensing target recognition[J].IEEE Geosci-ence and Remote Sensing Letters,2011,8(2):374-378. [30]Guo W Y,Xia X Z,Wang X F.A remote sensing ship rec-

ognition method based on dynamic probability generative model[J].Expert Systems with Applications,2014,41(14): 6446-6458.

[31]丁正虎,余映,王斌,等.选择性视觉注意机制下的多光谱

图像舰船检测[J].计算机辅助设计与图形学学报,2011, 23(3):419-425.

[32]Lu C Y,Zou H X,Sun H,et https://www.doczj.com/doc/d5540467.html,bing rough set and

RBF neural network for large-scale ship recognition in optical satellite images[J].35th International Symposium on Remote Sensing of Environment(ISESE35),2014,17

(1):1-6.

[33]Prasad S,Bruce L M.Decision fusion with confidence-

based weight assignment for hyperspectral target recogni-tion[J].IEEE Transactions on Geoscience and Remote Sensing,2008,46(5):1448-1456.

[34]Sun J D,Fan G L,Yu L J,et al.Concave-convex local bi-

nary features for automatic target recognition in infrared imagery[J].Eurasip Journal on Image and Video Process-ing,2014,2014(23):1-13.

[35]Wang M G,Tian Y G.Target recognition of infrared

bridge image based on morphological operator[C].Inter-national Conference on Advances in Engineering(ICAE), 2011:490-494.

[36]Lang H T,Zhang J,Zhang T,et al.Hierarchical ship de-

tection and recognition with high-resolution polarimetric synthetic aperture radar imagery[J].Journal of Applied Remote Sensing,2014,8(1):1-17.

[37]Bryner D,Srivastava A.Shadow segmentation in SAS

and SAR using bayesian elastic contours[C].2013IEEE

Conference on Computer Vision and Pattern Recognition Workshops(CVPRW),2013:375-380.

[38]Lopera O,Dupont Y.Automated target recognition with

SAS:Shadow and highlight-based classification[C].

2012Oceans,2012:1-5.

[39]Isaacs J C,Tucker J D.Signal diffusion features for auto-

matic target recognition in synthetic aperture sonar[C].

Digital Signal Processing Workshop and IEEE Signal Pro-cessing Education Workshop(DSP/SPE),2011IEEE, 2011:461-465.

[40]Fei T,Kraus D,Zoubir A M.Contributions to automatic

target recognition systems for underwater mine classifica-tion[J].IEEE Transactions on Geoscience and Remote Sensing,2015,53(1):505-518.

[41]Wang X Y,Li Z H,Gao S.Parallel remote sensing image

processing:Taking image classification as an example

[C].6th International Symposium,ISICA2012,October

27-28,2012:159-169.

[42]Yang J H,Zhang J X,Huang G M.A parallel computing

paradigm for pan-sharpening algorithms of remotely sensed images on a multi-core computer[J].Remote Sens-ing,2014,6(7):6039-6063.

[43]Qu H C,Zhang J P,Chen Y S,et al.Parallel implementa-

tion for SAM algorithm based on GPU and distributed computing[C].2012IEEE International Geoscience and Remote Sensing Symposium(IGARSS),2012:4074-4077.

[44]Yang C T,Huang C L,Lin C F.Hybrid CUDA,OpenMP,

and MPI parallel programming on multicore GPU clusters [J].Computer Physics Communications,2011,182(1):266-269.

[45]Timchenko L,Yarovyy A,Kokriatskaia N,et al.Applica-

tion of parallel-hierarchical transformations for rapid rec-ognition of dynamic images based on GPU technology

[C].Proceedings of the2nd International Conference on

Advances in Computer Science and Engineering(CSE 2013),2013:224-228.

[46]Chen H,Liu X Y,Shao S,et al.A GPU-paralleled imple-

mentation of an enhanced face recognition algorithm[C].

Proc.SPIE8783,Fifth International Conference on Ma-chine Vision(ICMV2012):Computer Vision,Image Analysis and Processing,2013:1-10.

[47]Li G Q,Liu D S.Key technologies research on building a

cluster-based parallel computing system for remote sens-ing[C].Computational Science-ICCS2005,Pt3,2005: 484-491.

[48]Jing X Y,Li S,Zhang D,et al.Supervised and unsuper-

vised parallel subspace learning for large-scale image rec-ognition[J].IEEE Transactions on Circuits and Systems

1089

地球信息科学学报2015年

for Video Technology,2012,22(10):1497-1511.

[49]王珊,王会举,覃雄派,等.架构大数据:挑战、现状与展望

[J].计算机学报,2011,34(10):1741-1752.

[50]Taylor R C.An overview of the Hadoop/MapReduce/

HBase framework and its current applications in bioinfor-matics[C].Proceedings of the11th Annual Bioinformat-ics Open Source Conference(BOSC)2010,July2010:1-6.

[51]Dean J,Ghemawat S.MapReduce:A flexible data pro-

cessing tool[J].Communications of the ACM,2010,53(1): 72-77.

[52]Lv Z H,Hu Y J,Zhong H D,et al.Parallel K-means clus-

tering of remote sensing images based on MapReduce

[C].Web Information Systems and Mining2010,October

23-24,2010:162-170.

[53]李帆,何洪林,任小丽,等.基于MapReduce的空间敏感性

分析并行算法设计[J].地球信息科学学报,2014,16(6): 874-881.

[54]Ghosh-Dastidar S,Adeli H.Spiking neural networks[J].

International Journal of Neural Systems,2009,9(4):295-308.

[55]Liu Y D,Wang L M.Application of memristor-based spik-

ing neural network in image edge extraction[J].Acta Physica Sinica,2014,63(8):1-7.

[56]Wu Q X,McGinnity T M,Maguire L,et al.A visual atten-

tion model based on hierarchical spiking neural networks [J].Neurocomputing,2013,116(1):3-12.

[57]蔺想红,张田文,张贵仓.进化大规模脉冲神经网络的发

育方法[J].计算机学报,2012,35(12):2633-2644.

[58]Lee H,Grosse R,Ranganath R,et al.Unsupervised learn-

ing of hierarchical representations with convolutional deep belief networks[J].Communications of the ACM, 2011,54(10):95-103.

[59]Le Q V,Ranzato M A,Monga R,et al.Building high-lev-

el features using large scale unsupervised learning[C].

2013IEEE International Conference on Acoustics, Speech,and Signal Processing(ICASSP),2013:8595-

8598.

[60]Dahl G E,Yu D,Deng L,et al.Context-dependent pre-

trained deep neural networks for large-vocabulary speech recognition[J].IEEE Transactions on Audio,Speech,and Language Processing,2012,20(1):30-42.

[61]Masci J,Meier U,Ciresan D,et al.Stacked convolutional

auto-encoders for hierarchical feature extraction[C].Arti-ficial Neural Networks and Machine Learning-ICANN 2011,Pt I,2011:52-59.

[62]Smirnov E A,Timoshenko D M,Andrianov S https://www.doczj.com/doc/d5540467.html,par-

ison of regularization methods for ImageNet classifica-tion with deep convolutional neural networks[C].2nd AASRI Conference on Computational Intelligence and Bioinformatics(CIB),2014:89-94.

[63]Chen Y S,Lin Z H,Zhao X,et al.Deep learning-based

classification of hyperspectral data[J].IEEE Journal of Selected Topics in Applied Earth Observations and Re-mote Sensing,2014,7(6):2094-2107.

[64]Gondek D C,Lally A,Kalyanpur A,et al.A framework

for merging and ranking of answers in DeepQA[J].IBM Journal of Research and Development,2012,56(3-4):1-12.

[65]Ogiela L,Ogiela M R,Tadeusiewicz R.Ubiquitous com-

puting in creation of cognitive systems for medical imag-es interpretation[C].International Conference on Ubiqui-tous Computing and Multimedia Applications,JUN23-25,2010:44-50.

[66]骆剑承.遥感影像智能图解及其地学认知问题探索[J].

地理科学进展,2000,19(4):289-296.

[67]Wang L Z,Lu K,Liu P,et al.IK-SVD:Dictionary learn-

ing for spatial big data via incremental atom update[J].

Computing in Science&Engineering,2014,16(4):41-52.

[68]Luo W,Li H L,Liu G H.Automatic annotation of multi-

spectral satellite images using author-topic Model[J].

IEEE Geoscience and Remote Sensing Letters,2012,9(4): 634-638.

1090

9期刘扬等:高分辨率遥感影像目标分类与识别研究进展

1091

Review on High Resolution Remote Sensing Image

Classification and Recognition

LIU Yang1,2,3,FU Zhengye4and ZHENG Fengbin2,3*

(1.College of Environment and Planning,Henan University,Kaifeng475004,China;https://www.doczj.com/doc/d5540467.html,boratory of Spatial Information

Processing,Henan University,Kaifeng475004,China;3.College of Computer Science and Information Engineering,Henan University,Kaifeng475004,China;4.College of Software,Henan University,Kaifeng4750041,China)

Abstract:Target classification and recognition(TCR)of high resolution remote sensing image is an important approach of image analysis,for the understanding of earth observation system(EOS),and for extracting information from the automatic target recognition(ATR)system,which has important values in military and civil fields.This paper reviews the latest progress and key technologies between domestic and international remote sensing image TCR in optical,infrared,synthetic aperture radar(SAR)and synthetic aperture sonar(SAS).The main research levels and the contents of high resolution remote sensing image TCR are firstly discussed.Then, the key technologies and their existing problems of high resolution remote sensing image TCR are deeply analyzed,from aspects such as filtering and noise reduction,feature extraction,target detection,scene classification,target classification and target recognition.Finally,combined with the related technologies including parallel computing,neural computing and cognitive computing,the new methods of TCR are discussed.Specifically,the main framework includes three aspects,which are detailed in the following.Firstly, the predominant techniques of high resolution remote sensing image processing are discussed based on high performance parallel computing.And the hybrid parallel architecture of high resolution remote sensing image processing based on Apache Hadoop,open multi-processing(OpenMP)and compute unified device architecture (CUDA)are also presented in this paper.Secondly,application prospects of TCR accuracy promotion are analyzed based on a thorough study of neuromorphic computing,and the method of multi-level remote sensing image target recognition based on the deep neural network(DNN)is introduced.Thirdly,the model and algorithm of big data uncertainty analysis for remote sensing images are discussed based on probabilistic graphical model(PGM)of cognitive computing,and the multi-scale remote sensing image scene description is given based on hierarchical topic model(HTM).Moreover,according to the related research of multi-media neural cognitive computing(MNCC),we discuss the development trend and research direction of TCR for remote sensing images big data in the future.

Key words:target classification and recognition;multi-media neural and cognitive computing;parallel comput-ing;deep learning;topic model

*Corresponding author:ZHENG Fengbin,E-mail:zhengfb@https://www.doczj.com/doc/d5540467.html,

北京揽宇方圆信息技术有限公司 常见国产卫星遥感影像数据的简介 本文介绍了常见国产卫星数据的简介、数据时间、传感器类型、分辨率等情况。 中国资源卫星应用中心产品级别说明 ◆1A级和1C级产品均为相对辐射校正产品,只是不同卫星选用的生产参数不同。 ◆2级,2A级和2C级产品均为系统几何校正产品,只是不同卫星选用的生产参数不同。 其中: ■GF-1卫星和ZY3卫星归档产品为1A级,ZY1-02C卫星数据归档产品级别为1C级,其他卫星归档级别为2级! ◆归档产品是指:该类产品已经存在于系统中,仅需要从存储系统中迁移出来.即可供用户下载的数据。 ◆生产产品是指:该类产品不是已经存在的产品,需要对原始数据产品进行生产,然后再提供给用户下载的数据。

■当用户需要的产品级别是上述归档的级别,直接选择相应的产品级别,然后查询即可! ■当用户需要的产品级别不是上述归档的级别,就需要进行生产.本系统提供GF-1卫星和ZY3卫星2A级的生产产品,ZY1-02C卫星2C级的生产产品,在选择需要的级别查询后,无论有没有数据,在查询结果页上方有一个“查询0级景”按钮,点击此按钮后,进行数据查询,如果有数据,选择需要的产品直接订购,即可选择需要的产品级别。 国产卫星 一、GF-3(高分3号) 1.简介 2016年8月10日6时55分,高分三号卫星在太原卫星发射中心用长征四号丙运载火箭成功发射升空。 高分三号卫星是中国高分专项工程的一颗遥感卫星,为1米分辨率雷达遥感卫星,也是中国首颗分辨率达到1米的C频段多极化合成孔径雷达(SAR)成像卫星,由中国航天科技集团公司研制。 2.数据时间 2016年8月10日-现在 3.传感器 SAR:1米 二、ZY3-02(资源三号02星) 1.简介 资源三号02星(ZY3-02)于2016年5月30日11时17分,在我国在太原卫星发射中心用长征四号乙运载火箭成功将资源三号02星发射升空。这将是我国首次实现自主民用立体测绘双星组网运行,形成业务观测星座,

遥感图像目标地物识别特征: (1)色调:全色遥感图像中从白到黑的密度比例叫色调(也叫灰度)。 如海滩的砂砾色调标志是识别目标地物的基本依据,依据色调标志,可以区分出目标地物。 (2)颜色:是彩色遥感图像中目标地物识别的基本标志。日常生活中目标地物的颜色:遥感图像中目标地物的颜色:地物在不同波段中反射或发 射电磁辐射能量差异的综合反映。彩色遥感图像上的颜色:真\假彩色。真彩色图像上地物颜色能真实反映实际地物颜色特征,符合人的认知习惯。 目视判读前, 需了解图像采用哪些波段合成,每个波段分别被赋予何种颜色。 (3)阴影:遥感图像上光束被地物遮挡而产生的地物的影子。根据阴影形状、大小可判读物体的性质或高度。不同遥感影像中阴影的解译是不同的。(4)形状:目标地物在遥感图像上呈现的外部轮廓。遥感图像上目标地物形状:顶视平面图。解译时须考虑遥感图像的成像方式。 (5)纹理(texture):内部结构,指遥感图像中目标地物内部色调有规则变化造成的影像结构。如航空像片上农田呈现的条带状纹理。纹理可以作为区别地物属性的重要依据。 (6)大小:指遥感图像上目标物体的形状、面积与体积的度量。判读地物大小时必须考虑图像的比例尺。影响图像上物体大小的因素有地面分辨 率,物体本身亮度与周围亮度的对比关系。 (7)位置:只目标地物分布的地点。位置分为地理位置、相对位置。依据遥感图像周框注记的地理经纬度位置,可以推断出区域所处的温度带,依据相对位置,可以为具体目标地物解译提供重要判据。

(8)图型:目标地物有规律的排列而成的图形结构。 (9)相关布局:多个目标地物只讲的空间配置关系。可以推断目标地物的属性。

摘要 在面向对象的影像分类方法中,首先需要将遥感影像分割成有意义的影像对象集合,进而在影像对象的基础上进行特征提取和分类。本文针对面向对象影像分类思想的关键环节展开讨论和研究,(1) 采用基于改进分水岭变换的多尺度分割算法对高分辨率遥感影像进行分割。构建了基于高斯尺度金字塔的多尺度视觉单词,并且通过实验证明其表达能力优于经典的词包表示。最后,在词包表示的基础上,利用概率潜在语义分析方法对同义词和多义词较强的鉴别能力对影像对象进行分析,找出其最可能属于的主题或类别,进而完成影像的分类。 近些年来,随着航空航天平台与传感器技术的高速发展,获取的遥感影像的分辨率越来越高。高分辨率遥感影像在各行业部门的应用也越来越广泛,除了传统的国土资源、地质调查和测绘测量等部门,还涉及到城市规划、交通旅游和环境生态等领域,极大地拓展了遥感影像的应用范围。因此,对高分辨率遥感影像的处理分析成为备受关注的领域之一。高分辨率遥感影像包括以下三种形式:高空间分辨率(获取影像的空间分辨率从以前的几十米提高到1 至5 米,甚至更高);高光谱分辨率(电磁波谱被不断细分,获取遥感数据的波段数从几十个到数百个);高时间分辨率(遥感卫星的回访周期不断缩短,在部分区域甚至可以连续观测)。本文所要研究的高分辨率遥感影像均是指“高空间分辨率”影像。 相对于中低分辨率的遥感数据,高空间分辨率遥感影像具有更加丰富的空间结构、几何纹理及拓扑关系等信息,对认知地物目标的属性特征更加方便,如光谱、形状、纹理、结构和层次等。另外,高分辨率遥感影像有效减弱了混合像元的影响,并且能够在较小的空间尺度下反映地物特征的细节变化,为实现更高精度的地物识别和分类提供了可能。 然而,传统的遥感影像分析方法主要基于“像元”进行,它处于图像工程中的“图像处理”阶段(见图1-1),已然不能满足当今遥感数据发展的需求。基于“像元”的高分辨率遥感影像分类更多地依赖光谱特征,而忽视影像的纹理、形状、上下文和结构等重要的空间特征,因此,分类结果会产生很严重的“椒盐(salt and pepper)现象”,从而影响到分类的精度。虽然国内外的很多研究人员针对以上缺陷提出了很多新的方法,如支持向量机(Support Vector Machine,SVM) 、纹理聚类、分层聚类(Hierarchical Clustering) 、神经网络(Neural Network, NN)等,但仅依靠光谱特征的基于像元的方法很难取得更好的分类结果。基于“像元”的传统分类方法还有着另一个局限:无法很好的描述和应用地物目标的尺度特征,而多尺度特征正是遥感信息的基本属性之一。由于在不同的空间尺度上,同样的地表空间格局与过程会表现出明显的差异,因此,在单一尺度下对遥感影像进行分析和识别是不全面的。为了得到更好的分类结果,需要充分考虑多尺度特征。 针对以上问题,面向对象的处理方法应运而生,并且逐渐成为高空间分辨率遥感影像分析和识别的新途径。所谓“面向对象”,即影像分析的最小单元不再是传统的单个像元,而是由特定像元组成的有意义的同质区域,也即“对象”;因此,在对影像分析和识别的过程

摘要 现代遥感技术的快速发展使人类能够更精准、更快速、更全面地观测世界。遥感成像传感器的高度及搭载平台姿态的变化、地形地貌等诸多客观因素都会导致图像发生几何畸变,给进一步应用带来一系列问题。随着遥感对地观测能力不断增强,如何对遥感数据进行精确几何处理实现高精度地理空间信息获取,是有效发挥遥感对地观测优势的基础。因此,开展遥感图像的高精度几何校正理论与方法的研究,提高遥感数据中目标定位识别的应用潜力,将刻不容缓。然而随着遥感系统的多样化、多层次发展,其不同的成像特点也给遥感图像几何处理技术提出了更多新的要求和挑战,传统的几何校正技术不再适用,需根据具体成像特点进行开发和扩展。鉴于遥感对地观测的高标准应用需求,本文对遥感图像几何校正及目标识别技术理论和方法进行研究,旨在将遥感图像的几何校正后,最终提高遥感目标定位识别应用的精度。 关键词:遥感图像;几何变形;变形误差;几何校正;目标识别

摘要 (1) 目录 (2) 1引言 (3) 2 遥感成像原理及遥感图像特征 (4) 2.1 遥感成像原理 (4) 2.2 遥感图像特征 (4) 3 遥感图像产生的几何畸变的分析 (5) 3.1 成像投影方式引起的误差计算 (5) 3.2 传感器外方位元素变化引起的误差计算 (6) 3.3 大气折射引起的误差计算 (6) 4 遥感图像几何校正的研究方法 (7) 4.1 从影像到地图的校正 (8) 4.2 从影像到影像的配准 (8) 5遥感图像的目标识别技术 (8) 5.1基于相位一致特征和混沌粒子群的大型目标识别 (8) 5.2 基于改进多尺度自卷积不变矩的小型目标识别 (10) 6 结论 (11) 参考文献 (11) 致谢 (12)

北京揽宇方圆信息技术有限公司 常用的遥感卫星影像数据有哪些 公司拥有WorldView、QuickBird、IKONOS、GeoEye、SPOT、高分一号、资源三号等卫星的代理权,与国内多家遥感影像一级代理商长期合作,能够为客户提供全天候、全覆盖、多分辨率、多尺度的影像产品 WorldView,分辨率0.5米 WorldView卫星系统由两颗(WorldView-I和WorldView-II)卫星组成。WorldView-I全色成像系统每天能够拍摄多达50万平方公里的0.5米分辨率图像,并具备现代化的地理定位精度能力和极佳的响应能力,能够快速瞄准要拍摄的目标和有效地进行同轨立体成像。WorldView-II多光谱遥感器具有8个波段,平均重访周期为一天,每天采集能力达到97.5万平方公里。

QuickBird,分辨率0.61米 QuickBird具有较高的地理定位精度,每年能采集7500万平方公里的卫星影像数据,在中国境内每天至少有2至3个过境轨道,有存档数据约500万平方公里,重访周期为1-6天,每天采集能力达到21万平方公里。 IKONOS,分辨率0.8米 IKONOS卫星是世界上第一颗高分辨率卫星,开启了商业高分辨率卫星的新时代,同时也创立了全新的商业化卫星影像标准。全色影像分辨率达到了0.8米,多光谱影像分辨率4米,平均重访周期3天。

Geoeye,分辨率0.41米 GeoEye-1卫星具有分辨率最高、测图能力极强、重返周期极短的特点。全色影像分辨率达到了0.41米,多光谱影像分辨率1.65米,定位精度达到3米,重访周期2-3天,每天采集能力70万平方公里。

北京揽宇方圆信息技术有限公司 高分辨率遥感卫星有哪些 高分辨率遥感可以以米级甚至亚米级空间分辨率精细观测地球,所获取的高空间分辨率遥感影像可以清楚地表达地物目标的空间结构与表层纹理特征,分辨出地物内部更为精细的组成,地物边缘信息也更加清晰,为有效的地学解译分析提供了条件和基础。随着高分辨率遥感影像资源日益丰富,高分辨率遥感在测绘制图、城市规划、交通、水利、农业、林业、环境资源监测等领域得到了飞速发展。 北京揽宇方圆信息技术有限公司是国内的领先遥感卫星数据机构,而且是整合全球的遥感卫星数据资源,分发不同性能、技术应用上可以互补的多种卫星影像,包括光学、雷达卫星影像、历史遥感影像等各种卫星数据服务,各种专业应用目的的图像处理、解译、顾问服务以及基于卫星影像的各种解决方案等。遥感卫星影像数据贯穿中国1960年至今的所有卫星影像数据,是中国遥感卫星数据资源最多的专业遥感卫星数据服务机构,提供多尺度、多分辨率、全覆盖的遥感卫星影像数据服务,最大限度的保证了遥感影像数据获取的及时性和完整性。 一、卫星类型 (1)光学卫星:worldview1、worldview2、worldview3、worldview4、quickbird、geoeye、ikonos、pleiades、deimos、spot1、kompsat系例、spot2、spot3、spot4、spot5、spot6、spot7、landsat5(tm)、Sentinel-卫星、landsat(etm)、rapideye、alos、kompsat系例卫星、planet卫星、北京二号、高景一号、资源三号、高分一号、高分二号、环境卫星。 (2)雷达卫星:terrasar-x、radarsat-2、alos雷达卫星、高分三号卫星、哨兵卫星 (3)侦查卫星:美国锁眼卫星全系例(1960-1980) 二、卫星分辨率 (1)0.3米:worldview3、worldview4 (2)0.4米:worldview3、worldview2、geoeye、kompsat-3A (3)0.5米:worldview3、worldview2、geoeye、worldview1、pleiades

xx遥感影像解译服务一、项目内容 本项目包括两部分内 容,一是对 xx遥感影像解译服务 一、项目内容 本项目包括两部分内容,一是对广州市2M高分辨率多光谱原始数据进行相关技术处理,包括正射校正、融合、匀色、镶嵌、裁切等,最终得出DOM成果;二是在上述2M高分辨率影像数据处理成果基础上,勾画广州市土地利用类型图斑,并利用专业GIS软件进一步处理,形成广州市土地利用现状类型图成果。 二、关键技术指标要求 1)影像分辨率2米,波段组合色彩为自然真彩色; 2)影像时间:2015年1月以后拍摄的影像数据,少部分遥感影像未拍到的地方,可用2014年12月以前的数据填补,但所占面积比例不能超过广州市区域面积的10%,色彩要与相邻区域一致。为使影像色彩一致,原则上要求采用同一卫星的影像数据; 3)数据制作精度满足1:1万比例尺要求; 4)分幅方式按广州市1:1万比例尺地形图分幅编号法分幅; 5)影像和土地利用现状图坐标:WGS84; 6)影像数据格式TIF和SID,土地利用现状图数据格式: shape格式;7)数据要求色彩清晰、层次丰富、反差适中、彩色色彩柔和鲜艳、色彩均匀,相同地物的色彩基调基本一致。正射影像接边重叠带不允许出现明显的模糊和重影,相邻数字正射影像要严格接边,精度满足规范要求。 三、xx影像数据制作加工要求

1.制图须符合国家有关技术标准和规范。 2.投标人提供的影像成果须经正射纠正,航空影像正射纠正技术流程要详细,有正射纠正的原理和具体方法,有正射纠正的工艺流程图。 3.投标人有专业遥感影像处理软件,可用软件提供的正射纠正模块进行纠正。逐张卫片处理,生成具有坐标系统和投影信息的正射影像,检验图像校正的结果是否满足要求,直至满足要求。 4.对遥感数据制作数字正射影像地图,采用满足成图比例尺精度要求的控制资料,基于适宜分辨率的数字高程模型(DEM),对卫星影像进行正射纠正、配准、融合、镶嵌,建立覆盖广州全市域范围的数字正射影像;按相应比例尺分幅整饰,制作成遥感数字正射影像图(DOM)。 5.利用成像的卫星轨道参数、传感器参数及DEM,对影像进行严密的物理 模型纠正。要求控制点均匀分布、控制整景影像,平原地区布设4个控制点,高山地控制点个数不应少于12个。对于没有影像卫星轨道参数、传感器参数地区,可采用多项式变换几何模型进行纠正。6.图幅整饰:在标准分幅的数字正射影像上分层叠加内外图廓线及公里格 网、注记、境界等要素,进行图幅整饰。其中,图廓整饰包括图名、图号、图幅行政区划注记、公里格网、图幅结合表、比例尺、左下角的出版说明注记等;行政境界包括镇级以上行政境界;注记包括居民点自然村注记、主要河流水系、大型山脉等其它地理名称。 7.对数字正射影像成果的检查包括:作业过程是否满足控制点、配准点、检查点残差和中误差的精度要求;DOM影像是否色调均匀、反差适中、色彩自然;相邻景/块之间接边差是否在控制点残差的两倍以内,是否存在扭曲变形现象;外业检测DOM精度是否符合要求;整饰内容是否准确、完整;图面要素表达是否符合规定;元数据文件各项内容填写是否完备、准确;文件命名、文件组织与数据格式是否符合规范;上交成果内容是否完备、数据的一致性、完整性及其是否可读。 四、广州市土地利用现状分布图制作处理要求

遥感图像分类方法的国内外研究现状与发展趋势

遥感图像分类方法的研究现状与发展趋势 摘要:遥感在中国已经取得了世界级的成果和发展,被广泛应用于国民经济发展的各个方面,如土地资源调查和管理、农作物估产、地质勘查、海洋环境监测、灾害监测、全球变化研究等,形成了适合中国国情的技术发展和应用推广模式。随着遥感数据获取手段的加强,需要处理的遥感信息量急剧增加。在这种情况下,如何满足应用人员对于大区域遥感资料进行快速处理与分析的要求,正成为遥感信息处理面临的一大难题。这里涉及二个方面,一是遥感图像处理本身技术的开发,二是遥感与地理信息系统的结合,归结起来,最迫切需要解决的问题是如何提高遥感图像分类精度,这是解决大区域资源环境遥感快速调查与制图的关键。 关键词:遥感图像、发展、分类、计算机 一、遥感技术的发展现状 遥感技术正在进入一个能够快速准确地提供多种对地观测海量数据及应用研究的新阶段,它在近一二十年内得到了飞速发展,目前又将达到一个新的高潮。这种发展主要表现在以下4个方面: 1. 多分辨率多遥感平台并存。空间分辨率、时间分辨率及光谱分辨率普遍提高目前,国际上已拥有十几种不同用途的地球观测卫星系统,并拥有全色0.8~5m、多光谱3.3~30m的多种空间分辨率。遥感平台和传感器已从过去的单一型向多样化发展,并能在不同平台

上获得不同空间分辨率、时间分辨率和光谱分辨率的遥感影像。民用遥感影像的空间分辨率达到米级,光谱分辨率达到纳米级,波段数已增加到数十甚至数百个,重复周期达到几天甚至十几个小时。例如,美国的商业卫星ORBVIEW可获取lm空间分辨率的图像,通过任意方向旋转可获得同轨和异轨的高分辨率立体图像;美国EOS卫星上的MOiDIS-N传感器具有35个波段;美国NOAA的一颗卫星每天可对地面同一地区进行两次观测。随着遥感应用领域对高分辨率遥感数据需求的增加及高新技术自身不断的发展,各类遥感分辨率的提高成为普遍发展趋势。 2. 微波遥感、高光谱遥感迅速发展微波遥感技术是近十几年发展起来的具有良好应用前景的主动式探测方法。微波具有穿透性强、不受天气影响的特性,可全天时、全天候工作。微波遥感采用多极化、多波段及多工作模式,形成多级分辨率影像序列,以提供从粗到细的对地观测数据源。成像雷达、激光雷达等的发展,越来越引起人们的关注。例如,美国实施的航天飞机雷达地形测绘计划即采用雷达干涉测量技术,在一架航天飞机上安装了两个雷达天线,对同一地区一次获取两幅图像,然后通过影像精匹配、相位差解算、高程计算等步骤得到被观测地区的高程数据。高光谱遥感的出现和发展是遥感技术的一场革命。它使本来在宽波段遥感中不可探测的物质,在高光谱遥感中能被探测。高光谱遥感的发展,从研制第一代航空成像光谱仪算起已有二十多年的历史,并受到世界各国遥感科学家的普遍关注。但长期以来,高光谱遥感一直处在以航空为基础的研究发展阶段,且主要

北京揽宇方圆信息技术有限公司 Planet卫星高频率中高分遥感影像 北京揽宇方圆Planet卫星群目前有170多颗卫星,分辨率为3-4米,另有13颗8波段卫星在建。该星群最大特点是每天对全球陆地和重点海域进行自主采集,实现每日全球3.6亿平方公里的覆盖,这使得Planet公司在全球高频次中高分卫星遥感影像服务上独占鳌头,能够帮助用户实现真正实用意义上的“遥感卫星监测”。Planet公司高频率中高分遥感影像,适用于对目标区域进行时间序列动态监测的卫星遥感用户,如区域资源环境动态变化、农作物全生长周期、特殊目标动向、灾害应急、热点地区、热点事件等监 测。 北京揽宇方圆信息技术有限公司是国内的领先遥感卫星数据机构,而且是整合全球的遥感卫星数据资源,分发不同性能、技术应用上可以互补的多种卫星影像,包括光学、雷达卫星影像、历史遥感影像等各种卫星数据服务,各种专业应用目的的图像处理、解译、顾问服务以及基于卫星影像的各种解决方案等。遥感卫星影像数据贯穿中国1960年至今的所有卫星影像数据,是中国遥感卫星数据资源最多的专业遥感卫星数据服务机构,提供多尺度、多分辨率、全覆盖的遥感卫星影像数据服务,最大限度的保证了遥感影像数据获取的及时性和完整性。 优势:

1:北京揽宇方圆国内老牌卫星数据公司,经营时间久,行业口碑相传,1800个行业用户选择的实力见证。 2:北京揽宇方圆遥感数据购买专人数据查询一对一服务,数据查询网址是卫星公司网。 3:北京揽宇方圆拥有大型正版遥感处理软件,遥感数据处理工程师有10年以上遥感处理工作经验,并有国家大型项目工作经验自主卫星数据处理软件著作权,最大限度保持遥感卫星影像处理的真实度。 4:北京揽宇方圆国家高新技术企业,通过ISO900认证的国际质量管理操作体系,无论是遥感卫星品质和遥感数据处理质量,都能得到保障。 5:影像数据官方渠道:所有的卫星数据都是卫星公司授权的原始数据,全球公众数据查询网址公开查询,影像数据质量一目了然,数据反应客观公正实事求是,数据处理技术团队国标规范操作,提供的是行业优质的专业化服务。 6:签定正规合同:影像数据服务付款前,买卖双方须签订服务合同,提供合同相应的正规发票,发票国家税网可以详细查询,有增值税普通发票和增值税专用发票两种发票类型可供选择。以最有效的法律手段来保障您的权益。 7:对公帐号转款:合同约定的对公帐号,与合同主体名发票上面的帐号名称一致,是由工商行政管理部门核准的公司银行账户,所有交易记录均能查询,保障资金安全。 8:售后服务:完善的售后服务体制,全国热线,登陆官网客服服务同步。 北京揽宇方圆信息技术有限公司

龙源期刊网 https://www.doczj.com/doc/d5540467.html, 遥感图像目标识别文献综述 作者:谭博彦 来源:《电脑知识与技术》2016年第35期 摘要:随着科学技术的不断发展,特别是遥感技术的飞速发展,遥感图像的分辨率越来越高,其包含的信息也越来越复杂,因此,迫切需要发展感兴趣目标自动识别技术。精确识别对象对民用导航、环境保护、军事等各个方面意义重大,提高对象的自动识别精度也是不可缺少的。本文通过查阅分析遥感图像识别的文献资料,对目标识别使用的一些基本理论和方法进行了综合归纳。 关键词:遥感图像;目标识别;综述 中图分类号:TP311 文献标识码:A 文章编号:1009-3044(2016)35-0206-03 A Literature Review on Remote Sensing Image Target Recognition TAN Bo-yan (Class 1422 The 1st Middle School of Loudi, Loudi 417000 China) Abstract:With the continuous development of science and technology, Especially the rapid development of remote sensing technology, The resolution of the remote sensing images is higher and higher, it contains information is becoming more and more complex, therefore, an urgent need to develop interest in automatic target recognition technology. Accurately identify the object is of great significance to civil navigation, environment protection, military and other various aspects, to improve the automatic identification precision of the object is also indispensable. This article through the analysis of remote sensing image recognition of the literature, the target recognition using some of the basic theory and method are summarized. Key words:remote sensing image; target recognition; literature review 目标识别是计算机视觉、图像处理和机器学习中的重要研究课题之一。目前,目标识别的技术已经广泛应用在各个领域中,近些年来其在遥感图像中的应用也越来越普遍。对遥感图像进行精确地目标识别,一直是计算机图像识别中的一个难题,且随着遥感技术的迅速发展,其也成了该领域一个重要研究方向。精确定位遥感图像中的感兴趣目标,同时提取其状态参数和属性值,是遥感图像目标识别的基本任务。该任务需要经过地学、生物学、物候学等综合性的专家知识指导,运用信息科学和数学等一系列方法来实现简单地电磁辐射特性的记录,到地物时空分布变化的反演,这是一个非常典型的交叉学科问题[1]。

北京揽宇方圆信息技术有限公司 遥感卫星影像辐射校正和大气校正的方法 辐射校正是指对由于外界因素,数据获取和传输系统产生的系统的、随机的辐射失真或畸变进行的校正,消除或改正因辐射误差而引起影像畸变的过程。 利用传感器观测目标的反射或辐射能量时,所得到的测量值与目标的光谱反射率或光谱辐射亮度等物理量之间的差值叫做辐射误差。辐射误差造成了遥感图像的失真,影响遥感图像的判读和解译,因此,必须进行消除或减弱。需要指出的是,导致遥感图像辐射量失真的因素很多,除了由遥感器灵敏度特性引起的畸变之外,还有视场角、太阳角、地形起伏以及大气吸收、散射等的强烈影响。 遥感图像辐射校正主要包括三个方面:(1)传感器的灵敏度特性引起的辐射误差,如光学镜头的非均匀性引起的边缘减光现象、光电变换系统的灵敏度特性引起的辐射畸变等;(2)光照条件差异引起的辐射误差,如太阳高度角的不同引起的辐射畸变校正、地面倾斜、起伏引起的辐射畸变校正等;(3)大气散射和吸收引起的辐射误差改正。 辐射校正的目的主要包括:1、尽可能消除因传感器自身条件、薄雾等大气条件、太阳位置和角度条件及某些不可避免的噪声等引起的传感器的测量值与目标的光谱反射率或光谱辐射亮度等物理量之间的差异;2、尽可能恢复图像的本来面目,为遥感图像的识别、分类、解译等后续工作奠定基础。 辐射校正分为辐射定标和大气校正两部分。 辐射定标是用户需要计算地物的光谱反射率或光谱辐射亮度时,或者需要对不同时间、不同传感器获取的图像进行比较时,都必须将图像的亮度灰度值转换为绝对的辐射亮度,这个过程就是辐射定标。

大气校正是指传感器最终测得的地面目标的总辐射亮度并不是地表真实反射率的反映,其中包含了由大气吸收,尤其是散射作用造成的辐射量误差。大气校正就是消除这些由大气影响所造成的辐射误差,反演地物真实的表面反射率的过程。 辐射校正流程图 1.4.3.2影像辐射校正方法 辐射定标主要分为两种类型:统计型和物理型。统计型是基于陆地表面变量和遥感数据的相关关系,优点在于容易建立并且可以有效地概括从局部区域获取的数据,例如经验线性定标法,内部平场域法等,另一方面,物理模型遵循遥感系统的物理规律,它们也可以建立因果关系。如果初始的模型不好,通过加入新的知识和信息就可以知道应该在哪部分改进模型。但是建立和学习这些物理模型的过程漫长而曲折。模型是对现实的抽象;所以一个逼真的模型可能非常复杂,包含大量的变量。例如6s模型,Mortran等。 用于大气辐射传输校正的模型主要有5S模型、6S模型、LOWTRAN模型、MODTRAN模型、ACORN模型、FLAASH模型和ATCOR模型。 1、ACORN模型 一种基于图像自身的大气校正软件,可以实现图像辐射值到表观地表反射率的转换,其工作波长范围是350-2500nm。在目前的大气校正程序一般都把地表假定为水平朗伯体,这主要是因为我们一般很难获取地表的充足信息以完成地形校正,因此大气校正的结果称为拉伸的地表反射率,又称表观反射率,在地形信息已知的情况下,可以将表观反射率转为地表反射率。

几种典型高分辨率商业遥感卫星系统 1.2.1 IKONOS卫星系统 1.基本情况 IKONOS是空间成像公司(Space Imaging)为满足高解析度和高精度空间信息获取而设计制造,是全球首颗高分辨率商业遥感卫星。IKONOS-1于1999年4月27日发射失败,同年9月24日,IKONOS-2发射成功,紧接着于10月12日成功接收到第一幅影像。 IKONOS卫星由洛克希德—马丁公司(Lockheed Martin)制造,重1600lb,由Athena II 火箭于加利福尼亚州的范登堡空军基地发射成功,卫星设计寿命为7年。它采用太阳同步轨道,轨道倾角98.1o,平均飞行高度681km,轨道周期98.3min,通过赤道的当地时间为上午10:30,在地面上空平均飞行速度为6.79km/s,卫星平台自身高1.8m,直径1.6m。 IKONOS卫星的传感器系统由美国伊斯曼—柯达公司(Eastman Kodak)研制,包括一个1m分辨率的全色传感器和一个4m分辨率的多光谱传感器,其中的全色传感器由13816个CCD单元以线阵列排成,CCD单元的物理尺寸为12μm x 12μm,多光谱传感器分四个波段,每个波段由3454个CCD单元组成。传感器光学系统的等效焦距为10m,视场角(FOV)为0.931o,因此当卫星在681km的高度飞行时,其星下点的地面分辨率在全色波段最高可达0.82m,多光谱可达3.28m,扫描宽度约为11km。传感器可倾斜至26o立体成像,平均地面分辨率1m左右,此时扫描宽度约为13km。IKONOS的多光谱波段与Landsat TM的1—4波段大体相同,并且全部波段都具有11位的动态范围,从而使其影像包含更加丰富的信息。 IKONOS卫星载有高性能的GPS接收机、恒星跟踪仪和激光陀螺。GPS数据经过后处理可提供较精确的星历信息;恒星跟踪仪用以高精度确定卫星的姿态,其采样频率低;激光陀螺则可高频地测量成像期间卫星的姿态变化,短期内有很高的精度。恒星跟踪数据与激光陀螺数据通过卡尔曼滤波能提供成像期间卫星较精确的姿态信息。GPS接收机、恒星跟踪仪和激光陀螺提供的较高精度的轨道星历和姿态信息,保证了在没有地面控制的情况下,IKONOS卫星影像也能达到较高的地理定位精度。 2.成像原理 与Landsat和SPOT-4卫星相比,IKONOS卫星的成像方式更加灵活,其传感器系统采用独特的机械设计,可以十分灵活地以任意方位角成像,偏离正底点的摆动角甚至可达到60o。IKONOS卫星360o的照准能力使其既可侧摆成像以获取异轨立体或缩短重访周期,也可通过沿轨道方向的前后摆动同轨立体成像,具有推扫、横扫成像能力。 IKONOS卫星能获取同轨立体影像。当卫星接近目标时,传感器光学系统先沿着轨道向前倾斜,照准目标区域并采集第一幅影像,接着控制系统操纵传感器向后摆动,大约100s 后再次照准目标区并采集第二幅影像,如图1.1所示。由于IKONOS卫星利用单线阵CCD 传感器,通过光学系统的前后摆动实现同轨立体成像。因此,相应的立体覆盖是不连续的。

IKONOS卫星遥感影像解译数据分辨率是多少? IKONOS卫星简介 IKONOS为美国DigitalGlobe公司的高分辨率遥感卫星,于1999年09月24日发射,其影像分辨率达0.82米,为全球首颗提供1米以下分辨率的商用光学卫星,揭开了高分辨率卫星影像的时代。--广西善图科技。 IKONOS卫星基本参数

IKONOS卫星影像样片 IKONOS卫星影像 IKONOS卫星影像 卫星遥感数据分类: 一、卫星分辨率 1.0.3米:worldview3、worldview4 2.0.4米:worldview3、worldview2、geoeye、kompsat-3A 3.0.5米:worldview3、worldview2、geoeye、worldview1、pleiades、高景一号 4.0.6米:quickbird、锁眼卫星 5.1米:ikonos、高分二号、kompsat、deimos、北京二号 6.1.5米:spot6、spot7、锁眼卫星 7.2.5米:spot5、alos、资源三号、高分一号(4颗)、高分六号、锁眼卫星 8.5米:spot5、rapideye、锁眼卫星、planet卫星4米

9.10米:spot5、spot4、spot3、spot2、spot1、Sentinel-卫星 10.15米:landsat5(tm)、landsat(etm)、landsat8、高分一号16米 二、卫星类型 1.光学卫星:spot2、spot3、spot4、spot5、spot6、spot7、worldview1、worldview2、worldview3、worldview4、quickbird、geoeye、ikonos、pleiades、deimos、spot1、kompsat系例、landsat5(tm)、Sentinel-卫星、landsat(etm)、rapideye、alos、kompsat系例卫星、planet卫星、高分一号、高分二号、高分六号、北京二号、高景一号、资源三号、环境卫星。 2.雷达卫星:terrasar-x、radarsat-2、alos雷达卫星、高分三号卫星、哨兵卫星 3.侦查卫星:美国锁眼卫星全系例(1960-1980) 4.高光谱类卫星:高分五号、环境小卫星、ASTER卫星、EO-1卫星 三、卫星国籍 1.美国:worldview1、worldview2、worldview3、quickbird、geoeye、ikonos、landsat5(tm)、landsat(etm)、锁眼卫星、planet卫星 2.法国:pleiades、spot1、spot2、spot3、spot4、spot5、spot6 3.中国:高分一号、高分二号、高分六号、高景卫星、北京二号、资源三号等 4.德国:terrasar-x、rapideye 5.加拿大:radarsat-2 四、卫星发射年份 1.1960-1980年:锁眼卫星(0.6米分辨率至10米) 2.1980-1990年:landsat5(tm)、spot1 3.1990-2000年:spot2、spot3、spot4、landsat(etm)、ikonos 4.2000-2010年:quickbird、worldview1、worldview2、spot5、rapideye、radarsat-2、alos 5.2010-至今:高分一号、高分二号、高分三、高分四、高分五、高分六号、高分七、spot6、spot7、资源三号、worldview3、worldview4、pleiades、高景卫星、planet卫星

遥感图像分类后处理 一、实验目的与要求 监督分类和决策树分类等分类方法得到的一般是初步结果,难于达到最终的应用目的。 因此,需要对初步的分类结果进行一些处理,才能得到满足需求的分类结果,这些处理过程就通常称为分类后处理。常用分类后处理通常包括:更改分类颜色、分类统计分析、小斑点处理(类后处理)、栅矢转换等操作。 本课程将以几种常见的分类后处理操作为例,学习分类后处理工具。 二、实验内容与方法 1.实验内容 1.小斑块去除 ●Majority和Minority分析 ●聚类处理(Clump) ●过滤处理(Sieve) 2.分类统计 3.分类叠加 4.分类结果转矢量 5.ENVI Classic分类后处理 ●浏览结果 ●局部修改 ●更改类别颜色 6.精度评价 1.实验方法 在ENVI 5.x中,分类后处理的工具主要位于Toolbox/Classification/Post Classification/;

三、实验设备与材料 1.实验设备 装有ENVI 5.1的计算机 2.实验材料 以ENVI自带数据"can_tmr.img"的分类结果"can_tmr_class.dat"为例。数据位于"...\13数据\"。其他数据描述: ?can_tmr.img ——原始数据 ?can_tmr_验证.roi ——精度评价时用到的验证ROI 四、实验步骤 1.小斑块去除 应用监督分类或者非监督分类以及决策树分类,分类结果中不可避免地会产生一些面 积很小的图斑。无论从专题制图的角度,还是从实际应用的角度,都有必要对这些小图斑进行剔除或重新分类,目前常用的方法有Majority/Minority分析、聚类处理(clump)和过滤处理(Sieve)。 1)Majority和Minority分析 Majority/Minority分析采用类似于卷积滤波的方法将较大类别中的虚假像元归到该 类中,定义一个变换核尺寸,主要分析(Majority Analysis)用变换核中占主要地位(像元数最多)的像元类别代替中心像元的类别。如果使用次要分析(Minority Analysis),将用变换核中占次要地位的像元的类别代替中心像元的类别。 下面介绍详细操作流程: (1)打开分类结果——"\12.分类后处理\数据\can_tmr_class.dat"; (2)打开Majority/Minority分析工具,路径为Toolbox /Classification/Post Classification/Majority/Minority Analysis,在弹出对话框中选择"can_tmr_class.dat",点击OK; (3)在Majority/Minority Parameters面板中,点击Select All Items选中所有的类别,其他参数按照默认即可,如下图所示。然后点击Choose按钮设置输出路径,点击OK执行操作。

高分辨率遥感影像分类实验报告 班级:___________________ 姓名:___________________ 学号:___________________ 指导老师:_______________ 地球科学与环境工程学院 二?一四年六月

目录 1 实验方法——面向对象方法 (1) 2 实验内容 (1) 2.1 影像预处理 (1) 2.1.1 影像数据融合 (1) 2.1.2 影像增强处理 (2) 2.2 创建工程 (2) 2.3 分割处理 (3) 2.4 分类 (4) 2.4.1 水体 (4) 2.4.2 陆地 (5) 2.4.3 植被 (6) 2.4.4 裸土 (7) 2.4.5 建筑物 (8) 2.4.6 道路 (9) 2.4.7 阴影 (10) 2.4.8 总体分类图 (12) 3 结语 (13)

1实验方法——面向对象方法 面向对象方法是一个模拟人类大脑认知的过程,将图像分割为不同均质的对 象,充分利用对象所包含的信息,将知识库转换为规则特征,从而提取影像信息。 因为分析的是对象而不是像元,因此我们可以利用对象丰富的语义信息, 结合各 种地学概念,如面积、距离、光谱、尺度、纹理等进行分析。 面向对象的遥感影像分析方法与传统的面向像元的影像分析方法不同。 首先 需要使用一定方法对遥感影像进行分割, 在提取分割单元(图像分割后所得到的 内部属性相对一致或均质程度较高的图像区域) 的各种特征后,在特征空间中进 行对象识别和标识,从而最终完成信息的分类与提取。 2实验内容及详细过程 2.1影像预处理 2.1.1影像数据融合 实验数据为QuickBird 影像,包括4个多光谱波段以及一个全色波段。 QuickBird 影像星下点分辨率:全色为 0.61m ,多光谱为2.44m 。对于面向对象 影像分类 来说,越高的高空间分辨率越好,但在对对象进行分类时,光谱信息同 样重要,因此,可将高分辨率的全色影像和多光谱影像进行数据融合。 使用 ERDAS 进行数据融合: Interprete u spatialenchancemen ^resolution mergeo 图1 全色影像与多光谱影像融合 Ib^pul Fh (*.网| MJitiMewl lf 高分辨率遥感影像分类实验报告 班级: 姓名: 学号: 指导老师: 地球科学与环境工程学院 二〇一四年六月 目录 1实验方法——面向对象方法 (1) 2实验内容 (1) 2.1 影像预处理 (1) 2.1.1影像数据融合 (1) 2.1.2 影像增强处理 (2) 2.2 创建工程 (2) 2.3 分割处理 (3) 2.4 分类 (4) 2.4.1 水体 (4) 2.4.2陆地 (5) 2.4.3 植被 (6) 2.4.4 裸土 (7) 2.4.5 建筑物 (8) 2.4.6 道路 (9) 2.4.7 阴影 (10) 2.4.8 总体分类图 (12) 3 结语 (13) 1实验方法——面向对象方法 面向对象方法是一个模拟人类大脑认知的过程,将图像分割为不同均质的对象,充分利用对象所包含的信息,将知识库转换为规则特征,从而提取影像信息。因为分析的是对象而不是像元,因此我们可以利用对象丰富的语义信息,结合各种地学概念,如面积、距离、光谱、尺度、纹理等进行分析。 面向对象的遥感影像分析方法与传统的面向像元的影像分析方法不同。首先需要使用一定方法对遥感影像进行分割,在提取分割单元(图像分割后所得到的内部属性相对一致或均质程度较高的图像区域)的各种特征后,在特征空间中进行对象识别和标识,从而最终完成信息的分类与提取。 2实验内容及详细过程 2.1 影像预处理 2.1.1影像数据融合 实验数据为QuickBird影像,包括4个多光谱波段以及一个全色波段。QuickBird影像星下点分辨率:全色为0.61m,多光谱为2.44m。对于面向对象影像分类来说,越高的高空间分辨率越好,但在对对象进行分类时,光谱信息同样重要,因此,可将高分辨率的全色影像和多光谱影像进行数据融合。 使用ERDAS进行数据融合:Interpreter→spatialenchancement→resolution merge。 图 1 全色影像与多光谱影像融合高分辨率遥感影像分类实验报告